Amazon SageMaker Autopilot hjelper deg med å fullføre en ende-til-ende maskinlæring (ML) arbeidsflyt ved å automatisere trinnene for funksjonsutvikling, opplæring, innstilling og distribusjon av en ML-modell for slutninger. Du gir SageMaker Autopilot et tabelldatasett og et målattributt å forutsi. Deretter utforsker SageMaker Autopilot automatisk dataene dine, trener, stiller inn, rangerer og finner den beste modellen. Til slutt kan du distribuere denne modellen til produksjon for slutning med ett klikk.

Hva er nytt?

Den nylig lanserte funksjonen, SageMaker Autopilot modellkvalitetsrapporter, rapporterer nå modellens beregninger for å gi bedre innsyn i modellens ytelse for regresjons- og klassifiseringsproblemer. Du kan bruke disse beregningene til å samle inn mer innsikt om den beste modellen i modellpoengoversikten.

Disse beregningene og rapportene som er tilgjengelige i en ny "Ytelse"-fane under "Modelldetaljer" for den beste modellen inkluderer forvirringsmatriser, et område under mottakeroperasjonskarakteristikken (AUC-ROC) og et område under presisjonsgjenkallingskurven (AUC-PR). Disse beregningene hjelper deg å forstå de falske positive/falske negativene (FP-er/FN-er), avveininger mellom sanne positive (TP-er) og falske positive (FP-er), samt avveiningene mellom presisjon og tilbakekalling for å vurdere de beste modellens ytelsesegenskaper.

Kjører SageMaker Autopilot-eksperimentet

Datasettet

Vi bruker UCIs bankmarkedsføringsdatasett for å demonstrere SageMaker Autopilot Model Quality Reports. Disse dataene inneholder kundeattributter, som alder, jobbtype, sivilstatus og andre som vi vil bruke til å forutsi om kunden vil åpne en konto i banken. Datasettet refererer til denne kontoen som et termininnskudd. Dette gjør vårt tilfelle til et binært klassifiseringsproblem - prediksjonen vil enten være "ja" eller "nei". SageMaker Autopilot vil generere flere modeller på våre vegne for best å forutsi potensielle kunder. Deretter vil vi undersøke modellkvalitetsrapporten for SageMaker autopiloter beste modell.

Forutsetninger

For å starte et SageMaker Autopilot-eksperiment må du først plassere dataene dine i en Amazon enkel lagringstjeneste (Amazon S3) bøtte. Angi bøtte og prefiks du vil bruke til trening. Sørg for at bøtten er i samme region som SageMaker Autopilot-eksperimentet. Du må også sørge for at rollen Autopilot Identity and Access Management (IAM) har tillatelser til å få tilgang til dataene i Amazon S3.

Opprette eksperimentet

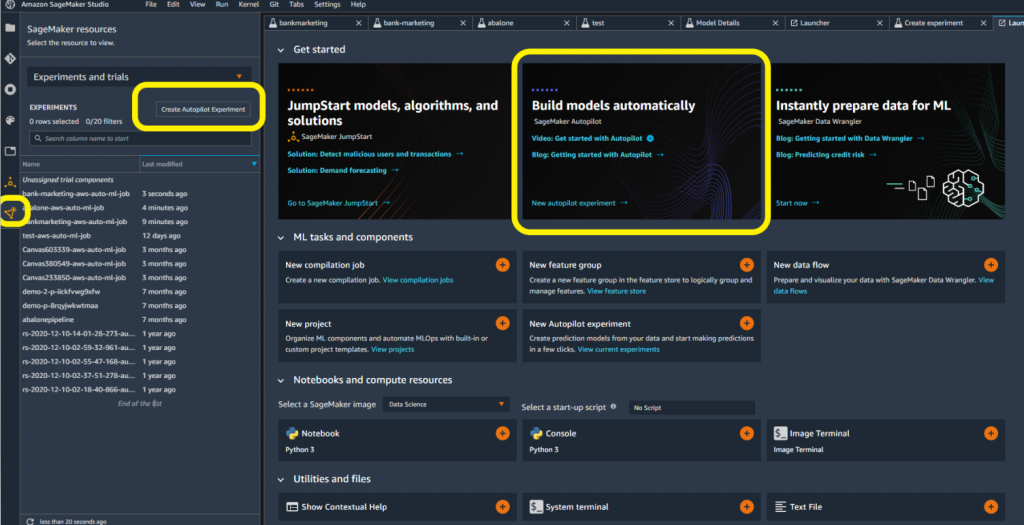

Du har flere alternativer for å lage et SageMaker Autopilot-eksperiment i SageMaker Studio. Ved å åpne en ny launcher kan du kanskje få tilgang til SageMaker Autopilot direkte. Hvis ikke, kan du velge SageMaker-ressursikonet på venstre side. Deretter kan du velge Eksperimenter og forsøk fra rullegardinmenyen.

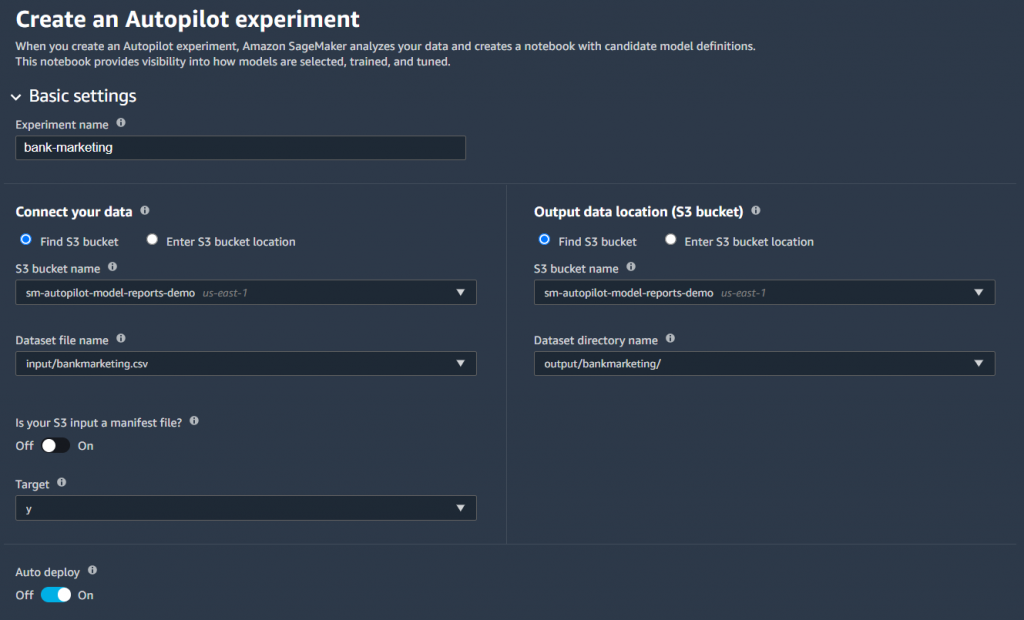

- Gi eksperimentet et navn.

- Koble til datakilden din ved å velge Amazon S3-bøtte og filnavn.

- Velg utdataplasseringen i Amazon S3.

- Velg målkolonnen for datasettet ditt. I dette tilfellet målretter vi «y»-kolonnen for å indikere ja/nei.

- Eventuelt, oppgi et endepunktnavn hvis du ønsker at SageMaker Autopilot automatisk skal distribuere et modellendepunkt.

- La alle de andre avanserte innstillingene være standard, og velg Lag eksperiment.

Når eksperimentet er fullført, kan du se resultatene i SageMaker Studio. SageMaker Autopilot vil presentere den beste modellen blant de forskjellige modellene den trener. Du kan se detaljer og resultater for forskjellige forsøk, men vi bruker den beste modellen for å demonstrere bruken av modellkvalitetsrapporter.

- Velg modellen, og høyreklikk for å Åpne i modelldetaljer.

- I modelldetaljene velger du Ytelse fanen. Dette viser modellberegninger gjennom visualiseringer og plott.

- Under Ytelse, plukke ut Last ned ytelsesrapporter som PDF.

Tolking av SageMaker Autopilot Model Quality Report

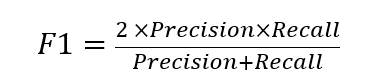

Modellkvalitetsrapporten oppsummerer SageMaker Autopilot-jobben og modelldetaljer. Vi vil fokusere på rapportens PDF-format, men du kan også få tilgang til resultatene som JSON. Fordi SageMaker Autopilot bestemte at datasettet vårt var et binært klassifiseringsproblem, hadde SageMaker Autopilot som mål å maksimere F1 kvalitetsmåling for å finne den beste modellen. SageMaker Autopilot velger dette som standard. Imidlertid er det fleksibilitet til å velge andre objektive beregninger, som nøyaktighet og AUC. Vår modells F1-poengsum er 0.61. For å tolke en F1-poengsum, hjelper det først å forstå en forvirringsmatrise, som er forklart av modellkvalitetsrapporten i den utsendte PDF-filen.

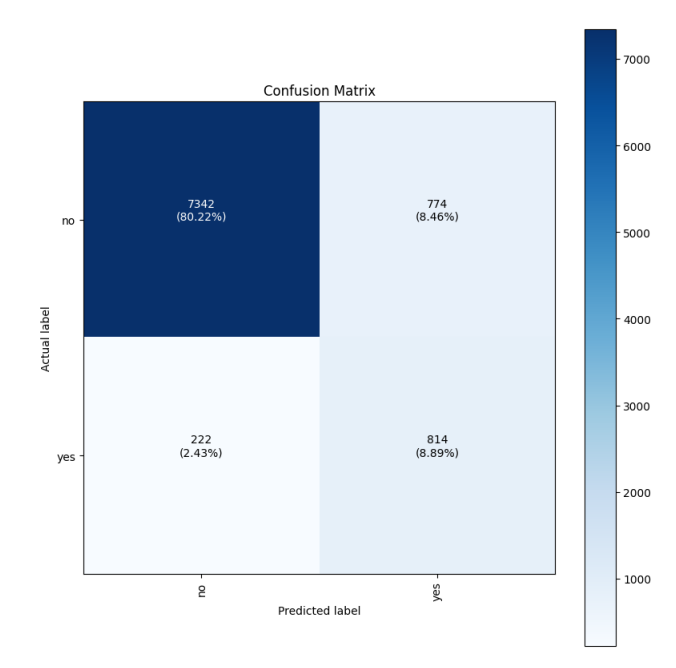

Forvirringsmatrise

En forvirringsmatrise hjelper til med å visualisere modellens ytelse ved å sammenligne forskjellige klasser og etiketter. SageMaker Autopilot-eksperimentet opprettet en forvirringsmatrise som viser de faktiske etikettene som rader, og de predikerte etikettene som kolonner i modellkvalitetsrapporten. Den øverste venstre boksen viser kunder som ikke åpnet en konto i banken som ble korrekt spådd som "nei" av modellen. Disse er ekte negativer (TN). Den nederste høyre boksen viser kunder som åpnet en konto i banken som ble korrekt spådd som "ja" av modellen. Disse er ekte positive (TP).

Nedre venstre hjørne viser antallet falske negativer (FN). Modellen spådde at kunden ikke ville åpne en konto, men det gjorde kunden. Øvre høyre hjørne viser antallet falske positive (FP). Modellen spådde at kunden ville åpne en konto, men det gjorde kunden ikke faktisk gjør det.

Modellkvalitetsrapportberegninger

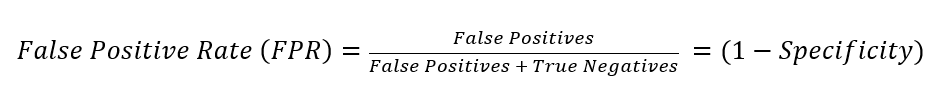

Modellkvalitetsrapporten forklarer hvordan du beregner falsk positiv rate (FPR) og sann positiv rate (TPR).

Tilbakekalling eller falsk positiv rate (FPR) måler andelen av faktiske negative som ble feilaktig spådd som åpning av en konto (positive). Området er 0 til 1, og en mindre verdi indikerer en bedre prediktiv nøyaktighet.

Merk at FPR også er uttrykt som 1-spesifisitet, der spesifisitet eller True Negative Rate (TNR) er andelen av TN-ene som er korrekt identifisert som ikke åpner en konto (negative).

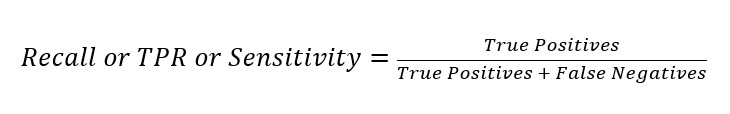

Tilbakekalling/Sensitivitet/True Positive Rate (TPR) måler brøkdelen av faktiske positive som ble spådd som åpning av en konto. Området er også 0 til 1, og en større verdi indikerer en bedre prediktiv nøyaktighet. Dette er også kjent som Recall/Sensitivity. Dette målet uttrykker muligheten til å finne alle de relevante forekomstene i et datasett.

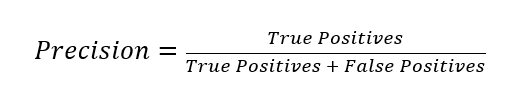

Precision måler andelen av faktiske positive som ble spådd som positive av alle de som ble spådd som positive. Området er 0 til 1, og en større verdi indikerer bedre nøyaktighet. Presisjon uttrykker andelen av datapunktene som vår modell sier var relevante og som faktisk var relevante. Presisjon er et godt mål å vurdere, spesielt når kostnadene ved FP er høye – for eksempel med e-postoppdaging.

Vår modell viser en presisjon på 0.53 og en tilbakekalling på 0.72.

F1-poengsum demonstrerer målberegningen vår, som er det harmoniske gjennomsnittet for presisjon og gjenkalling. Fordi datasettet vårt er ubalansert til fordel for mange "nei"-spådommer, tar F1 både FP og FN i betraktning for å gi samme vekt til presisjon og tilbakekalling.

Rapporten forklarer hvordan disse beregningene skal tolkes. Dette kan hjelpe hvis du ikke er kjent med disse vilkårene. I vårt eksempel er presisjon og tilbakekalling viktige beregninger for et binært klassifiseringsproblem, siden de brukes til å beregne F1-poengsummen. Rapporten forklarer at en F1-score kan variere mellom 0 og 1. Den best mulige ytelsen vil score 1, mens 0 vil indikere den dårligste. Husk at modellens F1-poengsum er 0.61.

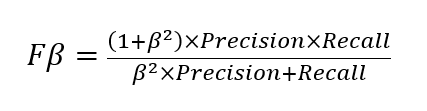

Fβ-poengsum er det vektede harmoniske gjennomsnittet for presisjon og gjenkalling. Dessuten er F1-poengsummen den samme som Fβ med β=1. Rapporten gir Fβ-poengsummen til klassifikatoren, der β tar 0.5, 1 og 2.

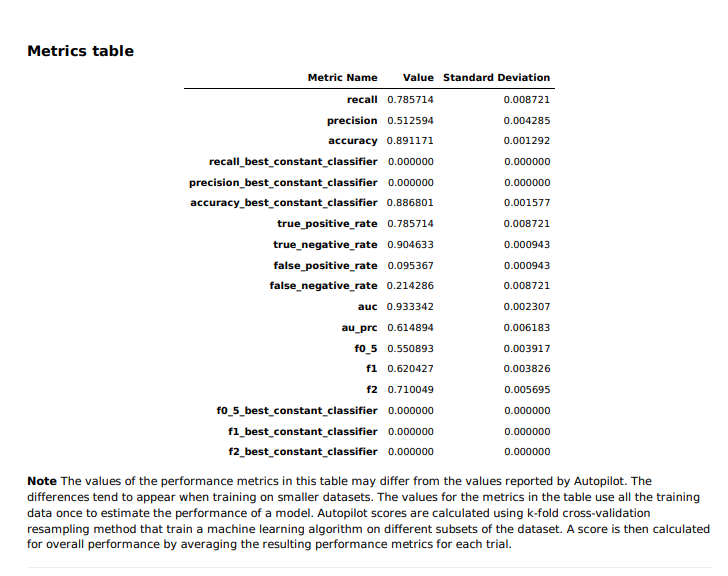

Metrikktabell

Avhengig av problemet kan du finne ut at SageMaker Autopilot maksimerer en annen beregning, for eksempel nøyaktighet, for et klassifiseringsproblem i flere klasser. Uansett problemtype produserer modellkvalitetsrapporter en tabell som oppsummerer modellens beregninger som er tilgjengelige både innebygd og i PDF-rapporten. Du kan lære mer om den metriske tabellen i dokumentasjon.

Den beste konstantklassifisereren – en klassifiserer som fungerer som en enkel grunnlinje for å sammenligne med andre mer komplekse klassifiserere – forutsier alltid en konstant majoritetsetikett som leveres av brukeren. I vårt tilfelle vil en "konstant" modell forutsi "nei", siden det er den hyppigste klassen og anses å være en negativ etikett. Beregningene for de trente klassifiseringsmodellene (som f1, f2 eller tilbakekalling) kan sammenlignes med de for konstantklassifisereren, dvs. grunnlinjen. Dette sikrer at den trente modellen presterer bedre enn den konstante klassifisereren. Fβ-score (f0_5, f1 og f2, hvor β tar verdiene på henholdsvis 0.5, 1 og 2) er det vektede harmoniske gjennomsnittet av presisjon og gjenkalling. Dette når sin optimale verdi ved 1 og sin dårligste verdi ved 0.

I vårt tilfelle forutsier den beste konstantklassifisereren alltid "nei". Derfor er nøyaktigheten høy på 0.89, men tilbakekallings-, presisjons- og Fβ-skårene er 0. Hvis datasettet er perfekt balansert der det ikke er en enkelt majoritets- eller minoritetsklasse, ville vi ha sett mye mer interessante muligheter for presisjonen, tilbakekalling, og Fβ-skåre for konstantklassifikatoren.

Videre kan du se disse resultatene i JSON-format som vist i følgende eksempel. Du kan få tilgang til både PDF- og JSON-filene gjennom brukergrensesnittet, så vel som Amazon SageMaker Python SDK ved å bruke S3OutputPath-elementet i OutputDataConfig struktur i CreateAutoMLJob/Beskriv AutoMLJob API-svar.

{ "version" : 0.0, "dataset" : { "item_count" : 9152, "evaluation_time" : "2022-03-16T20:49:18.661Z" }, "binary_classification_metrics" : { "confusion_matrix" : { "no" : { "no" : 7468, "yes" : 648 }, "yes" : { "no" : 295, "yes" : 741 } }, "recall" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "precision" : { "value" : 0.5334773218142549, "standard_deviation" : 0.007335840278445563 }, "accuracy" : { "value" : 0.8969624125874126, "standard_deviation" : 0.0011703516093899595 }, "recall_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "precision_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "accuracy_best_constant_classifier" : { "value" : 0.8868006993006993, "standard_deviation" : 0.0016707401772078998 }, "true_positive_rate" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "true_negative_rate" : { "value" : 0.9201577131591917, "standard_deviation" : 0.0010233756436643213 }, "false_positive_rate" : { "value" : 0.07984228684080828, "standard_deviation" : 0.0010233756436643403 }, "false_negative_rate" : { "value" : 0.2847490347490348, "standard_deviation" : 0.004399966000813983 },

………………….

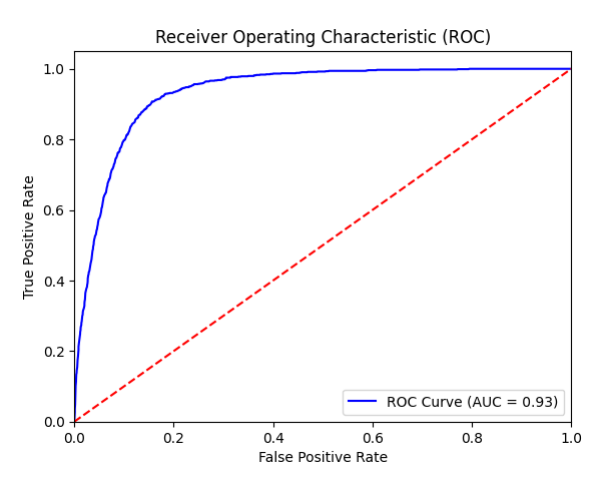

ROC og AUC

Avhengig av problemtypen kan du ha ulike terskler for hva som er akseptabelt som en FPR. For eksempel, hvis du prøver å forutsi om en kunde vil åpne en konto, kan det være mer akseptabelt for bedriften å ha en høyere FP-rate. Det kan være mer risikabelt å gå glipp av å utvide tilbud til kunder som ble feil spådd «nei», i motsetning til å tilby kunder som feilaktig ble spådd «ja». Å endre disse tersklene for å produsere forskjellige FPR-er krever at du oppretter nye forvirringsmatriser.

Klassifiseringsalgoritmer returnerer kontinuerlige verdier kjent som prediksjonssannsynligheter. Disse sannsynlighetene må transformeres til en binær verdi (for binær klassifisering). I binære klassifiseringsproblemer er en terskel (eller beslutningsterskel) en verdi som dikotomiserer sannsynlighetene til en enkel binær beslutning. For normaliserte projiserte sannsynligheter i området 0 til 1, er terskelen satt til 0.5 som standard.

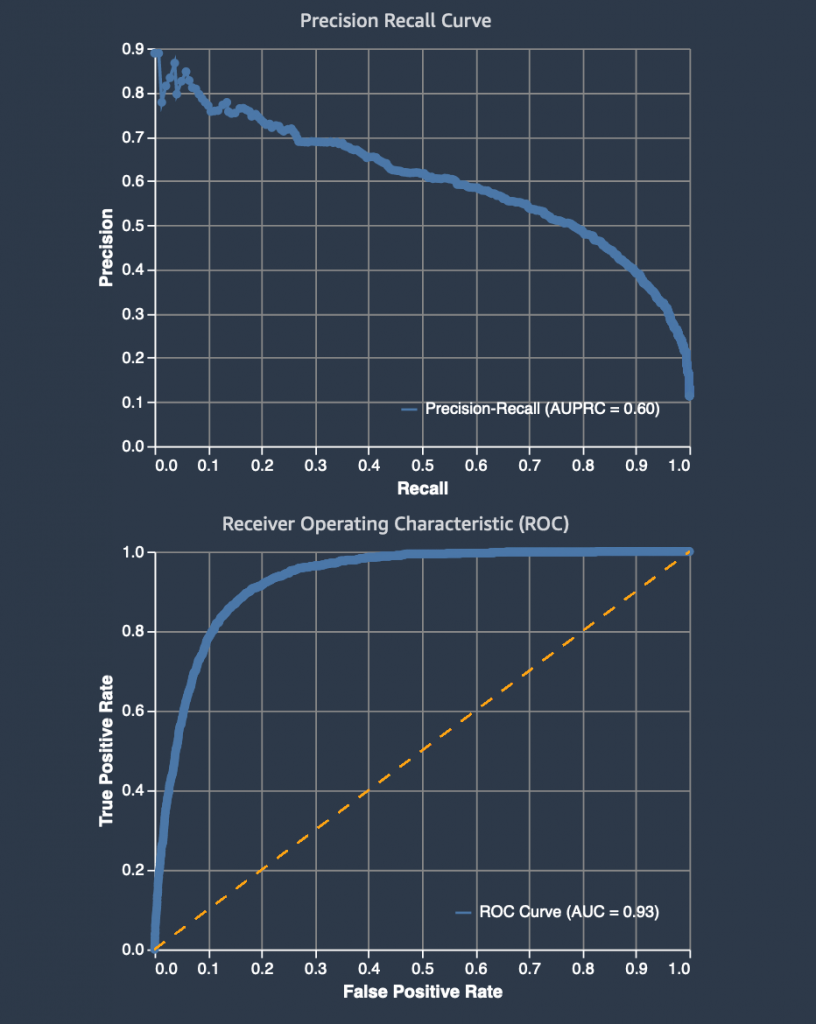

For binære klassifiseringsmodeller er en nyttig evalueringsmetrikk området under Receiver Operating Characteristic (ROC)-kurven. Modellkvalitetsrapporten inkluderer en ROC-graf med TP-raten som y-aksen og FPR som x-aksen. Området under mottakerens driftskarakteristikk (AUC-ROC) representerer avveiningen mellom TPR-ene og FPR-ene.

Du oppretter en ROC-kurve ved å ta en binær klassifiseringsprediktor, som bruker en terskelverdi, og tilordne etiketter med prediksjonssannsynligheter. Når du varierer terskelen for en modell, dekker du fra de to ytterpunktene. Når både TPR og FPR er 0, betyr det at alt er merket "nei", og når både TPR og FPR er 1, betyr det at alt er merket med "ja".

En tilfeldig prediktor som merker "Ja" halvparten av tiden og "Nei" den andre halvparten av tiden, vil ha en ROC som er en rett diagonal linje (rød stiplet linje). Denne linjen kutter enhetsfirkanten i to like store trekanter. Derfor er arealet under kurven 0.5. En AUC-ROC verdi på 0.5 ville bety at prediktoren din ikke var bedre til å skille mellom de to klassene enn å tilfeldig gjette om en kunde ville åpne en konto eller ikke. Jo nærmere AUC-ROC-verdien er 1.0, desto bedre er spådommene. En verdi under 0.5 indikerer at vi faktisk kunne få modellen vår til å produsere bedre spådommer ved å reversere svaret den gir oss. For vår beste modell er AUC 0.93.

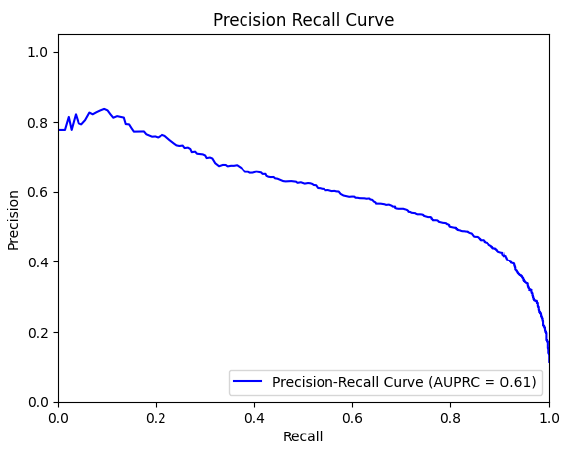

Presisjonsgjenkallingskurve

Modellkvalitetsrapporten opprettet også en presisjonsgjenkallingskurve (PR) for å plotte presisjonen (y-aksen) og tilbakekallingen (x-aksen) for forskjellige terskler – omtrent som ROC-kurven. PR-kurver, ofte brukt i informasjonsinnhenting, er et alternativ til ROC-kurver for klassifiseringsproblemer med stor skjevhet i klassefordelingen.

For disse klasseubalanserte datasettene blir PR-kurver spesielt nyttige når minoritetspositive klassen er mer interessant enn majoritetsnegative klassen. Husk at vår modell viser en presisjon på 0.53 og en tilbakekalling på 0.72. Husk dessuten at den beste konstantklassifisereren ikke kan skille mellom "ja" og "nei". Det ville forutsi en tilfeldig klasse eller en konstant klasse hver gang.

Kurven for et balansert datasett mellom "ja" og "nei" vil være en horisontal linje ved 0.5, og vil dermed ha et område under PR-kurven (AUPRC) som 0.5. For å lage PRC plotter vi ulike modeller på kurven ved varierende terskler, på samme måte som ROC-kurven. For våre data er AUPRC 0.61.

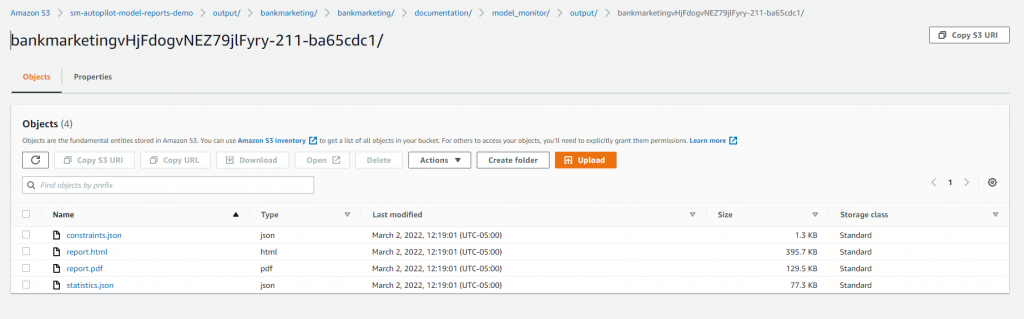

Utdata for modellkvalitetsrapport

Du kan finne modellkvalitetsrapporten i Amazon S3-bøtten som du spesifiserte da du definerte utdatabanen før du kjørte SageMaker AutoPilot-eksperimentet. Du finner rapportene under documentation/model_monitor/output/<autopilot model name>/ prefix lagret som PDF.

konklusjonen

SageMaker Autopilot Model Quality Reports gjør det enkelt for deg å raskt se og dele resultatene av et SageMaker Autopilot-eksperiment. Du kan enkelt fullføre modelltrening og tuning ved å bruke SageMaker Autopilot, og deretter referere til de genererte rapportene for å tolke resultatene. Enten du ender opp med å bruke SageMaker Autopilots beste modell, eller en annen kandidat, kan disse resultatene være et nyttig utgangspunkt for å evaluere en foreløpig modelltrenings- og tuningjobb. SageMaker Autopilot Model Quality Reports bidrar til å redusere tiden som trengs for å skrive kode og produsere bilder for ytelsesevaluering og sammenligning.

Du kan enkelt inkorporere autoML i forretningssakene dine i dag uten å måtte bygge et datavitenskapsteam. SageMaker dokumentasjon gir en rekke eksempler for å hjelpe deg i gang.

Om forfatterne

Peter Chung er en løsningsarkitekt for AWS, og brenner for å hjelpe kunder med å avdekke innsikt fra dataene deres. Han har bygget løsninger for å hjelpe organisasjoner med å ta datadrevne beslutninger i både offentlig og privat sektor. Han innehar alle AWS-sertifiseringer samt to GCP-sertifiseringer. Han liker kaffe, matlaging, å være aktiv og tilbringe tid med familien.

Peter Chung er en løsningsarkitekt for AWS, og brenner for å hjelpe kunder med å avdekke innsikt fra dataene deres. Han har bygget løsninger for å hjelpe organisasjoner med å ta datadrevne beslutninger i både offentlig og privat sektor. Han innehar alle AWS-sertifiseringer samt to GCP-sertifiseringer. Han liker kaffe, matlaging, å være aktiv og tilbringe tid med familien.

Arunprasath Shankar er en kunstig intelligens og maskinlæring (AI / ML) spesialistløsningsarkitekt med AWS, som hjelper globale kunder å skalere sine AI-løsninger effektivt og effektivt i skyen. På fritiden liker Arun å se sci-fi-filmer og lytte til klassisk musikk.

Arunprasath Shankar er en kunstig intelligens og maskinlæring (AI / ML) spesialistløsningsarkitekt med AWS, som hjelper globale kunder å skalere sine AI-løsninger effektivt og effektivt i skyen. På fritiden liker Arun å se sci-fi-filmer og lytte til klassisk musikk.

Ali Takbiri er en AI/ML-spesialist Solutions Architect, og hjelper kunder ved å bruke Machine Learning til å løse forretningsutfordringene deres på AWS Cloud.

Ali Takbiri er en AI/ML-spesialist Solutions Architect, og hjelper kunder ved å bruke Machine Learning til å løse forretningsutfordringene deres på AWS Cloud.

Pradeep Reddy er senior produktsjef i SageMaker Low/No Code ML-teamet, som inkluderer SageMaker Autopilot, SageMaker Automatic Model Tuner. Utenom jobben liker Pradeep å lese, løpe og nørde med datamaskiner i palmestørrelse som raspberry pi og annen hjemmeautomatiseringsteknologi.

Pradeep Reddy er senior produktsjef i SageMaker Low/No Code ML-teamet, som inkluderer SageMaker Autopilot, SageMaker Automatic Model Tuner. Utenom jobben liker Pradeep å lese, løpe og nørde med datamaskiner i palmestørrelse som raspberry pi og annen hjemmeautomatiseringsteknologi.

- Myntsmart. Europas beste Bitcoin og Crypto Exchange.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. FRI TILGANG.

- CryptoHawk. Altcoin Radar. Gratis prøveperiode.

- Kilde: https://aws.amazon.com/blogs/machine-learning/automatically-generate-model-evaluation-metrics-using-sagemaker-autopilot-model-quality-reports/

- "

- 100

- 7

- Om oss

- adgang

- Logg inn

- aktiv

- avansert

- AI

- algoritmer

- Alle

- Amazon

- blant

- En annen

- api

- AREA

- kunstig

- kunstig intelligens

- Kunstig intelligens og maskinlæring

- attributter

- Automatisering

- tilgjengelig

- AWS

- Bank

- Baseline

- bli

- BEST

- grensen

- Eske

- bygge

- Bygning

- virksomhet

- saker

- utfordringer

- Velg

- klasse

- klasser

- klassifisering

- nærmere

- Cloud

- kode

- Kaffe

- Kolonne

- sammenlignet

- komplekse

- datamaskiner

- forvirring

- inneholder

- Kostnader

- kunne

- opprettet

- Opprette

- skjøger

- Kunder

- dato

- datavitenskap

- datasett

- demonstrere

- utplassere

- utplasserings

- Gjenkjenning

- gJORDE

- forskjellig

- direkte

- distribusjon

- lett

- emalje

- Endpoint

- Ingeniørarbeid

- spesielt

- alt

- eksempel

- eksperiment

- familie

- Trekk

- Endelig

- funn

- Først

- fleksibilitet

- Fokus

- etter

- format

- generere

- Global

- god

- å ha

- hjelpe

- nyttig

- hjelper

- Høy

- høyere

- holder

- Hjemprodukt

- Hjemmeautomatisering

- Hvordan

- Hvordan

- HTTPS

- ICON

- Identitet

- viktig

- inkludere

- informasjon

- innsikt

- Intelligens

- IT

- Jobb

- kjent

- etiketter

- stor

- større

- LÆRE

- læring

- Leverage

- linje

- Lytting

- plassering

- maskin

- maskinlæring

- Flertall

- GJØR AT

- ledelse

- leder

- Marketing

- Matrix

- måle

- Metrics

- minoritet

- ML

- modell

- modeller

- mer

- mest

- Filmer

- musikk

- Antall

- mange

- tilby

- Tilbud

- åpen

- åpning

- drift

- alternativer

- organisasjoner

- Annen

- lidenskapelig

- ytelse

- Point

- positiv

- muligheter

- mulig

- potensiell

- forutsi

- prediksjon

- Spådommer

- presentere

- privat

- Problem

- problemer

- produsere

- Produkt

- Produksjon

- gi

- gir

- offentlig

- kvalitet

- raskt

- område

- Lesning

- redusere

- relevant

- rapporterer

- Rapporter

- representerer

- Ressurser

- svar

- Resultater

- rennende

- Skala

- Vitenskap

- sektorer

- sett

- Del

- Enkelt

- So

- Solutions

- LØSE

- spam

- utgifter

- kvadrat

- startet

- status

- lagring

- studio

- Target

- lag

- tech

- Gjennom

- tid

- i dag

- TPR

- Kurs

- Togene

- ui

- avdekke

- forstå

- us

- bruke

- verdi

- ulike

- Se

- synlighet

- om

- HVEM

- uten

- Arbeid

- ville