Vil du trekke ut data fra trykte eller håndskrevne skjemaer? Sjekk ut Nanonetter™ skjemadatauttrekker gratis og automatiser eksporten av informasjon fra alle former!

Skjemaer er overalt; de er definert som dokumenter opprettet for å samle inn informasjon ved å be deltakerne om å fylle ut nødvendig informasjon i et spesifikt format. De er nyttige på grunn av deres evne til å samle mye data på kort tid. Imidlertid har ikke alle skjemaer samme kapasitet til å samle inn data og krever ofte manuelt arbeid senere. Derfor er vi avhengige av verktøy og algoritmer for intelligent automatisering av prosessen med utvinning av skjemadata. Dette blogginnlegget vil dykke dypt inn i ulike scenarier og teknikker for å trekke ut data fra skjemaer ved hjelp av OCR og Deep Learning.

- Hva er Form Data Extraction?

- Hva gjør problemet utfordrende?

- Dybden av skjemautvinningsproblemet

- Hvordan har løsningene for utvinning av skjemadata utviklet seg?

- Skjemadatautvinning ved hjelp av OCR-er

- Løse skjemadatautvinning ved hjelp av dyp læring

- Gå inn i Nanonets

Hva er Form Data Extraction?

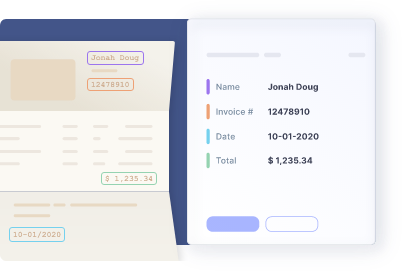

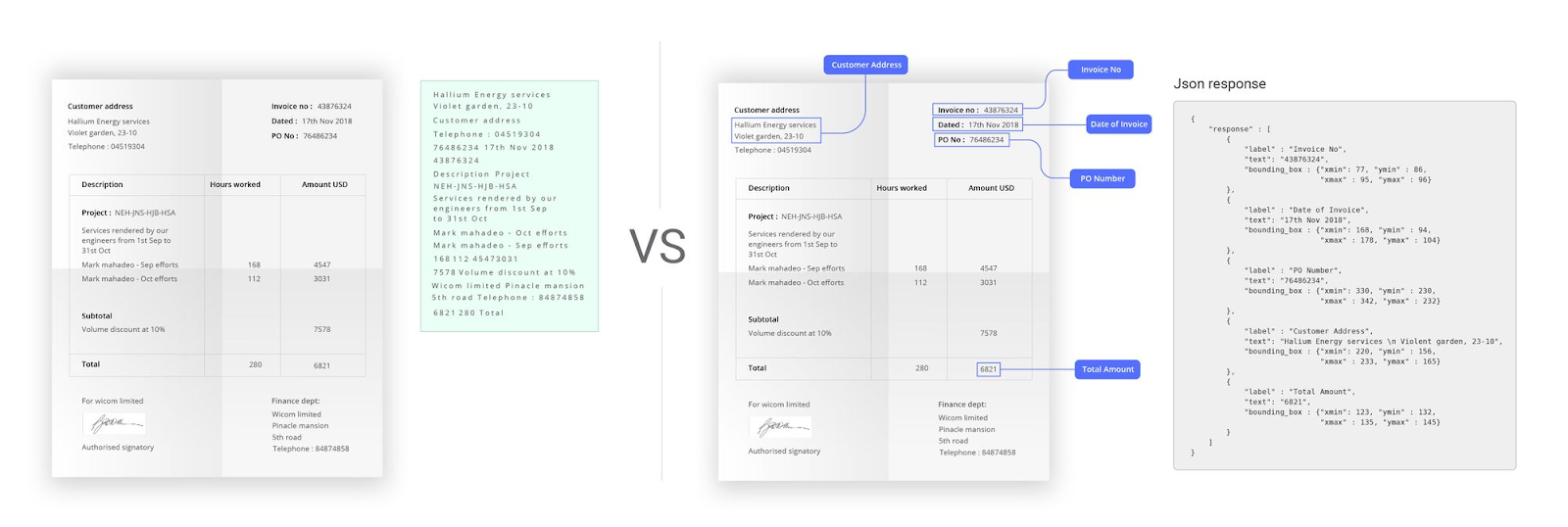

Skjemadatautvinning er prosessen med å trekke ut data fra skjemaer – både online og offline. Disse dataene kan finnes i alle formater, vanligvis inneholdende et skjema med relevant informasjon. Det er imidlertid ikke alltid en lett oppgave å trekke ut disse dataene fordi mange layouter og design ikke tillater at tekst velges enkelt. Det er ingen naturlig måte å kopiere data fra dem på. Derfor er vi avhengige av automatiserte teknikker for å hjelpe med å trekke ut data fra skjemaer som er mer effektive og mindre utsatt for feil.

For eksempel er mange brukere i dag avhengige av PDF-baserte skjemaer for å samle inn kontaktinformasjon. Dette er en svært effektiv måte å samle informasjon på fordi det ikke krever at avsender og mottaker gir innspill. Men å trekke ut disse dataene fra et PDF-skjema kan være utfordrende og dyrt.

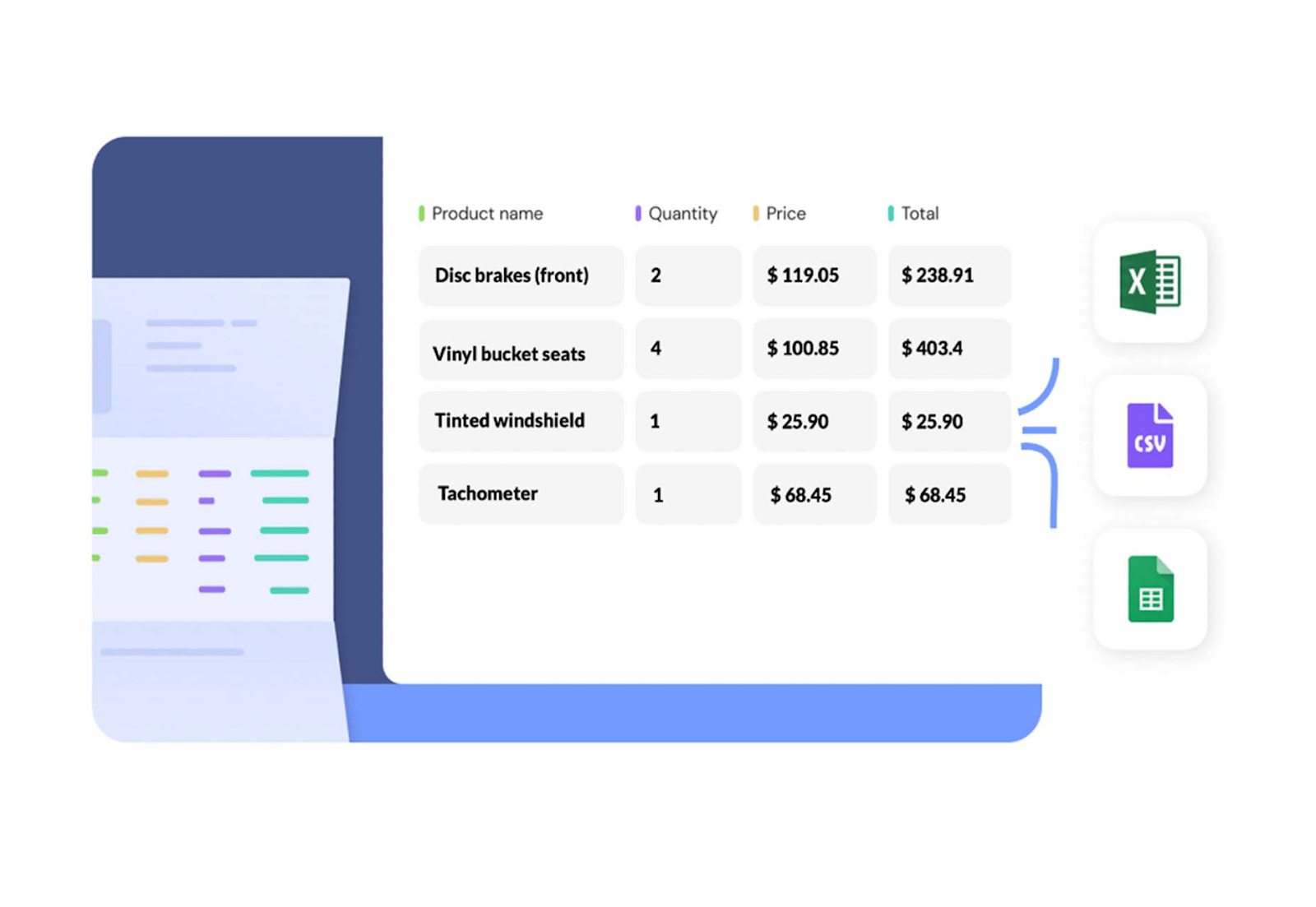

Her kan utvinning av skjemadata hjelpe til med å trekke ut data fra et PDF-skjema, for eksempel navn, e-postadresse, telefonnummer osv. Det kan importeres til et annet program som Excel, Sheets eller et hvilket som helst annet strukturert format. Måten det fungerer på er at utvinningsverktøyene leser over PDF-filen, trekker automatisk ut det den trenger og organiserer den i et lettlest format. Disse dataene kan eksporteres til andre formater som Excel, CSV, JSON og andre godt strukturerte dataformater. I neste avsnitt, la oss se på noen av de hyppige utfordringene når vi bygger algoritmer for utvinning av skjemadata.

Vil du trekke ut data fra trykte eller håndskrevne skjemaer? Sjekk ut Nanonetter™ skjemadatauttrekk gratis og automatiser eksporten av informasjon fra alle skjemaer!

Hva gjør utvinning av skjemadata utfordrende?

Datautvinning er et spennende problem av en rekke årsaker. For det første er det et bildegjenkjenningsproblem, men det må også vurdere teksten som kan være tilstede i bildet og utformingen av skjemaet, noe som gjør byggingen av en algoritme mer kompleks. Denne delen diskuterer noen av de vanlige utfordringene folk møter når de bygger algoritmer for utvinning av skjemadata.

- Mangel på data: Dataekstraksjonsalgoritmer bygges vanligvis ved hjelp av kraftige dyplærings- og datasynsbaserte algoritmer. Disse er vanligvis avhengige av enorme mengder data for å oppnå topp ytelse. Å finne et konsistent og pålitelig datasett og behandle dem er derfor avgjørende for enhver form for datautvinningsverktøy eller programvare. For eksempel, si at vi har skjemaer med flere maler, så bør disse algoritmene kunne forstå et bredt spekter av skjemaer; derfor å trene dem på et robust datasett ville ha en mer nøyaktig ytelse.

- Håndtere skrifter, språk og oppsett: Det er svimlende mengder forskjellige skrifttyper, design og maler tilgjengelig for ulike typer skjemadata. De kan falle inn i flere helt forskjellige klassifikasjoner, noe som gjør det utfordrende å sikre nøyaktig gjenkjennelse når det er en enorm mengde forskjellige karaktertyper å ta hensyn til. Derfor er det viktig å begrense skriftsamlingen til et bestemt språk og type fordi det vil skape mange prosesser som flyter jevnt når du har behandlet disse dokumentene på riktig måte. I flerspråklige tilfeller må sjonglering mellom tegn fra flere språk være forberedt på og også ta seg av kompleks typografi.

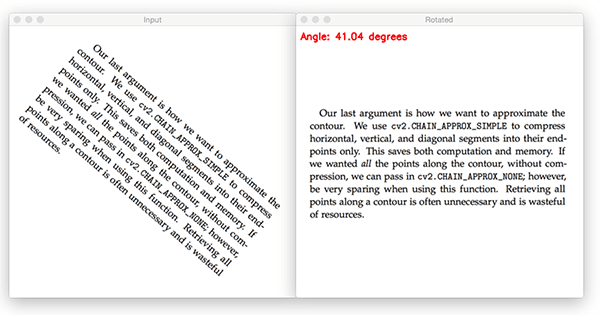

- Orientering og skjevhet (rotasjon): Under datakurering skanner vi ofte bilder for å trene algoritmer for innsamling av inndata. Hvis du noen gang har brukt en skanner eller digitalkamera, har du kanskje lagt merke til at vinkelen du tar bilder av dokumenter i noen ganger kan føre til at de ser skjeve ut. Dette er kjent som skjevhet som refererer til graden av vinkel. Denne skjevheten kan redusere nøyaktigheten til modellen. Heldigvis kan ulike teknikker brukes til å fikse dette problemet ved å endre hvordan programvaren vår oppdager funksjoner i bestemte områder av bildet. Et eksempel på en slik teknikk er Projection Profile-metoder eller Fourier Transformation-metoder, som gir mye renere resultater i form, dimensjon og teksturgjenkjenning! Selv om orientering og skjevheter kan være enkle feil, kan disse påvirke nøyaktigheten til modellen i et stort antall.

- Data Security: Dersom du henter ut data fra ulike kilder for datainnsamling, er det viktig å være klar over hvilke sikkerhetstiltak som er på plass. Ellers risikerer du å kompromittere informasjonen som overføres. Dette kan føre til situasjoner der personopplysninger brytes eller informasjonen som sendes til et API ikke er sikker. Derfor, mens man jobber med ETL-skript og online APIer for datautvinning, må man også være oppmerksom på datasikkerhetsproblemer.

- Tabellutvinning: Noen ganger ser vi skjemadata inne i tabeller; Det kan være utfordrende å bygge en robust algoritme som kan håndtere både formutvinning og bordutvinning. Den vanlige tilnærmingen er å bygge disse algoritmene uavhengig og bruke dem på dataene, men dette vil føre til bruk av mer regnekraft som øker kostnadene. Derfor bør en ideell skjemautvinning kunne trekke ut både skjemadata så vel som data fra et gitt dokument.

- Etterbehandling / eksport av utdata: Utdataene fra enhver datautvinning er ikke rett. Derfor er utviklere avhengige av etterbehandlingsteknikker for å filtrere resultatene til et mer strukturert format. Etter å ha behandlet dataene, eksporteres de til et mer strukturert format som CSV, Excel eller en database. Organisasjoner er avhengige av tredjepartsintegrasjoner eller utvikler APIer for å automatisere denne prosessen, som igjen er tidkrevende. Derfor bør ideelle datautvinningsalgoritmer være fleksible og enkle å kommunisere med eksterne datakilder.

Vil du trekke ut data fra trykte eller håndskrevne skjemaer? Sjekk ut Nanonetter™ skjemadatauttrekk gratis og automatiser eksporten av informasjon fra alle skjemaer!

Forstå dybden av skjemautvinningen med forskjellige scenarier

Så langt har vi diskutert det grunnleggende og utfordringene ved utvinning av skjemadata. I denne delen vil vi dykke dypt inn i forskjellige scenarier og forstå dybden av utvinning av skjemadata. Vi vil også se på hvordan vi kan automatisere utvinningsprosessen for disse spesifikke scenariene.

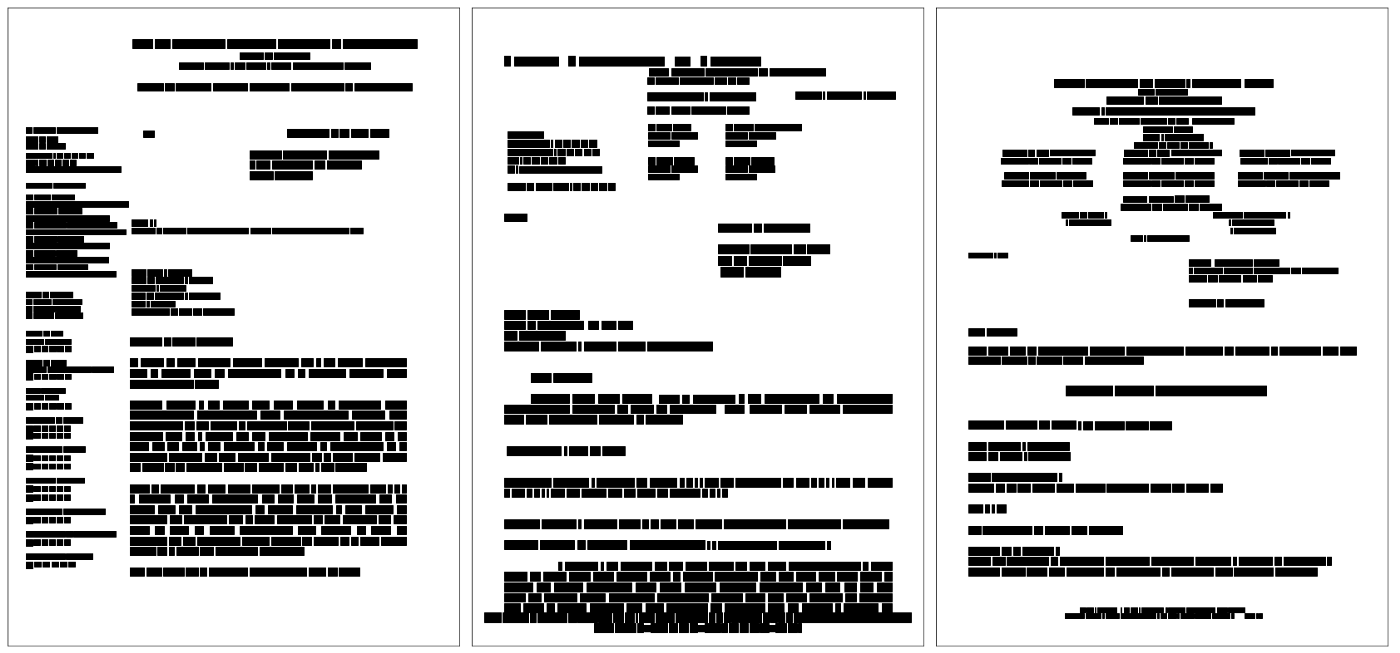

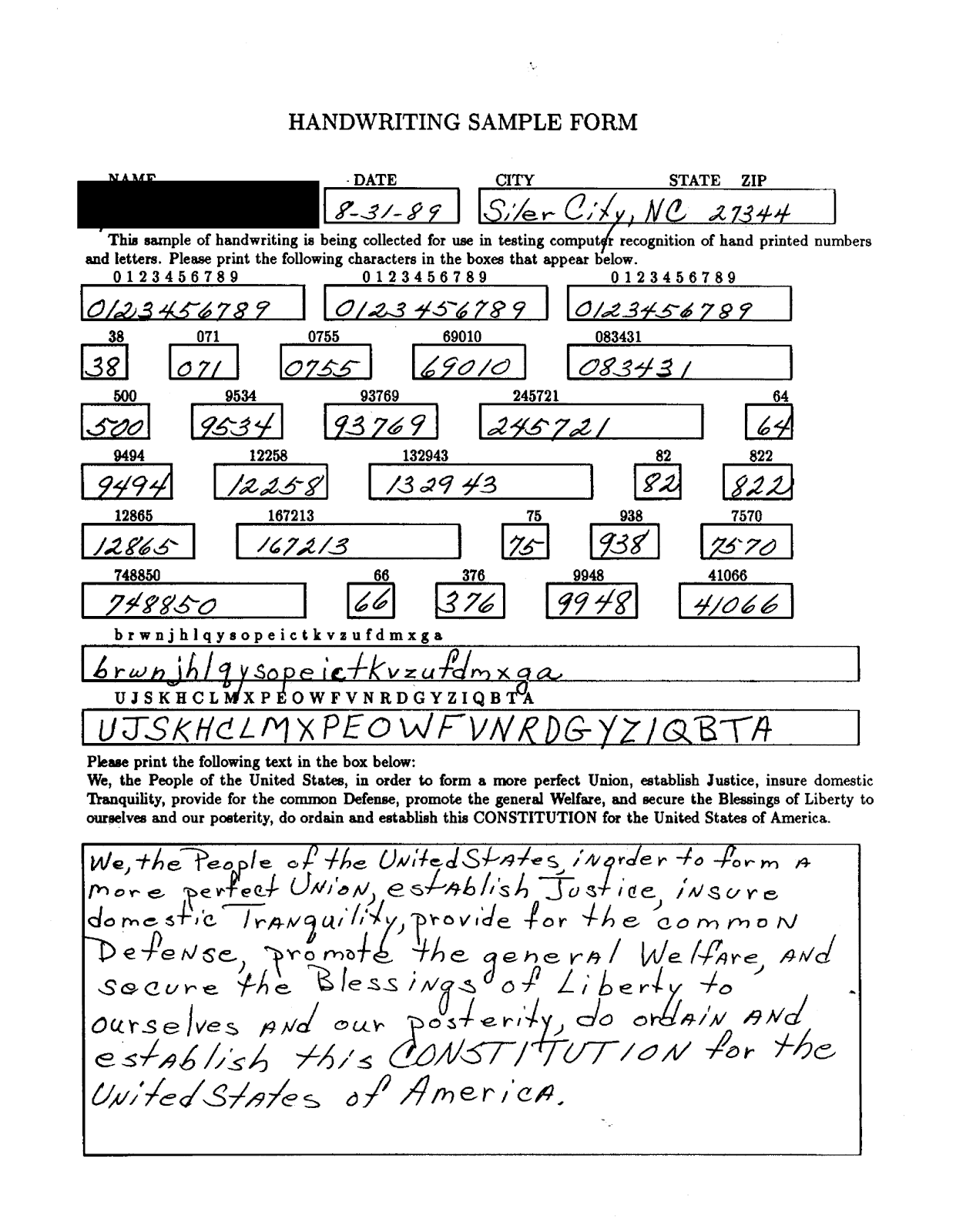

Scenario #1: Håndskrevet gjenkjennelse for skjemaer uten nett

Frakoblede skjemaer oppstår ofte i dagliglivet. Det er viktig at skjemaene er enkle å fylle ut og sende inn. Manuell digitalisering av offline-skjemaer kan være en hektisk og kostbar oppgave, og det er grunnen til at dyplæringsalgoritmer er nødvendige. Håndskrevne dokumenter er en stor utfordring å trekke ut data fra på grunn av kompleksiteten til de håndskrevne tegnene. Derfor er datagjenkjenningsalgoritmer mye brukt som en maskin lærer å lese og tolke den håndskrevne teksten. Prosessen innebærer å skanne bilder av håndskrevne ord og konvertere dem til data som kan behandles og analyseres av en algoritme. Algoritmen lager deretter et tegnkart basert på streker og gjenkjenner tilsvarende bokstaver for å trekke ut teksten.

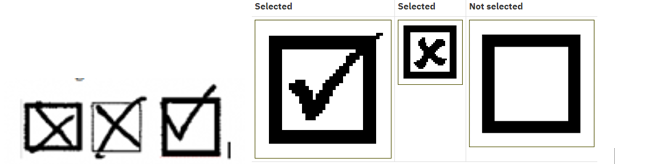

Scenario #2: Avmerkingsboksidentifikasjon på skjemaer

Avmerkingsboksskjemaer er en form for datainndata som brukes til å samle informasjon fra en bruker i et inndatafelt. Denne typen data finnes vanligvis i lister og tabeller som krever at brukeren velger ett eller flere elementer, for eksempel elementer de ønsker å bli kontaktet. Det kan finnes på en rekke steder - online skjemaer, spørreskjemaer og undersøkelser, og så videre. I dag kan noen algoritmer automatisere datautvinningsprosessen selv fra avmerkingsboksene. Hovedmålet med denne algoritmen er å identifisere inngangsregionene ved hjelp av datasynsteknikker. Disse innebærer å identifisere linjer (horisontale og vertikale), bruke filtre, konturer og oppdage kanter på bildene. Etter at inndataområdet er identifisert, er det enkelt å trekke ut innholdet i avmerkingsboksen som enten er merket eller umerket.

Scenario #3: Layout Endringer av skjemaet fra tid til annen

Når det gjelder å fylle ut skjemaer, er det vanligvis to forskjellige typer alternativer. For noen skjemaer må vi oppgi informasjonen vår ved å skrive i alle relevante felt, mens for andre kan vi gi informasjonen ved å velge fra noen få avmerkingsbokser. Oppsettet til skjemaet endres også avhengig av type skjema og dens kontekst. Derfor er det viktig å bygge en algoritme som kan håndtere flere ustrukturerte dokumenter og intelligent trekke ut innhold avhengig av skjemaetikettene. En populær teknikk for dyplæringsarkitektur for å håndtere dokumentoppsett er Graph CNNs. Ideen bak Graph Convolutional Networks (GCNs) er å sikre at nevronaktiveringene er datadrevne. De er designet for å fungere på grafer, som er sammensatt av noder og kanter. Et grafkonvolusjonslag er i stand til å gjenkjenne mønstre i fravær av et oppgavespesifikt treningssignal. Derfor er disse egnet når dataene er robuste.

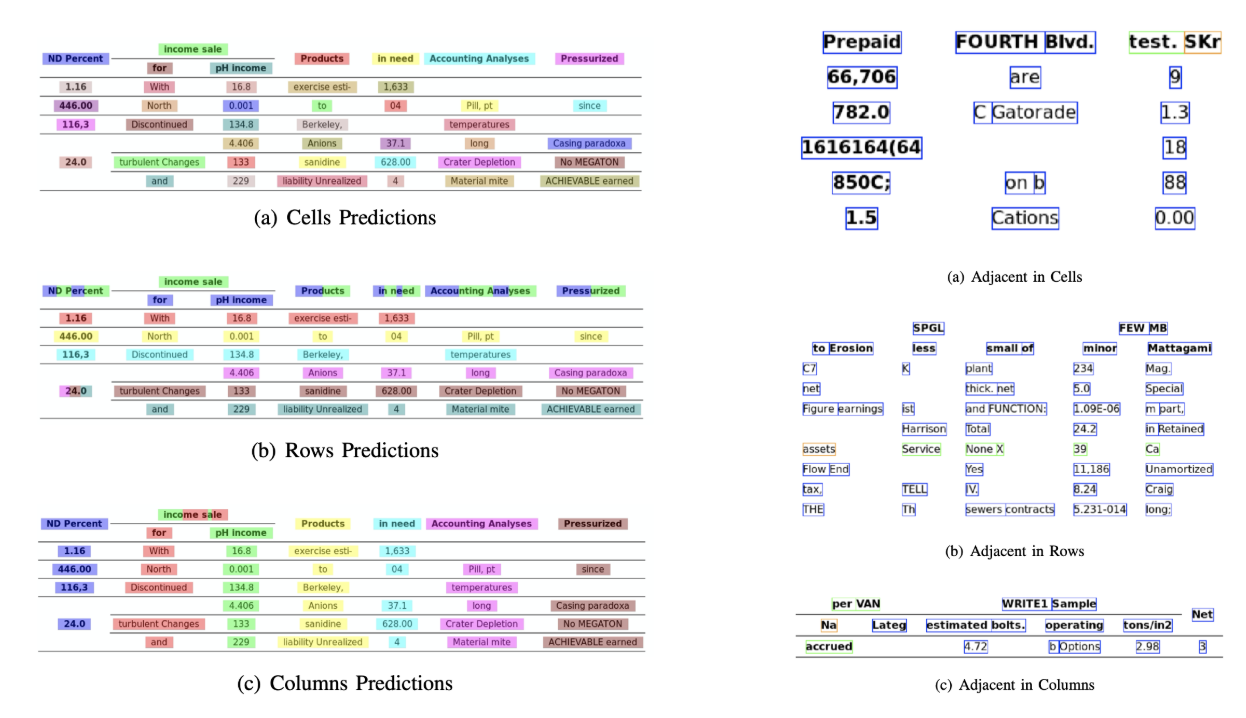

Scenario #4: Tabellcelledeteksjon

I noen tilfeller kommer bedrifter over spesielle typer skjemaer som består av tabellceller. Tabellceller er rektangulære områder inne i en tabell der data lagres. De kan klassifiseres som overskrifter, rader eller kolonner. En ideell algoritme bør identifisere alle disse celletypene og deres grenser for å trekke ut dataene fra dem. Noen populære teknikker for bordekstraksjon inkluderer Stream og Lattice; dette er algoritmer som kan hjelpe med å oppdage linjer, former, polygoner ved å bruke enkle isomorfe operasjoner på bilder.

Hvordan har løsningene for utvinning av skjemadata utviklet seg?

Skjemadatautvinning har sin opprinnelse i tiden før datamaskinen da folk håndterte papirskjemaer. Med bruken av databehandling ble det mulig å lagre data elektronisk. Dataprogrammene kunne bruke dataene til å lage rapporter, for eksempel salgsstatistikk. Denne programvaren kan også brukes til å skrive ut postetiketter, for eksempel navn og adresse til kunder, og skrive ut fakturaer, for eksempel forfallsbeløpet og adressen den skal sendes til. Imidlertid ser vi i dag en annen versjon av programvaren for utvinning av skjemadata; disse er svært nøyaktige, raskere og leverer dataene på en svært organisert og strukturert måte. La oss nå kort diskutere forskjellige typer teknikker for utvinning av skjemadata.

- Regelbasert fra datautvinning: Regelbasert utvinning er en teknikk som automatisk trekker ut data fra et bestemt malskjema. Den kan trekke ut data uten menneskelig innblanding. De fungerer ved å undersøke forskjellige felt på siden og bestemme hvilke som skal trekkes ut basert på omkringliggende tekst, etiketter og andre kontekstuelle ledetråder. Disse algoritmene er vanligvis utviklet og automatisert ved hjelp av ETL-skript eller nettskraping. Men når de testes på usynlige data, mislykkes de totalt.

- Skjemadatautvinning ved hjelp av OCR: OCR er en god løsning for alle former for datautvinningsproblemer. Imidlertid må man skrive ekstra skript og programmer for å oppnå nøyaktig ytelse. For at OCR skal fungere, krever det inntasting av et bilde med tekst på. Programvaren leser deretter hver piksel og sammenligner hver piksel med dens tilsvarende bokstav. Hvis den samsvarer, vil den skrive ut den bokstaven og eventuelle tall eller symboler nær nok til bokstaven. Den største utfordringen med OCR er å finne ut hvordan man skiller bokstaver. For eksempel når tonene er tett sammen eller overlapper hverandre, for eksempel "a" og "e." Derfor kan det hende at disse ikke fungerer når vi trekker ut frakoblede skjemaer.

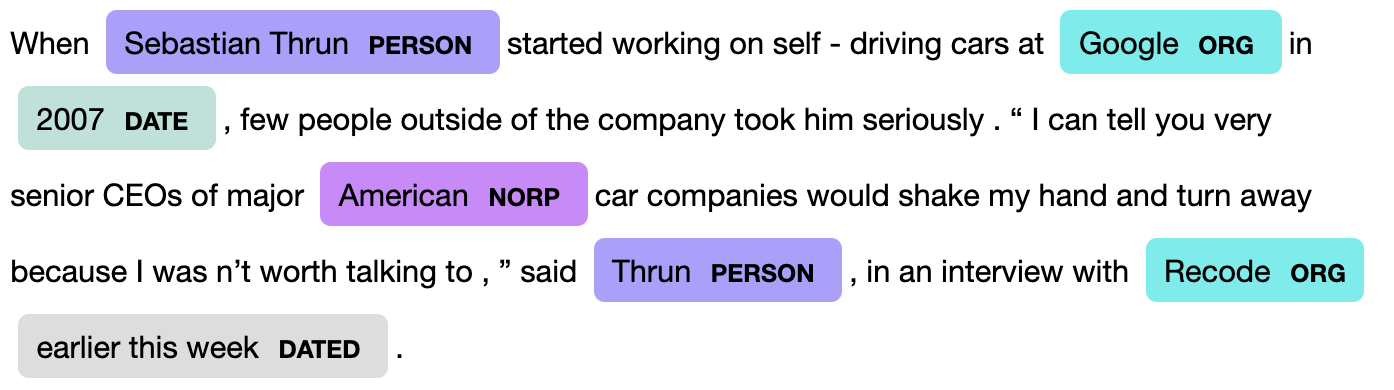

- NER for Form Data Extraction: Navngitt enhetsgjenkjenning er oppgaven med å identifisere og klassifisere forhåndsdefinerte enheter i naturlig språktekst. Det brukes ofte til å trekke ut informasjon fra skjemaer, der folk skriver inn navn, adresser, kommentarer osv. Oppgaven med å gjenkjenne navngitte enheter er nært knyttet til den bredere oppgaven med coreference resolution, som avgjør om omtale av de samme enhetene refererer til samme enheter i den virkelige verden. I dag, med avanserte programmeringsverktøy og rammeverk, kunne vi utnytte forhåndstrente modeller for å bygge NER-baserte modeller for informasjonsutvinningsoppgaver.

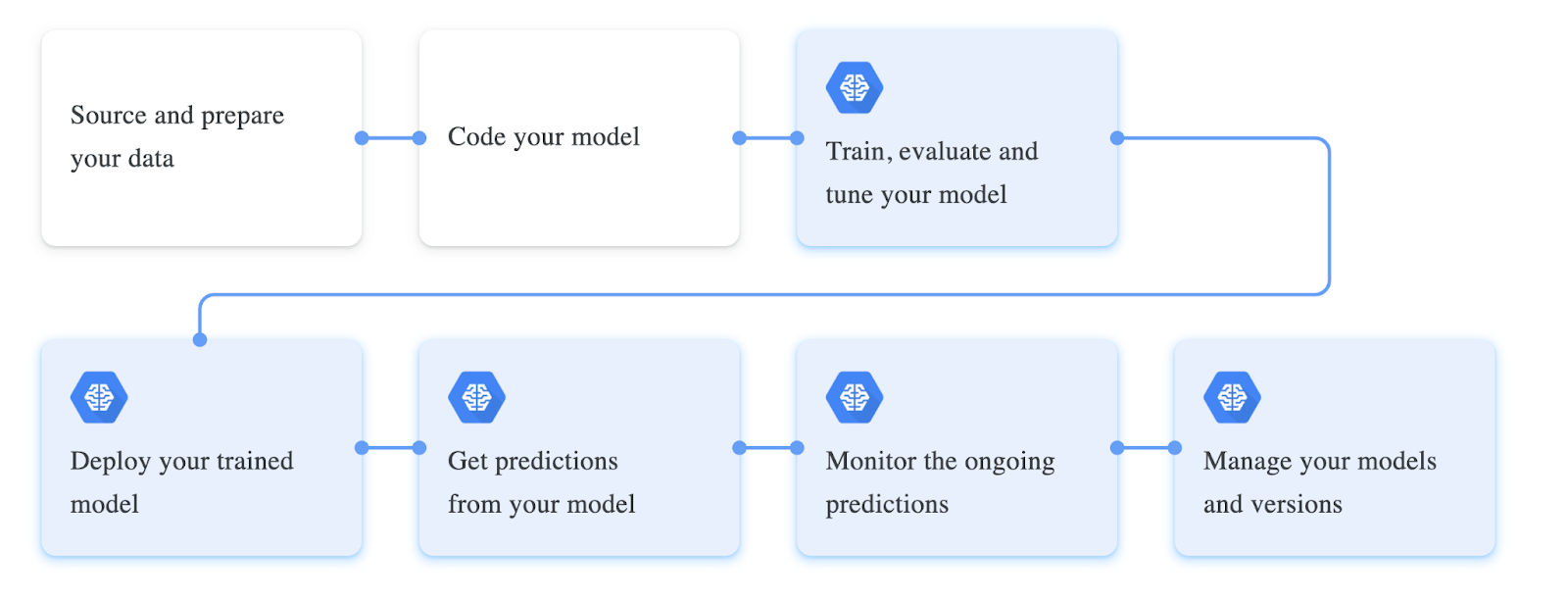

- Bruk av dyp læring for utvinning av skjemadata: Deep learning er ikke nytt, det har eksistert i flere tiår, men nyere utviklinger innen dyplæringsarkitekturer og datakraft har ført til banebrytende resultater. Skjemadatautvinning ved hjelp av dyp læring oppnådde toppmoderne ytelse i nesten alle formater, enten det er digitalt eller håndskrevet. Prosessen begynner med å mate det dype nevrale nettverket (DNN) tusenvis eller millioner av forskjellige eksempler merket med hva de er. For eksempel bilde-formetiketter med dens enheter som navn, e-post, id osv. DNN behandler all denne informasjonen og lærer på egen hånd hvordan disse delene henger sammen. Å bygge en svært nøyaktig modell krever imidlertid mye ekspertise og eksperimentering.

Vil du trekke ut data fra trykte eller håndskrevne skjemaer? Sjekk ut Nanonetter™ skjemadatauttrekk gratis og automatiser eksporten av informasjon fra alle skjemaer!

Skjemadatautvinning ved hjelp av OCR-er

Det er mange forskjellige biblioteker tilgjengelig for å trekke ut data fra skjemaer. Men hva om du vil trekke ut data fra et bilde av et skjema? Det er her Tesseract OCR (Optical Character Recognition) kommer inn. Tesseract er en åpen kildekode OCR (Optical Character Recognition)-motor utviklet av HP. Ved å bruke Tesseract OCR er det mulig å konvertere skannede dokumenter som papirfakturaer, kvitteringer og sjekker til søkbare, redigerbare digitale filer. Den er tilgjengelig på flere språk og kan gjenkjenne tegn i ulike bildeformater. Tesseract brukes vanligvis i kombinasjon med andre biblioteker for å behandle bilder for å trekke ut tekst.

For å teste dette ut, sørg for at du installerer Tesseract på din lokale maskin. Du kan enten bruke Tesseract CLI eller Python-bindinger for å kjøre OCR. Python-tesseract er en innpakning for Googles Tesseract-OCR-motor. Den kan brukes til å lese alle bildetyper som støttes av bildebibliotekene Pillow og Leptonica, inkludert jpeg, png, gif, bmp, tiff og andre. Du kan enkelt bruke det som et frittstående påkallingsskript for å tessere om nødvendig.

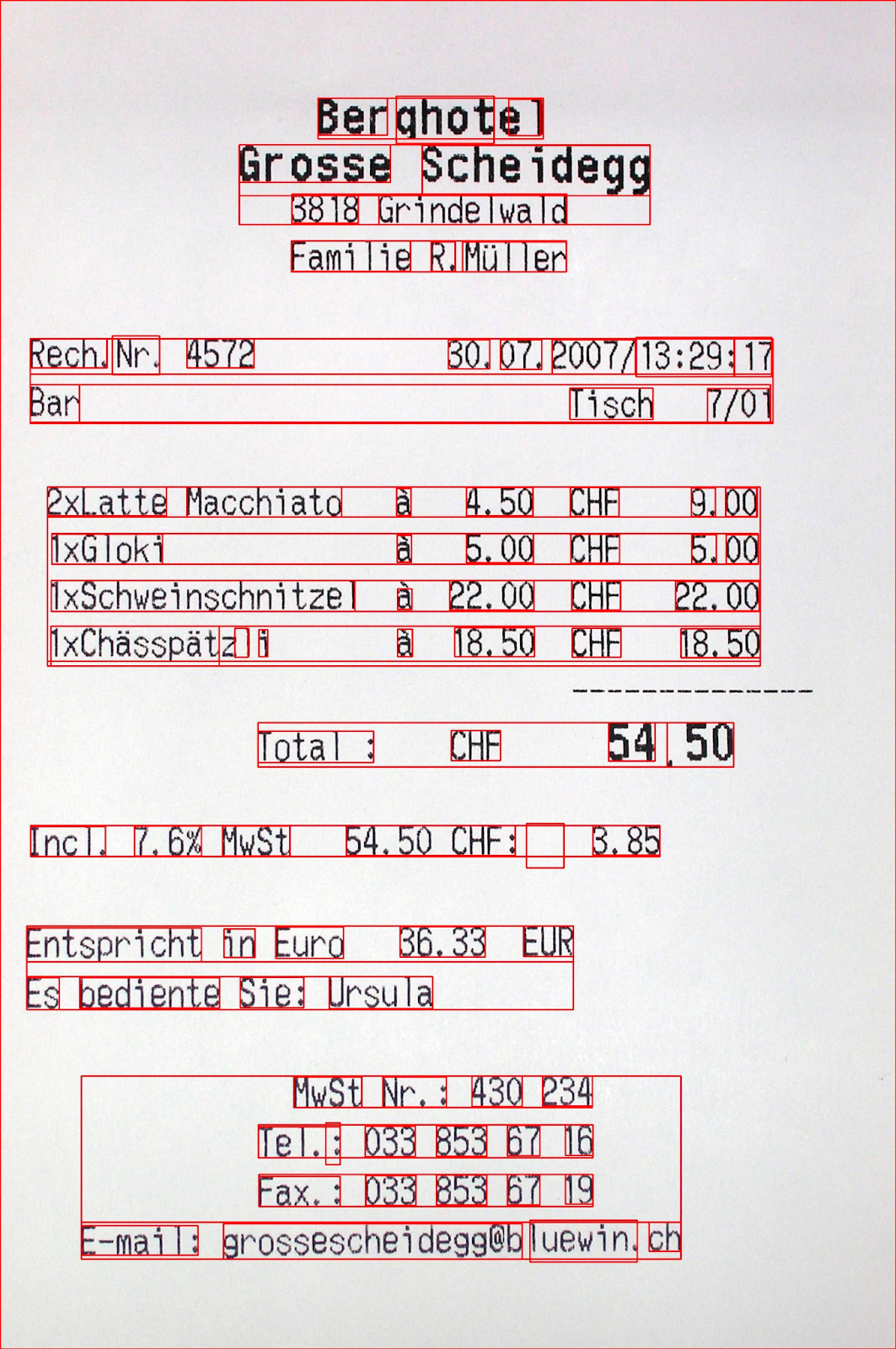

La oss nå ta en kvittering som inneholder skjemadata og prøve å identifisere plasseringen av teksten ved hjelp av Computer Vision og Tesseract.

import pytesseract

from pytesseract import Output

import cv2 img = cv2.imread('receipt.jpg')

d = pytesseract.image_to_data(img, output_type=Output.DICT)

n_boxes = len(d['level'])

for i in range(n_boxes): (x, y, w, h) = (d['left'][i], d['top'][i], d['width'][i], d['height'][i]) img = cv2.rectangle(img, (x, y), (x + w, y + h), (0, 0, 255), 2) cv2.imshow(img,'img')

Her, i utgangen, som vi kan se, var programmet i stand til å identifisere all teksten inne i skjemaet. La oss nå bruke OCR på dette for å trekke ut all informasjonen. Vi kan ganske enkelt gjøre dette ved å bruke bilde_til_streng funksjon i Python.

extracted_text = pytesseract.image_to_string(img, lang = 'deu')

Utgang:

Berghotel

Grosse Scheidegg

3818 Grindelwald

Familie R.Müller Rech.Nr. 4572 30.07.2007/13:29: 17

Bar Tisch 7/01

2xLatte Macchiato &ä 4.50 CHF 9,00

1xGloki a 5.00 CH 5.00

1xSchweinschnitzel ä 22.00 CHF 22.00

IxChässpätz 1 a 18.50 CHF 18.50 Total: CHF 54.50 Incl. 7.6% MwSt 54.50 CHF: 3.85 Entspricht in Euro 36.33 EUR

Es bediente Sie: Ursula MwSt Nr. : 430 234

Tel.: 033 853 67 16

Fax.: 033 853 67 19

E-mail: grossescheidegs@b luewin. Ch Her kan vi trekke ut all informasjon fra skjemaet. I de fleste tilfeller vil det imidlertid ikke hjelpe å bruke bare OCR, da dataene som trekkes ut vil være helt ustrukturerte. Derfor er brukere avhengige av uttrekk av nøkkelverdi-par på skjemaer, som bare kan identifisere spesifikke enheter som ID, Datoer, Skattebeløp osv. Dette er bare mulig med dyp læring. I neste avsnitt, la oss se på hvordan vi kan utnytte forskjellige dyplæringsteknikker for å bygge informasjonsutvinningsalgoritmer.

Løse skjemadatautvinning ved hjelp av dyp læring

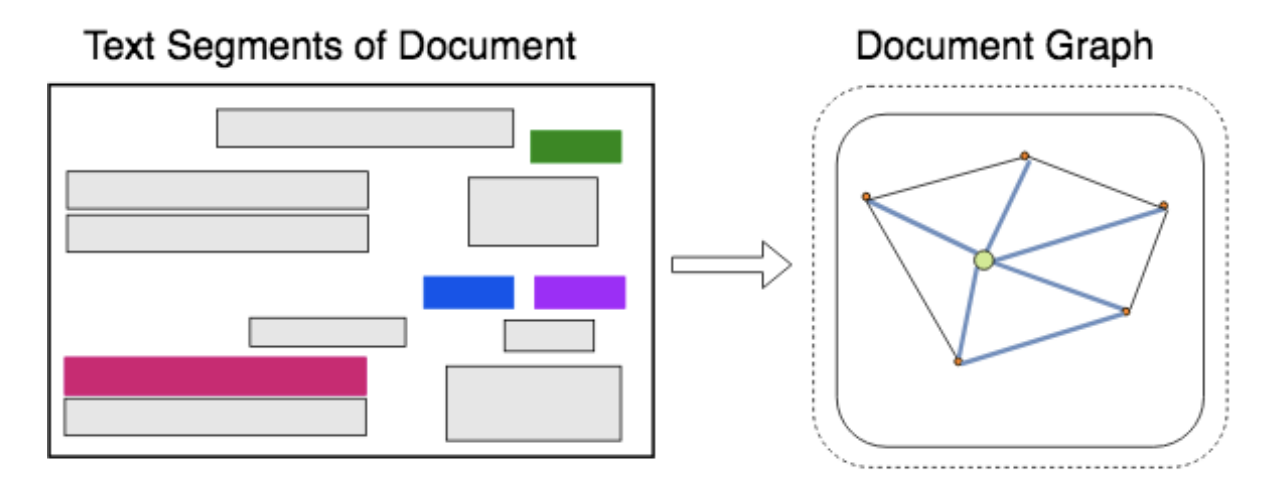

Grafkonvolusjon for multimodal informasjonsutvinning fra visuelt rike dokumenter

Graph Convolutional Networks (Graph CNNs) er en klasse med dype konvolusjonelle nevrale nettverk (CNN) som effektivt kan lære svært ikke-lineære funksjoner i grafdatastrukturer samtidig som node- og kantstrukturen bevares. De kan ta grafdatastrukturer som input og generere "funksjonskart" for noder og kanter. De resulterende funksjonene kan brukes til grafklassifisering, gruppering eller fellesskapsdeteksjon. GCN-er gir en kraftig løsning for å trekke ut informasjon fra store, visuelt rike dokumenter som fakturaer og kvitteringer. For å behandle disse må hvert bilde transformeres til en graf bestående av noder og kanter. Ethvert ord på bildet er representert av sin egen node; visualisering av resten av dataene er kodet i nodens funksjonsvektor.

Denne modellen koder først hvert tekstsegment i dokumentet til grafinnbygging. Dette fanger den visuelle og tekstuelle konteksten rundt hvert tekstelement, sammen med dets posisjon eller plassering i en tekstblokk. Den kombinerer deretter disse grafene med tekstinnbygging for å skape en helhetlig representasjon av dokumentets struktur og hva som er skrevet i det. Modellen lærer å legge høyere vekt på tekster som sannsynligvis er enheter basert på deres plassering i forhold til hverandre og konteksten de vises i innenfor en større blokk av lesere. Til slutt bruker den en standard BiLSTM-CRF-modell for enhetsutvinning. Resultatene viser at denne algoritmen overgår baseline-modellen (BiLSTM-CRF) med bred margin.

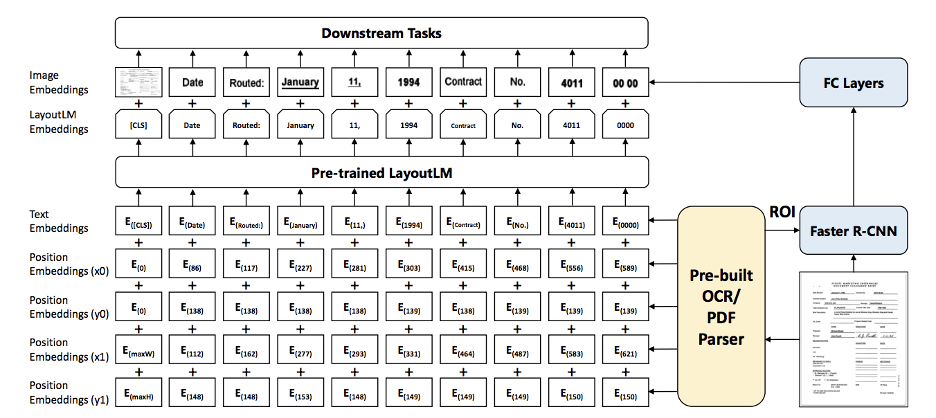

LayoutLM: Foropplæring av tekst og layout for dokumentbildeforståelse

Arkitekturen til LayoutLM-modellen er sterkt inspirert av BERT og inkluderer bildeinnbygging fra en Faster R-CNN. LayoutLM-innbygginger genereres som en kombinasjon av tekst- og posisjonsinnleiringer, deretter kombinert med bildeinnbygginger generert av Faster R-CNN-modellen. Maskerte visuelle språkmodeller og fleretikettsdokumentklassifisering brukes først og fremst som forhåndsopplæringsoppgaver for LayoutLM. LayoutLM-modellen er verdifull, dynamisk og sterk nok for enhver jobb som krever layoutforståelse, slik som utvinning av skjema/kvitteringer, klassifisering av dokumentbilder eller til og med visuelle spørsmålssvar kan utføres med denne opplæringsmodellen.

LayoutLM-modellen ble trent på IIT-CDIP Test Collection 1.0, som inkluderer over 6 millioner dokumenter og mer enn 11 millioner skannede dokumentbilder på totalt over 12 GB data. Denne modellen hadde klart utkonkurrert flere SOTA forhåndsopplærte modeller i formforståelse, kvitteringsforståelse og klassifiseringsoppgaver for skannet dokumentbilde.

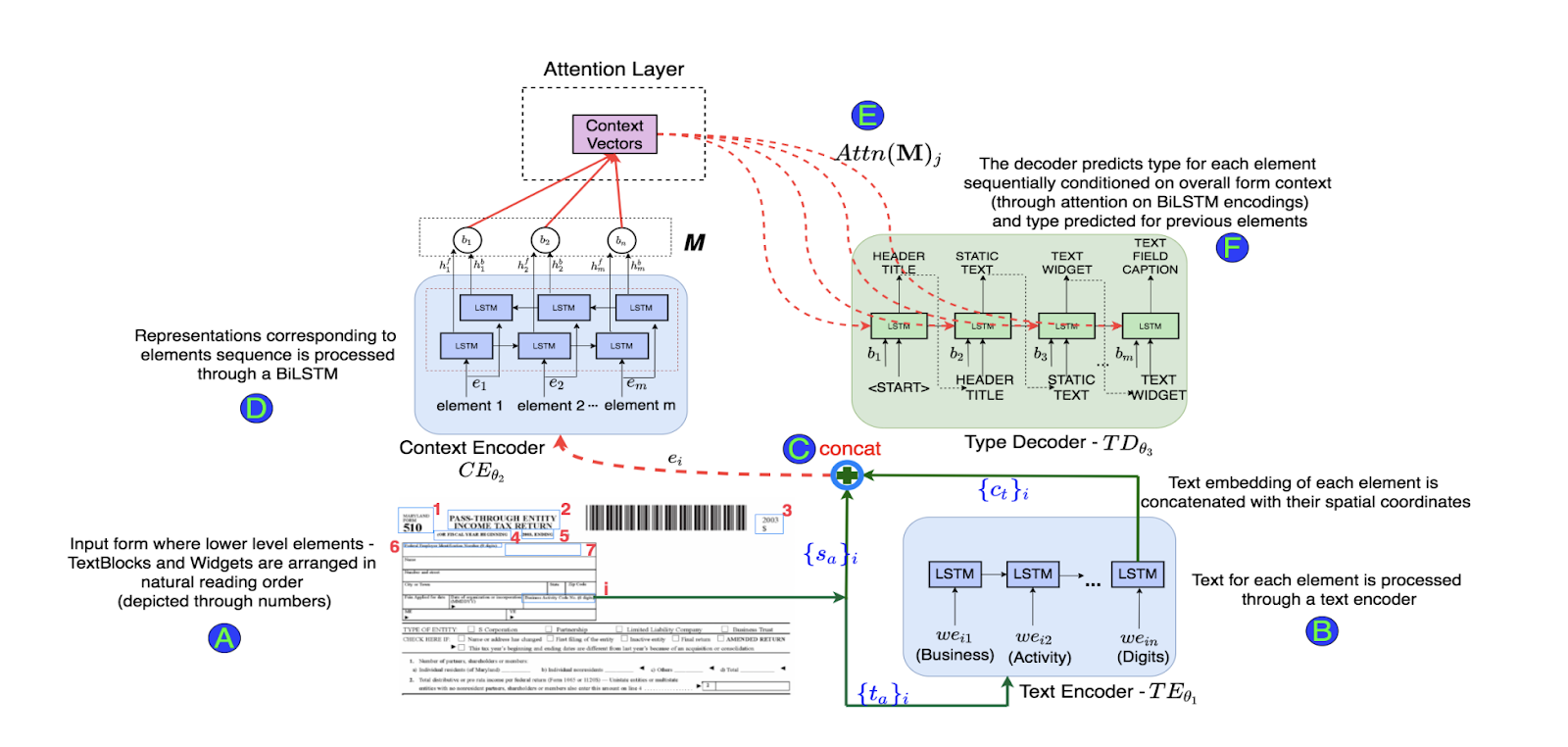

Form2Seq: A Framework for Higher Order Form Structure Extraction

Form2Seq er et rammeverk som fokuserer på å trekke ut strukturer fra inndatatekst ved å bruke posisjonelle sekvenser. I motsetning til tradisjonelle seq2seq-rammeverk, utnytter Form2Seq relative romlige posisjoner til strukturene, i stedet for deres rekkefølge.

I denne metoden klassifiserer vi først lavnivåelementer som vil gi bedre behandling og organisering. Det er 10 typer skjemaer, for eksempel felttekster, listeelementer og så videre. Deretter grupperer vi elementer på lavere nivå, for eksempel tekstfelt og valgfelt, i konstruksjoner av høyere orden kalt ChoiceGroups. Disse brukes som informasjonsinnsamlingsmekanismer for å oppnå bedre brukeropplevelse på lavere nivåelementer til konstruksjoner av høyere orden, slik som tekstfelt, valgfelt og valggrupper, brukt som informasjonsinnsamlingsmekanismer i skjemaer. Dette er mulig ved å arrangere de konstituerende elementene i en lineær rekkefølge i naturlig leserekkefølge og mate deres romlige og tekstlige representasjoner til Seq2Seq-rammeverket. Seq2Seq-rammeverket lager sekvensielt spådommer for hvert element i en setning avhengig av konteksten. Dette gjør at den kan behandle mer informasjon og komme frem til en bedre forståelse av oppgaven.

Modellen oppnådde en nøyaktighet på 90 % på klassifiseringsoppgaven, som var høyere enn for segmenteringsbaserte grunnlinjemodeller. F1 på tekstblokker, tekstfelt og valgfelt var henholdsvis 86.01 %, 61.63 %. Dette rammeverket oppnådde statusen til resultatene på ICDAR-datasettet for tabellstrukturgjenkjenning.

Vil du trekke ut data fra trykte eller håndskrevne skjemaer? Sjekk ut Nanonetter™ skjemadatauttrekk gratis og automatiser eksporten av informasjon fra alle skjemaer!

Hvorfor Nanonets AI-basert OCR er det beste alternativet

Selv om OCR-programvare kan konvertere skannede bilder av tekst til formaterte digitale filer som PDF-er, DOC-er og PPT-er, er det ikke alltid nøyaktig. Dagens ledende programvare som Nanonets AI-basert OCR dyplæringssystem har overvunnet mange utfordringer som tradisjonelle OCR-systemer har møtt mens de opprettet en redigerbar fil fra et skannet dokument. Det har blitt det beste alternativet for datautvinning fordi det kan gi høye nøyaktighetshastigheter og høye toleransenivåer for støy, grafiske elementer og formateringsendringer. La oss nå diskutere noen punkter om hvordan AI-basert OCR er det beste alternativet.

- OCR, som diskutert, er en enkel teknikk for å trekke ut data. De vil imidlertid ikke fungere konsekvent når de legges på usett/nye data. Imidlertid kan AI-basert OCR håndtere situasjoner som disse, da de trener på et bredt spekter av data.

- Vanlige OCR-er kan ikke håndtere komplekse oppsett for uttrekk av skjemadata. Derfor, når de drives med dyp læring eller AI, gir de de beste resultatene ved å forstå dataens oppsett, tekst og kontekst.

- OCR-er kan fungere dårligere når det er støy i data, for eksempel skjevheter, skannede bilder med lite lys osv., mens dyplæringsmodeller kan håndtere slike forhold og fortsatt gi svært nøyaktige resultater.

- AI-baserte OCR-er er svært tilpassbare og fleksible sammenlignet med tradisjonelle OCR-er; de kan bygges på ulike typer data for å konvertere ustrukturerte data til ethvert strukturert format.

- Etterbehandlingsutdata fra AI-basert OCR er tilgjengelig sammenlignet med vanlig OCR; de kan eksporteres til alle dataformater som JSON, CSV, Excel Sheets, eller til og med en database som Postgres direkte fra modellen.

- AI-basert OCR kan eksporteres som en enkel API ved å bruke forhåndstrente modeller. Dette er fortsatt mulig i andre tradisjonelle metoder, men det kan være vanskelig å forbedre modellene konsekvent i tide. Mens den er på AI-basert OCR, kan den automatisk justeres ved feil.

- Tabellekstraksjon er svært umulig ved bruk av rett OCR. Det kan imidlertid gjøres enkelt med kraften til AI/DL. I dag kan AI-baserte OCR-er positivt peke tabellbaserte skjemaer inne i dokumenter og trekke ut informasjon.

- Hvis det er økonomiske eller konfidensielle data i dokumenter, kan AI-modeller også utføre svindelkontroller. Den ser i utgangspunktet etter redigert/uskarp tekst fra de skannede dokumentene og varsler administratorene. Dupliserte dokumenter eller informasjon kan også identifiseres gjennom disse modellene. Mens OCR rett og slett feiler i slike tilfeller.

- &

- 67

- 7

- 9

- Logg inn

- nøyaktig

- oppnådd

- tvers

- Ytterligere

- adresse

- avansert

- AI

- algoritme

- algoritmer

- Alle

- Selv

- beløp

- beløp

- En annen

- api

- APIer

- Søknad

- påføring

- tilnærming

- arkitektur

- rundt

- Automatisert

- tilgjengelig

- bakgrunn

- Baseline

- I utgangspunktet

- basis

- bli

- være

- BEST

- Biggest

- Blokker

- Blogg

- grensen

- bygge

- Bygning

- bedrifter

- Kapasitet

- teksting

- hvilken

- saker

- Årsak

- utfordre

- utfordringer

- Sjekker

- klassifisering

- samle

- Samle

- samling

- kombinasjon

- kombinert

- kommentarer

- Felles

- samfunnet

- sammenlignet

- komplekse

- databehandling

- databehandlingskraft

- innhold

- innhold

- Kostnader

- kunne

- skaper

- Opprette

- avgjørende

- Kunder

- dato

- datasikkerhet

- Database

- datoer

- design

- Gjenkjenning

- utvikle

- utviklet

- utviklere

- utviklingen

- forskjellig

- digitalt

- Dimensjon

- diskutere

- dokumenter

- dynamisk

- e-post

- lett

- Edge

- Effektiv

- effektiv

- emalje

- avgjørende

- euro

- eksempel

- Excel

- erfaring

- ekspertise

- ekstrakter

- møtt

- raskere

- Trekk

- Egenskaper

- Felt

- filtre

- Endelig

- finansiell

- Først

- Fix

- flyten

- skjema

- format

- skjemaer

- funnet

- Rammeverk

- svindel

- Gratis

- funksjon

- Fundamentals

- generere

- mål

- Gruppe

- hjelpe

- nyttig

- Høy

- svært

- Hvordan

- Hvordan

- HTTPS

- Tanken

- Identifikasjon

- identifisere

- bilde

- Påvirkning

- viktig

- umulig

- forbedre

- I andre

- inkludere

- Inkludert

- informasjon

- inspirert

- integrasjoner

- saker

- IT

- Jobb

- kjent

- etiketter

- Språk

- språk

- stor

- større

- føre

- læring

- Led

- Leverage

- utnytter

- Liste

- lister

- lokal

- plassering

- steder

- maskin

- større

- håndbok

- manuelt

- kart

- nevner

- millioner

- millioner

- modell

- modeller

- mest

- navn

- Naturlig

- nettverk

- nettverk

- noder

- Bråk

- Merknader

- tall

- på nett

- Drift

- Alternativ

- alternativer

- rekkefølge

- organisasjon

- organisasjoner

- Annen

- ellers

- Papir

- deltakere

- Ansatte

- ytelse

- personlig

- Populær

- mulig

- makt

- kraftig

- Spådommer

- presentere

- primære

- Problem

- prosess

- Prosesser

- Profil

- program

- Programmering

- programmer

- Projeksjon

- gi

- spørsmål

- område

- priser

- RE

- lesere

- Lesning

- grunner

- gjenkjenner

- redusere

- Rapporter

- krever

- REST

- Resultater

- Risiko

- rennende

- salg

- skanne

- skanning

- sikre

- sikkerhet

- segmentering

- valgt

- figurer

- Kort

- Enkelt

- So

- Software

- Solutions

- startet

- Tilstand

- state-of-the-art

- statistikk

- oppbevare

- stream

- sterk

- Støttes

- system

- Systemer

- oppgaver

- skatt

- teknikker

- test

- tredjeparts

- tusener

- Gjennom

- tid

- tidkrevende

- i dag

- sammen

- toleranse

- verktøy

- tradisjonelle

- Kurs

- Transformation

- forstå

- bruke

- Brukere

- vanligvis

- syn

- visualisering

- W

- web

- Hva

- Hva er

- om

- innenfor

- uten

- ord

- Arbeid

- arbeid

- virker

- skriving

- X