Generative AI-løsninger har potensial til å transformere virksomheter ved å øke produktiviteten og forbedre kundeopplevelsene, og bruk av store språkmodeller (LLM) med disse løsningene har blitt stadig mer populært. Å bygge proof of concept er relativt enkelt fordi banebrytende grunnmodeller er tilgjengelig fra spesialiserte leverandører gjennom et enkelt API-kall. Derfor har organisasjoner av ulike størrelser og på tvers av ulike bransjer begynt å omforme produktene og prosessene sine ved hjelp av generativ AI.

Til tross for deres vell av generell kunnskap, har toppmoderne LLM-er bare tilgang til informasjonen de ble opplært på. Dette kan føre til faktiske unøyaktigheter (hallusinasjoner) når LLM blir bedt om å generere tekst basert på informasjon de ikke så under opplæringen. Derfor er det avgjørende å bygge bro mellom LLMs generelle kunnskap og dine proprietære data for å hjelpe modellen med å generere mer nøyaktige og kontekstuelle svar samtidig som risikoen for hallusinasjoner reduseres. Den tradisjonelle metoden for finjustering, selv om den er effektiv, kan være datamaskinintensiv, kostbar og krever teknisk ekspertise. Et annet alternativ å vurdere kalles Retrieval Augmented Generation (RAG), som gir LLM-er tilleggsinformasjon fra en ekstern kunnskapskilde som enkelt kan oppdateres.

I tillegg må bedrifter sørge for datasikkerhet når de håndterer proprietære og sensitive data, slik som personopplysninger eller åndsverk. Dette er spesielt viktig for organisasjoner som opererer i sterkt regulerte bransjer, som finansielle tjenester og helsevesen og biovitenskap. Derfor er det viktig å forstå og kontrollere flyten av dataene dine gjennom den generative AI-applikasjonen: Hvor er modellen plassert? Hvor behandles dataene? Hvem har tilgang til dataene? Vil dataene bli brukt til å trene modeller, og til slutt risikere lekkasje av sensitive data til offentlige LLM-er?

Dette innlegget diskuterer hvordan bedrifter kan bygge nøyaktige, transparente og sikre generative AI-applikasjoner mens de beholder full kontroll over proprietære data. Den foreslåtte løsningen er en RAG-rørledning som bruker en AI-native teknologistabel, hvis komponenter er designet fra grunnen av med AI i kjernen, i stedet for å ha AI-evner lagt til som en ettertanke. Vi viser hvordan du bygger en ende-til-ende RAG-applikasjon ved hjelp av Coheres språkmodeller gjennom Amazonas grunnfjell og en Weaviate vektordatabase på AWS Marketplace. Den medfølgende kildekoden er tilgjengelig i relatert GitHub-depot arrangert av Weaviate. Selv om AWS ikke vil være ansvarlig for å vedlikeholde eller oppdatere koden i partnerens depot, oppfordrer vi kunder til å koble direkte til Weaviate angående eventuelle ønskede oppdateringer.

Løsningsoversikt

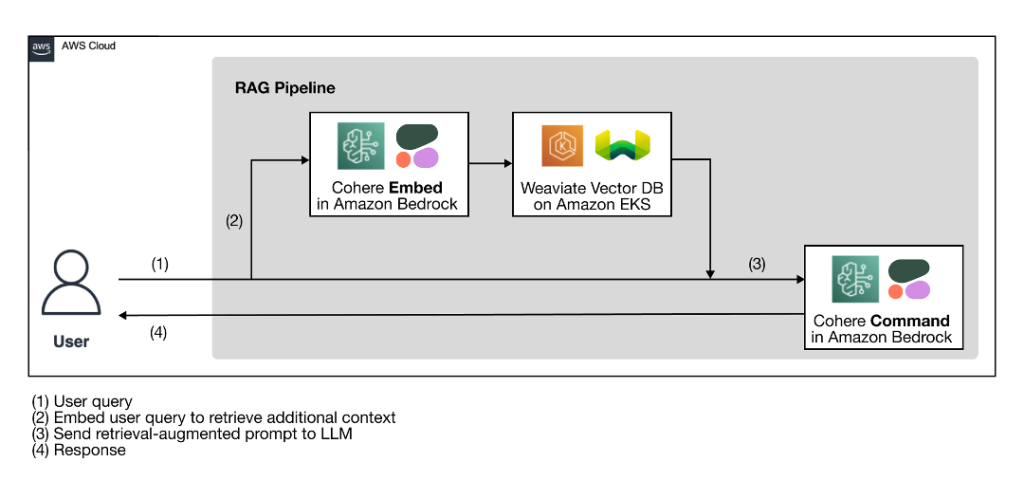

Følgende arkitekturdiagram på høyt nivå illustrerer den foreslåtte RAG-rørledningen med en AI-native teknologistabel for å bygge nøyaktige, transparente og sikre generative AI-løsninger.

Figur 1: RAG arbeidsflyt ved bruk av Coheres språkmodeller gjennom Amazon Bedrock og en Weaviate vektordatabase på AWS Marketplace

Som et forberedelsestrinn for RAG-arbeidsflyten inntas en vektordatabase, som fungerer som den eksterne kunnskapskilden, med tilleggskonteksten fra de proprietære dataene. Selve RAG-arbeidsflyten følger de fire trinnene som er illustrert i diagrammet:

- Brukeren legger inn søket sitt.

- Brukerspørringen brukes til å hente relevant tilleggskontekst fra vektordatabasen. Dette gjøres ved å generere vektorinnbyggingene til brukerspørringen med en innbyggingsmodell for å utføre et vektorsøk for å hente den mest relevante konteksten fra databasen.

- Den hentede konteksten og brukerspørringen brukes til å utvide en ledetekstmal. Den gjenfinningsforsterkede prompten hjelper LLM med å generere en mer relevant og nøyaktig fullføring, og minimerer hallusinasjoner.

- Brukeren får et mer nøyaktig svar basert på deres forespørsel.

Den AI-native teknologistabelen illustrert i arkitekturdiagrammet har to nøkkelkomponenter: Cohere-språkmodeller og en Weaviate-vektordatabase.

Kohere språkmodeller i Amazon Bedrock

De Sammenhengende plattform bringer språkmodeller med toppmoderne ytelse til bedrifter og utviklere gjennom et enkelt API-kall. Det er to nøkkeltyper av språkbehandlingsfunksjoner som Cohere-plattformen tilbyr – generativ og innebygging – og hver av dem betjenes av en annen type modell:

- Tekstgenerering med Kommando – Utviklere kan få tilgang til endepunkter som driver genererende AI-funksjoner, som muliggjør applikasjoner som samtale, svar på spørsmål, copywriting, oppsummering, informasjonsutvinning og mer.

- Tekstrepresentasjon med embed – Utviklere kan få tilgang til endepunkter som fanger den semantiske betydningen av tekst, og muliggjør applikasjoner som vektorsøkemotorer, tekstklassifisering og klynging og mer. Cohere Embed kommer i to former, en engelskspråklig modell og en flerspråklig modell, som begge er nå tilgjengelig på Amazon Bedrock.

Cohere-plattformen gir bedrifter mulighet til å tilpasse sin generative AI-løsning privat og sikkert gjennom Amazon Bedrock-distribusjonen. Amazon Bedrock er en fullstendig administrert skytjeneste som gjør det mulig for utviklingsteam å bygge og skalere generative AI-applikasjoner raskt samtidig som du hjelper til med å holde dataene og applikasjonene dine sikre og private. Dataene dine brukes ikke til tjenesteforbedringer, deles aldri med tredjeparts modellleverandører og forblir i Region hvor API-kallet behandles. Dataene er alltid kryptert under overføring og hvile, og du kan kryptere dataene med dine egne nøkler. Amazon Bedrock støtter sikkerhetskrav, inkludert US Health Insurance Portability and Accountability Act (HIPAA) kvalifisering og overholdelse av General Data Protection Regulation (GDPR). I tillegg kan du trygt integrere og enkelt distribuere dine generative AI-applikasjoner ved å bruke AWS-verktøyene du allerede er kjent med.

Weaviate vektordatabase på AWS Marketplace

Vev er en AI-innfødt vektor database som gjør det enkelt for utviklingsteam å bygge sikre og transparente generative AI-applikasjoner. Weaviate brukes til å lagre og søke i både vektordata og kildeobjekter, noe som forenkler utviklingen ved å eliminere behovet for å være vert for og integrere separate databaser. Weaviate leverer sekundær semantisk søkeytelse og kan skaleres til å håndtere milliarder av vektorer og millioner av leietakere. Med en unik utvidbar arkitektur, integreres Weaviate naturlig med Cohere-fundamentmodeller som er distribuert i Amazon Bedrock for å lette praktisk vektorisering av data og bruke dens generative evner fra databasen.

Weaviate AI-native vektordatabasen gir kundene fleksibiliteten til å distribuere den som en bring-your-own-cloud (BYOC)-løsning eller som en administrert tjeneste. Dette utstillingsvinduet bruker Weaviate Kubernetes Cluster på AWS Marketplace, en del av Weaviates BYOC-tilbud, som tillater containerbasert skalerbar distribusjon i din AWS-leietaker og VPC med bare noen få klikk ved hjelp av en AWS skyformasjon mal. Denne tilnærmingen sikrer at vektordatabasen din distribueres i din spesifikke region nær grunnmodellene og proprietære data for å minimere latens, støtte datalokalitet og beskytte sensitive data samtidig som potensielle regulatoriske krav, slik som GDPR, adresseres.

Bruk saksoversikt

I de følgende avsnittene viser vi hvordan du bygger en RAG-løsning ved å bruke den AI-native teknologistabelen med Cohere, AWS og Weaviate, som illustrert i løsningsoversikten.

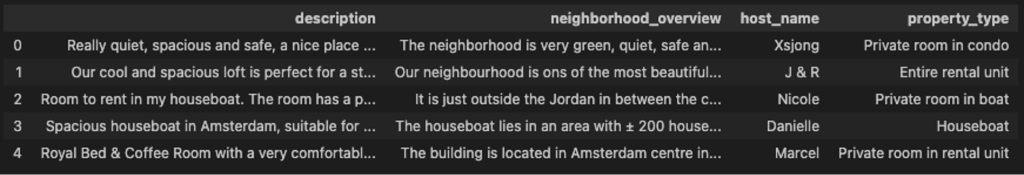

Brukseksemplet genererer målrettede annonser for ferieopphold basert på en målgruppe. Målet er å bruke brukerspørsmålet for målgruppen (for eksempel "familie med små barn") for å hente den mest relevante oppføringen for ferieopphold (for eksempel en oppføring med lekeplasser i nærheten) og deretter generere en annonse for hentet oppføring tilpasset målgruppen.

Figur 2: De første radene med oppføringer for ferieopphold tilgjengelig fra Inside Airbnb.

Datasettet er tilgjengelig fra Inne på Airbnb og er lisensiert under a Creative Commons Attribution 4.0 Internasjonal lisens. Du finner den medfølgende koden i GitHub repository.

Forutsetninger

For å følge med og bruke AWS-tjenester i den følgende opplæringen, sørg for at du har en AWS-konto.

Aktiver komponenter i den AI-native teknologistabelen

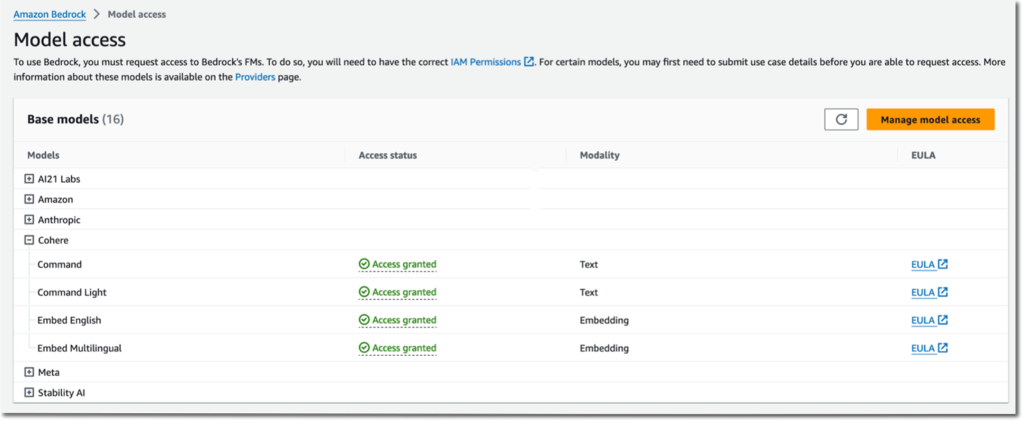

Først må du aktivere de relevante komponentene som er omtalt i løsningsoversikten i AWS-kontoen din. Fullfør følgende trinn:

- Til venstre Amazon Bedrock-konsoll, velg Modelltilgang i navigasjonsruten.

- Velg Administrer modelltilgang øverst til høyre.

- Velg grunnlagsmodellene du ønsker og be om tilgang.

Figur 3: Administrer modelltilgang i Amazon Bedrock-konsollen.

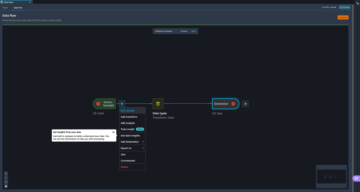

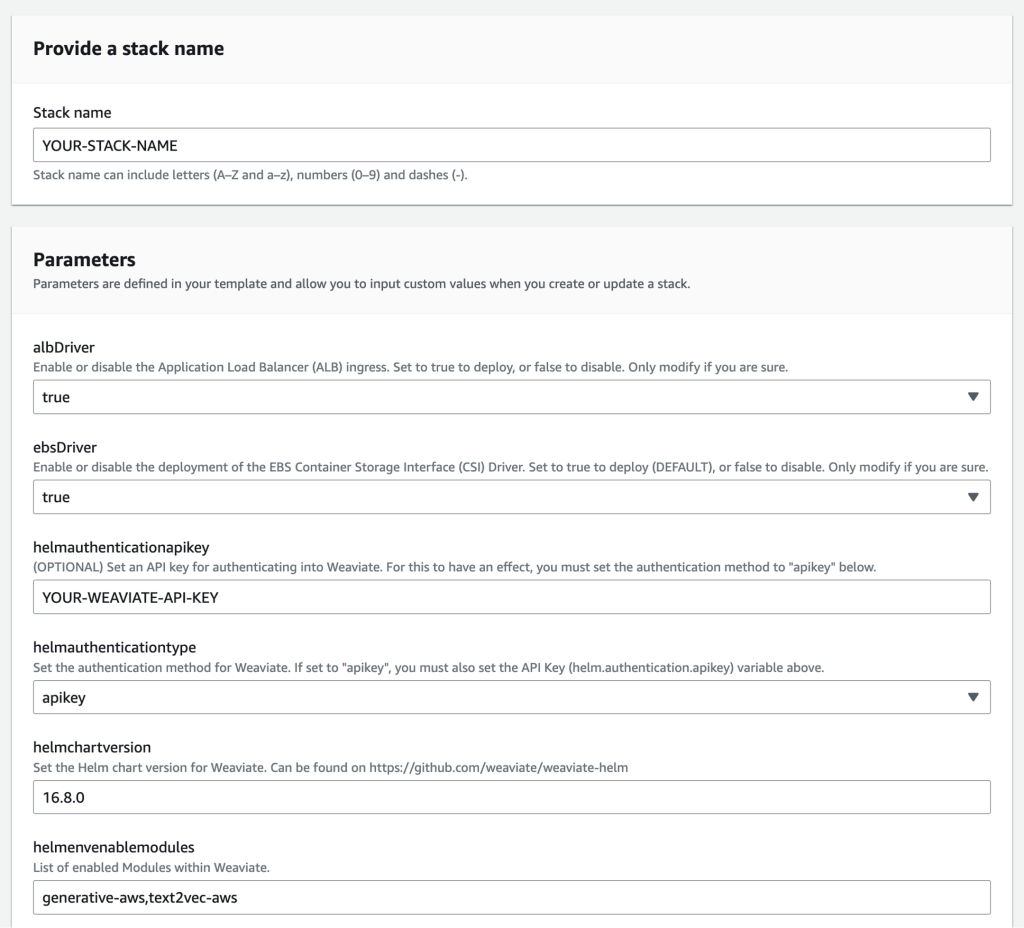

Deretter setter du opp en Weaviate-klynge.

- Abonner på Weaviate Kubernetes Cluster på AWS Marketplace.

- Start programvaren ved å bruke en CloudFormation-mal i henhold til din foretrukne tilgjengelighetssone.

CloudFormation-malen er forhåndsutfylt med standardverdier.

- Til Stabelnavn, skriv inn et stabelnavn.

- Til helautentiseringstype, anbefales det å aktivere autentisering ved innstilling

helmauthenticationtypetilapikeyog definere en helmauthenticationapikey. - Til helmauthenticationapikey, skriv inn Weaviate API-nøkkelen.

- Til helmchartversjon, skriv inn ditt versjonsnummer. Det må være minst v.16.8.0. Referere til GitHub repo for den siste versjonen.

- Til helmenabled modules, forsikre

tex2vec-awsoggenerative-awsfinnes i listen over aktiverte moduler i Weaviate.

Figur 4: CloudFormation-mal.

Denne malen tar omtrent 30 minutter å fullføre.

Koble til Weaviate

Fullfør følgende trinn for å koble til Weaviate:

- på Amazon SageMaker-konsoll, navigere til Notatboksforekomster i navigasjonsruten via bærbare > Notatboksforekomster til venstre.

- Opprett en ny notatbokforekomst.

- Installer Weaviate-klientpakken med de nødvendige avhengighetene:

- Koble til din Weaviate-forekomst med følgende kode:

- Weaviate URL – Få tilgang til Weaviate via URL-adressen til lastbalansering. I Amazon Elastic Compute Cloud (Amazon EC2) -konsoll, velg Lastbalansører i navigasjonsruten og finn lastbalanseren. Se etter kolonnen DNS-navn og legg til

http://foran den. - Weaviate API-nøkkel – Dette er nøkkelen du satte tidligere i CloudFormation-malen (

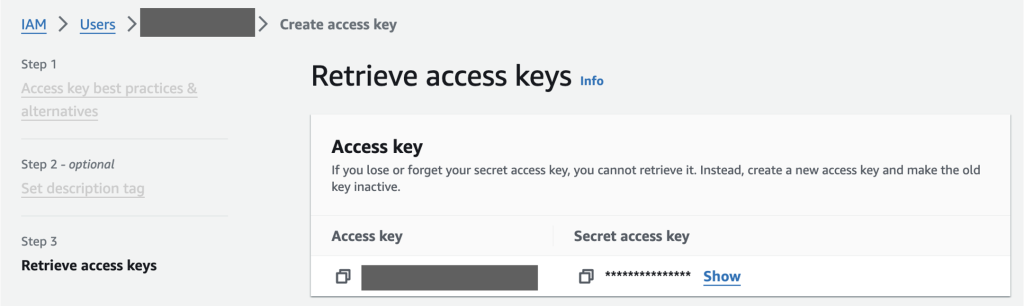

helmauthenticationapikey). - AWS tilgangsnøkkel og hemmelig tilgangsnøkkel – Du kan hente tilgangsnøkkelen og den hemmelige tilgangsnøkkelen for brukeren din i AWS identitets- og tilgangsadministrasjon (IAM) konsoll.

Figur 5: AWS Identity and Access Management (IAM)-konsoll for å hente AWS-tilgangsnøkkel og hemmelig tilgangsnøkkel.

Konfigurer Amazon Bedrock-modulen for å aktivere Cohere-modeller

Deretter definerer du en datainnsamling (class) kalt Listings å lagre oppføringenes dataobjekter, som er analogt med å lage en tabell i en relasjonsdatabase. I dette trinnet konfigurerer du de relevante modulene for å aktivere bruken av Cohere-språkmodeller som er vert på Amazon Bedrock, fra Weaviate vektordatabasen. Vectorizeren ("text2vec-aws") og generativ modul ("generative-aws“) er spesifisert i datainnsamlingsdefinisjonen. Begge disse modulene tar tre parametere:

- "service" - Bruk "

bedrock" for Amazon Bedrock (bruk alternativt "sagemaker"For Amazon SageMaker JumpStart) - "Region" – Angi regionen der modellen din er utplassert

- "modell" – Oppgi navnet på fundamentmodellen

Se følgende kode:

Ta inn data i Weaviate vektordatabasen

I dette trinnet definerer du strukturen til datainnsamlingen ved å konfigurere egenskapene. Bortsett fra egenskapens navn og datatype, kan du også konfigurere om bare dataobjektet skal lagres eller om det skal lagres sammen med dets vektorinnbygging. I dette eksemplet, host_name og property_type er ikke vektorisert:

Kjør følgende kode for å opprette samlingen i Weaviate-forekomsten din:

Du kan nå legge til objekter i Weaviate. Du bruker en batchimportprosess for maksimal effektivitet. Kjør følgende kode for å importere data. Under importen vil Weaviate bruke den definerte vektoriseringen for å lage en vektorinnbygging for hvert objekt. Følgende kode laster inn objekter, initialiserer en batchprosess og legger til objekter til målsamlingen én etter én:

Retrieval Augmented Generation

Du kan bygge en RAG-pipeline ved å implementere et generativt søk på Weaviate-forekomsten din. For dette definerer du først en ledetekstmal i form av en f-streng som kan ta inn brukerspørringen ({target_audience}) direkte og tilleggskonteksten ({{host_name}}, {{property_type}}, {{description}}og {{neighborhood_overview}}) fra vektordatabasen ved kjøretid:

Deretter kjører du et generativt søk. Dette ber den definerte generative modellen med en ledetekst som består av brukerspørringen så vel som de hentede dataene. Følgende spørring henter ett oppføringsobjekt (.with_limit(1)) fra Listings samling som ligner mest på brukersøket (.with_near_text({"concepts": target_audience})). Deretter brukersøket (target_audience) og de hentede oppføringsegenskapene (["description", "neighborhood", "host_name", "property_type"]) mates inn i ledetekstmalen. Se følgende kode:

I det følgende eksempelet kan du se at den foregående kodebiten for target_audience = “Family with small children” henter en oppføring fra verten Marre. Spørsmålsmalen er utvidet med Marres oppføringsdetaljer og målgruppen:

Basert på forespørselen med utvidet henting, genererer Cohere's Command-modell følgende målrettede annonse:

Alternative tilpasninger

Du kan gjøre alternative tilpasninger til forskjellige komponenter i den foreslåtte løsningen, for eksempel følgende:

- Coheres språkmodeller er også tilgjengelige gjennom Amazon SageMaker JumpStart, som gir tilgang til banebrytende fundamentmodeller og gjør det mulig for utviklere å distribuere LLM-er til Amazon SageMaker, en fullstendig administrert tjeneste som samler et bredt sett med verktøy for å muliggjøre høyytelse, rimelig maskinlæring for enhver bruk. Weaviate er også integrert med SageMaker.

- Et kraftig tillegg til denne løsningen er Kohere Rerank endepunkt, tilgjengelig gjennom SageMaker JumpStart. Rerangering kan forbedre relevansen til søkeresultater fra leksikalske eller semantiske søk. Reranking fungerer ved å beregne semantiske relevansskårer for dokumenter som hentes av et søkesystem og rangere dokumentene basert på disse skårene. Å legge til Rerank til en applikasjon krever bare en enkelt kodeendring.

- For å imøtekomme ulike distribusjonskrav for ulike produksjonsmiljøer, kan Weaviate distribueres på flere forskjellige måter. For eksempel er den tilgjengelig som direkte nedlasting fra Weaviate nettsted, som kjører på Amazon Elastic Kubernetes-tjeneste (Amazon EKS) eller lokalt via Docker or Kubernetes. Den er også tilgjengelig som en administrert tjeneste som kan kjøres sikkert innenfor en VPC eller som en offentlig skytjeneste hostet på AWS med en 14-dagers gratis prøveversjon.

- Du kan betjene løsningen din i en VPC ved hjelp av Amazon Virtual Private Cloud (Amazon VPC), som gjør det mulig for organisasjoner å lansere AWS-tjenester i et logisk isolert virtuelt nettverk, som ligner et tradisjonelt nettverk, men med fordelene av AWS sin skalerbare infrastruktur. Avhengig av det klassifiserte sensitivitetsnivået til dataene, kan organisasjoner også deaktivere internettilgang i disse VPC-ene.

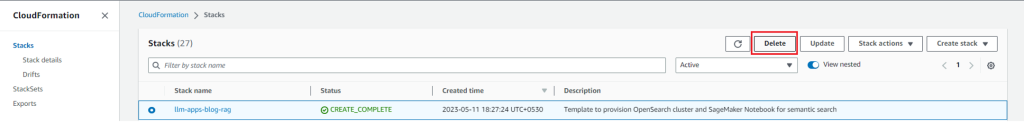

Rydd opp

For å forhindre uventede belastninger, slett alle ressursene du distribuerte som en del av dette innlegget. Hvis du startet CloudFormation-stakken, kan du slette den via AWS CloudFormation-konsollen. Merk at det kan være noen AWS-ressurser, som f.eks Amazon Elastic Block Store (Amazon EBS) volumer og AWS nøkkelstyringstjeneste (AWS KMS)-nøkler, som kanskje ikke slettes automatisk når CloudFormation-stakken slettes.

Figur 6: Slett alle ressurser via AWS CloudFormation-konsollen.

konklusjonen

Dette innlegget diskuterte hvordan bedrifter kan bygge nøyaktige, transparente og sikre generative AI-applikasjoner mens de fortsatt har full kontroll over dataene sine. Den foreslåtte løsningen er en RAG-rørledning som bruker en AI-native teknologistabel som en kombinasjon av Cohere-fundamentmodeller i Amazon Bedrock og en Weaviate-vektordatabase på AWS Marketplace. RAG-tilnærmingen gjør det mulig for bedrifter å bygge bro mellom LLMs generelle kunnskap og proprietære data, samtidig som hallusinasjoner minimeres. En AI-native teknologistabel muliggjør rask utvikling og skalerbar ytelse.

Du kan begynne å eksperimentere med RAG-konseptbevis for bedriftsklare generative AI-applikasjoner ved å bruke trinnene som er skissert i dette innlegget. Den medfølgende kildekoden er tilgjengelig i relatert GitHub-depot. Takk for at du leser. Kom gjerne med kommentarer eller tilbakemeldinger i kommentarfeltet.

Om forfatterne

James Yi er senior AI/ML Partner Solutions Architect i Technology Partners COE Tech-teamet hos Amazon Web Services. Han brenner for å jobbe med bedriftskunder og partnere for å designe, distribuere og skalere AI/ML-applikasjoner for å oppnå forretningsverdi. Utenom jobben liker han å spille fotball, reise og tilbringe tid med familien.

James Yi er senior AI/ML Partner Solutions Architect i Technology Partners COE Tech-teamet hos Amazon Web Services. Han brenner for å jobbe med bedriftskunder og partnere for å designe, distribuere og skalere AI/ML-applikasjoner for å oppnå forretningsverdi. Utenom jobben liker han å spille fotball, reise og tilbringe tid med familien.

Leonie Monigatti er en utvikleradvokat hos Weaviate. Fokusområdet hennes er AI/ML, og hun hjelper utviklere med å lære om generativ AI. Utenom jobben deler hun også lærdommene sine innen datavitenskap og ML på bloggen sin og på Kaggle.

Leonie Monigatti er en utvikleradvokat hos Weaviate. Fokusområdet hennes er AI/ML, og hun hjelper utviklere med å lære om generativ AI. Utenom jobben deler hun også lærdommene sine innen datavitenskap og ML på bloggen sin og på Kaggle.

Meor Amer er en Developer Advocate hos Cohere, en leverandør av banebrytende NLP-teknologi (natural language processing). Han hjelper utviklere med å bygge banebrytende applikasjoner med Coheres store språkmodeller (LLM).

Meor Amer er en Developer Advocate hos Cohere, en leverandør av banebrytende NLP-teknologi (natural language processing). Han hjelper utviklere med å bygge banebrytende applikasjoner med Coheres store språkmodeller (LLM).

Skyn Mao er senior AI/ML Partner Solutions Architect i Emerging Technologies-teamet hos Amazon Web Services. Han brenner for å jobbe med bedriftskunder og partnere for å designe, distribuere og skalere AI/ML-applikasjoner for å utlede deres forretningsverdier. Utenom jobben liker han å fiske, reise og spille bordtennis.

Skyn Mao er senior AI/ML Partner Solutions Architect i Emerging Technologies-teamet hos Amazon Web Services. Han brenner for å jobbe med bedriftskunder og partnere for å designe, distribuere og skalere AI/ML-applikasjoner for å utlede deres forretningsverdier. Utenom jobben liker han å fiske, reise og spille bordtennis.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/build-enterprise-ready-generative-ai-solutions-with-cohere-foundation-models-in-amazon-bedrock-and-weaviate-vector-database-on-aws-marketplace/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 10

- 100

- 11

- 12

- 13

- 16

- 17

- 19

- 23

- 30

- 32

- 33

- 7

- 8

- 9

- a

- Om oss

- adgang

- Ifølge

- Logg inn

- ansvarlighet

- nøyaktig

- tvers

- Handling

- faktiske

- legge til

- la til

- legge

- tillegg

- Ytterligere

- Tilleggsinformasjon

- I tillegg

- adressering

- Legger

- voksne

- Annonse

- advokat

- AI

- AI / ML

- airbnb

- Alle

- tillater

- langs

- allerede

- også

- alternativ

- Selv

- alltid

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- amsterdam

- an

- og

- En annen

- besvare

- noen

- api

- Søknad

- søknader

- tilnærming

- arkitektur

- ER

- AREA

- områder

- AS

- side

- At

- attraksjoner

- publikum

- øke

- augmented

- Autentisering

- automatisk

- tilgjengelighet

- tilgjengelig

- borte

- AWS

- AWS skyformasjon

- AWS Identity and Access Management (IAM)

- AWS Marketplace

- swing

- barer

- basert

- BE

- fordi

- bli

- begynt

- Fordeler

- BEST

- mellom

- milliarder

- Blokker

- Blogg

- øke

- både

- BRO

- Bringer

- bred

- bygge

- Bygning

- virksomhet

- bedrifter

- men

- by

- kafeer

- ring

- som heter

- CAN

- evner

- fangst

- saken

- imøtekomme

- sentral

- senter

- endring

- avgifter

- Barn

- valg

- Velg

- City

- klasse

- klassifisering

- klassifisert

- kunde

- Lukke

- Cloud

- Cluster

- gruppering

- kode

- samling

- Kolonne

- kombinasjon

- Kom

- kommer

- kommentarer

- Commons

- fullføre

- ferdigstillelse

- samsvar

- komponenter

- Omfattet

- Beregn

- databehandling

- konsept

- konsepter

- konfigurering

- Koble

- Vurder

- Konsoll

- kontekst

- kontekstuelle

- kontroll

- Praktisk

- beleilig

- conversational

- copywriting

- Kjerne

- skape

- Opprette

- avgjørende

- kunde

- Kunder

- tilpasse

- skjærekant

- dato

- databeskyttelse

- datavitenskap

- datasikkerhet

- Database

- databaser

- Misligholde

- definere

- definert

- definere

- definisjon

- leverer

- demonstrere

- avhengig

- avhengig

- utplassere

- utplassert

- distribusjon

- Derive

- beskrivelse

- utforming

- designet

- ønsket

- detaljer

- Utvikler

- utviklere

- Utvikling

- utviklingsteam

- forskjellig

- servering

- direkte

- direkte

- diskutert

- dns

- dokumenter

- gjort

- nedlasting

- under

- hver enkelt

- Tidligere

- lett

- Effektiv

- effektivitet

- forhøyet

- valgbarhet

- eliminere

- embed

- embedding

- Emery

- Nye teknologier

- bemyndiger

- muliggjøre

- aktivert

- muliggjør

- muliggjør

- oppmuntre

- kryptert

- ende til ende

- Motorer

- Engelsk

- sikre

- sikrer

- Enter

- Enterprise

- bedrifter

- Går inn

- Hele

- miljøer

- etter hvert

- eksempel

- dyrt

- erfaring

- Erfaringer

- ekspertise

- utvendig

- utdrag

- legge til rette

- kjent

- familie

- FAST

- Egenskaper

- Featuring

- Fed

- tilbakemelding

- føler

- Noen få

- filet

- finansiell

- finansielle tjenester

- Finn

- Først

- fiske

- fleksibilitet

- Gulv

- flyten

- Fokus

- følge

- etter

- følger

- Til

- skjema

- skjemaer

- Fundament

- fire

- Gratis

- gratis prøveperiode

- fra

- foran

- fullt

- fullt

- videre

- mellomrom

- GDPR

- general

- generell data

- Generell databeskyttelsesforskrift

- generere

- genererer

- genererer

- generasjonen

- generative

- Generativ AI

- GitHub

- gir

- mål

- Ground

- Gruppe

- Halvparten

- håndtere

- Håndtering

- Ha

- å ha

- he

- Overskrift

- Helse

- helseforsikring

- helsetjenester

- Hjerte

- tungt

- hjelpe

- hjelpe

- hjelper

- her

- høyt nivå

- høy ytelse

- hans

- Hjemprodukt

- vert

- vert

- Hvordan

- Hvordan

- http

- HTTPS

- Identitet

- if

- illustrerer

- implementere

- importere

- viktig

- forbedre

- forbedringer

- bedre

- in

- Inkludert

- stadig

- bransjer

- informasjon

- informasjonsutvinning

- Infrastruktur

- innsiden

- installere

- f.eks

- forsikring

- integrere

- integrert

- Integrerer

- intellektuell

- intellektuell eiendom

- internasjonalt

- Internet

- Internettilgang

- inn

- isolert

- IT

- DET ER

- jpg

- bare

- Hold

- holde

- nøkkel

- nøkler

- kids

- kunnskap

- Språk

- stor

- Ventetid

- siste

- lansere

- lansert

- føre

- Fører

- lekke

- LÆRE

- læring

- minst

- venstre

- Nivå

- Licensed

- Life

- Life Sciences

- linje

- Liste

- oppføring

- oppføringer

- levende

- LLM

- laste

- laster

- lokal

- lokalt

- ligger

- plassering

- logisk

- Se

- ser

- lave kostnader

- maskin

- maskinlæring

- Vedlike

- gjøre

- GJØR AT

- administrer

- fikk til

- ledelse

- markedsplass

- Master

- maksimal

- Kan..

- betyr

- midler

- Minner

- metode

- millioner

- minimere

- minutter

- ML

- modell

- modeller

- Moduler

- Moduler

- mer

- mest

- må

- navn

- fritt

- Naturlig

- Natural Language Processing

- Naviger

- Navigasjon

- Trenger

- nettverk

- aldri

- Ny

- nlp

- Nei.

- note

- bærbare

- nå

- Antall

- objekt

- gjenstander

- of

- tilby

- tilby

- on

- ONE

- bare

- drift

- Alternativ

- or

- organisasjoner

- Annen

- vår

- skissert

- utenfor

- enn

- oversikt

- egen

- pakke

- betalt

- pandaer

- brød

- parametere

- parkering

- del

- spesielt

- partner

- partnere

- lidenskapelig

- perfekt

- Utfør

- ytelse

- personlig

- personlig informasjon

- brikke

- rørledning

- Sted

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- Populær

- portabilitet

- Post

- potensiell

- makt

- kraftig

- forut

- trekkes

- forberedelse

- presentere

- forebygge

- privat

- prosess

- Bearbeidet

- Prosesser

- prosessering

- Produksjon

- produktivitet

- Produkter

- ledetekster

- bevis

- egenskaper

- eiendom

- foreslått

- proprietær

- beskytte

- beskyttelse

- gi

- leverandør

- tilbydere

- gir

- offentlig

- Offentlig sky

- spørsmål

- raskt

- fille

- Ranking

- heller

- RE

- Lese

- Lesning

- mottar

- anbefales

- redusere

- referere

- om

- region

- regulert

- regulerte næringer

- Regulering

- regulatorer

- relativt

- relevans

- relevant

- forblir

- Repository

- anmode

- påkrevd

- Krav

- Krever

- likner

- Ressurser

- svar

- svar

- ansvarlig

- REST

- restauranter

- resultere

- Resultater

- ikke sant

- Risiko

- risikere

- rom

- RAD

- Kjør

- går

- runtime

- s

- sagemaker

- skalerbar

- Skala

- Vitenskap

- VITENSKAPER

- Søk

- Søkemotorer

- Secret

- Seksjon

- seksjoner

- sikre

- sikkert

- sikkerhet

- se

- semantisk

- senior

- sensitive

- Følsomhet

- separat

- betjene

- servert

- serverer

- tjeneste

- Tjenester

- sett

- innstilling

- delt

- Aksjer

- hun

- Kort

- presentere

- lignende

- Enkelt

- forenkler

- enkelt

- størrelser

- liten

- Fotball

- Software

- løsning

- Solutions

- noen

- kilde

- kildekoden

- Rom

- spesialisert

- spesifikk

- spesifisert

- utgifter

- stable

- Begynn

- state-of-the-art

- opphold

- Trinn

- Steps

- Still

- oppbevare

- lagret

- rett fram

- struktur

- stilig

- slik

- egnet

- støtte

- Støtter

- sikker

- system

- bord

- skreddersydd

- Ta

- tar

- Target

- målrettet

- lag

- lag

- tech

- Teknisk

- Technologies

- Teknologi

- mal

- leietaker

- tekst

- Tekstklassifisering

- enn

- takk

- Det

- De

- informasjonen

- deres

- deretter

- Der.

- derfor

- Disse

- de

- tredjeparts

- denne

- tre

- Gjennom

- tid

- til

- sammen

- verktøy

- topp

- tradisjonelle

- Tog

- trent

- Kurs

- Transform

- transitt

- gjennomsiktig

- Traveling

- prøve

- tutorial

- to

- typen

- typer

- oss

- etter

- forstå

- Uventet

- uforglemmelig

- unikt

- oppdatert

- oppdateringer

- oppdatering

- oppe

- URL

- bruk

- bruke

- bruk sak

- brukt

- Bruker

- bruker

- ved hjelp av

- ferie

- verdi

- Verdier

- ulike

- Ve

- versjon

- av

- virtuelle

- volumer

- gå

- Vei..

- måter

- we

- Rikdom

- web

- webtjenester

- velkommen

- VI VIL

- var

- når

- hvilken

- mens

- HVEM

- hvem sin

- vil

- med

- innenfor

- Arbeid

- arbeidsflyt

- arbeid

- virker

- skrive

- Du

- Din

- zephyrnet