Amazon SageMaker JumpStart er Machine Learning (ML)-huben til SageMaker som tilbyr forhåndsopplærte, offentlig tilgjengelige modeller for et bredt spekter av problemtyper for å hjelpe deg med å komme i gang med maskinlæring.

Å forstå kundeatferd er det viktigste for enhver bedrift i dag. Å få innsikt i hvorfor og hvordan kunder kjøper kan bidra til å øke inntektene. Kundeavgang er et problem for et bredt spekter av selskaper, fra telekommunikasjon til bank, hvor kunder vanligvis går tapt for konkurrenter. Det er i en bedrifts beste interesse å beholde eksisterende kunder i stedet for å skaffe nye kunder, fordi det vanligvis koster betydelig mer å tiltrekke seg nye kunder. Når de prøver å beholde kunder, fokuserer bedrifter ofte på kunder som er mer sannsynlig å forlate. Brukeratferd og chatlogger for kundestøtte kan inneholde verdifulle indikatorer på sannsynligheten for at en kunde avslutter tjenesten. I denne løsningen trener og distribuerer vi en churn-prediksjonsmodell som bruker en toppmoderne NLP-modell (natural language processing) for å finne nyttige signaler i tekst. I tillegg til tekstinndata, bruker denne modellen tradisjonelle strukturerte datainndata som numeriske og kategoriske felt.

Multimodalitet er et tverrfaglig forskningsfelt som adresserer noen av de opprinnelige målene for kunstig intelligens ved å integrere og modellere flere modaliteter. Dette innlegget tar sikte på å bygge en modell som kan behandle og relatere informasjon fra flere modaliteter som tabell- og tekstfunksjoner.

Vi viser deg hvordan du trener, distribuerer og bruker en churn-prediksjonsmodell som har behandlet numeriske, kategoriske og tekstlige funksjoner for å gjøre sin prediksjon. Selv om vi dykker dypt inn i en brukscase for churn-prediksjon i dette innlegget, kan du bruke denne løsningen som en mal for å generalisere finjustering av forhåndstrente modeller med ditt eget datasett, og deretter kjøre hyperparameteroptimalisering (HPO) for å forbedre nøyaktigheten. Du kan til og med erstatte eksempeldatasettet med ditt eget og kjøre det fra ende til annen for å løse dine egne brukstilfeller. Løsningen skissert i innlegget er tilgjengelig på GitHub.

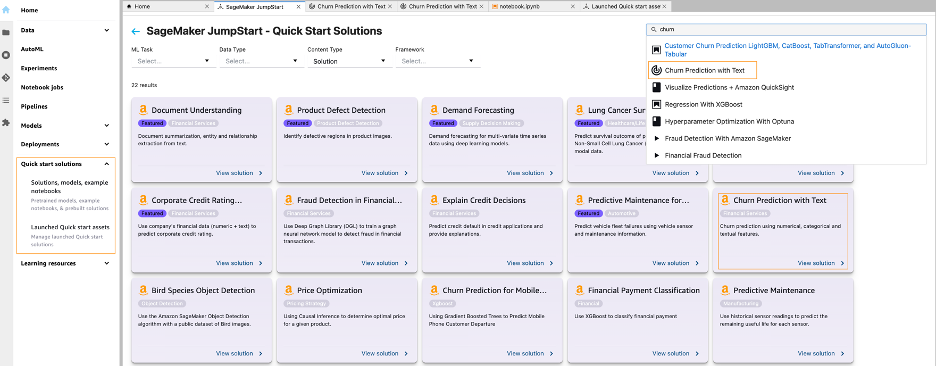

JumpStart løsningsmaler

Amazon SageMaker JumpStart gir ett-klikks, ende-til-ende-løsninger for mange vanlige ML-brukstilfeller. Utforsk følgende brukstilfeller for mer informasjon om tilgjengelige løsningsmaler:

JumpStart-løsningsmalene dekker en rekke brukstilfeller, under hver av disse tilbys flere forskjellige løsningsmaler (denne Document Understanding-løsningen er under brukstilfellet "Trekk ut og analyser data fra dokumenter").

Velg løsningsmalen som passer best for din brukssituasjon fra JumpStart-landingssiden. For mer informasjon om spesifikke løsninger under hvert brukstilfelle og hvordan du starter en JumpStart-løsning, se Løsningsmaler.

Løsningsoversikt

Følgende figur viser hvordan du kan bruke denne løsningen med Amazon SageMaker komponenter. SageMaker-opplæringsjobbene brukes til å trene de ulike NLP-modellene, og SageMaker-endepunkter brukes til å distribuere modellene i hvert trinn. Vi bruker Amazon enkel lagringstjeneste (Amazon S3) sammen med SageMaker for å lagre treningsdata og modellartefakter, og Amazon CloudWatch for å logge trening og endepunktutganger.

Vi nærmer oss å løse churn-prediksjonsproblemet med følgende trinn:

- Datautforskning for å forberede dataene til å være ML-klare.

- Tren en multimodal modell med en Hugging Face setningstransformator og Scikit-lær tilfeldig skogklassifiserer.

- Forbedre modellytelsen ytterligere med HPO-bruk SageMaker automatisk modellinnstilling.

- Tren to AutoGluon multimodale modeller: en AutoGluon multimodal vektet/stablet ensemblemodell, og en AutoGluon multimodal fusjonsmodell.

- Evaluer og sammenlign modellytelsene på holdout-testdataene.

Forutsetninger

For å prøve ut løsning på din egen konto, sørg for at du har følgende på plass:

- En AWS-konto. Hvis du ikke har en konto, kan du registrer deg for en.

- Løsningen som er skissert i innlegget er en del av SageMaker JumpStart. For å kjøre denne JumpStart-løsningen og få infrastrukturen til å distribuere til AWS-kontoen din, må du opprette en aktiv Amazon SageMaker Studio forekomst (se Ombord på Amazon SageMaker Studio). Når Studio-forekomsten din er klar, bruk instruksjonene i JumpStart for å starte løsningen.

- Når du kjører dette bærbare på Studio, bør du sørge for at Python 3 (PyTorch 1.10 Python 3.8 CPU-optimalisert) bilde/kjerne brukes.

Du kan installere de nødvendige pakkene som beskrevet i løsningen for å kjøre denne notatboken:

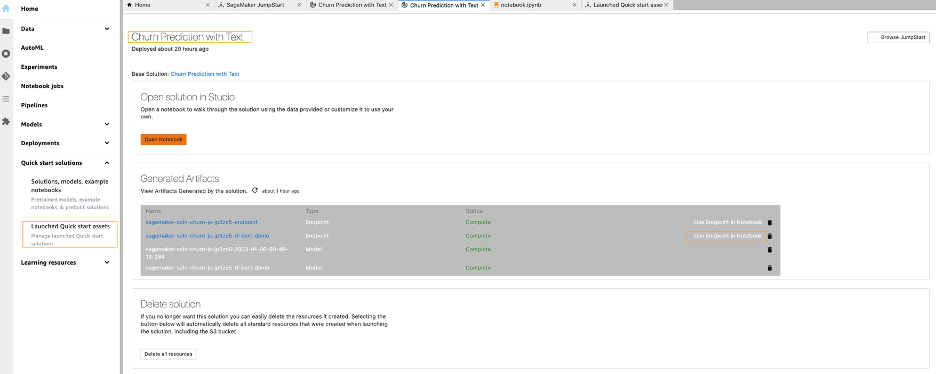

Åpne brukssaken for churn-prediksjon

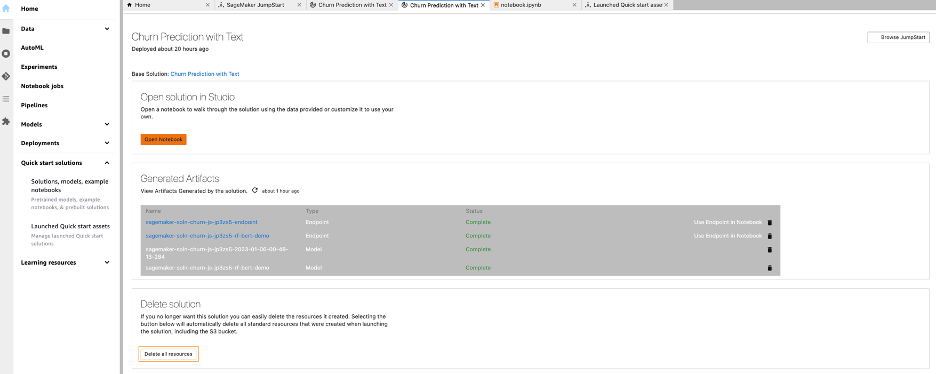

På Studio-konsollen velger du Løsninger, modeller, eksempel notatbøker etter Hurtigstartløsninger i navigasjonsruten. Naviger til Churn Prediction med tekst løsning i JumpStart.

Nå kan vi se nærmere på noen av eiendelene som inngår i denne løsningen.

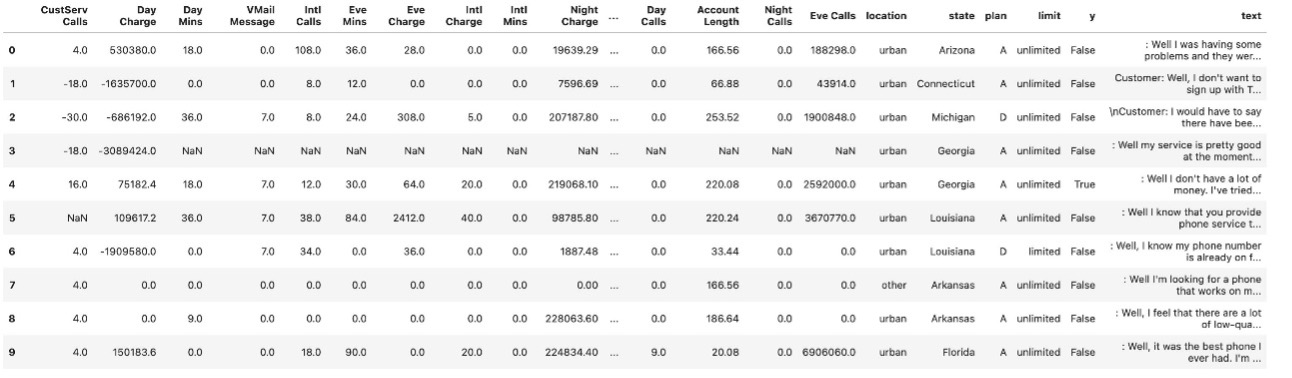

Data leting

La oss først laste ned testen, validere og trene datasettet fra S3-kilden og laste den opp til S3-bøtten vår. Følgende skjermbilde viser oss 10 observasjoner av treningsdataene.

La oss begynne å utforske tog- og valideringsdatasettet.

Som du ser har vi forskjellige funksjoner som f.eks CustServ Calls, Day Chargeog Day Calls som vi bruker til å forutsi målkolonnen y (om kunden forlot tjenesten).

y er kjent som målattributt: attributtet som vi vil at ML-modellen skal forutsi. Fordi målattributtet er binært, utfører modellen vår binær prediksjon, også kjent som binær klassifisering.

Det er 21 funksjoner, inkludert målvariabelen. Antall eksempler for opplærings- og valideringsdata er henholdsvis 43,000 5,000 og XNUMX XNUMX.

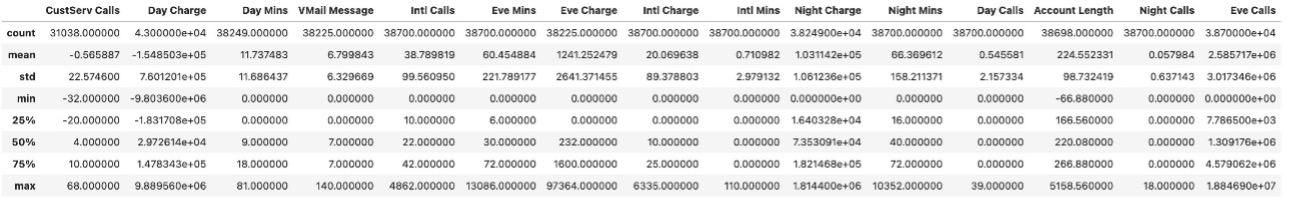

Følgende skjermbilde viser sammendragsstatistikken for treningsdatasettet.

Vi har utforsket datasettet og delt det inn i opplærings-, validerings- og testsett. Trenings- og valideringssettet brukes til trening og HPO. Testsettet brukes som holdout-sett for evaluering av modellytelse. Vi utfører nå funksjonstekniske trinn og tilpasser deretter modellen.

Tilpass en multimodal modell med en Hugging Face-setningstransformator og Scikit-learn tilfeldig skogklassifiser

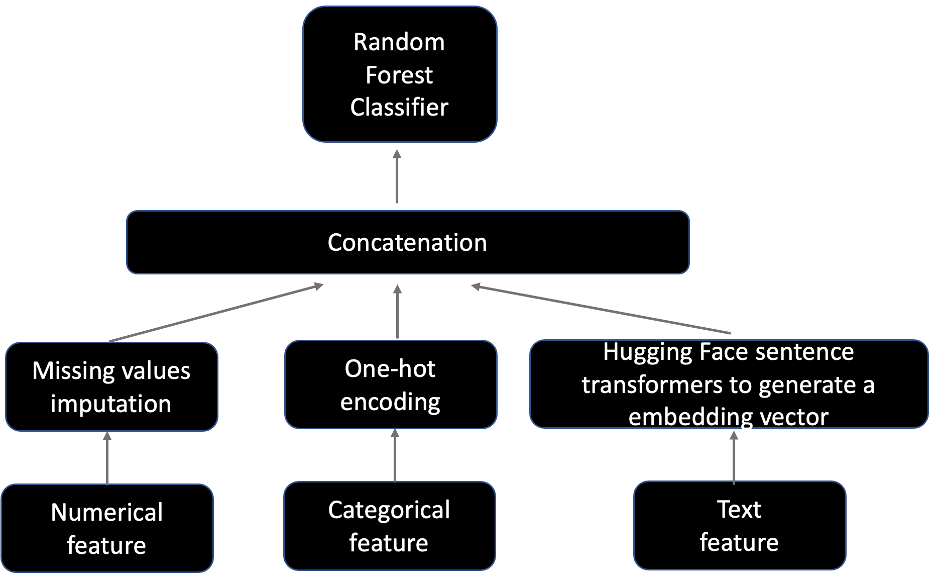

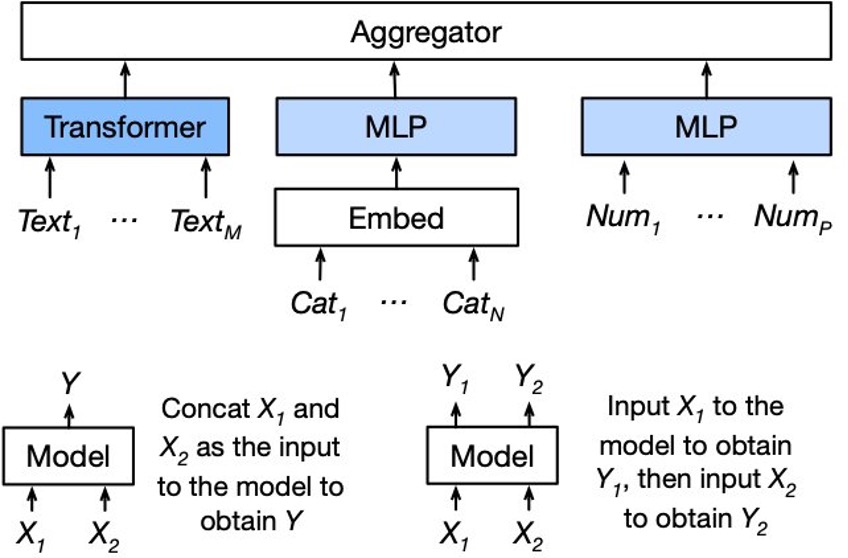

Modellopplæringen består av to komponenter: et funksjonsteknikktrinn som behandler numeriske, kategoriske og teksttrekk, og et modelltilpasningstrinn som tilpasser de transformerte funksjonene til en Scikit-lær tilfeldig skogklassifiserer.

For funksjonsutvikling fullfører vi følgende trinn:

- Fyll inn de manglende verdiene for numeriske funksjoner.

- Kod kategoriske funksjoner inn i one-hot-verdier, der de manglende verdiene regnes som en av kategoriene for hver funksjon.

- Bruk Hugging Face setningstransformator å kode tekstfunksjonen for å generere en X-dimensjonal tett vektor, hvor verdien av X avhenger av en bestemt setningstransformator.

Vi velger de tre mest nedlastede setningstransformatormodellene og bruker dem i følgende modelltilpasning og HPO. Konkret bruker vi all-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1og parafrase-MiniLM-L6-v2. For hyperparametre for den tilfeldige skogklassifisereren, se GitHub repo.

Følgende figur viser modellarkitekturdiagrammet.

Det er mange hyperparametre du kan justere, for eksempel n-estimatorer, maks-dybde og bootstrap. For flere detaljer, se GitHub repo.

For demonstrasjonsformål bruker vi kun numeriske funksjoner CustServ Calls og Account Length, kategoriske trekk planog limit, og tekstfunksjon text for å passe til modellen. Flere funksjoner bør skilles med ,.

Vi implementerer modellen etter at opplæringen er fullført:

Når vi ringer vårt nye endepunkt fra notatboken, bruker vi en SageMaker SDK Predictor. A Predictor brukes til å sende data til et endepunkt (som en del av en forespørsel) og tolke svaret. JSON brukes som format for både inndata og utdatasvar fordi det er et standard endepunktformat og endepunktsvaret kan inneholde nestede datastrukturer.

Når modellen vår er vellykket distribuert og prediktoren vår konfigurert, kan vi prøve ut churn-prediksjonsmodellen på et eksempelinndata:

Følgende kode viser responsen (sannsynligheten for churn) fra å spørre endepunktet:

Merk at sannsynligheten returnert av denne modellen ikke er kalibrert. Når modellen gir en sannsynlighet for churn på for eksempel 20 %, betyr ikke dette nødvendigvis at 20 % av kundene med 20 % sannsynlighet resulterte i churn. Kalibrering er en nyttig egenskap under visse omstendigheter, men er ikke nødvendig i tilfeller der diskriminering mellom tilfeller av churn og ikke-churn er tilstrekkelig. CalibratedClassifierCV fra Scikit lære kan brukes til å kalibrere en modell.

Nå spør vi endepunktet ved hjelp av hold-out-testdataene, som består av 1,939 XNUMX eksempler. Følgende tabell oppsummerer evalueringsresultatene for vår multimodale modell med en Hugging Face-setningstransformator og Scikit-learn tilfeldig skogklassifisering.

| Metric | BERT + Random Forest |

| Nøyaktighet | 0.77463 |

| ROC AUC | 0.75905 |

Modellytelsen er avhengig av hyperparameterkonfigurasjoner. Å trene en modell med ett sett med hyperparameterkonfigurasjoner vil ikke garantere en optimal modell. Som et resultat kjører vi HPO-prosessen i den følgende delen for å forbedre modellens ytelse ytterligere.

Monter en multimodal modell med HPO

I denne delen forbedrer vi modellytelsen ytterligere ved å legge til HPO-tuning med SageMaker automatisk modellinnstilling. SageMaker automatisk modellinnstilling, også kjent som hyperparameterinnstilling, finner den beste versjonen av en modell ved å kjøre mange treningsjobber på datasettet ved hjelp av algoritmen og rekkevidden av hyperparametere som du spesifiserer. Den velger deretter hyperparameterverdiene som resulterer i en modell som gir best ytelse, målt med en beregning du velger. Den beste modellen og dens tilsvarende hyperparametre velges på valideringsdataene. Deretter blir den beste modellen evaluert på hold-out-testdataene, som er de samme testdataene vi laget i forrige seksjon. Til slutt viser vi at ytelsen til modellen trent med HPO er betydelig bedre enn den trent uten HPO.

Følgende er statiske hyperparametre vi ikke justerer og dynamiske hyperparametre vi ønsker å justere og deres søkeområder:

Vi definerer det objektive metriske navnet, metriske definisjonen (med regex-mønster) og objektivtypen for innstillingsjobben.

Først setter vi målet som nøyaktighetsscore på valideringsdataene (roc auc score on validation data) og definerte beregninger for innstillingsjobben ved å spesifisere det objektive metriske navnet og et regulært uttrykk (regex). Det regulære uttrykket brukes til å matche algoritmens loggutdata og fange opp de numeriske verdiene til metrikkene.

Deretter spesifiserer vi hyperparameterområder for å velge de beste hyperparameterverdiene fra. Vi setter totalt antall tuningjobber til 10 og fordeler disse jobbene på fem forskjellige Amazon Elastic Compute Cloud (Amazon EC2) forekomster for å kjøre parallelle innstillingsjobber.

Til slutt sender vi disse verdiene for å instansiere et SageMaker Estimator-objekt, som ligner på det vi gjorde i forrige opplæringstrinn. I stedet for å kalle tilpasningsfunksjonen til Estimator-objektet, sender vi Estimator-objektet inn som en parameter til HyperparameterTuner konstruktør og kall opp tilpasningsfunksjonen til den for å starte innstillingsjobber:

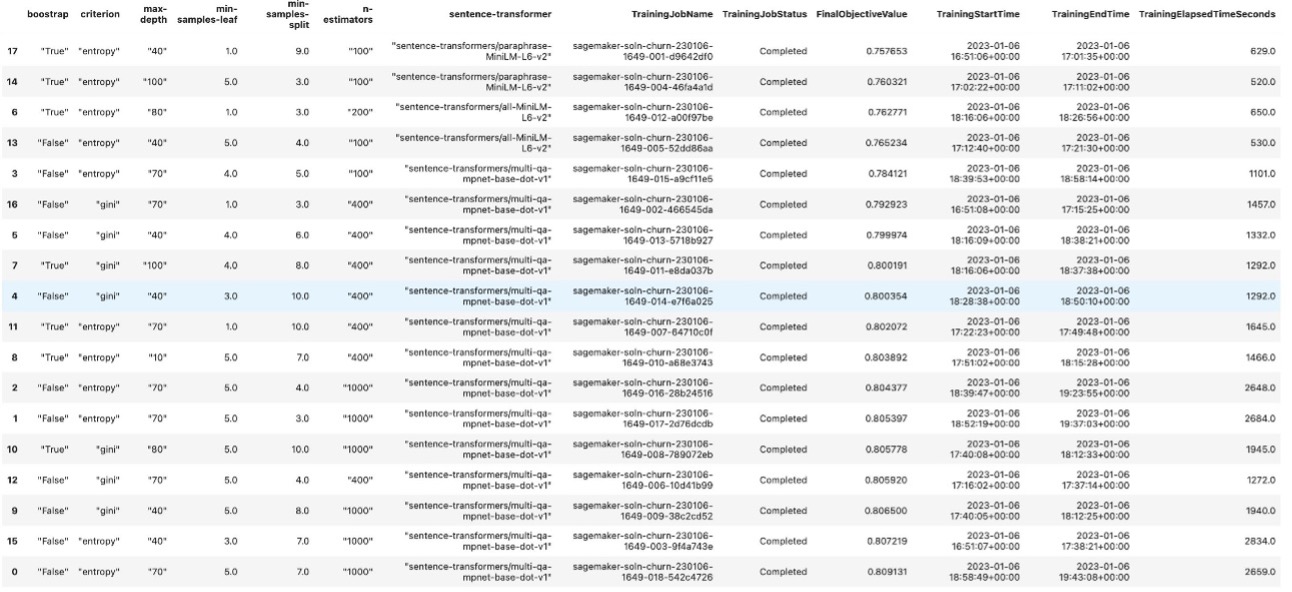

Når tuningjobben er fullført, kan vi generere sammendragstabellen over alle tuningjobbene.

Etter at innstillingsjobbene er fullført, implementerer vi modellen som gir den beste evalueringsmetriske poengsummen på valideringsdatasettet, utfører slutninger på det samme hold-out-testdatasettet som vi gjorde i forrige seksjon, og beregner evalueringsberegninger.

| Metric | BERT + Random Forest | BERT + Random Forest med HPO |

| Nøyaktighet | 0.77463 | 0.9278 |

| ROC AUC | 0.75905 | 0.79861 |

Vi kan se å kjøre HPO med SageMaker automatisk modellinnstilling forbedrer modellytelsen betydelig.

I tillegg til HPO er modellytelsen også avhengig av algoritmen. Det er viktig å trene flere toppmoderne algoritmer, sammenligne ytelsen deres på samme hold-out-testdata og finne den optimale. Derfor trener vi ytterligere to AutoGluon multimodale modeller i de følgende avsnittene.

Monter en AutoGluon multimodal vektet/stablet ensemblemodell

Det finnes to typer AutoGluon multimodalitet:

- Tren flere tabellmodeller i tillegg til

TextPredictormodell (ved å brukeTextPredictormodell innsiden avTabularPredictor), og deretter kombinere dem via enten et vektet ensemble eller stablet ensemble, som forklart i AutoGluon-tabell: Robust og nøyaktig AutoML for strukturerte data - Slå sammen flere nevrale nettverksmodeller direkte og håndtere rå tekst (som også er i stand til å håndtere flere numeriske og kategoriske kolonner)

Vi trener en multimodal vektet eller stablet ensemblemodell først i denne delen, og trener en fusjonsnevrale nettverksmodell i neste avsnitt.

Først henter vi AutoGluon-treningsbildet:

Deretter sender vi inn hyperparametre. I motsetning til eksisterende AutoML-rammeverk som primært fokuserer på valg av modell eller hyperparameter, lykkes AutoGluonTabular ved å sette sammen flere modeller og stable dem i flere lag. Derfor er HPO vanligvis ikke nødvendig for AutoGluon-ensemblemodeller.

Til slutt lager vi en SageMaker Estimator og ring estimator.fit() for å starte en treningsjobb:

Etter at opplæringen er fullført, henter vi AutoGluon-inferensbildet og distribuerer modellen:

Etter at vi har distribuert endepunktene, spør vi etter endepunktet ved hjelp av det samme testsettet og beregner evalueringsmetrikker. I den følgende tabellen kan vi se at AutoGluon multimodalt ensemble forbedrer omtrent 3 % i ROC AUC sammenlignet med BERT-setningstransformatoren og tilfeldig skog med HPO.

| Metric | BERT + Random Forest | BERT + Random Forest med HPO | AutoGluon Multimodal Ensemble |

| Nøyaktighet | 0.77463 | 0.9278 | 0.92625 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 |

Monter en AutoGluon multimodal fusjonsmodell

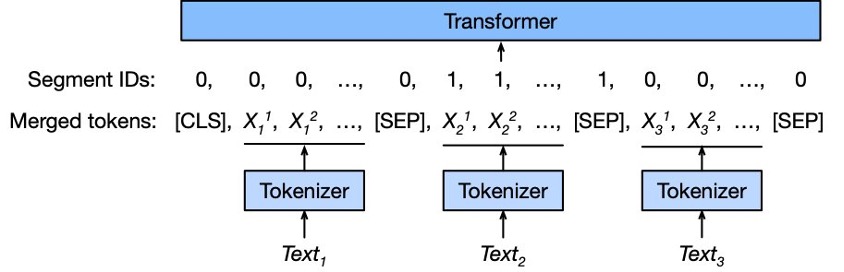

Følgende diagram illustrerer arkitekturen til modellen. For detaljer, se AutoMM for tekst + tabell – hurtigstart.

Internt bruker vi forskjellige nettverk for å kode tekstkolonner, kategoriske kolonner og numeriske kolonner. Funksjonene generert av individuelle nettverk er aggregert av en senfusjonsaggregator. Aggregeren kan sende ut både logits eller poengspådommer.

Her bruker vi den forhåndstrente NLP-ryggraden for å trekke ut tekstfunksjonene og bruker deretter to andre tårn for å trekke ut funksjonen fra den kategoriske kolonnen og den numeriske kolonnen.

I tillegg, for å håndtere flere tekstfelt, skiller vi disse feltene med [SEP]-token og veksler på 0-er og 1-er som segment-ID-ene, som vist i følgende diagram.

På samme måte følger vi instruksjonene i forrige seksjon for å trene og distribuere AutoGluon multimodal fusjonsmodell:

Følgende tabell oppsummerer evalueringsresultatene for AutoGluon multimodale fusjonsmodell, sammen med resultatene fra tre modeller som vi evaluerte i de forrige avsnittene. Vi kan se AutoGluon multimodale ensemble og multimodale fusjonsmodeller oppnå best ytelse.

| Metrics | BERT + Random Forest | BERT + Random Forest med HPO | AutoGluon Multimodal Ensemble | AutoGluon Multimodal Fusion |

| Nøyaktighet | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Merk at resultatene og den relative ytelsen mellom disse modellene avhenger av datasettet du bruker til trening. Disse resultatene er representative, og selv om tendensen til at visse algoritmer gir bedre resultater er basert på relevante faktorer, kan balansen i ytelse endres gitt en annen datafordeling. Du kan erstatte eksempeldatasettet med dine egne data for å finne ut hvilken modell som fungerer best for deg.

Demo notatbok

Du kan bruke demo-notatboken til å sende eksempeldata til allerede distribuerte modellendepunkter. Demo-notatboken lar deg raskt få praktisk erfaring ved å spørre etter eksempeldata. Etter at du har startet Churn Prediction with Text-løsningen, åpner du demo-notatboken ved å velge Bruk endepunkt i Notebook.

Rydd opp

Når du er ferdig med denne løsningen, sørg for at du sletter alle uønskede AWS-ressurser ved å velge Slett alle ressurser.

Merk at du manuelt må slette eventuelle tilleggsressurser du har opprettet i denne notatboken.

konklusjonen

I dette innlegget viste vi hvordan du kan bruke Sagemaker JumpStart til å forutsi churn ved å bruke multimodalitet av tekst og tabellfunksjoner.

Hvis du er interessert i å lære mer om kundefrafallsmodeller, sjekk ut følgende innlegg:

Om forfatterne

Dr. Xin Huang er en Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker innebygde algoritmer. Han fokuserer på å utvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er innen naturlig språkbehandling, forklarbar dyp læring på tabelldata og robust analyse av ikke-parametrisk rom-tid-klynger. Han har publisert mange artikler i ACL, ICDM, KDD-konferanser og Royal Statistical Society: Series A journal.

Dr. Xin Huang er en Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker innebygde algoritmer. Han fokuserer på å utvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er innen naturlig språkbehandling, forklarbar dyp læring på tabelldata og robust analyse av ikke-parametrisk rom-tid-klynger. Han har publisert mange artikler i ACL, ICDM, KDD-konferanser og Royal Statistical Society: Series A journal.

Rajakumar Sampathkumar er en Principal Technical Account Manager hos AWS, og gir kundene veiledning om justering av forretningsteknologi og støtter gjenoppfinnelsen av deres skyoperasjonsmodeller og -prosesser. Han er lidenskapelig opptatt av sky og maskinlæring. Raj er også en maskinlæringsspesialist og jobber med AWS-kunder for å designe, distribuere og administrere AWS-arbeidsmengdene og -arkitekturene deres.

Rajakumar Sampathkumar er en Principal Technical Account Manager hos AWS, og gir kundene veiledning om justering av forretningsteknologi og støtter gjenoppfinnelsen av deres skyoperasjonsmodeller og -prosesser. Han er lidenskapelig opptatt av sky og maskinlæring. Raj er også en maskinlæringsspesialist og jobber med AWS-kunder for å designe, distribuere og administrere AWS-arbeidsmengdene og -arkitekturene deres.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- Om oss

- Logg inn

- nøyaktighet

- nøyaktig

- Oppnå

- anskaffe

- aktiv

- tillegg

- Ytterligere

- adresser

- Etter

- Agent

- aggregator

- mål

- algoritme

- algoritmer

- Alle

- tillater

- sammen

- Selv

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon SageMaker JumpStart

- analyse

- analysere

- og

- anvendt

- tilnærming

- arkitektur

- AREA

- kunstig

- kunstig intelligens

- Eiendeler

- Automatisk

- AutoML

- tilgjengelig

- AWS

- Backbone

- Balansere

- Banking

- basert

- fordi

- BEST

- Bedre

- mellom

- Bootstrap

- bygge

- innebygd

- virksomhet

- kjøpe

- ring

- ringer

- Samtaler

- stand

- fangst

- bære

- saken

- saker

- kategorier

- viss

- sjanse

- endring

- sjekk

- Velg

- velge

- omstendigheter

- klassifisering

- nærmere

- Cloud

- gruppering

- kode

- Kolonne

- kolonner

- kombinere

- Felles

- Selskaper

- Selskapets

- sammenligne

- sammenlignet

- konkurrenter

- fullføre

- komponenter

- Beregn

- konferanser

- Konsoll

- Container

- kontrakt

- kontrakter

- Tilsvarende

- Kostnader

- dekke

- skape

- opprettet

- kunde

- kundeatferd

- Kundeservice

- Kundeservice

- Kunder

- dato

- avtale

- håndtering

- besluttet

- dyp

- dyp læring

- avhengig

- avhenger

- utplassere

- utplassert

- utforming

- detaljer

- Bestem

- utvikle

- gJORDE

- forskjellig

- direkte

- distribuere

- distribusjon

- Docker

- dokument

- ikke

- ikke

- nedlasting

- dynamisk

- hver enkelt

- innsats

- enten

- ende til ende

- Endpoint

- Ingeniørarbeid

- evaluert

- evaluering

- Selv

- eksempel

- eksempler

- eksisterende

- erfaring

- forklarte

- leting

- utforske

- utforsket

- Utforske

- trekke ut

- ekstremt

- Face

- møtt

- faktorer

- Trekk

- Egenskaper

- felt

- Felt

- Figur

- Endelig

- Finn

- funn

- Først

- passer

- fitting

- Fokus

- fokuserer

- følge

- etter

- skog

- format

- rammer

- fra

- funksjon

- videre

- fusjon

- få

- generere

- generert

- få

- gitt

- gir

- gluon

- Mål

- god

- Grow

- garantere

- håndtere

- Håndtering

- hands-on

- hjelpe

- nyttig

- Hvordan

- Hvordan

- HTML

- HTTPS

- Hub

- Optimalisering av hyperparameter

- Innstilling av hyperparameter

- identifisere

- bilde

- importere

- viktig

- forbedre

- in

- inkludert

- Inkludert

- Øke

- indikatorer

- individuelt

- informasjon

- Infrastruktur

- inngang

- innsikt

- installere

- f.eks

- i stedet

- instruksjoner

- Integrering

- Intelligens

- interesse

- interessert

- interesser

- involvert

- saker

- IT

- Jobb

- Jobb

- journal

- JSON

- nøkkel

- Type

- kjent

- landing

- Språk

- lansere

- lag

- læring

- Permisjon

- Lengde

- Sannsynlig

- BEGRENSE

- linje

- Lang

- Se

- maskin

- maskinlæring

- gjøre

- administrer

- leder

- manuelt

- mange

- Match

- Maksimer

- maksimal

- metrisk

- Metrics

- kunne

- tankene

- mangler

- ML

- modell

- modeller

- Måned

- måneder

- mer

- mest

- tverrfaglig

- flere

- navn

- Naturlig

- Natural Language Processing

- Naviger

- Navigasjon

- nødvendigvis

- Trenger

- nettverk

- nettverk

- nevrale nettverket

- Ny

- neste

- nlp

- bærbare

- Antall

- objekt

- Målet

- tilbudt

- ONE

- åpen

- drift

- optimal

- optimalisering

- optimalisert

- original

- Annen

- skissert

- egen

- pakker

- brød

- papirer

- Parallel

- parameter

- del

- Spesielt

- lidenskapelig

- Mønster

- Utfør

- ytelse

- forestillinger

- utfører

- telefon

- plukke

- Sted

- fly

- plato

- Platon Data Intelligence

- PlatonData

- Post

- innlegg

- forutsi

- prediksjon

- Spådommer

- Predictor

- Forbered

- forrige

- primært

- Principal

- Problem

- prosess

- Bearbeidet

- Prosesser

- prosessering

- eiendom

- gir

- gi

- offentlig

- publisert

- formål

- Python

- pytorch

- Rask

- raskt

- tilfeldig

- område

- Raw

- RE

- klar

- regex

- regelmessig

- relevant

- erstatte

- representant

- anmode

- påkrevd

- forskning

- Ressurser

- svar

- responsive

- resultere

- Resultater

- inntekter

- robust

- kongelig

- Kjør

- rennende

- sagemaker

- SageMaker Automatisk modellinnstilling

- samme

- skalerbar

- Forsker

- scikit lære

- SDK

- Søk

- søker

- Seksjon

- seksjoner

- segmentet

- valgt

- utvalg

- dømme

- Serien

- Serie A

- tjeneste

- sett

- sett

- flere

- bør

- Vis

- vist

- Viser

- signaler

- betydelig

- lignende

- Enkelt

- So

- Samfunnet

- løsning

- Solutions

- LØSE

- løse

- noen

- kilde

- spesialist

- spesifikk

- spesielt

- splittet

- Sprint

- stablet

- stabling

- Scene

- Standard

- Begynn

- startet

- state-of-the-art

- statistisk

- statistikk

- Trinn

- Steps

- lagring

- oppbevare

- strukturert

- studio

- I ettertid

- vellykket

- slik

- tilstrekkelig

- SAMMENDRAG

- støtte

- Støtte

- bord

- Ta

- Target

- tech

- Teknisk

- telekommunikasjon

- mal

- maler

- vilkår

- test

- De

- Området

- Kilden

- deres

- derfor

- tre

- til

- i dag

- token

- topp

- Totalt

- tradisjonelle

- Tog

- trent

- Kurs

- forvandlet

- sant

- typer

- typisk

- etter

- forståelse

- ubegrenset

- uønsket

- oppgradering

- us

- bruke

- bruk sak

- Bruker

- vanligvis

- utnytte

- VALIDERE

- validering

- Verdifull

- verdi

- Verdier

- variasjon

- ulike

- Ve

- Verizon

- versjon

- av

- Hva

- om

- hvilken

- HVEM

- bred

- Bred rekkevidde

- vil

- uten

- Arbeid

- virker

- ville

- Feil

- X

- Du

- Din

- zephyrnet