I dag er vi glade for å kunngjøre at Gemma modellen er nå tilgjengelig for kunder som bruker Amazon SageMaker JumpStart. Gemma er en familie av språkmodeller basert på Googles Gemini-modeller, trent på opptil 6 billioner tokens med tekst. Gemma-familien består av to størrelser: en 7 milliarder parametermodell og en 2 milliarder parametermodell. Nå kan du bruke Gemma 2B og Gemma 7B forhåndstrente og instruksjonsinnstilte modeller innen SageMaker JumpStart. JumpStart er maskinlæringssenteret (ML) til SageMaker som gir tilgang til grunnmodeller i tillegg til innebygde algoritmer og ende-til-ende løsningsmaler for å hjelpe deg raskt å komme i gang med ML.

I dette innlegget går vi gjennom hvordan du distribuerer Gemma-modellen og finjusterer den for brukstilfellene dine i SageMaker JumpStart. Den komplette notatboken er tilgjengelig på GitHub.

Gemma modell

Gemma er en familie av lette, toppmoderne modeller bygget fra den samme forskningen og teknologien som ble brukt til å lage Gemini modeller. Gemma er utviklet av Google DeepMind og andre team på tvers av Google, og er inspirert av Gemini. Gemma viser sterke generalistiske evner i tekstdomener og state-of-the-art forståelse og resonnement ferdigheter i skala. Den oppnår bedre ytelse sammenlignet med andre offentlig tilgjengelige modeller av lignende eller større skalaer på tvers av forskjellige domener, inkludert svar på spørsmål, sunn fornuft, matematikk og vitenskap og koding. Gemma ga ut modellvektene for å støtte utviklerinnovasjon ved å bruke Gemma-modeller. Gemma ble lansert med en ny Ansvarlig Generative AI Toolkit som gir veiledning og viktige verktøy for å lage tryggere AI-applikasjoner med Gemma.

Fundamentmodeller i SageMaker

JumpStart gir tilgang til en rekke modeller fra populære modellhuber, inkludert Hugging Face, PyTorch Hub og TensorFlow Hub, som du kan bruke i ML-utviklingsarbeidsflyten din i SageMaker. Nylige fremskritt innen ML har gitt opphav til en ny klasse modeller kjent som grunnmodeller, som vanligvis trenes på milliarder av parametere og kan tilpasses en bred kategori av brukstilfeller, for eksempel tekstoppsummering, generering av digital kunst og språkoversettelse. Fordi disse modellene er dyre å trene, ønsker kundene å bruke eksisterende forhåndstrente fundamentmodeller og finjustere dem etter behov, i stedet for å trene disse modellene selv. SageMaker gir en kurert liste over modeller som du kan velge mellom på SageMaker-konsollen.

Du kan nå finne fundamentmodeller fra forskjellige modellleverandører i JumpStart, slik at du raskt kan komme i gang med fundamentmodeller. Du kan finne fundamentmodeller basert på ulike oppgaver eller modellleverandører, og gjennomgå modellens egenskaper og bruksvilkår. Du kan også prøve disse modellene ved å bruke en test UI-widget. Når du vil bruke en grunnmodell i stor skala, kan du gjøre det uten å forlate SageMaker ved å bruke forhåndsbygde notatbøker fra modellleverandører. Fordi modellene er vert for og distribuert på AWS, blir dataene dine aldri delt med tredjeparter, enten de brukes til å evaluere modellen eller bruke den i stor skala.

La oss utforske hvordan du kan bruke Llama Guard-modellen i JumpStart.

Utforsk Gemma-modellen i Jumpstart

Du kan få tilgang til Gemma-grunnmodeller gjennom SageMaker JumpStart i SageMaker Studio UI og SageMaker Python SDK. I denne delen går vi gjennom hvordan du oppdager modellene i SageMaker Studio.

SageMaker Studio er et integrert utviklingsmiljø (IDE) som gir et enkelt nettbasert visuelt grensesnitt der du kan få tilgang til spesialbygde verktøy for å utføre alle ML-utviklingstrinn, fra å forberede data til å bygge, trene og distribuere ML-modellene dine. For mer informasjon om hvordan du kommer i gang og konfigurerer SageMaker Studio, se Amazon SageMaker Studio.

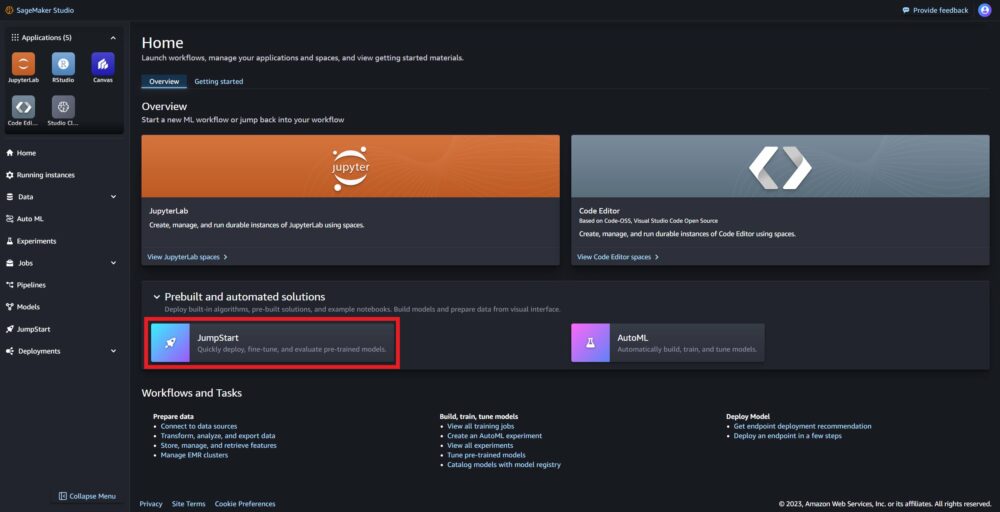

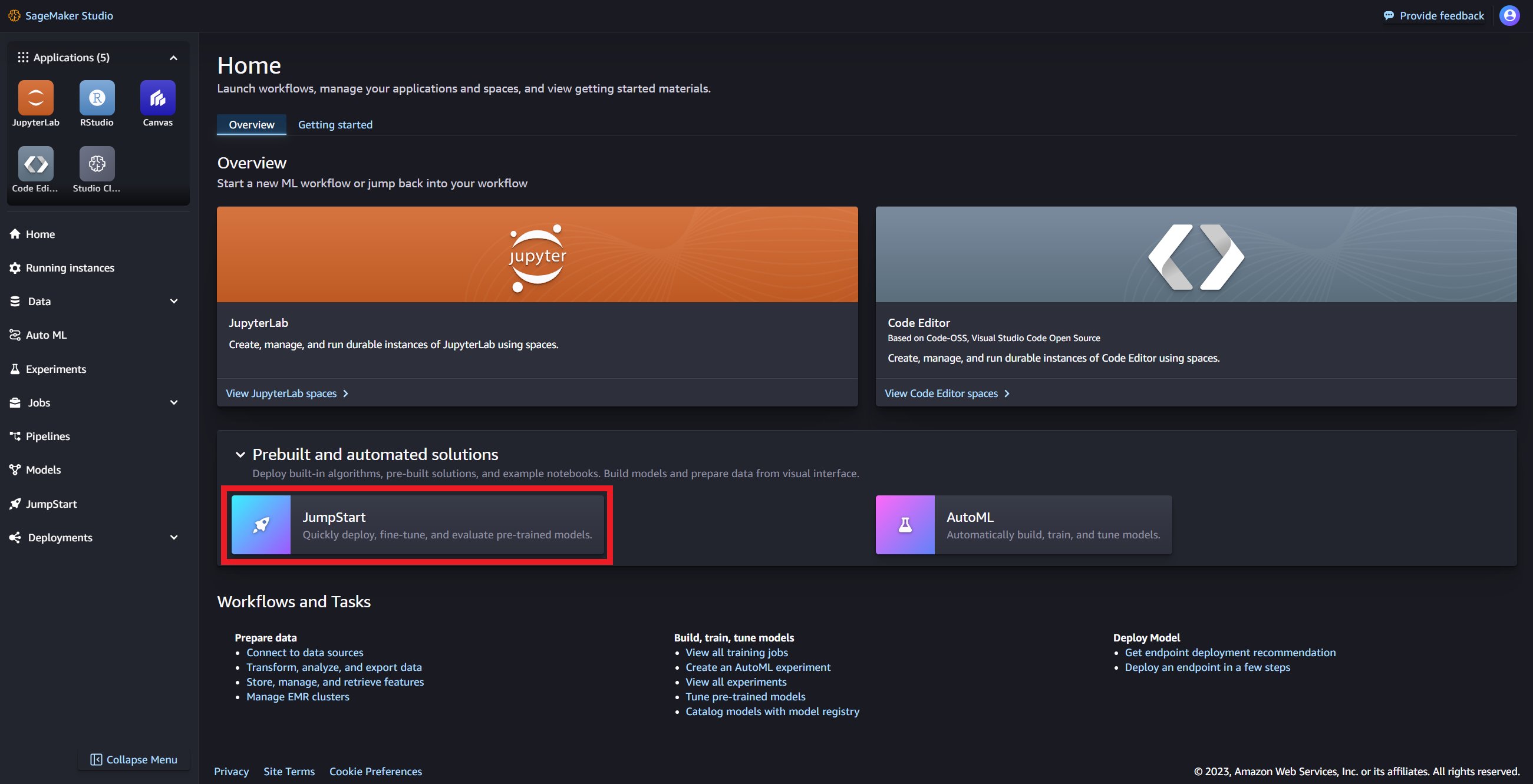

I AWS Management Console for SageMaker Studio, gå til SageMaker JumpStart under Forhåndsbygde og automatiserte løsninger. Jumpstart inneholder ferdigtrente modeller, bærbare datamaskiner og forhåndsbygde løsninger.

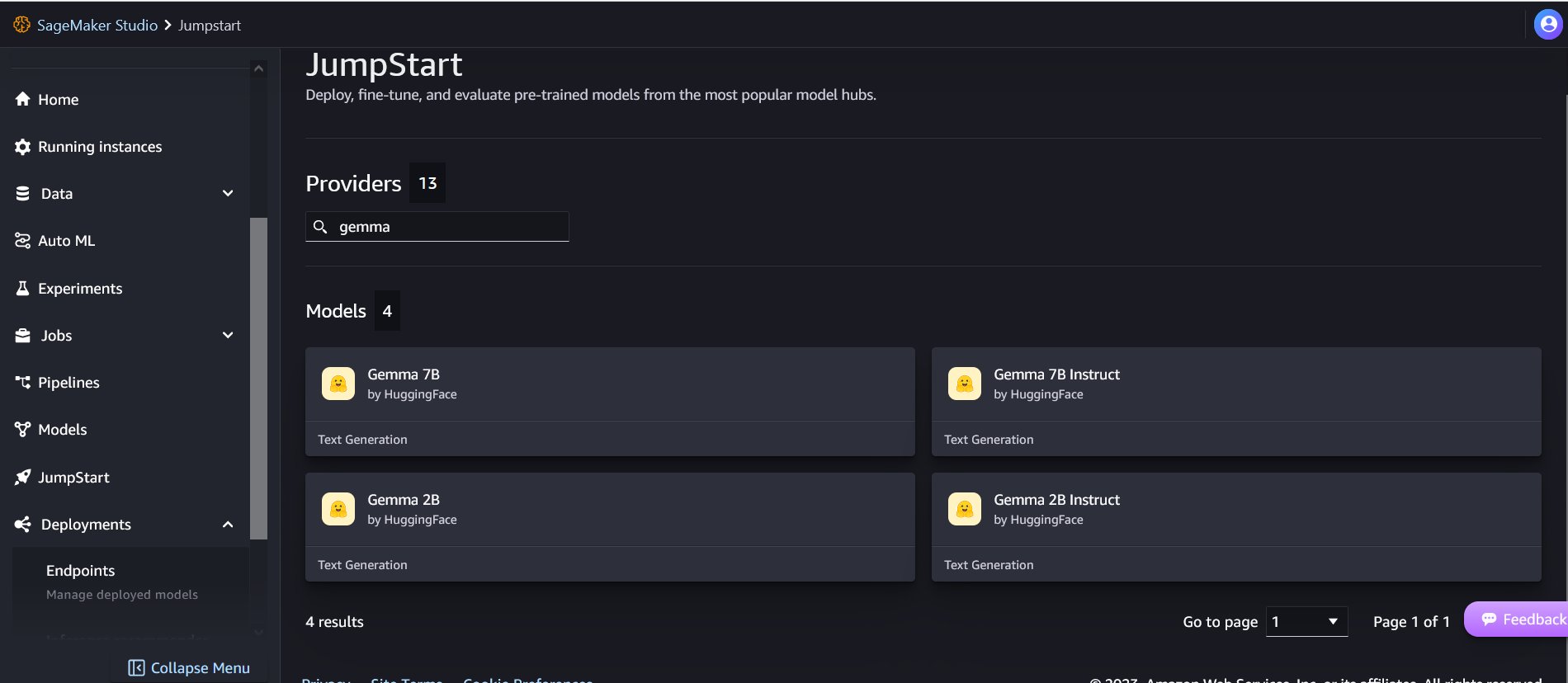

På SageMaker JumpStart-landingssiden kan du finne Gemma-modellen ved å søke etter Gemma.

Du kan deretter velge fra en rekke Gemma-modellvarianter, inkludert Gemma 2B, Gemma 7B, Gemma 2B instruct og Gemma 7B instruct.

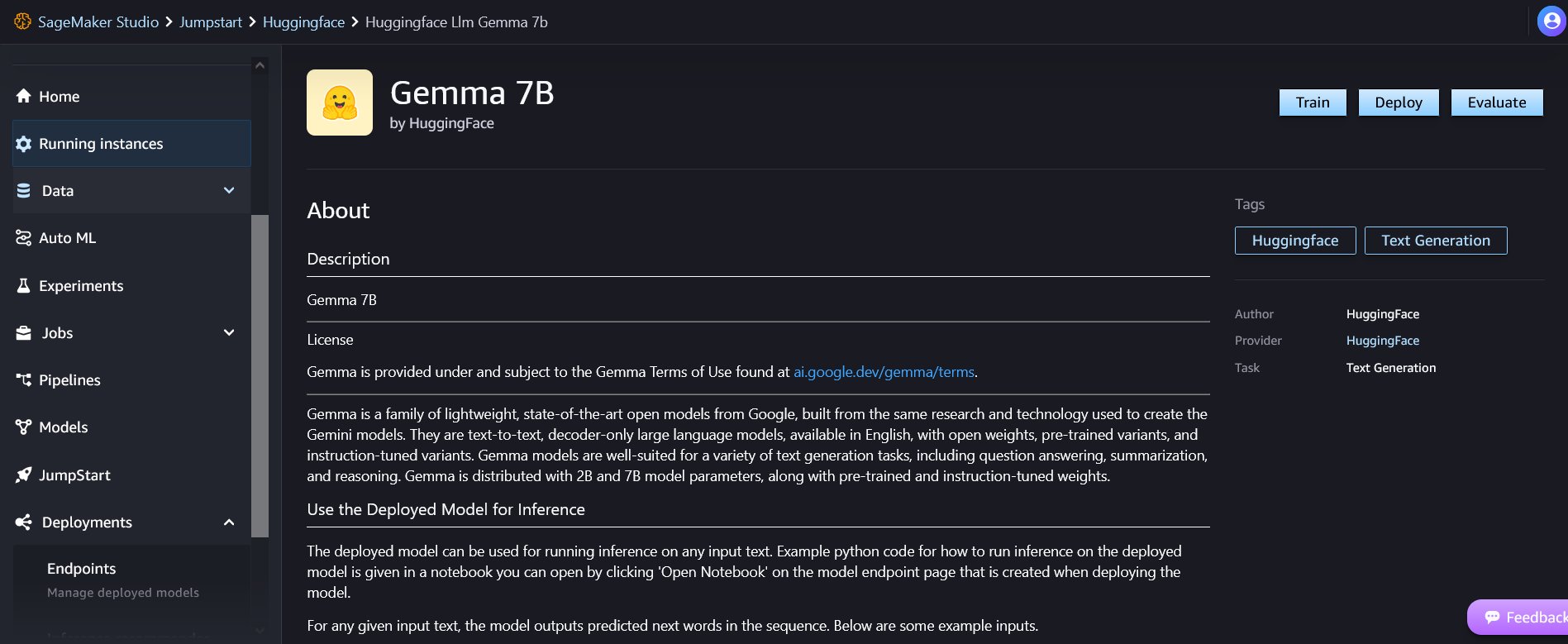

Velg modellkortet for å se detaljer om modellen, for eksempel lisensen, data som brukes til å trene, og hvordan du bruker modellen. Du finner også en Distribuer -knappen, som tar deg til en landingsside hvor du kan teste slutninger med et eksempel på nyttelast.

Distribuer Gemma med SageMaker Python SDK

Du kan finne koden som viser distribusjonen av Gemma på JumpStart og et eksempel på hvordan du bruker den distribuerte modellen i denne GitHub-notatboken.

Start med å velge SageMaker Model Hub-modell-ID og modellversjon som skal brukes når du distribuerer Gemma.

Velg en modell-ID fra følgende tabell, som beskriver standard konfigurasjonsalternativer for JumpStart-implementeringen. På grunn av den store vokabularstørrelsen på 256 tusen tokens, kan Gemma 7B bare passe på en enkelt A10G GPU når den støtter en kontekstlengde på 1 tusen. Av denne grunn bruker JumpStart en større standardforekomst for Gemma 7B.

| Modell-ID | Standard slutningsforekomst | Tensor parallell grad | Støttet kontekst Lengde |

| huggingface-llm-gemma-2b | ml.g5.xlarge | 1 | 8k |

| huggingface-llm-gemma-2b-instruct | ml.g5.xlarge | 1 | 8k |

| huggingface-llm-gemma-7b | ml.g5.12xlarge | 4 | 8k |

| huggingface-llm-gemma-7b-instruct | ml.g5.12xlarge | 4 | 8k |

Du kan nå distribuere modellen ved å bruke SageMaker JumpStart. Følgende kode bruker standardforekomsten ml.g5.12xlarge for slutningsendepunktet Du kan distribuere modellen på andre forekomsttyper ved å sende instance_type i JumpStartModel klasse. Utrullingen kan ta 5–10 minutter.

For vellykket distribusjon må du manuelt endre accept_eula argument i modellens distribusjonsmetode til True. Denne modellen er distribuert ved hjelp av tekstgenerasjonsinferens (TGI) dyplæringsbeholder.

Påkall endepunkt

Du kan programmatisk hente eksempler på nyttelast fra JumpStartModel gjenstand. Dette vil hjelpe deg å komme i gang ved å observere forhåndsformaterte instruksjoner som Gemma kan innta.

Før vi ser på spesifikke spørsmål, la oss vurdere chatmalen for Gemma Instruct-modeller.

Her plasserer du ledeteksten i [USER_PROMPT] plassering. Det er ingen støtte for en systeminstruksjon; i stedet kan du sette den ønskede instruksjonen foran på brukermeldingen. I tillegg, hvis du har en samtale med flere svinger, kan modellforespørselen veksle mellom bruker og assistent etter behov.

Vurder nå noen få instruksjonseksempler. Her ber du Gemma skrive et Hello World-program.

Følgende er forventet utgang:

Deretter påkaller du Gemma for den kreative oppgaven med å skrive et dikt.

Følgende er utgangen:

Dette ser ganske bra ut!

La oss nå se på referansemåling for ventetid og gjennomstrømming for modellservering med standard JumpStart-distribusjonskonfigurasjon. Her viser vi hvordan modellytelsen kan variere for din typiske endepunktarbeidsbelastning. I de følgende tabellene kan du observere at små spørringer (256 inputord og 256 output tokens) er ganske effektive under et stort antall samtidige brukere, og når token-gjennomstrømning i størrelsesorden tusen til to tusen tokens per sekund. Men ettersom antallet inndataord nærmer seg Gemmas maksimale støttede kontekstlengde på åtte tusen tokens, metter endepunktet sin batchkapasitet – antallet samtidige forespørsler som tillates behandlet samtidig – på grunn av minnebundne begrensninger for forekomster.

For mer informasjon om hvordan du vurderer denne informasjonen og justerer distribusjonskonfigurasjoner for din spesifikke brukssituasjon, se Benchmark og optimaliser endepunktdistribusjon i Amazon SageMaker JumpStart.

| . | Gjennomstrømning (tokens/s) | ||||||||||

| Samtidige brukere | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modell | Forekomsttype | Skriv inn ord | Output tokens | . | . | . | . | . | . | . | . |

| gemma-2b-instruks | ml.g5.xlarge | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | - | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | - | - | ||

| gemma-7b-instruks | ml.g5.12xlarge | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | - | - | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | - | - | - | ||

| . | P50-forsinkelse (ms/token) | ||||||||||

| Samtidige brukere | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| modell | Forekomsttype | Skriv inn ord | Output tokens | . | . | . | . | . | . | . | . |

| gemma-2b-instruks | ml.g5.xlarge | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | - | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | - | - | ||

| Gemma-7b-instruks | ml.g5.12xlarge | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | - | - | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | - | - | - | ||

Finjuster Gemma med SageMaker Python SDK

Deretter viser vi deg hvordan du finjusterer Gemma 7B instruksjonsmodellen på et samtaleformatert datasett ved hjelp av QLoRA teknikk. Som nevnt tidligere, på grunn av den store vokabularstørrelsen på 256 tusen og 8 tusen kontekstlengde, tilbyr JumpStart følgende standardkonfigurasjoner for QLoRA-finjustering.

| Modell-ID | Standard treningsforekomst | Maksimal lengde på inngangssekvensen | Per enhet trening batchstørrelse | Gradientakkumuleringstrinn |

| huggingface-llm-gemma-2b | ml.g5.2xlarge | 1024 | 1 | 4 |

| huggingface-llm-gemma-2b-instruct | ml.g5.2xlarge | 1024 | 1 | 4 |

| huggingface-llm-gemma-7b | ml.g5.12xlarge | 2048 | 1 | 4 |

| huggingface-llm-gemma-7b-instruct | ml.g5.12xlarge | 2048 | 1 | 4 |

La oss laste og behandle datasettet i samtaleformat. Eksempeldatasettet for denne demonstrasjonen er OpenAssistants TOP-1 samtaletråder.

Treningsdataene skal formuleres i JSON-linjer (.jsonl) format, der hver linje er en ordbok som representerer et sett med samtaler. Et eksempel i JSON-linjefilen er vist nedenfor. For detaljer om hvordan du behandler datasettet, se notatboken i GitHub.

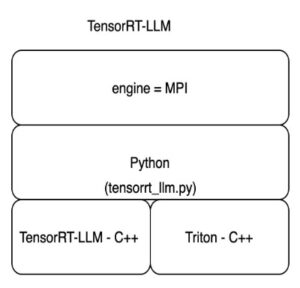

Underliggende treningsskriptene bruker JumpStart HuggingFace SFTrener med QLoRA og FlashAttention. Flash Attention muliggjør skaleringseffektivitet, noe som fører til raskere trening og slutninger. Foruten chat-basert finjustering, støtter JumpStart også instruksjon og domenetilpasning finjustering med QLoRA. For detaljer, se notatboken i GitHub.

Etter finjusteringen kan du distribuere den finjusterte modellen til et SageMaker-endepunkt.

Du kan velge å distribuere modellen finjustert på samtaledata i SageMaker-endepunktet med HuggingFace messages API-funksjon som en alternativ tilnærming. Fordelen med å bruke Message API-funksjonen er at den lar brukere sende spørringseksemplene i råformat som vist i følgende tabell, og chat_template i endepunktet vil konvertere spørringseksemplene til riktig format før de sendes inn i modellen. For detaljer, se distribusjonsdelen etter finjustering i bærbare.

Etter å ha distribuert den finjusterte modellen i et endepunkt, kan du sammenligne utdatasvar fra forhåndstrente og finjusterte Gemma-modeller. Eksemplene er samlet fra testdata, som er et hold-out-sett fra treningsdataene. Inferensparametrene er max_tokens som 512 XNUMX, top_p som 0.9 XNUMX, temperature som 0.4, og top_k som 50.

Som du kan se med finjusteringsresultatene, er agentsvarene mer nøyaktige.

For å vurdere de finjusterte modellene dine ytterligere, kan du utforske FM-evaluering med Amazon SageMaker Clarify for å se hvordan den finjusterte modellen presterer sammenlignet med basismodellen.

| Innganger | Grunnsannhet | Svar fra basen modell | Svar fra finjustert modell | |

| 1 |

Bruker: Jeg vil jobbe med vokabularet mitt, kan du gi meg noen enkle måter jeg kan finne nye ord å bruke for å øke mangfoldet i setningene mine? Assistent: Absolutt! Å forbedre vokabularet er en kontinuerlig prosess, men her er noen enkle måter å finne nye ord og øke mangfoldet av setningene dine: 1. Les mye: Å lese bøker, artikler og blogger fra forskjellige sjangre og emner utsetter deg for nye ord og uttrykk. Noter ned eventuelle ukjente ord du møter og slå opp betydningen deres. 2. Bruk en synonymordbok: Når du skriver eller leser, bruk en synonymordbok for å finne synonymer for ofte brukte ord. Dette hjelper deg ikke bare med å lære nye ord, men forbedrer også forståelsen av deres subtile meningsforskjeller. 3. Ord-en-dag-kalendere eller apper: Abonner på en ord-en-dag-e-post eller last ned en app for å bygge ordforråd. Disse verktøyene introduserer deg for et nytt ord hver dag, sammen med dets betydning, uttale og brukseksempler. 4. Bli med i en bokklubb eller diskusjonsgruppe: Å delta i samtaler og diskusjoner om bøker, artikler eller et hvilket som helst annet emne utsetter deg for forskjellige perspektiver og nytt ordforråd. Lytt oppmerksomt til andre og prøv å bruke nye ord i sammenheng. 5. Spill ordspill: Spill som Scrabble, Boggle og kryssord utfordrer vokabularferdighetene dine og hjelper deg å lære nye ord på en morsom måte. 6. Se filmer, TV-serier eller dokumentarer: Visuelle medier bruker ofte mangfoldig språk, slang og sjargong. Å se filmer, TV-serier eller dokumentarer med undertekster kan hjelpe deg bedre å forstå og huske nye ord. 7. Øv på å skrive: Regelmessig skriving av historier, essays eller journaloppføringer oppfordrer deg til å bruke nye ord og uttrykk. Eksperimenter med forskjellige skrivestiler og sjangre for å utvide ordforrådet ditt. 8. Lær et nytt ords etymologi: Å forstå opprinnelsen og historien til et ord kan gjøre det lettere å huske og bruke riktig. Å forske på etymologien utsetter deg også for relaterte ord og begreper. 9. Bruk flashcards eller repetisjonsprogramvare med mellomrom: Lag flashcards med nye ord, deres betydninger og eksempelsetninger. Gjennomgå dem regelmessig, eller bruk programvare for gjentakelse med avstander som Anki for å optimere læringen din. 10. Sett personlige mål: Sett deg oppnåelige mål, for eksempel å lære fem nye ord per uke. Følg med på fremgangen din og belønn deg selv for å nå målene dine. Ved å konsekvent innlemme disse strategiene i din daglige rutine, vil du gradvis bygge et mangfoldig og robust ordforråd. Bruker: Hm, jeg liker virkelig tanken på å lese. Kan du anbefale meg en kul science-fiction-thriller som jeg kan lese? |

Assistent: Absolutt! Her er noen anbefalinger for science fiction-thrillere som du kanskje liker: 1. "The Three-Body Problem" av Liu Cixin – Denne prisbelønte romanen utforsker den første kontakten mellom menneskeheten og en fremmed sivilisasjon, og de politiske og personlige konsekvensene som blir resultatet. Det er en gripende og tankevekkende lesning som fordyper seg i dype spørsmål om tilværelsens og universets natur. 2. «Annihilation» av Jeff Vandermeer – Denne romanen følger en gruppe forskere når de begir seg inn i et mystisk område kjent som «Area X», hvor de møter merkelige og urovekkende fenomener. Etter hvert som de går dypere inn i området, begynner de å avdekke mørke hemmeligheter om virkelighetens natur og verden rundt dem. 3. "Dark Matter" av Blake Crouch – Denne romanen følger en strålende fysiker ved navn Jason Dessen, som blir bortført og fraktet til et parallelt univers. Mens han prøver å finne tilbake til sin egen virkelighet, må han konfrontere sine egne valg og konsekvensene av sine handlinger. 4. «The Andromeda Strain» av Michael Crichton – Denne klassiske romanen følger et team av forskere mens de prøver å inneholde og studere en dødelig utenomjordisk mikrobe som har landet på jorden. Mens de raser mot tiden for å finne en måte å nøytralisere mikroben, må de også kjempe med politiske intriger og personlige konflikter. 5. "Ready Player One" av Ernest Cline – Denne romanen er satt i en dystopisk fremtid der majoriteten av befolkningen tilbringer tiden sin i en virtuell virkelighetsverden kjent som OASIS. Når skaperen av OASIS dør og etterlater seg en utfordring for å finne et skjult påskeegg, legger en ung hovedperson ut på et spennende oppdrag som vil forandre livet hans for alltid. Jeg håper en av disse anbefalingene vekker interessen din! |

Assistent: Teksten inneholder ikke informasjon om dine lesepreferanser eller interesser, derfor kan jeg ikke gi en bokanbefaling. |

Assistent: Jada, her er noen science-fiction-thrilleranbefalinger som du kanskje liker: – «Dune» av Frank Herbert: Denne episke sci-fi-romanen er satt på ørkenplaneten Arrakis, der en ung prins ved navn Paul Atreides må møte utfordringene i et fiendtlig miljø og et forrædersk politisk landskap. – «The Martian» av Andy Weir: Denne gripende sci-fi-thrilleren følger historien om Mark Watney, en astronaut strandet på Mars etter en støvstorm, mens han bruker sin oppfinnsomhet og oppfinnsomhet for å overleve og til slutt komme seg tilbake til jorden. – «The Time Machine» av HG Wells: Denne klassiske sci-fi-romanen tar en filosofisk tilnærming til konseptet tidsreise, og utforsker konsekvensene av å endre fortiden og fremtiden. – «The Blade Runner» av Philip K. Dick: Denne neo-noir sci-fi-romanen, satt i et futuristisk Los Angeles, utforsker skjæringspunktet mellom menneskelig og kunstig intelligens, og dens innflytelse på samfunnet og virkelighetens natur. – «Androidene» av Isaac Asimov: Denne sci-fi-romanen utforsker konseptet kunstig intelligens og dets potensielle konsekvenser, spesielt når mennesker utvikler avanserte androider som utfordrer tradisjonelle menneskelige verdier og tro. Dette er bare noen få forslag, og til syvende og sist vil den beste boken for deg avhenge av dine personlige preferanser og hva slags opplevelse du leter etter i en sci-fi-thriller. Men jeg håper disse anbefalingene gir deg et godt utgangspunkt for å utforske sjangeren. Gi meg beskjed hvis du har flere spørsmål eller hvis det er noe jeg kan hjelpe deg med. |

| 2 |

Bruker: Skriv et Hello World-program i VB.NET Assistent: Sånn: "`vbnet Bruker: Få den til å ta innspill fra $-en og si "Hallo, $" i stedet for "Hallo, verden!" |

Assistent: Offentlig modul HelloWorld Offentlig under hoved() System.Console.WriteLine(“Hva er navnet ditt?”) Dim navn As String = System.Console.ReadLine() System.Console.WriteLine(“Hei,” & navn & “!”) End Sub Sluttmodul |

Assistent: "`vbnet Offentlig modul HelloWorld Offentlig under hoved() Dim navn As String = Console.ReadLine() Console.WriteLine(“Hei,” & navn) End Sub Sluttmodul |

Assistent: Klart det! Her er et eksempel: "`vbnet |

| 3 |

Bruker: Gi meg en liste over ting jeg må gjøre når jeg starter et prosjekt for å trene en stor språkmodell som kan forstå og svare på menneskelige spørsmål Assistent: Følgende trinn er en komprimert liste over trinn du må ta når du starter et prosjekt for å trene en stor språkmodell som er i stand til å forstå og svare på menneskelige henvendelser: 1. Etablere prosjektets omfang og mål, målgruppe. Dette bør gi deg en grunnleggende ide om hva de nødvendige trinnene er. Bør jeg gå nærmere inn på ett av punktene? Bruker: Disse oppgavene må deles ned ytterligere, kan du gi en oppdatert oppgaveliste med en mer detaljert oversikt over oppgavene fremover |

Assistent: Her er en mer detaljert oversikt over hvert trinn: 1. Etablere prosjektets omfang og mål: Det er viktig å tydelig definere målene for prosjektet og hva målgruppen er. Dette vil hjelpe deg å ta beslutninger om hvilken type data du skal samle inn og hvilken modellarkitektur som er passende. 2. Samle inn og forhåndsbehandle data: Dette er et viktig skritt ettersom kvaliteten og mangfoldet til dataene vil direkte påvirke ytelsen til modellen. Forbehandling kan innebære å rense dataene, tokenisere tekst og konvertere ord til numeriske representasjoner. 3. Velg modellarkitektur: Det er mange forskjellige typer modeller å velge mellom, inkludert tilbakevendende nevrale nettverk (RNN), transformatormodeller og konvolusjonelle nevrale nettverk (CNN). Valget vil avhenge av de spesifikke kravene til prosjektet og mengden data som er tilgjengelig. 4. Del opp datasett og implementer dataforsterkning: Å dele opp dataene i trenings-, validerings- og testdelsett er viktig for å overvåke ytelsen til modellen under trening. Dataforstørrelse kan brukes til å kunstig øke størrelsen på datasettet og forbedre robustheten til modellen. 5. Tren modell og overvåk fremdrift: Dette trinnet innebærer å trene modellen på treningsdataene, ved å bruke valideringssettet til å overvåke fremdriften og justere hyperparametre etter behov. Det kan være nødvendig å gjenta denne prosessen flere ganger til modellen gir gode resultater på valideringssettet. 6. Evaluer modellen på testsett: Når modellen er opplært, er det viktig å evaluere ytelsen på et separat testsett for å få en ide om dens generaliseringsevne. Dette kan gjøres ved å sammenligne modellens prediksjoner med de faktiske utfallene og analysere feilene. 7. Finjuster for spesifikke oppgaver eller domener: Dette trinnet innebærer videre opplæring av modellen på oppgavespesifikke data for å forbedre ytelsen for et bestemt domene. Dette kan gjøres gjennom transfer learning, hvor en forhåndstrent modell finjusteres på nye data, eller gjennom finjustering, hvor modellen trenes fra bunnen av på de nye dataene. 8. Lag et grensesnitt for brukerinndata: Dette innebærer å designe et grensesnitt som lar brukere legge inn spørsmål eller forespørsler, og motta svar fra modellen. 9. Test i kontrollert miljø: Før du distribuerer modellen i en virkelig setting, er det viktig å teste den i et kontrollert miljø og samle tilbakemeldinger fra brukerne. Dette vil bidra til å identifisere eventuelle feil eller skjevheter i modellen og gi muligheter for forbedringer. 10. Kontinuerlig overvåke og forbedre ytelsen: Til slutt er det viktig å kontinuerlig overvåke ytelsen til modellen og gjøre oppdateringer og forbedringer etter behov. Dette kan innebære omopplæring av modellen på nye data, finjustering av hyperparametre eller oppdatering av arkitekturen. |

Assistent: ## Gjøremålsliste for opplæring av en stor språkmodell for svar på spørsmål **1. Prosjektets omfang og mål:** * Definer prosjektmål og ønskede funksjonaliteter. **2. Datainnsamling og forhåndsbehandling:** * Identifiser kilder for opplæringsdata og samle et mangfoldig tekstdatasett. **3. Modellvalg og konfigurasjon:** * Velg en passende modellarkitektur basert på oppgavens kompleksitet og ønsket ytelse. **4. Opplæring og evaluering:** * Del treningsdataene inn i delsett for opplæring, validering og testing. **5. Finjustering og grensesnittutvikling:** * Finjuster modellen for spesifikke oppgaver eller domener gjennom overføringslæring. **6. Testing og forbedring:** * Test modellen i et kontrollert miljø med ulike input-scenarier. **Ytterligere hensyn:** * Sett en tidslinje og budsjett for prosjektet. **Merk:** Denne listen er ikke uttømmende og må kanskje tilpasses basert på de spesifikke prosjektkravene. |

Assistent: Jada, her er en mer detaljert oversikt over oppgavene som er involvert i å trene en stor språkmodell for å forstå og svare på menneskelige spørsmål: **1. Etablere prosjektets omfang og mål** **2. Samle og forhåndsbehandle et omfattende/mangfoldig tekstdatasett** **3. Velg en passende modellarkitektur, juster hyperparametere for nøyaktighet/hastighet** **4. Del datasett inn i opplæring, validering, testing av delsett, implementer dataforsterkning** **5. Togmodell, overvåk fremdrift på valideringssett, juster etter behov** **6. Evaluer modell på testsett, sammenlign med benchmarks, analyser feil og skjevheter** **7. Finjuster for spesifikke oppgaver eller domener gjennom overføringslæring eller finjustering** **8. Lag grensesnitt for brukerinndata og modellrespons** **9. Test i kontrollert miljø, innhent tilbakemelding for forbedring** **10. Kontinuerlig overvåke og forbedre ytelsen gjennom omskolering og finjustering** Dette er trinnene som er involvert i å trene en stor språkmodell for å forstå og svare på menneskelige spørsmål. Gi meg beskjed hvis du har spørsmål. |

Rydd opp

Etter at du har testet endepunktene, slett SageMaker-slutningsendepunktene og modellen for å unngå kostnader.

konklusjonen

I dette innlegget viste vi deg hvordan du kommer i gang med Gemma i SageMaker Studio og distribuerer modellen for slutning. Vi viste deg også hvordan du kan finjustere Gemma-modeller på SageMaker Jumpstart.

Fordi grunnmodeller er forhåndsopplært, kan de bidra til å redusere opplærings- og infrastrukturkostnadene og muliggjøre tilpasning for ditt bruksområde. Besøk SageMaker JumpStart i SageMaker Studio nå for å komme i gang.

Denne veiledningen er kun til informasjonsformål. Du bør fortsatt utføre din egen uavhengige vurdering og iverksette tiltak for å sikre at du overholder dine egne spesifikke kvalitetskontrollpraksiser og standarder, og de lokale reglene, lovene, forskriftene, lisensene og bruksvilkårene som gjelder for deg, innholdet ditt og tredjepartsmodellen det refereres til i denne veiledningen. AWS har ingen kontroll eller autoritet over tredjepartsmodellen det refereres til i denne veiledningen, og gir ingen representasjoner eller garantier for at tredjepartsmodellen er sikker, virusfri, operativ eller kompatibel med ditt produksjonsmiljø og standarder. AWS gir ingen representasjoner, garantier eller garanterer at informasjon i denne veiledningen vil resultere i et bestemt resultat eller resultat.

Om forfatterne

Dr. Kyle Ulrich er en anvendt vitenskapsmann med Amazon SageMaker innebygde algoritmer team. Hans forskningsinteresser inkluderer skalerbare maskinlæringsalgoritmer, datasyn, tidsserier, Bayesianske ikke-parametriske og Gaussiske prosesser. Hans doktorgrad er fra Duke University og han har publisert artikler i NeurIPS, Cell og Neuron.

Dr. Kyle Ulrich er en anvendt vitenskapsmann med Amazon SageMaker innebygde algoritmer team. Hans forskningsinteresser inkluderer skalerbare maskinlæringsalgoritmer, datasyn, tidsserier, Bayesianske ikke-parametriske og Gaussiske prosesser. Hans doktorgrad er fra Duke University og han har publisert artikler i NeurIPS, Cell og Neuron.

Dr. Xin Huang er Senior Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker innebygde algoritmer. Han fokuserer på å utvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er innen naturlig språkbehandling, forklarbar dyp læring på tabelldata og robust analyse av ikke-parametrisk rom-tid-klynger. Han har publisert mange artikler i ACL, ICDM, KDD-konferanser og Royal Statistical Society: Series A.

Dr. Xin Huang er Senior Applied Scientist for Amazon SageMaker JumpStart og Amazon SageMaker innebygde algoritmer. Han fokuserer på å utvikle skalerbare maskinlæringsalgoritmer. Hans forskningsinteresser er innen naturlig språkbehandling, forklarbar dyp læring på tabelldata og robust analyse av ikke-parametrisk rom-tid-klynger. Han har publisert mange artikler i ACL, ICDM, KDD-konferanser og Royal Statistical Society: Series A.

Rachna Chadha er en hovedløsningsarkitekt AI/ML i strategiske kontoer hos AWS. Rachna er en optimist som tror at etisk og ansvarlig bruk av AI kan forbedre samfunnet i fremtiden og gi økonomisk og sosial velstand. På fritiden liker Rachna å tilbringe tid med familien, gå på tur og høre på musikk.

Rachna Chadha er en hovedløsningsarkitekt AI/ML i strategiske kontoer hos AWS. Rachna er en optimist som tror at etisk og ansvarlig bruk av AI kan forbedre samfunnet i fremtiden og gi økonomisk og sosial velstand. På fritiden liker Rachna å tilbringe tid med familien, gå på tur og høre på musikk.

Evan Kravitz er programvareingeniør hos Amazon Web Services, og jobber med SageMaker JumpStart. Han liker å lage mat og gå på løpetur i New York City.

Evan Kravitz er programvareingeniør hos Amazon Web Services, og jobber med SageMaker JumpStart. Han liker å lage mat og gå på løpetur i New York City.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker innebygde algoritmer og hjelper til med å utvikle maskinlæringsalgoritmer. Han fikk sin doktorgrad fra University of Illinois Urbana-Champaign. Han er en aktiv forsker innen maskinlæring og statistisk inferens, og har publisert mange artikler på NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP-konferanser.

Dr. Ashish Khetan er en Senior Applied Scientist med Amazon SageMaker innebygde algoritmer og hjelper til med å utvikle maskinlæringsalgoritmer. Han fikk sin doktorgrad fra University of Illinois Urbana-Champaign. Han er en aktiv forsker innen maskinlæring og statistisk inferens, og har publisert mange artikler på NeurIPS, ICML, ICLR, JMLR, ACL og EMNLP-konferanser.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/gemma-is-now-available-in-amazon-sagemaker-jumpstart/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- evne

- Om oss

- ovenfor

- Aksepterer

- adgang

- tilgjengelighet

- Logg inn

- kontoer

- akkumulering

- nøyaktighet

- nøyaktig

- oppnåelig

- oppnår

- oppkjøp

- tvers

- handlinger

- aktiv

- faktiske

- tilpasning

- tillegg

- I tillegg

- justere

- avansert

- fremskritt

- Etter

- mot

- Agent

- AI

- AI / ML

- luftfartøy

- algoritmer

- alien

- Alle

- tillate

- tillatt

- tillater

- langs

- også

- alternativ

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- beløp

- an

- analyse

- analysere

- analyser

- analyserer

- og

- og infrastruktur

- andromeda

- Angeles

- Kunngjøre

- besvare

- besvare

- svar

- noen

- hva som helst

- api

- app

- søknader

- anvendt

- Påfør

- tilnærming

- tilnærminger

- hensiktsmessig

- apps

- arkitektur

- ER

- AREA

- områder

- argument

- rundt

- Kunst

- artikler

- kunstig

- kunstig intelligens

- AS

- spør

- evaluering

- Assistent

- astronaut

- At

- publikum

- myndighet

- Automatisert

- tilgjengelig

- unngå

- Prisbelønte

- AWS

- AWS-administrasjonskonsoll

- tilbake

- balanserte

- basen

- basert

- grunnleggende

- batching

- Bayesiansk

- BE

- fordi

- før du

- begynne

- bak

- være

- tro

- mener

- under

- referansemåling

- benchmarks

- nytte

- foruten

- BEST

- Bedre

- mellom

- Bias

- skjevheter

- Milliarder

- milliarder

- BLAD

- Blokker

- Blogg

- blogger

- Bloom

- kroppen

- bok

- bøker

- Breakdown

- brilliant

- bringe

- Bringe

- Bringer

- Brutt

- budsjett

- bygge

- Bygning

- bygget

- innebygd

- men

- knapp

- by

- kalendere

- ring

- som heter

- CAN

- kan ikke

- lerret

- evner

- stand

- kort

- saken

- saker

- Kategori

- forsiktighet

- celle

- utfordre

- utfordringer

- endring

- egenskaper

- avgifter

- chatte

- Sjekker

- valg

- valg

- Velg

- City

- Civilization

- klasse

- Classic

- ren

- Rengjøring

- klart

- klikk

- klubb

- gruppering

- kode

- Koding

- samarbeid

- kommer

- vanligvis

- sammenligne

- sammenlignet

- sammenligne

- sammenligning

- kompatibel

- fullføre

- kompleksiteten

- kompleksitet

- overholde

- datamaskin

- Datamaskin syn

- konsept

- konsepter

- samtidig

- konferanser

- Konfigurasjon

- konflikter

- Konsekvenser

- Vurder

- betraktninger

- vurderer

- konsekvent

- består

- Konsoll

- konstant

- begrensninger

- kontakt

- inneholde

- Container

- inneholder

- strides

- innhold

- kontekst

- kontinuerlig

- kontroll

- kontrolleres

- Samtale

- conversational

- samtaler

- konvertere

- konvertering

- Kul

- riktig

- Kostnader

- kunne

- skape

- Opprette

- Kreativ

- skaperen

- kryssord

- kuratert

- nysgjerrig

- Gjeldende

- Kunder

- tilpasning

- daglig

- danse

- mørk

- dato

- datasett

- dag

- avgjørelser

- dyp

- dyp læring

- dypere

- DeepMind

- Misligholde

- definere

- definerer

- dybden

- dykker

- demonstrasjon

- avhenge

- utplassere

- utplassert

- utplasserings

- distribusjon

- ØRKEN

- utforming

- utforme

- ønsket

- detalj

- detaljert

- detaljer

- Bestem

- utvikle

- utviklet

- Utvikler

- utvikle

- Utvikling

- enhet

- diagnostisering

- Dialog

- avvike

- forskjeller

- forskjellig

- digitalt

- digital kunst

- direkte

- katalog

- oppdage

- diskusjon

- diskusjoner

- sykdommer

- dykk

- diverse

- Mangfold

- dele

- do

- dokument

- dokumentarer

- gjør

- domene

- domener

- gjort

- ned

- nedlasting

- to

- Duke

- duke universitetet

- under

- Støv

- dystopisk

- hver enkelt

- jord

- enklere

- effektivitet

- åtte

- emalje

- Empire

- muliggjøre

- muliggjør

- muliggjør

- møte

- oppmuntrer

- ende til ende

- Endpoint

- engasjerende

- ingeniør

- Forbedrer

- nyte

- hyggelig

- sikre

- Miljø

- EPIC

- feil

- avgjørende

- etablere

- etisk

- evaluere

- evaluere

- evaluering

- etter hvert

- Hver

- eksempel

- eksempler

- opphisset

- omfattende

- utstillinger

- eksistens

- eksisterende

- Expand

- forventet

- dyrt

- erfaring

- eksperiment

- eksperter

- utforske

- utforsker

- Utforske

- Face

- rettferdighet

- falsk

- familie

- raskere

- Trekk

- tilbakemelding

- Feet

- Noen få

- felt

- slåss

- filet

- Endelig

- Finn

- funn

- slutt

- Først

- første kontakt

- passer

- fem

- Blitz

- flytur

- fokuserer

- etter

- følger

- Til

- for alltid

- format

- Fundament

- Rammeverk

- frank

- fra

- funksjon

- funksjonalitet

- funksjonalitet

- funksjon

- videre

- framtid

- futuristiske

- Games

- samle

- Gemini

- genererer

- generative

- Generativ AI

- genre

- sjangere

- få

- GitHub

- Gi

- gitt

- Go

- Mål

- skal

- god

- Googles

- fikk

- GPU

- nåde

- gradvis

- flott

- stor kraft

- Gruppe

- garantier

- Guard

- veiledning

- veilede

- førings

- hånd

- seletøy

- Ha

- he

- høyde

- Hallo

- hjelpe

- hjelper

- her

- her.

- skjult

- hans

- historie

- håp

- vert

- Hvordan

- Hvordan

- Men

- HTML

- HTTPS

- Hub

- huber

- Klem ansikt

- menneskelig

- Menneskeheten

- Mennesker

- i

- ID

- Tanken

- identifisere

- if

- Illinois

- bilder

- Påvirkning

- iverksette

- gjennomføring

- importere

- viktig

- forbedre

- forbedring

- forbedringer

- bedre

- in

- inkludere

- Inkludert

- innlemme

- Øke

- uavhengig

- industri

- industristandarder

- påvirke

- informasjon

- Informativ

- Infrastruktur

- oppfinnsomhet

- Innovasjon

- inngang

- innganger

- forespørsler

- innsikt

- inspirert

- f.eks

- i stedet

- integrere

- integrert

- Intelligens

- hensikt

- interaksjon

- interesser

- Interface

- kryss

- inn

- introdusere

- intuitiv

- involvere

- involvert

- innebærer

- IT

- varer

- DET ER

- sjargong

- bli medlem

- journal

- reise

- jpg

- JSON

- bare

- Hold

- Type

- Vet

- kunnskap

- kjent

- Kyle

- landing

- landskap

- Språk

- stor

- større

- Ventetid

- lansert

- Lover

- ledende

- LÆRE

- læring

- lærer

- forlater

- Lengde

- la

- Nivå

- Leverage

- Tillatelse

- lisenser

- Life

- Lyn

- Lysets hastighet

- lettvekt

- i likhet med

- liker

- linje

- linjer

- Liste

- lytte

- Lytting

- lytter

- Llama

- laste

- lokal

- plassering

- Se

- ser

- UTSEENDE

- den

- Los Angeles

- lavere

- maskin

- maskinlæring

- Flertall

- gjøre

- skadelig

- ledelse

- manuelt

- mange

- merke

- Mars

- matematikk

- maksimal

- Kan..

- me

- betyr

- betydninger

- målinger

- Media

- medisin

- møte

- nevnt

- melding

- meldinger

- metode

- Michael

- kunne

- tankene

- minutter

- ML

- modell

- modeller

- Moduler

- Overvåke

- overvåking

- mer

- mest

- Filmer

- musikk

- må

- my

- mystisk

- navn

- oppkalt

- Naturlig

- Natural Language Processing

- Natur

- nødvendig

- Trenger

- nødvendig

- behov

- nettverk

- nevrale

- nevrale nettverk

- aldri

- Ny

- New York

- New York City

- natt

- Nei.

- note

- bærbare

- roman

- nå

- Antall

- Oasis

- objekt

- mål

- observere

- of

- Tilbud

- ofte

- on

- gang

- ONE

- pågående

- bare

- operasjonell

- Muligheter

- optimalisering

- Optimalisere

- alternativer

- or

- rekkefølge

- opprinnelse

- OS

- Annen

- andre

- ut

- Utfallet

- utfall

- produksjon

- enn

- egen

- side

- papirer

- Parallel

- parameter

- parametere

- Spesielt

- spesielt

- parter

- passere

- Passerer

- Past

- banen

- mønstre

- paul

- Ansatte

- for

- Utfør

- ytelse

- utfører

- utfører

- personlig

- prospektet

- phd

- setninger

- fysiker

- pilot

- Sted

- planet

- planer

- plato

- Platon Data Intelligence

- PlatonData

- Spille

- spiller

- vær så snill

- Point

- poeng

- politisk

- Populær

- befolkningen

- Post

- potensiell

- makt

- praksis

- praksis

- Spådommer

- Predictor

- preferanser

- forbereder

- pen

- tidligere

- Prince

- Principal

- utskrifter

- prosess

- Bearbeidet

- Prosesser

- prosessering

- Produksjon

- program

- Progress

- prosjekt

- ledetekster

- ordentlig

- velstand

- gi

- tilbydere

- gir

- offentlig

- offentlig

- publisert

- formål

- Puslespill

- Python

- pytorch

- kvalitet

- spørsmål

- spørring

- søken

- spørsmål

- spørsmål

- raskt

- ganske

- Race

- ramifications

- område

- heller

- Raw

- nå

- Lese

- Lesning

- virkelige verden

- Reality

- virkelig

- riket

- grunnen til

- motta

- nylig

- Anbefaling

- anbefalinger

- anbefale

- tilbakevendende

- referanse

- refererte

- Gjenspeiler

- regelmessig

- forskrifter

- i slekt

- utgitt

- relevant

- husker

- gjenta

- representerer

- forespørsler

- påkrevd

- Krav

- forskning

- forsker

- Svare

- svare

- svar

- svar

- ansvar

- ansvarlig

- resultere

- Resultater

- anmeldelse

- Belønn

- Rise

- robust

- robusthet

- Rolle

- rutine

- kongelig

- regler

- Kjør

- går

- s

- sikrere

- sagemaker

- SageMaker Inference

- samme

- Spar

- sier

- skalerbar

- Skala

- vekter

- skalering

- scenarier

- sci-fi

- Vitenskap

- Forsker

- forskere

- omfang

- skraper

- script

- skript

- SDK

- sømløs

- søker

- Sekund

- hemmeligheter

- Seksjon

- sikre

- se

- velg

- valgt

- velge

- utvalg

- sending

- senior

- separat

- Sequence

- Serien

- Serie A

- Tjenester

- servering

- Session

- sett

- sett

- innstilling

- flere

- delt

- bør

- Vis

- viste

- viser

- vist

- Viser

- side

- lignende

- Enkelt

- enkelt

- Størrelse

- størrelser

- ferdigheter

- So

- selskap

- Samfunnet

- Software

- Software Engineer

- løsning

- Solutions

- noen

- Kilder

- Sparks

- spesifikk

- fart

- utgifter

- tilbringer

- stå

- standarder

- startet

- Start

- Tilstand

- state-of-the-art

- Uttalelse

- statistisk

- Trinn

- Steps

- Still

- Stories

- Storm

- Story

- merkelig

- Strategisk

- strategier

- String

- sterk

- studio

- Studer

- abonnere

- tekster

- vellykket

- slik

- egnet

- støtte

- Støttes

- Støtte

- Støtter

- sikker

- overleve

- system

- bord

- Ta

- tar

- fortelling

- Target

- mål

- Oppgave

- oppgaver

- lag

- lag

- teknikk

- teknikker

- Teknologi

- mal

- maler

- tensorflow

- vilkår

- test

- testet

- Testing

- tekst

- enn

- Det

- De

- Området

- Fremtiden

- verden

- deres

- Dem

- seg

- deretter

- Der.

- derfor

- Disse

- de

- Tredje

- tredjeparter

- tredjeparts

- denne

- De

- trodde

- tankevekkende

- tusen

- spennende

- Gjennom

- gjennomstrømning

- tid

- Tidsserier

- tidsreiser

- tidslinje

- ganger

- til

- token

- tokenizing

- tokens

- fortalte

- verktøy

- verktøy

- Tema

- Totalt

- spor

- tradisjonelle

- Tog

- trent

- Kurs

- overføre

- Overføre

- transformator

- Oversettelse

- reiser

- Trillion

- sant

- prøve

- melodi

- tuned

- tuning

- tv

- to

- typen

- typer

- typisk

- typisk

- ui

- Til syvende og sist

- avdekke

- etter

- forstå

- forståelse

- ukjent

- Universe

- universitet

- uovertruffen

- til

- avdukingen

- oppdatert

- oppdateringer

- oppdatering

- us

- brukervennlighet

- bruk

- bruke

- bruk sak

- brukt

- Bruker

- brukervennlig

- Brukere

- bruker

- ved hjelp av

- validering

- Verdier

- variasjon

- ulike

- venture-

- versjon

- Se

- virtuelle

- Virtuell virkelighet

- syn

- Besøk

- visuell

- visuelle medier

- volum

- gå

- ønsker

- garantier

- var

- Se

- se

- Vei..

- måter

- we

- web

- webtjenester

- Web-basert

- uke

- VI VIL

- Wells

- Hva

- Hva er

- når

- når som helst

- om

- hvilken

- HVEM

- bred

- allment

- widget

- vil

- visdom

- med

- innenfor

- uten

- ord

- ord

- Arbeid

- arbeidsflyt

- arbeid

- verden

- skrive

- skriving

- X

- york

- Du

- Young

- Din

- deg selv

- zephyrnet