Dette innlegget er skrevet av Shirsha Ray Chaudhuri, Harpreet Singh Baath, Rashmi B Pawar og Palvika Bansal fra Thomson Reuters.

Thomson Reuters (TR), et globalt innholds- og teknologidrevet selskap, har brukt kunstig intelligens (AI) og maskinlæring (ML) i sine profesjonelle informasjonsprodukter i flere tiår. Thomson Reuters Labs, selskapets dedikerte innovasjonsteam, har vært integrert i dets banebrytende arbeid innen AI og naturlig språkbehandling (NLP). En viktig milepæl var lanseringen av Westlaw Is Natural (WIN) i 1992. Denne teknologien var en av de første i sitt slag, og brukte NLP for mer effektiv og naturlig juridisk forskning. Spol frem til 2023, og Thomson Reuters fortsetter å definere fremtiden til profesjonelle gjennom rask innovasjon, kreative løsninger og kraftig teknologi.

Introduksjonen av generativ kunstig intelligens gir Thomson Reuters enda en mulighet til å jobbe med kunder og igjen fremme hvordan de gjør arbeidet sitt, og hjelper fagfolk med å få innsikt og automatisere arbeidsflyter, slik at de kan fokusere tiden sin der det betyr mest. Mens Thomson Reuters flytter grensene for hva generativ AI og andre teknologier kan gjøre for den moderne profesjonelle, hvordan bruker den kraften til denne teknologien for sine egne team?

Thomson Reuters er sterkt fokusert på å skape bevissthet og forståelse for AI blant kolleger i alle team og alle forretningsområder. Med utgangspunkt i grunnleggende prinsipper for hva som er AI og hvordan fungerer ML, leverer det et rullerende program med selskapsomfattende AI-bevissthetsøkter, inkludert webinarer, opplæringsmateriell og paneldiskusjoner. I løpet av disse øktene dukket det opp ideer om hvordan AI kunne brukes etter hvert som kolleger vurderte hvordan de kunne bruke verktøy som hjalp dem med å bruke AI til sine daglige oppgaver samt betjene kundene sine.

I dette innlegget diskuterer vi hvordan Thomson Reuters Labs skapte Open Arena, Thomson Reuters sin virksomhetsomfattende lekeplass for store språkmodeller (LLM) som ble utviklet i samarbeid med AWS. Det originale konseptet kom fra et AI/ML Hackathon støttet av Simone Zucchet (AWS Solutions Architect) og Tim Precious (AWS Account Manager) og ble utviklet til produksjon ved bruk av AWS-tjenester på under 6 uker med støtte fra AWS. AWS-administrerte tjenester som f.eks AWS Lambda, Amazon DynamoDBog Amazon SageMaker, samt de forhåndsbygde Hugging Face Deep Learning Containers (DLCs), bidro til innovasjonstakten. Open Arena har bidratt til å låse opp virksomhetsomfattende eksperimentering med generativ AI i et trygt og kontrollert miljø.

Å dykke dypere er Open Arena en nettbasert lekeplass som lar brukere eksperimentere med et voksende sett med verktøy aktivert med LLM-er. Dette gir ikke-programmatisk tilgang for Thomson Reuters-ansatte som ikke har bakgrunn i koding, men som ønsker å utforske kunsten til det mulige med generativ AI hos TR. Open Arena er utviklet for å få raske svar fra flere sett med korpus, som for kundestøtteagenter, løsninger for å få raske svar fra nettsider, løsninger for å oppsummere og verifisere poeng i et dokument, og mye mer. Mulighetene til Open Arena fortsetter å vokse ettersom erfaringene fra ansatte på tvers av Thomson Reuters ansporer til nye ideer og etter hvert som nye trender dukker opp innen generativ AI. Alt dette tilrettelegges av den modulære serverløse AWS-arkitekturen som underbygger løsningen.

Ser for seg den åpne arenaen

Thomson Reuters mål var klart: å bygge en trygg, sikker, brukervennlig plattform – en «åpen arena» – som en virksomhetsomfattende lekeplass. Her kunne interne team ikke bare utforske og teste de ulike LLM-ene som er utviklet internt og de fra åpen kildekode-fellesskapet, for eksempel med AWS og Hugging Face-partnerskapet, men også oppdage unike brukstilfeller ved å slå sammen mulighetene til LLMs med Thomson Reuters sine omfattende bedriftsdata. Denne typen plattform vil forbedre teamenes evne til å generere innovative løsninger, og forbedre produktene og tjenestene som Thomson Reuters kan tilby sine kunder.

Den planlagte Open Arena-plattformen vil tjene de forskjellige teamene i Thomson Reuters globalt, og gi dem en lekeplass for fritt å samhandle med LLM-er. Evnen til å ha denne interaksjonen i et kontrollert miljø ville tillate team å avdekke nye applikasjoner og metoder som kanskje ikke var tydelige i et mindre direkte engasjement med disse komplekse modellene.

Bygger åpen arena

Å bygge Open Arena var en mangefasettert prosess. Vi hadde som mål å utnytte egenskapene til AWS sine serverløse og ML-tjenester for å lage en løsning som sømløst ville gjøre det mulig for Thomson Reuters-ansatte å eksperimentere med de nyeste LLM-ene. Vi så potensialet til disse tjenestene ikke bare for å gi skalerbarhet og håndterbarhet, men også for å sikre kostnadseffektivitet.

Løsningsoversikt

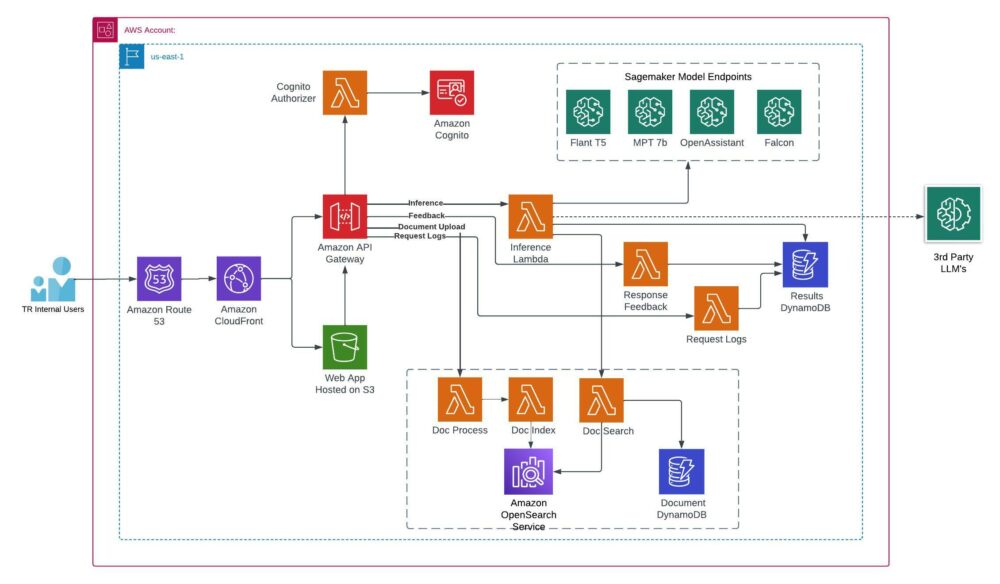

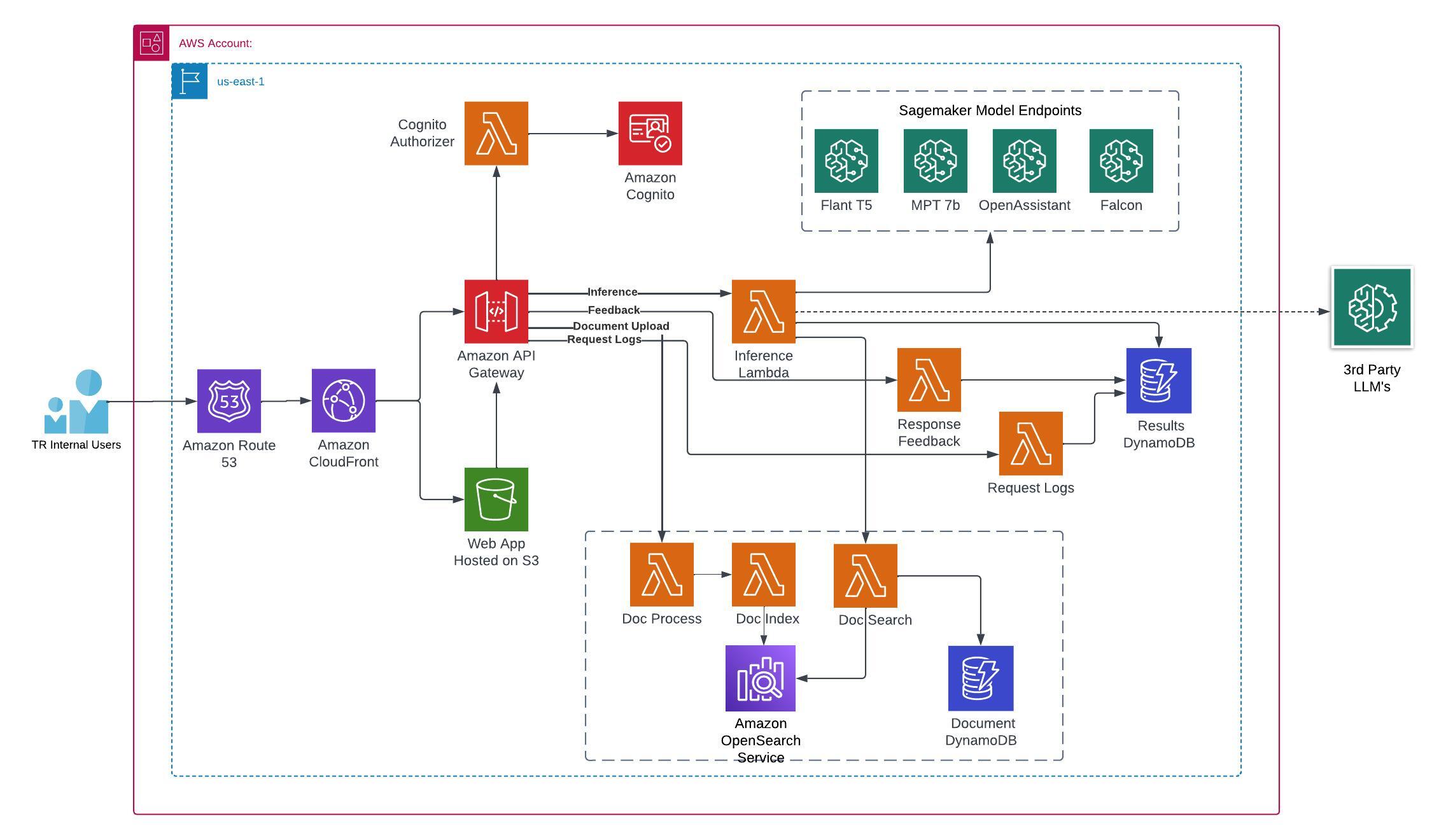

Fra å skape et robust miljø for modelldistribusjon og finjustering til å sikre omhyggelig dataadministrasjon og gi en sømløs brukeropplevelse, trengte TR hvert aspekt for å integreres med flere AWS-tjenester. Open Arenas arkitektur ble designet for å være omfattende, men likevel intuitiv, og balansere kompleksitet med brukervennlighet. Følgende diagram illustrerer denne arkitekturen.

SageMaker fungerte som ryggraden, forenklet modelldistribusjon som SageMaker-endepunkter og ga et robust miljø for finjustering av modellene. Vi utnyttet Hugging Face på SageMaker DLC som tilbys av AWS for å forbedre distribusjonsprosessen vår. I tillegg brukte vi SageMaker Hugging Face Inference Toolkit og Accelerate-biblioteket for å akselerere slutningsprosessen og effektivt håndtere kravene til å kjøre komplekse og ressurskrevende modeller. Disse omfattende verktøyene var medvirkende til å sikre rask og sømløs distribusjon av våre LLM-er. Lambdafunksjoner, utløst av Amazon API-gateway, administrerte API-ene, og sørget for grundig forbehandling og etterbehandling av dataene.

I vår søken etter å levere en sømløs brukeropplevelse, tok vi i bruk en sikker API-gateway for å koble til grensesnittet som er vert i Amazon enkel lagringstjeneste (Amazon S3) til Lambda-backend. Vi distribuerte frontend som et statisk nettsted på en S3-bøtte, og sikret brukerautentisering ved hjelp av Amazon CloudFront og selskapets enkeltpåloggingsmekanisme.

Open Arena er designet for å integrere sømløst med flere LLM-er gjennom REST API-er. Dette sikret at plattformen var fleksibel nok til å reagere og integreres raskt ettersom nye toppmoderne modeller ble utviklet og utgitt i det raske generative AI-rommet. Helt fra starten ble Open Arena bygget for å tilby en trygg og sikker AI/ML-lekeplass for bedrifter, slik at Thomson Reuters-ansatte kan eksperimentere med hvilken som helst toppmoderne LLM så raskt som de blir utgitt. Ved å bruke Hugging Face-modeller på SageMaker kunne teamet finjustere modeller i et sikkert miljø fordi all data er kryptert og ikke forlater den virtuelle private skyen (VPC), noe som sikrer at data forblir private og konfidensielle.

DynamoDB, vår valgte NoSQL-databasetjeneste, lagret og administrerte effektivt et bredt utvalg av data, inkludert brukerforespørsler, svar, responstider og brukerdata. For å effektivisere utviklings- og distribusjonsprosessen, ansatte vi AWS CodeBuild og AWS CodePipeline for kontinuerlig integrasjon og kontinuerlig levering (CI/CD). Overvåking av infrastrukturen og sikre at den fungerer optimalt ble gjort mulig med Amazon CloudWatch, som ga tilpassede dashbord og omfattende loggingsmuligheter.

Modellutvikling og integrasjon

Hjertet til Open Arena er det mangfoldige utvalget av LLM-er, som omfatter både åpen kildekode og egenutviklede modeller. Disse modellene er finjustert for å gi svar etter spesifikke brukeroppfordringer.

Vi har eksperimentert med forskjellige LLM-er for forskjellige brukstilfeller i Open Arena, inkludert Flan-T5-XL, Open Assistant, MPT, Falcon og finjustert Flan-T5-XL på tilgjengelige åpen kildekode-datasett ved å bruke parameteren effektiv finjustering teknikk. Vi brukte bitsandbytes-integrasjon fra Hugging Face for å eksperimentere med ulike kvantiseringsteknikker. Dette tillot oss å optimalisere våre LLM-er for forbedret ytelse og effektivitet, og banet vei for enda større innovasjon. Mens vi valgte en modell som backend bak disse brukstilfellene, vurderte vi forskjellige aspekter, for eksempel hvordan ytelsen til disse modellene ser ut på NLP-oppgaver som er relevante for Thomson Reuters. Videre måtte vi vurdere tekniske aspekter, for eksempel følgende:

- Økt effektivitet når du bygger applikasjoner med LLM-er – Rask integrering og distribusjon av toppmoderne LLM-er i applikasjonene og arbeidsbelastningene våre som kjører på AWS, ved å bruke kjente kontroller og integrasjoner med dybden og bredden til AWS

- Sikker tilpasning – Sikre at all data som brukes til å finjustere LLM-er forblir kryptert og ikke forlater VPC-en

- fleksibilitet – Muligheten til å velge fra et bredt utvalg av AWS native og åpen kildekode LLM-er for å finne den riktige modellen for våre varierte brukstilfeller

Vi har stilt spørsmål som er de høyere kostnadene for større modeller rettferdiggjort av betydelige ytelsesgevinster? Kan disse modellene håndtere lange dokumenter?

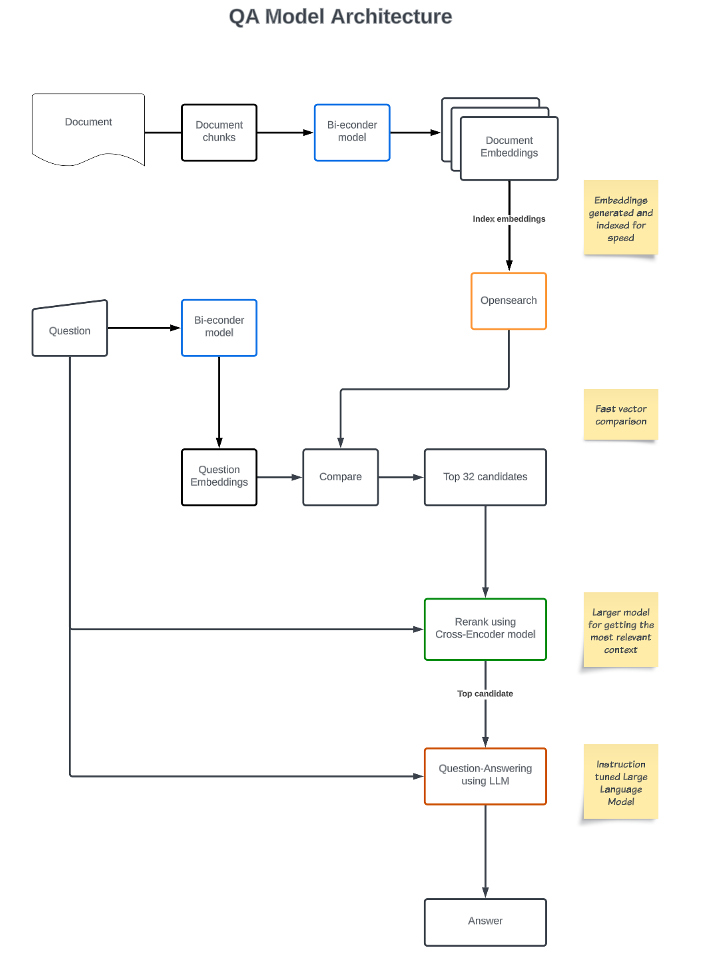

Følgende diagram illustrerer vår modellarkitektur.

Vi har evaluert disse modellene på de foregående aspektene på juridiske datasett med åpen kildekode og Thomson Reuters interne datasett for å vurdere dem for spesifikke brukstilfeller.

For innholdsbaserte use cases (erfaringer som krever svar fra spesifikke korpus), har vi en gjenfinning utvidet generasjon (RAG) pipeline på plass, som vil hente det mest relevante innholdet mot søket. I slike rørledninger deles dokumenter opp i biter, og deretter opprettes og lagres innbygginger i OpenSearch. For å få best matchende dokumenter eller biter, bruker vi henting/re-ranger-tilnærmingen basert på bi-encoder- og cross-encoder-modeller. Den hentede beste matchen sendes deretter som en input til LLM sammen med spørringen for å generere den beste responsen.

Integreringen av Thomson Reuters sitt interne innhold med LLM-opplevelsen har vært avgjørende for å gjøre det mulig for brukere å trekke ut mer relevante og innsiktsfulle resultater fra disse modellene. Enda viktigere, det førte til ideer blant hvert team for muligheter for å ta i bruk AI-aktiverte løsninger i deres forretningsarbeid.

Åpne Arena-brikker: Tilrettelegging for brukerinteraksjon

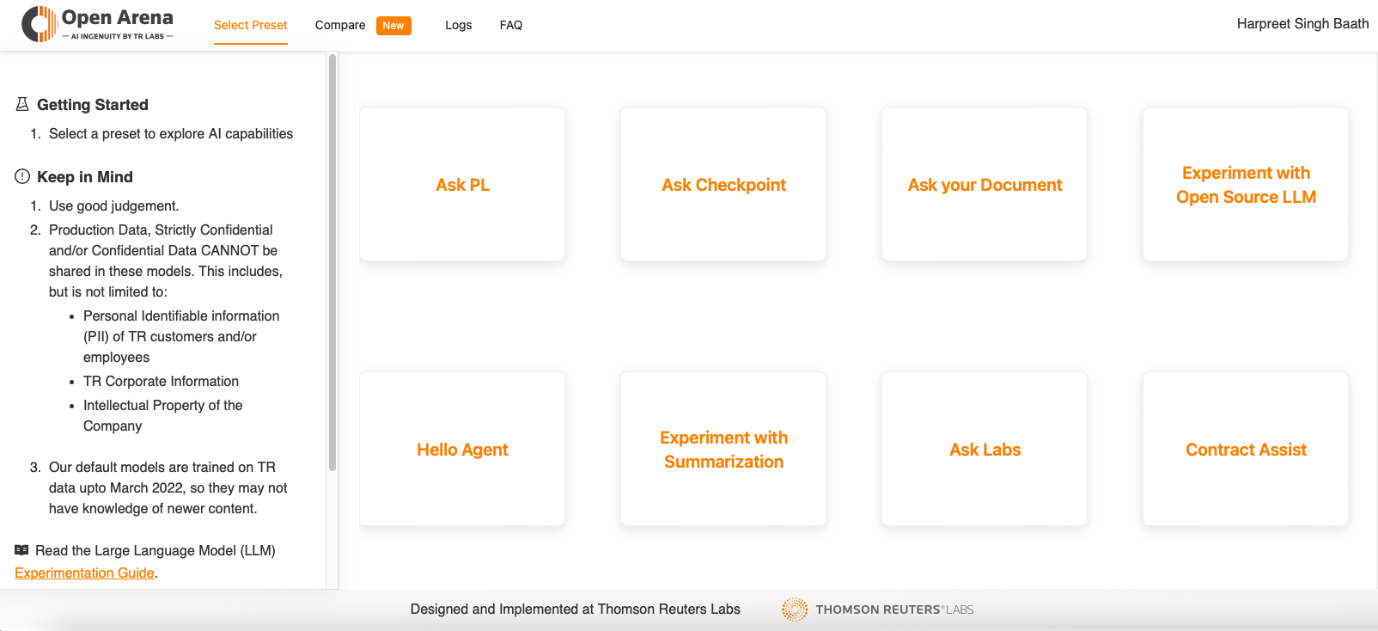

Open Arena tar i bruk et brukervennlig grensesnitt, designet med forhåndsinnstilte aktiveringsfliser for hver opplevelse, som vist i følgende skjermbilde. Disse flisene fungerer som forhåndsinnstilte interaksjoner som imøtekommer de spesifikke kravene til brukerne.

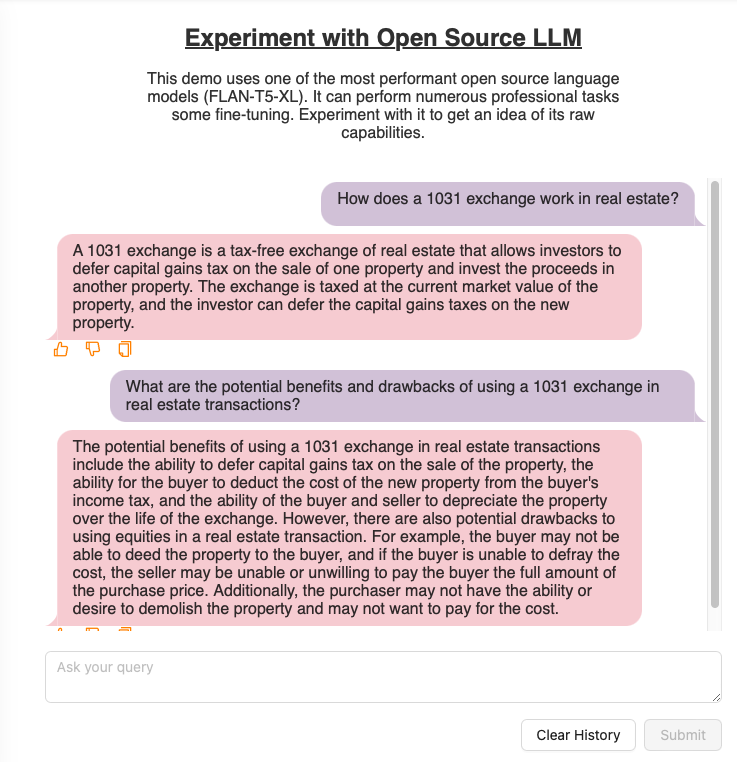

For eksempel åpner Experiment with Open Source LLM-flisen en chat-lignende interaksjonskanal med åpen kildekode LLM-er.

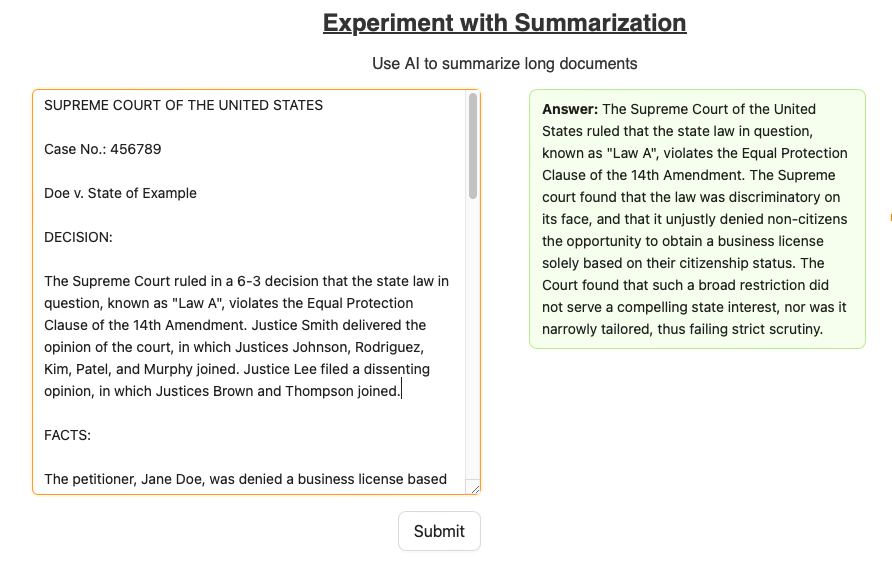

Ask your Document-flisen lar brukere laste opp dokumenter og stille spesifikke spørsmål knyttet til innholdet fra LLM-ene. Eksperimenter med oppsummering-flisen gjør det mulig for brukere å destillere store mengder tekst til konsise sammendrag, som vist i følgende skjermbilde.

Disse flisene forenkler brukerforbruket av AI-aktiverte arbeidsløsninger og navigasjonsprosessen innenfor plattformen, tenner kreativitet og fremmer oppdagelsen av innovative brukstilfeller.

Virkningen av Open Arena

Lanseringen av Open Arena markerte en betydelig milepæl i Thomson Reuters sin reise mot å fremme en kultur for innovasjon og samarbeid. Plattformens suksess var ubestridelig, og fordelene ble raskt synlige i hele selskapet.

Open Arenas intuitive, chat-baserte design krevde ingen betydelig teknisk kunnskap, noe som gjør den tilgjengelig for forskjellige team og forskjellige jobbroller over hele verden. Denne brukervennligheten økte engasjementsnivåene, oppmuntret flere brukere til å utforske plattformen og avduket innovative brukstilfeller.

På under en måned tok Open Arena seg inn for over 1,000 månedlige interne brukere fra TRs globale fotavtrykk, med en gjennomsnittlig interaksjonstid på 5 minutter per bruker. Med et mål om å fremme intern TR LLM-eksperimentering og crowdsource-oppretting av LLM-brukstilfeller, førte Open Arenas lansering til en tilstrømning av nye brukssaker, som effektivt utnytter kraften til LLM-er kombinert med Thomson Reuters sine enorme dataressurser.

Her er hva noen av våre brukere hadde å si om Open Arena:

"Open Arena gir ansatte fra alle deler av selskapet en sjanse til å eksperimentere med LLM-er på en praktisk, praktisk måte. Det er én ting å lese om AI-verktøy, og en annen å bruke dem selv. Denne plattformen setter turbo på vår AI-læringsinnsats på tvers av Thomson Reuters.»

– Abby Pinto, leder for talentutviklingsløsninger, People Function

"OA (Open Arena) har gjort det mulig for meg å eksperimentere med vanskelige nyhetsoversettelsesproblemer for den tyske språktjenesten til Reuters som konvensjonell oversettelsesprogramvare ikke kan håndtere, og å gjøre det i et trygt miljø der jeg kan bruke våre faktiske historier uten frykt for datalekkasjer. Teamet bak OA har vært utrolig lydhøre for forslag til nye funksjoner, som er den typen tjeneste du bare kan drømme om med annen programvare."

– Scot W. Stevenson, Senior Breaking News Correspondent for German Language Service, Berlin, Tyskland

«Da jeg brukte Open Arena, fikk jeg ideen om å bygge et lignende grensesnitt for våre team av kundestøtteagenter. Denne lekeplassen hjalp oss med å tenke nytt om mulighetene med GenAI.»

– Marcel Batista, Gerente de Servicos, Operations Customer Service & Support

"Open Arena drevet av AWS-serverløse tjenester, Amazon SageMaker og Hugging Face hjalp oss til raskt å avsløre banebrytende LLM-er og generativ AI-verktøy for våre kolleger, noe som bidro til å drive bedriftsomfattende innovasjon."

– Shirsha Ray Chaudhuri, direktør for forskningsteknikk, Thomson Reuters Labs

I en bredere skala hadde introduksjonen av Open Arena en dyp innvirkning på selskapet. Det økte ikke bare AI-bevisstheten blant ansatte, men stimulerte også en ånd av innovasjon og samarbeid. Plattformen brakte team sammen for å utforske, eksperimentere og generere ideer, og fremme et miljø der banebrytende konsepter kunne gjøres til virkelighet.

Videre har Open Arena hatt en positiv innflytelse på Thomson Reuters AI-tjenester og produkter. Plattformen har fungert som en sandkasse for AI, slik at teamene kan identifisere og avgrense AI-applikasjoner før de inkorporerer dem i tilbudene våre. Følgelig har dette akselerert utviklingen og forbedringen av Thomson Reuters AI-tjenester, og gir kundene løsninger som er i stadig utvikling og i forkant av teknologisk fremskritt.

konklusjonen

I den fartsfylte verden av kunstig intelligens er det avgjørende å fortsette å utvikle seg, og Thomson Reuters er forpliktet til å gjøre nettopp det. Teamet bak Open Arena jobber kontinuerlig med å legge til flere funksjoner og forbedre plattformens muligheter, ved å bruke AWS-tjenester som Amazonas grunnfjell og Amazon SageMaker Jumpstart, og sikrer at det forblir en verdifull ressurs for teamene våre. Når vi beveger oss fremover, tar vi sikte på å holde tritt med det raskt utviklende landskapet av generative AI og LLM-er. AWS leverer tjenestene som trengs for at TR skal holde tritt med det stadig utviklende generative AI-feltet.

I tillegg til den pågående utviklingen av Open Arena-plattformen, jobber vi aktivt med produksjon av mangfoldet av brukssaker som genereres av plattformen. Dette vil tillate oss å gi våre kunder enda mer avanserte og effektive AI-løsninger, skreddersydd for deres spesifikke behov. Videre vil vi fortsette å fremme en kultur for innovasjon og samarbeid, slik at teamene våre kan utforske nye ideer og applikasjoner for AI-teknologi.

Når vi legger ut på denne spennende reisen, er vi sikre på at Open Arena vil spille en sentral rolle i å drive innovasjon og samarbeid på tvers av Thomson Reuters. Ved å være i forkant av AI-fremskritt, vil vi sikre at produktene og tjenestene våre fortsetter å utvikle seg og møte de stadig skiftende kravene til kundene våre.

Om forfatterne

Shirsha Ray Chaudhuri (Director, Research Engineering) leder ML Engineering-teamet i Bangalore for Thomson Reuters Labs, hvor hun leder utviklingen og distribusjonen av godt utformede løsninger i AWS og andre skyplattformer for ML-prosjekter som driver effektivitet og verdi for AI-drevne funksjoner i Thomson Reuters produkter, plattformer og forretningssystemer. Hun jobber med samfunn om AI for gode samfunnseffektprosjekter og i teknologien for D&I-rom. Hun elsker å nettverke med folk som bruker kunstig intelligens og moderne teknologi for å bygge en bedre verden som er mer inkluderende, mer digital og sammen en bedre morgendag.

Shirsha Ray Chaudhuri (Director, Research Engineering) leder ML Engineering-teamet i Bangalore for Thomson Reuters Labs, hvor hun leder utviklingen og distribusjonen av godt utformede løsninger i AWS og andre skyplattformer for ML-prosjekter som driver effektivitet og verdi for AI-drevne funksjoner i Thomson Reuters produkter, plattformer og forretningssystemer. Hun jobber med samfunn om AI for gode samfunnseffektprosjekter og i teknologien for D&I-rom. Hun elsker å nettverke med folk som bruker kunstig intelligens og moderne teknologi for å bygge en bedre verden som er mer inkluderende, mer digital og sammen en bedre morgendag.

Harpreet Singh Baath er Senior Cloud and DevOps Engineer ved Thomson Reuters Labs, hvor han hjelper forskningsingeniører og forskere med å utvikle maskinlæringsløsninger på skyplattformer. Med over 6 års erfaring spenner Harpreets ekspertise over skyarkitekturer, automatisering, containerisering, muliggjøring av DevOps-praksis og kostnadsoptimalisering. Han brenner for effektivitet og kostnadseffektivitet, og sørger for at skyressurser utnyttes optimalt.

Harpreet Singh Baath er Senior Cloud and DevOps Engineer ved Thomson Reuters Labs, hvor han hjelper forskningsingeniører og forskere med å utvikle maskinlæringsløsninger på skyplattformer. Med over 6 års erfaring spenner Harpreets ekspertise over skyarkitekturer, automatisering, containerisering, muliggjøring av DevOps-praksis og kostnadsoptimalisering. Han brenner for effektivitet og kostnadseffektivitet, og sørger for at skyressurser utnyttes optimalt.

Rashmi B Pawar er maskinlæringsingeniør hos Thomson Reuters. Hun har betydelig erfaring med å produsere modeller, etablere slutninger og lage opplæringspipelines skreddersydd for ulike maskinlæringsapplikasjoner. Videre har hun betydelig kompetanse på å inkorporere arbeidsflyter for maskinlæring i eksisterende systemer og produkter.

Rashmi B Pawar er maskinlæringsingeniør hos Thomson Reuters. Hun har betydelig erfaring med å produsere modeller, etablere slutninger og lage opplæringspipelines skreddersydd for ulike maskinlæringsapplikasjoner. Videre har hun betydelig kompetanse på å inkorporere arbeidsflyter for maskinlæring i eksisterende systemer og produkter.

Palvika Bansal er Associate Applied Research Scientist ved Thomson Reuters. Hun har jobbet med prosjekter på tvers av ulike sektorer for å løse forretningsproblemer for kunder som bruker AI/ML. Hun brenner for arbeidet sitt og er entusiastisk til å ta fatt på nye utfordringer. Utenom jobben liker hun å reise, lage mat og lese.

Palvika Bansal er Associate Applied Research Scientist ved Thomson Reuters. Hun har jobbet med prosjekter på tvers av ulike sektorer for å løse forretningsproblemer for kunder som bruker AI/ML. Hun brenner for arbeidet sitt og er entusiastisk til å ta fatt på nye utfordringer. Utenom jobben liker hun å reise, lage mat og lese.

Simone Zucchet er Senior Solutions Architect hos AWS. Med nesten et tiårs erfaring som skyarkitekt, liker Simone å jobbe med innovative prosjekter som bidrar til å transformere måten organisasjoner tilnærmer seg forretningsproblemer. Han hjelper til med å støtte store bedriftskunder hos AWS og er en del av Machine Learning TFC. Utenom yrkeslivet liker han å jobbe med biler og fotografering.

Simone Zucchet er Senior Solutions Architect hos AWS. Med nesten et tiårs erfaring som skyarkitekt, liker Simone å jobbe med innovative prosjekter som bidrar til å transformere måten organisasjoner tilnærmer seg forretningsproblemer. Han hjelper til med å støtte store bedriftskunder hos AWS og er en del av Machine Learning TFC. Utenom yrkeslivet liker han å jobbe med biler og fotografering.

Heiko Hotz er en senior løsningsarkitekt for AI og maskinlæring med spesielt fokus på naturlig språkbehandling, store språkmodeller og generativ AI. Før denne rollen var han sjef for datavitenskap for Amazons EU-kundeservice. Heiko hjelper kundene våre med å lykkes i deres AI/ML-reise på AWS og har jobbet med organisasjoner i mange bransjer, inkludert forsikring, finansielle tjenester, media og underholdning, helsetjenester, verktøy og produksjon. På fritiden reiser Heiko så mye som mulig.

Heiko Hotz er en senior løsningsarkitekt for AI og maskinlæring med spesielt fokus på naturlig språkbehandling, store språkmodeller og generativ AI. Før denne rollen var han sjef for datavitenskap for Amazons EU-kundeservice. Heiko hjelper kundene våre med å lykkes i deres AI/ML-reise på AWS og har jobbet med organisasjoner i mange bransjer, inkludert forsikring, finansielle tjenester, media og underholdning, helsetjenester, verktøy og produksjon. På fritiden reiser Heiko så mye som mulig.

João Moura er en AI/ML Specialist Solutions Architect hos AWS, basert i Spania. Han hjelper kunder med dyplæringsmodellopplæring og inferensoptimalisering, og mer bredt å bygge store ML-plattformer på AWS. Han er også en aktiv talsmann for ML-spesialisert maskinvare og lavkode ML-løsninger.

João Moura er en AI/ML Specialist Solutions Architect hos AWS, basert i Spania. Han hjelper kunder med dyplæringsmodellopplæring og inferensoptimalisering, og mer bredt å bygge store ML-plattformer på AWS. Han er også en aktiv talsmann for ML-spesialisert maskinvare og lavkode ML-løsninger.

Georgios Schinas er en spesialistløsningsarkitekt for AI/ML i EMEA-regionen. Han er basert i London og jobber tett med kunder i Storbritannia og Irland. Georgios hjelper kunder med å designe og distribuere maskinlæringsapplikasjoner i produksjon på AWS, med en spesiell interesse for MLOps-praksis og gjør det mulig for kunder å utføre maskinlæring i stor skala. På fritiden liker han å reise, lage mat og tilbringe tid med venner og familie.

Georgios Schinas er en spesialistløsningsarkitekt for AI/ML i EMEA-regionen. Han er basert i London og jobber tett med kunder i Storbritannia og Irland. Georgios hjelper kunder med å designe og distribuere maskinlæringsapplikasjoner i produksjon på AWS, med en spesiell interesse for MLOps-praksis og gjør det mulig for kunder å utføre maskinlæring i stor skala. På fritiden liker han å reise, lage mat og tilbringe tid med venner og familie.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Bil / elbiler, Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- ChartPrime. Hev handelsspillet ditt med ChartPrime. Tilgang her.

- BlockOffsets. Modernisering av eierskap for miljøkompensasjon. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/how-thomson-reuters-developed-open-arena-an-enterprise-grade-large-language-model-playground-in-under-6-weeks/

- : har

- :er

- :ikke

- :hvor

- 000

- 1

- 100

- 2023

- 7

- a

- evne

- Om oss

- akselerere

- akselerert

- adgang

- tilgjengelig

- Logg inn

- tvers

- aktiv

- aktivt

- faktiske

- legge til

- tillegg

- vedtatt

- vedta

- avansere

- avansert

- forfremmelse

- fremskritt

- Advancing

- en gang til

- mot

- agenter

- AI

- AI og maskinlæring

- AI-tjenester

- AI / ML

- sikte

- sikte

- Alle

- tillate

- tillatt

- tillate

- tillater

- langs

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- blant

- blant

- an

- og

- En annen

- svar

- noen

- api

- APIer

- tilsynelatende

- søknader

- anvendt

- tilnærming

- arkitektur

- ER

- AREA

- Arena

- Kunst

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- aspektet

- aspekter

- vurdere

- Assistent

- Førsteamanuensis

- sortiment

- At

- augmented

- Autentisering

- automatisere

- Automatisering

- tilgjengelig

- gjennomsnitt

- bevissthet

- AWS

- Backbone

- Backend

- bakgrunn

- balansering

- basert

- BE

- fordi

- bli

- vært

- før du

- bak

- Fordeler

- Berlin

- BEST

- Bedre

- styrket

- både

- grenser

- bredde

- Breaking

- breaking news

- bredere

- bredt

- brakte

- bygge

- Bygning

- virksomhet

- men

- by

- ring

- kom

- CAN

- evner

- kapitalisert

- biler

- saker

- imøtekomme

- utfordringer

- sjanse

- Kanal

- Velg

- valgt ut

- fjerne

- klienter

- Lukke

- tett

- Cloud

- Koding

- samarbeid

- kollegaer

- kombinert

- forpliktet

- Communities

- samfunnet

- Selskapet

- Selskapets

- komplekse

- kompleksitet

- omfattende

- konsept

- konsepter

- konsis

- trygg

- Koble

- Følgelig

- Vurder

- betydelig

- ansett

- stadig

- forbruk

- Containere

- innhold

- fortsette

- fortsetter

- kontinuerlig

- bidratt

- kontrolleres

- kontroller

- konvensjonell

- Kostnad

- kunne

- lage

- opprettet

- Opprette

- skaperverket

- Kreativ

- kreativitet

- avgjørende

- Kultur

- skikk

- kunde

- Kundeservice

- Kundeservice

- Kunder

- tilpasning

- skjærekant

- oversikter

- dato

- Dataledelse

- datavitenskap

- Database

- datasett

- dag til dag

- tiår

- dedikert

- dyp

- dyp læring

- dypere

- definere

- leverer

- levere

- levering

- krav

- utplassere

- utplassert

- utplasserings

- distribusjon

- dybde

- utforming

- designet

- utvikle

- utviklet

- Utvikling

- forskjellig

- digitalt

- direkte

- Regissør

- oppdage

- Funnet

- diskutere

- diskusjoner

- diverse

- do

- dokument

- dokumenter

- gjør

- ikke

- gjør

- ikke

- tegne

- drøm

- stasjonen

- kjøring

- under

- hver enkelt

- lette

- brukervennlighet

- effektivt

- effektivitet

- effektiv

- effektivt

- innsats

- legge ut på

- EMEA

- dukke

- ansatt

- ansatte

- muliggjøre

- aktivert

- muliggjør

- muliggjør

- oppmuntrende

- kryptert

- slutt

- engasjement

- ingeniør

- Ingeniørarbeid

- Ingeniører

- forbedre

- forbedret

- nok

- sikre

- sikrer

- Enterprise

- enterprise-klasse

- Entertainment

- entusiastisk

- Miljø

- etablere

- EU

- evaluere

- Selv

- NOEN GANG

- stadig skiftende

- Hver

- tydelig

- utvikle seg

- utvikling

- spennende

- eksisterende

- erfaring

- Erfaringer

- eksperiment

- ekspertise

- utforske

- omfattende

- trekke ut

- Face

- tilrettelagt

- tilrettelegging

- kjent

- familie

- FAST

- Fartsfylt

- frykt

- Egenskaper

- felt

- finansiell

- finansielle tjenester

- Finn

- Først

- fleksibel

- Fokus

- fokuserte

- etter

- Fotspor

- Til

- teten

- Forward

- Foster

- fostre

- venner

- fra

- foran

- Front end

- funksjon

- funksjoner

- Dess

- framtid

- inntjening

- gateway

- generere

- generert

- generative

- Generativ AI

- Tysk

- få

- gir

- Global

- Globalt

- globus

- mål

- god

- større

- banebrytende

- Grow

- Økende

- hackathon

- HAD

- håndtere

- hands-on

- maskinvare

- seletøy

- Utnyttelse

- Ha

- he

- hode

- .

- helsetjenester

- Hjerte

- hjelpe

- hjulpet

- hjelpe

- hjelper

- her

- her.

- høyere

- svært

- hans

- vert

- Hvordan

- Hvordan

- HTML

- http

- HTTPS

- i

- Tanken

- Ideer

- identifisere

- antennes

- illustrerer

- Påvirkning

- bedre

- in

- begynnelse

- Inkludert

- Inklusive

- innlemme

- økt

- utrolig

- bransjer

- påvirke

- tilstrømning

- informasjon

- Infrastruktur

- Innovasjon

- Innovasjonsteam

- innovative

- inngang

- innsiktsfull

- innsikt

- f.eks

- instrumental

- forsikring

- integrert

- integrere

- Integrering

- integrering

- integrasjoner

- Intelligens

- samhandle

- interaksjon

- interaksjoner

- interesse

- Interface

- intern

- inn

- Introduksjon

- intuitiv

- Irland

- IT

- DET ER

- Jobb

- reise

- jpg

- bare

- Hold

- nøkkel

- viktig milepæl

- Type

- kunnskap

- Labs

- landskap

- Språk

- stor

- storskala

- større

- siste

- lansere

- føre

- ledende

- Lekkasjer

- læring

- Permisjon

- Led

- Lovlig

- mindre

- nivåer

- Bibliotek

- Life

- i likhet med

- LLM

- logging

- London

- Lang

- Se

- ser ut som

- elsker

- maskin

- maskinlæring

- laget

- Making

- fikk til

- ledelse

- leder

- produksjon

- mange

- merket

- Match

- materialer

- Saker

- me

- mekanisme

- Media

- Møt

- sammenslåing

- metoder

- grundig

- kunne

- milepæl

- minutter

- ML

- MLOps

- modell

- modeller

- Moderne

- modulære

- overvåking

- Måned

- månedlig

- mer

- mer effektivt

- mest

- flytte

- gå fremover

- mye

- flere

- mangfold

- innfødt

- Naturlig

- Natural Language Processing

- Navigasjon

- nødvendig

- behov

- nettverk

- Ny

- Nye funksjoner

- nyheter

- nlp

- Nei.

- Målet

- of

- tilby

- tilbudt

- tilbud

- on

- gang

- ONE

- pågående

- bare

- åpen

- åpen kildekode

- åpner

- Drift

- Opportunity

- optimal

- optimalisering

- Optimalisere

- or

- organisasjoner

- original

- Annen

- vår

- ut

- utenfor

- enn

- egen

- Fred

- panel

- paneldiskusjoner

- parameter

- del

- Spesielt

- Partnerskap

- deler

- bestått

- lidenskapelig

- asfaltering

- Ansatte

- for

- Utfør

- ytelse

- fotografering

- Banebryt

- rørledning

- sentral

- Sted

- plattform

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- Spille

- poeng

- positiv

- muligheter

- mulig

- Post

- potensiell

- makt

- powered

- kraftig

- Praktisk

- praksis

- Dyrebar

- prinsipper

- Før

- privat

- problemer

- prosess

- prosessering

- Produksjon

- Produkter

- profesjonell

- fagfolk

- dyp

- program

- prosjekter

- forkjemper

- gi

- forutsatt

- gir

- gi

- skyver

- spørsmål

- søken

- spørsmål

- Rask

- raskt

- rask

- raskt

- RAY

- Reager

- Lese

- Lesning

- Reality

- avgrense

- region

- i slekt

- utgitt

- relevans

- relevant

- forblir

- påkrevd

- Krav

- forskning

- ressurs

- ressurskrevende

- Ressurser

- svar

- svar

- responsive

- REST

- Resultater

- Reuters

- ikke sant

- robust

- Rolle

- roller

- rullende

- Kjør

- rennende

- trygge

- sagemaker

- sandkasse

- så

- sier

- skalerbarhet

- Skala

- Vitenskap

- Forsker

- forskere

- sømløs

- sømløst

- sektorer

- sikre

- velge

- utvalg

- senior

- betjene

- server~~POS=TRUNC

- tjeneste

- Tjenester

- sesjoner

- sett

- sett

- flere

- hun

- vist

- signifikant

- lignende

- Enkelt

- forenkle

- enkelt

- nettstedet

- So

- samfunnsmessig

- Software

- løsning

- Solutions

- LØSE

- noen

- kilde

- Rom

- Spania

- spenn

- spesiell

- spesialist

- spesifikk

- utgifter

- ånd

- splittet

- startet

- Start

- state-of-the-art

- lagring

- lagret

- Stories

- effektivisere

- suksess

- vellykket

- slik

- oppsummere

- støtte

- Støttes

- overflaten

- Systemer

- skreddersydd

- ta

- Talent

- oppgaver

- lag

- lag

- tech

- Teknisk

- teknikker

- teknologisk

- Technologies

- Teknologi

- test

- Det

- De

- Fremtiden

- Storbritannia

- deres

- Dem

- deretter

- Disse

- de

- ting

- denne

- Thomson Reuters

- De

- Gjennom

- Tim

- tid

- ganger

- til

- sammen

- i morgen

- verktøykasse

- verktøy

- mot

- Kurs

- Transform

- Oversettelse

- Traveling

- reiser

- Trender

- utløst

- snudde

- Uk

- avdekke

- etter

- forståelse

- unik

- låse opp

- avdukingen

- us

- bruke

- brukt

- Bruker

- Brukererfaring

- brukervennlig

- Brukere

- ved hjelp av

- verktøy

- benyttes

- Verdifull

- verdi

- variasjon

- ulike

- enorme

- verifisere

- virtuelle

- volumer

- W

- ønsker

- var

- Vei..

- we

- web

- webtjenester

- Web-basert

- Webinarer

- nettsteder

- uker

- VI VIL

- var

- Hva

- Hva er

- når

- hvilken

- mens

- HVEM

- bred

- vil

- vinne

- med

- innenfor

- uten

- Arbeid

- arbeidet

- arbeidsflyt

- arbeid

- virker

- verden

- ville

- år

- ennå

- Du

- Din

- deg selv

- zephyrnet