-

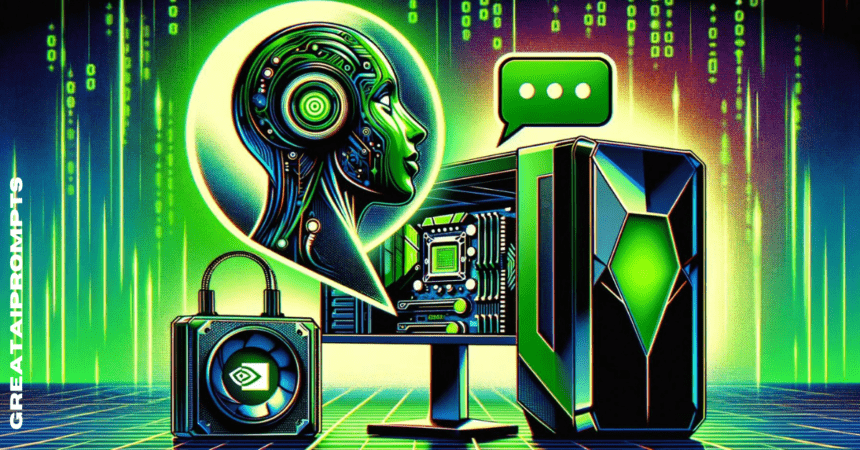

Nvidia Chat med RTX er en stor språkmodell på enheten som bruker informasjonen på PC-en din for å oppfylle forespørslene dine.

-

Den kan også brukes på data på internett, for eksempel nettsider.

-

Mens modellen er dyktig, antyder folk at dens evner er sterkt overdrevet.

Nvidia trapper opp sitt engasjement i AI-revolusjonen ved å gå utover sin tradisjonelle rolle og etablere seg som en nøkkelspiller. Etter en utviklerkonferanse fylt med betydelige kunngjøringer, har Nvidia introdusert et nytt produkt for testing: Nvidia Chat med RTX.

Denne store språkmodellen på enheten fungerer utelukkende på PC-en din, og bruker lokal informasjon for å svare på forespørsler. I likhet med Samsungs Galaxy AI, lansert med Galaxy S24-serien, som håndterte de fleste AI-oppgaver på enheten, bringer Nvidia Chat med RTX denne muligheten til PC-er, noe som potensielt omformer vår tilnærming til AI, Transformers og store språkmodeller (LLM).

Chat med RTX

Chat med RTX er en AI chatbot på din PC. Installert som eldre programvare gir den en chatbot som kjenner alle dataene på PC-en din. Så enten du prøver å huske noe fra månedssluttrapporten for oktober 2022 eller hvor du bestilte middag natten til 17. februar 2019, hvis informasjonen er på PC-en din, vil Chat med RTX kunne bringe den opp.

Fordeler med AI på enheten

Hastighet: En av de største fordelene med Chat med RTX er behandlingshastigheten. Å utføre all behandling på enheten betyr at hastigheten på internettforbindelsen din blir irrelevant. Du trenger ikke engang en! Dette er et stort fremskritt sammenlignet med eksisterende digitale eller AI-assistenter.

Personvern: Å behandle all enhetsinformasjon har også en stor fordel med tanke på personvern. All informasjon behandles og oppbevares på enheten, noe som gir eieren full kontroll og forvaring. Det er ingen tredjepart som kan se gjennom, samle, mine, selge eller lekke dataene dine til noen andre, med vilje eller på annen måte.

Sikkerhet: Oppbevaring av data gir også fordeler innen sikkerhet. Uten at du trenger å logge inn et sted eller sende informasjonen, øker du til syvende og sist sikkerheten. Informasjonen trenger aldri å reise eller lagres andre steder, selv ikke midlertidig.

tilpasning: En annen klar fordel er tilpasning. Chat med RTX fungerer basert på informasjonen som er lagret på datamaskinen din, og fungerer i hovedsak som en LLM som er trent på dine data og informasjon. Enten hoveddelen av informasjonen din er dokumenter, stillbilder eller video, er IT en chatbot som er spesifikk for deg og dine data.

Fleksibilitet: Chat med RTX er ikke begrenset til dataene på enheten din; den kan også brukes på data på internett, for eksempel nettsider. Så du kan be Chat with RTX om å grave etter litt informasjon på en nettside, og det vil gi resultater, alt uten at det går på bekostning av sikkerhet eller personvernaspekter. Det er også verdt å merke seg at dette bare er begynnelsen.

Djevelen i detaljene

Systemkravene for å kjøre Chat med RTX er på etterspørselssiden. Foreløpig er den kun tilgjengelig for Windows-PCer, og MacOS og Linux er foreløpig ute i kulden. Den er kun tilgjengelig for PC-er som kjører Windows 11.

Et minimum på 16 GB RAM og en filstørrelse på 35 GB betyr at du trenger et ganske kraftig system for å bruke det. I tillegg til alt dette krever systemet også en Nvidia GeForce RTX 30 eller 40-serie GPU for å fungere godt på en maskin. Systemkravene er litt på den tunge siden, men fortsatt innen rekkevidde for mange mellomstore PC-er og bærbare datamaskiner.

Blandede anmeldelser

Chat med RTX ble først gjort tilgjengelig for testing 19. februar 2024. Vurderingene skiller seg noe fra demoene og kommunikasjonen som kommer ut av Nvidia. Mens modellen er dyktig, antyder folk at dens evner er sterkt overdrevet. Den store filstørrelsen og de store kravene samsvarer ikke med utdata.

Den kan gjøre mange oppgaver, men den gjør dem dårlig. Dette er forståelig som et første skudd på en ny idé. Når disse tingene går, bør vi forvente forbedringer i fremtiden. Den enorme størrelsen og de tunge systemkravene er to områder de bør jobbe med mens de også målretter ytelsesforbedringer.

Mens talsmenn har begynt å snakke opp Chat med RTX som begynnelsen på slutten for Chat GPT og Googles Gemini, tyder erfaringene til de som har brukt det at vi er ganske lenge fra dette er tilfelle. LLM-er og transformatorer krever en stor mengde prosessorkraft og opplæring for å gå med det.

Å forvente at en lokal installasjon på en PC skal levere like bra som datasentrene bak din favoritt generative AI, krever for mye for tidlig. For bedrifter har dette imidlertid et løfte som kan leveres snart.

Et selskap av en rimelig størrelse kan drive sitt eget LLM-system for arbeidsstyrken. Dette vil ha enorme applikasjoner, men det er klart at fordelene med arbeidsflyten i informasjonstunge industrier er mange.

Fordelene med tilpasning, personvern og sikkerhet vil være svært verdifulle for bedriftsbrukere. Så selv om ideen om en LLM på PC-en din ikke er helt klar til å konkurrere med de beste i klassen på umiddelbar sikt, kan vi se personlige LLM-er for bedriftsbrukere på kort til mellomlang sikt.

Alderen til AI på enheten

Tilgjengeligheten til Nvidias Chat med RTX signaliserer at vi beveger oss mot en alder av AI på enheten. Samsung S24 er på linje med Galaxy AI og behandlet de fleste oppgavene på enheten.

Nå gir Nvidia oss fullstendig prosessering på enheten. Produktet er ifølge noen anmeldelser ikke bra nok ennå. Når det er sagt, er det svært få førstegangsprodukter. Nvidia har absolutt kastet katten blant duene med Chat med RTX.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://web3africa.news/2024/04/12/news/nvidia-chat-with-rtx-on-device-ai/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 11

- 17

- 19

- 2019

- 2022

- 30

- a

- evner

- I stand

- Om oss

- Ifølge

- skuespill

- tillegg

- Fordel

- fordeler

- alder

- AI

- AI chatbot

- Alle

- også

- blant

- beløp

- an

- og

- Kunngjøringer

- En annen

- noen

- søknader

- tilnærming

- ER

- områder

- AS

- spør

- spør

- aspekter

- assistenter

- At

- tilgjengelighet

- tilgjengelig

- basert

- BE

- blir

- Begynnelsen

- bak

- være

- Fordeler

- BEST

- Beyond

- bringe

- Bringer

- men

- by

- CAN

- evne

- stand

- saken

- CAT

- sentre

- Gjerne

- chatte

- chatbot

- klasse

- fjerne

- klart

- forkjølelse

- kommer

- Kommunikasjon

- Selskapet

- sammenlignet

- konkurrere

- helt

- kompromittere

- datamaskin

- Konferanse

- tilkobling

- kontroll

- kunne

- I dag

- varetekt

- tilpasning

- dato

- datasentre

- leverer

- levert

- Etterspørsel

- Demonstrasjoner

- Utvikler

- enhet

- avvike

- DIG

- digitalt

- Middag

- do

- dokumenter

- gjør

- ikke

- gjør

- ikke

- ellers

- andre steder

- slutt

- nok

- Enterprise

- bedrifter

- fullstendig

- hovedsak

- etablere

- Selv

- eksisterende

- forvente

- Erfaringer

- Falling

- kommer til kort

- Februar

- Noen få

- filet

- fylt

- Først

- etter

- Til

- Forward

- fra

- fullt

- framtid

- Galaxy

- Gemini

- generative

- Generativ AI

- gir

- Giving

- Go

- god

- Googles

- GPU

- flott

- størst

- sterkt

- Ha

- å ha

- tung

- heftig

- svært

- hold

- Men

- HTTPS

- Tanken

- if

- bilder

- umiddelbar

- forbedringer

- in

- Øke

- bransjer

- informasjon

- installere

- installerte

- med hensikt

- Internet

- Internett-tilkobling

- introdusert

- engasjement

- IT

- DET ER

- selv

- bare

- holdt

- nøkkel

- vet

- Språk

- bærbare datamaskiner

- stor

- lansert

- lekke

- forlater

- Legacy

- Begrenset

- linje

- linux

- lite

- LLM

- lokal

- logg

- Se

- maskin

- MacOS

- laget

- større

- Flertall

- mange

- matchet

- bety

- midler

- medium

- minimum

- modell

- modeller

- mest

- flytting

- mye

- Trenger

- aldri

- Ny

- nytt produkt

- natt

- Nei.

- merke seg

- nå

- Nvidia

- oktober

- of

- on

- ONE

- bare

- opererer

- or

- ellers

- vår

- ut

- produksjon

- egen

- eieren

- sider

- parti

- PC

- PC-er

- Ansatte

- ytelse

- Personlig

- plato

- Platon Data Intelligence

- PlatonData

- spiller

- potensielt

- makt

- kraftig

- privatliv

- Personvern og sikkerhet

- Bearbeidet

- prosessering

- Behandlingseffekt

- Produkt

- Produkter

- løfte

- talsmenn

- gi

- gir

- ganske

- RAM

- å nå

- klar

- rimelig

- rapporterer

- forespørsler

- krever

- Krav

- Krever

- omforming

- Svare

- Resultater

- Anmeldelser

- Revolution

- Rolle

- RTX

- rennende

- s

- Sa

- Samsung

- sikkerhet

- se

- selger

- send

- innstilling

- Kort

- shot

- bør

- side

- signaler

- signifikant

- lignende

- Størrelse

- So

- Software

- noen

- noe

- noe

- et sted

- snart

- spesifikk

- fart

- Scene

- startet

- Trinn

- spring

- Still

- lagret

- slik

- foreslår

- system

- snakker

- rettet mot

- oppgaver

- begrep

- vilkår

- Testing

- Det

- De

- Fremtiden

- informasjonen

- Dem

- Der.

- Disse

- de

- ting

- Tredje

- denne

- De

- Gjennom

- tid

- til

- også

- mot

- tradisjonelle

- trent

- Kurs

- transformers

- reiser

- sant

- prøver

- to

- Til syvende og sist

- forståelig

- us

- bruke

- brukt

- Brukere

- bruker

- ved hjelp av

- Verdifull

- enorme

- veldig

- video

- var

- we

- web

- webp

- VI VIL

- om

- hvilken

- mens

- HVEM

- vil

- vinduer

- Windows 11

- med

- innenfor

- uten

- Arbeid

- arbeidsflyt

- arbeidsstyrke

- virker

- verdt

- ville

- ennå

- Du

- Din

- zephyrnet