Aplikacje wykorzystujące sztuczną inteligencję generatywną (AI) zbudowane w oparciu o duże modele językowe (LLM) wykazały potencjał tworzenia i przyspieszania wartości ekonomicznej dla przedsiębiorstw. Przykładowe zastosowania obejmują wyszukiwanie konwersacyjne, pomoc agenta obsługi klienta, analityka obsługi klienta, samoobsługowi wirtualni asystenci, nasze chatboty, pokolenie bogatych mediów, moderacja treści, towarzysze kodowania, aby przyspieszyć tworzenie bezpiecznego i wydajnego oprogramowania, głębsze spostrzeżenia z multimodalnych źródeł treści, przyspieszenie badań bezpieczeństwa i łagodzenia jego skutków w Twojej organizacji, i wiele więcej. Wielu klientów szuka wskazówek dotyczących zarządzania bezpieczeństwem, prywatnością i zgodnością podczas opracowywania generatywnych aplikacji AI. Zrozumienie i wyeliminowanie luk w zabezpieczeniach, zagrożeń i ryzyka LLM na etapie projektowania i architektury pomaga zespołom skoncentrować się na maksymalizacji korzyści ekonomicznych i produktywności, jakie może przynieść generacyjna sztuczna inteligencja. Świadomość zagrożeń zwiększa przejrzystość i zaufanie do generatywnych zastosowań sztucznej inteligencji, zachęca do większej obserwowalności, pomaga spełnić wymogi dotyczące zgodności i ułatwia liderom podejmowanie świadomych decyzji.

Celem tego postu jest umożliwienie inżynierom sztucznej inteligencji i uczenia maszynowego (ML), badaczom danych, architektom rozwiązań, zespołom ds. bezpieczeństwa i innym zainteresowanym stronom wspólnego modelu mentalnego i ram stosowania najlepszych praktyk w zakresie bezpieczeństwa, umożliwiając zespołom AI/ML przenoszenie szybko, bez poświęcania bezpieczeństwa na rzecz szybkości. W szczególności ten post ma na celu pomóc badaczom zajmującym się sztuczną inteligencją i systemem uczenia się oraz analitykom danych, którzy być może nie mieli wcześniej kontaktu z zasadami bezpieczeństwa, w zrozumieniu podstawowych najlepszych praktyk w zakresie bezpieczeństwa i prywatności w kontekście opracowywania generatywnych aplikacji AI przy użyciu LLM. Omawiamy również wspólne obawy dotyczące bezpieczeństwa, które mogą podważyć zaufanie do sztucznej inteligencji, zidentyfikowane przez Open Worldwide Application Security Project (OWASP) Top 10 dla aplikacji LLMi pokaż, w jaki sposób możesz wykorzystać AWS do zwiększenia poziomu bezpieczeństwa i pewności siebie, wprowadzając innowacje dzięki generatywnej sztucznej inteligencji.

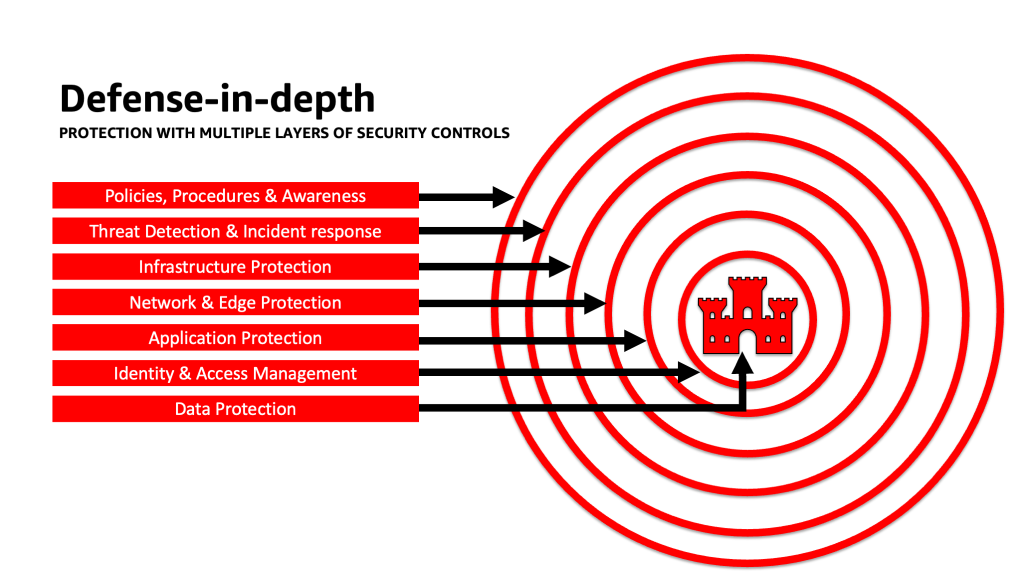

W tym poście przedstawiono trzy etapy projektowania strategii zarządzania ryzykiem podczas opracowywania generatywnych aplikacji AI przy użyciu LLM. Najpierw zagłębiamy się w słabe punkty, zagrożenia i ryzyko wynikające z wdrażania, wdrażania i użytkowania rozwiązań LLM, a także zapewniamy wskazówki, jak rozpocząć wprowadzanie innowacji z myślą o bezpieczeństwie. Następnie omawiamy, jak istotne jest budowanie na bezpiecznych podstawach dla generatywnej sztucznej inteligencji. Na koniec łączymy je z przykładowym obciążeniem LLM, aby opisać podejście do architektury z dogłębnym bezpieczeństwem w zakresie ochrony ponad granicami zaufania.

Na koniec tego posta, Inżynierowie AI/ML, analitycy danych i technolodzy dbający o bezpieczeństwo będą w stanie zidentyfikować strategie projektowania warstwowych zabezpieczeń dla swoich generatywnych aplikacji AI, zrozumieć, w jaki sposób przypisać 10 najważniejszych problemów związanych z bezpieczeństwem OWASP dla LLM do odpowiednich kontroli i zbudować podstawową wiedzę na temat odpowiadanie na następujące najczęściej zadawane pytania klientów AWS dotyczące ich aplikacji:

- Jakie są typowe zagrożenia dla bezpieczeństwa i prywatności związane z używaniem generatywnej sztucznej inteligencji opartej na LLM w moich aplikacjach, na które mogę mieć największy wpływ dzięki tym wskazówkom?

- Jakie są sposoby wdrożenia kontroli bezpieczeństwa i prywatności w cyklu rozwoju generatywnych aplikacji AI LLM na AWS?

- Jakie najlepsze praktyki operacyjne i techniczne mogę włączyć do sposobu, w jaki moja organizacja tworzy generatywne aplikacje AI LLM, aby zarządzać ryzykiem i zwiększać zaufanie do generatywnych aplikacji AI korzystających z LLM?

Popraw wyniki w zakresie bezpieczeństwa, rozwijając generatywną sztuczną inteligencję

Innowacje w zakresie generatywnej sztucznej inteligencji wykorzystującej LLM wymagają rozpoczęcia od bezpieczeństwa, aby rozwinąć odporność organizacji, zbudować na bezpiecznym fundamencie i zintegrować bezpieczeństwo z podejściem polegającym na głębokiej obronie. Bezpieczeństwo jest wspólna odpowiedzialność pomiędzy AWS i klientami AWS. Wszystkie zasady Modelu Wspólnej Odpowiedzialności AWS mają zastosowanie do generatywnych rozwiązań AI. Odśwież swoją wiedzę na temat modelu współdzielonej odpowiedzialności AWS w odniesieniu do infrastruktury, usług i danych podczas tworzenia rozwiązań LLM.

Zacznij od zapewnienia bezpieczeństwa, aby zwiększyć odporność organizacji

Zacznij od zapewnienia bezpieczeństwa, aby zwiększyć odporność organizacji na potrzeby tworzenia generatywnych aplikacji AI, które spełnią Twoje cele w zakresie bezpieczeństwa i zgodności. Odporność organizacyjna opiera się na i rozszerza definicja odporności w AWS Well-Architected Framework uwzględnić i przygotować się na zdolność organizacji do wyjścia z zakłóceń. Oceniając ogólną gotowość do opracowania generatywnej sztucznej inteligencji w ramach programów LLM oraz odporność swojej organizacji na wszelkie potencjalne skutki, weź pod uwagę swój poziom bezpieczeństwa, zarządzanie i doskonałość operacyjną. W miarę jak Twoja organizacja będzie coraz bardziej wykorzystywać nowe technologie, takie jak generatywna sztuczna inteligencja i LLM, ogólną odporność organizacji należy uznać za kamień węgielny wielowarstwowej strategii obronnej mającej na celu ochronę aktywów i linii biznesowych przed niezamierzonymi konsekwencjami.

Odporność organizacyjna ma istotne znaczenie w zastosowaniach LLM

Chociaż wszystkie programy zarządzania ryzykiem mogą zyskać na odporności, odporność organizacji ma istotne znaczenie w przypadku generatywnej sztucznej inteligencji. Pięć z 10 najważniejszych zagrożeń zidentyfikowanych przez OWASP dla aplikacji LLM opiera się na zdefiniowaniu mechanizmów kontroli architektonicznej i operacyjnej oraz egzekwowaniu ich na skalę organizacyjną w celu zarządzania ryzykiem. Te pięć zagrożeń to niepewna obsługa wyników, słabe punkty łańcucha dostaw, ujawnianie wrażliwych informacji, nadmierna agencja i nadmierne poleganie. Rozpocznij zwiększanie odporności organizacji poprzez nawiązywanie kontaktów towarzyskich ze swoimi zespołami, aby uważały bezpieczeństwo sztucznej inteligencji, uczenia maszynowego i generatywnej sztucznej inteligencji za podstawowy wymóg biznesowy i najwyższy priorytet w całym cyklu życia produktu, od powstania pomysłu, przez badania, rozwój aplikacji, wdrażanie i używać. Oprócz zwiększania świadomości Twoje zespoły powinny podjąć działania uwzględniające generatywną sztuczną inteligencję w praktykach zarządzania, zapewniania pewności i sprawdzania zgodności.

Buduj odporność organizacji wokół generatywnej sztucznej inteligencji

Organizacje mogą zacząć wdrażać sposoby budowania swojego potencjału i możliwości w zakresie AI/ML i generatywnego bezpieczeństwa AI w swoich organizacjach. Powinieneś zacząć od rozszerzenia istniejących programów bezpieczeństwa, zapewnienia zgodności i rozwoju, aby uwzględnić generatywną sztuczną inteligencję.

Poniżej przedstawiono pięć kluczowych obszarów zainteresowań w zakresie organizacyjnej sztucznej inteligencji, uczenia maszynowego i generatywnego bezpieczeństwa sztucznej inteligencji:

- Zrozumienie krajobrazu bezpieczeństwa AI/ML

- Uwzględnij różnorodne perspektywy w strategiach bezpieczeństwa

- Podejmij aktywne działania w celu zabezpieczenia działalności badawczo-rozwojowej

- Dostosuj zachęty do wyników organizacji

- Przygotuj się na realistyczne scenariusze bezpieczeństwa w AI/ML i generatywnej sztucznej inteligencji

Opracuj model zagrożeń w całym cyklu życia sztucznej inteligencji

Organizacje korzystające z generatywnej sztucznej inteligencji powinny skoncentrować się na zarządzaniu ryzykiem, a nie na jego eliminacji, i uwzględniać modelowanie zagrożeń w I Business Continuity Planning planowanie, rozwój i działanie generatywnych obciążeń AI. Cofnij się od produkcyjnego wykorzystania generatywnej sztucznej inteligencji, opracowując model zagrożeń dla każdej aplikacji, korzystając z tradycyjnych zagrożeń bezpieczeństwa, a także zagrożeń specyficznych dla generatywnej sztucznej inteligencji. Niektóre ryzyka mogą być akceptowalne dla Twojej firmy, a modelowanie zagrożeń może pomóc Twojej firmie w określeniu akceptowalnego apetytu na ryzyko. Na przykład Twoja firma może nie wymagać sprawności działania aplikacji generującej sztuczną inteligencję na poziomie 99.999%, więc dodatkowy czas odzyskiwania związany z odzyskiwaniem przy użyciu Kopia zapasowa AWS w Lodowiec Amazon S3 może stanowić akceptowalne ryzyko. I odwrotnie, dane w Twoim modelu mogą być niezwykle wrażliwe i podlegać ścisłym regulacjom, dlatego należy odstąpić od tego Usługa zarządzania kluczami AWS (AWS KMS) klucz zarządzany przez klienta (CMK) rotacja i wykorzystanie Zapora sieciowa AWS pomoc w egzekwowaniu zabezpieczeń TLS (Transport Layer Security) dla ruchu przychodzącego i wychodzącego w celu ochrony przed wyciekiem danych może stanowić niedopuszczalne ryzyko.

Oceń ryzyko (wrodzone czy szczątkowe) związane z używaniem generatywnej aplikacji AI w środowisku produkcyjnym, aby zidentyfikować odpowiednie kontrole podstawowe i na poziomie aplikacji. Zaplanuj wycofywanie i odzyskiwanie po zdarzeniach związanych z bezpieczeństwem produkcji i zakłóceniach usług, takich jak natychmiastowe wstrzykiwanie, zatruwanie danych szkoleniowych, odmowa usługi modelu i kradzież modelu na wczesnym etapie, a także zdefiniuj środki zaradcze, których będziesz używać podczas definiowania wymagań aplikacji. Poznanie zagrożeń i mechanizmów kontrolnych, które należy wdrożyć, pomoże w zdefiniowaniu najlepszego podejścia do wdrażania tworzenia generatywnej aplikacji AI oraz zapewni interesariuszom i decydentom informacje umożliwiające podejmowanie świadomych decyzji biznesowych dotyczących ryzyka. Jeśli nie znasz ogólnego przepływu pracy w zakresie sztucznej inteligencji i uczenia maszynowego, zacznij od przejrzenia 7 sposobów na poprawę bezpieczeństwa obciążeń związanych z uczeniem maszynowym zwiększenie znajomości mechanizmów kontroli bezpieczeństwa niezbędnych w tradycyjnych systemach AI/ML.

Podobnie jak budowanie dowolnej aplikacji ML, budowanie generatywnej aplikacji AI wymaga przejścia przez szereg etapów cyklu życia badań i rozwoju. Być może zechcesz przejrzeć Macierz zakresu zabezpieczeń generowanej sztucznej inteligencji AWS aby pomóc w zbudowaniu modelu mentalnego umożliwiającego zrozumienie kluczowych dziedzin bezpieczeństwa, które należy wziąć pod uwagę w zależności od wybranego rozwiązania generatywnej sztucznej inteligencji.

Generacyjne aplikacje AI wykorzystujące LLM są zazwyczaj opracowywane i obsługiwane w następujących uporządkowanych etapach:

- Wymagania aplikacyjne – Zidentyfikuj cele biznesowe, wymagania i kryteria sukcesu w przypadku użycia

- Wybór modelu – Wybierz model podstawowy, który jest zgodny z wymaganiami przypadku użycia

- Adaptacja i dostrajanie modelu – Przygotuj dane, podpowiedz inżynierom i dopracuj model

- Ocena modelu – Oceń modele podstawowe za pomocą wskaźników specyficznych dla przypadku użycia i wybierz model o najlepszej wydajności

- Wdrożenie i integracja – Wdróż wybrany model podstawowy na zoptymalizowanej infrastrukturze i zintegruj się z generatywną aplikacją AI

- Monitorowanie aplikacji – Monitoruj wydajność aplikacji i modelu, aby umożliwić analizę przyczyn źródłowych

Upewnij się, że zespoły rozumieją kluczową naturę bezpieczeństwa w ramach faz projektowania i architektury cyklu życia oprogramowania już od pierwszego dnia. Oznacza to omówienie bezpieczeństwa na każdej warstwie stosu i cyklu życia oraz umiejscowienie bezpieczeństwa i prywatności jako czynników umożliwiających osiągnięcie celów biznesowych. Przed uruchomieniem aplikacji LLM zaprojektuj kontrolę zagrożeń i rozważ, czy dane i informacje, których będziesz używać do adaptacji i dostrajania modelu, uzasadniają wdrożenie kontroli w środowiskach badawczo-rozwojowych i szkoleniowych. W ramach testów zapewniania jakości wprowadzaj syntetyczne zagrożenia bezpieczeństwa (takie jak próba zatrucia danych szkoleniowych lub próba wyodrębnienia wrażliwych danych za pomocą złośliwej inżynierii natychmiastowej), aby regularnie testować swoje zabezpieczenia i stan bezpieczeństwa.

Ponadto zainteresowane strony powinny ustalić spójną częstotliwość przeglądów produkcyjnych obciążeń AI, uczenia maszynowego i generatywnej sztucznej inteligencji oraz ustalić priorytet organizacyjny w zakresie zrozumienia kompromisów między kontrolą człowieka i maszyny oraz błędami przed uruchomieniem. Walidacja i zapewnienie, że te kompromisy są przestrzegane we wdrożonych aplikacjach LLM, zwiększy prawdopodobieństwo powodzenia w ograniczaniu ryzyka.

Twórz generatywne aplikacje AI na bezpiecznych podstawach chmury

W AWS bezpieczeństwo jest naszym najwyższym priorytetem. AWS został zaprojektowany jako najbezpieczniejsza globalna infrastruktura chmurowa, na której można budować, migrować i zarządzać aplikacjami i obciążeniami. Potwierdza to nasz bogaty zestaw ponad 300 narzędzi zapewniających bezpieczeństwo w chmurze oraz zaufanie milionów naszych klientów, w tym organizacji najbardziej wrażliwych na bezpieczeństwo, takich jak instytucje rządowe, służby zdrowia i usługi finansowe. Tworząc generatywne aplikacje AI przy użyciu LLM w AWS, zyskujesz korzyści w zakresie bezpieczeństwa dzięki bezpieczne, niezawodne i elastyczne środowisko obliczeniowe AWS Cloud.

Korzystaj z globalnej infrastruktury AWS, aby zapewnić bezpieczeństwo, prywatność i zgodność

Tworząc aplikacje intensywnie korzystające z danych w AWS, możesz skorzystać z globalnej infrastruktury regionalnej AWS, zaprojektowanej tak, aby zapewniała możliwości spełniające Twoje podstawowe wymagania dotyczące bezpieczeństwa i zgodności. U nas to potwierdza Przyrzeczenie suwerenności cyfrowej AWS, nasze zaangażowanie w oferowanie najbardziej zaawansowanego zestawu kontroli suwerenności i funkcji dostępnych w chmurze. Zależy nam na poszerzaniu naszych możliwości, aby umożliwić Państwu spełnienie Państwa oczekiwań suwerenność cyfrowa potrzeb, bez uszczerbku dla wydajności, innowacyjności, bezpieczeństwa i skali chmury AWS. Aby uprościć wdrażanie najlepszych praktyk w zakresie bezpieczeństwa i prywatności, rozważ wykorzystanie projektów referencyjnych i infrastruktury jako zasobów kodu, takich jak Architektura referencyjna bezpieczeństwa AWS (AWS SRA) oraz Architektura referencyjna dotycząca prywatności AWS (AWS PRA). Przeczytaj więcej o projektowanie rozwiązań zapewniających prywatność, suwerenność z założenia, zgodność z AWS i korzystaj z usług takich jak Konfiguracja AWS, Artefakt AWS, Menedżer audytu AWS aby wspierać Twoje potrzeby w zakresie prywatności, zgodności, audytu i obserwowalności.

Zrozum swój stan bezpieczeństwa, korzystając z AWS Well-Architected i Cloud Adoption Frameworks

AWS oferuje wskazówki dotyczące najlepszych praktyk opracowane na podstawie wieloletniego doświadczenia we wspieraniu klientów w projektowaniu środowisk chmurowych za pomocą Dobrze zaprojektowany framework AWS oraz w rozwoju, aby realizować wartość biznesową z technologii chmurowych za pomocą Platforma wdrażania chmury AWS (AWS CAF). Zrozum stan zabezpieczeń obciążeń związanych ze sztuczną inteligencją, uczeniem się maszynowym i generatywną sztuczną inteligencją, przeprowadzając przegląd dobrze zaprojektowanego środowiska. Recenzje można przeprowadzać za pomocą narzędzi takich jak Dobrze zaprojektowane narzędzie AWSlub z pomocą zespołu AWS Wsparcie dla przedsiębiorstw AWS. Dobrze zaprojektowane narzędzie AWS automatycznie integruje spostrzeżenia od Zaufany doradca AWS aby ocenić, jakie najlepsze praktyki są stosowane i jakie istnieją możliwości poprawy funkcjonalności i optymalizacji kosztów. Narzędzie AWS Well-Architected Tool oferuje również niestandardowe soczewki z określonymi najlepszymi praktykami, takimi jak Obiektyw uczenia maszynowego abyś mógł regularnie mierzyć swoją architekturę pod kątem najlepszych praktyk i identyfikować obszary wymagające poprawy. Sprawdź swoją podróż na ścieżce do realizacji wartości i dojrzałości chmury, poznając, w jaki sposób klienci AWS przyjmują strategie w celu rozwijania możliwości organizacyjnych w Struktura wdrażania chmury AWS dla sztucznej inteligencji, uczenia maszynowego i generatywnej sztucznej inteligencji. Możesz także zyskać na zrozumieniu ogólnej gotowości do pracy w chmurze, uczestnicząc w konferencji Ocena gotowości do pracy w chmurze AWS. AWS oferuje dodatkowe możliwości zaangażowania — poproś zespół obsługi klienta AWS o więcej informacji o tym, jak rozpocząć korzystanie z Generacyjne Centrum Innowacji AI.

Przyspiesz naukę bezpieczeństwa i AI/ML dzięki wskazówkom, szkoleniom i certyfikatom dotyczącym najlepszych praktyk

AWS jest także kuratorem rekomendacji z Najlepsze praktyki w zakresie bezpieczeństwa, tożsamości i zgodności i Dokumentacja bezpieczeństwa AWS aby pomóc Ci określić sposoby zabezpieczenia środowisk szkoleniowych, programistycznych, testowych i operacyjnych. Jeśli dopiero zaczynasz, zagłęb się w szkolenia i certyfikację w zakresie bezpieczeństwa, rozważ rozpoczęcie od Podstawy bezpieczeństwa AWS oraz Plan nauki o bezpieczeństwie AWS. Możesz także użyć Model dojrzałości zabezpieczeń AWS aby pomóc Ci znaleźć i ustalić priorytety najlepszych działań na różnych etapach dojrzałości w AWS, zaczynając od szybkich zwycięstw, poprzez podstawowe, wydajne i zoptymalizowane etapy. Gdy Ty i Twoje zespoły zdobędziecie podstawową wiedzę na temat bezpieczeństwa w AWS, zdecydowanie zalecamy zapoznanie się z nimi Jak podejść do modelowania zagrożeń a następnie poprowadź ze swoimi zespołami ćwiczenie modelowania zagrożeń, zaczynając od Warsztaty dotyczące modelowania zagrożeń dla konstruktorów program treningowy. Jest wiele innych Zasoby szkoleniowe i certyfikacyjne dotyczące bezpieczeństwa AWS dostępny.

Zastosuj podejście dogłębnej obrony, aby zabezpieczyć aplikacje LLM

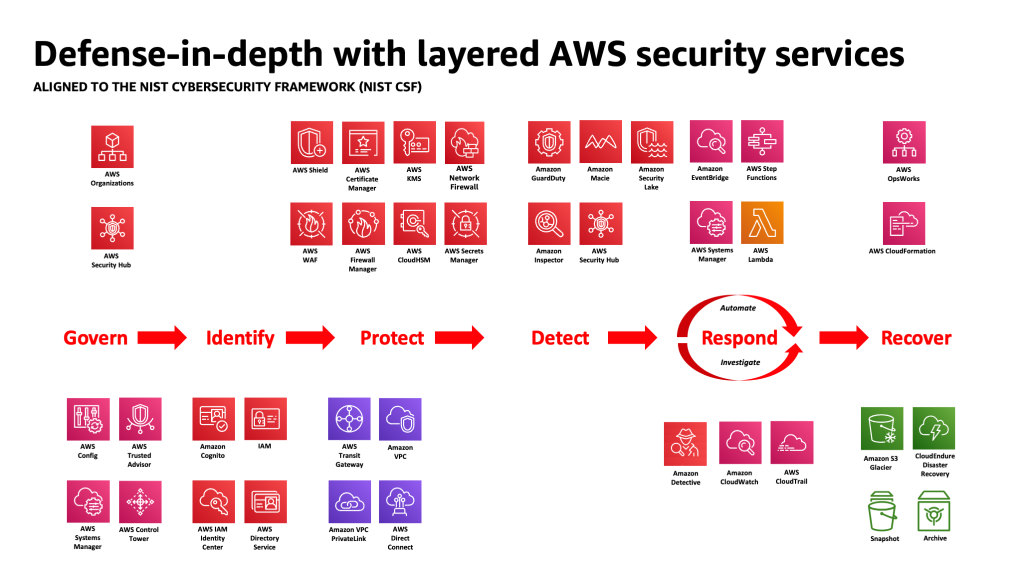

Zastosowanie podejścia zapewniającego dogłębną ochronę do obciążeń, danych i informacji związanych z generatywną sztuczną inteligencją może pomóc w stworzeniu najlepszych warunków do osiągnięcia celów biznesowych. Najlepsze praktyki w zakresie zabezpieczeń zapewniających dogłębną ochronę ograniczają wiele typowych zagrożeń, na jakie narażają się dowolne obciążenia, pomagając Tobie i Twoim zespołom przyspieszyć wprowadzanie generatywnych innowacji w zakresie sztucznej inteligencji. Strategia bezpieczeństwa obejmująca dogłębną ochronę wykorzystuje wiele nadmiarowych zabezpieczeń w celu ochrony kont AWS, obciążeń, danych i zasobów. Pomaga mieć pewność, że w przypadku naruszenia lub awarii dowolnej kontroli bezpieczeństwa istnieją dodatkowe warstwy pomagające izolować zagrożenia oraz zapobiegać, wykrywać, reagować i odzyskiwać siły po zdarzeniach związanych z bezpieczeństwem. Możesz zastosować kombinację strategii, w tym usług i rozwiązań AWS, na każdej warstwie, aby poprawić bezpieczeństwo i odporność obciążeń generatywnej sztucznej inteligencji.

Wielu klientów AWS dostosowuje się do standardów branżowych, takich jak NIST Cyberbezpieczeństwo Framework. Ta struktura pomaga zapewnić ochronę obejmującą filary identyfikacji, ochrony, wykrywania, reagowania, odzyskiwania i ostatnio dodanego zarządzania. Tę platformę można następnie łatwo odwzorować na usługi bezpieczeństwa AWS i usługi zintegrowanych stron trzecich, aby pomóc Ci zweryfikować odpowiedni zakres i zasady dotyczące każdego zdarzenia związanego z bezpieczeństwem, jakie napotka Twoja organizacja.

Dogłębna obrona: zabezpiecz swoje środowisko, a następnie dodaj ulepszone funkcje zabezpieczeń i prywatności specyficzne dla AI/ML

Strategia dogłębnej obrony powinna rozpoczynać się od ochrony kont i organizacji, a następnie zastosować dodatkowe wbudowane funkcje usług poprawiające bezpieczeństwo i prywatność, takie jak Amazońska skała macierzysta i Amazon Sage Maker. Amazon oferuje ponad 30 usług z zakresu bezpieczeństwa, tożsamości i zgodności które są zintegrowane z usługami AWS AI/ML i mogą być używane razem w celu zabezpieczenia obciążeń, kont i organizacji. Aby właściwie obronić się przed OWASP Top 10 for LLM, należy ich używać razem z usługami AWS AI/ML.

Zacznij od wdrożenia polityki najniższych uprawnień, korzystając z usług takich jak Analizator dostępu IAM do szukaj zbyt liberalnych kont, ról i zasobów, aby ograniczyć dostęp za pomocą krótkoterminowych poświadczeń. Następnie upewnij się, że wszystkie przechowywane dane są zaszyfrowane za pomocą AWS KMS, biorąc pod uwagę użycie CMK, a wszystkie dane i modele są wersjonowane i kopie zapasowe przy użyciu Usługa Amazon Simple Storage (Amazon S3) wersjonowanie i stosowanie niezmienności na poziomie obiektu za pomocą Blokada obiektu Amazon S3. Chroń wszystkie dane przesyłane między usługami za pomocą Menedżer certyfikatów AWS i / lub AWS Prywatna CAi przechowuj go w VPC za pomocą Prywatny link AWS. Zdefiniuj rygorystyczne reguły dotyczące przychodzących i wychodzących danych, aby chronić je przed manipulacją i eksfiltracją za pomocą VPC Zapora sieciowa AWS polityki. Rozważ wstawienie Zapora sieciowa AWS (AWS WAF) z przodu chronić aplikacje internetowe i interfejsy API od złośliwe boty, Ataki polegające na wstrzykiwaniu SQL, cross-site scripting (XSS), i przejęcia kont z Kontrola oszustw. Logowanie za pomocą Chmura AWS, Wirtualna prywatna chmura Amazon dzienniki przepływu (Amazon VPC) oraz Elastyczna usługa Amazon Kubernetes Dzienniki audytu (Amazon EKS) pomogą w przeprowadzeniu analizy kryminalistycznej każdej transakcji dostępnej dla usług takich jak Detektyw Amazona. Możesz użyć Inspektor Amazona do automatyzacji wykrywania i zarządzania lukami w zabezpieczeniach Elastyczna chmura obliczeniowa Amazon (Amazon EC2) instancje, kontenery, AWS Lambda funkcje i określić dostępność sieci dla swoich obciążeń. Chroń swoje dane i modele przed podejrzaną aktywnością za pomocą Amazon Guard Obowiązekmodele zagrożeń i źródła danych wywiadowczych oparte na technologii ML oraz umożliwiające dodatkowe funkcje ochrony EKS, ochrony ECS, ochrony S3, ochrony RDS, ochrony przed złośliwym oprogramowaniem, ochrony Lambda i innych. Możesz skorzystać z usług np Centrum bezpieczeństwa AWS aby scentralizować i zautomatyzować kontrole bezpieczeństwa, aby wykryć odchylenia od najlepszych praktyk w zakresie bezpieczeństwa oraz przyspieszyć dochodzenie i zautomatyzować korygowanie ustaleń dotyczących bezpieczeństwa za pomocą podręczników. Można także rozważyć wdrożenie np zero zaufania architekturę na platformie AWS w celu dalszego zwiększenia szczegółowej kontroli uwierzytelniania i autoryzacji w odniesieniu do tego, do czego użytkownicy lub procesy maszyna-maszyna mogą uzyskać dostęp na podstawie pojedynczego żądania. Rozważ także użycie Jezioro bezpieczeństwa Amazonii aby automatycznie centralizować dane dotyczące bezpieczeństwa ze środowisk AWS, dostawców SaaS, lokalnie i źródeł w chmurze w specjalnie zbudowanym jeziorze danych przechowywanym na Twoim koncie. Dzięki rozwiązaniu Security Lake możesz uzyskać pełniejszy obraz danych dotyczących zabezpieczeń w całej organizacji.

Po zabezpieczeniu środowiska obciążeń generatywnych AI można nakładać na nie funkcje specyficzne dla AI/ML, takie jak Pogromca danych Amazon SageMaker w celu zidentyfikowania potencjalnej stronniczości podczas przygotowywania danych i Amazon SageMaker Wyjaśnij w celu wykrycia błędu systematycznego w danych i modelach uczenia maszynowego. Możesz także użyć Monitor modelu Amazon SageMaker aby ocenić jakość modeli SageMaker ML w środowisku produkcyjnym i powiadomić Cię o zmianie jakości danych, jakości modelu i przypisaniu funkcji. Te usługi AI/ML AWS współpracujące (w tym SageMaker współpracujący z Amazon Bedrock) z usługami AWS Security mogą pomóc w zidentyfikowaniu potencjalnych źródeł naturalnej stronniczości i ochronie przed złośliwym manipulowaniem danymi. Powtórz ten proces dla każdej z 10 najpopularniejszych luk w zabezpieczeniach OWASP dla LLM, aby mieć pewność, że maksymalizujesz wartość usług AWS w celu wdrożenia dogłębnej ochrony w celu ochrony danych i obciążeń.

Jak napisał w swoim poście na blogu specjalista ds. strategii AWS Enterprise Clarke Rodgers „Wgląd CISO: każda usługa AWS to usługa bezpieczeństwa”„Twierdzę, że praktycznie każda usługa w chmurze AWS albo sama zapewnia bezpieczeństwo, albo może być używana (samodzielnie lub w połączeniu z jedną lub większą liczbą usług) przez klientów w celu osiągnięcia celu związanego z bezpieczeństwem, ryzykiem lub zgodnością”. Ponadto „Specjaliści ds. bezpieczeństwa informacji klientów (CISO) (lub ich odpowiednie zespoły) mogą chcieć poświęcić czas na upewnienie się, że są dobrze zaznajomieni ze wszystkimi usługami AWS, ponieważ może istnieć cel w zakresie bezpieczeństwa, ryzyka lub zgodności, który można osiągnąć, nawet jeśli usługa nie należy do kategorii „Bezpieczeństwo, tożsamość i zgodność”.

Warstwowe zabezpieczenia na granicach zaufania w aplikacjach LLM

Tworząc generatywne systemy i aplikacje oparte na sztucznej inteligencji, należy wziąć pod uwagę te same obawy, co w przypadku każdej innej aplikacji ML, jak wspomniano w Matryca zagrożeń uczenia maszynowego MITRE ATLAS, takie jak zwracanie uwagi na pochodzenie oprogramowania i składników danych (np. przeprowadzanie audytu oprogramowania typu open source, przeglądanie zestawienia komponentów oprogramowania (SBOM) oraz analizowanie przepływów pracy z danymi i integracji interfejsów API) oraz wdrażanie niezbędnych zabezpieczeń przed zagrożeniami w łańcuchu dostaw LLM. Uwzględnij spostrzeżenia ze środowisk branżowych i miej świadomość sposobów korzystania z wielu źródeł informacji o zagrożeniach i ryzyku w celu dostosowania i rozszerzenia zabezpieczeń w celu uwzględnienia zagrożeń bezpieczeństwa związanych ze sztuczną inteligencją, uczeniem się maszynowym i generatywną sztuczną inteligencją, które pojawiają się i nie są uwzględniane w tradycyjnych strukturach. Poszukuj dodatkowych informacji na temat zagrożeń związanych ze sztuczną inteligencją ze źródeł branżowych, obronnych, rządowych, międzynarodowych i akademickich, ponieważ w tej przestrzeni regularnie pojawiają się i ewoluują nowe zagrożenia, a towarzyszące ramy i przewodniki są często aktualizowane. Na przykład w przypadku korzystania z modelu generacji rozszerzonej wyszukiwania (RAG), jeśli model nie zawiera potrzebnych danych, może zażądać ich z zewnętrznego źródła danych w celu wykorzystania podczas wnioskowania i dostrajania. Źródło, którego dotyczy zapytanie, może znajdować się poza Twoją kontrolą i może stanowić potencjalne źródło kompromisu w Twoim łańcuchu dostaw. Podejście polegające na dogłębnej obronie powinno zostać rozszerzone na źródła zewnętrzne w celu ustanowienia zaufania, uwierzytelniania, autoryzacji, dostępu, bezpieczeństwa, prywatności i dokładności danych, do których uzyskuje dostęp. Aby zanurkować głębiej, przeczytaj „Zbuduj bezpieczną aplikację dla przedsiębiorstw za pomocą Generative AI i RAG za pomocą Amazon SageMaker JumpStart"

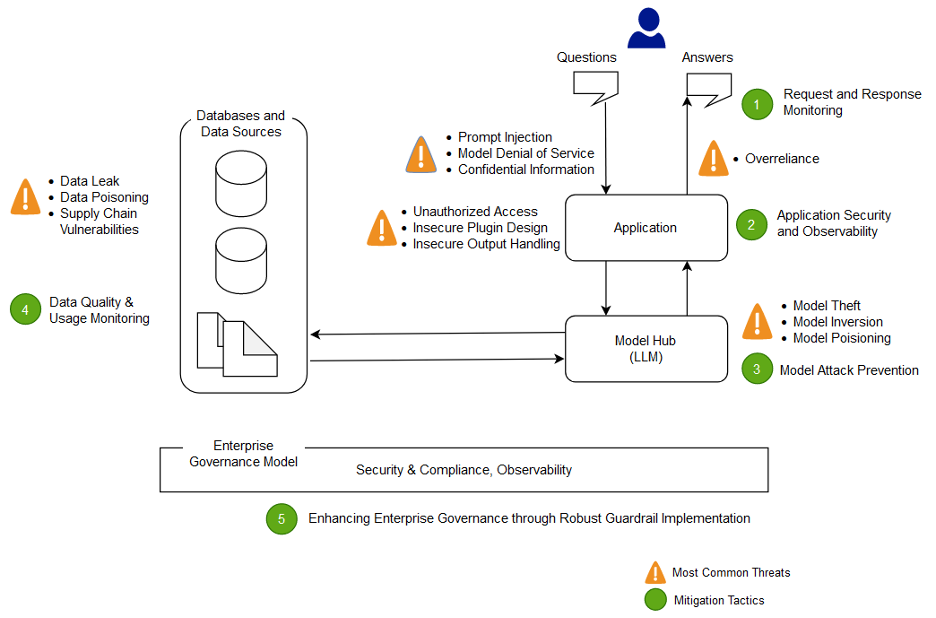

Analizuj i łagodź ryzyko w swoich aplikacjach LLM

W tej sekcji analizujemy i omawiamy niektóre techniki ograniczania ryzyka w oparciu o granice zaufania i interakcje lub odrębne obszary obciążenia pracą o podobnym zakresie odpowiednich kontroli i profilu ryzyka. W tej przykładowej architekturze aplikacji chatbota istnieje pięć granic zaufania, w których zademonstrowano kontrole w oparciu o sposób, w jaki klienci AWS zwykle budują swoje aplikacje LLM. Twoja aplikacja LLM może mieć więcej lub mniej możliwych do zdefiniowania granic zaufania. W poniższej przykładowej architekturze te granice zaufania są zdefiniowane jako:

- Interakcje w interfejsie użytkownika (żądanie i odpowiedź)

- Interakcje aplikacji

- Modelowe interakcje

- Interakcje danych

- Interakcje organizacyjne i wykorzystanie

Interakcje w interfejsie użytkownika: Opracuj monitorowanie żądań i odpowiedzi

Wykrywaj incydenty cybernetyczne związane z generatywną sztuczną inteligencją i reaguj na nie w odpowiednim czasie, oceniając strategię mającą na celu zajęcie się ryzykiem na podstawie danych wejściowych i wyjściowych aplikacji generatywnej sztucznej inteligencji. Na przykład może być konieczne zastosowanie dodatkowego monitorowania zachowań i wypływu danych w celu wykrycia ujawnienia poufnych informacji poza domeną lub organizacją, w przypadku gdy są one wykorzystywane w aplikacji LLM.

Aplikacje generujące sztuczną inteligencję powinny nadal przestrzegać standardowych najlepszych praktyk w zakresie bezpieczeństwa, jeśli chodzi o ochronę danych. Ustanowić bezpieczny obszar danych i bezpieczne magazyny wrażliwych danych. Szyfruj dane i informacje używane w aplikacjach LLM w stanie spoczynku i podczas transportu. Chroń dane używane do uczenia modelu przed zatruwaniem danych szkoleniowych poprzez zrozumienie i kontrolowanie, którzy użytkownicy, procesy i role mogą wnosić wkład do magazynów danych, a także sposób przepływu danych w aplikacji, monitorowanie odchyleń od stronniczości oraz korzystanie z wersjonowania i niezmienna pamięć w usługach pamięci masowej, takich jak Amazon S3. Ustanów ścisłą kontrolę danych przychodzących i wychodzących, korzystając z usług takich jak AWS Network Firewall i AWS VPC, aby chronić przed podejrzanymi danymi wejściowymi i możliwością wycieku danych.

Podczas procesu szkolenia, przekwalifikowania lub dostrajania należy mieć świadomość wszelkich wykorzystywanych wrażliwych danych. Po wykorzystaniu danych w trakcie jednego z tych procesów należy zaplanować scenariusz, w którym dowolny użytkownik Twojego modelu nagle będzie mógł wyodrębnić dane lub informacje z powrotem, korzystając z technik szybkiego wstrzykiwania. Zrozum ryzyko i korzyści wynikające z używania wrażliwych danych w modelach i wnioskowaniu. Wdrażaj niezawodne mechanizmy uwierzytelniania i autoryzacji w celu ustanawiania i zarządzania szczegółowymi uprawnieniami dostępu, które nie opierają się na logice aplikacji LLM, aby zapobiec ujawnieniu. Wykazano, że kontrolowane przez użytkownika dane wejściowe do generatywnej aplikacji AI są w stanie w pewnych warunkach zapewnić wektor umożliwiający wyodrębnienie informacji z modelu lub dowolnych części danych wejściowych niekontrolowanych przez użytkownika. Może to nastąpić poprzez szybkie wstrzyknięcie, gdy użytkownik wprowadza dane wejściowe, które powodują, że dane wyjściowe modelu odbiegają od oczekiwanych poręczy aplikacji LLM, w tym dostarczają wskazówek dotyczących zbiorów danych, na których model był pierwotnie szkolony.

Zaimplementuj przydziały dostępu na poziomie użytkownika dla użytkowników dostarczających dane wejściowe i odbierających dane wyjściowe z modelu. Należy rozważyć podejścia, które nie pozwalają na anonimowy dostęp w warunkach, w których dane i informacje dotyczące uczenia modelu są wrażliwe lub gdy istnieje ryzyko, że przeciwnik szkoli faksymile Twojego modelu na podstawie jego danych wejściowych i dostosowanych wyników modelu. Ogólnie rzecz biorąc, jeśli część danych wejściowych do modelu składa się z dowolnego tekstu dostarczonego przez użytkownika, należy uznać, że dane wyjściowe mogą zostać natychmiast wstrzyknięte i odpowiednio upewnić się, że wykorzystanie wyników obejmuje wdrożone techniczne i organizacyjne środki zaradcze w celu złagodzenia niepewnego przetwarzania wyników, nadmiernej agencji i nadmierne poleganie. We wcześniejszym przykładzie związanym z filtrowaniem złośliwych danych wejściowych za pomocą AWS WAF rozważ zbudowanie przed aplikacją filtra pod kątem potencjalnego niewłaściwego użycia monitów i opracuj zasady postępowania z nimi i ich rozwijania w miarę wzrostu modelu i danych. Rozważ także filtrowaną recenzję wyników, zanim zostaną one zwrócone użytkownikowi, aby upewnić się, że spełniają standardy jakości, dokładności i moderacji treści. Możesz dodatkowo dostosować to do potrzeb swojej organizacji, zapewniając dodatkową warstwę kontroli danych wejściowych i wyjściowych przed modelami, aby złagodzić podejrzane wzorce ruchu.

Interakcje aplikacji: bezpieczeństwo i obserwowalność aplikacji

Przejrzyj swoją aplikację LLM, zwracając uwagę na to, w jaki sposób użytkownik może wykorzystać Twój model w celu ominięcia standardowej autoryzacji do dalszego narzędzia lub łańcucha narzędzi, do którego nie ma uprawnień dostępu ani używania. Innym problemem na tej warstwie jest dostęp do zewnętrznych magazynów danych przy użyciu modelu jako mechanizmu ataku z wykorzystaniem nieograniczonego ryzyka technicznego lub organizacyjnego LLM. Na przykład, jeśli Twój model został przeszkolony w zakresie uzyskiwania dostępu do określonych magazynów danych, które mogą zawierać dane wrażliwe, należy upewnić się, że istnieją odpowiednie kontrole autoryzacji między modelem a magazynami danych. Podczas sprawdzania autoryzacji używaj niezmiennych atrybutów użytkowników, którzy nie pochodzą z modelu. Całkowicie niezabezpieczona obsługa danych wyjściowych, niepewny projekt wtyczek i nadmierna agencja mogą stworzyć warunki, w których ugrupowanie zagrażające może wykorzystać model w celu oszukania systemu autoryzacji w celu eskalacji skutecznych uprawnień, co prowadzi do tego, że element końcowy będzie przekonany, że użytkownik jest upoważniony do pobrania danych lub podjęcia określonego działanie.

Podczas wdrażania dowolnej wtyczki lub narzędzia generatywnej sztucznej inteligencji konieczne jest sprawdzenie i zrozumienie poziomu przyznawanego dostępu, a także sprawdzenie skonfigurowanych kontroli dostępu. Korzystanie z całkowicie niepewnych, generatywnych wtyczek AI może narazić system na luki i zagrożenia w łańcuchu dostaw, co może prowadzić do złośliwych działań, w tym do uruchomienia zdalnego kodu.

Interakcje modelowe: zapobieganie atakom modelowym

Powinieneś być świadomy pochodzenia wszelkich modeli, wtyczek, narzędzi lub danych, z których korzystasz, aby ocenić i złagodzić luki w łańcuchu dostaw. Na przykład niektóre popularne formaty modeli pozwalają na osadzanie dowolnego kodu uruchamialnego w samych modelach. Korzystaj z kopii lustrzanych pakietów, skanowania i dodatkowych inspekcji stosownie do celów bezpieczeństwa Twojej organizacji.

Należy również sprawdzić zbiory danych, na których szkolisz i dostrajasz modele. Jeśli będziesz dalej automatycznie dostrajać model na podstawie opinii użytkowników (lub innych informacji, którymi może sterować użytkownik końcowy), musisz rozważyć, czy złośliwy aktor zagrażający nie mógłby dowolnie zmienić modelu w oparciu o manipulowanie ich odpowiedziami i spowodować zatrucie danych szkoleniowych.

Interakcje z danymi: Monitoruj jakość i wykorzystanie danych

Modele generatywne AI, takie jak LLM, na ogół sprawdzają się dobrze, ponieważ zostały przeszkolone na dużej ilości danych. Chociaż dane te pomagają LLM w wykonywaniu złożonych zadań, mogą również narazić system na ryzyko zatrucia danych szkoleniowych, które ma miejsce, gdy w zestawie danych szkoleniowych zostaną uwzględnione lub pominięte nieodpowiednie dane, które mogą zmienić zachowanie modelu. Aby ograniczyć to ryzyko, należy przyjrzeć się swojemu łańcuchowi dostaw i zrozumieć proces przeglądu danych w systemie, zanim zostaną one wykorzystane w modelu. Chociaż potok szkoleniowy jest głównym źródłem zatruwania danych, należy również sprawdzić, w jaki sposób model pobiera dane, na przykład w modelu RAG lub jeziorze danych, oraz czy źródło tych danych jest zaufane i chronione. Korzystaj z usług bezpieczeństwa AWS, takich jak AWS Security Hub, Amazon GuardDuty i Amazon Inspector, aby stale monitorować podejrzaną aktywność w Amazon EC2, Amazon EKS, Amazon S3, Usługa relacyjnych baz danych Amazon (Amazon RDS) i dostęp do sieci, które mogą być wskaźnikami pojawiających się zagrożeń, a także używać narzędzia Detektyw do wizualizacji dochodzeń w sprawie bezpieczeństwa. Rozważ także skorzystanie z usług takich jak Jezioro bezpieczeństwa Amazonii aby przyspieszyć badania bezpieczeństwa poprzez utworzenie specjalnie zaprojektowanego jeziora danych w celu automatycznej centralizacji danych dotyczących bezpieczeństwa ze środowisk AWS, dostawców SaaS, lokalnie i źródeł w chmurze, które przyczyniają się do obciążeń AI/ML.

Interakcje organizacyjne: Wdrażaj zabezpieczenia ładu korporacyjnego dla generatywnej sztucznej inteligencji

Zidentyfikuj ryzyka związane z wykorzystaniem generatywnej sztucznej inteligencji w swoich firmach. Powinieneś zbudować taksonomię ryzyka swojej organizacji i przeprowadzić oceny ryzyka, aby podejmować świadome decyzje podczas wdrażania generatywnych rozwiązań AI. Rozwijać plan ciągłości działania (BCP) który obejmuje obciążenia AI, ML i generatywnej AI i który można szybko wdrożyć, aby zastąpić utraconą funkcjonalność aplikacji LLM, której dotyczy problem lub aplikacji LLM działającej w trybie offline, w celu spełnienia warunków umów SLA.

Zidentyfikuj luki, nieefektywności i niespójności w procesach i zasobach oraz zwiększ świadomość i poczucie odpowiedzialności w całej firmie. Model zagrożenia wszystkie obciążenia związane z generatywną sztuczną inteligencją w celu identyfikowania i łagodzenia potencjalnych zagrożeń bezpieczeństwa, które mogą prowadzić do skutków mających wpływ na działalność biznesową, w tym nieautoryzowanego dostępu do danych, odmowy usługi i niewłaściwego wykorzystania zasobów. Skorzystaj z nowości Narzędzie do modelowania narzędzia AWS Threat Composer aby pomóc skrócić czas uzyskiwania korzyści podczas modelowania zagrożeń. W dalszej części cykli rozwoju rozważ wprowadzenie inżynieria chaosu bezpieczeństwa eksperymenty z wstrzykiwaniem błędów w celu stworzenia rzeczywistych warunków, aby zrozumieć, jak system zareaguje na nieznane i zbudować pewność co do odporności i bezpieczeństwa systemu.

Uwzględnij różnorodne perspektywy w opracowywaniu strategii bezpieczeństwa i mechanizmów zarządzania ryzykiem, aby zapewnić zgodność i pokrycie sztucznej inteligencji/ML oraz bezpieczeństwa generatywnego na wszystkich stanowiskach i funkcjach. Od samego początku kieruj się podejściem do bezpieczeństwa i badaj dowolną generatywną aplikację AI, aby dostosować ją do wymagań. Jeśli potrzebujesz dodatkowej pomocy ze strony AWS, poproś swojego menedżera konta AWS, aby upewnił się, że wsparcie jest równe, prosząc o pomoc architektów rozwiązań AWS z AWS Security i AI/ML.

Upewnij się, że Twoja organizacja zajmująca się bezpieczeństwem regularnie podejmuje działania mające na celu wspieranie komunikacji zarówno w zakresie świadomości ryzyka, jak i zrozumienia zarządzania ryzykiem wśród interesariuszy generatywnej sztucznej inteligencji, takich jak menedżerowie produktów, programiści, analitycy danych i kierownictwo wykonawcze, umożliwiając wytyczne dotyczące informacji o zagrożeniach i kontroli dotarcia do zespołów, które mogą mieć wpływ. Organizacje zajmujące się bezpieczeństwem mogą wspierać kulturę odpowiedzialnego ujawniania informacji i iteracyjnego doskonalenia, uczestnicząc w dyskusjach i przedstawiając interesariuszom generatywnej sztucznej inteligencji nowe pomysły i informacje, które odnoszą się do ich celów biznesowych. Dowiedz się więcej o nasze zaangażowanie w odpowiedzialną sztuczną inteligencję i dodatkowe odpowiedzialne zasoby AI aby pomóc naszym klientom.

Zdobądź przewagę, umożliwiając lepszą postawę organizacyjną dla generatywnej sztucznej inteligencji, odblokowując wartość czasową w istniejących procesach bezpieczeństwa Twojej organizacji. Aktywnie oceniaj, gdzie Twoja organizacja może wymagać procesów, które są zbyt uciążliwe, biorąc pod uwagę kontekst bezpieczeństwa generatywnej sztucznej inteligencji, i udoskonalaj je, aby zapewnić programistom i naukowcom jasną ścieżkę do uruchomienia z właściwymi mechanizmami kontroli.

Oceń, gdzie mogą istnieć możliwości dostosowania zachęt, wyśmiewaj i zapewnij jasny pogląd na pożądane rezultaty. Aktualizuj wytyczne dotyczące kontroli i zabezpieczenia, aby sprostać zmieniającym się potrzebom w zakresie sztucznej inteligencji/ML i tworzenia aplikacji generatywnej sztucznej inteligencji, aby zmniejszyć zamieszanie i niepewność, które mogą kosztować czas opracowywania, zwiększać ryzyko i zwiększać wpływ.

Upewnij się, że interesariusze, którzy nie są ekspertami w dziedzinie bezpieczeństwa, są w stanie zrozumieć, w jaki sposób ład organizacyjny, zasady i kroki zarządzania ryzykiem odnoszą się do ich obciążeń, a także zastosować mechanizmy zarządzania ryzykiem. Przygotuj swoją organizację do reagowania na realistyczne zdarzenia i scenariusze, które mogą wystąpić w przypadku generatywnych aplikacji AI, i upewnij się, że role twórców generatywnej sztucznej inteligencji i zespoły reagowania są świadome ścieżek eskalacji i działań w przypadku podejrzeń o jakiekolwiek podejrzane działanie.

Wnioski

Aby pomyślnie skomercjalizować innowacje w oparciu o jakąkolwiek nową i powstającą technologię, należy zacząć od nastawienia na bezpieczeństwo, budować na fundamencie bezpiecznej infrastruktury i zastanowić się, w jaki sposób na wczesnym etapie zintegrować bezpieczeństwo na każdym poziomie stosu technologii z zabezpieczeniem zapewniającym dogłębną obronę zbliżać się. Obejmuje to interakcje na wielu warstwach stosu technologii oraz punkty integracji w cyfrowym łańcuchu dostaw, aby zapewnić odporność organizacji. Chociaż generatywna sztuczna inteligencja wprowadza pewne nowe wyzwania w zakresie bezpieczeństwa i prywatności, jeśli zastosujesz podstawowe najlepsze praktyki w zakresie bezpieczeństwa, takie jak korzystanie z dogłębnej obrony z warstwowymi usługami bezpieczeństwa, możesz pomóc chronić swoją organizację przed wieloma typowymi problemami i ewoluującymi zagrożeniami. Powinieneś wdrożyć warstwowe usługi bezpieczeństwa AWS w swoich generatywnych obciążeniach AI i większej organizacji i skupić się na punktach integracji w cyfrowych łańcuchach dostaw, aby zabezpieczyć środowiska chmurowe. Następnie możesz skorzystać z ulepszonych funkcji bezpieczeństwa i prywatności w usługach AWS AI/ML, takich jak Amazon SageMaker i Amazon Bedrock, aby dodać kolejne warstwy ulepszonych kontroli bezpieczeństwa i prywatności do swoich generatywnych aplikacji AI. Wdrożenie zabezpieczeń od samego początku sprawi, że wprowadzanie innowacji dzięki generatywnej sztucznej inteligencji będzie szybsze, łatwiejsze i tańsze, a jednocześnie uprości zgodność. Pomoże Ci to zwiększyć kontrolę, pewność i obserwowalność generatywnych aplikacji AI dla pracowników, klientów, partnerów, organów regulacyjnych i innych zainteresowanych stron.

Dodatkowe referencje

- Standardy branżowe dotyczące zarządzania ryzykiem i bezpieczeństwa specyficznego dla sztucznej inteligencji/ML:

O autorach

Krzysztof Rae jest głównym specjalistą ds. bezpieczeństwa globalnego GTM, skupiającym się na opracowywaniu i realizacji strategicznych inicjatyw przyspieszających i skalujących wdrażanie usług bezpieczeństwa AWS. Jego pasją jest połączenie cyberbezpieczeństwa i nowych technologii. Posiada ponad 20-letnie doświadczenie na stanowiskach globalnego strategicznego lidera w dostarczaniu rozwiązań w zakresie bezpieczeństwa klientom z branży mediów, rozrywki i telekomunikacji. Ładuje baterie poprzez czytanie, podróże, jedzenie i wino, odkrywanie nowej muzyki i doradzanie start-upom na wczesnym etapie rozwoju.

Krzysztof Rae jest głównym specjalistą ds. bezpieczeństwa globalnego GTM, skupiającym się na opracowywaniu i realizacji strategicznych inicjatyw przyspieszających i skalujących wdrażanie usług bezpieczeństwa AWS. Jego pasją jest połączenie cyberbezpieczeństwa i nowych technologii. Posiada ponad 20-letnie doświadczenie na stanowiskach globalnego strategicznego lidera w dostarczaniu rozwiązań w zakresie bezpieczeństwa klientom z branży mediów, rozrywki i telekomunikacji. Ładuje baterie poprzez czytanie, podróże, jedzenie i wino, odkrywanie nowej muzyki i doradzanie start-upom na wczesnym etapie rozwoju.

Eliasz Zima jest starszym inżynierem ds. bezpieczeństwa w Amazon Security, posiada licencjat z inżynierii bezpieczeństwa cybernetycznego i jest przepełniony miłością do Harry'ego Pottera. Elijah specjalizuje się w identyfikowaniu i eliminowaniu luk w systemach AI, łącząc wiedzę techniczną z odrobiną magii. Elijah projektuje dostosowane protokoły bezpieczeństwa dla ekosystemów sztucznej inteligencji, wnosząc magiczny styl do cyfrowej obrony. Kierując się uczciwością, Elijah ma doświadczenie w zakresie bezpieczeństwa zarówno w organizacjach sektora publicznego, jak i komercyjnego, koncentrujących się na ochronie zaufania.

Eliasz Zima jest starszym inżynierem ds. bezpieczeństwa w Amazon Security, posiada licencjat z inżynierii bezpieczeństwa cybernetycznego i jest przepełniony miłością do Harry'ego Pottera. Elijah specjalizuje się w identyfikowaniu i eliminowaniu luk w systemach AI, łącząc wiedzę techniczną z odrobiną magii. Elijah projektuje dostosowane protokoły bezpieczeństwa dla ekosystemów sztucznej inteligencji, wnosząc magiczny styl do cyfrowej obrony. Kierując się uczciwością, Elijah ma doświadczenie w zakresie bezpieczeństwa zarówno w organizacjach sektora publicznego, jak i komercyjnego, koncentrujących się na ochronie zaufania.

Rama Vittal jest głównym architektem rozwiązań ML w AWS. Ma ponad 3-letnie doświadczenie w projektowaniu i budowaniu aplikacji rozproszonych, hybrydowych i chmurowych. Pasjonuje się tworzeniem bezpiecznych i skalowalnych rozwiązań AI/ML i Big Data, aby pomóc klientom korporacyjnym w procesie wdrażania chmury i optymalizacji w celu poprawy wyników biznesowych. W wolnym czasie jeździ na motocyklu i spaceruje ze swoim 3-letnim Sheepadoodle!

Rama Vittal jest głównym architektem rozwiązań ML w AWS. Ma ponad 3-letnie doświadczenie w projektowaniu i budowaniu aplikacji rozproszonych, hybrydowych i chmurowych. Pasjonuje się tworzeniem bezpiecznych i skalowalnych rozwiązań AI/ML i Big Data, aby pomóc klientom korporacyjnym w procesie wdrażania chmury i optymalizacji w celu poprawy wyników biznesowych. W wolnym czasie jeździ na motocyklu i spaceruje ze swoim 3-letnim Sheepadoodle!

Navneet Tuteja jest specjalistą ds. danych w Amazon Web Services. Przed dołączeniem do AWS Navneet pracował jako facylitator dla organizacji, które chciały zmodernizować swoją architekturę danych i wdrożyć kompleksowe rozwiązania AI/ML. Ukończyła studia inżynierskie na Thapar University oraz tytuł magistra statystyki na Texas A&M University.

Navneet Tuteja jest specjalistą ds. danych w Amazon Web Services. Przed dołączeniem do AWS Navneet pracował jako facylitator dla organizacji, które chciały zmodernizować swoją architekturę danych i wdrożyć kompleksowe rozwiązania AI/ML. Ukończyła studia inżynierskie na Thapar University oraz tytuł magistra statystyki na Texas A&M University.

Emilia Soward jest analitykiem danych w AWS Professional Services. Posiada tytuł magistra z wyróżnieniem w dziedzinie sztucznej inteligencji Uniwersytetu w Edynburgu w Szkocji w Wielkiej Brytanii, ze szczególnym uwzględnieniem przetwarzania języka naturalnego (NLP). Emily pełniła stosowane stanowiska naukowe i inżynieryjne, koncentrując się na badaniach i rozwoju produktów wykorzystujących sztuczną inteligencję, doskonałości operacyjnej i zarządzaniu obciążeniami SI działającymi w organizacjach w sektorze publicznym i prywatnym. Pomaga w prowadzeniu klientów jako starszy mówca AWS, a ostatnio jako autorka AWS Well-Architected in the Machine Learning Lens.

Emilia Soward jest analitykiem danych w AWS Professional Services. Posiada tytuł magistra z wyróżnieniem w dziedzinie sztucznej inteligencji Uniwersytetu w Edynburgu w Szkocji w Wielkiej Brytanii, ze szczególnym uwzględnieniem przetwarzania języka naturalnego (NLP). Emily pełniła stosowane stanowiska naukowe i inżynieryjne, koncentrując się na badaniach i rozwoju produktów wykorzystujących sztuczną inteligencję, doskonałości operacyjnej i zarządzaniu obciążeniami SI działającymi w organizacjach w sektorze publicznym i prywatnym. Pomaga w prowadzeniu klientów jako starszy mówca AWS, a ostatnio jako autorka AWS Well-Architected in the Machine Learning Lens.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/architect-defense-in-depth-security-for-generative-ai-applications-using-the-owasp-top-10-for-llms/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 125

- 140

- 150

- 30

- 300

- 7

- a

- zdolność

- Zdolny

- O nas

- akademicki

- przyśpieszyć

- do przyjęcia

- dostęp

- Dostęp do danych

- Dostęp

- odpowiednio

- Konto

- Konta

- precyzja

- Osiągać

- osiągnięcia

- w poprzek

- Działania

- działania

- zajęcia

- działalność

- adaptacja

- Dodaj

- w dodatku

- dodatek

- Dodatkowy

- adres

- adresowanie

- przyczepność

- przyjąć

- Przyjęcie

- Przyjęcie

- zaawansowany

- zaliczki

- Korzyść

- doradztwo

- Po

- przed

- agencja

- Agent

- AI

- Modele AI

- Systemy SI

- AI / ML

- wyrównać

- wyrównany

- Wyrównuje

- Wszystkie kategorie

- dopuszczać

- dozwolony

- Pozwalać

- sam

- również

- Chociaż

- Amazonka

- Amazon EC2

- Amazon RDS

- Amazon Sage Maker

- Amazon Web Services

- wśród

- ilość

- an

- w czasie rzeczywistym sprawiają,

- Analizując

- i

- i infrastruktura

- Anonimowy

- Inne

- sekretarka

- każdy

- api

- apetyt

- odpowiedni

- Zastosowanie

- Application Development

- bezpieczeństwo aplikacji

- aplikacje

- stosowany

- dotyczy

- Aplikuj

- Stosowanie

- podejście

- awanse

- właściwy

- architekci

- architektoniczny

- architektura

- SĄ

- obszary

- argumentować

- powstać

- na około

- sztuczny

- sztuczna inteligencja

- Sztuczna inteligencja (AI)

- AS

- zapytać

- oceniając

- oceny

- Aktywa

- Wsparcie

- asystenci

- powiązany

- zapewnienie

- At

- atakować

- Ataki

- próbując

- Uwaga

- atrybuty

- Audyt

- zwiększona

- Uwierzytelnianie

- autor

- autoryzacja

- upoważniony

- zautomatyzować

- automatycznie

- dostępny

- świadomy

- świadomość

- AWS

- Klient AWS

- Usługi profesjonalne AWS

- z powrotem

- poparła

- tło

- na podstawie

- podstawowy

- podstawa

- BE

- bo

- staje się

- być

- zanim

- rozpocząć

- zachowanie

- zachowania

- jest

- wierząc

- korzyści

- Korzyści

- BEST

- Najlepsze praktyki

- Ulepsz Swój

- pomiędzy

- stronniczość

- Duży

- Big Data

- Rachunek

- Mieszanie

- Blog

- obie

- Granice

- przynieść

- Bringing

- budować

- budowniczy

- budowniczowie

- Budowanie

- Buduje

- wybudowany

- wbudowany

- biznes

- biznes

- by

- bypass

- CAN

- Może uzyskać

- możliwości

- Pojemność

- walizka

- Kategoria

- Spowodować

- Przyczyny

- scentralizować

- pewien

- świadectwo

- Certyfikacja

- łańcuch

- więzy

- wyzwania

- zmiana

- Chaos

- chatbot

- Wykrywanie urządzeń szpiegujących

- szef

- jasny

- Chmura

- adopcja chmury

- cloud computing

- infrastruktura chmurowa

- Cloud Security

- kod

- połączenie

- jak

- byliśmy spójni, od początku

- handlowy

- skomercjalizować

- zobowiązanie

- zobowiązany

- wspólny

- powszechnie

- Komunikacja

- towarzysz

- towarzysze

- sukcesy firma

- kompletny

- kompleks

- spełnienie

- składnik

- Komponować

- zrozumieć

- wszechstronny

- kompromis

- Zagrożone

- kompromis

- obliczać

- computing

- Troska

- zaniepokojony

- Obawy

- Warunki

- Prowadzenie

- pewność siebie

- skonfigurowany

- zamieszanie

- spójnik

- Skontaktuj się

- Konsekwencje

- Rozważać

- za

- wobec

- zgodny

- składa się

- zawierać

- Pojemniki

- zawartość

- kontekst

- ciągłość

- bez przerwy

- przyczynić się

- przyczynia się

- kontrola

- kontrolowania

- kontroli

- odwrotnie

- rdzeń

- kamień węgielny

- skorygowania

- Odpowiedni

- Koszty:

- opłacalne

- mógłby

- pokrycie

- Stwórz

- Tworzenie

- krytyczny

- kultura

- wikary

- klient

- Klientów

- dostosować

- dostosowane

- cyber

- bezpieczeństwo cybernetyczne

- Bezpieczeństwo cybernetyczne

- Cykle

- dane

- Jezioro danych

- Przygotowywanie danych

- naukowiec danych

- manipulowanie danymi

- Baza danych

- zbiory danych

- dzień

- lat

- Podejmowanie decyzji

- Decydenci

- Decyzje

- głęboko

- głębiej

- Obrona

- obronny

- określić

- zdefiniowane

- definiowanie

- Stopień

- dostarczanie

- sięgać

- wykazać

- Denial of Service

- W zależności

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- głębokość

- opisać

- Wnętrze

- projekty

- życzenia

- wykryć

- rozwijać

- rozwinięty

- deweloperzy

- rozwijanie

- oprogramowania

- zbaczać

- odchylenie

- różne

- cyfrowy

- dyscypliny

- ujawnienie

- odkrywanie

- odkrycie

- dyskutować

- Omawiając

- dyskusje

- zakłócenia

- odrębny

- wyróżnienie

- dystrybuowane

- nurkować

- inny

- różne perspektywy

- Nie

- domena

- nie

- rysuje

- napędzany

- podczas

- każdy

- Wcześniej

- Wcześnie

- wczesna faza

- łatwiej

- z łatwością

- Gospodarczy

- wartość ekonomiczna

- Ekosystemy

- Efektywne

- wydajny

- bądź

- osadzanie

- wyłaniać się

- wschodzących

- nowe technologie

- Nowa technologia

- nacisk

- pracowników

- upoważniać

- umożliwiać

- Umożliwia

- umożliwiając

- zachęca

- szyfrowane

- zakończenia

- egzekwować

- Egzekwowanie

- inżynier

- Inżynieria

- Inżynierowie

- wzmocnione

- zapewnić

- Enterprise

- rozrywka

- Cały

- Środowisko

- środowiska

- równy

- błąd

- eskalacja

- niezbędny

- zapewniają

- ustanowienie

- oceniać

- oceny

- ewaluację

- Parzyste

- wydarzenie

- wydarzenia

- Każdy

- ewoluuje

- ewoluuje

- zbadać

- przykład

- przykłady

- Doskonałość

- nadmierny

- wykonywania

- wykonawczy

- Ćwiczenie

- eksfiltracja

- istnieć

- Przede wszystkim system został opracowany

- rozszerzenie

- spodziewany

- doświadczenie

- eksperymenty

- ekspertyza

- eksperci

- Ekspozycja

- rozciągać się

- dużym

- rozsuwalny

- rozciąga się

- zewnętrzny

- dodatkowy

- wyciąg

- niezwykle

- twarze

- ułatwia

- Facilitator

- nie

- Spadać

- Znajomość

- FAST

- szybciej

- Cecha

- Korzyści

- informacja zwrotna

- mniej

- filtrować

- filtracja

- budżetowy

- usługi finansowe

- Znajdź

- znalezieniu

- Ustalenia

- zapora

- i terminów, a

- pięć

- elastyczne

- pływ

- Przepływy

- Skupiać

- koncentruje

- obserwuj

- następujący

- jedzenie

- W razie zamówieenia projektu

- Kryminalistyka

- Sprzyjać

- opiekunowie

- Fundacja

- podstawowy

- Framework

- Ramy

- często

- od

- z przodu

- Funkcjonalność

- Funkcje

- fundamentalny

- dalej

- Wzrost

- luki

- Ogólne

- ogólnie

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- miejsce

- dany

- Globalne

- cel

- Gole

- będzie

- rządzić

- zarządzanie

- Rząd

- rządowy

- udzielony

- Rośnie

- poradnictwo

- poprowadzi

- prowadzony

- Przewodniki

- miał

- uchwyt

- Prowadzenie

- Have

- he

- opieki zdrowotnej

- pomoc

- pomoc

- pomaga

- wysoka wydajność

- wysoko

- jego

- przytrzymanie

- posiada

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- Piasta

- człowiek

- Hybrydowy

- i

- pomysł

- pomysły

- zidentyfikowane

- zidentyfikować

- identyfikacja

- tożsamość

- if

- niezmienność

- niezmienny

- Rezultat

- wpływ

- Oddziaływania

- tryb rozkazujący

- wdrożenia

- realizacja

- realizowane

- wykonawczych

- podnieść

- poprawa

- in

- zachęty

- początek

- zawierać

- włączony

- obejmuje

- Włącznie z

- niespójności

- Zwiększać

- wzrosła

- wzrastający

- wskaźniki

- przemysł

- nieefektywności

- Informacja

- bezpieczeństwo informacji

- poinformowany

- Infrastruktura

- infuzji

- nieodłączny

- inicjatywy

- wprowadzać innowacje

- innowacyjne

- Innowacja

- wkład

- Wejścia

- niepewny

- wewnątrz

- wgląd

- spostrzeżenia

- integrować

- zintegrowany

- Integruje się

- integracja

- integracje

- integralność

- Inteligencja

- Interakcje

- odsetki

- Interfejs

- na świecie

- skrzyżowanie

- najnowszych

- przedstawiać

- Przedstawia

- wprowadzenie

- śledztwo

- Dochodzenia

- dotyczy

- problemy

- IT

- JEGO

- samo

- Praca

- łączący

- podróż

- jpg

- właśnie

- Trzymać

- Klawisz

- Kluczowe obszary

- Królestwo

- wiedza

- jezioro

- język

- duży

- większe

- w końcu

- później

- uruchomić

- warstwa

- warstwowy

- nioski

- prowadzić

- Przywódcy

- Przywództwo

- prowadzący

- UCZYĆ SIĘ

- nauka

- najmniej

- obiektyw

- obiektywy

- poziom

- wifecycwe

- lubić

- prawdopodobieństwo

- Linia

- linie

- LLM

- zalogowaniu

- logika

- Popatrz

- poszukuje

- stracił

- miłość

- maszyna

- uczenie maszynowe

- robić

- złośliwy

- malware

- zarządzanie

- zarządzane

- i konserwacjami

- kierownik

- Zarządzający

- zarządzający

- manipulowanie

- Manipulacja

- sposób

- wiele

- mapa

- mistrz

- mistrzowski

- materiały

- Matters

- dojrzałość

- maksymalizacji

- Może..

- znaczy

- zmierzyć

- mechanizm

- Mechanizmy

- Media

- Poznaj nasz

- Spełnia

- psychika

- wzmiankowany

- spełnione

- Metryka

- może

- migrować

- miliony

- nic

- Mindset

- nadużycie

- Złagodzić

- łagodzenie

- ML

- model

- modelowanie

- modele

- umiar

- zmodernizować

- monitor

- monitorowanie

- jeszcze

- większość

- motocykl

- ruch

- dużo

- wielokrotność

- Muzyka

- musi

- my

- Naturalny

- Przetwarzanie języka naturalnego

- Natura

- niezbędny

- Potrzebować

- potrzebne

- wymagania

- sieć

- Nowości

- Następny

- nist

- nlp

- przedmiot

- cel

- Cele

- of

- poza

- oferuje

- Oferty

- Oficerowie

- nieaktywny

- on

- ONE

- koncepcja

- open source

- eksploatowane

- operacyjny

- operacje

- Szanse

- optymalizacja

- zoptymalizowane

- or

- zamówienie

- organizacja

- organizacyjny

- organizacji

- pochodzenie

- pierwotnie

- Początki

- Inne

- ludzkiej,

- na zewnątrz

- Wynik

- wyniki

- wydajność

- Wyjścia

- zewnętrzne

- koniec

- ogólny

- własność

- pakiet

- część

- uczestnictwo

- strony

- wzmacniacz

- strony

- namiętny

- ścieżka

- ścieżki

- wzory

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywane

- wykonywania

- uprawnienia

- perspektywy

- fazy

- słupy

- rurociąg

- Miejsce

- krok po kroku

- planowanie

- plato

- Analiza danych Platona

- PlatoDane

- wtyczka

- wtyczki

- zwrotnica

- trucizna

- polityka

- polityka

- pozycjonowanie

- Post

- potencjał

- potencjalnie

- praktyka

- praktyki

- przygotowanie

- Przygotować

- zapobiec

- poprzedni

- premia

- Główny

- Zasady

- Wcześniejszy

- ustalanie priorytetów

- priorytet

- prywatność

- prywatny

- Sektor prywatny

- przywilej

- przywileje

- wygląda tak

- procesów

- przetwarzanie

- Produkt

- Produkcja

- wydajność

- profesjonalny

- Profil

- Program

- Programy

- projekt

- monity

- właściwy

- prawidłowo

- chronić

- chroniony

- ochrony

- ochrona

- protokoły

- zapewniać

- dostawców

- zapewnia

- że

- publiczny

- położyć

- jakość

- zapytania

- pytanie

- Szybki

- szybko

- szmata

- dosięgnąć

- React

- Czytaj

- Gotowość

- Czytający

- Prawdziwy świat

- realistyczny

- realizacja

- zrealizować

- odbieranie

- niedawno

- polecić

- zalecenia

- Recover

- regeneracja

- zmniejszyć

- odniesienie

- oczyścić

- region

- regularny

- regularnie

- regulowane

- Regulatory

- związane z

- rzetelny

- polegać

- remediacja

- zdalny

- oddać

- powtarzać

- obsługi produkcji rolnej, która zastąpiła

- zażądać

- z prośbą

- wymagać

- wymaganie

- wymagania

- Wymaga

- Badania naukowe

- badania i rozwój

- sprężystość

- Zasób

- Zasoby

- szanowany

- osób

- Odpowiadać

- odpowiedź

- Odpowiedzi

- odpowiedzialność

- odpowiedzialny

- REST

- ograniczać

- wyszukiwanie

- przeglądu

- recenzja

- recenzowanie

- Recenzje

- przejażdżki

- prawo

- Ryzyko

- apetyt na ryzyko

- Zarządzanie ryzykiem

- ryzyko

- krzepki

- rodgers

- role

- korzeń

- rutynowo

- reguły

- bieganie

- s

- SaaS

- sagemaker

- taki sam

- skalowalny

- Skala

- skanowanie

- scenariusz

- scenariusze

- nauka

- naukowy

- Naukowiec

- Naukowcy

- zakres

- Zakres

- Szukaj

- Sekcja

- sektor

- bezpieczne

- zabezpieczone

- zabezpieczenia

- bezpieczeństwo

- korzyści związane z bezpieczeństwem

- zdarzenia zabezpieczeń

- zagrożenia bezpieczeństwa

- Zagrożenia bezpieczeństwa

- Szukajcie

- poszukuje

- Poszukuje

- wybierać

- wybrany

- senior

- wrażliwy

- służył

- usługa

- Usługi

- zestaw

- ustawienie

- shared

- ona

- powinien

- pokazać

- Widok

- podobny

- Prosty

- upraszczać

- upraszczanie

- So

- towarzyskie

- Tworzenie

- rachunek za oprogramowanie

- Software Developers

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- kilka

- Źródło

- Źródła

- suwerenność

- Typ przestrzeni

- Głośnik

- specjalista

- specyficzny

- swoiście

- prędkość

- stos

- etapy

- interesariusze

- standard

- standardy

- początek

- rozpoczęty

- Startowy

- Startups

- statystyka

- Cel

- Nadal

- przechowywanie

- przechowywany

- sklep

- Strategiczny

- strategie

- Strateg

- Strategia

- Ścisły

- strongly

- w zasadzie

- sukces

- Z powodzeniem

- taki

- Dostawa

- łańcuch dostaw

- Dostarczać łańcuchy

- wsparcie

- Wspierający

- pewnie

- wrażliwy

- podejrzliwy

- syntetyczny

- system

- systemy

- stół

- dostosowane

- Brać

- trwa

- Tandem

- zadania

- taksonomia

- zespół

- Zespoły

- Techniczny

- Techniki

- Technologies

- technolodzy

- Technologia

- Telecom

- test

- Testowanie

- Testy

- texas

- XNUMX

- że

- Połączenia

- Źródło

- kradzież

- ich

- Im

- motywy

- sami

- następnie

- Tam.

- Te

- one

- Myślący

- Trzeci

- osoby trzecie

- to

- tych

- groźba

- zagrożenia

- trzy

- Przez

- poprzez

- czas

- aktualny

- do

- razem

- narzędzie

- narzędzia

- Top

- Top 10

- Kontakt

- w kierunku

- Handel

- tradycyjny

- ruch drogowy

- Pociąg

- przeszkolony

- Trening

- transakcja

- tranzyt

- Przezroczystość

- transportu

- Podróżowanie

- Zaufaj

- zaufany

- zazwyczaj

- Nieupoważniony

- Niepewność

- dla

- Osłabiać

- zrozumieć

- zrozumienie

- nieznany

- Zjednoczony

- Wielka Brytania

- uniwersytet

- prawdziwy

- Aktualizacja

- zaktualizowane

- Utrzymuj

- uptime

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- wykorzystać

- wykorzystany

- Wykorzystując

- UPRAWOMOCNIĆ

- sprawdzanie poprawności

- uprawomocnienie

- wartość

- biegły w czymś

- przez

- Wirtualny

- prawie

- wyobrażać sobie

- vs

- Luki w zabezpieczeniach

- wrażliwość

- spacery

- chcieć

- Warranty

- była

- sposoby

- we

- sieć

- Aplikacja internetowa

- Aplikacje internetowe

- usługi internetowe

- DOBRZE

- Co

- jeśli chodzi o komunikację i motywację

- czy

- który

- Podczas

- KIM

- cały

- będzie

- WINO

- Zwycięstwa

- w

- w ciągu

- bez

- Praca

- pracował

- workflow

- przepływów pracy

- pracujący

- na calym swiecie

- by

- napisał

- XSS

- lat

- You

- Twój

- zefirnet