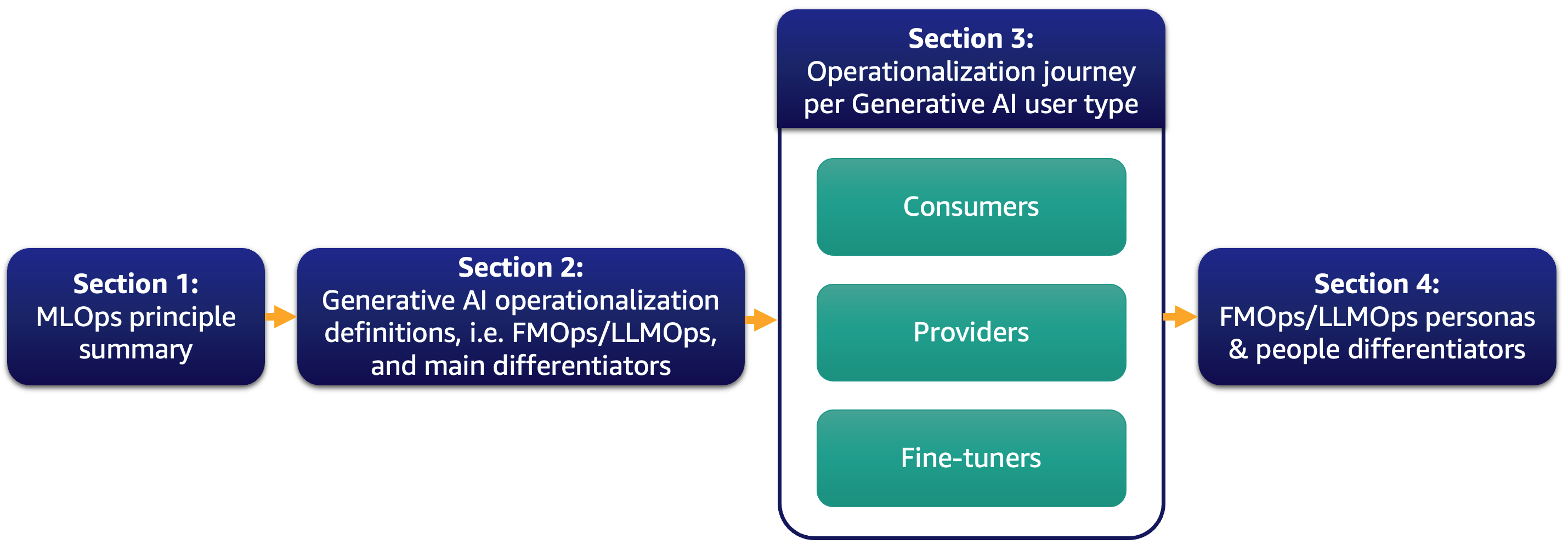

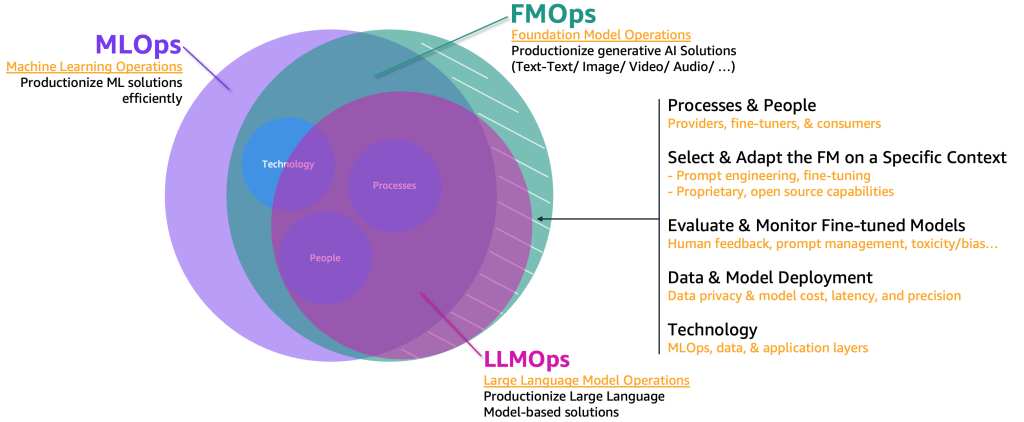

Obecnie większość naszych klientów jest podekscytowana dużymi modelami językowymi (LLM) i zastanawia się, w jaki sposób generatywna sztuczna inteligencja może przekształcić ich biznes. Jednak wprowadzenie takich rozwiązań i modeli do normalnej działalności nie jest zadaniem łatwym. W tym poście omawiamy, jak operacjonalizować generatywne aplikacje AI przy użyciu zasad MLOps, prowadząc do operacji na modelu podstawowym (FMOps). Co więcej, szczegółowo omawiamy najczęstszy przypadek użycia generatywnej sztucznej inteligencji w aplikacjach zamiany tekstu na tekst i operacjach LLM (LLMOps), stanowiących podzbiór FMops. Poniższy rysunek ilustruje poruszane przez nas tematy.

W szczególności krótko przedstawiamy zasady MLOps i skupiamy się na głównych wyróżnikach w porównaniu z FMops i LLMOps w zakresie procesów, ludzi, wyboru i oceny modeli, prywatności danych i wdrażania modeli. Dotyczy to klientów, którzy korzystają z nich od razu po wyjęciu z pudełka, tworzą modele fundamentów od podstaw lub je dopracowują. Nasze podejście ma zastosowanie zarówno do modeli open source, jak i modeli zastrzeżonych.

Podsumowanie operacjonalizacji ML

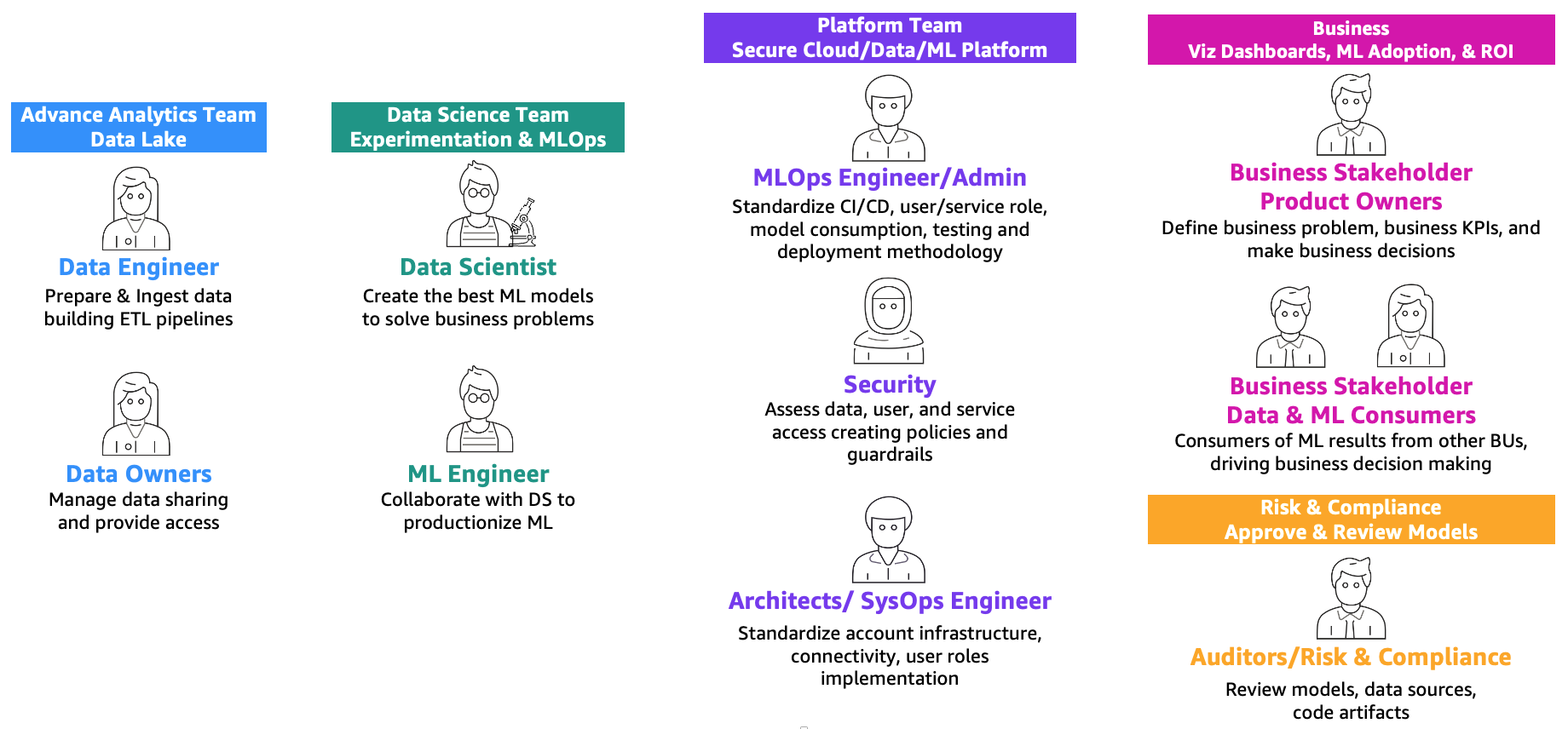

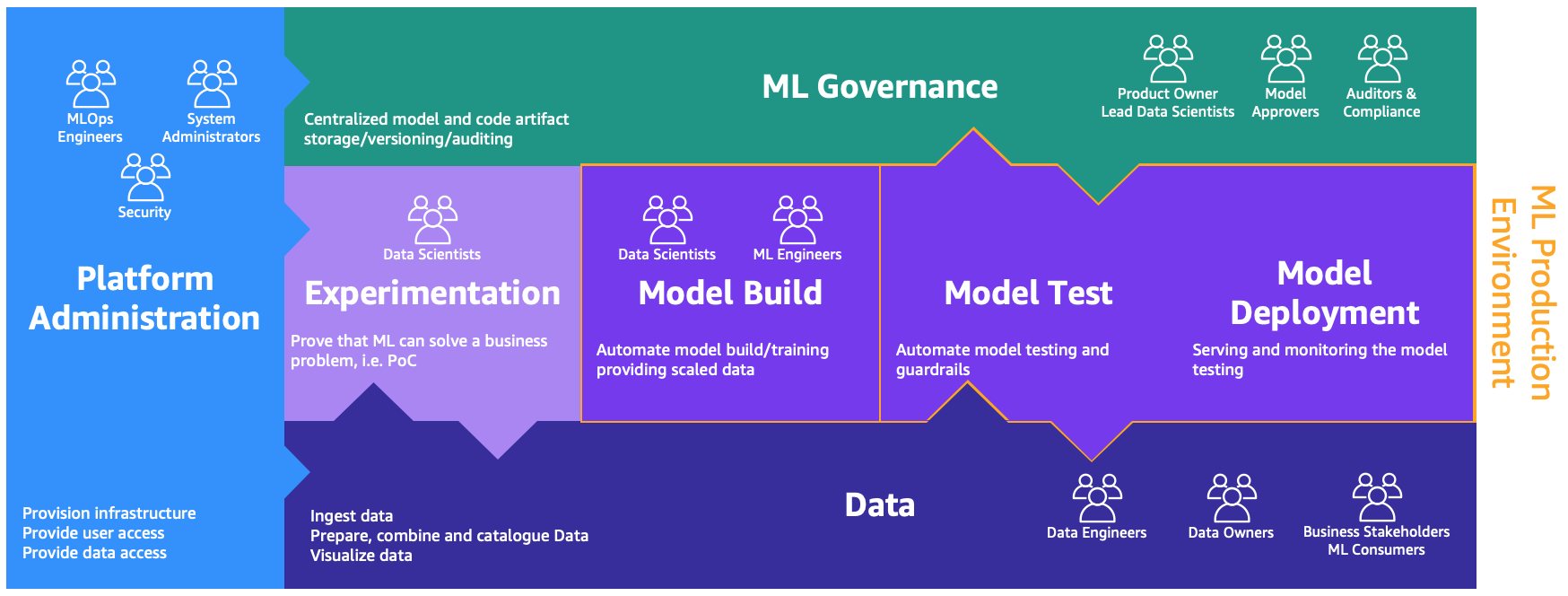

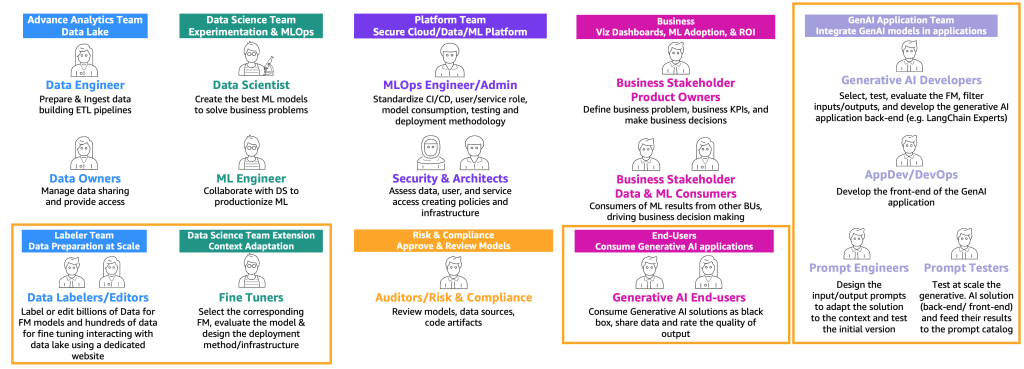

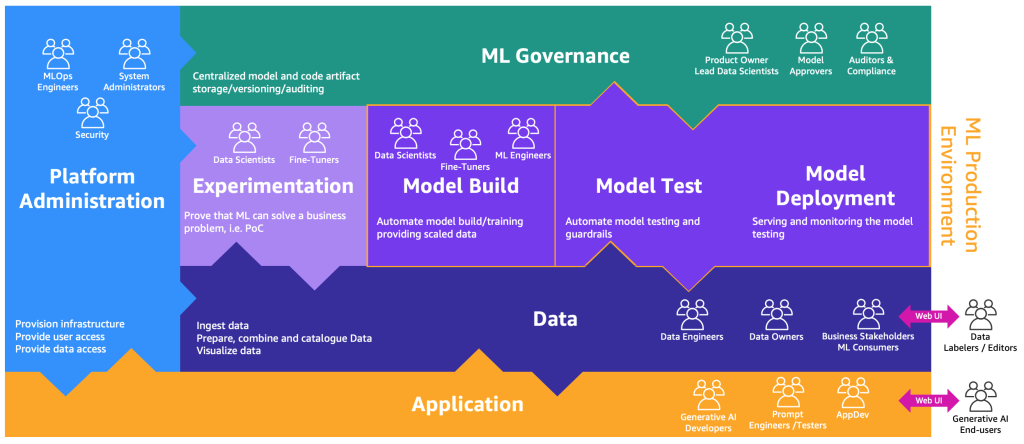

Zgodnie z definicją w poście Mapa drogowa fundacji MLOps dla przedsiębiorstw z Amazon SageMaker, ML i operacje (MLops) to połączenie ludzi, procesów i technologii w celu wydajnego tworzenia rozwiązań uczenia maszynowego (ML). Aby to osiągnąć, kombinacja zespołów i osób musi współpracować, jak pokazano na poniższym rysunku.

Zespoły te są następujące:

- Zaawansowany zespół analityczny (jezioro danych i siatka danych) – Inżynierowie danych są odpowiedzialni za przygotowywanie i pozyskiwanie danych z wielu źródeł, budowanie potoków ETL (wyodrębnianie, przekształcanie i ładowanie) w celu selekcji i katalogowania danych oraz przygotowywania niezbędnych danych historycznych dla przypadków użycia ML. Właściciele danych skupiają się na zapewnianiu dostępu do swoich danych wielu jednostkom biznesowym lub zespołom.

- Zespół analityki danych – Analitycy danych muszą skupić się na stworzeniu najlepszego modelu w oparciu o predefiniowane kluczowe wskaźniki wydajności (KPI) pracujące w notatnikach. Po zakończeniu fazy badawczej badacze danych muszą współpracować z inżynierami ML, aby stworzyć automatyzacje do budowania (potoki ML) i wdrażania modeli do produkcji przy użyciu potoków CI/CD.

- Zespół biznesowy – Właściciel produktu jest odpowiedzialny za zdefiniowanie uzasadnienia biznesowego, wymagań i wskaźników KPI, które będą wykorzystywane do oceny wydajności modelu. Konsumenci ML to inni interesariusze biznesowi, którzy wykorzystują wyniki wnioskowania (prognozy) do podejmowania decyzji.

- Zespół Platformy – Architekci są odpowiedzialni za ogólną architekturę chmury w firmie i sposób, w jaki wszystkie różne usługi są ze sobą powiązane. MŚP zajmujące się bezpieczeństwem dokonują przeglądu architektury w oparciu o zasady i potrzeby bezpieczeństwa biznesowego. Inżynierowie MLOps są odpowiedzialni za zapewnienie bezpiecznego środowiska dla analityków danych i inżynierów ML w celu tworzenia przypadków użycia ML. W szczególności są odpowiedzialni za standaryzację potoków CI/CD, ról użytkowników i usług oraz tworzenia kontenerów, wykorzystania modeli, testowania i metodologii wdrażania w oparciu o wymagania biznesowe i bezpieczeństwa.

- Zespół ds. ryzyka i zgodności – W przypadku bardziej restrykcyjnych środowisk audytorzy są odpowiedzialni za ocenę danych, kodu i artefaktów modeli oraz upewnienie się, że firma przestrzega przepisów, takich jak prywatność danych.

Należy pamiętać, że ta sama osoba może obsługiwać wiele osób, w zależności od skalowania i dojrzałości MLOps firmy.

Osoby te potrzebują dedykowanych środowisk do wykonywania różnych procesów, jak pokazano na poniższym rysunku.

Środowiska są następujące:

- Administracja platformą – Środowisko administracyjne platformy to miejsce, w którym zespół platformy ma dostęp do tworzenia kont AWS i łączenia odpowiednich użytkowników i danych

- Dane – Warstwa danych, często nazywana jeziorem danych lub siatką danych, to środowisko, którego inżynierowie danych, właściciele i interesariusze biznesowi używają do przygotowywania, interakcji i wizualizacji danych

- Eksperymentowanie – Analitycy danych korzystają z piaskownicy lub środowiska eksperymentalnego do testowania nowych bibliotek i technik uczenia maszynowego, aby udowodnić, że ich weryfikacja koncepcji może rozwiązać problemy biznesowe

- Budowa modelu, test modelu, wdrożenie modelu – Środowisko budowania, testowania i wdrażania modeli to warstwa MLOps, w której badacze danych i inżynierowie ML współpracują w celu automatyzacji i przeniesienia badań do produkcji

- Zarządzanie systemem ml – Ostatnim elementem układanki jest środowisko zarządzania ML, w którym wszystkie modele i artefakty kodu są przechowywane, przeglądane i kontrolowane przez odpowiednie osoby

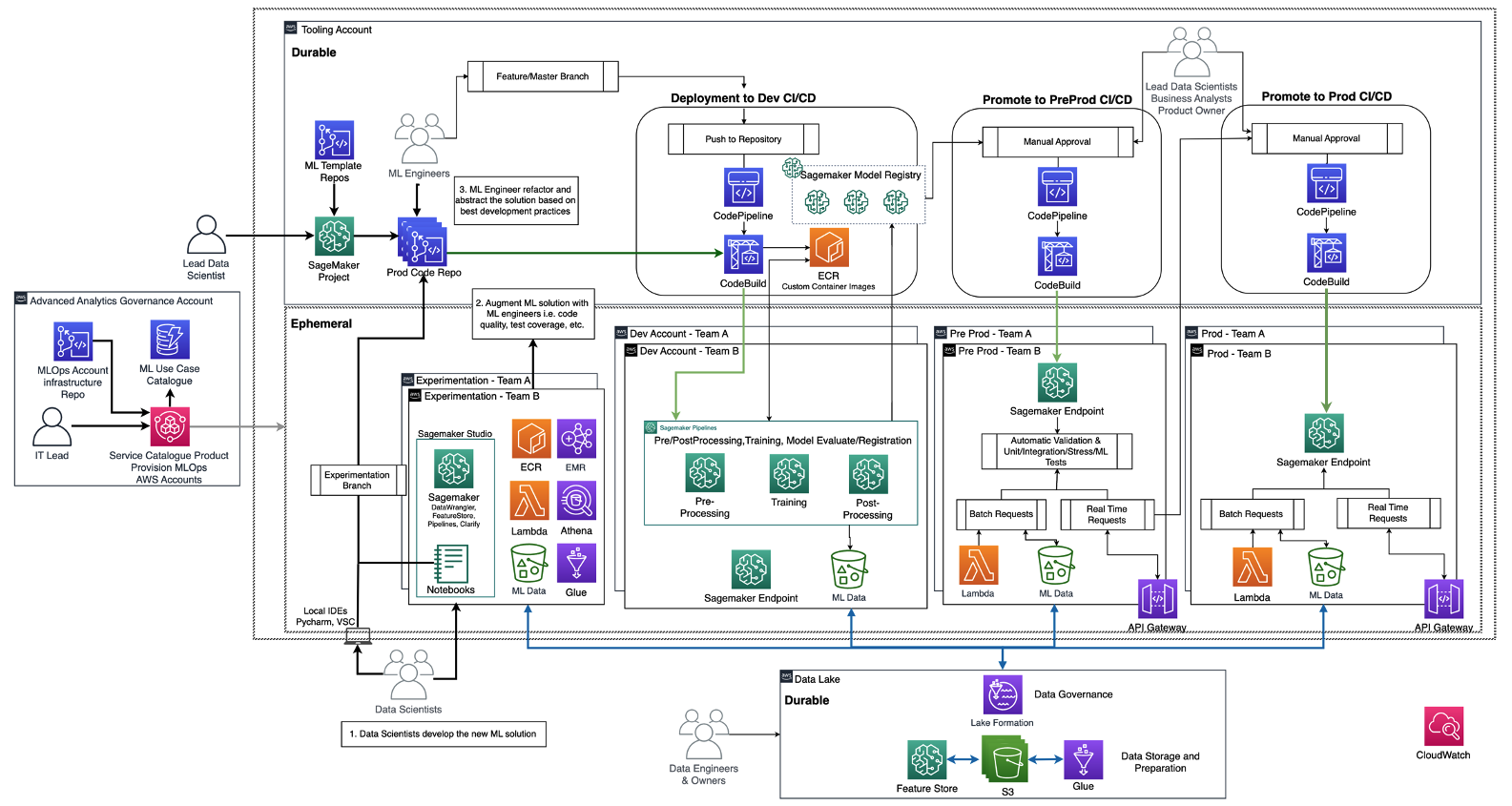

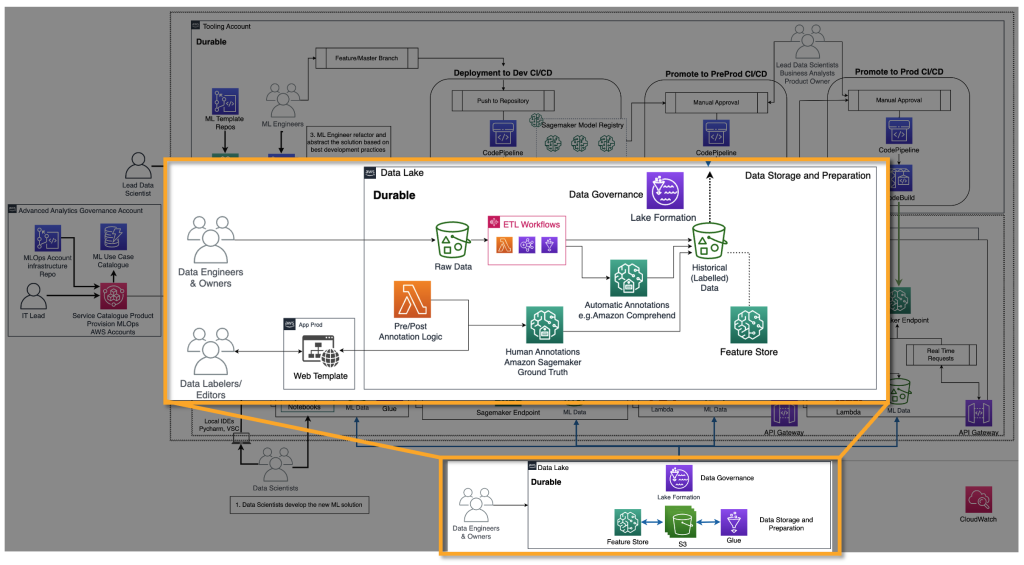

Poniższy diagram ilustruje architekturę referencyjną, która została już omówiona w Mapa drogowa fundacji MLOps dla przedsiębiorstw z Amazon SageMaker.

Każda jednostka biznesowa ma własny zestaw kont programistycznych (automatyczne szkolenie i budowanie modeli), przedprodukcyjnych (automatyczne testowanie) i produkcyjnych (wdrażanie i udostępnianie modeli) w celu tworzenia przypadków użycia ML, które pobierają dane ze scentralizowanego lub zdecentralizowanego jeziora danych lub danych siatka, odpowiednio. Wszystkie wytworzone modele i automatyzacja kodu są przechowywane na scentralizowanym koncie narzędziowym, korzystając z możliwości rejestru modeli. Kod infrastruktury dla wszystkich tych kont jest wersjonowany na koncie usługi udostępnionej (koncie zarządzania zaawansowaną analityką), które zespół ds. platformy może streszczać, tworzyć szablony, konserwować i ponownie wykorzystywać na potrzeby wprowadzenia każdego nowego zespołu na platformę MLOps.

Definicje generatywnej sztucznej inteligencji i różnice w stosunku do MLOps

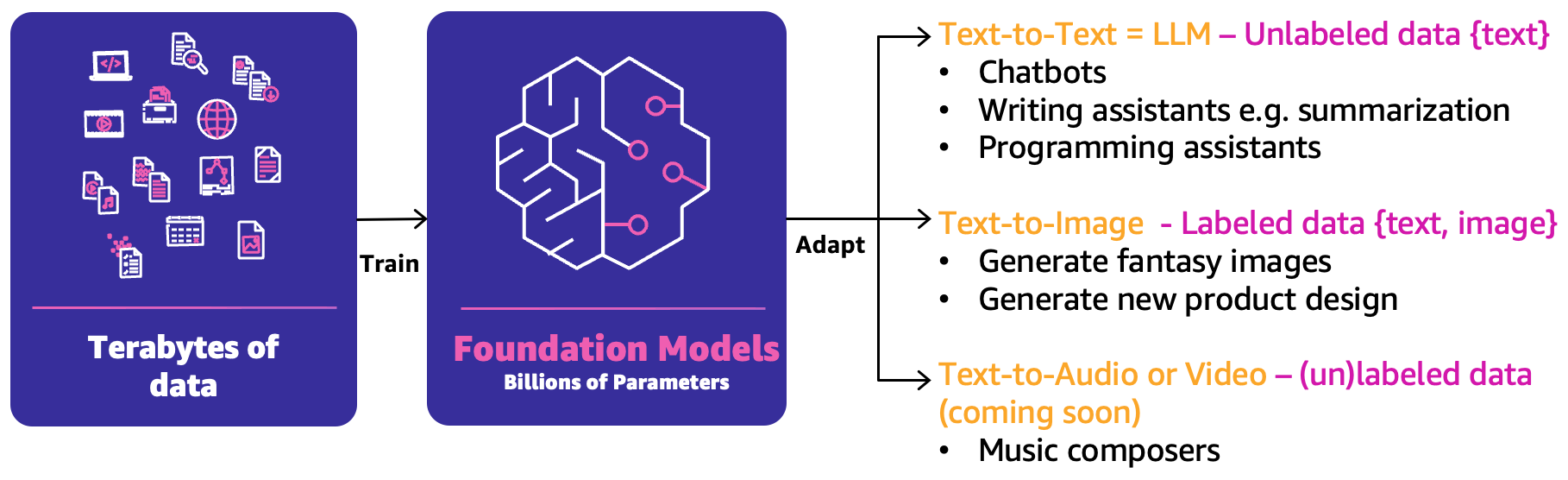

W klasycznym uczeniu maszynowym powyższa kombinacja osób, procesów i technologii może pomóc w stworzeniu przypadków użycia uczenia maszynowego. Jednak w generatywnej sztucznej inteligencji charakter przypadków użycia wymaga rozszerzenia tych możliwości lub nowych możliwości. Jednym z tych nowych pojęć jest model podstawowy (FM). Nazywa się je tak, ponieważ można ich używać do tworzenia szerokiej gamy innych modeli sztucznej inteligencji, jak pokazano na poniższym rysunku.

FM zostało przeszkolone w oparciu o terabajty danych i ma setki miliardów parametrów, aby móc przewidzieć kolejną najlepszą odpowiedź w oparciu o trzy główne kategorie przypadków użycia generatywnej sztucznej inteligencji:

- Tekst na tekst – FM (LLM) zostali przeszkoleni w oparciu o nieoznaczone dane (takie jak dowolny tekst) i są w stanie przewidzieć następne najlepsze słowo lub sekwencję słów (akapity lub długie eseje). Główne przypadki użycia dotyczą chatbotów przypominających ludzi, podsumowań lub tworzenia innych treści, takich jak kod programowania.

- Tekst na obraz – Oznaczone dane, takie jak pary , został wykorzystany do szkolenia FM, które są w stanie przewidzieć najlepszą kombinację pikseli. Przykładowe przypadki użycia to generowanie projektów odzieży lub wyimaginowane spersonalizowane obrazy.

- Tekst na audio lub wideo – Do treningu FM można używać zarówno danych oznaczonych, jak i nieoznaczonych. Jednym z głównych przykładów użycia generatywnej sztucznej inteligencji jest komponowanie muzyki.

Aby wyprodukować te generatywne przypadki użycia sztucznej inteligencji, musimy pożyczyć i rozszerzyć domenę MLOps, aby uwzględnić następujące elementy:

- Operacje FM (FMOps) – Może to umożliwić produkcję generatywnych rozwiązań AI, w tym dowolnego typu przypadków użycia

- Operacje LLM (LLMOps) – Jest to podzbiór FMOps skupiający się na tworzeniu rozwiązań opartych na LLM, takich jak zamiana tekstu na tekst

Poniższy rysunek ilustruje nakładanie się tych przypadków użycia.

W porównaniu do klasycznych ML i MLOps, FMops i LLMOps odraczają się w oparciu o cztery główne kategorie, które omawiamy w następujących sekcjach: ludzie i proces, wybór i adaptacja FM, ocena i monitorowanie FM, prywatność danych i wdrażanie modeli oraz potrzeby technologiczne. Monitoringowi poświęcimy osobny wpis.

Ścieżka operacjonalizacji według generatywnego typu użytkownika AI

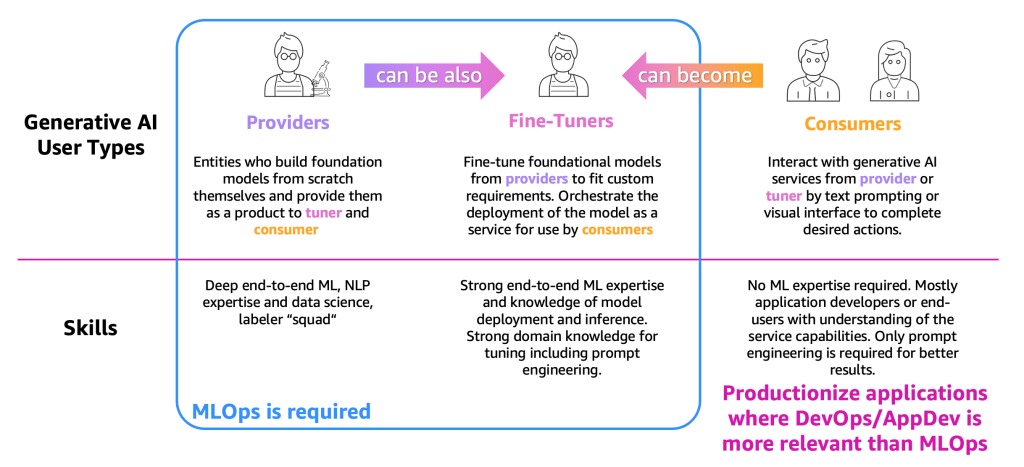

Aby uprościć opis procesów, musimy sklasyfikować główne typy użytkowników generatywnej sztucznej inteligencji, jak pokazano na poniższym rysunku.

Typy użytkowników są następujące:

- Dostawcy – Użytkownicy, którzy budują FM od podstaw i dostarczają je jako produkt innym użytkownikom (dostrajaczom i konsumentom). Mają głęboką, kompleksową wiedzę specjalistyczną w zakresie uczenia maszynowego i przetwarzania języka naturalnego (NLP) oraz umiejętności w zakresie analizy danych, a także ogromne zespoły osób zajmujących się etykietowaniem i redagowaniem danych.

- Dostrajacze – Użytkownicy, którzy przekwalifikowują (dostosowują) FM od dostawców, aby dopasować je do niestandardowych wymagań. Organizują wdrażanie modelu jako usługi do użytku konsumentów. Użytkownicy ci potrzebują wszechstronnej wiedzy specjalistycznej w zakresie uczenia maszynowego i analizy danych oraz wiedzy na temat wdrażania modeli i wnioskowania. Wymagana jest również solidna wiedza dziedzinowa dotycząca tuningu, w tym szybka inżynieria.

- Konsumenci – Użytkownicy, którzy wchodzą w interakcję z generatywnymi usługami AI oferowanymi przez dostawców lub narzędzia dostrajające za pomocą komunikatów tekstowych lub interfejsu wizualnego w celu wykonania żądanych działań. Nie jest wymagana żadna specjalistyczna wiedza z zakresu uczenia maszynowego, ale głównie twórcy aplikacji lub użytkownicy końcowi rozumiejący możliwości usługi. Aby uzyskać lepsze wyniki, konieczna jest jedynie szybka inżynieria.

Zgodnie z definicją i wymaganą wiedzą specjalistyczną w zakresie uczenia maszynowego, MLOps jest wymagany głównie przez dostawców i dostrajających, podczas gdy konsumenci mogą korzystać z zasad produkcji aplikacji, takich jak DevOps i AppDev, do tworzenia generatywnych aplikacji AI. Co więcej, zaobserwowaliśmy zmianę wśród typów użytkowników, w przypadku której dostawcy mogą stać się podmiotami dostrajającymi, aby wspierać przypadki użycia w oparciu o konkretną branżę (np. sektor finansowy), a konsumenci mogą stać się podmiotami dostrajającymi, aby uzyskać dokładniejsze wyniki. Ale przyjrzyjmy się głównym procesom według typu użytkownika.

Podróż konsumentów

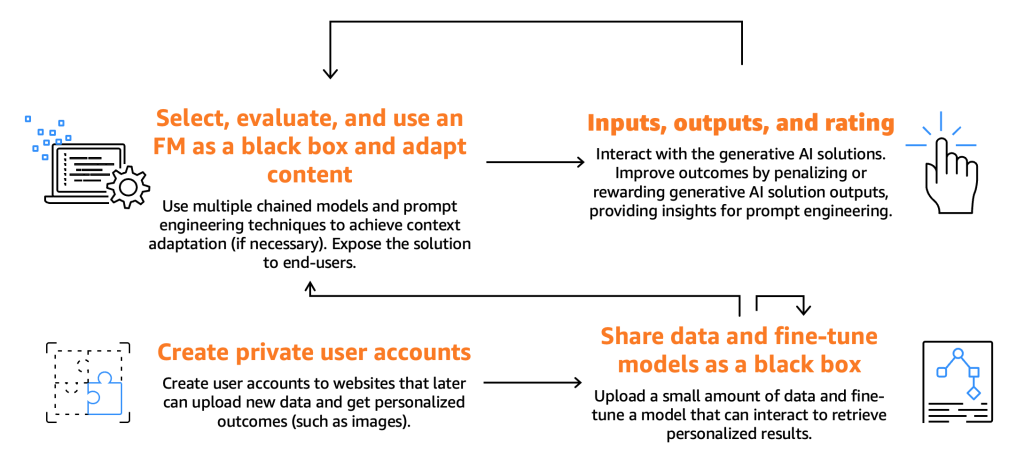

Poniższy rysunek ilustruje podróż konsumenta.

Jak wspomniano wcześniej, konsumenci mają obowiązek wybierać, testować i używać FM, wchodząc z nim w interakcję poprzez dostarczanie określonych danych wejściowych, zwanych inaczej monity. Podpowiedzi w kontekście programowania komputerowego i sztucznej inteligencji odnoszą się do danych wejściowych przekazywanych modelowi lub systemowi w celu wygenerowania odpowiedzi. Może to mieć formę tekstu, polecenia lub pytania, które system wykorzystuje do przetworzenia i wygenerowania wyniku. Dane wyjściowe wygenerowane przez FM mogą następnie zostać wykorzystane przez użytkowników końcowych, którzy powinni również móc ocenić te wyniki, aby ulepszyć przyszłe reakcje modelu.

Oprócz tych podstawowych procesów zauważyliśmy, że konsumenci wyrażali chęć udoskonalenia modelu poprzez wykorzystanie funkcjonalności oferowanej przez dostrajacze. Weźmy na przykład witrynę internetową generującą obrazy. W tym miejscu użytkownicy końcowi mogą zakładać konta prywatne, przesyłać osobiste zdjęcia, a następnie generować treści powiązane z tymi obrazami (na przykład generując obraz przedstawiający użytkownika końcowego na motocyklu z mieczem lub znajdującego się w egzotycznej lokalizacji). W tym scenariuszu generatywna aplikacja AI zaprojektowana przez konsumenta musi wchodzić w interakcję z backendem dostrajającym za pośrednictwem interfejsów API, aby zapewnić tę funkcjonalność użytkownikom końcowym.

Zanim jednak się w to zagłębimy, skupmy się najpierw na procesie wyboru modelu, testowaniu, użyciu, interakcji wejść i wyjść oraz ocenie, jak pokazano na poniższym rysunku.

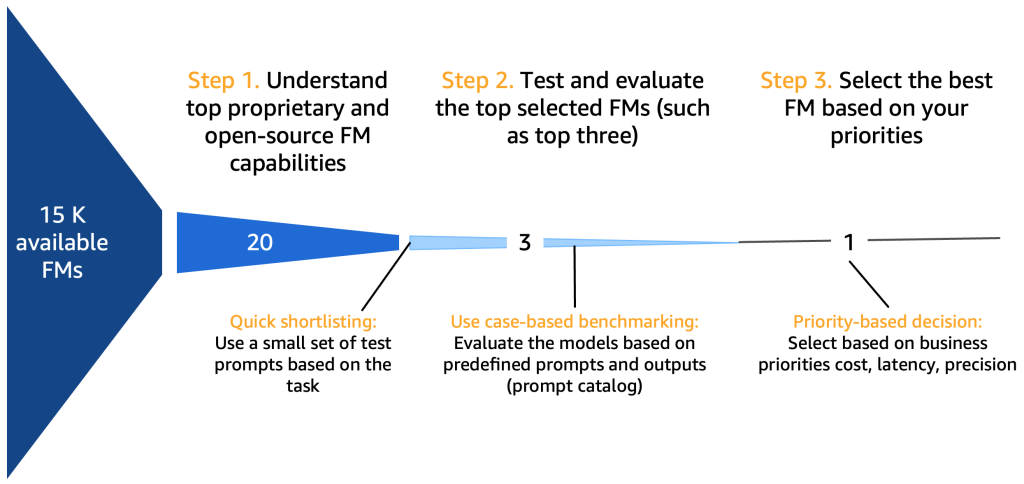

*15 tys. dostępnych referencji FM

Krok 1. Zapoznaj się z najważniejszymi możliwościami FM

Przy wyborze modeli fundamentów należy wziąć pod uwagę wiele aspektów, w zależności od przypadku użycia, dostępnych danych, przepisów i tak dalej. Dobra lista kontrolna, choć niepełna, może wyglądać następująco:

- Zastrzeżone lub otwarte źródło FM – Zastrzeżone modele często wiążą się z kosztami finansowymi, ale zazwyczaj oferują lepszą wydajność (pod względem jakości wygenerowanego tekstu lub obrazu), często są opracowywane i utrzymywane przez dedykowane zespoły dostawców modeli, którzy zapewniają optymalną wydajność i niezawodność. Z drugiej strony obserwujemy również przyjęcie modeli typu open source, które poza tym, że są bezpłatne, oferują dodatkowe korzyści w postaci dostępności i elastyczności (na przykład każdy model typu open source można precyzyjnie dostrajać). Przykładem zastrzeżonego modelu jest model Claude firmy Anthropic, a przykładem wysokowydajnego modelu open source jest Falcon-40B, stan na lipiec 2023 r.

- Licencja komercyjna – Przy podejmowaniu decyzji o wyborze FM kluczowe znaczenie mają względy licencyjne. Należy pamiętać, że niektóre modele są typu open source, ale nie można ich używać do celów komercyjnych ze względu na ograniczenia lub warunki licencyjne. Różnice mogą być subtelne: Nowo wydany baza xgen-7b-8k model jest na przykład open source i nadaje się do użytku komercyjnego (licencja Apache-2.0), natomiast instrukcja dopracowuje wersję modelu xgen-7b-8k-inst jest udostępniany wyłącznie w celach badawczych. Wybierając FM do zastosowań komercyjnych, istotne jest sprawdzenie umowy licencyjnej, zrozumienie jej ograniczeń i upewnienie się, że jest ona zgodna z zamierzonym wykorzystaniem projektu.

- parametry – Liczba parametrów, na które składają się wagi i odchylenia w sieci neuronowej, to kolejny kluczowy czynnik. Więcej parametrów oznacza ogólnie bardziej złożony i potencjalnie wydajny model, ponieważ może uchwycić bardziej skomplikowane wzorce i korelacje w danych. Jednak kompromis jest taki, że wymaga więcej zasobów obliczeniowych, a zatem jest droższy w działaniu. Ponadto widzimy tendencję w kierunku mniejszych modeli, zwłaszcza w przestrzeni open source (modele od 7 do 40 miliardów), które dobrze sobie radzą, zwłaszcza po dostrojeniu.

- Prędkość – Na prędkość modelu wpływa jego rozmiar. Większe modele mają tendencję do wolniejszego przetwarzania danych (większe opóźnienia) ze względu na zwiększoną złożoność obliczeniową. Dlatego niezwykle ważne jest zrównoważenie zapotrzebowania na model o dużej mocy predykcyjnej (często większe modele) z praktycznymi wymaganiami dotyczącymi szybkości, szczególnie w aplikacjach takich jak chatboty, które wymagają odpowiedzi w czasie rzeczywistym lub prawie rzeczywistym.

- Rozmiar okna kontekstowego (liczba tokenów) – Okno kontekstu, zdefiniowane przez maksymalną liczbę tokenów, które można wprowadzić lub wyprowadzić na monit, ma kluczowe znaczenie przy określaniu, ile kontekstu model może uwzględnić jednocześnie (token w przybliżeniu przekłada się na 0.75 słowa w języku angielskim). Modele z większymi oknami kontekstowymi mogą rozumieć i generować dłuższe sekwencje tekstu, co może być przydatne w przypadku zadań obejmujących dłuższe rozmowy lub dokumenty.

- Zbiór danych szkoleniowych – Ważne jest także zrozumienie, na jakich danych uczono FM. Niektóre modele można szkolić na różnych tekstowych zbiorach danych, takich jak dane internetowe, skrypty kodujące, instrukcje lub opinie ludzi. Inne mogą być również przeszkolone w zakresie multimodalnych zbiorów danych, takich jak kombinacje danych tekstowych i graficznych. Może to mieć wpływ na przydatność modelu do różnych zadań. Ponadto organizacja może mieć obawy dotyczące praw autorskich w zależności od dokładnych źródeł, na których model został przeszkolony — dlatego obowiązkowe jest dokładne sprawdzenie zbioru danych szkoleniowych.

- Jakość – Jakość FM może się różnić w zależności od jego typu (zastrzeżone lub otwarte oprogramowanie), rozmiaru i tego, na czym został przeszkolony. Jakość zależy od kontekstu, co oznacza, że to, co w jednej aplikacji jest uważane za wysoką jakość, może nie być nią w innej. Na przykład model wyszkolony na danych internetowych można uznać za wysokiej jakości w przypadku generowania tekstu konwersacyjnego, ale mniej w przypadku zadań technicznych lub specjalistycznych.

- Możliwość precyzyjnej regulacji – Możliwość precyzyjnego dostrojenia FM poprzez dostosowanie ciężaru modelu lub warstw może być czynnikiem kluczowym. Dostrajanie pozwala na lepsze dostosowanie modelu do konkretnego kontekstu aplikacji, poprawiając wydajność konkretnego zadania. Jednak dostrojenie wymaga dodatkowych zasobów obliczeniowych i wiedzy technicznej, a nie wszystkie modele obsługują tę funkcję. Modele typu open source można (ogólnie) zawsze precyzyjnie dostrajać, ponieważ artefakty modelu są dostępne do pobrania, a użytkownicy mogą je rozszerzać i wykorzystywać według własnego uznania. Modele zastrzeżone mogą czasami oferować opcję dostrajania.

- Istniejące umiejętności klienta – Na wybór FM mogą mieć również wpływ umiejętności i znajomość klienta lub zespołu programistów. Jeśli organizacja nie ma w swoim zespole ekspertów AI/ML, wówczas usługa API może być dla niej bardziej odpowiednia. Ponadto, jeśli zespół ma duże doświadczenie z konkretnym FM, bardziej efektywne może być dalsze jego używanie zamiast inwestowania czasu i zasobów w naukę i dostosowywanie się do nowego.

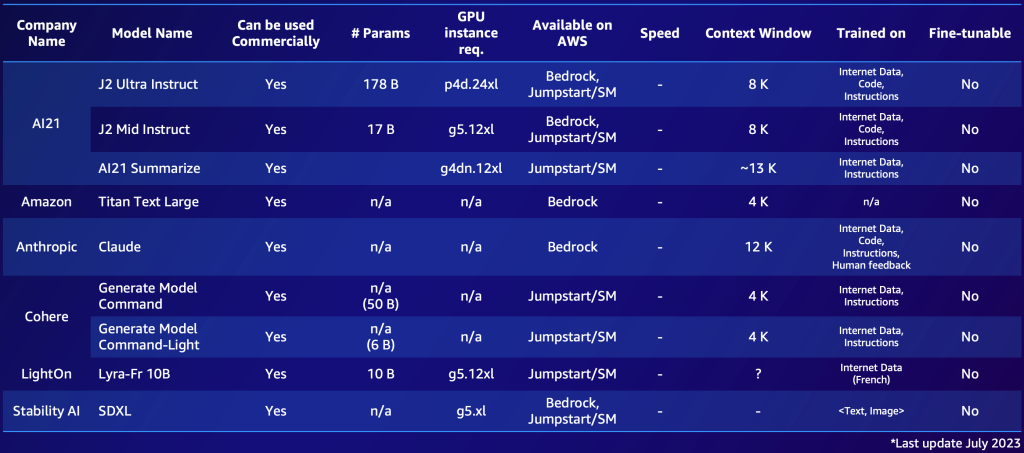

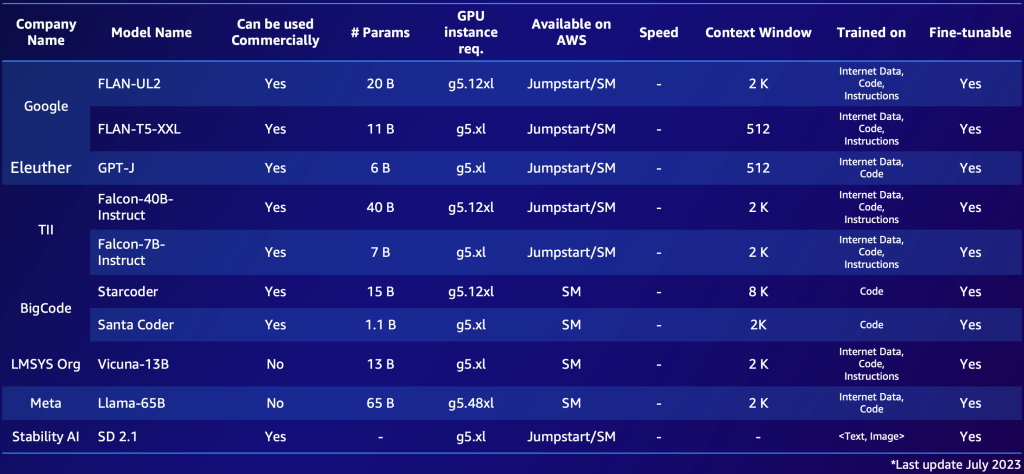

Poniżej znajduje się przykład dwóch krótkich list, jednej dla modeli zastrzeżonych i jednej dla modeli typu open source. Możesz skompilować podobne tabele w oparciu o swoje konkretne potrzeby, aby uzyskać szybki przegląd dostępnych opcji. Należy pamiętać, że wydajność i parametry tych modeli zmieniają się szybko i mogą być nieaktualne w momencie czytania, podczas gdy inne funkcje mogą być ważne dla konkretnych klientów, np. obsługiwany język.

Poniżej znajduje się przykład godnych uwagi zastrzeżonych FM dostępnych w AWS (lipiec 2023).

Poniżej znajduje się przykład godnego uwagi FM typu open source dostępnego w AWS (lipiec 2023).

Po sporządzeniu przeglądu 10–20 potencjalnych modeli kandydatów konieczne staje się dalsze udoskonalenie tej krótkiej listy. W tej sekcji proponujemy szybki mechanizm, który pozwoli uzyskać dwa lub trzy realne modele końcowe jako kandydatów do następnej rundy.

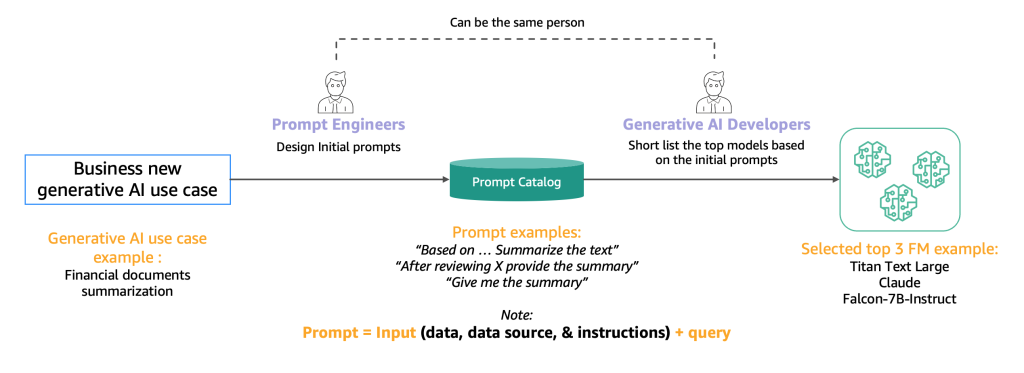

Poniższy diagram ilustruje wstępny proces tworzenia krótkiej listy.

Zazwyczaj inżynierowie podpowiedzi, którzy są ekspertami w tworzeniu wysokiej jakości podpowiedzi, które pozwalają modelom AI rozumieć i przetwarzać dane wejściowe użytkownika, eksperymentują z różnymi metodami wykonania tego samego zadania (takiego jak podsumowanie) na modelu. Sugerujemy, aby podpowiedzi te nie były tworzone na bieżąco, ale systematycznie wyodrębniane z katalogu podpowiedzi. Ten katalog podpowiedzi to centralne miejsce do przechowywania podpowiedzi, co pozwala uniknąć replikacji, umożliwia kontrolę wersji i udostępnianie podpowiedzi w zespole, aby zapewnić spójność między różnymi testerami podpowiedzi na różnych etapach programowania, co przedstawimy w następnej sekcji. Ten katalog podpowiedzi jest analogiczny do repozytorium Git zawierającego magazyn funkcji. Twórca generatywnej sztucznej inteligencji, który potencjalnie może być tą samą osobą, co szybki inżynier, musi następnie ocenić wyniki, aby określić, czy będą one odpowiednie dla generatywnej aplikacji AI, którą chcą opracować.

Krok 2. Przetestuj i oceń najlepsze FM

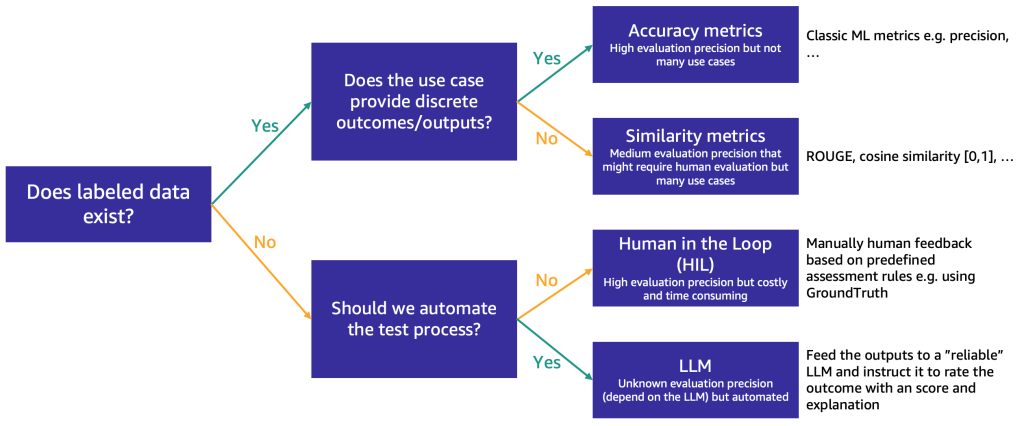

Po zmniejszeniu krótkiej listy do około trzech FM zalecamy etap oceny w celu dalszego przetestowania możliwości FM i przydatności dla danego przypadku użycia. W zależności od dostępności i charakteru danych ewaluacyjnych sugerujemy różne metody, jak pokazano na poniższym rysunku.

Metoda, którą należy zastosować jako pierwszą, zależy od tego, czy dane testowe zostały oznaczone etykietą, czy nie.

Jeśli masz oznaczone dane, możesz ich użyć do przeprowadzenia oceny modelu, tak jak robimy to w przypadku tradycyjnych modeli ML (wprowadź kilka próbek i porównaj wyniki z etykietami). W zależności od tego, czy dane testowe mają oddzielne etykiety (takie jak analiza nastrojów pozytywnych, negatywnych lub neutralnych), czy też są tekstem nieustrukturyzowanym (takim jak podsumowanie), proponujemy różne metody oceny:

- Metryki dokładności – W przypadku wyników dyskretnych (takich jak analiza nastrojów) możemy użyć standardowych wskaźników dokładności, takich jak precyzja, zapamiętywanie i wynik F1

- Metryki podobieństwa – Jeśli wynik nie jest ustrukturyzowany (np. podsumowanie), sugerujemy wskaźniki podobieństwa, takie jak ROUGE i podobieństwo cosinusa

Niektóre przypadki użycia nie pozwalają na uzyskanie jednej prawdziwej odpowiedzi (na przykład „Utwórz krótką opowieść dla dzieci dla mojej 5-letniej córki”). W takich przypadkach ocena modeli staje się trudniejsza, ponieważ nie masz oznaczonych danych testowych. Proponujemy dwa podejścia, w zależności od znaczenia przeglądu modelu przez człowieka w porównaniu z oceną automatyczną:

- Człowiek w pętli (HIL) – W takim przypadku zespół szybkich testerów sprawdzi odpowiedzi z modelu. W zależności od tego, jak krytyczna jest aplikacja, testerzy podpowiedzi mogą przejrzeć 100% wyników modelu lub tylko próbkę.

- Ocena oparta na LLM – W tym scenariuszu szybkich testerów zastępuje LLM, najlepiej taki, który jest potężniejszy (choć być może wolniejszy i najbardziej kosztowny) od testowanych. LLM dokona przeglądu wszystkich odpowiedzi wygenerowanych przez model i oceni je. Ta metoda może skutkować niższą jakością, ale jest tańszą i szybszą opcją oceny, która może zapewnić dobry wstępny pomiar wydajności modeli.

Na przykład możemy użyć następującego przykładowego monitu do LLM, który zawiera zapytanie wejściowe, odpowiedź LLM i instrukcje: „Chcielibyśmy poprosić o Twoją opinię na temat działania asystenta AI w odpowiedzi na pytanie użytkownika wyświetlone powyżej . Proszę ocenić przydatność, trafność, dokładność i poziom szczegółowości odpowiedzi asystenta. Asystent otrzymuje ogólny wynik w skali od 1 do 10, gdzie wyższy wynik oznacza lepsze ogólne wyniki.”

Ten monit zostanie wysłany do innego LLM (EvalLLM) w celu oceny. Poniżej znajduje się przykład, w którym reakcja modelu Falcon-40B została oceniona przez EvalLLM (w tym przypadku Claude). Używamy pytania „Co by było, gdyby Kanał Sueski nigdy nie został zbudowany?” Odpowiedź jest następująca:

Pytanie: Co by było, gdyby Kanał Sueski nigdy nie został zbudowany?

instruktaż falcon-40b

Gdyby Kanał Sueski nigdy nie został zbudowany, statki musiałyby podróżować po Afryce, aby pływać między Morzem Śródziemnym a Morzem Czerwonym. Wydłużyłoby to znacznie czas i odległość podróży, czyniąc ją mniej wydajną i droższą. Ponadto bez Kanału Sueskiego wiele krajów Bliskiego Wschodu i Afryki Północnej byłoby znacznie mniej połączonych z resztą świata, co utrudniałoby rozwój gospodarczy i kulturalny.

Recenzja (ocena: 9/10)

Odpowiedź asystenta jest bardzo trafna, dokładna i szczegółowa. Stanowi doskonałą odpowiedź na hipotetyczne pytanie użytkownika dotyczące nieistnienia Kanału Sueskiego. Asystent prawidłowo wskazuje konsekwencje dla podróży morskich oraz wpływ gospodarczy i kulturowy na Bliski Wschód i Afrykę Północną. W celu uzyskania bardziej kompleksowej reakcji mogłaby jednak bardziej szczegółowo opisać implikacje geopolityczne lub wpływ na struktury handlu światowego.

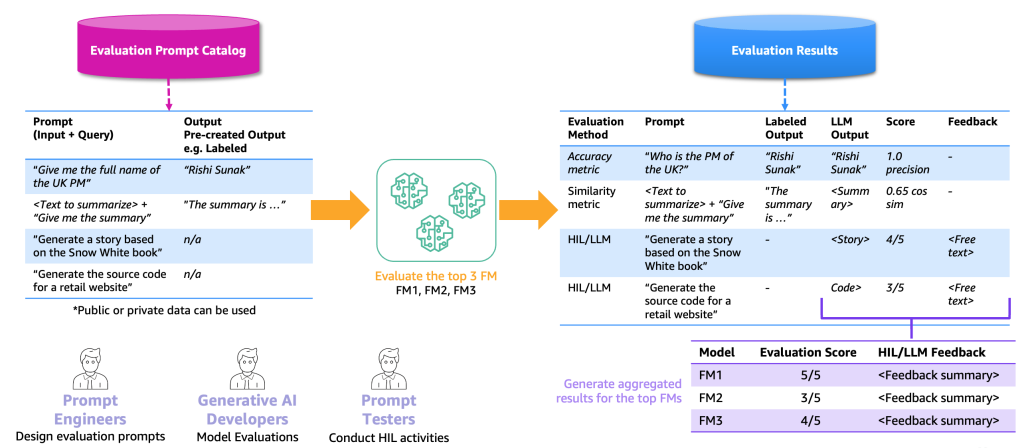

Poniższy rysunek ilustruje przykład kompleksowego procesu oceny.

W oparciu o ten przykład, aby przeprowadzić ocenę, musimy podać przykładowe podpowiedzi, które przechowujemy w katalogu podpowiedzi, oraz zestaw danych z etykietą ewaluacyjną lub bez niej, w oparciu o nasze konkretne aplikacje. Na przykład za pomocą oznaczonego zbioru danych ewaluacyjnych możemy udostępniać podpowiedzi (dane wejściowe i zapytania), takie jak „Podaj pełne imię i nazwisko premiera Wielkiej Brytanii w 2023 r.”, oraz wyniki i odpowiedzi, takie jak „Rishi Sunak”. W przypadku nieoznakowanego zbioru danych podajemy jedynie pytanie lub instrukcję, na przykład „Wygeneruj kod źródłowy witryny detalicznej”. Połączenie katalogu szybkiego i zbioru danych ewaluacyjnych nazywamy katalog monitów o ocenę. Powodem, dla którego rozróżniamy katalog podpowiedzi i katalog podpowiedzi ewaluacyjnych, jest to, że ten drugi jest dedykowany konkretnemu przypadkowi użycia, a nie ogólnym podpowiedziom i instrukcjom (takim jak odpowiadanie na pytania), które zawiera katalog podpowiedzi.

Następnym krokiem w przypadku tego katalogu podpowiedzi oceny jest przekazanie podpowiedzi oceny czołowym FM. Rezultatem jest zbiór danych wyników oceny, który zawiera podpowiedzi, wyniki każdego FM i oznaczone wyjście wraz z oceną (jeśli istnieje). W przypadku nieoznakowanego katalogu podpowiedzi do oceny, HIL lub LLM musi wykonać dodatkowy krok w celu przejrzenia wyników i przedstawienia oceny oraz informacji zwrotnej (jak opisaliśmy wcześniej). Ostatecznym wynikiem będą zagregowane wyniki, które łączą wyniki wszystkich wyników (obliczają średnią precyzję lub ocenę ludzką) i umożliwiają użytkownikom porównanie jakości modeli.

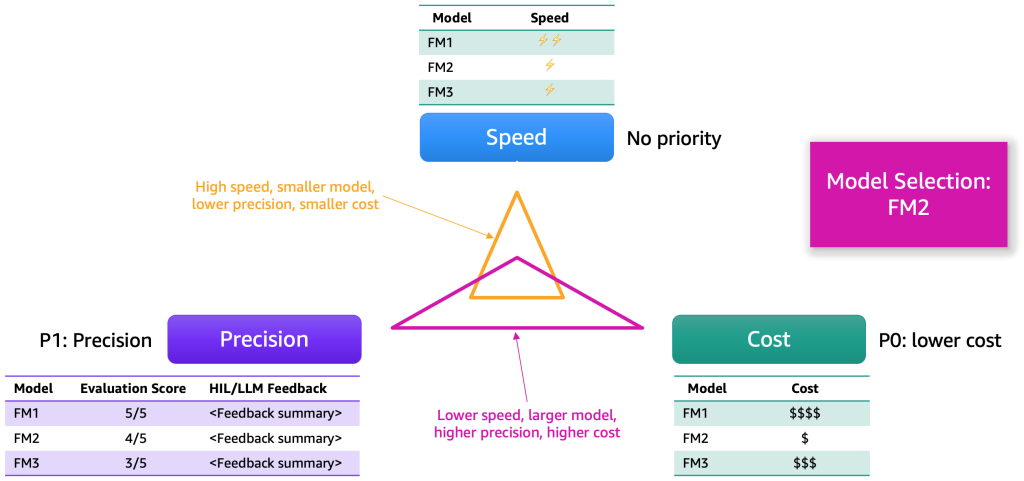

Po zebraniu wyników ewaluacji proponujemy wybór modelu bazującego na kilku wymiarach. Zwykle sprowadzają się one do takich czynników, jak precyzja, szybkość i koszt. Poniższy rysunek przedstawia przykład.

Każdy model będzie miał mocne strony i pewne kompromisy w tych wymiarach. W zależności od przypadku użycia, powinniśmy przypisać tym wymiarom różne priorytety. W poprzednim przykładzie jako najważniejszy czynnik uznaliśmy koszt, następnie precyzję i szybkość. Mimo że jest wolniejszy i nie tak wydajny jak FM1, pozostaje wystarczająco skuteczny i znacznie tańszy w utrzymaniu. W związku z tym możemy wybrać FM2 jako najlepszy wybór.

Krok 3. Opracuj backend i frontend aplikacji generatywnej AI

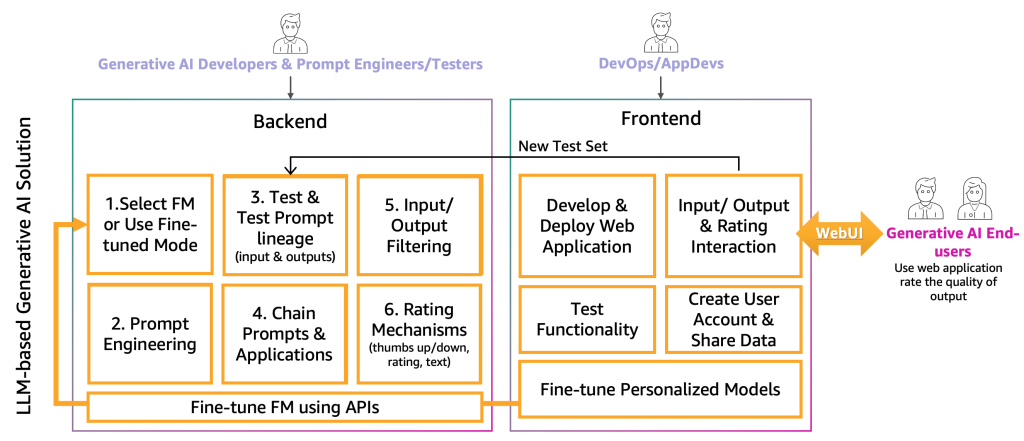

W tym momencie twórcy generatywnej sztucznej inteligencji wybrali odpowiedni FM do konkretnego zastosowania wraz z pomocą szybkich inżynierów i testerów. Kolejnym krokiem jest rozpoczęcie prac nad generatywną aplikacją AI. Rozdzieliliśmy rozwój aplikacji generatywnej AI na dwie warstwy, backend i frontend, jak pokazano na poniższym rysunku.

Na zapleczu programiści generatywnej sztucznej inteligencji włączają wybrane FM do rozwiązań i współpracują z inżynierami szybkiej obsługi, aby stworzyć automatyzację przekształcającą dane wejściowe użytkownika końcowego na odpowiednie podpowiedzi FM. Testerzy podpowiedzi tworzą niezbędne wpisy w katalogu podpowiedzi na potrzeby testowania automatycznego lub ręcznego (HIL lub LLM). Następnie twórcy generatywnej sztucznej inteligencji tworzą mechanizm szybkiego łączenia i aplikacji, aby zapewnić ostateczny wynik. W tym kontekście szybkie łączenie jest techniką tworzenia bardziej dynamicznych i świadomych kontekstowo aplikacji LLM. Działa poprzez podzielenie złożonego zadania na serię mniejszych, łatwiejszych do wykonania podzadań. Na przykład, jeśli zadamy LLM pytanie „Gdzie urodził się premier Wielkiej Brytanii i jak daleko jest to miejsce od Londynu”, zadanie można podzielić na poszczególne podpowiedzi, w przypadku których można zbudować podpowiedź na podstawie odpowiedzi wcześniejszej, szybkiej oceny, takiej jak „Kto jest premierem Wielkiej Brytanii”, „Jakie jest ich miejsce urodzenia” i „Jak daleko jest to miejsce od Londynu?” Aby zapewnić określoną jakość danych wejściowych i wyjściowych, twórcy generatywnej sztucznej inteligencji muszą również stworzyć mechanizm monitorowania i filtrowania danych wejściowych i wyjściowych użytkownika końcowego. Jeśli na przykład aplikacja LLM ma unikać toksycznych żądań i odpowiedzi, może zastosować detektor toksyczności dla danych wejściowych i wyjściowych oraz je odfiltrować. Wreszcie, muszą zapewnić mechanizm oceniania, który będzie wspierał poszerzanie katalogu podpowiedzi o dobre i złe przykłady. Bardziej szczegółowe przedstawienie tych mechanizmów zostanie zaprezentowane w kolejnych postach.

Aby zapewnić funkcjonalność użytkownikowi końcowemu generatywnej sztucznej inteligencji, konieczne jest stworzenie frontendowej strony internetowej, która wchodzi w interakcję z backendem. Dlatego osoby DevOps i AppDevs (twórcy aplikacji w chmurze) muszą przestrzegać najlepszych praktyk programistycznych, aby wdrożyć funkcjonalność wejścia/wyjścia i oceniania.

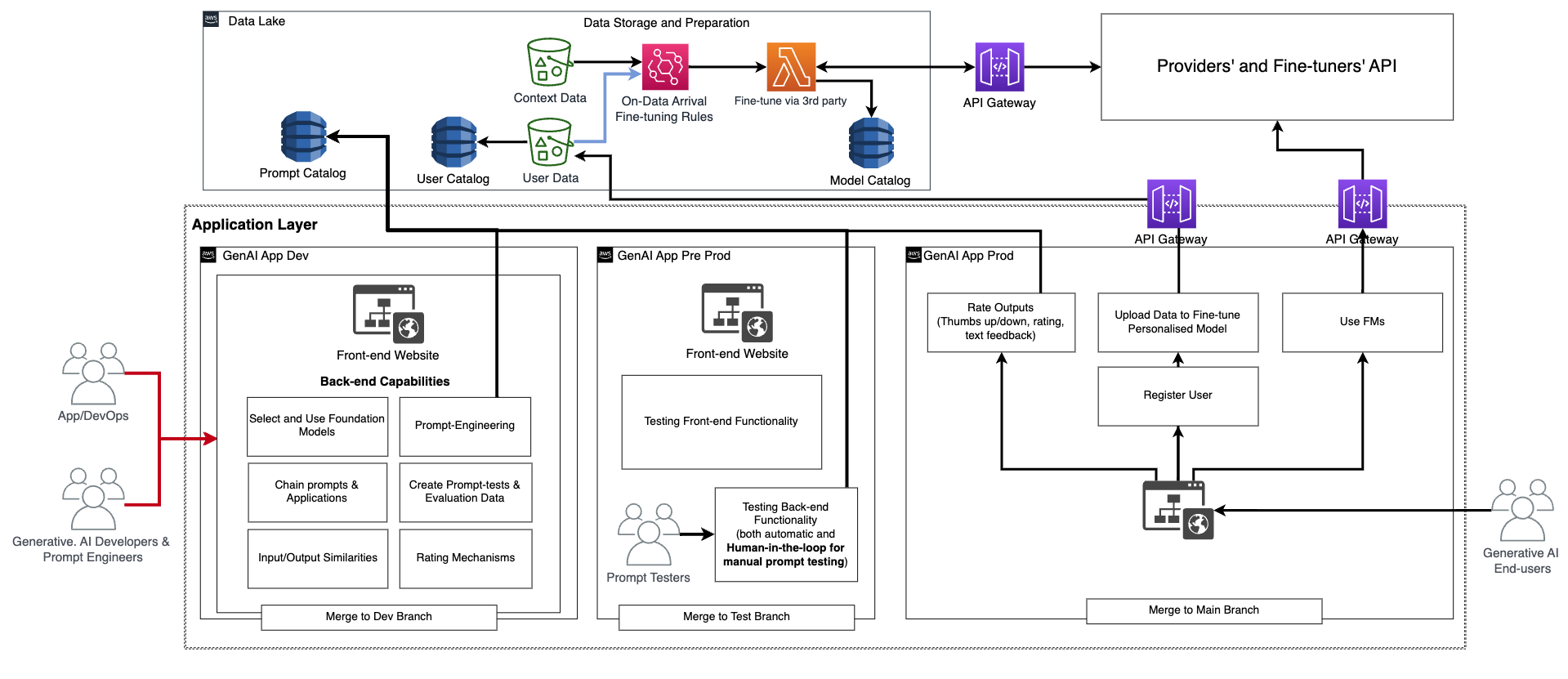

Oprócz tej podstawowej funkcjonalności, frontend i backend muszą zawierać funkcję tworzenia osobistych kont użytkowników, przesyłania danych, inicjowania dostrajania jako czarna skrzynka i używania spersonalizowanego modelu zamiast podstawowego FM. Produkcja generatywnej aplikacji AI jest podobna w przypadku normalnej aplikacji. Poniższy rysunek przedstawia przykładową architekturę.

W tej architekturze programiści generatywnej sztucznej inteligencji, inżynierowie podpowiedzi oraz DevOps lub AppDevs tworzą i testują aplikację ręcznie, wdrażając ją za pomocą CI/CD w środowisku programistycznym (generatywne tworzenie aplikacji AI na poprzednim rysunku) przy użyciu dedykowanych repozytoriów kodu i łącząc się z oddział deweloperów. Na tym etapie twórcy generatywnej sztucznej inteligencji będą korzystać z odpowiedniego FM, wywołując API, które zostało dostarczone przez dostawców FM w zakresie dostrajania. Następnie, aby intensywnie przetestować aplikację, muszą wypromować kod do gałęzi testowej, co spowoduje wdrożenie poprzez CI/CD do środowiska przedprodukcyjnego (generatywne preprod aplikacji AI). W tym środowisku testerzy podpowiedzi muszą wypróbować dużą liczbę kombinacji podpowiedzi i przejrzeć wyniki. Kombinację podpowiedzi, wyników i przeglądu należy przenieść do katalogu podpowiedzi oceny, aby w przyszłości zautomatyzować proces testowania. Po tym obszernym teście ostatnim krokiem jest wypromowanie generatywnej aplikacji AI do produkcji poprzez CI/CD poprzez połączenie z główną gałęzią (generative AI App Prod). Należy pamiętać, że wszystkie dane, w tym katalog podpowiedzi, dane i wyniki oceny, dane i metadane użytkowników końcowych oraz metadane dopracowanego modelu, muszą być przechowywane w warstwie Data Lake lub Data Mesh. Potoki i repozytoria CI/CD muszą być przechowywane na oddzielnym koncie narzędziowym (podobnym do tego opisanego dla MLOps).

Podróż dostawców

Dostawcy FM muszą szkolić FM, na przykład w zakresie modeli głębokiego uczenia się. Dla nich niezbędny jest kompleksowy cykl życia i infrastruktura MLOps. Dodatki są wymagane przy przygotowywaniu danych historycznych, ocenie modelu i monitorowaniu. Poniższy rysunek ilustruje ich podróż.

W klasycznym ML dane historyczne są najczęściej tworzone poprzez dostarczanie podstawowej prawdy za pośrednictwem potoków ETL. Na przykład w przypadku przewidywania rezygnacji automatyzacja aktualizuje tabelę bazy danych w oparciu o nowy status klienta, aby automatycznie zrezygnował/nie zrezygnował. W przypadku FM potrzebne są miliardy oznaczonych lub nieoznaczonych punktów danych. W przypadkach zamiany tekstu na obraz zespół osób zajmujących się etykietowaniem danych musi oznaczyć etykietą pary ręcznie. Jest to kosztowne przedsięwzięcie wymagające zaangażowania dużej liczby ludzi. Amazon SageMaker Ground Truth Plus może zapewnić zespół etykietujących, którzy wykonają tę czynność za Ciebie. W niektórych przypadkach proces ten można również częściowo zautomatyzować, na przykład stosując modele typu CLIP. W przypadku LLM, np. zamiany tekstu na tekst, dane nie są oznaczone etykietą. Należy je jednak przygotować i zachować format istniejących, nieoznaczonych danych historycznych. Dlatego też potrzebni są redaktorzy danych, którzy dokonają niezbędnego przygotowania danych i zapewnią ich spójność.

Po przygotowaniu danych historycznych kolejnym krokiem jest uczenie i produkcja modelu. Należy pamiętać, że można zastosować te same techniki oceny, które opisaliśmy dla konsumentów.

Podróż dostrajaczy

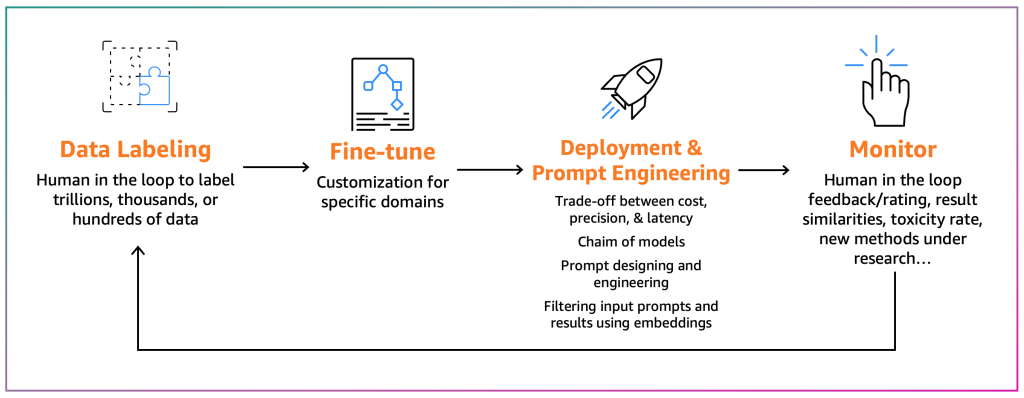

Celem dostrajaczy jest dostosowanie istniejącego FM do ich specyficznego kontekstu. Na przykład model FM może podsumować tekst ogólnego przeznaczenia, ale nie dokładnie raport finansowy, lub nie może wygenerować kodu źródłowego dla nietypowego języka programowania. W takich przypadkach osoby dostrajające muszą oznaczyć dane etykietami, dostroić model poprzez uruchomienie zadania szkoleniowego, wdrożyć model, przetestować go w oparciu o procesy konsumenckie i monitorować model. Poniższy diagram ilustruje ten proces.

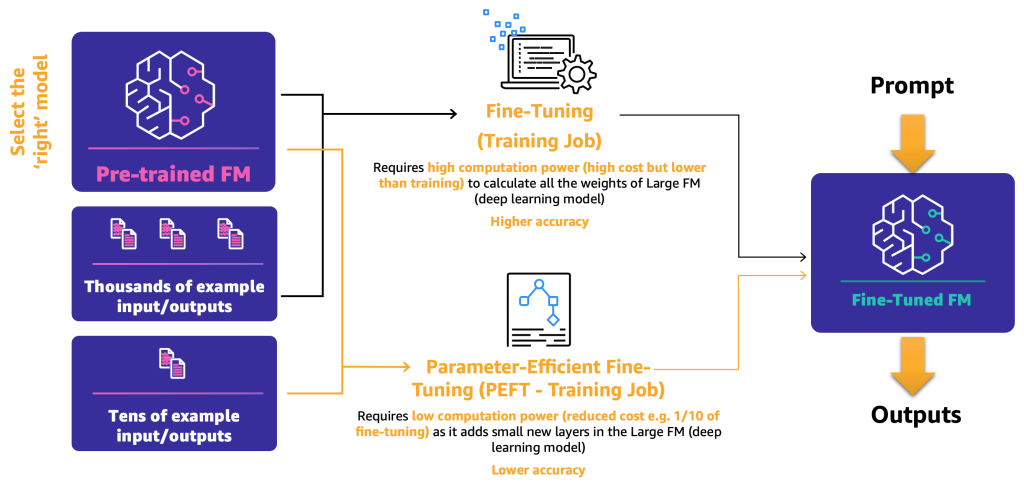

Na razie istnieją dwa mechanizmy dostrajające:

- Strojenie – Korzystając z FM i oznaczonych danych, zadanie szkoleniowe ponownie oblicza wagi i odchylenia warstw modelu głębokiego uczenia się. Proces ten może wymagać intensywnych obliczeń i wymaga reprezentatywnej ilości danych, ale może generować dokładne wyniki.

- Efektywne dostrajanie parametrów (PEFT) – Zamiast przeliczać wszystkie wagi i błędy systematyczne, badacze pokazali, że dodając dodatkowe małe warstwy do modeli głębokiego uczenia się, można osiągnąć zadowalające wyniki (np. LoRA). PEFT wymaga mniejszej mocy obliczeniowej niż głębokie dostrajanie i zadania szkoleniowego z mniejszą ilością danych wejściowych. Wadą jest potencjalna niższa dokładność.

Poniższy diagram ilustruje te mechanizmy.

Teraz, gdy zdefiniowaliśmy dwie główne metody dostrajania, następnym krokiem jest określenie, w jaki sposób możemy wdrożyć i używać zastrzeżonego FM o otwartym kodzie źródłowym.

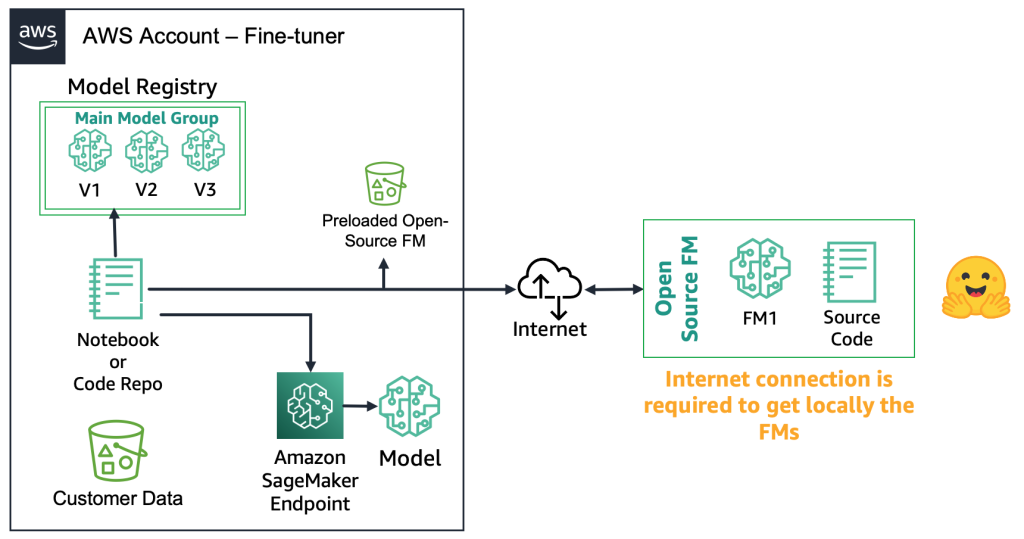

Dzięki FM o otwartym kodzie źródłowym dostrajający mogą pobrać artefakt modelu i kod źródłowy z Internetu, na przykład za pomocą Przytulanie twarzy Model Hub. Daje to elastyczność w zakresie głębokiego dostrajania modelu, przechowywania go w lokalnym rejestrze modeli i wdrażania w pliku Amazon Sage Maker punkt końcowy. Ten proces wymaga połączenia z Internetem. Aby obsługiwać bezpieczniejsze środowiska (takie jak dla klientów z sektora finansowego), możesz pobrać model lokalnie, przeprowadzić wszystkie niezbędne kontrole bezpieczeństwa i przesłać je do lokalnego zasobnika na koncie AWS. Następnie dostrajający korzystają z FM z lokalnego segmentu bez połączenia z Internetem. Zapewnia to prywatność danych, a dane nie są przesyłane przez Internet. Poniższy diagram ilustruje tę metodę.

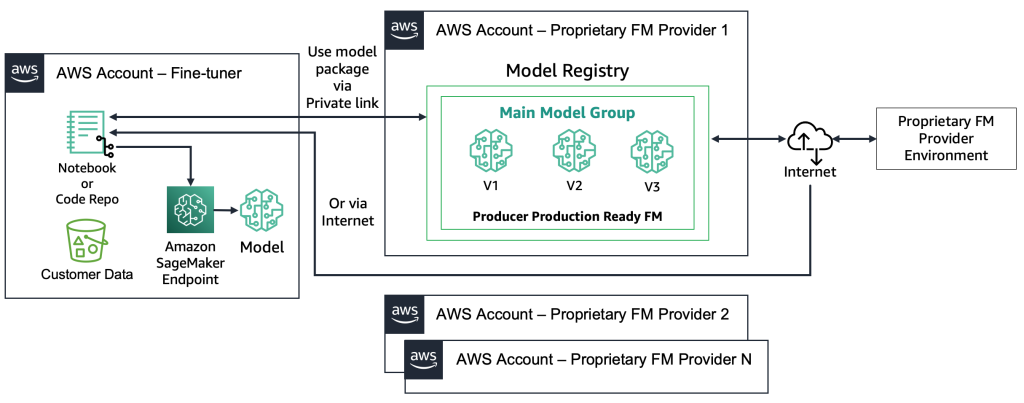

W przypadku zastrzeżonych FM proces wdrażania jest inny, ponieważ osoby dostrajające nie mają dostępu do artefaktu modelu ani kodu źródłowego. Modele są przechowywane na kontach AWS i rejestrach modeli zastrzeżonych dostawców FM. Aby wdrożyć taki model w punkcie końcowym SageMaker, osoby dostrajające mogą zażądać tylko pakietu modelu, który zostanie wdrożony bezpośrednio w punkcie końcowym. Proces ten wymaga wykorzystania danych klientów na kontach zastrzeżonych dostawców usług FM, co rodzi pytania dotyczące wykorzystywania danych wrażliwych klienta na koncie zdalnym w celu dostrajania oraz przechowywania modeli w rejestrze modeli współdzielonym przez wielu klientów . Prowadzi to do problemu wielu najemców, który staje się większym wyzwaniem, jeśli zastrzeżeni dostawcy FM muszą obsługiwać te modele. Jeśli używają dostrajających Amazońska skała macierzysta, problemy te zostały rozwiązane — dane nie są przesyłane przez Internet, a dostawcy FM nie mają dostępu do danych dostrajających. Te same wyzwania stoją przed modelami typu open source, jeśli dostrajające modele chcą obsługiwać modele od wielu klientów, jak na przykład podaliśmy wcześniej w przypadku witryny internetowej, na którą tysiące klientów będzie przesyłać spersonalizowane obrazy. Jednakże scenariusze te można uznać za możliwe do kontrolowania, ponieważ zaangażowany jest tylko dostrajacz. Poniższy diagram ilustruje tę metodę.

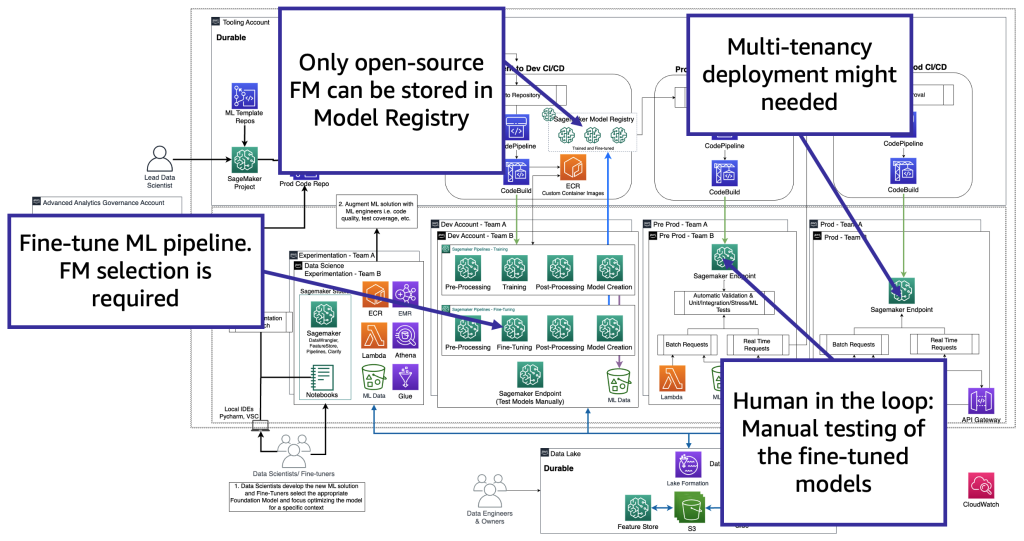

Z technologicznego punktu widzenia architektura, którą musi obsługiwać dostrajacz, jest podobna do tej dla MLOps (patrz poniższy rysunek). Dostrajanie należy przeprowadzić na poziomie deweloperskim, tworząc potoki ML, takie jak using Rurociągi Amazon SageMaker; wykonywanie przetwarzania wstępnego, dostrajania (zadanie szkoleniowe) i przetwarzania końcowego; oraz wysyłanie dopracowanych modeli do lokalnego rejestru modeli w przypadku FM typu open source (w przeciwnym razie nowy model zostanie zapisany w zastrzeżonym środowisku FM). Następnie, na etapie przedprodukcyjnym, musimy przetestować model opisany przez nas dla scenariusza konsumenckiego. Docelowo model będzie obsługiwany i monitorowany w prod. Należy pamiętać, że bieżący (dostrojony) FM wymaga punktów końcowych instancji GPU. Jeśli będziemy musieli wdrożyć każdy dopracowany model w oddzielnym punkcie końcowym, w przypadku setek modeli może to zwiększyć koszty. Dlatego musimy używać punktów końcowych obsługujących wiele modeli i stawić czoła wyzwaniu związanemu z wieloma dzierżawcami.

Dostrajający dostosowują model FM w oparciu o konkretny kontekst, aby wykorzystać go do celów biznesowych. Oznacza to, że w większości przypadków osoby dostrajające to także konsumenci, którzy muszą obsługiwać wszystkie warstwy, jak opisaliśmy w poprzednich sekcjach, w tym tworzenie aplikacji generatywnej sztucznej inteligencji, jezioro danych i siatkę danych oraz MLOps.

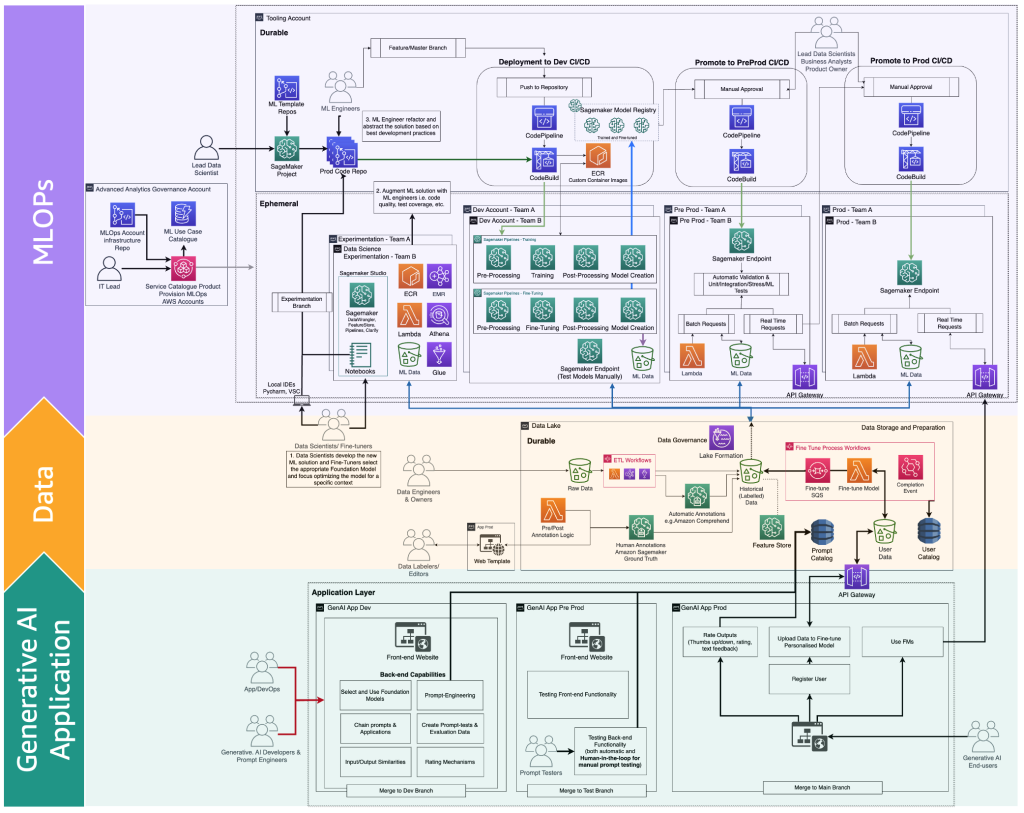

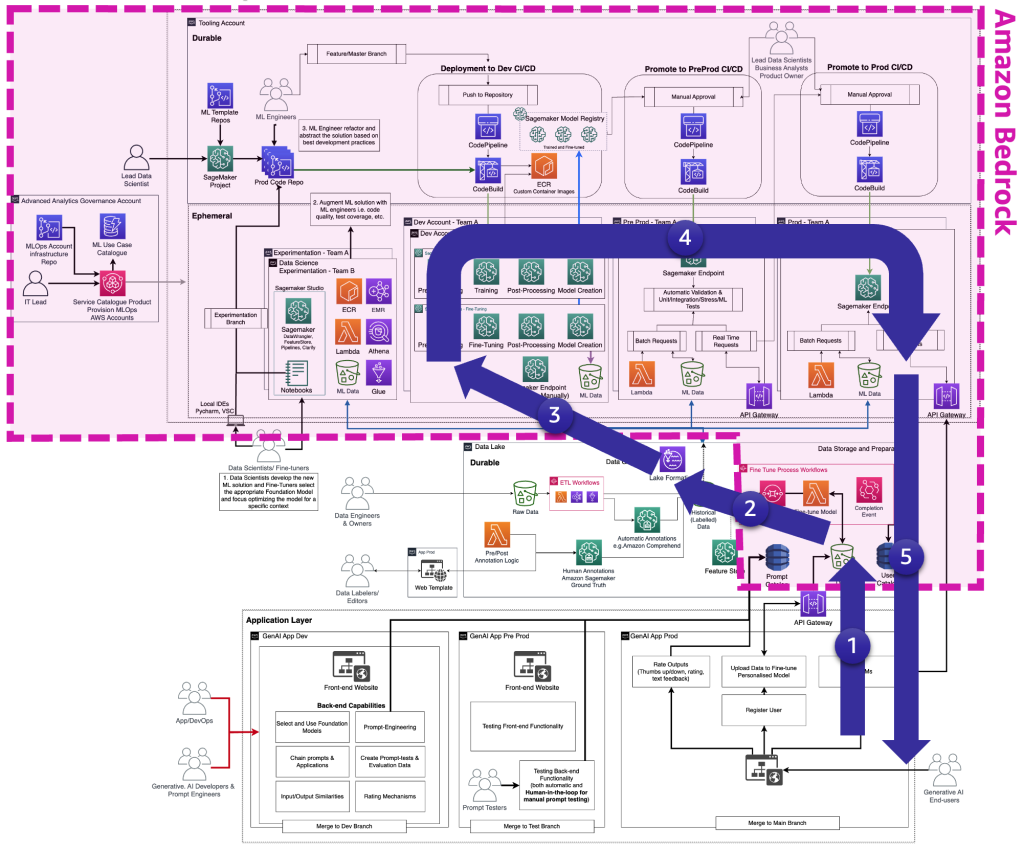

Poniższy rysunek ilustruje pełny cykl dostrajania FM, który osoby dostrajające muszą zapewnić użytkownikowi końcowemu generatywnej sztucznej inteligencji.

Poniższy rysunek ilustruje kluczowe kroki.

Kluczowe kroki są następujące:

- Użytkownik końcowy tworzy konto osobiste i przesyła prywatne dane.

- Dane są przechowywane w jeziorze danych i wstępnie przetwarzane zgodnie z formatem oczekiwanym przez FM.

- To wyzwala potok dostrajania ML, który dodaje model do rejestru modeli,

- Następnie albo model jest wdrażany do produkcji po minimalnych testach, albo przechodzi szeroko zakrojone testy z HIL i ręcznymi bramkami zatwierdzającymi.

- Dopracowany model jest udostępniany użytkownikom końcowym.

Ponieważ infrastruktura ta jest złożona dla klientów innych niż przedsiębiorstwa, AWS udostępniło Amazon Bedrock, aby odciążyć wysiłek związany z tworzeniem takich architektur i przybliżaniem dopracowanych FM do produkcji.

Persony i wyróżniki procesów FMOps i LLMOps

W oparciu o poprzednie podróże typu użytkownika (konsument, producent i dostrajacz), wymagane są nowe osoby z określonymi umiejętnościami, jak pokazano na poniższym rysunku.

Nowe persony przedstawiają się następująco:

- Etykiety i edytory danych – Ci użytkownicy oznaczają dane, takie jak pary lub przygotowuj nieoznakowane dane, takie jak dowolny tekst, i rozszerzaj zespół zaawansowanych analityków i środowiska jezior danych.

- Dostrajacze – Ci użytkownicy mają głęboką wiedzę na temat FM i wiedzą, jak je dostroić, poszerzając zespół analityki danych, który skupi się na klasycznym ML.

- Twórcy generatywnej sztucznej inteligencji – Mają głęboką wiedzę na temat wybierania FM, łączenia podpowiedzi i aplikacji oraz filtrowania wejść i wyjść. Należą do nowego zespołu — zespołu ds. aplikacji generatywnej sztucznej inteligencji.

- Natychmiastowi inżynierowie – Ci użytkownicy projektują podpowiedzi wejściowe i wyjściowe w celu dostosowania rozwiązania do kontekstu oraz testują i tworzą wstępną wersję katalogu podpowiedzi. Ich zespół to zespół zajmujący się generatywną aplikacją AI.

- Szybkie testery – Testują na dużą skalę generatywne rozwiązanie AI (backend i frontend) i przekazują wyniki, aby rozszerzyć szybki katalog i zbiór danych ewaluacyjnych. Ich zespół to zespół zajmujący się generatywną aplikacją AI.

- AppDev i DevOps – Opracowują interfejs (taki jak strona internetowa) aplikacji generatywnej AI. Ich zespół to zespół zajmujący się generatywną aplikacją AI.

- Użytkownicy końcowi generatywnej sztucznej inteligencji – Ci użytkownicy korzystają z generatywnych aplikacji AI w postaci czarnych skrzynek, udostępniają dane i oceniają jakość wyników.

Rozszerzoną wersję mapy procesów MLOps o uwzględnienie generatywnej sztucznej inteligencji można zilustrować na poniższym rysunku.

Nowa warstwa aplikacji to środowisko, w którym programiści generatywnej sztucznej inteligencji, inżynierowie szybkiej obsługi i testerzy oraz AppDevs stworzyli backend i frontend generatywnych aplikacji AI. Użytkownicy końcowi generatywnej sztucznej inteligencji wchodzą w interakcję z interfejsem aplikacji generatywnej sztucznej inteligencji za pośrednictwem Internetu (takiego jak internetowy interfejs użytkownika). Z drugiej strony osoby zajmujące się etykietowaniem danych i redaktorzy muszą wstępnie je przetwarzać bez konieczności uzyskiwania dostępu do zaplecza jeziora danych lub siatki danych. Dlatego do bezpiecznej interakcji z danymi niezbędny jest interfejs sieciowy (strona internetowa) z edytorem. SageMaker Ground Truth zapewnia tę funkcjonalność od razu po wyjęciu z pudełka.

Wnioski

MLOps może nam pomóc w efektywnym tworzeniu modeli ML. Aby jednak operacjonalizować generatywne aplikacje AI, potrzebne są dodatkowe umiejętności, procesy i technologie, prowadzące do FMOps i LLMOps. W tym poście zdefiniowaliśmy główne koncepcje FMOps i LLMOps oraz opisaliśmy kluczowe wyróżniki w porównaniu z możliwościami MLOps pod względem ludzi, procesów, technologii, wyboru modelu FM i oceny. Ponadto zilustrowaliśmy proces myślowy twórcy generatywnej sztucznej inteligencji oraz cykl życia generatywnej aplikacji AI.

W przyszłości skupimy się na dostarczaniu rozwiązań dla omawianych przez nas dziedzin i podamy więcej szczegółów na temat integracji monitorowania FM (takiego jak toksyczność, błąd i halucynacje) z wzorcami architektonicznymi źródeł danych stron trzecich lub prywatnych, takich jak Wyszukiwanie rozszerzonej generacji (RAG) do FMops/LLMOps.

Aby dowiedzieć się więcej, zapoznaj się z Mapa drogowa fundacji MLOps dla przedsiębiorstw z Amazon SageMaker i wypróbuj kompleksowe rozwiązanie w Wdrażanie praktyk MLOps za pomocą wstępnie wyszkolonych modeli Amazon SageMaker JumpStart.

Jeśli masz jakieś uwagi lub pytania, zostaw je w sekcji komentarzy.

O autorach

Dr Sokratis Kartakis jest starszym architektem rozwiązań w zakresie uczenia maszynowego i operacji w Amazon Web Services. Sokratis koncentruje się na umożliwianiu klientom korporacyjnym industrializacji rozwiązań Machine Learning (ML) poprzez wykorzystanie usług AWS i kształtowanie ich modelu operacyjnego, tj. fundamentu MLOps i planu transformacji z wykorzystaniem najlepszych praktyk programistycznych. Spędził ponad 15 lat na wymyślaniu, projektowaniu, kierowaniu i wdrażaniu innowacyjnych, kompleksowych rozwiązań ML i Internetu rzeczy (IoT) na poziomie produkcyjnym w obszarach energii, handlu detalicznego, zdrowia, finansów/bankowości, sportów motorowych itp. Wolny czas Sokratis lubi spędzać z rodziną i przyjaciółmi lub jeździć na motocyklach.

Dr Sokratis Kartakis jest starszym architektem rozwiązań w zakresie uczenia maszynowego i operacji w Amazon Web Services. Sokratis koncentruje się na umożliwianiu klientom korporacyjnym industrializacji rozwiązań Machine Learning (ML) poprzez wykorzystanie usług AWS i kształtowanie ich modelu operacyjnego, tj. fundamentu MLOps i planu transformacji z wykorzystaniem najlepszych praktyk programistycznych. Spędził ponad 15 lat na wymyślaniu, projektowaniu, kierowaniu i wdrażaniu innowacyjnych, kompleksowych rozwiązań ML i Internetu rzeczy (IoT) na poziomie produkcyjnym w obszarach energii, handlu detalicznego, zdrowia, finansów/bankowości, sportów motorowych itp. Wolny czas Sokratis lubi spędzać z rodziną i przyjaciółmi lub jeździć na motocyklach.

Heiko Hotza jest starszym architektem rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego, ze szczególnym naciskiem na przetwarzanie języka naturalnego, duże modele językowe i generatywną sztuczną inteligencję. Przed objęciem tego stanowiska był dyrektorem ds. analityki danych w dziale obsługi klienta Amazon w UE. Heiko pomaga naszym klientom odnieść sukces na ich drodze do AI/ML w AWS i współpracował z organizacjami z wielu branż, w tym z ubezpieczeniami, usługami finansowymi, mediami i rozrywką, opieką zdrowotną, usługami użyteczności publicznej i produkcją. W wolnym czasie Heiko podróżuje tak dużo, jak to możliwe.

Heiko Hotza jest starszym architektem rozwiązań w zakresie sztucznej inteligencji i uczenia maszynowego, ze szczególnym naciskiem na przetwarzanie języka naturalnego, duże modele językowe i generatywną sztuczną inteligencję. Przed objęciem tego stanowiska był dyrektorem ds. analityki danych w dziale obsługi klienta Amazon w UE. Heiko pomaga naszym klientom odnieść sukces na ich drodze do AI/ML w AWS i współpracował z organizacjami z wielu branż, w tym z ubezpieczeniami, usługami finansowymi, mediami i rozrywką, opieką zdrowotną, usługami użyteczności publicznej i produkcją. W wolnym czasie Heiko podróżuje tak dużo, jak to możliwe.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/fmops-llmops-operationalize-generative-ai-and-differences-with-mlops/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 2023

- 23

- 7

- 75

- a

- zdolność

- Zdolny

- O nas

- powyżej

- ABSTRACT

- dostęp

- dostępny

- Dostęp

- Konto

- Konta

- precyzja

- dokładny

- dokładnie

- Osiągać

- działania

- działalność

- przystosować

- adaptacja

- Dodaj

- dodanie

- dodatek

- Dodatkowy

- do tego

- wzbogacenie

- Dodaje

- administracja

- Przyjęcie

- zaawansowany

- Afryka

- Po

- Umowa

- AI

- AI i uczenie maszynowe

- Asystent AI

- Modele AI

- Usługi AI

- przypadki użycia ai

- AI / ML

- zmierzać

- Wyrównuje

- Wszystkie kategorie

- dopuszczać

- pozwala

- wzdłuż

- już

- również

- Chociaż

- zawsze

- Amazonka

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- wśród

- ilość

- an

- analiza

- analityka

- i

- i infrastruktura

- Inne

- odpowiedź

- odpowiedzi

- każdy

- api

- Pszczoła

- Aplikacja

- Zastosowanie

- Application Development

- aplikacje

- Aplikuj

- podejście

- awanse

- właściwy

- zatwierdzenie

- w przybliżeniu

- architekci

- architektoniczny

- architektura

- SĄ

- na około

- AS

- oceniając

- Asystent

- At

- zbadane

- audytorzy

- zwiększona

- zautomatyzować

- zautomatyzowane

- automatycznie

- automatycznie

- Automatyzacja

- dostępność

- dostępny

- średni

- uniknąć

- AWS

- Backend

- Łazienka

- Bilans

- na podstawie

- podstawowy

- BE

- bo

- stają się

- staje się

- być

- zanim

- jest

- Benchmark

- Korzyści

- BEST

- Ulepsz Swój

- pomiędzy

- stronniczość

- uprzedzenia

- Miliard

- miliardy

- Czarny

- urodzony

- pożyczać

- obie

- boty

- Pudełko

- Skrzynki

- Oddział

- Przełamując

- krótko

- Bringing

- Złamany

- budować

- Budowanie

- wybudowany

- biznes

- ale

- by

- obliczać

- wezwanie

- nazywa

- powołanie

- CAN

- kandydat

- kandydatów

- możliwości

- zdolność

- zdobyć

- walizka

- Etui

- katalog

- kategorie

- centralny

- scentralizowane

- pewien

- wyzwanie

- wyzwania

- wyzwanie

- zmiana

- nasze chatboty

- tańsze

- Wykrywanie urządzeń szpiegujących

- wybór

- Wybierając

- klasyczny

- dokładnie

- bliższy

- Odzież

- Chmura

- kod

- Kodowanie

- współpracować

- połączenie

- kombinacje

- połączyć

- jak

- komentarze

- handlowy

- komercyjnie

- wspólny

- porównać

- w porównaniu

- kompletny

- ukończenia

- kompleks

- kompleksowość

- spełnienie

- zgodny

- skład

- wszechstronny

- moc obliczeniowa

- komputer

- koncentrować się

- pojęcie

- Koncepcje

- Obawy

- Warunki

- Prowadzenie

- przeprowadzone

- połączony

- połączenie

- w konsekwencji

- Rozważać

- Rozważania

- za

- konsumować

- konsument

- Konsumenci

- konsumpcja

- Pojemnik

- zawiera

- zawartość

- Tworzenie treści

- kontekst

- kontynuować

- kontrola

- konwersacyjny

- rozmowy

- prawo autorskie

- Odpowiedni

- Koszty:

- kosztowny

- Koszty:

- mógłby

- kraje

- pokrywa

- pokryty

- Stwórz

- stworzony

- tworzy

- Tworzenie

- tworzenie

- krytyczny

- istotny

- kulturalny

- Aktualny

- zwyczaj

- klient

- dane klienta

- Obsługa klienta

- Klientów

- dane

- Jezioro danych

- punkty danych

- Przygotowywanie danych

- prywatność danych

- nauka danych

- Baza danych

- zbiory danych

- Zdecentralizowane

- Decydowanie

- Decyzje

- dedykowane

- głęboko

- głębokie nurkowanie

- głęboka nauka

- zdefiniowane

- definiowanie

- definicja

- definicje

- dostarczyć

- sięgać

- Kreowanie

- W zależności

- zależy

- przedstawiający

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- opisać

- opisane

- opis

- Wnętrze

- zaprojektowany

- projektowanie

- pragnienie

- życzenia

- szczegółowe

- detale

- Ustalać

- określaniu

- dev

- rozwijać

- rozwinięty

- Deweloper

- deweloperzy

- rozwijanie

- oprogramowania

- zespół programistów

- Różnice

- różne

- różnicować

- Wymiary

- bezpośrednio

- dyskutować

- omówione

- wystawiany

- dystans

- nurkować

- inny

- do

- dokumenty

- Nie

- domena

- domeny

- nie

- na dół

- pobieranie

- napęd

- z powodu

- dynamiczny

- e

- każdy

- Wcześniej

- Wschód

- łatwo

- Gospodarczy

- redaktor

- Efektywne

- wydajny

- skutecznie

- wysiłek

- bądź

- opracowane

- wybrany

- umożliwiać

- umożliwiając

- zakończenia

- koniec końców

- Punkt końcowy

- energia

- inżynier

- Inżynieria

- Inżynierowie

- Angielski

- wzmacniać

- zapewnić

- zapewnia

- Enterprise

- przedsiębiorstwa

- rozrywka

- Środowisko

- środowiska

- Równie

- szczególnie

- niezbędny

- itp

- EU

- oceniać

- oceniane

- ewaluację

- Parzyste

- Każdy

- przykład

- przykłady

- doskonała

- podniecony

- Ćwiczenie

- Przede wszystkim system został opracowany

- istnieje

- Egzotyczny

- oczekuje

- drogi

- doświadczenie

- eksperyment

- ekspertyza

- eksperci

- wykorzystywanie

- rozciągać się

- rozsuwalny

- rozbudowa

- rozległy

- Szerokie doświadczenie

- obszernie

- wyciąg

- f1

- Twarz

- czynnik

- Czynniki

- Znajomość

- członków Twojej rodziny

- daleko

- szybciej

- Cecha

- informacja zwrotna

- karmienie

- Postać

- filtrować

- filtracja

- finał

- W końcu

- budżetowy

- raport finansowy

- Sektor finansowy

- usługi finansowe

- i terminów, a

- dopasować

- Elastyczność

- elastyczne

- Skupiać

- koncentruje

- koncentruje

- skupienie

- obserwuj

- następnie

- następujący

- następujący sposób

- W razie zamówieenia projektu

- Dla konsumentów

- Nasz formularz

- format

- Fundacja

- cztery

- Darmowy

- przyjaciele

- od

- z przodu

- Zaczepy

- frontend

- pełny

- Funkcjonalność

- fundamentalny

- dalej

- Ponadto

- przyszłość

- Bramy

- wskaźnik

- Ogólne

- ogólny cel

- ogólnie

- Generować

- wygenerowane

- generuje

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- geopolityczna

- otrzymać

- git

- dany

- daje

- Globalne

- global Trade

- dobry

- zarządzanie

- GPU

- Ziemia

- miał

- ręka

- Wykorzystywanie

- Have

- mający

- he

- głowa

- Zdrowie

- opieki zdrowotnej

- pomoc

- pomaga

- tutaj

- Wysoki

- wysokiej jakości

- wyższy

- wysoko

- jego

- historyczny

- przytrzymaj

- gospodarz

- hostowane

- W jaki sposób

- How To

- Jednak

- HTML

- HTTPS

- człowiek

- Setki

- i

- idealnie

- if

- ilustruje

- obraz

- zdjęcia

- wyimaginowany

- Rezultat

- wdrożenia

- wykonawczych

- implikacje

- znaczenie

- ważny

- poprawy

- in

- zawierać

- obejmuje

- Włącznie z

- włączać

- Zwiększać

- wzrosła

- wskazuje

- wskaźniki

- indywidualny

- przemysłowa

- wpływ

- pod wpływem

- Infrastruktura

- początkowy

- Innowacyjny

- wkład

- Wejścia

- przykład

- zamiast

- instrukcje

- ubezpieczenie

- integrować

- zamierzony

- interakcji

- interakcji

- wzajemne oddziaływanie

- współdziała

- Interfejs

- Internet

- połączenie internetowe

- Internet przedmiotów

- najnowszych

- przedstawiać

- inwestowanie

- zaangażowany

- z udziałem

- Internet przedmiotów

- IT

- JEGO

- Praca

- podróż

- Podróże

- lipiec

- właśnie

- Klawisz

- kluczowy czynnik

- Uprzejmy

- Wiedzieć

- wiedza

- znany

- Etykieta

- Etykiety

- jezioro

- język

- duży

- większe

- Nazwisko

- Utajenie

- warstwa

- nioski

- prowadzący

- Wyprowadzenia

- UCZYĆ SIĘ

- nauka

- Pozostawiać

- wypożyczać

- mniej

- poziom

- lewarowanie

- biblioteki

- Licencja

- Koncesjonowanie

- wifecycwe

- lubić

- lubi

- Ograniczenia

- LINK

- LLM

- załadować

- miejscowy

- usytuowany

- lokalizacja

- Londyn

- długo

- dłużej

- niższy

- maszyna

- uczenie maszynowe

- zrobiony

- Główny

- utrzymać

- Większość

- Dokonywanie

- wykonalny

- obowiązkowe

- podręcznik

- ręcznie

- produkcja

- wiele

- mapa

- masywny

- dojrzałość

- maksymalny

- Może..

- me

- znaczenie

- znaczy

- mechanizm

- Mechanizmy

- Media

- Morze Śródziemne

- wzmiankowany

- połączenie

- siatka

- Metadane

- metoda

- Metodologia

- metody

- Metryka

- Środkowy

- Bliski Wschód

- może

- minimum

- ML

- MLOps

- model

- modele

- monitor

- monitorowane

- monitorowanie

- jeszcze

- bardziej wydajny

- większość

- przeważnie

- Sporty motorowe

- ruch

- przeniósł

- ruch

- dużo

- wielokrotność

- Muzyka

- musi

- my

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Natura

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- wymagania

- ujemny

- sieć

- sieci neuronowe

- Neutralny

- nigdy

- Nowości

- nowo

- Następny

- nlp

- Nie

- normalna

- Północ

- dostojnik

- numer

- obserwować

- of

- oferta

- oferowany

- często

- on

- Wprowadzenie

- ONE

- te

- tylko

- koncepcja

- open source

- operacyjny

- operacje

- Optymalny

- Option

- Opcje

- or

- organizacja

- organizacji

- Inne

- Pozostałe

- Inaczej

- ludzkiej,

- na zewnątrz

- Wynik

- wydajność

- koniec

- ogólny

- przegląd

- własny

- właściciel

- właściciele

- pakiet

- par

- parametry

- wzory

- Ludzie

- dla

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywania

- może

- osoba

- osobisty

- Personalizowany

- perspektywa

- faza

- ZDJĘCIA

- kawałek

- rurociąg

- Miejsce

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- punkt

- zwrotnica

- polityka

- pozytywny

- posiadać

- możliwy

- Post

- Wiadomości

- potencjał

- potencjalnie

- power

- mocny

- Praktyczny

- praktyki

- Detaliczność

- przewidzieć

- przepowiednia

- Przewidywania

- przygotowanie

- Przygotować

- przygotowany

- przygotowanie

- przedstawione

- poprzedni

- poprzednio

- premia

- premier

- Zasady

- Wcześniejszy

- Priorytet

- prywatność

- prywatny

- Problem

- wygląda tak

- procesów

- przetwarzanie

- Wytworzony

- producent

- Produkt

- Produkcja

- Programowanie

- projekt

- promować

- dowód

- dowód koncepcji

- zaproponować

- własność

- Udowodnij

- zapewniać

- pod warunkiem,

- dostawca

- dostawców

- zapewnia

- że

- cel

- cele

- wypycha

- puzzle

- jakość

- pytanie

- pytania

- Szybki

- podnosi

- zasięg

- nośny

- szybko

- Kurs

- raczej

- ocena

- Czytający

- w czasie rzeczywistym

- powód

- otrzymać

- polecić

- Czerwony

- Zredukowany

- oczyścić

- w sprawie

- rejestry

- rejestr

- regulamin

- związane z

- wydany

- mających znaczenie

- niezawodność

- szczątki

- zdalny

- otrzymuje

- raport

- składnica

- reprezentacja

- przedstawiciel

- zażądać

- wywołań

- wymagany

- wymagania

- Wymaga

- Badania naukowe

- Badacze

- Zasoby

- odpowiednio

- odpowiedź

- Odpowiedzi

- odpowiedzialny

- REST

- Ograniczenia

- Restrykcyjne

- dalsze

- Efekt

- detaliczny

- ponownie

- przeglądu

- recenzja

- jazda konna

- prawo

- mapa drogowa

- Rola

- role

- w przybliżeniu

- okrągły

- run

- bieganie

- sagemaker

- taki sam

- piaskownica

- Skala

- skalowaniem

- scenariusz

- scenariusze

- nauka

- Naukowcy

- wynik

- zadraśnięcie

- skrypty

- SEA

- Sekcja

- działy

- sektor

- bezpieczne

- bezpiecznie

- bezpieczeństwo

- zasady bezpieczeństwa

- widzieć

- poszukuje

- wybrany

- wybierając

- wybór

- wysyłanie

- senior

- wysłany

- sentyment

- oddzielny

- Sekwencja

- Serie

- służyć

- usługa

- Usługi

- służąc

- zestaw

- kilka

- modelacja

- Share

- shared

- statki

- Short

- powinien

- pokazane

- Targi

- bok

- znaczący

- znacznie

- podobny

- upraszczać

- Rozmiar

- umiejętności

- mały

- mniejszy

- MŚP

- So

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- kilka

- Źródło

- Kod źródłowy

- Źródła

- Typ przestrzeni

- specjalny

- specjalista

- wyspecjalizowanym

- specyficzny

- swoiście

- prędkość

- wydać

- spędził

- STAGE

- etapy

- interesariusze

- standard

- normalizująca

- początek

- Rynek

- Ewolucja krok po kroku

- Cel

- sklep

- przechowywany

- przechowywania

- Historia

- silne strony

- silny

- Następnie

- udany

- taki

- sugerować

- stosowność

- odpowiedni

- streszczać

- PODSUMOWANIE

- wsparcie

- Utrzymany

- domniemany

- pewnie

- SWIFT

- system

- stół

- Brać

- Zadanie

- zadania

- zespół

- Zespoły

- Techniczny

- Techniki

- Technologies

- Technologia

- REGULAMIN

- test

- przetestowany

- testerzy

- Testowanie

- niż

- że

- Połączenia

- Przyszłość

- Źródło

- UK

- świat

- ich

- Im

- sami

- następnie

- Tam.

- w związku z tym

- Te

- one

- rzeczy

- Myślący

- innych firm

- to

- tych

- chociaż?

- myśl

- tysiące

- trzy

- czas

- do

- razem

- żeton

- Żetony

- Top

- tematy

- w kierunku

- handel

- tradycyjny

- Pociąg

- przeszkolony

- Trening

- Przekształcać

- Transformacja

- podróżować

- podróże

- Trend

- wyzwalać

- prawdziwy

- Prawda

- próbować

- drugiej

- rodzaj

- typy

- zazwyczaj

- ui

- Uk

- zrozumieć

- zrozumienie

- jednostka

- jednostek

- Nowości

- Uploading

- us

- nadający się do użytku

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- Użytkowe

- wykorzystany

- różnorodny

- zweryfikować

- wersja

- Przeciw

- pionowy

- przez

- wykonalne

- wyobrażać sobie

- vs

- chcieć

- była

- we

- sieć

- usługi internetowe

- Strona internetowa

- DOBRZE

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- natomiast

- czy

- który

- Podczas

- KIM

- szeroki

- Szeroki zasięg

- będzie

- okno

- okna

- w

- w ciągu

- bez

- słowo

- słowa

- Praca

- pracować razem

- pracował

- pracujący

- działa

- świat

- by

- lat

- Wydajność

- You

- Twój

- zefirnet