generatywna sztuczna inteligencja aplikacje oparte na modelach podstawowych (FM) umożliwiają organizacjom uzyskanie znaczącej wartości biznesowej w zakresie obsługi klienta, produktywności, optymalizacji procesów i innowacji. Jednakże przyjęcie tych FM wiąże się z sprostaniem kilku kluczowym wyzwaniom, w tym jakości wyników, prywatności danych, bezpieczeństwu, integracji z danymi organizacji, kosztom i umiejętnościom dostarczania.

W tym poście omawiamy różne podejścia, jakie można zastosować podczas tworzenia aplikacji wykorzystujących generatywną sztuczną inteligencję. Wraz z szybkim rozwojem FM jest to ekscytujący czas na wykorzystanie ich mocy, ale także kluczowy dla zrozumienia, jak właściwie je wykorzystać, aby osiągnąć wyniki biznesowe. Zapewniamy przegląd kluczowych podejść do generatywnej sztucznej inteligencji, w tym szybkiej inżynierii, generowania rozszerzonego wyszukiwania (RAG) i dostosowywania modelu. Stosując te podejścia, omawiamy kluczowe kwestie dotyczące potencjalnej halucynacji, integracji z danymi przedsiębiorstwa, jakości wyników i kosztów. Na koniec będziesz mieć solidne wytyczne i pomocny schemat blokowy umożliwiający określenie najlepszej metody tworzenia własnych aplikacji wykorzystujących technologię FM, w oparciu o przykłady z życia. Niezależnie od tego, czy tworzysz chatbota, czy narzędzie do podsumowań, możesz kształtować potężne FMy tak, aby odpowiadały Twoim potrzebom.

Generatywna sztuczna inteligencja z AWS

Pojawienie się FM stwarza zarówno możliwości, jak i wyzwania dla organizacji chcących korzystać z tych technologii. Kluczowym wyzwaniem jest zapewnienie wysokiej jakości spójnych wyników zgodnych z potrzebami biznesowymi, a nie halucynacji lub fałszywych informacji. Organizacje muszą także uważnie zarządzać zagrożeniami związanymi z prywatnością i bezpieczeństwem danych, które wynikają z przetwarzania zastrzeżonych danych za pomocą FM. Brakuje umiejętności potrzebnych do właściwej integracji, dostosowania i walidacji FM w ramach istniejących systemów i danych. Tworzenie od podstaw dużych modeli językowych (LLM) lub dostosowywanie wstępnie wyszkolonych modeli wymaga znacznych zasobów obliczeniowych, ekspertów w dziedzinie analityki danych i miesięcy pracy inżynieryjnej. Sam koszt obliczeniowy może z łatwością wynieść miliony dolarów w przypadku uczenia modeli zawierających setki miliardów parametrów na ogromnych zbiorach danych przy użyciu tysięcy procesorów graficznych lub TPU. Oprócz sprzętu czyszczenie i przetwarzanie danych, projektowanie architektury modeli, dostrajanie hiperparametrów i opracowywanie potoków szkoleniowych wymagają specjalistycznych umiejętności uczenia maszynowego (ML). Kompleksowy proces jest złożony, czasochłonny i zbyt kosztowny dla większości organizacji nieposiadających wymaganej infrastruktury i inwestycji w talenty. Organizacje, które nie zareagują odpowiednio na te ryzyka, mogą odczuć negatywny wpływ na reputację swojej marki, zaufanie klientów, działalność operacyjną i przychody.

Amazońska skała macierzysta to w pełni zarządzana usługa oferująca wybór wydajnych modeli podstawowych (FM) wiodących firm zajmujących się sztuczną inteligencją, takich jak AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI i Amazon, za pośrednictwem jednego interfejsu API. Dzięki bezserwerowemu rozwiązaniu Amazon Bedrock możesz szybko rozpocząć pracę, prywatnie dostosowywać FM za pomocą własnych danych oraz integrować i wdrażać je w swoich aplikacjach za pomocą narzędzi AWS bez konieczności zarządzania jakąkolwiek infrastrukturą. Amazon Bedrock spełnia wymagania ustawy HIPAA i możesz korzystać z Amazon Bedrock zgodnie z RODO. Dzięki Amazon Bedrock Twoje treści nie są wykorzystywane do ulepszania modeli podstawowych i nie są udostępniane zewnętrznym dostawcom modeli. Twoje dane w Amazon Bedrock są zawsze szyfrowane podczas przesyłania i przechowywania, a opcjonalnie możesz szyfrować zasoby przy użyciu własnych kluczy. Możesz użyć Prywatny link AWS z Amazon Bedrock, aby ustanowić prywatną łączność pomiędzy FM i VPC bez narażania swojego ruchu na Internet. Z Bazy wiedzy na temat Amazon Bedrockmożesz przekazywać FM i agentom informacje kontekstowe z prywatnych źródeł danych Twojej firmy, aby RAG mógł dostarczać bardziej trafne, dokładne i dostosowane odpowiedzi. Możesz prywatnie dostosowywać FM za pomocą własnych danych za pomocą interfejsu wizualnego, bez pisania żadnego kodu. Jako w pełni zarządzana usługa Amazon Bedrock oferuje proste środowisko programistyczne umożliwiające pracę z szeroką gamą wydajnych FM.

Rozpoczęty w 2017, Amazon Sage Maker to w pełni zarządzana usługa, która ułatwia tworzenie, trenowanie i wdrażanie modeli uczenia maszynowego. Coraz więcej klientów tworzy własne FM za pomocą SageMaker, w tym Stability AI, AI21 Labs, Hugging Face, Perplexity AI, Hippocratic AI, LG AI Research i Technology Innovation Institute. Aby pomóc Ci szybko rozpocząć pracę, Amazon SageMaker JumpStart oferuje centrum ML, w którym można eksplorować, szkolić i wdrażać szeroki wybór publicznych FM, takich jak modele Mistral, modele LightOn, RedPajama, Mosiac MPT-7B, FLAN-T5/UL2, GPT-J-6B/Neox-20B i Bloom/BloomZ, korzystając ze specjalnie opracowanych narzędzi SageMaker, takich jak eksperymenty i potoki.

Powszechne generatywne podejścia do sztucznej inteligencji

W tej sekcji omawiamy powszechne podejścia do wdrażania skutecznych rozwiązań generatywnej sztucznej inteligencji. Badamy popularne techniki szybkiego inżynierii, które pozwalają na realizację bardziej złożonych i interesujących zadań za pomocą FM. Omawiamy również, w jaki sposób techniki takie jak RAG i dostosowywanie modeli mogą jeszcze bardziej zwiększyć możliwości FM i przezwyciężyć wyzwania, takie jak ograniczone dane i ograniczenia obliczeniowe. Dzięki odpowiedniej technice możesz tworzyć wydajne i skuteczne rozwiązania w zakresie generatywnej sztucznej inteligencji.

Szybka inżynieria

Szybka inżynieria to praktyka starannego projektowania podpowiedzi, aby skutecznie wykorzystać możliwości FM. Polega na użyciu podpowiedzi, czyli krótkich fragmentów tekstu, które kierują modelem w celu wygenerowania dokładniejszych i trafniejszych odpowiedzi. Dzięki szybkiej inżynierii możesz poprawić wydajność FM i zwiększyć ich skuteczność w różnych zastosowaniach. W tej części omawiamy techniki, takie jak podpowiadanie typu zero-shot i kilka strzałów, które szybko dostosowuje FM do nowych zadań za pomocą zaledwie kilku przykładów, oraz podpowiadanie na podstawie łańcucha myślowego, które rozkłada złożone rozumowanie na etapy pośrednie. Metody te pokazują, jak szybka inżynieria może zwiększyć skuteczność FM w przypadku złożonych zadań bez konieczności ponownego szkolenia modelu.

Monit o zerowy strzał

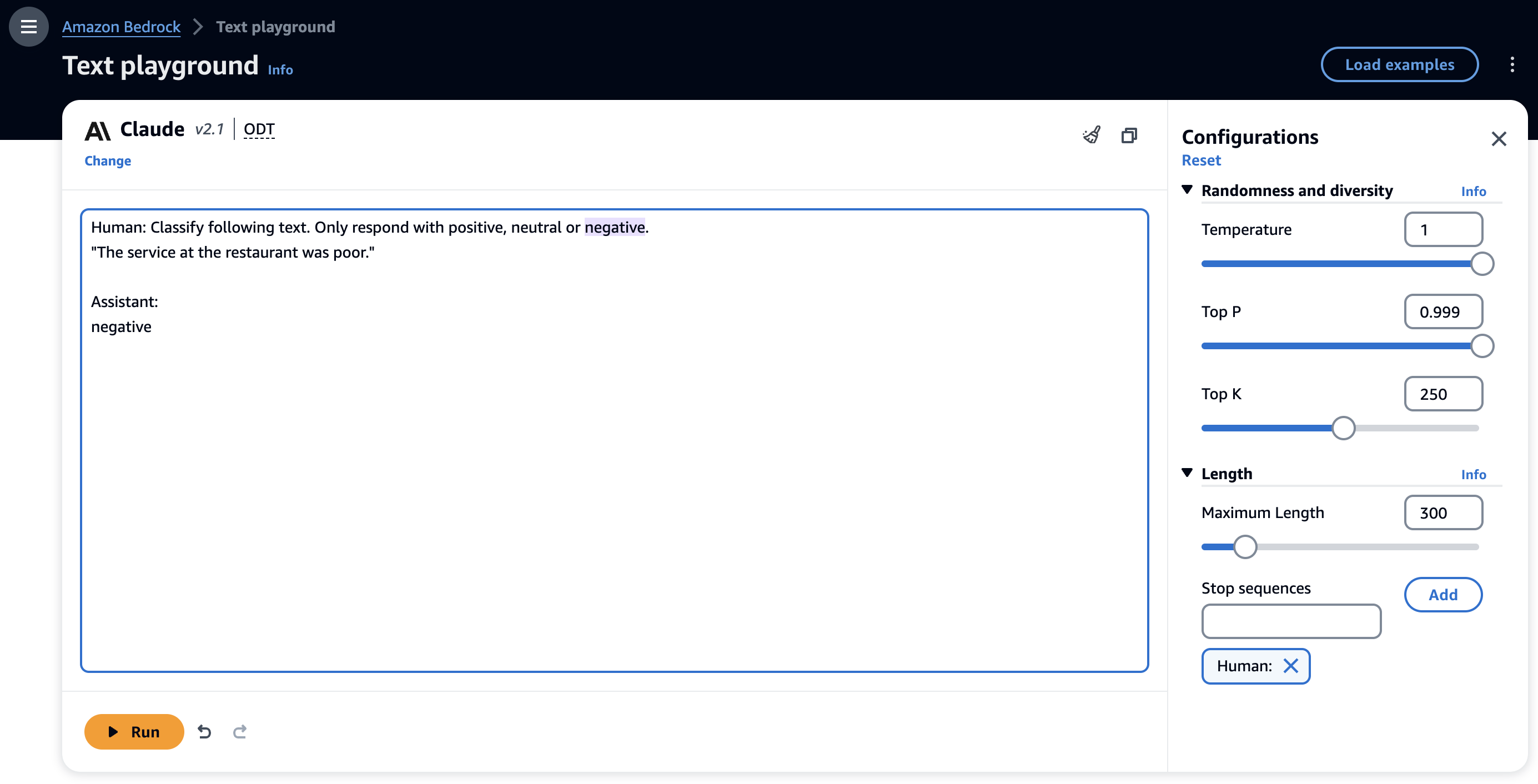

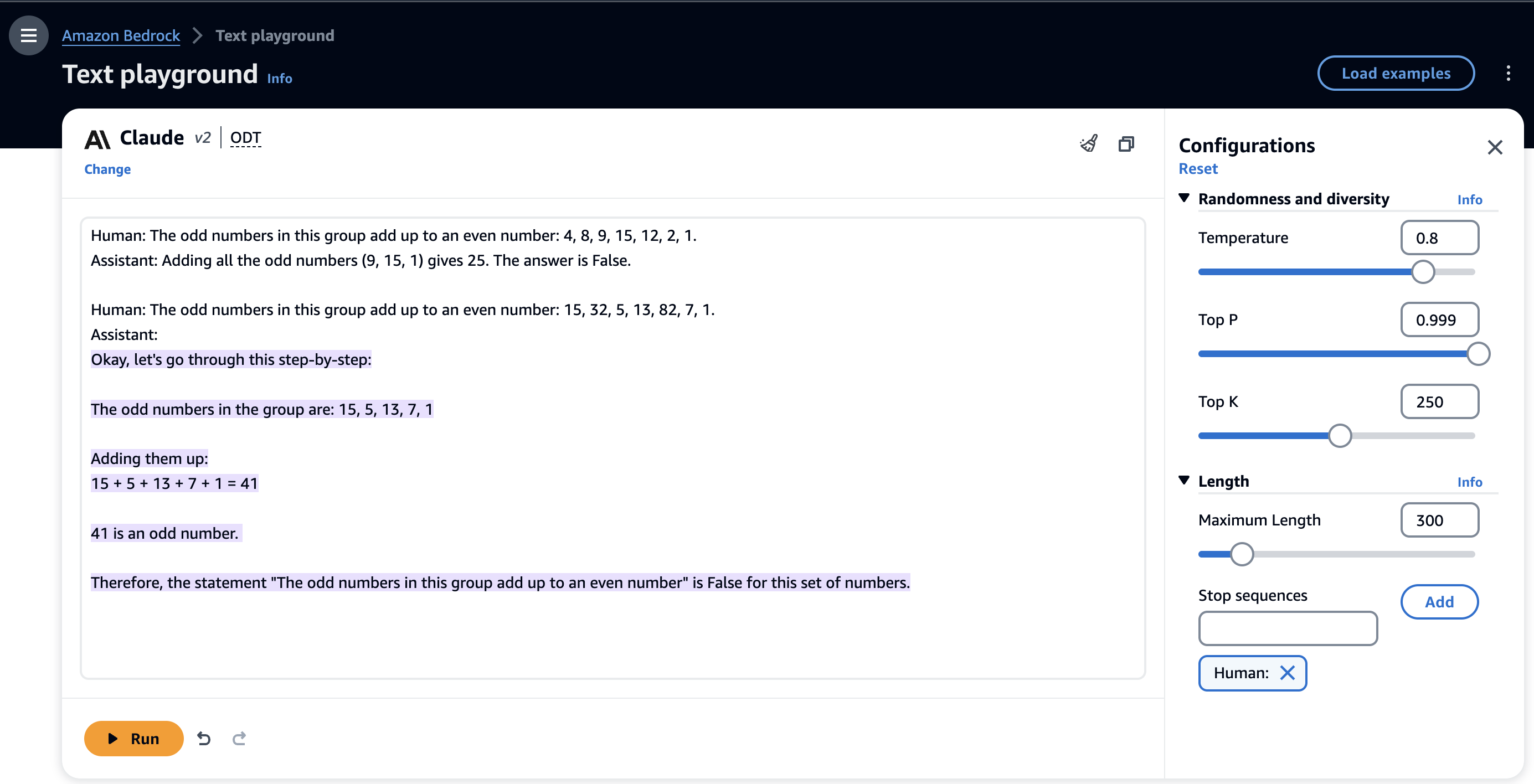

Technika podpowiedzi zero-shot wymaga od FM wygenerowania odpowiedzi bez podawania żadnych wyraźnych przykładów pożądanego zachowania, opierając się wyłącznie na wstępnym szkoleniu. Poniższy zrzut ekranu przedstawia przykład monitu o zerowym strzałie w przypadku modelu Anthropic Claude 2.1 na konsoli Amazon Bedrock.

W tych instrukcjach nie podaliśmy żadnych przykładów. Jednak model może zrozumieć zadanie i wygenerować odpowiedni wynik. Podpowiedzi zerowe to najprostsza technika podpowiedzi, od której można zacząć przy ocenie FM dla danego przypadku użycia. Jednakże, chociaż FM są niezwykłe pod względem podpowiedzi zerowych, nie zawsze mogą dawać dokładne lub pożądane wyniki w przypadku bardziej złożonych zadań. Jeżeli podpowiedzi dotyczące zerowego strzału nie są wystarczające, zaleca się podanie w podpowiedzi kilku przykładów (podpowiedzi o kilku strzałach).

Podpowiadanie o kilku strzałach

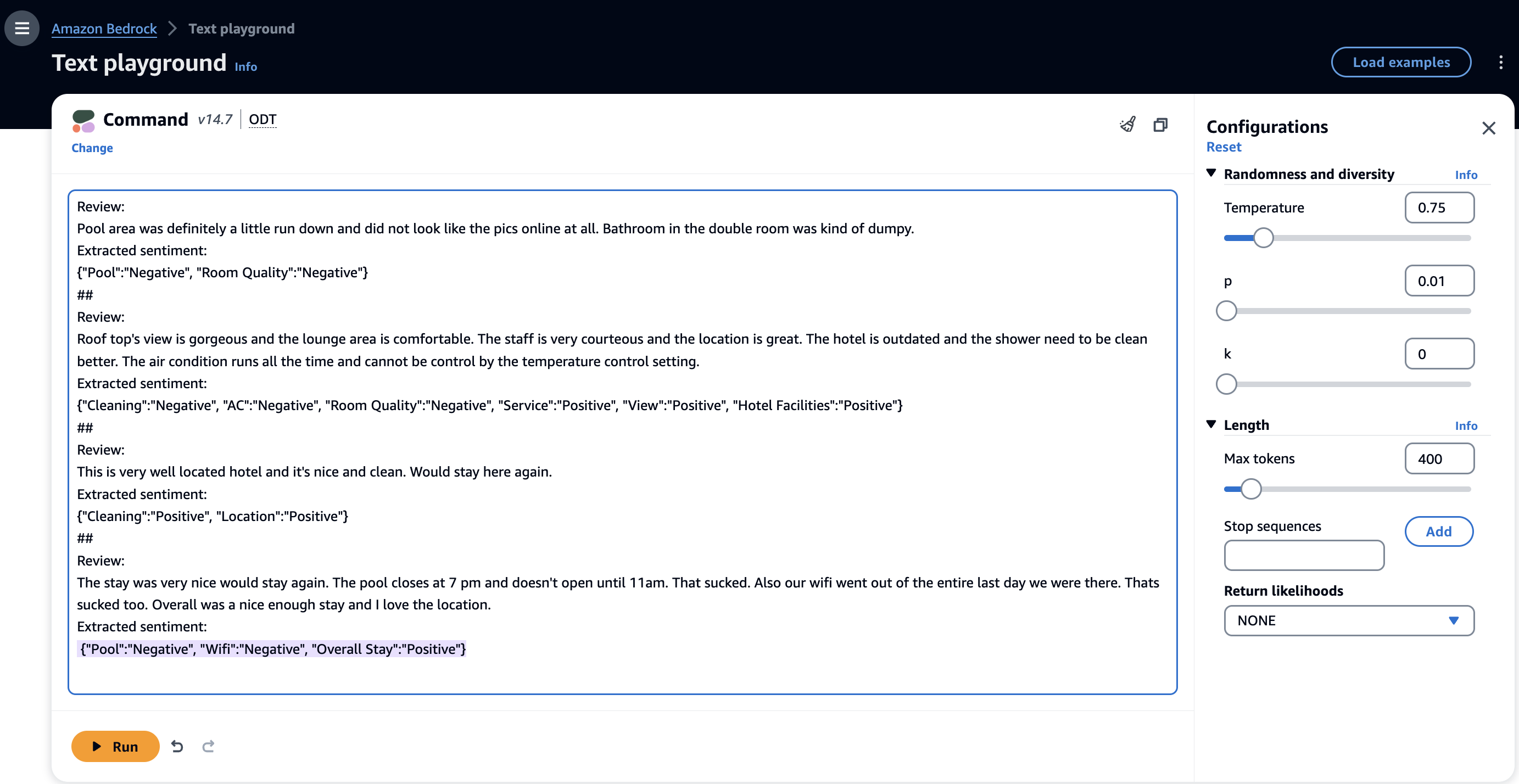

Technika podpowiedzi kilku strzałów pozwala FM na uczenie się w kontekście na podstawie przykładów zawartych w podpowiedziach i dokładniejsze wykonywanie zadania. Za pomocą zaledwie kilku przykładów możesz szybko dostosować FM do nowych zadań bez konieczności stosowania dużych zestawów szkoleniowych i poprowadzić ich w kierunku pożądanego zachowania. Poniżej znajduje się przykład monitu składającego się z kilku strzałów z modelem Cohere Command na konsoli Amazon Bedrock.

W poprzednim przykładzie FM był w stanie zidentyfikować podmioty na podstawie tekstu wejściowego (recenzji) i wyodrębnić powiązane z nimi nastroje. Podpowiedzi zawierające kilka zdań to skuteczny sposób rozwiązywania złożonych zadań poprzez podanie kilku przykładów par wejście-wyjście. W przypadku prostych zadań możesz podać jeden przykład (1 strzał), natomiast w przypadku trudniejszych zadań powinieneś podać trzy (3 strzały) do pięciu (5 strzałów) przykładów. Min i in. (2022) opublikowali ustalenia dotyczące uczenia się w kontekście, które mogą poprawić skuteczność techniki podpowiedzi opartej na kilku strzałach. Monitowania w kilku krokach można używać do różnych zadań, takich jak analiza tonacji, rozpoznawanie jednostek, odpowiadanie na pytania, tłumaczenie i generowanie kodu.

Łańcuch myśli

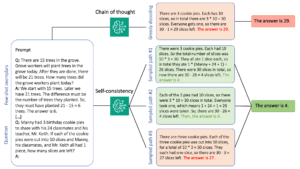

Pomimo swojego potencjału, podpowiadanie kilkoma strzałami ma ograniczenia, szczególnie w przypadku złożonych zadań rozumowania (takich jak zadania arytmetyczne lub logiczne). Zadania te wymagają podzielenia problemu na etapy, a następnie jego rozwiązania. Wei i in. (2022) wprowadził technikę podpowiadania za pomocą łańcucha myśli (CoT) w celu rozwiązywania złożonych problemów rozumowania poprzez pośrednie etapy rozumowania. Możesz połączyć CoT z monitowaniem o kilka strzałów, aby poprawić wyniki w przypadku złożonych zadań. Poniżej znajduje się przykład zadania wnioskowania z wykorzystaniem kilkukrotnego podpowiedzi CoT z modelem Anthropic Claude 2 na konsoli Amazon Bedrock.

Kojima i in. (2022) wprowadził ideę CoT zerowego strzału, wykorzystując niewykorzystane możliwości FM zerowego strzału. Ich badania wskazują, że CoT typu zero-shot, wykorzystujący ten sam szablon pojedynczego podpowiedzi, znacznie przewyższa wyniki FM typu zero-shot w różnorodnych zadaniach wnioskowania porównawczego. Monitowania o zerowej wartości CoT można używać do prostych zadań związanych z rozumowaniem, dodając „Pomyślmy krok po kroku” do oryginalnego monitu.

Reagować

Podpowiadanie CoT może zwiększyć możliwości rozumowania FM, ale nadal zależy od wewnętrznej wiedzy modelu i nie uwzględnia żadnej zewnętrznej bazy wiedzy ani środowiska w celu zebrania większej ilości informacji, co może prowadzić do problemów takich jak halucynacje. Podejście ReAct (wnioskowanie i działanie) wypełnia tę lukę, rozszerzając CoT i umożliwiając dynamiczne rozumowanie przy użyciu środowiska zewnętrznego (takiego jak Wikipedia).

Integracja

FM mają zdolność rozumienia pytań i udzielania odpowiedzi, korzystając ze swojej wcześniej przeszkolonej wiedzy. Brakuje im jednak możliwości reagowania na zapytania wymagające dostępu do prywatnych danych organizacji lub możliwości samodzielnej realizacji zadań. RAG i agenci to metody łączenia tych generatywnych aplikacji opartych na sztucznej inteligencji ze zbiorami danych przedsiębiorstwa, umożliwiając im udzielanie odpowiedzi uwzględniających informacje organizacyjne i umożliwiających uruchamianie działań na podstawie żądań.

Odzyskanie Augmented Generation

Generowanie rozszerzone pobierania (RAG) umożliwia dostosowanie odpowiedzi modelu, jeśli chcesz, aby model uwzględniał nową wiedzę lub aktualne informacje. Gdy dane często się zmieniają, np. zapasy lub ceny, dostrajanie i aktualizowanie modelu podczas obsługi zapytań użytkowników jest niepraktyczne. Aby wyposażyć FM w aktualne, zastrzeżone informacje, organizacje zwracają się do RAG – techniki polegającej na pobieraniu danych ze źródeł danych firmy i wzbogacaniu podpowiedzi tymi danymi, aby zapewnić bardziej trafne i dokładne odpowiedzi.

Istnieje kilka przypadków użycia, w których RAG może pomóc poprawić wydajność FM:

- Odpowiadanie na pytania – Modele RAG pomagają aplikacjom odpowiadającym na pytania lokalizować i integrować informacje z dokumentów lub źródeł wiedzy w celu generowania wysokiej jakości odpowiedzi. Na przykład aplikacja odpowiadająca na pytania może pobrać fragmenty na dany temat przed wygenerowaniem odpowiedzi podsumowującej.

- Chatboty i agenci konwersacyjni – RAG umożliwia chatbotom dostęp do odpowiednich informacji z dużych zewnętrznych źródeł wiedzy. Dzięki temu odpowiedzi chatbota są bardziej świadome i naturalne.

- Pomoc w pisaniu – RAG może sugerować odpowiednie treści, fakty i punkty do dyskusji, aby pomóc Ci efektywniej pisać dokumenty, takie jak artykuły, raporty i e-maile. Pozyskane informacje dostarczają użytecznego kontekstu i pomysłów.

- Podsumowanie – RAG może znaleźć odpowiednie dokumenty źródłowe, fragmenty lub fakty, aby poszerzyć zrozumienie tematu w modelu podsumowującym, umożliwiając mu generowanie lepszych podsumowań.

- Kreatywne pisanie i opowiadanie historii – RAG może wyciągać pomysły na fabułę, postacie, ustawienia i elementy kreatywne z istniejących historii, aby inspirować modele generowania historii AI. Dzięki temu wynik jest bardziej interesujący i uziemiony.

- Tłumaczenie – RAG może znaleźć przykłady tłumaczenia niektórych wyrażeń między językami. Zapewnia to kontekst modelowi tłumaczenia, poprawiając tłumaczenie niejednoznacznych zwrotów.

- Personalizacja – W chatbotach i aplikacjach rekomendacyjnych RAG może wyciągać kontekst osobisty, taki jak wcześniejsze rozmowy, informacje o profilu i preferencje, aby odpowiedzi były bardziej spersonalizowane i trafne.

Stosowanie frameworka RAG ma kilka zalet:

- Zmniejszone halucynacje – Odzyskanie odpowiednich informacji pomaga oprzeć wygenerowany tekst na faktach i wiedzy ze świata rzeczywistego, a nie na halucynacyjnym tekście. Dzięki temu odpowiedzi będą dokładniejsze, oparte na faktach i wiarygodne.

- Pokrycie – Wyszukiwanie umożliwia FM uwzględnienie szerszego zakresu tematów i scenariuszy wykraczających poza dane szkoleniowe poprzez pobieranie informacji zewnętrznych. Pomaga to rozwiązać problemy z ograniczonym zasięgiem.

- Wydajność – Wyszukiwanie pozwala modelowi skoncentrować generowanie na najbardziej istotnych informacjach, zamiast generować wszystko od zera. Poprawia to wydajność i pozwala na użycie większych kontekstów.

- Bezpieczeństwo – Pobieranie informacji z wymaganych i dozwolonych źródeł danych może poprawić zarządzanie i kontrolę nad generowaniem szkodliwych i niedokładnych treści. Wspiera to bezpieczniejszą adopcję.

- Skalowalność – Indeksowanie i wyszukiwanie z dużych korpusów umożliwia lepsze skalowanie podejścia w porównaniu z wykorzystaniem pełnego korpusu podczas generowania. Umożliwia to zastosowanie rozwiązań FM w środowiskach o bardziej ograniczonych zasobach.

RAG zapewnia wysokiej jakości wyniki dzięki rozszerzeniu kontekstu specyficznego dla przypadku użycia bezpośrednio z wektoryzowanych magazynów danych. W porównaniu z szybką inżynierią daje znacznie lepsze wyniki przy znacznie niskim ryzyku halucynacji. Możesz tworzyć aplikacje oparte na RAG na danych przedsiębiorstwa za pomocą Amazonka Kendra. RAG ma większą złożoność niż szybka inżynieria, ponieważ do wdrożenia tego rozwiązania potrzebne są umiejętności kodowania i architektury. Jednakże bazy wiedzy dla Amazon Bedrock zapewniają w pełni zarządzane środowisko RAG i najprostszy sposób na rozpoczęcie pracy z RAG w Amazon Bedrock. Bazy wiedzy dla Amazon Bedrock automatyzują kompleksowy przepływ pracy RAG, w tym pozyskiwanie, pobieranie i szybkie rozszerzanie, eliminując potrzebę pisania niestandardowego kodu w celu integracji źródeł danych i zarządzania zapytaniami. Zarządzanie kontekstem sesji jest wbudowane, dzięki czemu Twoja aplikacja może obsługiwać wielostronne rozmowy. Odpowiedzi z bazy wiedzy zawierają cytaty ze źródeł, co poprawia przejrzystość i minimalizuje halucynacje. Najprostszym sposobem na zbudowanie asystenta opartego na generatywnej sztucznej inteligencji jest użycie Amazonka Q, który posiada wbudowany system RAG.

RAG charakteryzuje się największą elastycznością w zakresie zmian w architekturze. Możesz niezależnie zmieniać model osadzania, magazyn wektorów i FM, przy minimalnym lub umiarkowanym wpływie na inne komponenty. Aby dowiedzieć się więcej o podejściu RAG z Usługa Amazon OpenSearch i Amazon Bedrock, patrz Twórz skalowalne i bezserwerowe przepływy pracy RAG za pomocą silnika wektorowego dla modeli Amazon OpenSearch Serverless i Amazon Bedrock Claude. Aby dowiedzieć się, jak wdrożyć RAG z Amazon Kendra, zobacz Wykorzystanie mocy danych przedsiębiorstwa za pomocą generatywnej sztucznej inteligencji: spostrzeżenia Amazon Kendra, LangChain i duże modele językowe.

Agenci

FM mogą rozumieć zapytania i odpowiadać na nie w oparciu o swoją wcześniej przeszkoloną wiedzę. Nie są jednak w stanie samodzielnie wykonać żadnych zadań w świecie rzeczywistym, takich jak rezerwacja lotu czy realizacja zamówienia. Dzieje się tak dlatego, że takie zadania wymagają specyficznych dla organizacji danych i przepływów pracy, które zazwyczaj wymagają niestandardowego programowania. Frameworki takie jak LangChain a niektóre FM, takie jak modele Claude, zapewniają możliwości wywoływania funkcji w celu interakcji z interfejsami API i narzędziami. Jednakże, Agenci Amazon Bedrock, nowa, w pełni zarządzana funkcja AI firmy AWS, ma na celu ułatwienie programistom tworzenia aplikacji przy użyciu FM nowej generacji. Za pomocą zaledwie kilku kliknięć może automatycznie podzielić zadania i wygenerować wymaganą logikę orkiestracji, bez konieczności ręcznego kodowania. Agenci mogą bezpiecznie łączyć się z firmowymi bazami danych za pośrednictwem interfejsów API, przyjmować i porządkować dane w celu wykorzystania ich przez maszynę oraz rozszerzać je o szczegóły kontekstowe, aby generować dokładniejsze odpowiedzi i realizować żądania. Ponieważ obsługuje integrację i infrastrukturę, Agents for Amazon Bedrock pozwala w pełni wykorzystać generatywną sztuczną inteligencję do zastosowań biznesowych. Programiści mogą teraz skupić się na swoich podstawowych zastosowaniach, a nie na rutynowej instalacji hydraulicznej. Zautomatyzowane przetwarzanie danych i wywoływanie API umożliwia także FM dostarczanie aktualnych, dostosowanych do indywidualnych potrzeb odpowiedzi i wykonywanie rzeczywistych zadań przy wykorzystaniu zastrzeżonej wiedzy.

Dostosowanie modelu

Modele podstawowe są niezwykle wydajne i umożliwiają kilka świetnych aplikacji, ale w prowadzeniu Twojej firmy pomoże generatywna sztuczna inteligencja, która wie, co jest ważne dla Twoich klientów, Twoich produktów i Twojej firmy. Jest to możliwe tylko wtedy, gdy doładujesz modele swoimi danymi. Dane są kluczem do przejścia od aplikacji ogólnych do niestandardowych, generatywnych aplikacji AI, które tworzą rzeczywistą wartość dla Twoich klientów i Twojej firmy.

W tej sekcji omawiamy różne techniki i zalety dostosowywania FM. Omawiamy, w jaki sposób dostosowywanie modelu obejmuje dalsze szkolenie i zmianę ciężarów modelu w celu zwiększenia jego wydajności.

Strojenie

Dostrajanie to proces wykorzystania wstępnie wyszkolonego FM, takiego jak Lama 2, i dalszego szkolenia go w zakresie dalszego zadania z wykorzystaniem zestawu danych specyficznego dla tego zadania. Wstępnie wyszkolony model zapewnia ogólną wiedzę językową, a dostrajanie pozwala mu specjalizować się i poprawiać wydajność w przypadku konkretnego zadania, takiego jak klasyfikacja tekstu, odpowiadanie na pytania lub generowanie tekstu. Dzięki dostrajaniu udostępniasz oznaczone zestawy danych — z adnotacjami z dodatkowym kontekstem — w celu uczenia modelu w zakresie określonych zadań. Następnie możesz dostosować parametry modelu do konkretnego zadania w oparciu o kontekst biznesowy.

Możesz wdrożyć dostrajanie na FM za pomocą Amazon SageMaker JumpStart i Amazonka Bedrock. Więcej szczegółów znajdziesz w Wdrażaj i dostosowuj podstawowe modele w Amazon SageMaker JumpStart za pomocą dwóch linii kodu i Dostosuj modele w Amazon Bedrock przy użyciu własnych danych, korzystając z dostrajania i ciągłego szkolenia wstępnego.

Kontynuacja szkolenia wstępnego

Ciągłe szkolenie wstępne w Amazon Bedrock umożliwia uczenie wcześniej wytrenowanego modelu na dodatkowych danych podobnych do jego oryginalnych danych. Umożliwia modelowi zdobycie bardziej ogólnej wiedzy językowej, zamiast skupiania się na pojedynczej aplikacji. Dzięki ciągłemu szkoleniu wstępnemu możesz używać nieoznakowanych zbiorów danych lub surowych danych, aby poprawić dokładność podstawowego modelu domeny poprzez poprawianie parametrów modelu. Na przykład firma z branży opieki zdrowotnej może w dalszym ciągu wstępnie szkolić swój model, korzystając z czasopism medycznych, artykułów i prac badawczych, aby zwiększyć wiedzę na temat terminologii branżowej. Więcej szczegółów znajdziesz w Doświadczenie programisty Amazon Bedrock.

Korzyści z dostosowywania modelu

Dostosowywanie modelu ma kilka zalet i może pomóc organizacjom w następujących kwestiach:

- Adaptacja specyficzna dla domeny – Możesz użyć FM ogólnego przeznaczenia, a następnie dalej go trenować na danych z określonej domeny (takiej jak biomedyczna, prawna lub finansowa). Spowoduje to dostosowanie modelu do słownictwa, stylu i tak dalej domeny.

- Dopasowanie specyficzne dla zadania – Możesz skorzystać z wstępnie przeszkolonego FM i dostroić go na podstawie danych do konkretnego zadania (takiego jak analiza nastrojów lub odpowiadanie na pytania). Specjalizuje model dla tego konkretnego zadania.

- Personalizacja – Możesz dostosować FM na podstawie danych danej osoby (e-maili, SMS-ów, napisanych przez nią dokumentów), aby dostosować model do jej unikalnego stylu. Może to umożliwić bardziej spersonalizowane aplikacje.

- Dostrajanie języka przy niskich zasobach – Możesz przeszkolić tylko górne warstwy wielojęzycznego FM w języku o niskich zasobach, aby lepiej dostosować go do tego języka.

- Naprawianie wad – Jeśli w modelu zostaną wykryte pewne niezamierzone zachowania, dostosowanie odpowiednich danych może pomóc w aktualizacji modelu w celu ograniczenia tych wad.

Dostosowywanie modelu pomaga pokonać następujące wyzwania związane z przyjęciem FM:

- Adaptacja do nowych dziedzin i zadań – FM przeszkoleni w zakresie ogólnych korpusów tekstowych często muszą zostać dostrojeni w oparciu o dane specyficzne dla zadania, aby dobrze działały w dalszych zastosowaniach. Dostrajanie dostosowuje model do nowych dziedzin lub zadań, w zakresie których nie był pierwotnie szkolony.

- Przezwyciężenie uprzedzeń – FM mogą wykazywać błędy w stosunku do oryginalnych danych treningowych. Dostosowywanie modelu na podstawie nowych danych może zmniejszyć niepożądane odchylenia w wynikach modelu.

- Poprawa wydajności obliczeniowej – Wstępnie wyszkolone FM są często bardzo duże i kosztowne obliczeniowo. Dostosowywanie modelu może pozwolić na zmniejszenie rozmiaru modelu poprzez usunięcie nieistotnych parametrów, dzięki czemu wdrożenie stanie się bardziej wykonalne.

- Radzenie sobie z ograniczonymi danymi docelowymi – W niektórych przypadkach dostępne są ograniczone dane rzeczywiste dotyczące docelowego zadania. Dostosowywanie modelu wykorzystuje wstępnie wyszkolone wagi wyuczone na większych zbiorach danych, aby przezwyciężyć ten niedobór danych.

- Poprawa wydajności zadań – Dostrajanie prawie zawsze poprawia wydajność docelowych zadań w porównaniu z użyciem oryginalnych, wstępnie wytrenowanych ciężarków. Ta optymalizacja modelu pod kątem jego zamierzonego zastosowania pozwala z powodzeniem wdrożyć FM w rzeczywistych zastosowaniach.

Dostosowywanie modelu jest bardziej złożone niż szybka inżynieria i RAG, ponieważ waga i parametry modelu są zmieniane za pomocą skryptów dostrajających, co wymaga wiedzy z zakresu analityki danych i uczenia maszynowego. Jednak Amazon Bedrock ułatwia to, zapewniając zarządzane środowisko umożliwiające dostosowywanie modeli strojenie or kontynuacja treningu przedtreningowego. Dostosowywanie modelu zapewnia bardzo dokładne wyniki i jakość porównywalną z RAG. Ponieważ aktualizujesz wagi modelu na danych specyficznych dla domeny, model generuje więcej odpowiedzi kontekstowych. W porównaniu do RAG jakość może być nieznacznie lepsza w zależności od przypadku użycia. Dlatego ważne jest przeprowadzenie analizy kompromisu pomiędzy obiema technikami. Potencjalnie możesz wdrożyć RAG z niestandardowym modelem.

Przekwalifikowanie lub szkolenie od zera

Budowanie własnego podstawowego modelu sztucznej inteligencji zamiast wyłącznie korzystania ze wstępnie wyszkolonych modeli publicznych pozwala na większą kontrolę, lepszą wydajność i dostosowanie do konkretnych przypadków użycia i danych Twojej organizacji. Inwestycja w stworzenie dostosowanego FM może zapewnić lepszą adaptację, ulepszenia i kontrolę nad możliwościami. Uczenie rozproszone zapewnia skalowalność potrzebną do uczenia bardzo dużych FM na ogromnych zbiorach danych na wielu maszynach. Ta równoległość sprawia, że modele z setkami miliardów parametrów wyszkolonych na bilionach tokenów są wykonalne. Większe modele mają większą zdolność uczenia się i uogólniania.

Trenowanie od zera może dawać wyniki wysokiej jakości, ponieważ model trenuje od podstaw na danych specyficznych dla konkretnego przypadku użycia, ryzyko wystąpienia halucynacji jest rzadkie, a dokładność wyników może być jedną z najwyższych. Jeśli jednak Twój zbiór danych stale się rozwija, nadal możesz napotkać problemy z halucynacjami. Szkolenie od podstaw charakteryzuje się największą złożonością i kosztem wdrożenia. Wymaga najwięcej wysiłku, ponieważ wymaga gromadzenia ogromnej ilości danych, ich selekcji i przetwarzania oraz szkolenia dość dużego FM, co wymaga głębokiej analizy danych i wiedzy specjalistycznej w zakresie uczenia maszynowego. Takie podejście jest czasochłonne (zwykle może zająć tygodnie lub miesiące).

Powinieneś rozważyć przeszkolenie FM od zera, jeśli żadne inne podejście nie jest dla Ciebie odpowiednie i masz możliwość zbudowania FM z dużą ilością dobrze dobranych tokenizowanych danych, wyrafinowanym budżetem i zespołem wysoko wykwalifikowanych ekspertów ML . AWS zapewnia najbardziej zaawansowaną infrastrukturę chmurową do szkolenia i uruchamiania LLM i innych FM zasilanych procesorami graficznymi i specjalnie zaprojektowanym chipem szkoleniowym ML, Szkolenie AWSi akcelerator wnioskowania ML, Inferencja AWS. Aby uzyskać więcej informacji na temat szkolenia LLM w SageMaker, zobacz Szkolenie dużych modeli językowych w Amazon SageMaker: najlepsze praktyki i HyperPod SageMakera.

Wybór odpowiedniego podejścia do tworzenia generatywnych aplikacji AI

Tworząc generatywne aplikacje AI, organizacje muszą dokładnie rozważyć kilka kluczowych czynników, zanim wybiorą model najbardziej odpowiedni do swoich potrzeb. Należy wziąć pod uwagę różne aspekty, takie jak koszt (w celu zapewnienia zgodności wybranego modelu z ograniczeniami budżetowymi), jakość (w celu dostarczenia spójnych i zgodnych z faktami wyników), bezproblemową integrację z obecnymi platformami i przepływami pracy dla przedsiębiorstw oraz ograniczenie halucynacji lub generowania fałszywych informacji . Dostępnych jest wiele opcji. Poświęcenie czasu na dokładną ocenę tych aspektów pomoże organizacjom wybrać generatywny model sztucznej inteligencji, który najlepiej odpowiada ich konkretnym wymaganiom i priorytetom. Należy dokładnie sprawdzić następujące czynniki:

- Integracja z systemami korporacyjnymi – Aby FM były naprawdę przydatne w kontekście przedsiębiorstwa, muszą integrować się i współpracować z istniejącymi systemami biznesowymi i przepływami pracy. Może to obejmować dostęp do danych z baz danych, planowanie zasobów przedsiębiorstwa (ERP) i zarządzanie relacjami z klientami (CRM), a także uruchamianie działań i przepływów pracy. Bez odpowiedniej integracji istnieje ryzyko, że FM stanie się narzędziem izolowanym. Systemy korporacyjne, takie jak ERP, zawierają kluczowe dane biznesowe (klienci, produkty, zamówienia). FM musi być podłączony do tych systemów, aby móc korzystać z danych przedsiębiorstwa, zamiast opracowywać własny wykres wiedzy, który może być niedokładny lub nieaktualny. Zapewnia to dokładność i jedno źródło prawdy.

- Halucynacje – Halucynacje mają miejsce, gdy aplikacja AI generuje fałszywe informacje, które wydają się oparte na faktach. Należy się nimi dokładnie zająć, zanim FM zostaną powszechnie przyjęte. Na przykład chatbot medyczny zaprojektowany w celu przedstawiania sugestii diagnostycznych może wywoływać halucynacje dotyczące szczegółów objawów lub historii choroby pacjenta, co może prowadzić do zaproponowania niedokładnej diagnozy. Zapobieganie takim szkodliwym halucynacjom poprzez rozwiązania techniczne i selekcję zbiorów danych będzie miało kluczowe znaczenie, aby zapewnić niezawodność tych FM w przypadku wrażliwych zastosowań, takich jak opieka zdrowotna, finanse i prawo. Wdrożeniom będą musiały towarzyszyć dokładne testy i przejrzystość danych szkoleniowych FM oraz pozostałych usterek.

- Umiejętności i zasoby – Pomyślne przyjęcie FM będzie w dużej mierze zależeć od posiadania odpowiednich umiejętności i zasobów, aby skutecznie korzystać z tej technologii. Organizacje potrzebują pracowników o dużych umiejętnościach technicznych, aby prawidłowo wdrażać, dostosowywać i utrzymywać FM w celu dostosowania do ich specyficznych potrzeb. Do obsługi złożonych FM wymagają także dużych zasobów obliczeniowych, takich jak zaawansowany sprzęt i możliwości przetwarzania w chmurze. Na przykład zespół marketingowy, który chce wykorzystać FM do generowania tekstów reklamowych i postów w mediach społecznościowych, potrzebuje wykwalifikowanych inżynierów do integracji systemu, twórców, którzy będą wyświetlać podpowiedzi i oceniać jakość wyników, a także wystarczającej mocy obliczeniowej w chmurze, aby wdrożyć model w sposób opłacalny. Inwestowanie w rozwój wiedzy specjalistycznej i infrastruktury technicznej umożliwi organizacjom uzyskanie realnej wartości biznesowej z zastosowania FM.

- Jakość wyjściowa – Jakość wyników wytwarzanych przez FM będzie miała kluczowe znaczenie przy określaniu ich przyjęcia i wykorzystania, szczególnie w aplikacjach skierowanych do konsumentów, takich jak chatboty. Jeśli chatboty zasilane przez FM będą udzielać odpowiedzi, które są niedokładne, nonsensowne lub niewłaściwe, użytkownicy szybko popadną w frustrację i przestaną się z nimi kontaktować. Dlatego firmy chcące wdrożyć chatboty muszą rygorystycznie przetestować FM, które nimi sterują, aby mieć pewność, że konsekwentnie generują wysokiej jakości odpowiedzi, które są pomocne, istotne i odpowiednie do zapewnienia dobrego doświadczenia użytkownika. Jakość wyników obejmuje czynniki takie jak trafność, dokładność, spójność i stosowność, które wszystkie przyczyniają się do ogólnej satysfakcji użytkownika i decydują o przyjęciu FM, takich jak te używane w chatbotach, lub przerwaniu ich stosowania.

- Koszty: – Wysoka moc obliczeniowa wymagana do szkolenia i obsługi dużych modeli sztucznej inteligencji, takich jak FM, może wiązać się ze znacznymi kosztami. Wielu organizacjom może brakować zasobów finansowych lub infrastruktury chmurowej niezbędnej do korzystania z tak masowych modeli. Dodatkowo integracja i dostosowywanie FM do konkretnych przypadków użycia zwiększa koszty inżynieryjne. Znaczne wydatki wymagane do korzystania z FM mogą zniechęcić do powszechnego przyjęcia, szczególnie wśród mniejszych firm i startupów o ograniczonych budżetach. Ocena potencjalnego zwrotu z inwestycji i porównanie kosztów i korzyści FM ma kluczowe znaczenie dla organizacji rozważających ich zastosowanie i użyteczność. Opłacalność będzie prawdopodobnie decydującym czynnikiem przy ustalaniu, czy i w jaki sposób można zastosować te potężne, ale wymagające dużych zasobów modele.

Decyzja projektowa

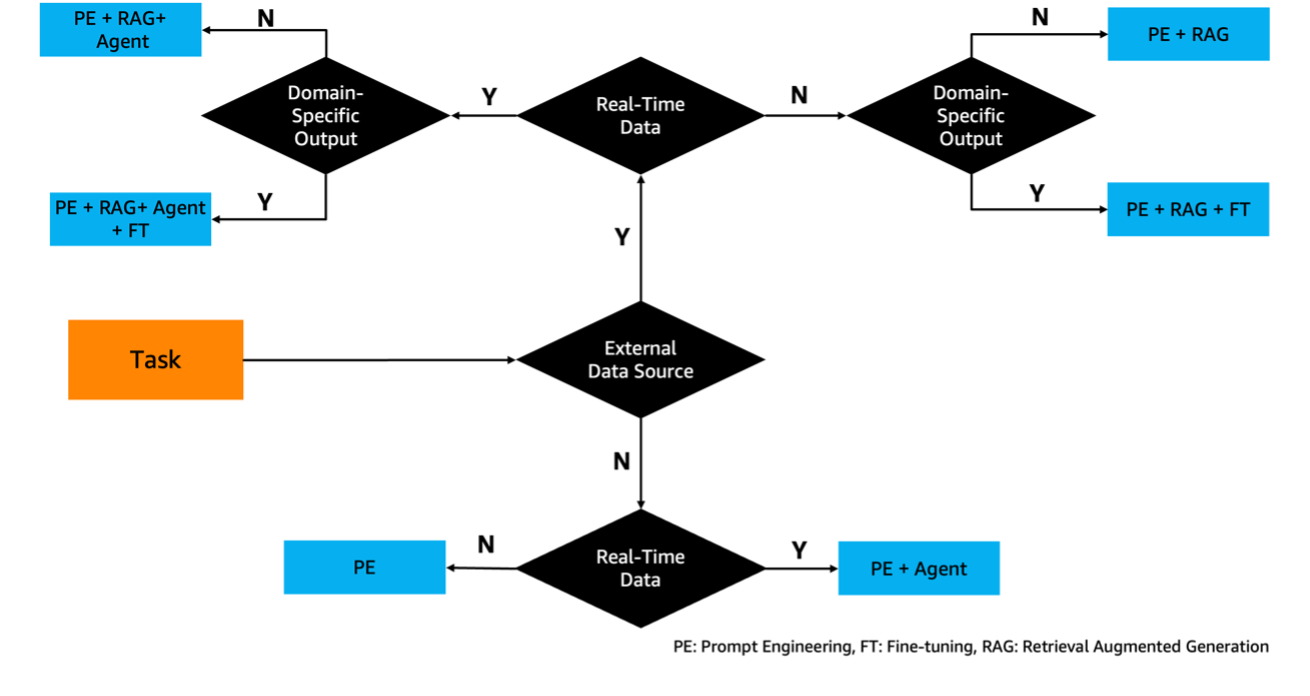

Jak pisaliśmy w tym poście, obecnie dostępnych jest wiele różnych technik sztucznej inteligencji, takich jak szybka inżynieria, RAG i dostosowywanie modelu. Tak szeroki zakres możliwości wyboru sprawia, że firmom trudno jest określić optymalne podejście do konkretnego przypadku użycia. Wybór odpowiedniego zestawu technik zależy od różnych czynników, w tym dostępu do zewnętrznych źródeł danych, źródeł danych w czasie rzeczywistym i specyfiki domeny zamierzonej aplikacji. Aby pomóc w określeniu najodpowiedniejszej techniki na podstawie przypadku użycia i związanych z tym rozważań, przeanalizujemy poniższy schemat blokowy, który przedstawia zalecenia dotyczące dopasowania konkretnych potrzeb i ograniczeń do odpowiednich metod.

Aby uzyskać jasne zrozumienie, przejrzyjmy schemat podejmowania decyzji projektowych, korzystając z kilku ilustrujących przykładów:

- Wyszukiwanie korporacyjne – Pracownik chce wystąpić o urlop do swojej organizacji. Aby zapewnić reakcję zgodną z polityką HR organizacji, FM potrzebuje szerszego kontekstu wykraczającego poza jego własną wiedzę i możliwości. W szczególności FM wymaga dostępu do zewnętrznych źródeł danych, które zapewniają odpowiednie wytyczne i zasady HR. Biorąc pod uwagę ten scenariusz żądania pracownika, który wymaga odniesienia się do zewnętrznych danych specyficznych dla domeny, zalecanym podejściem zgodnie ze schematem blokowym jest szybka inżynieria z RAG. RAG pomoże w dostarczeniu odpowiednich danych z zewnętrznych źródeł danych jako kontekstu dla FM.

- Wyszukiwanie korporacyjne z wynikami specyficznymi dla organizacji – Załóżmy, że masz rysunki techniczne i chcesz wyodrębnić z nich zestawienie komponentów, formatując dane wyjściowe zgodnie ze standardami branżowymi. Aby to zrobić, możesz zastosować technikę, która łączy szybką inżynierię z RAG i precyzyjnie dostrojonym modelem językowym. Dopracowany model zostałby przeszkolony do tworzenia zestawień materiałowych na podstawie rysunków technicznych jako danych wejściowych. RAG pomaga znaleźć najbardziej odpowiednie rysunki techniczne ze źródeł danych organizacji, które można wykorzystać w kontekście FM. Ogólnie rzecz biorąc, podejście to polega na wyodrębnieniu zestawień materiałowych z rysunków technicznych i ustrukturyzowaniu wyników odpowiednio dla dziedziny inżynierii.

- Wyszukiwanie ogólne – Wyobraź sobie, że chcesz poznać tożsamość 30. Prezydenta Stanów Zjednoczonych. Możesz użyć szybkiej inżynierii, aby uzyskać odpowiedź od FM. Ponieważ modele te są szkolone na wielu źródłach danych, często mogą zapewnić dokładne odpowiedzi na pytania oparte na faktach, takie jak to.

- Wyszukiwanie ogólne z ostatnimi wydarzeniami – Jeśli chcesz ustalić aktualną cenę akcji Amazona, możesz skorzystać z metody szybkiej inżynierii z agentem. Agent przekaże FM najnowszą cenę akcji, aby mógł wygenerować opartą na faktach odpowiedź.

Wnioski

Generatywna sztuczna inteligencja oferuje organizacjom ogromny potencjał w zakresie stymulowania innowacji i zwiększania produktywności w różnych zastosowaniach. Jednak pomyślne wdrożenie tych nowych technologii sztucznej inteligencji wymaga uwzględnienia kluczowych kwestii związanych z integracją, jakością wyników, umiejętnościami, kosztami i potencjalnymi zagrożeniami, takimi jak szkodliwe halucynacje lub luki w zabezpieczeniach. Organizacje muszą przyjąć systematyczne podejście do oceny wymagań i ograniczeń dotyczących przypadków użycia, aby określić najbardziej odpowiednie techniki adaptacji i stosowania FM. Jak podkreślono w tym poście, szybkie prace inżynieryjne, RAG i efektywne metody dostosowywania modelu mają swoje mocne i słabe strony, które pasują do różnych scenariuszy. Mapując potrzeby biznesowe na możliwości sztucznej inteligencji za pomocą ustrukturyzowanej struktury, organizacje mogą pokonać przeszkody we wdrażaniu i zacząć czerpać korzyści z FM, jednocześnie budując bariery zabezpieczające w celu zarządzania ryzykiem. Dzięki przemyślanemu planowaniu opartemu na przykładach z życia codziennego firmy z każdej branży mogą odblokować ogromną wartość dzięki nowej fali generatywnej sztucznej inteligencji. Uczyć się o generatywne AI na AWS.

O autorach

Jay'a Rao jest głównym architektem rozwiązań w AWS. Koncentruje się na technologiach AI/ML, szczególnie interesuje się generatywną sztuczną inteligencją i wizją komputerową. W AWS lubi udzielać klientom wskazówek technicznych i strategicznych oraz pomagać im projektować i wdrażać rozwiązania, które wpływają na wyniki biznesowe. Jest autorem książki (Computer Vision on AWS), regularnie publikuje blogi i próbki kodu oraz wygłasza prelekcje na konferencjach technologicznych, takich jak AWS re:Invent.

Jay'a Rao jest głównym architektem rozwiązań w AWS. Koncentruje się na technologiach AI/ML, szczególnie interesuje się generatywną sztuczną inteligencją i wizją komputerową. W AWS lubi udzielać klientom wskazówek technicznych i strategicznych oraz pomagać im projektować i wdrażać rozwiązania, które wpływają na wyniki biznesowe. Jest autorem książki (Computer Vision on AWS), regularnie publikuje blogi i próbki kodu oraz wygłasza prelekcje na konferencjach technologicznych, takich jak AWS re:Invent.

Babu Kariyaden Parambath jest starszym specjalistą AI/ML w AWS. W AWS lubi pracować z klientami, pomagając im zidentyfikować właściwy biznesowy przypadek użycia mający wartość biznesową i rozwiązać go za pomocą rozwiązań i usług AWS AI/ML. Przed dołączeniem do AWS Babu był ewangelistą AI z 20-letnim zróżnicowanym doświadczeniem branżowym w dostarczaniu klientom wartości biznesowej opartej na sztucznej inteligencji.

Babu Kariyaden Parambath jest starszym specjalistą AI/ML w AWS. W AWS lubi pracować z klientami, pomagając im zidentyfikować właściwy biznesowy przypadek użycia mający wartość biznesową i rozwiązać go za pomocą rozwiązań i usług AWS AI/ML. Przed dołączeniem do AWS Babu był ewangelistą AI z 20-letnim zróżnicowanym doświadczeniem branżowym w dostarczaniu klientom wartości biznesowej opartej na sztucznej inteligencji.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/best-practices-to-build-generative-ai-applications-on-aws/

- :ma

- :Jest

- :nie

- :Gdzie

- 1

- 100

- 116

- 20

- 20 roku

- 2017

- 2022

- 30

- 7

- a

- zdolność

- Zdolny

- O nas

- akcelerator

- dostęp

- Dostęp

- towarzyszyć

- Stosownie

- Konto

- precyzja

- dokładny

- dokładnie

- Osiągać

- w poprzek

- gra aktorska

- działania

- rzeczywisty

- przystosować

- adaptacja

- adaptacja

- dostosowuje się

- dodanie

- Dodatkowy

- do tego

- adres

- zaadresowany

- Adresy

- adresowanie

- Dodaje

- odpowiednio

- przyjąć

- przyjęty

- Przyjęcie

- Przyjęcie

- zaawansowany

- postęp

- Zalety

- Reklama

- Agent

- agentów

- AI

- Modele AI

- ai badania

- Zasilany AI

- AI / ML

- AID

- Cele

- AL

- wyrównać

- wyrównany

- Wyrównuje

- Wszystkie kategorie

- dopuszczać

- Pozwalać

- pozwala

- prawie

- sam

- również

- Chociaż

- zawsze

- Amazonka

- Amazonka Kendra

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- wśród

- wśród

- ilość

- an

- analiza

- i

- i infrastruktura

- odpowiedź

- sekretarka

- odpowiedzi

- Antropiczny

- każdy

- api

- Pszczoła

- Aplikacja

- pojawia się

- Zastosowanie

- aplikacje

- Stosowanie

- podejście

- awanse

- właściwy

- odpowiednio

- architektura

- SĄ

- powstać

- na około

- towary

- AS

- aspekty

- oszacować

- Asystent

- powiązany

- At

- zwiększać

- zwiększona

- autor

- zautomatyzowane

- automaty

- automatycznie

- autonomicznie

- dostępny

- AWS

- AWS re: Invent

- baza

- na podstawie

- BE

- bo

- stają się

- zanim

- rozpocząć

- zachowanie

- zachowania

- jest

- Benchmark

- Korzyści

- BEST

- Najlepsze praktyki

- Ulepsz Swój

- pomiędzy

- Poza

- uprzedzenia

- Rachunek

- miliardy

- Banknoty

- biomedyczny

- blogi

- książka

- Rezerwacja

- podnieść

- obie

- marka

- przerwa

- Przełamując

- przerwy

- szeroki

- szerszy

- budżet

- Budżety

- budować

- Budowanie

- wybudowany

- wbudowany

- biznes

- biznes

- ale

- by

- powołanie

- CAN

- Może uzyskać

- możliwości

- zdolność

- zdolny

- Pojemność

- ostrożnie

- nieść

- walizka

- Etui

- pewien

- wyzwanie

- wyzwania

- wyzwanie

- duża szansa,

- zmiana

- zmieniony

- Zmiany

- wymiana pieniędzy

- znaków

- Wykres

- chatbot

- nasze chatboty

- żeton

- wybór

- wybory

- Dodaj

- klasyfikacja

- Sprzątanie

- jasny

- dokładnie

- Chmura

- cloud computing

- infrastruktura chmurowa

- kod

- Kodowanie

- ZGODNY

- Zbieranie

- połączyć

- kombajny

- jak

- byliśmy spójni, od początku

- wspólny

- Firmy

- sukcesy firma

- Firma

- porównywalny

- w porównaniu

- kompletny

- kompleks

- kompleksowość

- spełnienie

- składniki

- zrozumieć

- obliczeniowy

- moc obliczeniowa

- obliczeniowo

- obliczać

- komputer

- Wizja komputerowa

- computing

- moc obliczeniowa

- Prowadzenie

- konferencje

- Skontaktuj się

- połączony

- Łączność

- Rozważać

- znaczny

- Rozważania

- za

- wobec

- konsekwentnie

- Konsola

- stale

- Ograniczenia

- konsumpcja

- zawierać

- zawartość

- Generowanie treści

- kontekst

- konteksty

- kontekstowy

- kontynuować

- nadal

- przyczynić się

- kontrola

- konwersacyjny

- rozmowy

- kopia

- rdzeń

- Koszty:

- Koszty:

- mógłby

- pokrywa

- pokrycie

- pokryty

- Stwórz

- Tworzenie

- Twórczy

- kreacje

- krytyczny

- CRM

- istotny

- kurator

- kuracja

- Aktualny

- Obecnie

- zwyczaj

- klient

- doświadczenie klienta

- Klientów

- dostosowywanie

- dostosować

- dostosowane

- dane

- prywatność danych

- Prywatność i bezpieczeństwo danych

- analiza danych

- nauka danych

- Bazy danych

- zbiory danych

- czynienia

- Decydowanie

- decyzja

- głęboko

- Stopień

- dostarczyć

- dostarczona

- dostarczanie

- Kreowanie

- wykazać

- zależeć

- W zależności

- zależy

- rozwijać

- wdrażane

- Wdrożenie

- wdrożenia

- Wnętrze

- zaprojektowany

- projektowanie

- życzenia

- detale

- Ustalać

- określaniu

- rozwijać

- Deweloper

- deweloperzy

- rozwijanie

- oprogramowania

- diagnoza

- różne

- trudny

- bezpośrednio

- odkryty

- dyskutować

- dystrybuowane

- szkolenia rozproszone

- inny

- do

- dokumenty

- Nie

- dolarów

- domena

- domeny

- na dół

- Rysunki

- napęd

- napędzany

- z powodu

- podczas

- dynamiczny

- E i T

- każdy

- z łatwością

- Efektywne

- faktycznie

- efektywność

- wydajny

- skutecznie

- wysiłek

- Elementy

- kwalifikowalne

- eliminując

- e-maile

- osadzanie

- powstanie

- wschodzących

- Pracownik

- pracowników

- uprawniającej

- umożliwiać

- Umożliwia

- umożliwiając

- obejmuje

- Szyfrowanie

- szyfrowane

- zakończenia

- koniec końców

- ujmujący

- silnik

- Inżynieria

- Inżynierowie

- wzmacniać

- wzbogacanie

- zapewnić

- zapewnia

- zapewnienie

- Enterprise

- podmioty

- jednostka

- Środowisko

- środowiska

- wyposażyć

- ERP

- szczególnie

- zapewniają

- oceniać

- oceny

- Ewangelista

- Każdy

- wszystko

- ewoluuje

- zbadać

- przykład

- przykłady

- ekscytujący

- pokazać

- Przede wszystkim system został opracowany

- wydatki

- drogi

- doświadczenie

- eksperymenty

- ekspert

- ekspertyza

- eksperci

- odkryj

- rozsuwalny

- zewnętrzny

- wyciąg

- Wyciągi

- niezwykle

- Twarz

- czynnik

- Czynniki

- fakty

- FAIL

- dość

- Spadać

- fałszywy

- wykonalny

- kilka

- finansować

- budżetowy

- Znajdź

- Ustalenia

- pięć

- Skazy

- Elastyczność

- lot

- pływ

- Skupiać

- koncentruje

- następujący

- W razie zamówieenia projektu

- Fundacja

- podstawowy

- Framework

- Ramy

- często

- od

- udaremniony

- Spełnić

- pełny

- w pełni

- dalej

- Wzrost

- szczelina

- zbierać

- `RODO

- Ogólne

- ogólny cel

- Generować

- wygenerowane

- generuje

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- Dać

- dany

- Go

- dobry

- zarządzanie

- GPU

- wykres

- wspaniały

- większy

- Ziemia

- uziemiony

- poradnictwo

- poprowadzi

- wytyczne

- Uchwyty

- sprzęt komputerowy

- szkodliwy

- uprząż

- Have

- mający

- he

- opieki zdrowotnej

- ciężko

- pomoc

- pomocny

- pomoc

- pomaga

- Wysoki

- wydajny

- wysokiej jakości

- wyższy

- Najwyższa

- najwyższy stopień

- Podświetlony

- wysoko

- historia

- W jaki sposób

- How To

- Jednak

- hr

- HTML

- HTTPS

- Piasta

- Setki

- Przeszkody

- Dostrajanie hiperparametrów

- pomysł

- pomysły

- zidentyfikować

- identyfikacja

- tożsamość

- if

- obraz

- ogromny

- Rezultat

- wpływowy

- Oddziaływania

- wdrożenia

- realizacja

- ważny

- podnieść

- ulepszony

- poprawia

- poprawy

- in

- niedokładny

- Włącznie z

- niezależnie

- wskazuje

- przemysł

- standardy przemysłowe

- Informacja

- Infrastruktura

- Innowacja

- innowacje

- wkład

- spostrzeżenia

- inspirować

- Instytut

- instrukcje

- integrować

- Integracja

- integracja

- zamierzony

- interakcji

- odsetki

- ciekawy

- Interfejs

- wewnętrzny

- Internet

- współdziałać

- najnowszych

- wprowadzono

- inwentarz

- inwestowanie

- inwestycja

- angażować

- zaangażowany

- dotyczy

- odosobniony

- problemy

- IT

- JEGO

- łączący

- właśnie

- Zapalony

- Klawisz

- Klawisze

- wiedza

- Wykres Wiedza

- wie

- Labs

- Brak

- język

- Języki

- duży

- większe

- nioski

- prowadzić

- prowadzący

- UCZYĆ SIĘ

- dowiedziałem

- nauka

- Pozostawiać

- Regulamin

- pozwala

- LG

- lubić

- Prawdopodobnie

- Ograniczenia

- Ograniczony

- linie

- Lama

- logika

- logiczny

- poszukuje

- niski

- maszyna

- uczenie maszynowe

- maszyny

- utrzymać

- robić

- WYKONUJE

- Dokonywanie

- zarządzanie

- zarządzane

- i konserwacjami

- podręcznik

- wiele

- mapowanie

- Marketing

- masywny

- masywnie

- dopasowywanie

- materiały

- Może..

- Media

- medyczny

- Poznaj nasz

- Meta

- metoda

- metody

- może

- miliony

- zminimalizować

- ML

- model

- modele

- miesięcy

- jeszcze

- większość

- przeniesienie

- musi

- Naturalny

- niezbędny

- Potrzebować

- potrzebne

- potrzeba

- wymagania

- ujemny

- Nowości

- następna generacja

- żaden

- już dziś

- of

- poza

- Oferty

- często

- on

- ONE

- tylko

- operacje

- Szanse

- Optymalny

- optymalizacja

- Opcje

- or

- orkiestracja

- zamówienie

- Zlecenia

- organizacja

- organizacyjny

- organizacji

- oryginalny

- pierwotnie

- Inne

- na zewnątrz

- wyniki

- przestarzały

- wytyczne

- Przewyższa

- wydajność

- Wyjścia

- koniec

- ogólny

- Przezwyciężać

- przegląd

- własny

- par

- Papiery

- parametry

- szczególny

- szczególnie

- fragmenty

- Przeszłość

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- spektakle

- osobisty

- Personalizowany

- Zwroty

- sztuk

- rurociąg

- planowanie

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- działka

- zwrotnica

- polityka

- Popularny

- możliwy

- Post

- Wiadomości

- potencjał

- potencjalnie

- power

- powered

- mocny

- Praktyczny

- praktyka

- praktyki

- poprzedzający

- preferencje

- prezydent

- zapobieganie

- poprzednio

- Cena

- wycena

- Główny

- Wcześniejszy

- prywatność

- Prywatność i bezpieczeństwo

- prywatny

- Problem

- problemy

- wygląda tak

- przetwarzanie

- produkować

- Wytworzony

- produkuje

- wydajność

- Produkty

- Profil

- Programowanie

- promuje

- monity

- właściwy

- prawidłowo

- zaproponować

- własność

- zapewniać

- dostawców

- zapewnia

- że

- publiczny

- opublikowany

- Publikuje

- ciągnięcie

- zakup

- zamówienie zakupu

- jakość

- zapytania

- pytanie

- pytania

- szybko

- szmata

- zasięg

- szybki

- szybko

- RZADKO SPOTYKANY

- raczej

- Surowy

- RE

- React

- real

- prawdziwa wartość

- Prawdziwy świat

- w czasie rzeczywistym

- dane w czasie rzeczywistym

- zrealizowanie

- niedawny

- uznanie

- Rekomendacja

- zalecenia

- Zalecana

- zmniejszyć

- redukcja

- odnosić się

- regularnie

- związek

- mających znaczenie

- opierając się

- pozostały

- znakomity

- Raporty

- reputacja

- zażądać

- wywołań

- wymagać

- wymagany

- wymagania

- Wymaga

- wymagany

- Badania naukowe

- Zasób

- zasobochłonne

- Zasoby

- Odpowiadać

- odpowiedź

- Odpowiedzi

- REST

- Efekt

- wyszukiwanie

- powrót

- przychody

- Recenzje

- prawo

- ryzyko

- rutyna

- run

- bieganie

- bezpieczniej

- sagemaker

- taki sam

- klientów

- Skalowalność

- skalowalny

- Skala

- Niedobór

- scenariusz

- scenariusze

- nauka

- Naukowcy

- zadraśnięcie

- skrypty

- bezszwowy

- Szukaj

- Sekcja

- bezpiecznie

- bezpieczeństwo

- zagrożenia bezpieczeństwa

- wybrany

- wybierając

- wybór

- senior

- wrażliwy

- sentyment

- uczucia

- Bezserwerowe

- służy

- usługa

- Usługi

- służąc

- Sesja

- zestaw

- Zestawy

- w panelu ustawień

- kilka

- Shape

- shared

- Short

- powinien

- Targi

- znaczący

- znacznie

- podobny

- Prosty

- pojedynczy

- wykwalifikowany

- umiejętności

- mniejszy

- So

- Obserwuj Nas

- Media społecznościowe

- Posty w mediach społecznościowych

- Wyłącznie

- solidny

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- Rozwiązywanie

- kilka

- wyrafinowany

- Źródło

- Źródła

- specjalista

- specjalizować

- wyspecjalizowanym

- specjalizuje się

- specyficzny

- swoiście

- specyficzność

- Stabilność

- stoisko

- standardy

- początek

- rozpoczęty

- Startups

- Zjednoczone

- Ewolucja krok po kroku

- Cel

- Nadal

- stany magazynowe

- Stop

- sklep

- sklep

- historie

- Historia

- bezpośredni

- Strategiczny

- silne strony

- silny

- Struktura

- zbudowany

- Struktury

- styl

- znaczny

- udany

- Z powodzeniem

- taki

- wystarczający

- sugerować

- Garnitur

- odpowiedni

- doładowania

- Dostawa

- wsparcie

- podpory

- pewnie

- objawy

- system

- systemy

- sprzęt

- dostosowane

- Brać

- biorąc

- Talent

- rozmawiać

- Rozmowy

- Stuknij

- cel

- Zadanie

- zadania

- zespół

- tech

- Techniczny

- umiejętności techniczne

- technika

- Techniki

- Technologies

- Technologia

- Innowacje technologiczne

- szablon

- terminologia

- test

- Testowanie

- XNUMX

- Klasyfikacja tekstu

- niż

- że

- Połączenia

- Informacje

- ich

- Im

- następnie

- Tam.

- w związku z tym

- Te

- one

- myśleć

- innych firm

- to

- dokładny

- całkowicie

- tych

- tysiące

- trzy

- Przez

- czas

- czasochłonne

- do

- tokenizowany

- Żetony

- narzędzie

- narzędzia

- Top

- aktualny

- tematy

- w kierunku

- ruch drogowy

- Pociąg

- przeszkolony

- Trening

- tranzyt

- Tłumaczenie

- Przezroczystość

- ogromny

- wyzwalanie

- biliony

- naprawdę

- Zaufaj

- zaufany

- godny zaufania

- Prawda

- strojenie

- SKRĘCAĆ

- szczypanie

- drugiej

- zazwyczaj

- niezdolny

- zrozumieć

- zrozumienie

- wyjątkowy

- Zjednoczony

- United States

- odblokować

- nie wykorzystany

- niepożądany

- nowomodny

- Aktualizacja

- zaktualizowane

- aktualizowanie

- Uaktualnienia

- posługiwać się

- przypadek użycia

- używany

- użyteczny

- Użytkownik

- Doświadczenie użytkownika

- Użytkownicy

- zastosowania

- za pomocą

- użyteczność

- UPRAWOMOCNIĆ

- wartość

- różnorodność

- różnorodny

- Naprawiono

- bardzo

- początku.

- przez

- wizja

- wizualny

- vs

- Luki w zabezpieczeniach

- spacer

- chcieć

- brakujący

- była

- fala

- Droga..

- we

- Słabości

- sieć

- usługi internetowe

- tygodni

- ważenia

- waga

- DOBRZE

- Co

- jeśli chodzi o komunikację i motywację

- natomiast

- czy

- który

- Podczas

- szeroki

- Szeroki zasięg

- szeroko

- rozpowszechniony

- Wikipedia

- będzie

- w

- w ciągu

- bez

- Praca

- workflow

- przepływów pracy

- pracujący

- by

- napisać

- pisanie

- napisany

- lat

- Wydajność

- You

- Twój

- zefirnet