Wprowadzenie

Kiedy Aleksiej Efros jako nastolatek przeprowadził się z rodziną z Rosji do Kalifornii w latach 1980., przywiózł ze sobą swój komputer osobisty wyprodukowany w ZSRR, Elektronikę BK-0010. Maszyna nie miała zewnętrznej pamięci masowej i co kilka godzin przegrzewała się, więc aby grać w gry wideo, musiał pisać kod, rozwiązywać problemy i grać szybko – zanim maszyna się wyłączyła. Cykl ten, powtarzany przez większość dni, przyspieszał jego naukę.

„Miałem wielkie szczęście, że ten radziecki komputer nie był zbyt dobry!” — zawołał Efros, który łatwo się śmieje i mówi z łagodnym rosyjskim akcentem. Obecnie nie gra już w tak wiele gier, ale chęć odkrywania i maksymalnego wykorzystania swoich narzędzi pozostała.

Podczas studiów podyplomowych na Uniwersytecie Kalifornijskim w Berkeley Efros zaczął wędrować i odkrywać naturalne piękno Bay Area. Niedługo potem zaczął łączyć swoją pasję do komputerów z przyjemnością podziwiania tych zabytków. Opracował sposób na płynne łatanie dziur na zdjęciach — na przykład zastąpienie zabłąkanego śmietnika na zdjęciu lasu sekwoi naturalnie wyglądającymi drzewami. Później Adobe Photoshop przyjął wersję tej techniki w swoim narzędziu „wypełniania z uwzględnieniem zawartości”.

Obecnie Efros, informatyk w laboratorium badawczym sztucznej inteligencji w Berkeley, łączy ogromne zbiory danych online z algorytmami uczenia maszynowego, aby zrozumieć, modelować i odtwarzać świat wizualny. W 2016 roku Stowarzyszenie Maszyn Obliczeniowych przyznało mu nagrodę im Nagroda w dziedzinie informatyki za twórczość polegającą na tworzeniu realistycznych, syntetycznych obrazów, nazywając go „alchemik obrazu".

Wprowadzenie

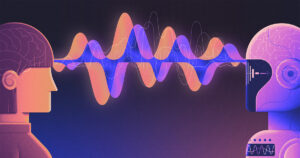

Efros twierdzi, że pomimo największych wysiłków badaczy maszyny nadal widzą zasadniczo inaczej niż my. „Plamy koloru i jasności wymagają od nas połączenia tego, co widzimy teraz, z pamięcią o tym, gdzie widzieliśmy te rzeczy wcześniej” – powiedział Efros. „To połączenie nadaje znaczenie temu, co widzimy”. Zbyt często maszyny widzą to, co jest w danej chwili, bez łączenia tego z tym, co widziały wcześniej.

Ale różnica może mieć zalety. W wizji komputerowej Efros docenia natychmiastowość wiedzy, czy algorytm przeznaczony do rozpoznawania obiektów i scen działa na obrazie. Niektóre z jego pytań dotyczących wizji komputerowej — np. „Co sprawia, że Paryż wygląda jak Paryż?” — mają zacięcie filozoficzne. Inne, na przykład sposób rozwiązywania uporczywych problemów błąd w zbiorach danych, są praktyczne i pilne.

„Obecnie wiele osób zajmuje się sztuczną inteligencją za pomocą języka” – powiedział Efros. „Chcę przyjrzeć się całkowicie wizualnym wzorcom, które pozostały”. Udoskonalając widzenie komputerowe, ma nadzieję nie tylko na lepsze zastosowania praktyczne, takie jak samochody autonomiczne; chce także wykorzystać te spostrzeżenia, aby lepiej zrozumieć to, co nazywa „ludzką inteligencją wizualną” – w jaki sposób ludzie nadają sens temu, co widzą.

Magazyn Quanta spotkał się z Efrosem w jego biurze w Berkeley, aby porozmawiać o naukowych supermocach, trudnościach w opisywaniu efektów wizualnych oraz o tym, jak naprawdę niebezpieczna jest sztuczna inteligencja. Wywiad został skrócony i zredagowany dla przejrzystości.

Wprowadzenie

Jak poprawiła się wizja komputerowa od czasu, gdy byłeś studentem?

Kiedy zaczynałem doktorat, nie było prawie nic przydatnego. Niektóre roboty wkręcały pewne śruby, korzystając z wizji komputerowej, ale ograniczało się to do tego rodzaju bardzo kontrolowanych warunków przemysłowych. Potem nagle mój aparat wykrył twarze i wyostrzył je.

Obecnie wizja komputerowa znajduje zastosowanie w ogromnej liczbie zastosowań, np. w samochodach autonomicznych. Trwa to dłużej, niż niektórzy początkowo sądzili, ale mimo to widać postęp. Dla kogoś, kto nie prowadzi samochodu, jest to niezwykle ekscytujące.

Czekaj, nie prowadzisz?

Nie, nie widzę na tyle dobrze, żeby prowadzić! [Śmiech.] Dla mnie byłaby to ogromna zmiana – mieć samochód, który będzie mnie woził w różne miejsca.

Nie zdawałem sobie sprawy, że twój wzrok nie pozwala ci prowadzić. Czy widzisz obrazy, z którymi pracujesz, na monitorze komputera?

Jeśli zrobię je wystarczająco duże. Jak widać, moje czcionki są dość duże. Urodziłem się słabo widząc. Myślę, że wszyscy inni są dziwakami, bo mają szalenie dobry wzrok.

Czy Twój status osoby niebędącej dziwakiem miał wpływ na kierunek Twoich badań?

Kto wie? Zdecydowanie nie było mowy o stwierdzeniu: „Och, słabo widzę, więc stworzę komputery, które będą widzieć lepiej”. Nie, nigdy nie miałem tego jako motywacji.

Aby być dobrym naukowcem, potrzebujesz tajnej supermocy. Musisz zrobić coś lepiej niż wszyscy inni. Wspaniałą rzeczą w nauce jest to, że nie wszyscy mamy tę samą supermoc. Może moja supermoc polega na tym, że ponieważ nie widzę zbyt dobrze, mogę mieć lepszy wgląd w problem ze wzrokiem.

Wprowadzenie

Wcześnie zrozumiałem znaczenie wcześniejszych danych, gdy patrzę na świat. Sam nie widziałem zbyt dobrze, ale pamięć o wcześniejszych doświadczeniach wypełniła luki na tyle, że mogłem funkcjonować w zasadzie tak dobrze, jak normalna osoba. Większość ludzi nie wie, że słabo widzę. To dało mi — jak sądzę — tę wyjątkową intuicję, że może mniej chodzi o piksele, a bardziej o pamięć.

Komputery widzą tylko to, co jest teraz, podczas gdy my widzimy moment powiązany z materią wszystkiego, co widzieliśmy wcześniej.

Czy da się w ogóle wyrazić słowami subtelne wzorce wizualne, które na przykład sprawiają, że Paryż wygląda jak Paryż?

Kiedy jesteś w konkretnym mieście, czasami po prostu wiesz, w jakim mieście się znajdujesz — o to chodzi je ne sais quoi, nawet jeśli nigdy nie byłeś na tym konkretnym rogu ulicy. Niezwykle trudno to opisać słowami, ale widać to w pikselach.

[W przypadku Paryża] można by mówić o tym, że są to zazwyczaj budynki sześciopiętrowe, a na czwartym piętrze zwykle są balkony. Można by to ująć w słowa, ale wiele z nich nie ma charakteru językowego. Dla mnie to ekscytujące.

Twoja ostatnia praca polega na uczeniu komputerów przyjmować dane wizualne w sposób naśladujący ludzki wzrok. Jak to działa?

Obecnie komputery dysponują ogromnym zbiorem danych: miliardami przypadkowych obrazów pobranych z Internetu. Robią losowe obrazy, przetwarzają jeden obraz, następnie robią inny losowy obraz, przetwarzają go itd. Trenujesz swój system [wizualny komputera], przeglądając ten zestaw danych.

Sposób, w jaki my – czynniki biologiczne – przyswajamy dane, jest bardzo różny. Kiedy mamy do czynienia z nową sytuacją, jest to jedyny raz, kiedy te dane będą dla nas dostępne. Nigdy nie byliśmy w takiej sytuacji, w tym pomieszczeniu, przy takim oświetleniu i tak ubrani. Po pierwsze, wykorzystujemy te dane, aby zrobić to, co musimy zrobić, aby zrozumieć świat. Następnie wykorzystujemy te dane, aby się na nich uczyć i przewidywać przyszłość.

Wprowadzenie

Ponadto dane, które widzimy, nie są przypadkowe. To, co widzisz teraz, jest bardzo powiązane z tym, co widziałeś kilka sekund temu. Można o tym myśleć jak o wideo. Wszystkie klatki filmu są ze sobą skorelowane, co znacznie różni się od sposobu przetwarzania danych przez komputery.

Interesuje mnie takie podejście do uczenia się, w którym komputery widzą napływające dane, przetwarzają je i uczą się na ich podstawie.

Wyobrażam sobie, że nie jest to tak proste, jak to, że komputery oglądają filmy zamiast nieruchomych obrazów.

Nie, nadal potrzebujesz [komputerów], aby się dostosować. Interesują mnie podejścia do uczenia się, które postrzegają dane w momencie ich nadejścia, a następnie przetwarzają je i uczą się na ich podstawie. Jedno z podejść, jakie mamy, jest znane jako szkolenie w czasie testów. Pomysł jest taki, że gdy patrzysz na sekwencję obrazów niczym na wideo, wszystko może się zmienić. Więc nie chcesz, żeby Twój model był naprawiany. Tak jak czynnik biologiczny zawsze dostosowuje się do otoczenia, tak my chcemy, aby komputer stale się dostosowywał.

Standardowy paradygmat polega na tym, że najpierw szkolisz się na dużym zestawie danych, a następnie wdrażasz. Dall·E i ChatGPT zostali przeszkoleni w zakresie Internetu około 2021 r., a następnie [ich wiedza] została zamrożona. Następnie wypluwa to, co już wie. Bardziej naturalnym sposobem jest [szkolenie w czasie testu], polegające na absorpcji danych i zdobywaniu wiedzy w trakcie pracy, a nie na oddzielnych fazach szkolenia i wdrażania.

Zdecydowanie istnieje problem z komputerami, zwany przesunięciem domeny lub odchyleniem zbioru danych — pomysł, że jeśli dane szkoleniowe bardzo różnią się od danych, których używasz podczas wdrażania systemu, wszystko nie zadziała bardzo dobrze. Robimy pewne postępy, ale to jeszcze nie wszystko.

Wprowadzenie

Czy problem jest podobny do tego, jak banki ostrzegają inwestorów, że wyniki z przeszłości mogą nie przewidywać przyszłych zysków?

To jest właśnie problem. W prawdziwym świecie wszystko się zmienia. Na przykład, jeśli mysz polna trafi do domu, wszystko będzie dobrze. Nigdy nie pozbędziesz się tej myszy! [Śmiech.] Urodziło się na polu, nigdy wcześniej nie było w domu, a mimo to znajdzie i zje wszystkie twoje zapasy. Bardzo szybko się adaptuje, uczy i dostosowuje się do nowego środowiska.

Tej możliwości nie ma w obecnych systemach [wizji komputerowej]. W przypadku autonomicznej jazdy, jeśli szkolisz samochód w Kalifornii, a następnie testujesz go w Minnesocie – bum! - jest śnieg. Nigdy nie widziało śniegu. Robi się zamieszanie.

Teraz ludzie rozwiązują ten problem, uzyskując tak dużo danych, że [system] w zasadzie widział wszystko. Wtedy nie trzeba się dostosowywać. Ale to wciąż pomija rzadkie wydarzenia.

Wygląda zatem na to, że systemy sztucznej inteligencji są rozwiązaniem przyszłościowym. Dokąd to prowadzi ludzi?

Praca wynikająca z OpenAI zarówno w zakresie tekstu (ChatGPT), jak i obrazu (Dall·E) była niezwykle ekscytująca i zaskakująca. Potwierdza to pogląd, że gdy dysponuje się wystarczającą ilością danych, stosunkowo proste metody mogą dać zaskakująco dobre wyniki.

Wprowadzenie

Ale ChatGPT uświadomiło mi, że ludzie nie są tak kreatywni i wyjątkowi, jak chcielibyśmy siebie postrzegać. W większości przypadków to, co w nas rozpoznaje wzorce, może przejmować kontrolę. Mówimy zdaniami utworzonymi z wyrażeń lub zdań, które słyszeliśmy wcześniej. Oczywiście mamy mnóstwo fantazji i kreatywności. Jesteśmy w stanie robić rzeczy, których nie potrafią komputery — przynajmniej na razie. Ale w większości przypadków możemy zostać zastąpieni przez ChatGPT, a większość ludzi by tego nie zauważyła.

To upokarzające. Ale to też motywacja do wyłamania się z tych schematów, do poszukiwania większej fantazji, do tego, by nie tkwić w kliszach i pastiszach.

Niektórzy naukowcy wyrazili zaniepokojenie zagrożeniami, jakie sztuczna inteligencja stwarza dla ludzkości. Martwisz się?

Wielu badaczy, których darzę wielkim szacunkiem, ostrzegało przed sztuczną inteligencją. Nie chcę umniejszać tych słów. Wiele z nich to uzasadnione uwagi. Ale trzeba spojrzeć na wszystko z właściwej perspektywy.

W tej chwili największym zagrożeniem dla cywilizacji nie są komputery, ale ludzie. Armagedon nuklearny i zmiany klimatyczne są o wiele bardziej palącymi zmartwieniami. Federacja Rosyjska zaatakowała swojego całkowicie niewinnego sąsiada. Urodziłem się w Rosji i to szczególnie przerażające, że moi byli rodacy mogli to robić. Robię wszystko, co w mojej mocy, aby ten temat pozostał tematem numer jeden.

Może nam się wydawać, że rewolucja AI jest najważniejszym wydarzeniem w naszym życiu. Ale rewolucja AI będzie niczym, jeśli nie uratujemy wolnego świata.

Więc w ogóle nie martwisz się sztuczną inteligencją?

Nie. Wiesz, uwielbiam się martwić. Jestem wielkim zmartwieniem! Ale jeśli Putin niszczący świat jest tutaj [podnosi rękę do głowy] i zmiany klimatyczne są tutaj [opuszcza rękę na ramiona], to sztuczna inteligencja jest tutaj na dole [opuszcza rękę na nogi]. To ułamek procenta moich zmartwień w porównaniu z Putinem i zmianami klimatycznymi.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://www.quantamagazine.org/the-computing-pioneer-helping-ai-see-20231024/

- :ma

- :Jest

- :nie

- :Gdzie

- ][P

- $W GÓRĘ

- 2016

- 2021

- a

- zdolność

- Zdolny

- O nas

- przyśpieszony

- ACM

- przystosować

- dostosowuje się

- adres

- Adobe

- przyjęty

- Zalety

- Agent

- agentów

- temu

- AI

- Systemy SI

- algorytm

- Algorytmy

- Wszystkie kategorie

- prawie

- już

- również

- zawsze

- am

- an

- i

- Inne

- aplikacje

- podejście

- awanse

- SĄ

- sztuczny

- sztuczna inteligencja

- AS

- Stowarzyszenie

- At

- Stephen Schwartz wygrywa

- Banki

- Gruntownie

- Zatoka

- BE

- Uroda

- bo

- być

- zanim

- rozpoczął

- za

- Berkeley

- BEST

- Ulepsz Swój

- stronniczość

- Duży

- Big Data

- Najwyższa

- miliardy

- urodzony

- obie

- przerwa

- wyrwać się

- przyniósł

- ale

- by

- California

- nazywa

- powołanie

- Połączenia

- aparat fotograficzny

- CAN

- nie może

- wózek

- samochody

- zmiana

- Changer

- wymiana pieniędzy

- ChatGPT

- o

- Miasto

- Civilization

- klarowność

- Klimat

- Zmiana klimatu

- kod

- kolor

- kombajny

- łączenie

- byliśmy spójni, od początku

- przyjście

- w porównaniu

- całkowicie

- komputer

- Wizja komputerowa

- komputery

- computing

- Troska

- zmieszany

- Skontaktuj się

- połączony

- Podłączanie

- połączenie

- bez przerwy

- kontrolowanych

- Corner

- mógłby

- Kurs

- zwariowany

- Tworzenie

- Twórczy

- kreatywność

- Aktualny

- cykl

- ZAGROŻENIE

- Niebezpieczny

- dane

- zbiór danych

- zestawy danych

- Dni

- Zdecydowanie

- rozwijać

- wdrażanie

- Wdrożenie

- opisać

- zaprojektowany

- Mimo

- wykryte

- rozwinięty

- różnica

- różne

- Trudność

- kierunek

- do

- robi

- Nie

- robi

- domena

- nie

- na dół

- napęd

- jazdy

- Śmietnik

- każdy

- Wcześnie

- Zarobki

- z łatwością

- jeść

- starania

- więcej

- kończy się

- dość

- Środowisko

- itp

- Parzyste

- wydarzenie

- wydarzenia

- Każdy

- wszyscy

- wszystko

- dokładnie

- przykład

- wyjątkowy

- ekscytujący

- Doświadczenia

- odkryj

- Exploring

- ekspresowy

- wyrażone

- zewnętrzny

- niezwykle

- w obliczu

- twarze

- członków Twojej rodziny

- FAST

- Federacja

- stopy

- kilka

- pole

- wypełniony

- Znajdź

- w porządku

- i terminów, a

- ustalony

- Loty

- czcionki

- W razie zamówieenia projektu

- las

- Dawny

- Naprzód

- Czwarty

- Darmowy

- od

- z przodu

- funkcjonować

- zasadniczo

- przyszłość

- gra

- game-changer

- Games

- dał

- otrzymać

- miejsce

- GitHub

- daje

- Go

- będzie

- dobry

- absolwent

- wspaniały

- miał

- ręka

- Ciężko

- Have

- mający

- he

- głowa

- wysłuchany

- pomoc

- tutaj

- go

- jego

- Dziury

- nadzieję

- przerażające

- GODZINY

- dom

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- olbrzymi

- człowiek

- Ludzkość

- Ludzie

- i

- pomysł

- if

- obraz

- zdjęcia

- obraz

- znaczenie

- ważny

- ulepszony

- poprawy

- in

- niewiarygodnie

- przemysłowy

- wpływ

- początkowo

- niewinny

- wgląd

- spostrzeżenia

- zamiast

- Inteligencja

- zainteresowany

- Internet

- Wywiad

- najnowszych

- Inwestorzy

- problem

- IT

- JEGO

- Praca

- właśnie

- Uprzejmy

- Wiedzieć

- Wiedząc

- wiedza

- znany

- wie

- laboratorium

- język

- później

- UCZYĆ SIĘ

- nauka

- najmniej

- Pozostawiać

- lewo

- mniej

- dożywotni

- Oświetlenie

- lubić

- Ograniczony

- długo

- dłużej

- Popatrz

- wygląda jak

- poszukuje

- Partia

- miłość

- maszyna

- uczenie maszynowe

- maszyny

- maszyny

- zrobiony

- magazyn

- robić

- WYKONUJE

- Dokonywanie

- wiele

- masywny

- Może..

- może

- me

- znaczenie

- Pamięć

- spełnione

- metody

- może

- tęskni

- MIT

- model

- moment

- monitor

- jeszcze

- większość

- Motywacja

- przeniósł

- dużo

- my

- sam

- Naturalny

- ne

- Potrzebować

- wymagania

- nigdy

- Nowości

- Nie

- normalna

- nic

- Zauważyć..

- powieść

- już dziś

- jądrowy

- numer

- obiekty

- of

- poza

- Biurowe

- często

- on

- pewnego razu

- ONE

- Online

- tylko

- OpenAI

- or

- zamówienie

- Inne

- Pozostałe

- ludzkiej,

- sobie

- na zewnątrz

- koniec

- paradygmat

- Paryż

- szczególny

- szczególnie

- pasja

- Przeszłość

- Łata

- Wzór

- wzory

- Ludzie

- procent

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- osoba

- osobisty

- perspektywa

- fotografie

- Zwroty

- pionier

- Miejsca

- plato

- Analiza danych Platona

- PlatoDane

- Grać

- zwrotnica

- stwarza

- możliwy

- Praktyczny

- przewidzieć

- pilny

- Wcześniejszy

- Problem

- wygląda tak

- produkować

- Postęp

- położyć

- Putin

- pytania

- szybko

- całkiem

- podnosi

- przypadkowy

- RZADKO SPOTYKANY

- potwierdza

- real

- Prawdziwy świat

- realistyczny

- zrealizować

- naprawdę

- niedawny

- rozpoznać

- szczątki

- powtórzony

- otrzymuje

- wymagać

- Badania naukowe

- Badacze

- poszanowanie

- Efekt

- Rewolucja

- Pozbyć się

- prawo

- ryzyko

- roboty

- Pokój

- Rosja

- Rosyjski

- Federacja Rosyjska

- Powiedział

- taki sam

- Zapisz

- zobaczył

- mówią

- Sceny

- Szkoła

- nauka

- naukowy

- Naukowiec

- Naukowcy

- płynnie

- sekund

- Tajemnica

- widzieć

- widzenie

- widziany

- samodzielna jazda

- rozsądek

- oddzielny

- Sekwencja

- zestaw

- Zestawy

- ustawienie

- przesunięcie

- plecy

- zamknąć

- Widok

- Zabytki

- podobny

- Prosty

- ponieważ

- sytuacja

- śnieg

- So

- kilka

- coś

- czasami

- mówić

- Mówi

- standard

- rozpoczęty

- Rynek

- Nadal

- przechowywanie

- Historia

- ulica

- student

- taki

- supermocarstwem

- zaopatrzenie

- pewnie

- zaskakujący

- syntetyczny

- system

- systemy

- Brać

- biorąc

- Mówić

- Nauczanie

- technika

- nastolatek

- test

- XNUMX

- niż

- że

- Połączenia

- Przyszłość

- świat

- ich

- Im

- następnie

- Tam.

- Te

- one

- rzecz

- rzeczy

- myśleć

- to

- tych

- chociaż?

- myśl

- czas

- do

- także

- narzędzie

- narzędzia

- aktualny

- Pociąg

- przeszkolony

- Trening

- Drzewa

- próbować

- zrozumieć

- zrozumiany

- wyjątkowy

- uniwersytet

- University of California

- us

- posługiwać się

- za pomocą

- zazwyczaj

- ważny

- wersja

- początku.

- Wideo

- gier wideo

- Filmy

- wizja

- wizualizacje

- chcieć

- chce

- ostrzeżenie

- była

- Droga..

- sposoby

- we

- webp

- DOBRZE

- były

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- natomiast

- czy

- który

- KIM

- całkowicie

- będzie

- Gotowość

- w

- bez

- słowa

- Praca

- działa

- świat

- zmartwiony

- martwić się

- by

- napisać

- pisać kod

- jeszcze

- You

- Twój

- zefirnet