W 2021, przemysł farmaceutyczny wygenerował w USA przychody w wysokości 550 miliardów dolarów. Firmy farmaceutyczne sprzedają na rynku różnorodne, często nowatorskie leki, w przypadku których czasami mogą wystąpić niezamierzone, ale poważne działania niepożądane.

Zdarzenia te można zgłaszać w dowolnym miejscu, czy to w szpitalu, czy w domu, i należy je odpowiedzialnie i skutecznie monitorować. Tradycyjne ręczne przetwarzanie zdarzeń niepożądanych staje się wyzwaniem ze względu na rosnącą ilość danych dotyczących zdrowia i koszty. Ogółem szacuje się, że do roku 384 koszty działań związanych z nadzorem nad bezpieczeństwem farmakoterapii w całej branży opieki zdrowotnej wyniosą 2022 miliardy dolarów. Aby wesprzeć nadrzędne działania w zakresie nadzoru nad bezpieczeństwem farmakoterapii, nasi klienci z branży farmaceutycznej chcą wykorzystać możliwości uczenia maszynowego (ML) do automatyzacji wykrywania zdarzeń niepożądanych na podstawie różnych źródeł danych , takie jak kanały w mediach społecznościowych, rozmowy telefoniczne, e-maile i odręczne notatki, i wywołują odpowiednie działania.

W tym poście pokazujemy, jak opracować rozwiązanie oparte na ML przy użyciu Amazon Sage Maker do wykrywania zdarzeń niepożądanych przy użyciu publicznie dostępnego zbioru danych dotyczących niepożądanych reakcji na leki na przytulającej twarzy. W tym rozwiązaniu dostrajamy różne modele na Hugging Face, które zostały wstępnie wytrenowane na danych medycznych i wykorzystujemy model BioBERT, który został wstępnie wytrenowany na Opublikowany zbiór danych i radzi sobie najlepiej z wypróbowanych.

Rozwiązanie wdrożyliśmy korzystając z Zestaw programistyczny AWS Cloud (AWS CDK). Jednak w tym poście nie omawiamy szczegółów budowania rozwiązania. Więcej informacji na temat wdrożenia tego rozwiązania można znaleźć w artykule Zbuduj system do wychwytywania zdarzeń niepożądanych w czasie rzeczywistym, korzystając z Amazon SageMaker i Amazon QuickSight.

W tym poście omówiono kilka kluczowych obszarów, zapewniając kompleksową analizę następujących tematów:

- Wyzwania związane z danymi, przed którymi stoją usługi profesjonalne AWS

- Krajobraz i zastosowanie dużych modeli językowych (LLM):

- Transformatory, BERT i GPT

- Przytulanie Twarzy

- Dopracowane rozwiązanie LLM i jego komponenty:

- Przygotowywanie danych

- Szkolenie modelowe

Wyzwanie dotyczące danych

Przy opracowywaniu zadań klasyfikacyjnych często problemem jest zniekształcenie danych. Idealnie byłoby mieć zrównoważony zbiór danych i ten przypadek użycia nie jest wyjątkiem.

Rozwiązujemy to pochylenie za pomocą generatywna sztuczna inteligencja modele (Falcon-7B i Falcon-40B), które poproszono o wygenerowanie próbek zdarzeń na podstawie pięciu przykładów ze zbioru uczącego, aby zwiększyć różnorodność semantyczną i zwiększyć wielkość próby oznaczonych zdarzeń niepożądanych. Używanie tutaj modeli Falcona jest dla nas korzystne, ponieważ w przeciwieństwie do niektórych LLM w Hugging Face, Falcon udostępnia zestaw danych szkoleniowych, z których korzysta, więc możesz mieć pewność, że żaden z przykładów zestawu testowego nie jest zawarty w zestawie treningowym Falcona i unikaj danych zanieczyszczenie.

Kolejnym wyzwaniem dotyczącym danych dla klientów opieki zdrowotnej są wymagania dotyczące zgodności z ustawą HIPAA. Aby spełnić te wymagania, w rozwiązaniu należy włączyć szyfrowanie w stanie spoczynku i podczas przesyłania.

Transformatory, BERT i GPT

Architektura transformatora to architektura sieci neuronowej używana do zadań przetwarzania języka naturalnego (NLP). Po raz pierwszy pojawił się w artykule „Wszystko, czego potrzebujesz, to uwaga” przez Vaswaniego i in. (2017). Architektura transformatora opiera się na mechanizmie uwagi, który pozwala modelowi uczyć się zależności dalekiego zasięgu między słowami. Transformatory, jak przedstawiono w oryginalnej pracy, składają się z dwóch głównych elementów: kodera i dekodera. Koder przyjmuje sekwencję wejściową jako sygnał wejściowy i generuje sekwencję stanów ukrytych. Dekoder następnie przyjmuje te ukryte stany jako dane wejściowe i generuje sekwencję wyjściową. Mechanizm uwagi jest stosowany zarówno w koderze, jak i dekoderze. Mechanizm uwagi pozwala modelowi zwracać uwagę na określone słowa w sekwencji wejściowej podczas generowania sekwencji wyjściowej. Pozwala to modelowi nauczyć się zależności między słowami o dużym zasięgu, co jest niezbędne w wielu zadaniach NLP, takich jak tłumaczenie maszynowe i podsumowywanie tekstu.

Jedna z bardziej popularnych i użytecznych architektur transformatorów, Dwukierunkowe reprezentacje enkoderów z transformatorów (BERT), to model reprezentacji języka, który został wprowadzone w 2018. BERT uczy się na sekwencjach, w których niektóre słowa w zdaniu są zamaskowane i musi je uzupełniać, biorąc pod uwagę zarówno słowa znajdujące się przed, jak i po słowach zamaskowanych. BERT można dostosować do różnych zadań NLP, w tym odpowiadania na pytania, wnioskowania w języku naturalnym i analizy nastrojów.

Inną popularną architekturą transformatorów, która szturmem podbiła świat, jest wstępnie przeszkolony transformator generatywny (GPT). Pierwszym modelem GPT był wprowadzony w 2018 roku przez OpenAI. Działa poprzez nauczenie się ścisłego przewidywania następnego słowa w sekwencji, mając jedynie świadomość kontekstu poprzedzającego słowo. Modele GPT są szkolone na ogromnym zbiorze danych składającym się z tekstu i kodu i można je dostosować do szeregu zadań NLP, w tym generowania tekstu, odpowiadania na pytania i podsumowań.

Generalnie BERT lepiej radzi sobie z zadaniami wymagającymi głębszego zrozumienia kontekstu słów, natomiast GPT lepiej nadaje się do zadań wymagających generowania tekstu.

Przytulanie Twarzy

Hugging Face to firma zajmująca się sztuczną inteligencją specjalizującą się w NLP. Zapewnia platformę z narzędziami i zasobami, które umożliwiają programistom budowanie, trenowanie i wdrażanie modeli uczenia maszynowego skupionych na zadaniach NLP. Jedną z kluczowych ofert Hugging Face jest biblioteka, Transformatory, który obejmuje wstępnie wytrenowane modele, które można dostosować do różnych zadań językowych, takich jak klasyfikacja tekstu, tłumaczenie, podsumowywanie i odpowiadanie na pytania.

Hugging Face bezproblemowo integruje się z SageMaker, czyli w pełni zarządzaną usługą, która umożliwia programistom i badaczom danych budowanie, trenowanie i wdrażanie modeli uczenia maszynowego na dużą skalę. Ta synergia przynosi korzyści użytkownikom, zapewniając solidną i skalowalną infrastrukturę do obsługi zadań NLP z najnowocześniejszymi modelami oferowanymi przez Hugging Face, w połączeniu z wydajnymi i elastycznymi usługami ML oferowanymi przez AWS. Możesz także uzyskać bezpośredni dostęp do modeli Hugging Face Amazon SageMaker JumpStart, dzięki czemu wygodnie jest zacząć od gotowych rozwiązań.

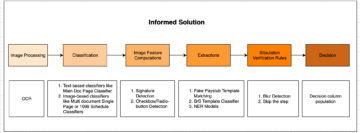

Omówienie rozwiązania

Wykorzystaliśmy bibliotekę Hugging Face Transformers do dostrojenia modeli transformatorów w programie SageMaker na potrzeby klasyfikacji zdarzeń niepożądanych. Zadanie szkoleniowe jest tworzone przy użyciu estymatora SageMaker PyTorch. SageMaker JumpStart posiada również kilka uzupełniających integracji z Hugging Face, co ułatwia wdrożenie. W tej sekcji opisujemy główne etapy przygotowania danych i uczenia modeli.

Przygotowywanie danych

Wykorzystaliśmy dane dotyczące działań niepożądanych leków (ade_corpus_v2) w zestawie danych Hugging Face z podziałem na trening/test 80/20. Wymagana struktura danych do uczenia i wnioskowania modelu składa się z dwóch kolumn:

- Jedna kolumna na treść tekstową jako dane wejściowe modelu.

- Kolejna kolumna dla klasy label. Mamy dwie możliwe klasy tekstu:

Not_AEiAdverse_Event.

Trening modeli i eksperymenty

Aby efektywnie zbadać przestrzeń możliwych modeli Przytulonej Twarzy w celu dostrojenia naszych połączonych danych dotyczących zdarzeń niepożądanych, skonstruowaliśmy zadanie optymalizacji hiperparametrów (HPO) w programie SageMaker i przekazaliśmy różne modele Przytulonej Twarzy jako hiperparametr wraz z innymi ważnymi hiperparametrami takie jak wielkość partii szkoleniowej, długość sekwencji, modele i szybkość uczenia się. Zadania szkoleniowe korzystały z instancji ml.p3dn.24xlarge i zajmowały średnio 30 minut na zadanie w przypadku tego typu instancji. Metryki szkoleniowe zostały przechwycone chociaż Eksperymenty Amazon SageMaker narzędzie, a każde zadanie szkoleniowe trwało 10 epok.

W naszym kodzie określamy co następuje:

- Wielkość partii szkoleniowej – Liczba próbek, które są przetwarzane łącznie przed aktualizacją wag modelu

- Długość sekwencji – Maksymalna długość sekwencji wejściowej, którą BERT może przetworzyć

- Wskaźnik uczenia się – Jak szybko model aktualizuje swoje ciężary podczas treningu

- modele – Wstępnie przeszkolone modele Hugging Face

Efekt

Modelem, który w naszym przypadku sprawdził się najlepiej, był model monologg/biobert_v1.1_pubmed model hostowany na platformie Hugging Face, która jest wersją architektury BERT, która została wstępnie przeszkolona w zbiorze danych Pubmed, na który składa się 19,717 XNUMX publikacji naukowych. Wstępne szkolenie BERT na tym zbiorze danych zapewnia temu modelowi dodatkową wiedzę specjalistyczną, jeśli chodzi o identyfikację kontekstu wokół terminów naukowych związanych z medycyną. Zwiększa to wydajność modelu w przypadku zadania wykrywania zdarzeń niepożądanych, ponieważ został on wstępnie przeszkolony w zakresie składni specyficznej medycznie, która często pojawia się w naszym zbiorze danych.

Poniższa tabela podsumowuje nasze wskaźniki oceny.

| Model | Detaliczność | Odwołanie | F1 |

| Baza BERT | 0.87 | 0.95 | 0.91 |

| BioBert | 0.89 | 0.95 | 0.92 |

| BioBERT z HPO | 0.89 | 0.96 | 0.929 |

| BioBERT z HPO i syntetycznie generowanym zdarzeniem niepożądanym | 0.90 | 0.96 | 0.933 |

Chociaż są to stosunkowo niewielkie i stopniowe ulepszenia w stosunku do podstawowego modelu BERT, niemniej jednak pokazuje to pewne realne strategie poprawy wydajności modelu za pomocą tych metod. Generowanie danych syntetycznych za pomocą Falcona wydaje się nieść wiele obietnic i potencjału w zakresie poprawy wydajności, zwłaszcza że te generatywne modele sztucznej inteligencji z biegiem czasu stają się coraz lepsze.

Sprzątać

Aby uniknąć przyszłych opłat, usuń wszystkie utworzone zasoby, takie jak model i punkty końcowe modelu utworzone za pomocą następującego kodu:

Wnioski

Wiele firm farmaceutycznych chciałoby dziś w sposób systematyczny zautomatyzować proces identyfikacji zdarzeń niepożądanych w interakcjach z klientami, aby poprawić bezpieczeństwo klientów i wyniki. Jak pokazaliśmy w tym poście, dopracowany LLM BioBERT z syntetycznie wygenerowanymi zdarzeniami niepożądanymi dodanymi do danych klasyfikuje zdarzenia niepożądane z wysokimi wynikami F1 i może zostać wykorzystany do zbudowania rozwiązania zgodnego z HIPAA dla naszych klientów.

Jak zawsze, AWS z radością przyjmie Twoją opinię. Zostaw swoje przemyślenia i pytania w sekcji komentarzy.

O autorach

Zacka Petersona jest analitykiem danych w AWS Professional Services. Od wielu lat zajmuje się dostarczaniem klientom rozwiązań w zakresie uczenia maszynowego i posiada tytuł magistra ekonomii.

Zacka Petersona jest analitykiem danych w AWS Professional Services. Od wielu lat zajmuje się dostarczaniem klientom rozwiązań w zakresie uczenia maszynowego i posiada tytuł magistra ekonomii.

Doktor Adewale Akinfaderin jest starszym analitykiem danych w dziale Healthcare and Life Sciences w AWS. Jego wiedza specjalistyczna obejmuje powtarzalne i kompleksowe metody AI/ML, praktyczne wdrożenia oraz pomaganie klientom z branży opieki zdrowotnej na całym świecie w formułowaniu i opracowywaniu skalowalnych rozwiązań problemów interdyscyplinarnych. Posiada dwa stopnie naukowe z fizyki i stopień doktora inżynierii.

Doktor Adewale Akinfaderin jest starszym analitykiem danych w dziale Healthcare and Life Sciences w AWS. Jego wiedza specjalistyczna obejmuje powtarzalne i kompleksowe metody AI/ML, praktyczne wdrożenia oraz pomaganie klientom z branży opieki zdrowotnej na całym świecie w formułowaniu i opracowywaniu skalowalnych rozwiązań problemów interdyscyplinarnych. Posiada dwa stopnie naukowe z fizyki i stopień doktora inżynierii.

Ekta Walia Bhullarjest starszym konsultantem AI/ML w jednostce biznesowej AWS Healthcare and Life Sciences (HCLS) Professional Services. Posiada szerokie doświadczenie w stosowaniu AI/ML w służbie zdrowia, zwłaszcza w radiologii. Poza pracą, jeśli nie rozmawia o sztucznej inteligencji w radiologii, lubi biegać i wędrować.

Ekta Walia Bhullarjest starszym konsultantem AI/ML w jednostce biznesowej AWS Healthcare and Life Sciences (HCLS) Professional Services. Posiada szerokie doświadczenie w stosowaniu AI/ML w służbie zdrowia, zwłaszcza w radiologii. Poza pracą, jeśli nie rozmawia o sztucznej inteligencji w radiologii, lubi biegać i wędrować.

Han Man jest starszym menedżerem ds. analityki danych i uczenia maszynowego w AWS Professional Services z siedzibą w San Diego w Kalifornii. Uzyskał tytuł doktora inżynierii na Northwestern University i ma kilkuletnie doświadczenie jako konsultant ds. zarządzania, doradzający klientom z branży produkcyjnej, usług finansowych i energetyki. Dziś z pasją współpracuje z kluczowymi klientami z różnych branż, aby opracowywać i wdrażać rozwiązania ML i generatywnej sztucznej inteligencji w AWS.

Han Man jest starszym menedżerem ds. analityki danych i uczenia maszynowego w AWS Professional Services z siedzibą w San Diego w Kalifornii. Uzyskał tytuł doktora inżynierii na Northwestern University i ma kilkuletnie doświadczenie jako konsultant ds. zarządzania, doradzający klientom z branży produkcyjnej, usług finansowych i energetyki. Dziś z pasją współpracuje z kluczowymi klientami z różnych branż, aby opracowywać i wdrażać rozwiązania ML i generatywnej sztucznej inteligencji w AWS.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- dostęp

- Konto

- ACM

- działania

- zajęcia

- w dodatku

- adres

- korzystny

- niekorzystny

- doradztwo

- Po

- AI

- Modele AI

- AI / ML

- AL

- Wszystkie kategorie

- pozwala

- wzdłuż

- również

- zawsze

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- ilość

- an

- analiza

- i

- sekretarka

- każdy

- nigdzie

- Zastosowanie

- właściwy

- architektura

- architektur

- SĄ

- obszary

- na około

- sztuczny

- sztuczna inteligencja

- AS

- At

- uczęszczać

- Uwaga

- zautomatyzować

- dostępny

- średni

- uniknąć

- świadomy

- AWS

- Usługi profesjonalne AWS

- zrównoważony

- baza

- na podstawie

- BE

- bo

- być

- zanim

- jest

- Korzyści

- BEST

- Ulepsz Swój

- pomiędzy

- dwukierunkowa

- Miliard

- zwiększa

- obie

- Granice

- budować

- Budowanie

- wybudowany

- biznes

- ale

- by

- CA

- Połączenia

- CAN

- Zajęte

- walizka

- wyzwanie

- wyzwania

- wyzwanie

- Opłaty

- klasa

- Klasy

- klasyfikacja

- klientów

- Chmura

- kod

- Kolumna

- kolumny

- połączony

- byliśmy spójni, od początku

- przyjście

- komentarze

- Firmy

- sukcesy firma

- uzupełniający

- spełnienie

- składniki

- wszechstronny

- składa się

- zbudowany

- konsultant

- zawarte

- zawartość

- kontekst

- Wygodny

- Koszty:

- Koszty:

- pokrywa

- Stwórz

- stworzony

- klient

- Klientów

- dane

- Przygotowywanie danych

- nauka danych

- naukowiec danych

- Struktura danych

- głębiej

- określić

- Stopień

- dostarczanie

- zagłębia się

- demonstruje

- Zależności

- rozwijać

- opisać

- Wykrywanie

- rozwijać

- deweloperzy

- oprogramowania

- Diego

- różne

- bezpośrednio

- Omawiając

- Różnorodność

- domena

- nie

- lek

- Narkotyki

- podczas

- E i T

- każdy

- ekonomia

- skutecznie

- e-maile

- umożliwiać

- Umożliwia

- szyfrowanie

- koniec końców

- energia

- Inżynieria

- epoki

- szczególnie

- niezbędny

- ewaluację

- wydarzenie

- wydarzenia

- przykłady

- wyjątek

- doświadczenie

- ekspertyza

- eksploracja

- odkryj

- rozległy

- Szerokie doświadczenie

- dodatkowy

- f1

- Twarz

- informacja zwrotna

- wypełniać

- budżetowy

- usługi finansowe

- i terminów, a

- pięć

- elastyczne

- koncentruje

- następujący

- W razie zamówieenia projektu

- od

- w pełni

- przyszłość

- Ogólne

- Generować

- wygenerowane

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- daje

- Globalne

- absolwent

- uchwyt

- siła robocza

- Have

- he

- Zdrowie

- opieki zdrowotnej

- przemysł medyczny

- Techniki Zdrowia

- pomoc

- pomoc

- tutaj

- Ukryty

- Wysoki

- Wycieczka

- jego

- przytrzymaj

- Strona główna

- szpitale

- hostowane

- W jaki sposób

- How To

- Jednak

- HTTPS

- Optymalizacja hiperparametrów

- idealnie

- identyfikacja

- wdrożenia

- realizacja

- wdrożenia

- realizowane

- importować

- ważny

- podnieść

- ulepszenia

- in

- obejmuje

- Włącznie z

- Rejestrowy

- Zwiększać

- wzrastający

- przyrostowe

- przemysł

- Informacja

- Infrastruktura

- wkład

- przykład

- Integruje się

- integracje

- Inteligencja

- Interakcje

- najnowszych

- wprowadzono

- zaangażowany

- IT

- JEGO

- Praca

- Oferty pracy

- jpg

- Klawisz

- Kluczowe obszary

- Etykieta

- laid

- krajobraz

- język

- duży

- UCZYĆ SIĘ

- nauka

- Pozostawiać

- Długość

- Biblioteka

- życie

- Life Sciences

- lubić

- lubi

- LLM

- Partia

- maszyna

- uczenie maszynowe

- zrobiony

- Główny

- poważny

- WYKONUJE

- Dokonywanie

- mężczyzna

- zarządzane

- i konserwacjami

- kierownik

- podręcznik

- produkcja

- wiele

- rynek

- masywny

- mistrzowski

- Maksymalizuj

- maksymalny

- mechanizm

- Media

- medyczny

- dane medyczne

- Poznaj nasz

- metody

- Metryka

- minut

- ML

- model

- modele

- monitorowane

- jeszcze

- musi

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- sieć

- nerwowy

- sieci neuronowe

- Niemniej jednak

- Następny

- nlp

- Nie

- żaden

- Uwagi

- powieść

- numer

- występować

- of

- Oferty

- Oferty

- często

- on

- ONE

- tylko

- optymalizacja

- or

- zamówienie

- oryginalny

- Inne

- ludzkiej,

- na zewnątrz

- wyniki

- wydajność

- zewnętrzne

- koniec

- ogólny

- nadrzędny

- Papier

- minęło

- dla

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywane

- wykonuje

- Przemysł farmaceutyczny

- PhD

- telefon

- rozmowy telefoniczne

- Fizyka

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- Popularny

- możliwy

- Post

- potencjał

- power

- mocny

- Praktyczny

- przewidzieć

- przygotowanie

- Problem

- problemy

- wygląda tak

- Obrobiony

- przetwarzanie

- produkuje

- profesjonalny

- Przewiduje

- obietnica

- zapewnia

- że

- publikacje

- publicznie

- płomień

- pytanie

- pytania

- szybko

- zasięg

- Kurs

- reakcja

- w czasie rzeczywistym

- odnosić się

- regex

- związane z

- stosunkowo

- Zgłoszone

- reprezentacja

- wymagać

- wymagany

- wymagania

- Zasoby

- odpowiedzialnie

- REST

- krzepki

- run

- Bezpieczeństwo

- sagemaker

- próba

- San

- San Diego

- skalowalny

- Skala

- nauka

- NAUKI

- naukowy

- Naukowiec

- Naukowcy

- płynnie

- Sekcja

- wydaje

- sprzedać

- semantyczny

- senior

- wyrok

- sentyment

- Sekwencja

- poważny

- usługa

- Usługi

- zestaw

- kilka

- ona

- pokazać

- pokazał

- Targi

- Rozmiar

- ukośnie

- mały

- So

- Obserwuj Nas

- Media społecznościowe

- rozwiązanie

- Rozwiązania

- kilka

- czasami

- Źródła

- Typ przestrzeni

- specjalizuje się

- specyficzny

- specyfika

- dzielić

- początek

- state-of-the-art

- Zjednoczone

- Cel

- burza

- bezpośredni

- strategie

- Struktura

- taki

- wsparcie

- pewnie

- synergia

- składnia

- syntetyczny

- dane syntetyczne

- syntetycznie

- system

- stół

- Zadania

- trwa

- biorąc

- Zadanie

- zadania

- REGULAMIN

- test

- XNUMX

- Klasyfikacja tekstu

- że

- Połączenia

- świat

- ich

- następnie

- Te

- one

- to

- tych

- chociaż?

- Przez

- czas

- do

- już dziś

- razem

- wziął

- narzędzie

- narzędzia

- tematy

- tradycyjny

- Pociąg

- przeszkolony

- Trening

- transformator

- Transformatory

- tranzyt

- Tłumaczenie

- wypróbowany

- wyzwalać

- drugiej

- rodzaj

- zrozumienie

- jednostka

- uniwersytet

- w odróżnieniu

- Nowości

- us

- posługiwać się

- przypadek użycia

- używany

- użyteczny

- Użytkownicy

- za pomocą

- różnorodność

- różnorodny

- wersja

- pionowe

- wykonalne

- chcieć

- była

- Droga..

- we

- sieć

- usługi internetowe

- Z zadowoleniem przyjmuje

- były

- jeśli chodzi o komunikację i motywację

- natomiast

- który

- w

- w ciągu

- słowo

- słowa

- Praca

- pracujący

- działa

- świat

- by

- lat

- You

- Twój

- zefirnet