Wierzymy, że generatywna sztuczna inteligencja może z czasem zmienić praktycznie każde doświadczenie klienta, jakie znamy. Liczba firm uruchamiających generatywne aplikacje AI na AWS jest znaczna i szybko rośnie, w tym Adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy i LexisNexis Legal & Professional, żeby wymienić tylko kilka. Innowacyjne start-upy, takie jak Perplexity AI, stawiają na AWS na rzecz generatywnej sztucznej inteligencji. Wiodące firmy zajmujące się sztuczną inteligencją, takie jak Anthropic, wybrały AWS jako głównego dostawcę chmury dla obciążeń o znaczeniu krytycznym oraz miejsce do szkolenia swoich przyszłych modeli. Globalni dostawcy usług i rozwiązań, tacy jak Accenture, czerpią korzyści z niestandardowych, generatywnych aplikacji AI, umożliwiając swoim wewnętrznym programistom Zaklinacz kodów Amazon.

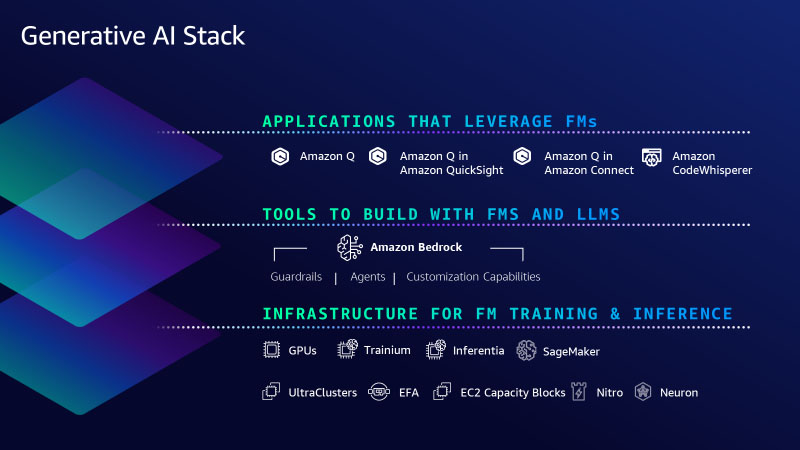

Ci klienci wybierają AWS, ponieważ koncentrujemy się na robieniu tego, co zawsze robiliśmy — korzystaniu ze złożonej i drogiej technologii, która może zmienić doświadczenia klientów i firmy, oraz demokratyzowaniu jej dla klientów każdej wielkości i możliwości technicznych. Aby to osiągnąć, inwestujemy i szybko wprowadzamy innowacje, aby zapewnić najbardziej kompleksowy zestaw możliwości w trzech warstwach generatywnego stosu sztucznej inteligencji. Dolna warstwa to infrastruktura służąca do uczenia modeli dużego języka (LLM) i innych modeli podstawowych (FM) oraz tworzenia wniosków i prognoz. Warstwa środkowa to łatwy dostęp do wszystkich modeli i narzędzi, których klienci potrzebują do tworzenia i skalowania generatywnych aplikacji AI z tymi samymi zabezpieczeniami, kontrolą dostępu i innymi funkcjami, których oczekują klienci od usługi AWS. W najwyższym stopniu inwestujemy w aplikacje zmieniające zasady gry w kluczowych obszarach, takich jak generatywne kodowanie oparte na sztucznej inteligencji. Oprócz oferowania im wyboru i – zgodnie z oczekiwaniami od nas – szerokiego zakresu możliwości na wszystkich warstwach, klienci mówią nam również, że doceniają nasze podejście oparte na danych i ufają, że zbudowaliśmy wszystko od podstaw z myślą o przedsiębiorstwach. stopień bezpieczeństwa i prywatności.

W tym tygodniu zrobiliśmy duży krok naprzód, ogłaszając wiele znaczących nowych możliwości we wszystkich trzech warstwach stosu, aby ułatwić naszym klientom szerokie wykorzystanie generatywnej sztucznej inteligencji w ich firmach.

Dolna warstwa stosu: AWS Trainium2 to najnowszy dodatek zapewniający najbardziej zaawansowaną infrastrukturę chmurową dla generatywnej sztucznej inteligencji

Dolną warstwę stosu stanowi infrastruktura — obliczeniowa, sieciowa, frameworki, usługi — wymagana do szkolenia i obsługi LLM i innych FM. AWS wprowadza innowacje, aby zaoferować najbardziej zaawansowaną infrastrukturę dla ML. Dzięki naszej długotrwałej współpracy z firmą NVIDIA, firma AWS jako pierwsza wprowadziła procesory graficzne do chmury ponad 12 lat temu, a ostatnio byliśmy pierwszym dużym dostawcą usług w chmurze, który udostępnił procesory graficzne NVIDIA H100 w naszych instancjach P5. Nieustannie inwestujemy w unikalne innowacje, które czynią AWS najlepszą chmurą do obsługi procesorów graficznych, w tym korzyści w stosunku ceny do wydajności najbardziej zaawansowanego systemu wirtualizacji (AWS Nitro), wydajną sieć w skali petabitowej z Elastic Fabric Adapter (EFA) i technologię Hyper- skalowanie klastrów za pomocą Amazon EC2 UltraClusters (tysiące przyspieszonych instancji zlokalizowanych w Strefie Dostępności i połączonych ze sobą w nieblokującą sieć, która może zapewnić do 3,200 Gb/s na potrzeby szkoleń ML na masową skalę). Ułatwiamy także każdemu klientowi dostęp do bardzo poszukiwanej mocy obliczeniowej procesora graficznego na potrzeby generatywnej sztucznej inteligencji dzięki blokom pojemności Amazon EC2 dla ML — pierwszemu i jedynemu modelowi wykorzystania w branży, który pozwala klientom rezerwować procesory graficzne do wykorzystania w przyszłości (do 500 wdrożone w EC2 UltraClusters) w przypadku krótkotrwałych obciążeń ML.

Kilka lat temu zdaliśmy sobie sprawę, że aby nadal przesuwać granicę w zakresie wydajności cenowej, będziemy musieli wprowadzić innowacje aż do krzemu, i zaczęliśmy inwestować we własne chipy. W szczególności w przypadku ML zaczęliśmy od AWS Inferentia, naszego specjalnie zaprojektowanego chipa wnioskowującego. Dziś korzystamy z drugiej generacji AWS Inferentia z instancjami Amazon EC2 Inf2, które są zoptymalizowane specjalnie pod kątem wielkoskalowych generatywnych aplikacji AI z modelami zawierającymi setki miliardów parametrów. Instancje Inf2 oferują najniższy koszt wnioskowania w chmurze, zapewniając jednocześnie do czterech razy większą przepustowość i do dziesięciu razy mniejsze opóźnienia w porównaniu z instancjami Inf1. Obsługiwane przez maksymalnie 12 chipów Inferentia2, Inf2 to jedyne instancje EC2 zoptymalizowane pod kątem wnioskowania, które zapewniają szybką łączność między akceleratorami, dzięki czemu klienci mogą wnioskować szybciej i wydajniej (przy niższych kosztach) bez poświęcania wydajności lub opóźnień poprzez dystrybucję bardzo dużych modeli w wielu akceleratorach. Klienci tacy jak Adobe, Deutsche Telekom i Leonardo.ai już zauważyli świetne wyniki i są podekscytowani możliwością wdrożenia swoich modeli na dużą skalę w Inf2.

Jeśli chodzi o szkolenie, instancje Trn1 — obsługiwane przez specjalnie zaprojektowany układ szkoleniowy ML firmy AWS, AWS Trainium — są zoptymalizowane pod kątem dystrybucji szkoleń na wielu serwerach połączonych siecią EFA. Klienci tacy jak Ricoh przeszkolili japońskie LLM z miliardami parametrów w ciągu zaledwie kilku dni. Databricks zapewnia nawet o 40% lepszy stosunek ceny do wydajności dzięki instancjom opartym na Trainium do uczenia modeli głębokiego uczenia się na dużą skalę. Jednak dzięki nowym, bardziej wydajnym modelom, które pojawiają się praktycznie co tydzień, w dalszym ciągu przesuwamy granice wydajności i skali, dlatego z radością ogłaszamy Szkolenie AWS2, zaprojektowany, aby zapewnić jeszcze lepszą wydajność cenową dla modeli szkoleniowych z setkami miliardów do bilionów parametrów. Trainium2 powinien zapewnić do czterech razy większą wydajność treningową niż Trainium pierwszej generacji, a w przypadku użycia w EC2 UltraClusters powinien zapewnić do 65 eksaflopów łącznej mocy obliczeniowej. Oznacza to, że klienci będą mogli wytrenować LLM o wartości 300 miliardów parametrów w ciągu tygodni, a nie miesięcy. Wydajność, skala i efektywność energetyczna Trainium2 to tylko niektóre z powodów, dla których Anthropic zdecydowało się trenować swoje modele na platformie AWS i będzie używać Trainium2 w swoich przyszłych modelach. Współpracujemy z Anthropic nad ciągłymi innowacjami zarówno w Trainium, jak i Inferentia. Oczekujemy, że nasze pierwsze instancje Trainium2 będą dostępne dla klientów w 2024 roku.

Podwoiliśmy także zakres narzędzi programowych dla naszego krzemu ML, szczególnie przy udoskonalaniu AWS Neuron, zestawu programistycznego (SDK), który pomaga klientom uzyskać maksymalną wydajność Trainium i Inferentia. Od czasu wprowadzenia Neurona w 2019 roku poczyniliśmy znaczne inwestycje w technologie kompilatorów i frameworków, a dziś Neuron obsługuje wiele najpopularniejszych publicznie dostępnych modeli, w tym Llama 2 firmy Meta, MPT firmy Databricks i Stable Diffusion firmy Stability AI, a także 93 ze 100 najlepszych modeli w popularnym repozytorium modeli Hugging Face. Neuron można podłączyć do popularnych frameworków ML, takich jak PyTorch i TensorFlow, a obsługa JAX pojawi się na początku przyszłego roku. Klienci mówią nam, że Neuron ułatwił im przejście istniejących potoków uczenia modeli i wnioskowania na Trainium i Inferentia za pomocą zaledwie kilku linijek kodu.

Nikt inny nie oferuje takiej kombinacji najlepszych chipów ML, superszybkiej sieci, wirtualizacji i klastrów o dużej skali. Nic więc dziwnego, że niektóre z najbardziej znanych startupów zajmujących się generatywną sztuczną inteligencją, takie jak AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway i Stability AI, działają na platformie AWS. Jednak nadal potrzebujesz odpowiednich narzędzi, aby skutecznie wykorzystać te obliczenia do wydajnego i opłacalnego budowania, trenowania i obsługi LLM i innych FM. W przypadku wielu z tych startupów Amazon Sage Maker jest odpowiedzią. Niezależnie od tego, czy budujemy i szkolimy nowy, autorski model od podstaw, czy zaczynamy od jednego z wielu popularnych, publicznie dostępnych modeli, szkolenie jest przedsięwzięciem złożonym i kosztownym. Nie jest też łatwo eksploatować te modele w sposób ekonomiczny. Klienci muszą pozyskać duże ilości danych i je przygotować. Zwykle wiąże się to z dużą ilością ręcznej pracy związanej z czyszczeniem danych, usuwaniem duplikatów, wzbogacaniem ich i przekształcaniem. Następnie muszą tworzyć i utrzymywać duże klastry procesorów graficznych/akceleratorów, pisać kod w celu wydajnej dystrybucji uczenia modelu pomiędzy klastrami, często punktować punkty kontrolne, wstrzymywać, sprawdzać i optymalizować model, a także ręcznie interweniować i naprawiać problemy sprzętowe w klastrze. Wiele z tych wyzwań nie jest nowych. To tylko niektóre z powodów, dla których sześć lat temu uruchomiliśmy SageMaker — aby przełamać wiele barier związanych ze szkoleniem i wdrażaniem modeli oraz zapewnić programistom znacznie łatwiejszy sposób. Dziesiątki tysięcy klientów korzysta z Amazon SageMaker, a coraz większa liczba z nich, takich jak LG AI Research, Perplexity AI, AI21, Hugging Face i Stability AI, szkoli LLM i innych FM w SageMaker. Niedawno Instytut Innowacji Technologicznych (twórcy popularnych Falcon LLM) przeszkolił największy publicznie dostępny model — Falcon 180B — w programie SageMaker. Wraz ze wzrostem rozmiarów i złożoności modeli rośnie zakres SageMaker.

Na przestrzeni lat dodaliśmy do Amazon SageMaker ponad 380 rewolucyjnych funkcji i możliwości, takich jak automatyczne dostrajanie modeli, szkolenia rozproszone, elastyczne opcje wdrażania modeli, narzędzia do operacji ML, narzędzia do przygotowywania danych, sklepy z funkcjami, notatniki, bezproblemowa integracja z oceną dokonywaną przez człowieka w pętli w całym cyklu życia uczenia maszynowego oraz wbudowanymi funkcjami odpowiedzialnej sztucznej inteligencji. Szybko wprowadzamy innowacje, aby mieć pewność, że klienci SageMaker będą mogli nadal budować, trenować i uruchamiać wnioskowanie dla wszystkich modeli — w tym LLM i innych FM. Dzięki dwóm nowym funkcjom sprawiamy, że trenowanie i wdrażanie dużych modeli jest jeszcze łatwiejsze i bardziej opłacalne dla klientów. Po pierwsze, aby uprościć szkolenie, jesteśmy wprowadzenie HyperPod Amazon SageMaker co automatyzuje więcej procesów wymaganych w przypadku rozproszonego szkolenia odpornego na awarie na dużą skalę (np. konfiguracja rozproszonych bibliotek szkoleniowych, skalowanie obciążeń szkoleniowych w tysiącach akceleratorów, wykrywanie i naprawianie wadliwych instancji), przyspieszając szkolenie aż o 40%. W rezultacie klienci tacy jak Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid i inni używają SageMaker HyperPod do budowania, trenowania i rozwijania modeli. Drugi, wprowadzamy nowe możliwości, dzięki którym wnioskowanie jest bardziej opłacalne, a jednocześnie zmniejszają opóźnienia. SageMaker pomaga teraz klientom wdrażać wiele modeli w tej samej instancji, dzięki czemu mogą współdzielić zasoby obliczeniowe, redukując koszty wnioskowania średnio o 50%. SageMaker aktywnie monitoruje również instancje przetwarzające żądania wnioskowania i inteligentnie kieruje żądania w oparciu o dostępne instancje, osiągając średnio o 20% mniejsze opóźnienie wnioskowania. Ze względu na te optymalizacje wnioskowania firmy Conjecture, Salesforce i Slack korzystają już z SageMaker do hostowania modeli.

Środkowa warstwa stosu: Amazon Bedrock dodaje nowe modele, a fala nowych możliwości jeszcze bardziej ułatwia klientom bezpieczne tworzenie i skalowanie generatywnych aplikacji AI

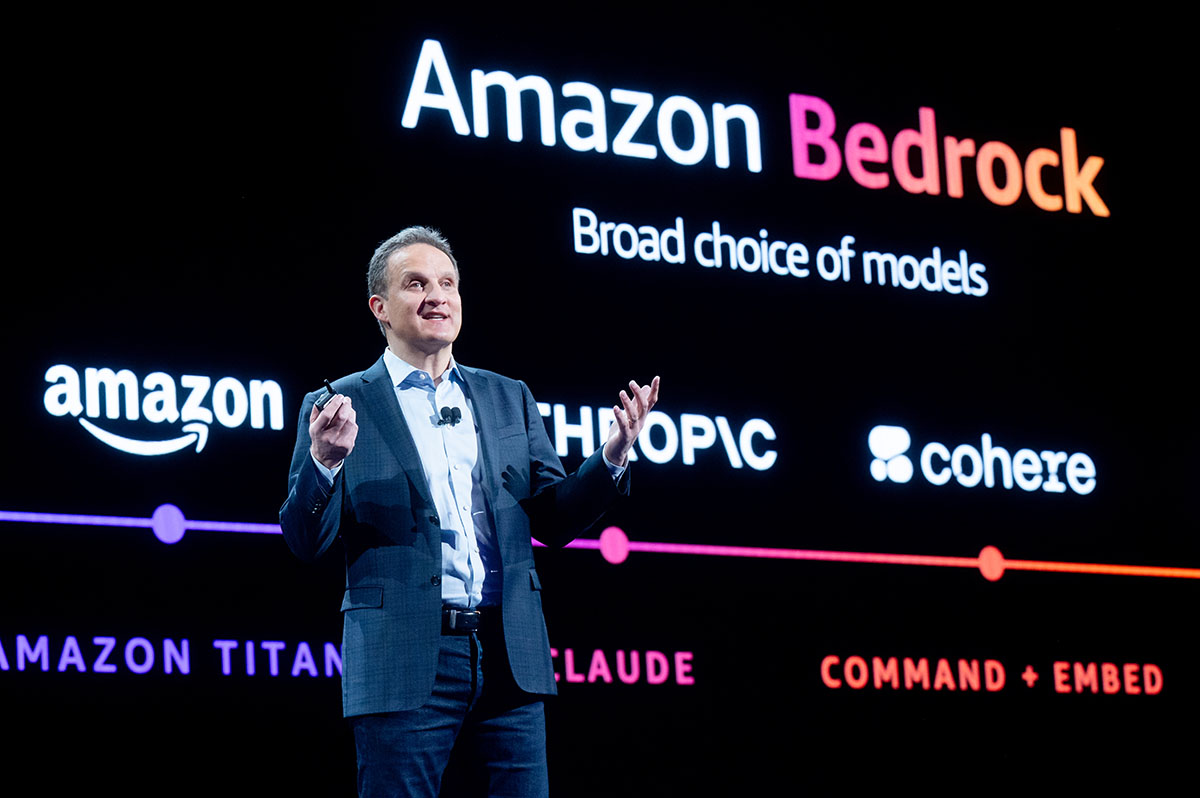

Chociaż wielu klientów zbuduje własne LLM i inne FM lub rozwinie dowolną liczbę publicznie dostępnych opcji, wielu nie będzie chciało poświęcać na to zasobów i czasu. Dla nich środkowa warstwa stosu oferuje te modele jako usługę. Nasze rozwiązanie tutaj, Amazońska skała macierzysta, pozwala klientom wybierać spośród wiodących w branży modeli Anthropic, Stability AI, Meta, Cohere, AI21 i Amazon, dostosowywać je przy użyciu własnych danych i korzystać z tych samych wiodących zabezpieczeń, kontroli dostępu i funkcji, do których są przyzwyczajeni w AWS — wszystko poprzez usługę zarządzaną. Pod koniec września udostępniliśmy usługę Amazon Bedrock ogólnie i reakcja klientów była w przeważającej mierze pozytywna. Klienci z całego świata i praktycznie każdej branży są podekscytowani możliwością korzystania z Amazon Bedrock. Adidas umożliwia programistom uzyskanie szybkich odpowiedzi na wszystko, od informacji „na początek” po bardziej szczegółowe pytania techniczne. Booking.com zamierza wykorzystywać generatywną sztuczną inteligencję do tworzenia rekomendacji podróży dostosowanych do potrzeb każdego klienta. Bridgewater Associates opracowuje opartego na LLM asystenta analityka inwestycyjnego, który pomaga w generowaniu wykresów, obliczaniu wskaźników finansowych i podsumowywaniu wyników. Carrier udostępnia klientom bardziej precyzyjne analizy i spostrzeżenia dotyczące energii, dzięki czemu mogą zmniejszyć zużycie energii i emisję gazów cieplarnianych. Clariant udostępnia członkom swojego zespołu wewnętrznego chatbota generującego sztuczną inteligencję, który przyspiesza procesy badawczo-rozwojowe, wspiera zespoły sprzedaży w przygotowywaniu spotkań i automatyzuje wiadomości e-mail od klientów. GoDaddy pomaga klientom łatwo zakładać firmy online, wykorzystując generatywną sztuczną inteligencję do tworzenia witryn internetowych, znajdowania dostawców, nawiązywania kontaktu z klientami i nie tylko. Lexis Nexis Legal & Professional przekształca pracę prawników prawników i zwiększa ich produktywność dzięki funkcjom wyszukiwania konwersacyjnego, podsumowywania oraz opracowywania i analizy dokumentów Lexis+ AI. Nasdaq pomaga zautomatyzować przebieg dochodzeń w sprawie podejrzanych transakcji oraz wzmacniać swoje możliwości w zakresie zwalczania przestępczości finansowej i nadzoru. Wszystkie te – i wiele innych – różnorodnych aplikacji generatywnej sztucznej inteligencji działają na platformie AWS.

Jesteśmy podekscytowani tempem rozwoju Amazon Bedrock, ale to dopiero początek. Pracując z klientami, zaobserwowaliśmy, że wszyscy poruszają się szybko, ale ewolucja generatywnej sztucznej inteligencji postępuje w szybkim tempie, a nowe opcje i innowacje pojawiają się praktycznie codziennie. Klienci przekonują się, że istnieją różne modele, które sprawdzają się lepiej w różnych przypadkach użycia lub na różnych zestawach danych. Niektóre modele świetnie nadają się do podsumowań, inne świetnie nadają się do wnioskowania i integracji, a jeszcze inne oferują naprawdę niesamowitą obsługę językową. Do tego dochodzi generowanie obrazów, przypadki użycia wyszukiwania i wiele więcej — wszystko to pochodzi zarówno z modeli zastrzeżonych, jak i modeli dostępnych publicznie dla każdego. A w czasach, gdy jest tak wiele niepoznawanych, umiejętność adaptacji jest prawdopodobnie najcenniejszym narzędziem ze wszystkich. Nie będzie jednego modelu, który rządziłby wszystkimi. I na pewno nie tylko jedna firma technologiczna dostarczająca modele, z których wszyscy korzystają. Klienci muszą wypróbowywać różne modele. Muszą mieć możliwość przełączania się między nimi lub łączenia ich w ramach tego samego przypadku użycia. Oznacza to, że potrzebują prawdziwego wyboru dostawców modeli (co wydarzenia ostatnich 10 dni jeszcze bardziej uwydatniły). Właśnie dlatego wynaleźliśmy Amazon Bedrock, dlaczego tak głęboko rezonuje on z klientami i dlaczego nadal wprowadzamy innowacje i szybko wprowadzamy kolejne iteracje, aby budowanie (i poruszanie się pomiędzy) szeregiem modeli było tak proste jak wywołanie API, wykorzystując najnowsze techniki do dostosowywania modelu w rękach wszystkich programistów i zapewnia bezpieczeństwo klientów i prywatność ich danych. Z radością przedstawiamy kilka nowych funkcji, które jeszcze bardziej ułatwią klientom tworzenie i skalowanie generatywnych aplikacji AI:

- Rozszerzenie wyboru modeli o Anthropic Claude 2.1, Meta Llama 2 70B i dodatki do rodziny Amazon Titan. Na początku klienci wciąż uczą się i eksperymentują z różnymi modelami, aby określić, którego chcą używać do różnych celów. Chcą mieć możliwość łatwego wypróbowania najnowszych modeli, a także przetestowania, aby sprawdzić, które możliwości i funkcje zapewnią im najlepsze wyniki i charakterystykę kosztową w ich przypadkach użycia. Dzięki Amazon Bedrock klienci są tylko o jedno wywołanie API od nowego modelu. Niektóre z najbardziej imponujących wyników, jakie klienci osiągnęli w ciągu ostatnich kilku miesięcy, pochodzą z uczelni LLM Model Claude firmy Anthropic, który wyróżnia się w szerokim zakresie zadań, od wyrafinowanych dialogów i generowania treści po złożone rozumowanie, przy jednoczesnym zachowaniu wysokiego stopnia niezawodności i przewidywalności. Klienci zgłaszają, że Claude jest znacznie mniej podatny na generowanie szkodliwych wyników, jest łatwiejszy w rozmowie i łatwiejszy w sterowaniu w porównaniu z innymi FM, dzięki czemu programiści mogą uzyskać pożądany efekt przy mniejszym wysiłku. Najnowocześniejszy model firmy Anthropic, Claude 2, osiąga wyniki powyżej 90. percentyla w egzaminach GRE z czytania i pisania, a także w zakresie rozumowania ilościowego. I teraz nowo wydany model Claude 2.1 jest dostępny w Amazon Bedrock. Claude 2.1 zapewnia kluczowe funkcje dla przedsiębiorstw, takie jak wiodące w branży okno kontekstowe tokenów o pojemności 200 tys. (2 razy więcej niż kontekst Claude 2.0), zmniejszony współczynnik halucynacji i znaczna poprawa dokładności, nawet przy bardzo długich kontekstach. Claude 2.1 zawiera także ulepszone podpowiedzi systemowe – będące modelowymi instrukcjami zapewniającymi lepsze doświadczenia użytkownikom końcowym – jednocześnie zmniejszając koszt podpowiedzi i uzupełnień o 25%.

Dla rosnącej liczby klientów, którzy chcą korzystać z zarządzanej wersji publicznie dostępnego modelu Llama 2 firmy Meta, Amazon Bedrock oferuje Llama 2 13B i dodajemy Lamę 2 70B. Lama 2 70B nadaje się do zadań na dużą skalę, takich jak modelowanie języka, generowanie tekstu i systemy dialogowe. Publicznie dostępne modele Llama zostały pobrane ponad 30 milionów razy, a klientom podoba się to, że Amazon Bedrock oferuje je w ramach usługi zarządzanej, dzięki której nie muszą martwić się o infrastrukturę ani mieć głębokiej wiedzy w zakresie uczenia maszynowego w swoich zespołach. Dodatkowo do generowania obrazów Stability AI oferuje zestaw popularnych modeli zamiany tekstu na obraz. Najbardziej zaawansowanym z nich jest Stable Diffusion XL 1.0 (SDXL 1.0), który jest obecnie ogólnie dostępny w Amazon Bedrock. Najnowsza edycja tego popularnego modelu obrazu charakteryzuje się zwiększoną dokładnością, lepszym fotorealizmem i wyższą rozdzielczością.

Klienci też korzystają Amazon Tytan modele, które są tworzone i wstępnie trenowane przez AWS, aby oferować potężne możliwości przy doskonałej ekonomii dla różnych przypadków użycia. Amazon ma 25-letnie doświadczenie w zakresie uczenia maszynowego i sztucznej inteligencji – technologii, których używamy w naszych firmach – i wiele się nauczyliśmy na temat tworzenia i wdrażania modeli. Starannie wybraliśmy sposób uczenia naszych modeli i dane, których w tym celu używamy. Zabezpieczamy klientów przed roszczeniami, że nasze modele lub ich produkty naruszają czyjeś prawa autorskie. Nasze pierwsze modele Titan wprowadziliśmy na rynek w kwietniu tego roku. Tekst Tytana Lite— obecnie ogólnie dostępne— to zwięzły, opłacalny model do zastosowań takich jak chatboty, podsumowania tekstu lub copywriting, który również wymaga dopracowania. Titan Text Express — teraz także ogólnie dostępny—jest bardziej rozbudowany i może być używany do szerszego zakresu zadań tekstowych, takich jak generowanie tekstu otwartego i czat konwersacyjny. Oferujemy te opcje modeli tekstowych, aby zapewnić klientom możliwość optymalizacji pod kątem dokładności, wydajności i kosztów w zależności od ich przypadku użycia i wymagań biznesowych. Klienci tacy jak Nexxiot, PGA Tour i Ryanair korzystają z naszych dwóch modeli Titan Text. Mamy również model osadzania, Titan Text Embeddings, do zastosowań związanych z wyszukiwaniem i personalizacją. Klienci tacy jak Nasdaq zauważają świetne wyniki dzięki osadzaniu tekstu Titan w celu zwiększenia możliwości Nasdaq IR Insight w zakresie generowania spostrzeżeń z dokumentów ponad 9,000 globalnych firm dla zespołów ds. zrównoważonego rozwoju, prawnych i księgowych. Z czasem będziemy dodawać kolejne modele do rodziny Titan. Wprowadzamy nowy model osadzania, Titan Multimodal Embeddings, aby zapewnić użytkownikom wielomodalne możliwości wyszukiwania i rekomendacji korzystających z obrazów i tekstu (lub ich kombinacji) jako danych wejściowych. I my jesteśmy wprowadzenie nowego modelu zamiany tekstu na obraz, Amazon Titan Image Generator. Dzięki Titan Image Generator klienci z różnych branż, takich jak reklama, handel elektroniczny, media i rozrywka, mogą używać wprowadzania tekstu do generowania realistycznych obrazów o studyjnej jakości w dużych nakładach i przy niskich kosztach. Jesteśmy podekscytowani tym, jak klienci reagują na Titan Models i możesz oczekiwać, że będziemy w dalszym ciągu wprowadzać innowacje.

- Nowe możliwości bezpiecznego dostosowywania aplikacji generatywnej AI przy użyciu zastrzeżonych danych: Jedną z najważniejszych możliwości Amazon Bedrock jest łatwość dostosowania modelu. Staje się to naprawdę ekscytujące dla klientów, ponieważ w tym miejscu generatywna sztuczna inteligencja spotyka się z ich głównym wyróżnikiem – danymi. Jednak naprawdę ważne jest, aby ich dane pozostały bezpieczne, aby miały nad nimi kontrolę i aby ulepszenia modelu były dla nich prywatne. Można to zrobić na kilka sposobów, a Amazon Bedrock oferuje najszerszy wybór opcji dostosowywania w wielu modelach). Pierwszym z nich jest precyzyjne strojenie. Dostrojenie modelu w Amazon Bedrock jest łatwe. Po prostu wybierasz model, a Amazon Bedrock tworzy jego kopię. Następnie wskazujesz kilka oznaczonych etykietami przykładów (np. serię dobrych par pytanie-odpowiedź), które przechowujesz w Amazon Simple Storage Service (Amazon S3), a Amazon Bedrock „przyrostowo trenuje” (rozbudowuje skopiowany model o nowe informacje) na tych przykładach, a w rezultacie powstał prywatny, dokładniejszy, dopracowany model, który zapewnia trafniejsze, dostosowane odpowiedzi. Z radością ogłaszamy, że dostrajanie jest ogólnie dostępne dla Cohere Command, Meta Llama 2, Amazon Titan Text (Lite i Express), Amazon Titan Multimodal Embeddings oraz w wersji zapoznawczej dla Amazon Titan Image Generator. Dzięki naszej współpracy z Anthropic wkrótce zapewnimy klientom AWS wcześniejszy dostęp do unikalnych funkcji umożliwiających dostosowywanie i dostrajanie najnowocześniejszego modelu Claude.

Drugą techniką dostosowywania LLM i innych FM do potrzeb Twojej firmy jest generowanie rozszerzone wyszukiwania (RAG), które pozwala dostosować odpowiedzi modelu poprzez uzupełnienie podpowiedzi danymi z wielu źródeł, w tym repozytoriów dokumentów, baz danych i interfejsów API. We wrześniu wprowadziliśmy funkcję RAG, Bazy wiedzy dla Amazon Bedrock, która bezpiecznie łączy modele z zastrzeżonymi źródłami danych, aby uzupełniać podpowiedzi większą ilością informacji, dzięki czemu Twoje aplikacje zapewniają bardziej trafne, kontekstowe i dokładne odpowiedzi. Bazy wiedzy jest teraz ogólnie dostępny z interfejsem API, który wykonuje cały przepływ pracy RAG od pobrania tekstu potrzebnego do rozszerzenia podpowiedzi, wysłania podpowiedzi do modelu i zwrócenia odpowiedzi. Bazy wiedzy obsługują bazy danych z funkcjami wektorowymi, które przechowują reprezentacje numeryczne Twoich danych (osadzenia), których modele używają do uzyskiwania dostępu do tych danych dla RAG, w tym Amazon OpenSearch Service i inne popularne bazy danych, takie jak Pinecone i Redis Enterprise Cloud (obsługa wektorów Amazon Aurora i MongoDB będzie wkrótce dostępna Wkrótce).

Trzeci sposób dostosowywania modeli w Amazon Bedrock polega na ciągłym szkoleniu wstępnym. Dzięki tej metodzie model opiera się na oryginalnym szkoleniu wstępnym dotyczącym ogólnego rozumienia języka w celu nauki języka i terminologii specyficznej dla danej dziedziny. To podejście jest przeznaczone dla klientów, którzy dysponują dużymi zasobami nieoznaczonych, specyficznych dla domeny informacji i chcą umożliwić swoim menedżerom LLM zrozumienie języka, wyrażeń, skrótów, pojęć, definicji i żargonu charakterystycznego dla ich świata (i biznesu). W odróżnieniu od dostrajania, które wymaga niewielkiej ilości danych, ciągłe uczenie wstępne przeprowadzane jest na dużych zbiorach danych (np. tysiącach dokumentów tekstowych). Teraz w Amazon Bedrock dostępne są funkcje wstępnego szkolenia dla Titan Text Lite i Titan Text Express.

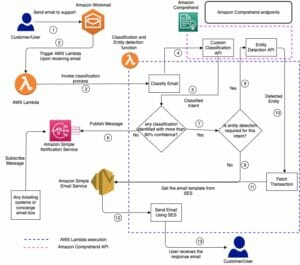

- Ogólna dostępność Agenci Amazon Bedrock aby pomóc w realizacji wieloetapowych zadań z wykorzystaniem systemów, źródeł danych i wiedzy firmy. Firmy LLM świetnie radzą sobie z prowadzeniem rozmów i generowaniem treści, ale klienci chcą, aby ich aplikacje to umożliwiały do jeszcze więcej — na przykład podejmowanie działań, rozwiązywanie problemów i interakcja z szeregiem systemów w celu wykonywania wieloetapowych zadań, takich jak rezerwacja podróży, zgłaszanie roszczeń ubezpieczeniowych lub zamawianie części zamiennych. Amazon Bedrock może pomóc w tym wyzwaniu. W przypadku agentów programiści wybierają model, piszą kilka podstawowych instrukcji typu „jesteś wesołym agentem obsługi klienta” i „sprawdź dostępność produktu w systemie magazynowym”, kieruj wybrany model do odpowiednich źródeł danych i systemów korporacyjnych (np. CRM lub aplikacje ERP) i napisać kilka funkcji AWS Lambda w celu wykonania API (np. sprawdzenie dostępności pozycji w magazynie ERP). Amazon Bedrock automatycznie analizuje żądanie i dzieli je na logiczną sekwencję, korzystając z możliwości wnioskowania wybranego modelu, aby określić, jakie informacje są potrzebne, jakie interfejsy API wywołać i kiedy je wywołać, aby ukończyć krok lub rozwiązać zadanie. Teraz ogólnie dostępni agenci mogą planować i wykonywać większość zadań biznesowych — od odpowiadania na pytania klientów dotyczące dostępności produktu po przyjmowanie zamówień — a programiści nie muszą znać uczenia maszynowego, podpowiedzi inżynierskich, trenować modeli ani ręcznie łączyć systemów. Bedrock robi to wszystko bezpiecznie i prywatnie, a klienci tacy jak Druva i Athene już z nich korzystają, aby poprawić dokładność i szybkość tworzenia swoich generatywnych aplikacji AI.

- wprowadzenie Poręcze dla Amazon Bedrock dzięki czemu możesz zastosować zabezpieczenia w oparciu o wymagania dotyczące przypadków użycia i odpowiedzialne zasady sztucznej inteligencji. Klienci chcą mieć pewność, że interakcje z ich aplikacjami AI są bezpieczne, unikają toksycznego lub obraźliwego języka, pozostają istotne dla ich działalności i są zgodne z ich odpowiedzialnymi politykami dotyczącymi sztucznej inteligencji. Dzięki poręczom klienci mogą określić tematy, których należy unikać, a Amazon Bedrock zapewni użytkownikom jedynie zatwierdzone odpowiedzi na pytania, które mieszczą się w tych zastrzeżonych kategoriach. Na przykład aplikację bankowości internetowej można skonfigurować tak, aby unikać udzielania porad inwestycyjnych i usuwać nieodpowiednie treści (takie jak mowa nienawiści i przemoc). Na początku 2024 r. klienci będą mogli także redagować dane osobowe (PII) w odpowiedziach modelowych. Na przykład po interakcji klienta z agentem call center rozmowa z obsługą klienta jest często podsumowywana w celu prowadzenia rejestrów, a poręcze mogą usunąć informacje umożliwiające identyfikację z tych podsumowań. Poręcze ochronne mogą być używane w różnych modelach w Amazon Bedrock (w tym w modelach dopracowanych) oraz z agentami dla Amazon Bedrock, dzięki czemu klienci mogą zapewnić stały poziom ochrony wszystkim swoim generatywnym aplikacjom AI.

Górna warstwa stosu: ciągłe innowacje sprawiają, że generatywna sztuczna inteligencja jest dostępna dla większej liczby użytkowników

Na najwyższej warstwie stosu znajdują się aplikacje wykorzystujące LLM i inne FM, dzięki czemu możesz korzystać z generatywnej sztucznej inteligencji w pracy. Jednym z obszarów, w którym generatywna sztuczna inteligencja już zmienia reguły gry, jest kodowanie. W zeszłym roku wprowadziliśmy Amazon CodeWhisperer, który pomaga szybciej i bezpieczniej tworzyć aplikacje, generując sugestie i rekomendacje dotyczące kodu w czasie zbliżonym do rzeczywistego. Klienci tacy jak Accenture, Boeing, Bundesliga, The Cigna Group, Kone i Warner Music Group używają CodeWhisperer do zwiększania produktywności programistów, a Accenture umożliwia korzystanie z Amazon CodeWhisperer nawet 50,000 XNUMX swoich programistów i specjalistów IT. Chcemy, aby jak najwięcej programistów mogło czerpać korzyści z produktywności generatywnej sztucznej inteligencji, dlatego CodeWhisperer oferuje bezpłatne rekomendacje wszystkim osobom.

Jednakże, chociaż narzędzia do kodowania AI w dużym stopniu ułatwiają życie programistom, ich korzyści w zakresie produktywności są ograniczone przez brak wiedzy na temat wewnętrznych baz kodu, wewnętrznych interfejsów API, bibliotek, pakietów i klas. Można o tym pomyśleć: jeśli zatrudnisz nowego programistę, nawet jeśli jest on światowej klasy, nie będzie on tak produktywny w Twojej firmie, dopóki nie zrozumie Twoich najlepszych praktyk i kodu. Dzisiejsze narzędzia do kodowania oparte na sztucznej inteligencji działają jak nowozatrudniony programista. Aby w tym pomóc, niedawno udostępniliśmy podgląd nowego możliwość dostosowywania w Amazon CodeWhisperer, który w bezpieczny sposób wykorzystuje wewnętrzną bazę kodu klienta, aby zapewnić bardziej trafne i przydatne rekomendacje dotyczące kodu. Dzięki tej możliwości CodeWhisperer jest ekspertem w dziedzinie Twój kodu i dostarcza rekomendacji, które są trafniejsze i pozwalają zaoszczędzić jeszcze więcej czasu. W badaniu przeprowadzonym z Persistent, globalną firmą zajmującą się inżynierią cyfrową i modernizacją przedsiębiorstw, odkryliśmy, że dostosowania pomagają programistom wykonywać zadania nawet o 28% szybciej niż w przypadku ogólnych możliwości CodeWhisperer. Teraz programista w firmie zajmującej się technologią medyczną może poprosić CodeWhisperer o „zaimportowanie obrazów MRI powiązanych z identyfikatorem klienta i poddanie ich przez klasyfikator obrazów” w celu wykrycia anomalii. Ponieważ CodeWhisperer ma dostęp do bazy kodów, może dostarczyć znacznie trafniejsze sugestie, które obejmują lokalizacje importu obrazów MRI i identyfikatory klientów. CodeWhisperer zapewnia całkowitą prywatność dostosowań, a bazowy FM nie wykorzystuje ich do celów szkoleniowych, chroniąc cenną własność intelektualną klientów. AWS jest jedynym dużym dostawcą usług w chmurze, który oferuje każdemu taką możliwość.

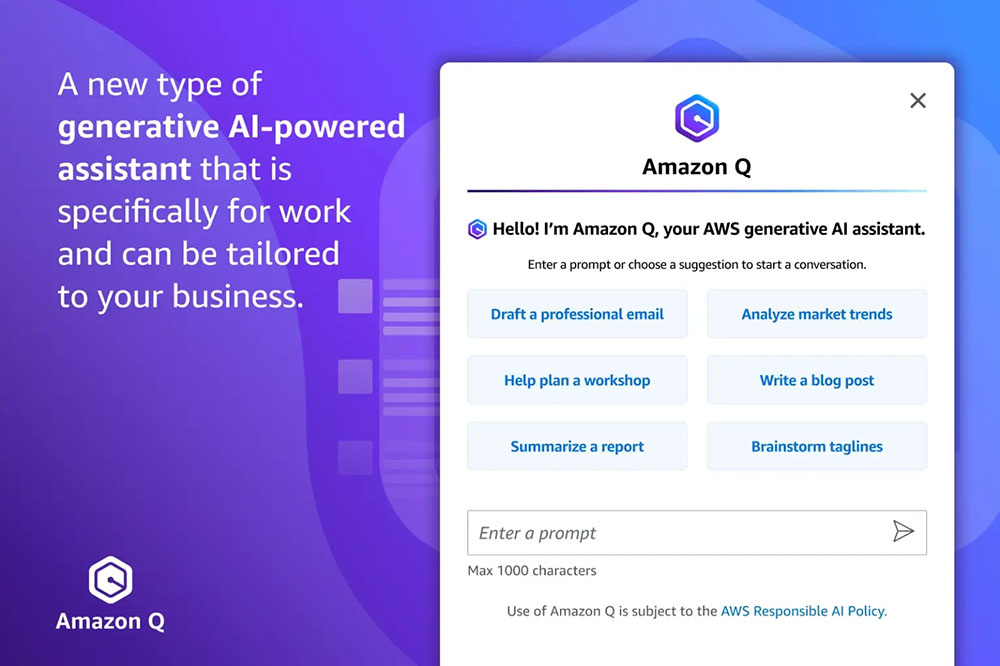

wprowadzenie Amazonka Q, generatywny asystent oparty na sztucznej inteligencji, dostosowany do pracy

Programiści z pewnością nie są jedynymi, którzy mają kontakt z generatywną sztuczną inteligencją — miliony ludzi korzystają z aplikacji do czatowania z generatywną sztuczną inteligencją. To, co pierwsi dostawcy zrobili w tej przestrzeni, jest ekscytujące i niezwykle przydatne dla konsumentów, ale pod wieloma względami nie do końca „działa” w pracy. Ich ogólna wiedza i możliwości są ogromne, ale nie znają Twojej firmy, Twoich danych, Twoich klientów, Twoich operacji ani Twojej firmy. To ogranicza zakres, w jakim mogą Ci pomóc. Nie wiedzą też zbyt wiele o Twojej roli – jaką pracę wykonujesz, z kim współpracujesz, jakich informacji używasz i do czego masz dostęp. Te ograniczenia są zrozumiałe, ponieważ ci asystenci nie mają dostępu do prywatnych informacji Twojej firmy i nie zostali zaprojektowani tak, aby spełniać wymagania dotyczące prywatności i bezpieczeństwa danych, które firmy muszą zapewnić im taki dostęp. Trudno po fakcie założyć zabezpieczenia i oczekiwać, że będą działać dobrze. Uważamy, że mamy lepszy sposób, który pozwoli każdej osobie w każdej organizacji bezpiecznie wykorzystywać generatywną sztuczną inteligencję w codziennej pracy.

Wz przyjemnością przedstawiamy Amazon Q, nowy typ generatywnego asystenta opartego na sztucznej inteligencji, który jest specjalnie przeznaczony do pracy i można go dostosować do Twojej firmy. Q może pomóc Ci uzyskać szybkie, trafne odpowiedzi na palące pytania, rozwiązać problemy, wygenerować treść i podjąć działania, korzystając z danych i wiedzy specjalistycznej znajdującej się w repozytoriach informacji Twojej firmy, kodzie i systemach korporacyjnych. Kiedy rozmawiasz z Amazon Q, zapewnia ona natychmiastowe, istotne informacje i porady, które pomagają usprawnić zadania, przyspieszyć podejmowanie decyzji oraz pobudzić kreatywność i innowacyjność w pracy. Stworzyliśmy usługę Amazon Q tak, aby była bezpieczna i prywatna, a także potrafiła rozumieć i szanować Twoje istniejące tożsamości, role i uprawnienia oraz wykorzystywać te informacje do personalizacji swoich interakcji. Jeśli użytkownik nie ma uprawnień dostępu do pewnych danych bez Q, nie będzie mógł uzyskać do nich dostępu również przy użyciu Q. Zaprojektowaliśmy Amazon Q tak, aby od pierwszego dnia spełniać rygorystyczne wymagania klientów korporacyjnych — żadna zawartość nie jest wykorzystywana do ulepszania podstawowych modeli.

Amazon Q to Twój kompetentny asystent do budowania na AWS: Szkolimy firmę Amazon Q w oparciu o wiedzę i doświadczenie AWS zdobyte na przestrzeni 17 lat, dzięki czemu może ona zmienić sposób, w jaki budujesz, wdrażasz i obsługujesz aplikacje oraz obciążenia w AWS. Amazon Q ma interfejs czatu w konsoli zarządzania AWS i dokumentacji, Twoje IDE (przez CodeWhisperer) i pokoje rozmów Twojego zespołu na Slacku lub innych aplikacjach do czatowania. Amazon Q może pomóc Ci odkryć nowe możliwości AWS, szybciej rozpocząć pracę, poznać nieznane technologie, opracować rozwiązania, rozwiązywać problemy, aktualizować i wiele więcej — jest ekspertem w zakresie dobrze zaprojektowanych wzorców AWS, najlepszych praktyk, dokumentacji i wdrożeń rozwiązań. Oto kilka przykładów tego, co możesz zrobić z nowym asystentem eksperta AWS:

- Uzyskaj jasne odpowiedzi i wskazówki dotyczące możliwości, usług i rozwiązań AWS: Poproś Amazon Q, aby „Opowiedział mi o agentach Amazon Bedrock”, a Q przekaże Ci opis tej funkcji wraz z linkami do odpowiednich materiałów. Możesz także zadać Amazon Q praktycznie dowolne pytanie dotyczące działania usługi AWS (np. „Jakie są limity skalowania tabeli DynamoDB?”, „Co to jest zarządzana pamięć masowa Redshift?”) lub jak najlepiej zaprojektować dowolną liczbę rozwiązań ( „Jakie są najlepsze praktyki w zakresie budowania architektur sterowanych zdarzeniami?”). Amazon Q będzie zbierać zwięzłe odpowiedzi i zawsze powoływać się na źródła (oraz linki do nich).

- Wybierz najlepszą usługę AWS dla swojego przypadku użycia i szybko rozpocznij pracę: Zapytaj Amazon Pytanie: „Jakie są sposoby tworzenia aplikacji internetowej na platformie AWS? ” i wyświetli listę potencjalnych usług, takich jak Wzmocnienie AWS, AWS Lambda, Amazon EC2 z zaletami każdego z nich. W tym miejscu możesz zawęzić opcje, pomagając Q zrozumieć Twoje wymagania, preferencje i ograniczenia (np. „Które z nich będą najlepsze, jeśli chcę używać kontenerów?” lub „Czy powinienem używać relacyjnej czy nierelacyjnej bazy danych? ”). Zakończ pytaniem „Jak zacząć?” i Amazon Q przedstawią kilka podstawowych kroków i wskażą dodatkowe zasoby.

- Zoptymalizuj swoje zasoby obliczeniowe: Amazon Q może pomóc Ci wybrać instancje Amazon EC2. Jeśli poprosisz go o „Pomóż mi znaleźć odpowiednią instancję EC2 do wdrożenia obciążenia związanego z kodowaniem wideo dla mojej aplikacji do gier o najwyższej wydajności”, Q wyświetli listę rodzin instancji z uzasadnieniem każdej sugestii. Możesz także zadać dowolną liczbę pytań uzupełniających, aby znaleźć najlepszy wybór dla swojego obciążenia pracą.

- Uzyskaj pomoc w debugowaniu, testowaniu i optymalizacji kodu: Jeśli napotkasz błąd podczas kodowania w swoim IDE, możesz poprosić Amazon Q o pomoc, mówiąc: „W moim kodzie występuje błąd IO, czy możesz zapewnić poprawkę?” a Q wygeneruje dla Ciebie kod. Jeśli podoba Ci się ta sugestia, możesz poprosić Amazon Q o dodanie poprawki do Twojej aplikacji. Ponieważ Amazon Q znajduje się w Twoim IDE, rozumie kod, nad którym pracujesz i wie, gdzie wstawić poprawkę. Amazon Q może także tworzyć testy jednostkowe („Napisz testy jednostkowe dla wybranej funkcji”), które wstawia do Twojego kodu i możesz je uruchomić. Wreszcie Amazon Q może podpowiedzieć Ci, jak zoptymalizować kod w celu uzyskania wyższej wydajności. Poproś Q, aby „zoptymalizował wybrane zapytanie DynamoDB”, a na podstawie zrozumienia Twojego kodu przedstawi sugestię w języku naturalnym dotyczącą tego, co należy poprawić, wraz z towarzyszącym kodem, który możesz zaimplementować jednym kliknięciem.

- Diagnozowanie i rozwiązywanie problemów: Jeśli napotkasz problemy w konsoli zarządzania AWS, takie jak błędy uprawnień EC2 lub błędy konfiguracji Amazon S3, możesz po prostu nacisnąć przycisk „Rozwiązywanie problemów z Amazon Q”, a aplikacja wykorzysta swoją wiedzę na temat rodzaju błędu i usługi, w której znajduje się błąd aby przekazać sugestie dotyczące rozwiązania. Możesz nawet poprosić Amazon Q o rozwiązywanie problemów z Twoją siecią (np. „Dlaczego nie mogę połączyć się z moją instancją EC2 przy użyciu SSH?”), a Q przeanalizuje Twoją kompleksową konfigurację i przedstawi diagnozę (np. „Ta instancja wygląda na to, że znajduje się w prywatnej podsieci, więc może być konieczne zapewnienie dostępności publicznej”).

- Błyskawiczne wdrożenie nowej bazy kodu: Kiedy rozmawiasz z Amazon Q w swoim IDE, łączy on swoją wiedzę w zakresie tworzenia oprogramowania ze zrozumieniem Twojego kodu – to potężne połączenie! Wcześniej, jeśli przejmowałeś projekt od kogoś innego lub byłeś nowy w zespole, konieczne mogło być spędzanie godzin na ręcznym przeglądaniu kodu i dokumentacji, aby zrozumieć, jak to działa i do czego służy. Teraz, ponieważ Amazon Q rozumie kod w Twoim IDE, możesz po prostu poprosić Amazon Q o wyjaśnienie kodu („Dostarcz mi opis tego, co robi ta aplikacja i jak działa”), a Q poda Ci szczegółowe informacje, takie jak usługi, które obsługuje kod używa i jakie funkcje pełnią (np. Q może odpowiedzieć coś w stylu: „Ta aplikacja tworzy podstawowy system zgłoszeń pomocy technicznej przy użyciu Python Flask i AWS Lambda”, a następnie opisać każdą z jej podstawowych możliwości oraz sposób ich implementacji, i wiele więcej).

- Szybciej usuwaj zaległości w zakresie funkcji: Możesz nawet poprosić Amazon Q, aby poprowadził Cię przez cały proces dodawania funkcji do aplikacji i zautomatyzował większość jego kompleksowego procesu. Amazon CodeCatalyst, nasza ujednolicona usługa tworzenia oprogramowania dla zespołów. Aby to zrobić, po prostu przypisz Q zadanie z listy problemów – tak jak zrobiłbyś to z członkiem zespołu – a Q wygeneruje szczegółowy plan budowania i wdrażania tej funkcji. Po zatwierdzeniu planu Q napisze kod i przedstawi sugerowane zmiany w formie przeglądu kodu. Możesz poprosić o przeróbkę (jeśli to konieczne), zatwierdzić i/lub wdrożyć!

- Uaktualnij swój kod w ułamku sekundy: Większość programistów tak naprawdę spędza tylko ułamek swojego czasu na pisaniu nowego kodu i budowaniu nowych aplikacji. Dużo więcej cykli spędzają na bolesnych, powolnych obszarach, takich jak konserwacja i aktualizacje. Skorzystaj z aktualizacji wersji językowych. Duża liczba klientów w dalszym ciągu korzysta ze starszych wersji języka Java, ponieważ aktualizacja zajmie miesiące, a nawet lata i tysiące godzin pracy programistów. Odkładanie tego na później wiąże się z realnymi kosztami i ryzykiem — tracisz możliwość poprawy wydajności i jesteś podatny na problemy związane z bezpieczeństwem. Uważamy, że Amazon Q może zmienić zasady gry i jesteśmy tym podekscytowani Transformacja kodu Amazon Q, to funkcja, która może usunąć większość tego ciężkiego zadania i skrócić czas potrzebny na aktualizację aplikacji z dni do minut. Po prostu otwierasz kod, który chcesz zaktualizować w swoim IDE i prosisz Amazon Q o „/transformację” Twojego kodu. Amazon Q przeanalizuje cały kod źródłowy aplikacji, wygeneruje kod w docelowym języku i wersji oraz przeprowadzi testy, pomagając Ci uświadomić sobie ulepszenia bezpieczeństwa i wydajności najnowszych wersji językowych. Niedawno bardzo mały zespół programistów firmy Amazon wykorzystał technologię Amazon Q Code Transformation do aktualizacji 1,000 aplikacji produkcyjnych z Java 8 do Java 17 w ciągu zaledwie dwóch dni. Średni czas na aplikację wynosił mniej niż 10 minut. Dzisiaj Amazon Q Code Transformation przeprowadza aktualizacje języka Java z Java 8 lub Java 11 do Java 17. W następnej kolejności (i wkrótce) pojawi się możliwość przekształcenia .NET Framework w wieloplatformową platformę .NET (z jeszcze większą liczbą transformacji w przyszłości). .

Amazon Q to Twój ekspert biznesowy: Możesz połączyć Amazon Q z danymi biznesowymi, informacjami i systemami, aby mógł wszystko zsyntetyzować i zapewnić dostosowaną do potrzeb pomoc, aby pomóc ludziom rozwiązywać problemy, generować treści i podejmować działania istotne dla Twojej firmy. Wprowadzenie Amazon Q do Twojej firmy jest łatwe. Posiada ponad 40 wbudowanych złączy do popularnych systemów korporacyjnych, takich jak Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive i Zendesk. Może także łączyć się z wewnętrznym intranetem, stronami wiki i uruchamiać książki, a dzięki pakietowi Amazon Q SDK możesz nawiązać połączenie z dowolną aplikacją wewnętrzną. Skieruj Amazon Q na te repozytoria, a „przyspieszy” rozwój Twojej firmy, przechwytując i rozumiejąc informacje semantyczne, które czynią Twoją firmę wyjątkową. Następnie otrzymujesz własną, przyjazną i prostą aplikację internetową Amazon Q, dzięki której pracownicy Twojej firmy mogą wchodzić w interakcję z interfejsem konwersacyjnym. Amazon Q łączy się również z Twoim dostawcą tożsamości, aby zrozumieć użytkownika, jego rolę i systemy, do których ma dostęp, dzięki czemu użytkownicy mogą zadawać szczegółowe, dopracowane pytania i uzyskiwać dostosowane wyniki, które obejmują tylko te informacje, do których są upoważnieni. Amazon Q generuje odpowiedzi i spostrzeżenia, które są dokładne i wierne dostarczonym materiałom i wiedzy. Możesz też ograniczyć drażliwe tematy, zablokować słowa kluczowe lub odfiltrować nieodpowiednie pytania i odpowiedzi. Oto kilka przykładów tego, co możesz zrobić dzięki nowemu asystentowi-ekspertowi w Twojej firmie:

- Uzyskaj jasne, niezwykle trafne odpowiedzi na podstawie danych i informacji biznesowych: Pracownicy mogą pytać Amazon Q o wszystko, czego wcześniej musieli szukać we wszelkiego rodzaju źródłach. Zapytaj „Jakie są najnowsze wytyczne dotyczące używania logo?” lub „Jak ubiegać się o firmową kartę kredytową?”, a Amazon Q dokona syntezy wszystkich istotnych treści, które znajdzie, i wróci z szybkimi odpowiedziami oraz linkami do odpowiednich źródła (np. portale marek i repozytoria logo, firmowe zasady T&E i aplikacje kartowe).

- Usprawnij codzienną komunikację: Po prostu zapytaj, a Amazon Q może wygenerować treść („Utwórz wpis na blogu i trzy nagłówki w mediach społecznościowych ogłaszające produkt opisany w tej dokumentacji”), utwórz streszczenia dla kadry kierowniczej („Napisz podsumowanie transkrypcji naszego spotkania z wypunktowaną listą działań” ), dostarczaj aktualizacje e-mailem („Napisz wiadomość e-mail przedstawiającą nasze programy szkoleniowe dla klientów w Indiach na trzeci kwartał”) i pomagaj w organizacji spotkań („Utwórz program spotkań, aby porozmawiać o najnowszym raporcie satysfakcji klienta”).

- Wykonaj zadania: Amazon Q może pomóc w wykonaniu określonych zadań, zmniejszając ilość czasu spędzanego przez pracowników na powtarzalnych zadaniach, takich jak składanie zgłoszeń. Poproś Amazon Q, aby „podsumował opinie klientów na temat nowej oferty cenowej w Slack”, a następnie poproś Q o pobranie tych informacji i otwarcie zgłoszenia w Jira, aby zaktualizować zespół marketingowy. Możesz poprosić Q o „podsumowanie transkrypcji tej rozmowy”, a następnie „Otworzyć nową sprawę dla klienta A w Salesforce”. Amazon Q obsługuje inne popularne narzędzia do automatyzacji pracy, takie jak Zendesk i Service Now.

Amazon Q jest w Amazon QuickSight: Z Amazon Q w QuickSight, usługi analizy biznesowej AWS, użytkownicy mogą zadawać w swoich pulpitach nawigacyjnych pytania typu „Dlaczego liczba zamówień wzrosła w zeszłym miesiącu?” oraz uzyskaj wizualizacje i wyjaśnienia czynników, które wpłynęły na wzrost. Analitycy mogą korzystać z Amazon Q, aby skrócić czas potrzebny na tworzenie dashboardów z dni do minut za pomocą prostego monitu, np. „Pokaż mi sprzedaż według regionu według miesiąca w postaci skumulowanego wykresu słupkowego”. Q natychmiast wraca z tym diagramem i możesz łatwo dodać go do dashboardu lub dalej rozmawiać z Q, aby udoskonalić wizualizację (np. „Zmień wykres słupkowy na diagram Sankeya” lub „Pokaż kraje zamiast regionów”). Amazon Q w QuickSight ułatwia także korzystanie z istniejących pulpitów nawigacyjnych w celu informowania interesariuszy biznesowych, wydobywania kluczowych spostrzeżeń i upraszczania podejmowania decyzji za pomocą historii danych. Na przykład użytkownicy mogą poprosić Amazon Q o „Stworzenie historii o tym, jak zmieniła się firma w ciągu ostatniego miesiąca, do przeglądu biznesowego z udziałem kierownictwa wyższego szczebla”, a w ciągu kilku sekund Amazon Q przedstawi historię opartą na danych, która jest wizualnie przekonująca i całkowicie konfigurowalny. Historie te można bezpiecznie udostępniać w całej organizacji, aby pomóc w dostosowaniu interesariuszy i podejmowaniu lepszych decyzji.

Amazon Q jest w Amazon Connect: W Amazon Connect, naszej usłudze centrum kontaktowego, Amazon Q pomaga agentom obsługi klienta zapewnić lepszą obsługę klienta. Amazon Q wykorzystuje repozytoria wiedzy, z których zazwyczaj korzystają Twoi agenci, aby uzyskać informacje dla klientów, a następnie agenci mogą rozmawiać z Amazon Q bezpośrednio w Connect, aby uzyskać odpowiedzi, które pomogą im szybciej reagować na prośby klientów bez konieczności samodzielnego przeszukiwania dokumentacji. I choć rozmowa z Amazon Q w celu uzyskania superszybkich odpowiedzi jest świetna, w obsłudze klienta nie ma czegoś takiego jak za szybko. Dlatego Amazon Q w połączeniu zamienia rozmowę klienta z agentem na żywo w monit i automatycznie przekazuje agentowi możliwe odpowiedzi, sugerowane działania i linki do zasobów. Na przykład Amazon Q może wykryć, że klient kontaktuje się z wypożyczalnią samochodów w celu zmiany rezerwacji, wygenerować odpowiedź dla agenta, aby szybko poinformować, w jaki sposób obowiązują zasady firmy dotyczące opłat za zmianę, i poprowadzić agenta przez kroki potrzebne do aktualizacji rezerwacja.

Amazon Q jest w łańcuchu dostaw AWS (wkrótce): W AWS Supply Chain, naszej usłudze analizy łańcucha dostaw, Amazon Q pomaga planistom podaży i popytu, menedżerom zapasów i partnerom handlowym optymalizować łańcuch dostaw, podsumowując i podkreślając potencjalne ryzyko braku lub przepełnienia zapasów, a także wizualizując scenariusze rozwiązania problemu. Użytkownicy mogą zadawać Amazon Q pytania „co”, „dlaczego” i „co jeśli” dotyczące danych dotyczących ich łańcucha dostaw oraz rozmawiać na temat złożonych scenariuszy i kompromisów między różnymi decyzjami w łańcuchu dostaw. Na przykład klient może zapytać: „Co powoduje opóźnienia w moich przesyłkach i jak mogę to przyspieszyć?” na co Amazon Q może odpowiedzieć: „90% twoich zamówień znajduje się na wschodnim wybrzeżu, a wielka burza na południowym wschodzie powoduje 24-godzinne opóźnienie. Jeśli wysyłasz do portu w Nowym Jorku zamiast do Miami, przyspieszysz dostawy i obniżysz koszty o 50%.

Nasi klienci szybko wdrażają generatywną sztuczną inteligencję — szkolą przełomowe modele w AWS, opracowują aplikacje generatywnej sztucznej inteligencji z rekordową szybkością przy użyciu Amazon Bedrock i wdrażają rewolucyjne aplikacje w swoich organizacjach, takich jak Amazon Q. Dzięki naszym najnowszym zapowiedziom AWS zapewnia klientom jeszcze większą wydajność, wybór i innowacje na każdym poziomie stosu. Łączny wpływ wszystkich funkcji, które zapewniamy w re:Invent, stanowi kamień milowy w kierunku osiągnięcia ekscytującego i znaczącego celu: udostępniamy generatywną sztuczną inteligencję klientom każdej wielkości i możliwości technicznych, aby mogli wymyślić na nowo i przekształcić to, co jest możliwe.

Zasoby

O autorze

Swami Śiwasubramanian jest wiceprezesem ds. danych i uczenia maszynowego w AWS. W tej roli Swami nadzoruje wszystkie usługi AWS Database, Analytics oraz AI i Machine Learning. Misją jego zespołu jest pomoc organizacjom we wdrażaniu danych do pracy dzięki kompletnemu, kompleksowemu rozwiązaniu do przechowywania, uzyskiwania dostępu, analizowania, wizualizacji i przewidywania danych.

Swami Śiwasubramanian jest wiceprezesem ds. danych i uczenia maszynowego w AWS. W tej roli Swami nadzoruje wszystkie usługi AWS Database, Analytics oraz AI i Machine Learning. Misją jego zespołu jest pomoc organizacjom we wdrażaniu danych do pracy dzięki kompletnemu, kompleksowemu rozwiązaniu do przechowywania, uzyskiwania dostępu, analizowania, wizualizacji i przewidywania danych.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35%

- 40

- 50

- 500

- 7

- 8

- 9

- a

- zdolności

- zdolność

- Zdolny

- O nas

- powyżej

- przyśpieszyć

- przyśpieszony

- akceleratory

- Accenture

- dostęp

- dostępność

- dostępny

- Księgowość

- precyzja

- dokładny

- nabyć

- w poprzek

- Działania

- działania

- aktywnie

- faktycznie

- przystosować

- Dodaj

- w dodatku

- dodanie

- dodatek

- Dodatkowy

- do tego

- wzbogacenie

- Dodaje

- Adidas

- Adobe

- Przyjęcie

- zaawansowany

- postęp

- Korzyść

- Zalety

- Reklama

- Rada

- Po

- przed

- agenda

- Agent

- agentów

- agregat

- temu

- AI

- AI i uczenie maszynowe

- Chatbot AI

- ai badania

- Zasilany AI

- wyrównać

- Wszystkie kategorie

- dopuszczać

- pozwala

- wzdłuż

- już

- również

- zawsze

- Amazonka

- Zaklinacz kodów Amazon

- Amazon EC2

- Usługa Amazon OpenSearch

- Amazon QuickSight

- Amazon Sage Maker

- Amazon Web Services

- ilość

- kwoty

- an

- analiza

- analityk

- analitycy

- analityka

- w czasie rzeczywistym sprawiają,

- ćwiczenie

- i

- Ogłosić

- Ogłoszenia

- Ogłaszając

- anomalie

- odpowiedź

- odpowiedzi

- Antropiczny

- każdy

- ktoś

- wszystko

- api

- Pszczoła

- Aplikacja

- pojawia się

- Zastosowanie

- aplikacje

- Aplikuj

- doceniać

- podejście

- Zatwierdzać

- zatwierdzony

- mobilne i webowe

- kwiecień

- SĄ

- POWIERZCHNIA

- obszary

- prawdopodobnie

- na około

- AS

- zapytać

- Wsparcie

- Asystent

- asystenci

- powiązany

- stowarzyszonych

- At

- zwiększać

- zwiększona

- rozszerzenia

- jutrzenka

- upoważniony

- zautomatyzować

- automaty

- automatycznie

- automatycznie

- Automatyzacja

- motoryzacyjny

- dostępność

- dostępny

- średni

- uniknąć

- z dala

- AWS

- Inferencja AWS

- AWS Lambda

- Konsola zarządzania AWS

- z powrotem

- Bankowość

- bar

- bariery

- baza

- na podstawie

- podstawowy

- BE

- bo

- staje się

- być

- rozpoczął

- uwierzyć

- Korzyści

- BEST

- Najlepsze praktyki

- Ulepsz Swój

- pomiędzy

- Duży

- Miliard

- miliardy

- Blokować

- Bloki

- Blog

- Boeing

- Bolt

- Rezerwacja

- Booking.com

- Książki

- obie

- Dolny

- Granice

- marka

- przerwa

- przerwy

- przynieść

- Bringing

- budować

- Budowanie

- Buduje

- wybudowany

- wbudowany

- biznes

- business intelligence

- biznes

- ale

- przycisk

- by

- wezwanie

- Call Center

- CAN

- Może uzyskać

- możliwości

- zdolność

- zdolny

- Pojemność

- Przechwytywanie

- wózek

- węgiel

- emisji dwutlenku węgla

- karta

- ostrożnie

- walizka

- Etui

- kategorie

- spowodowanie

- Centrum

- pewien

- na pewno

- łańcuch

- wyzwanie

- wyzwania

- zmiana

- zmieniony

- Changer

- Zmiany

- wymiana pieniędzy

- Charakterystyka

- Wykres

- Wykresy

- pokoje czatowe

- chatbot

- nasze chatboty

- na czacie

- ZOBACZ

- żeton

- Frytki

- wybór

- Dodaj

- Wybierając

- wybrany

- roszczenia

- Klasy

- Sprzątanie

- jasny

- kliknij

- Chmura

- infrastruktura chmurowa

- Grupa

- klastrowanie

- Wybrzeże

- kod

- podstawa kodu

- Przegląd kodu

- Kodowanie

- współpracę

- współpraca

- COM

- połączenie

- połączyć

- połączony

- kombajny

- jak

- byliśmy spójni, od początku

- przyjście

- Coming Soon

- komunikować

- Komunikacja

- Firmy

- sukcesy firma

- Firma

- w porównaniu

- zniewalający

- kompletny

- całkowicie

- kompleks

- kompleksowość

- wszechstronny

- obliczać

- Koncepcje

- systemu

- konfigurowanie

- przypuszczenie

- Skontaktuj się

- połączony

- połączenie

- Łączność

- łączy

- zgodny

- Konsola

- Ograniczenia

- Konsumenci

- konsumpcja

- skontaktuj się

- contact center

- Pojemniki

- zawartość

- Generowanie treści

- kontekst

- kontekstowy

- kontynuować

- nadal

- ciągły

- kontynuując

- kontrola

- kontroli

- Rozmowa

- konwersacyjny

- rozmowy

- prawo autorskie

- copywriting

- rdzeń

- Koszty:

- opłacalne

- Koszty:

- kraje

- Sternik

- Stwórz

- stworzony

- kreatywność

- twórcy

- kredyt

- Karta kredytowa

- Przestępstwo

- CRM

- klient

- doświadczenie klienta

- Zadowolenie klienta

- Obsługa klienta

- Klientów

- konfigurowalny

- dostosowywanie

- dostosować

- dostosowane

- Ciąć

- Cykle

- codziennie

- tablica rozdzielcza

- Deski rozdzielcze

- dane

- Przygotowywanie danych

- prywatność danych

- Prywatność i bezpieczeństwo danych

- zestawy danych

- sterowane danymi

- Baza danych

- Bazy danych

- dzień

- dzień do dnia

- Dni

- Podejmowanie decyzji

- Decyzje

- głęboko

- głęboka nauka

- głębiej

- definicje

- Stopień

- opóźnienie

- dostarczyć

- Dostawy

- dostarczanie

- dostarcza

- Kreowanie

- Demokratyzować

- W zależności

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- głębokość

- opisać

- opisane

- opis

- zaprojektowany

- życzenia

- szczegółowe

- detale

- wykryć

- Ustalać

- DEUTSCHE TELECOM

- Deweloper

- deweloperzy

- rozwijanie

- oprogramowania

- diagnoza

- Dialog

- Dialog

- ZROBIŁ

- różne

- Transmitowanie

- cyfrowy

- bezpośrednio

- rozprowadzać

- dystrybuowane

- szkolenia rozproszone

- rozdzielczy

- do

- dokument

- dokumentacja

- dokumenty

- robi

- Nie

- robi

- zrobić

- nie

- podwojenie

- na dół

- napęd

- z powodu

- duplikaty

- czas trwania

- e

- e-commerce

- każdy

- Wcześnie

- łatwiej

- z łatwością

- Wschód

- łatwo

- ekonomia

- edycja

- faktycznie

- efektywność

- skutecznie

- wysiłek

- bądź

- więcej

- e-maile

- emisje

- pracowników

- upoważniać

- uprawniającej

- umożliwiać

- umożliwiając

- kodowanie

- zakończenia

- koniec końców

- energia

- Zużycie energii

- inżynier

- Inżynieria

- wzmacniać

- ulepszenia

- wzbogacanie

- Enterprise

- klasy korporacyjnej

- przedsiębiorstwa

- rozrywka

- Cały

- koperta

- Era

- ERP

- błąd

- Błędy

- oceny

- Parzyste

- wydarzenia

- EVER

- Każdy

- wszyscy

- wszystko

- ewolucja

- ewoluuje

- przykład

- przykłady

- podniecony

- ekscytujący

- wykonać

- wykonawczy

- Przede wszystkim system został opracowany

- ekspansywny

- oczekiwać

- przyśpieszyć coś

- drogi

- doświadczenie

- doświadczony

- Doświadczenia

- ekspert

- ekspertyza

- Wyjaśniać

- odkryj

- ekspresowy

- tkanina

- Twarz

- fakt

- Czynniki

- dość

- wierny

- Spadać

- znajomy

- rodzin

- członków Twojej rodziny

- FAST

- szybciej

- wadliwy

- Cecha

- Korzyści

- opłata

- informacja zwrotna

- kilka

- Złożenie

- filtrować

- W końcu

- budżetowy

- Znajdź

- znalezieniu

- znajduje

- w porządku

- koniec

- i terminów, a

- Fix

- elastyczne

- koncentruje

- obserwuj

- W razie zamówieenia projektu

- Dla konsumentów

- Naprzód

- znaleziono

- Fundacja

- cztery

- frakcja

- Framework

- Ramy

- Darmowy

- często

- przyjazny

- od

- Funkcje

- dalej

- przyszłość

- gra

- game-changer

- gier

- Ogólne

- ogólnie

- Generować

- generuje

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- generator

- otrzymać

- miejsce

- Dać

- Globalne

- globalny cyfrowy

- Go

- cel

- będzie

- dobry

- GPU

- GPU

- wspaniały

- Ziemia

- przełomowy

- Zarządzanie

- Rozwój

- dorosły

- poradnictwo

- poprowadzi

- wytyczne

- miał

- siła robocza

- Wydarzenie

- Ciężko

- sprzęt komputerowy

- szkodliwy

- nienawidzić

- Have

- mający

- Nagłówki

- opieki zdrowotnej

- ciężki

- ciężkie podnoszenie

- pomoc

- pomoc

- pomaga

- tutaj

- Wysoki

- wyższy

- Najwyższa

- podświetlanie

- wysoko

- zatrudnić

- jego

- Hosting

- GODZINY

- W jaki sposób

- How To

- Jednak

- HTTPS

- Setki

- i

- ID

- tożsamości

- tożsamość

- ids

- if

- obraz

- zdjęcia

- Natychmiastowy

- Rezultat

- wdrożenia

- wdrożenia

- realizowane

- importować

- ważny

- imponujący

- podnieść

- ulepszony

- ulepszenia

- in

- zawierać

- obejmuje

- Włącznie z

- Zwiększać

- wzrosła

- wzrastający

- wskaźniki

- osób

- przemysłowa

- przemysł

- wiodący w branży

- pod wpływem

- Informacje

- informować

- Informacja

- Infrastruktura

- wprowadzać innowacje

- innowacyjne

- Innowacja

- innowacje

- Innowacyjny

- wkład

- Wejścia

- wgląd

- spostrzeżenia

- przykład

- zamiast

- Instytut

- instrukcje

- ubezpieczenie

- integracja

- intelektualny

- własność intelektualna

- Inteligencja

- zamierza

- interakcji

- Interakcje

- współdziała

- połączone

- Interfejs

- wewnętrzny

- interweniować

- najnowszych

- przedstawiać

- wprowadzono

- wprowadzenie

- Zmyślony

- inwentarz

- Inwestuj

- badawczy

- inwestowanie

- inwestycja

- Inwestycje

- zaangażowany

- problemy

- IT

- JEGO

- Japonki

- żargon

- Java

- jpg

- właśnie

- tylko jeden

- Trzymać

- konserwacja

- utrzymuje

- Klawisz

- Kluczowe obszary

- słowa kluczowe

- Zestaw (SDK)

- Wiedzieć

- wiedza

- wie

- Labs

- Brak

- język

- duży

- na dużą skalę

- największym

- Nazwisko

- Ostatni rok

- Późno

- Utajenie

- firmy

- uruchomiona

- wodowanie

- Prawnicy

- warstwa

- nioski

- Przywództwo

- prowadzący

- UCZYĆ SIĘ

- dowiedziałem

- nauka

- Regulamin

- mniej

- pozwala

- poziom

- Dźwignia

- wykorzystuje

- LexisNexis

- LG

- biblioteki

- wifecycwe

- Modernizacja

- lubić

- Prawdopodobnie

- Ograniczenia

- Ograniczony

- Limity

- linie

- LINK

- linki

- Lista

- relacja na żywo

- Zyje

- Lama

- LLM

- usytuowany

- lokalizacji

- logiczny

- logo

- długo

- od dawna

- Partia

- miłość

- niski

- niższy

- najniższy

- maszyna

- uczenie maszynowe

- zrobiony

- utrzymać

- Utrzymywanie

- konserwacja

- poważny

- robić

- WYKONUJE

- Dokonywanie

- zarządzane

- i konserwacjami

- Zarządzający

- podręcznik

- prace ręczne

- ręcznie

- wiele

- Marketing

- materiał

- materiały

- maksymalny

- Może..

- me

- wymowny

- znaczy

- Media

- Poznaj nasz

- Spotkanie

- Spotkania

- Spełnia

- Użytkownicy

- sam

- Meta

- metoda

- Miami

- Microsoft

- Środkowy

- może

- kamień milowy

- minut

- tęsknić

- Misja

- ML

- model

- modelowanie

- modele

- pęd

- MongoDB

- monitory

- Miesiąc

- miesięcy

- jeszcze

- większość

- Najbardziej popularne posty

- przeniesienie

- MRI

- dużo

- wielokrotność

- Muzyka

- musi

- my

- Nazwa

- wąski

- Nasdaq

- Naturalny

- Blisko

- niezbędny

- Potrzebować

- potrzebne

- potrzeba

- netto

- sieć

- sieci

- Nowości

- I Love New York

- nowo

- Następny

- Nitro

- Nie

- już dziś

- numer

- Nvidia

- of

- poza

- obraźliwy

- oferta

- oferuje

- Oferty

- często

- starszych

- on

- pewnego razu

- ONE

- te

- Online

- bankowości online

- tylko

- koncepcja

- działać

- operacje

- Optymalizacja

- zoptymalizowane

- optymalizacji

- Opcje

- or

- Zlecenia

- organizacja

- organizacji

- oryginalny

- Inne

- Pozostałe

- ludzkiej,

- na zewnątrz

- zarys

- wydajność

- Wyjścia

- koniec

- Nadmiar zapasów

- przemożnie

- własny

- Pokój

- Pakiety

- bolesny

- par

- parametr

- parametry

- część

- wzmacniacz

- strony

- Przeszłość

- wzory

- pauza

- Ludzie

- dla

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywane

- wykonuje

- pozwolenie

- uprawnienia

- osoba

- personalizacja

- personalizować

- Osobiście

- Wycieczka PGA

- Zwroty

- Miejsce

- krok po kroku

- plato

- Analiza danych Platona

- PlatoDane

- plus

- punkt

- polityka

- Popularny

- pozytywny

- możliwy

- Post

- potencjał

- power

- powered

- mocny

- Praktyczny

- praktycznie

- praktyki

- precyzyjny

- przewidzieć

- Przewidywania

- preferencje

- przygotowanie

- Przygotować

- teraźniejszość

- prezydent

- naciśnij

- pilny

- Podgląd

- poprzednio

- Cena

- wycena

- pierwotny

- prywatność

- Prywatność i bezpieczeństwo

- prywatny

- prywatna informacja

- Problem

- problemy

- wygląda tak

- procesów

- przetwarzanie

- produkować

- Produkt

- Produkcja

- produktywny

- wydajność

- profesjonalny

- specjalistów

- Programy

- projekt

- monity

- własność

- własność

- ochrony

- ochrona

- zapewniać

- dostawca

- dostawców

- zapewnia

- że

- publiczny

- publicznie

- cele

- Naciskać

- Popychanie

- położyć

- Putting

- Python

- płomień

- Q3

- ilościowy

- pytanie

- pytania

- Szybki

- szybko

- całkiem

- R & D

- zasięg

- szybki

- szybko

- ceny

- RE

- Czytający

- real

- w czasie rzeczywistym

- realistyczny

- zrealizować

- realizowany

- naprawdę

- żniwa

- Przyczyny

- niedawno

- Rekomendacja

- zalecenia

- rekord

- zmniejszyć

- Zredukowany

- redukcja

- oczyścić

- region

- wydany

- niezawodność

- szczątki

- usunąć

- usuwanie

- naprawy

- powtarzalne

- wymiana

- odpowiadać

- raport

- składnica

- zażądać

- wywołań

- wymagany

- wymagania

- Badania naukowe

- Rezerwacja

- rezerwować

- Rozkład

- rezonuje

- Zasoby

- poszanowanie

- Odpowiadać

- odpowiadanie

- odpowiedź

- Odpowiedzi

- odpowiedzialny

- ograniczać

- ograniczony

- dalsze

- Efekt

- powrót

- przeglądu

- recenzowanie

- prawo

- ryzyko

- Rola

- role

- Pokoje

- trasy

- Zasada

- run

- bieganie

- pas startowy

- poświęcanie

- "bezpiecznym"

- zabezpieczenia

- bezpiecznie

- sagemaker

- sole

- sprzedawca

- taki sam

- klientów

- Zapisz

- powiedzenie

- Skala

- skalowaniem

- scenariusze

- zakres

- zadraśnięcie

- Sdk

- bezszwowy

- Szukaj

- druga

- Drugie pokolenie

- sekund

- bezpieczne

- bezpiecznie

- bezpieczeństwo

- widzieć

- widzenie

- widziany

- wybierać

- wybrany

- wybór

- wysyłanie

- senior

- starsze przywództwo

- wrażliwy

- wrzesień

- Sekwencja

- Serie

- Serwery

- usługa

- Usługi

- zestaw

- Zestawy

- kilka

- Share

- shared

- STATEK

- Short

- powinien

- bok

- znaczący

- Krzem

- Podobnie

- Prosty

- upraszczać

- po prostu

- ponieważ

- SIX

- rozmiary

- luźny

- mały

- So

- Obserwuj Nas

- Media społecznościowe

- Tworzenie

- Software Developers

- rozwoju oprogramowania

- zestaw programistyczny

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- kilka

- Ktoś

- coś

- wkrótce

- wyrafinowany

- Źródło

- Kod źródłowy

- Źródła

- na południowy wschód

- Typ przestrzeni

- Iskra

- swoiście

- przemówienie

- prędkość

- wydać

- Stabilność

- stabilny

- stos

- ułożone w stos

- interesariusze

- rozpoczęty

- Startowy

- Startups

- state-of-the-art

- pobyt

- Ewolucja krok po kroku

- Cel

- Nadal

- przechowywanie

- sklep

- sklep

- historie

- burza

- Historia

- opływowy

- Wzmacniać

- przekonywający

- Struktura

- Badanie

- podsieci

- znaczny

- taki

- odpowiedni

- apartament

- streszczać

- PODSUMOWANIE

- Wspaniały

- uzupełnienie

- dostawcy

- Dostawa

- Podaż i popyt

- łańcuch dostaw

- wsparcie

- podpory

- pewnie

- zaskakujący

- inwigilacja

- podejrzliwy

- Zrównoważony rozwój

- Przełącznik

- syntetyzują

- system

- systemy

- stół

- dostosowane

- Brać

- trwa

- biorąc

- Mówić

- cel

- Zadanie

- zadania

- zespół

- Członkowie Zespołu

- Zespoły

- Techniczny

- technika

- Techniki

- Technologies

- Technologia

- Innowacje technologiczne

- powiedzieć

- mówi

- dziesięć

- kilkadziesiąt

- tensorflow

- terminologia

- test

- Testowanie

- Testy

- XNUMX

- niż

- że

- Połączenia

- Przyszłość

- świat

- ich

- Im

- sami

- następnie

- Tam.

- Te

- one

- rzecz

- rzeczy

- myśleć

- Trzeci

- to

- w tym roku

- tych

- tysiące

- trzy

- Przez

- poprzez

- wydajność

- bilet

- bilety

- czas

- czasy

- tytan

- do

- już dziś

- dzisiaj

- razem

- żeton

- także

- wziął

- narzędzie

- narzędzia

- Top

- tematy

- Wycieczka

- w kierunku

- w kierunku

- śledzić

- Śledź rekord

- Handel

- Pociąg

- przeszkolony

- Trening

- transakcje

- Transkrypcja

- Przekształcać

- Transformacja

- przemiany

- transformatorowy

- podróżować

- biliony

- wycieczka

- naprawdę

- Zaufaj

- próbować

- stara

- strojenie

- włącza

- drugiej

- rodzaj

- zazwyczaj

- zasadniczy

- zrozumieć

- zrozumiały

- zrozumienie

- rozumie

- nieznany

- Ujednolicony

- wyjątkowy

- jednostka

- w odróżnieniu

- aż do

- Aktualizacja

- Nowości

- uaktualnienie

- Uaktualnienia

- us

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- Cenny

- różnorodność

- różnorodny

- wersja

- Wersje

- Przeciw

- początku.

- przez

- wice

- Wiceprezes

- Wideo

- Przemoc

- prawie

- wyobrażanie sobie

- wyobrażać sobie

- naocznie

- kłęby

- Wrażliwy

- chcieć

- Warner

- grupa muzyczna warner

- była

- fala

- Droga..

- sposoby

- we

- sieć

- Aplikacja internetowa

- usługi internetowe

- strony internetowe

- tydzień

- tygodni

- powitanie

- DOBRZE

- znane

- były

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- czy

- który

- Podczas

- KIM

- dlaczego

- szeroki

- Szeroki zasięg

- szerszy

- będzie

- okno

- w

- w ciągu

- bez

- Praca

- pracował

- przepływów pracy

- pracujący

- działa

- świat

- klasa światowa

- martwić się

- wartość

- by

- napisać

- pisać kod

- pisanie

- rok

- lat

- york

- You

- Twój

- Zendesk

- zefirnet