AutoML umożliwia szybkie i ogólne wyciąganie wniosków z danych już na początku cyklu życia projektu uczenia maszynowego (ML). Zrozumienie od razu, które techniki przetwarzania wstępnego i typy algorytmów zapewniają najlepsze wyniki, skraca czas opracowywania, uczenia i wdrażania odpowiedniego modelu. Odgrywa kluczową rolę w procesie opracowywania każdego modelu i pozwala badaczom danych skoncentrować się na najbardziej obiecujących technikach uczenia maszynowego. Ponadto AutoML zapewnia wydajność modelu bazowego, która może służyć jako punkt odniesienia dla zespołu zajmującego się analizą danych.

Narzędzie AutoML stosuje do danych kombinację różnych algorytmów i różnych technik wstępnego przetwarzania. Na przykład może skalować dane, przeprowadzać selekcję cech jednowymiarowych, przeprowadzać PCA przy różnych poziomach progów wariancji i stosować grupowanie. Takie techniki wstępnego przetwarzania można stosować indywidualnie lub łączyć w rurociągu. Następnie narzędzie AutoML będzie szkolić różne typy modeli, takie jak regresja liniowa, Elastic-Net lub Random Forest, na różnych wersjach wstępnie przetworzonego zestawu danych i przeprowadzać optymalizację hiperparametrów (HPO). Autopilot Amazon SageMaker eliminuje konieczność podnoszenia ciężarów związanych z budowaniem modeli ML. Po dostarczeniu zestawu danych SageMaker Autopilot automatycznie bada różne rozwiązania w celu znalezienia najlepszego modelu. Ale co, jeśli chcesz wdrożyć dostosowaną wersję przepływu pracy AutoML?

W tym poście pokazano, jak utworzyć niestandardowy przepływ pracy AutoML na Amazon Sage Maker za pomocą Automatyczne strojenie modeli Amazon SageMaker z przykładowym kodem dostępnym w formacie a Repozytorium GitHub.

Omówienie rozwiązania

W tym przypadku załóżmy, że należysz do zespołu zajmującego się analizą danych, który opracowuje modele w wyspecjalizowanej domenie. Opracowałeś zestaw niestandardowych technik przetwarzania wstępnego i wybrałeś szereg algorytmów, które zazwyczaj dobrze sprawdzają się w przypadku Twojego problemu z uczeniem się maszynowym. Pracując nad nowymi przypadkami użycia uczenia maszynowego, chciałbyś najpierw wykonać uruchomienie AutoML przy użyciu technik i algorytmów przetwarzania wstępnego, aby zawęzić zakres potencjalnych rozwiązań.

W tym przykładzie nie używasz wyspecjalizowanego zbioru danych; zamiast tego będziesz pracować ze zbiorem danych California Housing, z którego będziesz importować Usługa Amazon Simple Storage (Amazon S3). Nacisk położony jest na zademonstrowanie technicznej implementacji rozwiązania przy użyciu SageMaker HPO, które później można zastosować w dowolnym zbiorze danych i domenie.

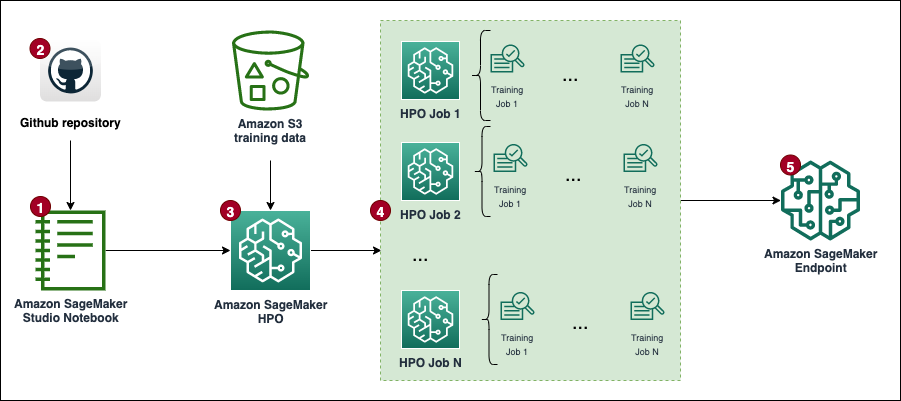

Poniższy diagram przedstawia ogólny przepływ pracy rozwiązania.

Wymagania wstępne

Aby ukończyć przewodnik zawarty w tym poście, należy spełnić następujące warunki:

Zaimplementuj rozwiązanie

Pełny kod jest dostępny w pliku GitHub repo.

Kroki wdrożenia rozwiązania (jak pokazano na schemacie przepływu pracy) są następujące:

- Utwórz instancję notesu i określ co następuje:

- W razie zamówieenia projektu Typ wystąpienia notebookawybierz ml.t3.średnie.

- W razie zamówieenia projektu Elastyczne wnioskowaniewybierz Żaden.

- W razie zamówieenia projektu Identyfikator platformywybierz Amazon Linux 2, Jupyter Lab 3.

- W razie zamówieenia projektu Rola IAM, wybierz opcję domyślną

AmazonSageMaker-ExecutionRole. Jeśli nie istnieje, utwórz nowy AWS Zarządzanie tożsamością i dostępem (IAM) i dołącz plik Polityka uprawnień AmazonSageMakerFullAccess.

Należy pamiętać, że w środowisku produkcyjnym należy utworzyć rolę i zasady wykonywania o minimalnym zakresie.

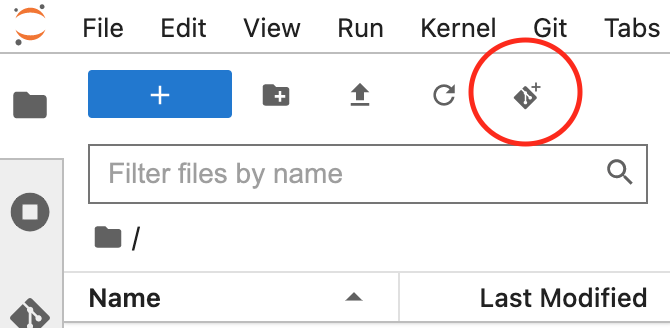

- Otwórz interfejs JupyterLab dla instancji notatnika i sklonuj repozytorium GitHub.

Możesz to zrobić, rozpoczynając nową sesję terminalową i uruchamiając plik git clone <REPO> poleceniem lub za pomocą funkcji interfejsu użytkownika, jak pokazano na poniższym zrzucie ekranu.

- Otwórz

automl.ipynbplik notatnika, wybierz plikconda_python3jądro i postępuj zgodnie z instrukcjami, aby uruchomić a zestaw zadań HPO.

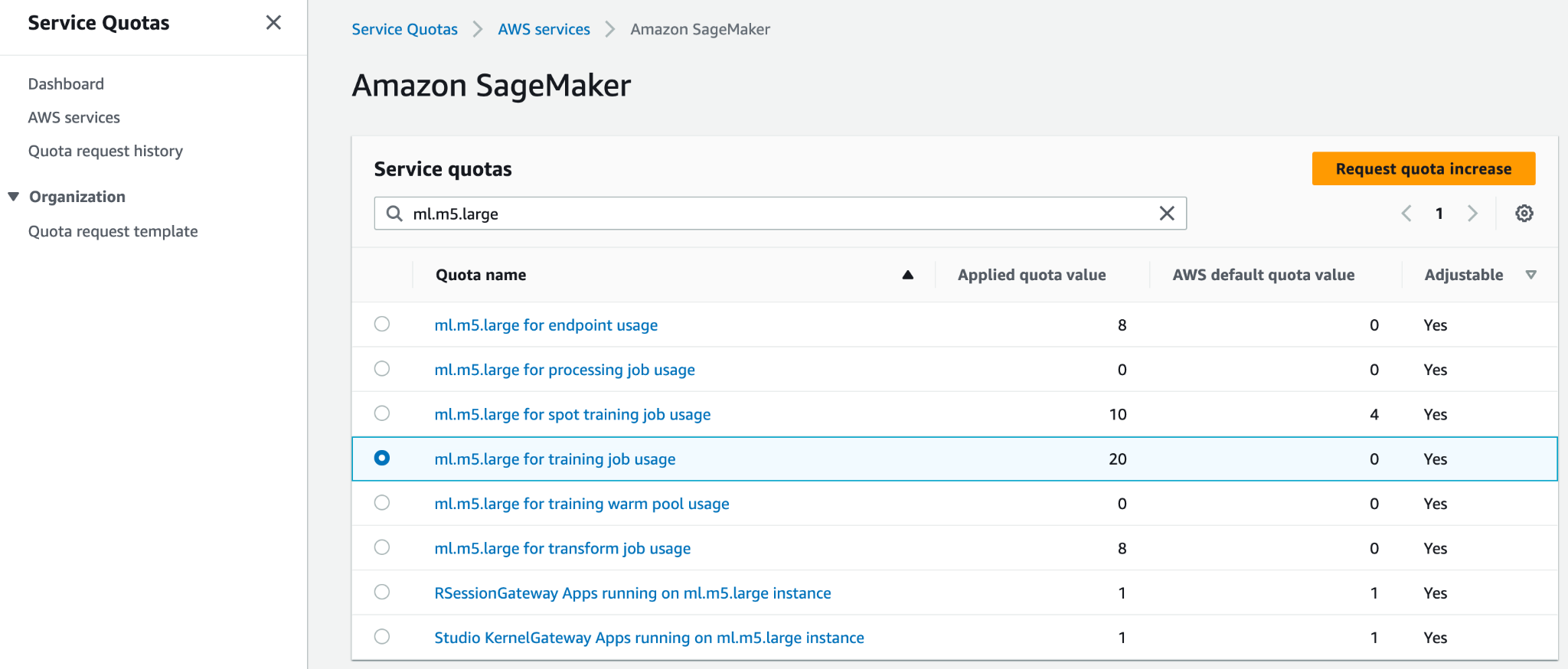

Aby uruchomić kod bez żadnych zmian, musisz zwiększyć limit usługi dla ml.m5.large do wykorzystania w zadaniach szkoleniowych i Liczba wystąpień we wszystkich zadaniach szkoleniowych. AWS domyślnie dopuszcza tylko 20 równoległych zadań szkoleniowych SageMaker dla obu przydziałów. Musisz poprosić o zwiększenie limitu do 30 w obu przypadkach. Obie zmiany kwot powinny zazwyczaj zostać zatwierdzone w ciągu kilku minut. Odnosić się do Prośba o zwiększenie limitu po więcej informacji.

Jeśli nie chcesz zmieniać limitu, możesz po prostu zmodyfikować wartość pliku MAX_PARALLEL_JOBS zmienną w skrypcie (na przykład na 5).

- Każde zadanie HPO zakończy zestaw praca szkoleniowa prób i wskazać model z optymalnymi hiperparametrami.

- Przeanalizuj wyniki i wdrożyć najskuteczniejszy model.

To rozwiązanie będzie wiązać się z kosztami na Twoim koncie AWS. Koszt tego rozwiązania będzie zależał od liczby i czasu trwania szkoleń HPO. Wraz ze wzrostem tych kosztów wzrosną również koszty. Możesz obniżyć koszty, ograniczając czas szkolenia i konfiguracji TuningJobCompletionCriteriaConfig zgodnie z instrukcjami omówionymi w dalszej części tego postu. Aby uzyskać informacje o cenach, zobacz Cennik Amazon SageMaker.

W poniższych sekcjach bardziej szczegółowo omawiamy notatnik, przedstawiając przykłady kodu i kroki umożliwiające analizę wyników i wybranie najlepszego modelu.

Początkowe ustawienia

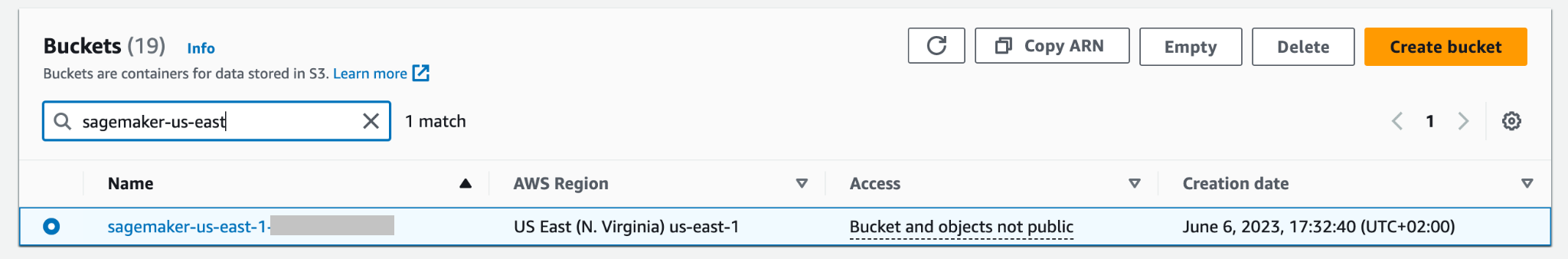

Zacznijmy od uruchomienia Import i konfiguracja sekcja w custom-automl.ipynb zeszyt. Instaluje i importuje wszystkie wymagane zależności, tworzy instancję sesji i klienta SageMaker oraz ustawia domyślny region i segment S3 do przechowywania danych.

Przygotowywanie danych

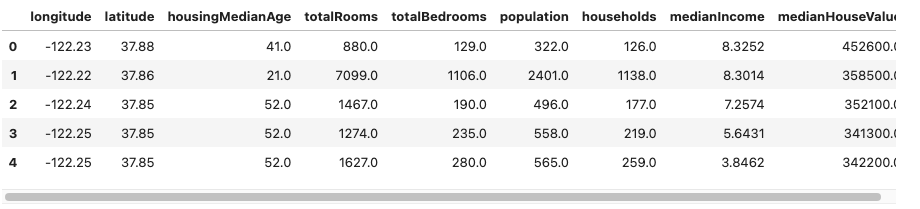

Pobierz zestaw danych California Housing i przygotuj go, uruchamiając plik Pobierz dane część notatnika. Zbiór danych jest dzielony na ramki danych szkoleniowe i testowe i przesyłany do domyślnego zasobnika S3 sesji SageMaker.

Cały zbiór danych zawiera łącznie 20,640 9 rekordów i XNUMX kolumn, łącznie z wartością docelową. Celem jest przewidzenie średniej wartości domu (medianHouseValue kolumna). Poniższy zrzut ekranu przedstawia górne wiersze zestawu danych.

Szablon skryptu szkoleniowego

Przepływ pracy AutoML w tym poście opiera się na nauka-scikit potoki i algorytmy wstępnego przetwarzania. Celem jest wygenerowanie dużej kombinacji różnych potoków i algorytmów przetwarzania wstępnego w celu znalezienia najskuteczniejszej konfiguracji. Zacznijmy od utworzenia ogólnego skryptu szkoleniowego, który zostanie utrwalony lokalnie w instancji notatnika. W tym skrypcie znajdują się dwa puste bloki komentarzy: jeden do wstrzykiwania hiperparametrów, a drugi do obiektu potoku modelu przetwarzania wstępnego. Będą one wstrzykiwane dynamicznie dla każdego kandydata na model przetwarzania wstępnego. Celem posiadania jednego ogólnego skryptu jest utrzymanie SUCHEJ implementacji (nie powtarzaj się).

Twórz kombinacje przetwarzania wstępnego i modeli

Połączenia preprocessors Słownik zawiera specyfikację technik przetwarzania wstępnego zastosowanych do wszystkich cech wejściowych modelu. Każdy przepis jest zdefiniowany przy użyciu a Pipeline lub FeatureUnion obiekt z scikit-learn, który łączy poszczególne transformacje danych i układa je w stos. Na przykład, mean-imp-scale to prosty przepis, który zapewnia, że brakujące wartości są imputowane przy użyciu średnich wartości odpowiednich kolumn i że wszystkie cechy są skalowane przy użyciu Skaler standardowy. W przeciwieństwie do tego mean-imp-scale-pca przepis łączy w sobie kilka dodatkowych operacji:

- Wpisz brakujące wartości w kolumnach wraz z ich średnią.

- Zastosuj skalowanie cech przy użyciu średniej i odchylenia standardowego.

- Oblicz PCA na podstawie danych wejściowych przy określonej wartości progowej wariancji i połącz ją z przypisanymi i skalowanymi cechami wejściowymi.

W tym poście wszystkie funkcje wejściowe są numeryczne. Jeśli w wejściowym zestawie danych znajduje się więcej typów danych, należy określić bardziej skomplikowany potok, w którym do różnych zestawów typów obiektów stosowane są różne gałęzie przetwarzania wstępnego.

Połączenia models Słownik zawiera specyfikacje różnych algorytmów, do których dopasowujesz zbiór danych. Każdy typ modelu ma w słowniku następującą specyfikację:

- wyjście_skryptu – Wskazuje lokalizację skryptu szkoleniowego używanego przez estymator. To pole jest wypełniane dynamicznie, gdy

modelssłownik jest połączony zpreprocessorssłownik. - wstawki – Definiuje kod, który zostanie wstawiony do pliku

script_draft.pya następnie zapisane podscript_output. Klucz“preprocessor”jest celowo pozostawione puste, ponieważ ta lokalizacja jest wypełniona jednym z preprocesorów w celu utworzenia wielu kombinacji modelu-preprocesora. - hiperparametry – Zestaw hiperparametrów zoptymalizowanych przez zadanie HPO.

- include_cls_metadata – Więcej szczegółów konfiguracji wymaganych przez SageMaker

Tunerclass.

Pełny przykład models słownik jest dostępny w repozytorium GitHub.

Następnie iterujmy po preprocessors i models słowniki i tworzyć wszystkie możliwe kombinacje. Na przykład, jeśli Twój preprocessors Słownik zawiera 10 przepisów, a w słowniku masz 5 definicji modeli models słownika, nowo utworzony słownik potoków zawiera 50 potoków modelu preprocesora, które są oceniane podczas HPO. Należy pamiętać, że w tym momencie nie zostały jeszcze utworzone indywidualne skrypty potoku. Następny blok kodu (komórka 9) notatnika Jupyter wykonuje iterację po wszystkich obiektach modelu preprocesora w pipelines słownika, wstawia wszystkie odpowiednie fragmenty kodu i utrzymuje lokalnie w notatniku wersję skryptu specyficzną dla potoku. Skrypty te są używane w kolejnych krokach podczas tworzenia indywidualnych estymatorów podłączanych do zadania HPO.

Zdefiniuj estymatory

Możesz teraz pracować nad zdefiniowaniem estymatorów SageMaker, które będą używane przez zadanie HPO, gdy skrypty będą gotowe. Zacznijmy od stworzenia klasy opakowującej, która definiuje pewne wspólne właściwości dla wszystkich estymatorów. Dziedziczy po SKLearn class i określa rolę, liczbę instancji i typ, a także kolumny używane przez skrypt jako funkcje i cel.

Zbudujmy estimators słownika, iterując po wszystkich skryptach wygenerowanych wcześniej i znajdujących się w pliku scripts informator. Tworzysz instancję nowego estymatora za pomocą SKLearnBase class z unikalną nazwą estymatora i jednym ze skryptów. Należy pamiętać, że estimators słownik ma dwa poziomy: najwyższy poziom definiuje a pipeline_family. Jest to logiczne grupowanie oparte na typie modeli do oceny i jest równe długości models słownik. Drugi poziom zawiera poszczególne typy preprocesorów połączone z podanymi pipeline_family. To logiczne grupowanie jest wymagane podczas tworzenia zadania HPO.

Zdefiniuj argumenty tunera HPO

Aby zoptymalizować przekazywanie argumentów do HPO Tuner klasa, ew HyperparameterTunerArgs klasa danych jest inicjowana argumentami wymaganymi przez klasę HPO. Zawiera zestaw funkcji, które zapewniają zwrócenie argumentów HPO w formacie oczekiwanym przy wdrażaniu wielu definicji modeli jednocześnie.

Następny blok kodu wykorzystuje wprowadzone wcześniej HyperparameterTunerArgs klasa danych. Tworzysz kolejny słownik o nazwie hp_args i wygenerować zestaw parametrów wejściowych specyficznych dla każdego z nich estimator_family z estimators słownik. Argumenty te są używane w następnym kroku podczas inicjowania zadań HPO dla każdej rodziny modeli.

Twórz obiekty tunera HPO

Na tym etapie tworzysz indywidualne tunery dla każdego estimator_family. Dlaczego tworzysz trzy oddzielne zadania HPO zamiast uruchamiać tylko jedno we wszystkich estymatorach? The HyperparameterTuner klasa jest ograniczona do 10 dołączonych do niej definicji modelu. Dlatego każdy HPO jest odpowiedzialny za znalezienie najlepiej działającego preprocesora dla danej rodziny modeli i dostrojenie hiperparametrów tej rodziny modeli.

Poniżej znajduje się kilka dodatkowych punktów dotyczących konfiguracji:

- Strategia optymalizacji jest metodą Bayesa, co oznacza, że HPO aktywnie monitoruje wydajność wszystkich prób i kieruje optymalizacją w stronę bardziej obiecujących kombinacji hiperparametrów. Należy ustawić opcję wczesnego zatrzymania poza or Samochody podczas pracy ze strategią Bayesa, która sama obsługuje tę logikę.

- Każde zadanie HPO działa dla maksymalnie 100 zadań i uruchamia 10 zadań równolegle. Jeśli masz do czynienia z większymi zbiorami danych, możesz zwiększyć łączną liczbę zadań.

- Ponadto możesz chcieć użyć ustawień kontrolujących czas trwania zadania i liczbę zadań uruchamianych przez HPO. Jednym ze sposobów, aby to zrobić, jest ustawienie maksymalnego czasu działania w sekundach (w tym poście ustawiliśmy go na 1 godzinę). Innym jest użycie niedawno wydanego

TuningJobCompletionCriteriaConfig. Oferuje zestaw ustawień, które monitorują postęp Twoich zadań i decydują, czy jest prawdopodobne, że więcej zadań poprawi wynik. W tym poście ustaliliśmy maksymalną liczbę zadań szkoleniowych, które nie uległy poprawie, na 20. W ten sposób, jeśli wynik nie ulegnie poprawie (na przykład w czterdziestej próbie), nie będziesz musiał płacić za pozostałe próby do czasumax_jobszostał osiągnięty.

Teraz iterujmy przez tuners i hp_args słowniki i uruchamiaj wszystkie zadania HPO w SageMaker. Zwróć uwagę na użycie argumentu oczekiwania ustawionego na False, co oznacza, że jądro nie będzie czekać, aż wyniki zostaną zakończone i możesz uruchomić wszystkie zadania na raz.

Jest prawdopodobne, że nie wszystkie zadania szkoleniowe zostaną ukończone, a niektóre z nich mogą zostać zatrzymane przez zadanie HPO. Powodem tego jest TuningJobCompletionCriteriaConfig—optymalizacja kończy się, jeśli spełnione jest którekolwiek z określonych kryteriów. W tym przypadku, gdy kryteria optymalizacji nie poprawiają się przez 20 kolejnych zadań.

Przeanalizuj wyniki

Komórka 15 notatnika sprawdza, czy wszystkie zadania HPO zostały ukończone i łączy wszystkie wyniki w postaci ramki danych pandy w celu dalszej analizy. Zanim szczegółowo przeanalizujemy wyniki, przyjrzyjmy się z bliska konsoli SageMaker.

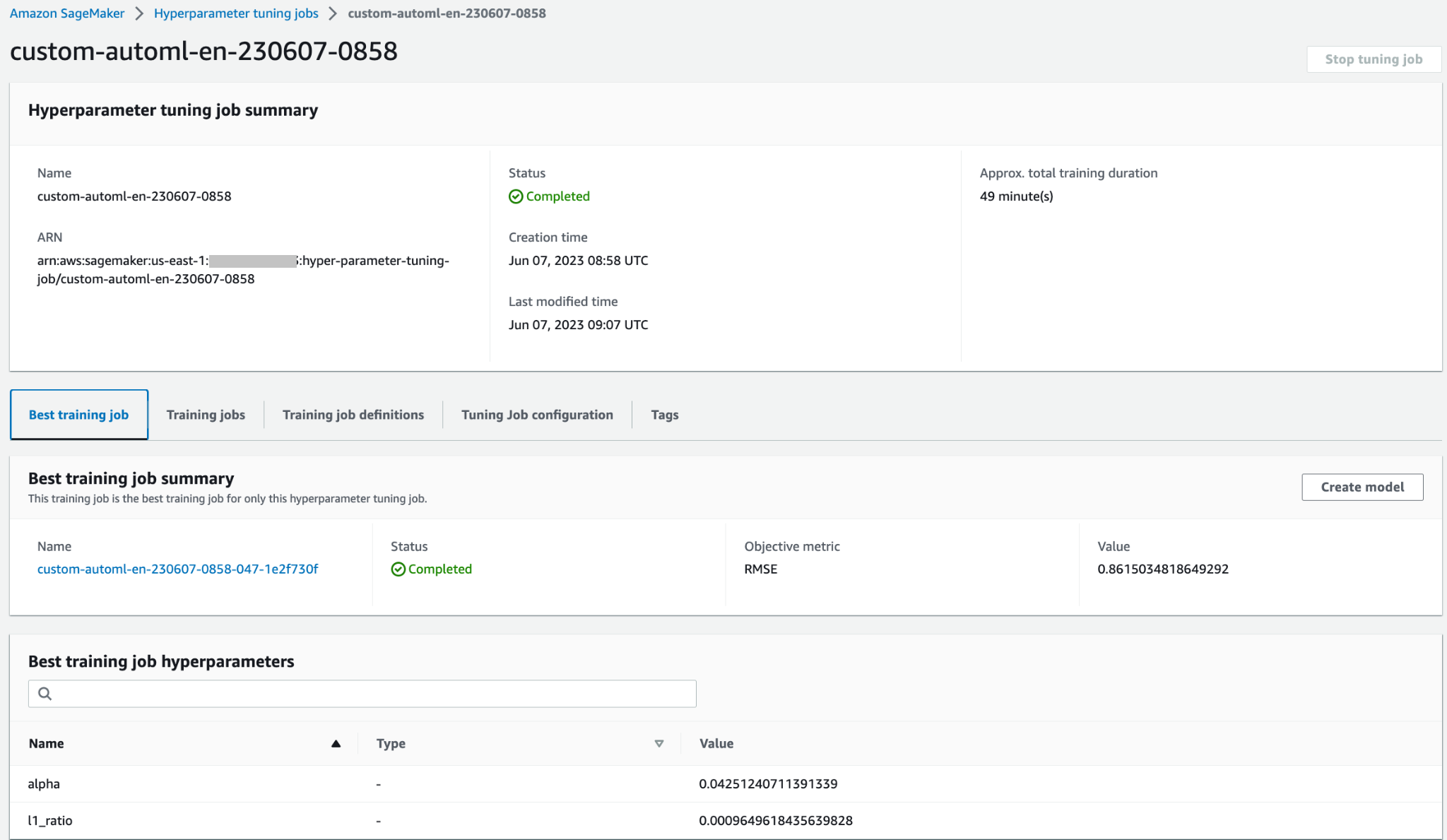

Na szczycie Zadania dostrajania hiperparametrów możesz zobaczyć trzy uruchomione zadania HPO. Wszyscy zakończyli szkolenie wcześniej i nie wykonali wszystkich 100 zadań szkoleniowych. Na poniższym zrzucie ekranu widać, że rodzina modeli Elastic-Net przeszła największą liczbę prób, podczas gdy inne nie potrzebowały tak wielu zadań szkoleniowych, aby znaleźć najlepszy wynik.

Możesz otworzyć zadanie HPO, aby uzyskać dostęp do większej liczby szczegółów, takich jak indywidualne zadania szkoleniowe, konfiguracja zadania oraz informacje i wydajność najlepszego zadania szkoleniowego.

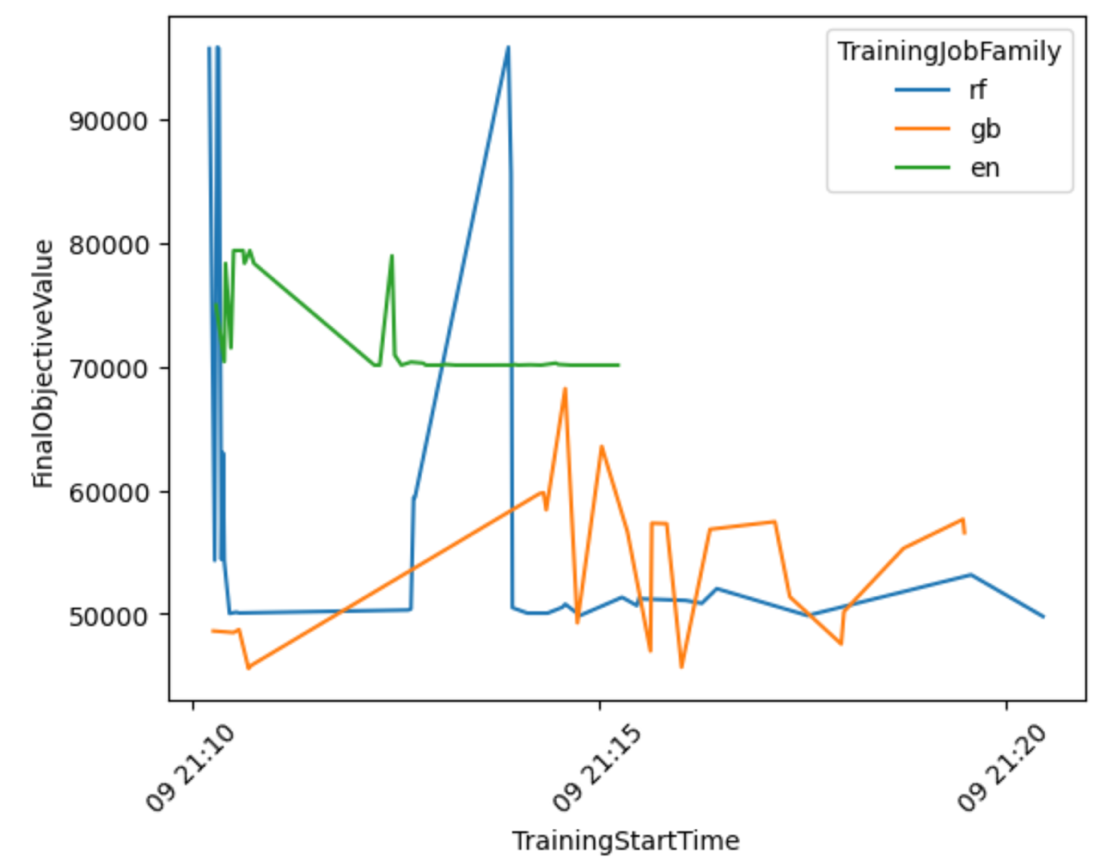

Utwórzmy wizualizację na podstawie wyników, aby uzyskać więcej informacji na temat wydajności przepływu pracy AutoML we wszystkich rodzinach modeli.

Z poniższego wykresu można stwierdzić, że Elastic-Net wydajność modelu oscylowała między 70,000 80,000 a XNUMX XNUMX RMSE i ostatecznie utknęła w martwym punkcie, ponieważ algorytm nie był w stanie poprawić swojej wydajności pomimo wypróbowania różnych technik przetwarzania wstępnego i wartości hiperparametrów. Wydaje się również, że RandomForest wydajność różniła się znacznie w zależności od zestawu hiperparametrów zbadanego przez HPO, ale pomimo wielu prób nie mogła spaść poniżej błędu 50,000 XNUMX RMSE. GradientBoosting osiągnął najlepszą wydajność już od początku, spadając poniżej 50,000 XNUMX RMSE. HPO próbował jeszcze bardziej poprawić ten wynik, ale nie był w stanie osiągnąć lepszej wydajności w przypadku innych kombinacji hiperparametrów. Ogólny wniosek dotyczący wszystkich zadań HPO jest taki, że do znalezienia najskuteczniejszego zestawu hiperparametrów dla każdego algorytmu nie potrzeba było zbyt wielu zadań. Aby jeszcze bardziej poprawić wynik, należy poeksperymentować z utworzeniem większej liczby funkcji i wykonaniem dodatkowej inżynierii funkcji.

Można także zbadać bardziej szczegółowy widok kombinacji modelu i preprocesora, aby wyciągnąć wnioski na temat najbardziej obiecujących kombinacji.

Wybierz najlepszy model i wdróż go

Poniższy fragment kodu wybiera najlepszy model na podstawie najniższej osiągniętej wartości docelowej. Następnie możesz wdrożyć model jako punkt końcowy SageMaker.

Sprzątać

Aby zapobiec niechcianym obciążeniom Twojego konta AWS, zalecamy usunięcie zasobów AWS, których użyłeś w tym poście:

- Na konsoli Amazon S3 opróżnij dane z segmentu S3, w którym przechowywane były dane szkoleniowe.

- W konsoli SageMaker zatrzymaj instancję notatnika.

- Usuń punkt końcowy modelu, jeśli go wdrożyłeś. Punkty końcowe należy usuwać, gdy nie są już używane, ponieważ są rozliczane na podstawie czasu wdrożenia.

Wnioski

W tym poście pokazaliśmy, jak utworzyć niestandardowe zadanie HPO w SageMaker, korzystając z niestandardowego wyboru algorytmów i technik wstępnego przetwarzania. W szczególności ten przykład pokazuje, jak zautomatyzować proces generowania wielu skryptów szkoleniowych i jak wykorzystać struktury programistyczne w języku Python do wydajnego wdrażania wielu równoległych zadań optymalizacyjnych. Mamy nadzieję, że to rozwiązanie będzie podstawą wszelkich niestandardowych zadań dostrajania modeli, które wdrożysz za pomocą SageMaker, aby osiągnąć wyższą wydajność i przyspieszyć przepływy pracy ML.

Zapoznaj się z poniższymi zasobami, aby jeszcze bardziej pogłębić swoją wiedzę na temat korzystania z SageMaker HPO:

O autorach

Konrad Semsch jest starszym architektem rozwiązań ML w zespole Amazon Web Services Data Lab. Pomaga klientom wykorzystać uczenie maszynowe do rozwiązywania problemów biznesowych za pomocą AWS. Lubi wymyślać i upraszczać, aby zapewnić klientom proste i pragmatyczne rozwiązania dla ich projektów AI/ML. Jego największą pasją jest MlOps i tradycyjna analityka danych. Poza pracą jest wielkim fanem windsurfingu i kitesurfingu.

Konrad Semsch jest starszym architektem rozwiązań ML w zespole Amazon Web Services Data Lab. Pomaga klientom wykorzystać uczenie maszynowe do rozwiązywania problemów biznesowych za pomocą AWS. Lubi wymyślać i upraszczać, aby zapewnić klientom proste i pragmatyczne rozwiązania dla ich projektów AI/ML. Jego największą pasją jest MlOps i tradycyjna analityka danych. Poza pracą jest wielkim fanem windsurfingu i kitesurfingu.

Tuńczyk Ersoy jest starszym architektem rozwiązań w AWS. Jej głównym celem jest pomaganie klientom z sektora publicznego w wdrażaniu technologii chmurowych do swoich obciążeń. Ma doświadczenie w tworzeniu aplikacji, architekturze korporacyjnej i technologiach contact center. Jej zainteresowania obejmują architektury bezserwerowe i AI/ML.

Tuńczyk Ersoy jest starszym architektem rozwiązań w AWS. Jej głównym celem jest pomaganie klientom z sektora publicznego w wdrażaniu technologii chmurowych do swoich obciążeń. Ma doświadczenie w tworzeniu aplikacji, architekturze korporacyjnej i technologiach contact center. Jej zainteresowania obejmują architektury bezserwerowe i AI/ML.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Zdolny

- O nas

- dostęp

- Stosownie

- Konto

- Osiągać

- osiągnięty

- w poprzek

- aktywnie

- Dodatkowy

- do tego

- przyjąć

- Po

- AI / ML

- zmierzać

- algorytm

- Algorytmy

- Wszystkie kategorie

- Pozwalać

- pozwala

- już

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- an

- analiza

- w czasie rzeczywistym sprawiają,

- Analizując

- i

- Inne

- każdy

- Zastosowanie

- Application Development

- stosowany

- dotyczy

- Aplikuj

- zatwierdzony

- architektura

- SĄ

- argument

- argumenty

- AS

- założyć

- At

- dołączać

- samochód

- zautomatyzować

- automatycznie

- automatycznie

- AutoML

- dostępny

- AWS

- tło

- baza

- na podstawie

- Baseline

- Bayesian

- BE

- bo

- zanim

- Początek

- poniżej

- BEST

- Ulepsz Swój

- pomiędzy

- Duży

- Blokować

- Bloki

- obie

- gałęzie

- budować

- Budowanie

- biznes

- ale

- przycisk

- by

- California

- wezwanie

- nazywa

- CAN

- kandydat

- walizka

- Etui

- Centrum

- więzy

- wyzwania

- zmiana

- Zmiany

- Opłaty

- Wykrywanie urządzeń szpiegujących

- Dodaj

- klasa

- CLF

- klient

- Chmura

- Grupa

- klastrowanie

- kod

- Kolumna

- kolumny

- połączenie

- kombinacje

- połączony

- kombajny

- byliśmy spójni, od początku

- komentarz

- wspólny

- kompletny

- Zakończony

- wypełniając

- skomplikowane

- stwierdza,

- konkluzja

- Prowadzenie

- systemu

- kolejny

- Konsola

- skontaktuj się

- contact center

- zawiera

- kontrast

- kontrola

- Koszty:

- Koszty:

- mógłby

- Stwórz

- stworzony

- Tworzenie

- Kryteria

- istotny

- Obecnie

- zwyczaj

- Klientów

- dane

- nauka danych

- zbiory danych

- czynienia

- zdecydować

- Pogłębiać

- Domyślnie

- zdefiniowane

- Definiuje

- definiowanie

- definicje

- wykazać

- demonstruje

- zależeć

- Zależności

- W zależności

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- czerpać

- Mimo

- detal

- szczegółowe

- detale

- rozwijać

- rozwinięty

- oprogramowania

- rozwija się

- odchylenie

- DICT

- różne

- katalogi

- dyskutować

- omówione

- do

- Nie

- domena

- nie

- na dół

- rysować

- suchy

- czas trwania

- podczas

- dynamicznie

- każdy

- Wcześnie

- wydajny

- eliminuje

- umożliwiać

- Punkt końcowy

- Inżynieria

- zapewnić

- zapewnia

- Enterprise

- Cały

- całkowicie

- równy

- błąd

- oceniać

- oceniane

- ostatecznie

- Każdy

- zbadać

- przykład

- przykłady

- egzekucja

- istnieć

- oczekiwać

- spodziewany

- eksperyment

- wyjaśnione

- zbadane

- odkrywa

- fałszywy

- rodzin

- członków Twojej rodziny

- wentylator

- Cecha

- Korzyści

- kilka

- pole

- filet

- wypełniony

- Znajdź

- znalezieniu

- i terminów, a

- dopasować

- pięć

- Skupiać

- obserwuj

- następujący

- następujący sposób

- W razie zamówieenia projektu

- las

- Nasz formularz

- format

- FRAME

- od

- z przodu

- pełny

- funkcjonować

- Funkcjonalność

- Funkcje

- dalej

- Ogólne

- Generować

- wygenerowane

- generujący

- otrzymać

- git

- GitHub

- dany

- Go

- cel

- będzie

- wykres

- ręka

- Uchwyty

- Have

- mający

- he

- ciężki

- ciężkie podnoszenie

- pomoc

- pomaga

- jej

- na wysokim szczeblu

- wyższy

- Najwyższa

- nadzieję

- godzina

- dom

- gospodarstw domowych

- obudowa

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- Optymalizacja hiperparametrów

- Dostrajanie hiperparametrów

- tożsamość

- if

- wdrożenia

- realizacja

- importować

- import

- podnieść

- poprawy

- in

- zawierać

- Włącznie z

- Zwiększać

- wskazać

- indywidualny

- Indywidualnie

- Informacja

- wkład

- Wejścia

- Wkłady

- spostrzeżenia

- przykład

- zamiast

- instrukcje

- integracja

- celowo

- zainteresowania

- Interfejs

- najnowszych

- wprowadzono

- IT

- JEGO

- samo

- Praca

- Oferty pracy

- jpg

- właśnie

- tylko jeden

- Trzymać

- Klawisz

- wiedza

- laboratorium

- duży

- większe

- później

- uruchomiona

- wodowanie

- nauka

- lewo

- Długość

- poziom

- poziomy

- wifecycwe

- Modernizacja

- lubić

- Prawdopodobnie

- ograniczenie

- linux

- załadować

- lokalnie

- usytuowany

- lokalizacja

- logika

- logiczny

- długo

- dłużej

- Popatrz

- Partia

- najniższy

- maszyna

- uczenie maszynowe

- wiele

- maksymalny

- Może..

- oznaczać

- znaczy

- Łączyć

- spełnione

- Metryka

- może

- minut

- brakujący

- ML

- MLOps

- model

- modele

- modyfikować

- monitor

- monitory

- jeszcze

- większość

- wielokrotność

- Nazwa

- wąski

- nawiguje

- Potrzebować

- Nowości

- nowo

- Następny

- Nie

- żaden

- notatnik

- zauważyć

- już dziś

- numer

- tępy

- przedmiot

- cel

- obiekty

- of

- poza

- Oferty

- on

- pewnego razu

- ONE

- tylko

- koncepcja

- operacje

- Optymalny

- optymalizacja

- Optymalizacja

- zoptymalizowane

- or

- zamówienie

- OS

- Inne

- Pozostałe

- na zewnątrz

- wydajność

- zewnętrzne

- koniec

- ogólny

- strona

- pandy

- Parallel

- parametry

- część

- szczególny

- Przechodzący

- namiętny

- ścieżka

- Zapłacić

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywania

- utrzymuje się

- sztuk

- rurociąg

- plato

- Analiza danych Platona

- PlatoDane

- odgrywa

- wtyczka

- punkt

- zwrotnica

- polityka

- populacja

- możliwy

- Post

- potencjał

- pragmatyczny

- przewidzieć

- Urządzenie prognozujące

- Przygotować

- warunki wstępne

- prezenty

- zapobiec

- poprzednio

- wycena

- pierwotny

- Problem

- wygląda tak

- produkować

- Produkcja

- Programowanie

- Postęp

- projekt

- projektowanie

- obiecujący

- niska zabudowa

- zapewniać

- zapewnia

- że

- publiczny

- cel

- Python

- przypadkowy

- szybki

- osiągnięty

- gotowy

- powód

- niedawno

- Przepis

- polecić

- dokumentacja

- zmniejszyć

- zmniejsza

- odnosić się

- odniesienie

- w sprawie

- regex

- region

- wydany

- pozostały

- usunąć

- powtarzać

- składnica

- zażądać

- wymagać

- wymagany

- Zasoby

- osób

- odpowiedzialny

- ograniczony

- dalsze

- Efekt

- powrót

- prawo

- Rola

- run

- bieganie

- działa

- Czas

- sagemaker

- Automatyczne strojenie modeli SageMaker

- zapisywane

- Skala

- skalowaniem

- nauka

- Naukowcy

- nauka-scikit

- zakres

- wynik

- scenariusz

- skrypty

- druga

- sekund

- Sekcja

- działy

- sektor

- widzieć

- wydaje

- wybrany

- wybór

- SAMEGO SIEBIE

- senior

- oddzielny

- służyć

- Bezserwerowe

- usługa

- Usługi

- Sesja

- zestaw

- Zestawy

- w panelu ustawień

- ustawienie

- ona

- powinien

- prezentowany

- pokazane

- Targi

- Prosty

- upraszczanie

- po prostu

- skrawek

- So

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- kilka

- wyspecjalizowanym

- specyficzny

- specyfikacja

- Specyfikacje

- określony

- prędkość

- dzielić

- stos

- standard

- początek

- Startowy

- Rynek

- Ewolucja krok po kroku

- Cel

- Stop

- zatrzymany

- zatrzymanie

- przechowywanie

- przechowywany

- przechowywania

- Strategia

- Struktura

- Struktury

- Następnie

- taki

- Utrzymany

- stół

- dostosowane

- Brać

- cel

- zespół

- Techniczny

- Techniki

- Technologies

- terminal

- test

- Testowanie

- że

- Połączenia

- ich

- Im

- następnie

- Tam.

- w związku z tym

- Te

- one

- to

- tych

- trzy

- próg

- Przez

- czas

- do

- razem

- narzędzie

- Top

- Kwota produktów:

- w kierunku

- tradycyjny

- Pociąg

- Trening

- przemiany

- próba

- Próby

- wypróbowany

- wyzwalać

- rozsierdzony

- wyzwalanie

- stara

- strojenie

- drugiej

- rodzaj

- typy

- zazwyczaj

- ui

- dla

- zrozumienie

- wyjątkowy

- aż do

- niepożądany

- przesłanych

- Stosowanie

- posługiwać się

- przypadek użycia

- używany

- zastosowania

- za pomocą

- UPRAWOMOCNIĆ

- wartość

- Wartości

- zmienna

- urozmaicony

- różnorodny

- wersja

- Wersje

- Zobacz i wysłuchaj

- wyobrażanie sobie

- W

- czekać

- solucja

- chcieć

- była

- Droga..

- we

- sieć

- usługi internetowe

- DOBRZE

- były

- Co

- jeśli chodzi o komunikację i motywację

- natomiast

- czy

- który

- dlaczego

- będzie

- w

- w ciągu

- bez

- Praca

- workflow

- przepływów pracy

- pracujący

- by

- napisać

- jeszcze

- You

- Twój

- siebie

- zefirnet