Nowoczesne chatboty mogą służyć jako agenci cyfrowi, zapewniając nową możliwość zapewnienia całodobowej obsługi klienta i wsparcia w wielu branżach. Ich popularność wynika z możliwości odpowiadania na zapytania klientów w czasie rzeczywistym i obsługi wielu zapytań jednocześnie w różnych językach. Chatboty oferują również cenny wgląd w zachowania klientów oparty na danych, a jednocześnie można je łatwo skalować w miarę wzrostu bazy użytkowników. dlatego stanowią opłacalne rozwiązanie angażujące klientów. Chatboty wykorzystują zaawansowane możliwości języka naturalnego dużych modeli językowych (LLM), aby odpowiadać na pytania klientów. Rozumieją język konwersacji i reagują naturalnie. Jednak chatboty, które jedynie odpowiadają na podstawowe pytania, mają ograniczoną użyteczność. Aby stać się zaufanymi doradcami, chatboty muszą udzielać przemyślanych, dostosowanych do indywidualnych potrzeb odpowiedzi.

Jednym ze sposobów umożliwienia bardziej kontekstowych rozmów jest połączenie chatbota z wewnętrznymi bazami wiedzy i systemami informacyjnymi. Integracja zastrzeżonych danych przedsiębiorstwa z wewnętrznych baz wiedzy umożliwia chatbotom kontekstualizację swoich reakcji w zależności od indywidualnych potrzeb i zainteresowań każdego użytkownika. Na przykład chatbot może sugerować produkty odpowiadające preferencjom kupującego i wcześniejszym zakupom, wyjaśniać szczegóły w języku dostosowanym do poziomu wiedzy użytkownika lub zapewniać obsługę konta poprzez dostęp do konkretnych danych klienta. Zdolność do inteligentnego włączania informacji, rozumienia języka naturalnego i zapewniania dostosowanych odpowiedzi w trakcie konwersacji pozwala chatbotom dostarczać rzeczywistą wartość biznesową w różnych przypadkach użycia.

Popularny wzór architektoniczny Odzyskanie Augmented Generation (RAG) jest często używany do poszerzania kontekstu zapytań i odpowiedzi użytkowników. RAG łączy możliwości LLM z oparciem na faktach i wiedzą ze świata rzeczywistego, która pochodzi z wyszukiwania odpowiednich tekstów i fragmentów ze zbioru danych. Te odzyskane teksty są następnie wykorzystywane do informowania i ugruntowywania wyników, redukując halucynacje i poprawiając trafność.

W tym poście przedstawiamy kontekstowe ulepszanie chatbota za pomocą Bazy wiedzy na temat Amazon Bedrock, w pełni zarządzana usługa bezserwerowa. Bazy wiedzy dotyczące integracji z Amazon Bedrock umożliwiają naszemu chatbotowi dostarczanie bardziej odpowiednich, spersonalizowanych odpowiedzi poprzez łączenie zapytań użytkowników z powiązanymi punktami danych informacyjnych. Wewnętrznie, Amazońska skała macierzysta wykorzystuje osady przechowywane w wektorowej bazie danych, aby rozszerzyć kontekst zapytań użytkownika w czasie wykonywania i umożliwić rozwiązanie zarządzanej architektury RAG. Używamy Listy Amazona do akcjonariuszy zbiór danych umożliwiający opracowanie tego rozwiązania.

Odzyskanie Augmented Generation

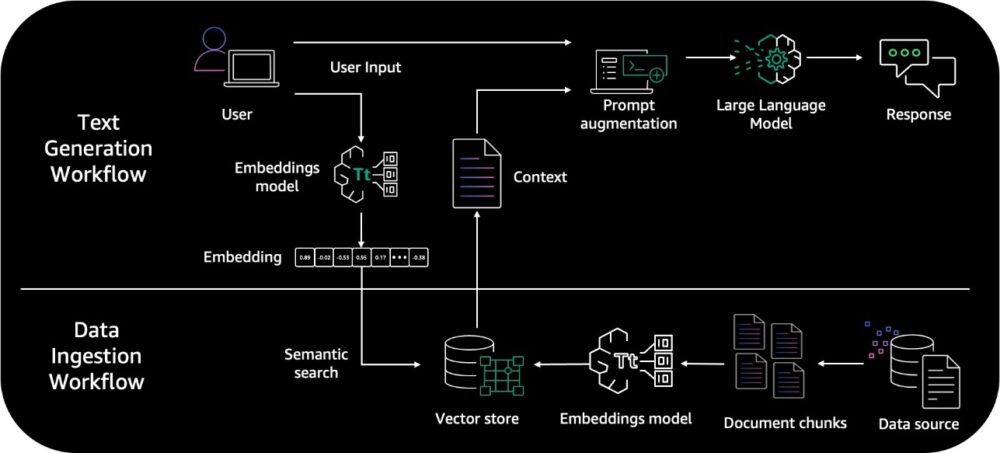

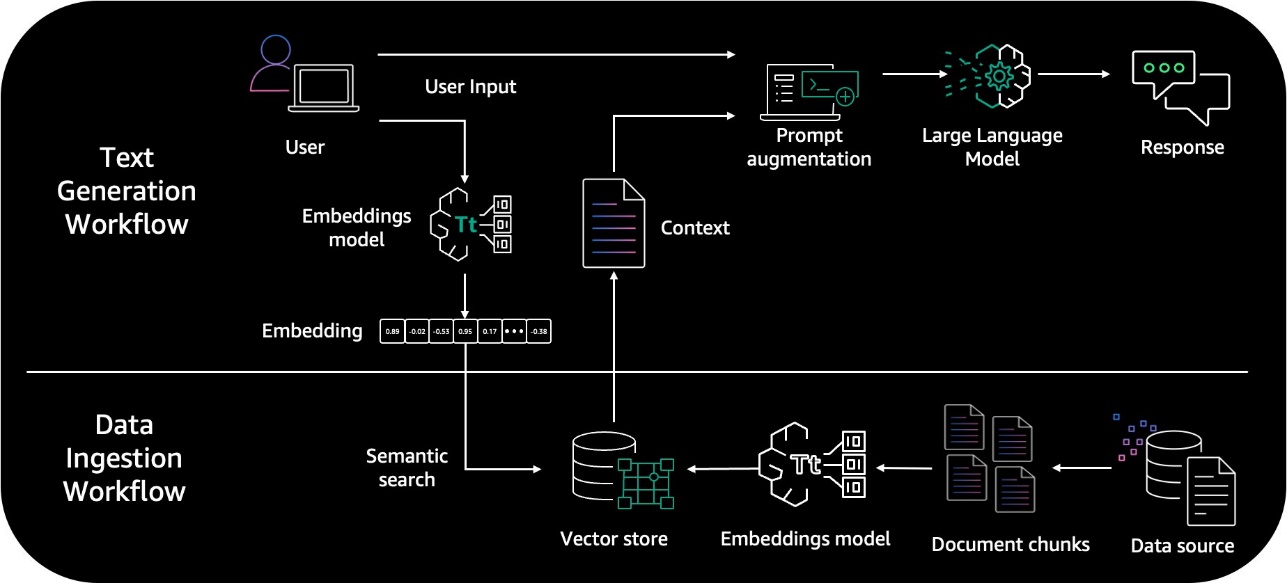

RAG to podejście do generowania języka naturalnego, które uwzględnia wyszukiwanie informacji w procesie generowania. Architektura RAG obejmuje dwa kluczowe przepływy pracy: wstępne przetwarzanie danych poprzez ich pozyskiwanie oraz generowanie tekstu przy użyciu rozszerzonego kontekstu.

Przepływ pracy pozyskiwania danych wykorzystuje LLM do tworzenia wektorów osadzania, które reprezentują semantyczne znaczenie tekstów. Osadzania tworzone są dla dokumentów i pytań użytkowników. Osadzone dokumenty są dzielone na fragmenty i przechowywane jako indeksy w wektorowej bazie danych. Następnie przepływ pracy generowania tekstu pobiera wektor osadzania pytania i używa go do pobrania najbardziej podobnych fragmentów dokumentu na podstawie podobieństwa wektorów. Rozszerza podpowiedzi o te odpowiednie fragmenty, aby wygenerować odpowiedź za pomocą LLM. Więcej szczegółów znajdziesz w Elementarz dotyczący generowania rozszerzonego wyszukiwania, osadzania i wektorowych baz danych sekcja w Podgląd — połącz modele podstawowe ze źródłami danych swojej firmy za pomocą agentów dla Amazon Bedrock.

Poniższy diagram ilustruje architekturę RAG wysokiego poziomu.

Chociaż architektura RAG ma wiele zalet, obejmuje wiele komponentów, w tym bazę danych, mechanizm wyszukiwania, monit i model generatywny. Zarządzanie tymi współzależnymi częściami może skomplikować rozwój i wdrażanie systemu. Integracja wyszukiwania i generowania wymaga również dodatkowego wysiłku inżynieryjnego i zasobów obliczeniowych. Niektóre biblioteki open source udostępniają opakowania, które zmniejszają ten narzut; jednakże zmiany w bibliotekach mogą wprowadzić błędy i dodać dodatkowe obciążenie związane z wersjonowaniem. Nawet w przypadku bibliotek typu open source pisanie kodu, określanie optymalnego rozmiaru fragmentów, generowanie osadzania i nie tylko wymaga znacznego wysiłku. Sama konfiguracja może zająć tygodnie, w zależności od ilości danych.

Dlatego zarządzane rozwiązanie, które obsługuje te niezróżnicowane zadania, mogłoby usprawnić i przyspieszyć proces wdrażania aplikacji RAG i zarządzania nimi.

Bazy wiedzy na temat Amazon Bedrock

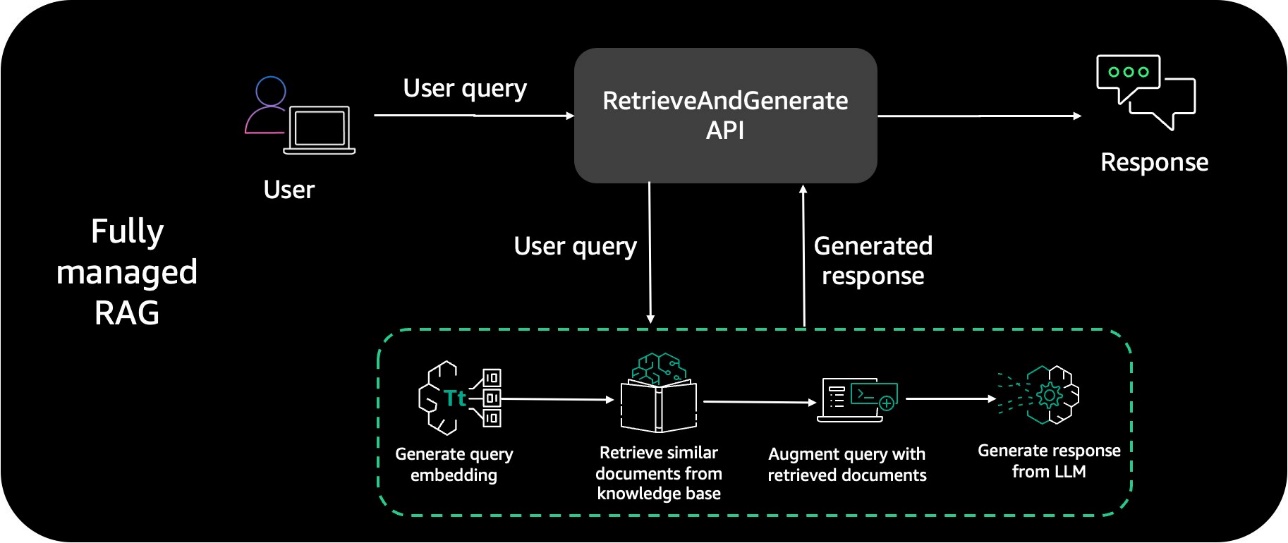

Bazy wiedzy dla Amazon Bedrock to bezserwerowa opcja tworzenia potężnych konwersacyjnych systemów AI przy użyciu RAG. Oferuje w pełni zarządzane przepływy pracy związane z pozyskiwaniem danych i generowaniem tekstu.

W przypadku pozyskiwania danych obsługuje automatyczne tworzenie, przechowywanie, zarządzanie i aktualizację osadzonych tekstów danych dokumentów w bazie danych wektorowych. Dzieli dokumenty na łatwe do zarządzania fragmenty w celu wydajnego wyszukiwania. Fragmenty są następnie konwertowane na elementy osadzone i zapisywane w indeksie wektorowym, co pozwala zobaczyć dokumenty źródłowe podczas udzielania odpowiedzi na pytanie.

Do generowania tekstu Amazon Bedrock udostępnia plik Pobierz i wygeneruj API do tworzenia osadzania zapytań użytkowników i pobierania odpowiednich fragmentów z bazy danych wektorowych w celu generowania dokładnych odpowiedzi. Obsługuje także przypisywanie źródeł i pamięć krótkotrwałą potrzebną w zastosowaniach RAG.

Dzięki temu możesz skoncentrować się na podstawowych zastosowaniach biznesowych i wyeliminować niezróżnicowane dźwiganie ciężkich przedmiotów.

Omówienie rozwiązania

Rozwiązanie zaprezentowane w tym poście wykorzystuje chatbota utworzonego przy użyciu pliku Strumieniowe aplikacji i obejmuje następujące usługi AWS:

Poniższy diagram przedstawia typowy wzorzec architektury rozwiązania, którego można użyć do zintegrowania dowolnej aplikacji chatbota z bazami wiedzy dla Amazon Bedrock.

Architektura ta obejmuje następujące kroki:

- Użytkownik wchodzi w interakcję z interfejsem chatbota Streamlit i przesyła zapytanie w języku naturalnym

- To wyzwala funkcję Lambda, która wywołuje bazy wiedzy

RetrieveAndGenerateAPI. Wewnętrznie Bazy Wiedzy korzystają z pliku Amazon Tytan osadzanie modelu i konwertuje zapytanie użytkownika na wektor i znajduje fragmenty, które są semantycznie podobne do zapytania użytkownika. Podpowiedź użytkownika jest następnie uzupełniana fragmentami pobranymi z bazy wiedzy. Podpowiedź wraz z dodatkowym kontekstem jest następnie wysyłana do LLM w celu wygenerowania odpowiedzi. W tym rozwiązaniu używamy Antropiczny Claude Instant jako nasz LLM do generowania odpowiedzi użytkowników przy użyciu dodatkowego kontekstu. Należy pamiętać, że to rozwiązanie jest obsługiwane w regionach, w których znajduje się Anthropic Claude na Amazon Bedrock dostępny. - Odpowiednia kontekstowo odpowiedź jest wysyłana z powrotem do aplikacji chatbota i użytkownika.

Wymagania wstępne

Użytkownicy Amazon Bedrock muszą poprosić o dostęp do modeli fundamentów, zanim będą one dostępne do użytku. Jest to czynność jednorazowa i zajmuje mniej niż minutę. Aby skorzystać z tego rozwiązania, musisz włączyć dostęp do modelu Titan Embeddings G1 – Text i Claude Instant – v1.2 w Amazon Bedrock. Aby uzyskać więcej informacji, zobacz Dostęp do modelu.

Sklonuj repozytorium GitHub

Rozwiązanie przedstawione w tym poście jest dostępne poniżej GitHub repo. Musisz sklonować repozytorium GitHub na komputer lokalny. Otwórz okno terminala i uruchom następujące polecenie. Zauważ, że jest to jedno polecenie klonowania git.

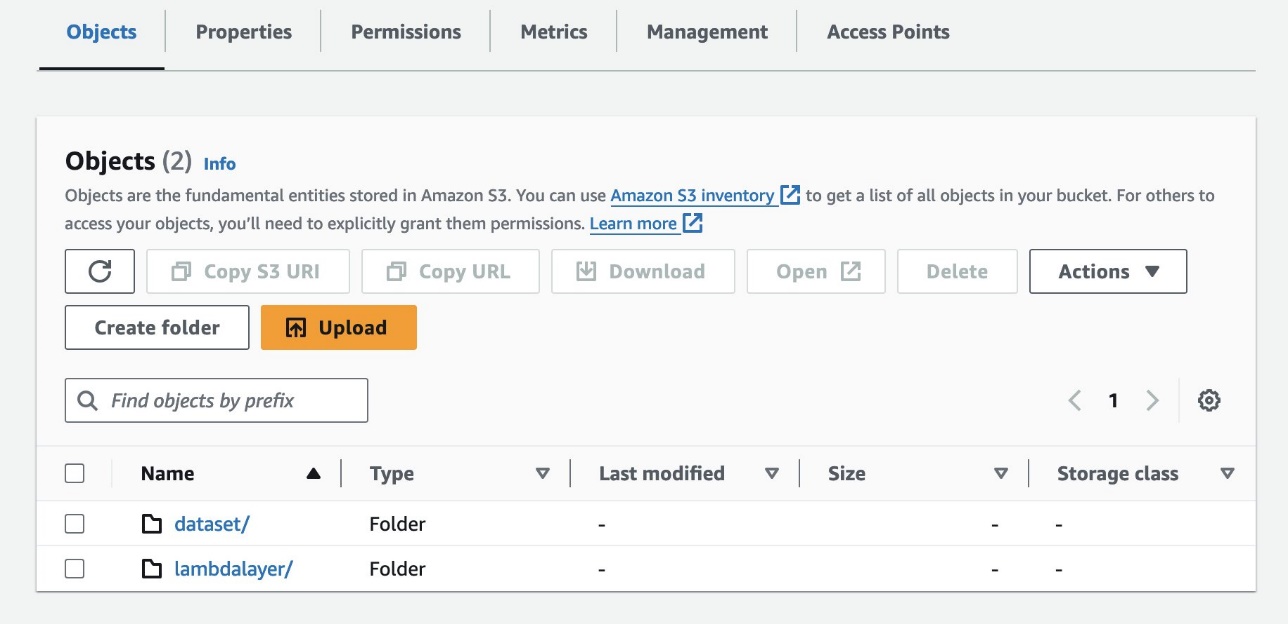

Prześlij swój zbiór danych wiedzy do Amazon S3

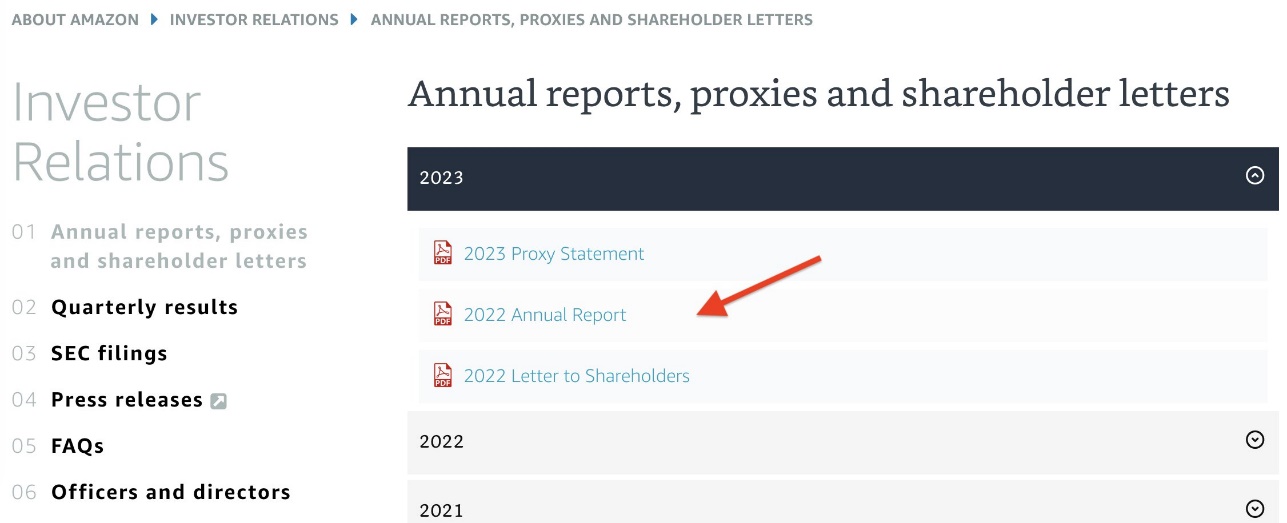

Pobieramy zbiór danych do naszej bazy wiedzy i przesyłamy go do segmentu S3. Ten zbiór danych będzie zasilał i zasilał bazę wiedzy. Wykonaj następujące kroki:

- Nawiguj do Sprawozdania roczne, pełnomocnictwa i pisma akcjonariuszy repozytorium danych i pobierz listy akcjonariuszy Amazon z ostatnich kilku lat.

- Na konsoli Amazon S3 wybierz Wiadra w okienku nawigacji.

- Dodaj Utwórz wiadro.

- Nazwij wiadro

knowledgebase-<your-awsaccount-number>. - Pozostaw wszystkie pozostałe ustawienia zasobnika jako domyślne i wybierz Stwórz.

- Nawiguj do

knowledgebase-<your-awsaccount-number>wiadro. - Dodaj Utwórz folder i nazwij go zbiorem danych.

- Pozostaw wszystkie pozostałe ustawienia folderów jako domyślne i wybierz Stwórz.

- Wróć do domu wiadra i wybierz Utwórz folder , aby utworzyć nowy folder i nadać mu nazwę

lambdalayer. - Pozostaw wszystkie inne ustawienia jako domyślne i wybierz Stwórz.

- Nawiguj do

datasetteczka. - Prześlij pobrane wcześniej pliki danych raportów rocznych, pełnomocnictw i listów do akcjonariuszy do tego zasobnika i wybierz Prześlij.

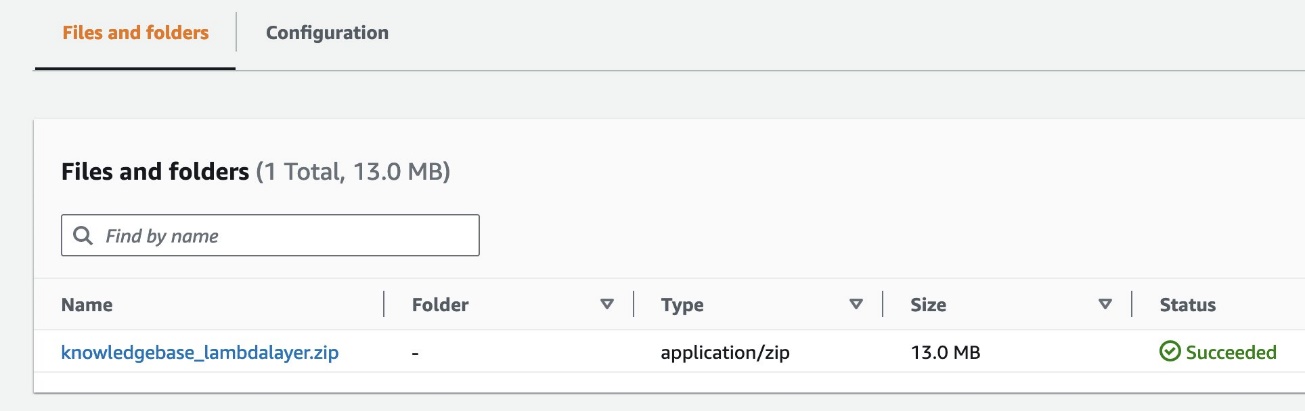

- Nawiguj do

lambdalayerteczka. - Prześlij plik

knowledgebase-lambdalayer.zipplik dostępny pod/lambda/layerfolder w repozytorium GitHub, które sklonowałeś wcześniej i wybierz Prześlij. Użyjesz tego kodu warstwy Lambda później do utworzenia funkcji Lambda.

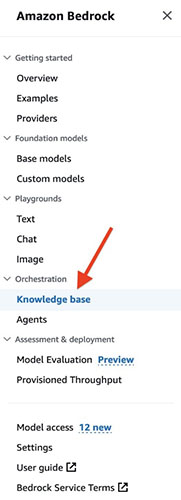

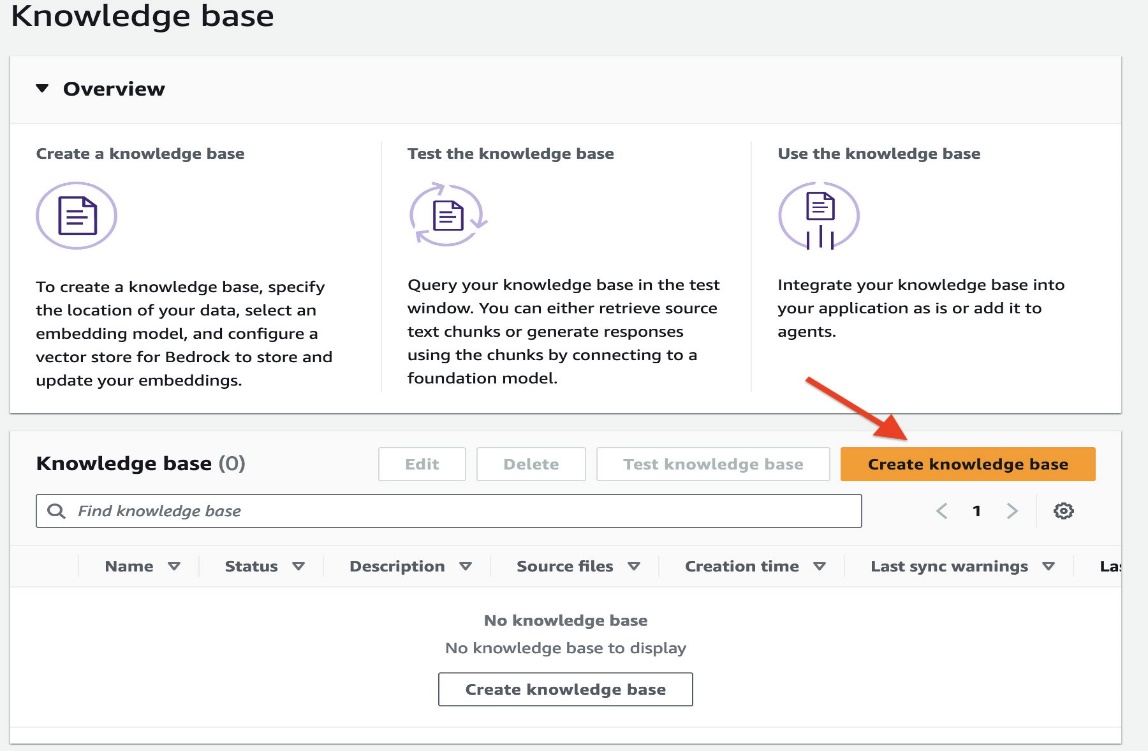

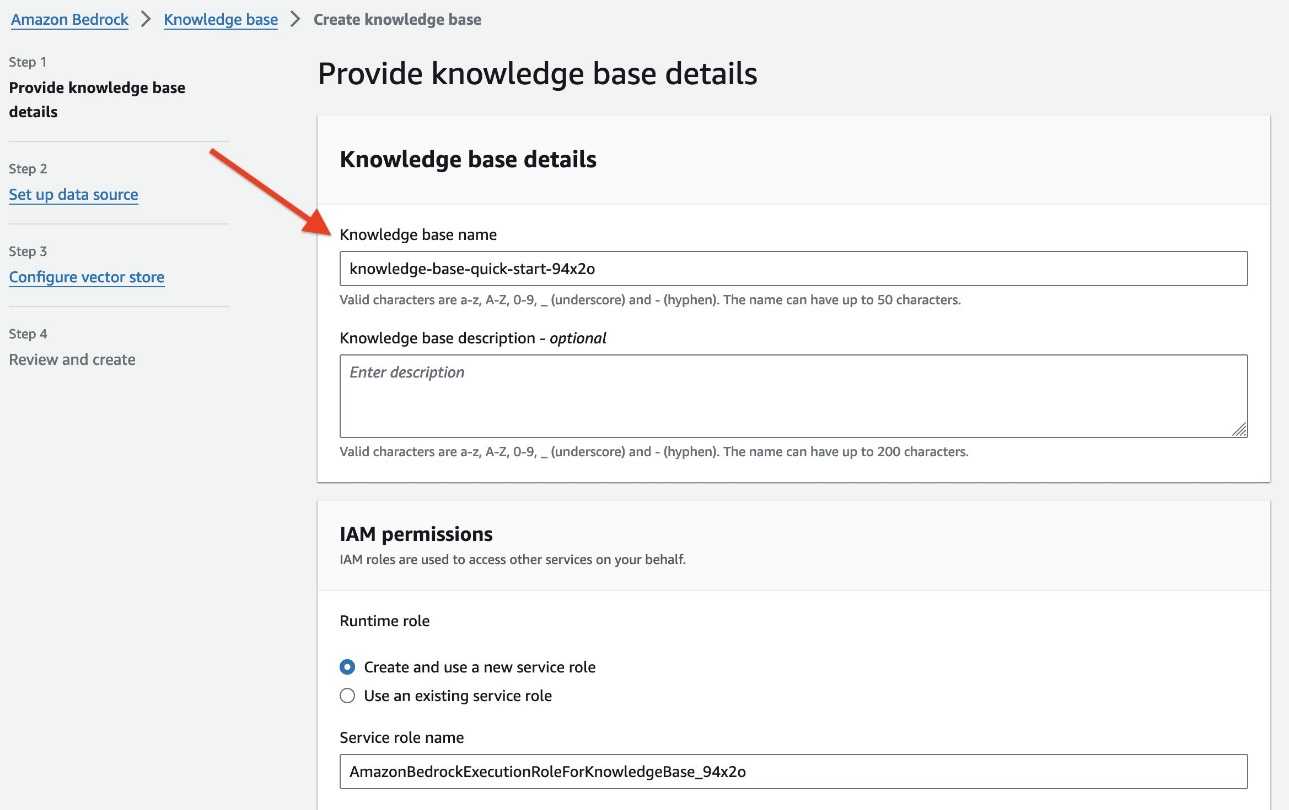

Utwórz bazę wiedzy

Na tym etapie tworzymy bazę wiedzy, korzystając ze zbioru danych listów akcjonariuszy Amazon, który przesłaliśmy do naszego segmentu S3 w poprzednim kroku.

- Na konsoli Amazon Bedrock w sekcji orkiestracja w okienku nawigacji wybierz Blog.

- Dodaj Utwórz bazę wiedzy.

- W Szczegóły bazy wiedzy sekcji wprowadź nazwę i opcjonalny opis.

- W Uprawnienia sekcja, wybierz Utwórz i użyj nowej roli usługi i wprowadź nazwę roli.

- Dodaj tagi według potrzeb.

- Dodaj Następna.

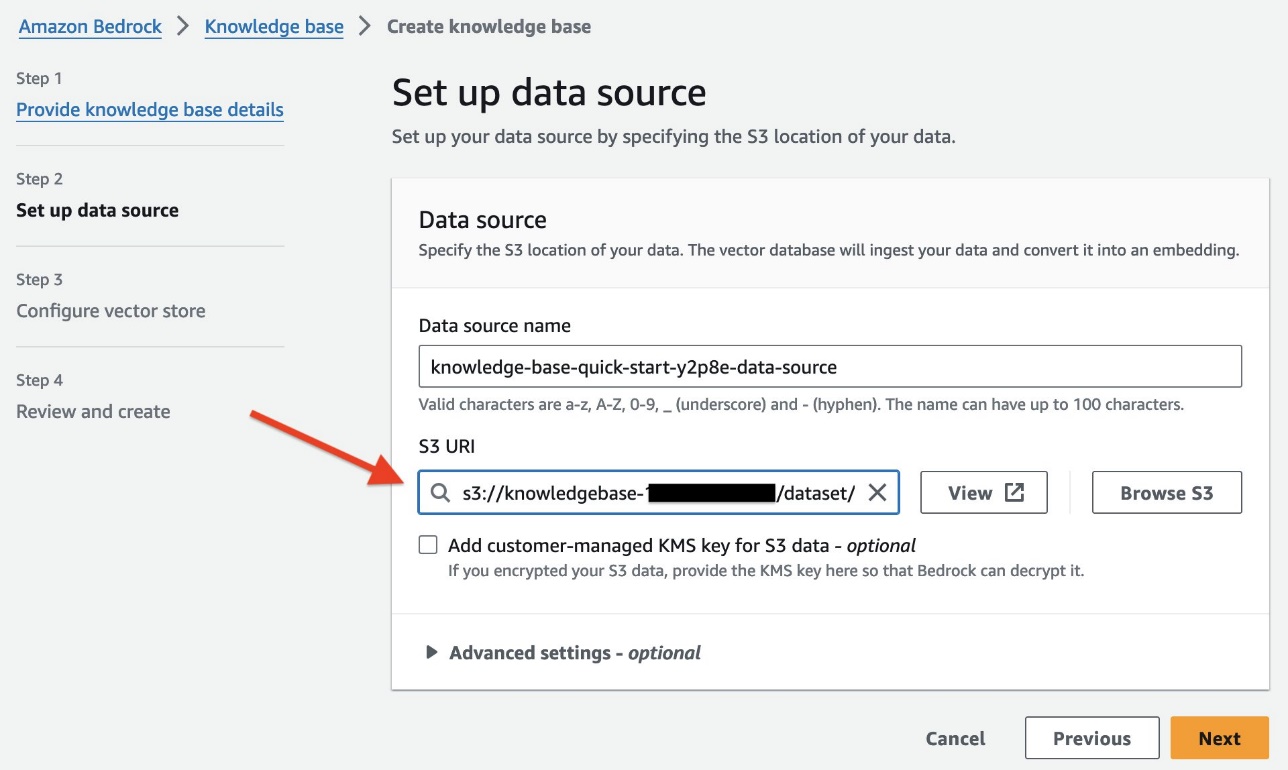

- Pozostawiać Nazwa źródła danych jako nazwa domyślna.

- W razie zamówieenia projektu Identyfikator URI S3wybierz Przeglądaj S3 aby wybrać wiadro S3

knowledgebase-<your-account-number>/dataset/.Musisz wskazać folder wiadra i zestawu danych utworzony w poprzednich krokach. - W ustawienia zaawansowane sekcji, pozostaw wartości domyślne (jeśli chcesz, możesz zmienić domyślną strategię fragmentowania i określić rozmiar porcji i nakładkę w procentach).

- Dodaj Następna.

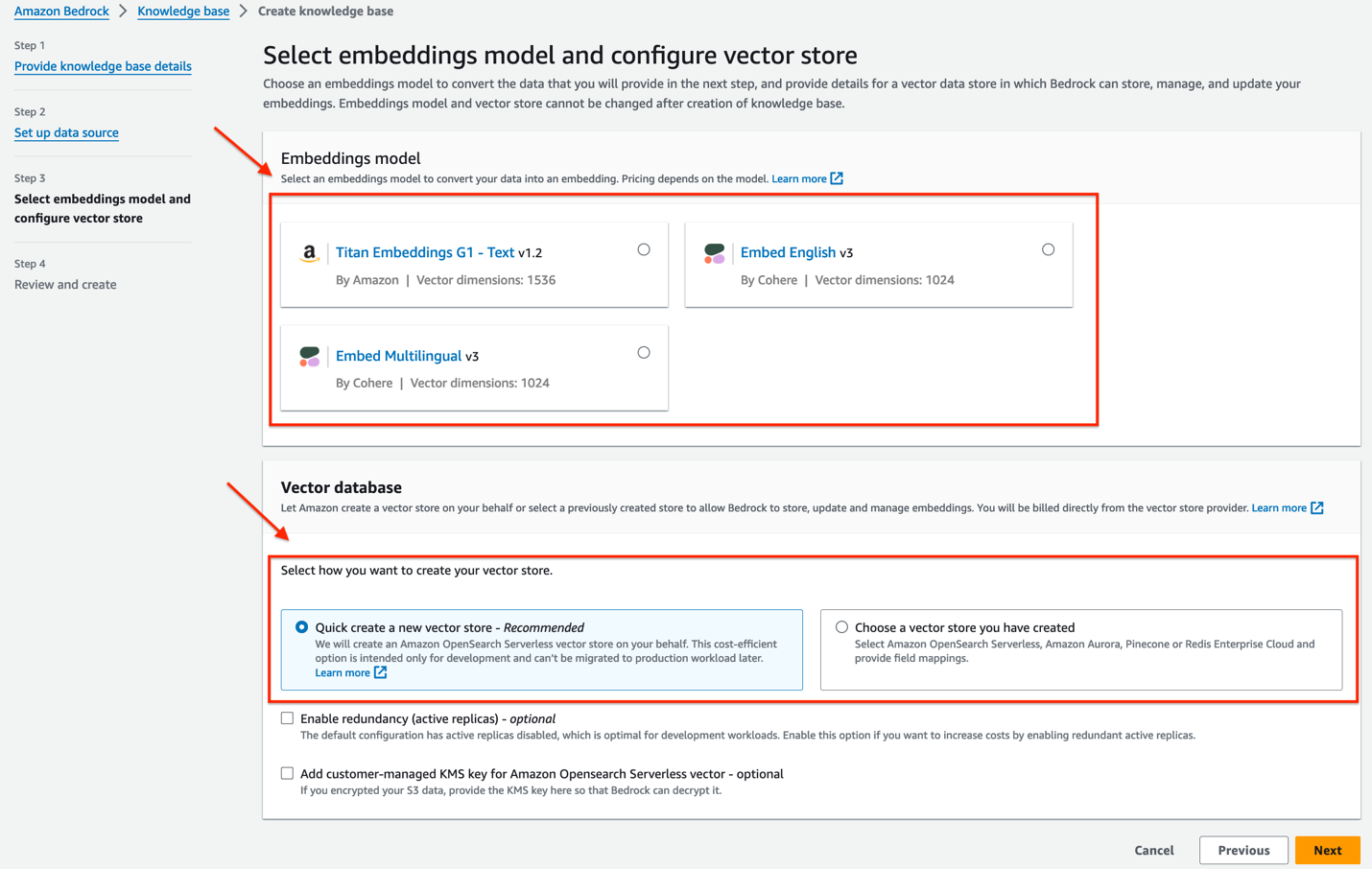

- W razie zamówieenia projektu Model osadzania, Wybierz Titan Embedding G1 – Tekst.

- W razie zamówieenia projektu Baza danych wektorowych, możesz wybrać Szybko utwórz nowy sklep wektorowy or Wybierz utworzony sklep wektorowy. Pamiętaj, że aby móc korzystać z wybranego magazynu wektorów, musisz mieć wstępnie skonfigurowany magazyn wektorów. Obecnie obsługujemy cztery typy silników wektorowych: silnik wektorowy dla Amazon OpenSearch Serverless, Amazon Aurora, Pinecone i Redis Enterprise Cloud. W tym poście wybieramy opcję Szybkie utworzenie nowego sklepu wektorowego, co domyślnie tworzy na Twoim koncie nowy sklep wektorowy OpenSearch Serverless.

- Dodaj Następna.

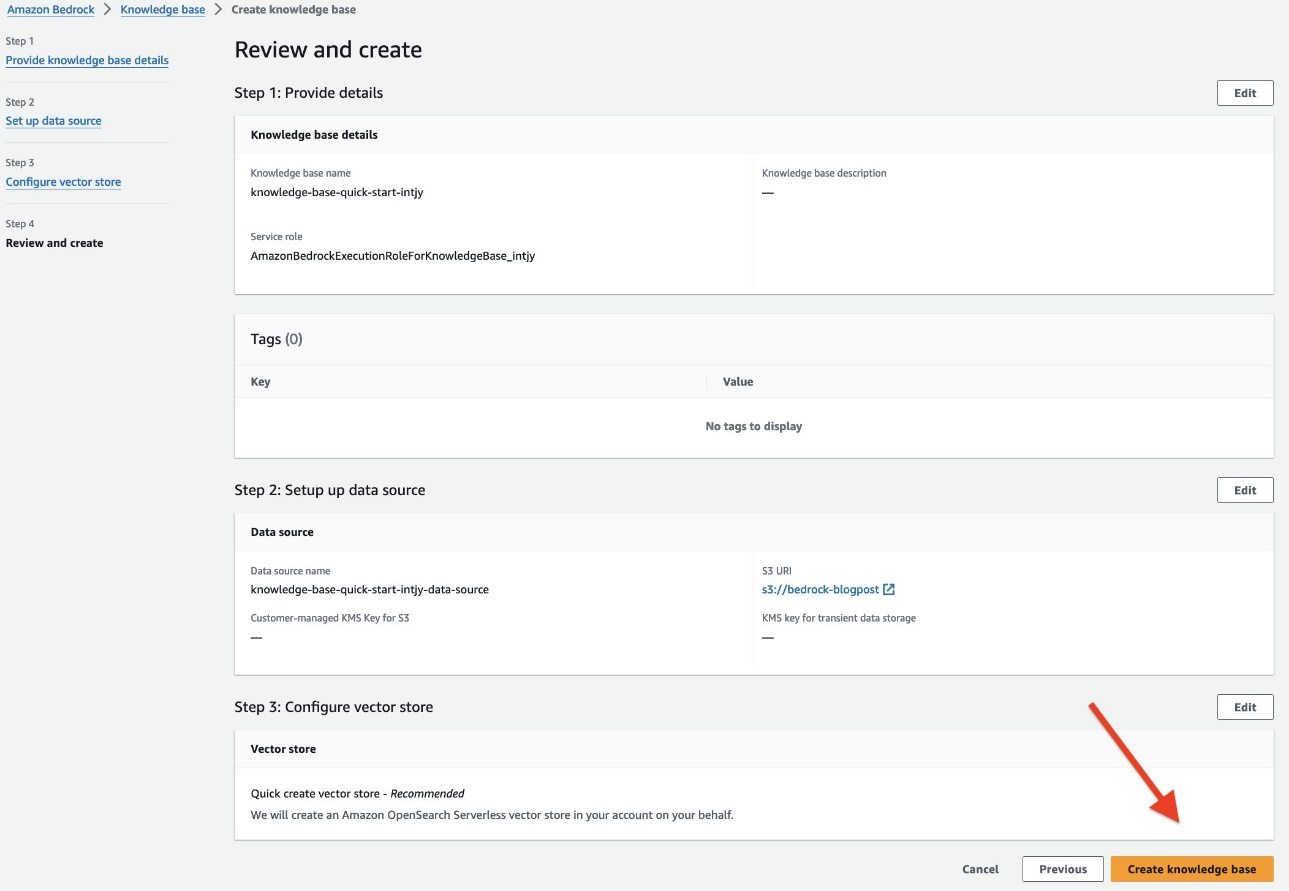

- Na Przejrzyj i utwórz stronę, przejrzyj wszystkie informacje lub wybierz Poprzednie aby zmodyfikować dowolne opcje.

- Dodaj Utwórz bazę wiedzy.

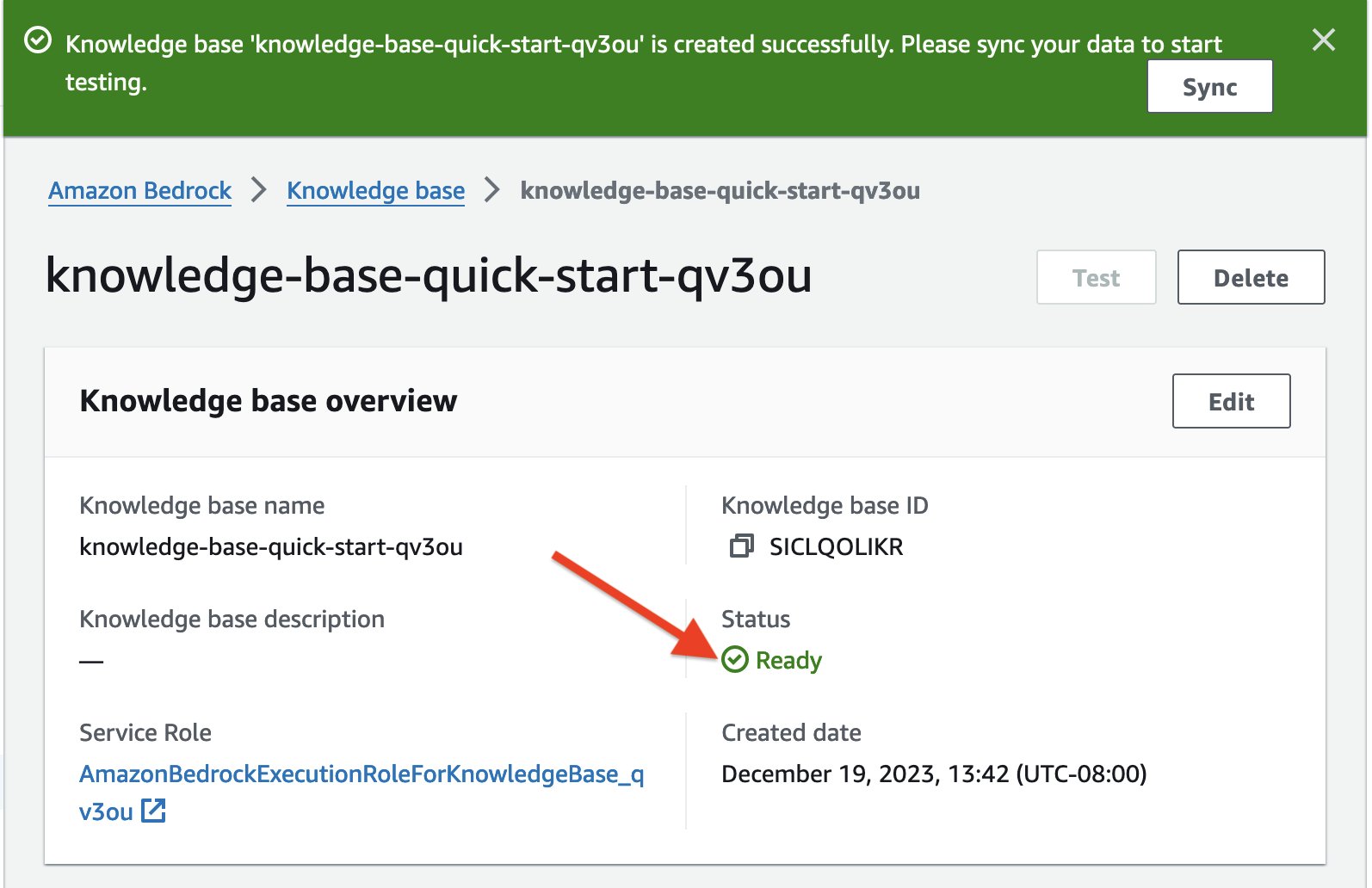

Należy pamiętać, że rozpoczyna się proces tworzenia bazy wiedzy i ma ona status W toku. Utworzenie sklepu wektorowego i bazy wiedzy zajmie kilka minut. Nie opuszczaj strony, w przeciwnym razie utworzenie się nie powiedzie.

Należy pamiętać, że rozpoczyna się proces tworzenia bazy wiedzy i ma ona status W toku. Utworzenie sklepu wektorowego i bazy wiedzy zajmie kilka minut. Nie opuszczaj strony, w przeciwnym razie utworzenie się nie powiedzie. - Gdy stan bazy wiedzy to

Readystanu, zanotuj identyfikator bazy wiedzy. Wykorzystasz go w kolejnych krokach do skonfigurowania funkcji Lambda.

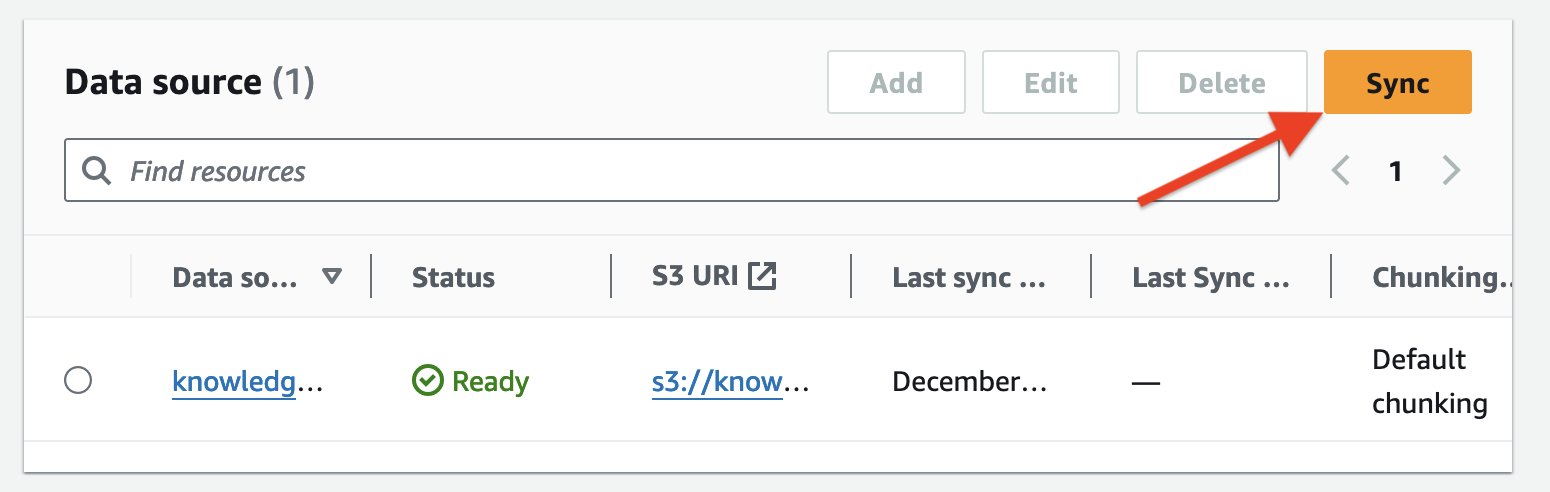

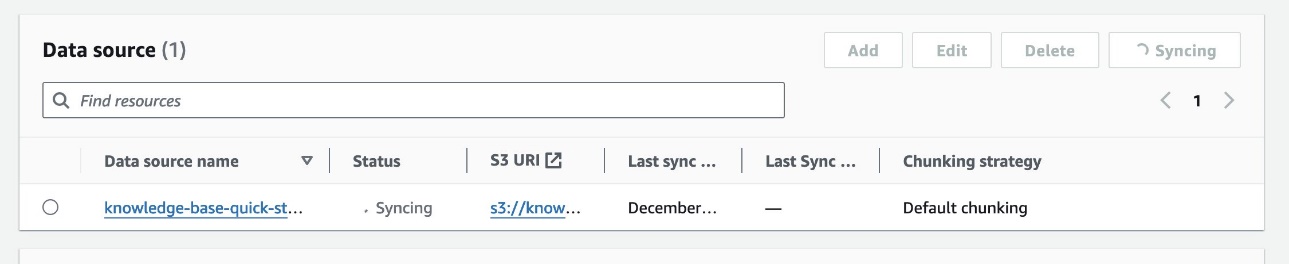

- Teraz, gdy baza wiedzy jest już gotowa, musimy zsynchronizować z nią dane z listów akcjonariuszy Amazon. w Źródło danych w sekcji strony szczegółów bazy wiedzy wybierz Sync aby uruchomić proces pozyskiwania danych z segmentu S3 do bazy wiedzy.

Ten proces synchronizacji dzieli pliki dokumentów na mniejsze fragmenty o określonym wcześniej rozmiarze, generuje osadzanie wektorów przy użyciu wybranego modelu osadzania tekstu i przechowuje je w magazynie wektorów zarządzanym przez Bazy wiedzy dla Amazon Bedrock.

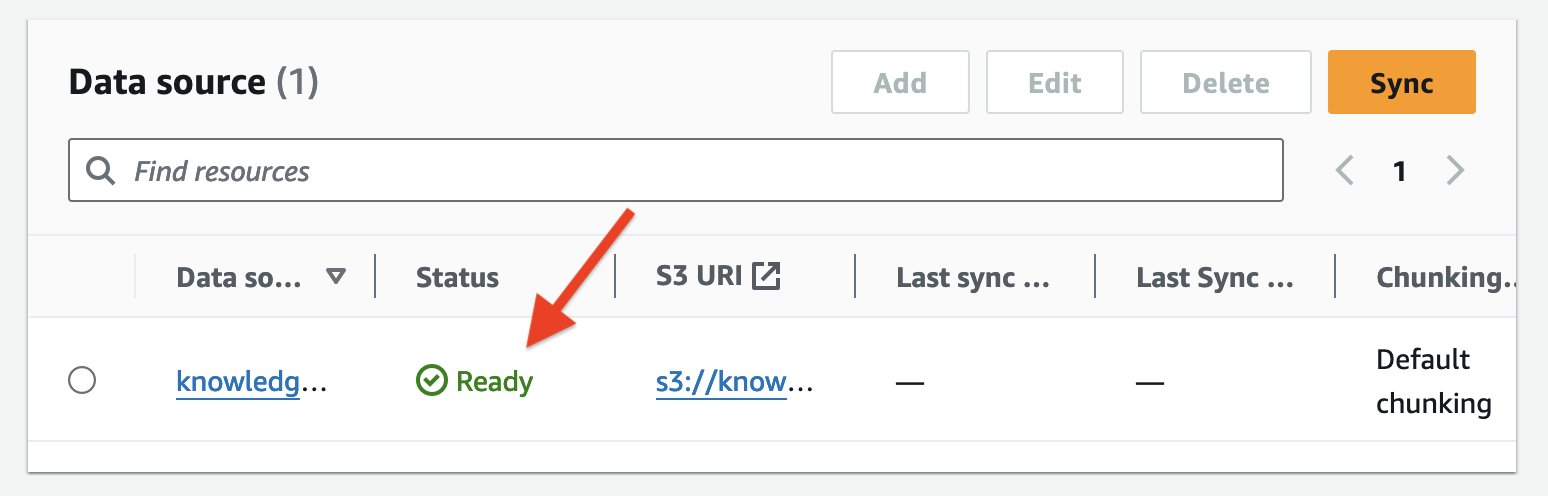

Po zakończeniu synchronizacji zestawu danych status źródła danych zmieni się na Ready państwo. Pamiętaj, że jeśli dodasz dodatkowe dokumenty do folderu danych S3, musisz ponownie zsynchronizować bazę wiedzy.

Gratulacje, Twoja baza wiedzy jest gotowa.

Pamiętaj, że możesz także skorzystać z baz wiedzy dotyczących interfejsów API usług Amazon Bedrock i Interfejs wiersza poleceń AWS (AWS CLI) do programowego tworzenia bazy wiedzy. Będziesz musiał uruchomić różne sekcje notatnika Jupyter dostarczonego w sekcji /notebook folder w repozytorium GitHub.

Utwórz funkcję Lambda

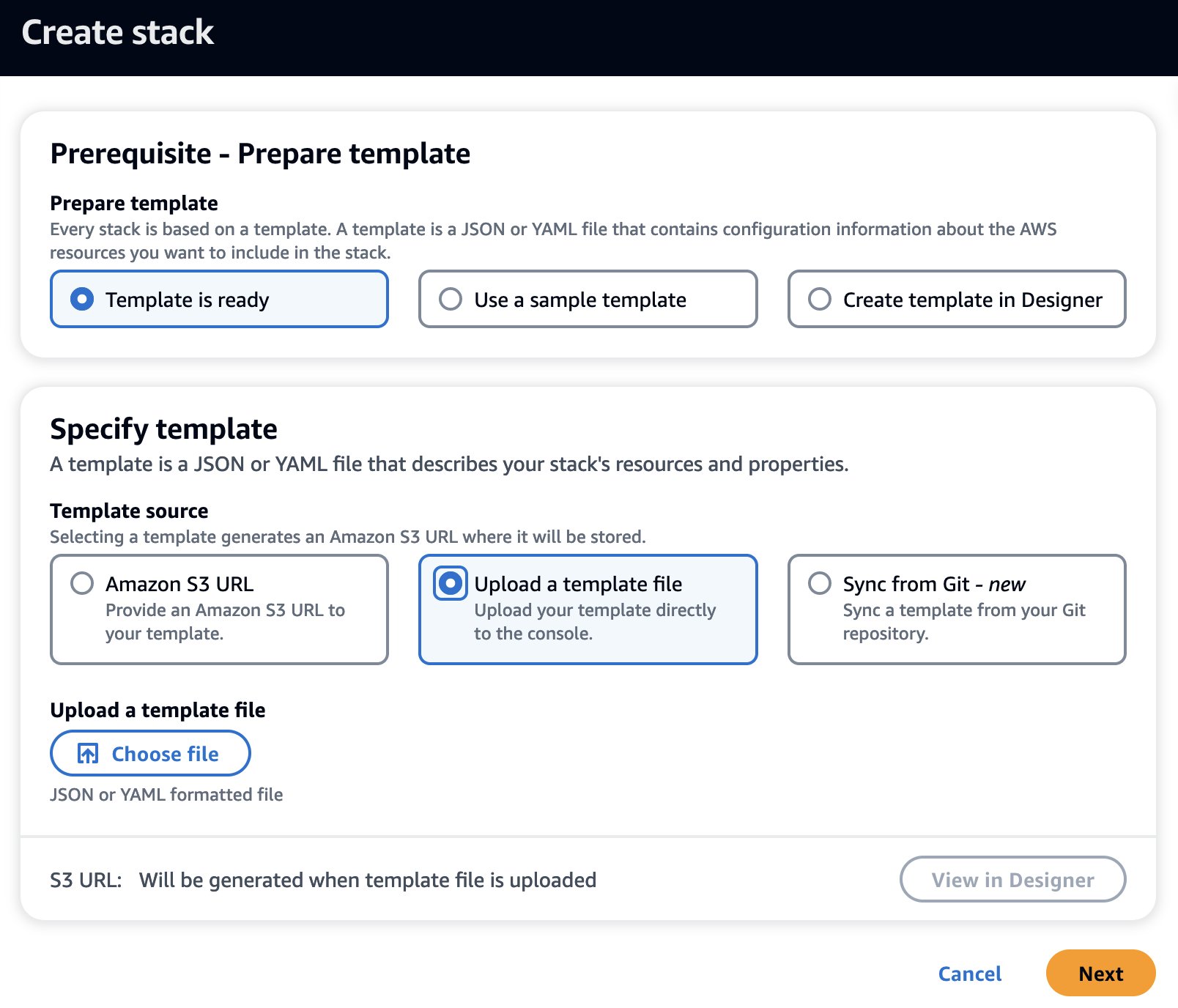

Ta funkcja Lambda jest wdrażana przy użyciu pliku Tworzenie chmury AWS szablon dostępny w repozytorium GitHub w sekcji /cfn teczka. Szablon wymaga dwóch parametrów: nazwy segmentu S3 i identyfikatora bazy wiedzy.

- Na stronie głównej usługi AWS CloudFormation wybierz Utwórz stos aby utworzyć nowy stos.

- Wybierz Szablon jest gotowy dla Przygotuj szablon.

- Wybierz Prześlij plik szablonu dla Źródło szablonu.

- Dodaj Wybierz plik, przejdź do sklonowanego wcześniej repozytorium GitHub i wybierz plik .yaml w obszarze

/cfnteczka. - Dodaj Następna.

- W razie zamówieenia projektu Nazwa stosu, Wpisz imię.

- W parametry wprowadź zanotowany wcześniej identyfikator bazy wiedzy i nazwę segmentu S3.

- Dodaj Następna.

- Pozostaw wszystkie opcje domyślne bez zmian, wybierz Następnai wybierz Prześlij.

- Sprawdź, czy szablon CloudFormation został pomyślnie uruchomiony i nie ma żadnych błędów.

Gratulacje, pomyślnie utworzyłeś funkcję Lambda, powiązane role i zasady.

Przetestuj aplikację chatbota kontekstowego

Aby przetestować aplikację chatbota, wykonaj następujące kroki:

- Otwórz nowy terminal lub okno wiersza poleceń na swoim komputerze.

- Uruchom następujące polecenie, aby zainstalować AWS SDK dla Pythona (Boto3). Boto3 ułatwia integrację aplikacji, biblioteki lub skryptu w języku Python z usługami AWS.

- Uruchom następującą komendę, aby zainstalować i skonfigurować lokalne środowisko programistyczne w języku Python w celu uruchomienia aplikacji Streamlit:

- Nawiguj do

/streamlitfolder w folderze repozytorium GitHub, który sklonowałeś wcześniej. - Uruchom następujące polecenie, aby utworzyć instancję aplikacji chatbota:

Powinno to otworzyć internetową aplikację do czatowania obsługiwaną przez Streamlit w domyślnej przeglądarce internetowej.

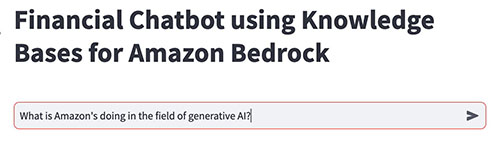

- Użyj tej aplikacji chatbota Streamlit, aby zadawać pytania w języku naturalnym i rozpoczynać rozmowy obsługiwane przez bazy wiedzy dla Amazon Bedrock.

Po przesłaniu monitu aplikacja Streamlit uruchamia funkcję Lambda, która wywołuje bazy wiedzy RetrieveAndGenerate API do wyszukiwania i generowania odpowiedzi.

Poniższa tabela zawiera kilka przykładowych pytań i powiązanych odpowiedzi z bazy wiedzy. Wypróbuj niektóre z tych pytań, korzystając z podpowiedzi.

| pytania | odpowiedzi |

| Co Amazon robi w obszarze generatywnej sztucznej inteligencji? | Amazon pracuje nad własnymi dużymi modelami językowymi (LLM) na potrzeby generatywnej sztucznej inteligencji i wierzy, że zmieni to i poprawi doświadczenia każdego klienta. Planują w dalszym ciągu znacząco inwestować w te modele we wszystkich doświadczeniach konsumentów, sprzedawców, marek i twórców. |

| Jakie są przychody AWS rok do roku w 2022 r.? | Przychody AWS wzrosły o 29% rok do roku w 2022 r., przy przychodach wynoszących 62 miliardy dolarów. |

| Przez ile dni Amazon zapraszał pracowników do pracy w biurze? | Amazon poprosił pracowników korporacji, aby począwszy od maja 2022 r. wracali do biura co najmniej trzy dni w tygodniu. |

| O jaki procent przychody AWS wzrosły rok do roku w 2022 r.? | W 29 r. AWS osiągnął 2022% przychodów rok do roku („r/r”). |

| Jaką poprawę wydajności zapewniły chipy Graviton2, zgodnie z fragmentem, w porównaniu z procesorami Graviton3? | W 2022 roku firma AWS dostarczyła chipy Graviton3, zapewniające o 25% lepszą wydajność niż procesory Graviton2. |

| Który zgodnie z fragmentem był pierwszym chipem wnioskującym uruchomionym przez AWS? | AWS wypuściło na rynek swoje pierwsze chipy wnioskowania („Inferentia”) w 2019 r., dzięki czemu firmom takim jak Amazon zaoszczędzono ponad sto milionów dolarów na wydatkach kapitałowych. |

| Zgodnie z kontekstem, w którym roku roczne przychody Amazona wzrosły z 245 miliardów dolarów do 434 miliardów dolarów? | Roczne przychody Amazona wzrosły z 245 miliardów dolarów w 2019 roku do 434 miliardów dolarów w 2022 roku. |

| Powiedz mi jeszcze raz, jakie były przychody w 2019 r.? | Przychody Amazona w 2019 roku wyniosły 245 miliardów dolarów. |

| i 2021? | Przychody Amazona w 2021 r. wyniosły 469.8 miliarda dolarów, co oznacza wzrost o 22% w stosunku do roku 2020. |

| I przypomnij mi jeszcze raz, kiedy został wprowadzony na rynek pierwszy chip wnioskowujący? | Pierwszym chipem wnioskowującym Amazona była Inferentia, która została wprowadzona na rynek w 2019 roku. |

Podczas pierwszego wywołania funkcji Lambda plik RetrieveAndGenerate API zwraca a sessionId, który jest następnie przekazywany przez aplikację Streamlit wraz z kolejnym monitem użytkownika jako dane wejściowe do interfejsu API RetrieveAndGenerate w celu kontynuowania konwersacji w tej samej sesji. The RetrieveAndGenerate API zarządza pamięcią krótkotrwałą i korzysta z historii czatów, o ile ten sam identyfikator sesji jest przekazywany jako dane wejściowe w kolejnych wywołaniach.

Gratulacje, pomyślnie utworzyłeś i przetestowałeś aplikację chatbota przy użyciu Baz wiedzy dla Amazon Bedrock.

Sprzątać

Nieusunięcie zasobów, takich jak zasobnik S3, kolekcja OpenSearch Serverless i baza wiedzy, spowoduje naliczenie opłat. Aby wyczyścić te zasoby, usuń stos CloudFormation, usuń segment S3 (w tym wszystkie foldery dokumentów i pliki przechowywane w tym zasobniku), usuń kolekcję OpenSearch Serverless, usuń bazę wiedzy i usuń wszelkie role, zasady i uprawnienia, które posiadasz stworzony wcześniej.

Wnioski

W tym poście przedstawiliśmy przegląd chatbotów kontekstowych i wyjaśniliśmy, dlaczego są one ważne. Opisaliśmy złożoność związaną z przepływami pracy związanymi z pozyskiwaniem danych i generowaniem tekstu dla architektury RAG. Następnie przedstawiliśmy, jak Bazy wiedzy dla Amazon Bedrock tworzą w pełni zarządzany, bezserwerowy system RAG, w tym sklep wektorowy. Na koniec udostępniliśmy architekturę rozwiązania i przykładowy kod w formacie GitHub repo do pobierania i generowania odpowiedzi kontekstowych dla aplikacji chatbota przy użyciu bazy wiedzy.

Wyjaśniając wartość chatbotów kontekstowych, wyzwania stojące przed systemami RAG oraz sposób, w jaki bazy wiedzy dla Amazon Bedrock radzą sobie z tymi wyzwaniami, ten post miał na celu pokazanie, w jaki sposób Amazon Bedrock umożliwia tworzenie zaawansowanych konwersacyjnych aplikacji AI przy minimalnym wysiłku.

Aby uzyskać więcej informacji, zobacz Przewodnik programisty Amazon Bedrock i Interfejsy API bazy wiedzy.

O autorach

Manish Chugh jest głównym architektem rozwiązań w AWS z siedzibą w San Francisco w Kalifornii. Specjalizuje się w uczeniu maszynowym i generatywnej sztucznej inteligencji. Współpracuje z organizacjami, od dużych przedsiębiorstw po start-upy na wczesnym etapie rozwoju, nad problemami związanymi z uczeniem maszynowym. Jego rola polega na pomaganiu tym organizacjom w projektowaniu skalowalnych, bezpiecznych i opłacalnych obciążeń w AWS. Regularnie występuje na konferencjach AWS i innych wydarzeniach partnerskich. Poza pracą lubi wędrować szlakami w East Bay, jeździć na rowerze szosowym i oglądać (i grać) w krykieta.

Manish Chugh jest głównym architektem rozwiązań w AWS z siedzibą w San Francisco w Kalifornii. Specjalizuje się w uczeniu maszynowym i generatywnej sztucznej inteligencji. Współpracuje z organizacjami, od dużych przedsiębiorstw po start-upy na wczesnym etapie rozwoju, nad problemami związanymi z uczeniem maszynowym. Jego rola polega na pomaganiu tym organizacjom w projektowaniu skalowalnych, bezpiecznych i opłacalnych obciążeń w AWS. Regularnie występuje na konferencjach AWS i innych wydarzeniach partnerskich. Poza pracą lubi wędrować szlakami w East Bay, jeździć na rowerze szosowym i oglądać (i grać) w krykieta.

Mani Chanuja jest Tech Lead – Generatative AI Specialists, autorką książki Applied Machine Learning and High Performance Computing on AWS oraz członkinią Rady Dyrektorów Fundacji ds. Kobiet w Edukacji Produkcyjnej. Prowadzi projekty uczenia maszynowego w różnych dziedzinach, takich jak widzenie komputerowe, przetwarzanie języka naturalnego i generatywna sztuczna inteligencja. Występuje na konferencjach wewnętrznych i zewnętrznych, takich jak AWS re:Invent, Women in Manufacturing West, webinary na YouTube i GHC 23. W wolnym czasie lubi długie biegi po plaży.

Mani Chanuja jest Tech Lead – Generatative AI Specialists, autorką książki Applied Machine Learning and High Performance Computing on AWS oraz członkinią Rady Dyrektorów Fundacji ds. Kobiet w Edukacji Produkcyjnej. Prowadzi projekty uczenia maszynowego w różnych dziedzinach, takich jak widzenie komputerowe, przetwarzanie języka naturalnego i generatywna sztuczna inteligencja. Występuje na konferencjach wewnętrznych i zewnętrznych, takich jak AWS re:Invent, Women in Manufacturing West, webinary na YouTube i GHC 23. W wolnym czasie lubi długie biegi po plaży.

Pallavi Nargund jest głównym architektem rozwiązań w AWS. Pełniąc rolę osoby wspierającej technologię chmury, współpracuje z klientami, aby zrozumieć ich cele i wyzwania, a także udziela wskazówek, jak osiągnąć swoje cele dzięki ofertom AWS. Jej pasją są kobiety w technologii i jest główną członkinią Women in AI/ML w Amazon. Występuje na konferencjach wewnętrznych i zewnętrznych, takich jak AWS re:Invent, AWS Summits i webinariach. Poza pracą lubi wolontariat, prace w ogrodzie, jazdę na rowerze i piesze wędrówki.

Pallavi Nargund jest głównym architektem rozwiązań w AWS. Pełniąc rolę osoby wspierającej technologię chmury, współpracuje z klientami, aby zrozumieć ich cele i wyzwania, a także udziela wskazówek, jak osiągnąć swoje cele dzięki ofertom AWS. Jej pasją są kobiety w technologii i jest główną członkinią Women in AI/ML w Amazon. Występuje na konferencjach wewnętrznych i zewnętrznych, takich jak AWS re:Invent, AWS Summits i webinariach. Poza pracą lubi wolontariat, prace w ogrodzie, jazdę na rowerze i piesze wędrówki.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :ma

- :Jest

- :Gdzie

- $W GÓRĘ

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- zdolność

- O nas

- przyśpieszyć

- dostęp

- Dostęp

- Stosownie

- Konto

- dokładny

- Osiągać

- w poprzek

- Działania

- Dodaj

- Dodatkowy

- Adresy

- zaawansowany

- Zalety

- doradcy

- ponownie

- agentów

- AI

- Systemy SI

- AI / ML

- wymierzony

- Wszystkie kategorie

- Pozwalać

- pozwala

- sam

- wzdłuż

- wzdłuż

- również

- Amazonka

- Amazon Web Services

- an

- i

- roczny

- PRZYCHODY ROCZNE

- odpowiedź

- sekretarka

- Antropiczny

- każdy

- api

- Pszczoła

- Aplikacja

- Zastosowanie

- aplikacje

- stosowany

- podejście

- architektura

- SĄ

- AS

- At

- zwiększać

- zwiększona

- rozszerzenia

- jutrzenka

- autor

- automatycznie

- dostępny

- Aleja

- z dala

- AWS

- Tworzenie chmury AWS

- AWS re: Invent

- z powrotem

- baza

- na podstawie

- podstawowy

- Zatoka

- Plaża

- stają się

- być

- zanim

- Początek

- zaczyna się

- zachowanie

- uważa,

- Ulepsz Swój

- Miliard

- deska

- Rada dyrektorów

- książka

- marka

- przeglądarka

- budować

- biznes

- Aplikacje biznesowe

- by

- CA

- wezwanie

- Połączenia

- CAN

- możliwości

- kapitał

- Etui

- CD

- wyzwania

- zmiana

- Zmiany

- Opłaty

- pogawędzić

- chatbot

- nasze chatboty

- Koszyk

- żeton

- Frytki

- wybór

- Dodaj

- kleń

- Cli

- Chmura

- TECHNOLOGIA W CHMURZE

- kod

- kolekcja

- kombajny

- jak

- byliśmy spójni, od początku

- wspólny

- Firmy

- sukcesy firma

- kompletny

- złożoności

- składniki

- obliczeniowy

- komputer

- Wizja komputerowa

- computing

- konferencje

- Skontaktuj się

- Konsola

- konsument

- kontekst

- kontekstowy

- kontekstualizować

- kontynuować

- Rozmowa

- konwersacyjny

- konwersacyjna sztuczna inteligencja

- rozmowy

- przeliczone

- rdzeń

- Korporacyjny

- opłacalne

- mógłby

- Stwórz

- stworzony

- tworzy

- Tworzenie

- tworzenie

- twórca

- krykiet

- Obecnie

- klient

- zachowanie klienta

- doświadczenie klienta

- Obsługa klienta

- Klientów

- dostosowane

- dane

- punkty danych

- sterowane danymi

- Baza danych

- Dni

- Domyślnie

- dostarczyć

- dostarczona

- dostarczanie

- W zależności

- wdrażane

- Wdrożenie

- opisane

- opis

- detale

- Ustalać

- rozwijać

- Deweloper

- oprogramowania

- schemat

- ZROBIŁ

- różne

- cyfrowy

- Dyrektorzy

- inny

- dokument

- dokumenty

- robi

- dolarów

- domeny

- nie

- na dół

- pobieranie

- każdy

- Wcześniej

- wczesna faza

- Wschód

- Edukacja

- wydajny

- wysiłek

- bez wysiłku

- bądź

- osadzanie

- pracowników

- umożliwiać

- aktywator

- Umożliwia

- ujmujący

- silnik

- Inżynieria

- wzmocnione

- wzmocnienie

- Wchodzę

- Enterprise

- przedsiębiorstwa

- Środowisko

- Błędy

- Parzyste

- wydarzenia

- Każdy

- przykład

- doświadczenie

- Doświadczenia

- ekspertyza

- Wyjaśniać

- wyjaśnione

- wyjaśniając

- zewnętrzny

- fakty

- FAIL

- kilka

- pole

- filet

- Akta

- W końcu

- znajduje

- i terminów, a

- pływ

- Skupiać

- następujący

- W razie zamówieenia projektu

- Fundacja

- cztery

- Francisco

- Darmowy

- od

- w pełni

- funkcjonować

- g1

- Generować

- generuje

- generacja

- generatywny

- generatywna sztuczna inteligencja

- git

- GitHub

- Dać

- Go

- Gole

- wzrosła

- Ziemia

- Rosnąć

- Rośnie

- poradnictwo

- miał

- uchwyt

- Uchwyty

- Have

- he

- ciężki

- ciężkie podnoszenie

- pomoc

- jej

- Wysoki

- na wysokim szczeblu

- jego

- historia

- Strona główna

- W jaki sposób

- Jednak

- HTML

- http

- HTTPS

- cetnar

- ID

- if

- zilustrować

- ilustruje

- wykonawczych

- ważny

- podnieść

- poprawa

- poprawy

- in

- obejmuje

- Włącznie z

- włączać

- zawiera

- Zwiększać

- wzrosła

- wskaźnik

- indeksy

- indywidualny

- przemysłowa

- informować

- Informacja

- Systemy informacyjne

- wkład

- Zapytania

- spostrzeżenia

- zainstalować

- natychmiastowy

- integrować

- Integracja

- integracja

- współdziała

- zainteresowania

- Interfejs

- wewnętrzny

- wewnętrznie

- najnowszych

- przedstawiać

- wprowadzono

- inwestowanie

- inwokuje

- zaangażowany

- dotyczy

- IT

- jpg

- Klawisz

- wiedza

- język

- Języki

- duży

- Duże przedsiębiorstwa

- Nazwisko

- później

- uruchomiona

- warstwa

- prowadzić

- Wyprowadzenia

- nauka

- najmniej

- Pozostawiać

- mniej

- list

- poziom

- biblioteki

- Biblioteka

- Modernizacja

- lubić

- lubi

- Ograniczony

- Linia

- Powiązanie

- LLM

- miejscowy

- długo

- maszyna

- uczenie maszynowe

- Główny

- WYKONUJE

- wykonalny

- zarządzane

- zarządza

- zarządzający

- produkcja

- wiele

- Mecz

- Może..

- me

- znaczenie

- mechanizm

- członek

- Pamięć

- jedynie

- milion

- milion dolarów

- minimalny

- chwila

- minut

- model

- modele

- modyfikować

- jeszcze

- większość

- wielokrotność

- Nazwa

- Naturalny

- Przetwarzanie języka naturalnego

- Nawigacja

- Nawigacja

- Potrzebować

- potrzebne

- wymagania

- Nowości

- Następny

- Nie

- żaden

- noty

- notatnik

- zauważyć

- cel

- of

- oferta

- Oferty

- Oferty

- Biurowe

- często

- on

- ONE

- koncepcja

- open source

- Optymalny

- Option

- Opcje

- or

- organizacji

- Inne

- Inaczej

- ludzkiej,

- na zewnątrz

- wydajność

- zewnętrzne

- koniec

- nad głową

- przegląd

- własny

- strona

- chleb

- parametry

- partnerem

- strony

- przejście

- fragmenty

- minęło

- namiętny

- Przeszłość

- Wzór

- procent

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- uprawnienia

- Personalizowany

- krok po kroku

- plato

- Analiza danych Platona

- PlatoDane

- gra

- punkt

- zwrotnica

- polityka

- Popularny

- popularność

- Post

- power

- powered

- mocny

- preferencje

- teraźniejszość

- przedstawione

- prezenty

- poprzedni

- Główny

- problemy

- wygląda tak

- przetwarzanie

- Procesory

- Produkty

- Postęp

- projektowanie

- monity

- własność

- zapewniać

- pod warunkiem,

- zapewnia

- że

- zakupy

- Python

- zapytania

- pytanie

- pytanie

- pytania

- Szybki

- szmata

- nośny

- RE

- gotowy

- real

- Prawdziwy świat

- w czasie rzeczywistym

- dokumentacja

- zmniejszyć

- redukcja

- odnosić się

- regiony

- regularnie

- związane z

- mających znaczenie

- usuwa

- Raporty

- składnica

- reprezentować

- zażądać

- wymagany

- Wymaga

- Zasoby

- Odpowiadać

- odpowiedź

- Odpowiedzi

- wyszukiwanie

- powraca

- dochód

- przeglądu

- droga

- Rola

- role

- run

- działa

- Czas

- taki sam

- próba

- San

- San Francisco

- zapisywane

- skalowalny

- skalowaniem

- scenariusz

- Sdk

- Szukaj

- Sekcja

- działy

- bezpieczne

- widzieć

- wybierać

- wybrany

- semantyczny

- wysłany

- służyć

- Bezserwerowe

- usługa

- Usługi

- Sesja

- zestaw

- w panelu ustawień

- ustawienie

- akcjonariusz

- Akcjonariusze

- ona

- krótkoterminowy

- powinien

- prezentacja

- znaczący

- podobny

- jednocześnie

- pojedynczy

- Rozmiar

- mniejszy

- rozwiązanie

- Rozwiązania

- kilka

- wyrafinowany

- Źródło

- Źródła

- Mówi

- Specjaliści

- specjalizuje się

- specyficzny

- określony

- dzielić

- Dzieli

- stos

- początek

- Startups

- Stan

- Rynek

- wynika

- Ewolucja krok po kroku

- Cel

- sklep

- przechowywany

- sklep

- przechowywania

- bezpośredni

- Strategia

- opływowy

- Zatwierdź

- kolejny

- w zasadzie

- Z powodzeniem

- taki

- sugerować

- Szczyty

- wsparcie

- Utrzymany

- podpory

- synchronizacja

- system

- systemy

- stół

- dostosowane

- Brać

- trwa

- zadania

- tech

- Technologia

- szablon

- terminal

- test

- przetestowany

- XNUMX

- niż

- że

- Połączenia

- Informacje

- Źródło

- ich

- Im

- następnie

- Tam.

- w związku z tym

- Te

- one

- to

- tych

- trzy

- Przez

- czas

- tytan

- do

- Przekształcać

- wyzwalać

- zaufany

- próbować

- drugiej

- typy

- dla

- zrozumieć

- aktualizowanie

- przesłanych

- posługiwać się

- używany

- Użytkownik

- Użytkownicy

- zastosowania

- za pomocą

- użyteczność

- v1

- Cenny

- wartość

- Wartości

- różnorodny

- wizja

- Tom

- chcieć

- była

- oglądania

- Droga..

- we

- sieć

- przeglądarka internetowa

- usługi internetowe

- Web-based

- Seminaria

- tydzień

- tygodni

- Zachód

- Co

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- dlaczego

- będzie

- okno

- w

- Kobieta

- kobiety w technologii

- Praca

- workflow

- przepływów pracy

- pracujący

- działa

- napisać

- pisać kod

- napisany

- jamla

- rok

- lat

- You

- Twój

- youtube

- zefirnet