Rozwój wyszukiwania kontekstowego i semantycznego sprawił, że wyszukiwanie produktów w handlu elektronicznym i handlu detalicznym jest dla konsumentów proste. Wyszukiwarki i systemy rekomendacji oparte na generatywnej sztucznej inteligencji mogą wykładniczo poprawić doświadczenie wyszukiwania produktów, rozumiejąc zapytania w języku naturalnym i dostarczając dokładniejsze wyniki. Poprawia to ogólne wrażenia użytkownika, pomagając klientom znaleźć dokładnie to, czego szukają.

Usługa Amazon OpenSearch teraz obsługuje podobieństwo cosinusowe metryka dla indeksów k-NN. Podobieństwo cosinusowe mierzy cosinus kąta między dwoma wektorami, gdzie mniejszy kąt cosinusowy oznacza większe podobieństwo między wektorami. Za pomocą podobieństwa cosinusoidalnego można zmierzyć orientację między dwoma wektorami, co sprawia, że jest to dobry wybór dla niektórych konkretnych aplikacji do wyszukiwania semantycznego.

W tym poście pokazujemy, jak zbudować kontekstową wyszukiwarkę tekstowo-graficzną rekomendacji produktów za pomocą Model osadzania multimodalnego Amazon Titan, dostępne w Amazońska skała macierzystaZ Amazon OpenSearch bez serwera.

Model osadzania multimodalnego ma na celu uczenie się wspólnych reprezentacji różnych modalności, takich jak tekst, obrazy i dźwięk. Trenując na dużych zbiorach danych zawierających obrazy i odpowiadające im podpisy, multimodalny model osadzania uczy się osadzać obrazy i teksty we wspólnej ukrytej przestrzeni. Poniżej znajduje się ogólny przegląd tego, jak to działa koncepcyjnie:

- Oddzielne enkodery – Te modele mają osobne kodery dla każdej modalności — koder tekstu dla tekstu (na przykład BERT lub RoBERTa), koder obrazu dla obrazów (na przykład CNN dla obrazów) i kodery audio dla dźwięku (na przykład modele takie jak Wav2Vec) . Każdy koder generuje osady przechwytujące cechy semantyczne odpowiednich modalności

- Fuzja modalności – Osadzania z koderów unimodalnych są łączone przy użyciu dodatkowych warstw sieci neuronowej. Celem jest poznanie interakcji i korelacji pomiędzy modalnościami. Typowe podejścia do fuzji obejmują łączenie, operacje na elementach, łączenie i mechanizmy uwagi.

- Wspólna przestrzeń reprezentacji – Warstwy fuzyjne pomagają rzutować poszczególne modalności na wspólną przestrzeń reprezentacji. Ucząc się na multimodalnych zbiorach danych, model uczy się wspólnej przestrzeni osadzania, w której osadzania z każdej modalności reprezentujące tę samą podstawową treść semantyczną są bliżej siebie.

- Zadania dolne – Wygenerowane wspólne osadzanie multimodalne można następnie wykorzystać do różnych dalszych zadań, takich jak wyszukiwanie multimodalne, klasyfikacja lub tłumaczenie. Model wykorzystuje korelacje między modalnościami, aby poprawić wydajność tych zadań w porównaniu z indywidualnym osadzeniem modalnym. Kluczową zaletą jest możliwość zrozumienia interakcji i semantyki między modalnościami, takimi jak tekst, obrazy i dźwięk, poprzez wspólne modelowanie.

Omówienie rozwiązania

Rozwiązanie zapewnia implementację umożliwiającą budowanie prototypu wyszukiwarki opartej na dużym modelu językowym (LLM) w celu wyszukiwania i rekomendowania produktów na podstawie zapytań tekstowych lub graficznych. Szczegółowo opisujemy kroki, aby użyć pliku Multimodalne osadzania Amazon Titan model do kodowania obrazów i tekstu do osadzania, pozyskiwania osadzania do indeksu usługi OpenSearch i wysyłania zapytań do indeksu za pomocą usługi OpenSearch Funkcjonalność k-najbliższych sąsiadów (k-NN)..

To rozwiązanie zawiera następujące elementy:

- Model osadzania multimodalnego Amazon Titan – Ten model podstawowy (FM) generuje osadzanie zdjęć produktów użytych w tym poście. Dzięki Amazon Titan Multimodal Embeddings możesz generować osadzania dla swoich treści i przechowywać je w wektorowej bazie danych. Gdy użytkownik końcowy przesyła jako zapytanie wyszukiwane dowolną kombinację tekstu i obrazu, model generuje osadzania dla wyszukiwanego hasła i dopasowuje je do przechowywanych osadowań, aby zapewnić użytkownikom końcowym odpowiednie wyniki wyszukiwania i rekomendacje. Możesz dodatkowo dostosować model, aby lepiej zrozumieć unikalną treść i zapewnić bardziej znaczące wyniki, korzystając z par obraz-tekst w celu doprecyzowania. Domyślnie model generuje wektory (osadzenia) o 1,024 wymiarach i jest dostępny za pośrednictwem Amazon Bedrock. Możesz także generować mniejsze wymiary, aby zoptymalizować szybkość i wydajność

- Amazon OpenSearch bez serwera – Jest to bezserwerowa konfiguracja usługi OpenSearch na żądanie. Używamy Amazon OpenSearch Serverless jako wektorowej bazy danych do przechowywania osadzań generowanych przez model Amazon Titan Multimodal Embeddings. Indeks utworzony w kolekcji Amazon OpenSearch Serverless służy jako magazyn wektorów dla naszego rozwiązania Retrieval Augmented Generation (RAG).

- Studio Amazon SageMaker – Jest to zintegrowane środowisko programistyczne (IDE) do uczenia maszynowego (ML). Praktycy ML mogą wykonywać wszystkie etapy rozwoju ML — od przygotowania danych po budowanie, szkolenie i wdrażanie modeli ML.

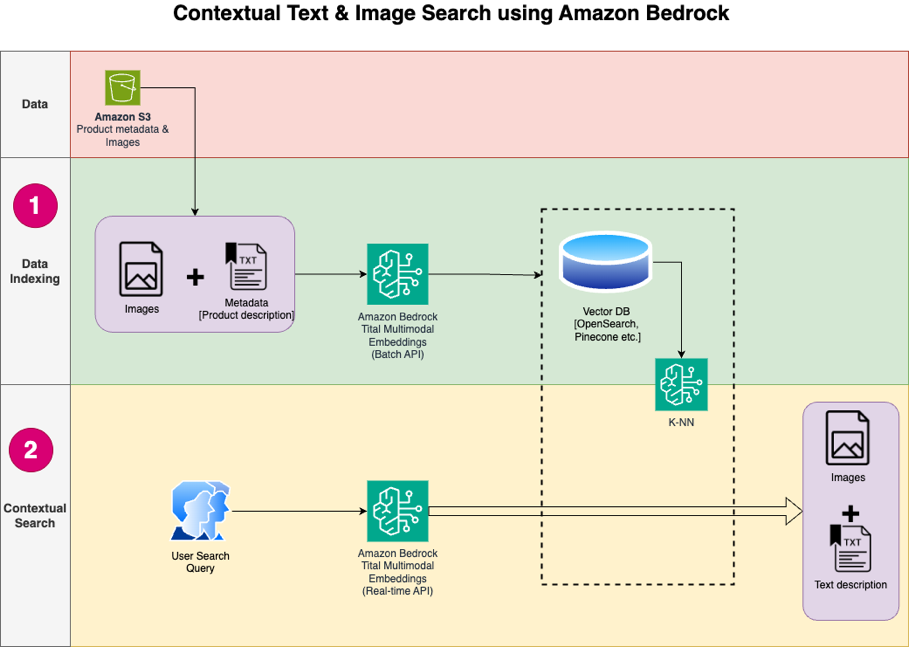

Projekt rozwiązania składa się z dwóch części: indeksowania danych i wyszukiwania kontekstowego. Podczas indeksowania danych przetwarzasz obrazy produktów w celu wygenerowania elementów osadzonych dla tych obrazów, a następnie zapełniasz magazyn danych wektorowych. Te kroki są wykonywane przed etapami interakcji z użytkownikiem.

W fazie wyszukiwania kontekstowego zapytanie użytkownika (tekst lub obraz) jest konwertowane na osadzanie, a w bazie danych wektorowych przeprowadzane jest wyszukiwanie podobieństw w celu znalezienia podobnych obrazów produktów w oparciu o wyszukiwanie podobieństwa. Następnie wyświetlasz najlepsze podobne wyniki. Cały kod tego wpisu jest dostępny w pliku GitHub repo.

Poniższy schemat ilustruje architekturę rozwiązania.

Poniżej przedstawiono kroki przepływu pracy rozwiązania:

- Pobierz tekst opisu produktu i zdjęcia z publicznych źródeł Usługa Amazon Simple Storage Łyżka (Amazon S3).

- Przejrzyj i przygotuj zbiór danych.

- Wygeneruj osadzanie obrazów produktów przy użyciu modelu Amazon Titan Multimodal Embeddings (amazon.titan-embed-image-v1). Jeżeli posiadasz dużą ilość zdjęć i opisów, możesz opcjonalnie skorzystać z opcji Wnioskowanie wsadowe dla Amazon Bedrock.

- Przechowuj elementy osadzone w formacie Amazon OpenSearch bez serwera jako wyszukiwarka.

- Na koniec pobierz zapytanie użytkownika w języku naturalnym, przekonwertuj je na osadzanie przy użyciu modelu Amazon Titan Multimodal Embeddings i wykonaj wyszukiwanie k-NN, aby uzyskać odpowiednie wyniki wyszukiwania.

Do opracowania rozwiązania używamy SageMaker Studio (niepokazanego na schemacie) jako IDE.

Kroki te omówiono szczegółowo w poniższych sekcjach. Dołączamy także zrzuty ekranu i szczegóły wyników.

Wymagania wstępne

Aby wdrożyć rozwiązanie przedstawione w tym poście, powinieneś mieć:

- An Konto AWS i znajomość FM, Amazon Bedrock, Amazon Sage Makeri usługę OpenSearch.

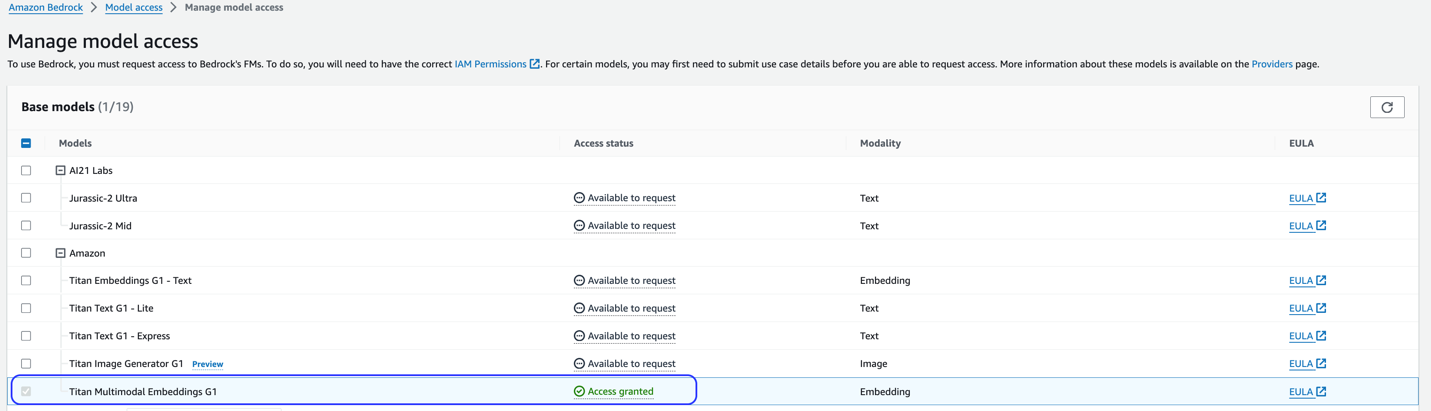

- Model osadzania multimodalnego Amazon Titan włączony w Amazon Bedrock. Możesz potwierdzić, że jest ona włączona na stronie Dostęp do modelu strona konsoli Amazon Bedrock. Jeśli włączone jest osadzanie multimodalne Amazon Titan, status dostępu będzie wyświetlany jako Dostęp przyznany, jak pokazano na poniższym zrzucie ekranu.

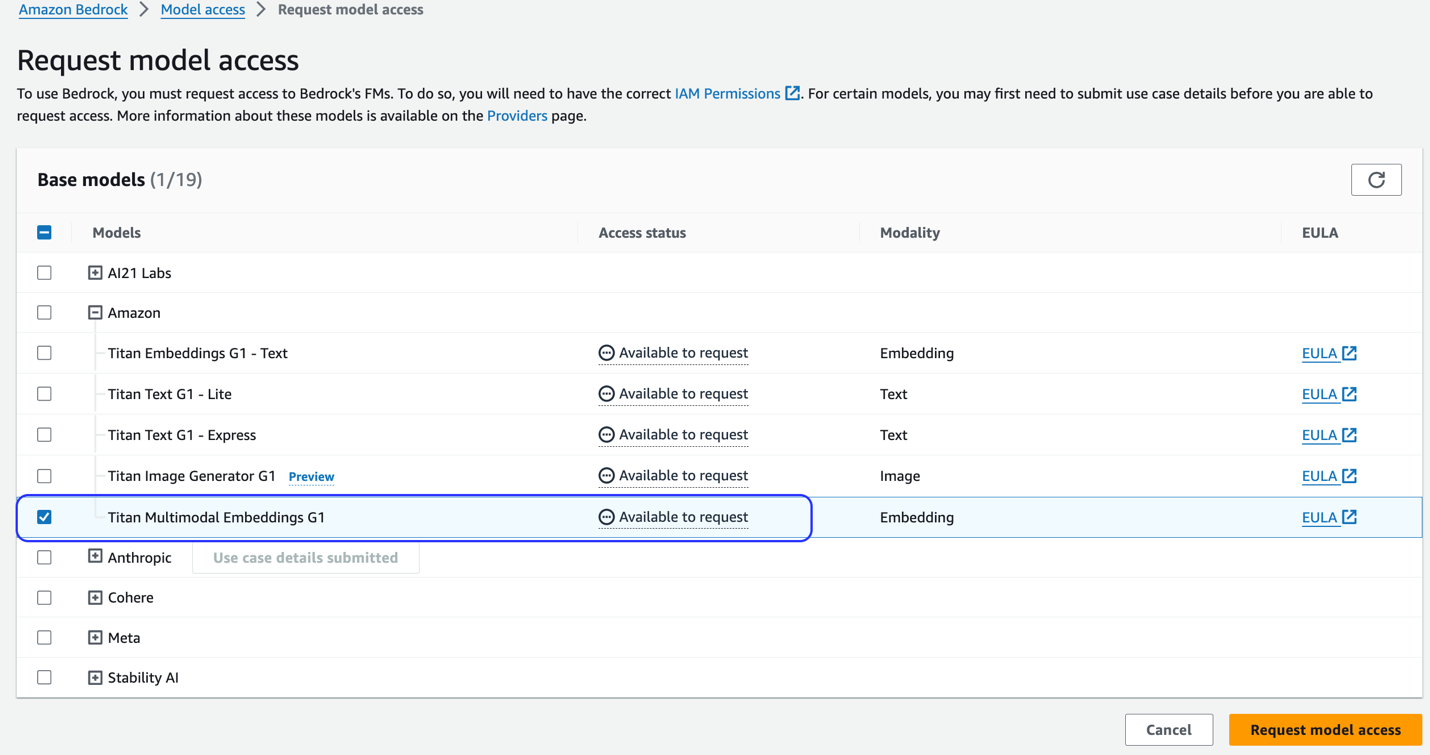

Jeśli model nie jest dostępny, włącz dostęp do modelu, wybierając Zarządzaj dostępem do modelu, wybierając Multimodalne osadzanie Amazon Titan G1i wybór Poproś o dostęp do modelu. Model jest natychmiast udostępniany do użytku.

Skonfiguruj rozwiązanie

Po wykonaniu wymaganych kroków można przystąpić do konfigurowania rozwiązania:

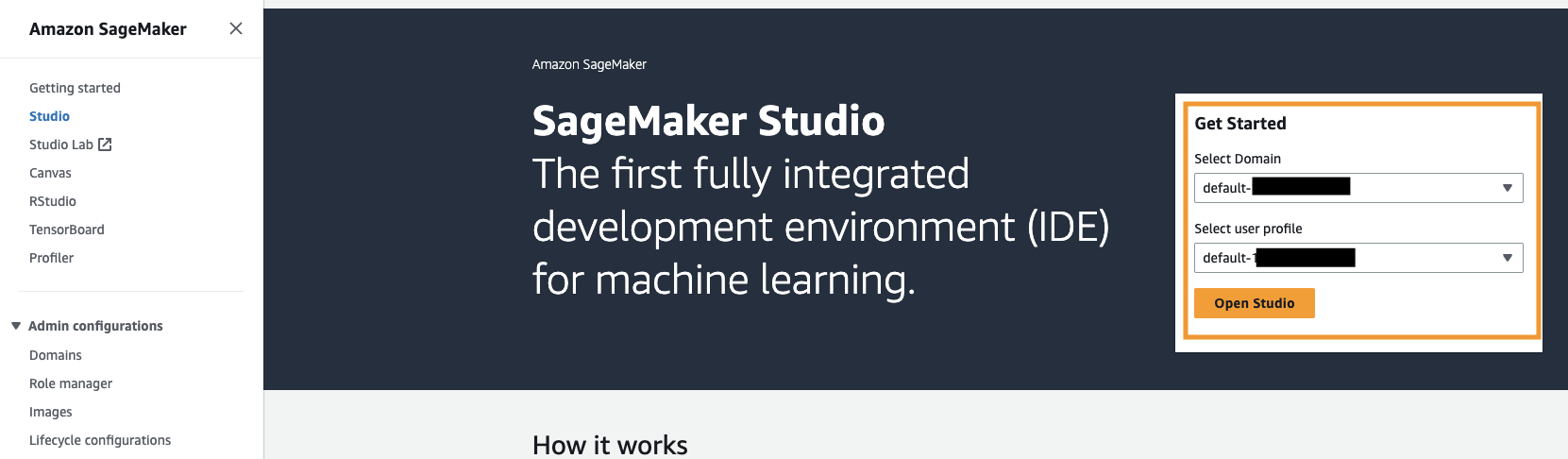

- Na swoim koncie AWS otwórz konsolę SageMaker i wybierz Studio w okienku nawigacji.

- Wybierz swoją domenę i profil użytkownika, a następnie wybierz Otwórz studio.

Twoja domena i nazwa profilu użytkownika mogą się różnić.

- Dodaj Terminal systemowy dla Narzędzia i pliki.

- Uruchom następujące polecenie, aby sklonować plik GitHub repo do instancji SageMaker Studio:

- Nawiguj do

multimodal/Titan/titan-multimodal-embeddings/amazon-bedrock-multimodal-oss-searchengine-e2eteczka. - Otwórz

titan_mm_embed_search_blog.ipynbnotatnik.

Uruchom rozwiązanie

Otwórz plik titan_mm_embed_search_blog.ipynb i użyj jądra Data Science Python 3. Na run menu, wybierz Uruchom wszystkie komórki aby uruchomić kod w tym notatniku.

Ten notatnik wykonuje następujące kroki:

- Zainstaluj pakiety i biblioteki wymagane dla tego rozwiązania.

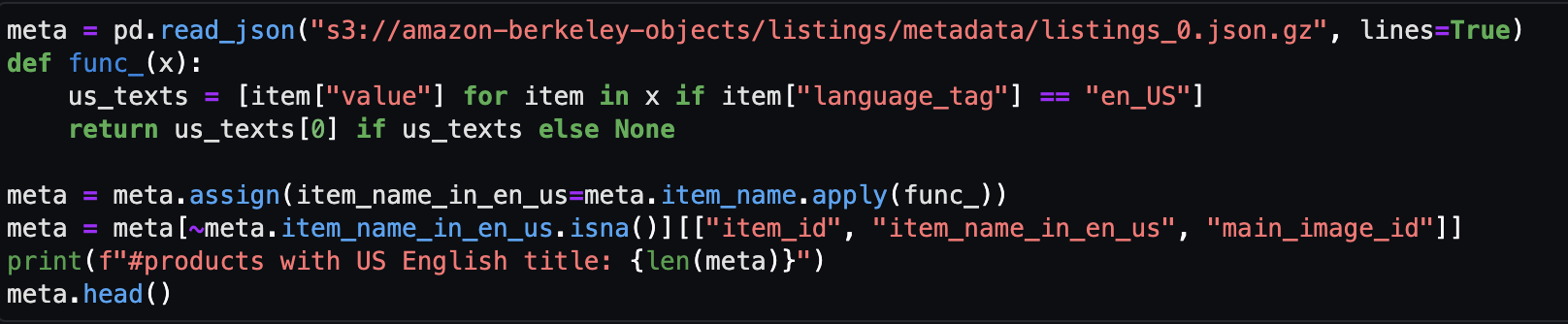

- Załaduj publicznie dostępne Zbiór danych obiektów Amazon Berkeley i metadane w ramce danych pand.

Zbiór danych to zbiór 147,702 398,212 list produktów z wielojęzycznymi metadanymi i 1,600 XNUMX unikalnych zdjęć katalogowych. W tym poście używasz wyłącznie obrazów i nazw przedmiotów w języku angielskim (USA). Używasz około XNUMX produktów.

- Wygeneruj osadzanie dla obrazów przedmiotów, korzystając z modelu Amazon Titan Multimodal Embeddings, korzystając z

get_titan_multomodal_embedding()funkcjonować. Dla abstrakcji wszystkie ważne funkcje używane w tym notatniku zdefiniowaliśmy w plikuutils.pyplik.

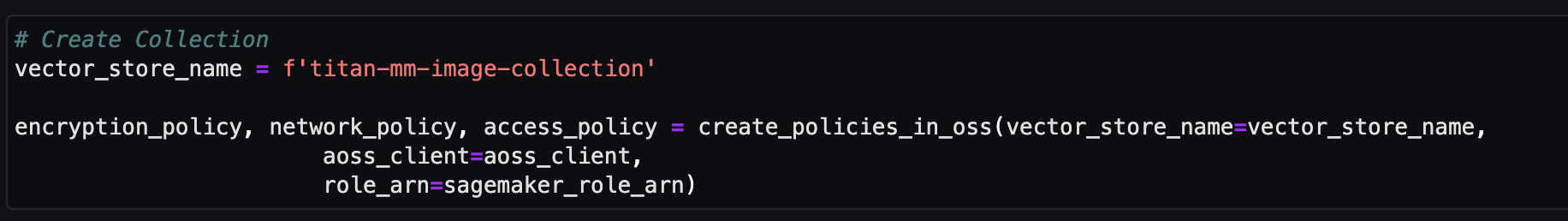

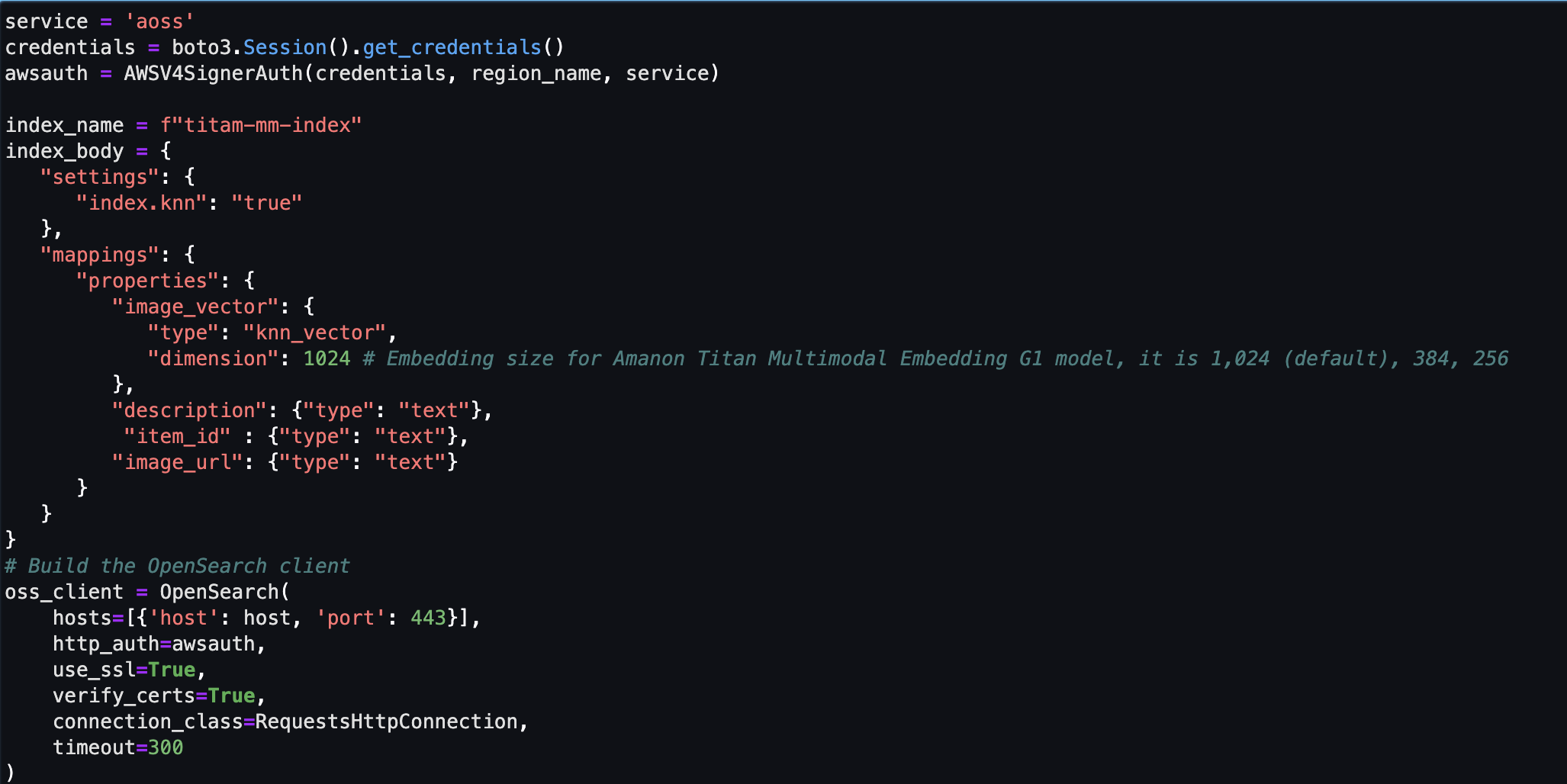

Następnie utwórz i skonfiguruj magazyn wektorowy Amazon OpenSearch Serverless (kolekcja i indeks).

- Przed utworzeniem nowej kolekcji i indeksu wyszukiwania wektorowego należy najpierw utworzyć trzy powiązane zasady usługi OpenSearch: zasady bezpieczeństwa szyfrowania, zasady bezpieczeństwa sieci i zasady dostępu do danych.

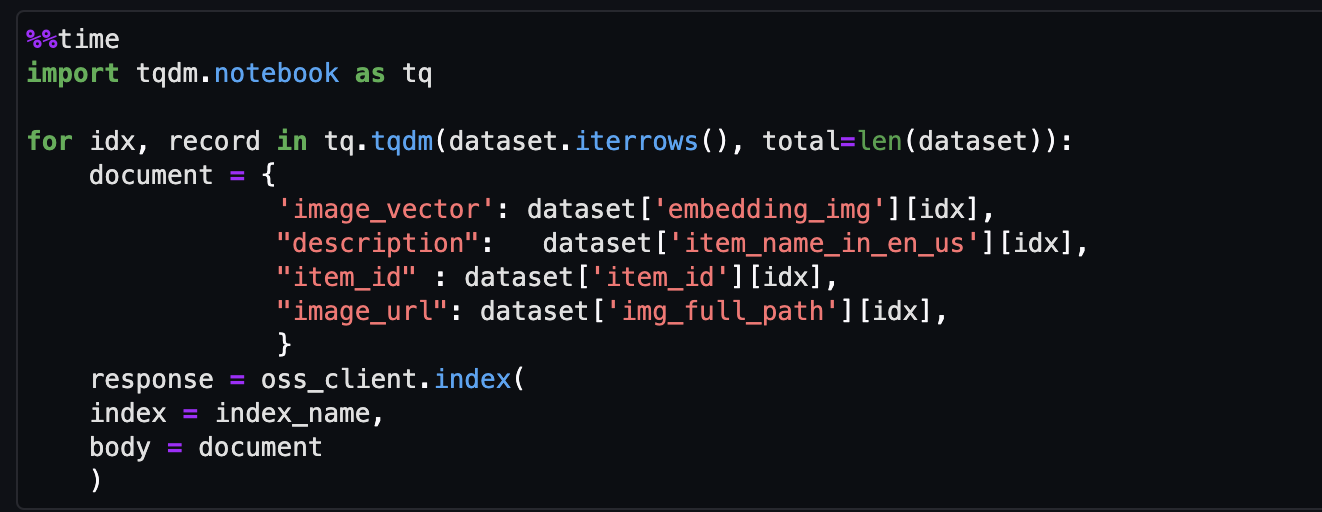

- Na koniec pozyskuj osadzanie obrazu w indeksie wektorowym.

Teraz możesz przeprowadzić wyszukiwanie multimodalne w czasie rzeczywistym.

Uruchom wyszukiwanie kontekstowe

W tej sekcji przedstawiamy wyniki wyszukiwania kontekstowego na podstawie zapytania tekstowego lub graficznego.

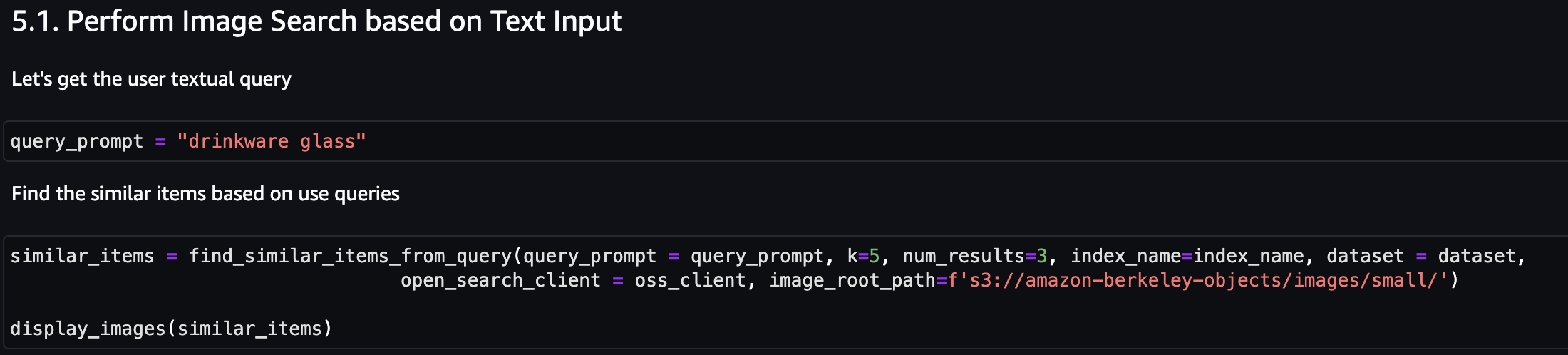

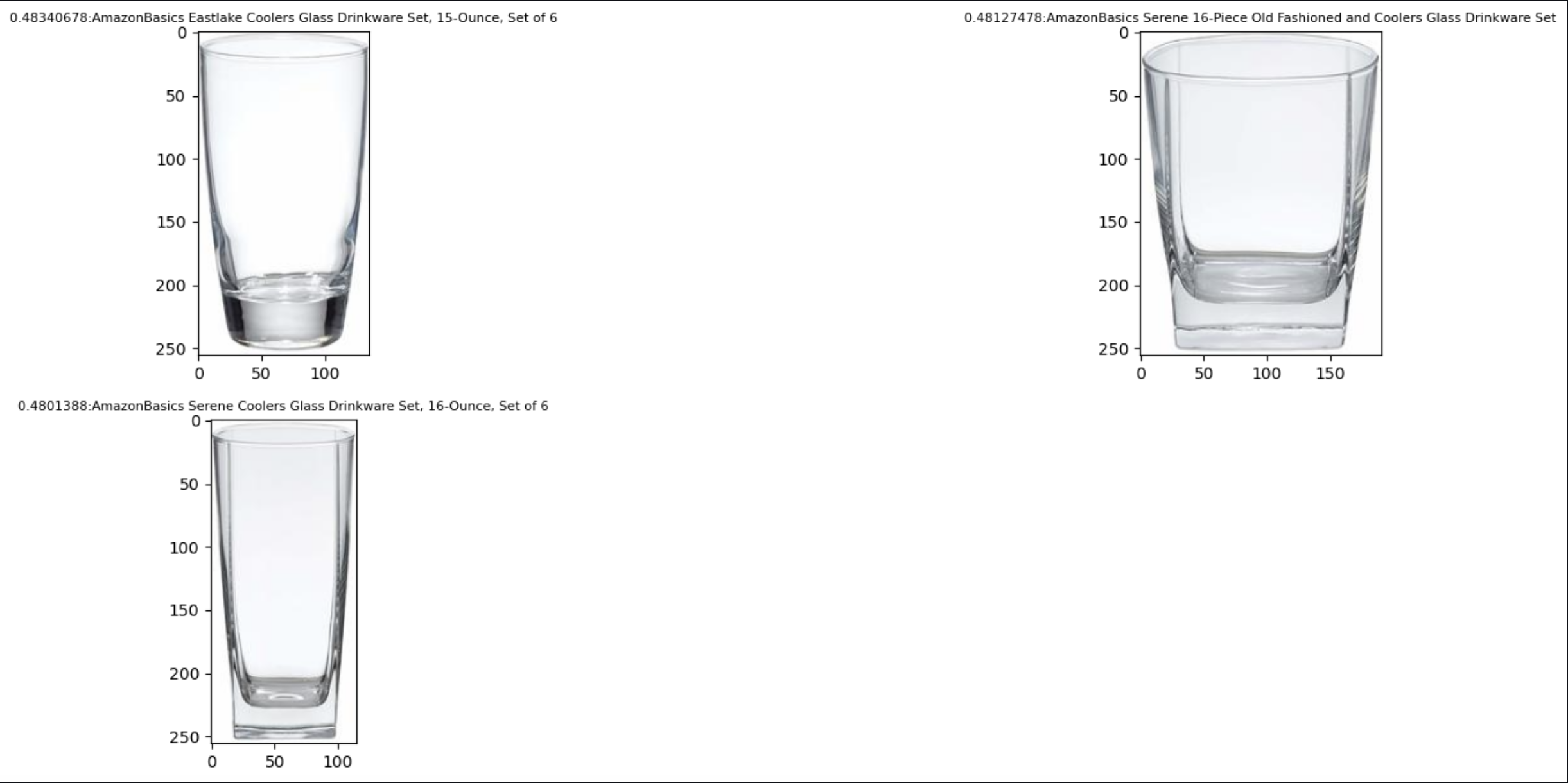

Najpierw przeprowadźmy wyszukiwanie obrazów na podstawie wprowadzonego tekstu. W poniższym przykładzie używamy wpisu „szklanka do napojów” i wysyłamy go do wyszukiwarki, aby znaleźć podobne przedmioty.

Poniższy zrzut ekranu przedstawia wyniki.

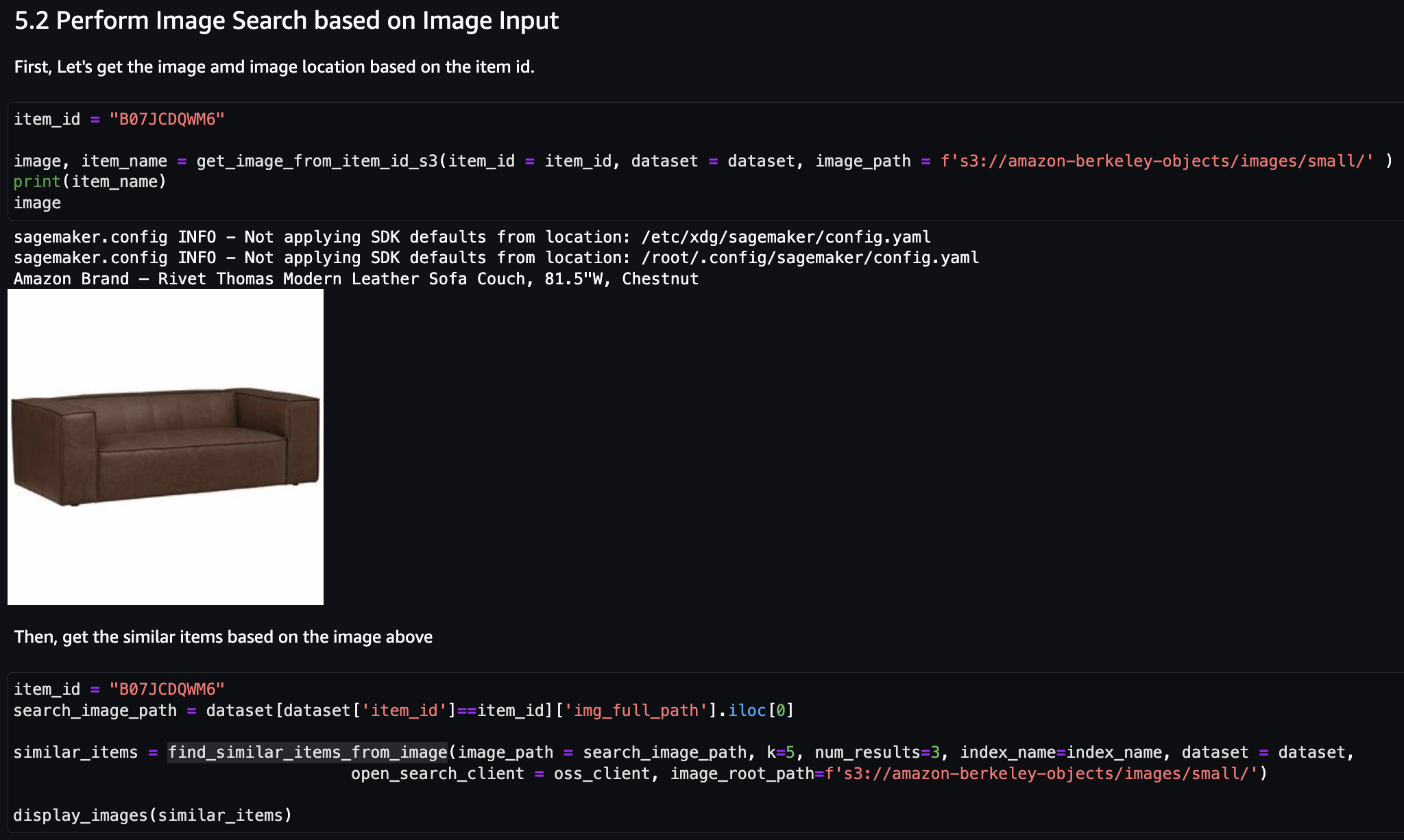

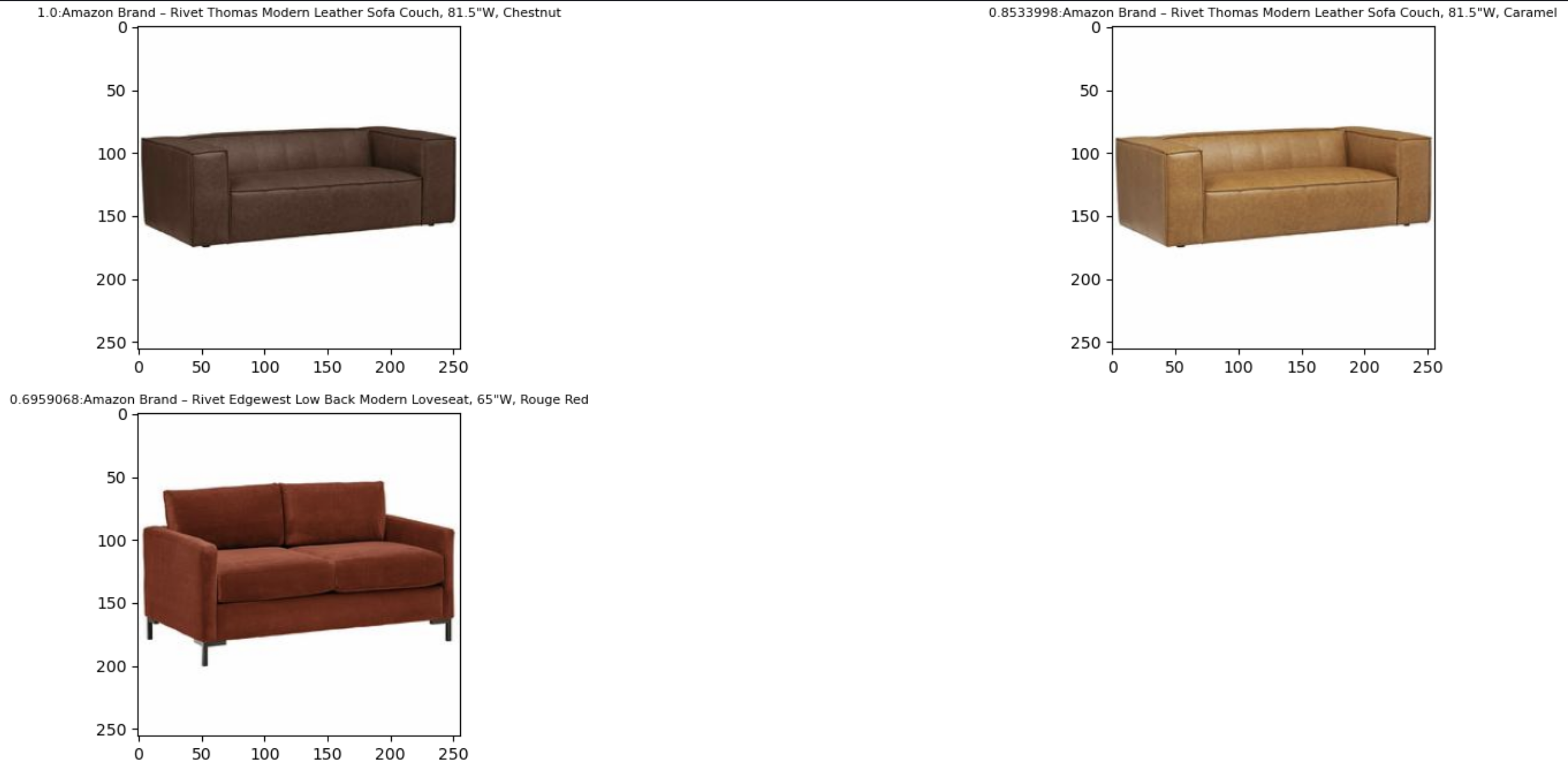

Przyjrzyjmy się teraz wynikom na podstawie prostego obrazu. Obraz wejściowy jest konwertowany na osadzanie wektorów i na podstawie wyszukiwania podobieństwa model zwraca wynik.

Możesz użyć dowolnego obrazu, ale w poniższym przykładzie użyjemy losowego obrazu ze zbioru danych na podstawie identyfikatora elementu (na przykład item_id = „B07JCDQWM6”), a następnie wyślij ten obraz do wyszukiwarki, aby znaleźć podobne przedmioty.

Poniższy zrzut ekranu przedstawia wyniki.

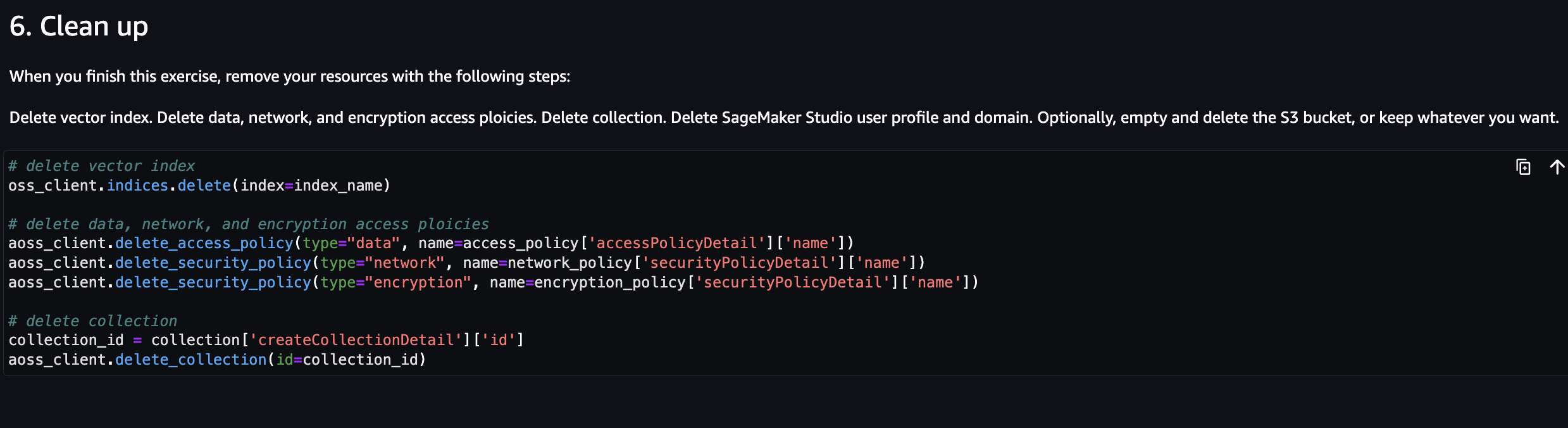

Sprzątać

Aby uniknąć przyszłych opłat, usuń zasoby używane w tym rozwiązaniu. Możesz to zrobić, uruchamiając sekcję czyszczenia notatnika.

Wnioski

W tym poście przedstawiono instruktaż wykorzystania modelu Amazon Titan Multimodal Embeddings w Amazon Bedrock do tworzenia potężnych aplikacji do wyszukiwania kontekstowego. W szczególności zademonstrowaliśmy przykładową aplikację do wyszukiwania list produktów. Widzieliśmy, jak model osadzania umożliwia wydajne i dokładne wyszukiwanie informacji z obrazów i danych tekstowych, poprawiając w ten sposób wygodę użytkownika podczas wyszukiwania odpowiednich elementów.

Usługa Amazon Titan Multimodal Embeddings pomaga zapewnić użytkownikom końcowym dokładniejsze i kontekstowo odpowiednie wyszukiwanie multimodalne, rekomendacje i personalizację. Na przykład firma zajmująca się fotografią stockową posiadająca setki milionów obrazów może wykorzystać ten model do wzmocnienia swojej funkcji wyszukiwania, dzięki czemu użytkownicy mogą wyszukiwać obrazy za pomocą frazy, obrazu lub kombinacji obrazu i tekstu.

Model Amazon Titan Multimodal Embeddings w Amazon Bedrock jest teraz dostępny we wschodnich stanach USA (N. Wirginia) i zachodnich stanach USA (Oregon) w regionach AWS. Aby dowiedzieć się więcej, zob Generator obrazów Amazon Titan, osadzania multimodalne i modele tekstowe są teraz dostępne w Amazon BedrockThe Strona produktu Amazon Titani Podręcznik użytkownika Amazon Bedrock. Aby rozpocząć korzystanie z multimodalnych osadzań Amazon Titan w Amazon Bedrock, odwiedź stronę Konsola Amazon Bedrock.

Rozpocznij budowanie z modelem Amazon Titan Multimodal Embeddings w Amazońska skała macierzysta dzisiaj.

O autorach

Sandeep Singh jest starszym analitykiem danych zajmującym się generatywną sztuczną inteligencją w Amazon Web Services, pomagając firmom wprowadzać innowacje dzięki generatywnej sztucznej inteligencji. Specjalizuje się w generatywnej sztucznej inteligencji, sztucznej inteligencji, uczeniu maszynowym i projektowaniu systemów. Pasjonuje się opracowywaniem najnowocześniejszych rozwiązań opartych na AI/ML w celu rozwiązywania złożonych problemów biznesowych dla różnych branż, optymalizując wydajność i skalowalność.

Sandeep Singh jest starszym analitykiem danych zajmującym się generatywną sztuczną inteligencją w Amazon Web Services, pomagając firmom wprowadzać innowacje dzięki generatywnej sztucznej inteligencji. Specjalizuje się w generatywnej sztucznej inteligencji, sztucznej inteligencji, uczeniu maszynowym i projektowaniu systemów. Pasjonuje się opracowywaniem najnowocześniejszych rozwiązań opartych na AI/ML w celu rozwiązywania złożonych problemów biznesowych dla różnych branż, optymalizując wydajność i skalowalność.

Mani Chanuja jest Tech Lead – Generatative AI Specialists, autorką książki Applied Machine Learning and High Performance Computing on AWS oraz członkinią Rady Dyrektorów Fundacji ds. Kobiet w Edukacji Produkcyjnej. Prowadzi projekty uczenia maszynowego w różnych dziedzinach, takich jak widzenie komputerowe, przetwarzanie języka naturalnego i generatywna sztuczna inteligencja. Występuje na konferencjach wewnętrznych i zewnętrznych, takich jak AWS re:Invent, Women in Manufacturing West, webinary na YouTube i GHC 23. W wolnym czasie lubi długie biegi po plaży.

Mani Chanuja jest Tech Lead – Generatative AI Specialists, autorką książki Applied Machine Learning and High Performance Computing on AWS oraz członkinią Rady Dyrektorów Fundacji ds. Kobiet w Edukacji Produkcyjnej. Prowadzi projekty uczenia maszynowego w różnych dziedzinach, takich jak widzenie komputerowe, przetwarzanie języka naturalnego i generatywna sztuczna inteligencja. Występuje na konferencjach wewnętrznych i zewnętrznych, takich jak AWS re:Invent, Women in Manufacturing West, webinary na YouTube i GHC 23. W wolnym czasie lubi długie biegi po plaży.

Rozbijacz Grewal jest starszym specjalistą ds. rozwiązań AI/ML w AWS. Obecnie koncentruje się na obsłudze modeli i MLOps na Amazon SageMaker. Przed objęciem tej roli pracował jako inżynier uczenia maszynowego, budując i hostując modele. Poza pracą lubi grać w tenisa i jeździć na rowerze po górskich szlakach.

Rozbijacz Grewal jest starszym specjalistą ds. rozwiązań AI/ML w AWS. Obecnie koncentruje się na obsłudze modeli i MLOps na Amazon SageMaker. Przed objęciem tej roli pracował jako inżynier uczenia maszynowego, budując i hostując modele. Poza pracą lubi grać w tenisa i jeździć na rowerze po górskich szlakach.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-text-and-image-search-engine-for-product-recommendations-using-amazon-bedrock-and-amazon-opensearch-serverless/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 125

- 212

- 23

- 258

- 411

- 600

- 7

- 89

- a

- zdolność

- O nas

- abstrakcja

- dostęp

- dostęp

- Konto

- dokładny

- w poprzek

- Dodatkowy

- Korzyść

- AI

- Dane SI

- AI / ML

- Wszystkie kategorie

- wzdłuż

- również

- Amazonka

- Amazon Sage Maker

- Amazon Web Services

- an

- i

- kąt

- każdy

- Zastosowanie

- aplikacje

- stosowany

- awanse

- w przybliżeniu

- architektura

- SĄ

- sztuczny

- sztuczna inteligencja

- AS

- powiązany

- At

- Uwaga

- audio

- zwiększona

- autor

- dostępny

- uniknąć

- AWS

- AWS re: Invent

- na podstawie

- BE

- Plaża

- Berkeley

- pomiędzy

- deska

- Rada dyrektorów

- książka

- budować

- Budowanie

- biznes

- biznes

- ale

- by

- CAN

- podpisy

- Przechwytywanie

- Opłaty

- wybór

- Dodaj

- Wybierając

- klasyfikacja

- bliższy

- CNN

- kod

- kolekcja

- połączenie

- połączony

- wspólny

- sukcesy firma

- w porównaniu

- kompletny

- Zakończony

- kompleks

- składniki

- komputer

- Wizja komputerowa

- computing

- Koncepcyjnie

- konferencje

- systemu

- Potwierdzać

- składa się

- Konsola

- Konsumenci

- zawartość

- kontekstowy

- konwertować

- przeliczone

- korelacje

- Odpowiedni

- Stwórz

- stworzony

- Obecnie

- Klientów

- dostosować

- dane

- dostęp do danych

- nauka danych

- naukowiec danych

- Baza danych

- zbiory danych

- Domyślnie

- zdefiniowane

- wykazać

- oznacza

- wdrażanie

- opis

- Wnętrze

- zaprojektowany

- detal

- detale

- rozwijać

- rozwijanie

- oprogramowania

- schemat

- różne

- Wymiary

- Dyrektorzy

- odkrycie

- omówione

- Wyświetlacz

- inny

- do

- domena

- domeny

- podczas

- każdy

- Wschód

- ecommerce

- Edukacja

- efektywność

- wydajny

- osadzać

- osadzanie

- umożliwiać

- włączony

- Umożliwia

- szyfrowanie

- silnik

- inżynier

- silniki

- Angielski

- wzmacniać

- Poprawia

- wzmocnienie

- Środowisko

- dokładnie

- przykład

- doświadczenie

- Doświadczenia

- wykładniczo

- zewnętrzny

- Znajomość

- Korzyści

- filet

- Znajdź

- i terminów, a

- koncentruje

- następujący

- W razie zamówieenia projektu

- Fundacja

- FRAME

- Darmowy

- od

- funkcjonować

- Funkcjonalność

- Funkcje

- dalej

- fuzja

- przyszłość

- Generować

- wygenerowane

- generuje

- generacja

- generatywny

- generatywna sztuczna inteligencja

- generator

- otrzymać

- dostaje

- Go

- cel

- dobry

- Have

- he

- pomoc

- pomoc

- pomaga

- jej

- Wysoki

- na wysokim szczeblu

- wyższy

- Hosting

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- olbrzymi

- Setki

- setki milionów

- ID

- if

- ilustruje

- obraz

- Wyszukiwanie obrazka

- zdjęcia

- natychmiast

- wdrożenia

- realizacja

- ważny

- podnieść

- in

- zawierać

- obejmuje

- wskaźnik

- indeksy

- indywidualny

- przemysłowa

- Informacja

- wprowadzać innowacje

- wkład

- przykład

- zintegrowany

- Inteligencja

- wzajemne oddziaływanie

- Interakcje

- wewnętrzny

- najnowszych

- IT

- szt

- JEGO

- połączenie

- jpeg

- Klawisz

- język

- duży

- na dużą skalę

- nioski

- prowadzić

- Wyprowadzenia

- UCZYĆ SIĘ

- nauka

- uczy się

- biblioteki

- lubić

- lubi

- wymienianie kolejno

- ofert

- LLM

- długo

- Popatrz

- poszukuje

- maszyna

- uczenie maszynowe

- zrobiony

- WYKONUJE

- produkcja

- zapałki

- Może..

- wymowny

- zmierzyć

- środków

- Mechanizmy

- członek

- Menu

- Metadane

- metryczny

- miliony

- ML

- MLOps

- model

- modelowanie

- modele

- jeszcze

- Góra

- musi

- Nazwa

- Nazwy

- Naturalny

- Przetwarzanie języka naturalnego

- Nawigacja

- sąsiedzi

- sieć

- Bezpieczeństwo sieci

- nerwowy

- sieci neuronowe

- Nowości

- notatnik

- już dziś

- numer

- obiekty

- of

- on

- Na żądanie

- tylko

- koncepcja

- operacje

- Optymalizacja

- optymalizacji

- or

- Oregon

- ludzkiej,

- wydajność

- zewnętrzne

- ogólny

- przegląd

- Pakiety

- par

- pandy

- chleb

- szczególny

- strony

- namiętny

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonuje

- personalizacja

- faza

- fotografia

- plato

- Analiza danych Platona

- PlatoDane

- gra

- polityka

- polityka

- łączenie

- Post

- power

- powered

- mocny

- Przygotować

- przygotowanie

- przesłanka

- przedstawione

- Wcześniejszy

- problemy

- wygląda tak

- przetwarzanie

- Produkt

- Produkty

- Profil

- projekt

- projektowanie

- prototyp

- zapewniać

- pod warunkiem,

- zapewnia

- publiczny

- publicznie

- Python

- zapytania

- pytanie

- szmata

- przypadkowy

- RE

- gotowy

- w czasie rzeczywistym

- polecić

- Rekomendacja

- zalecenia

- odnosić się

- regiony

- reprezentować

- reprezentacja

- wymagany

- Zasoby

- osób

- dalsze

- Efekt

- detaliczny

- wyszukiwanie

- powrót

- powraca

- Rosnąć

- Rola

- run

- bieganie

- działa

- sagemaker

- wzgląd

- taki sam

- zobaczył

- Skalowalność

- nauka

- Naukowiec

- screeny

- Szukaj

- Wyszukiwarka

- Wyszukiwarki

- poszukiwania

- Sekcja

- działy

- bezpieczeństwo

- wybierając

- semantyczny

- semantyka

- wysłać

- senior

- oddzielny

- Bezserwerowe

- służy

- usługa

- Usługi

- służąc

- zestaw

- shared

- ona

- powinien

- pokazać

- pokazane

- Targi

- podobny

- Prosty

- mniejszy

- So

- rozwiązanie

- Rozwiązania

- ROZWIĄZANIA

- kilka

- Typ przestrzeni

- Mówi

- specjalista

- Specjaliści

- specjalizuje się

- specyficzny

- prędkość

- rozpoczęty

- state-of-the-art

- Rynek

- Cel

- stany magazynowe

- przechowywanie

- sklep

- przechowywany

- przechowywania

- bezpośredni

- studio

- taki

- podpory

- system

- systemy

- zadania

- tech

- tenis

- XNUMX

- tekstowy

- że

- Połączenia

- staw

- ich

- Im

- następnie

- a tym samym

- Te

- to

- trzy

- Przez

- czas

- tytan

- do

- już dziś

- razem

- Top

- Trening

- Tłumaczenie

- drugiej

- dla

- zasadniczy

- zrozumieć

- zrozumienie

- wyjątkowy

- us

- posługiwać się

- używany

- Użytkownik

- Doświadczenie użytkownika

- Użytkownicy

- zastosowania

- za pomocą

- różnorodny

- przez

- virginia

- wizja

- Odwiedzić

- solucja

- we

- sieć

- usługi internetowe

- Seminaria

- Zachód

- Co

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- Wikipedia

- będzie

- w

- Kobieta

- Praca

- pracował

- workflow

- działa

- You

- Twój

- youtube

- zefirnet