W tym poście pokazujemy, jak skonfigurować nową funkcję uwierzytelniania opartą na OAuth do użycia Snowflake in Pogromca danych Amazon SageMaker. Snowflake to platforma danych w chmurze, która zapewnia rozwiązania do przechowywania danych dla analityki danych. Płatek śniegu jest Partner AWS z wieloma akredytacjami AWS, w tym kompetencjami AWS w zakresie uczenia maszynowego (ML), handlu detalicznego oraz danych i analiz.

Data Wrangler upraszcza proces przygotowania danych i inżynierii funkcji, skracając czas potrzebny z tygodni do minut, udostępniając pojedynczy interfejs wizualny dla analityków danych, który umożliwia wybieranie i czyszczenie danych, tworzenie funkcji i automatyzację przygotowywania danych w przepływach pracy ML bez pisania kodu. Możesz importować dane z wielu źródeł danych, takich jak Usługa Amazon Simple Storage (Amazonka S3), Amazonka Atena, Amazonka Przesunięcie ku czerwieni, Amazon EMRi Płatek śniegu. Dzięki tej nowej funkcji możesz korzystać z własnego dostawcy tożsamości (IdP), takiego jak Octa, Azure ADlub Federacja Pingów aby połączyć się z Snowflake przez Data Wrangler.

Omówienie rozwiązania

W poniższych sekcjach przedstawiamy czynności, które administrator musi wykonać, aby skonfigurować dostawcę tożsamości, płatek śniegu i Studio. Szczegółowo opisujemy również kroki, które analitycy danych mogą podjąć, aby skonfigurować przepływ danych, przeanalizować jakość danych i dodać przekształcenia danych. Na koniec pokazujemy, jak wyeksportować przepływ danych i wyszkolić model przy użyciu Autopilot SageMaker.

Wymagania wstępne

W tej instrukcji należy spełnić następujące wymagania wstępne:

- Dla administratora:

- Użytkownik Snowflake z uprawnieniami do tworzenia integracji pamięci masowej i integracji zabezpieczeń w Snowflake.

- Konto AWS z uprawnieniami do tworzenia AWS Zarządzanie tożsamością i dostępem (IAM) zasady i role.

- Dostęp i uprawnienia do konfiguracji IDP do rejestracji aplikacji Data Wrangler i konfiguracji serwera autoryzacji lub API.

- Dla analityka danych:

Konfiguracja administratora

Zamiast wymagać od użytkowników bezpośredniego wprowadzania danych uwierzytelniających Snowflake w Data Wrangler, możesz zlecić im korzystanie z dostawcy tożsamości w celu uzyskania dostępu do Snowflake.

Aby włączyć dostęp Data Wrangler OAuth do Snowflake, należy wykonać następujące kroki:

- Skonfiguruj dostawcę tożsamości.

- Skonfiguruj płatek śniegu.

- Skonfiguruj SageMaker Studio.

Skonfiguruj dostawcę tożsamości

Aby skonfigurować dostawcę tożsamości, musisz zarejestrować aplikację Data Wrangler i skonfigurować serwer autoryzacji lub interfejs API.

Zarejestruj aplikację Data Wrangler w ramach dostawcy tożsamości

Zapoznaj się z poniższą dokumentacją dotyczącą dostawców tożsamości obsługiwanych przez Data Wrangler:

Skorzystaj z dokumentacji dostarczonej przez dostawcę tożsamości, aby zarejestrować aplikację Data Wrangler. Informacje i procedury zawarte w tej sekcji pomagają zrozumieć, jak prawidłowo korzystać z dokumentacji dostarczonej przez dostawcę tożsamości.

Konkretne dostosowania oprócz kroków w odpowiednich przewodnikach są wymienione w podsekcjach.

- Wybierz konfigurację, która rozpoczyna proces rejestracji Data Wranglera jako aplikacji.

- Zapewnij użytkownikom w ramach IdP dostęp do Data Wrangler.

- Włącz uwierzytelnianie klienta OAuth, przechowując poświadczenia klienta jako klucz tajny programu Secrets Manager.

- Określ adres URL przekierowania, używając następującego formatu:

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Określasz identyfikator domeny SageMaker i region AWS, których używasz do uruchamiania Data Wranglera. Musisz zarejestrować adres URL dla każdej domeny i regionu, w którym działa Data Wrangler. Użytkownicy z domeny i regionu, dla których nie skonfigurowano adresów URL przekierowania, nie będą mogli uwierzytelnić się u dostawcy tożsamości w celu uzyskania dostępu do połączenia Snowflake.

- Upewnij się, że typy przyznawania kodu autoryzacyjnego i tokena odświeżania są dozwolone dla Twojej aplikacji Data Wrangler.

Skonfiguruj serwer autoryzacji lub interfejs API w ramach dostawcy tożsamości

W ramach dostawcy tożsamości musisz skonfigurować serwer autoryzacji lub interfejs programowania aplikacji (API). Dla każdego użytkownika serwer autoryzacyjny lub API wysyła tokeny do Data Wranglera ze Snowflake jako publicznością.

Płatek śniegu wykorzystuje koncepcję role które różnią się od ról IAM używanych w AWS. Musisz skonfigurować dostawcę tożsamości, aby używał DOWOLNEJ roli, aby używać domyślnej roli powiązanej z kontem Snowflake. Na przykład, jeśli użytkownik ma systems administrator jako domyślną rolę w ich profilu Snowflake wykorzystuje połączenie z Data Wrangler do Snowflake systems administrator jako rola.

Skorzystaj z poniższej procedury, aby skonfigurować serwer autoryzacji lub interfejs API w ramach dostawcy tożsamości:

- Od dostawcy tożsamości rozpocznij proces konfigurowania serwera lub interfejsu API.

- Skonfiguruj serwer autoryzacji tak, aby korzystał z kodu autoryzacji i typów nadania tokenu odświeżania.

- Określ okres istnienia tokenu dostępu.

- Ustaw limit czasu bezczynności tokena odświeżania.

Limit czasu bezczynności to czas wygaśnięcia tokenu odświeżania, jeśli nie jest używany. Jeśli planujesz zadania w Data Wrangler, zalecamy, aby limit czasu bezczynności był większy niż częstotliwość zadania przetwarzania. W przeciwnym razie niektóre zadania przetwarzania mogą zakończyć się niepowodzeniem, ponieważ token odświeżania wygasł, zanim mogły zostać uruchomione. Gdy token odświeżania wygaśnie, użytkownik musi ponownie uwierzytelnić się, uzyskując dostęp do połączenia nawiązanego z Snowflake za pośrednictwem Data Wrangler.

Pamiętaj, że Data Wrangler nie obsługuje rotacyjnych tokenów odświeżania. Używanie rotacyjnych tokenów odświeżania może spowodować awarie dostępu lub konieczność częstego logowania się użytkowników.

Jeśli token odświeżania wygaśnie, Twoi użytkownicy muszą ponownie uwierzytelnić się, uzyskując dostęp do połączenia nawiązanego z Snowflake za pośrednictwem Data Wrangler.

- Sprecyzować

session:role-anyjako nowy zakres.

W przypadku usługi Azure AD należy również określić unikatowy identyfikator zakresu.

Po skonfigurowaniu dostawcy OAuth podajesz Data Wrangler informacje potrzebne do nawiązania połączenia z dostawcą. Możesz skorzystać z dokumentacji dostawcy tożsamości, aby uzyskać wartości w następujących polach:

- Adres URL tokena – Adres URL tokena wysyłanego przez dostawcę tożsamości do Data Wrangler

- Adres URL autoryzacji – Adres URL serwera autoryzacji dostawcy tożsamości

- identyfikator klienta – Identyfikator dostawcy tożsamości

- Sekret klienta – Sekret, który rozpoznaje tylko serwer autoryzacji lub API

- Zakres OAuth — Dotyczy to tylko usługi Azure AD

Skonfiguruj płatek śniegu

Aby skonfigurować Snowflake, wykonaj instrukcje w Importuj dane ze Snowflake.

Użyj dokumentacji Snowflake dla swojego dostawcy tożsamości, aby skonfigurować zewnętrzną integrację OAuth w Snowflake. Zobacz poprzednią sekcję Zarejestruj aplikację Data Wrangler w ramach dostawcy tożsamości aby uzyskać więcej informacji na temat konfigurowania zewnętrznej integracji OAuth.

Podczas konfigurowania integracji zabezpieczeń w Snowflake upewnij się, że została aktywowana external_oauth_any_role_mode.

Skonfiguruj SageMaker Studio

Przechowujesz pola i wartości w tajnym kluczu Secrets Manager i dodajesz go do konfiguracji cyklu życia Studio, której używasz dla Data Wrangler. Konfiguracja cyklu życia to skrypt powłoki, który automatycznie ładuje poświadczenia przechowywane w kluczu tajnym, gdy użytkownik loguje się do Studio. Aby uzyskać informacje na temat tworzenia wpisów tajnych, zobacz Przenieś zakodowane na stałe sekrety do AWS Secrets Manager. Aby uzyskać informacje na temat korzystania z konfiguracji cyklu życia w programie Studio, zobacz Korzystaj z konfiguracji cyklu życia w Amazon SageMaker Studio.

Utwórz klucz tajny dla poświadczeń płatka śniegu

Aby utworzyć swój sekret dla poświadczeń Snowflake, wykonaj następujące kroki:

- W konsoli Secrets Manager wybierz Przechowaj nowy sekret.

- W razie zamówieenia projektu Typ tajny, Wybierz Inny rodzaj tajemnicy.

- Podaj szczegóły swojego tajnego klucza jako pary klucz-wartość.

Nazwy kluczy wymagają małych liter ze względu na rozróżnianie wielkości liter. Data Wrangler wyświetla ostrzeżenie, jeśli którykolwiek z nich zostanie wprowadzony nieprawidłowo. Wprowadź tajne wartości jako pary klucz-wartość Klucz/wartość, jeśli chcesz, lub użyj zwykły tekst opcja.

Poniżej przedstawiono format klucza tajnego używanego dla Okta. Jeśli używasz usługi Azure AD, musisz dodać datasource_oauth_scope pole.

- Zaktualizuj powyższe wartości, wybierając dostawcę tożsamości i informacje zebrane po rejestracji aplikacji.

- Dodaj Następna.

- W razie zamówieenia projektu Tajne imię, dodaj prefiks

AmazonSageMaker(na przykład naszym sekretem jestAmazonSageMaker-DataWranglerSnowflakeCreds). - W Tagi sekcji, dodaj tag za pomocą klawisza

SageMakeri wartośćtrue. - Dodaj Następna.

- Pozostałe pola są opcjonalne; wybierać Następna dopóki nie będziesz miał możliwości wyboru sklep przechowywać sekret.

Po zapisaniu klucza tajnego wrócisz do konsoli Menedżera obiektów tajnych.

- Wybierz właśnie utworzony klucz tajny, a następnie odzyskaj tajny ARN.

- Zapisz to w preferowanym edytorze tekstu do późniejszego wykorzystania podczas tworzenia źródła danych Data Wrangler.

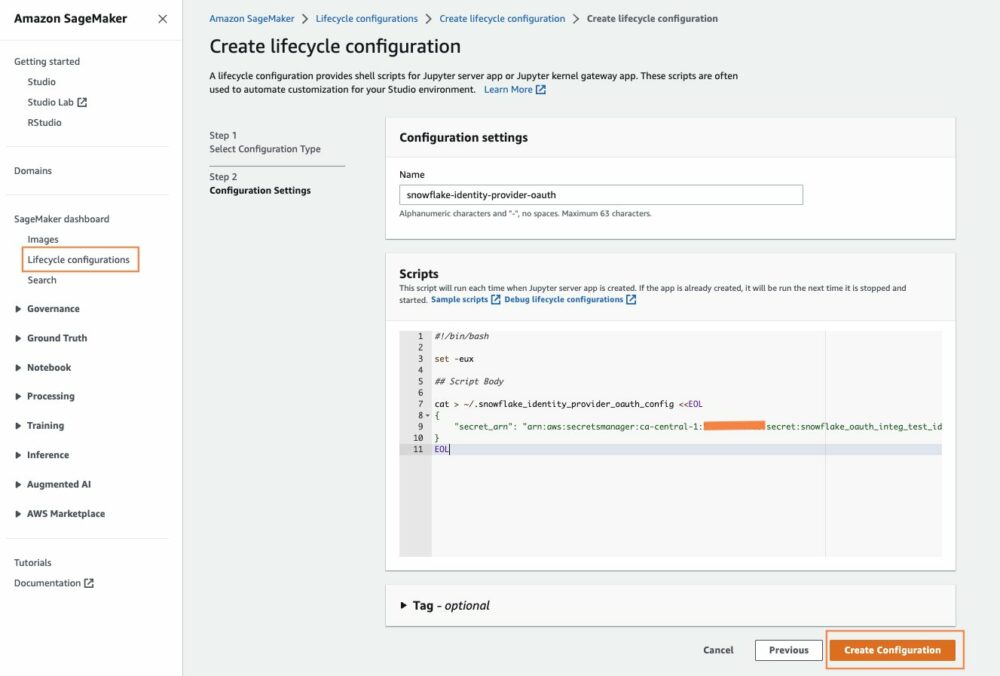

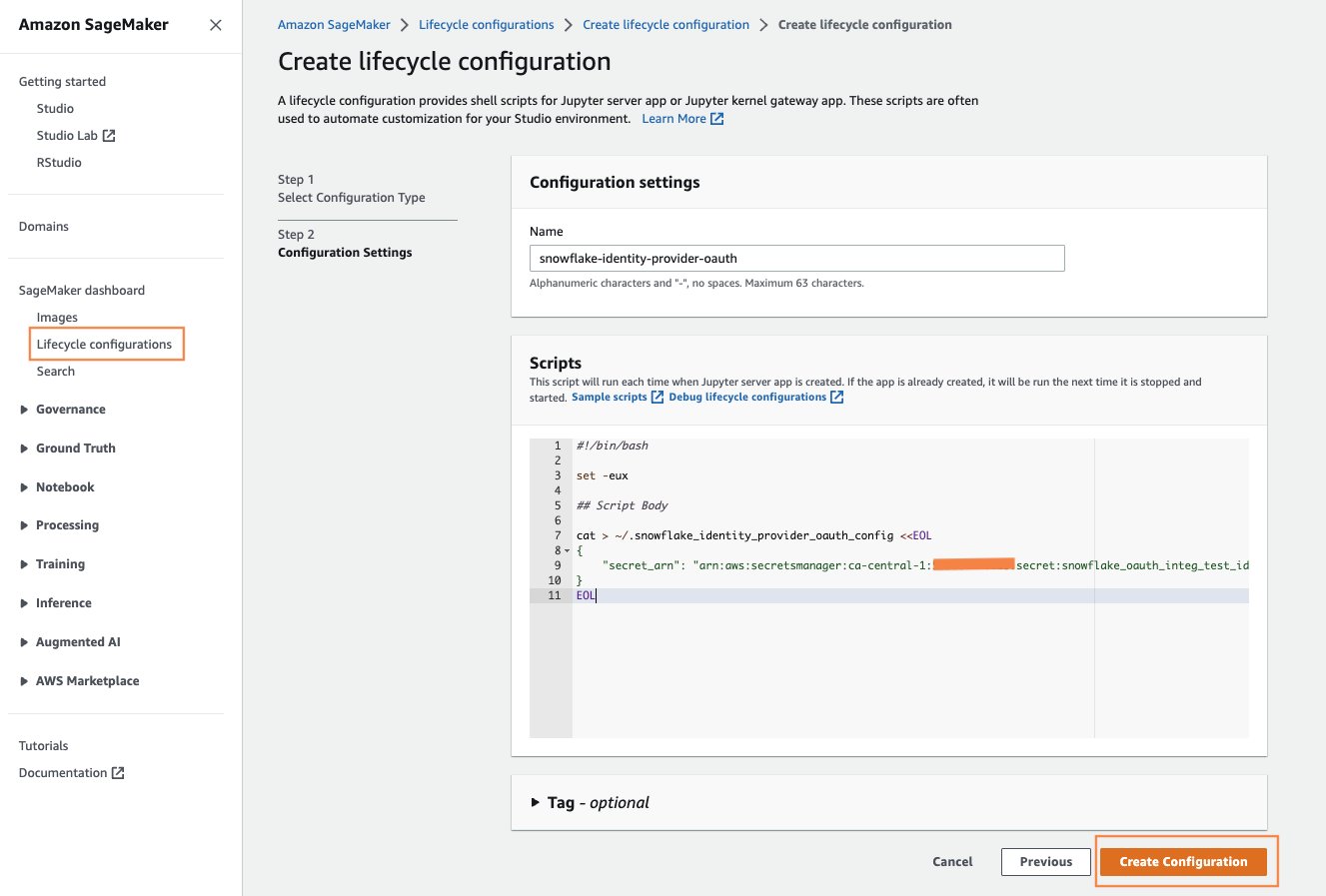

Utwórz konfigurację cyklu życia programu Studio

Aby utworzyć konfigurację cyklu życia w Studio, wykonaj następujące kroki:

- W konsoli SageMaker wybierz Konfiguracje cyklu życia w okienku nawigacji.

- Dodaj Utwórz konfigurację.

- Dodaj Aplikacja serwera Jupyter.

- Utwórz nową konfigurację cyklu życia lub dołącz istniejącą z następującą treścią:

Konfiguracja tworzy plik o nazwie ".snowflake_identity_provider_oauth_config", zawierający klucz tajny w folderze domowym użytkownika.

- Dodaj Utwórz konfigurację.

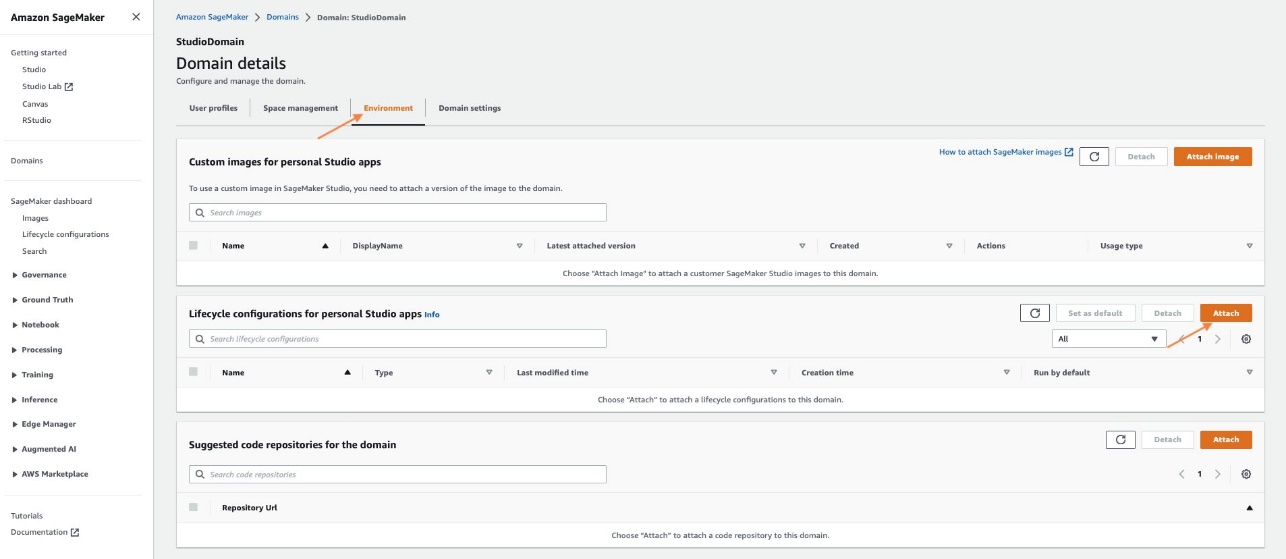

Ustaw domyślną konfigurację cyklu życia

Wykonaj następujące kroki, aby ustawić właśnie utworzoną konfigurację cyklu życia jako domyślną:

- W konsoli SageMaker wybierz domeny w okienku nawigacji.

- Wybierz domenę Studio, której będziesz używać w tym przykładzie.

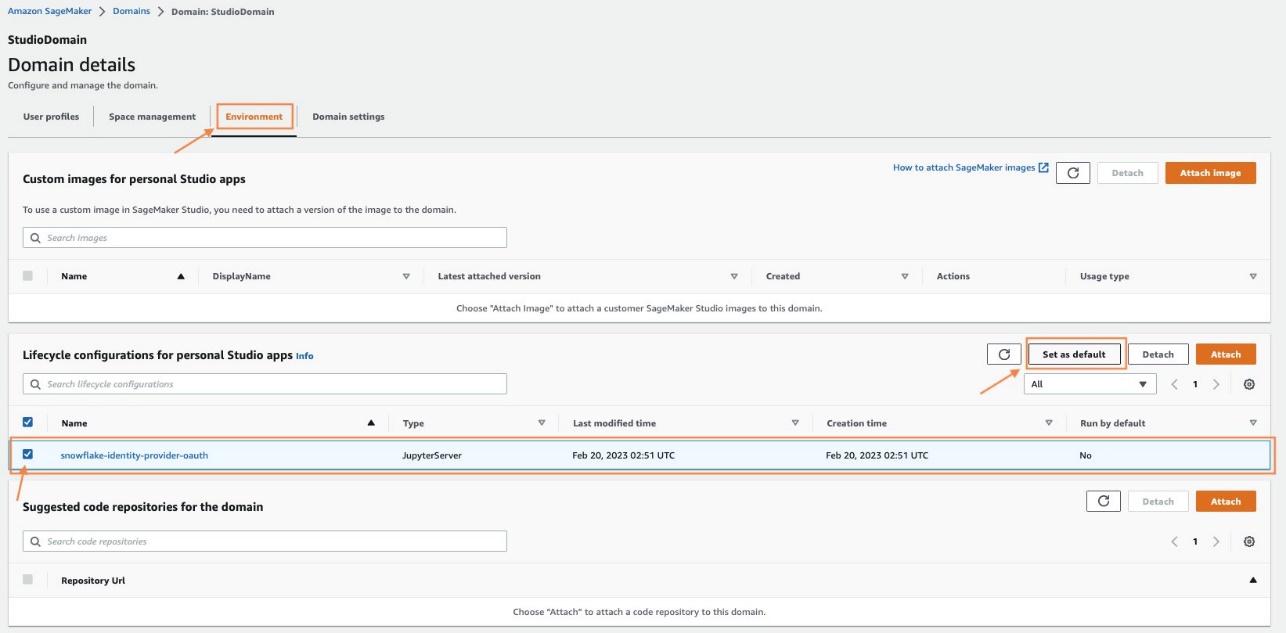

- Na Środowisko zakładka, w Konfiguracje cyklu życia dla osobistych aplikacji Studio Sekcja, wybierz Dołączać.

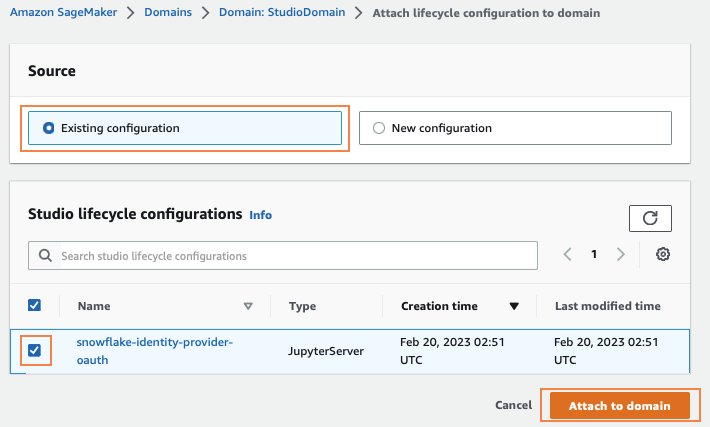

- W razie zamówieenia projektu Źródło, Wybierz Istniejąca konfiguracja.

- Wybierz właśnie utworzoną konfigurację, a następnie wybierz Dołącz do domeny.

- Wybierz nową konfigurację i wybierz Ustaw jako domyślny, A następnie wybierz Ustaw jako domyślny ponownie w wyskakującym okienku.

Twoje nowe ustawienia powinny być teraz widoczne pod Konfiguracje cyklu życia dla osobistych aplikacji Studio jako domyślny.

- Zamknij aplikację Studio i uruchom ją ponownie, aby zmiany zaczęły obowiązywać.

Doświadczenie analityka danych

W tej sekcji omawiamy, w jaki sposób analitycy danych mogą łączyć się z Snowflake jako źródłem danych w Data Wrangler i przygotowywać dane do uczenia maszynowego.

Utwórz nowy przepływ danych

Aby utworzyć przepływ danych, wykonaj następujące czynności:

- W konsoli SageMaker wybierz Studio Amazon SageMaker w okienku nawigacji.

- Dodaj Otwórz studio.

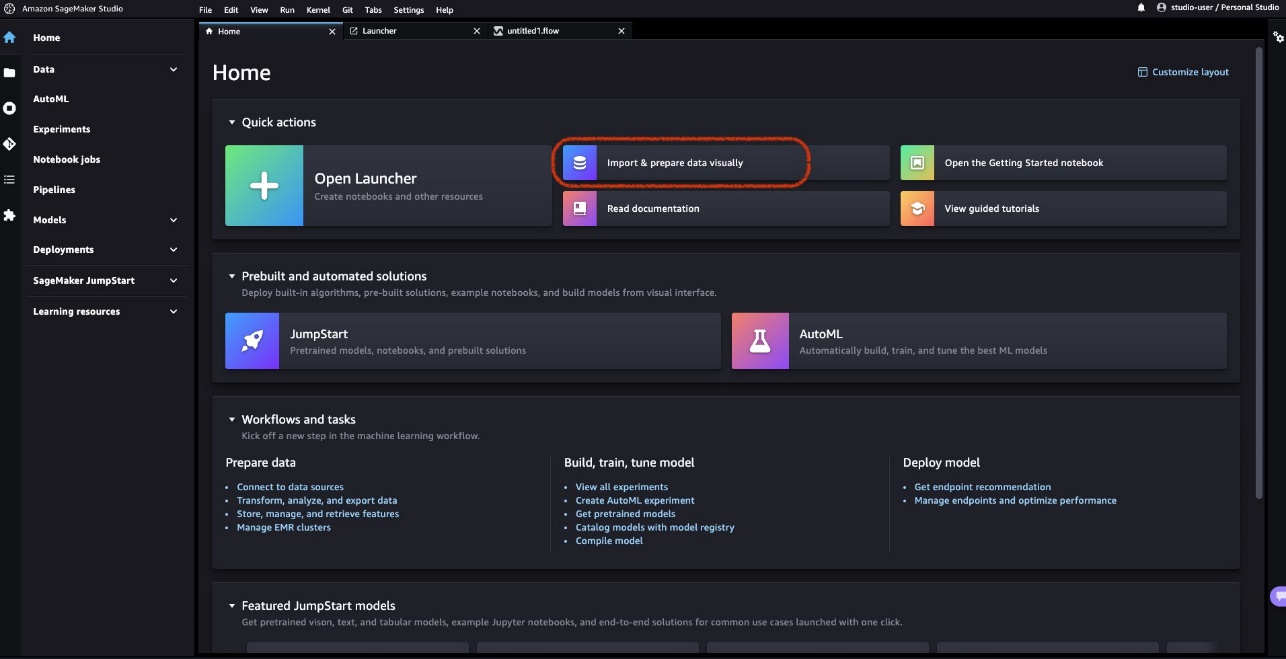

- w studiu Strona główna wybierz stronę Importuj i przygotuj dane wizualnie. Ewentualnie na filet menu rozwijane, wybierz Nowości, A następnie wybierz Przepływ danych SageMaker.

Tworzenie nowego przepływu może zająć kilka minut.

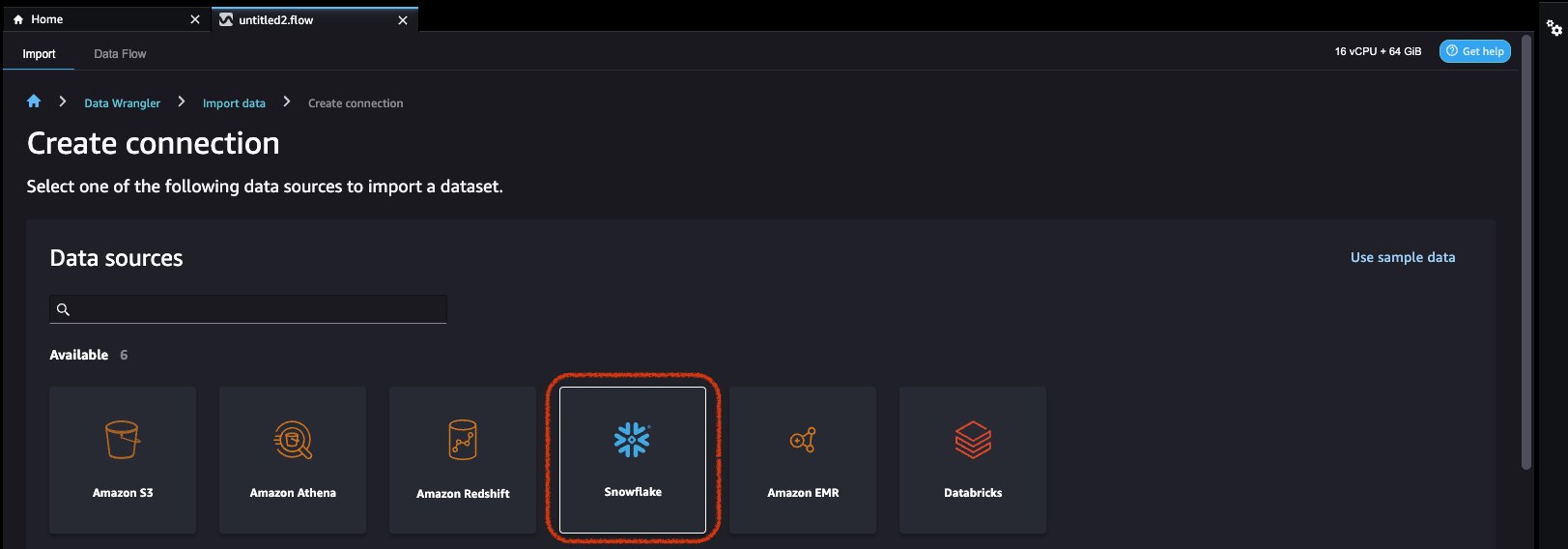

- Na Importuj daty wybierz stronę Utwórz połączenie.

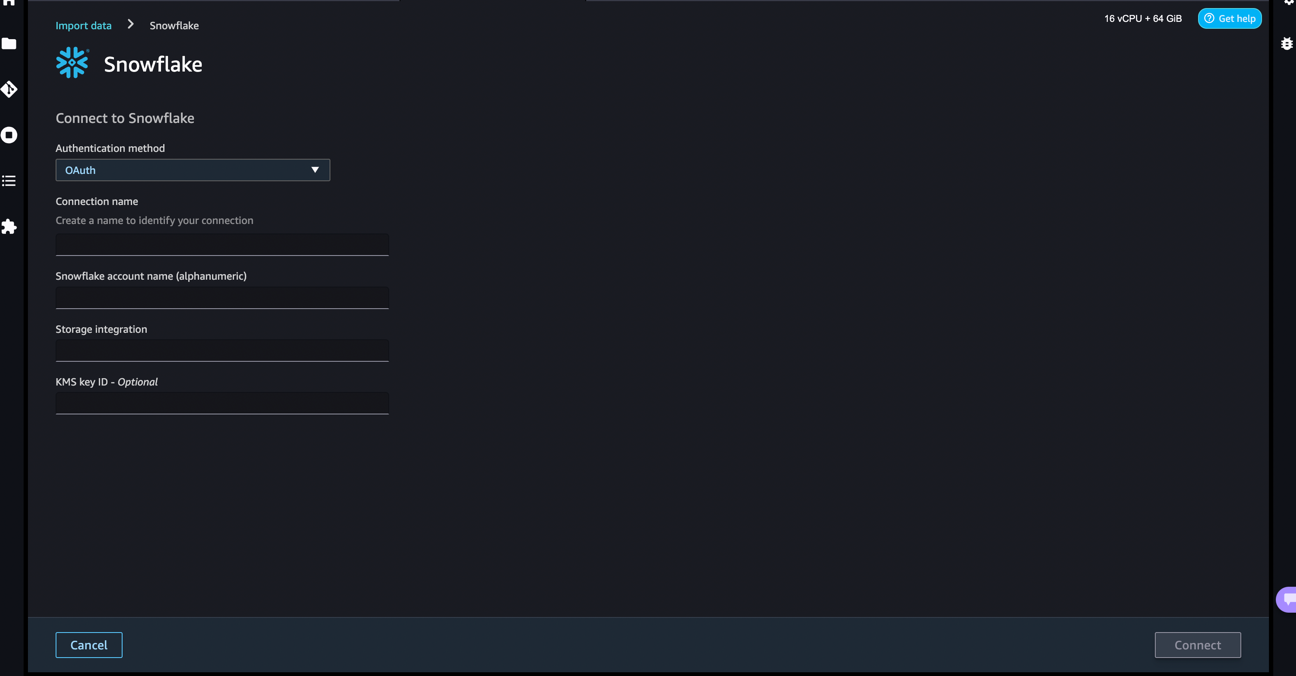

- Dodaj Snowflake z listy źródeł danych.

- W razie zamówieenia projektu Metoda Uwierzytelnieniawybierz OAuth.

Jeśli nie widzisz OAuth, sprawdź poprzednie kroki konfiguracji cyklu życia.

- Wprowadź szczegóły dla Nazwa konta płatka śniegu i Integracja pamięci masowej.

- Wpisz nazwę połączenia i wybierz Skontaktuj się.

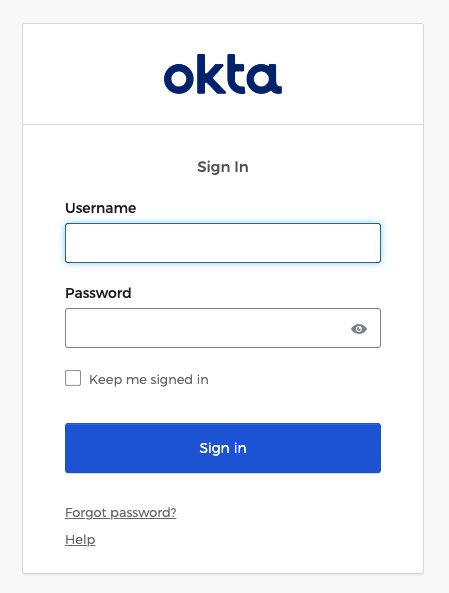

Nastąpiło przekierowanie do strony uwierzytelniania dostawcy tożsamości. W tym przykładzie używamy Okta.

- Wprowadź swoją nazwę użytkownika i hasło, a następnie wybierz LOGOWANIE.

Po pomyślnym uwierzytelnieniu nastąpi przekierowanie do strony przepływu danych Studio.

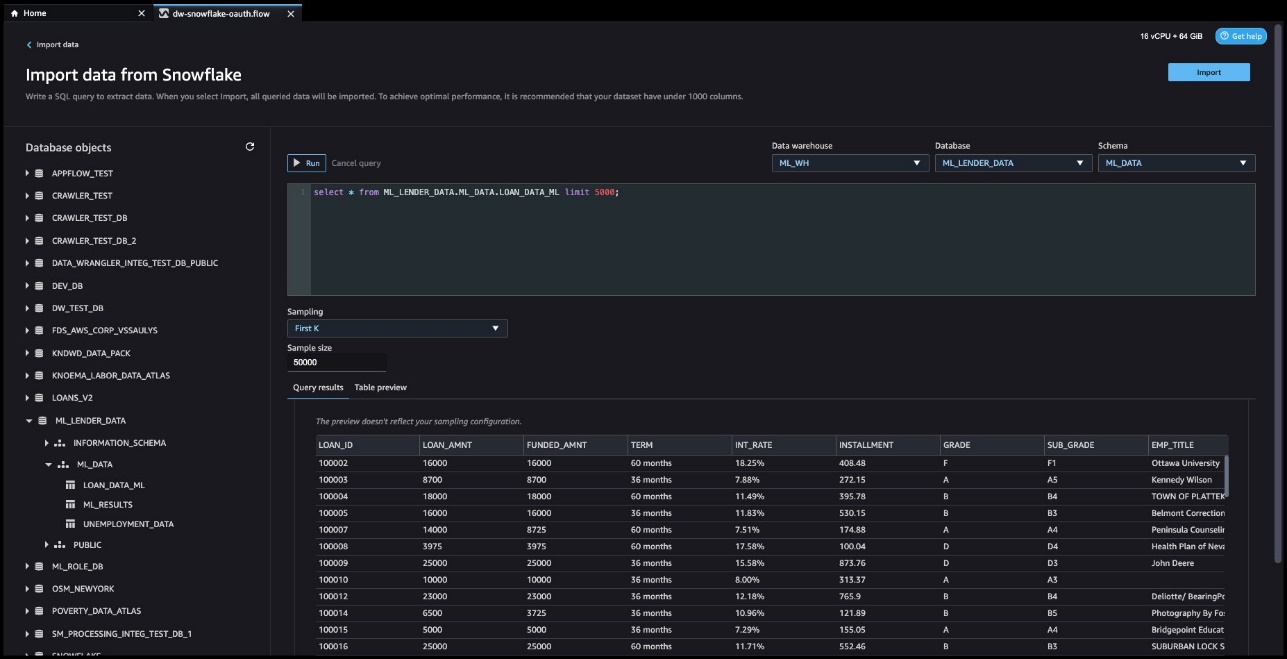

- Na Importuj dane ze Snowflake stronę, przeglądać obiekty bazy danych lub uruchamiać zapytanie dotyczące docelowych danych.

- W edytorze zapytań wprowadź zapytanie i wyświetl podgląd wyników.

W poniższym przykładzie ładujemy Dane pożyczki i pobierz wszystkie kolumny z 5,000 wierszy.

- Dodaj import.

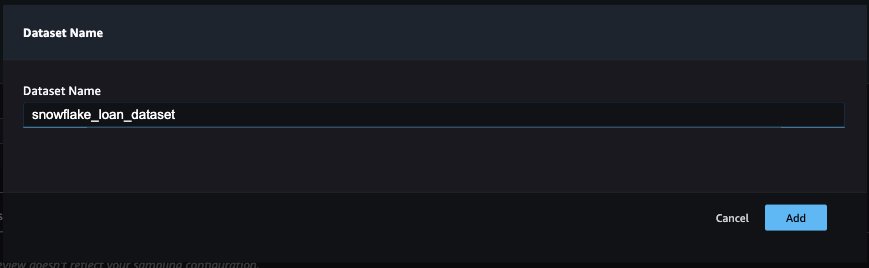

- Wprowadź nazwę zestawu danych (w tym poście używamy

snowflake_loan_dataset) i wybierz Dodaj.

Zostaniesz przekierowany do Przygotować strona, na której można dodawać przekształcenia i analizy do danych.

Data Wrangler ułatwia pozyskiwanie danych i wykonywanie zadań związanych z przygotowywaniem danych, takich jak eksploracyjna analiza danych, wybór funkcji i inżynieria funkcji. W tym poście dotyczącym przygotowania danych omówiliśmy tylko kilka możliwości narzędzia Data Wrangler; możesz użyć narzędzia Data Wrangler do bardziej zaawansowanej analizy danych, takiej jak ważność funkcji, przeciek docelowy i wyjaśnienie modelu, korzystając z łatwego i intuicyjnego interfejsu użytkownika.

Analizuj jakość danych

Użyj Raport dotyczący jakości danych i statystyk aby przeprowadzić analizę danych, które zaimportowałeś do Data Wrangler. Data Wrangler tworzy raport z próbkowanych danych.

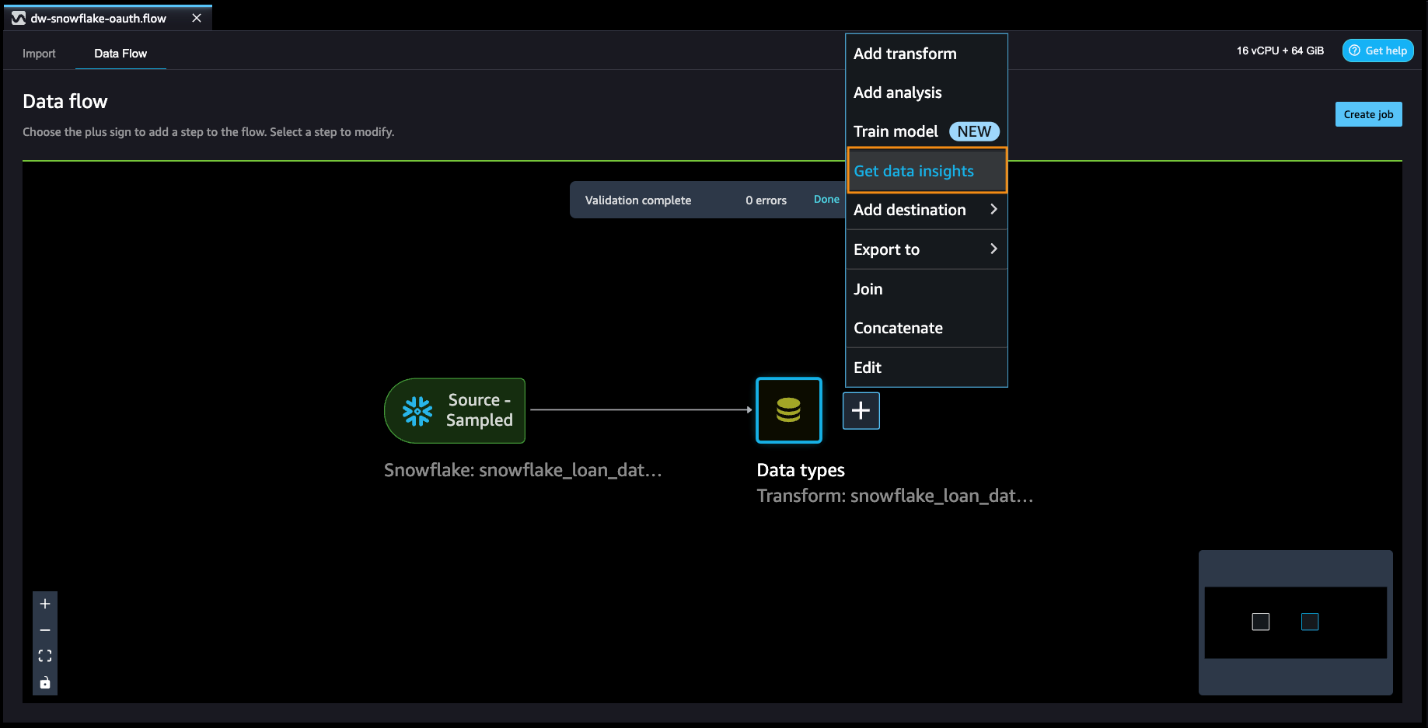

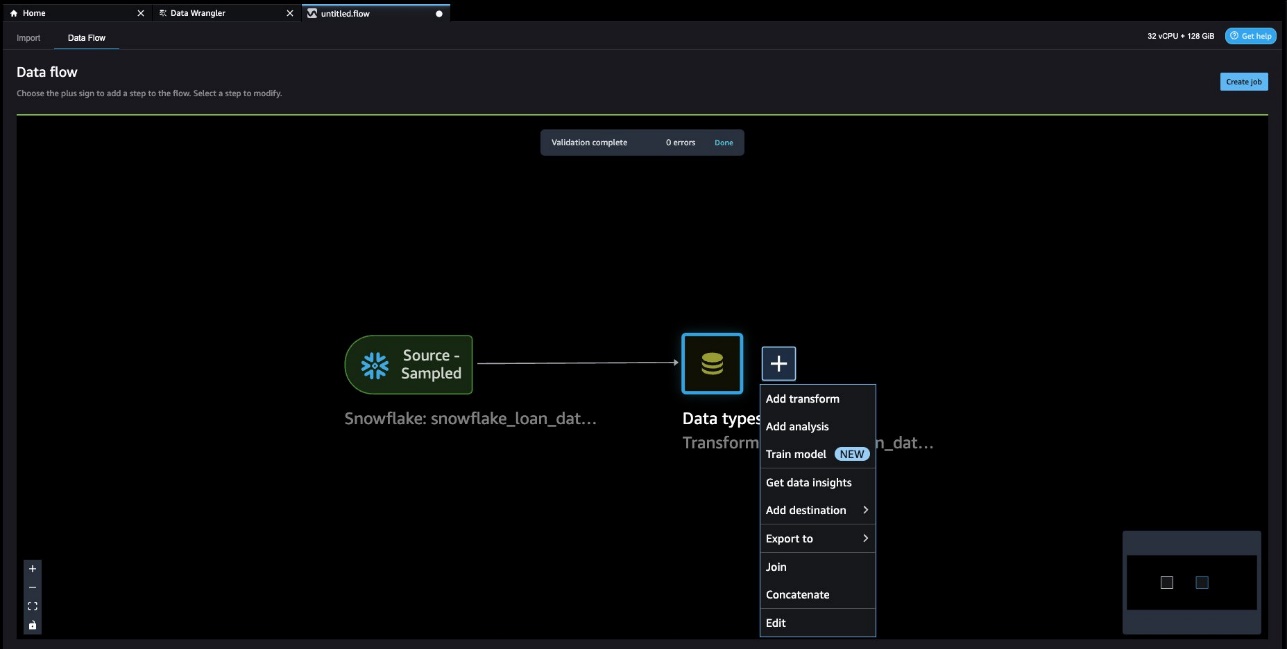

- Na stronie przepływu Data Wrangler wybierz znak plus obok Typy danych, A następnie wybierz Uzyskaj wgląd w dane.

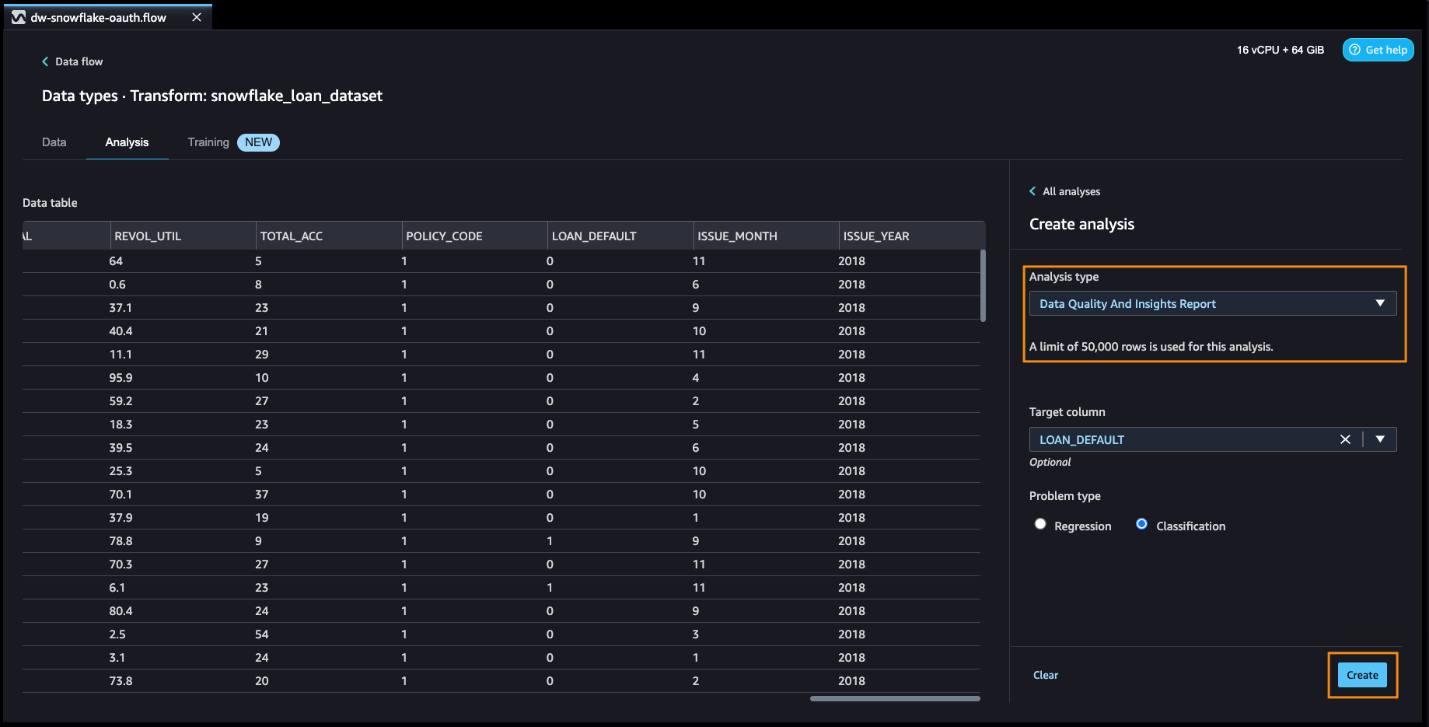

- Dodaj Raport dotyczący jakości danych i analiz dla Typ analizy.

- W razie zamówieenia projektu Kolumna docelowa, wybierz kolumnę docelową.

- W razie zamówieenia projektu Typ problemu, Wybierz Klasyfikacja.

- Dodaj Stwórz.

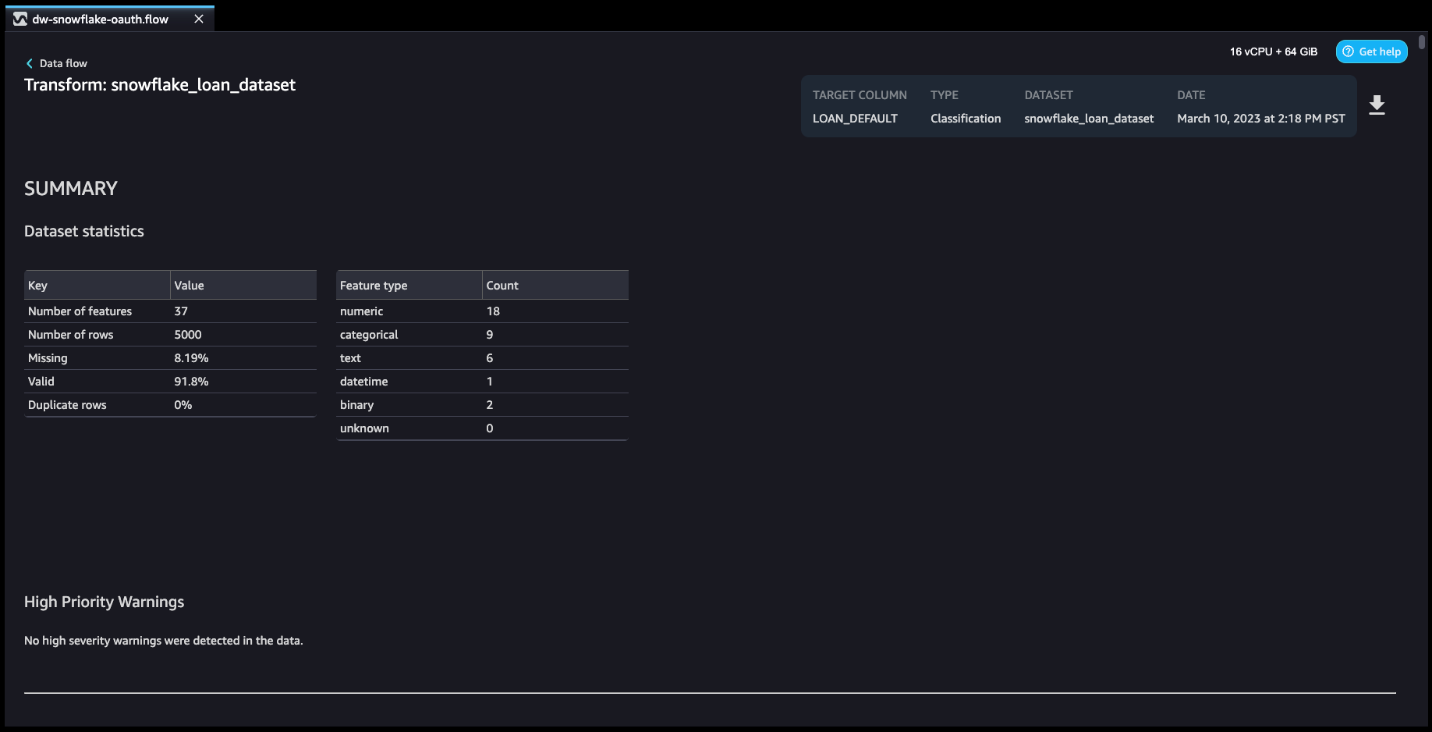

Raport Insights zawiera krótkie podsumowanie danych, które zawiera informacje ogólne, takie jak brakujące wartości, nieprawidłowe wartości, typy obiektów, liczby wartości odstających i inne. Możesz pobrać raport lub wyświetlić go online.

Dodaj przekształcenia do danych

Data Wrangler ma ponad 300 wbudowanych transformacji. W tej sekcji użyjemy niektórych z tych przekształceń, aby przygotować zestaw danych dla modelu ML.

- Na stronie przepływu Data Wrangler wybierz znak plus, a następnie wybierz Dodaj transformację.

Jeśli wykonujesz czynności opisane w poście, po dodaniu zestawu danych zostaniesz przekierowany tutaj automatycznie.

- Sprawdź i zmodyfikuj typ danych w kolumnach.

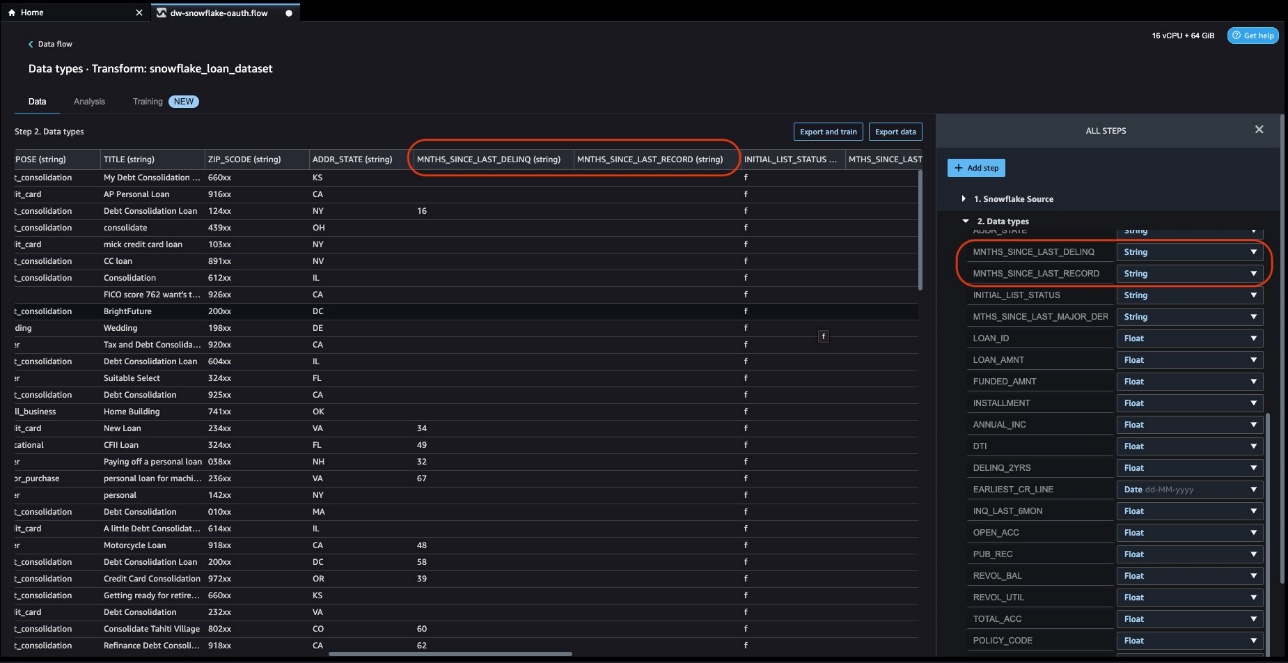

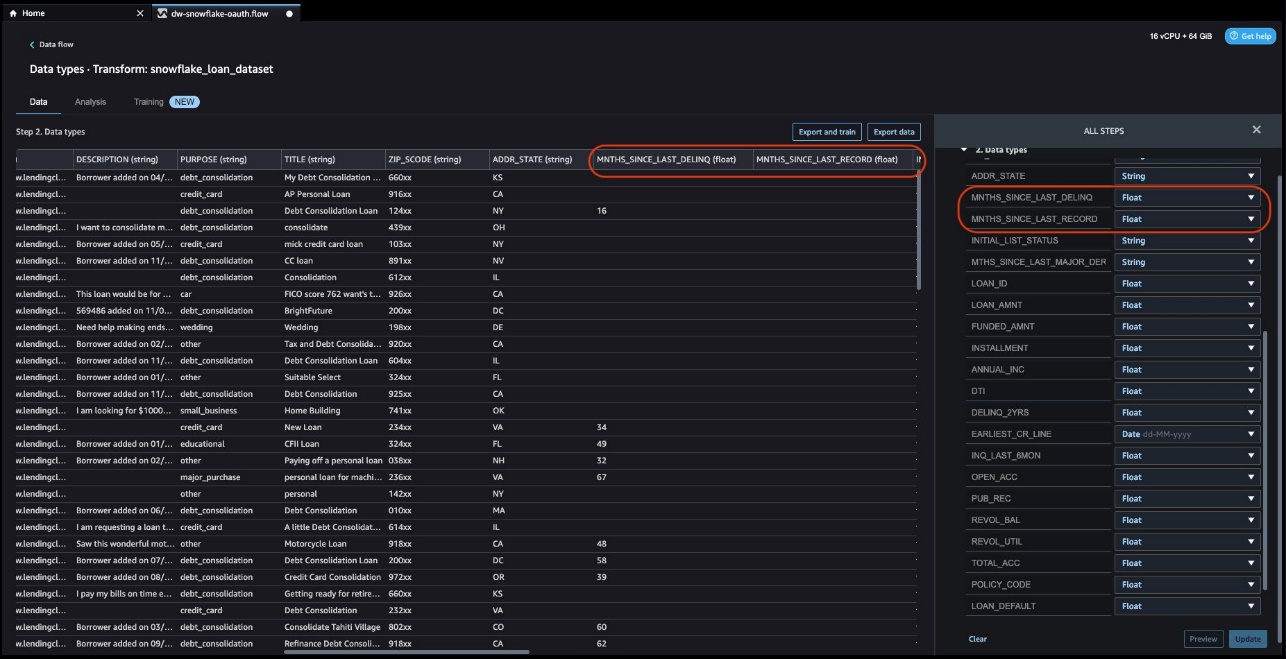

Przeglądając kolumny, identyfikujemy to MNTHS_SINCE_LAST_DELINQ i MNTHS_SINCE_LAST_RECORD powinien być najprawdopodobniej reprezentowany jako typ liczbowy, a nie łańcuchowy.

- Po zastosowaniu zmian i dodaniu kroku możesz sprawdzić, czy typ danych kolumny został zmieniony na zmiennoprzecinkowy.

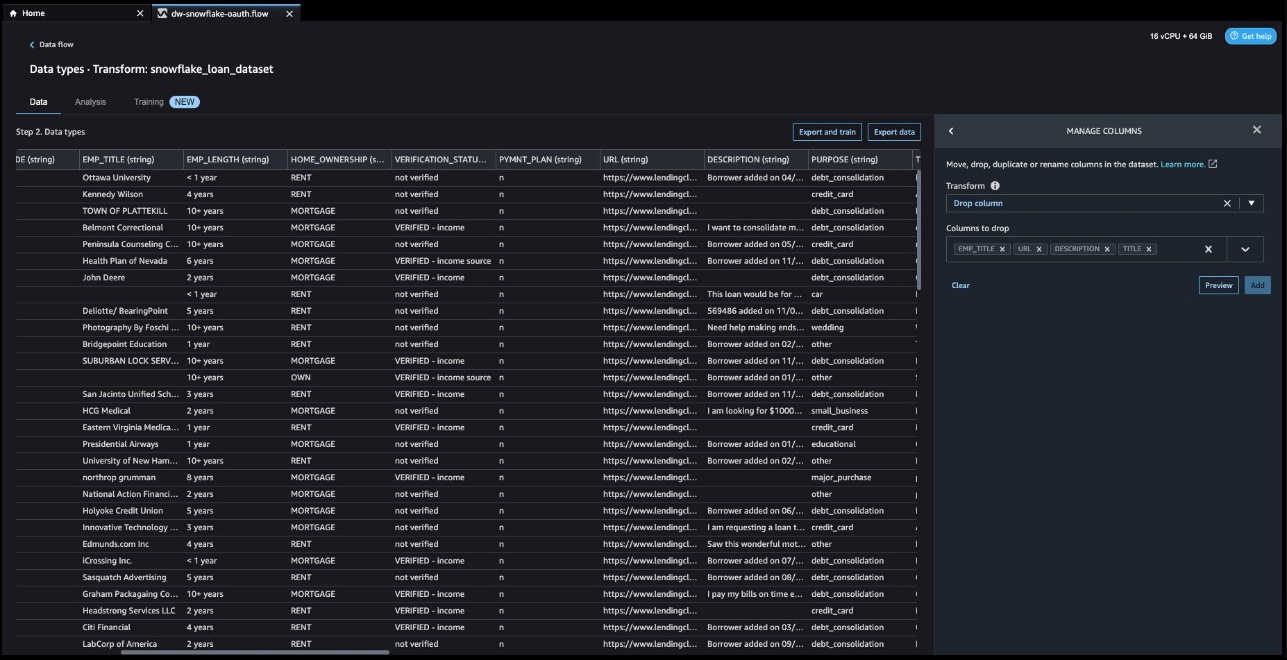

Przeglądając dane, widzimy, że pola EMP_TITLE, URL, DESCRIPTION, TITLE prawdopodobnie nie zapewnią wartości naszemu modelowi w naszym przypadku użycia, więc możemy je odrzucić.

- Dodaj Dodaj krok, A następnie wybierz Zarządzaj kolumnami.

- W razie zamówieenia projektu Przekształcaćwybierz Upuść kolumnę.

- W razie zamówieenia projektu Kolumna do upuszczenia, podaj

EMP_TITLE,URL,DESCRIPTION,TITLE. - Dodaj Podgląd i Dodaj.

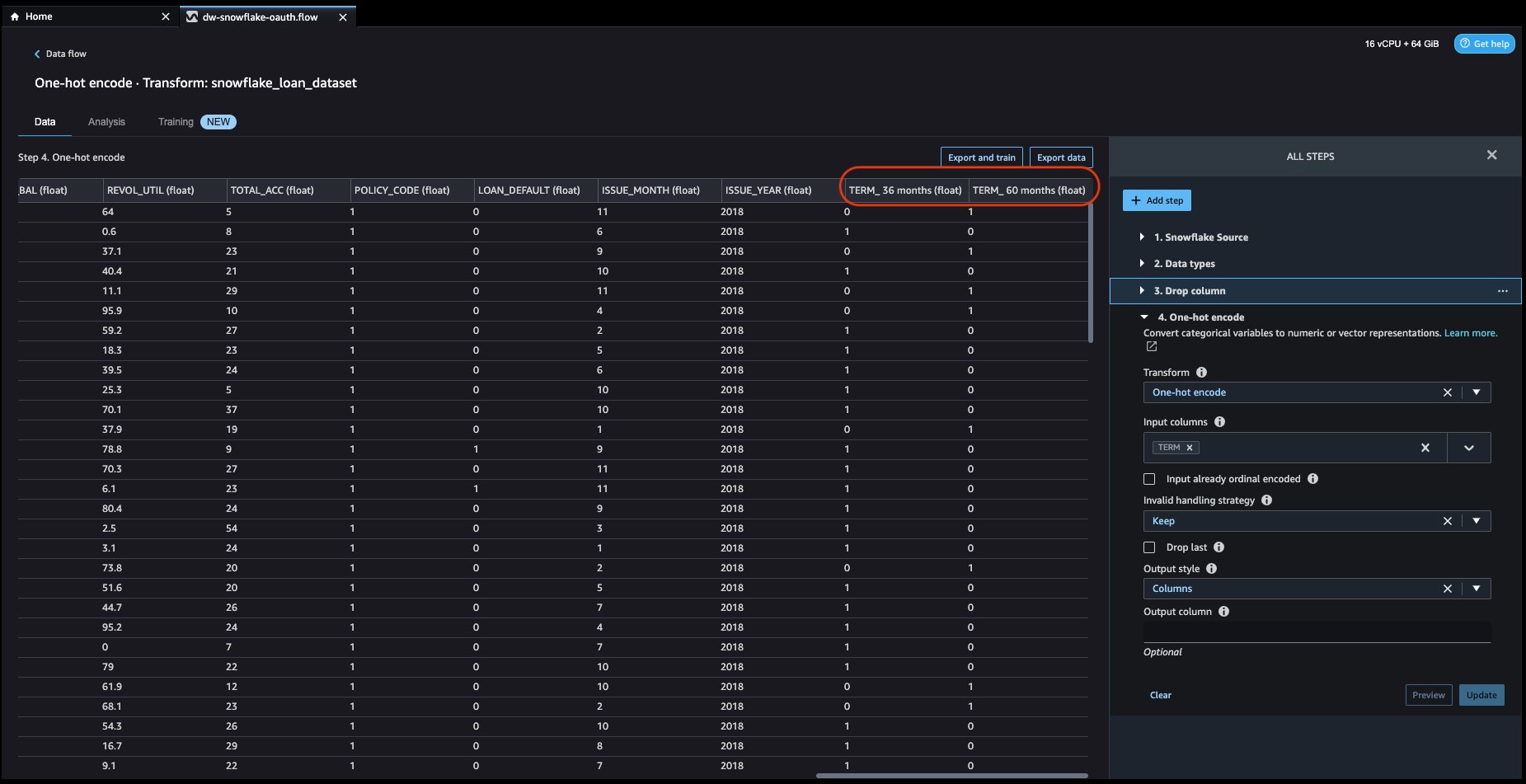

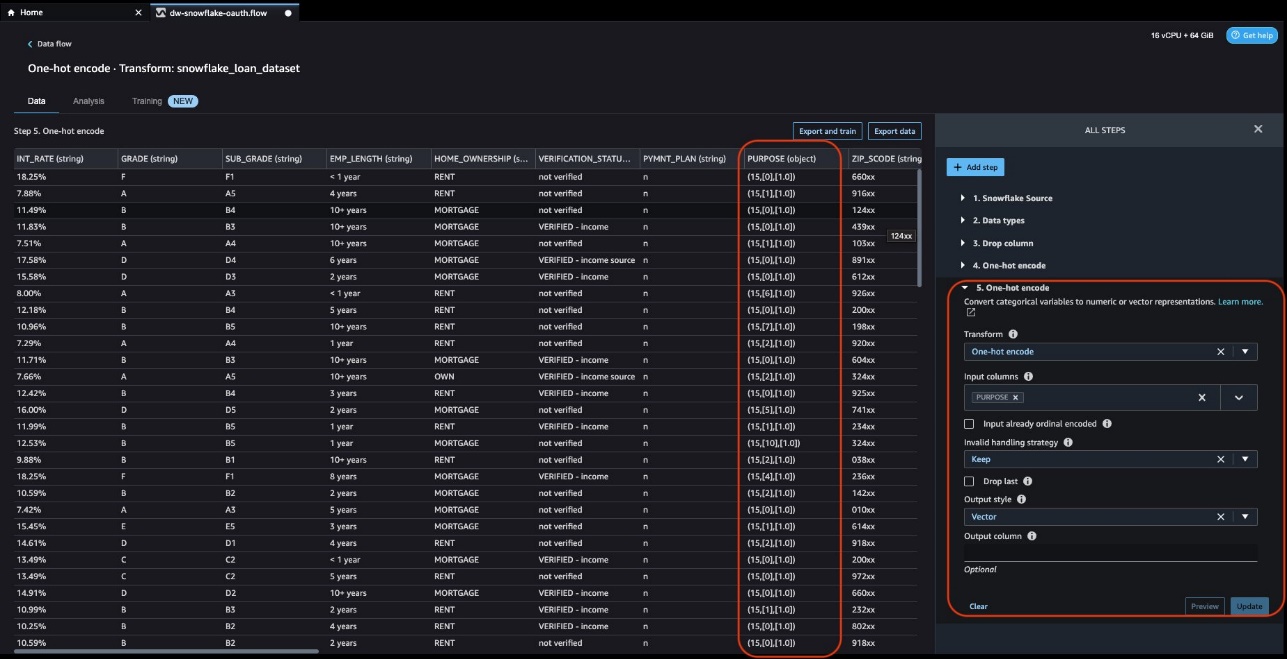

Następnie chcemy poszukać danych kategorycznych w naszym zbiorze danych. Data Wrangler ma wbudowaną funkcję kodowania danych kategorycznych przy użyciu zarówno kodowania porządkowego, jak i jednokrotnego. Patrząc na nasz zbiór danych, widzimy, że TERM, HOME_OWNERSHIP, PURPOSE wszystkie kolumny wydają się mieć charakter kategoryczny.

- Dodaj kolejny krok i wybierz Koduj kategorycznie.

- W razie zamówieenia projektu Przekształcaćwybierz Kodowanie na gorąco.

- W razie zamówieenia projektu Kolumna wejściowawybierz

TERM. - W razie zamówieenia projektu Styl wyjściowywybierz kolumny.

- Pozostaw wszystkie inne ustawienia jako domyślne, a następnie wybierz Podgląd i Dodaj.

Połączenia HOME_OWNERSHIP kolumna ma cztery możliwe wartości: RENT, MORTGAGE, OWN, i inne.

- Powtórz poprzednie kroki, aby zastosować podejście jednokrotnego kodowania do tych wartości.

Wreszcie, PURPOSE kolumna ma kilka możliwych wartości. W przypadku tych danych również stosujemy jednokierunkowe kodowanie, ale dane wyjściowe ustawiamy na wektor, a nie na kolumny.

- W razie zamówieenia projektu Przekształcaćwybierz Kodowanie na gorąco.

- W razie zamówieenia projektu Kolumna wejściowawybierz

PURPOSE. - W razie zamówieenia projektu Styl wyjściowywybierz wektor.

- W razie zamówieenia projektu Kolumna wyjściowa, nazywamy tę kolumnę

PURPOSE_VCTR.

To zachowuje oryginał PURPOSE kolumnę, jeśli zdecydujemy się ją później wykorzystać.

- Pozostaw wszystkie inne ustawienia jako domyślne, a następnie wybierz Podgląd i Dodaj.

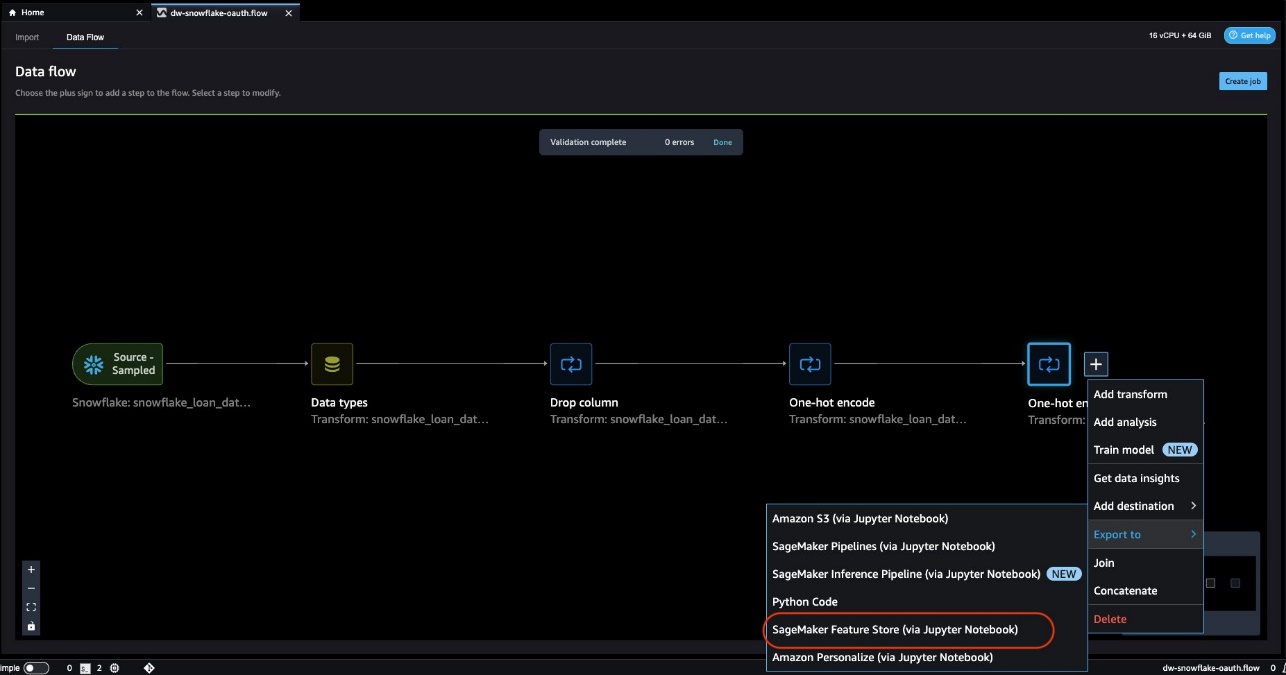

Eksportuj przepływ danych

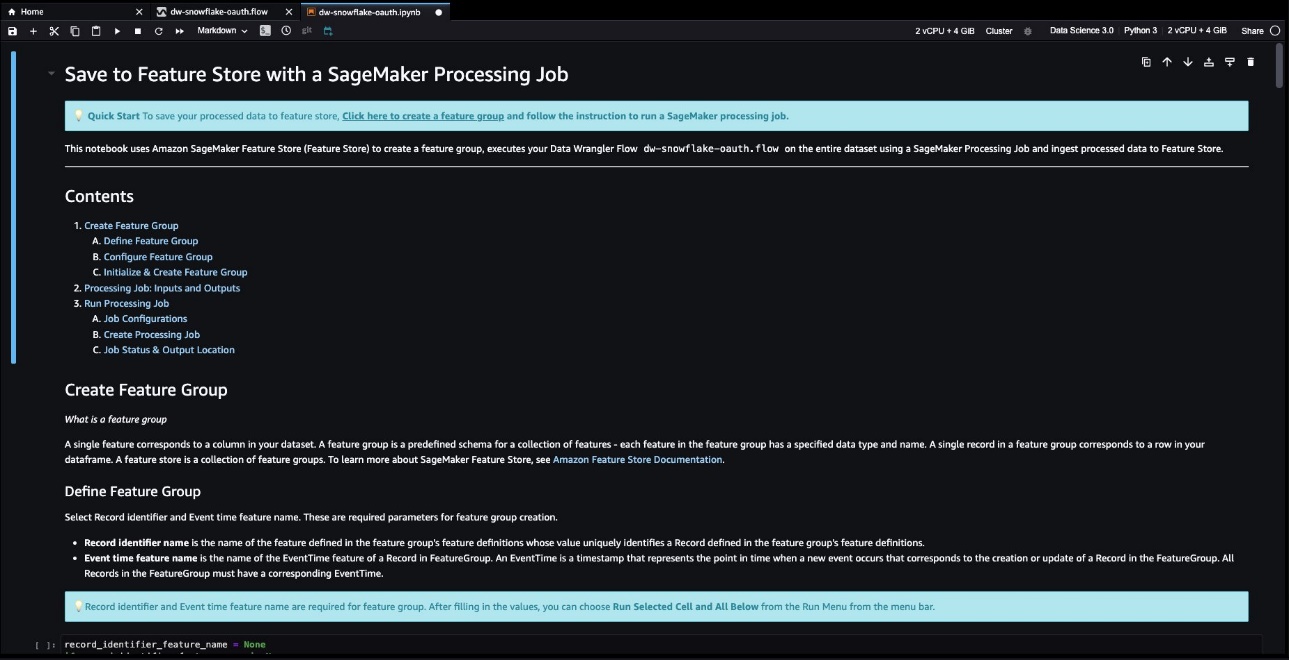

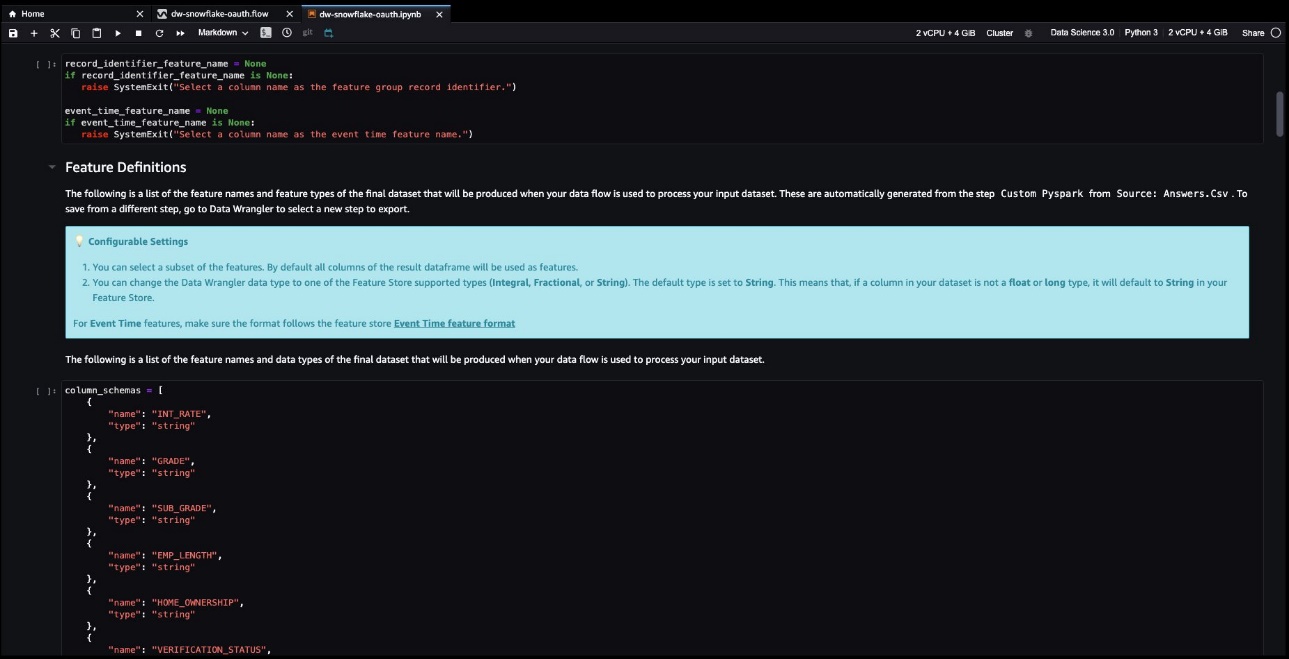

Na koniec eksportujemy cały przepływ danych do magazynu funkcji z zadaniem SageMaker Processing, które tworzy notatnik Jupyter z wstępnie wypełnionym kodem.

- Na stronie przepływu danych wybierz znak plus i Eksportować do.

- Wybierz miejsce eksportu. Dla naszego przypadku użycia wybieramy Sklep z funkcjami SageMaker.

Wyeksportowany notatnik jest teraz gotowy do uruchomienia.

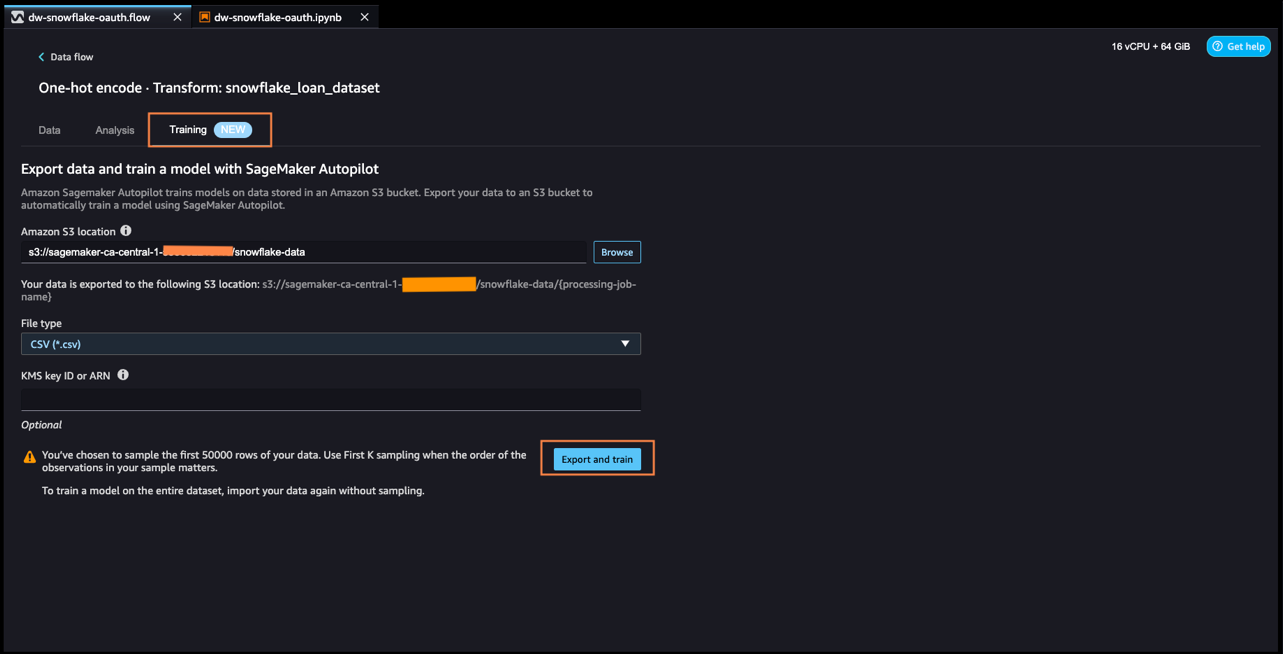

Eksportuj dane i trenuj model za pomocą Autopilota

Teraz możemy trenować model za pomocą Autopilot Amazon SageMaker.

- Na stronie przepływu danych wybierz Trening patka.

- W razie zamówieenia projektu Lokalizacja Amazon S3, wprowadź lokalizację, w której mają zostać zapisane dane.

- Dodaj Eksportuj i trenuj.

- Określ ustawienia w Cel i funkcje, Metoda treningowa, Ustawienia wdrażania i zaawansowane, Przejrzyj i utwórz działy.

- Dodaj Utwórz eksperyment aby znaleźć najlepszy model dla Twojego problemu.

Sprzątać

Jeśli Twoja praca z Data Wranglerem dobiegła końca, wyłącz instancję Data Wranglera aby uniknąć ponoszenia dodatkowych opłat.

Wnioski

W tym poście zademonstrowaliśmy łączenie Data Wrangler do Snowflake przy użyciu OAuth, przekształcając i analizując zestaw danych, a na koniec eksportując go do przepływu danych, aby można go było użyć w notatniku Jupyter. Przede wszystkim stworzyliśmy potok do przygotowywania danych bez konieczności pisania jakiegokolwiek kodu.

Aby rozpocząć korzystanie z Data Wranglera, zobacz Przygotuj dane ML za pomocą Amazon SageMaker Data Wrangler.

O autorach

Ajjay Govindaram jest starszym architektem rozwiązań w AWS. Pracuje ze strategicznymi klientami, którzy wykorzystują AI/ML do rozwiązywania złożonych problemów biznesowych. Jego doświadczenie polega na zapewnianiu wskazówek technicznych oraz pomocy projektowej w przypadku wdrożeń aplikacji AI/ML na niewielką lub dużą skalę. Jego wiedza obejmuje architekturę aplikacji, big data, analitykę i uczenie maszynowe. Lubi słuchać muzyki podczas odpoczynku, przebywania na świeżym powietrzu i spędzania czasu z najbliższymi.

Ajjay Govindaram jest starszym architektem rozwiązań w AWS. Pracuje ze strategicznymi klientami, którzy wykorzystują AI/ML do rozwiązywania złożonych problemów biznesowych. Jego doświadczenie polega na zapewnianiu wskazówek technicznych oraz pomocy projektowej w przypadku wdrożeń aplikacji AI/ML na niewielką lub dużą skalę. Jego wiedza obejmuje architekturę aplikacji, big data, analitykę i uczenie maszynowe. Lubi słuchać muzyki podczas odpoczynku, przebywania na świeżym powietrzu i spędzania czasu z najbliższymi.

Bosko Albuquerque jest starszym architektem rozwiązań partnerskich w AWS i ma ponad 20-letnie doświadczenie w pracy z bazami danych i produktami analitycznymi od dostawców baz danych dla przedsiębiorstw i dostawców chmury. Pomagał dużym firmom technologicznym projektować rozwiązania do analizy danych i kierował zespołami inżynierów w projektowaniu i wdrażaniu platform i produktów do analizy danych.

Bosko Albuquerque jest starszym architektem rozwiązań partnerskich w AWS i ma ponad 20-letnie doświadczenie w pracy z bazami danych i produktami analitycznymi od dostawców baz danych dla przedsiębiorstw i dostawców chmury. Pomagał dużym firmom technologicznym projektować rozwiązania do analizy danych i kierował zespołami inżynierów w projektowaniu i wdrażaniu platform i produktów do analizy danych.

Matta Marzillo jest starszym inżynierem ds. sprzedaży w firmie Snowflake. Ma 10-letnie doświadczenie w data science i machine learning na stanowiskach zarówno w konsultingu, jak iw organizacjach branżowych. Matt ma doświadczenie w opracowywaniu i wdrażaniu modeli AI i ML w wielu różnych organizacjach w obszarach takich jak marketing, sprzedaż, operacje, klinika i finanse, a także w doradztwie na stanowiskach konsultacyjnych.

Matta Marzillo jest starszym inżynierem ds. sprzedaży w firmie Snowflake. Ma 10-letnie doświadczenie w data science i machine learning na stanowiskach zarówno w konsultingu, jak iw organizacjach branżowych. Matt ma doświadczenie w opracowywaniu i wdrażaniu modeli AI i ML w wielu różnych organizacjach w obszarach takich jak marketing, sprzedaż, operacje, klinika i finanse, a także w doradztwie na stanowiskach konsultacyjnych.

Huong Nguyen jest liderem produktu Amazon SageMaker Data Wrangler w AWS. Ma 15 lat doświadczenia w tworzeniu zorientowanych na klienta i opartych na danych produktów dla przestrzeni korporacyjnych i konsumenckich. W wolnym czasie lubi audiobooki, ogrodnictwo, piesze wycieczki i spędzanie czasu z rodziną i przyjaciółmi.

Huong Nguyen jest liderem produktu Amazon SageMaker Data Wrangler w AWS. Ma 15 lat doświadczenia w tworzeniu zorientowanych na klienta i opartych na danych produktów dla przestrzeni korporacyjnych i konsumenckich. W wolnym czasie lubi audiobooki, ogrodnictwo, piesze wycieczki i spędzanie czasu z rodziną i przyjaciółmi.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :Jest

- $W GÓRĘ

- 000

- 10

- 100

- 15 roku

- 20 roku

- 7

- 8

- 9

- a

- Zdolny

- O nas

- dostęp

- Dostęp do danych

- Dostęp

- Konto

- w poprzek

- Ad

- dodatek

- Dodatkowy

- Admin

- awansować

- zaawansowany

- doradztwo

- Po

- AI

- AI / ML

- Wszystkie kategorie

- Amazonka

- Amazon Sage Maker

- Pogromca danych Amazon SageMaker

- analizuje

- analiza

- analityka

- w czasie rzeczywistym sprawiają,

- Analizując

- i

- Inne

- api

- Aplikacja

- zjawić się

- Zastosowanie

- Aplikuj

- Stosowanie

- podejście

- mobilne i webowe

- architektura

- SĄ

- obszary

- AS

- Wsparcie

- powiązany

- At

- dołączać

- publiczność

- audio

- uwierzytelniać

- Uwierzytelnianie

- autoryzacja

- zautomatyzować

- automatycznie

- AWS

- Lazur

- BE

- bo

- zanim

- rozpocząć

- BEST

- Duży

- Big Data

- ciało

- Książki

- wbudowany

- biznes

- by

- wezwanie

- nazywa

- CAN

- możliwości

- walizka

- CAT

- Zmiany

- wybór

- Dodaj

- klient

- Kliniczne

- Chmura

- kod

- Kolumna

- kolumny

- Firmy

- kompletny

- kompleks

- pojęcie

- systemu

- Skontaktuj się

- Podłączanie

- połączenie

- Konsola

- consulting

- konsument

- zawartość

- mógłby

- pokrywa

- pokryty

- Stwórz

- stworzony

- tworzy

- Tworzenie

- Listy uwierzytelniające

- Klientów

- dane

- analiza danych

- Analityka danych

- Platforma danych

- Przygotowywanie danych

- nauka danych

- naukowiec danych

- sterowane danymi

- Baza danych

- zdecydować

- Domyślnie

- wykazać

- wdrażanie

- wdrożenia

- Wnętrze

- projektowanie

- detal

- detale

- rozwijanie

- różne

- kierunek

- bezpośrednio

- odrębny

- dokumentacja

- Nie

- domena

- nie

- na dół

- pobieranie

- Spadek

- każdy

- redaktor

- efekt

- bądź

- umożliwiać

- inżynier

- Inżynieria

- Wchodzę

- Enterprise

- Środowisko

- przykład

- Przede wszystkim system został opracowany

- doświadczenie

- doświadczać

- Analiza danych rozpoznawczych

- eksport

- zewnętrzny

- FAIL

- członków Twojej rodziny

- Cecha

- Korzyści

- Opłaty

- kilka

- pole

- Łąka

- filet

- W końcu

- finansować

- Znajdź

- pływak

- pływ

- następujący

- W razie zamówieenia projektu

- format

- Częstotliwość

- często

- przyjaciele

- od

- Funkcjonalność

- Ogólne

- otrzymać

- daje

- przyznać

- większy

- Przewodniki

- Have

- mający

- pomoc

- pomógł

- tutaj

- Strona główna

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- ID

- identyfikator

- zidentyfikować

- tożsamość

- Idle

- wykonawczych

- importować

- znaczenie

- in

- obejmuje

- Włącznie z

- niepoprawnie

- przemysł

- Informacja

- wkład

- wgląd

- spostrzeżenia

- instrukcje

- integracja

- integracje

- Interfejs

- intuicyjny

- zaangażowany

- IT

- Praca

- Oferty pracy

- jpg

- Klawisz

- wiedza

- duży

- na dużą skalę

- lider

- nauka

- Doprowadziło

- leży

- wifecycwe

- dożywotni

- lubić

- Prawdopodobnie

- Lista

- Słuchanie

- załadować

- masa

- lokalizacja

- Popatrz

- poszukuje

- "kochanym"

- maszyna

- uczenie maszynowe

- zrobiony

- robić

- WYKONUJE

- Dokonywanie

- kierownik

- wiele

- Marketing

- wiadomość

- może

- minut

- brakujący

- ML

- model

- modele

- modyfikować

- jeszcze

- większość

- wielokrotność

- Muzyka

- Nazwa

- Nazwy

- Natura

- Nawigacja

- Potrzebować

- potrzeba

- wymagania

- Nowości

- Następny

- szczególnie

- notatnik

- numer

- przysięgać

- obiekty

- of

- OK

- on

- ONE

- Online

- operacje

- Option

- organizacji

- oryginalny

- Inne

- Inaczej

- na zewnątrz

- wydajność

- własny

- strona

- par

- chleb

- partnerem

- Hasło

- wykonać

- uprawnienia

- osobisty

- rurociąg

- Platforma

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- plus

- polityka

- pop-up

- możliwy

- Post

- Korzystny

- Przygotować

- warunki wstępne

- Podgląd

- poprzedni

- Problem

- problemy

- procedury

- wygląda tak

- przetwarzanie

- Produkt

- Produkty

- Profil

- Programowanie

- prawidłowo

- zapewniać

- pod warunkiem,

- dostawca

- dostawców

- zapewnia

- że

- jakość

- raczej

- gotowy

- polecić

- przekierowanie

- redukcja

- region

- zarejestrować

- rejestracji

- Rejestracja

- wznowienie

- raport

- reprezentowane

- wymagać

- osób

- REST

- dalsze

- Efekt

- detaliczny

- Rola

- role

- run

- bieganie

- sagemaker

- sole

- szeregowanie

- nauka

- Naukowiec

- Naukowcy

- zakres

- Tajemnica

- Sekcja

- działy

- bezpieczeństwo

- wybór

- senior

- Wrażliwość

- zestaw

- ustawienie

- w panelu ustawień

- kilka

- Powłoka

- powinien

- pokazać

- znak

- Prosty

- pojedynczy

- So

- Rozwiązania

- ROZWIĄZANIA

- kilka

- Źródło

- Źródła

- obowiązuje

- Spędzanie

- rozpoczęty

- rozpocznie

- Ewolucja krok po kroku

- Cel

- przechowywanie

- sklep

- przechowywany

- przechowywania

- Strategiczny

- sznur

- studio

- udany

- taki

- PODSUMOWANIE

- wsparcie

- podpory

- TAG

- Brać

- trwa

- cel

- ukierunkowane

- zadania

- Zespoły

- Techniczny

- Technologia

- firmy technologiczne

- że

- Połączenia

- Informacje

- ich

- Im

- Te

- Przez

- czas

- do

- żeton

- Żetony

- Pociąg

- Przekształcać

- przemiany

- transformatorowy

- typy

- dla

- zrozumieć

- wyjątkowy

- Aktualizacja

- URL

- posługiwać się

- przypadek użycia

- Użytkownik

- Interfejs użytkownika

- Użytkownicy

- wartość

- Wartości

- sprzedawców

- zweryfikować

- przez

- Zobacz i wysłuchaj

- widoczny

- solucja

- ostrzeżenie

- tygodni

- DOBRZE

- który

- Podczas

- KIM

- cały

- będzie

- w

- w ciągu

- bez

- Praca

- przepływów pracy

- pracujący

- działa

- napisać

- pisanie

- lat

- You

- Twój

- zefirnet