Ten post został napisany wspólnie z Ming (Melvinem) Qinem, Davidem Bericatem i Bradem Genereaux z firmy NVIDIA.

Badacze i programiści zajmujący się sztuczną inteligencją w zakresie obrazowania medycznego potrzebują skalowalnej platformy korporacyjnej do tworzenia, wdrażania i integrowania aplikacji AI. AWS i NVIDIA połączyły siły, aby urzeczywistnić tę wizję. AWS, NVIDIA i inni partnerzy Twórz aplikacje i rozwiązania, dzięki którym opieka zdrowotna będzie bardziej dostępna, przystępna cenowo i wydajna, poprzez przyspieszenie łączności w chmurze w obrazowaniu korporacyjnym. Wdrożenie MONAI jest jednym z kluczowych modułów wewnątrz MONAI (Medical Open Network for Artificial Intelligence) opracowane przez konsorcjum liderów akademickich i branżowych, w tym firmę NVIDIA. Obrazowanie zdrowia AWS (AHI) to spełniający wymagania ustawy HIPAA, wysoce skalowalny, wydajny i ekonomiczny sklep ze zdjęciami medycznymi. Opracowaliśmy złącze MONAI Deploy do AHI, aby zintegrować aplikacje AI do obrazowania medycznego z opóźnieniami w pobieraniu obrazów poniżej sekundy na dużą skalę dzięki interfejsom API natywnym dla chmury. Można na nim hostować modele i aplikacje MONAI AI Amazon Sage Maker, czyli w pełni zarządzana usługa umożliwiająca wdrażanie modeli uczenia maszynowego (ML) na dużą skalę. SageMaker zajmuje się konfiguracją instancji wnioskowania i zarządzaniem nimi oraz udostępnia wbudowane metryki i dzienniki dla punktów końcowych, których można używać do monitorowania i odbierania alertów. Oferuje również różnorodne Instancje GPU NVIDIA do wnioskowania ML, a także wiele opcji wdrażania modelu z automatycznym skalowaniem, w tym wnioskowanie w czasie rzeczywistym, wnioskowanie bezserwerowe, wnioskowanie asynchroniczne, transformacja wsadowa.

W tym poście pokazujemy, jak wdrożyć pakiet aplikacji MONAI (MAP) ze złączem do AWS HealthImaging, używając wielomodelowego punktu końcowego SageMaker do wnioskowania w czasie rzeczywistym i wnioskowania asynchronicznego. Te dwie opcje obejmują większość przypadków użycia potoku wnioskowania z obrazowania medycznego w czasie zbliżonym do rzeczywistego.

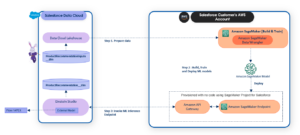

Omówienie rozwiązania

Poniższy schemat ilustruje architekturę rozwiązania.

Wymagania wstępne

Wykonaj następujące wymagane kroki:

- Użyj konta AWS w jednym z następujących regionów, w których dostępna jest usługa AWS HealthImaging: Wirginia Północna (

us-east-1), Oregonie (us-west-2), Irlandia (eu-west-1) i Sydney (ap-southeast-2). - Tworzenie Studio Amazon SageMaker domena i profil użytkownika w AWS Zarządzanie tożsamością i dostępem (IAM) pozwolenie na dostęp do AWS HealthImaging.

- Włącz rozszerzenie JupyterLab v3 i zainstaluj rozszerzenie Imjoy-jupyter, jeśli chcesz interaktywnie wizualizować obrazy medyczne na notebooku SageMaker za pomocą itkwidgets.

Złącze MAP do AWS HealthImaging

AWS HealthImaging importuje pliki DICOM P10 i konwertuje je do zestawów obrazów, które stanowią zoptymalizowaną reprezentację serii DICOM. AHI zapewnia dostęp API do metadanych ImageSet i ImageFrames. Metadane zawierają wszystkie atrybuty DICOM w dokumencie JSON. ImageFrame są zwracane w postaci zakodowanej w formacie Wysokoprzepustowy JPEG2000 (HTJ2K) formacie bezstratnym, który można dekodować niezwykle szybko. Zestawy obrazów można pobrać za pomocą metody Interfejs wiersza poleceń AWS (AWS CLI) lub Pakiety SDK AWS.

MONAI to platforma sztucznej inteligencji do obrazowania medycznego, która przenosi przełomowe badania i zastosowania sztucznej inteligencji do zastosowań klinicznych. MONAI Deploy to potok przetwarzania, który umożliwia kompleksowy przepływ pracy, w tym pakowanie, testowanie, wdrażanie i uruchamianie aplikacji AI do obrazowania medycznego w produkcji klinicznej. Zawiera MONAI Wdróż pakiet SDK aplikacji, MONAI Wdrożenie ekspresowe, Menedżer przepływu pracy, Brama informatyczna. Pakiet MONAI Deploy App SDK zapewnia gotowe do użycia algorytmy i platformę przyspieszającą tworzenie aplikacji AI do obrazowania medycznego, a także narzędzia użytkowe do pakowania aplikacji w kontener MAP. Wbudowane, oparte na standardach funkcje pakietu SDK aplikacji umożliwiają MAP płynną integrację z sieciami IT zajmującymi się opieką zdrowotną, co wymaga stosowania standardów takich jak DICOM, HL7 i FHIR, a także w centrach danych i środowiskach chmurowych. W mapach MAP można używać zarówno predefiniowanych, jak i niestandardowych operatorów do ładowania obrazów DICOM, wybierania serii, wnioskowania o modelu i przetwarzania końcowego

Opracowaliśmy Moduł Pythona przy użyciu pakietu AWS HealthImaging Python SDK Boto3. Możesz go zainstalować za pomocą pip i użyć funkcji pomocnika, aby pobrać instancje pary obiektów usługowych DICOM (SOP) w następujący sposób:

!pip install -q AHItoDICOMInterface

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

instances = helper.DICOMizeImageSet(datastore_id=datastoreId , image_set_id=next(iter(imageSetIds)))Wyjściowe instancje SOP można wizualizować za pomocą interaktywnej przeglądarki obrazów medycznych 3D itkwidgets w następujący sposób: notatnik, AHItoDICOM klasa wykorzystuje wiele procesów do równoległego pobierania klatek pikseli z AWS HealthImaging, oraz rozszyfrować dotychczasowy Binarne obiekty blob HTJ2K używając Biblioteka Pythona OpenJPEG. Identyfikatory ImageSetId pochodzą z plików wyjściowych danego zadania importu AWS HealthImaging. Mając DatastoreId i import JobId, możesz pobrać ImageSetId, który jest odpowiednikiem identyfikatora UID instancji serii DICOM, w następujący sposób:

imageSetIds = {}

try: response = s3.head_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/job-output-manifest.json") if response['ResponseMetadata']['HTTPStatusCode'] == 200: data = s3.get_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/SUCCESS/success.ndjson") contents = data['Body'].read().decode("utf-8") for l in contents.splitlines(): isid = json.loads(l)['importResponse']['imageSetId'] if isid in imageSetIds: imageSetIds[isid]+=1 else: imageSetIds[isid]=1

except ClientError: passDzięki ImageSetId możesz oddzielnie pobierać metadane nagłówka DICOM i piksele obrazu, korzystając z natywnych funkcji API AWS HealthImaging. The Agregaty eksportujące DICOM nagłówki DICOM i piksele obrazu do pliku Pydicom zbiór danych, który może być przetwarzany przez Operator modułu ładującego dane MAP DICOM. Wykorzystując funkcję DICOMizeImageSet() stworzyliśmy konektor umożliwiający ładowanie danych obrazowych z AWS HealthImaging, w oparciu o MAP Operator modułu ładującego dane DICOM:

class AHIDataLoaderOperator(Operator): def __init__(self, ahi_client, must_load: bool = True, *args, **kwargs): self.ahi_client = ahi_client … def _load_data(self, input_obj: string): study_dict = {} series_dict = {} sop_instances = self.ahi_client.DICOMizeImageSet(input_obj['datastoreId'], input_obj['imageSetId'])W poprzednim kodzie ahi_client jest instancją klasy eksportera AHItoDICOM DICOM, z zilustrowanymi funkcjami wyszukiwania danych. Dodaliśmy tego nowego operatora modułu ładującego dane do pliku Aplikacja AI do segmentacji śledziony 3D stworzona przez pakiet SDK aplikacji MONAI Deploy. Możesz najpierw dowiedzieć się, jak utworzyć i uruchomić tę aplikację w lokalnej instancji notatnika, a następnie wdróż tę aplikację MAP w punktach końcowych wnioskowania zarządzanych przez SageMaker.

Wnioskowanie asynchroniczne SageMaker

SageMaker wnioskowanie asynchroniczne punkt końcowy jest używany w przypadku żądań o dużych rozmiarach ładunku (do 1 GB), długim czasie przetwarzania (do 15 minut) i wymaganiach dotyczących opóźnień w czasie zbliżonym do rzeczywistego. Jeśli nie ma żadnych żądań do przetworzenia, ta opcja wdrożenia może zmniejszyć liczbę instancji do zera, co pozwala zaoszczędzić koszty, co jest idealnym rozwiązaniem w przypadku obciążeń związanych z wnioskowaniem ML w obrazowaniu medycznym. Postępuj zgodnie z instrukcjami w przykładowy notatnik do tworzenia i wywoływania asynchronicznego punktu końcowego wnioskowania SageMaker. Do utwórz asynchroniczny punkt końcowy wnioskowania, musisz najpierw utworzyć model SageMaker i konfigurację punktu końcowego. Aby utworzyć model SageMaker, będziesz musiał załadować pakiet model.tar.gz z plikiem zdefiniowaną strukturę katalogów do kontenera Docker. Pakiet model.tar.gz zawiera wstępnie wytrenowany plik model.ts segmentacji śledziony i dostosowany plik inference.py. Do załadowania modelu i uruchomienia prognoz wykorzystaliśmy wstępnie zbudowany kontener z wersjami platformy Python 3.8 i PyTorch 1.12.1.

W niestandardowym inference.py tworzymy instancję klasy pomocniczej AHItoDICOM z interfejsu AHItoDICOMInterface i używamy jej do utworzenia instancji MAP w model_fn() funkcję i uruchamiamy aplikację MAP przy każdym żądaniu wnioskowania w pliku predict_fn() funkcjonować:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

def model_fn(model_dir, context): … monai_app_instance = AISpleenSegApp(helper, do_run=False,path="/home/model-server") def predict_fn(input_data, model): with open('/home/model-server/inputImageSets.json', 'w') as f: f.write(json.dumps(input_data)) output_folder = "/home/model-server/output" if not os.path.exists(output_folder): os.makedirs(output_folder) model.run(input='/home/model-server/inputImageSets.json', output=output_folder, workdir='/home/model-server', model='/opt/ml/model/model.ts')Do wywołać asynchroniczny punkt końcowy, będziesz musiał załadować wejściowy ładunek żądania do Usługa Amazon Simple Storage (Amazon S3), który jest plikiem JSON określającym identyfikator magazynu danych AWS HealthImaging i identyfikator ImageSet, na których mają być uruchamiane wnioskowania:

sess = sagemaker.Session()

InputLocation = sess.upload_data('inputImageSets.json', bucket=sess.default_bucket(), key_prefix=prefix, extra_args={"ContentType": "application/json"})

response = runtime_sm_client.invoke_endpoint_async(EndpointName=endpoint_name, InputLocation=InputLocation, ContentType="application/json", Accept="application/json")

output_location = response["OutputLocation"]Dane wyjściowe można znaleźć również w Amazon S3.

Wnioskowanie w czasie rzeczywistym dotyczące wielu modeli SageMaker

SageMaker wnioskowanie w czasie rzeczywistym punkty końcowe spełniają wymagania dotyczące interaktywności i małych opóźnień. Ta opcja umożliwia hostowanie wielu modeli w jednym kontenerze za jednym punktem końcowym, co stanowi skalowalne i ekonomiczne rozwiązanie umożliwiające wdrażanie kilku modeli uczenia maszynowego. A Wielomodelowy punkt końcowy SageMaker korzysta z serwera NVIDIA Triton Inference Server z procesorem graficznym do uruchamiania wielu wniosków dotyczących modelu głębokiego uczenia się.

W tej sekcji omówimy sposób tworzenia i wywoływania punktu końcowego z wieloma modelami dostosowywanie własnego kontenera wnioskowania w następującym przykładowy notatnik. Różne modele mogą być obsługiwane we wspólnym kontenerze na tej samej flocie zasobów. Punkty końcowe z wieloma modelami zmniejszają obciążenie związane z wdrażaniem i wnioskowanie o modelu skalowania w oparciu o wzorce ruchu do punktu końcowego. Użyliśmy Narzędzia programistyczne AWS włącznie z Amazon CodeCommit, Tworzenie kodu Amazon, Amazon CodePipeline budować dostosowany pojemnik do wnioskowania o modelu SageMaker. Przygotowaliśmy A model_handler.py aby w poprzednim przykładzie użyć własnego kontenera zamiast pliku inference.py i zaimplementować funkcje inicjujące(), preprocess() i inference():

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

class ModelHandler(object): def __init__(self): self.initialized = False self.shapes = None def initialize(self, context): self.initialized = True properties = context.system_properties model_dir = properties.get("model_dir") gpu_id = properties.get("gpu_id") helper = AHItoDICOM() self.monai_app_instance = AISpleenSegApp(helper, do_run=False, path="/home/model-server/") def preprocess(self, request): inputStr = request[0].get("body").decode('UTF8') datastoreId = json.loads(inputStr)['inputs'][0]['datastoreId'] imageSetId = json.loads(inputStr)['inputs'][0]['imageSetId'] with open('/tmp/inputImageSets.json', 'w') as f: f.write(json.dumps({"datastoreId": datastoreId, "imageSetId": imageSetId})) return '/tmp/inputImageSets.json' def inference(self, model_input): self.monai_app_instance.run(input=model_input, output="/home/model-server/output/", workdir="/home/model-server/", model=os.environ["model_dir"]+"/model.ts")Po zbudowaniu i wypchnięciu kontenera Rejestr elastycznego pojemnika Amazon (Amazon ECR), możesz za jego pomocą stworzyć model SageMaker oraz różne pakiety modeli (pliki tar.gz) w danej ścieżce Amazon S3:

model_name = "DEMO-MONAIDeployModel" + strftime("%Y-%m-%d-%H-%M-%S", gmtime())

model_url = "s3://{}/{}/".format(bucket, prefix)

container = "{}.dkr.ecr.{}.amazonaws.com/{}:dev".format( account_id, region, prefix )

container = {"Image": container, "ModelDataUrl": model_url, "Mode": "MultiModel"}

create_model_response = sm_client.create_model(ModelName=model_name, ExecutionRoleArn=role, PrimaryContainer=container)Warto zauważyć, że model_url tutaj określa jedynie ścieżkę do folderu plików tar.gz i określa, który pakiet modelu ma być używany do wnioskowania podczas wywoływania punktu końcowego, jak pokazano w następującym kodzie:

Payload = {"inputs": [ {"datastoreId": datastoreId, "imageSetId": next(iter(imageSetIds))} ]}

response = runtime_sm_client.invoke_endpoint(EndpointName=endpoint_name, ContentType="application/json", Accept="application/json", TargetModel="model.tar.gz", Body=json.dumps(Payload))Możemy dodać więcej modeli do istniejącego punktu końcowego wnioskowania obejmującego wiele modeli bez konieczności aktualizowania punktu końcowego lub tworzenia nowego.

Sprzątać

Nie zapomnij wypełnić Usuń zasoby hostingowe krok w laboratorium-3 i laboratorium-4 notatniki, aby usunąć punkty końcowe wnioskowania SageMaker. Aby zaoszczędzić na kosztach, powinieneś zrezygnować z instancji notatnika SageMaker. Na koniec możesz wywołać funkcję API AWS HealthImaging lub użyć konsoli AWS HealthImaging, aby usunąć utworzone wcześniej zestawy obrazów i magazyn danych:

for s in imageSetIds.keys(): medicalimaging.deleteImageSet(datastoreId, s)

medicalimaging.deleteDatastore(datastoreId)Wnioski

W tym poście pokazaliśmy, jak utworzyć złącze MAP do AWS HealthImaging, które można ponownie wykorzystać w aplikacjach zbudowanych przy użyciu pakietu MONAI Deploy App SDK, aby zintegrować i przyspieszyć pobieranie danych obrazów z natywnego w chmurze magazynu DICOM do obciążeń AI związanych z obrazowaniem medycznym . Zestaw SDK MONAI Deploy może być używany do wspierania operacji szpitalnych. Zademonstrowaliśmy także dwie opcje hostingu umożliwiające wdrażanie aplikacji MAP AI w SageMaker na dużą skalę.

Przejrzyj przykładowe notesy w Repozytorium GitHub aby dowiedzieć się więcej o wdrażaniu aplikacji MONAI w SageMaker z obrazami medycznymi przechowywanymi w AWS HealthImaging. Aby dowiedzieć się, co AWS może dla Ciebie zrobić, skontaktuj się z: przedstawiciel AWS.

Aby zapoznać się z dodatkowymi zasobami, zobacz:

O autorach

Ming (Melvin) Qin jest niezależnym współpracownikiem zespołu Healthcare w firmie NVIDIA, skupiającym się na opracowywaniu platformy i platformy aplikacji do wnioskowania opartej na sztucznej inteligencji, umożliwiającej wykorzystanie sztucznej inteligencji w procesach obrazowania medycznego. Przed dołączeniem do firmy NVIDIA w 2018 roku jako członek-założyciel Clara, Ming spędził 15 lat na rozwijaniu Radiology PACS i Workflow SaaS jako główny inżynier/architekt w firmie Stentor Inc., przejętej później przez firmę Philips Healthcare w celu utworzenia działu Enterprise Imaging.

Ming (Melvin) Qin jest niezależnym współpracownikiem zespołu Healthcare w firmie NVIDIA, skupiającym się na opracowywaniu platformy i platformy aplikacji do wnioskowania opartej na sztucznej inteligencji, umożliwiającej wykorzystanie sztucznej inteligencji w procesach obrazowania medycznego. Przed dołączeniem do firmy NVIDIA w 2018 roku jako członek-założyciel Clara, Ming spędził 15 lat na rozwijaniu Radiology PACS i Workflow SaaS jako główny inżynier/architekt w firmie Stentor Inc., przejętej później przez firmę Philips Healthcare w celu utworzenia działu Enterprise Imaging.

Davida Bericata jest menedżerem produktu ds. opieki zdrowotnej w firmie NVIDIA, gdzie kieruje grupą roboczą projektu MONAI Deploy, której zadaniem jest wprowadzenie sztucznej inteligencji z badań do wdrożeń klinicznych. Jego pasją jest przyspieszanie innowacji w dziedzinie zdrowia na całym świecie, przekładając je na rzeczywisty wpływ kliniczny. Wcześniej David pracował w firmie Red Hat, wdrażając zasady open source na styku sztucznej inteligencji, chmury, przetwarzania brzegowego i IoT. Do jego najwspanialszych chwil zalicza się wędrówka do bazy pod Everestem i gra w piłkę nożną przez ponad 20 lat.

Davida Bericata jest menedżerem produktu ds. opieki zdrowotnej w firmie NVIDIA, gdzie kieruje grupą roboczą projektu MONAI Deploy, której zadaniem jest wprowadzenie sztucznej inteligencji z badań do wdrożeń klinicznych. Jego pasją jest przyspieszanie innowacji w dziedzinie zdrowia na całym świecie, przekładając je na rzeczywisty wpływ kliniczny. Wcześniej David pracował w firmie Red Hat, wdrażając zasady open source na styku sztucznej inteligencji, chmury, przetwarzania brzegowego i IoT. Do jego najwspanialszych chwil zalicza się wędrówka do bazy pod Everestem i gra w piłkę nożną przez ponad 20 lat.

Brada Genereaux jest globalnym liderem działu Healthcare Alliances w firmie NVIDIA, gdzie odpowiada za relacje z programistami, ze szczególnym uwzględnieniem obrazowania medycznego w celu przyspieszenia sztucznej inteligencji oraz rozwiązań głębokiego uczenia się, wizualizacji, wirtualizacji i analizy. Dzięki ponad 20-letniemu doświadczeniu w IT w służbie zdrowia Brad propaguje wszechobecne przyjęcie i integrację płynnych przepływów pracy w opiece zdrowotnej i obrazowaniu medycznym z codzienną praktyką kliniczną.

Brada Genereaux jest globalnym liderem działu Healthcare Alliances w firmie NVIDIA, gdzie odpowiada za relacje z programistami, ze szczególnym uwzględnieniem obrazowania medycznego w celu przyspieszenia sztucznej inteligencji oraz rozwiązań głębokiego uczenia się, wizualizacji, wirtualizacji i analizy. Dzięki ponad 20-letniemu doświadczeniu w IT w służbie zdrowia Brad propaguje wszechobecne przyjęcie i integrację płynnych przepływów pracy w opiece zdrowotnej i obrazowaniu medycznym z codzienną praktyką kliniczną.

gang fu jest architektem rozwiązań dla opieki zdrowotnej w AWS. Uzyskał tytuł doktora nauk farmaceutycznych na Uniwersytecie Mississippi i ma ponad 10-letnie doświadczenie w dziedzinie technologii i badań biomedycznych. Pasjonuje się technologią i jej wpływem na opiekę zdrowotną.

gang fu jest architektem rozwiązań dla opieki zdrowotnej w AWS. Uzyskał tytuł doktora nauk farmaceutycznych na Uniwersytecie Mississippi i ma ponad 10-letnie doświadczenie w dziedzinie technologii i badań biomedycznych. Pasjonuje się technologią i jej wpływem na opiekę zdrowotną.

JP Legera jest starszym architektem rozwiązań wspierającym akademickie centra medyczne i przepływ pracy w zakresie obrazowania medycznego w AWS. Ma ponad 20-letnie doświadczenie w inżynierii oprogramowania, IT w służbie zdrowia i obrazowaniu medycznym, a także bogate doświadczenie w projektowaniu systemów pod kątem wydajności, skalowalności i bezpieczeństwa w rozproszonych wdrożeniach dużych ilości danych lokalnie, w chmurze oraz hybrydowo z analityką i sztuczną inteligencją .

JP Legera jest starszym architektem rozwiązań wspierającym akademickie centra medyczne i przepływ pracy w zakresie obrazowania medycznego w AWS. Ma ponad 20-letnie doświadczenie w inżynierii oprogramowania, IT w służbie zdrowia i obrazowaniu medycznym, a także bogate doświadczenie w projektowaniu systemów pod kątem wydajności, skalowalności i bezpieczeństwa w rozproszonych wdrożeniach dużych ilości danych lokalnie, w chmurze oraz hybrydowo z analityką i sztuczną inteligencją .

Chrisa Hafeya jest głównym architektem rozwiązań w Amazon Web Services. Posiada ponad 25-letnie doświadczenie w branży obrazowania medycznego i specjalizuje się w budowaniu skalowalnych systemów o wysokiej wydajności. Jest twórcą popularnego projektu open source CornerstoneJS, który napędza popularną przeglądarkę OHIF o otwartym kodzie źródłowym o zerowym zasięgu. Brał udział w tworzeniu specyfikacji DICOMweb i nadal pracuje nad poprawą jej wydajności do przeglądania w Internecie.

Chrisa Hafeya jest głównym architektem rozwiązań w Amazon Web Services. Posiada ponad 25-letnie doświadczenie w branży obrazowania medycznego i specjalizuje się w budowaniu skalowalnych systemów o wysokiej wydajności. Jest twórcą popularnego projektu open source CornerstoneJS, który napędza popularną przeglądarkę OHIF o otwartym kodzie źródłowym o zerowym zasięgu. Brał udział w tworzeniu specyfikacji DICOMweb i nadal pracuje nad poprawą jej wydajności do przeglądania w Internecie.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-a-medical-imaging-ai-inference-pipeline-with-monai-deploy-on-aws/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 12

- 15 roku

- 15%

- 20

- 20 roku

- 200

- 2018

- 25

- 3d

- 7

- 8

- a

- O nas

- akademicki

- przyśpieszyć

- przyspieszenie

- dostęp

- dostępny

- Konto

- nabyty

- w poprzek

- Dodaj

- Dodatkowy

- Przyjęcie

- Korzyść

- przystępne

- AI

- Modele AI

- Alarmy

- Algorytmy

- Wszystkie kategorie

- Sojusze

- dopuszczać

- również

- Amazonka

- Amazon Web Services

- an

- analityka

- i

- api

- Dostęp do API

- Pszczoła

- Aplikacja

- Zastosowanie

- aplikacje

- architektura

- SĄ

- sztuczny

- sztuczna inteligencja

- AS

- At

- atrybuty

- automatycznie

- dostępny

- AWS

- baza

- na podstawie

- BE

- zanim

- za

- biomedyczny

- ciało

- obie

- ćwiek

- przełomy

- przynieść

- budować

- Budowanie

- wybudowany

- wbudowany

- by

- wezwanie

- Obóz

- CAN

- który

- Etui

- Centrum

- Centra

- Clara

- klasa

- Kliniczne

- Chmura

- kod

- jak

- kompletny

- zawiera

- computing

- systemu

- Łączność

- Konsola

- konsorcjum

- skontaktuj się

- Pojemnik

- zawiera

- treść

- kontekst

- ciągły

- przyczyniły

- współpracownik

- Koszty:

- oszczędności

- opłacalne

- Koszty:

- pokrywa

- współautorem

- Stwórz

- stworzony

- twórca

- dostosowane

- dane

- Centrum danych

- David

- głęboko

- głęboka nauka

- wykazać

- wykazać

- rozwijać

- wdrażanie

- Wdrożenie

- wdrożenia

- dev

- rozwinięty

- Deweloper

- deweloperzy

- rozwijanie

- różne

- dystrybuowane

- do

- Doker

- dokument

- na dół

- Wcześniej

- krawędź

- przetwarzanie krawędziowe

- wydajny

- bądź

- więcej

- Umożliwia

- koniec końców

- Punkt końcowy

- Inżynieria

- Enterprise

- środowiska

- Równoważny

- Everest

- Każdy

- codzienny

- przykład

- Z wyjątkiem

- Przede wszystkim system został opracowany

- doświadczenie

- ekspertyza

- odkryj

- rozległy

- Szerokie doświadczenie

- niezwykle

- fałszywy

- FAST

- filet

- Akta

- W końcu

- i terminów, a

- FLOTA

- Skupiać

- koncentruje

- obserwuj

- następujący

- następujący sposób

- Ślad stopy

- W razie zamówieenia projektu

- Nasz formularz

- format

- znaleziono

- założenie

- Framework

- od

- fu

- w pełni

- funkcjonować

- funkcjonalności

- Funkcje

- GitHub

- dany

- Globalne

- Globalnie

- GPU

- Zarządzanie

- kapelusz

- Have

- mający

- he

- headers

- Zdrowie

- opieki zdrowotnej

- tutaj

- wysoka wydajność

- wysoko

- jego

- posiada

- szpital

- gospodarz

- hostowane

- Hosting

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- Hybrydowy

- ID

- idealny

- tożsamość

- if

- ilustruje

- obraz

- zdjęcia

- Obrazowanie

- Rezultat

- realizowane

- wykonawczych

- importować

- import

- poprawy

- in

- Inc

- zawierać

- włączony

- obejmuje

- Włącznie z

- niezależny

- przemysł

- Innowacja

- wkład

- Wejścia

- zainstalować

- przykład

- zamiast

- integrować

- integracja

- Inteligencja

- interaktywne

- skrzyżowanie

- najnowszych

- Internet przedmiotów

- Irlandia

- IT

- JEGO

- Praca

- łączący

- jpg

- json

- Klawisz

- Wiedzieć

- duży

- Utajenie

- później

- prowadzić

- Przywódcy

- Wyprowadzenia

- UCZYĆ SIĘ

- nauka

- Linia

- załadować

- ładowarka

- załadunek

- miejscowy

- długo

- maszyna

- uczenie maszynowe

- Większość

- robić

- zarządzane

- kierownik

- zarządzający

- mapa

- Mapy

- medyczny

- Poznaj nasz

- członek

- Metadane

- Metryka

- minut

- ML

- Moda

- model

- modele

- Moduły

- Chwile

- monitor

- jeszcze

- Wielomodelowy punkt końcowy

- wielokrotność

- rodzimy

- Potrzebować

- sieć

- sieci

- Nowości

- Nie

- żaden

- Północ

- notatnik

- godny uwagi

- Nvidia

- przedmiot

- of

- Oferty

- on

- ONE

- tylko

- koncepcja

- otwarta sieć

- open source

- operacje

- operator

- operatorzy

- zoptymalizowane

- Option

- Opcje

- or

- Oregon

- OS

- Inne

- wydajność

- koniec

- własny

- pakiet

- Pakiety

- opakowania

- đôi

- Parallel

- pasja

- namiętny

- ścieżka

- wzory

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- pozwolenie

- Przemysł farmaceutyczny

- PhD

- rurociąg

- piksel

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- gra

- plus

- Popularny

- Post

- powered

- uprawnienia

- praktyka

- Przewidywania

- przygotowany

- poprzedni

- poprzednio

- Główny

- Zasady

- wygląda tak

- Obrobiony

- procesów

- przetwarzanie

- Produkt

- product manager

- Produkcja

- projekt

- niska zabudowa

- zapewnia

- popychany

- Python

- płomień

- w czasie rzeczywistym

- Rzeczywistość

- otrzymać

- Czerwony

- Red Hat

- zmniejszyć

- odnosić się

- region

- regiony

- relacje

- reprezentacja

- zażądać

- wywołań

- wymagania

- Wymaga

- Badania naukowe

- Badacze

- Zasoby

- odpowiedź

- odpowiedzialny

- powrót

- wielokrotnego użytku

- run

- bieganie

- s

- SaaS

- sagemaker

- Wnioskowanie SageMakera

- taki sam

- Zapisz

- Oszczędności

- Skalowalność

- skalowalny

- Skala

- skalowaniem

- nauka

- Sdk

- bezszwowy

- Sekcja

- bezpieczeństwo

- segmentacja

- wybór

- SAMEGO SIEBIE

- senior

- Serie

- służył

- usługa

- Usługi

- Zestawy

- ustawienie

- kilka

- kształty

- shared

- powinien

- pokazał

- pokazane

- Prosty

- rozmiary

- płynnie

- Piłka nożna

- Tworzenie

- Inżynieria oprogramowania

- rozwiązanie

- Rozwiązania

- Źródło

- specjalizuje się

- specyfikacja

- spędził

- standardy

- Ewolucja krok po kroku

- Cel

- przechowywanie

- sklep

- przechowywany

- sznur

- taki

- wsparcie

- Wspierający

- sydney

- systemy

- trwa

- zespół

- Technologia

- Testowanie

- niż

- że

- Połączenia

- ich

- Im

- następnie

- Tam.

- Te

- to

- Przez

- czasy

- do

- razem

- narzędzia

- w kierunku

- ruch drogowy

- Tryton

- prawdziwy

- próbować

- SKRĘCAĆ

- drugiej

- wszechobecny

- uniwersytet

- Aktualizacja

- posługiwać się

- używany

- Użytkownik

- zastosowania

- za pomocą

- użyteczność

- różnorodność

- Wersje

- wejść

- virginia

- wizja

- wyobrażanie sobie

- wyobrażać sobie

- kłęby

- W

- spacer

- chcieć

- we

- sieć

- usługi internetowe

- Web-based

- DOBRZE

- Co

- jeśli chodzi o komunikację i motywację

- który

- będzie

- w

- w ciągu

- bez

- Praca

- pracował

- workflow

- przepływów pracy

- pracujący

- Grupa robocza

- lat

- You

- Twój

- zefirnet

- zero