Zalążki zmiany paradygmatu uczenia maszynowego (ML) istnieją od dziesięcioleci, ale dzięki łatwej dostępności praktycznie nieskończonej mocy obliczeniowej, ogromnemu rozprzestrzenianiu się danych i szybkiemu rozwojowi technologii uczenia maszynowego klienci z różnych branż szybko przyjmują i używają uczenia maszynowego technologii, aby zmienić ich biznes.

Niedawno generatywne aplikacje sztucznej inteligencji przykuły uwagę i wyobraźnię wszystkich. Jesteśmy naprawdę w ekscytującym punkcie zwrotnym w powszechnym wdrażaniu ML i wierzymy, że każde doświadczenie klienta i aplikacja zostaną odkryte na nowo dzięki generatywnej sztucznej inteligencji.

Generatywna sztuczna inteligencja to rodzaj sztucznej inteligencji, który może tworzyć nowe treści i pomysły, w tym rozmowy, historie, obrazy, filmy i muzykę. Jak każda sztuczna inteligencja, generatywna sztuczna inteligencja opiera się na modelach uczenia maszynowego — bardzo dużych modelach, które są wstępnie szkolone na ogromnych korpusach danych i są powszechnie określane jako modele podstawowe (FM).

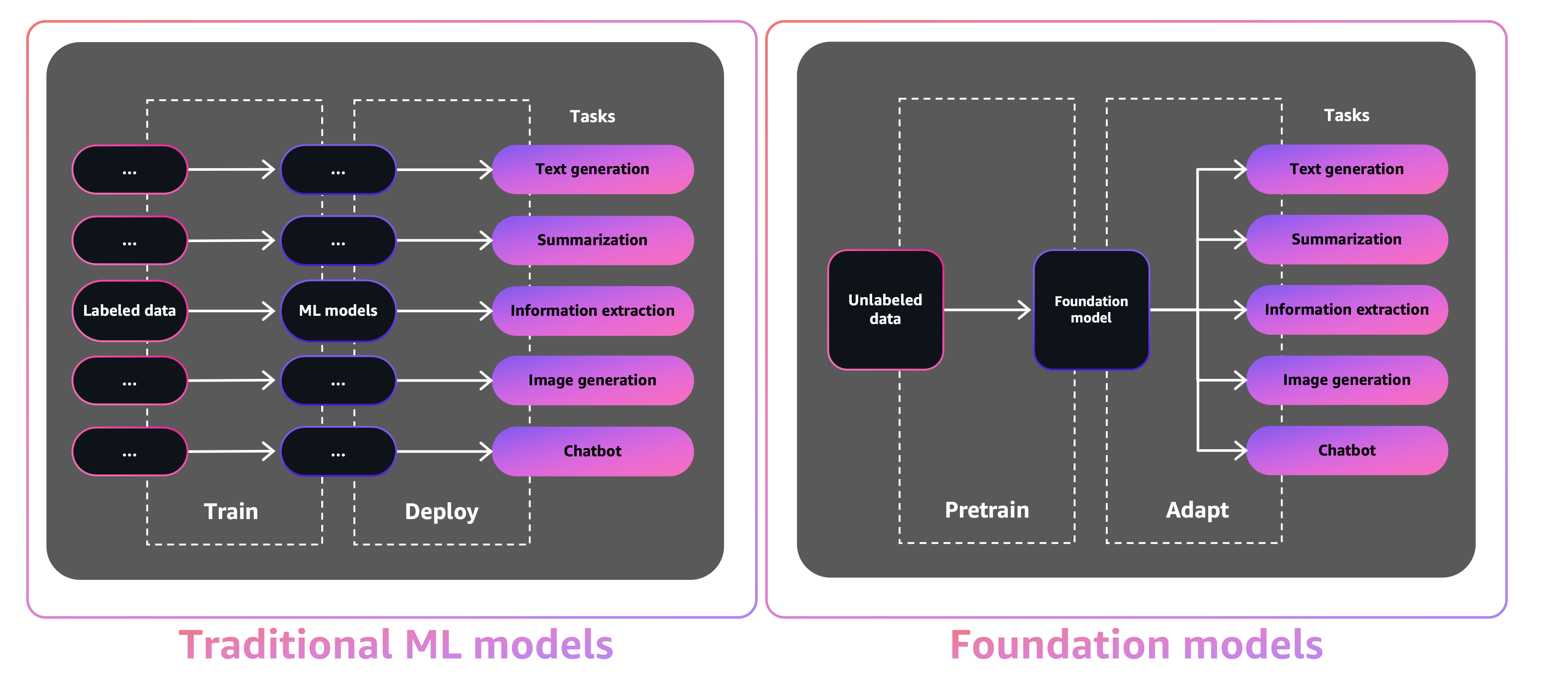

Rozmiar i uniwersalny charakter FM odróżniają je od tradycyjnych modeli ML, które zazwyczaj wykonują określone zadania, takie jak analiza tekstu pod kątem nastrojów, klasyfikowanie obrazów i prognozowanie trendów.

W przypadku tradycyjnych modeli ML, aby osiągnąć każde określone zadanie, należy zebrać oznaczone dane, wyszkolić model i wdrożyć ten model. Dzięki modelom podstawowym zamiast zbierać dane z etykietami dla każdego modelu i trenować wiele modeli, możesz użyć tego samego wstępnie wytrenowanego FM do dostosowania różnych zadań. Możesz także dostosować FM do wykonywania funkcji specyficznych dla domeny, które różnią się od Twojej firmy, przy użyciu tylko niewielkiej części danych i mocy obliczeniowej wymaganych do wytrenowania modelu od podstaw.

Generatywna sztuczna inteligencja może zrewolucjonizować wiele branż, rewolucjonizując sposób tworzenia i konsumowania treści. Produkcja oryginalnych treści, generowanie kodu, poprawa obsługi klienta i podsumowanie dokumentów to typowe przypadki użycia generatywnej sztucznej inteligencji.

Amazon SageMaker JumpStart zapewnia wstępnie wytrenowane modele typu open source dla szerokiego zakresu typów problemów, które pomogą Ci rozpocząć pracę z uczeniem maszynowym. Te modele można stopniowo trenować i dostrajać przed wdrożeniem. JumpStart zapewnia również szablony rozwiązań, które konfigurują infrastrukturę dla typowych przypadków użycia, oraz wykonywalne przykładowe notatniki dla ML z Amazon Sage Maker.

Z ponad 600 wstępnie wyszkolonymi modelami dostępnymi i rosnącymi każdego dnia, JumpStart umożliwia programistom szybkie i łatwe włączanie najnowocześniejszych technik uczenia maszynowego do przepływów pracy produkcyjnej. Możesz uzyskać dostęp do wstępnie wytrenowanych modeli, szablonów rozwiązań i przykładów za pośrednictwem strony docelowej JumpStart w Studio Amazon SageMaker. Możesz także uzyskać dostęp do modeli JumpStart za pomocą SageMaker Python SDK. Aby uzyskać informacje o programowym korzystaniu z modeli JumpStart, zobacz Używaj algorytmów SageMaker JumpStart z wstępnie wytrenowanymi modelami.

W kwietniu 2023 r. odsłonięto AWS Amazońska skała macierzysta, która umożliwia tworzenie generatywnych aplikacji opartych na sztucznej inteligencji za pomocą wstępnie wyszkolonych modeli od startupów, w tym Laboratoria AI21, Antropiczny, Stabilność AI. Amazon Bedrock oferuje również dostęp do modeli fundamentów Titan, rodziny modeli wyszkolonych wewnętrznie przez AWS. Dzięki bezserwerowemu doświadczeniu Amazon Bedrock możesz łatwo znaleźć odpowiedni model do swoich potrzeb, szybko rozpocząć pracę, prywatnie dostosowywać FM z własnymi danymi oraz łatwo integrować i wdrażać je w swoich aplikacjach za pomocą narzędzi i możliwości AWS, które znasz z (w tym integracje z funkcjami SageMaker ML, takimi jak Eksperymenty Amazon SageMaker przetestować różne modele i Rurociągi Amazon SageMaker do zarządzania FM na dużą skalę) bez konieczności zarządzania jakąkolwiek infrastrukturą.

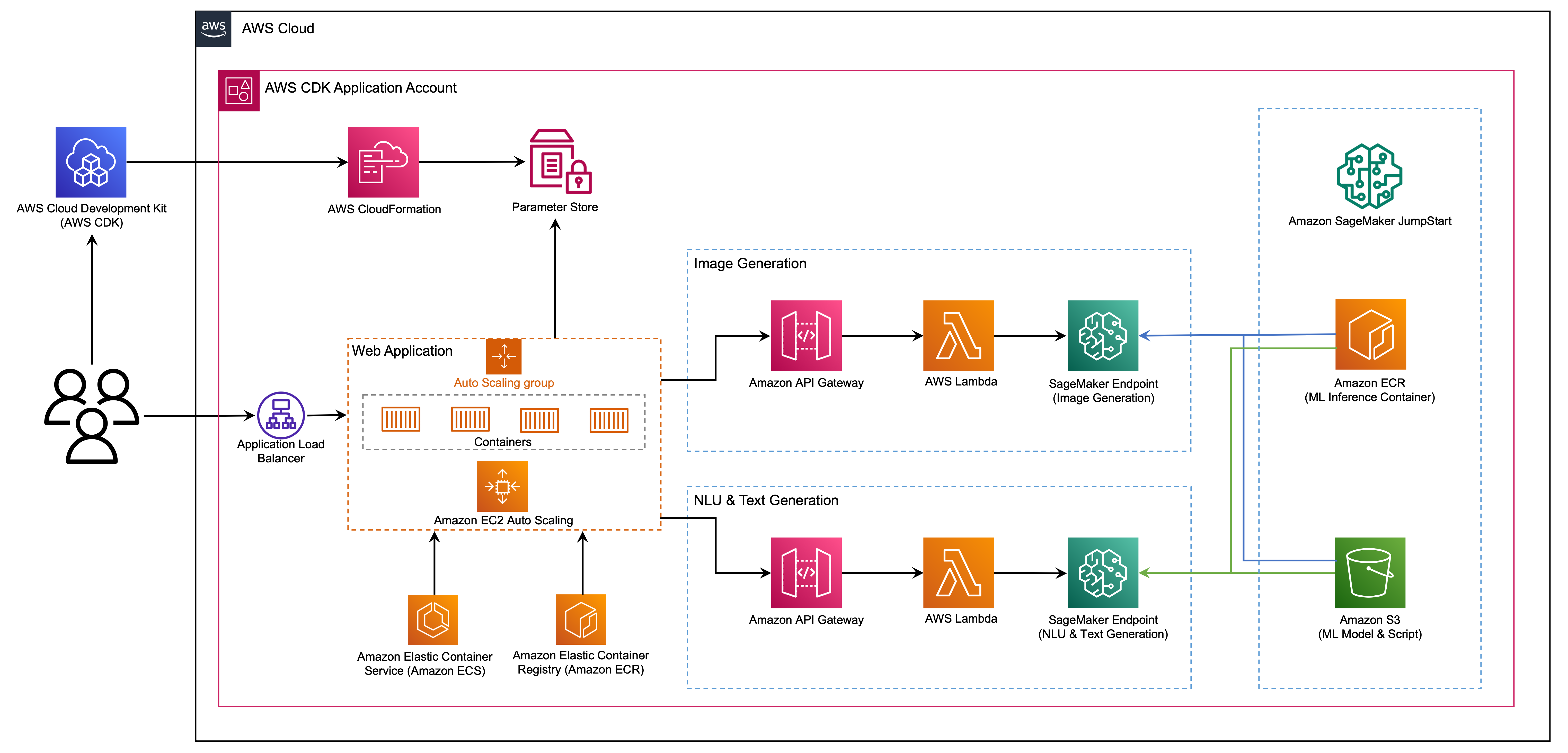

W tym poście pokazujemy, jak wdrażać modele sztucznej inteligencji do generowania obrazów i tekstu z usługi JumpStart przy użyciu Zestaw programistyczny AWS Cloud (CDK AWS). AWS CDK to platforma programistyczna typu open source do definiowania zasobów aplikacji w chmurze przy użyciu znanych języków programowania, takich jak Python.

Do generowania obrazu używamy modelu stabilnej dyfuzji, a do generowania modelu FLAN-T5-XL rozumienie języka naturalnego (NLU) i generowanie tekstu z Przytulanie Twarzy w JumpStarcie.

Omówienie rozwiązania

Aplikacja internetowa jest zbudowana na Strumieniowe, biblioteka języka Python typu open source, która ułatwia tworzenie i udostępnianie pięknych, niestandardowych aplikacji internetowych do uczenia maszynowego i nauki o danych. Hostujemy aplikację internetową za pomocą Usługa Amazon Elastic Container Service (Amazon ECS) z AWS-Fargate i jest dostępny za pośrednictwem modułu równoważenia obciążenia aplikacji. Fargate to technologia, której można używać z Amazon ECS do uruchamiania Pojemniki bez konieczności zarządzania serwerami, klastrami lub maszynami wirtualnymi. Punkty końcowe generatywnego modelu AI są uruchamiane z obrazów JumpStart w Rejestr elastycznego pojemnika Amazon (Amazon ECR). Dane modelu są przechowywane na Usługa Amazon Simple Storage (Amazon S3) na koncie JumpStart. Aplikacja internetowa współpracuje z modelami za pośrednictwem Brama Amazon API i AWS Lambda funkcje, jak pokazano na poniższym schemacie.

API Gateway zapewnia aplikacji internetowej i innym klientom standardowy interfejs RESTful, jednocześnie osłaniając funkcje Lambda, które współpracują z modelem. Upraszcza to kod aplikacji klienckiej, który zużywa modele. W tym przykładzie punkty końcowe API Gateway są publicznie dostępne, co pozwala na rozszerzenie tej architektury w celu wdrożenia różnych Kontrola dostępu do API i integrować z innymi aplikacjami.

W tym poście przeprowadzimy Cię przez następujące kroki:

- Instalacja Interfejs wiersza poleceń AWS (AWS CLI) i AWS CDK v2 na twojej lokalnej maszynie.

- Sklonuj i skonfiguruj aplikację AWS CDK.

- Wdróż aplikację AWS CDK.

- Użyj modelu AI do generowania obrazu.

- Użyj modelu AI do generowania tekstu.

- Wyświetl wdrożone zasoby na Konsola zarządzania AWS.

Omówienie kodu w tym projekcie przedstawiamy w załączniku na końcu tego wpisu.

Wymagania wstępne

Musisz mieć następujące wymagania wstępne:

Możesz wdrożyć infrastrukturę w tym samouczku z komputera lokalnego lub użyć Chmura AWS9 jako wdrożeniowa stacja robocza. AWS Cloud9 jest fabrycznie wyposażony w AWS CLI, AWS CDK i Docker. Jeśli zdecydujesz się na AWS Cloud9, stworzyć środowisko z Konsola AWS.

Szacunkowy koszt ukończenia tego posta to 50 USD, przy założeniu, że zasoby pozostaną uruchomione przez 8 godzin. Upewnij się, że usunąłeś zasoby utworzone w tym poście, aby uniknąć bieżących opłat.

Zainstaluj AWS CLI i AWS CDK na komputerze lokalnym

Jeśli nie masz jeszcze interfejsu AWS CLI na komputerze lokalnym, zobacz Instalowanie lub aktualizowanie najnowszej wersji AWS CLI i Konfigurowanie interfejsu wiersza polecenia AWS.

Zainstaluj globalnie zestaw narzędzi AWS CDK Toolkit, używając następującego polecenia menedżera pakietów węzłów:

Uruchom następujące polecenie, aby zweryfikować poprawność instalacji i wydrukować numer wersji AWS CDK:

Upewnij się, że masz zainstalowanego Dockera na komputerze lokalnym. Wydaj następującą komendę, aby zweryfikować wersję:

Sklonuj i skonfiguruj aplikację AWS CDK

Na komputerze lokalnym sklonuj aplikację AWS CDK za pomocą następującego polecenia:

Przejdź do folderu projektu:

Zanim wdrożymy aplikację, przejrzyjmy strukturę katalogów:

Połączenia stack folder zawiera kod dla każdego stosu w aplikacji AWS CDK. The code folder zawiera kod funkcji Lambda. Repozytorium zawiera również aplikację internetową znajdującą się w folderze web-app.

Połączenia cdk.json informuje zestaw narzędzi AWS CDK Toolkit, jak uruchomić aplikację.

Ta aplikacja została przetestowana w us-east-1 Region, ale powinien działać w każdym regionie, który ma wymagane usługi i typ wystąpienia wnioskowania ml.g4dn.4xlarge określone w app.py.

Skonfiguruj środowisko wirtualne

Ten projekt jest skonfigurowany jak standardowy projekt Pythona. Utwórz środowisko wirtualne Pythona, używając następującego kodu:

Użyj następującego polecenia, aby aktywować środowisko wirtualne:

Jeśli korzystasz z platformy Windows, aktywuj środowisko wirtualne w następujący sposób:

Po aktywacji środowiska wirtualnego zaktualizuj pip do najnowszej wersji:

Zainstaluj wymagane zależności:

Przed wdrożeniem jakiejkolwiek aplikacji AWS CDK należy zainicjować przestrzeń na swoim koncie i regionie, w którym wdrażasz. Aby załadować w domyślnym regionie, wydaj następujące polecenie:

Jeśli chcesz przeprowadzić wdrożenie na określonym koncie i regionie, wydaj następujące polecenie:

Aby uzyskać więcej informacji na temat tej konfiguracji, odwiedź stronę Pierwsze kroki z AWS CDK.

Struktura stosu aplikacji AWS CDK

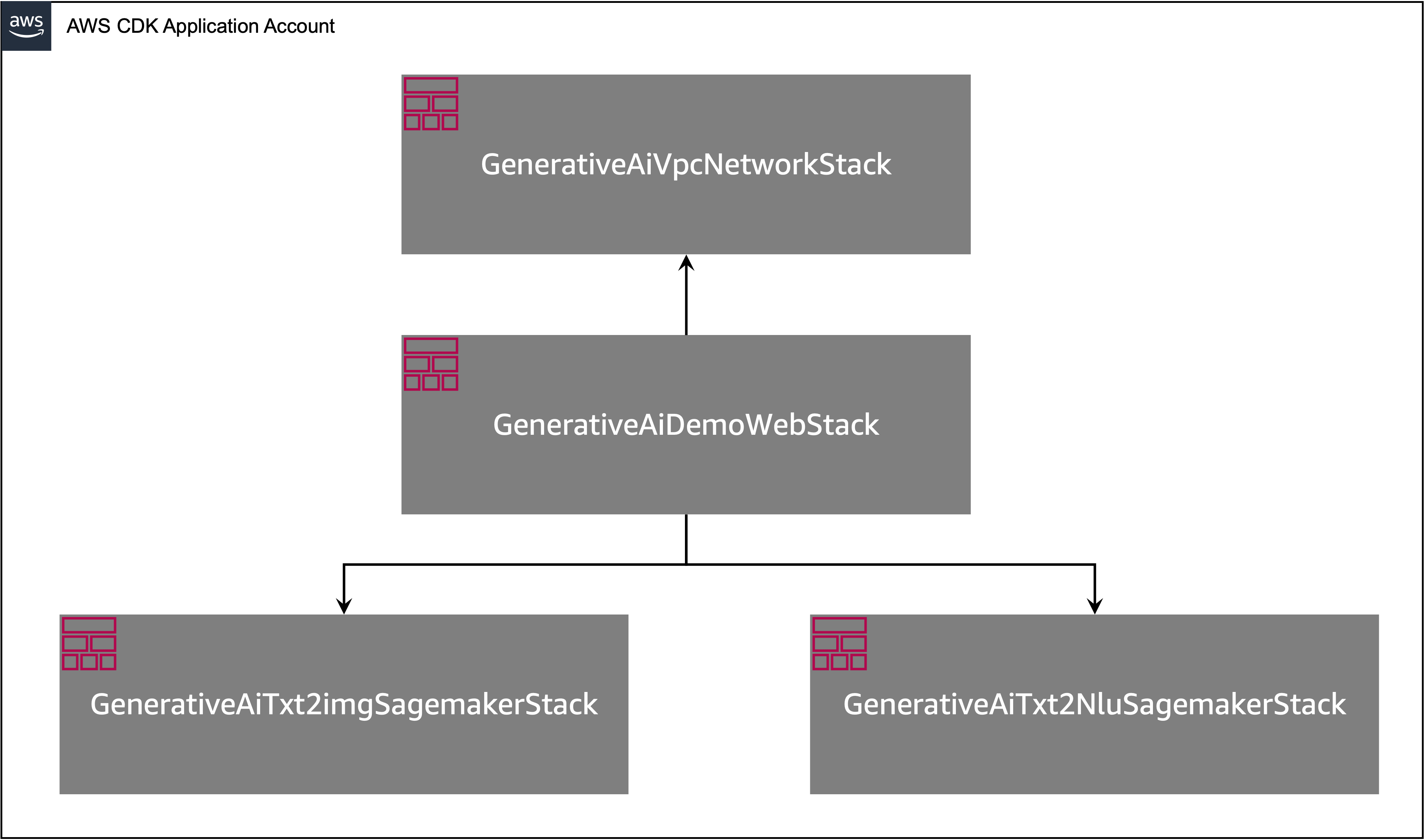

Aplikacja AWS CDK zawiera wiele stosów, jak pokazano na poniższym diagramie.

Możesz wyświetlić listę stosów w swojej aplikacji AWS CDK za pomocą następującego polecenia:

Poniżej przedstawiono inne przydatne polecenia AWS CDK:

- cdk ls – Wyświetla listę wszystkich stosów w aplikacji

- syntezator cdk – Emituje syntezę Tworzenie chmury AWS szablon

- wdrożenie cdk – Wdraża ten stos na Twoim domyślnym koncie AWS i regionie

- cdk różnica – Porównuje wdrożony stos z bieżącym stanem

- dokumenty cdk – Otwiera dokumentację AWS CDK

W następnej sekcji pokazano, jak wdrożyć aplikację AWS CDK.

Wdróż aplikację AWS CDK

Aplikacja AWS CDK zostanie wdrożona w domyślnym regionie na podstawie konfiguracji stacji roboczej. Jeśli chcesz wymusić wdrożenie w określonym regionie, ustaw swój AWS_DEFAULT_REGION odpowiednio zmienną środowiskową.

W tym momencie możesz wdrożyć aplikację AWS CDK. Najpierw uruchamiasz stos sieciowy VPC:

Jeśli pojawi się monit, wprowadź y aby kontynuować wdrażanie. Powinna zostać wyświetlona lista zasobów AWS, które są udostępniane w stosie. Wykonanie tego kroku zajmuje około 3 minut.

Następnie uruchamiasz stos aplikacji internetowych:

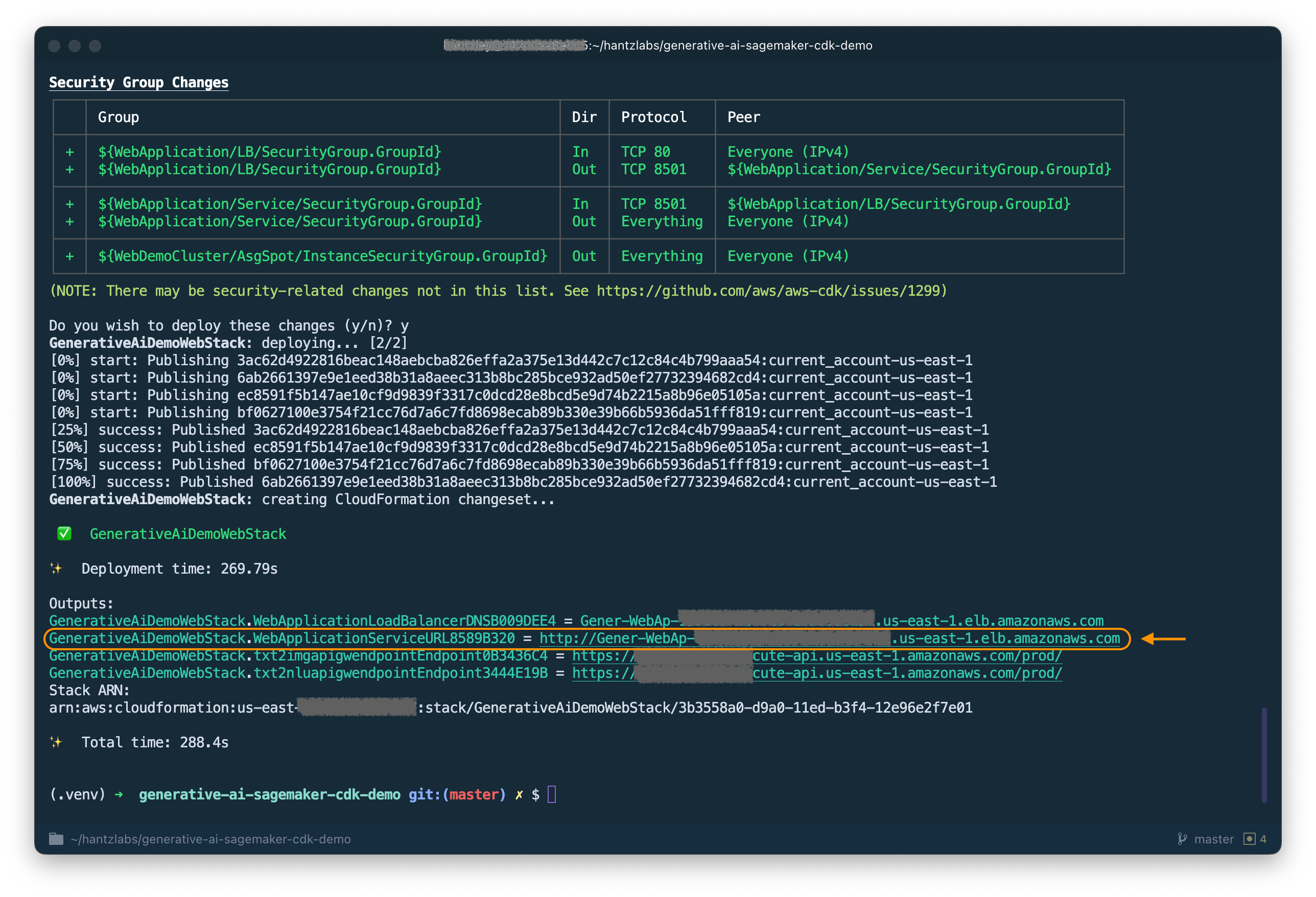

Po przeanalizowaniu stosu AWS CDK wyświetli listę zasobów w stosie. Wpisz y, aby kontynuować wdrażanie. Ten krok zajmuje około 5 minut.

Zanotuj WebApplicationServiceURL z wyjścia do późniejszego wykorzystania. Możesz go również pobrać w konsoli AWS CloudFormation, pod plikiem GenerativeAiDemoWebStack wyjścia stosu.

Teraz uruchom stos punktów końcowych modelu AI do generowania obrazu:

Ten krok zajmuje około 8 minut. Punkt końcowy modelu generowania obrazu został wdrożony, możemy go teraz używać.

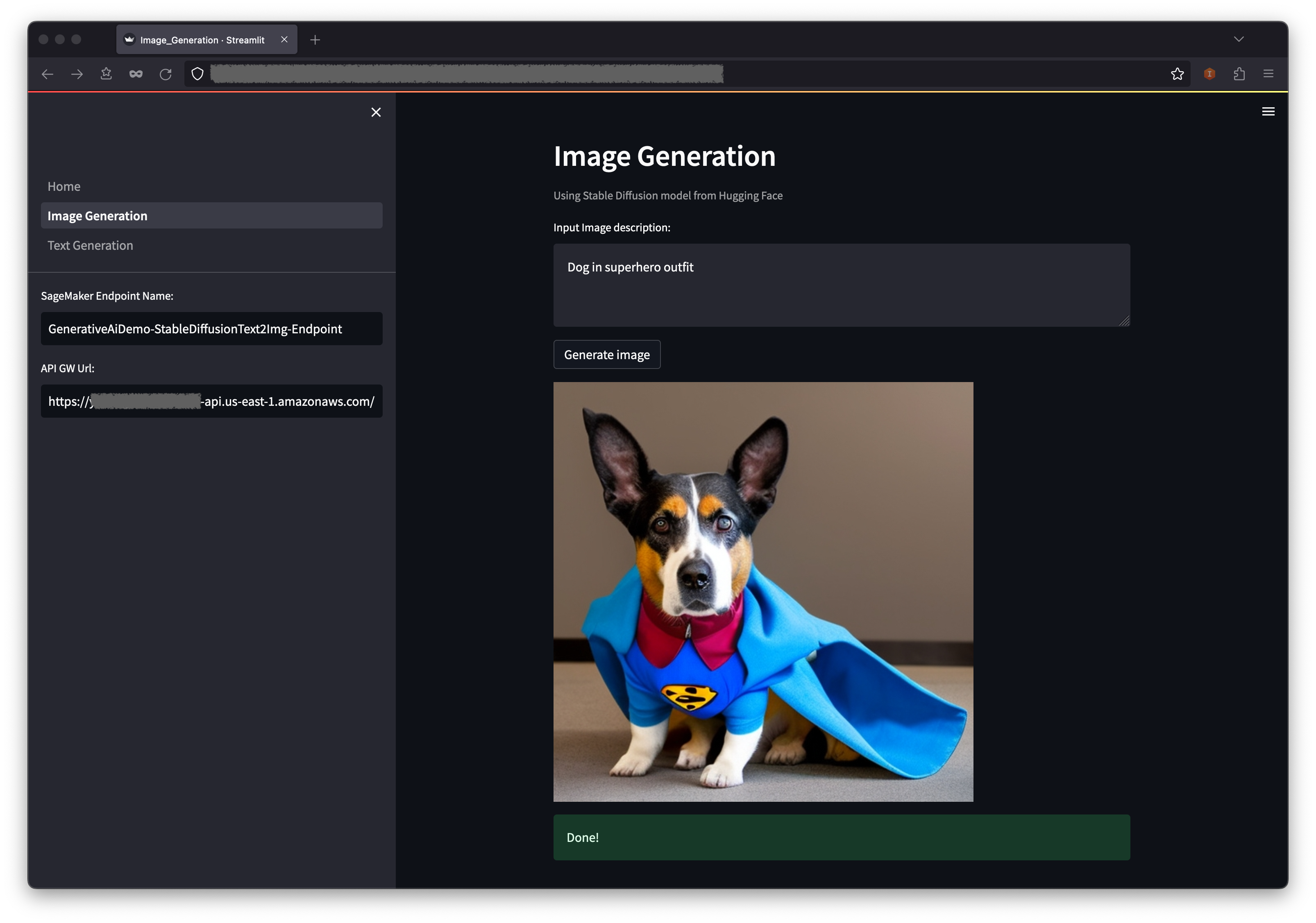

Użyj modelu AI do generowania obrazu

Pierwszy przykład pokazuje, jak wykorzystać stabilną dyfuzję, potężną technikę modelowania generatywnego, która umożliwia tworzenie wysokiej jakości obrazów z monitów tekstowych.

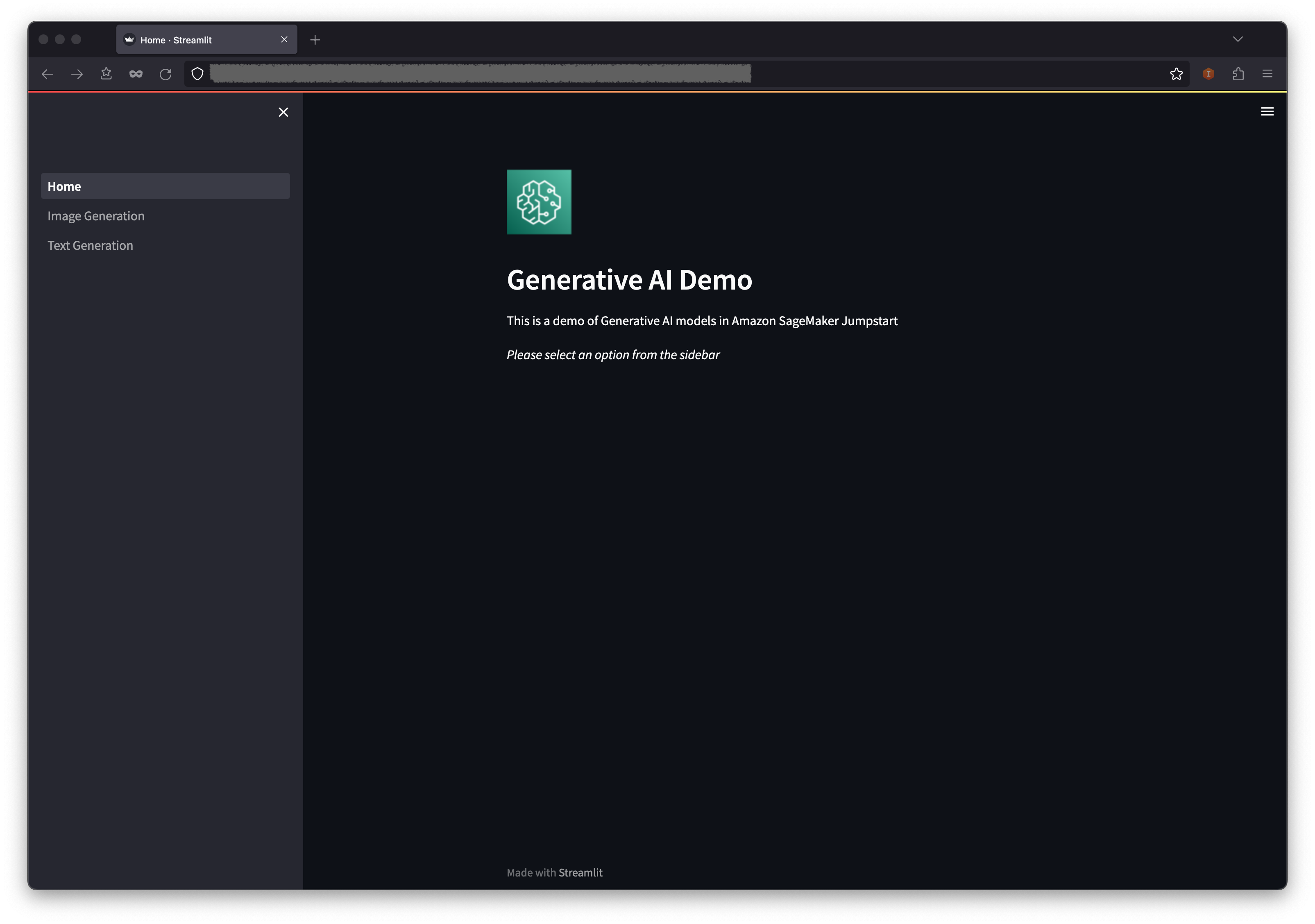

- Uzyskaj dostęp do aplikacji internetowej za pomocą

WebApplicationServiceURLz wyjściaGenerativeAiDemoWebStackw przeglądarce.

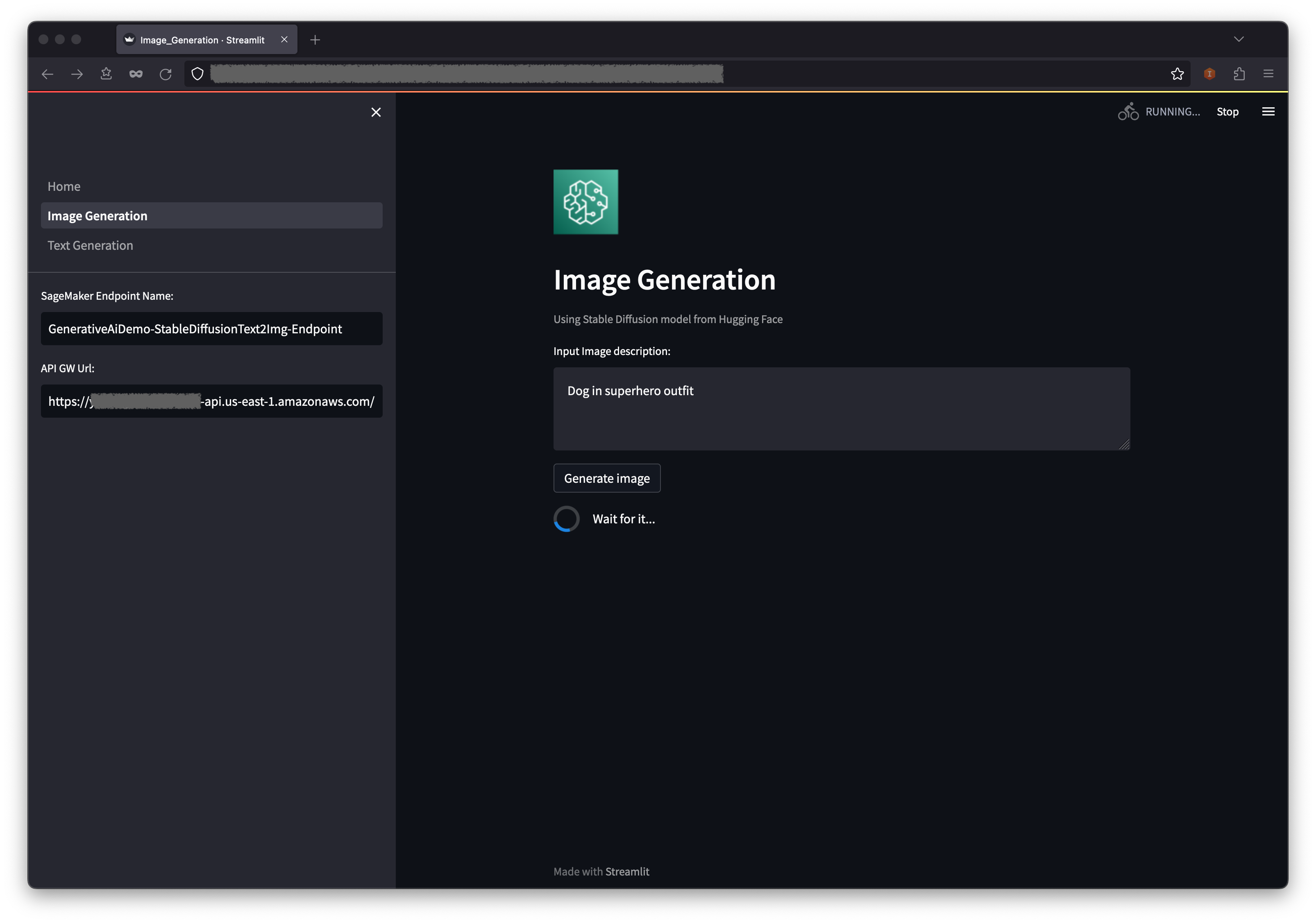

- W okienku nawigacji wybierz Generowanie obrazu.

- Połączenia Nazwa punktu końcowego SageMaker i Adres API GW pola będą wstępnie wypełnione, ale jeśli chcesz, możesz zmienić monit o opis obrazu.

- Dodaj Wygeneruj obraz.

- Aplikacja wykona połączenie z punktem końcowym SageMaker. Zajmuje to kilka sekund. Zostanie wyświetlony obraz z cechami podanymi w opisie obrazu.

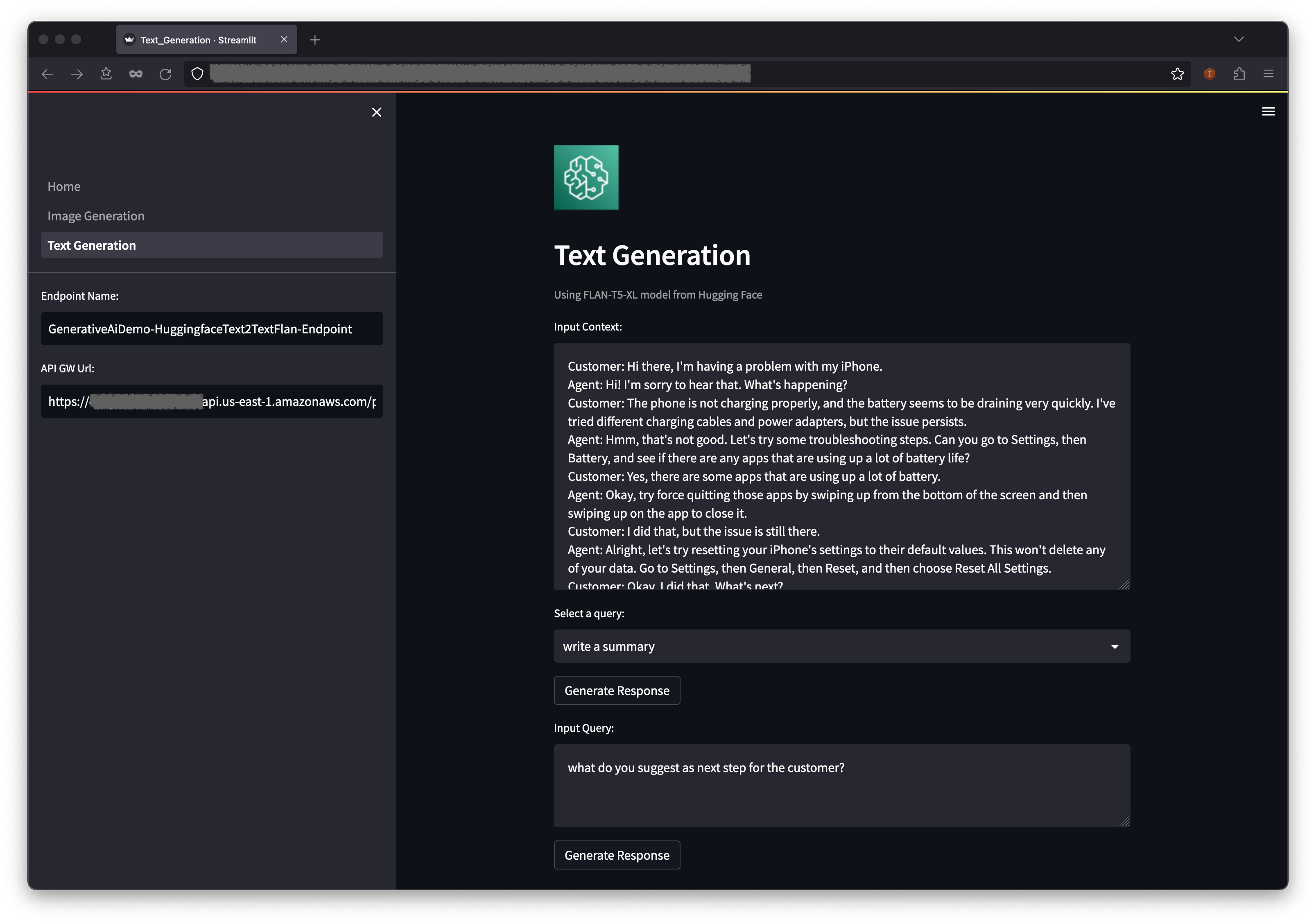

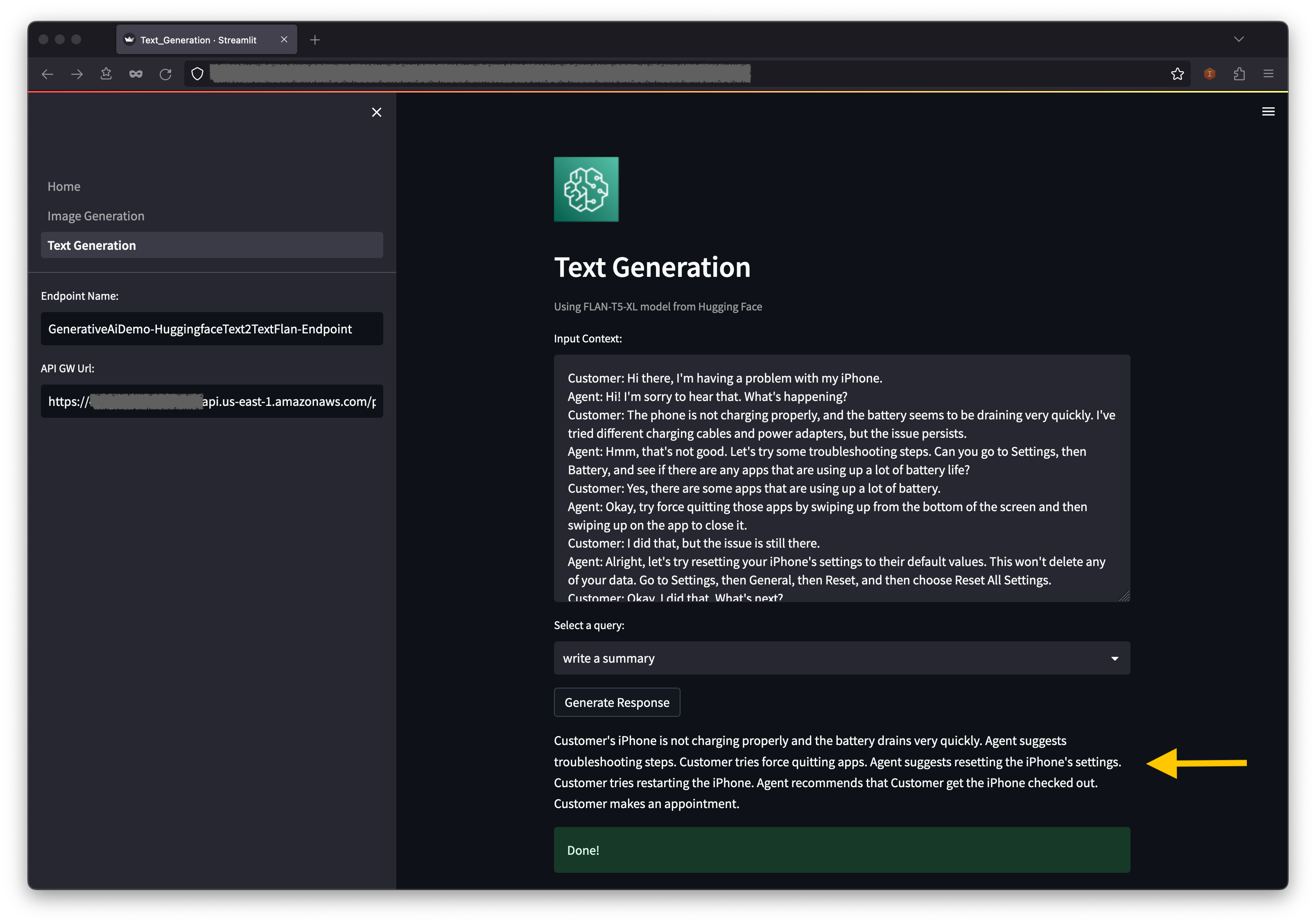

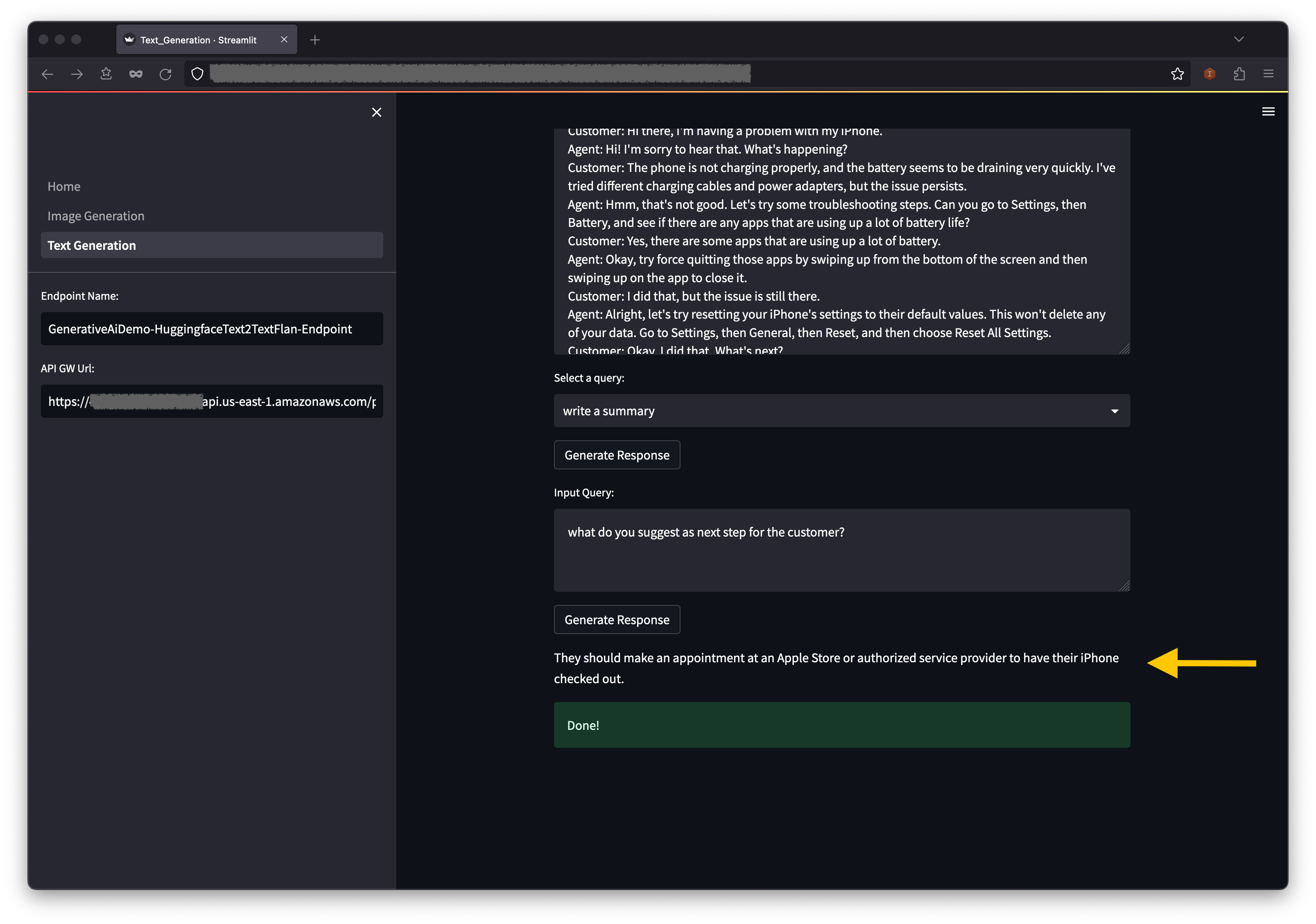

Użyj modelu AI do generowania tekstu

Drugi przykład koncentruje się wokół wykorzystania modelu FLAN-T5-XL, który jest podstawowym lub dużym modelem językowym (LLM), w celu osiągnięcia uczenia się w kontekście w celu generowania tekstu, przy jednoczesnym uwzględnieniu szerokiego zakresu rozumienia języka naturalnego (NLU) i naturalnego zadania generowania języka (NLG).

Niektóre środowiska mogą ograniczać liczbę punktów końcowych, które można uruchomić jednocześnie. W takim przypadku możesz uruchomić jeden punkt końcowy SageMaker na raz. Aby zatrzymać punkt końcowy SageMaker w aplikacji AWS CDK, musisz zniszczyć wdrożony stos punktów końcowych i przed uruchomieniem drugiego stosu punktów końcowych. Aby odrzucić punkt końcowy modelu AI generowania obrazu, wydaj następujące polecenie:

Następnie uruchom stos punktów końcowych modelu AI do generowania tekstu:

Wpisz y w monitach.

Po uruchomieniu stosu punktów końcowych modelu generowania tekstu wykonaj następujące kroki:

- Wróć do aplikacji internetowej i wybierz Generowanie tekstu w okienku nawigacji.

- Połączenia Kontekst wejściowy pole jest wstępnie wypełnione rozmową między klientem a agentem dotyczącą problemu z telefonem klienta, ale jeśli chcesz, możesz wprowadzić własny kontekst.

- Poniżej kontekstu znajdziesz kilka wstępnie wypełnionych zapytań w rozwijanym menu. Wybierz zapytanie i wybierz Wygeneruj odpowiedź.

- Możesz również wprowadzić własne zapytanie w Zapytanie wejściowe pole, a następnie wybierz Wygeneruj odpowiedź.

Wyświetl wdrożone zasoby na konsoli

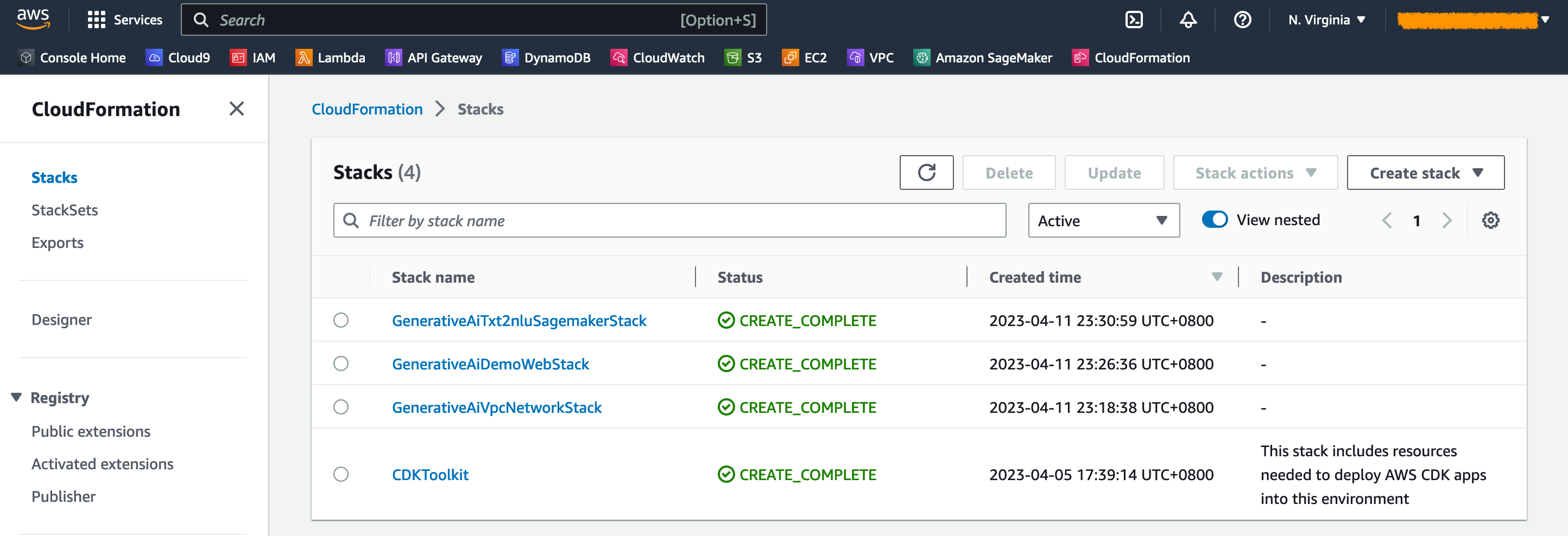

W konsoli AWS CloudFormation wybierz Półki na książki w okienku nawigacji, aby wyświetlić wdrożone stosy.

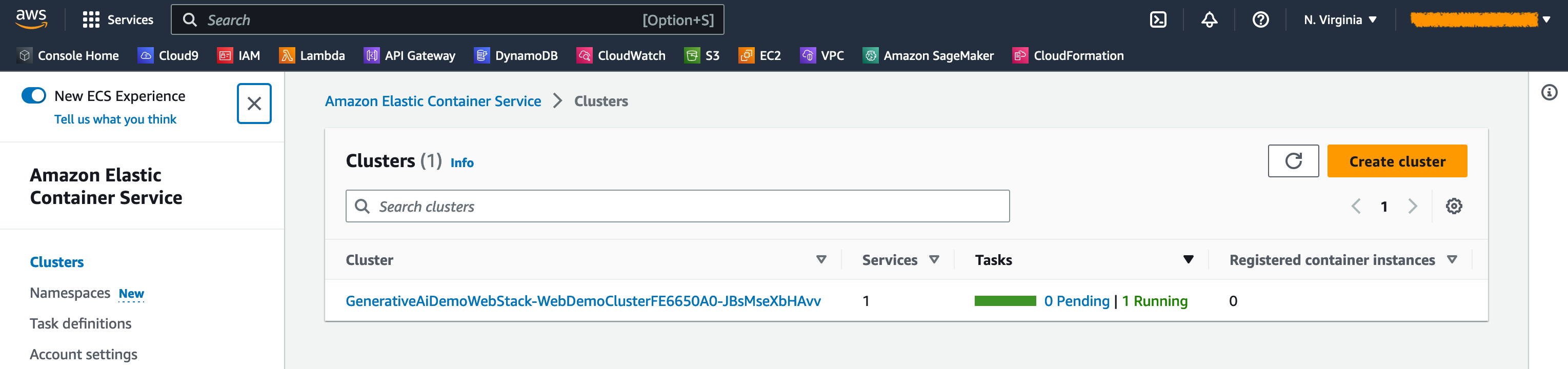

Na konsoli Amazon ECS możesz zobaczyć klastry na Klastry strona.

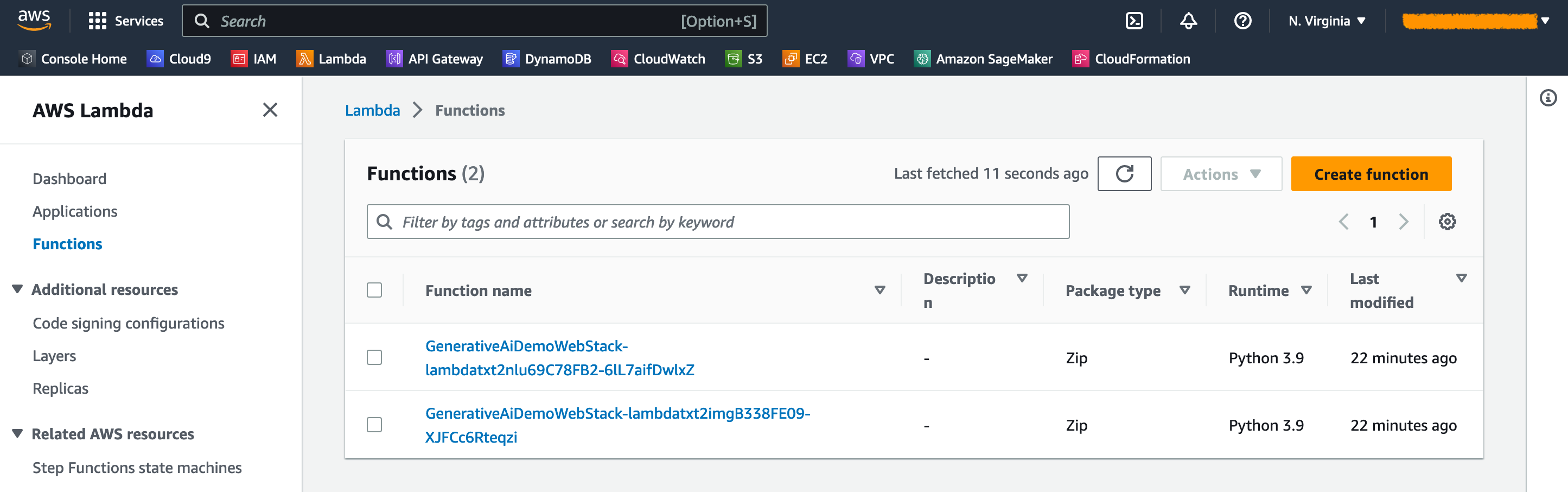

Na konsoli AWS Lambda możesz zobaczyć funkcje na Funkcje strona.

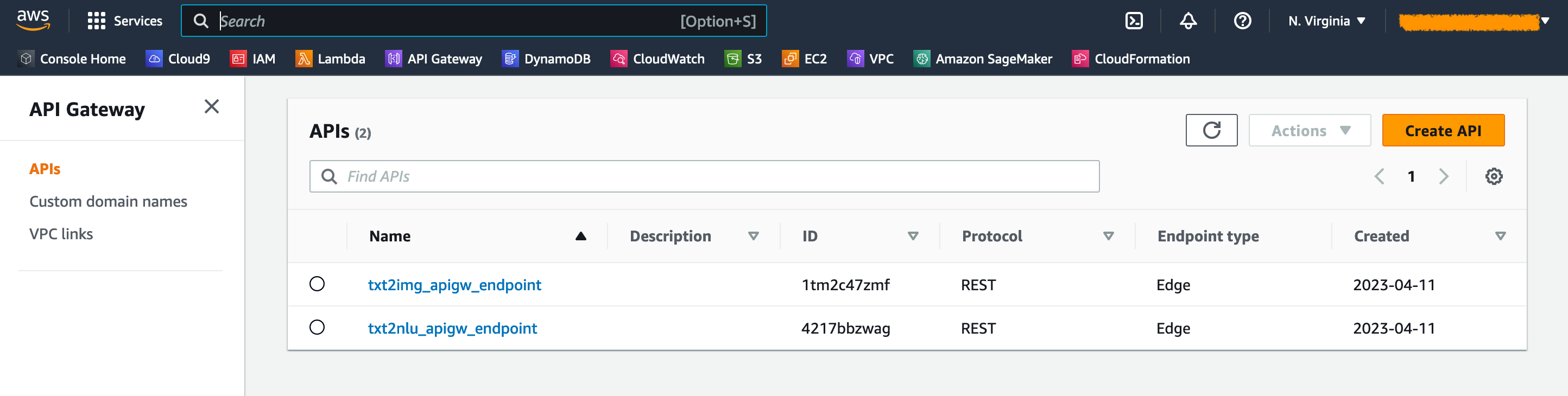

W konsoli API Gateway możesz zobaczyć punkty końcowe API Gateway na Pszczoła strona.

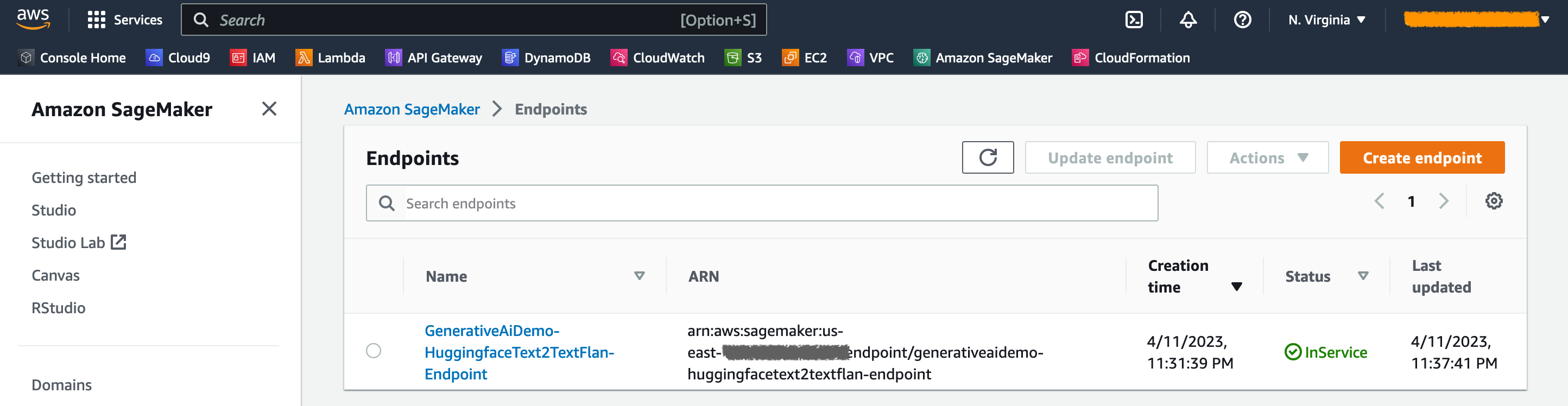

W konsoli SageMaker możesz zobaczyć wdrożone punkty końcowe modelu na Punkty końcowe strona.

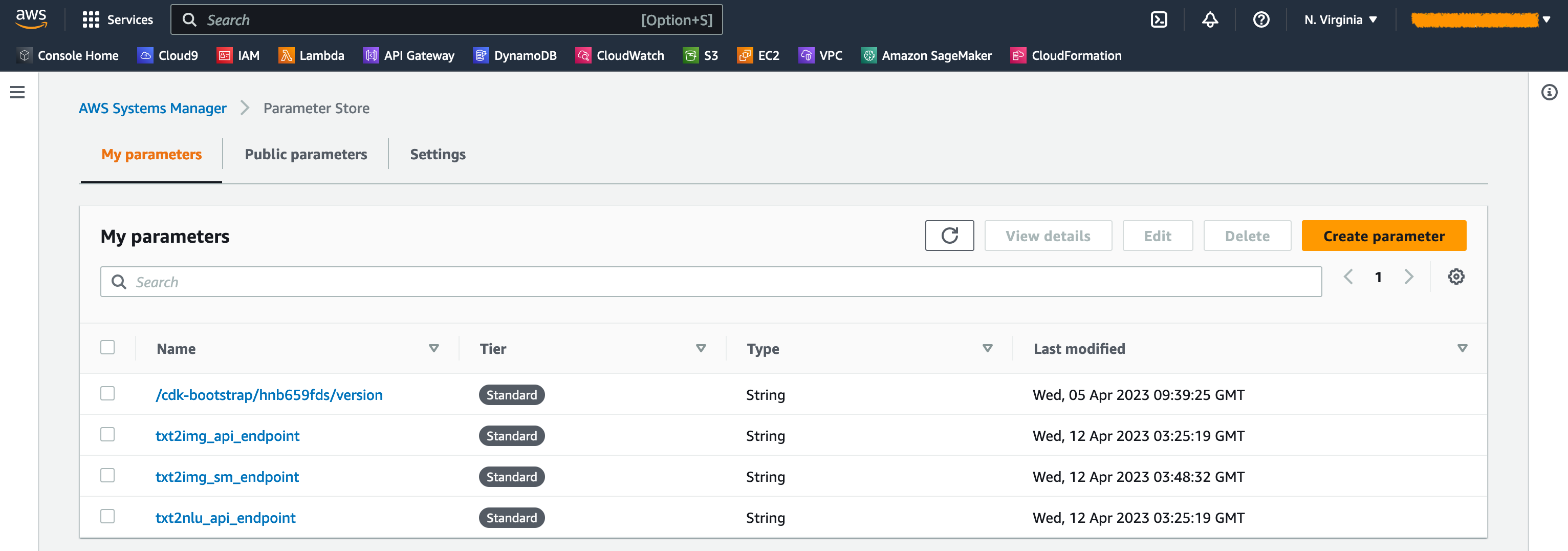

Po uruchomieniu stosów generowane są niektóre parametry. Są one przechowywane w Magazyn parametrów menedżera systemów AWS. Aby je wyświetlić, wybierz Magazyn parametrów w okienku nawigacji na Menedżer systemów AWS Konsola.

Sprzątać

Aby uniknąć niepotrzebnych kosztów, wyczyść całą utworzoną infrastrukturę za pomocą następującego polecenia na stacji roboczej:

Wchodzę y na monit. Ten krok zajmuje około 10 minut. Sprawdź, czy wszystkie zasoby zostały usunięte z konsoli. Usuń również zasobniki zasobów S3 utworzone przez AWS CDK na konsoli Amazon S3, a także repozytoria zasobów na Amazon ECR.

Wnioski

Jak pokazano w tym poście, możesz użyć AWS CDK do wdrożenia generatywnych modeli AI w JumpStart. Pokazaliśmy przykład generowania obrazu i przykład generowania tekstu przy użyciu interfejsu użytkownika obsługiwanego przez Streamlit, Lambda i API Gateway.

Możesz teraz tworzyć generatywne projekty AI przy użyciu wstępnie wyszkolonych modeli AI w JumpStart. Możesz także rozszerzyć ten projekt, aby dostroić modele podstawowe do swojego przypadku użycia i kontrolować dostęp do punktów końcowych API Gateway.

Zapraszamy do przetestowania rozwiązania i współtworzenia projektu na GitHub. Podziel się swoimi przemyśleniami na temat tego samouczka w komentarzach!

Podsumowanie licencji

Ten przykładowy kod jest udostępniany na podstawie zmodyfikowanej licencji MIT. Zobacz LICENCJA plik, aby uzyskać więcej informacji. Przejrzyj również odpowiednie licencje dla stabilna dyfuzja i flan-t5-xl modele na przytulanie twarzy.

O autorach

Hantzleya Tauckoora jest Liderem Architektury Rozwiązań Partnerskich APJ z siedzibą w Singapurze. Posiada 20-letnie doświadczenie w branży ICT obejmujące wiele obszarów funkcjonalnych, w tym architekturę rozwiązań, rozwój biznesu, strategię sprzedaży, doradztwo i przywództwo. Kieruje zespołem Senior Solutions Architects, który umożliwia partnerom opracowywanie wspólnych rozwiązań, budowanie możliwości technicznych i kierowanie nimi przez fazę wdrażania, gdy klienci migrują i modernizują swoje aplikacje do AWS.

Hantzleya Tauckoora jest Liderem Architektury Rozwiązań Partnerskich APJ z siedzibą w Singapurze. Posiada 20-letnie doświadczenie w branży ICT obejmujące wiele obszarów funkcjonalnych, w tym architekturę rozwiązań, rozwój biznesu, strategię sprzedaży, doradztwo i przywództwo. Kieruje zespołem Senior Solutions Architects, który umożliwia partnerom opracowywanie wspólnych rozwiązań, budowanie możliwości technicznych i kierowanie nimi przez fazę wdrażania, gdy klienci migrują i modernizują swoje aplikacje do AWS.

Kwonyul Choi jest CTO w BABITALK, koreańskim startupie zajmującym się platformą do pielęgnacji urody z siedzibą w Seulu. Przed objęciem tej roli Kownyul pracował jako inżynier ds. rozwoju oprogramowania w AWS, koncentrując się na AWS CDK i Amazon SageMaker.

Kwonyul Choi jest CTO w BABITALK, koreańskim startupie zajmującym się platformą do pielęgnacji urody z siedzibą w Seulu. Przed objęciem tej roli Kownyul pracował jako inżynier ds. rozwoju oprogramowania w AWS, koncentrując się na AWS CDK i Amazon SageMaker.

Arunprasath Shankar jest starszym architektem rozwiązań AI/ML z AWS, pomagającym globalnym klientom skutecznie i wydajnie skalować ich rozwiązania AI w chmurze. W wolnym czasie Arun lubi oglądać filmy science fiction i słuchać muzyki klasycznej.

Arunprasath Shankar jest starszym architektem rozwiązań AI/ML z AWS, pomagającym globalnym klientom skutecznie i wydajnie skalować ich rozwiązania AI w chmurze. W wolnym czasie Arun lubi oglądać filmy science fiction i słuchać muzyki klasycznej.

Satish Upreti jest liderem migracji PSA i bezpieczeństwa MŚP w organizacji partnerskiej w APJ. Satish ma 20 lat doświadczenia w lokalnych technologiach chmury prywatnej i chmury publicznej. Odkąd dołączył do AWS w sierpniu 2020 roku jako specjalista ds. migracji, zapewnia szerokie doradztwo techniczne i wsparcie dla partnerów AWS w planowaniu i wdrażaniu złożonych migracji.

Satish Upreti jest liderem migracji PSA i bezpieczeństwa MŚP w organizacji partnerskiej w APJ. Satish ma 20 lat doświadczenia w lokalnych technologiach chmury prywatnej i chmury publicznej. Odkąd dołączył do AWS w sierpniu 2020 roku jako specjalista ds. migracji, zapewnia szerokie doradztwo techniczne i wsparcie dla partnerów AWS w planowaniu i wdrażaniu złożonych migracji.

Dodatek: Przewodnik po kodzie

W tej sekcji przedstawiamy omówienie kodu w tym projekcie.

Aplikacja AWS CDK

Główna aplikacja AWS CDK jest zawarta w app.py plik w katalogu głównym. Projekt składa się z wielu stosów, więc musimy je zaimportować:

Definiujemy nasze generatywne modele AI i uzyskujemy powiązane URI z SageMaker:

Funkcja get_sagemaker_uris pobiera wszystkie informacje o modelu z JumpStart. Widzieć script/sagemaker_uri.py.

Następnie tworzymy instancje stosów:

Pierwszym stosem do uruchomienia jest stos VPC, GenerativeAiVpcNetworkStack. Stos aplikacji internetowych, GenerativeAiDemoWebStack, jest zależny od stosu VPC. Zależność odbywa się poprzez przekazanie parametru vpc=network_stack.vpc.

See app.py dla pełnego kodu.

Stos sieciowy VPC

W stosie GenerativeAiVpcNetworkStack tworzymy VPC z podsiecią publiczną i prywatną obejmującą dwie strefy dostępności:

See /stack/generative_ai_vpc_network_stack.py dla pełnego kodu.

Demonstracyjny stos aplikacji internetowych

W stosie GenerativeAiDemoWebStack uruchamiamy funkcje Lambda i odpowiednie punkty końcowe API Gateway, za pośrednictwem których aplikacja internetowa wchodzi w interakcję z punktami końcowymi modelu SageMaker. Zobacz następujący fragment kodu:

Aplikacja internetowa jest konteneryzowana i hostowana na Amazon ECS z Fargate. Zobacz następujący fragment kodu:

See /stack/generative_ai_demo_web_stack.py dla pełnego kodu.

Generowanie obrazu stosu punktów końcowych modelu SageMaker

Stos GenerativeAiTxt2imgSagemakerStack tworzy punkt końcowy modelu generowania obrazu z usługi JumpStart i przechowuje nazwę punktu końcowego w magazynie parametrów programu Systems Manager. Ten parametr będzie używany przez aplikację internetową. Zobacz następujący kod:

See /stack/generative_ai_txt2img_sagemaker_stack.py dla pełnego kodu.

NLU i generowanie tekstu stos punktów końcowych modelu SageMaker

Stos GenerativeAiTxt2nluSagemakerStack tworzy punkt końcowy modelu NLU i generowania tekstu z usługi JumpStart i przechowuje nazwę punktu końcowego w magazynie parametrów programu Systems Manager. Ten parametr będzie również używany przez aplikację internetową. Zobacz następujący kod:

See /stack/generative_ai_txt2nlu_sagemaker_stack.py dla pełnego kodu.

Aplikacja internetowa

Aplikacja internetowa znajduje się w /web-app informator. Jest to aplikacja Streamlit, która jest konteneryzowana zgodnie z Dockerfile:

Aby dowiedzieć się więcej o Streamlicie, zobacz Uproszczona dokumentacja.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoAiStream. Analiza danych Web3. Wiedza wzmocniona. Dostęp tutaj.

- Wybijanie przyszłości w Adryenn Ashley. Dostęp tutaj.

- Kupuj i sprzedawaj akcje spółek PRE-IPO z PREIPO®. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/deploy-generative-ai-models-from-amazon-sagemaker-jumpstart-using-the-aws-cdk/

- :ma

- :Jest

- $W GÓRĘ

- 1

- 10

- 100

- 20

- 20 roku

- 2020

- 2023

- 7

- 8

- 9

- a

- O nas

- dostęp

- dostęp

- dostępny

- odpowiednio

- Konto

- Osiągać

- w poprzek

- przystosować

- adresowanie

- Przyjęcie

- Przyjęcie

- postęp

- Rada

- Agent

- AI

- Zasilany AI

- AI / ML

- Algorytmy

- Wszystkie kategorie

- Pozwalać

- już

- również

- Amazonka

- Brama Amazon API

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- Analizując

- i

- każdy

- api

- Aplikacja

- Zastosowanie

- aplikacje

- mobilne i webowe

- kwiecień

- architektura

- SĄ

- obszary

- na około

- AS

- Aktywa

- At

- Uwaga

- Sierpnia

- dostępność

- dostępny

- uniknąć

- AWS

- Chmura AWS9

- Tworzenie chmury AWS

- AWS Lambda

- z powrotem

- stabilizator

- na podstawie

- BAT

- BE

- piękny

- Uroda

- zanim

- jest

- uwierzyć

- pomiędzy

- Bootstrap

- szeroki

- przeglądarka

- budować

- wybudowany

- biznes

- rozwój biznesu

- biznes

- ale

- by

- wezwanie

- CAN

- możliwości

- Pojemność

- Zajęte

- który

- walizka

- Etui

- CD

- Centra

- zmiana

- Charakterystyka

- Opłaty

- ZOBACZ

- Dodaj

- klient

- klientów

- Chmura

- Cloud9

- kod

- byliśmy spójni, od początku

- wspólny

- powszechnie

- kompletny

- kompleks

- obliczać

- komputer

- systemu

- Konsola

- skonstruować

- consulting

- spożywane

- zawarte

- Pojemnik

- zawiera

- zawartość

- kontekst

- przyczynić się

- kontrola

- Rozmowa

- rozmowy

- skorygowania

- Koszty:

- Stwórz

- stworzony

- tworzy

- tworzenie

- CTO

- Aktualny

- zwyczaj

- klient

- doświadczenie klienta

- Obsługa klienta

- Klientów

- dostosować

- pionierski nowatorski

- dane

- nauka danych

- dzień

- lat

- Domyślnie

- Definiuje

- wykazać

- demonstruje

- Zależność

- zależny

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- wdraża się

- opis

- zniszczyć

- rozwijać

- deweloperzy

- oprogramowania

- różne

- Transmitowanie

- Wyświetlacz

- Zakłócać

- Doker

- dokument

- zrobić

- nie

- na dół

- każdy

- z łatwością

- łatwo

- faktycznie

- skutecznie

- umożliwiać

- Umożliwia

- zakończenia

- Punkt końcowy

- inżynier

- Wchodzę

- Środowisko

- środowiska

- szacunkowa

- Każdy

- codziennie

- każdy jest

- przykład

- przykłady

- ekscytujący

- doświadczenie

- rozciągać się

- rozległy

- Twarz

- fałszywy

- znajomy

- członków Twojej rodziny

- Korzyści

- kilka

- pole

- Łąka

- filet

- Znajdź

- i terminów, a

- Skupiać

- następujący

- następujący sposób

- W razie zamówieenia projektu

- wytrzymałość

- Fundacja

- frakcja

- Framework

- od

- pełny

- funkcjonować

- funkcjonalny

- Funkcje

- Bramka

- zbierać

- zebranie

- ogólny cel

- wygenerowane

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- git

- Globalne

- Globalnie

- Rozwój

- Have

- mający

- he

- pomoc

- pomoc

- wysokiej jakości

- jego

- Strona główna

- gospodarz

- hostowane

- GODZINY

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- ICT

- pomysły

- if

- obraz

- zdjęcia

- wyobraźnia

- wdrożenia

- realizacja

- importować

- in

- Włącznie z

- włączać

- przemysłowa

- przemysł

- Nieskończony

- Punkt przegięcia

- Informacja

- Infrastruktura

- zainstalować

- instalacja

- zainstalowany

- przykład

- zamiast

- integrować

- integracje

- współdziała

- Interfejs

- najnowszych

- zapraszać

- problem

- IT

- łączący

- połączenie

- jpg

- json

- koreański

- lądowanie

- język

- Języki

- duży

- później

- firmy

- uruchomić

- uruchomiona

- wodowanie

- prowadzić

- lider

- Przywództwo

- Wyprowadzenia

- UCZYĆ SIĘ

- nauka

- Pozostawiać

- Biblioteka

- Licencja

- licencje

- lubić

- LIMIT

- Linia

- Lista

- Słuchanie

- wykazy

- LLM

- załadować

- miejscowy

- usytuowany

- maszyna

- uczenie maszynowe

- maszyny

- zrobiony

- Główny

- robić

- WYKONUJE

- zarządzanie

- i konserwacjami

- kierownik

- wiele

- masywny

- Menu

- może

- migrować

- migracja

- minut

- MIT

- ML

- model

- modele

- zmodernizować

- zmodyfikowano

- jeszcze

- Kino

- wielokrotność

- Muzyka

- musi

- Nazwa

- Naturalny

- Natura

- Nawigacja

- Potrzebować

- wymagania

- sieć

- Nowości

- Następny

- węzeł

- już dziś

- numer

- of

- Oferty

- on

- ONE

- trwający

- tylko

- open source

- Oprogramowanie typu open source

- otwiera

- or

- zamówienie

- organizacja

- oryginalny

- Inne

- ludzkiej,

- wydajność

- koniec

- przegląd

- własny

- pakiet

- strona

- chleb

- paradygmat

- parametr

- parametry

- partnerem

- wzmacniacz

- Przechodzący

- wykonać

- faza

- telefon

- obraz

- krok po kroku

- Platforma

- plato

- Analiza danych Platona

- PlatoDane

- punkt

- możliwość

- Post

- potencjał

- powered

- mocny

- warunki wstępne

- Wcześniejszy

- prywatny

- Problem

- Produkcja

- Programowanie

- języki programowania

- projekt

- projektowanie

- zapewniać

- zapewnia

- publiczny

- Chmura publiczna

- publicznie

- Python

- zapytania

- szybko

- zasięg

- szybki

- szybko

- gotowy

- niedawno

- , o którym mowa

- w sprawie

- region

- związane z

- składnica

- wymagany

- wymagania

- Zasób

- Zasoby

- osób

- przeglądu

- Rewolucjonizujący

- prawo

- Rola

- korzeń

- run

- bieganie

- sagemaker

- sole

- taki sam

- Skala

- sci-fi

- nauka

- zadraśnięcie

- Sdk

- druga

- sekund

- Sekcja

- bezpieczeństwo

- widzieć

- posiew

- SAMEGO SIEBIE

- senior

- sentyment

- Seul

- Bezserwerowe

- Serwery

- usługa

- Usługi

- zestaw

- ustawienie

- Share

- przesunięcie

- powinien

- pokazać

- pokazał

- pokazane

- Targi

- Prosty

- ponieważ

- Singapur

- Rozmiar

- mały

- EMS

- So

- Tworzenie

- rozwoju oprogramowania

- rozwiązanie

- Rozwiązania

- kilka

- Źródło

- Typ przestrzeni

- specjalista

- specyficzny

- określony

- stabilny

- stos

- Półki na książki

- standard

- rozpoczęty

- startup

- Startups

- Ewolucja krok po kroku

- Cel

- Stop

- przechowywanie

- sklep

- przechowywany

- sklep

- historie

- Strategia

- Struktura

- podsieci

- wsparcie

- systemy

- trwa

- Zadanie

- zadania

- zespół

- Techniczny

- Techniki

- Technologies

- Technologia

- mówi

- Szablony

- test

- Testy

- że

- Połączenia

- ich

- Im

- następnie

- Te

- to

- Przez

- czas

- tytan

- do

- Zestaw narzędzi

- narzędzia

- tradycyjny

- tradycyjny

- Pociąg

- przeszkolony

- Trening

- Przekształcać

- Trendy

- prawdziwy

- naprawdę

- SKRĘCAĆ

- Tutorial

- drugiej

- rodzaj

- typy

- typowy

- zazwyczaj

- dla

- zrozumienie

- odsłonięty

- aktualizowanie

- uaktualnienie

- posługiwać się

- przypadek użycia

- używany

- Użytkownik

- Interfejs użytkownika

- za pomocą

- wykorzystać

- różnorodny

- Naprawiono

- zweryfikować

- wersja

- przez

- Filmy

- Zobacz i wysłuchaj

- Wirtualny

- prawie

- Odwiedzić

- chcieć

- była

- oglądania

- Droga..

- we

- sieć

- Aplikacja internetowa

- usługi internetowe

- DOBRZE

- który

- Podczas

- szeroki

- Szeroki zasięg

- rozpowszechniony

- Wikipedia

- będzie

- okna

- w

- bez

- Praca

- pracował

- przepływów pracy

- stacja robocza

- lat

- You

- Twój

- zefirnet

- Strefy