Ten post jest współautorem z Janem Paulem Assendorpem, Thomasem Lietzowem, Christopherem Maschem, Alexandrem Meinertem, dr Larsem Palzerem, Janem Schillemansem z SIGNAL IDUNA.

W SIGNAL IDUNA, dużym niemieckim ubezpieczycielu, obecnie odkrywamy się na nowo za pomocą naszego programu transformacji VISION2023, aby stać się jeszcze bardziej zorientowanym na klienta. Kluczowe dla tej transformacji są dwa aspekty: reorganizacja dużej części siły roboczej w wielofunkcyjne i zwinne zespoły oraz przekształcenie się w firmę prawdziwie opartą na danych. W tym przypadku motto „Budujesz, uruchamiasz” jest ważnym wymogiem dla zespołu wielofunkcyjnego, który tworzy produkt oparty na danych lub uczeniu maszynowym (ML). Nakłada to ścisłe ograniczenia na to, ile zespół roboczy może wydać na wyprodukowanie i uruchomienie produktu.

Ten post pokazuje, jak SIGNAL IDUNA radzi sobie z tym wyzwaniem i wykorzystuje AWS Cloud aby umożliwić międzyfunkcyjnym zespołom tworzenie i wdrażanie własnych produktów ML. W tym celu w pierwszej kolejności wprowadzamy strukturę organizacyjną zwinnych zespołów, która określa centralne wymagania dla infrastruktury chmurowej wykorzystywanej do tworzenia i uruchamiania produktu. Następnie pokazujemy, w jaki sposób trzy centralne zespoły w SIGNAL IDUNA umożliwiają wielofunkcyjnym zespołom tworzenie produktów danych w AWS Cloud przy minimalnej pomocy, zapewniając odpowiedni przepływ pracy i rozwiązania infrastrukturalne, które można łatwo wykorzystać i dostosować. Na koniec dokonujemy przeglądu naszego podejścia i porównujemy je z bardziej klasycznym podejściem, w którym rozwój i działanie są ściślej oddzielone.

Agile@SI – Fundacja Zmiany Organizacyjnej

Od początku 2021 roku SIGNAL IDUNA zaczęła wdrażać swoją strategię Agile@SI i ustanawiać zwinne metody opracowywania rozwiązań zorientowanych na klienta w całej firmie [1]. Dotychczasowe zadania i cele są obecnie realizowane przez zespoły interdyscyplinarne, tzw Drużyny. Te zespoły stosują zwinne metody (takie jak framework Scrum), podejmują własne decyzje i budują produkty zorientowane na klienta. Zazwyczaj zespoły są zlokalizowane w działach biznesowych, takich jak marketing, a wiele z nich kładzie duży nacisk na budowanie produktów opartych na danych i ML. Na przykład typowymi przypadkami użycia w ubezpieczeniach są przewidywanie odpływu klientów i rekomendacja produktu.

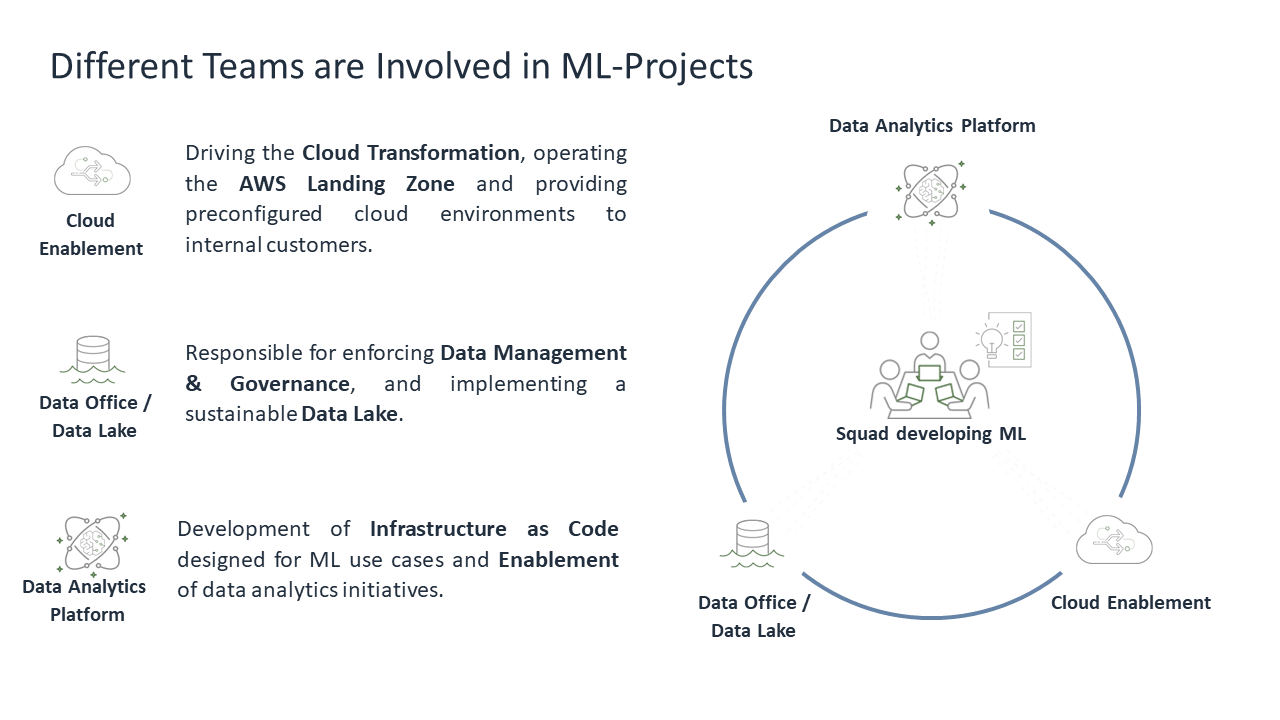

Ze względu na złożoność ML tworzenie rozwiązania ML przez jeden zespół jest wyzwaniem, a zatem wymaga współpracy różnych zespołów.

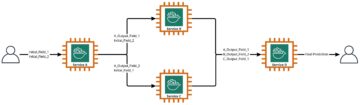

SIGNAL IDUNA posiada trzy kluczowe zespoły, które wspierają tworzenie rozwiązań ML. Otoczony tymi trzema zespołami jest zespół odpowiedzialny za rozwój i długofalowe działanie rozwiązania ML. Podejście to jest zgodne z modelem współodpowiedzialności AWS [2].

Na powyższym obrazku wszystkie drużyny są przedstawione w przeglądzie.

Włączenie chmury

Podstawowa infrastruktura chmurowa dla całej organizacji jest zapewniana przez oddział Cloud Enablement. Ich zadaniem jest umożliwienie zespołom samodzielnego budowania produktów w oparciu o technologie chmurowe. Skraca to czas wprowadzania na rynek nowych produktów, takich jak ML, i jest zgodne z zasadą „Tworzysz, uruchamiasz”.

Biuro danych/jezioro danych

Przenoszenie danych do chmury, jak również znalezienie odpowiedniego zestawu danych, wspiera zespół Data Office/Data Lake. Tworzą katalog danych, którego można używać do wyszukiwania i wybierania wymaganych zestawów danych. Ich celem jest ustanowienie przejrzystości danych i zarządzania nimi. Ponadto są odpowiedzialni za ustanowienie i obsługę Data Lake, która pomaga zespołom uzyskiwać dostęp do odpowiednich danych i je przetwarzać.

Platforma analizy danych

Nasz zespół Data Analytics Platform (DAP) to zespół zorientowany na chmurę i ML w SIGNAL IDUNA, który jest biegły w inżynierii ML, inżynierii danych, a także analizie danych. Umożliwiamy zespołom wewnętrznym korzystanie z chmury publicznej dla ML, dostarczając komponenty infrastruktury i wiedzę. Nasze produkty i usługi zostały szczegółowo zaprezentowane w poniższym dziale.

Umożliwienie zespołom międzyfunkcyjnym tworzenia rozwiązań ML

Aby umożliwić wielofunkcyjnym zespołom w SIGNAL IDUNA tworzenie rozwiązań ML, potrzebujemy szybkiego i wszechstronnego sposobu udostępniania infrastruktury chmurowej wielokrotnego użytku, a także wydajnego przepływu pracy dla zespołów wdrażających, aby wykorzystać możliwości chmury.

W tym celu stworzyliśmy ustandaryzowany proces onboardingu i wsparcia oraz udostępniliśmy modułowe szablony infrastruktury jako Infrastructure as Code (IaC). Te szablony zawierają komponenty infrastruktury przeznaczone do typowych przypadków użycia ML, które można łatwo dostosować do wymagań konkretnego przypadku użycia.

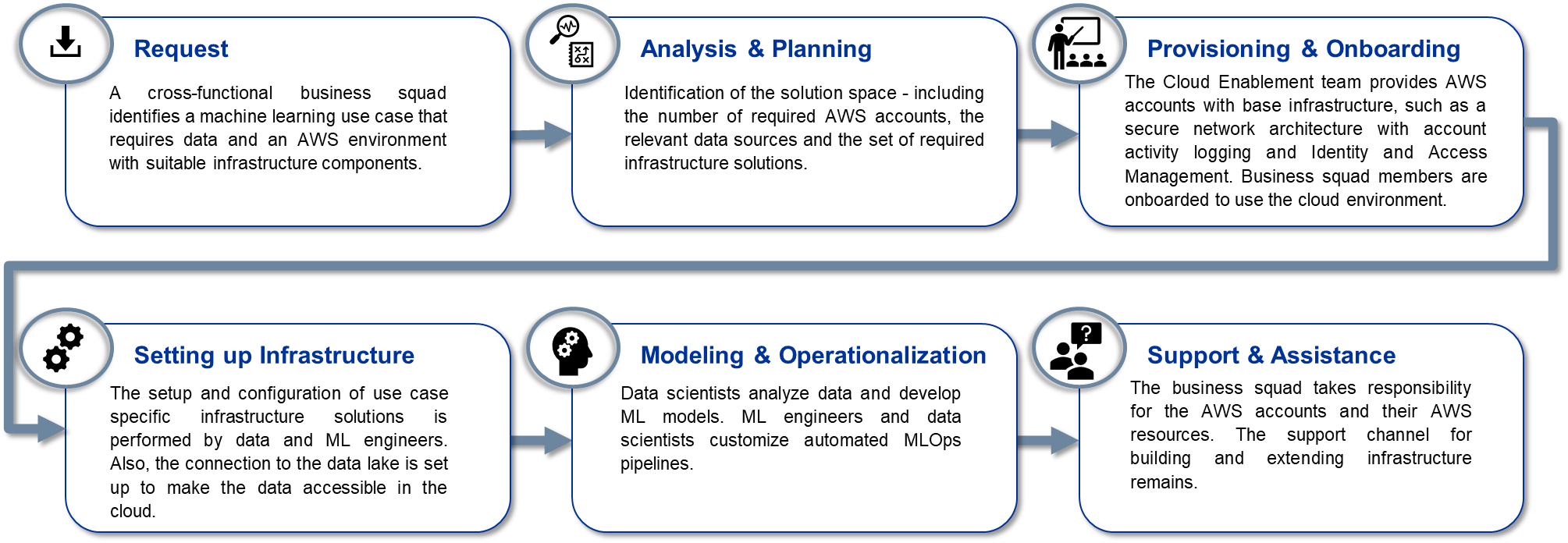

Przepływ pracy tworzenia rozwiązań ML

Istnieją trzy główne role techniczne związane z tworzeniem i obsługą rozwiązań ML: naukowiec danych, inżynier ML i inżynier danych. Każda rola jest częścią zespołu wielofunkcyjnego i ma inne obowiązki. Analityk danych ma wymaganą wiedzę dziedzinową dotyczącą wymagań funkcjonalnych i technicznych przypadku użycia. Inżynier ML specjalizuje się w budowaniu zautomatyzowanych rozwiązań ML i wdrażaniu modeli. A inżynier danych upewnia się, że dane przepływają lokalnie i w chmurze.

Proces udostępniania platformy wygląda następująco:

Infrastruktura konkretnego przypadku użycia jest zdefiniowana w IaC i wersjonowana w centralnym repozytorium projektu. Obejmuje to również potoki do szkolenia i wdrażania modeli, a także inne artefakty kodu związane z nauką o danych. Analitycy danych, inżynierowie ML i inżynierowie danych mają dostęp do repozytorium projektu i mogą autonomicznie konfigurować i aktualizować cały kod infrastruktury. Umożliwia to zespołowi szybką zmianę infrastruktury w razie potrzeby. Jednak inżynier ML zawsze może wesprzeć w opracowaniu i aktualizacji modeli infrastruktury lub ML.

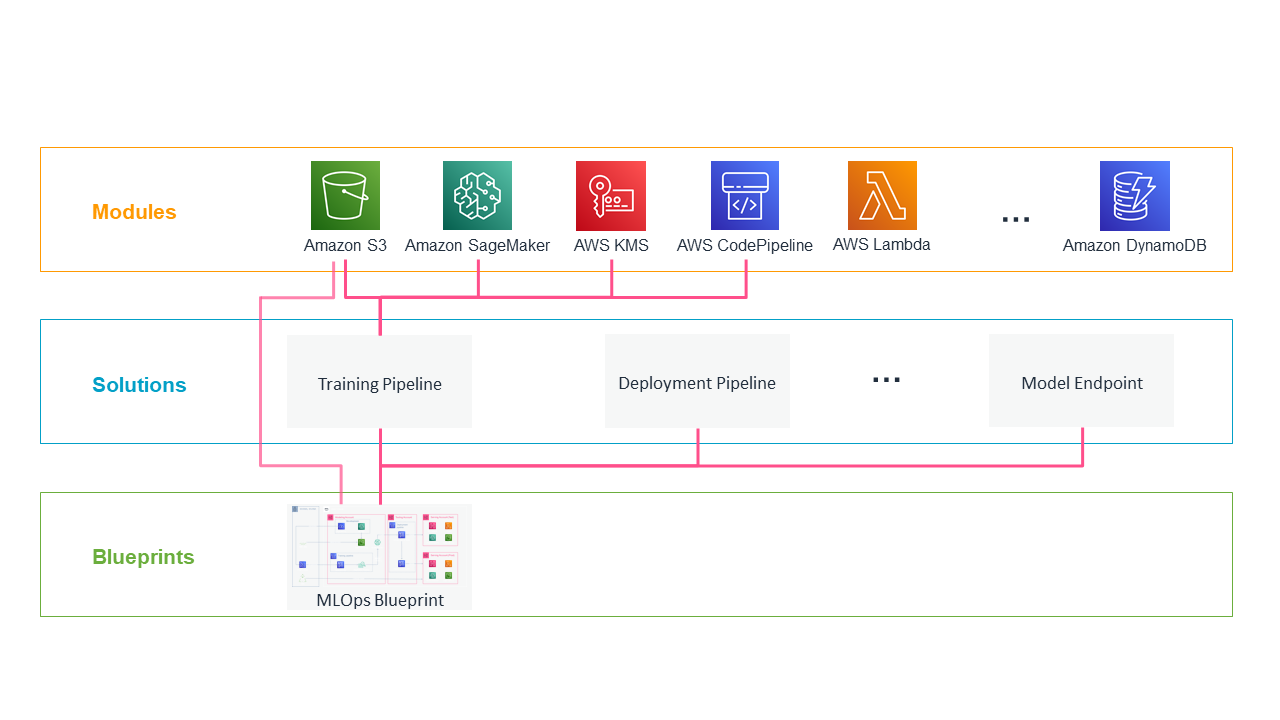

Wielokrotnego użytku i modułowe komponenty infrastruktury

Hierarchiczne i modułowe zasoby IaC są zaimplementowane w Terraform i obejmują infrastrukturę dla typowych przypadków użycia nauki o danych i ETL. Dzięki temu możemy ponownie wykorzystywać kod infrastruktury i egzekwować wymagane zasady bezpieczeństwa i zgodności, takie jak używanie Usługa zarządzania kluczami AWS (KMS) szyfrowanie danych, a także enkapsulacja infrastruktury w Wirtualna prywatna chmura Amazon (VPC) środowisk bez bezpośredniego dostępu do Internetu.

Hierarchiczna struktura IaC wygląda następująco:

- Moduły hermetyzować podstawowe usługi AWS z wymaganą konfiguracją do zarządzania bezpieczeństwem i dostępem. Obejmuje to konfiguracje najlepszych praktyk, takie jak zapobieganie publicznemu dostępowi do Usługa Amazon Simple Storage (S3) zasobniki lub wymuszanie szyfrowania wszystkich przechowywanych plików.

- W niektórych przypadkach potrzebujesz różnych usług do automatyzacji procesów, takich jak wdrażanie modeli ML na różnych etapach. Dlatego zdefiniowaliśmy Rozwiązania jako pakiet różnych modułów we wspólnej konfiguracji dla różnych rodzajów zadań.

- Ponadto oferujemy kompletne plany które łączą rozwiązania w różnych środowiskach, aby spełnić wiele potencjalnych potrzeb projektu. W naszym schemacie MLOps definiujemy możliwą do wdrożenia infrastrukturę do szkolenia, udostępniania i monitorowania modeli ML, które są zintegrowane i dystrybuowane na kontach AWS. Omówimy dalsze szczegóły w następnej sekcji.

Te produkty są wersjonowane w centralnym repozytorium przez zespół DAP. To pozwala nam stale ulepszać nasz IaC i rozważać nowe funkcje AWS, takie jak Amazon Sage Maker Rejestr modeli. Każdy oddział może odwoływać się do tych zasobów, parametryzować je zgodnie z potrzebami, a na końcu wdrażać je na swoich własnych kontach AWS.

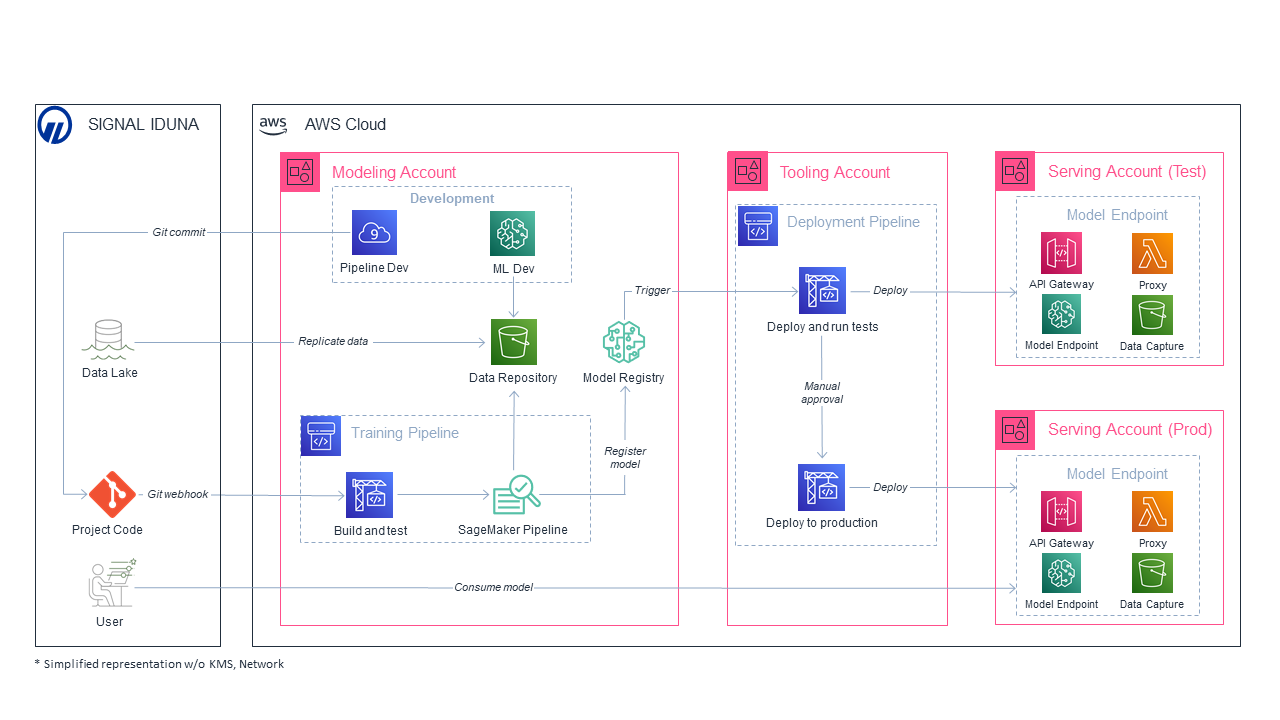

Architektura MLOps

Dostarczamy gotowy do użycia plan z konkretnymi rozwiązaniami obejmującymi cały proces MLOps. Plan zawiera infrastrukturę rozproszoną na czterech kontach AWS do budowania i wdrażania modeli ML. Pozwala nam to wyizolować zasoby i przepływy pracy dla różnych etapów procesu MLOps. Poniższy rysunek przedstawia architekturę z wieloma kontami i opisujemy, w jaki sposób odpowiedzialność za poszczególne etapy procesu jest podzielona między różne role techniczne.

Połączenia modelowanie konto obejmuje usługi w zakresie rozwoju modeli ML. Po pierwsze, inżynier danych stosuje proces ETL w celu dostarczenia odpowiednich danych z jeziora danych SIGNAL IDUNA, scentralizowanej bramy dla przepływów pracy opartych na danych w chmurze AWS. Następnie zestaw danych może zostać wykorzystany przez analityka danych do szkolenia i oceny kandydatów na modele. Po przygotowaniu do szeroko zakrojonych eksperymentów kandydat na model jest integrowany przez inżyniera ML w zautomatyzowanym procesie szkoleniowym. Używamy Amazon SageMaker Pipelines do automatyzacji szkolenia, dostrajania hiperparametrów i oceny modeli na dużą skalę. Obejmuje to również pochodzenie modeli i znormalizowany mechanizm zatwierdzania modeli, które mają być przygotowane do wdrożenia do produkcji. Zautomatyzowane testy jednostkowe i analiza kodu zapewniają jakość i niezawodność kodu na każdym etapie potoku, takim jak wstępne przetwarzanie danych, szkolenie modeli i ocena. Po ocenie i zatwierdzeniu modelu używamy Amazon SageMaker ModelPackages jako interfejsu do przeszkolonego modelu i odpowiednich metadanych.

Połączenia obróbka konto zawiera zautomatyzowane potoki CI/CD z różnymi etapami testowania i wdrażania przeszkolonych modeli. Na etapie testów modele są wdrażane w służąca-nonprod konto. Chociaż jakość modelu jest oceniana w potoku szkoleniowym przed przekazaniem modelu do produkcji, tutaj przeprowadzamy testy wydajności i integracji w odizolowanym środowisku testowym. Po przejściu etapu testowania modele są wdrażane do porcja-prod konta, które mają być zintegrowane z przepływami pracy w produkcji.

Rozdzielenie etapów przepływu pracy MLOps na różne konta AWS pozwala nam odizolować rozwój i testowanie od produkcji. Dlatego możemy egzekwować ścisłą politykę dostępu i bezpieczeństwa. Ponadto dostosowane role IAM zapewniają, że określone usługi mogą uzyskiwać dostęp tylko do danych i innych usług wymaganych w ich zakresie, zgodnie z zasada najmniejszego przywileju. Usługi w środowiskach obsługujących można dodatkowo udostępnić zewnętrznym procesom biznesowym. Na przykład proces biznesowy może wysłać zapytanie do punktu końcowego w środowisku obsługującym produkt w celu uzyskania prognoz modelu.

Korzyści z naszego podejścia

Proces ten ma wiele zalet w porównaniu ze ścisłym rozdzieleniem rozwoju i działania zarówno dla modeli ML, jak i wymaganej infrastruktury:

- Izolacja: Każdy zespół otrzymuje własny zestaw kont AWS, które są całkowicie odizolowane od środowisk innych zespołów. Ułatwia to zarządzanie prawami dostępu i zapewnia prywatność danych osobom uprawnionym do pracy z nimi.

- Włączenie chmury: Członkowie zespołu z niewielkim doświadczeniem w DevOps w chmurze (tacy jak wielu analityków danych) mogą z łatwością obserwować cały proces projektowania i zarządzania infrastrukturą, ponieważ (prawie) nic nie jest przed nimi ukryte za usługą centralną. Pozwala to na lepsze zrozumienie infrastruktury, co z kolei może pomóc w wydajniejszym tworzeniu produktów do nauki o danych.

- Własność produktu: Zastosowanie wstępnie skonfigurowanych rozwiązań infrastrukturalnych i usług zarządzanych sprawia, że bariera w zarządzaniu produktem ML w środowisku produkcyjnym jest bardzo niska. Dlatego analityk danych może łatwo przejąć na własność model, który jest wprowadzany do produkcji. Minimalizuje to dobrze znane ryzyko niepowodzenia wprowadzenia modelu do produkcji po opracowaniu.

- Innowacja: Ponieważ inżynierowie ML są zaangażowani na długo przed tym, jak model jest gotowy do wprowadzenia do produkcji, mogą tworzyć rozwiązania infrastrukturalne odpowiednie dla nowych przypadków użycia, podczas gdy analitycy danych opracowują model ML.

- Zdolność adaptacji: Ponieważ rozwiązania IaC opracowane przez firmę DAP są ogólnodostępne, każdy zespół może je łatwo dostosować do konkretnych potrzeb w przypadku użycia.

- Otwarte źródło: Wszystkie nowe rozwiązania infrastrukturalne można łatwo udostępnić za pośrednictwem centralnego repozytorium kodów DAP do wykorzystania przez inne zespoły. Z czasem stworzy to bogatą bazę kodu z komponentami infrastruktury dostosowanymi do różnych przypadków użycia.

Podsumowanie

W tym poście zilustrowaliśmy, w jaki sposób międzyfunkcyjne zespoły w SIGNAL IDUNA mogą tworzyć i uruchamiać produkty ML w AWS. Centralnym elementem naszego podejścia jest wykorzystanie dedykowanego zestawu kont AWS dla każdego zespołu w połączeniu z dostosowanymi planami i rozwiązaniami IaC. Te dwa komponenty umożliwiają wielofunkcyjnemu zespołowi tworzenie i obsługę infrastruktury jakości produkcji. Z kolei mogą przejąć pełną własność swoich produktów ML.

Odnosić się do Rurociągi tworzenia modeli Amazon SageMaker – Amazon SageMaker uczyć się więcej.

Znajdź więcej informacji na temat ML na AWS na naszej oficjalnej stronie.

Referencje

[1] https://www.handelsblatt.com/finanzen/versicherungsbranche-vorbild-spotify-signal-iduna-wird-von-einer-handwerker-versicherung-zum-agilen-konzern/27381902.html

[2] https://blog.crisp.se/wp-content/uploads/2012/11/SpotifyScaling.pdf

[3] https://aws.amazon.com/compliance/shared-responsibility-model/

O autorach

Jana Pawła Assendorpa jest inżynierem ML z silnym ukierunkowaniem na naukę danych. Buduje modele ML i automatyzuje szkolenie modeli oraz wdrażanie w środowiskach produkcyjnych.

Jana Pawła Assendorpa jest inżynierem ML z silnym ukierunkowaniem na naukę danych. Buduje modele ML i automatyzuje szkolenie modeli oraz wdrażanie w środowiskach produkcyjnych.

Tomasza Lietzowa jest Scrum Masterem zespołu Data Analytics Platform.

Tomasza Lietzowa jest Scrum Masterem zespołu Data Analytics Platform.

Krzysztof Masch jest właścicielem produktu zespołu Data Analytics Platform ze znajomością inżynierii danych, nauki o danych i inżynierii uczenia maszynowego.

Krzysztof Masch jest właścicielem produktu zespołu Data Analytics Platform ze znajomością inżynierii danych, nauki o danych i inżynierii uczenia maszynowego.

Aleksandra Meinerta jest częścią zespołu Data Analytics Platform i pracuje jako inżynier ML. Zaczynał od statystyki, rozwijał się na projektach data science, znalazł pasję do metod i architektury ML.

Aleksandra Meinerta jest częścią zespołu Data Analytics Platform i pracuje jako inżynier ML. Zaczynał od statystyki, rozwijał się na projektach data science, znalazł pasję do metod i architektury ML.

dr Larsa Palzera jest analitykiem danych i członkiem zespołu Data Analytics Platform. Po pomocy w budowaniu komponentów architektury MLOps wykorzystuje je teraz do tworzenia produktów ML.

dr Larsa Palzera jest analitykiem danych i członkiem zespołu Data Analytics Platform. Po pomocy w budowaniu komponentów architektury MLOps wykorzystuje je teraz do tworzenia produktów ML.

Jana Schillemansa jest inżynierem ML z doświadczeniem w inżynierii oprogramowania. Koncentruje się na stosowaniu najlepszych praktyk inżynierii oprogramowania w środowiskach ML (MLOps).

Jana Schillemansa jest inżynierem ML z doświadczeniem w inżynierii oprogramowania. Koncentruje się na stosowaniu najlepszych praktyk inżynierii oprogramowania w środowiskach ML (MLOps).

- Coinsmart. Najlepsza w Europie giełda bitcoinów i kryptowalut.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. DARMOWY DOSTĘP.

- CryptoJastrząb. Radar Altcoin. Bezpłatna wersja próbna.

- Źródło: https://aws.amazon.com/blogs/machine-learning/how-signal-iduna-operationalizes-machine-learning-projects-on-aws/

- "

- 100

- 2021

- dostęp

- Konto

- w poprzek

- Działania

- Zalety

- zwinny

- Wszystkie kategorie

- Chociaż

- Amazonka

- analiza

- analityka

- Stosowanie

- podejście

- architektura

- zautomatyzowane

- dostępny

- AWS

- jest

- BEST

- Najlepsze praktyki

- budować

- Budowanie

- Zapakować

- biznes

- możliwości

- Etui

- wyzwanie

- Chmura

- infrastruktura chmurowa

- kod

- współpraca

- połączenie

- wspólny

- sukcesy firma

- w porównaniu

- spełnienie

- systemu

- zawiera

- Tworzenie

- dane

- Analityka danych

- nauka danych

- naukowiec danych

- dedykowane

- rozwijać

- wdrażanie

- Wdrożenie

- projektowanie

- detal

- rozwijać

- rozwinięty

- rozwijanie

- oprogramowania

- różne

- dyskutować

- dystrybuowane

- domena

- z łatwością

- szyfrowanie

- Punkt końcowy

- inżynier

- Inżynieria

- Inżynierowie

- Środowisko

- niezbędny

- zapewniają

- przykład

- doświadczenie

- FAST

- Korzyści

- Postać

- W końcu

- i terminów, a

- Skupiać

- koncentruje

- następujący

- znaleziono

- Fundacja

- Framework

- pełny

- Gole

- zarządzanie

- pomoc

- pomaga

- tutaj

- W jaki sposób

- HTTPS

- obraz

- realizowane

- ważny

- podnieść

- zawierać

- Informacja

- Infrastruktura

- ubezpieczenie

- zintegrowany

- integracja

- Interfejs

- Internet

- zaangażowany

- IT

- Klawisz

- wiedza

- duży

- UCZYĆ SIĘ

- nauka

- mało

- długo

- maszyna

- uczenie maszynowe

- i konserwacjami

- zarządzający

- rynek

- Marketing

- Mecz

- Użytkownicy

- Meta

- ML

- model

- modele

- Modułowa

- monitorowanie

- Nowe funkcje

- Nowe produkty

- oferta

- urzędnik

- Wprowadzenie

- operacyjny

- organizacja

- Inne

- właściciel

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- Platforma

- polityka

- polityka

- przepowiednia

- Przewidywania

- Zapobieganie

- prywatny

- wygląda tak

- procesów

- Produkt

- Produkcja

- Produkty

- Program

- projekt

- projektowanie

- zapewniać

- publiczny

- Chmura publiczna

- jakość

- składnica

- wymagany

- wymagania

- Zasoby

- odpowiedzialny

- przeglądu

- Ryzyko

- run

- Skala

- nauka

- Naukowiec

- Naukowcy

- Szukaj

- bezpieczeństwo

- usługa

- Usługi

- służąc

- zestaw

- shared

- Prosty

- Tworzenie

- Inżynieria oprogramowania

- Rozwiązania

- specjalizuje się

- wydać

- STAGE

- początek

- rozpoczęty

- statystyka

- przechowywanie

- Strategia

- silny

- Następnie

- wsparcie

- Utrzymany

- otoczony

- zadania

- zespół

- Techniczny

- Technologies

- test

- Testowanie

- Testy

- czas

- Trening

- Transformacja

- Przezroczystość

- Aktualizacja

- us

- posługiwać się

- wykorzystać

- Wirtualny

- Oglądaj

- KIM

- w ciągu

- bez

- Praca

- Siła robocza

- działa