Agenci modelu dużego języka (LLM) to programy, które rozszerzają możliwości samodzielnych programów LLM o 1) dostęp do narzędzi zewnętrznych (interfejsy API, funkcje, elementy webhook, wtyczki itd.) oraz 2) możliwość planowania i wykonywania zadań we własnym zakresie. -kierowana moda. Często LLM muszą współdziałać z innym oprogramowaniem, bazami danych lub interfejsami API, aby wykonywać złożone zadania. Na przykład chatbot administracyjny planujący spotkania wymagałby dostępu do kalendarzy i poczty e-mail pracowników. Dzięki dostępowi do narzędzi agenci LLM mogą stać się potężniejsi – kosztem dodatkowej złożoności.

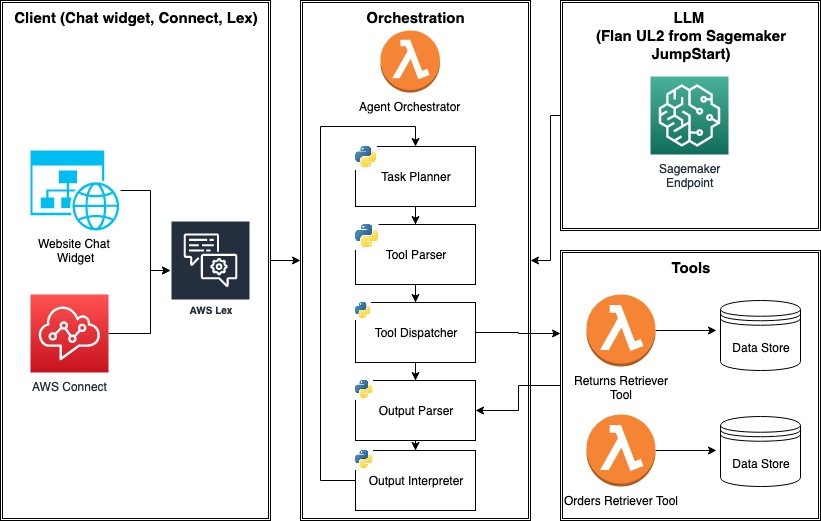

W tym poście przedstawiamy agentów LLM i pokazujemy, jak zbudować i wdrożyć agenta LLM dla handlu elektronicznego Amazon SageMaker JumpStart i AWS Lambda. Agent będzie korzystał z narzędzi zapewniających nowe możliwości, takie jak odpowiadanie na pytania dotyczące zwrotów („Czy mój zwrot rtn001 przetworzone?”) i dostarczanie aktualnych informacji o zamówieniach („Czy mógłbyś mi powiedzieć, czy zamówienie 123456 wysłał?"). Te nowe możliwości wymagają od LLM pobierania danych z wielu źródeł danych (orders, returns) i wykonać wyszukiwanie rozszerzone (RAG).

Aby zasilić agenta LLM, używamy a Flan-UL2 model wdrożony jako a Punkt końcowy SageMaker i korzystaj z narzędzi do odzyskiwania danych zbudowanych w oparciu o AWS Lambda. Agent może być następnie zintegrowany z Amazonka Lex i używany jako chatbot w witrynach internetowych lub Połączenie AWS. Kończymy post kwestiami do rozważenia przed wdrożeniem agentów LLM do produkcji. Aby zapewnić w pełni zarządzane doświadczenie w budowaniu agentów LLM, AWS zapewnia również agenci dla funkcji Amazon Bedrock (w wersji zapoznawczej).

Krótki przegląd architektur agentów LLM

Agenci LLM to programy, które wykorzystują LLM do decydowania, kiedy i jak używać narzędzi niezbędnych do wykonania złożonych zadań. Dzięki narzędziom i możliwościom planowania zadań agenci LLM mogą wchodzić w interakcje z systemami zewnętrznymi i przezwyciężać tradycyjne ograniczenia LLM, takie jak ograniczenia wiedzy, halucynacje i nieprecyzyjne obliczenia. Narzędzia mogą przybierać różne formy, takie jak wywołania API, funkcje Pythona lub wtyczki oparte na webhookach. Na przykład LLM może użyć „wtyczki pobierania”, aby pobrać odpowiedni kontekst i wykonać RAG.

Co więc oznacza dla LLM wybór narzędzi i planowanie zadań? Istnieje wiele podejść (np Reagować, MRKL, Formierka, PrzytulanieGPT, Agent Transformerss) do korzystania z LLM z narzędziami, a postęp następuje szybko. Ale jednym prostym sposobem jest poproszenie LLM o listę narzędzi i poproszenie go o określenie 1) czy narzędzie jest potrzebne do zaspokojenia zapytania użytkownika, a jeśli tak, 2) wybrania odpowiedniego narzędzia. Taki monit zazwyczaj wygląda jak poniższy przykład i może zawierać kilka przykładów, aby poprawić niezawodność LLM w wyborze odpowiedniego narzędzia.

Bardziej złożone podejścia obejmują wykorzystanie wyspecjalizowanego LLM, który może bezpośrednio dekodować „wywołania API” lub „użycie narzędzi”, np GorillaLLM. Takie dostrojone LLM są szkolone w oparciu o zestawy danych specyfikacji API w celu rozpoznawania i przewidywania wywołań API na podstawie instrukcji. Często te LLM wymagają pewnych metadanych o dostępnych narzędziach (opisy, yaml lub schemat JSON dla ich parametrów wejściowych), aby generować wywołania narzędzi. Takie podejście stosuje agenci Amazon Bedrock i Wywołania funkcji OpenAI. Należy pamiętać, że LLM na ogół muszą być wystarczająco duże i złożone, aby wykazać możliwość wyboru narzędzia.

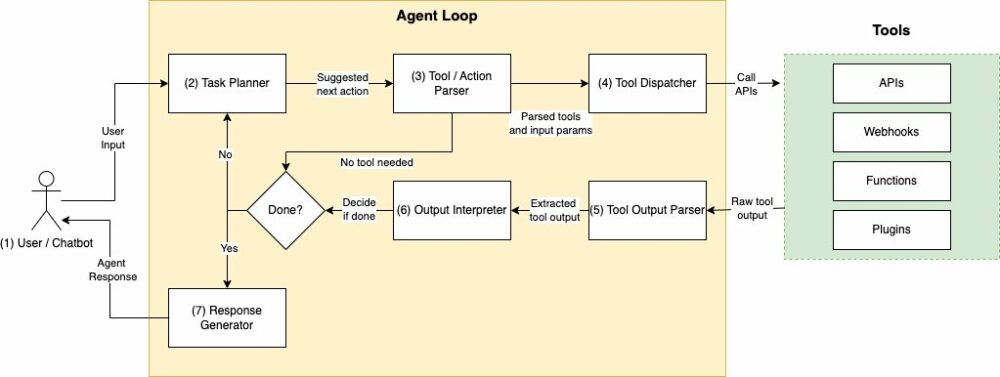

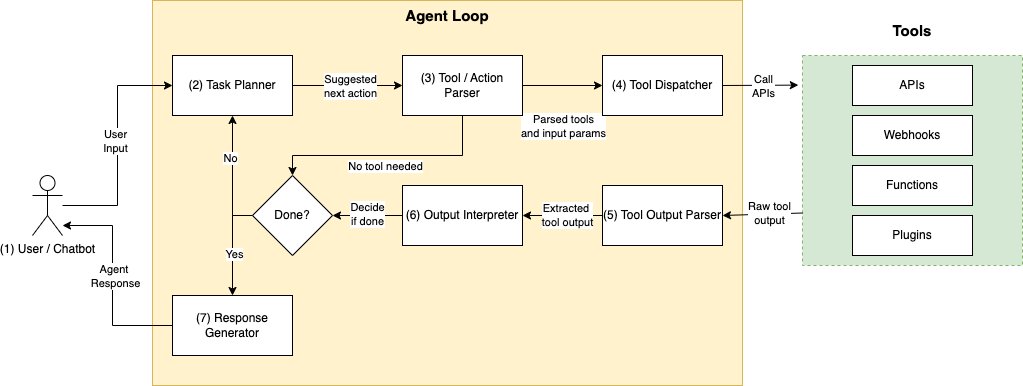

Zakładając, że wybrane zostaną mechanizmy planowania zadań i doboru narzędzi, typowy program agenta LLM działa w następującej kolejności:

- Żądanie użytkownika – Program pobiera dane wejściowe od użytkownika, takie jak „Gdzie jest moje zamówienie

123456?” z jakiejś aplikacji klienckiej. - Zaplanuj kolejne działania i wybierz narzędzia, których chcesz użyć – Następnie program wyświetla monit, aby LLM wygenerował następną akcję, na przykład: „Przejrzyj tabelę zamówień za pomocą

OrdersAPI.” LLM jest proszony o zasugerowanie nazwy narzędzia, npOrdersAPIz predefiniowanej listy dostępnych narzędzi i ich opisów. Alternatywnie, LLM można poinstruować, aby bezpośrednio wygenerował wywołanie API z parametrami wejściowymi, takimi jakOrdersAPI(12345).- Pamiętaj, że następna akcja może, ale nie musi, wiązać się z użyciem narzędzia lub interfejsu API. Jeśli nie, LLM odpowiedziałby na dane wejściowe użytkownika bez włączania dodatkowego kontekstu z narzędzi lub po prostu zwróciłby gotową odpowiedź, np. „Nie mogę odpowiedzieć na to pytanie”.

- Przeanalizuj żądanie narzędzia – Następnie musimy przeanalizować i zweryfikować prognozę narzędzia/działania sugerowaną przez LLM. Konieczna jest weryfikacja, aby upewnić się, że nazwy narzędzi, interfejsy API i parametry żądań nie są halucynacjami i że narzędzia są prawidłowo wywoływane zgodnie ze specyfikacją. Ta analiza może wymagać osobnego wywołania LLM.

- Wywołaj narzędzie – Po upewnieniu się, że nazwy narzędzi i parametry są prawidłowe, wywołujemy narzędzie. Może to być żądanie HTTP, wywołanie funkcji i tak dalej.

- Przeanalizuj dane wyjściowe – Odpowiedź narzędzia może wymagać dodatkowego przetwarzania. Na przykład wywołanie API może skutkować długą odpowiedzią JSON, w której LLM interesuje tylko podzbiór pól. Wyodrębnienie informacji w czystym, ustandaryzowanym formacie może pomóc LLM w bardziej wiarygodnej interpretacji wyniku.

- Zinterpretuj wynik – Biorąc pod uwagę wyniki narzędzia, LLM jest ponownie proszony o zrozumienie tego i podjęcie decyzji, czy może wygenerować ostateczną odpowiedź z powrotem do użytkownika, czy też wymagane są dodatkowe działania.

- Zakończ lub przejdź do kroku 2 – W przypadku błędów lub przekroczenia limitu czasu zwróć ostateczną odpowiedź lub odpowiedź domyślną.

Różne struktury agentów w różny sposób wykonują poprzedni przebieg programu. Na przykład, Reagować łączy wybór narzędzia i generowanie ostatecznej odpowiedzi w jeden monit, w przeciwieństwie do używania oddzielnych podpowiedzi do wyboru narzędzia i generowania odpowiedzi. Ponadto tę logikę można uruchomić w pojedynczym przebiegu lub w instrukcji while („pętla agenta”), która kończy się w momencie wygenerowania ostatecznej odpowiedzi, zgłoszenia wyjątku lub przekroczenia limitu czasu. Niezmienne pozostaje to, że agenci wykorzystują LLM jako centralny element planowania i wywoływania narzędzi do momentu zakończenia zadania. Następnie pokazujemy, jak zaimplementować prostą pętlę agenta przy użyciu usług AWS.

Omówienie rozwiązania

Na potrzeby tego wpisu na blogu wdrażamy agenta LLM wspierającego handel elektroniczny, który zapewnia dwie funkcjonalności obsługiwane przez narzędzia:

- Narzędzie do sprawdzania statusu zwrotu – Odpowiadaj na pytania dotyczące statusu zwrotów, np. „Co się dzieje z moim zwrotem

rtn001? " - Narzędzie do sprawdzania statusu zamówienia – Śledź status zamówień, np. „Jaki jest status mojego zamówienia

123456? "

Agent efektywnie wykorzystuje LLM jako router zapytań. Otrzymawszy zapytanie („Jaki jest status zamówienia 123456?”), wybierz odpowiednie narzędzie wyszukiwania, aby przeszukiwać wiele źródeł danych (tj. zwroty i zamówienia). Kierowanie zapytań realizujemy poprzez wybór przez LLM spośród wielu narzędzi wyszukiwania, które są odpowiedzialne za interakcję ze źródłem danych i kontekstem pobierania. To rozszerza prosty wzorzec RAG, który zakłada pojedyncze źródło danych.

Obydwa narzędzia do pobierania są funkcjami Lambda, które pobierają identyfikator (orderId or returnId) jako dane wejściowe, pobiera obiekt JSON ze źródła danych i konwertuje JSON na przyjazny dla człowieka ciąg znaków, który może być używany przez LLM. Źródłem danych w scenariuszu ze świata rzeczywistego może być wysoce skalowalna baza danych NoSQL, taka jak DynamoDB, ale to rozwiązanie wykorzystuje prosty język Python Dict z przykładowymi danymi do celów demonstracyjnych.

Do agenta można dodać dodatkowe funkcje, dodając narzędzia pobierania i odpowiednio modyfikując monity. Ten agent może zostać przetestowany jako samodzielna usługa, która integruje się z dowolnym interfejsem użytkownika za pośrednictwem protokołu HTTP, co można łatwo zrobić Amazonka Lex.

Oto kilka dodatkowych szczegółów na temat kluczowych komponentów:

- Punkt końcowy wnioskowania LLM – Rdzeniem programu agenta jest LLM. Będziemy używać koncentratora modelu podstawowego SageMaker JumpStart, aby łatwo wdrożyć

Flan-UL2Model. SageMaker JumpStart ułatwia wdrażanie punktów końcowych wnioskowania LLM w dedykowanych SageMaker instancje. - Koordynator agentów – Koordynator agentów koordynuje interakcje między LLM, narzędziami i aplikacją kliencką. W naszym rozwiązaniu używamy funkcji AWS Lambda do sterowania tym przepływem i wykorzystujemy następujące funkcje jako funkcje pomocnicze.

- Planista zadań (narzędzi) – Planista zadań korzysta z LLM, aby zasugerować jedno z: 1) zapytanie o zwrot, 2) zapytanie o zamówienie lub 3) brak narzędzia. Korzystamy wyłącznie z szybkiej inżynierii i

Flan-UL2model taki jaki jest, bez dostrajania. - Analizator narzędzi – Analizator narzędzi zapewnia, że sugestia narzędzia od planisty zadań jest prawidłowa. W szczególności zapewniamy, że pojedynczy

orderIdorreturnIdmożna przeanalizować. W przeciwnym razie odpowiadamy domyślnym komunikatem. - Dyspozytor narzędzi – Dyspozytor narzędzi wywołuje narzędzia (funkcje Lambda) przy użyciu prawidłowych parametrów.

- Parser wyjściowy – Parser wyjściowy czyści i wyodrębnia odpowiednie elementy z JSON do ciągu czytelnego dla człowieka. To zadanie jest wykonywane zarówno przez każde narzędzie pobierania, jak i w programie Orchestrator.

- Interpreter wyjściowy – Interpreter danych wyjściowych odpowiada za 1) interpretację danych wyjściowych wywołania narzędzia i 2) określenie, czy żądanie użytkownika może zostać spełnione, czy też potrzebne są dodatkowe kroki. W tym drugim przypadku ostateczna odpowiedź jest generowana oddzielnie i zwracana użytkownikowi.

- Planista zadań (narzędzi) – Planista zadań korzysta z LLM, aby zasugerować jedno z: 1) zapytanie o zwrot, 2) zapytanie o zamówienie lub 3) brak narzędzia. Korzystamy wyłącznie z szybkiej inżynierii i

Przyjrzyjmy się teraz bliżej kluczowym komponentom: koordynatorowi agentów, planiście zadań i dyspozytorowi narzędzi.

Orkiestrator agentów

Poniżej znajduje się skrócona wersja pętli agenta wewnątrz funkcji Lambda orkiestratora agenta. Pętla korzysta z funkcji pomocniczych, takich jak task_planner or tool_parser, aby modularyzować zadania. Pętla jest zaprojektowana tak, aby mogła działać co najwyżej dwa razy, aby zapobiec niepotrzebnemu utknięciu LLM w pętli.

Planista zadań (przewidywanie narzędzi)

Używa tego koordynator agenta task planner aby przewidzieć narzędzie do wyszukiwania na podstawie danych wejściowych użytkownika. W przypadku naszego agenta LLM po prostu zastosujemy szybką inżynierię i kilka podpowiedzi, aby nauczyć LLM tego zadania w kontekście. Bardziej wyrafinowani agenci mogliby wykorzystać dostrojony LLM do przewidywania narzędzi, co wykracza poza zakres tego postu. Podpowiedź jest następująca:

Dyspozytor narzędzi

Mechanizm wysyłki narzędzi działa poprzez if/else logika wywoływania odpowiednich funkcji Lambda w zależności od nazwy narzędzia. Poniżej jest tool_dispatch Implementacja funkcji pomocniczej. Jest używany wewnątrz agent pętli i zwraca surową odpowiedź z funkcji Lambda narzędzia, która jest następnie czyszczona przez funkcję output_parser funkcja.

Wdróż rozwiązanie

Ważne warunki wstępne – Aby rozpocząć wdrażanie, musisz spełnić następujące wymagania wstępne:

- Dostęp do Konsola zarządzania AWS za pośrednictwem użytkownika, który może uruchomić Stosy AWS CloudFormation

- Znajomość nawigacji po AWS Lambda i Amazonka Lex Konsole

Flan-UL2wymaga jedynkiml.g5.12xlargedo wdrożenia, co może wymagać zwiększenia limitów zasobów poprzez: Bilet wsparcia. W naszym przykładzie używamyus-east-1jako region, dlatego pamiętaj o zwiększeniu limitu usług (w razie potrzeby) wus-east-1.

Wdróż za pomocą CloudFormation – Możesz wdrożyć rozwiązanie do us-east-1 klikając w poniższy przycisk:![]()

Wdrożenie rozwiązania zajmie około 20 minut i spowoduje utworzenie pliku LLMAgentStack stos, który:

- wdraża punkt końcowy SageMaker przy użyciu

Flan-UL2model od SageMaker JumpStart; - wdraża trzy funkcje Lambda:

LLMAgentOrchestrator,LLMAgentReturnsTool,LLMAgentOrdersToolOraz - wdraża AWS-Lexa bot, którego można użyć do przetestowania agenta:

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot.

Przetestuj rozwiązanie

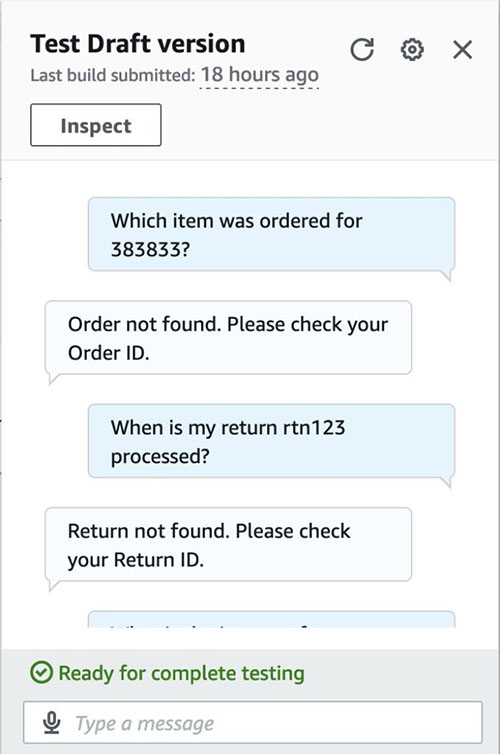

Stos wdraża bota Amazon Lex o nazwie Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Bota można używać do kompleksowego testowania agenta. Oto dodatkowy kompleksowy przewodnik dotyczący testowania botów AWS Amazon Lex z integracją Lambda i tego, jak integracja działa na wysokim poziomie. Krótko mówiąc, bot Amazon Lex to zasób zapewniający szybki interfejs użytkownika umożliwiający rozmowę z agentem LLM działającym w ramach zbudowanej przez nas funkcji Lambda (LLMAgentOrchestrator).

Przykładowe przypadki testowe, które należy rozważyć, są następujące:

- Prawidłowe zapytanie o zamówienie (na przykład „Jaki przedmiot został zamówiony

123456? ”)- Zamówienie „123456” jest zamówieniem prawidłowym, zatem należy spodziewać się rozsądnej odpowiedzi (np. „Ziołowe mydło do rąk”)

- Prawidłowe zapytanie dotyczące zwrotu o powrót (na przykład: „Kiedy wrócę

rtn003obrobiony?")- Należy spodziewać się rozsądnej odpowiedzi na temat statusu zwrotu.

- Nie ma znaczenia ani dla zwrotów, ani dla zamówień (na przykład: „Jaka jest teraz pogoda w Szkocji?”)

- Pytanie nieistotne dla zwrotów lub zamówień, dlatego należy zwrócić domyślną odpowiedź („Przepraszam, nie mogę odpowiedzieć na to pytanie”).

- Nieprawidłowe zapytanie o zamówienie (na przykład „Jaki przedmiot został zamówiony

383833? ”)- Identyfikator 383832 nie istnieje w zbiorze danych zamówień, dlatego powinniśmy bezpiecznie zakończyć niepowodzenie (na przykład „Nie znaleziono zamówienia. Sprawdź identyfikator zamówienia”).

- Nieprawidłowe zapytanie o zwrot (na przykład: „Kiedy wrócę

rtn123obrobiony?")- Podobnie identyfikator

rtn123nie istnieje w zbiorze danych zwrotów, a zatem powinno zakończyć się pomyślnym niepowodzeniem.

- Podobnie identyfikator

- Nieistotne zapytanie dotyczące zwrotu (na przykład: „Jaki jest wpływ zwrotu

rtn001o pokoju na świecie?”).- Pytanie to, choć wydaje się dotyczyć obowiązującego porządku, jest nieistotne. LLM służy do filtrowania pytań bez nieistotnego kontekstu.

Aby samodzielnie przeprowadzić te testy, zapoznaj się z instrukcjami.

- Na konsoli Amazon Lex (Konsola AWS > Amazon Lex), przejdź do bota pt

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Ten bot został już skonfigurowany do wywoływaniaLLMAgentOrchestratorFunkcja Lambda, gdyFallbackIntentjest wyzwalany. - W okienku nawigacji wybierz Zamiary.

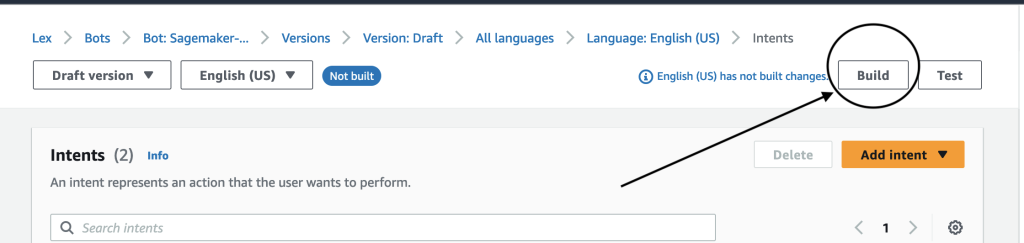

- Dodaj Budować w prawym górnym rogu

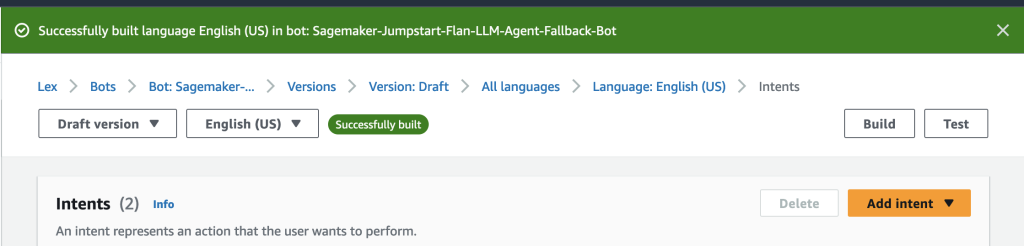

- 4. Poczekaj na zakończenie procesu kompilacji. Po zakończeniu pojawi się komunikat o powodzeniu, jak pokazano na poniższym zrzucie ekranu.

- Przetestuj bota, wprowadzając przypadki testowe.

Oczyszczanie

Aby uniknąć dodatkowych opłat, usuń zasoby utworzone przez nasze rozwiązanie, wykonując następujące kroki:

- Na Tworzenie chmury AWS konsoli, wybierz stos o nazwie

LLMAgentStack(lub wybrana przez Ciebie nazwa niestandardowa). - Dodaj Usuń

- Sprawdź, czy stos został usunięty z konsoli CloudFormation.

Ważne: sprawdź dwukrotnie, czy stos został pomyślnie usunięty, upewniając się, że Flan-UL2 punkt końcowy wnioskowania został usunięty.

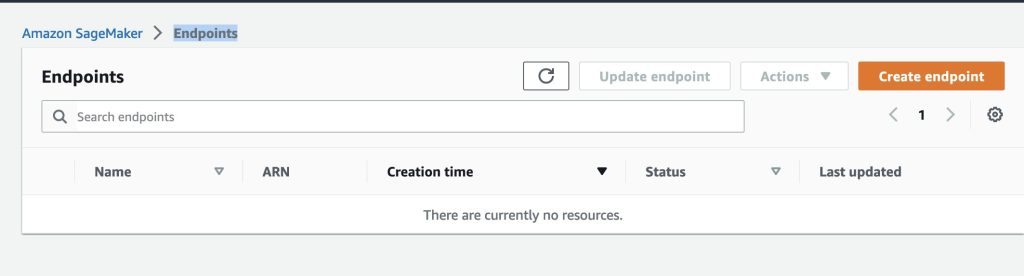

- Aby sprawdzić, przejdź do Konsola AWS > Sagemaker > Punkty końcowe > Wnioskowanie strona.

- Strona powinna zawierać listę wszystkich aktywnych punktów końcowych.

- Upewnij się,

sm-jumpstart-flan-bot-endpointnie istnieje, jak na poniższym zrzucie ekranu.

Uwagi dotyczące produkcji

Wdrożenie agentów LLM w środowisku produkcyjnym wymaga podjęcia dodatkowych kroków w celu zapewnienia niezawodności, wydajności i łatwości konserwacji. Oto kilka kwestii do rozważenia przed wdrożeniem agentów w środowisku produkcyjnym:

- Wybór modelu LLM do zasilania pętli agenta: W przypadku rozwiązania omawianego w tym poście użyliśmy a

Flan-UL2model bez dostrajania w celu planowania zadań lub wyboru narzędzi. W praktyce użycie LLM dostosowanego do bezpośredniego wysyłania żądań narzędzi lub API może zwiększyć niezawodność i wydajność, a także uprościć programowanie. Moglibyśmy dostroić LLM w zakresie zadań związanych z wyborem narzędzi lub zastosować model, który bezpośrednio dekoduje tokeny narzędzi, taki jak Toolformer.- Korzystanie z precyzyjnie dostrojonych modeli może również uprościć dodawanie, usuwanie i aktualizowanie narzędzi dostępnych dla agenta. W przypadku podejścia opartego wyłącznie na podpowiedziach aktualizacja narzędzi wymaga modyfikacji wszystkich podpowiedzi w orkiestratorze agenta, np. dotyczących planowania zadań, analizowania narzędzi i wysyłania narzędzi. Może to być kłopotliwe, a wydajność może się pogorszyć, jeśli w kontekście LLM zostanie udostępnionych zbyt wiele narzędzi.

- Niezawodność i wydajność: Agenci LLM mogą być zawodni, szczególnie w przypadku złożonych zadań, których nie można wykonać w kilku pętlach. Dodawanie weryfikacji wyników, ponownych prób, strukturyzowanie wyników z LLM w formacie JSON lub YAML oraz wymuszanie limitów czasu w celu zapewnienia luk awaryjnych dla LLM utkniętych w pętlach może zwiększyć niezawodność.

Wnioski

W tym poście omówiliśmy, jak zbudować agenta LLM, który może od podstaw wykorzystywać wiele narzędzi, wykorzystując szybką inżynierię niskiego poziomu, funkcje AWS Lambda i SageMaker JumpStart jako elementy składowe. Szczegółowo omówiliśmy architekturę agentów LLM i pętlę agentów. Koncepcje i architektura rozwiązań przedstawione w tym poście na blogu mogą być odpowiednie dla agentów korzystających z niewielkiej liczby predefiniowanego zestawu narzędzi. Omówiliśmy także kilka strategii wykorzystania agentów w produkcji. Agents for Bedrock, który jest w wersji zapoznawczej, zapewnia również zarządzane środowisko do tworzenia agentów z natywną obsługą wywołań narzędzi agenta.

O autorze

Johna Hwanga jest architektem generatywnej sztucznej inteligencji w AWS, ze szczególnym uwzględnieniem aplikacji modelu dużego języka (LLM), wektorowych baz danych i strategii produktów generatywnej sztucznej inteligencji. Jego pasją jest pomaganie firmom w rozwoju produktów AI/ML oraz przyszłości agentów i pilotów LLM. Przed dołączeniem do AWS był menedżerem produktu w Alexa, gdzie pomógł wprowadzić konwersacyjną sztuczną inteligencję na urządzenia mobilne, a także zajmował się handlem instrumentami pochodnymi w Morgan Stanley. Uzyskał tytuł licencjata z informatyki na Uniwersytecie Stanforda.

Johna Hwanga jest architektem generatywnej sztucznej inteligencji w AWS, ze szczególnym uwzględnieniem aplikacji modelu dużego języka (LLM), wektorowych baz danych i strategii produktów generatywnej sztucznej inteligencji. Jego pasją jest pomaganie firmom w rozwoju produktów AI/ML oraz przyszłości agentów i pilotów LLM. Przed dołączeniem do AWS był menedżerem produktu w Alexa, gdzie pomógł wprowadzić konwersacyjną sztuczną inteligencję na urządzenia mobilne, a także zajmował się handlem instrumentami pochodnymi w Morgan Stanley. Uzyskał tytuł licencjata z informatyki na Uniwersytecie Stanforda.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/learn-how-to-build-and-deploy-tool-using-llm-agents-using-aws-sagemaker-jumpstart-foundation-models/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 100

- 15%

- 19

- 20

- 200

- 24

- 27

- 500

- 7

- 9

- a

- zdolności

- zdolność

- O nas

- dostęp

- wykonać

- Stosownie

- odpowiednio

- w poprzek

- Działania

- działania

- aktywny

- w dodatku

- dodanie

- Dodatkowy

- administracyjny

- postępy

- Po

- ponownie

- Agent

- agentów

- AI

- AI / ML

- Alexa

- Wszystkie kategorie

- już

- również

- Amazonka

- Amazonka Lex

- Amazon Web Services

- wśród

- ilość

- an

- i

- odpowiedź

- każdy

- api

- Pszczoła

- Aplikacja

- Zastosowanie

- aplikacje

- podejście

- awanse

- właściwy

- architektura

- SĄ

- AS

- zapytać

- zakłada

- At

- zwiększona

- dostępny

- uniknąć

- AWS

- AWS Lambda

- z powrotem

- na podstawie

- BE

- stają się

- być

- zanim

- jest

- poniżej

- Berkeley

- Poza

- Bit

- Bloki

- Blog

- ciało

- Bot

- obie

- boty

- przynieść

- budować

- Budowanie

- wybudowany

- biznes

- ale

- przycisk

- by

- Obliczenia

- kalendarze

- wezwanie

- Połączenia

- CAN

- nie może

- możliwości

- walizka

- Etui

- Opłaty

- chatbot

- ZOBACZ

- Dodaj

- wybrany

- klient

- kombajny

- Firmy

- kompletny

- Zakończony

- kompleks

- kompleksowość

- składniki

- wszechstronny

- komputer

- Computer Science

- Koncepcje

- stwierdza,

- skonfigurowany

- Rozważać

- Rozważania

- Konsola

- stały

- kontekst

- kontynuować

- konwersacyjny

- konwersacyjna sztuczna inteligencja

- rdzeń

- Koszty:

- mógłby

- Stwórz

- stworzony

- niewygodny

- zwyczaj

- dane

- Baza danych

- Bazy danych

- zbiory danych

- Dni

- zdecydować

- dedykowane

- głębiej

- Domyślnie

- definicje

- próbny

- wykazać

- W zależności

- rozwijać

- wdrażane

- wdrażanie

- Wdrożenie

- wdraża się

- Pochodne

- zaprojektowany

- detal

- detale

- Ustalać

- oprogramowania

- urządzenia

- bezpośrednio

- omówione

- nurkować

- do

- robi

- zrobić

- napęd

- e

- e-commerce

- każdy

- z łatwością

- łatwo

- faktycznie

- bądź

- więcej

- zatrudnia

- koniec końców

- Punkt końcowy

- Egzekwowanie

- Inżynieria

- wzmacniać

- zapewnić

- zapewnione

- zapewnia

- zapewnienie

- wprowadzenie

- prawo

- błąd

- Błędy

- uciec

- szczególnie

- itp

- wydarzenie

- Każdy

- przykład

- przykłady

- Z wyjątkiem

- wyjątek

- wykonać

- istnieć

- oczekiwać

- doświadczenie

- zbadane

- rozciągać się

- rozciąga się

- zewnętrzny

- dodatkowy

- Wyciągi

- FAIL

- fałszywy

- Moda

- Cecha

- kilka

- Łąka

- filtrować

- finał

- pływ

- Skupiać

- następujący

- następujący sposób

- W razie zamówieenia projektu

- format

- formularze

- znaleziono

- Fundacja

- Ramy

- przyjazny

- od

- Spełnić

- w pełni

- funkcjonować

- funkcjonalności

- Funkcje

- przyszłość

- ogólnie

- Generować

- wygenerowane

- generacja

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- dany

- Go

- Ziemia

- poprowadzi

- Wydarzenie

- włazy

- Have

- mający

- he

- pomoc

- pomógł

- pomoc

- stąd

- tutaj

- hi

- Wysoki

- wysoko

- posiada

- GODZINY

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- Piasta

- człowiek

- czytelne dla człowieka

- i

- ID

- if

- Rezultat

- wdrożenia

- realizacja

- import

- podnieść

- in

- zawierać

- włączenie

- Zwiększać

- wzrastający

- Informacja

- wkład

- zapytanie

- wewnątrz

- instrukcje

- zintegrowany

- Integruje się

- integracja

- zamiar

- interakcji

- interakcji

- Interakcje

- odsetki

- najnowszych

- przedstawiać

- wprowadzono

- przywołany

- inwokuje

- angażować

- IT

- szt

- iteracje

- łączący

- jpg

- json

- Klawisz

- wiedza

- język

- duży

- uruchomić

- UCZYĆ SIĘ

- poziom

- lubić

- Ograniczenia

- Limity

- Lista

- LLM

- logika

- długo

- WYGLĄD

- robić

- WYKONUJE

- zarządzane

- i konserwacjami

- kierownik

- wiele

- Może..

- me

- oznaczać

- mechanizm

- Mechanizmy

- Spotkania

- wiadomość

- Metadane

- minut

- Aplikacje mobilne

- urządzenia mobilne

- model

- modele

- jeszcze

- Morgan

- Morgan Stanley

- większość

- wielokrotność

- my

- Nazwa

- O imieniu

- Nazwy

- rodzimy

- Nawigacja

- żeglujący

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- Nowości

- Następny

- Nie

- żaden

- szczególnie

- już dziś

- numer

- liczny

- przedmiot

- of

- często

- on

- pewnego razu

- ONE

- tylko

- przeciwny

- or

- zamówienie

- Zlecenia

- Inne

- Inaczej

- ludzkiej,

- na zewnątrz

- wydajność

- zewnętrzne

- koniec

- Przezwyciężać

- przegląd

- strona

- chleb

- parametry

- przechodzić

- namiętny

- Wzór

- pokój

- w oczekiwaniu

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wybierać

- doborowy

- krok po kroku

- planowanie

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- wtyczki

- polityka

- Post

- power

- powered

- praktyka

- przewidzieć

- przepowiednia

- warunki wstępne

- zapobiec

- Podgląd

- poprzedni

- Wcześniejszy

- wygląda tak

- Obrobiony

- przetwarzanie

- Produkt

- rozwój produktów

- product manager

- Produkcja

- Program

- Programy

- prawidłowo

- zapewniać

- pod warunkiem,

- zapewnia

- że

- cele

- Python

- pytanie

- pytania

- Szybki

- podnieść

- szybko

- Surowy

- Prawdziwy świat

- rozsądny

- rozpoznać

- zwrotu

- region

- niezawodność

- szczątki

- Usunięto

- usuwanie

- reprezentacja

- zażądać

- wywołań

- wymagać

- wymagany

- Wymaga

- Zasób

- Zasoby

- Odpowiadać

- odpowiedź

- odpowiedzialność

- odpowiedzialny

- dalsze

- powrót

- powrót

- powraca

- prawo

- Router

- Routing

- run

- bieganie

- s

- sagemaker

- zadowolony

- skalowalny

- scenariusz

- nauka

- zakres

- Szukaj

- wydaje

- wybrany

- wybór

- samokierowanie

- rozsądek

- oddzielny

- Sekwencja

- usługa

- Usługi

- zestaw

- kilka

- wysłane

- Wysyłka

- Short

- strzał

- powinien

- pokazać

- pokazane

- Prosty

- upraszczać

- po prostu

- pojedynczy

- mały

- So

- Tworzenie

- rozwiązanie

- kilka

- wyrafinowany

- Źródło

- Źródła

- specjalny

- wyspecjalizowanym

- specyficzny

- specyfikacja

- stos

- standalone

- Stanford

- Uniwersytet Stanford

- stanley

- początek

- rozpoczęty

- Zestawienie sprzedaży

- Rynek

- Ewolucja krok po kroku

- Cel

- Stop

- sklep

- strategie

- Strategia

- sznur

- strukturyzacja

- Następnie

- sukces

- Z powodzeniem

- taki

- sugerować

- odpowiedni

- wsparcie

- pewnie

- systemy

- stół

- Brać

- Zadania

- trwa

- biorąc

- Zadanie

- zadania

- powiedzieć

- test

- przetestowany

- Testowanie

- Testy

- że

- Połączenia

- Przyszłość

- ich

- następnie

- Tam.

- Te

- to

- tych

- trzy

- A zatem

- czasy

- do

- Żetony

- także

- narzędzie

- narzędzia

- Top

- Kwota produktów:

- śledzić

- handlowiec

- tradycyjny

- przeszkolony

- rozsierdzony

- próbować

- drugiej

- typowy

- zazwyczaj

- ui

- uniwersytet

- niepotrzebnie

- aż do

- Nowości

- aktualizowanie

- posługiwać się

- używany

- Użytkownik

- zastosowania

- za pomocą

- wykorzystać

- UPRAWOMOCNIĆ

- uprawomocnienie

- różnorodność

- wersja

- przez

- czekać

- była

- Droga..

- we

- Pogoda

- sieć

- usługi internetowe

- strony internetowe

- DOBRZE

- Co

- Co to jest

- jeśli chodzi o komunikację i motywację

- ilekroć

- czy

- który

- Podczas

- KIM

- będzie

- w

- w ciągu

- bez

- działa

- świat

- by

- jamla

- You

- Twój

- siebie

- zefirnet