Rozprzestrzenianie się sztucznej inteligencji pozwala jej wejść do dowolnego sektora, jakiego potrzebuje technologia. Jej wszechstronność przeniknęła do sił zbrojnych Stanów Zjednoczonych, a sztuczna inteligencja klasy wojskowej różni się od zwykłego wykorzystania generatywnego lub sposobu, w jaki jest wykorzystywana w zakładach produkcyjnych. Istotne jest rozróżnienie tego, co wyróżnia tę firmę pod względem rozwoju technologicznego. Cechy oznaczają, jak sztuczna inteligencja dostosowała się do standardów wojskowych.

Co definiuje sztuczną inteligencję na poziomie wojskowym?

Sztuczna inteligencja warta wdrożenia wojskowego obejmuje dwa aspekty – intencje i specyfikacje. Sztuczna inteligencja klasy wojskowej ma na celu ochronę narodów poprzez gromadzenie wiedzy i danych o przeciwnikach. Informacje są gromadzone z szybkością przekraczającą ludzkie możliwości, co zapewnia większe bezpieczeństwo i dokładność.

Sztuczna inteligencja przyspiesza przeprowadzanie dochodzeń i usprawnia przygotowania na niepokojące scenariusze, co skutkuje wyższą produktywnością.

„Sztuczna inteligencja klasy wojskowej jest pomocna na polu bitwy i poza nim w celach ofensywnych i defensywnych”.

Inne wykorzystanie odbywa się poprzez autonomiczność broń. Integruje się z bronią lub powiązanymi systemami kontroli. Wojskowe narzędzia sztucznej inteligencji nie są przeznaczone do sprzedaży komercyjnej ani do użytku prywatnego. Ich niebezpieczne właściwości muszą być zakryte przez rząd i podlegać rygorystycznym warunkom wstępnym dla zatwierdzania operatorów.

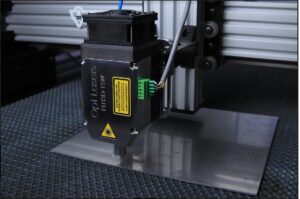

Siły zbrojne nie mogą używać sztucznej inteligencji, która nie spełnia standardów. Technologia wojskowa musi być odporna i solidna. Chociaż będzie bezpiecznie odpoczywał w miejscach o kontrolowanym klimacie, takich jak Pentagon, będzie również podróżować do wilgotnych, burzliwych środowisk. Firmy muszą robić specjalnie zaprojektowaną, gotową technologię wojskową uwzględnianie sztucznej inteligencji we wszystkich standardach, od samolotów po marynarkę.

Wojskowa sztuczna inteligencja musi posiadać zabezpieczenia uniemożliwiające użytkownikom wykorzystywanie obywateli. Technologia musi uwzględniać najnowocześniejsze praktyki w zakresie cyberbezpieczeństwa na rzecz bezpieczeństwa narodowego i obrony. W przeciwnym razie sztuczna inteligencja pozostawia więcej tylnych drzwi podmiotom zagrażającym, niż chroni. Na przykład, gdy wykorzystuje się go do skanowania zdjęć satelitarnych potencjalnych pól bitew, dane geolokalizacyjne muszą być zabezpieczone przed hakerami i nieuprawnionymi osobami.

Cechy te kształtują oczekiwania AI wobec armii Stanów Zjednoczonych. Pracownicy muszą dostosować swoje opisy stanowisk, uczestniczyć w większej liczbie szkoleń w zakresie umiejętności cyfrowych i rozumieć znaczenie zarządzania danymi w nowatorskiej infrastrukturze cyfrowej. Czy sztuczna inteligencja jest skuteczna w dotychczasowy sposób?

Marketing dla pracodawców korporacyjnych

Kwalifikator „klasa wojskowa” stał się terminem marketingowym. Pracownicy na całym świecie chcą korzyści płynących ze sztucznej inteligencji, zwłaszcza gdy pracownicy przenoszą się zdalnie. Konkluzje zależą od odpowiedzialności i zaufania, a przedsiębiorstwa potrzebują zabezpieczeń i narzędzi do zarządzania, które pozwolą pracownikom działać zgodnie z przepisami.

Tę samą technologię, której wojsko używa do oprogramowania szpiegującego, można przełożyć na nadzór w miejscu pracy. Programy, znane również jako bossware, wykonują zrzuty ekranu, monitorują produktywność pracowników i określają potencjał wzrostu.

Firmy Bossware mogą nie skupiać się na wojsku, ale technologia nadzoru pozostaje podobna. Oprogramowanie jako usługa maskuje proaktywne zaangażowanie pracowników, ale niektórzy nazywają to zarządzaniem reputacją lub oceną zagrożeń wewnętrznych, minimalizując zaufanie między pracownikami a menedżerami. Służby mają podobny potencjał w zakresie wykrywania terroryzmu, jak i powstrzymywania pracowników od zakładania związków zawodowych.

Używanie sztucznej inteligencji na poziomie wojskowym w ten sposób prowadzi do pytań etycznych, takich jak:

- Jak organy regulacyjne zareagują na to monitorowanie, skoro technologia nie powinna szkodzić ani denerwować obywateli?

- Jak bezpieczne są osoby fizyczne i ich dane?

- Czy dotkliwość wojskowej sztucznej inteligencji jest zbyt duża, aby ją przetestować, zanim dostępne będą odpowiednie badania?

- Czy manipulowanie technologią w stylu wojskowym na taką skalę komercyjną ma konsekwencje etyczne?

- Czy jest to bardziej kwestia praw człowieka niż kwestia bezpieczeństwa narodowego?

Jest zbyt wcześnie, aby to wyjaśnić, ale organy regulacyjne muszą omówić obawy, aby wyprzedzić narrację. W przeciwnym razie może to skutkować niepokojami społecznymi pomimo zamiaru AI ochrony narodu.

Generowanie odpowiedzi na kryzysy globalne

Pentagon i Departament Obrony przenoszą generatywną sztuczną inteligencję na wyższy poziom. Podczas gdy laicy proszą ChatGPT o pisanie wierszy i opowiadanie dowcipów, Departament Obrony chce eksperymentować z generowaniem rozwiązań problemów globalnych. Procesy biurokratyczne wymagają organizowania spotkań, tworzenia prezentacji i przechodzenia przez wiele szczebli dowodzenia w celu zatwierdzenia działań krajowych. A co jeśli AI przyspieszy preambułę?

Szczegóły eksperymentu są ściśle tajne, ale wyniki sugerują, że opracowanie reakcji armii Stanów Zjednoczonych na narastający problem może zająć 10 minut zamiast kilku tygodni. Urzędnicy wykorzystują duże modele językowe oparte na poufnych informacjach, aby sprawdzić, jak dobrze konstruują praktyczne i praktyczne pomysły.

Podobnie jak w przypadku całej sztucznej inteligencji klasy wojskowej, w praktyce istnieją oczywiste obawy. Generatywna sztuczna inteligencja jest podatna na ataki hakerskie, podczas których cyberprzestępcy zanieczyszczają zbiory danych, aby zwiększyć stronniczość lub prawdopodobieństwo wystąpienia halucynacji.

„Sztuczna inteligencja może jednego dnia przedstawić racjonalny plan, a następnego wkraść się do złośliwego oprogramowania lub niezrozumiałych nonsensów. ”

Jeden model sztucznej inteligencji posiada zbiór danych obejmujący 60,000 XNUMX stron dokumentacji chińskiej i amerykańskiej, który mógłby wyłonić zwycięzcę potencjalnej wojny. Jednak niezrównoważone informacje wypaczają wyniki, zwłaszcza bez odpowiedniego nadzoru.

Udział w wyścigu zbrojeń AI

Najbardziej prawdopodobnym zastosowaniem wojskowej sztucznej inteligencji jest broń. Obywatele obawiają się, że od chwili powstania ma ona ścieżkę podobną do bomby atomowej – zdolną do wywołania ogólnoświatowego konfliktu, ale tym razem jest autonomiczna lub zdalnie sterowana. Testy wykazują zdolność sztucznej inteligencji do zrzucania bomb na pola bitew analizowane jako siatka ze względną dokładnością. Im więcej sił zbrojnych USA ćwiczy z ustawieniami, tym większe prawdopodobieństwo, że ataki zostaną przeprowadzone bez interwencji.

Skomplikowane programowanie powoduje wystrzelenie rakiety napędzanej sztuczną inteligencją, gdy cała załoga śpi w łóżku, ponieważ warunki środowiskowe spełniają wymagane parametry. Stany Zjednoczone starają się utrzymać znaczenie, ale konkurencyjny sposób myślenia Rosji i Chin wywołuje napięcia.

Doszło do tego, że sztuczna inteligencja klasy wojskowej w broni autonomicznej może zostać zakazana na arenie międzynarodowej. Systemy te mogą stać się niekontrolowane przez ludzi. W nadchodzących latach rządy muszą omówić rzeczywistość związaną z tą bronią służącą do oceny stanu wojennego.

Sztuczna inteligencja typu open source może przechwycić jak najwięcej danych i zapewnić jak największą dostępność technologii. Jednak tak jest trudniej wprowadzić ogólne zakazynawet w przypadku broni AI klasy wojskowej. Zbyt wiele stron ma dostęp do tej technologii i odebranie jej byłoby niemożliwe.

Jak USA wykorzystują sztuczną inteligencję

Wdrożenie sztucznej inteligencji w USA do celów wojskowych inspiruje do jej stosowania na całym świecie. Musi uważać się za światowego lidera w tym sektorze, ponieważ zasoby i budżety obronne są wyższe niż w przypadku innych krajów. Kraj ma potencjał do wprowadzania innowacji i wykorzystania sztucznej inteligencji na poziomie wojskowym w sposób, jakiego świat nigdy nie widział – na dobre i na złe.

Zachowanie ostrożności ma kluczowe znaczenie dla etycznego wdrożenia, podobnie jak wnikliwa weryfikacja zewnętrznych dostawców i operatorów wewnętrznych. Priorytetem wojskowej sztucznej inteligencji musi być zwiększenie bezpieczeństwa i jeśli ta trajektoria będzie się utrzymywać, świat to zauważy.

Przeczytaj także 5 rzeczy, które musisz wiedzieć o sztucznej inteligencji analizującej profile smaków kawy

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://www.aiiottalk.com/military-grade-ai/

- :ma

- :Jest

- :nie

- :Gdzie

- 000

- 1

- 10

- 60

- a

- zdolność

- O nas

- dostęp

- dostępny

- odpowiedzialność

- precyzja

- Działania

- aktorzy

- Po

- przed

- przed

- AI

- Zasilany AI

- Cele

- samolot

- Wszystkie kategorie

- pozwala

- wzdłuż

- również

- Chociaż

- an

- analizowane

- Analizując

- i

- każdy

- osobno

- Zatwierdzać

- SĄ

- uzbrojony

- Ramiona

- sztuczny

- AS

- oszacowanie

- At

- Ataki

- Próby

- upoważniony

- autonomiczny

- dostępny

- z dala

- Backdoory

- zakazany

- Battlefield

- BE

- bo

- stają się

- zanim

- za

- Korzyści

- Ulepsz Swój

- pomiędzy

- stronniczość

- ciała

- bomba

- Dolny

- Budżety

- biurokratyczny

- ale

- by

- wezwanie

- CAN

- nie może

- zdolność

- zdolny

- casual

- Przyczyny

- ostrożność

- więzy

- Charakterystyka

- ChatGPT

- Chińskie

- chiński

- Dodaj

- Obywatele

- cywilny

- Kawa

- przyjście

- handlowy

- Firmy

- konkurowania

- konkurencyjny

- Troska

- Obawy

- Warunki

- konflikt

- Rozważać

- ciągły

- kontrola

- Korporacyjny

- mógłby

- kraj

- Tworzenie

- istotny

- Obecnie

- cyberprzestępcy

- Bezpieczeństwo cybernetyczne

- Niebezpieczny

- dane

- zbiór danych

- zestawy danych

- dzień

- Obrona

- obronny

- Definiuje

- wykazać

- Departament

- Departament Obrony

- zaprojektowany

- Mimo

- detale

- Ustalać

- oprogramowania

- cyfrowy

- dyskutować

- odrębny

- rozróżniać

- dokumentacja

- robi

- Spadek

- Efektywne

- Pracownik

- pracowników

- zatrudnia

- obejmuje

- zaręczynowy

- Wchodzę

- przedsiębiorstwa

- Cały

- środowiskowy

- środowiska

- szczególnie

- ustanowienie

- etyczny

- Parzyste

- oczywisty

- przykład

- oczekiwania

- przyspiesza

- eksperyment

- wykorzystywanie

- aspekty

- nie

- strach

- natura

- W razie zamówieenia projektu

- Siły

- od

- zebranie

- generujący

- generatywny

- generatywna sztuczna inteligencja

- otrzymać

- Globalne

- Go

- będzie

- zarządzanie

- rządowy

- Rządy

- chwycić

- Krata

- Wzrost

- potencjał wzrostu

- hakerzy

- włamanie

- zaszkodzić

- Have

- pomocny

- wyższy

- Zawias

- W jaki sposób

- Jednak

- HTTPS

- człowiek

- prawa człowieka

- wilgotny

- pomysły

- if

- zdjęcia

- realizacja

- znaczenie

- niemożliwy

- in

- początek

- włączać

- włączenie

- Zwiększać

- wzrastający

- osób

- Informacja

- poinformowany

- Infrastruktura

- wprowadzać innowacje

- Insider

- inspiruje

- zamiast

- Integruje się

- Zamiar

- intencje

- wewnętrzny

- międzynarodowo

- interwencja

- najnowszych

- Dochodzenia

- problem

- problemy

- IT

- JEGO

- samo

- Praca

- jpg

- Trzymać

- Klawisz

- Wiedzieć

- wiedza

- znany

- język

- duży

- lider

- Wyprowadzenia

- poziom

- Dźwignia

- lubić

- prawdopodobieństwo

- Prawdopodobnie

- Linia

- linie

- umiejętność czytania i pisania

- utrzymać

- robić

- malware

- i konserwacjami

- Narzędzia zarządzania

- Zarządzający

- manipulowanie

- produkcja

- wiele

- Marketing

- Może..

- Poznaj nasz

- Spotkania

- wojsko

- Wojsko

- Mindset

- minimalizowanie

- minut

- model

- modele

- monitor

- monitorowanie

- jeszcze

- większość

- dużo

- wielokrotność

- wiele łańcuchów

- musi

- NARRACJA

- naród

- narodowy

- bezpieczeństwo narodowe

- Narodów

- Potrzebować

- nigdy

- Następny

- Zauważyć..

- powieść

- of

- poza

- obraźliwy

- urzędnicy

- on

- ONE

- eksploatowane

- działanie

- operatorzy

- or

- Inne

- Inaczej

- Przeoczenie

- stron

- parametry

- strony

- ścieżka

- pentagon

- Miejsca

- krok po kroku

- plato

- Analiza danych Platona

- PlatoDane

- punkt

- poza

- możliwy

- potencjał

- Praktyczny

- praktyka

- praktyki

- przygotowanie

- warunki wstępne

- Presentations

- zapobieganie

- priorytet

- prywatny

- Proaktywne

- Problem

- procesów

- wydajność

- Programowanie

- Programy

- obiecujący

- właściwy

- niska zabudowa

- chronić

- cele

- pytania

- Wyścig

- Racjonalnie

- Czytaj

- Rzeczywistość

- Regulatory

- regulacyjne

- związane z

- względny

- mających znaczenie

- pozostawać

- szczątki

- zdalny

- reperkusje

- reputacja

- wymagać

- Badania naukowe

- sprężysty

- Zasoby

- Odpowiadać

- odpowiedź

- Odpowiedzi

- REST

- dalsze

- wynikły

- Efekt

- prawa

- krzepki

- Rosja

- s

- "bezpiecznym"

- zabezpieczenia

- bezpiecznie

- Bezpieczeństwo

- sprzedaż

- taki sam

- satelita

- Skala

- skanować

- scenariusze

- screeny

- Tajemnica

- sektor

- bezpieczeństwo

- widzieć

- widziany

- Usługi

- zestaw

- Zestawy

- w panelu ustawień

- kilka

- Shape

- powinien

- podobny

- Rozwiązania

- kilka

- wkrótce

- Specyfikacje

- prędkość

- spyware

- Personel

- standardy

- Zjednoczone

- Ścisły

- taki

- sugerować

- inwigilacja

- systemy

- Brać

- biorąc

- tech

- techniczny

- Technologia

- powiedzieć

- Napięcia

- semestr

- Testy

- niż

- że

- Połączenia

- Informacje

- świat

- ich

- Im

- Tam.

- Te

- rzeczy

- innych firm

- to

- myśl

- groźba

- podmioty grożące

- Przez

- czas

- do

- także

- narzędzia

- Top

- Trening

- trajektoria

- podróżować

- niepokojące

- Zaufaj

- burzliwie

- drugiej

- nas

- odkryć

- w trakcie

- zrozumieć

- Zjednoczony

- United States

- niepokój

- zaktualizowane

- Stosowanie

- posługiwać się

- Użytkownicy

- za pomocą

- sprzedawców

- wszechstronność

- istotny

- chcieć

- chce

- wojna

- Droga..

- sposoby

- Bronie

- tygodni

- DOBRZE

- Co

- jeśli chodzi o komunikację i motywację

- który

- Podczas

- będzie

- w

- bez

- pracownik

- pracowników

- Stanowisko pracy

- świat

- na calym swiecie

- gorzej

- by

- napisać

- lat

- You

- zefirnet