A obtenção da certificação AWS pode ajudá-lo a impulsionar sua carreira, esteja você procurando uma nova função, mostre suas habilidades para assumir um novo projeto ou torne-se o principal especialista de sua equipe. E como os exames da AWS Certification são criados por especialistas na função ou área técnica relevante, a preparação para um desses exames ajuda você a desenvolver as habilidades necessárias identificadas por profissionais qualificados na área.

Ler a página de perguntas frequentes dos serviços da AWS relevantes para seu exame de certificação é importante para adquirir uma compreensão mais profunda do serviço. No entanto, isso pode levar algum tempo. A leitura das perguntas frequentes de até mesmo um serviço pode levar meio dia para ser lida e compreendida. Por exemplo, o Amazon Sage Maker O FAQ contém cerca de 33 páginas (impressas) de conteúdo apenas no SageMaker.

Não seria uma experiência de aprendizado mais fácil e divertida se você pudesse usar um sistema para se testar nas páginas de perguntas frequentes do serviço AWS? Na verdade, você pode desenvolver tal sistema usando modelos de linguagem de última geração e algumas linhas de Python.

Nesta postagem, apresentamos um guia abrangente de implantação de uma solução de questionário de múltipla escolha para as páginas de perguntas frequentes de qualquer serviço da AWS, com base no modelo de fundação AI21 Jurassic-2 Jumbo Instruct em Início rápido do Amazon SageMaker.

Modelos de grande linguagem

Nos últimos anos, os modelos de linguagem tiveram um grande aumento em tamanho e popularidade. Em 2018, BERT-large fez sua estreia com seus 340 milhões de parâmetros e arquitetura de transformador inovadora, estabelecendo a referência para desempenho em tarefas de NLP. Em poucos anos, o estado da arte em termos de tamanho do modelo aumentou mais de 500 vezes; O GPT-3 e o Bloom 176 B da OpenAI, ambos com 175 bilhões de parâmetros, e o AI21 Jurassic-2 Jumbo Instruct com 178 bilhões de parâmetros são apenas três exemplos de modelos de linguagem grande (LLMs) elevando o nível de precisão do processamento de linguagem natural (NLP).

Modelos de fundação do SageMaker

O SageMaker fornece uma variedade de modelos de hubs de modelos populares, incluindo Hugging Face, PyTorch Hub e TensorFlow Hub, e modelos proprietários de AI21, Cohere e LightOn, que você pode acessar em seu fluxo de trabalho de desenvolvimento de aprendizado de máquina (ML) no SageMaker. Avanços recentes em ML deram origem a uma nova classe de modelos conhecida como modelos de fundação, que têm bilhões de parâmetros e são treinados em grandes quantidades de dados. Esses modelos de base podem ser adaptados a uma ampla variedade de casos de uso, como resumo de texto, geração de arte digital e tradução de idiomas. Como esses modelos podem ser caros para treinar, os clientes desejam usar modelos de fundação pré-treinados existentes e ajustá-los conforme necessário, em vez de treinar esses modelos por conta própria. O SageMaker fornece uma lista selecionada de modelos que você pode escolher no console do SageMaker.

Com o JumpStart, você pode encontrar modelos de fundação de diferentes fornecedores, permitindo que você comece a usar os modelos de fundação rapidamente. Você pode revisar as características do modelo e os termos de uso e experimentar esses modelos usando um widget de interface do usuário de teste. Quando estiver pronto para usar um modelo de base em escala, você poderá fazer isso facilmente sem sair do SageMaker usando notebooks pré-construídos de fornecedores de modelos. Seus dados, sejam usados para avaliar ou usar o modelo em escala, nunca são compartilhados com terceiros porque os modelos são hospedados e implantados na AWS.

Instrução Jumbo AI21 Jurássico-2

Jurassic-2 Jumbo Instruct é um LLM da AI21 Labs que pode ser aplicado a qualquer tarefa de compreensão ou geração de linguagem. Ele é otimizado para seguir instruções e contexto de linguagem natural, portanto, não há necessidade de fornecer exemplos. O endpoint vem pré-carregado com o modelo e pronto para atender consultas por meio de uma API fácil de usar e do Python SDK, para que você possa começar a trabalhar. Jurassic-2 Jumbo Instruct é um dos melhores alunos do LEME, principalmente em tarefas relacionadas à leitura e escrita.

Visão geral da solução

Nas seções a seguir, passamos pelas etapas para testar o modelo de instrução Jurassic-2 Jumbo no SageMaker:

- Escolha o modelo de instrução Jurassic-2 Jumbo no console do SageMaker.

- Avalie o modelo usando o playground.

- Use um notebook associado ao modelo de base para implantá-lo em seu ambiente.

Acesse o Jurassic-2 Jumbo Instruct por meio do console do SageMaker

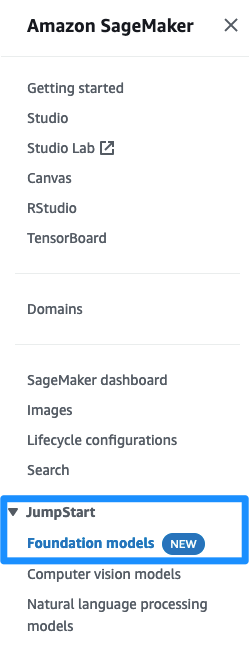

A primeira etapa é fazer login no console do SageMaker. Sob Acelerador no painel de navegação, escolha modelos de fundação para solicitar acesso à lista de modelos.

Depois que sua conta for listada como permitida, você poderá ver uma lista de modelos nesta página e procurar o modelo Jurassic-2 Jumbo Instruct.

Avalie o modelo Jurassic-2 Jumbo Instruct no playground modelo

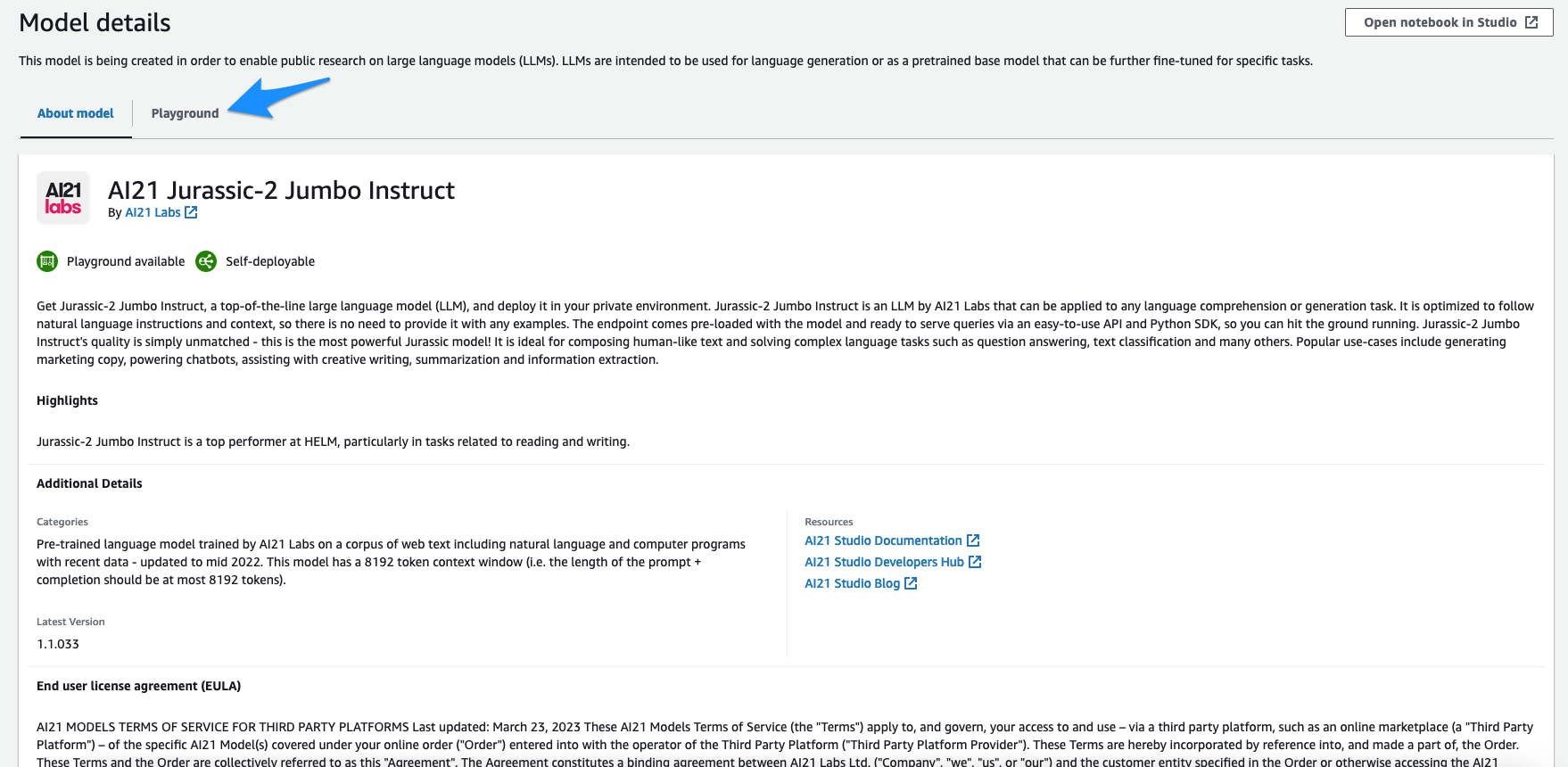

Na lista AI21 Jurassic-2 Jumbo Instruct, escolha Ver Modelo. Você verá uma descrição do modelo e as tarefas que você pode executar. Leia o EULA do modelo antes de prosseguir.

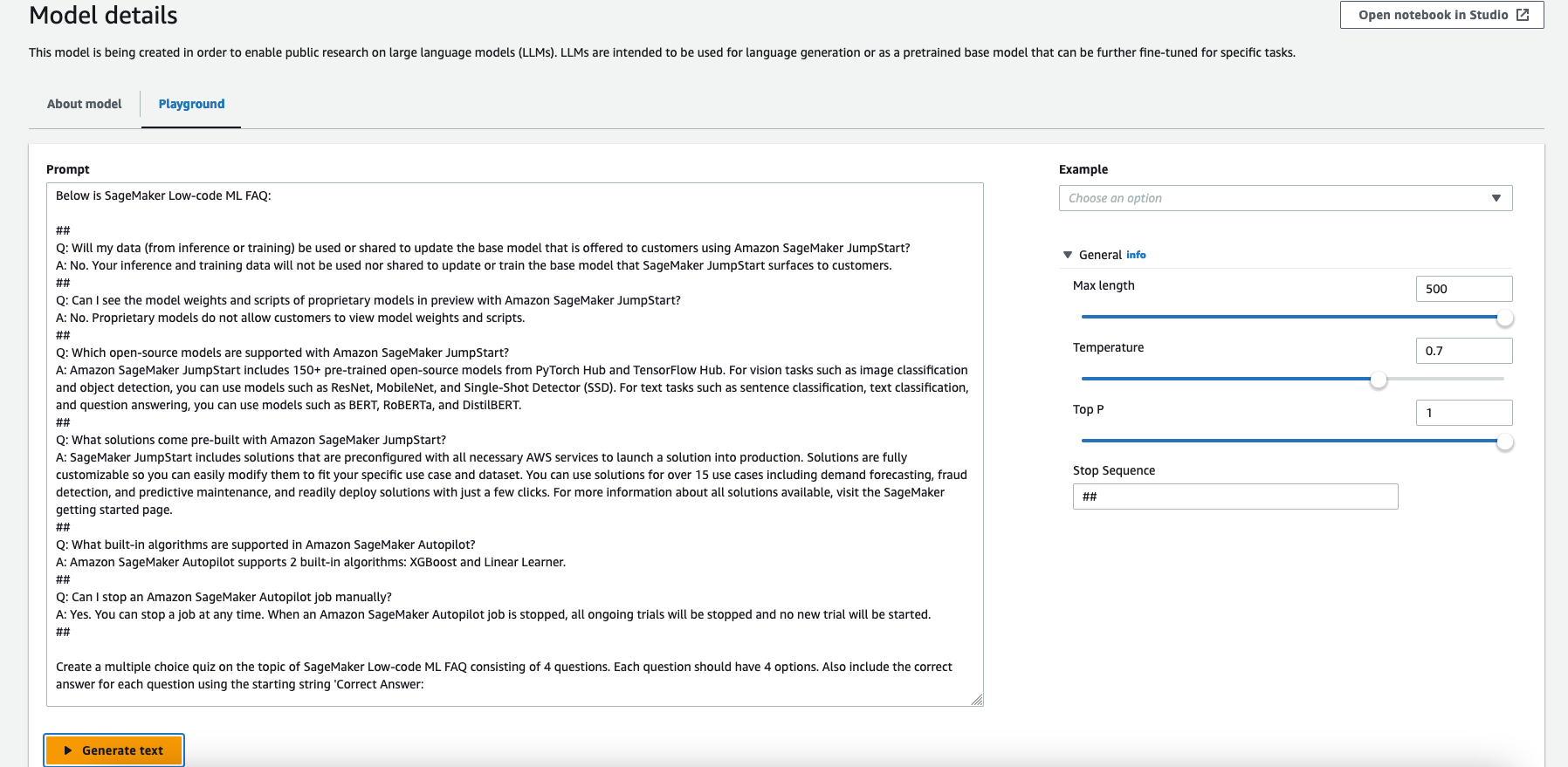

Vamos primeiro experimentar o modelo para gerar um teste com base na página de perguntas frequentes do SageMaker. Navegue até o Playground aba.

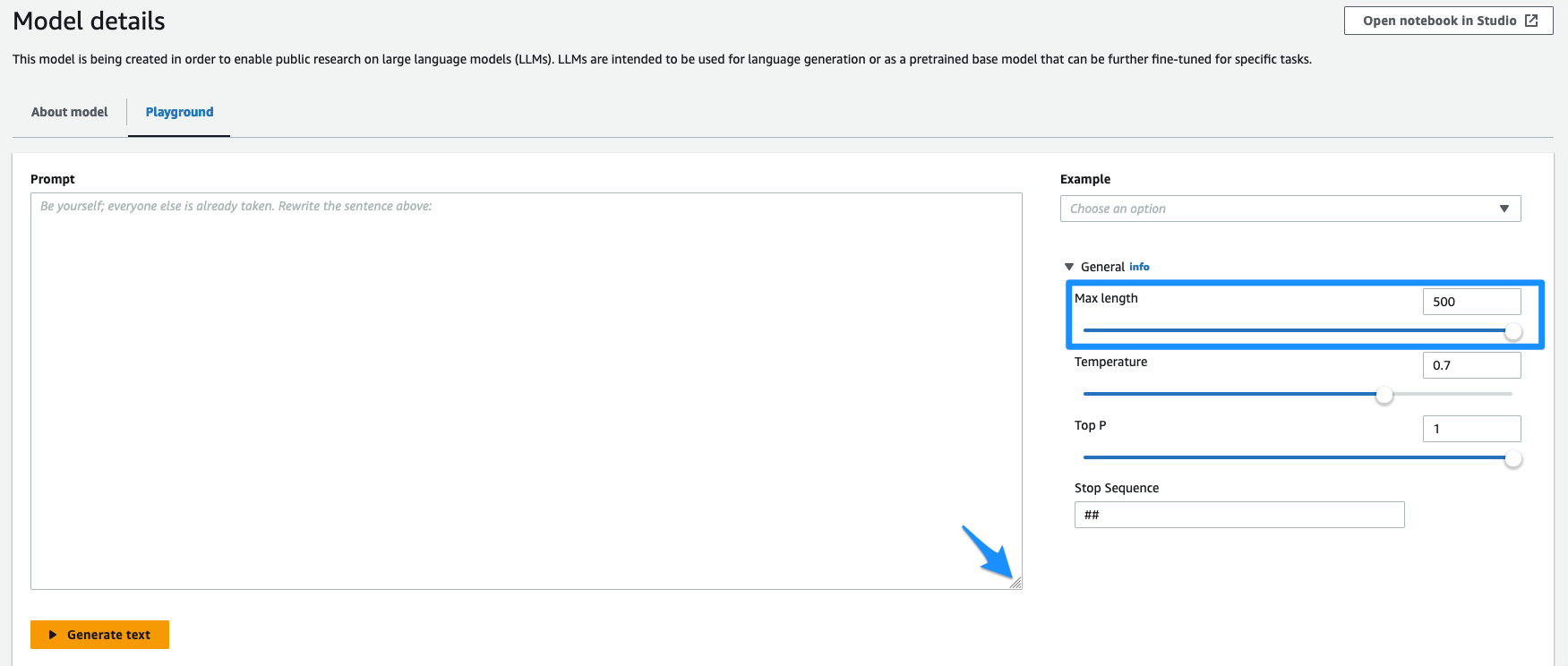

No Playground guia, você pode fornecer prompts de amostra para o modelo Jurassic-2 Jumbo Instruct e visualizar a saída.

Observe que você pode usar no máximo 500 tokens. Definimos o comprimento máximo para 500, que é o número máximo de tokens a serem gerados. Este modelo tem uma janela de contexto de 8,192 tokens (o comprimento do prompt mais a conclusão deve ser de no máximo 8,192 tokens).

Para facilitar a visualização do prompt, você pode ampliar o Prompt caixa.

Como podemos usar no máximo 500 tokens, pegamos uma pequena parte do Página de perguntas frequentes do Amazon SageMaker, ML de baixo código seção, para nosso prompt de teste.

Usamos o seguinte prompt:

A engenharia de prompt é um processo iterativo. Você deve ser claro e específico e dar ao modelo tempo para pensar.

Aqui especificamos o contexto com ## como sequências de parada, que sinalizam ao modelo para parar de gerar depois que esse caractere ou string é gerado. É útil ao usar um prompt de poucos disparos.

Em seguida, somos claros e muito específicos em nosso prompt, solicitando um questionário de múltipla escolha, composto por quatro questões com quatro opções. Pedimos ao modelo para incluir a resposta correta para cada pergunta usando a string inicial 'Correct Answer:' para que possamos analisá-lo mais tarde usando Python:

Um prompt bem projetado pode tornar o modelo mais criativo e generalizado para que ele possa se adaptar facilmente a novas tarefas. Os prompts também podem ajudar a incorporar conhecimento de domínio em tarefas específicas e melhorar a interpretabilidade. A engenharia imediata pode melhorar muito o desempenho dos modelos de aprendizado de tiro zero e poucos tiros. A criação de prompts de alta qualidade requer uma consideração cuidadosa da tarefa em mãos, bem como uma compreensão profunda dos pontos fortes e limitações do modelo.

No escopo deste post, não cobrimos mais essa ampla área.

Copie o prompt e insira-o no Prompt caixa, em seguida, escolha Gerar texto.

Isso envia o prompt para o modelo Jurassic-2 Jumbo Instruct para inferência. Observe que a experimentação no playground é gratuita.

Lembre-se também de que, apesar da natureza de ponta dos LLMs, eles ainda são propensos a preconceitos, erros e alucinações.

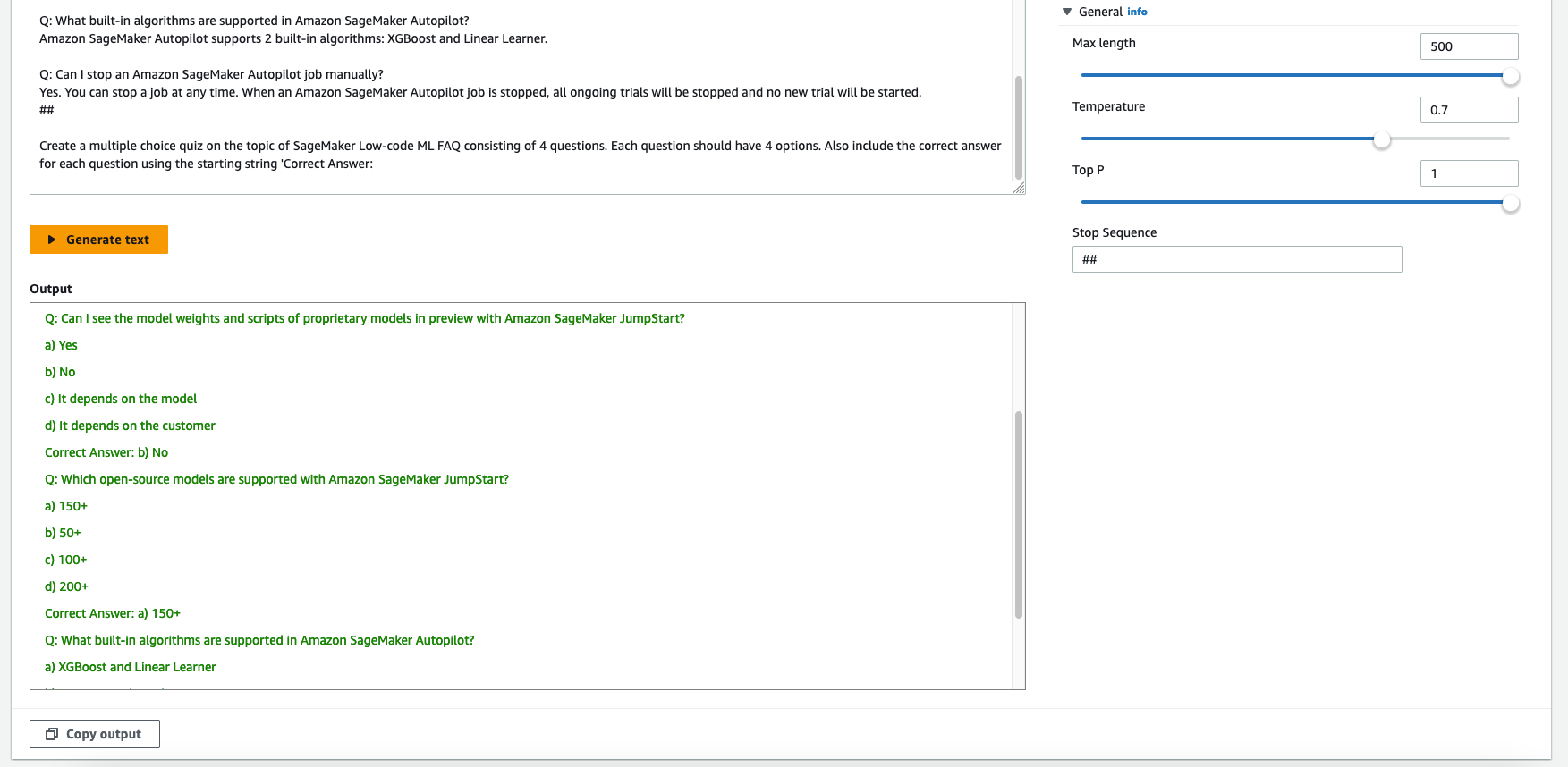

Depois de ler a saída do modelo completa e cuidadosamente, podemos ver que o modelo gerou um bom questionário!

Depois de brincar com o modelo, é hora de usar o notebook e implantá-lo como um endpoint em seu ambiente. Usamos uma pequena função Python para analisar a saída e simular um teste interativo.

Implante o modelo de base Jurassic-2 Jumbo Instruct a partir de um notebook

Você pode usar o seguinte caderno de amostra para implantar o Jurassic-2 Jumbo Instruct usando o SageMaker. Observe que este exemplo usa uma instância ml.p4d.24xlarge. Se o limite padrão para sua conta da AWS for 0, você precisará solicitar aumento de limite para esta instância de GPU.

Vamos criar o endpoint usando a inferência do SageMaker. Primeiro, definimos as variáveis necessárias e, em seguida, implantamos o modelo do pacote de modelos:

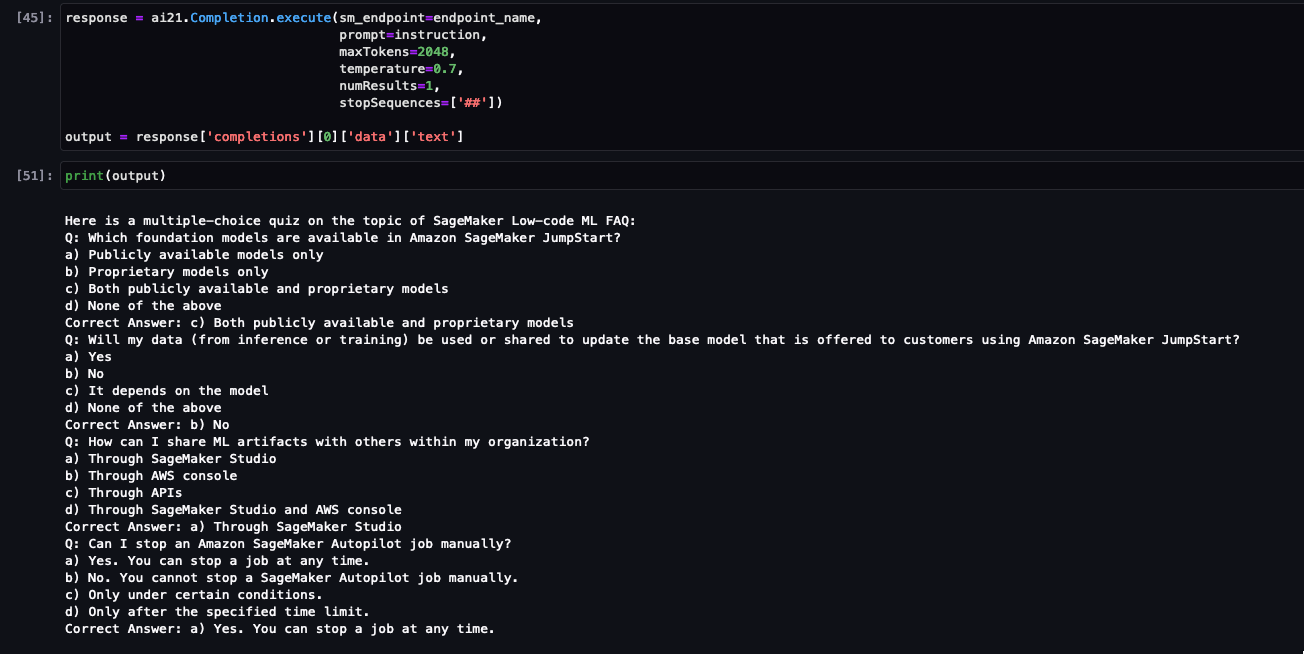

Após a implantação do endpoint, você pode executar consultas de inferência no modelo.

Após a implantação do modelo, você pode interagir com o endpoint implantado usando o seguinte trecho de código:

Com o modelo de base Jurassic-2 Jumbo Instruct implantado em um endpoint SageMaker de instância ml.p4d.24xlarge, você pode usar um prompt com 4,096 tokens. Você pode seguir o mesmo prompt que usamos no playground e adicionar muitas outras perguntas. Neste exemplo, adicionamos todo o FAQ ML de baixo código seção como contexto no prompt.

Podemos ver o resultado do modelo, que gerou um questionário de múltipla escolha com quatro questões e quatro opções para cada questão.

Agora você pode desenvolver uma função Python para analisar a saída e criar um questionário interativo de múltipla escolha.

É bastante simples desenvolver tal função com algumas linhas de código. Você pode analisar a resposta facilmente porque o modelo criou uma linha com “Resposta correta: ” para cada pergunta, exatamente como solicitamos no prompt. Não fornecemos o código Python para a geração do questionário no escopo desta postagem.

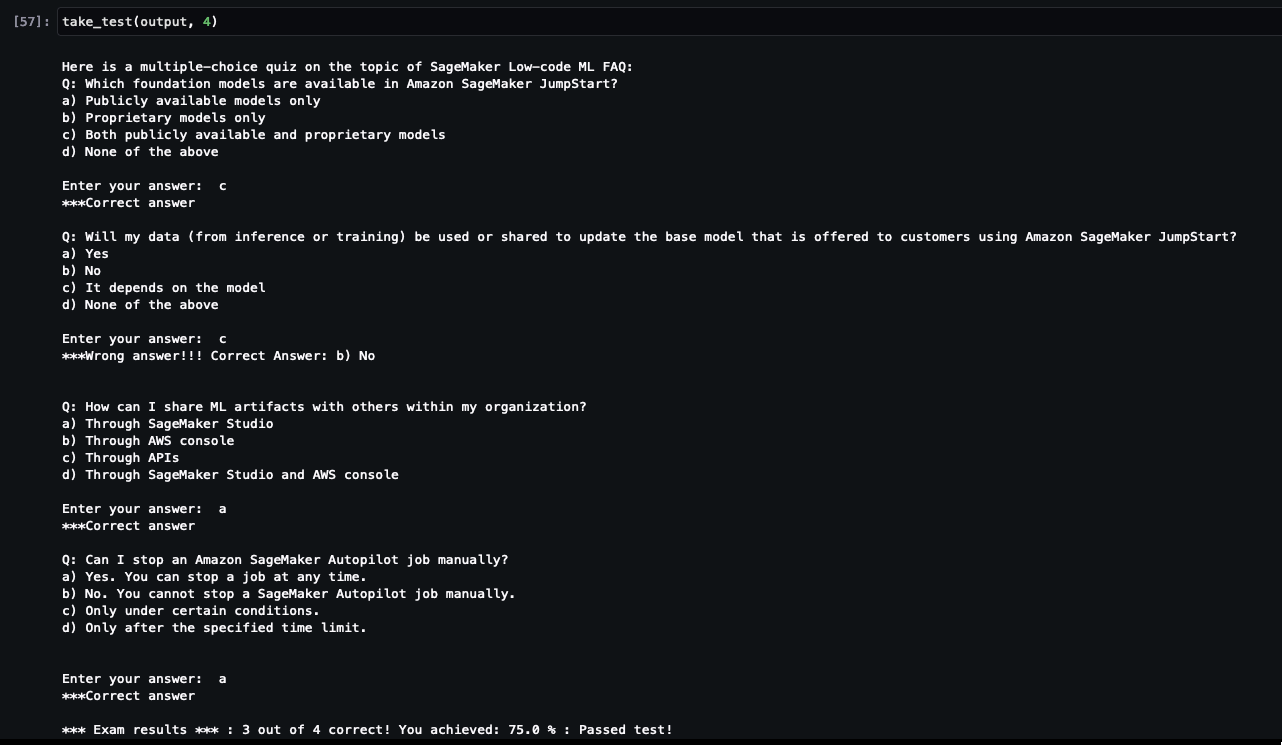

Executar o questionário no notebook

Usando a função Python que criamos anteriormente e a saída do modelo de base Jurassic-2 Jumbo Instruct, executamos o questionário interativo no notebook.

Você pode ver que respondi três das quatro perguntas corretamente e obtive uma nota de 75%. Talvez eu precise ler o FAQ do SageMaker mais algumas vezes!

limpar

Depois de experimentar o endpoint, certifique-se de remover o endpoint de inferência do SageMaker e o modelo para evitar cobranças:

Conclusão

Nesta postagem, mostramos como você pode testar e usar o modelo Jurassic-21 Jumbo Instruct do AI2 usando o SageMaker para criar um sistema automatizado de geração de questionários. Isso foi obtido usando um prompt bastante simples com o texto de uma página de perguntas frequentes do SageMaker disponível publicamente incorporado e algumas linhas de código Python.

Semelhante a este exemplo mencionado na postagem, você pode personalizar um modelo de base para o seu negócio com apenas alguns exemplos rotulados. Como todos os dados são criptografados e não saem de sua conta da AWS, você pode confiar que seus dados permanecerão privados e confidenciais.

Solicite acesso a experimente o modelo de fundação no SageMaker hoje e deixe-nos saber seus comentários!

Sobre o autor

Eitan Sela é um arquiteto de soluções especialista em aprendizado de máquina da Amazon Web Services. Ele trabalha com clientes da AWS para fornecer orientação e assistência técnica, ajudando-os a criar e operar soluções de machine learning na AWS. Em seu tempo livre, Eitan gosta de correr e ler os artigos mais recentes de aprendizado de máquina.

Eitan Sela é um arquiteto de soluções especialista em aprendizado de máquina da Amazon Web Services. Ele trabalha com clientes da AWS para fornecer orientação e assistência técnica, ajudando-os a criar e operar soluções de machine learning na AWS. Em seu tempo livre, Eitan gosta de correr e ler os artigos mais recentes de aprendizado de máquina.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoAiStream. Inteligência de Dados Web3. Conhecimento Amplificado. Acesse aqui.

- Cunhando o Futuro com Adryenn Ashley. Acesse aqui.

- Compre e venda ações em empresas PRE-IPO com PREIPO®. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/accelerate-your-learning-towards-aws-certification-exams-with-automated-quiz-generation-using-amazon-sagemaker-foundations-models/

- :tem

- :é

- :não

- 1

- 100

- 14

- 15%

- 17

- 2018

- 23

- 500

- 7

- 8

- 9

- a

- Sobre

- acelerar

- Acesso

- Conta

- precisão

- alcançado

- adquirir

- adaptar

- adicionar

- adicionado

- avanços

- Depois de

- contra

- algoritmos

- Todos os Produtos

- permitir

- tb

- Amazon

- Amazon Sage Maker

- Piloto automático do Amazon SageMaker

- JumpStart do Amazon SageMaker

- Amazon Web Services

- quantidades

- an

- e

- responder

- qualquer

- api

- aplicado

- arquitetura

- SOMOS

- ÁREA

- Arte

- artigos

- AS

- Assistência

- associado

- At

- Automatizado

- disponível

- AWS

- Barra

- base

- baseado

- BE

- Porque

- tornam-se

- antes

- referência

- vieses

- bilhão

- bilhões

- Florescer

- ambos

- Caixa

- construir

- construídas em

- negócio

- by

- CAN

- Oportunidades

- cuidadoso

- cuidadosamente

- casas

- casos

- FDA

- Non-GMO

- personagem

- características

- acusações

- escolha

- Escolha

- classe

- classificação

- remover filtragem

- código

- como

- vem

- realização

- compreensivo

- consideração

- Consistindo

- cônsul

- contém

- conteúdo

- contexto

- correta

- poderia

- cobrir

- crio

- criado

- Criar

- Criatividade

- comissariada

- Clientes

- personalizável

- personalizar

- ponta

- dados,

- dia

- profundo

- mais profunda

- Padrão

- Demanda

- Previsão de demanda

- implantar

- implantado

- Implantação

- descrição

- Apesar de

- Detecção

- desenvolver

- Desenvolvimento

- diferente

- digital

- Art digitais

- do

- Não faz

- domínio

- não

- cada

- Mais cedo

- mais fácil

- facilmente

- fácil de usar

- incorporado

- permitindo

- criptografada

- Ponto final

- Engenharia

- prolongar

- Entrar

- Todo

- Meio Ambiente

- erros

- avaliação

- Mesmo

- exatamente

- exame

- exemplo

- exemplos

- existente

- caro

- vasta experiência

- especialista

- especialistas

- Rosto

- Perguntas frequentes

- poucos

- campo

- Encontre

- Primeiro nome

- caber

- seguir

- seguinte

- Escolha

- Foundation

- Fundações

- quatro

- fraude

- detecção de fraude

- Gratuito

- da

- totalmente

- Diversão

- função

- mais distante

- gerar

- gerado

- gerando

- geração

- ter

- obtendo

- OFERTE

- dado

- Go

- Bom estado, com sinais de uso

- GPU

- grau

- grandemente

- Solo

- orientações

- guia

- Metade

- mão

- Ter

- he

- ajudar

- ajuda

- ajuda

- alta qualidade

- sua

- Acertar

- hospedado

- Como funciona o dobrador de carta de canal

- Contudo

- HTML

- HTTPS

- Hub

- enorme

- i

- identificado

- if

- imagem

- Classificação de imagem

- importante

- melhorar

- in

- incluir

- inclui

- Incluindo

- incorporar

- INFORMAÇÕES

- inovadores

- entrada

- instância

- instruções

- interagir

- interativo

- para dentro

- IT

- ESTÁ

- Trabalho

- apenas por

- Guarda

- Saber

- Conhecimento

- conhecido

- Laboratório

- língua

- grande

- mais tarde

- mais recente

- lançamento

- aprendizagem

- Deixar

- partida

- Comprimento

- deixar

- LIMITE

- limitações

- Line

- linhas

- Lista

- Listado

- listagem

- LLM

- log

- procurando

- máquina

- aprendizado de máquina

- moldadas

- manutenção

- fazer

- manualmente

- muitos

- maciço

- max

- máximo

- mencionado

- milhão

- mente

- ML

- modelo

- modelos

- modificar

- mais

- a maioria

- múltiplo

- my

- natural

- Processamento de linguagem natural

- Natureza

- Navegar

- Navegação

- necessário

- você merece...

- necessário

- nunca

- Novo

- PNL

- não

- caderno

- número

- objeto

- Detecção de Objetos

- of

- oferecido

- on

- ONE

- queridos

- contínuo

- open source

- operar

- otimizado

- Opções

- or

- ordem

- A Nossa

- Fora

- saída

- Acima de

- pacote

- página

- pão

- parâmetros

- particularmente

- partes

- Realizar

- atuação

- executante

- possivelmente

- platão

- Inteligência de Dados Platão

- PlatãoData

- desempenhado

- mais

- Popular

- popularidade

- parte

- Publique

- Predictor

- preparação

- presente

- evitar

- visualização

- privado

- processo

- em processamento

- Produção

- projeto

- Impulsionar

- proprietário

- fornecer

- fornecedores

- fornece

- publicamente

- Python

- pytorch

- consultas

- questão

- Frequentes

- rapidamente

- elevando

- alcance

- em vez

- Leia

- Leitura

- pronto

- recentemente

- relacionado

- relevante

- permanecem

- remover

- solicitar

- requeridos

- exige

- rever

- Subir

- Tipo

- Execute

- corrida

- sábio

- Inferência do SageMaker

- mesmo

- Escala

- escopo

- Scripts

- Sdk

- Pesquisar

- Seção

- seções

- Vejo

- visto

- envia

- sentença

- servir

- serviço

- Serviços

- conjunto

- contexto

- compartilhado

- Baixo

- rede de apoio social

- mostrar

- mostrou

- sinais

- simples

- Tamanho

- hábil

- Habilidades

- pequeno

- So

- solução

- Soluções

- alguns

- especialista

- específico

- especificada

- começado

- Comece

- estado-da-arte

- Passo

- Passos

- Ainda

- Dê um basta

- parou

- franco

- pontos fortes

- Tanga

- tal

- Suportado

- suportes

- surge

- .

- Tire

- Tarefa

- tarefas

- Dados Técnicos:

- fluxo tensor

- condições

- teste

- Classificação de Texto

- do que

- que

- A

- Eles

- si mesmos

- então

- Lá.

- Este

- deles

- think

- Terceiro

- terceiro

- isto

- completamente

- aqueles

- três

- Através da

- tempo

- vezes

- para

- hoje

- Tokens

- topo

- tópico

- para

- Trem

- treinado

- Training

- transformador

- Tradução

- julgamento

- ensaios

- experimentado

- Confiança

- tentar

- ui

- para

- compreender

- compreensão

- Atualizar

- us

- Uso

- usar

- caso de uso

- usava

- usos

- utilização

- muito

- via

- Ver

- visão

- Visite a

- queremos

- foi

- we

- web

- serviços web

- BEM

- O Quê

- quando

- se

- qual

- Largo

- Ampla variedade

- precisarão

- de

- dentro

- sem

- de gestão de documentos

- trabalho

- escrita

- XGBoostName

- anos

- sim

- Vocês

- investimentos

- você mesmo

- zefirnet