A criação de pipelines de aprendizado de máquina (ML) escalonáveis e eficientes é crucial para agilizar o desenvolvimento, a implantação e o gerenciamento de modelos de ML. Neste post, apresentamos um framework para automatizar a criação de um gráfico acíclico direcionado (DAG) para Pipelines Amazon SageMaker baseado em arquivos de configuração simples. O código de estrutura e exemplos apresentados aqui cobrem apenas pipelines de treinamento de modelo, mas também podem ser facilmente estendidos para pipelines de inferência em lote.

Essa estrutura dinâmica usa arquivos de configuração para orquestrar etapas de pré-processamento, treinamento, avaliação e registro para casos de uso de modelo único e multimodelo com base em scripts Python definidos pelo usuário, necessidades de infraestrutura (incluindo Nuvem virtual privada da Amazon (Amazon VPC) sub-redes e grupos de segurança, Gerenciamento de acesso e identidade da AWS (IAM) funções, Serviço de gerenciamento de chaves AWS (AWS KMS), registro de contêineres e tipos de instância), entrada e saída Serviço de armazenamento simples da Amazon (Amazon S3) caminhos e tags de recursos. Os arquivos de configuração (YAML e JSON) permitem que os profissionais de ML especifiquem código indiferenciado para orquestrar pipelines de treinamento usando sintaxe declarativa. Isso permite que os cientistas de dados criem e iterem rapidamente em modelos de ML e capacita os engenheiros de ML a executar pipelines de ML de integração contínua e entrega contínua (CI/CD) com mais rapidez, diminuindo o tempo de produção dos modelos.

Visão geral da solução

O código do framework proposto começa lendo os arquivos de configuração. Em seguida, ele cria dinamicamente um DAG do SageMaker Pipelines com base nas etapas declaradas nos arquivos de configuração e nas interações e dependências entre as etapas. Essa estrutura de orquestração atende casos de uso de modelo único e multimodelo e fornece um fluxo suave de dados e processos. A seguir estão os principais benefícios desta solução:

- Automação – Todo o fluxo de trabalho de ML, desde o pré-processamento de dados até o registro do modelo, é orquestrado sem intervenção manual. Isso reduz o tempo e o esforço necessários para a experimentação e operacionalização do modelo.

- Reprodutibilidade – Com um arquivo de configuração predefinido, os cientistas de dados e engenheiros de ML podem reproduzir todo o fluxo de trabalho, obtendo resultados consistentes em várias execuções e ambientes.

- AMPLIAR - Amazon Sage Maker é usado em todo o pipeline, permitindo que os profissionais de ML processem grandes conjuntos de dados e treinem modelos complexos sem preocupações de infraestrutura.

- Flexibilidade – A estrutura é flexível e pode acomodar uma ampla variedade de casos de uso de ML, estruturas de ML (como XGBoost e TensorFlow), treinamento de vários modelos e treinamento de várias etapas. Cada etapa do DAG de treinamento pode ser customizada por meio do arquivo de configuração.

- Governança modelo - A Registro de modelos do Amazon SageMaker a integração permite rastrear versões de modelos e, portanto, promovê-las para produção com confiança.

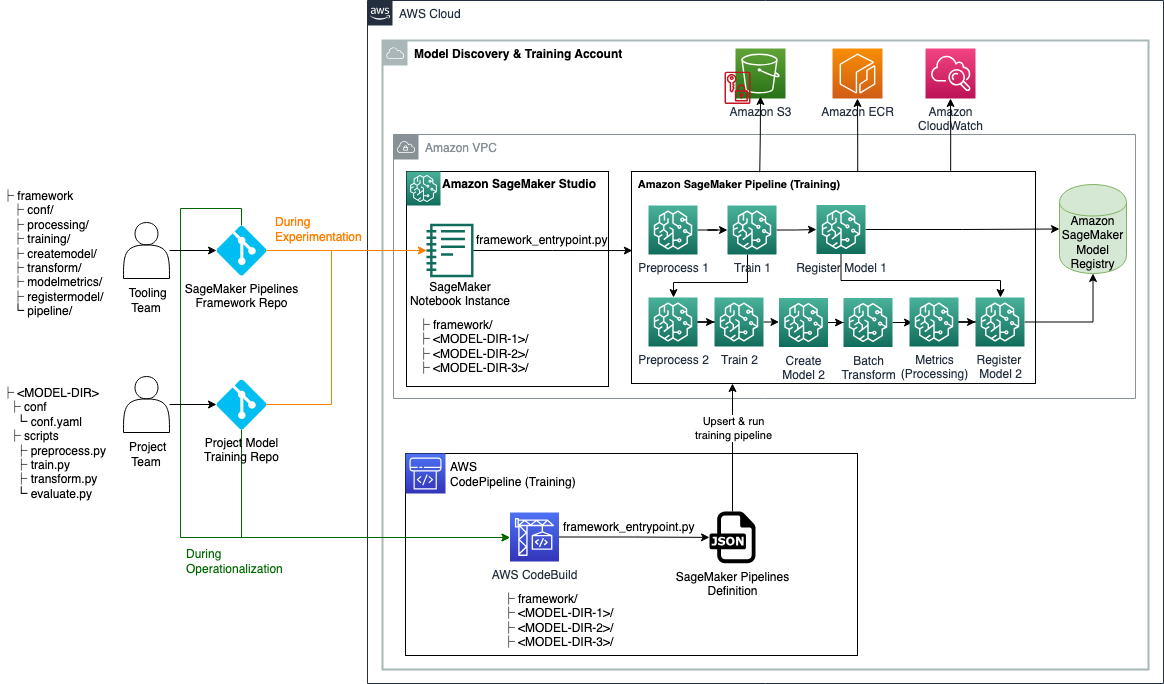

O diagrama de arquitetura a seguir descreve como você pode usar a estrutura proposta durante a experimentação e a operacionalização de modelos de ML. Durante a experimentação, você pode clonar o repositório de código da estrutura fornecido nesta postagem e os repositórios de código-fonte específicos do projeto em Estúdio Amazon SageMakere defina seu ambiente virtual (detalhado posteriormente nesta postagem). Você pode então iterar scripts de pré-processamento, treinamento e avaliação, bem como opções de configuração. Para criar e executar um DAG de treinamento do SageMaker Pipelines, você pode chamar o ponto de entrada da estrutura, que lerá todos os arquivos de configuração, criará as etapas necessárias e as orquestrará com base na ordem e nas dependências das etapas especificadas.

Durante a operacionalização, o pipeline de CI clona o repositório de código da estrutura e os repositórios de treinamento específicos do projeto em um AWS CodeBuild job, onde o script de ponto de entrada da estrutura é chamado para criar ou atualizar o DAG de treinamento do SageMaker Pipelines e, em seguida, executá-lo.

Estrutura do repositório

A Repositório GitHub contém os seguintes diretórios e arquivos:

- /framework/conf/ – Este diretório contém um arquivo de configuração que é usado para definir variáveis comuns em todas as unidades de modelagem, como sub-redes, grupos de segurança e função do IAM no tempo de execução. Uma unidade de modelagem é uma sequência de até seis etapas para treinar um modelo de ML.

- /framework/criarmodelo/ – Este diretório contém um script Python que cria um Modelo do SageMaker objeto baseado em artefatos de modelo de um Etapa de treinamento do SageMaker Pipelines. O objeto modelo é posteriormente usado em um Transformação em lote SageMaker trabalho para avaliar o desempenho do modelo em um conjunto de testes.

- /framework/modelmetria/ – Este diretório contém um script Python que cria um Processamento do Amazon SageMaker trabalho para gerar um relatório JSON de métricas de modelo para um modelo treinado com base nos resultados de um trabalho de transformação em lote do SageMaker realizado em dados de teste.

- /estrutura/pipeline/ – Este diretório contém scripts Python que usam classes Python definidas em outros diretórios da estrutura para criar ou atualizar um DAG do SageMaker Pipelines com base nas configurações especificadas. O script model_unit.py é usado por pipeline_service.py para criar uma ou mais unidades de modelagem. Cada unidade de modelagem é uma sequência de até seis etapas para treinar um modelo de ML: processar, treinar, criar modelo, transformar, métricas e registrar modelo. As configurações para cada unidade de modelagem devem ser especificadas no respectivo repositório do modelo. O pipeline_service.py também define dependências entre as etapas do SageMaker Pipelines (como as etapas dentro e entre unidades de modelagem são sequenciadas ou encadeadas) com base na seção sagemakerPipeline, que deve ser definida no arquivo de configuração de um dos repositórios do modelo (o modelo âncora). Isso permite substituir dependências padrão inferidas pelo SageMaker Pipelines. Discutiremos a estrutura do arquivo de configuração posteriormente nesta postagem.

- /estrutura/processamento/ – Este diretório contém um script Python que cria um trabalho de processamento do SageMaker com base na imagem do Docker especificada e no script do ponto de entrada.

- /estrutura/modelo de registro/ – Este diretório contém um script Python para registrar um modelo treinado junto com suas métricas calculadas no SageMaker Model Registry.

- /estrutura/treinamento/ – Este diretório contém um script Python que cria um trabalho de treinamento do SageMaker.

- /estrutura/transformar/ – Este diretório contém um script Python que cria um trabalho de transformação em lote do SageMaker. No contexto do treinamento de modelo, isso é usado para calcular a métrica de desempenho de um modelo treinado em dados de teste.

- /framework/utilitários/ – Este diretório contém scripts utilitários para leitura e junção de arquivos de configuração, bem como registro.

- /framework_entrypoint.py – Este arquivo é o ponto de entrada do código da estrutura. Ele chama uma função definida no diretório /framework/pipeline/ para criar ou atualizar um DAG do SageMaker Pipelines e executá-lo.

- /exemplos/ – Este diretório contém vários exemplos de como você pode usar esta estrutura de automação para criar DAGs de treinamento simples e complexos.

- /env.env – Este arquivo permite definir variáveis comuns, como sub-redes, grupos de segurança e função do IAM, como variáveis de ambiente.

- /requisitos.txt – Este arquivo especifica bibliotecas Python necessárias para o código da estrutura.

Pré-requisitos

Você deve ter os seguintes pré-requisitos antes de implantar esta solução:

- Uma conta da AWS

- Estúdio SageMaker

- Uma função SageMaker com permissões de leitura/gravação do Amazon S3 e criptografia/descriptografia do AWS KMS

- Um bucket S3 para armazenar dados, scripts e artefatos de modelo

- Opcionalmente, o Interface de linha de comando da AWS (AWS CLI)

- Python3 (Python 3.7 ou superior) e os seguintes pacotes Python:

- boto3

- sábio

- PyYAMLName

- Pacotes Python adicionais usados em seus scripts personalizados

Implante a solução

Conclua as etapas a seguir para implementar a solução:

- Organize seu repositório de treinamento de modelo de acordo com a seguinte estrutura:

- Clone o código da estrutura e o código-fonte do seu modelo nos repositórios Git:

-

- clone

dynamic-sagemaker-pipelines-frameworkrepo em um diretório de treinamento. No código a seguir, assumimos que o diretório de treinamento é chamadoaws-train: - Clone o código-fonte do modelo no mesmo diretório. Para treinamento de vários modelos, repita esta etapa para quantos modelos você precisar treinar.

- clone

Para treinamento de modelo único, seu diretório deve ser parecido com o seguinte:

Para treinamento multimodelo, seu diretório deve ser parecido com o seguinte:

- Configure as seguintes variáveis de ambiente. Os asteriscos indicam variáveis de ambiente necessárias; o resto é opcional.

| Variável de ambiente | Descrição |

SMP_ACCOUNTID* |

Conta AWS onde o pipeline do SageMaker é executado |

SMP_REGION* |

Região da AWS onde o pipeline do SageMaker é executado |

SMP_S3BUCKETNAME* |

Nome do depósito S3 |

SMP_ROLE* |

Função do SageMaker |

SMP_MODEL_CONFIGPATH* |

Caminho relativo dos arquivos de configuração de modelo único ou multimodelo |

SMP_SUBNETS |

IDs de sub-rede para configuração de rede do SageMaker |

SMP_SECURITYGROUPS |

IDs de grupos de segurança para configuração de rede do SageMaker |

Para casos de uso de modelo único, SMP_MODEL_CONFIGPATH será <MODEL-DIR>/conf/conf.yaml. Para casos de uso de vários modelos, SMP_MODEL_CONFIGPATH será */conf/conf.yaml, que permite encontrar todos conf.yaml arquivos usando o módulo glob do Python e combine-os para formar um arquivo de configuração global. Durante a experimentação (teste local), você pode especificar variáveis de ambiente dentro do arquivo env.env e depois exportá-las executando o seguinte comando em seu terminal:

Observe que os valores das variáveis de ambiente em env.env devem ser colocados entre aspas (por exemplo, SMP_REGION="us-east-1"). Durante a operacionalização, estas variáveis ambientais devem ser definidas pelo pipeline de CI.

- Crie e ative um ambiente virtual executando os seguintes comandos:

- Instale os pacotes Python necessários executando o seguinte comando:

- Edite o treinamento do seu modelo

conf.yamlarquivos. Discutiremos a estrutura do arquivo de configuração na próxima seção. - No terminal, chame o ponto de entrada da estrutura para criar ou atualizar e executar o DAG de treinamento do SageMaker Pipeline:

- Visualize e depure os pipelines do SageMaker executados no Dutos guia da IU do SageMaker Studio.

Estrutura do arquivo de configuração

Existem dois tipos de arquivos de configuração na solução proposta: configuração de framework e configuração de modelo. Nesta seção, descrevemos cada um em detalhes.

Configuração da estrutura

A /framework/conf/conf.yaml file define as variáveis que são comuns em todas as unidades de modelagem. Isso inclui SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPS e SMP_MODELNAME. Consulte a Etapa 3 das instruções de implantação para obter descrições dessas variáveis e como defini-las por meio de variáveis de ambiente.

Configuração do modelo

Para cada modelo do projeto, precisamos especificar o seguinte no <MODEL-DIR>/conf/conf.yaml arquivo (os asteriscos indicam as seções obrigatórias; o restante é opcional):

- /conf/modelos* – Nesta seção, você pode configurar uma ou mais unidades de modelagem. Quando o código da estrutura for executado, ele lerá automaticamente todos os arquivos de configuração durante o tempo de execução e os anexará à árvore de configuração. Teoricamente, você pode especificar todas as unidades de modelagem no mesmo

conf.yamlarquivo, mas é recomendado especificar cada configuração de unidade de modelagem em seu respectivo diretório ou repositório Git para minimizar erros. As unidades são as seguintes:- {nome do modelo}* – O nome do modelo.

- diretório_fonte* - Um comum

source_dircaminho a ser usado para todas as etapas na unidade de modelagem. - pré-processamento – Esta seção especifica parâmetros de pré-processamento.

- trem* – Esta seção especifica os parâmetros do trabalho de treinamento.

- transformar* – Esta seção especifica os parâmetros do trabalho do SageMaker Transform para fazer previsões nos dados de teste.

- avaliar – Esta seção especifica os parâmetros do trabalho de processamento do SageMaker para gerar um relatório JSON de métricas do modelo para o modelo treinado.

- registro* – Esta seção especifica parâmetros para registrar o modelo treinado no SageMaker Model Registry.

- /conf/sagemakerPipeline* – Esta seção define o fluxo do SageMaker Pipelines, incluindo dependências entre as etapas. Para casos de uso de modelo único, esta seção é definida no final do arquivo de configuração. Para casos de uso de vários modelos, o

sagemakerPipelineseção só precisa ser definida no arquivo de configuração de um dos modelos (qualquer um dos modelos). Chamamos esse modelo de modelo de âncora. Os parâmetros são os seguintes:- pipelineName* – Nome do pipeline do SageMaker.

- modelos* – Lista aninhada de unidades de modelagem:

- {nome do modelo}* – Identificador do modelo, que deve corresponder a um identificador {model-name} na seção /conf/models.

- degraus* -

- nome_etapa* – Nome da etapa a ser exibida no DAG do SageMaker Pipelines.

- classe_passo* – (União[Processamento, Treinamento, CreateModel, Transform, Metrics, RegisterModel])

- tipo_de_passo* – Este parâmetro é necessário apenas para etapas de pré-processamento, para as quais deve ser definido como pré-processamento. Isto é necessário para distinguir as etapas de pré-processamento e de avaliação, ambas com um

step_classde Processamento. - habilitar_cache – ([União[Verdadeiro, Falso]]). Isso indica se deve ativar Cache do SageMaker Pipelines para esta etapa.

- chain_input_source_step – ([lista[nome_passo]]). Você pode usar isso para definir as saídas do canal de outra etapa como entrada para esta etapa.

- chain_input_additional_prefix – Isso só é permitido para etapas do Transform

step_class, e pode ser usado em conjunto comchain_input_source_stepparâmetro para identificar o arquivo que deve ser usado como entrada para a etapa de transformação.

- degraus* -

- {nome do modelo}* – Identificador do modelo, que deve corresponder a um identificador {model-name} na seção /conf/models.

- dependências – Esta seção especifica a sequência na qual as etapas do SageMaker Pipelines devem ser executadas. Adaptamos a notação Apache Airflow para esta seção (por exemplo,

{step_name} >> {step_name}). Se esta seção for deixada em branco, as dependências explícitas especificadas pelochain_input_source_stepparâmetro ou dependências implícitas definem o fluxo DAG do SageMaker Pipelines.

Observe que recomendamos ter uma etapa de treinamento por unidade de modelagem. Se diversas etapas de treinamento forem definidas para uma unidade de modelagem, as etapas subsequentes executam implicitamente a última etapa de treinamento para criar o objeto de modelo, calcular métricas e registrar o modelo. Se precisar treinar vários modelos, é recomendável criar várias unidades de modelagem.

Exemplos

Nesta seção, demonstramos três exemplos de DAGs de treinamento de modelo de ML criados usando a estrutura apresentada.

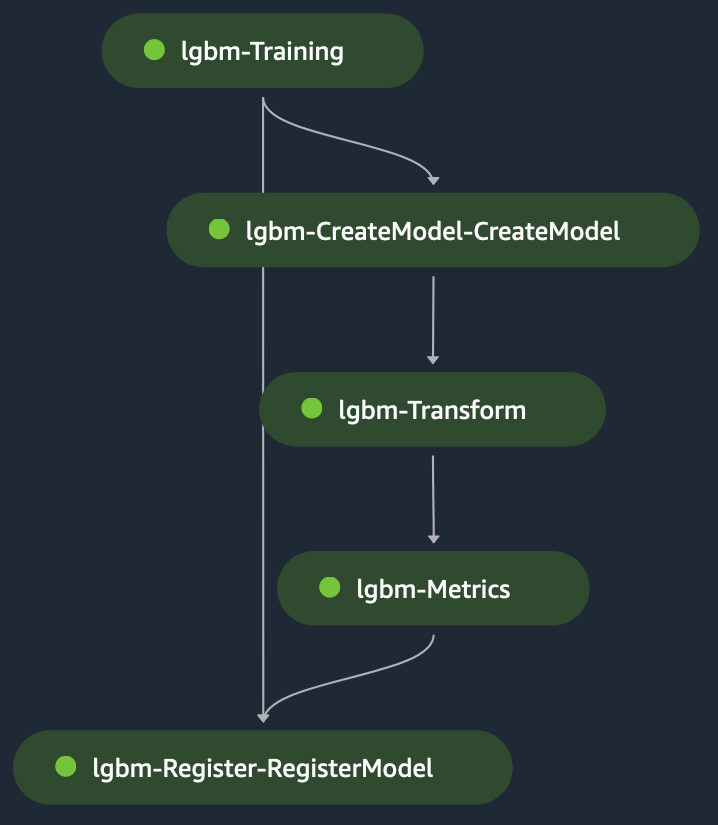

Treinamento de modelo único: LightGBM

Este é um exemplo de modelo único para um caso de uso de classificação onde usamos LightGBM em modo script no SageMaker. O conjunto de dados consiste em variáveis categóricas e numéricas para prever o rótulo binário Receita (para prever se o sujeito faz uma compra ou não). O script de pré-processamento é usado para modelar os dados para treinamento e teste e, em seguida, prepare-o em um bucket S3. Os caminhos S3 são então fornecidos ao etapa de treinamento no arquivo de configuração.

Quando a etapa de treinamento é executada, o SageMaker carrega o arquivo no contêiner em /opt/ml/input/data/{channelName}/, acessível através da variável de ambiente SM_CHANNEL_{channelName} no recipiente (channelName= 'treinar' ou 'teste'). A roteiro de treinamento faz o seguinte:

- Carregue os arquivos localmente a partir de caminhos de contêineres locais usando o Carga NumPy módulo.

- Defina hiperparâmetros para o algoritmo de treinamento.

- Salve o modelo treinado no caminho do contêiner local

/opt/ml/model/.

O SageMaker leva o conteúdo em /opt/ml/model/ para criar um tarball que é usado para implantar o modelo no SageMaker para hospedagem.

A etapa de transformação toma como entrada o teste arquivo de teste como entrada e o modelo treinado para fazer previsões no modelo treinado. A saída da etapa de transformação é acorrentado para a etapa de métricas para avaliar o modelo em relação ao verdade fundamental, que é fornecido explicitamente na etapa de métricas. Finalmente, a saída da etapa de métricas é implicitamente encadeada à etapa de registro para registrar o modelo no SageMaker Model Registry com informações sobre o desempenho do modelo produzido na etapa de métricas. A figura a seguir mostra uma representação visual do DAG de treinamento. Você pode consultar os scripts e o arquivo de configuração deste exemplo no GitHub repo.

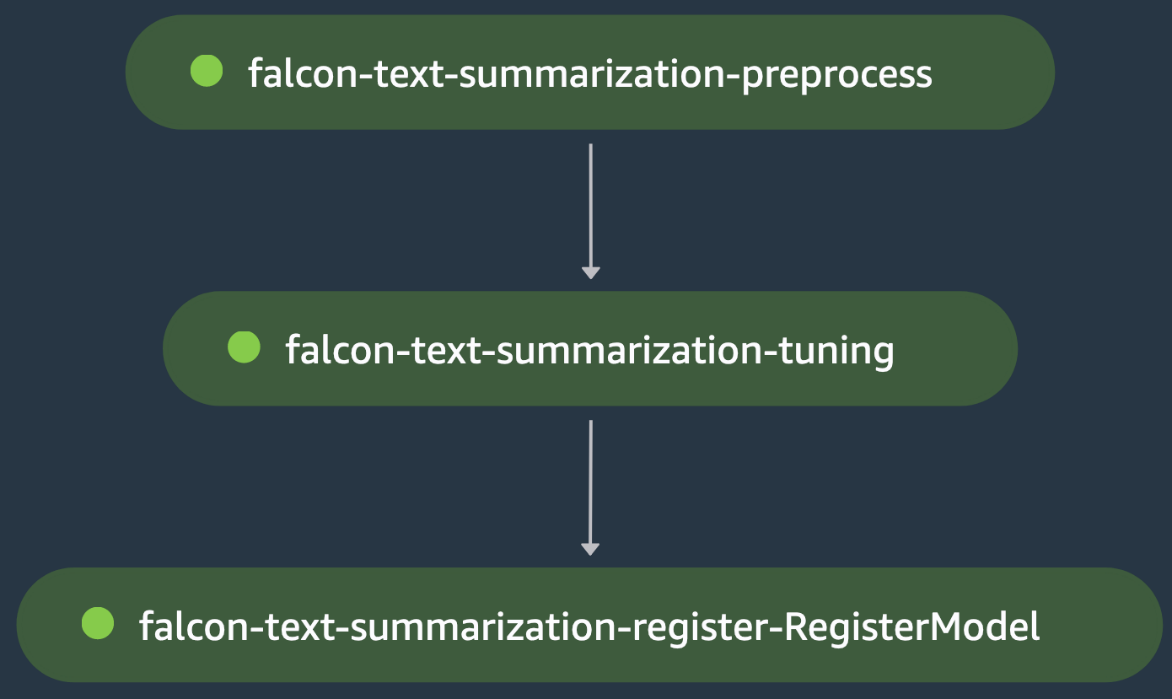

Treinamento de modelo único: ajuste fino do LLM

Este é outro exemplo de treinamento de modelo único, onde orquestramos o ajuste fino de um modelo de linguagem grande (LLM) Falcon-40B do Hugging Face Hub para um caso de uso de resumo de texto. O script de pré-processamento carrega o Samsum conjunto de dados do Hugging Face, carrega o tokenizer para o modelo e processa as divisões de dados de treinamento/teste para ajustar o modelo nesses dados de domínio na etapa de pré-processamento de resumo de texto falcon.

A saída é acorrentado para a etapa de ajuste de resumo de texto do falcão, onde o roteiro de treinamento carrega o Falcon-40B LLM do Hugging Face Hub e inicia o ajuste fino acelerado usando LoRA na divisão do trem. O modelo é avaliado na mesma etapa após o ajuste fino, que porteiros a perda de avaliação falha na etapa de ajuste de resumo de texto falcon, o que faz com que o pipeline do SageMaker pare antes de poder registrar o modelo ajustado. Caso contrário, a etapa de ajuste de resumo de texto falcon será executada com êxito e o modelo será registrado no SageMaker Model Registry. A figura a seguir mostra uma representação visual do DAG de ajuste fino do LLM. Os scripts e o arquivo de configuração deste exemplo estão disponíveis no GitHub repo.

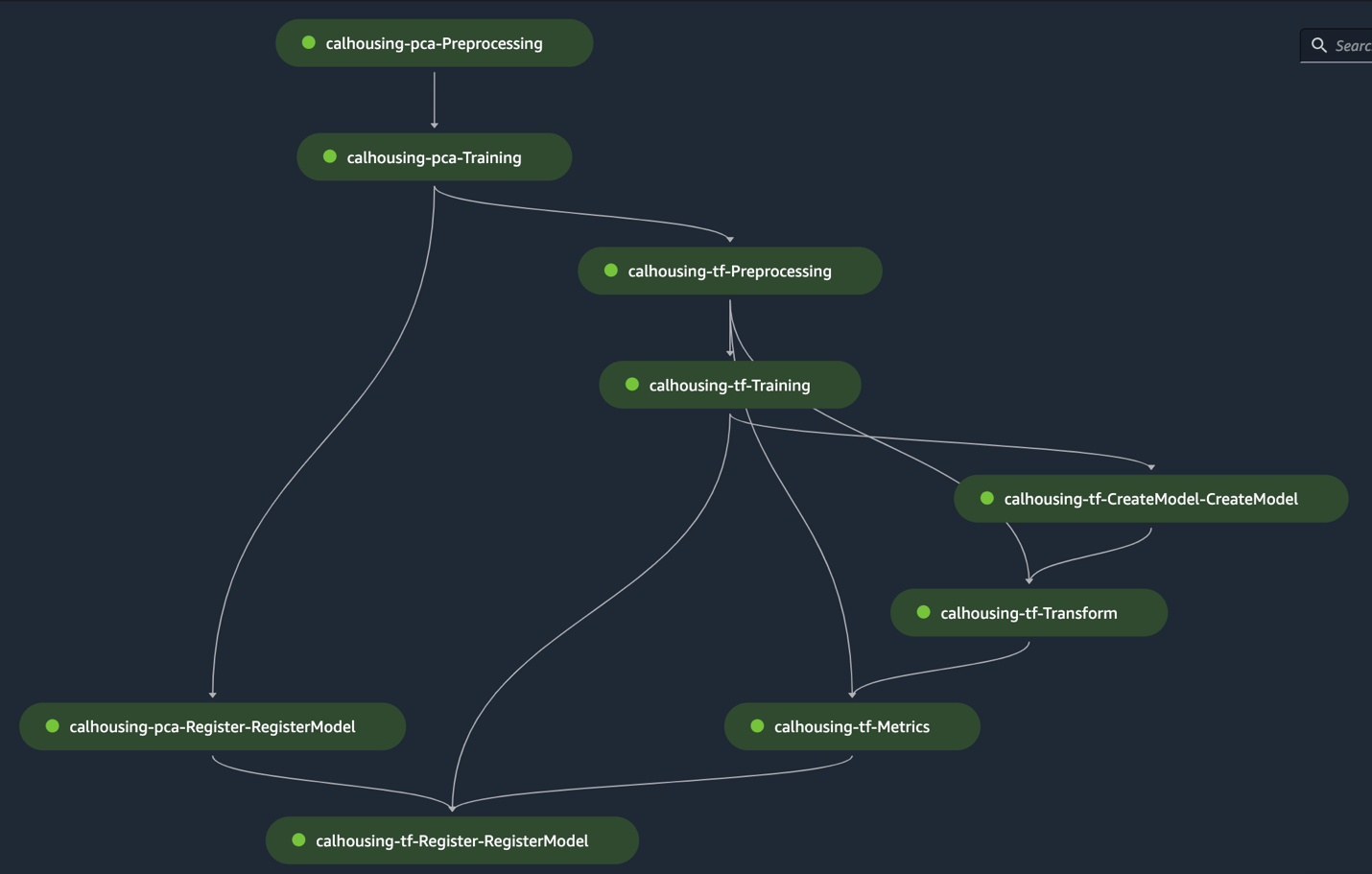

Treinamento multimodelo

Este é um exemplo de treinamento de vários modelos em que um modelo de análise de componentes principais (PCA) é treinado para redução de dimensionalidade e um modelo TensorFlow Multilayer Perceptron é treinado para Previsão do preço da habitação na Califórnia. A etapa de pré-processamento do modelo TensorFlow usa um modelo PCA treinado para reduzir a dimensionalidade dos dados de treinamento. Adicionamos uma dependência na configuração para garantir que o modelo TensorFlow seja registrado após o registro do modelo PCA. A figura a seguir mostra uma representação visual do exemplo de DAG de treinamento multimodelo. Os scripts e arquivos de configuração deste exemplo estão disponíveis no GitHub repo.

limpar

Conclua as etapas a seguir para limpar seus recursos:

- Use a AWS CLI para Lista e remover quaisquer pipelines restantes criados pelos scripts Python.

- Opcionalmente, exclua outros recursos da AWS, como o bucket S3 ou a função IAM criada fora do SageMaker Pipelines.

Conclusão

Neste post, apresentamos uma estrutura para automatizar a criação de DAG do SageMaker Pipelines com base em arquivos de configuração. A estrutura proposta oferece uma solução inovadora para o desafio de orquestrar cargas de trabalho complexas de ML. Ao usar um arquivo de configuração, o SageMaker Pipelines oferece flexibilidade para criar orquestração com código mínimo, para que você possa agilizar o processo de criação e gerenciamento de pipelines de modelo único e multimodelo. Esta abordagem não só poupa tempo e recursos, mas também promove as melhores práticas de MLOps, contribuindo para o sucesso geral das iniciativas de ML. Para obter mais informações sobre detalhes de implementação, revise o GitHub repo.

Sobre os autores

Luis Felipe Yepez Barrios, é engenheiro de aprendizado de máquina com serviços profissionais da AWS, focado em sistemas distribuídos escaláveis e ferramentas de automação para agilizar a inovação científica na área de aprendizado de máquina (ML). Além disso, ele auxilia clientes empresariais na otimização de suas soluções de aprendizado de máquina por meio de serviços AWS.

Luis Felipe Yepez Barrios, é engenheiro de aprendizado de máquina com serviços profissionais da AWS, focado em sistemas distribuídos escaláveis e ferramentas de automação para agilizar a inovação científica na área de aprendizado de máquina (ML). Além disso, ele auxilia clientes empresariais na otimização de suas soluções de aprendizado de máquina por meio de serviços AWS.

Jinzhao Feng, é engenheiro de aprendizado de máquina na AWS Professional Services. Ele se concentra na arquitetura e implementação de IA generativa em grande escala e soluções clássicas de pipeline de ML. É especializado em FMOps, LLMOps e treinamento distribuído.

Jinzhao Feng, é engenheiro de aprendizado de máquina na AWS Professional Services. Ele se concentra na arquitetura e implementação de IA generativa em grande escala e soluções clássicas de pipeline de ML. É especializado em FMOps, LLMOps e treinamento distribuído.

Asnani severo, é engenheiro de aprendizado de máquina na AWS. Sua formação é em Ciência de Dados Aplicada com foco na operacionalização de cargas de trabalho de Machine Learning na nuvem em escala.

Asnani severo, é engenheiro de aprendizado de máquina na AWS. Sua formação é em Ciência de Dados Aplicada com foco na operacionalização de cargas de trabalho de Machine Learning na nuvem em escala.

Hasan Shojaei, é cientista de dados sênior da AWS Professional Services, onde ajuda clientes de diferentes setores a resolver seus desafios de negócios por meio do uso de big data, aprendizado de máquina e tecnologias de nuvem. Antes desta função, Hasan liderou diversas iniciativas para desenvolver novas técnicas de modelagem baseadas na física e orientadas por dados para as principais empresas de energia. Fora do trabalho, Hasan é apaixonado por livros, caminhadas, fotografia e história.

Hasan Shojaei, é cientista de dados sênior da AWS Professional Services, onde ajuda clientes de diferentes setores a resolver seus desafios de negócios por meio do uso de big data, aprendizado de máquina e tecnologias de nuvem. Antes desta função, Hasan liderou diversas iniciativas para desenvolver novas técnicas de modelagem baseadas na física e orientadas por dados para as principais empresas de energia. Fora do trabalho, Hasan é apaixonado por livros, caminhadas, fotografia e história.

Alec Jenab, é um engenheiro de aprendizado de máquina especializado no desenvolvimento e operacionalização de soluções de aprendizado de máquina em escala para clientes corporativos. Alec é apaixonado por trazer soluções inovadoras ao mercado, especialmente em áreas onde o aprendizado de máquina pode melhorar significativamente a experiência do usuário final. Fora do trabalho, ele gosta de jogar basquete, praticar snowboard e descobrir joias escondidas em São Francisco.

Alec Jenab, é um engenheiro de aprendizado de máquina especializado no desenvolvimento e operacionalização de soluções de aprendizado de máquina em escala para clientes corporativos. Alec é apaixonado por trazer soluções inovadoras ao mercado, especialmente em áreas onde o aprendizado de máquina pode melhorar significativamente a experiência do usuário final. Fora do trabalho, ele gosta de jogar basquete, praticar snowboard e descobrir joias escondidas em São Francisco.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :é

- :não

- :onde

- $UP

- 120

- 160

- 7

- 8

- 9

- a

- Capaz

- Sobre

- acelerado

- Acesso

- acessível

- acomodar

- Segundo

- Conta

- alcançar

- em

- ativado

- acíclico

- adicionar

- Depois de

- contra

- AI

- algoritmo

- Todos os Produtos

- permitir

- permitidas

- permite

- juntamente

- tb

- Amazon

- Amazon Sage Maker

- Pipelines Amazon SageMaker

- Amazon Web Services

- entre

- an

- análise

- Apresentadora

- e

- Outro

- qualquer

- apache

- aplicado

- abordagem

- arquitetura

- SOMOS

- áreas

- AS

- ajuda

- assumir

- At

- automatizar

- automaticamente

- automatizando

- Automação

- disponível

- AWS

- Serviços Profissionais AWS

- fundo

- baseado

- Basquetebol

- BE

- antes

- Benefícios

- MELHOR

- melhores práticas

- Grande

- Big Data

- Livros

- ambos

- Trazendo

- construir

- negócio

- mas a

- by

- calcular

- calculado

- chamada

- chamado

- chamadas

- CAN

- casas

- casos

- atende

- causas

- acorrentado

- desafiar

- desafios

- Canal

- escolhas

- aulas

- classificação

- limpar

- cli

- clientes

- Na nuvem

- código

- combinar

- comum

- Empresas

- integrações

- componente

- Preocupações

- confiança

- Configuração

- conjunção

- consistente

- consiste

- Recipiente

- Containers

- contém

- conteúdo

- contexto

- contínuo

- contribuindo

- cobrir

- crio

- criado

- cria

- Criar

- criação

- crucial

- personalizadas

- Clientes

- personalizado

- DAG

- dados,

- ciência de dados

- cientista de dados

- orientado por dados

- conjuntos de dados

- Declarado

- Padrão

- definir

- definido

- Define

- Entrega

- demonstrar

- dependências

- Dependência

- implantar

- Implantação

- desenvolvimento

- descreve

- detalhe

- detalhado

- detalhes

- desenvolver

- em desenvolvimento

- Desenvolvimento

- diagrama

- diferente

- dirigido

- diretórios

- anuário

- descobrindo

- discutir

- exibido

- distinguir

- distribuído

- Sistemas distribuídos

- treinamento distribuído

- Estivador

- parece

- domínio

- durante

- dinâmico

- dinamicamente

- cada

- eficiente

- esforço

- empodera

- permitir

- permite

- permitindo

- final

- energia

- engenheiro

- Engenheiros

- garantir

- Empreendimento

- Todo

- entrada

- Meio Ambiente

- ambientes

- erros

- especialmente

- avaliar

- avaliadas

- avaliação

- avaliação

- Cada

- exemplo

- exemplos

- a acelerar

- vasta experiência

- explicitamente

- exportar

- opção

- Rosto

- FALHA

- falso

- mais rápido

- campo

- Figura

- Envie o

- Arquivos

- Finalmente

- Encontre

- Flexibilidade

- flexível

- fluxo

- Foco

- focado

- concentra-se

- seguinte

- segue

- Escolha

- formulário

- voltado para o futuro

- Quadro

- enquadramentos

- Francisco

- da

- função

- Além disso

- gerando

- generativo

- IA generativa

- Git

- Global

- governo

- gráfico

- maior

- Grupo

- Do grupo

- Ter

- ter

- he

- ajuda

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- oculto

- sua

- história

- hospedagem

- habitação

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- Hub

- identificador

- Identidade

- ids

- if

- imagem

- implementação

- implementação

- melhorar

- in

- Em outra

- inclui

- Incluindo

- indicam

- indicam

- indústrias

- inferido

- INFORMAÇÕES

- Infraestrutura

- iniciativas

- Inovação

- inovadores

- entrada

- dentro

- instalar

- instância

- instruções

- integração

- interações

- da intervenção

- para dentro

- IT

- ESTÁ

- Trabalho

- juntando

- jpg

- json

- Chave

- chaves

- O rótulo

- língua

- grande

- Sobrenome

- mais tarde

- aprendizagem

- levou

- esquerda

- bibliotecas

- como

- Line

- Lista

- LLM

- carregar

- cargas

- local

- localmente

- logging

- olhar

- parece

- fora

- máquina

- aprendizado de máquina

- fazer

- FAZ

- Fazendo

- de grupos

- gestão

- manual

- muitos

- mercado

- Match

- métrico

- Métrica

- mínimo

- minimizar

- ML

- MLOps

- Moda

- modelo

- modelagem

- modelos

- Módulo

- mais

- múltiplo

- nome

- necessário

- você merece...

- necessário

- Cria

- networking

- Próximo

- não

- romance

- objeto

- of

- Oferece

- on

- ONE

- só

- otimizando

- or

- orquestrada

- orquestrando

- orquestração

- Outros

- de outra forma

- saída

- outputs

- lado de fora

- global

- override

- pacotes

- parâmetro

- parâmetros

- apaixonado

- caminho

- caminhos

- para

- atuação

- realizada

- fotografia

- oleoduto

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- ponto

- Publique

- práticas

- predefinido

- predizer

- Previsões

- pré-requisitos

- presente

- apresentado

- preço

- Diretor

- Prévio

- privado

- processo

- processos

- em processamento

- Produzido

- Produção

- profissional

- projeto

- promove

- Promoção

- proposto

- fornecido

- fornece

- compra

- Python

- rapidamente

- alcance

- Leia

- prontamente

- Leitura

- recomendar

- Recomenda

- reduzir

- reduz

- redução

- referir

- região

- cadastre-se

- registrado

- registro

- Registo

- registro

- remanescente

- repetir

- Denunciar

- repositório

- representação

- requeridos

- Requisitos

- recurso

- Recursos

- aqueles

- DESCANSO

- Resultados

- receita

- rever

- Tipo

- papéis

- Execute

- corrida

- é executado

- tempo de execução

- sábio

- Pipelines SageMaker

- mesmo

- San

- San Francisco

- escalável

- Escala

- Ciência

- científico

- Cientista

- cientistas

- escrita

- Scripts

- Seção

- seções

- segurança

- Seqüência

- Serviços

- conjunto

- Conjuntos

- vários

- rede de apoio social

- Shows

- simples

- SIX

- Liso

- So

- solução

- Soluções

- RESOLVER

- fonte

- código fonte

- especializado

- especializada

- especificada

- divisão

- splits

- começa

- Passo

- Passos

- Dê um basta

- armazenamento

- armazenar

- simplificar

- racionalização

- estrutura

- estudo

- sujeito

- sub-redes

- subseqüente

- sucesso

- entraram com sucesso

- tal

- fornecidas

- sintaxe

- sistemas

- Tire

- toma

- técnicas

- Tecnologias

- fluxo tensor

- terminal

- teste

- ensaio

- texto

- que

- A

- O registro

- deles

- Eles

- então

- assim sendo

- Este

- isto

- três

- Através da

- todo

- tempo

- para

- topo

- Rastreamento

- Trem

- treinado

- Training

- Transformar

- árvore

- verdadeiro

- dois

- tipos

- ui

- para

- unidade

- unidades

- Atualizar

- usar

- caso de uso

- usava

- Utilizador

- Experiência do Usuário

- usos

- utilização

- utilidade

- Valores

- variável

- versões

- via

- Virtual

- visual

- we

- web

- serviços web

- BEM

- quando

- se

- qual

- QUEM

- Largo

- Ampla variedade

- precisarão

- de

- dentro

- sem

- Atividades:

- de gestão de documentos

- XGBoostName

- yaml

- Vocês

- investimentos

- zefirnet