Muitas empresas estão sobrecarregadas com o volume abundante de documentos que precisam processar, organizar e classificar para atender melhor seus clientes. Exemplos disso podem ser pedidos de empréstimo, declaração de impostos e cobrança. Esses documentos são mais comumente recebidos em formatos de imagem e são, em sua maioria, de várias páginas e em formato de baixa qualidade. Para serem mais competitivas e econômicas, mantendo-se seguras e em conformidade ao mesmo tempo, essas empresas devem desenvolver seus recursos de processamento de documentos para reduzir os tempos de processamento e melhorar a precisão da classificação de maneira automatizada e escalável. Essas empresas enfrentam os seguintes desafios no processamento de documentos:

- Realização de moderação nos documentos para detectar conteúdo impróprio, indesejado ou ofensivo

- A classificação manual de documentos, adotada por empresas menores, é demorada, propensa a erros e cara

- As técnicas de OCR com sistemas baseados em regras não são inteligentes o suficiente e não podem adotar mudanças no formato do documento

- As empresas que adotam abordagens de aprendizado de máquina (ML) geralmente não têm recursos para dimensionar seu modelo para lidar com picos no volume de documentos recebidos

Este post aborda esses desafios e fornece uma arquitetura que resolve esses problemas com eficiência. Mostramos como você pode usar Reconhecimento da Amazônia e amazontext otimizar e reduzir os esforços humanos no processamento de documentos. O Amazon Rekognition identifica rótulos de moderação em seu documento e os classifica usando Rótulos personalizados do Amazon Rekognition. O Amazon Textract extrai texto de seus documentos.

Neste post, abordamos a construção de dois pipelines de ML (treinamento e inferência) para processar documentos sem a necessidade de qualquer esforço manual ou código personalizado. As etapas de alto nível no pipeline de inferência incluem:

- Execute a moderação em documentos carregados usando o Amazon Rekognition.

- Classifique documentos em diferentes categorias, como W-2s, faturas, extratos bancários e recibos de pagamento usando as etiquetas personalizadas do Rekognition.

- Extraia texto de documentos como texto impresso, manuscrito, formulários e tabelas usando o Amazon Textract.

Visão geral da solução

Esta solução usa os seguintes serviços de IA, tecnologias sem servidor e serviços gerenciados para implementar uma arquitetura escalonável e econômica:

- Amazon DynamoDB - Um banco de dados de valores-chave e documentos que oferece desempenho em milissegundos de um dígito em qualquer escala.

- Amazon Event Bridge – Um barramento de eventos sem servidor para criar aplicativos orientados a eventos em escala usando eventos gerados a partir de seus aplicativos, aplicativos integrados de software como serviço (SaaS) e serviços da AWS.

- AWS Lambda – Um serviço de computação sem servidor que permite executar código em resposta a gatilhos, como alterações nos dados, mudanças no estado do sistema ou ações do usuário.

- Reconhecimento da Amazônia – Usa ML para identificar objetos, pessoas, textos, cenas e atividades em imagens e vídeos, bem como detectar qualquer conteúdo impróprio.

- Rótulos personalizados do Amazon Rekognition – Usa AutoML para visão computacional e aprendizado de transferência para ajudá-lo a treinar modelos personalizados para identificar os objetos e cenas em imagens que são específicos para suas necessidades de negócios.

- Serviço de armazenamento simples da Amazon (Amazon S3) – Serve como um armazenamento de objetos para seus documentos e permite o gerenciamento central com controles de acesso ajustados.

- Funções de etapa da Amazon – Um orquestrador de funções sem servidor que facilita a sequência de funções Lambda e vários serviços em aplicativos essenciais aos negócios.

- amazontext - Usa ML para extrair texto e dados de documentos digitalizados em formatos PDF, JPEG ou PNG.

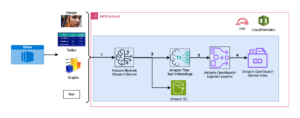

O diagrama a seguir ilustra a arquitetura do pipeline de inferência.

Nosso fluxo de trabalho inclui as seguintes etapas:

Nosso fluxo de trabalho inclui as seguintes etapas:

- O usuário carrega documentos no bucket do S3 de entrada.

- O upload aciona um Notificação de eventos do Amazon S3 para entregar eventos em tempo real diretamente ao EventBridge. Os eventos do Amazon S3 que correspondem ao “

object created” filtro definido para um Regra EventBridge inicia o fluxo de trabalho do Step Functions. - O fluxo de trabalho do Step Functions aciona uma série de funções do Lambda, que executam as seguintes tarefas:

- A primeira função executa tarefas de pré-processamento e faz chamadas de API para o Amazon Rekognition:

- Se os documentos recebidos estiverem em formato de imagem (como JPG ou PNG), a função chamará a API do Amazon Rekognition e fornecerá os documentos como objetos do S3. No entanto, se o documento estiver no formato PDF, a função transmitirá os bytes da imagem ao chamar a API do Amazon Rekognition.

- Se um documento contiver várias páginas, a função dividirá o documento em páginas individuais e as salvará em uma pasta intermediária no bucket de saída do S3 antes de processá-las individualmente.

- Quando as tarefas de pré-processamento são concluídas, a função faz uma chamada de API para o Amazon Rekognition para detectar conteúdo inadequado, indesejado ou ofensivo e faz outra chamada de API para o modelo Rekognition Custom Labels treinado para classificar documentos.

- A segunda função faz uma chamada de API para o Amazon Textract para iniciar um trabalho para extrair texto do documento de entrada e armazená-lo no bucket S3 de saída.

- A terceira função armazena metadados do documento, como rótulo de moderação, classificação do documento, confiança da classificação, ID do trabalho do Amazon Textract e caminho do arquivo em uma tabela do DynamoDB.

- A primeira função executa tarefas de pré-processamento e faz chamadas de API para o Amazon Rekognition:

Você pode ajustar o fluxo de trabalho conforme sua necessidade, por exemplo, você pode adicionar um recurso de processamento de linguagem natural (NLP) neste fluxo de trabalho usando Amazon Comprehend para obter informações sobre o texto extraído.

Canal de treinamento

Antes de implantarmos essa arquitetura, treinamos um modelo personalizado para classificar documentos em diferentes categorias usando os rótulos personalizados do Rekognition. No pipeline de treinamento, rotulamos os documentos usando Verdade no solo do Amazon SageMaker. Em seguida, usamos os documentos rotulados para treinar um modelo com os Rótulos personalizados do Rekognition. Neste exemplo, usamos um Amazon Sage Maker notebook para executar essas etapas, mas você também pode anotar imagens usando o console Rekognition Custom Labels. Para obter instruções, consulte Como rotular imagens.

Conjunto de dados

Para treinar o modelo, usamos os seguintes conjuntos de dados públicos contendo W2s e faturas:

- Conjunto de dados W-2 (formulário fiscal dos EUA) falso

- Conjunto de dados de verificação de carimbo (StaVer)

Você pode usar outro conjunto de dados relevante para seu setor.

A tabela a seguir resume as divisões do conjunto de dados entre treinamento e teste.

| Aula | Conjunto de treinamento | Conjunto de teste |

| Faturas | 352 | 75 |

| W-2 | 86 | 16 |

| Total | 438 | 91 |

Implante o pipeline de treinamento com o AWS CloudFormation

Você implanta um Formação da Nuvem AWS modelo para provisionar o necessário Gerenciamento de acesso e identidade da AWS (IAM) funções e componentes do pipeline de treinamento, incluindo uma instância de notebook SageMaker.

- Inicie o seguinte modelo do CloudFormation na região Leste dos EUA (Norte da Virgínia):

- Escolha Nome da pilha, insira um nome, como

document-processing-training-pipeline. - Escolha Próximo.

- No Capacidades e transformações seção, marque a caixa de seleção para reconhecer que o AWS CloudFormation pode criar Recursos IAM.

- Escolha Criar pilha.

A página de detalhes da pilha deve mostrar o status da pilha como CREATE_IN_PROGRESS. Pode levar até 5 minutos para que o status mude para CREATE_COMPLETE. Quando estiver concluído, você pode ver os resultados no Saídas aba.

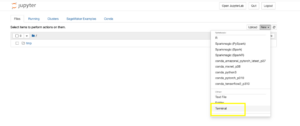

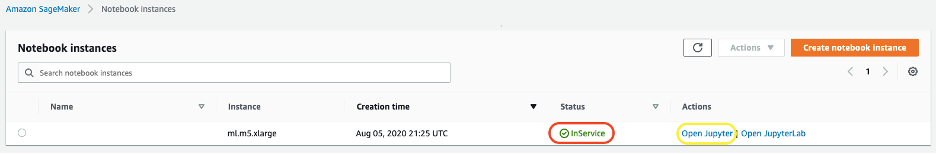

- Depois que a pilha for iniciada com sucesso, abra o console do SageMaker e escolha Instâncias de notebook no nome de navegação.

- Procure uma instância com o

DocProcessingNotebookInstance-prefix e aguarde até que seu status seja InService. - Debaixo Opções, escolha Abra o Jupyter.

Execute o bloco de anotações de exemplo

Para executar seu notebook, conclua as seguintes etapas:

- Escolha o

Rekognition_Custom_Labelscaderno de exemplo.

- Escolha Execute para executar as células no notebook de exemplo em ordem.

O notebook demonstra todo o ciclo de vida de preparação de imagens de treinamento e teste, rotulagem, criação de arquivos de manifesto, treinamento de um modelo e execução do modelo treinado com Rótulos personalizados do Rekognition. Como alternativa, você pode treinar e executar o modelo usando o console Rekognition Custom Labels. Para obter instruções, consulte Treinando um modelo (console).

O caderno é autoexplicativo; você pode seguir as etapas para concluir o treinamento do modelo.

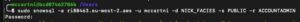

- Anote o

ProjectVersionArnpara fornecer o pipeline de inferência em uma etapa posterior.

Para instâncias de notebook SageMaker, você é cobrado pelo tipo de instância escolhido, com base na duração do uso. Se você tiver concluído o treinamento do modelo, poderá interromper a instância do notebook para evitar o custo de recursos ociosos.

Implante o pipeline de inferência com o AWS CloudFormation

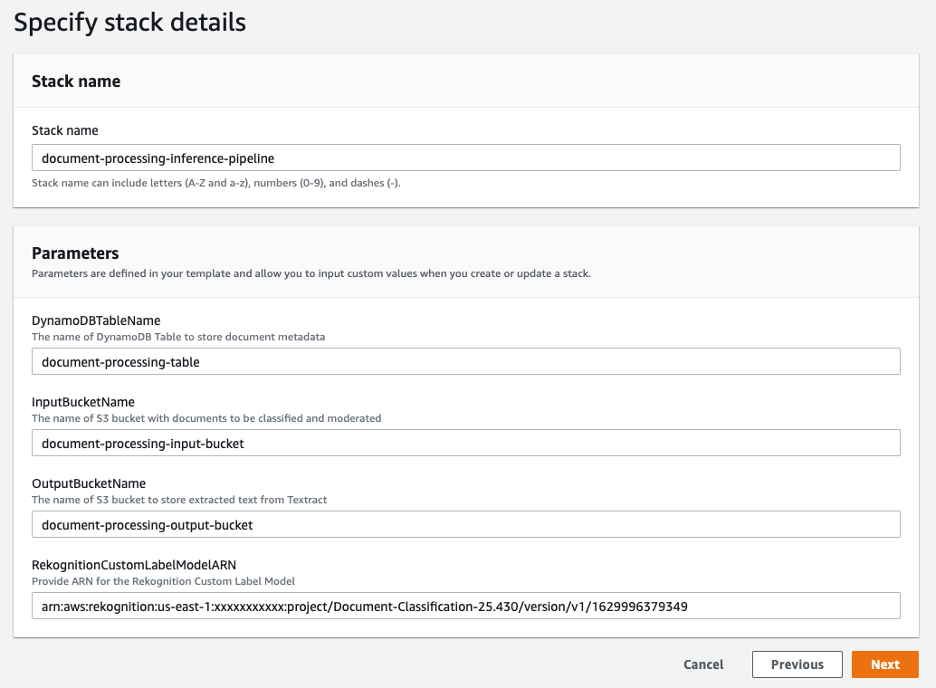

Para implantar o pipeline de inferência, conclua as etapas a seguir:

- Inicie o seguinte modelo do CloudFormation na região Leste dos EUA (Norte da Virgínia):

- Escolha Nome da pilha, insira um nome, como

document-processing-inference-pipeline. - Escolha DynamoDBTableName, insira um nome de tabela exclusivo do DynamoDB; por exemplo,

document-processing-table. - Escolha EntradaBucketName, insira um nome exclusivo para o bucket do S3 que a pilha cria; por exemplo,

document-processing-input-bucket.

Os documentos de entrada são carregados neste bucket antes de serem processados. Use apenas caracteres minúsculos e sem espaços ao criar o nome do bucket de entrada. Além disso, essa operação cria um novo bucket do S3, portanto, não use o nome de um bucket existente. Para mais informações, veja Regras para Nomenclatura de Bucket.

- Escolha OutputBucketName, insira um nome exclusivo para seu bucket de saída; por exemplo, d

ocument-processing-output-bucket.

Este bucket armazena os documentos de saída após serem processados. Ele também armazena páginas de documentos de entrada PDF de várias páginas depois de serem divididos pela função Lambda. Siga as mesmas regras de nomenclatura do seu bucket de entrada.

- Escolha RekognitionCustomLabelModelARN, introduzir o

ProjectVersionArnvalor que você anotou no notebook Jupyter. - Escolha Próximo.

- No Configurar opções de pilha página, defina quaisquer parâmetros adicionais para a pilha, incluindo tags.

- Escolha Próximo.

- No Capacidades e transformações seção, marque a caixa de seleção para reconhecer que o AWS CloudFormation pode criar recursos do IAM.

- Escolha Criar pilha.

A página de detalhes da pilha deve mostrar o status da pilha como CREATE_IN_PROGRESS. Pode levar até 5 minutos para que o status mude para CREATE_COMPLETE. Quando estiver concluído, você pode ver os resultados no Saídas aba.

Processar um documento pelo pipeline

Implementamos pipelines de treinamento e inferência e agora estamos prontos para usar a solução e processar um documento.

- No console do Amazon S3, abra o bucket de entrada.

- Carregue um documento de amostra na pasta S3.

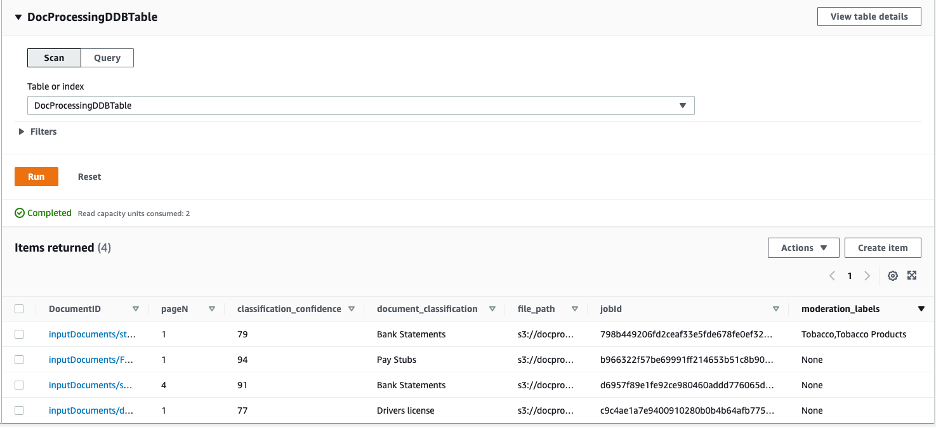

Isso inicia o fluxo de trabalho. O processo preenche a tabela do DynamoDB com classificação de documentos e rótulos de moderação. A saída do Amazon Textract é entregue ao bucket de saída do S3 no TextractOutput pasta.

Enviamos alguns documentos de amostra diferentes para o fluxo de trabalho e recebemos as seguintes informações preenchidas na tabela do DynamoDB.

Se você não vir itens na tabela do DynamoDB ou documentos carregados no bucket de saída do S3, verifique o Logs do Amazon CloudWatch para a função Lambda correspondente e procure erros potenciais que causaram a falha.

limpar

Conclua as etapas a seguir para limpar os recursos implantados para esta solução:

- No console do CloudFormation, escolha Pilhas.

- Selecione as pilhas implantadas para esta solução.

- Escolha Apagar.

Essas etapas não excluem os buckets do S3, a tabela do DynamoDB e o modelo de rótulos personalizados do Rekognition treinado. Você continua a incorrer em cobranças de armazenamento se elas não forem excluídas. Você deve excluir esses recursos diretamente por meio de seus respectivos consoles de serviço se não precisar mais deles.

Conclusão

Neste post, apresentamos uma abordagem escalável, segura e automatizada para moderar, classificar e processar documentos. Empresas de vários setores podem usar essa solução para melhorar seus negócios e atender melhor seus clientes. Ele permite um processamento de documentos mais rápido e maior precisão, além de reduzir a complexidade da extração de dados. Também oferece melhor segurança e conformidade com a legislação de dados pessoais, reduzindo a força de trabalho humana envolvida no processamento de documentos recebidos.

Para mais informações, consulte o Guia de rótulos personalizados do Amazon Rekognition, Guia do desenvolvedor do Amazon Rekognition e Guia do desenvolvedor do Amazon Textract. Se você é novo no Amazon Rekognition Custom Labels, experimente-o usando nosso nível gratuito, que dura 3 meses e inclui 10 horas de treinamento gratuitas por mês e 4 horas de inferência gratuitas por mês. O nível gratuito do Amazon Rekognition inclui o processamento de 5,000 imagens por mês durante 12 meses. O nível gratuito do Amazon Textract também dura três meses e inclui 1,000 páginas por mês para a API Detect Document Text.

Sobre os autores

Jay Rao é um arquiteto de soluções principal na AWS. Ele gosta de fornecer orientação técnica e estratégica aos clientes e ajudá-los a projetar e implementar soluções na AWS.

Jay Rao é um arquiteto de soluções principal na AWS. Ele gosta de fornecer orientação técnica e estratégica aos clientes e ajudá-los a projetar e implementar soluções na AWS.

Uchenna Egbe é um arquiteto de soluções associado na AWS. Ele passa seu tempo livre pesquisando sobre ervas, chás, superalimentos e como pode incorporá-los em sua dieta diária.

Uchenna Egbe é um arquiteto de soluções associado na AWS. Ele passa seu tempo livre pesquisando sobre ervas, chás, superalimentos e como pode incorporá-los em sua dieta diária.

- Coinsmart. A melhor troca de Bitcoin e criptografia da Europa.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. ACESSO LIVRE.

- CryptoHawk. Radar Altcoin. Teste grátis.

- Fonte: https://aws.amazon.com/blogs/machine-learning/moderate-classify-and-process-documents-using-amazon-rekognition-and-amazon-texttract/

- "

- 000

- 10

- 100

- 116

- de 12 meses

- Sobre

- Acesso

- em

- ações

- atividades

- Adicional

- AI

- Serviços de IA

- Amazon

- Outro

- api

- aplicações

- abordagem

- arquitetura

- Jurídico

- Automatizado

- AWS

- Bank

- antes

- morada

- fronteira

- Caixa

- construir

- Prédio

- ônibus

- negócio

- chamada

- capacidades

- causado

- central

- desafios

- alterar

- carregada

- acusações

- Escolha

- classificação

- código

- Empresas

- competitivo

- compliance

- compatível

- Computar

- computador

- confiança

- cônsul

- contém

- conteúdo

- continuar

- Correspondente

- relação custo-benefício

- cobrir

- crio

- cria

- Criar

- personalizadas

- Clientes

- dados,

- banco de dados

- entregue

- entrega

- implantar

- implantado

- Design

- detalhes

- Developer

- Dieta

- diferente

- diretamente

- INSTITUCIONAIS

- eficientemente

- esforço

- esforços

- Entrar

- Evento

- eventos

- evolui

- exemplo

- exemplos

- existente

- Extractos

- Rosto

- Falha

- mais rápido

- Primeiro nome

- seguir

- seguinte

- formulário

- formato

- formas

- Gratuito

- função

- funções

- Além disso

- manipular

- ajudar

- ajuda

- superior

- Como funciona o dobrador de carta de canal

- Contudo

- HTTPS

- humano

- identificar

- Identidade

- imagem

- executar

- melhorar

- incluir

- inclui

- Incluindo

- Individual

- indústrias

- indústria

- INFORMAÇÕES

- entrada

- insights

- integrado

- Inteligente

- envolvido

- IT

- Trabalho

- marcação

- Rótulos

- língua

- lançado

- aprendizagem

- Legislação

- máquina

- aprendizado de máquina

- FAZ

- gerenciados

- de grupos

- manual

- Match

- poder

- ML

- modelo

- modelos

- Mês

- mês

- mais

- múltiplo

- natural

- Navegação

- necessário

- Cria

- caderno

- aberto

- operação

- Otimize

- ordem

- Pagar

- Pessoas

- atuação

- pessoal

- dados pessoais

- potencial

- Diretor

- problemas

- processo

- em processamento

- fornecer

- fornece

- fornecendo

- público

- em tempo real

- recebido

- reduzir

- redução

- relevante

- Recursos

- resposta

- regras

- Execute

- corrida

- escalável

- Escala

- Cenas

- seguro

- segurança

- Série

- Serverless

- serviço

- Serviços

- conjunto

- simples

- So

- Software

- software como serviço

- sólido

- solução

- Soluções

- Resolve

- espaços

- divisão

- splits

- pilha

- começa

- Estado

- declarações

- Status

- ficar

- armazenamento

- loja

- lojas

- Estratégico

- apresentado

- entraram com sucesso

- .

- sistemas

- tarefas

- imposto

- Dados Técnicos:

- técnicas

- Tecnologias

- teste

- ensaio

- Através da

- tempo

- demorado

- vezes

- Training

- transferência

- único

- us

- usar

- valor

- Verificação

- VÍDEOS

- Ver

- Virgínia

- visão

- volume

- esperar

- sem

- Força de trabalho