As empresas estão usando cada vez mais o aprendizado de máquina (ML) para tomar decisões quase em tempo real, como colocar um anúncio, atribuir um motorista, recomendar um produto ou até mesmo precificar dinamicamente produtos e serviços. Os modelos de ML fazem previsões a partir de um conjunto de dados de entrada conhecido como características, e os cientistas de dados gastam facilmente mais de 60% de seu tempo projetando e construindo esses recursos. Além disso, previsões altamente precisas dependem do acesso oportuno a valores de recursos que mudam rapidamente ao longo do tempo, adicionando ainda mais complexidade ao trabalho de criar uma solução altamente disponível e precisa. Por exemplo, um modelo de aplicativo de carona pode escolher o melhor preço para uma corrida saindo do aeroporto, mas apenas se souber o número de solicitações de carona recebidas nos últimos 10 minutos e o número de passageiros projetados para desembarcar nos próximos 10 minutos. Um modelo de roteamento em um aplicativo de call center pode escolher o melhor agente disponível para uma chamada recebida, mas só é eficaz se souber os últimos cliques da sessão da web do cliente.

Embora o valor comercial das previsões de ML quase em tempo real seja enorme, a arquitetura necessária para fornecê-las de maneira confiável, segura e com bom desempenho é complicada. As soluções precisam de atualizações de alto rendimento e recuperação de baixa latência dos valores de recursos mais recentes em milissegundos, algo que a maioria dos cientistas de dados não está preparada para oferecer. Como resultado, algumas empresas gastaram milhões de dólares inventando sua própria infraestrutura proprietária para gerenciamento de recursos. Outras empresas limitaram seus aplicativos de ML a padrões mais simples, como pontuação em lote, até que os fornecedores de ML forneçam soluções prontas para uso mais abrangentes para lojas de recursos online.

Para enfrentar esses desafios, Loja de recursos Amazon SageMaker fornece um repositório central totalmente gerenciado para recursos de ML, facilitando o armazenamento e a recuperação segura de recursos sem a necessidade de criar e manter sua própria infraestrutura. O Feature Store permite que você defina grupos de recursos, use ingestão de lote e ingestão de streaming, recupere os valores de recursos mais recentes com latência de milissegundos de um dígito para previsões on-line altamente precisas e extraia conjuntos de dados corretos no momento para treinamento. Em vez de criar e manter esses recursos de infraestrutura, você obtém um serviço totalmente gerenciado que escala à medida que seus dados crescem, permite o compartilhamento de recursos entre equipes e permite que seus cientistas de dados se concentrem na criação de excelentes modelos de ML destinados a casos de uso de negócios que mudam o jogo. As equipes agora podem fornecer recursos robustos uma vez e reutilizá-los várias vezes em uma variedade de modelos que podem ser criados por equipes diferentes.

Esta postagem apresenta um exemplo completo de como você pode combinar a engenharia de recursos de streaming com a Feature Store para tomar decisões baseadas em ML quase em tempo real. Mostramos um caso de uso de detecção de fraude de cartão de crédito que atualiza recursos agregados de uma transmissão ao vivo de transações e usa recuperações de recursos de baixa latência para ajudar a detectar transações fraudulentas. Experimente você mesmo visitando nosso GitHub repo.

Caso de uso de fraude de cartão de crédito

Números de cartão de crédito roubados podem ser comprados em grandes quantidades na dark web de vazamentos anteriores ou hacks de organizações que armazenam esses dados confidenciais. Os fraudadores compram essas listas de cartões e tentam fazer o máximo possível de transações com os números roubados até que o cartão seja bloqueado. Esses ataques de fraude geralmente acontecem em um curto período de tempo e isso pode ser facilmente detectado em transações históricas porque a velocidade das transações durante o ataque difere significativamente do padrão de gasto normal do titular do cartão.

A tabela a seguir mostra uma sequência de transações de um cartão de crédito em que o titular do cartão primeiro tem um padrão de gastos genuíno e, em seguida, sofre um ataque de fraude a partir de 4 de novembro.

| núm_cc | trans_time | quantidade | rótulo_fraude |

| ... 1248 | 01 de novembro 14:50:01 | 10.15 | 0 |

| ... 1248 | 02 de novembro 12:14:31 | 32.45 | 0 |

| ... 1248 | 02 de novembro 16:23:12 | 3.12 | 0 |

| ... 1248 | 04 de novembro 02:12:10 | 1.01 | 1 |

| ... 1248 | 04 de novembro 02:13:34 | 22.55 | 1 |

| ... 1248 | 04 de novembro 02:14:05 | 90.55 | 1 |

| ... 1248 | 04 de novembro 02:15:10 | 60.75 | 1 |

| ... 1248 | 04 de novembro 13:30:55 | 12.75 | 0 |

Para esta postagem, treinamos um modelo de ML para identificar esse tipo de comportamento por meio de recursos de engenharia que descrevem o padrão de gastos de um cartão individual, como o número de transações ou o valor médio da transação desse cartão em uma determinada janela de tempo. Esse modelo protege os titulares de cartões contra fraudes no ponto de venda, detectando e bloqueando transações suspeitas antes que o pagamento seja concluído. O modelo faz previsões em um contexto de baixa latência em tempo real e conta com o recebimento de cálculos de recursos atualizados para que possa responder a um ataque de fraude em andamento. Em um cenário do mundo real, os recursos relacionados aos padrões de gastos do titular do cartão fariam apenas parte do conjunto de recursos do modelo e podemos incluir informações sobre o comerciante, o titular do cartão, o dispositivo usado para efetuar o pagamento e quaisquer outros dados que possam ser relevantes para detectar fraudes.

Como nosso caso de uso depende do perfil dos padrões de gastos de um cartão individual, é crucial que possamos identificar os cartões de crédito em um fluxo de transação. A maioria dos conjuntos de dados de detecção de fraude disponíveis publicamente não fornece essas informações, então usamos o Python Faker biblioteca para gerar um conjunto de transações cobrindo um período de 5 meses. Este conjunto de dados contém 5.4 milhões de transações espalhadas por 10,000 números de cartão de crédito únicos (e falsos) e é intencionalmente desequilibrado para corresponder à realidade da fraude de cartão de crédito (apenas 0.25% das transações são fraudulentas). Variamos o número de transações por dia por cartão, bem como os valores das transações. veja nosso GitHub repo para mais detalhes.

Visão geral da solução

Queremos que nosso modelo de detecção de fraude classifique as transações de cartão de crédito, observando uma explosão de transações recentes que difere significativamente do padrão de gasto normal do titular do cartão. Parece bastante simples, mas como o construímos?

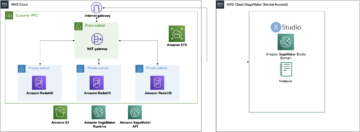

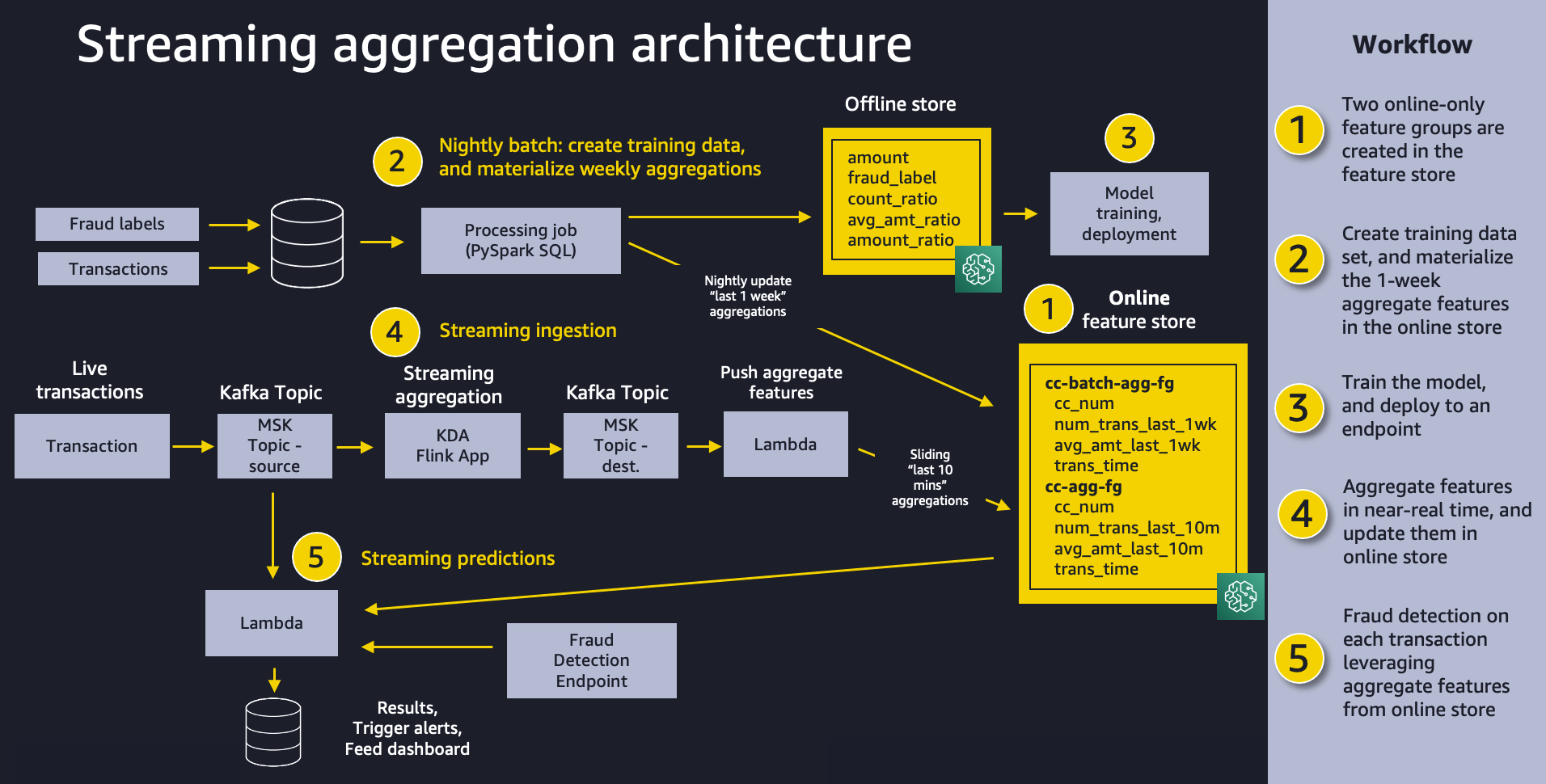

O diagrama a seguir mostra nossa arquitetura geral de solução. Acreditamos que esse mesmo padrão funcionará bem para uma variedade de casos de uso de agregação de streaming. Em um nível alto, o padrão envolve as cinco peças a seguir:

- Loja de artigos – Usamos o Feature Store para fornecer um repositório de recursos com gravações de alto rendimento e leituras seguras de baixa latência, usando valores de recursos organizados em vários grupos de recursos.

- Ingestão em lote – A ingestão em lote usa transações de cartão de crédito históricas rotuladas e cria os recursos agregados e as taxas necessárias para treinar o modelo de detecção de fraude. Nós usamos um Processamento do Amazon SageMaker trabalho e o contêiner Spark integrado para calcular contagens semanais agregadas e médias de quantidade de transações e inseri-las no armazenamento de recursos para uso em inferência online.

- Treinamento e implantação de modelo – Este aspecto da nossa solução é direto. Nós usamos Amazon Sage Maker para treinar um modelo usando o algoritmo XGBoost integrado em recursos agregados criados a partir de transações históricas. O modelo é implantado em um terminal SageMaker, onde lida com solicitações de detecção de fraude em transações ao vivo.

- Ingestão de streaming - A Análise de dados do Amazon Kinesis para o aplicativo Apache Flink apoiado pelos tópicos do Apache Kafka em Amazon Managed Streaming para Apache Kafka (MSK) (Amazon MSK) calcula recursos agregados de um fluxo de transação e um AWS Lambda A função atualiza a loja de recursos online. Apache Flink é uma estrutura e mecanismo popular para processamento de fluxos de dados.

- Previsões de streaming – Por fim, fazemos previsões de fraude em um fluxo de transações, usando o Lambda para extrair recursos agregados da loja de recursos online. Usamos os dados de recursos mais recentes para calcular as taxas de transação e, em seguida, chamamos o endpoint de detecção de fraude.

Pré-requisitos

Nós fornecemos um Formação da Nuvem AWS modelo para criar os recursos de pré-requisito para esta solução. A tabela a seguir lista as pilhas disponíveis para diferentes regiões.

Nas seções a seguir, exploramos cada componente de nossa solução com mais detalhes.

Loja de artigos

Os modelos de ML contam com recursos bem projetados provenientes de uma variedade de fontes de dados, com transformações tão simples quanto cálculos ou tão complicadas quanto um pipeline de várias etapas que leva horas de computação e codificação complexa. A Feature Store permite a reutilização desses recursos entre equipes e modelos, o que melhora a produtividade do cientista de dados, acelera o tempo de lançamento no mercado e garante a consistência da entrada do modelo.

Cada recurso dentro do Feature Store é organizado em um agrupamento lógico chamado grupo de recursos. Você decide quais grupos de recursos você precisa para seus modelos. Cada um pode ter dezenas, centenas ou até milhares de recursos. Os grupos de recursos são gerenciados e dimensionados de forma independente, mas estão todos disponíveis para pesquisa e descoberta em equipes de cientistas de dados responsáveis por muitos modelos e casos de uso independentes de ML.

Os modelos de ML geralmente requerem recursos de vários grupos de recursos. Um aspecto importante de um grupo de recursos é a frequência com que seus valores de recursos precisam ser atualizados ou materializados para treinamento posterior ou inferência. Você atualiza alguns recursos de hora em hora, todas as noites ou semanalmente, e um subconjunto de recursos deve ser transmitido para o armazenamento de recursos quase em tempo real. O streaming de todas as atualizações de recursos levaria a uma complexidade desnecessária e poderia até mesmo diminuir a qualidade das distribuições de dados por não dar a você a chance de remover outliers.

Em nosso caso de uso, criamos um grupo de recursos chamado cc-agg-batch-fg para recursos agregados de cartão de crédito atualizados em lote, e um chamado cc-agg-fg para recursos de streaming.

A cc-agg-batch-fg grupo de recursos é atualizado todas as noites e fornece recursos agregados olhando para trás em uma janela de tempo de 1 semana. Recalcular agregações de 1 semana em transações de streaming não oferece sinais significativos e seria um desperdício de recursos.

Por outro lado, nosso cc-agg-fg O grupo de recursos deve ser atualizado de forma contínua, porque oferece as contagens de transações mais recentes e os valores médios das transações em uma janela de tempo de 10 minutos. Sem a agregação de streaming, não poderíamos identificar o padrão típico de ataque de fraude de uma sequência rápida de compras.

Ao isolar os recursos que são recalculados todas as noites, podemos melhorar a taxa de transferência de ingestão para nossos recursos de streaming. A separação nos permite otimizar a ingestão para cada grupo de forma independente. Ao projetar para seus casos de uso, lembre-se de que os modelos que exigem recursos de um grande número de grupos de recursos podem querer fazer várias recuperações do armazenamento de recursos em paralelo para evitar a adição de latência excessiva a um fluxo de trabalho de previsão em tempo real.

Os grupos de recursos para nosso caso de uso são mostrados na tabela a seguir.

| cc-agg-fg | cc-agg-lote-fg |

| cc_num (ID do registro) | cc_num (ID do registro) |

| trans_time | trans_time |

| num_trans_last_10m | num_trans_last_1w |

| avg_amt_last_10m | avg_amt_last_1w |

Cada grupo de recursos deve ter um recurso usado como identificador de registro (para esta postagem, o número do cartão de crédito). O identificador de registro atua como uma chave primária para o grupo de recursos, permitindo pesquisas rápidas, bem como associações entre grupos de recursos. Um recurso de horário de evento também é necessário, o que permite que o armazenamento de recursos rastreie o histórico dos valores dos recursos ao longo do tempo. Isso se torna importante quando se olha para trás no estado dos recursos em um momento específico.

Em cada grupo de recursos, rastreamos o número de transações por cartão de crédito exclusivo e seu valor médio de transação. A única diferença entre nossos dois grupos é a janela de tempo usada para agregação. Usamos uma janela de 10 minutos para agregação de streaming e uma janela de 1 semana para agregação de lote.

Com o Feature Store, você tem a flexibilidade de criar grupos de recursos apenas offline, apenas online ou online e offline. Uma loja online fornece gravações de alto rendimento e recuperações de valores de recursos de baixa latência, o que é ideal para inferência online. Uma loja off-line é fornecida usando Serviço de armazenamento simples da Amazon (Amazon S3), oferecendo às empresas um repositório altamente escalável, com um histórico completo de valores de recursos, particionado por grupo de recursos. A loja offline é ideal para casos de uso de treinamento e pontuação em lote.

Quando você permite que um grupo de recursos forneça lojas on-line e off-line, o SageMaker sincroniza automaticamente os valores dos recursos com uma loja off-line, acrescentando continuamente os valores mais recentes para fornecer um histórico completo dos valores ao longo do tempo. Outro benefício dos grupos de recursos que estão online e offline é que eles ajudam a evitar o problema de treinamento e distorção de inferência. O SageMaker permite que você alimente o treinamento e a inferência com os mesmos valores de recursos transformados, garantindo consistência para gerar previsões mais precisas. O foco em nossa postagem é demonstrar o streaming de recursos online, então implementamos grupos de recursos somente online.

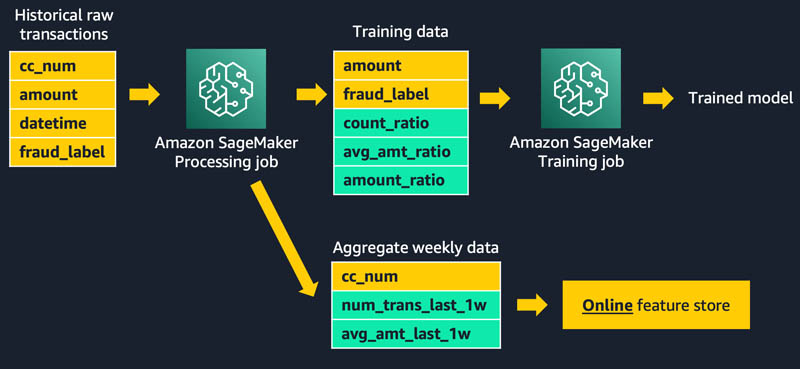

Ingestão em lote

Para materializar nossos recursos de lote, criamos um pipeline de recursos que é executado como um trabalho de processamento do SageMaker todas as noites. O trabalho tem duas responsabilidades: produzir o conjunto de dados para treinar nosso modelo e preencher o grupo de recursos em lote com os valores mais atualizados para recursos agregados de 1 semana, conforme mostrado no diagrama a seguir.

Cada transação histórica usada no conjunto de treinamento é enriquecida com recursos agregados para o cartão de crédito específico envolvido na transação. Nós olhamos para trás em duas janelas de tempo deslizantes separadas: 1 semana atrás e os 10 minutos anteriores. Os recursos reais usados para treinar o modelo incluem as seguintes proporções desses valores agregados:

- amt_ratio1 =

avg_amt_last_10m / avg_amt_last_1w - amt_ratio2 =

transaction_amount / avg_amt_last_1w - contagem_ratio =

num_trans_last_10m / num_trans_last_1w

Por exemplo, count_ratio é a contagem de transações dos 10 minutos anteriores dividida pela contagem de transações da última semana.

Nosso modelo de ML pode aprender padrões de atividade normal versus atividade fraudulenta a partir dessas proporções, em vez de depender de contagens brutas e valores de transação. Os padrões de gastos em diferentes cartões variam muito, portanto, as taxas normalizadas fornecem um sinal melhor para o modelo do que os próprios valores agregados.

Você pode estar se perguntando por que nosso trabalho em lote está computando recursos com uma retrospectiva de 10 minutos. Isso não é relevante apenas para inferência online? Precisamos da janela de 10 minutos nas transações históricas para criar um conjunto de dados de treinamento preciso. Isso é fundamental para garantir a consistência com a janela de streaming de 10 minutos que será usada quase em tempo real para dar suporte à inferência online.

O conjunto de dados de treinamento resultante do trabalho de processamento pode ser salvo diretamente como um CSV para treinamento de modelo ou pode ser ingerido em massa em um grupo de recursos off-line que pode ser usado para outros modelos e por outras equipes de ciência de dados para abordar uma ampla variedade de outros casos de uso. Por exemplo, podemos criar e preencher um grupo de recursos chamado cc-transactions-fg. Nosso job de treinamento pode extrair um conjunto de dados de treinamento específico com base nas necessidades de nosso modelo específico, selecionando intervalos de datas específicos e um subconjunto de recursos de interesse. Essa abordagem permite que várias equipes reutilizem grupos de recursos e mantenham menos pipelines de recursos, levando a economias de custo significativas e melhorias de produtividade ao longo do tempo. Este exemplo de notebook demonstra o padrão de uso do Feature Store como um repositório central do qual os cientistas de dados podem extrair conjuntos de dados de treinamento.

Além de criar um conjunto de dados de treinamento, usamos o PutRecord API para colocar as agregações de recursos de 1 semana na loja de recursos online todas as noites. O código a seguir demonstra como colocar um registro em um grupo de recursos on-line com valores de recursos específicos, incluindo um identificador de registro e um horário de evento:

Os engenheiros de ML geralmente criam uma versão separada do código de engenharia de recursos para recursos online com base no código original escrito por cientistas de dados para treinamento de modelo. Isso pode fornecer o desempenho desejado, mas é uma etapa extra de desenvolvimento e apresenta mais chances de distorção de treinamento e inferência. Em nosso caso de uso, mostramos como o uso de SQL para agregações pode permitir que um cientista de dados forneça o mesmo código para lote e streaming.

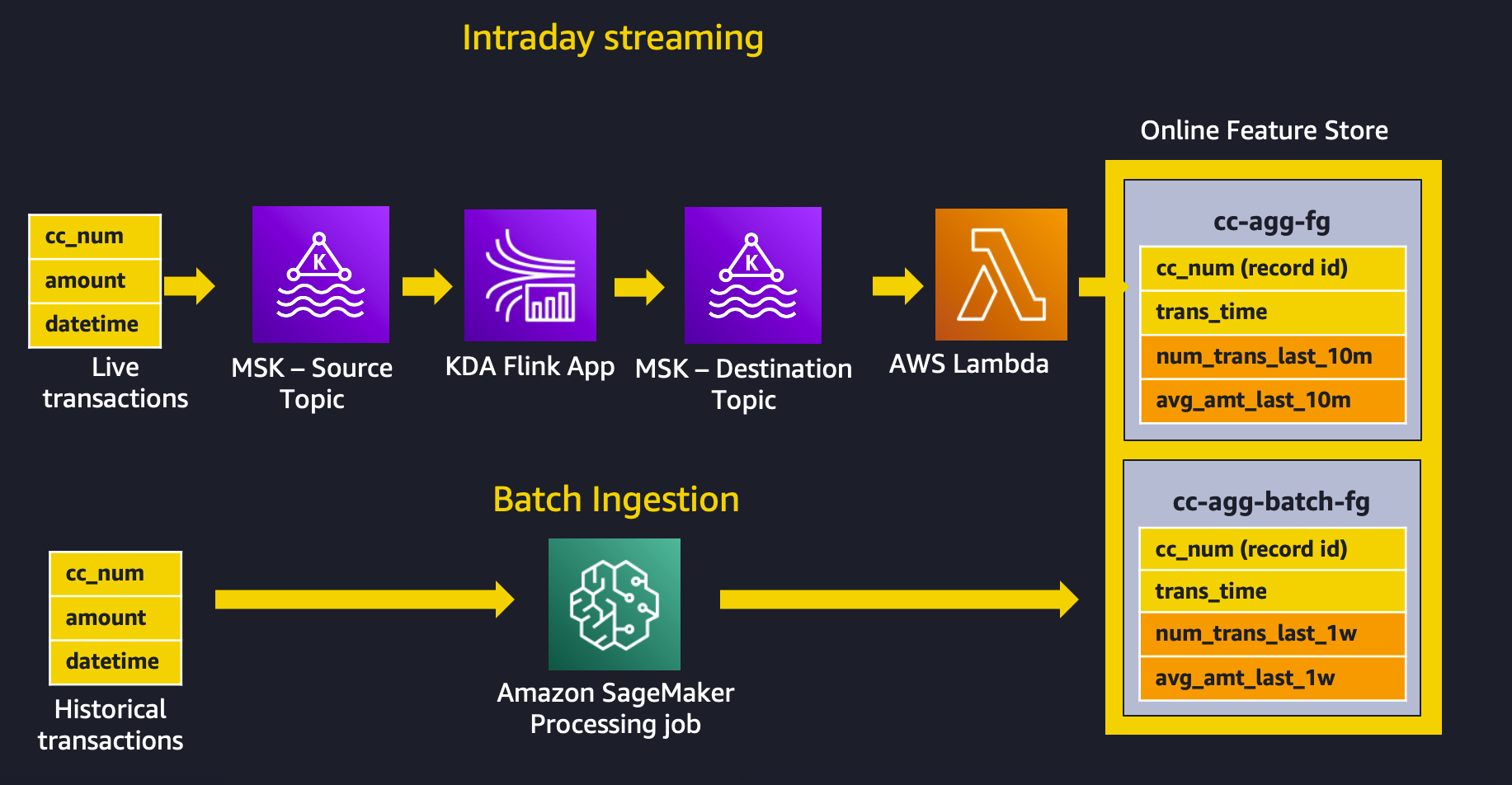

Ingestão de streaming

A Feature Store oferece recuperação de milissegundos de um dígito de recursos pré-calculados e também pode desempenhar um papel eficaz em soluções que exigem ingestão de streaming. Nosso caso de uso demonstra ambos. O lookback semanal é tratado como um grupo de recursos pré-calculado, materializado todas as noites, conforme mostrado anteriormente. Agora vamos nos aprofundar em como calculamos os recursos agregados em tempo real em uma janela de 10 minutos e os ingerimos no armazenamento de recursos para inferência online posterior.

Em nosso caso de uso, ingerimos transações de cartão de crédito em tempo real para um tópico MSK de origem e usamos um aplicativo Kinesis Data Analytics para Apache Flink para criar recursos agregados em um tópico MSK de destino. O aplicativo é escrito usando Apache FlinkSQL. O Flink SQL simplifica o desenvolvimento de aplicativos de streaming usando o SQL padrão. É fácil aprender o Flink se você já trabalhou com um banco de dados ou sistema semelhante ao SQL permanecendo compatível com ANSI-SQL 2011. Além do SQL, podemos construir aplicativos Java e Scala em Análise de dados do Amazon Kinesis usando bibliotecas de código aberto baseadas no Apache Flink. Em seguida, usamos uma função do Lambda para ler o tópico do MSK de destino e inserir os recursos agregados em um grupo de recursos do SageMaker para inferência. Criar o aplicativo Apache Flink usando a API SQL do Flink é simples. Usamos Flink SQL para agregar os dados de streaming no tópico MSK de origem e armazená-los em um tópico MSK de destino.

Para produzir contagens agregadas e valores médios olhando para trás em uma janela de 10 minutos, usamos a seguinte consulta Flink SQL no tópico de entrada e canalizamos os resultados para o tópico de destino:

| núm_cc | quantidade | datetime | num_trans_last_10m | avg_amt_last_10m |

| ... 1248 | 50.00 | Nov-01,22: 01: 00 | 1 | 74.99 |

| ... 9843 | 99.50 | Nov-01,22: 02: 30 | 1 | 99.50 |

| ... 7403 | 100.00 | Nov-01,22: 03: 48 | 1 | 100.00 |

| ... 1248 | 200.00 | Nov-01,22: 03: 59 | 2 | 125.00 |

| ... 0732 | 26.99 | 01 de novembro, 22:04:15 | 1 | 26.99 |

| ... 1248 | 50.00 | Nov-01,22: 04: 28 | 3 | 100.00 |

| ... 1248 | 500.00 | Nov-01,22: 05: 05 | 4 | 200.00 |

Neste exemplo, observe que a linha final tem uma contagem de quatro transações nos últimos 10 minutos do cartão de crédito terminando com 1248 e um valor médio de transação correspondente de $ 200.00. A consulta SQL é consistente com aquela usada para conduzir a criação de nosso conjunto de dados de treinamento, ajudando a evitar distorção de treinamento e inferência.

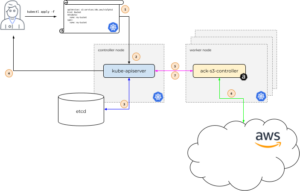

À medida que as transações são transmitidas para o aplicativo de agregação Kinesis Data Analytics para Apache Flink, o aplicativo envia os resultados agregados para nossa função Lambda, conforme mostrado no diagrama a seguir. A função do Lambda pega esses recursos e preenche o cc-agg-fg grupo de recursos.

Enviamos os valores de recursos mais recentes para o armazenamento de recursos do Lambda usando uma chamada simples para a API PutRecord. A seguir está a parte principal do código Python para armazenar os recursos agregados:

Preparamos o registro como uma lista de pares de valores nomeados, incluindo a hora atual como a hora do evento. A API do Feature Store garante que esse novo registro siga o esquema que identificamos quando criamos o grupo de recursos. Se já existia um registro para essa chave primária, ele agora é substituído na loja online.

Previsões de streaming

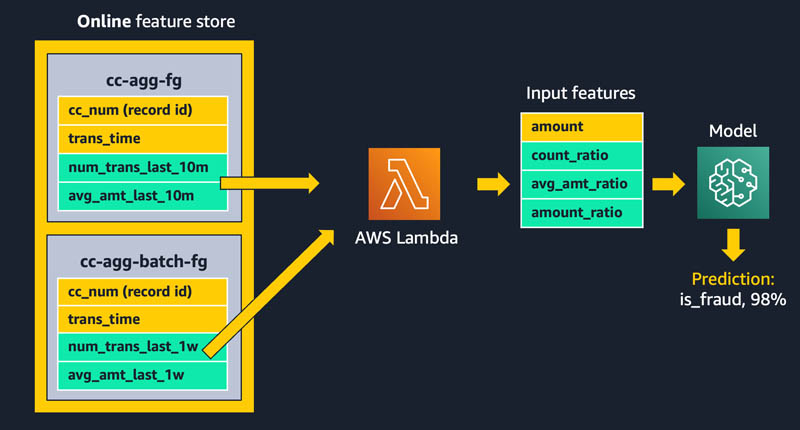

Agora que temos ingestão de streaming para manter o armazenamento de recursos atualizado com os valores de recursos mais recentes, vamos ver como fazemos previsões de fraude.

Criamos uma segunda função do Lambda que usa o tópico do MSK de origem como um gatilho. Para cada novo evento de transação, a função do Lambda primeiro recupera os recursos de lote e streaming do Feature Store. Para detectar anomalias no comportamento do cartão de crédito, nosso modelo procura picos nos valores de compras recentes ou na frequência de compras. A função Lambda calcula proporções simples entre as agregações de 1 semana e as agregações de 10 minutos. Em seguida, ele invoca o endpoint do modelo SageMaker usando essas proporções para fazer a previsão de fraude, conforme mostrado no diagrama a seguir.

Usamos o seguinte código para recuperar valores de recursos sob demanda do armazenamento de recursos antes de chamar o endpoint do modelo SageMaker:

O SageMaker também suporta a recuperação de vários registros de recursos com um única chamada, mesmo que sejam de grupos de recursos diferentes.

Por fim, com o vetor de recursos de entrada do modelo montado, chamamos o endpoint do modelo para prever se uma transação de cartão de crédito específica é fraudulenta. O SageMaker também oferece suporte à recuperação de vários registros de recursos com uma única chamada, mesmo que sejam de diferentes grupos de recursos.

sagemaker_runtime = boto3.client(service_name='runtime.sagemaker')

request_body = ','.join(features)

response = sagemaker_runtime.invoke_endpoint( EndpointName=ENDPOINT_NAME, ContentType='text/csv', Body=request_body)

probability = json.loads(response['Body'].read().decode('utf-8'))Neste exemplo, o modelo voltou com uma probabilidade de 98% de que a transação específica era fraudulenta e foi capaz de usar recursos de entrada agregada quase em tempo real com base nos 10 minutos mais recentes de transações naquele cartão de crédito.

Teste a solução de ponta a ponta

Para demonstrar o fluxo de trabalho completo de ponta a ponta de nossa solução, simplesmente enviamos transações de cartão de crédito para nosso tópico de origem do MSK. Nossa agregação automatizada do Kinesis Data Analytics para Apache Flink assume a partir daí, mantendo uma visualização quase em tempo real das contagens e valores de transações na Feature Store, com uma janela de lookback deslizante de 10 minutos. Esses recursos são combinados com os recursos agregados de 1 semana que já foram ingeridos na loja de recursos em lote, permitindo-nos fazer previsões de fraude em cada transação.

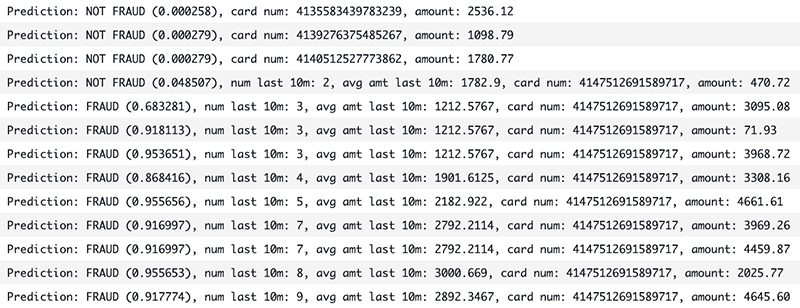

Enviamos uma única transação de três cartões de crédito diferentes. Em seguida, simulamos um ataque de fraude em um quarto cartão de crédito, enviando muitas transações consecutivas em segundos. A saída da nossa função Lambda é mostrada na captura de tela a seguir. Como esperado, as três primeiras transações pontuais são previstas como NOT FRAUD. Das 10 transações fraudulentas, a primeira está prevista como NOT FRAUD, e o restante está corretamente identificado como FRAUD. Observe como os recursos agregados são mantidos atualizados, ajudando a gerar previsões mais precisas.

Conclusão

Mostramos como o Feature Store pode desempenhar um papel fundamental na arquitetura da solução para fluxos de trabalho operacionais críticos que precisam de agregação de streaming e inferência de baixa latência. Com um armazenamento de recursos pronto para empresas, você pode usar a ingestão em lote e a ingestão de streaming para alimentar grupos de recursos e acessar valores de recursos sob demanda para realizar previsões on-line para um valor comercial significativo. Os recursos de ML agora podem ser compartilhados em escala entre muitas equipes de cientistas de dados e milhares de modelos de ML, melhorando a consistência dos dados, a precisão do modelo e a produtividade do cientista de dados. A Feature Store já está disponível e você pode experimentá-la exemplo inteiro. Deixe-nos saber o que você pensa.

Agradecimentos especiais a todos que contribuíram para o Postagem de blog anterior com uma arquitetura semelhante: Paul Hargis, James Leoni e Arunprasath Shankar.

Sobre os autores

Marcos Roy é o principal arquiteto de aprendizado de máquina da AWS, ajudando os clientes a projetar e criar soluções de IA/ML. O trabalho de Mark abrange uma ampla variedade de casos de uso de ML, com interesse principal em armazenamento de recursos, visão computacional, aprendizado profundo e dimensionamento de ML em toda a empresa. Ele ajudou empresas em muitos setores, incluindo seguros, serviços financeiros, mídia e entretenimento, saúde, serviços públicos e manufatura. Mark possui seis certificações da AWS, incluindo a ML Specialty Certification. Antes de ingressar na AWS, Mark foi arquiteto, desenvolvedor e líder de tecnologia por mais de 25 anos, incluindo 19 anos em serviços financeiros.

Marcos Roy é o principal arquiteto de aprendizado de máquina da AWS, ajudando os clientes a projetar e criar soluções de IA/ML. O trabalho de Mark abrange uma ampla variedade de casos de uso de ML, com interesse principal em armazenamento de recursos, visão computacional, aprendizado profundo e dimensionamento de ML em toda a empresa. Ele ajudou empresas em muitos setores, incluindo seguros, serviços financeiros, mídia e entretenimento, saúde, serviços públicos e manufatura. Mark possui seis certificações da AWS, incluindo a ML Specialty Certification. Antes de ingressar na AWS, Mark foi arquiteto, desenvolvedor e líder de tecnologia por mais de 25 anos, incluindo 19 anos em serviços financeiros.

Raj Ramasubbu é um arquiteto de soluções especialista em análises sênior com foco em big data e análises e IA/ML com Amazon Web Services. Ele ajuda os clientes a arquitetar e criar soluções baseadas em nuvem altamente escaláveis, de alto desempenho e seguras na AWS. Raj forneceu conhecimento técnico e liderança na criação de soluções de engenharia de dados, análise de big data, inteligência de negócios e ciência de dados por mais de 18 anos antes de ingressar na AWS. Ele ajudou clientes em vários setores verticais, como saúde, dispositivos médicos, ciências da vida, varejo, gestão de ativos, seguro de carro, REIT residencial, agricultura, seguro de título, cadeia de suprimentos, gerenciamento de documentos e imóveis.

Raj Ramasubbu é um arquiteto de soluções especialista em análises sênior com foco em big data e análises e IA/ML com Amazon Web Services. Ele ajuda os clientes a arquitetar e criar soluções baseadas em nuvem altamente escaláveis, de alto desempenho e seguras na AWS. Raj forneceu conhecimento técnico e liderança na criação de soluções de engenharia de dados, análise de big data, inteligência de negócios e ciência de dados por mais de 18 anos antes de ingressar na AWS. Ele ajudou clientes em vários setores verticais, como saúde, dispositivos médicos, ciências da vida, varejo, gestão de ativos, seguro de carro, REIT residencial, agricultura, seguro de título, cadeia de suprimentos, gerenciamento de documentos e imóveis.

Prabhakar Chandrasekaran é gerente técnico de contas sênior do AWS Enterprise Support. Prabhakar gosta de ajudar os clientes a criar soluções de IA/ML de ponta na nuvem. Ele também trabalha com clientes corporativos fornecendo orientação proativa e assistência operacional, ajudando-os a melhorar o valor de suas soluções ao usar a AWS. Prabhakar possui seis AWS e seis outras certificações profissionais. Com mais de 20 anos de experiência profissional, Prabhakar foi engenheiro de dados e líder de programa na área de serviços financeiros antes de ingressar na AWS.

Prabhakar Chandrasekaran é gerente técnico de contas sênior do AWS Enterprise Support. Prabhakar gosta de ajudar os clientes a criar soluções de IA/ML de ponta na nuvem. Ele também trabalha com clientes corporativos fornecendo orientação proativa e assistência operacional, ajudando-os a melhorar o valor de suas soluções ao usar a AWS. Prabhakar possui seis AWS e seis outras certificações profissionais. Com mais de 20 anos de experiência profissional, Prabhakar foi engenheiro de dados e líder de programa na área de serviços financeiros antes de ingressar na AWS.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Cunhando o Futuro com Adryenn Ashley. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/use-streaming-ingestion-with-amazon-sagemaker-feature-store-and-amazon-msk-to-make-ml-backed-decisions-in-near-real-time/

- :tem

- :é

- $UP

- 000

- 1

- 10

- 100

- 11

- 20 anos

- 2011

- 7

- 8

- a

- Capaz

- Sobre

- Acesso

- Conta

- precisão

- preciso

- em

- atividade

- atos

- Ad

- Adição

- endereço

- Agente

- agregação

- agricultura

- AI / ML

- aeroporto

- Todos os Produtos

- já

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- quantidade

- quantidades

- analítica

- e

- Outro

- qualquer

- apache

- à parte

- api

- app

- Aplicação

- aplicações

- abordagem

- arquitetura

- SOMOS

- AS

- aspecto

- montado

- ativo

- gestão de activos

- Assistência

- At

- ataque

- Ataques

- Automatizado

- automaticamente

- disponível

- média

- AWS

- em caminho duplo

- Apoiado

- baseado

- base

- BE

- Porque

- torna-se

- antes

- beneficiar

- MELHOR

- Melhor

- entre

- Grande

- Big Data

- bloqueado

- bloqueio

- Blog

- corpo

- comprou

- construir

- Prédio

- construído

- negócio

- inteligência de negócios

- comprar

- by

- calcular

- calcula

- cálculos

- chamada

- call center

- chamado

- chamada

- CAN

- capacidades

- carro

- cartão

- Cartões

- casas

- casos

- Centralização de

- central

- certo

- FDA

- certificações

- cadeia

- desafios

- chance

- alterar

- Escolha

- classificar

- Na nuvem

- código

- Codificação

- combinado

- vinda

- Empresas

- completar

- integrações

- complexidade

- compatível

- complicado

- componente

- compreensivo

- Computar

- computador

- Visão de Computador

- computação

- consistente

- contém

- contexto

- continuamente

- contribuiu

- núcleo

- Correspondente

- Custo

- economia de custos

- poderia

- Casal

- cobertura

- Covers

- crio

- criado

- cria

- Criar

- criação

- crédito

- cartão de crédito

- Cartões de crédito

- crítico

- crucial

- Atual

- Clientes

- ponta

- Escuro

- dark web

- dados,

- Análise de Dados

- ciência de dados

- cientista de dados

- banco de dados

- conjuntos de dados

- Data

- dia

- decidir

- decisões

- profundo

- deep learning

- entregar

- entrega

- Demanda

- demonstrar

- demonstra

- implantado

- descreve

- Design

- concepção

- desejado

- destino

- detalhe

- detalhes

- Detecção

- desenvolver

- Developer

- Desenvolvimento

- dispositivo

- Dispositivos/Instrumentos

- diferença

- diferente

- diretamente

- descoberta

- distribuições

- dividido

- documento

- gerenciamento de documentos

- dólares

- não

- dezenas

- distância

- motorista

- durante

- dinamicamente

- cada

- Mais cedo

- facilmente

- Eficaz

- permitir

- permite

- permitindo

- end-to-end

- Ponto final

- Motor

- engenheiro

- Engenharia

- Engenheiros

- enorme

- suficiente

- enriquecido

- garante

- assegurando

- Empreendimento

- empresas

- Entretenimento

- propriedade

- Mesmo

- Evento

- SEMPRE

- todos

- exemplo

- esperado

- vasta experiência

- Experiências

- experiência

- explorar

- extra

- extrato

- falsificação

- Moda

- RÁPIDO

- Característica

- Funcionalidades

- final

- financeiro

- serviços financeiros

- empresas

- Primeiro nome

- Flexibilidade

- Foco

- focado

- seguinte

- segue

- Escolha

- formulário

- quatro

- Quarto

- QUADRO

- Quadro

- fraude

- detecção de fraude

- fraudadores

- fraudulento

- atividade fraudulenta

- Frequência

- da

- cheio

- totalmente

- função

- Além disso

- gerar

- ter

- OFERTE

- dado

- Dando

- Bom estado, com sinais de uso

- ótimo

- grandemente

- Grupo

- Do grupo

- Cresce

- orientações

- hacks

- Alças

- acontecer

- Ter

- ter

- he

- saúde

- ajudar

- ajudou

- ajuda

- ajuda

- Alta

- altamente

- histórico

- história

- detém

- HORÁRIO

- Como funciona o dobrador de carta de canal

- HTML

- http

- HTTPS

- Centenas

- ID

- ideal

- identificado

- identificador

- identificar

- implementado

- importante

- melhorar

- melhorias

- melhorar

- in

- incluir

- Incluindo

- Entrada

- cada vez mais

- de treinadores em Entrevista Motivacional

- independentemente

- Individual

- indústrias

- indústria

- INFORMAÇÕES

- Infraestrutura

- entrada

- em vez disso

- com seguro

- Inteligência

- intencionalmente

- interesse

- Introduz

- invoca

- envolvido

- IT

- ESTÁ

- Java

- Trabalho

- juntando

- Junta

- jpg

- json

- Guarda

- manutenção

- Chave

- Tipo

- Saber

- conhecido

- Terreno

- grande

- Sobrenome

- Latência

- mais recente

- conduzir

- líder

- Liderança

- principal

- Vazamentos

- APRENDER

- aprendizagem

- Permite

- de locação

- Nível

- bibliotecas

- Biblioteca

- vida

- Ciência da vida

- como

- Limitado

- Lista

- listas

- viver

- lógico

- olhar

- procurando

- OLHARES

- máquina

- aprendizado de máquina

- a manter

- Manter

- fazer

- FAZ

- Fazendo

- gerenciados

- de grupos

- Gerente

- fabrica

- muitos

- marca

- Mark's

- mercado

- Match

- Posso..

- significativo

- Mídia

- médico

- Comerciante

- milhão

- milhões

- mente

- minuto

- Minutos

- ML

- modelo

- modelos

- mais

- a maioria

- múltiplo

- Nomeado

- você merece...

- Cria

- Novo

- Próximo

- normal

- Novembro

- número

- números

- of

- oferecer

- Oferece

- modo offline

- on

- ONE

- contínuo

- online

- open source

- operacional

- Otimize

- ordem

- organizações

- Organizado

- original

- Outros

- A Nossa

- saída

- Acima de

- global

- próprio

- pares

- Paralelo

- parte

- passado

- padrão

- padrões

- Paul

- pagamento

- Realizar

- atuação

- significativo

- escolher

- peça

- peças

- tubo

- oleoduto

- Lugar

- colocação

- platão

- Inteligência de Dados Platão

- PlatãoData

- Jogar

- ponto

- Popular

- possível

- Publique

- predizer

- previsto

- predição

- Previsões

- Preparar

- preparado

- anterior

- preço

- preços

- primário

- Diretor

- Prévio

- Proactive

- Problema

- em processamento

- produzir

- Produto

- produtividade

- Produtos

- profissional

- profiling

- Agenda

- projetado

- proprietário

- fornecer

- fornecido

- fornece

- fornecendo

- publicamente

- compra

- compras

- colocar

- Colocar

- Python

- qualidade

- rapidamente

- alcance

- rápido

- em vez

- Cru

- Leia

- reais

- bens imóveis

- mundo real

- em tempo real

- Realidade

- recebido

- receber

- recentemente

- recomendando

- registro

- registros

- regiões

- relacionado

- relevante

- remanescente

- remover

- repositório

- pedidos

- requerer

- requeridos

- residencial

- Recursos

- Responder

- resposta

- responsabilidades

- responsável

- DESCANSO

- resultar

- resultando

- Resultados

- varejo

- reutilizar

- Viajar

- uma conta de despesas robusta

- Tipo

- LINHA

- sábio

- Promoção

- mesmo

- Poupança

- escalável

- Escala

- Escalas

- dimensionamento

- cenário

- Ciência

- Cientista

- cientistas

- marcar

- Pesquisar

- Segundo

- segundo

- seções

- seguro

- firmemente

- selecionando

- envio

- senior

- sensível

- separado

- Seqüência

- serviço

- Serviços

- Sessão

- conjunto

- compartilhado

- compartilhando

- Baixo

- mostrar

- mostrando

- Shows

- Signal

- sinais

- periodo

- de forma considerável

- semelhante

- simples

- simplesmente

- solteiro

- SIX

- inclinar

- deslizamento

- So

- solução

- Soluções

- alguns

- algo

- fonte

- Fontes

- Espaço

- Faísca

- especialista

- Especialidade

- específico

- velocidades

- gastar

- Passar

- gasto

- picos

- Spot

- propagação

- Pilhas

- padrão

- Comece

- Estado

- Passo

- roubado

- armazenamento

- loja

- lojas

- armazenar

- franco

- transmitir canais

- fluídas

- de streaming

- córregos

- tal

- supply

- cadeia de suprimentos

- ajuda

- suportes

- suspeito

- .

- mesa

- toma

- equipes

- Dados Técnicos:

- Tecnologia

- modelo

- obrigado

- que

- A

- A fonte

- O Estado

- deles

- Eles

- si mesmos

- Este

- milhares

- três

- Através da

- Taxa de transferência

- tempo

- vezes

- Título

- para

- tópico

- Temas

- pista

- Trem

- Training

- transação

- Transações

- transformações

- transformado

- desencadear

- típico

- tipicamente

- único

- que vai mais à frente

- Atualizada

- Atualizações

- us

- usar

- caso de uso

- usava

- utilitários

- valor

- Valores

- variedade

- vário

- Velocidade

- fornecedores

- versão

- Verticais

- Ver

- visão

- vs

- Desperdício

- web

- serviços web

- semana

- semanal

- BEM

- O Quê

- qual

- QUEM

- Largo

- Ampla variedade

- precisarão

- Windows

- de

- sem

- perguntando

- Atividades:

- trabalhou

- fluxos de trabalho

- trabalho

- seria

- escrito

- XGBoostName

- anos

- Vocês

- investimentos

- você mesmo

- zefirnet