Amazon SageMaker Ground Truth Plus ajuda você a preparar conjuntos de dados de treinamento de alta qualidade removendo o trabalho pesado indiferenciado associado à criação de aplicativos de rotulagem de dados e ao gerenciamento da força de trabalho de rotulagem. Tudo o que você faz é compartilhar dados junto com os requisitos de rotulagem, e o Ground Truth Plus configura e gerencia seu fluxo de trabalho de rotulagem de dados com base nesses requisitos. A partir daí, uma força de trabalho especializada treinada em uma variedade de tarefas de aprendizado de máquina (ML) rotula seus dados. Você nem precisa de experiência profunda em ML ou conhecimento de design de fluxo de trabalho e gerenciamento de qualidade para usar o Ground Truth Plus. Agora, o Ground Truth Plus está atendendo clientes que precisam de rotulagem de dados e feedback humano para ajustar modelos de base para aplicativos generativos de IA.

Nesta postagem, você aprenderá sobre os avanços recentes em feedback humano para IA generativa disponível por meio do SageMaker Ground Truth Plus. Isso inclui novos fluxos de trabalho e interfaces de usuário (UIs) disponíveis para preparar conjuntos de dados de demonstração usados em ajuste fino supervisionado, coleta de feedback humano de alta qualidade para criar conjuntos de dados de preferência para alinhar modelos de fundação de IA generativa com preferências humanas, bem como personalizar modelos para os requisitos de estilo, substância e voz dos construtores de aplicativos.

Desafios de começar com IA generativa

Aplicativos de IA generativa em todo o mundo incorporam modelos de base monomodo e multimodal para resolver muitos casos de uso diferentes. Comuns entre eles são chatbots, geradores de imagem e geradores de vídeo. Modelos de linguagem grande (LLMs) estão sendo usados em chatbots para atividades criativas, assistentes acadêmicos e pessoais, ferramentas de business intelligence e ferramentas de produtividade. Você pode usar modelos de texto para imagem para gerar arte de IA abstrata ou realista e ativos de marketing. Modelos de texto para vídeo estão sendo usados para gerar vídeos para projetos de arte, anúncios altamente envolventes, desenvolvimento de videogames e até mesmo desenvolvimento de filmes.

Dois dos problemas mais importantes a serem resolvidos para produtores de modelos que criam modelos de base e construtores de aplicativos que usam modelos de base generativos existentes para criar suas próprias ferramentas e aplicativos são:

- Ajustar esses modelos de fundação para poder executar tarefas específicas

- Alinhá-los com as preferências humanas para garantir que eles forneçam informações úteis, precisas e inofensivas

Os modelos de base geralmente são pré-treinados em grandes corpora de dados não rotulados e, portanto, não funcionam bem seguindo instruções de linguagem natural. Para um LLM, isso significa que eles podem analisar e gerar linguagem em geral, mas podem não ser capazes de responder perguntas de forma coerente ou resumir o texto com a qualidade exigida pelo usuário. Por exemplo, quando um usuário solicita um resumo de um texto em um prompt, um modelo que não foi ajustado para resumir o texto pode apenas recitar o texto do prompt de volta para o usuário ou responder com algo irrelevante. Se um usuário fizer uma pergunta sobre um tópico, a resposta de um modelo pode ser apenas uma recitação da pergunta. Para modelos multimodais, como modelos de texto para imagem ou texto para vídeo, os modelos podem gerar conteúdo não relacionado ao prompt. Por exemplo, se um designer gráfico corporativo solicita a um modelo de texto para imagem que crie um novo logotipo ou uma imagem para um anúncio, o modelo pode não gerar um gráfico relevante relacionado ao prompt se tiver apenas um conceito geral de uma imagem e elementos de uma imagem. Em alguns casos, um modelo pode produzir uma imagem ou vídeo prejudicial, colocando em risco a confiança do usuário ou a reputação da empresa.

Mesmo que os modelos sejam ajustados para executar tarefas específicas, eles podem não estar alinhados com as preferências humanas em relação ao significado, estilo ou substância de seu conteúdo de saída. Em um LLM, isso pode se manifestar como conteúdo impreciso ou até prejudicial gerado pelo modelo. Por exemplo, um modelo que não está alinhado com as preferências humanas por meio do ajuste fino pode gerar instruções perigosas, antiéticas ou mesmo ilegais quando solicitadas por um usuário. Nenhum cuidado foi tomado para limitar o conteúdo gerado pelo modelo para garantir que ele esteja alinhado com as preferências humanas para ser preciso, relevante e útil. Esse desalinhamento pode ser um problema para empresas que dependem de modelos generativos de IA para suas aplicações, como chatbots e criação de multimídia. Para modelos multimodais, isso pode assumir a forma de imagens ou vídeos tóxicos, perigosos ou abusivos sendo gerados. Isso é um risco quando os prompts são inseridos no modelo sem a intenção de gerar conteúdo confidencial e também se o produtor do modelo ou o construtor do aplicativo não pretendia permitir que o modelo gerasse esse tipo de conteúdo, mas ele foi gerado mesmo assim.

Para resolver os problemas de capacidade específica da tarefa e alinhar os modelos de base generativa com as preferências humanas, os produtores de modelos e os construtores de aplicativos devem ajustar os modelos com dados usando demonstrações dirigidas por humanos e feedback humano das saídas do modelo.

Tipos de dados e treinamento

Existem vários tipos de métodos de ajuste fino com diferentes tipos de dados rotulados que são categorizados como ajuste de instrução – ou ensinando um modelo a seguir instruções. Entre eles estão o ajuste fino supervisionado (SFT) usando dados de demonstração e o aprendizado por reforço a partir de feedback humano (RLHF) usando dados de preferência.

Dados de demonstração para ajuste fino supervisionado

Para ajustar os modelos de base para executar tarefas específicas, como responder a perguntas ou resumir textos com alta qualidade, os modelos passam por SFT com dados de demonstração. O objetivo dos dados de demonstração é orientar o modelo, fornecendo-lhe exemplos rotulados (demonstrações) de tarefas concluídas realizadas por humanos. Por exemplo, para ensinar um LLM a responder a perguntas, um anotador humano criará um conjunto de dados rotulado de pares de perguntas e respostas gerados por humanos para demonstrar como uma interação de pergunta e resposta funciona linguisticamente e o que o conteúdo significa semanticamente. Esse tipo de SFT treina o modelo para reconhecer padrões de comportamento demonstrados pelos humanos nos dados de treinamento de demonstração. Os produtores de modelos precisam fazer esse tipo de ajuste fino para mostrar que seus modelos são capazes de realizar essas tarefas para adotantes posteriores. Os criadores de aplicativos que usam modelos de base existentes para seus aplicativos de IA generativos podem precisar ajustar seus modelos com dados de demonstração nessas tarefas com dados específicos do setor ou da empresa para melhorar a relevância e a precisão de seus aplicativos.

Dados de preferência para ajuste de instrução, como RLHF

Para alinhar ainda mais os modelos de base com as preferências humanas, os produtores de modelos – e especialmente os construtores de aplicativos – precisam gerar conjuntos de dados de preferências para executar o ajuste de instrução. Dados de preferência no contexto de ajuste de instrução são dados rotulados que capturam feedback humano em relação a um conjunto de opções de saída por um modelo de fundação generativo. Ele normalmente inclui classificação ou classificação de várias inferências ou comparação de pares de duas inferências de um modelo de fundação de acordo com algum atributo específico. Para LLMs, esses atributos podem ser utilidade, precisão e inocuidade. Para modelos de texto para imagem, pode ser uma qualidade estética ou alinhamento de imagem de texto. Esses dados de preferência com base no feedback humano podem ser usados em vários métodos de ajuste de instrução - incluindo RLHF - para ajustar ainda mais um modelo para se alinhar às preferências humanas.

O ajuste de instrução usando dados de preferência desempenha um papel crucial no aprimoramento da personalização e eficácia dos modelos de fundação. Esta é uma etapa fundamental na criação de aplicativos personalizados com base em modelos de base pré-treinados e é um método poderoso para garantir que os modelos gerem conteúdo útil, preciso e inofensivo. Um exemplo comum de ajuste de instrução é instruir um chatbot a gerar três respostas a uma consulta e fazer com que um humano leia e classifique todas as três de acordo com alguma dimensão especificada, como toxicidade, precisão factual ou legibilidade. Por exemplo, uma empresa pode usar um chatbot para seu departamento de marketing e deseja garantir que o conteúdo esteja alinhado à mensagem de sua marca, não exiba preconceitos e seja claramente legível. A empresa solicitaria ao chatbot durante o ajuste de instrução para produzir três exemplos e seus especialistas internos selecionariam aqueles que mais se alinhassem ao seu objetivo. Com o tempo, eles constroem um conjunto de dados usado para ensinar ao modelo qual estilo de conteúdo os humanos preferem por meio do aprendizado por reforço. Isso permite que o aplicativo chatbot gere conteúdo mais relevante, legível e seguro.

SageMaker Ground Truth Plus

O Ground Truth Plus ajuda você a enfrentar os dois desafios - gerar conjuntos de dados de demonstração com recursos específicos de tarefas, bem como reunir conjuntos de dados de preferência de feedback humano para alinhar modelos com preferências humanas. Você pode solicitar projetos para LLMs e modelos multimodais, como texto para imagem e texto para vídeo. Para LLMs, os principais conjuntos de dados de demonstração incluem a geração de perguntas e respostas (P&R), resumo de texto, geração de texto e retrabalho de texto para fins de moderação de conteúdo, mudança de estilo ou mudança de tamanho. Os principais conjuntos de dados de preferência do LLM incluem classificação e classificação de saídas de texto. Para modelos multimodais, os principais tipos de tarefas incluem legendagem de imagens ou vídeos, bem como registros de data e hora de eventos em vídeos. Portanto, o Ground Truth Plus pode ajudar tanto os produtores de modelos quanto os criadores de aplicativos em sua jornada de IA generativa.

Nesta postagem, nos aprofundamos no anotador humano e na jornada de feedback em quatro casos que abrangem dados de demonstração e dados de preferência para LLMs e modelos multimodais: geração de pares de perguntas e respostas e classificação de texto para LLMs, bem como legendas de imagens e legendas de vídeos para modelos multimodais.

Modelos de grande linguagem

Nesta seção, discutimos pares de perguntas e respostas e classificação de texto para LLMs, juntamente com personalizações que você pode desejar para seu caso de uso.

Pares de perguntas e respostas

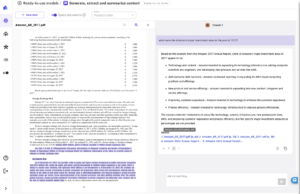

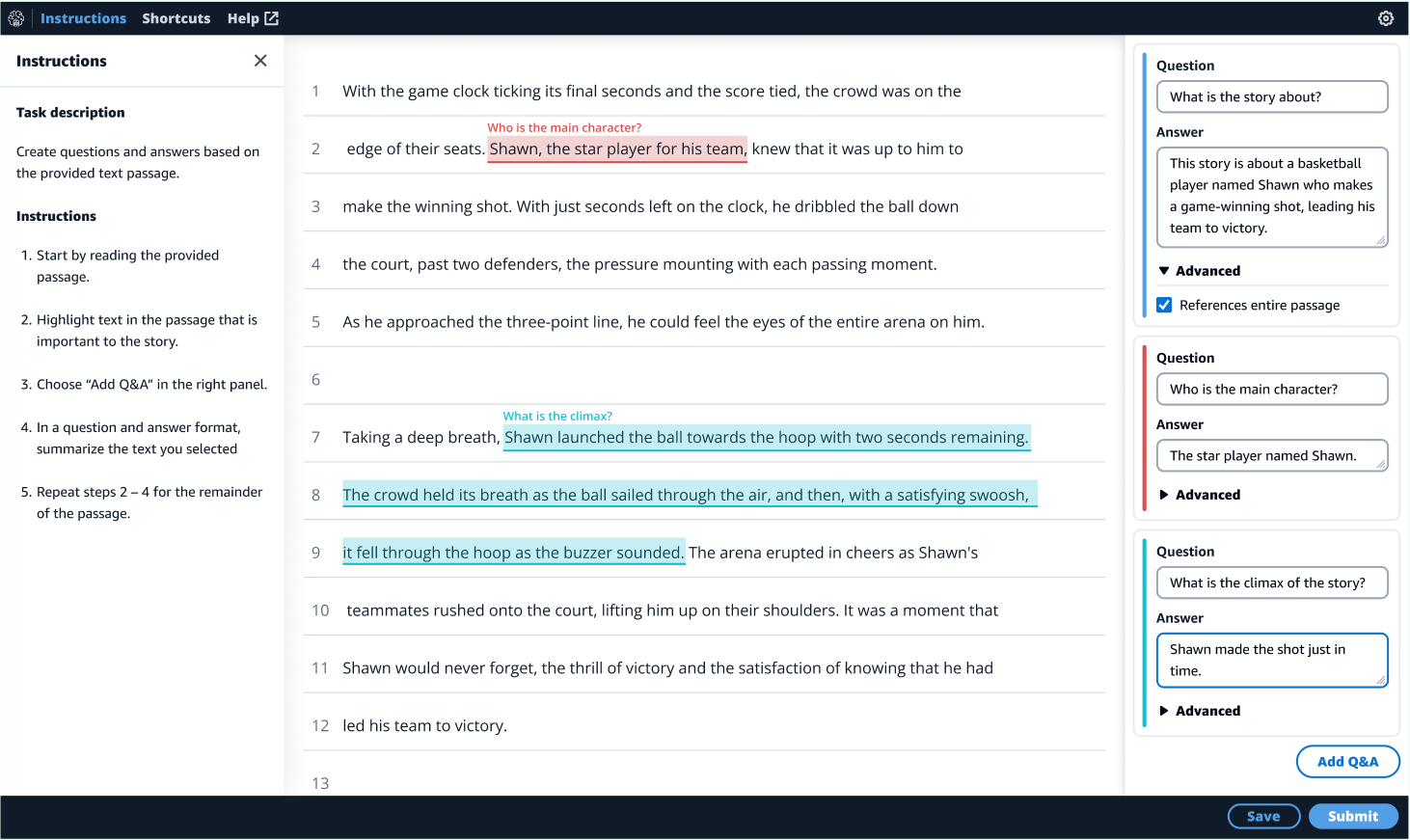

A captura de tela a seguir mostra uma IU de rotulagem na qual um anotador humano lerá uma passagem de texto e gerará perguntas e respostas no processo de criação de um conjunto de dados de demonstração de perguntas e respostas.

Vamos fazer um tour pela interface do usuário no lugar do anotador. No lado esquerdo da IU, as instruções específicas do solicitante do trabalho são apresentadas ao anotador. Nesse caso, o anotador deve ler a passagem de texto apresentada no centro da interface do usuário e criar perguntas e respostas com base no texto. No lado direito, são mostradas as perguntas e respostas que o anotador escreveu. A passagem do texto, bem como o tipo, tamanho e número de perguntas e respostas, podem ser personalizados pelo solicitante do trabalho durante a configuração do projeto com a equipe do Ground Truth Plus. Nesse caso, o anotador criou uma pergunta que exige a compreensão de todo o trecho do texto para responder e é marcada com um Referências passagem inteira caixa de seleção. As outras duas perguntas e respostas são baseadas em partes específicas da passagem de texto, conforme mostrado pelos destaques do anotador com correspondência codificada por cores. Opcionalmente, você pode solicitar que as perguntas e respostas sejam geradas sem uma passagem de texto fornecida e fornecer outras diretrizes para anotadores humanos – isso também é suportado pelo Ground Truth Plus.

Depois que as perguntas e respostas são enviadas, elas podem fluir para um fluxo de trabalho de loop de controle de qualidade opcional, onde outros revisores humanos confirmarão que a distribuição definida pelo cliente e os tipos de perguntas e respostas foram criados. Se houver uma incompatibilidade entre os requisitos do cliente e o que o anotador humano produziu, o trabalho será canalizado de volta para um humano para retrabalho antes de ser exportado como parte do conjunto de dados para entregar ao cliente. Quando o conjunto de dados é devolvido a você, ele está pronto para ser incorporado ao fluxo de trabalho de ajuste fino supervisionado a seu critério.

Classificação de texto

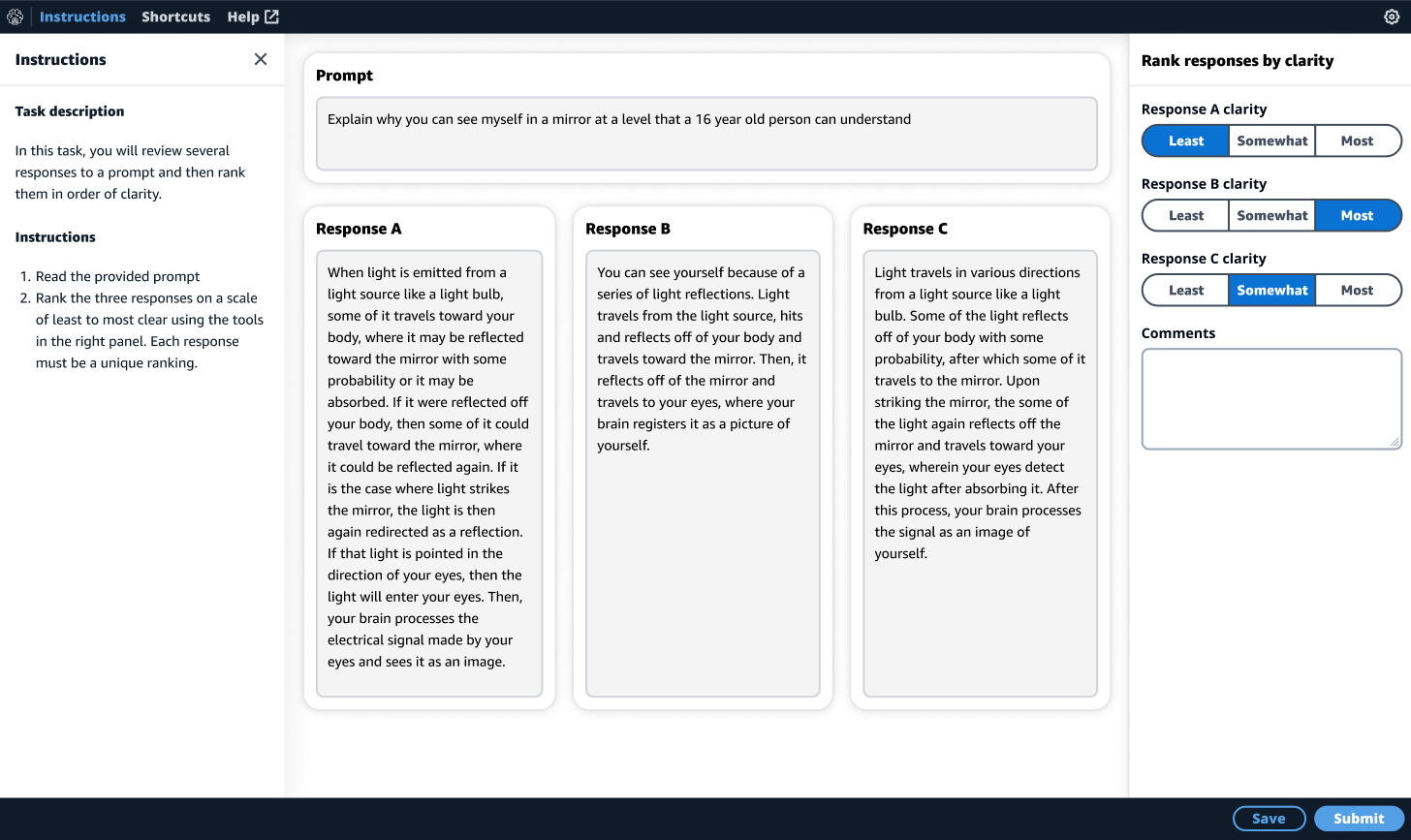

A captura de tela a seguir mostra uma interface do usuário para classificar as saídas de um LLM com base em um prompt.

Você pode simplesmente escrever as instruções para o revisor humano e trazer solicitações e respostas pré-geradas para a equipe de projeto do Ground Truth Plus para iniciar o trabalho. Nesse caso, solicitamos que um revisor humano classificasse três respostas por prompt de um LLM na dimensão da clareza da escrita (legibilidade). Novamente, o painel esquerdo mostra as instruções dadas ao revisor pelo solicitante do trabalho. No centro, o prompt está na parte superior da página e as três respostas pré-geradas são o corpo principal para facilitar o uso. No lado direito da interface do usuário, o revisor humano irá classificá-los na ordem da escrita mais clara para a menos clara.

Os clientes que desejam gerar esse tipo de conjunto de dados de preferência incluem criadores de aplicativos interessados em criar chatbots semelhantes a humanos e, portanto, desejam personalizar as instruções para seu próprio uso. O comprimento do prompt, o número de respostas e a dimensão de classificação podem ser personalizados. Por exemplo, você pode querer classificar cinco respostas da mais para a menos factualmente precisa, tendenciosa ou tóxica, ou até mesmo classificar e classificar várias dimensões simultaneamente. Essas personalizações são suportadas no Ground Truth Plus.

Modelos multimodais

Nesta seção, discutimos legendas de imagens e vídeos para treinar modelos multimodais, como modelos de texto para imagem e texto para vídeo, bem como personalizações que você pode querer fazer para seu caso de uso específico.

Legendagem de imagens

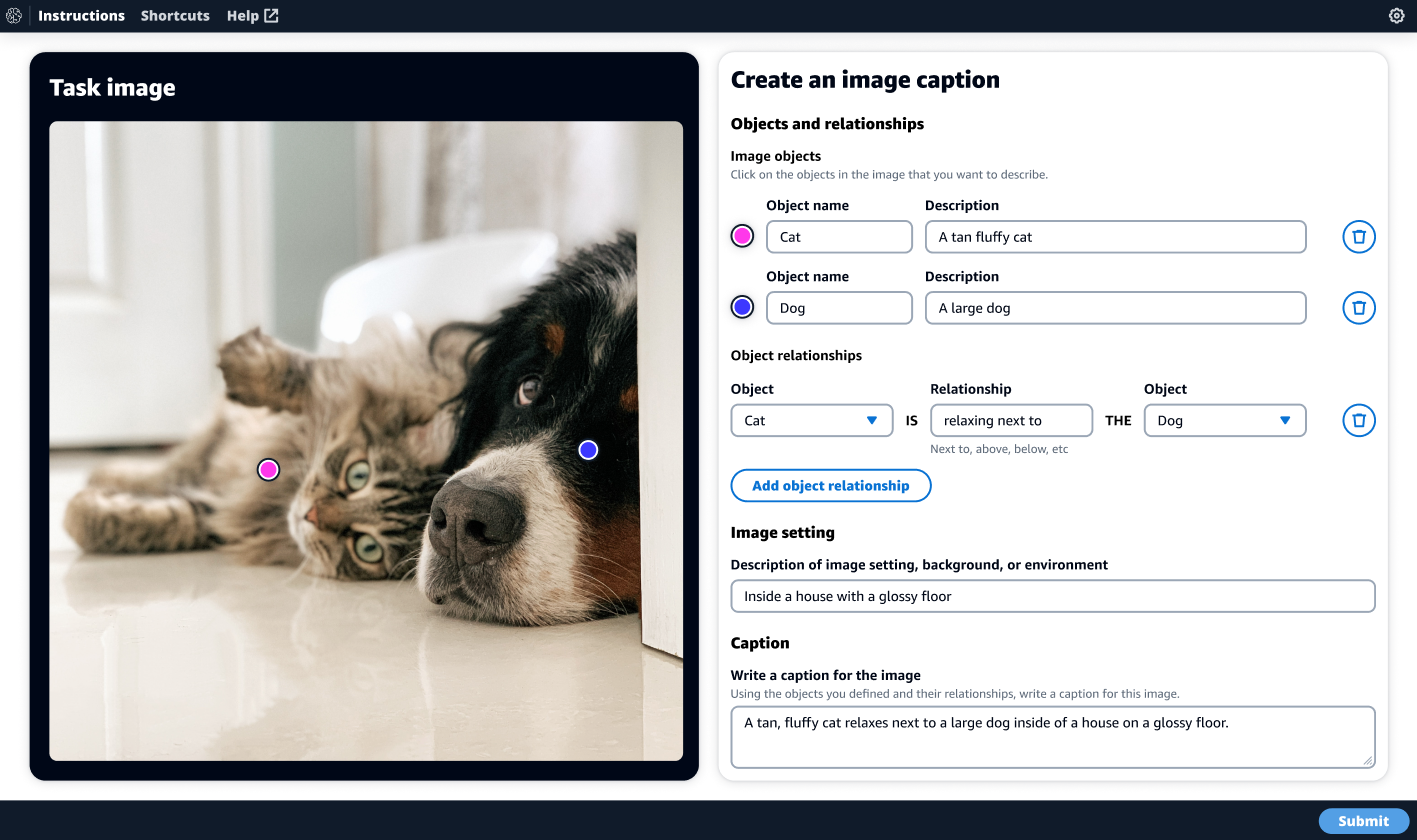

A captura de tela a seguir mostra uma IU de rotulagem para legendas de imagens. Você pode solicitar um projeto com legenda de imagem para coletar dados para treinar um modelo de texto para imagem ou um modelo de imagem para texto.

Nesse caso, solicitamos o treinamento de um modelo de texto para imagem e definimos requisitos específicos para a legenda em termos de tamanho e detalhes. A interface do usuário foi projetada para guiar os anotadores humanos pelo processo cognitivo de geração de legendas avançadas, fornecendo uma estrutura mental por meio de ferramentas assistivas e descritivas. Descobrimos que fornecer essa estrutura mental para anotadores resulta em legendas mais descritivas e precisas do que simplesmente fornecer uma caixa de texto editável sozinha.

A primeira etapa na estrutura é que o anotador humano identifique os principais objetos na imagem. Quando o anotador escolhe um objeto na imagem, um ponto codificado por cores aparece no objeto. Nesse caso, o anotador escolheu o cachorro e o gato, criando dois campos editáveis no lado direito da IU onde o anotador inserirá os nomes dos objetos — gato e cachorro — juntamente com uma descrição detalhada de cada objeto. Em seguida, o anotador é orientado a identificar todas as relações entre todos os objetos da imagem. Nesse caso, o gato está relaxando ao lado do cachorro. Em seguida, o anotador é solicitado a identificar atributos específicos sobre a imagem, como cenário, plano de fundo ou ambiente. Por fim, na caixa de texto de entrada da legenda, o anotador é instruído a combinar tudo o que escreveu nos campos objetos, relacionamentos e configuração de imagem em uma única legenda descritiva completa da imagem.

Opcionalmente, você pode configurar essa legenda de imagem para passar por um loop de verificação de qualidade humano com instruções específicas para garantir que a legenda atenda aos requisitos. Se houver um problema identificado, como um objeto de chave ausente, essa legenda poderá ser enviada de volta para que um humano corrija o problema antes de exportar como parte do conjunto de dados de treinamento.

Legendagem de vídeo

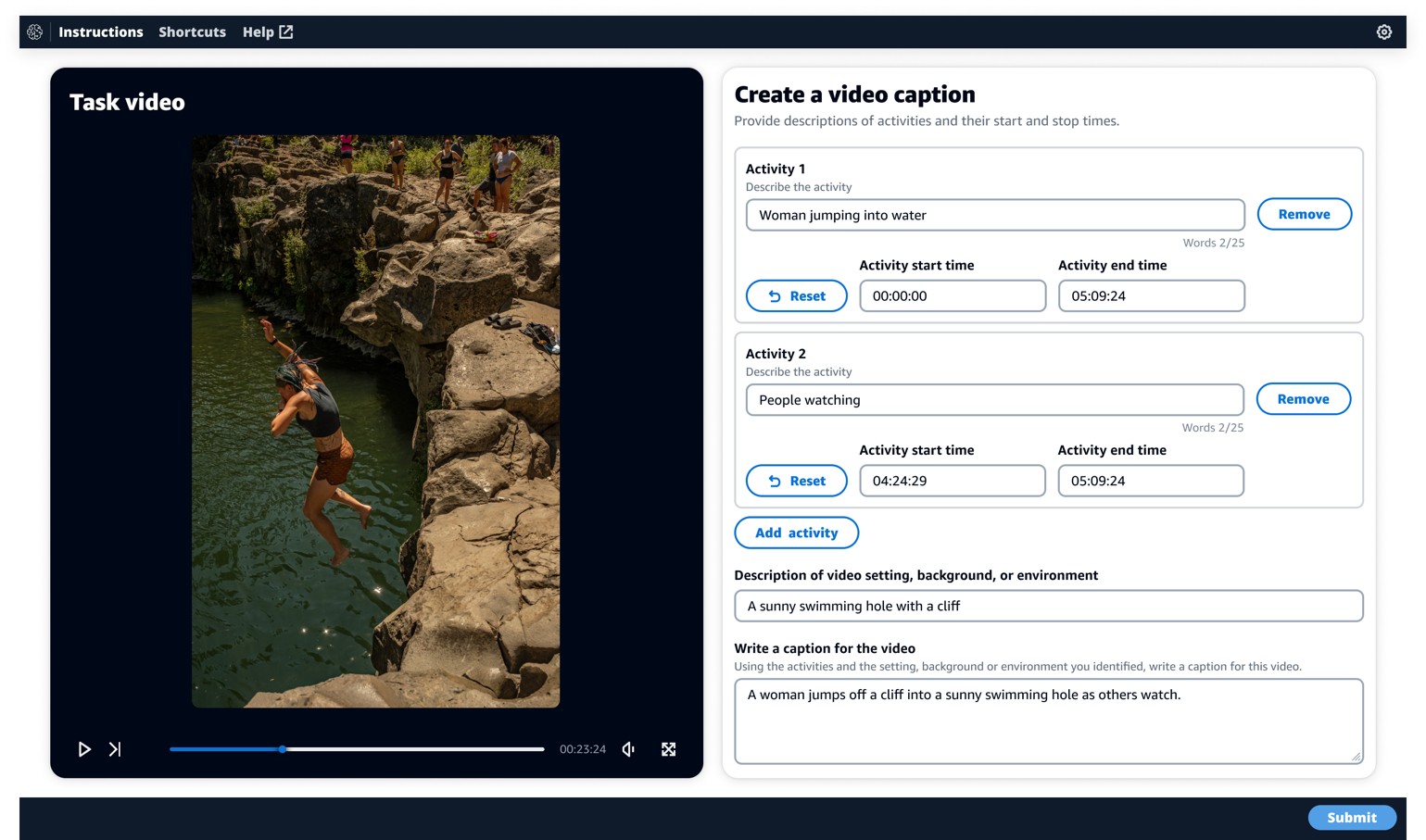

A captura de tela a seguir mostra uma IU de legenda de vídeo para gerar legendas de vídeo avançadas com tags de carimbo de data/hora. Você pode solicitar um projeto de legenda de vídeo para coletar dados para criar modelos de texto para vídeo ou vídeo para texto.

Nesta IU de rotulagem, construímos uma estrutura mental semelhante para garantir que as legendas de alta qualidade sejam escritas. O anotador humano pode controlar o vídeo no lado esquerdo e criar descrições e registros de data e hora para cada atividade mostrada no vídeo no lado direito com os elementos da interface do usuário. Semelhante à IU de legenda de imagem, também há um local para o anotador escrever uma descrição detalhada da configuração de vídeo, plano de fundo e ambiente. Por fim, o anotador é instruído a combinar todos os elementos em uma legenda de vídeo coerente.

Semelhante ao caso de legenda de imagem, as legendas de vídeo podem, opcionalmente, passar por um fluxo de trabalho de controle de qualidade humano para determinar se seus requisitos foram atendidos. Se houver um problema com as legendas do vídeo, ele será enviado para retrabalho pela força de trabalho do anotador humano.

Conclusão

O Ground Truth Plus pode ajudá-lo a preparar conjuntos de dados de alta qualidade para ajustar modelos de base para tarefas de IA generativas, desde responder a perguntas até gerar imagens e vídeos. Também permite que forças de trabalho humanas qualificadas revisem os resultados do modelo para garantir que estejam alinhados com as preferências humanas. Além disso, permite que os criadores de aplicativos personalizem modelos usando seus dados da indústria ou da empresa para garantir que seu aplicativo represente sua voz e estilo preferidos. Estas são as primeiras de muitas inovações no Ground Truth Plus, e outras estão em desenvolvimento. Fique ligado nas próximas postagens.

Interessado em iniciar um projeto para construir ou melhorar seus modelos e aplicativos de IA generativa? Comece com o Ground Truth Plus por conectando com nossa equipe hoje mesmo.

Sobre os autores

Jesse Manders é um gerente de produto sênior na equipe de serviços human in the loop da AWS AI/ML. Ele trabalha na interseção de IA e interação humana com o objetivo de criar e melhorar produtos e serviços de IA/ML para atender às nossas necessidades. Anteriormente, Jesse ocupou cargos de liderança em engenharia na Apple e na Lumileds e foi cientista sênior em uma startup do Vale do Silício. Ele tem um MS e Ph.D. pela University of Florida e MBA pela University of California, Berkeley, Haas School of Business.

Jesse Manders é um gerente de produto sênior na equipe de serviços human in the loop da AWS AI/ML. Ele trabalha na interseção de IA e interação humana com o objetivo de criar e melhorar produtos e serviços de IA/ML para atender às nossas necessidades. Anteriormente, Jesse ocupou cargos de liderança em engenharia na Apple e na Lumileds e foi cientista sênior em uma startup do Vale do Silício. Ele tem um MS e Ph.D. pela University of Florida e MBA pela University of California, Berkeley, Haas School of Business.

Romi Datta é gerente sênior de gerenciamento de produtos na equipe do Amazon SageMaker responsável pelos serviços Human in the Loop. Ele está na AWS há mais de 4 anos, ocupando vários cargos de liderança em gerenciamento de produtos em SageMaker, S3 e IoT. Antes da AWS, ele trabalhou em várias funções de gerenciamento de produtos, engenharia e liderança operacional na IBM, Texas Instruments e Nvidia. Ele tem um MS e Ph.D. em Engenharia Elétrica e de Computação pela Universidade do Texas em Austin e MBA pela Booth School of Business da Universidade de Chicago.

Romi Datta é gerente sênior de gerenciamento de produtos na equipe do Amazon SageMaker responsável pelos serviços Human in the Loop. Ele está na AWS há mais de 4 anos, ocupando vários cargos de liderança em gerenciamento de produtos em SageMaker, S3 e IoT. Antes da AWS, ele trabalhou em várias funções de gerenciamento de produtos, engenharia e liderança operacional na IBM, Texas Instruments e Nvidia. Ele tem um MS e Ph.D. em Engenharia Elétrica e de Computação pela Universidade do Texas em Austin e MBA pela Booth School of Business da Universidade de Chicago.

Jonathan Buck é um engenheiro de software da Amazon Web Services que trabalha na interseção de aprendizado de máquina e sistemas distribuídos. Seu trabalho envolve a produção de modelos de aprendizado de máquina e o desenvolvimento de novos aplicativos de software alimentados por aprendizado de máquina para colocar os recursos mais recentes nas mãos dos clientes.

Jonathan Buck é um engenheiro de software da Amazon Web Services que trabalha na interseção de aprendizado de máquina e sistemas distribuídos. Seu trabalho envolve a produção de modelos de aprendizado de máquina e o desenvolvimento de novos aplicativos de software alimentados por aprendizado de máquina para colocar os recursos mais recentes nas mãos dos clientes.

Alex Williams é um cientista aplicado na equipe de ciência human-in-the-loop da AWS AI, onde conduz pesquisas de sistemas interativos na interseção da interação humano-computador (HCI) e aprendizado de máquina. Antes de ingressar na Amazon, ele foi professor no Departamento de Engenharia Elétrica e Ciência da Computação da Universidade do Tennessee, onde codirigiu o laboratório de pesquisa Pessoas, Agentes, Interações e Sistemas (PAIRS). Ele também ocupou cargos de pesquisa na Microsoft Research, Mozilla Research e na Universidade de Oxford. Ele publica regularmente seu trabalho nos principais locais de publicação da HCI, como CHI, CSCW e UIST. Ele é PhD pela Universidade de Waterloo.

Alex Williams é um cientista aplicado na equipe de ciência human-in-the-loop da AWS AI, onde conduz pesquisas de sistemas interativos na interseção da interação humano-computador (HCI) e aprendizado de máquina. Antes de ingressar na Amazon, ele foi professor no Departamento de Engenharia Elétrica e Ciência da Computação da Universidade do Tennessee, onde codirigiu o laboratório de pesquisa Pessoas, Agentes, Interações e Sistemas (PAIRS). Ele também ocupou cargos de pesquisa na Microsoft Research, Mozilla Research e na Universidade de Oxford. Ele publica regularmente seu trabalho nos principais locais de publicação da HCI, como CHI, CSCW e UIST. Ele é PhD pela Universidade de Waterloo.

Sarah Gao é um gerente de desenvolvimento de software no Amazon SageMaker Human In the Loop (HIL) responsável por criar a plataforma de rotulagem baseada em ML. Sarah está na AWS há mais de 4 anos, ocupando vários cargos de liderança em gerenciamento de software em segurança do EC2 e SageMaker. Antes da AWS, ela trabalhou em várias funções de gerenciamento de engenharia na Oracle e na Sun Microsystem.

Sarah Gao é um gerente de desenvolvimento de software no Amazon SageMaker Human In the Loop (HIL) responsável por criar a plataforma de rotulagem baseada em ML. Sarah está na AWS há mais de 4 anos, ocupando vários cargos de liderança em gerenciamento de software em segurança do EC2 e SageMaker. Antes da AWS, ela trabalhou em várias funções de gerenciamento de engenharia na Oracle e na Sun Microsystem.

Erran Li é o gerente de ciência aplicada em serviços human-in-the-loop, AWS AI, Amazon. Seus interesses de pesquisa são aprendizado profundo em 3D e aprendizado de representação de visão e linguagem. Anteriormente, ele foi cientista sênior da Alexa AI, chefe de aprendizado de máquina da Scale AI e cientista-chefe da Pony.ai. Antes disso, ele estava com a equipe de percepção da Uber ATG e a equipe de plataforma de aprendizado de máquina da Uber trabalhando em aprendizado de máquina para direção autônoma, sistemas de aprendizado de máquina e iniciativas estratégicas de IA. Ele começou sua carreira no Bell Labs e foi professor adjunto na Universidade de Columbia. Ele co-lecionou tutoriais no ICML'17 e ICCV'19, e co-organizou vários workshops no NeurIPS, ICML, CVPR, ICCV sobre aprendizado de máquina para direção autônoma, visão 3D e robótica, sistemas de aprendizado de máquina e aprendizado de máquina adversário. Ele tem um PhD em ciência da computação na Cornell University. É Fellow da ACM e Fellow do IEEE.

Erran Li é o gerente de ciência aplicada em serviços human-in-the-loop, AWS AI, Amazon. Seus interesses de pesquisa são aprendizado profundo em 3D e aprendizado de representação de visão e linguagem. Anteriormente, ele foi cientista sênior da Alexa AI, chefe de aprendizado de máquina da Scale AI e cientista-chefe da Pony.ai. Antes disso, ele estava com a equipe de percepção da Uber ATG e a equipe de plataforma de aprendizado de máquina da Uber trabalhando em aprendizado de máquina para direção autônoma, sistemas de aprendizado de máquina e iniciativas estratégicas de IA. Ele começou sua carreira no Bell Labs e foi professor adjunto na Universidade de Columbia. Ele co-lecionou tutoriais no ICML'17 e ICCV'19, e co-organizou vários workshops no NeurIPS, ICML, CVPR, ICCV sobre aprendizado de máquina para direção autônoma, visão 3D e robótica, sistemas de aprendizado de máquina e aprendizado de máquina adversário. Ele tem um PhD em ciência da computação na Cornell University. É Fellow da ACM e Fellow do IEEE.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoAiStream. Inteligência de Dados Web3. Conhecimento Amplificado. Acesse aqui.

- Cunhando o Futuro com Adryenn Ashley. Acesse aqui.

- Compre e venda ações em empresas PRE-IPO com PREIPO®. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/high-quality-human-feedback-for-your-generative-ai-applications-from-amazon-sagemaker-ground-truth-plus/

- :tem

- :é

- :não

- :onde

- $UP

- 100

- 3d

- 7

- a

- Capaz

- Sobre

- RESUMO

- acadêmico

- Segundo

- precisão

- preciso

- ACM

- atividade

- Adicionalmente

- endereço

- adotantes

- avanços

- adversarial

- Anúncios

- novamente

- agentes

- AI

- arte ai

- AI / ML

- Alexa

- alinhar

- alinhado

- alinhamento

- Todos os Produtos

- permitir

- permite

- sozinho

- juntamente

- tb

- Amazon

- Amazon Sage Maker

- Verdade no solo do Amazon SageMaker

- Amazon Web Services

- entre

- an

- e

- responder

- respostas

- aparece

- Apple

- Aplicação

- aplicações

- aplicado

- SOMOS

- por aí

- Arte

- AS

- Ativos

- assistentes

- associado

- At

- atributos

- austin

- Autônomo

- disponível

- AWS

- em caminho duplo

- fundo

- baseado

- BE

- sido

- antes

- ser

- sino

- Berkeley

- entre

- tendencioso

- vieses

- corpo

- ambos

- Caixa

- interesse?

- trazer

- construir

- construtor

- construtores

- Prédio

- construído

- negócio

- inteligência de negócios

- mas a

- by

- Califórnia

- CAN

- capacidades

- capaz

- legendas

- capturas

- Cuidado

- Oportunidades

- casas

- casos

- CAT

- Centralização de

- alterar

- chatbot

- chatbots

- verificar

- Chicago

- chefe

- escolhido

- clareza

- classificar

- remover filtragem

- claramente

- cognitivo

- COERENTE

- COLÔMBIA

- combinar

- comum

- Empresas

- Empresa

- comparando

- completar

- Efetuado

- computador

- Engenharia computacional

- Ciência da Computação

- conceito

- conduz

- confiança

- Confirmar

- conteúdo

- contexto

- ao controle

- cornell

- Responsabilidade

- correta

- poderia

- cobertura

- crio

- criado

- Criar

- criação

- Criatividade

- crucial

- personalizadas

- cliente

- Clientes

- personalizar

- personalizado

- Perigoso

- dados,

- conjuntos de dados

- profundo

- deep learning

- mais profunda

- entregar

- entregue

- demonstrar

- demonstraram

- Departamento

- descrição

- Design

- projetado

- Designer

- detalhe

- detalhado

- Determinar

- em desenvolvimento

- Desenvolvimento

- diferente

- Dimensão

- dimensões

- critério

- discutir

- distribuído

- Sistemas distribuídos

- distribuição

- do

- Não faz

- Cachorro

- feito

- não

- DOT

- condução

- durante

- cada

- facilidade

- facilidade de utilização

- eficácia

- elementos

- permite

- noivando

- engenheiro

- Engenharia

- aprimorando

- garantir

- Entrar

- Todo

- Meio Ambiente

- especialmente

- Mesmo

- eventos

- exemplo

- exemplos

- apresentar

- existente

- especialista

- experiência

- especialistas

- retornos

- companheiro

- Campos

- Filme

- Finalmente

- Primeiro nome

- florida

- fluxo

- seguir

- seguinte

- Escolha

- formulário

- encontrado

- Foundation

- quatro

- Quadro

- da

- mais distante

- futuro

- jogo

- desenvolvimento de jogos

- GAO

- reunir

- coleta

- Geral

- gerar

- gerado

- gerando

- geração

- generativo

- IA generativa

- geradores

- ter

- obtendo

- dado

- meta

- Designer

- Solo

- guia

- orientações

- tinha

- mãos

- prejudicial

- Ter

- HCI

- he

- cabeça

- pesado

- levantamento pesado

- Herói

- ajudar

- útil

- ajuda

- Alta

- alta qualidade

- destaques

- altamente

- sua

- segurando

- detém

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- HTTPS

- humano

- Humanos

- IBM

- identificado

- identificar

- IEEE

- if

- Ilegal

- imagem

- imagens

- importante

- melhorar

- melhorar

- in

- impreciso

- incluir

- inclui

- incorporar

- indústria

- específico da indústria

- iniciativas

- e inovações

- entrada

- instruções

- instrumentos

- Inteligência

- Pretendido

- Intenção

- interação

- interações

- interativo

- interessado

- interesses

- interfaces de

- interno

- interseção

- para dentro

- iot

- emitem

- questões

- IT

- ESTÁ

- se

- Trabalho

- juntando

- viagem

- jpg

- apenas por

- Chave

- Tipo

- Conhecimento

- marcação

- Rótulos

- laboratório

- Laboratório

- língua

- grande

- mais recente

- Liderança

- APRENDER

- aprendizagem

- mínimo

- esquerda

- Comprimento

- facelift

- LIMITE

- LLM

- logging

- logotipo

- máquina

- aprendizado de máquina

- a Principal

- fazer

- de grupos

- Gerente

- gestão

- gestão

- muitos

- marcado

- Marketing

- correspondente

- Posso..

- significado

- significa

- Conheça

- atende

- mental

- mensagem

- método

- métodos

- Microsoft

- desaparecido

- ML

- modelo

- modelos

- moderação

- mais

- a maioria

- Mozilla

- Vídeos

- múltiplo

- devo

- nomes

- natural

- você merece...

- Cria

- Novo

- Próximo

- não

- romance

- agora

- número

- Nvidia

- objeto

- objetos

- of

- on

- queridos

- só

- operacional

- Opções

- or

- oráculo

- ordem

- Outros

- A Nossa

- saída

- Acima de

- próprio

- Oxford

- página

- par

- pares

- pão

- parte

- particular

- peças

- passou

- padrões

- Pessoas

- percepção

- Realizar

- realização

- pessoal

- Personalização

- Lugar

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- desempenha

- mais

- abertas

- Publique

- POSTAGENS

- alimentado

- poderoso

- preferir

- preferências

- preferido

- premier

- Preparar

- preparação

- apresentado

- anteriormente

- Prévio

- Problema

- problemas

- processo

- produzir

- Produzido

- produtor

- Produtores

- Produto

- gestão de produtos

- gerente de produto

- produtividade

- Produtos

- Professor

- projeto

- projetos

- fornecer

- fornecido

- fornecendo

- Publicação

- Publica

- propósito

- fins

- colocar

- Dúvidas

- qualidade

- questão

- Frequentes

- Posição

- classificação

- Leia

- pronto

- realista

- recentemente

- reconhecer

- regularmente

- relacionado

- Relacionamentos

- relevante

- depender

- removendo

- representação

- representa

- reputação

- solicitar

- pedidos

- requeridos

- Requisitos

- exige

- pesquisa

- respeito

- Responder

- resposta

- respostas

- responsável

- Resultados

- rever

- Rico

- certo

- Risco

- arriscando

- robótica

- Tipo

- papéis

- s

- seguro

- sábio

- Escala

- escala ai

- Escola

- Ciência

- Cientista

- Seção

- segurança

- senior

- sensível

- enviei

- Serviços

- de servir

- conjunto

- Conjuntos

- contexto

- instalação

- vários

- Partilhar

- ela

- mostrar

- mostrando

- Shows

- lado

- Silício

- Vale do Silício

- semelhante

- simplesmente

- simultaneamente

- solteiro

- hábil

- Software

- desenvolvimento de software

- Engenheiro de Software

- RESOLVER

- alguns

- algo

- específico

- especificada

- começo

- começado

- Comece

- inicialização

- ficar

- Passo

- Estratégico

- estilo

- apresentado

- substância

- tal

- resumir

- RESUMO

- Espreguiçadeiras

- Suportado

- suposto

- sistemas

- Tire

- tomado

- Tarefa

- tarefas

- Ensino

- Profissionais

- Tennessee

- condições

- texas

- do que

- que

- A

- o mundo

- deles

- Eles

- então

- Lá.

- assim sendo

- Este

- deles

- isto

- três

- Através da

- tempo

- timestamp

- para

- hoje

- ferramentas

- topo

- tópico

- excursão

- Trem

- treinado

- Training

- trens

- Verdade

- tutoriais

- dois

- tipo

- tipos

- tipicamente

- Uber

- ui

- compreensão

- universidade

- Universidade da Califórnia

- Universidade de Chicago

- Universidade de Oxford

- usar

- caso de uso

- usava

- Utilizador

- utilização

- Vale

- variedade

- vário

- locais

- Vídeo

- videogame

- VÍDEOS

- visão

- voz

- queremos

- querendo

- quer

- foi

- we

- web

- serviços web

- BEM

- O Quê

- quando

- qual

- QUEM

- inteiro

- precisarão

- de

- sem

- Atividades:

- trabalhou

- de gestão de documentos

- fluxos de trabalho

- Força de trabalho

- trabalhar

- trabalho

- Workshops

- mundo

- seria

- escrever

- escrita

- escrito

- anos

- Vocês

- investimentos

- zefirnet