AutoML permite que você obtenha insights gerais e rápidos de seus dados logo no início do ciclo de vida de um projeto de aprendizado de máquina (ML). Compreender antecipadamente quais técnicas de pré-processamento e tipos de algoritmos fornecem os melhores resultados reduz o tempo para desenvolver, treinar e implantar o modelo certo. Ele desempenha um papel crucial no processo de desenvolvimento de cada modelo e permite que os cientistas de dados se concentrem nas técnicas de ML mais promissoras. Além disso, o AutoML fornece um desempenho de modelo básico que pode servir como ponto de referência para a equipe de ciência de dados.

Uma ferramenta AutoML aplica uma combinação de diferentes algoritmos e diversas técnicas de pré-processamento aos seus dados. Por exemplo, ele pode dimensionar os dados, realizar seleção univariada de recursos, conduzir PCA em diferentes níveis de limite de variação e aplicar clustering. Tais técnicas de pré-processamento podem ser aplicadas individualmente ou combinadas em um pipeline. Posteriormente, uma ferramenta AutoML treinaria diferentes tipos de modelos, como regressão linear, Elastic-Net ou Random Forest, em diferentes versões do seu conjunto de dados pré-processado e realizaria otimização de hiperparâmetros (HPO). Piloto automático do Amazon SageMaker elimina o trabalho pesado de construir modelos de ML. Depois de fornecer o conjunto de dados, o SageMaker Autopilot explora automaticamente diferentes soluções para encontrar o melhor modelo. Mas e se você quiser implantar sua versão personalizada de um fluxo de trabalho do AutoML?

Esta postagem mostra como criar um fluxo de trabalho AutoML personalizado em Amazon Sage Maker utilização Ajuste automático de modelo do Amazon SageMaker com código de exemplo disponível em um Repo do GitHub.

Visão geral da solução

Para este caso de uso, vamos supor que você faça parte de uma equipe de ciência de dados que desenvolve modelos em um domínio especializado. Você desenvolveu um conjunto de técnicas de pré-processamento personalizadas e selecionou vários algoritmos que normalmente espera que funcionem bem com seu problema de ML. Ao trabalhar em novos casos de uso de ML, você gostaria primeiro de executar uma execução do AutoML usando suas técnicas e algoritmos de pré-processamento para restringir o escopo de possíveis soluções.

Neste exemplo, você não usa um conjunto de dados especializado; em vez disso, você trabalha com o conjunto de dados California Housing do qual importará Serviço de armazenamento simples da Amazon (Amazon S3). O foco é demonstrar a implementação técnica da solução utilizando SageMaker HPO, que posteriormente pode ser aplicada a qualquer conjunto de dados e domínio.

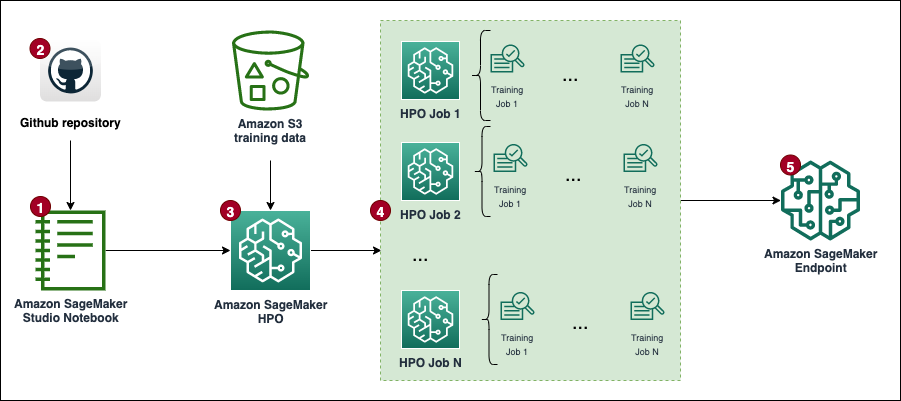

O diagrama a seguir apresenta o fluxo de trabalho geral da solução.

Pré-requisitos

A seguir estão os pré-requisitos para concluir o passo a passo nesta postagem:

Implementar a solução

O código completo está disponível no GitHub repo.

As etapas para implementar a solução (conforme observado no diagrama de fluxo de trabalho) são as seguintes:

- Crie uma instância do notebook e especifique o seguinte:

- Escolha Tipo de instância de notebook, escolha ml.t3.médio.

- Escolha Inferência elástica, escolha Nenhum.

- Escolha Identificador de plataforma, escolha Amazon Linux 2, Laboratório Jupyter 3.

- Escolha Papel do IAM, escolha o padrão

AmazonSageMaker-ExecutionRole. Se não existir, crie um novo Gerenciamento de acesso e identidade da AWS (IAM) e anexar o Política do IAM AmazonSageMakerFullAccess.

Observe que você deve criar uma função e uma política de execução com escopo mínimo na produção.

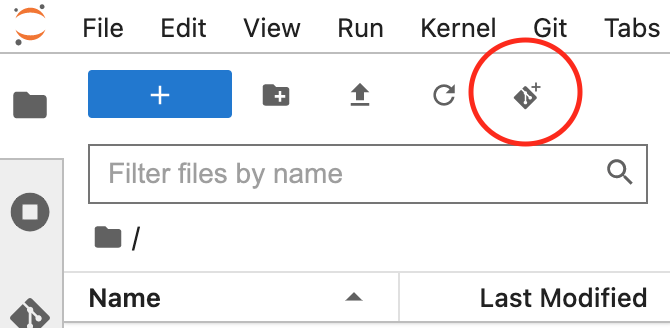

- Abra a interface do JupyterLab para sua instância de notebook e clone o repositório GitHub.

Você pode fazer isso iniciando uma nova sessão de terminal e executando o git clone <REPO> comando ou usando a funcionalidade da IU, conforme mostrado na captura de tela a seguir.

- Abra o

automl.ipynbarquivo de notebook, selecione oconda_python3kernel e siga as instruções para acionar um conjunto de trabalhos HPO.

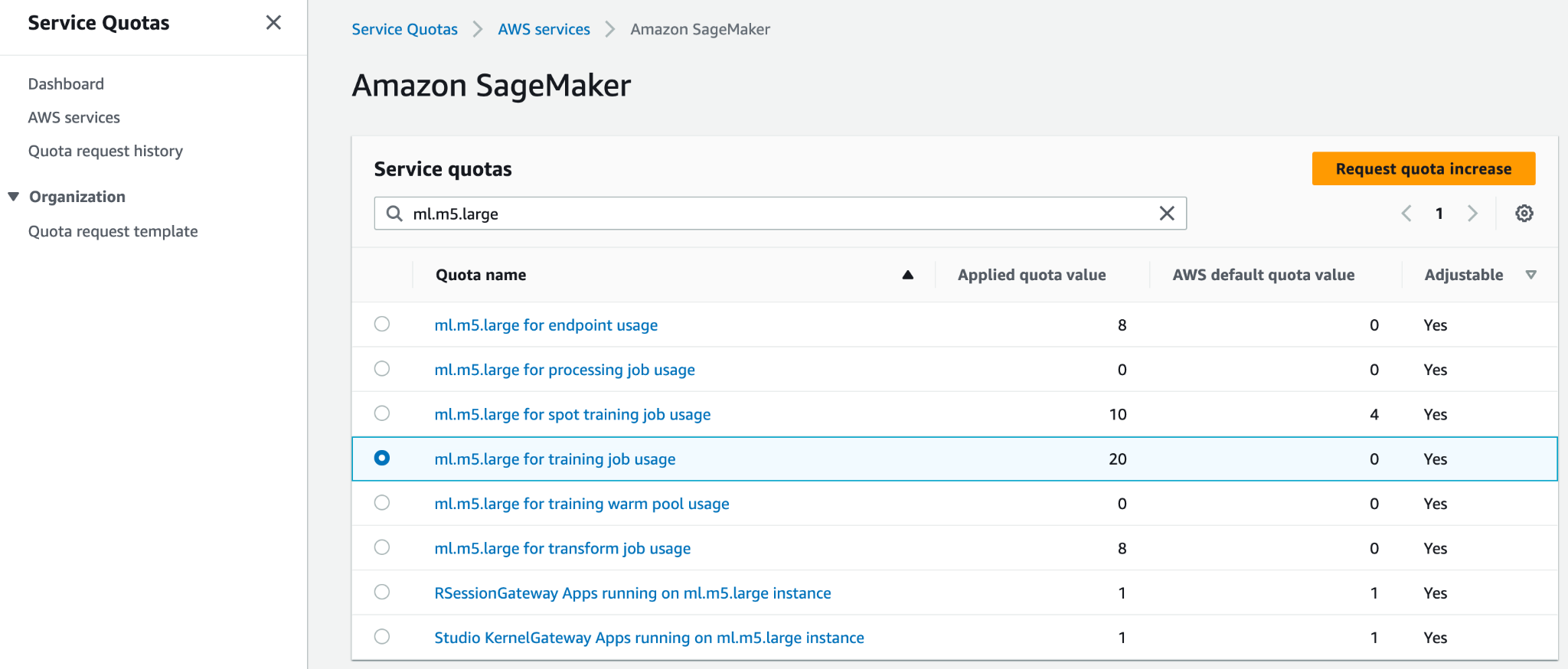

Para executar o código sem nenhuma alteração, você precisa aumentar a cota de serviço para ml.m5.large para uso de trabalho de treinamento e Número de instâncias em todos os jobs de treinamento. A AWS permite, por padrão, apenas 20 trabalhos de treinamento paralelos do SageMaker para ambas as cotas. Você precisa solicitar um aumento de cota para 30 para ambos. Ambas as alterações de cota normalmente devem ser aprovadas em alguns minutos. Referir-se Solicitando um aumento de cota para obter mais informações.

Se não quiser alterar a cota, você pode simplesmente modificar o valor da MAX_PARALLEL_JOBS variável no script (por exemplo, para 5).

- Cada trabalho HPO completará um conjunto de trabalho de treinamento ensaios e indicar o modelo com hiperparâmetros ideais.

- Analise os resultados e implantar o modelo de melhor desempenho.

Esta solução incorrerá em custos na sua conta AWS. O custo desta solução dependerá do número e da duração dos trabalhos de formação HPO. À medida que estes aumentam, também aumenta o custo. Você pode reduzir custos limitando o tempo de treinamento e configurando TuningJobCompletionCriteriaConfig de acordo com as instruções discutidas posteriormente nesta postagem. Para informações sobre preços, consulte Preços do Amazon SageMaker.

Nas seções a seguir, discutiremos o notebook com mais detalhes com exemplos de código e as etapas para analisar os resultados e selecionar o melhor modelo.

Configuração inicial

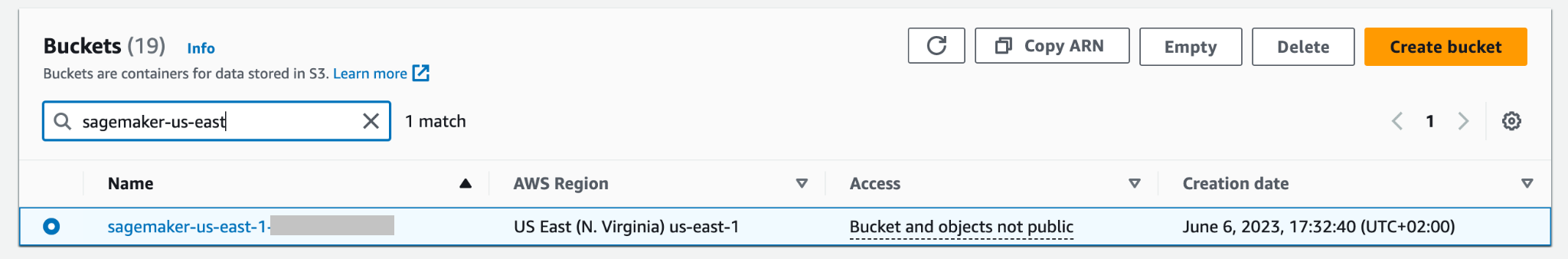

Vamos começar executando o Importações e configuração seção no custom-automl.ipynb caderno. Ele instala e importa todas as dependências necessárias, instancia uma sessão e um cliente SageMaker e define a região padrão e o bucket S3 para armazenar dados.

Preparação de dados

Baixe o conjunto de dados da California Housing e prepare-o executando o Baixar dados seção do caderno. O conjunto de dados é dividido em quadros de dados de treinamento e teste e carregado no bucket S3 padrão da sessão do SageMaker.

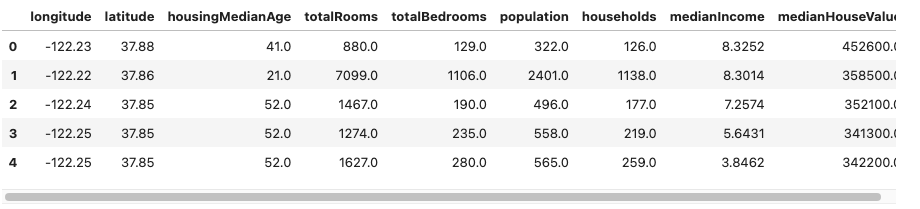

Todo o conjunto de dados possui 20,640 registros e 9 colunas no total, incluindo o destino. O objetivo é prever o valor mediano de uma casa (medianHouseValue coluna). A captura de tela a seguir mostra as linhas superiores do conjunto de dados.

Modelo de script de treinamento

O fluxo de trabalho do AutoML nesta postagem é baseado em scikit-learn pipelines e algoritmos de pré-processamento. O objetivo é gerar uma grande combinação de diferentes pipelines e algoritmos de pré-processamento para encontrar a configuração de melhor desempenho. Vamos começar criando um script de treinamento genérico, que é persistido localmente na instância do notebook. Neste script, existem dois blocos de comentários vazios: um para injetar hiperparâmetros e outro para o objeto de pipeline do modelo de pré-processamento. Eles serão injetados dinamicamente para cada candidato a modelo de pré-processamento. O objetivo de ter um script genérico é manter a implementação SECA (não se repita).

Crie combinações de pré-processamento e modelo

A preprocessors O dicionário contém uma especificação de técnicas de pré-processamento aplicadas a todos os recursos de entrada do modelo. Cada receita é definida usando um Pipeline ou um FeatureUnion objeto do scikit-learn, que encadeia transformações de dados individuais e as empilha. Por exemplo, mean-imp-scale é uma receita simples que garante que os valores ausentes sejam imputados usando os valores médios das respectivas colunas e que todos os recursos sejam dimensionados usando o StandardScaler. Em contraste, o mean-imp-scale-pca cadeias de receitas juntas mais algumas operações:

- Imputar valores ausentes em colunas com sua média.

- Aplique escala de recursos usando média e desvio padrão.

- Calcule o PCA sobre os dados de entrada em um valor limite de variação especificado e mescle-o com os recursos de entrada imputados e dimensionados.

Nesta postagem, todos os recursos de entrada são numéricos. Se você tiver mais tipos de dados em seu conjunto de dados de entrada, deverá especificar um pipeline mais complicado, onde diferentes ramificações de pré-processamento sejam aplicadas a diferentes conjuntos de tipos de recursos.

A models O dicionário contém especificações de diferentes algoritmos aos quais você ajusta o conjunto de dados. Cada tipo de modelo vem com a seguinte especificação no dicionário:

- script_output – Aponta para a localização do script de treinamento usado pelo estimador. Este campo é preenchido dinamicamente quando o

modelsdicionário é combinado com opreprocessorsdicionário. - inserções – Define o código que será inserido no

script_draft.pye posteriormente salvo emscript_output. A chave“preprocessor”é intencionalmente deixado em branco porque esse local é preenchido com um dos pré-processadores para criar múltiplas combinações de modelo-pré-processador. - hiperparâmetros – Um conjunto de hiperparâmetros otimizados pelo trabalho HPO.

- include_cls_metadata – Mais detalhes de configuração exigidos pelo SageMaker

Tunerclasse.

Um exemplo completo do models dicionário está disponível no repositório GitHub.

A seguir, vamos iterar pelo preprocessors e models dicionários e crie todas as combinações possíveis. Por exemplo, se o seu preprocessors dicionário contém 10 receitas e você tem 5 definições de modelo no models dicionário, o dicionário de pipelines recém-criado contém 50 pipelines de modelo de pré-processador que são avaliados durante o HPO. Observe que os scripts de pipeline individuais ainda não foram criados neste momento. O próximo bloco de código (célula 9) do notebook Jupyter itera por todos os objetos do modelo de pré-processador no pipelines dicionário, insere todas as partes de código relevantes e persiste uma versão específica do pipeline do script localmente no notebook. Esses scripts são usados nas próximas etapas ao criar estimadores individuais que você conecta ao trabalho HPO.

Definir estimadores

Agora você pode trabalhar na definição de estimadores do SageMaker que o trabalho HPO usa depois que os scripts estiverem prontos. Vamos começar criando uma classe wrapper que defina algumas propriedades comuns para todos os estimadores. Ele herda do SKLearn classe e especifica a função, a contagem de instâncias e o tipo, bem como quais colunas são usadas pelo script como recursos e o destino.

Vamos construir o estimators dicionário iterando por todos os scripts gerados antes e localizados no scripts diretório. Você instancia um novo estimador usando o SKLearnBase classe, com um nome de estimador exclusivo e um dos scripts. Observe que o estimators dicionário tem dois níveis: o nível superior define um pipeline_family. Este é um agrupamento lógico baseado no tipo de modelos a avaliar e é igual ao comprimento do models dicionário. O segundo nível contém tipos de pré-processadores individuais combinados com os dados pipeline_family. Esse agrupamento lógico é necessário ao criar a tarefa HPO.

Definir argumentos do sintonizador HPO

Para otimizar a passagem de argumentos para o HPO Tuner classe, o HyperparameterTunerArgs a classe de dados é inicializada com argumentos exigidos pela classe HPO. Ele vem com um conjunto de funções que garantem que os argumentos HPO sejam retornados em um formato esperado ao implantar várias definições de modelo de uma só vez.

O próximo bloco de código usa o introduzido anteriormente HyperparameterTunerArgs classe de dados. Você cria outro dicionário chamado hp_args e gerar um conjunto de parâmetros de entrada específicos para cada estimator_family do estimators dicionário. Esses argumentos são usados na próxima etapa ao inicializar trabalhos HPO para cada família de modelos.

Criar objetos sintonizadores HPO

Nesta etapa, você cria sintonizadores individuais para cada estimator_family. Por que você cria três trabalhos HPO separados em vez de lançar apenas um em todos os estimadores? O HyperparameterTuner classe está restrita a 10 definições de modelo anexadas a ela. Portanto, cada HPO é responsável por encontrar o pré-processador de melhor desempenho para uma determinada família de modelos e ajustar os hiperparâmetros dessa família de modelos.

A seguir estão mais alguns pontos sobre a configuração:

- A estratégia de otimização é bayesiana, o que significa que o HPO monitora ativamente o desempenho de todos os testes e navega na otimização em direção a combinações de hiperparâmetros mais promissoras. A parada antecipada deve ser definida como Off or Auto ao trabalhar com uma estratégia bayesiana, que lida sozinha com essa lógica.

- Cada trabalho HPO é executado em no máximo 100 trabalhos e executa 10 trabalhos em paralelo. Se estiver lidando com conjuntos de dados maiores, talvez você queira aumentar o número total de trabalhos.

- Além disso, você pode querer usar configurações que controlem por quanto tempo um trabalho é executado e quantos trabalhos seu HPO está acionando. Uma maneira de fazer isso é definir o tempo máximo de execução em segundos (para esta postagem, definimos para 1 hora). Outra é usar o recém-lançado

TuningJobCompletionCriteriaConfig. Ele oferece um conjunto de configurações que monitoram o andamento dos seus trabalhos e decidem se é provável que mais trabalhos melhorem o resultado. Neste post, definimos como 20 o número máximo de trabalhos de treinamento que não melhoram. Dessa forma, se a pontuação não estiver melhorando (por exemplo, a partir da quadragésima tentativa), você não terá que pagar pelas tentativas restantes atémax_jobsé atingido.

Agora vamos iterar através do tuners e hp_args dicionários e acionar todos os trabalhos HPO no SageMaker. Observe o uso do argumento wait definido como False, o que significa que o kernel não esperará até que os resultados sejam concluídos e você poderá acionar todos os trabalhos de uma vez.

É provável que nem todos os trabalhos de treinamento sejam concluídos e alguns deles possam ser interrompidos pelo trabalho HPO. A razão para isso é TuningJobCompletionCriteriaConfig—a otimização termina se algum dos critérios especificados for atendido. Neste caso, quando os critérios de otimização não melhoram há 20 trabalhos consecutivos.

Analise os resultados

A célula 15 do notebook verifica se todos os trabalhos HPO estão concluídos e combina todos os resultados na forma de um quadro de dados do pandas para análise posterior. Antes de analisar os resultados em detalhes, vamos dar uma olhada de alto nível no console do SageMaker.

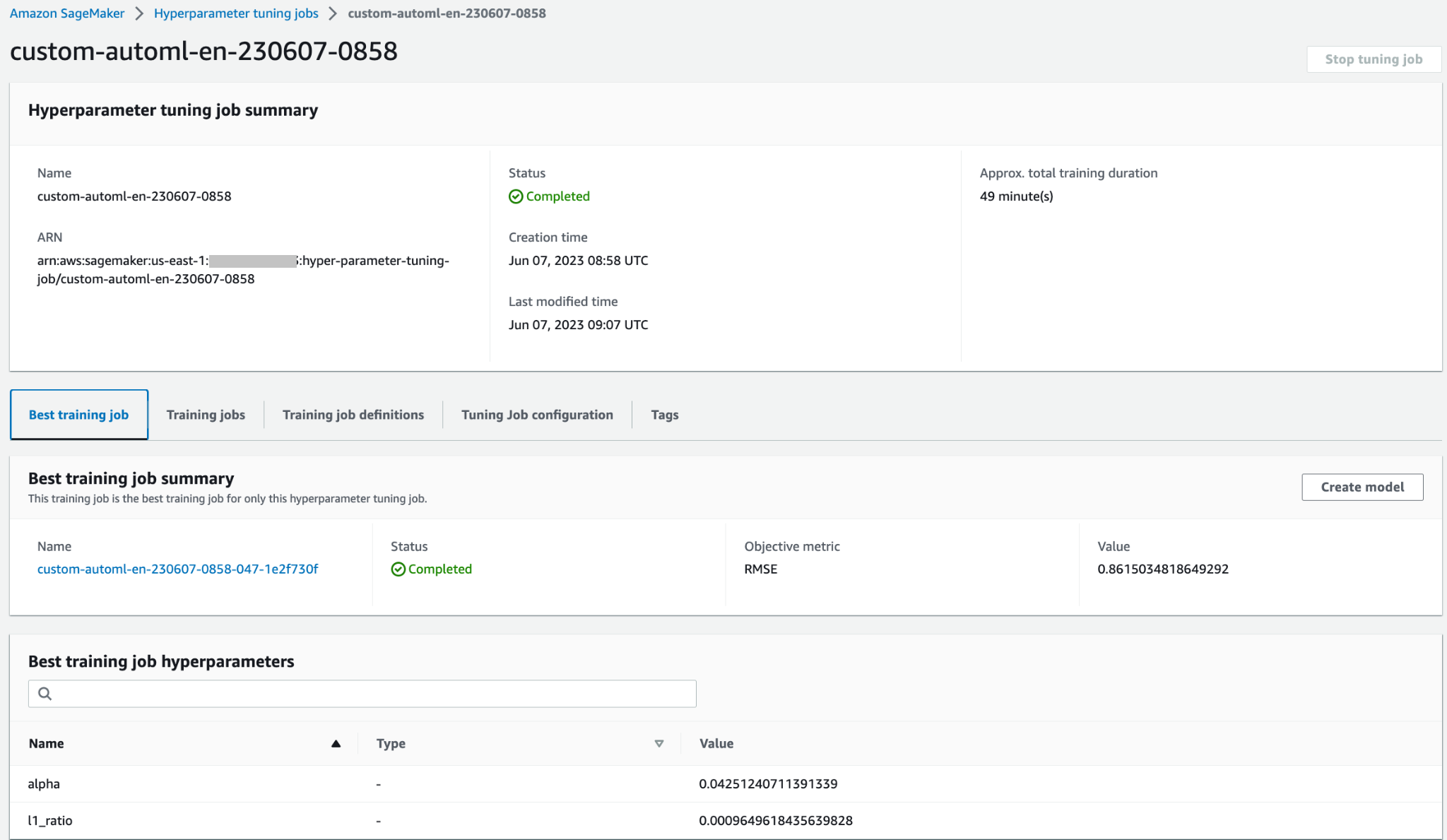

Na parte superior da Jobs de ajuste de hiperparâmetros página, você pode ver seus três trabalhos HPO lançados. Todos terminaram cedo e não realizaram todos os 100 trabalhos de treinamento. Na captura de tela a seguir, você pode ver que a família de modelos Elastic-Net concluiu o maior número de testes, enquanto outros não precisaram de tantos trabalhos de treinamento para encontrar o melhor resultado.

Você pode abrir o trabalho HPO para acessar mais detalhes, como trabalhos de treinamento individuais, configuração do trabalho e informações e desempenho do melhor trabalho de treinamento.

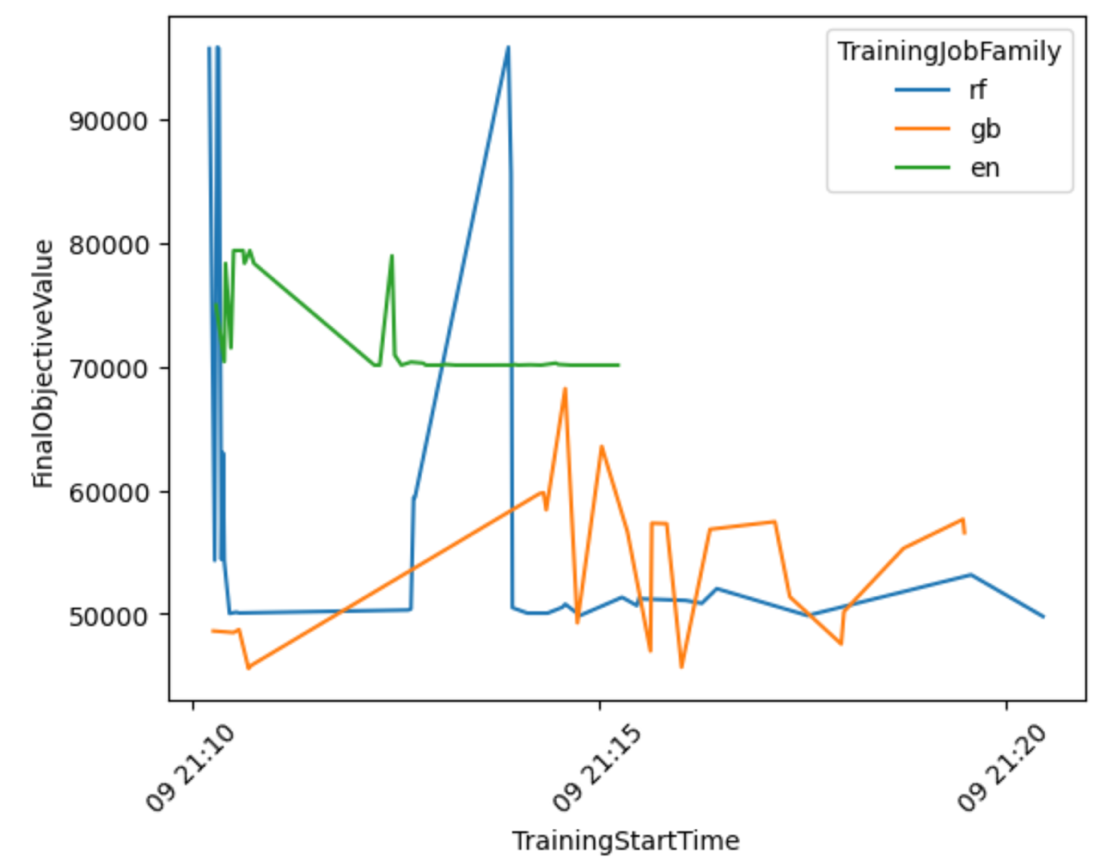

Vamos produzir uma visualização com base nos resultados para obter mais insights sobre o desempenho do fluxo de trabalho do AutoML em todas as famílias de modelos.

A partir do gráfico a seguir, você pode concluir que o Elastic-Net o desempenho do modelo oscilava entre 70,000 e 80,000 RMSE e eventualmente estagnou, pois o algoritmo não foi capaz de melhorar seu desempenho, apesar de tentar várias técnicas de pré-processamento e valores de hiperparâmetros. Também parece que RandomForest o desempenho variou muito dependendo do conjunto de hiperparâmetros explorado pelo HPO, mas apesar de muitos testes não conseguiu ficar abaixo do erro de 50,000 RMSE. GradientBoosting alcançou o melhor desempenho desde o início, ficando abaixo de 50,000 RMSE. O HPO tentou melhorar ainda mais esse resultado, mas não conseguiu obter melhor desempenho em outras combinações de hiperparâmetros. Uma conclusão geral para todos os trabalhos HPO é que não foram necessários tantos trabalhos para encontrar o conjunto de hiperparâmetros com melhor desempenho para cada algoritmo. Para melhorar ainda mais o resultado, você precisaria experimentar a criação de mais recursos e a execução de engenharia de recursos adicionais.

Você também pode examinar uma visão mais detalhada da combinação modelo-pré-processador para tirar conclusões sobre as combinações mais promissoras.

Selecione o melhor modelo e implante-o

O trecho de código a seguir seleciona o melhor modelo com base no valor objetivo mais baixo alcançado. Você pode então implantar o modelo como um endpoint do SageMaker.

limpar

Para evitar cobranças indesejadas em sua conta da AWS, recomendamos excluir os recursos da AWS que você usou nesta postagem:

- No console do Amazon S3, esvazie os dados do bucket do S3 onde os dados de treinamento foram armazenados.

- No console do SageMaker, interrompa a instância do notebook.

- Exclua o endpoint do modelo se você o implantou. Os endpoints devem ser excluídos quando não estiverem mais em uso, pois são cobrados por tempo de implantação.

Conclusão

Nesta postagem, mostramos como criar um trabalho HPO personalizado no SageMaker usando uma seleção personalizada de algoritmos e técnicas de pré-processamento. Em particular, este exemplo demonstra como automatizar o processo de geração de muitos scripts de treinamento e como usar estruturas de programação Python para implantação eficiente de vários trabalhos de otimização paralelos. Esperamos que esta solução forme a estrutura de qualquer trabalho de ajuste de modelo personalizado que você implantará usando o SageMaker para obter maior desempenho e acelerar seus fluxos de trabalho de ML.

Confira os seguintes recursos para aprofundar ainda mais seu conhecimento sobre como usar o SageMaker HPO:

Sobre os autores

Konrad Semsch é arquiteto sênior de soluções de ML na equipe do Amazon Web Services Data Lab. Ele ajuda os clientes a usar o machine learning para resolver seus desafios de negócios com a AWS. Ele gosta de inventar e simplificar para oferecer aos clientes soluções simples e pragmáticas para seus projetos de IA/ML. Ele é mais apaixonado por MlOps e ciência de dados tradicional. Fora do trabalho, ele é um grande fã de windsurf e kitesurf.

Konrad Semsch é arquiteto sênior de soluções de ML na equipe do Amazon Web Services Data Lab. Ele ajuda os clientes a usar o machine learning para resolver seus desafios de negócios com a AWS. Ele gosta de inventar e simplificar para oferecer aos clientes soluções simples e pragmáticas para seus projetos de IA/ML. Ele é mais apaixonado por MlOps e ciência de dados tradicional. Fora do trabalho, ele é um grande fã de windsurf e kitesurf.

Ersoy de atum é arquiteto de soluções sênior na AWS. Seu foco principal é ajudar os clientes do setor público a adotar tecnologias de nuvem para suas cargas de trabalho. Ela tem experiência em desenvolvimento de aplicativos, arquitetura corporativa e tecnologias de contact center. Seus interesses incluem arquiteturas sem servidor e IA/ML.

Ersoy de atum é arquiteto de soluções sênior na AWS. Seu foco principal é ajudar os clientes do setor público a adotar tecnologias de nuvem para suas cargas de trabalho. Ela tem experiência em desenvolvimento de aplicativos, arquitetura corporativa e tecnologias de contact center. Seus interesses incluem arquiteturas sem servidor e IA/ML.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :tem

- :é

- :não

- :onde

- $UP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Capaz

- Sobre

- Acesso

- Segundo

- Conta

- Alcançar

- alcançado

- em

- ativamente

- Adicional

- Adicionalmente

- adotar

- Depois de

- AI / ML

- visar

- algoritmo

- algoritmos

- Todos os Produtos

- Permitindo

- permite

- já

- tb

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- análise

- analisar

- análise

- e

- Outro

- qualquer

- Aplicação

- Desenvolvimento de Aplicações

- aplicado

- aplica

- Aplicar

- aprovou

- arquitetura

- SOMOS

- argumento

- argumentos

- AS

- assumir

- At

- anexar

- auto

- automatizar

- Automático

- automaticamente

- AutoML

- disponível

- AWS

- fundo

- base

- baseado

- Linha de Base

- Bayesiano

- BE

- Porque

- antes

- Começo

- abaixo

- MELHOR

- Melhor

- entre

- Grande

- Bloquear

- Blocos

- ambos

- ramos

- construir

- Prédio

- negócio

- mas a

- botão

- by

- Califórnia

- chamada

- chamado

- CAN

- candidato

- casas

- casos

- Centralização de

- correntes

- desafios

- alterar

- Alterações

- acusações

- Cheques

- Escolha

- classe

- CLF

- cliente

- Na nuvem

- Agrupar

- agrupamento

- código

- Coluna

- colunas

- combinação

- combinações

- combinado

- combina

- vem

- comentar

- comum

- completar

- Efetuado

- completando

- complicado

- conclui

- conclusão

- Conduzir

- Configuração

- consecutivo

- cônsul

- Contacto

- contact center

- contém

- contraste

- ao controle

- Custo

- custos

- poderia

- crio

- criado

- Criar

- critérios

- crucial

- Atualmente

- personalizadas

- Clientes

- dados,

- ciência de dados

- conjuntos de dados

- lidar

- decidir

- Aprofundar

- Padrão

- definido

- Define

- definição

- definições

- demonstrar

- demonstra

- depender

- dependências

- Dependendo

- implantar

- implantado

- Implantação

- desenvolvimento

- derivar

- Apesar de

- detalhe

- detalhado

- detalhes

- desenvolver

- desenvolvido

- Desenvolvimento

- desenvolve

- desvio

- DICT

- diferente

- diretórios

- discutir

- discutido

- do

- Não faz

- domínio

- não

- down

- desenhar

- secar

- duração

- durante

- dinamicamente

- cada

- Cedo

- eficiente

- elimina

- permitir

- Ponto final

- Engenharia

- garantir

- garante

- Empreendimento

- Todo

- inteiramente

- igual

- erro

- avaliar

- avaliadas

- eventualmente

- Cada

- examinar

- exemplo

- exemplos

- execução

- existir

- esperar

- esperado

- experimentar

- explicado

- Explorado

- explora

- falso

- famílias

- família

- ventilador

- Característica

- Funcionalidades

- poucos

- campo

- Envie o

- preenchida

- Encontre

- descoberta

- Primeiro nome

- caber

- cinco

- Foco

- seguir

- seguinte

- segue

- Escolha

- floresta

- formulário

- formato

- QUADRO

- da

- frente

- cheio

- função

- funcionalidade

- funções

- mais distante

- Geral

- gerar

- gerado

- gerando

- ter

- Git

- GitHub

- dado

- Go

- meta

- vai

- gráfico

- mão

- Alças

- Ter

- ter

- he

- pesado

- levantamento pesado

- ajuda

- ajuda

- sua experiência

- de alto nível

- superior

- mais

- esperança

- hora

- House

- famílias

- habitação

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- http

- HTTPS

- Otimização de hiperparâmetros

- Ajuste de hiperparâmetros

- Identidade

- if

- executar

- implementação

- importar

- importações

- melhorar

- melhorar

- in

- incluir

- Incluindo

- Crescimento

- indicam

- Individual

- Individualmente

- INFORMAÇÕES

- entrada

- inputs

- Inserções

- insights

- instância

- em vez disso

- instruções

- integração

- intencionalmente

- interesses

- Interface

- para dentro

- introduzido

- IT

- ESTÁ

- se

- Trabalho

- Empregos

- jpg

- apenas por

- apenas um

- Guarda

- Chave

- Conhecimento

- laboratório

- grande

- Maior

- mais tarde

- lançado

- de lançamento

- aprendizagem

- esquerda

- Comprimento

- Nível

- níveis

- wifecycwe

- facelift

- como

- Provável

- limitando

- linux

- carregar

- localmente

- localizado

- localização

- lógica

- lógico

- longo

- mais

- olhar

- lote

- menor

- máquina

- aprendizado de máquina

- muitos

- máximo

- Posso..

- significar

- significa

- ir

- conheceu

- Métrica

- poder

- Minutos

- desaparecido

- ML

- MLOps

- modelo

- modelos

- modificar

- Monitore

- monitores

- mais

- a maioria

- múltiplo

- nome

- estreito

- navega

- você merece...

- Novo

- recentemente

- Próximo

- não

- nenhum

- caderno

- notado

- agora

- número

- numpy

- objeto

- objetivo

- objetos

- of

- WOW!

- Oferece

- on

- uma vez

- ONE

- só

- aberto

- Operações

- ideal

- otimização

- Otimize

- otimizado

- or

- ordem

- OS

- Outros

- Outros

- Fora

- saída

- lado de fora

- Acima de

- global

- página

- pandas

- Paralelo

- parâmetros

- parte

- particular

- Passagem

- apaixonado

- caminho

- Pagar

- Realizar

- atuação

- realização

- persiste

- peças

- oleoduto

- platão

- Inteligência de Dados Platão

- PlatãoData

- desempenha

- plugue

- ponto

- pontos

- Privacidade

- população

- possível

- Publique

- potencial

- pragmático

- predizer

- Predictor

- Preparar

- pré-requisitos

- presentes

- evitar

- anteriormente

- preços

- primário

- Impressão

- Problema

- processo

- produzir

- Produção

- Programação

- Progresso

- projeto

- projetos

- promissor

- Propriedades

- fornecer

- fornece

- fornecendo

- público

- propósito

- Python

- acaso

- rápido

- alcançado

- pronto

- razão

- recentemente

- receita

- recomendar

- registros

- reduzir

- reduz

- referir

- referência

- em relação a

- regex

- região

- liberado

- relevante

- remanescente

- remover

- repetir

- repositório

- solicitar

- requerer

- requeridos

- Recursos

- aqueles

- responsável

- restringido

- resultar

- Resultados

- retorno

- certo

- Tipo

- Execute

- corrida

- é executado

- tempo de execução

- sábio

- Ajuste automático de modelos do SageMaker

- salvo

- Escala

- dimensionamento

- Ciência

- cientistas

- scikit-learn

- escopo

- Ponto

- escrita

- Scripts

- Segundo

- segundo

- Seção

- seções

- setor

- Vejo

- parece

- selecionado

- doadores,

- AUTO

- senior

- separado

- servir

- Serverless

- serviço

- Serviços

- Sessão

- conjunto

- Conjuntos

- Configurações

- instalação

- ela

- rede de apoio social

- mostrada

- mostrando

- Shows

- simples

- simplificando

- simplesmente

- fragmento

- So

- solução

- Soluções

- RESOLVER

- alguns

- especializado

- específico

- especificação

- especificações

- especificada

- velocidade

- divisão

- pilha

- padrão

- começo

- Comece

- Status

- Passo

- Passos

- Dê um basta

- parou

- paragem

- armazenamento

- armazenadas

- armazenar

- Estratégia

- estrutura

- estruturas

- Subseqüentemente

- tal

- Suportado

- mesa

- adaptados

- Tire

- Target

- Profissionais

- Dados Técnicos:

- técnicas

- Tecnologias

- terminal

- teste

- ensaio

- que

- A

- deles

- Eles

- então

- Lá.

- assim sendo

- Este

- deles

- isto

- aqueles

- três

- limiar

- Através da

- tempo

- para

- juntos

- ferramenta

- topo

- Total

- para

- tradicional

- Trem

- Training

- transformações

- julgamento

- ensaios

- experimentado

- desencadear

- desencadeado

- desencadeando

- tentando

- sintonização

- dois

- tipo

- tipos

- tipicamente

- ui

- para

- compreensão

- único

- até

- não desejado

- carregado

- Uso

- usar

- caso de uso

- usava

- usos

- utilização

- VALIDAR

- valor

- Valores

- variável

- variado

- vário

- versão

- versões

- Ver

- visualização

- W

- esperar

- Passo a passo

- queremos

- foi

- Caminho..

- we

- web

- serviços web

- BEM

- foram

- O Quê

- quando

- enquanto que

- se

- qual

- porque

- precisarão

- de

- dentro

- sem

- Atividades:

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- seria

- escrever

- ainda

- Vocês

- investimentos

- você mesmo

- zefirnet