JumpStart do Amazon SageMaker é o hub de aprendizado de máquina (ML) do SageMaker que fornece modelos pré-treinados e disponíveis ao público para uma ampla variedade de tipos de problemas para ajudá-lo a começar a usar o aprendizado de máquina.

Compreender o comportamento do cliente é uma prioridade para todas as empresas hoje. Obter insights sobre por que e como os clientes compram pode ajudar a aumentar a receita. A rotatividade de clientes é um problema enfrentado por uma ampla gama de empresas, de telecomunicações a bancos, onde os clientes normalmente são perdidos para os concorrentes. É do interesse de uma empresa manter os clientes existentes em vez de adquirir novos clientes, porque geralmente custa muito mais atrair novos clientes. Ao tentar reter clientes, as empresas geralmente concentram seus esforços nos clientes com maior probabilidade de sair. O comportamento do usuário e os logs de bate-papo do suporte ao cliente podem conter indicadores valiosos sobre a probabilidade de um cliente encerrar o serviço. Nesta solução, treinamos e implantamos um modelo de previsão de churn que usa um modelo de processamento de linguagem natural (NLP) de última geração para encontrar sinais úteis no texto. Além de entradas textuais, esse modelo usa entradas de dados estruturados tradicionais, como campos numéricos e categóricos.

A multimodalidade é um campo de pesquisa multidisciplinar que aborda alguns dos objetivos originais da inteligência artificial, integrando e modelando várias modalidades. Este post tem como objetivo construir um modelo que possa processar e relacionar informações de múltiplas modalidades, como recursos tabulares e textuais.

Mostramos como treinar, implantar e usar um modelo de previsão de rotatividade que processou recursos numéricos, categóricos e textuais para fazer sua previsão. Embora nos aprofundemos em um caso de uso de previsão de churn nesta postagem, você pode usar esta solução como modelo para generalizar o ajuste fino de modelos pré-treinados com seu próprio conjunto de dados e, posteriormente, executar a otimização de hiperparâmetros (HPO) para melhorar a precisão. Você pode até mesmo substituir o conjunto de dados de exemplo pelo seu próprio e executá-lo de ponta a ponta para resolver seus próprios casos de uso. A solução descrita no post está disponível em GitHub.

Modelos de solução JumpStart

JumpStart do Amazon SageMaker fornece soluções completas com um clique para muitos casos de uso comuns de ML. Explore os seguintes casos de uso para obter mais informações sobre os modelos de solução disponíveis:

Os modelos de solução JumpStart cobrem uma variedade de casos de uso, em cada um dos quais vários modelos de solução diferentes são oferecidos (esta solução de Compreensão de Documentos está no caso de uso “Extrair e analisar dados de documentos”).

Escolha o modelo de solução que melhor se adapta ao seu caso de uso na página inicial do JumpStart. Para obter mais informações sobre soluções específicas em cada caso de uso e como iniciar uma solução JumpStart, consulte Modelos de solução.

Visão geral da solução

A figura a seguir demonstra como você pode usar esta solução com Amazon Sage Maker componentes. Os trabalhos de treinamento do SageMaker são usados para treinar os vários modelos de NLP, e os endpoints do SageMaker são usados para implantar os modelos em cada estágio. Nós usamos Serviço de armazenamento simples da Amazon (Amazon S3) ao lado do SageMaker para armazenar os dados de treinamento e os artefatos do modelo, e Amazon CloudWatch para registrar as saídas de treinamento e endpoint.

Abordamos a solução do problema de previsão de churn com as seguintes etapas:

- Exploração de dados para preparar os dados para estarem prontos para ML.

- Treine um modelo multimodal com um Transformador de frase Abraçando o Rosto e Scikit-learn classificador de floresta aleatória.

- Melhore ainda mais o desempenho do modelo com HPO usando SageMaker ajuste automático do modelo.

- Treine dois Modelos multimodais AutoGluon: um modelo de conjunto ponderado/empilhado multimodal AutoGluon e um modelo de fusão multimodal AutoGluon.

- Avalie e compare os desempenhos do modelo nos dados de teste de validação.

Pré-requisitos

Para experimentar o solução em sua própria conta, certifique-se de ter o seguinte em vigor:

- Uma conta da AWS. Se você não tem uma conta, você pode inscreva-se para um.

- A solução descrita na postagem faz parte do SageMaker JumpStart. Para executar esta solução JumpStart e implantar a infraestrutura em sua conta da AWS, você deve criar um ativo Estúdio Amazon SageMaker instância (ver Integrado ao Amazon SageMaker Studio). Quando sua instância do Studio estiver pronta, use as instruções no JumpStart para iniciar a solução.

- Ao executar isso caderno no Studio, certifique-se de que o Python 3 (PyTorch 1.10 Python 3.8 otimizado para CPU) imagem/kernel é usado.

Você pode instalar os pacotes necessários conforme descrito na solução para executar este notebook:

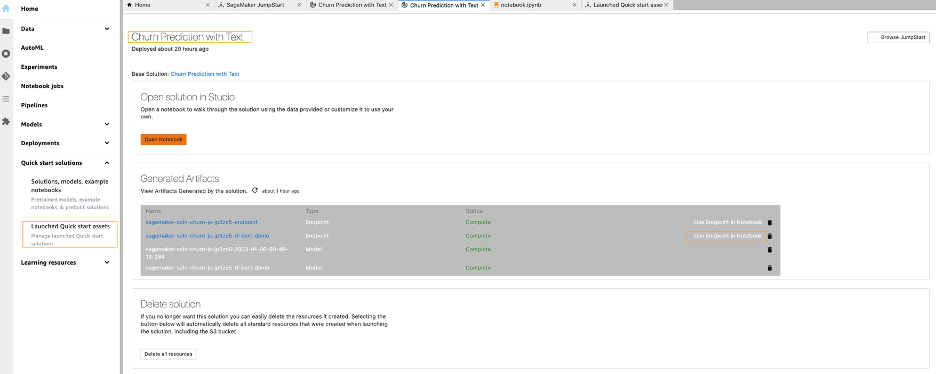

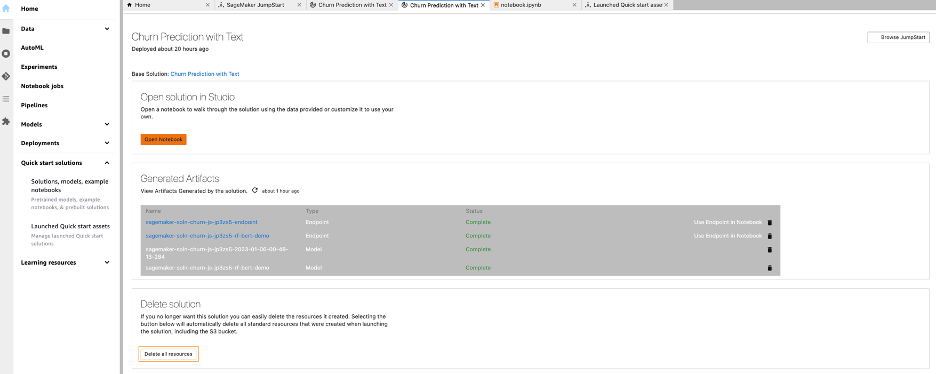

Abra o caso de uso de previsão de churn

No console do Studio, escolha Soluções, modelos, notebooks de exemplo para Soluções de início rápido no painel de navegação. Navegue até o Previsão de churn com texto solução no JumpStart.

Agora podemos dar uma olhada em alguns dos ativos que estão incluídos nesta solução.

Exploração de dados

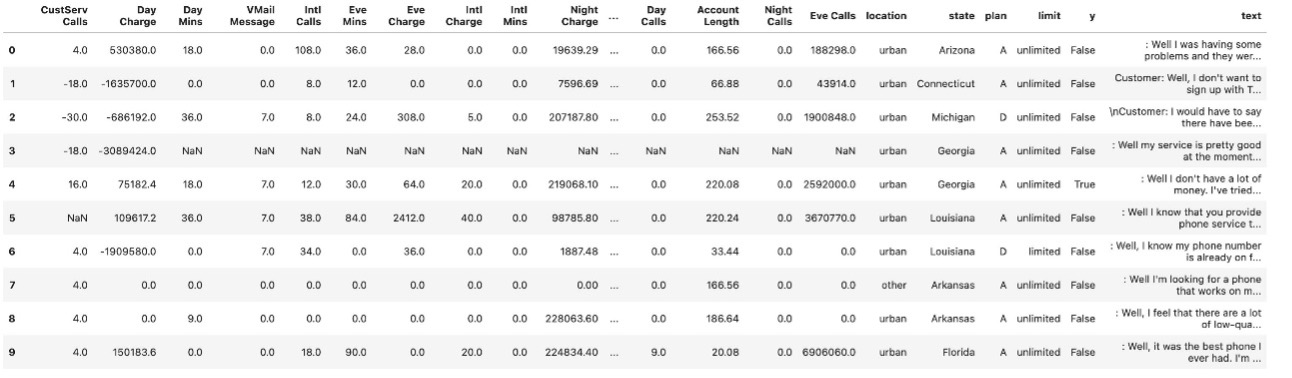

Primeiro, vamos baixar o conjunto de dados de teste, validação e treinamento do bucket S3 de origem e carregá-lo em nosso bucket S3. A captura de tela a seguir mostra 10 observações dos dados de treinamento.

Vamos começar a explorar o conjunto de dados de treinamento e validação.

Como você pode ver, temos recursos diferentes, como CustServ Calls, Day Charge e Day Calls que usamos para prever a coluna de destino y (se o cliente saiu do serviço).

y é conhecido como o atributo de destino: o atributo que queremos que o modelo de ML preveja. Como o atributo de destino é binário, nosso modelo executa a previsão binária, também conhecida como classificação binária.

Existem 21 recursos, incluindo a variável de destino. O número de exemplos para dados de treinamento e validação são 43,000 e 5,000, respectivamente.

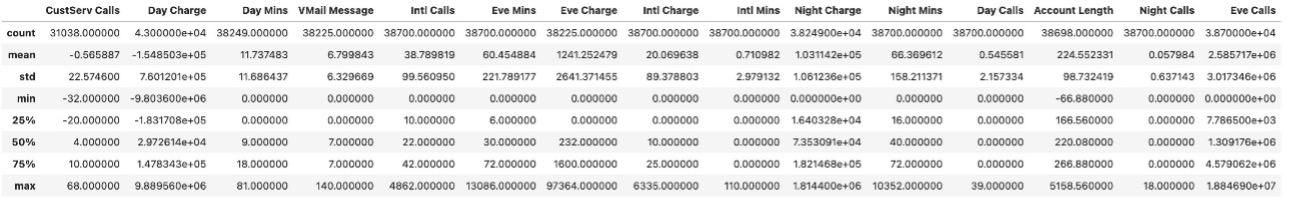

A captura de tela a seguir mostra as estatísticas resumidas do conjunto de dados de treinamento.

Exploramos o conjunto de dados e o dividimos em conjuntos de treinamento, validação e teste. O conjunto de treinamento e validação é usado para treinamento e HPO. O conjunto de teste é usado como o conjunto de validação para avaliação de desempenho do modelo. Agora realizamos as etapas de engenharia de recursos e ajustamos o modelo.

Ajustar um modelo multimodal com um transformador de sentença Hugging Face e classificador de floresta aleatória Scikit-learn

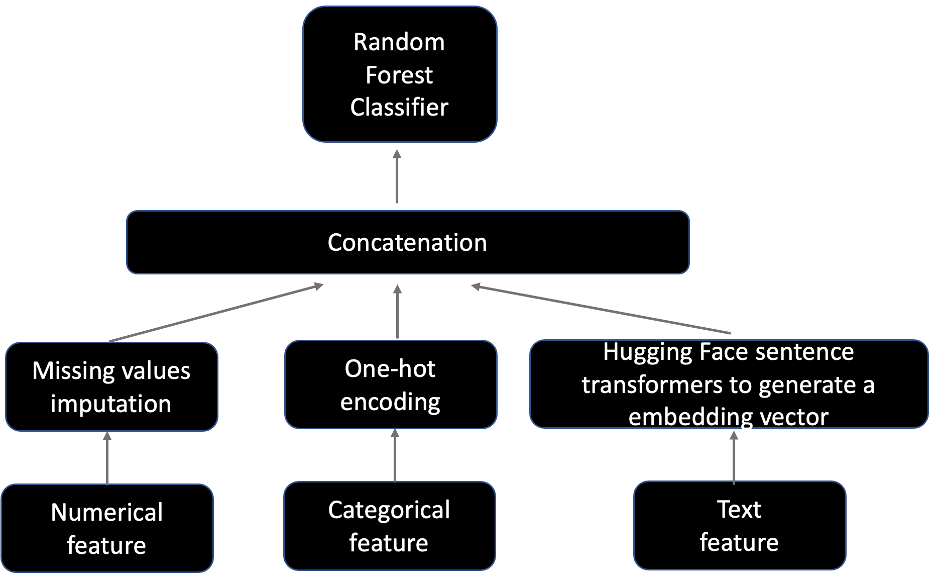

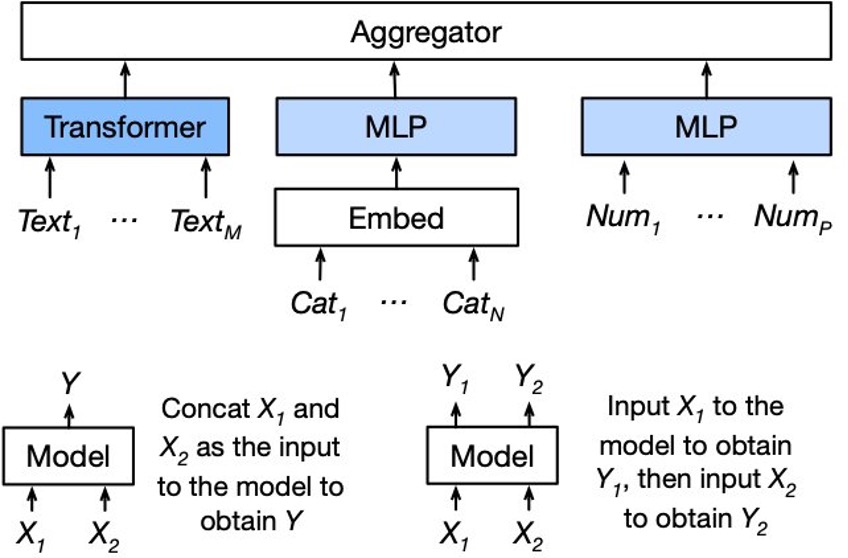

O treinamento do modelo consiste em dois componentes: uma etapa de engenharia de recursos que processa recursos numéricos, categóricos e de texto e uma etapa de ajuste de modelo que ajusta os recursos transformados em um Scikit-learn classificador de floresta aleatória.

Para a engenharia de recursos, concluímos as seguintes etapas:

- Preencha os valores que faltam para recursos numéricos.

- Codifique feições categóricas em valores únicos, onde os valores ausentes são contados como uma das categorias para cada feição.

- Usar um Transformador de frase Abraçando o Rosto para codificar o recurso de texto para gerar um vetor denso de dimensão X, em que o valor de X depende de um transformador de sentença específico.

Escolhemos os três principais modelos de transformadores de sentença mais baixados e os usamos no seguinte ajuste de modelo e HPO. Especificamente, usamos totalmente MiniLM-L6-v2, multi-qa-mpnet-base-ponto-v1 e paráfrase-MiniLM-L6-v2. Para hiperparâmetros do classificador de floresta aleatória, consulte o GitHub repo.

A figura a seguir descreve o diagrama de arquitetura do modelo.

Existem muitos hiperparâmetros que você pode ajustar, como n-estimadores, profundidade máxima e bootstrap. Para mais detalhes, consulte o GitHub repo.

Para fins de demonstração, usamos apenas recursos numéricos CustServ Calls e Account Length, características categóricas plan e limite recurso de texto text para se adequar ao modelo. Vários recursos devem ser separados por ,.

Implantamos o modelo após a conclusão do treinamento:

Ao chamar nosso novo endpoint do notebook, usamos um SageMaker SDK Predictor. UMA Predictor é usado para enviar dados para um terminal (como parte de uma solicitação) e interpretar a resposta. JSON é usado como formato para dados de entrada e resposta de saída porque é um formato de ponto de extremidade padrão e a resposta de ponto de extremidade pode conter estruturas de dados aninhadas.

Com nosso modelo implantado com sucesso e nosso preditor configurado, podemos experimentar o modelo de previsão de churn em uma entrada de exemplo:

O código a seguir mostra a resposta (probabilidade de rotatividade) da consulta ao endpoint:

Observe que a probabilidade retornada por este modelo não foi calibrada. Quando o modelo dá uma probabilidade de churn de 20%, por exemplo, isso não significa necessariamente que 20% dos clientes com probabilidade de 20% resultaram em churn. A calibração é uma propriedade útil em certas circunstâncias, mas não é necessária nos casos em que a discriminação entre casos de rotatividade e não rotatividade é suficiente. Classificador CalibradoCV da Scikit-learn pode ser usado para calibrar um modelo.

Agora, consultamos o terminal usando os dados de teste de validação, que consistem em 1,939 exemplos. A tabela a seguir resume os resultados da avaliação para nosso modelo multimodal com um transformador de sentença Hugging Face e classificador de floresta aleatória Scikit-learn.

| métrico | BERT + Floresta Aleatória |

| Precisão | 0.77463 |

| ROC AUC | 0.75905 |

O desempenho do modelo depende das configurações de hiperparâmetros. Treinar um modelo com um conjunto de configurações de hiperparâmetros não garantirá um modelo ideal. Como resultado, executamos o processo HPO na seção a seguir para melhorar ainda mais o desempenho do modelo.

Ajustar um modelo multimodal com HPO

Nesta seção, melhoramos ainda mais o desempenho do modelo adicionando ajuste HPO com SageMaker ajuste automático do modelo. O ajuste automático de modelo do SageMaker, também conhecido como ajuste de hiperparâmetros, encontra a melhor versão de um modelo executando muitos trabalhos de treinamento em seu conjunto de dados usando o algoritmo e intervalos de hiperparâmetros que você especifica. Em seguida, ele escolhe os valores de hiperparâmetros que resultam em um modelo com melhor desempenho, conforme medido por uma métrica que você escolher. O melhor modelo e seus hiperparâmetros correspondentes são selecionados nos dados de validação. Em seguida, o melhor modelo é avaliado nos dados de teste de validação, que são os mesmos dados de teste que criamos na seção anterior. Finalmente, mostramos que o desempenho do modelo treinado com HPO é significativamente melhor do que aquele treinado sem HPO.

A seguir estão hiperparâmetros estáticos que não ajustamos e hiperparâmetros dinâmicos que queremos ajustar e seus intervalos de pesquisa:

Definimos o nome da métrica objetiva, a definição da métrica (com padrão regex) e o tipo de objetivo para o trabalho de ajuste.

Primeiro, definimos o objetivo como a pontuação de precisão nos dados de validação (roc auc score on validation data) e métricas definidas para o trabalho de ajuste especificando o nome da métrica objetiva e uma expressão regular (regex). A expressão regular é usada para corresponder à saída de log do algoritmo e capturar os valores numéricos das métricas.

Em seguida, especificamos intervalos de hiperparâmetros para selecionar os melhores valores de hiperparâmetros. Definimos o número total de tarefas de ajuste como 10 e distribuímos essas tarefas em cinco Amazon Elastic Compute Nuvem (Amazon EC2) instâncias para executar tarefas de ajuste paralelo.

Por fim, passamos esses valores para instanciar um objeto SageMaker Estimator, semelhante ao que fizemos na etapa de treinamento anterior. Em vez de chamar a função de ajuste do objeto Estimator, passamos o objeto Estimator como um parâmetro para o objeto Estimator. HiperparâmetroTuner constructor e chame a função fit dele para iniciar os jobs de ajuste:

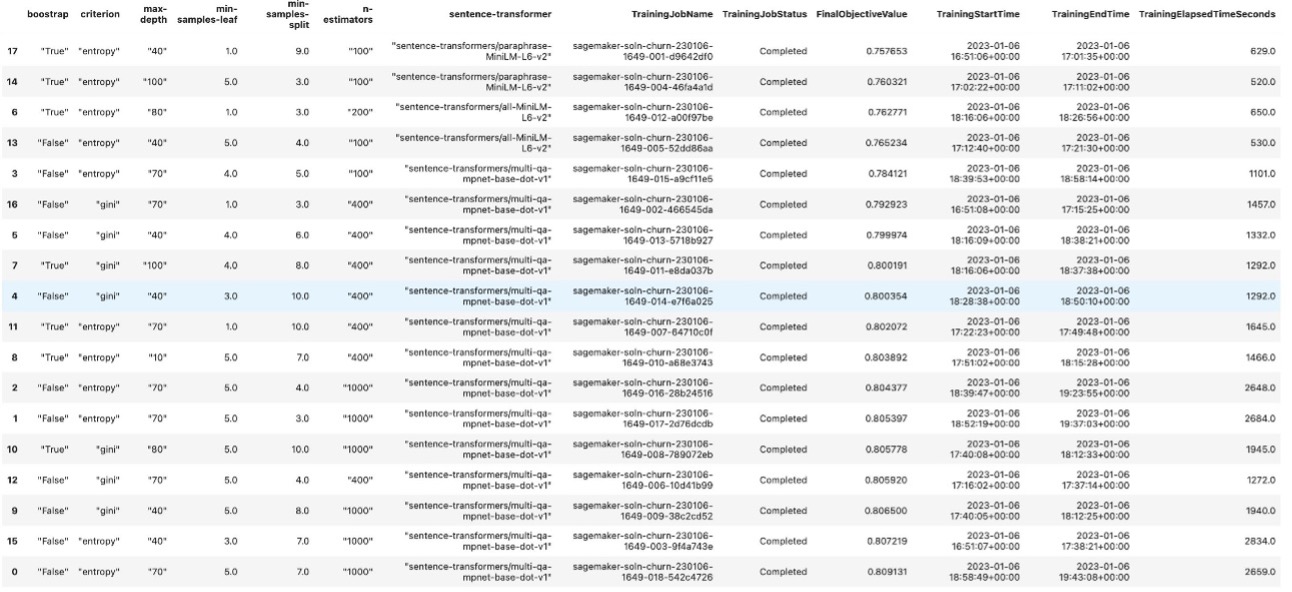

Quando o trabalho de ajuste estiver concluído, podemos gerar a tabela de resumo de todos os trabalhos de ajuste.

Após a conclusão dos trabalhos de ajuste, implantamos o modelo que fornece a melhor pontuação de métrica de avaliação no conjunto de dados de validação, realizamos inferência no mesmo conjunto de dados de teste de validação que fizemos na seção anterior e calculamos as métricas de avaliação.

| métrico | BERT + Floresta Aleatória | BERT + Floresta Aleatória com HPO |

| Precisão | 0.77463 | 0.9278 |

| ROC AUC | 0.75905 | 0.79861 |

Podemos ver que a execução do HPO com o ajuste automático do modelo do SageMaker melhora significativamente o desempenho do modelo.

Além do HPO, o desempenho do modelo também depende do algoritmo. É importante treinar vários algoritmos de última geração, comparar seu desempenho nos mesmos dados de teste de espera e escolher o ideal. Portanto, treinamos mais dois modelos multimodais AutoGluon nas seções a seguir.

Ajustar um modelo de conjunto ponderado/empilhado multimodal AutoGluon

Existem dois tipos de multimodalidade AutoGluon:

- Treine vários modelos tabulares, bem como o

TextPredictormodelo (utilizando oTextPredictormodelo dentro deTabularPredictor) e, em seguida, combine-os por meio de um conjunto ponderado ou conjunto empilhado, conforme explicado em AutoGluon-Tabular: AutoML robusto e preciso para dados estruturados - Fusão de vários modelos de rede neural diretamente e manipulação de texto bruto (que também são capazes de lidar com colunas numéricas e categóricas adicionais)

Treinamos um modelo de conjunto ponderado ou empilhado multimodal primeiro nesta seção e treinamos um modelo de rede neural de fusão na próxima seção.

Primeiro, recuperamos a imagem de treinamento do AutoGluon:

Em seguida, passamos os hiperparâmetros. Ao contrário das estruturas AutoML existentes que se concentram principalmente no modelo ou na seleção de hiperparâmetros, o AutoGluonTabular consegue agrupar vários modelos e empilhá-los em várias camadas. Portanto, HPO geralmente não é necessário para modelos de conjunto AutoGluon.

Por fim, criamos um Avaliador do SageMaker e ligue estimator.fit() para iniciar um trabalho de treinamento:

Após a conclusão do treinamento, recuperamos a imagem de inferência do AutoGluon e implantamos o modelo:

Depois de implantar os endpoints, consultamos o endpoint usando o mesmo conjunto de teste e calculamos as métricas de avaliação. Na tabela a seguir, podemos ver que o conjunto multimodal AutoGluon melhora cerca de 3% no ROC AUC em comparação com o transformador de sentença BERT e a floresta aleatória com HPO.

| métrico | BERT + Floresta Aleatória | BERT + Floresta Aleatória com HPO | Conjunto Multimodal AutoGluon |

| Precisão | 0.77463 | 0.9278 | 0.92625 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 |

Ajustar um modelo de fusão multimodal AutoGluon

O diagrama a seguir ilustra a arquitetura do modelo. Para detalhes, consulte AutoMM para Texto + Tabular – Início Rápido.

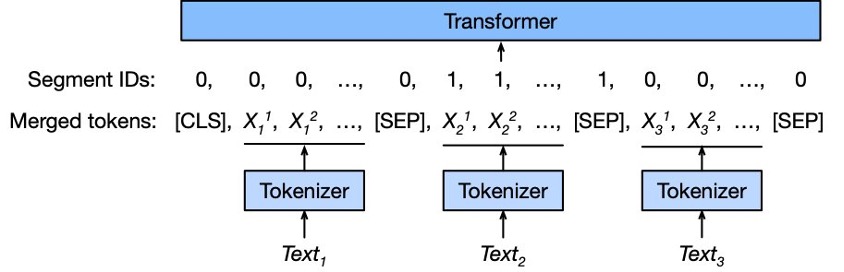

Internamente, usamos redes diferentes para codificar as colunas de texto, colunas categóricas e colunas numéricas. Os recursos gerados por redes individuais são agregados por um agregador de fusão tardia. O agregador pode gerar logits ou previsões de pontuação.

Aqui, usamos o backbone NLP pré-treinado para extrair os recursos de texto e, em seguida, usamos duas outras torres para extrair o recurso da coluna categórica e da coluna numérica.

Além disso, para lidar com vários campos de texto, separamos esses campos com o token [SEP] e alternamos 0s e 1s como IDs de segmento, conforme mostrado no diagrama a seguir.

Da mesma forma, seguimos as instruções da seção anterior para treinar e implantar o modelo de fusão multimodal AutoGluon:

A tabela a seguir resume os resultados da avaliação do modelo de fusão multimodal AutoGluon, junto com os dos três modelos que avaliamos nas seções anteriores. Podemos ver que o conjunto multimodal AutoGluon e os modelos de fusão multimodal alcançam o melhor desempenho.

| Métrica | BERT + Floresta Aleatória | BERT + Floresta Aleatória com HPO | Conjunto Multimodal AutoGluon | Fusão Multimodal AutoGluon |

| Precisão | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Observe que os resultados e o desempenho relativo entre esses modelos dependem do conjunto de dados usado para treinamento. Esses resultados são representativos e, embora a tendência de desempenho melhor de determinados algoritmos seja baseada em fatores relevantes, o equilíbrio no desempenho pode mudar devido a uma distribuição de dados diferente. Você pode substituir o conjunto de dados de exemplo por seus próprios dados para determinar qual modelo funciona melhor para você.

Caderno de demonstração

Você pode usar o notebook de demonstração para enviar dados de exemplo para endpoints de modelo já implantados. O notebook de demonstração permite que você obtenha experiência prática consultando os dados de exemplo. Depois de iniciar a solução Churn Prediction with Text, abra o notebook de demonstração escolhendo Usar endpoint no notebook.

limpar

Quando terminar esta solução, certifique-se de excluir todos os recursos indesejados da AWS escolhendo Excluir todos os recursos.

Observe que você precisa excluir manualmente quaisquer recursos adicionais que possa ter criado neste notebook.

Conclusão

Nesta postagem, mostramos como você pode usar o Sagemaker JumpStart para prever rotatividade usando multimodalidade de texto e recursos tabulares.

Se você estiver interessado em aprender mais sobre os modelos de rotatividade de clientes, confira os seguintes posts:

Sobre os autores

Dr.Xin Huang é um cientista aplicado para algoritmos integrados Amazon SageMaker JumpStart e Amazon SageMaker. Ele se concentra no desenvolvimento de algoritmos de aprendizado de máquina escaláveis. Seus interesses de pesquisa estão na área de processamento de linguagem natural, aprendizado profundo explicável em dados tabulares e análise robusta de agrupamento não paramétrico de espaço-tempo. Ele publicou muitos artigos em conferências ACL, ICDM, KDD e Royal Statistical Society: Series A journal.

Dr.Xin Huang é um cientista aplicado para algoritmos integrados Amazon SageMaker JumpStart e Amazon SageMaker. Ele se concentra no desenvolvimento de algoritmos de aprendizado de máquina escaláveis. Seus interesses de pesquisa estão na área de processamento de linguagem natural, aprendizado profundo explicável em dados tabulares e análise robusta de agrupamento não paramétrico de espaço-tempo. Ele publicou muitos artigos em conferências ACL, ICDM, KDD e Royal Statistical Society: Series A journal.

Rajakumar Sampathkumar é gerente técnico principal de contas da AWS, fornecendo orientação aos clientes sobre o alinhamento de tecnologia de negócios e apoiando a reinvenção de seus modelos e processos de operação em nuvem. Ele é apaixonado por nuvem e aprendizado de máquina. Raj também é especialista em machine learning e trabalha com clientes da AWS para projetar, implantar e gerenciar suas cargas de trabalho e arquiteturas da AWS.

Rajakumar Sampathkumar é gerente técnico principal de contas da AWS, fornecendo orientação aos clientes sobre o alinhamento de tecnologia de negócios e apoiando a reinvenção de seus modelos e processos de operação em nuvem. Ele é apaixonado por nuvem e aprendizado de máquina. Raj também é especialista em machine learning e trabalha com clientes da AWS para projetar, implantar e gerenciar suas cargas de trabalho e arquiteturas da AWS.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- Platoblockchain. Inteligência Metaverso Web3. Conhecimento Ampliado. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- Sobre

- Conta

- precisão

- preciso

- Alcançar

- aquisição de

- ativo

- Adição

- Adicional

- endereços

- Depois de

- Agente

- Agregador

- visa

- algoritmo

- algoritmos

- Todos os Produtos

- permite

- ao lado de

- Apesar

- Amazon

- Amazon EC2

- Amazon Sage Maker

- JumpStart do Amazon SageMaker

- análise

- analisar

- e

- aplicado

- abordagem

- arquitetura

- ÁREA

- artificial

- inteligência artificial

- Ativos

- Automático

- AutoML

- disponível

- AWS

- Espinha dorsal

- Equilíbrio

- Bancário

- baseado

- Porque

- MELHOR

- Melhor

- entre

- Bootstrap

- construir

- construídas em

- negócio

- comprar

- chamada

- chamada

- chamadas

- capaz

- capturar

- transportar

- casas

- casos

- Categorias

- certo

- chance

- alterar

- verificar

- Escolha

- escolha

- circunstâncias

- classificação

- mais próximo

- Na nuvem

- agrupamento

- código

- Coluna

- colunas

- combinar

- comum

- Empresas

- Empresa

- comparar

- comparado

- concorrentes

- completar

- componentes

- Computar

- conferências

- cônsul

- Recipiente

- contract

- contratos

- Correspondente

- custos

- cobrir

- crio

- criado

- cliente

- comportamento do consumidor

- Atendimento ao Cliente

- Suporte ao cliente

- Clientes

- dados,

- acordo

- lidar

- decidido

- profundo

- deep learning

- dependente

- depende

- implantar

- implantado

- Design

- detalhes

- Determinar

- em desenvolvimento

- DID

- diferente

- diretamente

- distribuir

- distribuição

- Estivador

- documento

- Não faz

- não

- download

- dinâmico

- cada

- esforços

- ou

- end-to-end

- Ponto final

- Engenharia

- avaliadas

- avaliação

- Mesmo

- exemplo

- exemplos

- existente

- vasta experiência

- explicado

- exploração

- explorar

- Explorado

- Explorando

- extrato

- extremamente

- Rosto

- enfrentou

- fatores

- Característica

- Funcionalidades

- campo

- Campos

- Figura

- Finalmente

- Encontre

- encontra

- Primeiro nome

- caber

- apropriado

- Foco

- concentra-se

- seguir

- seguinte

- floresta

- formato

- enquadramentos

- da

- função

- mais distante

- fusão

- ganhando

- gerar

- gerado

- ter

- dado

- dá

- glúon

- Objetivos

- Bom estado, com sinais de uso

- Cresça:

- garanta

- manipular

- Manipulação

- mãos em

- ajudar

- útil

- Como funciona o dobrador de carta de canal

- Como Negociar

- HTML

- HTTPS

- Hub

- Otimização de hiperparâmetros

- Ajuste de hiperparâmetros

- identificar

- imagem

- importar

- importante

- melhorar

- in

- incluído

- Incluindo

- Crescimento

- indicadores

- Individual

- INFORMAÇÕES

- Infraestrutura

- entrada

- insights

- instalar

- instância

- em vez disso

- instruções

- Integração

- Inteligência

- interesse

- interessado

- interesses

- envolvido

- questões

- IT

- Trabalho

- Empregos

- revista

- json

- Chave

- Tipo

- conhecido

- aterrissagem

- língua

- lançamento

- camadas

- aprendizagem

- Deixar

- Comprimento

- Provável

- LIMITE

- Line

- longo

- olhar

- máquina

- aprendizado de máquina

- fazer

- gerencia

- Gerente

- manualmente

- muitos

- Match

- Maximizar

- máximo

- métrico

- Métrica

- poder

- mente

- desaparecido

- ML

- modelo

- modelos

- Mês

- mês

- mais

- a maioria

- multidisciplinar

- múltiplo

- nome

- natural

- Processamento de linguagem natural

- Navegar

- Navegação

- necessariamente

- você merece...

- rede

- redes

- rede neural

- Novo

- Próximo

- PNL

- caderno

- número

- objeto

- objetivo

- oferecido

- ONE

- aberto

- operação

- ideal

- otimização

- otimizado

- original

- Outros

- delineado

- próprio

- pacotes

- pão

- papéis

- Paralelo

- parâmetro

- parte

- particular

- apaixonado

- padrão

- Realizar

- atuação

- performances

- executa

- telefone

- escolher

- Lugar

- plano

- platão

- Inteligência de Dados Platão

- PlatãoData

- Publique

- POSTAGENS

- predizer

- predição

- Previsões

- Predictor

- Preparar

- anterior

- principalmente

- Diretor

- Problema

- processo

- Processado

- processos

- em processamento

- propriedade

- fornece

- fornecendo

- publicamente

- publicado

- fins

- Python

- pytorch

- Links

- rapidamente

- acaso

- alcance

- Cru

- RE

- pronto

- regex

- regular

- relevante

- substituir

- representante

- solicitar

- requeridos

- pesquisa

- Recursos

- resposta

- responsivo

- resultar

- Resultados

- receita

- uma conta de despesas robusta

- real

- Execute

- corrida

- sábio

- Ajuste automático de modelos do SageMaker

- mesmo

- escalável

- Cientista

- scikit-learn

- Sdk

- Pesquisar

- pesquisar

- Seção

- seções

- segmento

- selecionado

- doadores,

- sentença

- Série

- Série A

- serviço

- conjunto

- Conjuntos

- vários

- rede de apoio social

- mostrar

- mostrando

- Shows

- sinais

- de forma considerável

- semelhante

- simples

- So

- Sociedade

- solução

- Soluções

- RESOLVER

- Resolvendo

- alguns

- fonte

- especialista

- específico

- especificamente

- divisão

- Sprint

- empilhado

- empilhamento

- Etapa

- padrão

- começo

- começado

- estado-da-arte

- estatístico

- estatística

- Passo

- Passos

- armazenamento

- loja

- estruturada

- estudo

- Subseqüentemente

- entraram com sucesso

- tal

- suficiente

- RESUMO

- ajuda

- Apoiar

- mesa

- Tire

- Target

- tecnologia

- Dados Técnicos:

- telecomunicações

- modelo

- modelos

- condições

- teste

- A

- A área

- A fonte

- deles

- assim sendo

- três

- para

- hoje

- token

- topo

- Total

- tradicional

- Trem

- treinado

- Training

- transformado

- verdadeiro

- tipos

- tipicamente

- para

- compreensão

- ilimitado

- não desejado

- atualização

- us

- usar

- caso de uso

- Utilizador

- geralmente

- Utilizando

- VALIDAR

- validação

- Valioso

- valor

- Valores

- variedade

- vário

- Ve

- Verizon

- versão

- via

- O Quê

- se

- qual

- QUEM

- Largo

- Ampla variedade

- precisarão

- sem

- Atividades:

- trabalho

- seria

- Errado

- X

- Vocês

- investimentos

- zefirnet