Enquanto arma de guerra, a destruição de sítios do património cultural é uma método comum por invasores armados para privar uma comunidade da sua identidade distinta. Não foi nenhuma surpresa então, em Fevereiro de 2022, quando as tropas russas invadiram a Ucrânia, que historiadores e especialistas em património cultural se prepararam para a destruição que se aproximava. Até agora, na Guerra Rússia-Ucrânia, a UNESCO confirmado danos a centenas de edifícios religiosos e históricos e dezenas de monumentos públicos, bibliotecas e museus.

Embora novas tecnologias como drones de baixo custo, impressão 3D e internet via satélite privada Embora possa estar a criar um campo de batalha distintamente do século XXI, desconhecido dos exércitos convencionais, outro conjunto de tecnologias está a criar novas possibilidades para os arquivistas cidadãos fora da linha da frente preservarem os locais do património ucraniano.

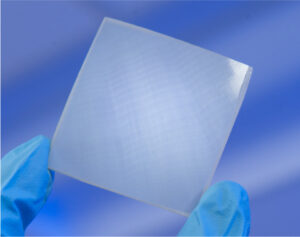

Backup Ucrânia, um projeto colaborativo entre a Comissão Nacional Dinamarquesa da UNESCO e a Polycam, uma ferramenta de criação 3D, permite que qualquer pessoa equipada apenas com um telefone digitalize e capture modelos 3D de alta qualidade, detalhados e fotorrealistas de locais históricos, algo que só é possível com recursos caros e onerosos. equipamento há apenas alguns anos.

Backup Ukraine é uma expressão notável da velocidade impressionante com que as tecnologias de captura e gráficos 3D estão progredindo, de acordo com Bilawal Sidhu, tecnólogo, investidor anjo e ex-gerente de produto do Google que trabalhou em mapas 3D e AR/VR.

“As tecnologias de captura da realidade estão numa impressionante curva exponencial de democratização”, explicou-me ele numa entrevista para Singularity Hub.

De acordo com Sidhu, a geração de ativos 3D era possível, mas apenas com ferramentas caras, como câmeras DSLR, scanners lidar e licenças de software caras. Como exemplo, ele citou o trabalho de CyArk, uma organização sem fins lucrativos fundada há duas décadas com o objetivo de usar tecnologia de captura 3D de nível profissional para preservar o patrimônio cultural em todo o mundo.

“O que é uma loucura, e o que mudou, é que hoje posso fazer tudo isso com o iPhone no bolso”, diz ele.

Na nossa discussão, Sidhu expôs três tendências tecnológicas distintas, mas inter-relacionadas, que estão impulsionando esse progresso. O primeiro é a queda no custo dos tipos de câmeras e sensores que podem capturar um objeto ou espaço. Em segundo lugar está uma cascata de novas técnicas que utilizam inteligência artificial para construir ativos 3D acabados. E o terceiro é a proliferação do poder computacional, em grande parte impulsionado por GPUs, capazes de renderizar objetos com uso intensivo de gráficos em dispositivos amplamente disponíveis aos consumidores.

Os scanners Lidar são um exemplo de melhoria de custo-desempenho em sensores. Popularizados pela primeira vez como sensores giratórios volumosos em cima de veículos autônomos, e com preço na casa dos dezenas de milhares de dólares, lidar fez sua estreia na tecnologia de consumo no iPhone 12 Pro e Pro Max em 2020. A capacidade de escanear um espaço da mesma forma que os carros sem motorista veem o mundo significou que de repente qualquer um poderia de forma rápida e barata gerar ativos 3D detalhados. Isto, no entanto, ainda estava disponível apenas para os clientes mais ricos da Apple.

Dia 254: caminhada no Parque Nacional Pinnacles e escaneando minha filha enquanto cruzávamos um pequeno riacho seco.

Capturado com o iPhone 12 Pro + @Scenario3d. Mal posso esperar para ver essas memórias em 3D daqui a 10 anos.

On @Sketchfab: https://t.co/mvxtOMhzS5#1scanadia #digitalização 3D #XR pic.twitter.com/9DX1Ltnmh8

-Emm (@emmanuel_2m) 14 de Setembro de 2021

Um dos momentos decisivos mais importantes da indústria ocorreu naquele mesmo ano, quando pesquisadores do Google introduzido campos de radiação neural, comumente chamados de NeRFs.

Essa abordagem usa aprendizado de máquina para construir um modelo 3D confiável de um objeto ou espaço a partir de imagens ou vídeos 2D. A rede neural “alucina” como uma cena 3D completa apareceria, de acordo com Sidhu. É uma solução para a “síntese de visualização”, um desafio de computação gráfica que busca permitir que alguém veja um espaço de qualquer ponto de vista a partir de apenas algumas imagens de origem.

“Então essa coisa foi lançada e todos perceberam que agora temos uma síntese de visualização de última geração que funciona brilhantemente para todas as coisas com as quais a fotogrametria tem tido dificuldades, como transparência, translucidez e refletividade. Isso é meio louco”, acrescenta.

A comunidade de visão computacional canalizou seu entusiasmo para aplicações comerciais. No Google, Sidhu e sua equipe exploraram o uso da tecnologia para visão imersiva, uma versão 3D do Google Maps. Para o usuário médio, a disseminação de aplicativos fáceis de consumir, como Luma IA e outros significavam que qualquer pessoa com apenas uma câmera de smartphone poderia criar recursos 3D fotorrealistas. A criação de conteúdo 3D de alta qualidade não estava mais limitada à elite lidar da Apple.

Agora, outro método potencialmente ainda mais promissor de resolver a síntese de visualizações está ganhando atenção, rivalizando com a excitação inicial do NeRF. Respingos gaussianos é uma técnica de renderização que imita a maneira triângulos são usados para ativos 3D tradicionais, mas em vez de triângulos, é uma “mancha” de cor expressa por meio de uma função matemática conhecida como gaussiana. À medida que mais gaussianas são colocadas juntas, um ativo 3D altamente detalhado e texturizado se torna visível. A velocidade de adoção do splatting é impressionante de se observar.

Faz apenas alguns meses, mas demos estão inundando o X, e tanto o Luma AI quanto o Polycam estão oferecendo ferramentas para gerar splats gaussianos. Outros desenvolvedores já estão trabalhando em formas de integrá-los a motores de jogos tradicionais como Unity e Unreal. Os Splats também estão ganhando a atenção da indústria tradicional de computação gráfica, pois sua velocidade de renderização é mais rápida do que os NeRFs e podem ser editados de maneiras já familiares aos artistas 3D. (Os NeRFs não permitem isso, pois são gerados por uma rede neural indecifrável.)

Para uma ótima explicação sobre como funciona o respingo gaussiano e por que está gerando buzz, veja este vídeo de Sidhu.

[Conteúdo incorporado]

Independentemente dos detalhes, para os consumidores, estamos decididamente num momento em que um telefone pode gerar recursos 3D do calibre de Hollywood que, há pouco tempo, apenas equipas de produção bem equipadas podiam produzir.

Mas por que a criação em 3D é importante?

Para avaliar a mudança em direção ao conteúdo 3D, vale a pena notar que o cenário tecnológico está se orientando para um futuro de “computação espacial”. Embora termos excessivamente usados, como metaverso, possam causar reviravoltas, o espírito subjacente é o reconhecimento de que ambientes 3D, como aqueles usados em videogames, mundos virtuais e gêmeos digitais, têm um grande papel a desempenhar em nosso futuro. Ativos 3D como os produzidos por NeRFs e splatting estão prestes a se tornar o conteúdo com o qual nos envolveremos no futuro.

Neste contexto, uma ambição em grande escala é a esperança de uma Mapa 3D do mundo. Embora estejam disponíveis ferramentas para gerar mapas estáticos em 3D, o desafio continua sendo encontrar maneiras de manter esses mapas atualizados em um mundo em constante mudança.

“Há a construção do modelo de mundo e depois a manutenção desse modelo de mundo. Com estes métodos de que estamos a falar, penso que poderemos finalmente ter a tecnologia para resolver o problema da “manutenção do modelo” através do crowdsourcing”, afirma Sidhu.

Projetos como o Immersive View do Google são bons exemplos iniciais das implicações disso para o consumidor. Embora ele não especule quando isso será possível, Sidhu concordou que, em algum momento, existirá a tecnologia que permitirá que um usuário em VR ande por qualquer lugar da Terra com uma experiência imersiva e em tempo real do que está acontecendo lá. . Este tipo de tecnologia também se traduzirá em esforços em “teletransporte baseado em avatar”, reuniões remotas e outras reuniões sociais.

Outro motivo de entusiasmo, diz Sidhu, é a captura de memória 3D. A Apple, por exemplo, está apostando fortemente em Foto e vídeo 3D para seu headset de realidade mista Vision Pro. Por exemplo, Sidhu me contou que recentemente criou uma réplica de alta qualidade da casa de seus pais antes de eles se mudarem. Ele poderia então dar-lhes a experiência de entrar nele usando realidade virtual.

“Ter aquela sensação visceral de estar de volta é muito poderoso. É por isso que estou tão otimista em relação à Apple, porque se eles acertarem nesse formato de mídia 3D, é aí que as coisas podem ficar emocionantes para as pessoas comuns.”

estou convencido de que o caso de uso matador para tecnologia de reconstrução 3D é a captura de memória

meus pais se aposentaram no início deste ano e eu imortalizei a casa deles para sempre

a digitalização de fotos é legítima, o meio mais preparado para o futuro ao qual temos acesso hoje

escaneie todos os espaços/lugares/coisas pic.twitter.com/kmqX5FYaN6

- Bilawal Sidhu (@bilawalsidhu) 3 de novembro de 2023

Da arte rupestre às pinturas a óleo, o impulso para preservar aspectos da nossa experiência sensorial é profundamente humano. Assim como a fotografia já foi aplicada em naturezas mortas como meio de preservação, as ferramentas de criação em 3D parecem preparadas para substituir nosso caso de longa data com imagens e vídeos em 2D.

No entanto, tal como a fotografia só pode esperar capturar uma fração de momento no tempo, os modelos 3D não podem substituir totalmente a nossa relação com o mundo físico. Ainda assim, para aqueles que vivenciam os horrores da guerra na Ucrânia, talvez estes sejam desenvolvimentos bem-vindos, oferecendo uma forma mais envolvente de preservar o que nunca poderá ser verdadeiramente substituído.

Crédito de imagem: Wim Torbeyns / Unsplash

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://singularityhub.com/2023/11/06/a-revolution-in-computer-graphics-is-bringing-3d-reality-capture-to-the-masses/

- :tem

- :é

- :não

- :onde

- 10

- 12

- 14

- 2020

- 2022

- 21st

- 2D

- 3d

- 9

- a

- habilidade

- Sobre

- Acesso

- Segundo

- Adiciona

- Adoção

- atrás

- concordaram

- AI

- visar

- Todos os Produtos

- permitir

- já

- tb

- ambição

- an

- e

- Anjo

- Outro

- qualquer

- qualquer um

- qualquer lugar

- aparecer

- Apple

- aplicações

- apreciar

- abordagem

- AR / VR

- SOMOS

- armado

- por aí

- Arte

- artificial

- inteligência artificial

- Artistas

- AS

- aspectos

- ativo

- Ativos

- At

- por WhatsApp.

- Autônomo

- veículos autônomos

- disponível

- média

- em caminho duplo

- Battlefield

- BE

- Porque

- tornam-se

- torna-se

- sido

- antes

- ser

- entre

- Grande

- ambos

- Trazendo

- Prédio

- Bullish

- mas a

- by

- veio

- Câmera

- câmeras

- CAN

- Pode obter

- capaz

- capturar

- carros

- cachoeiras

- casas

- caverna

- Century

- desafiar

- mudado

- citado

- cidadão

- colaborativo

- cor

- vinda

- comercial

- de referência

- geralmente

- comunidade

- computador

- Visão de Computador

- computação

- poder de computação

- consequencial

- construir

- consumidor

- Consumidores

- conteúdo

- contexto

- convencional

- convencido

- Custo

- poderia

- louco

- criado

- Criar

- criação

- credível

- crédito

- Enseada

- cruzado

- Crowdsourcing

- cultural

- Atual

- curva

- Clientes

- dano

- dinamarquês

- estréia

- décadas

- democratização

- detalhado

- detalhes

- desenvolvedores

- desenvolvimentos

- Dispositivos/Instrumentos

- digital

- Gêmeos digitais

- discussão

- distinto

- distintamente

- do

- parece

- não

- dezenas

- desenhar

- dirigido

- condução

- Cair

- secar

- Mais cedo

- Cedo

- Ganhando

- terra

- Economista

- esforços

- incorporado

- permite

- engajar

- Motores

- ambientes

- equipamento

- equipado

- Mesmo

- eventualmente

- SEMPRE

- em constante mudança

- todos

- exemplo

- exemplos

- animado

- Excitação

- emocionante

- existir

- caro

- vasta experiência

- experimentando

- explicado

- explicação

- Explorado

- exponencial

- expressa

- expressão

- olho

- familiar

- longe

- mais rápido

- Fevereiro

- poucos

- Campos

- Finalmente

- descoberta

- Primeiro nome

- Escolha

- Para os consumidores

- para sempre

- formato

- Antigo

- Fundado

- fração

- da

- cheio

- totalmente

- função

- futuro

- ganhando

- jogo

- Games

- reuniões

- gerar

- gerado

- gerando

- ter

- OFERTE

- dado

- Bom estado, com sinais de uso

- Google Maps

- tem

- GPUs

- grau

- gráficos

- ótimo

- tinha

- Acontecimento

- Queijos duros

- Ter

- he

- fone

- fortemente

- herança

- alta qualidade

- altamente

- sua

- histórico

- Início

- esperança

- House

- Como funciona o dobrador de carta de canal

- Contudo

- HTTPS

- humano

- Centenas

- i

- Identidade

- if

- imagens

- imersiva

- implicações

- melhoria

- in

- indústria

- da indústria

- INSANO

- dentro

- em vez disso

- Integração

- Inteligência

- Entrevista

- para dentro

- investidor

- iPhone

- IT

- ESTÁ

- apenas por

- manutenção

- Tipo

- conhecido

- paisagem

- em grande escala

- largamente

- em camadas

- aprendizagem

- Legit

- bibliotecas

- licenças

- como

- Limitado

- longo

- de longa data

- mais

- máquina

- aprendizado de máquina

- moldadas

- Manter

- fazer

- Gerente

- mapa,

- mapas

- massas

- matemático

- Importância

- max

- Posso..

- me

- significa

- significava

- Mídia

- média

- reuniões

- Memórias

- Memória

- metaverso

- método

- métodos

- poder

- misto

- realidade mista

- modelo

- modelos

- momento

- mês

- monumentos

- mais

- a maioria

- movido

- Museus

- my

- Nacional

- Parque Nacional

- Nerf

- líquido

- rede

- neural

- rede neural

- nunca

- Novo

- Novas tecnologias

- não

- sem fins lucrativos,

- notável

- notando

- agora

- objeto

- objetos

- ocorreu

- of

- WOW!

- oferecendo treinamento para distância

- AZEITE E AZEITE EVO

- on

- uma vez

- queridos

- só

- or

- Outros

- Outros

- A Nossa

- Fora

- pinturas

- pais

- Park

- parlamento

- Pessoas

- possivelmente

- telefone

- foto

- fotografia

- Fotorrealista

- físico

- FOTOS

- platão

- Inteligência de Dados Platão

- PlatãoData

- Jogar

- jogador

- ponto

- Ponto de vista

- pontos

- equilibrado

- possibilidades

- possível

- potencialmente

- poder

- poderoso

- preservação

- Pro

- Problema

- produzir

- Produzido

- Produto

- gerente de produto

- Produção

- profissional

- Progresso

- progredindo

- projeto

- promissor

- prova

- público

- rapidamente

- em tempo real

- Realidade

- realizado

- razão

- recentemente

- reconhecimento

- a que se refere

- regular

- relacionamento

- permanece

- remoto

- representação

- substituir

- substituído

- responder

- pesquisadores

- Revolução

- Tipo

- rolos

- Guerra Rússia-Ucrânia

- russo

- mesmo

- satélite

- diz

- digitalização

- exploração

- cena

- Segundo

- Vejo

- busca

- parecem

- sensor

- conjunto

- mudança

- desde

- Locais

- pequeno

- smartphones

- So

- até aqui

- Redes Sociais

- Software

- solução

- RESOLVER

- Resolvendo

- alguns

- Alguém

- algo

- fonte

- Espaço

- especialistas

- velocidade

- espírito

- propagação

- desconcertante

- estado-da-arte

- Ainda

- Assombroso

- surpresa

- síntese

- falando

- Profissionais

- equipes

- tecnologia

- técnica

- técnicas

- Tecnologias

- tecnólogo

- Tecnologia

- condições

- do que

- que

- A

- O Futuro

- o metaverso

- o mundo

- deles

- Eles

- então

- Lá.

- Este

- deles

- coisa

- coisas

- think

- Terceiro

- isto

- este ano

- aqueles

- milhares

- três

- Através da

- tempo

- para

- hoje

- juntos

- disse

- ferramenta

- ferramentas

- topo

- para

- tradicional

- Transparência

- Tendências

- verdadeiramente

- Passando

- Twins

- dois

- tipo

- Ucrânia

- Ucraniano

- subjacente

- desconhecido

- unidade

- Irreal

- usar

- caso de uso

- usava

- Utilizador

- usos

- utilização

- Veículos

- versão

- Vídeo

- jogos de vídeo

- Ver

- Virtual

- A realidade virtual

- mundos virtuais

- visível

- visão

- vr

- esperar

- andar

- caminhada

- guerra

- Guerra na Ucrânia

- foi

- Assistir

- Caminho..

- maneiras

- we

- boas-vindas

- O Quê

- O que é a

- quando

- qual

- enquanto

- QUEM

- porque

- largamente

- precisarão

- de

- Atividades:

- trabalhou

- trabalhar

- trabalho

- mundo

- do mundo

- Equivalente há

- seria

- X

- ano

- anos

- ainda

- investimentos

- Youtube

- zefirnet