Inteligência artificial gerativa (IA generativa) os modelos demonstraram capacidades impressionantes na geração de textos, imagens e outros conteúdos de alta qualidade. No entanto, esses modelos exigem grandes quantidades de dados de treinamento limpos e estruturados para atingir todo o seu potencial. A maioria dos dados do mundo real existe em formatos não estruturados como PDFs, o que requer pré-processamento antes de poder ser usado de forma eficaz.

De acordo com o IDC, os dados não estruturados representam mais de 80% de todos os dados de negócios atualmente. Isso inclui formatos como e-mails, PDFs, documentos digitalizados, imagens, áudio, vídeo e muito mais. Embora esses dados contenham informações valiosas, sua natureza não estruturada torna difícil para os algoritmos de IA interpretá-los e aprender com eles. De acordo com um Pesquisa de 2019 da Deloitte, apenas 18% das empresas relataram ser capazes de tirar proveito de dados não estruturados.

À medida que a adoção da IA continua a acelerar, o desenvolvimento de mecanismos eficientes para digerir e aprender a partir de dados não estruturados torna-se ainda mais crítico no futuro. Isto poderia envolver melhores ferramentas de pré-processamento, técnicas de aprendizagem semissupervisionadas e avanços no processamento de linguagem natural. As empresas que utilizam os seus dados não estruturados de forma mais eficaz obterão vantagens competitivas significativas com a IA. Dados limpos são importantes para um bom desempenho do modelo. Os textos extraídos ainda contêm grandes quantidades de texto sem sentido e clichê (por exemplo, leitura de HTML). Os dados extraídos da Internet geralmente contêm muitas duplicações. Dados de mídias sociais, avaliações ou qualquer conteúdo gerado por usuários também podem conter conteúdos tóxicos e tendenciosos, e pode ser necessário filtrá-los usando algumas etapas de pré-processamento. Também pode haver muitos conteúdos de baixa qualidade ou textos gerados por bots, que podem ser filtrados usando metadados que os acompanham (por exemplo, filtrar respostas de atendimento ao cliente que receberam classificações baixas dos clientes).

A preparação de dados é importante em vários estágios da Geração Aumentada de Recuperação (RAG) modelos. Os documentos fonte de conhecimento precisam de pré-processamento, como limpeza de texto e geração de incorporações semânticas, para que possam ser indexados e recuperados com eficiência. A consulta em linguagem natural do usuário também requer pré-processamento, para que possa ser codificada em um vetor e comparada com incorporações de documentos. Depois de recuperar contextos relevantes, eles podem precisar de pré-processamento adicional, como truncamento, antes de serem concatenados à consulta do usuário para criar o prompt final para o modelo base. Tela do Amazon SageMaker agora oferece suporte a recursos abrangentes de preparação de dados fornecidos por Gerenciador de dados do Amazon SageMaker. Com essa integração, o SageMaker Canvas oferece aos clientes um espaço de trabalho sem código de ponta a ponta para preparar dados, construir e usar ML e modelos básicos para acelerar o tempo entre os dados e os insights de negócios. Agora você pode descobrir e agregar facilmente dados de mais de 50 fontes de dados e explorar e preparar dados usando mais de 300 análises e transformações integradas na interface visual do SageMaker Canvas.

Visão geral da solução

Nesta postagem, trabalhamos com um conjunto de dados de documentação em PDF—Rocha Amazônica guia de utilizador.. Além disso, mostramos como pré-processar um conjunto de dados para RAG. Especificamente, limpamos os dados e criamos artefatos RAG para responder às perguntas sobre o conteúdo do conjunto de dados. Considere o seguinte problema de aprendizado de máquina (ML): o usuário faz uma pergunta sobre um modelo de linguagem grande (LLM): “Como filtrar e pesquisar modelos no Amazon Bedrock?”. O LLM não viu a documentação durante a fase de treinamento ou ajuste fino, portanto, não seria capaz de responder à pergunta e muito provavelmente terá alucinações. Nosso objetivo com esta postagem é encontrar um trecho de texto relevante do PDF (ou seja, RAG) e anexá-lo ao prompt, permitindo assim que o LLM responda a perguntas específicas deste documento.

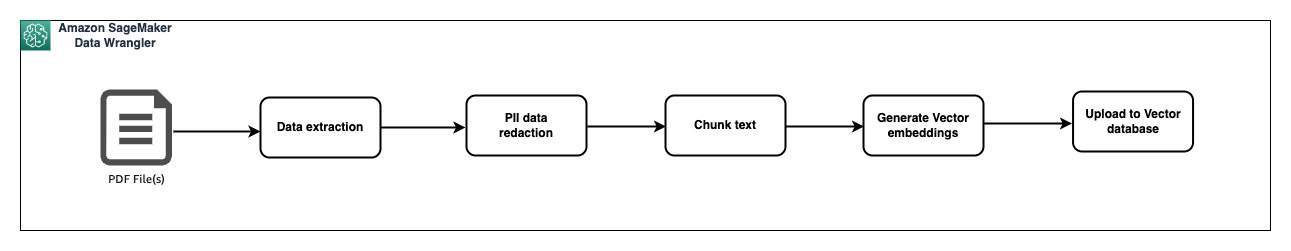

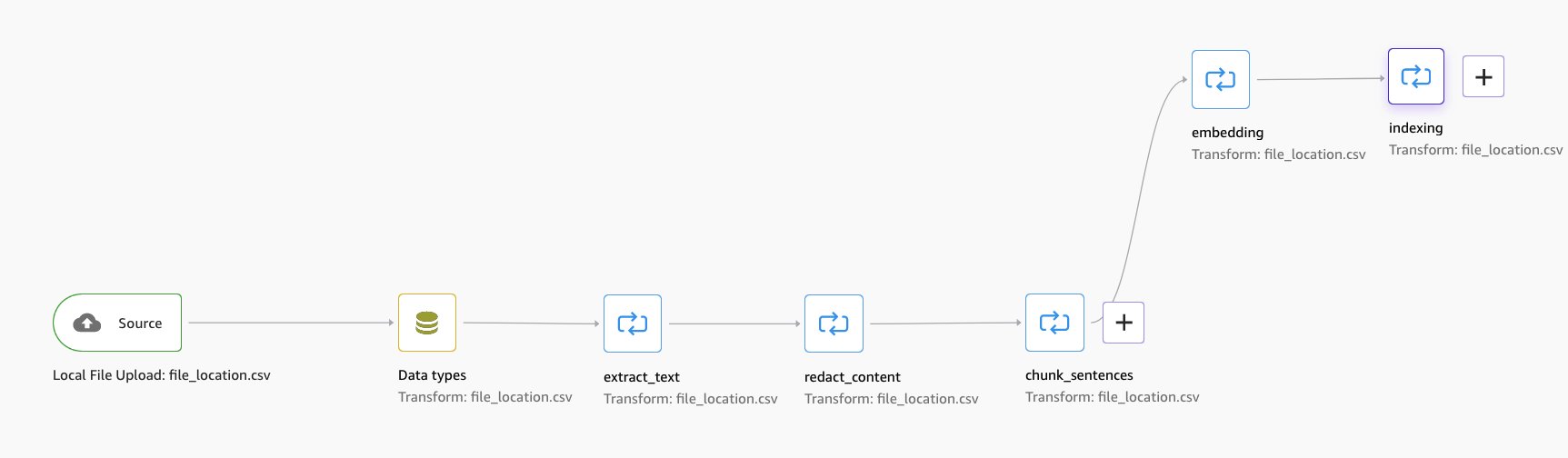

Abaixo, mostramos como você pode executar todas essas etapas principais de pré-processamento a partir de Tela do Amazon SageMaker (alimentado por Gerenciador de dados do Amazon SageMaker):

- Extraindo texto de um documento PDF (desenvolvido por Textract)

- Remova informações confidenciais (desenvolvido por Comprehend)

- Divida o texto em pedaços.

- Crie embutimentos para cada peça (desenvolvido pela Bedrock).

- Carregar incorporação em um banco de dados vetorial (desenvolvido por OpenSearch)

Pré-requisitos

Para este passo a passo, você deve ter o seguinte:

Note: Crie domínios do OpenSearch Service seguindo as instruções SUA PARTICIPAÇÃO FAZ A DIFERENÇA. Para simplificar, vamos escolher a opção com nome de usuário e senha mestres para controle de acesso refinado. Depois que o domínio for criado, crie um índice vetorial com os seguintes mapeamentos e a dimensão vetorial 1536 se alinhe com os embeddings do Amazon Titan:

Passo a passo

Crie um fluxo de dados

Nesta seção, abordamos como podemos construir um fluxo de dados para extrair texto e metadados de PDFs, limpar e processar os dados, gerar embeddings usando o Amazon Bedrock e indexar os dados no Amazon OpenSearch.

Inicie o SageMaker Canvas

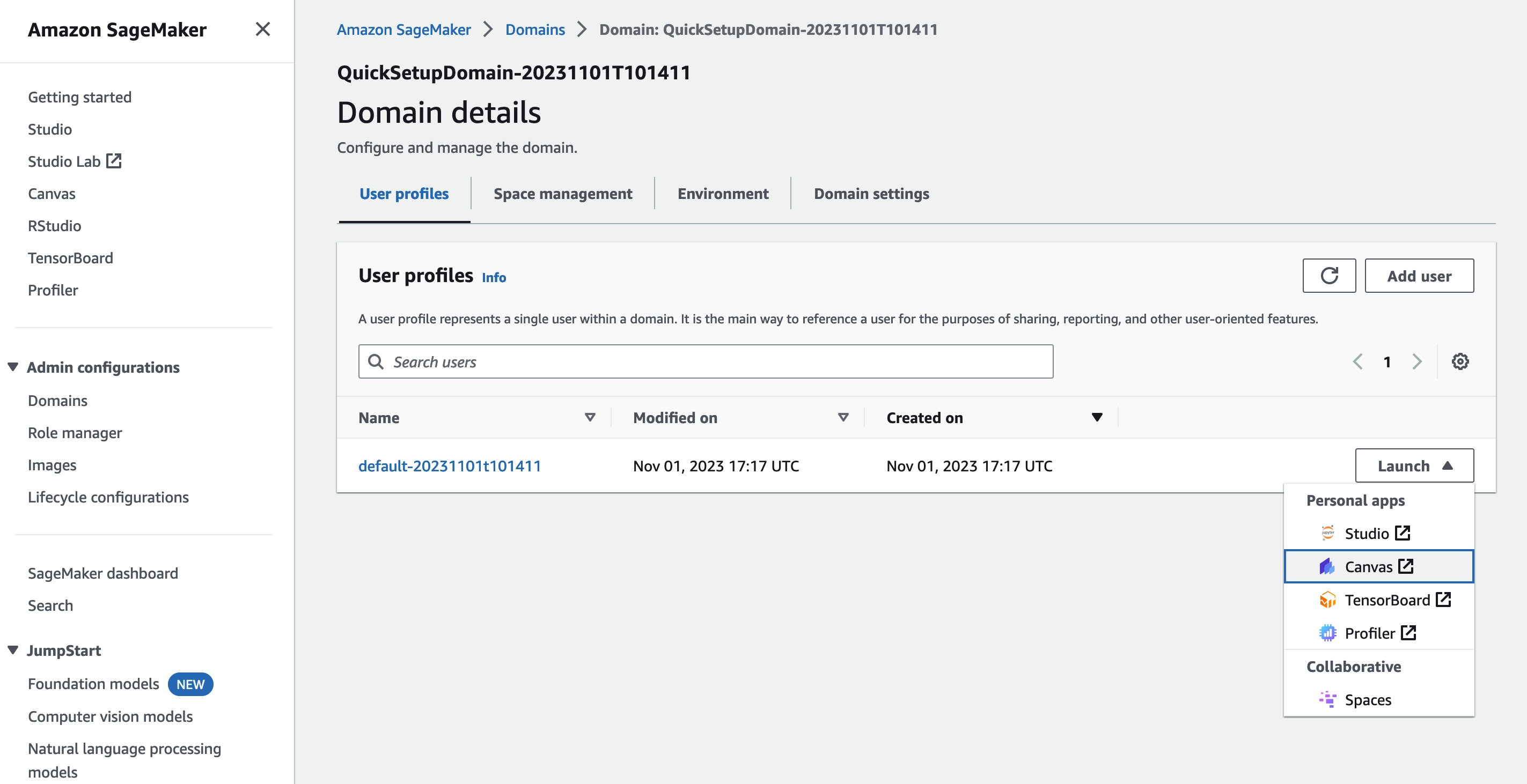

Para iniciar o SageMaker Canvas, execute as seguintes etapas:

- Na amazônia Console do SageMaker, escolha domínios no painel de navegação.

- Escolha seu domínio.

- No menu de inicialização, escolha Quadros.

Crie um fluxo de dados

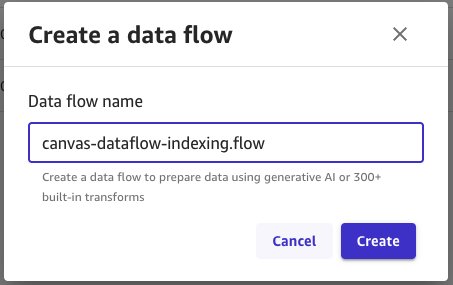

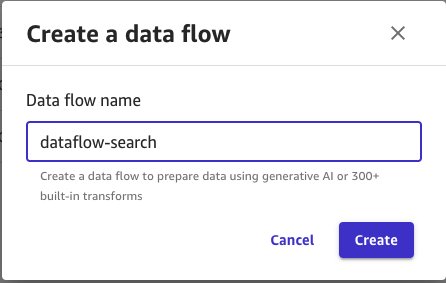

Conclua as etapas a seguir para criar um fluxo de dados no SageMaker Canvas:

- Na página inicial do SageMaker Canvas, escolha Organizador de dados.

- Escolha Crie no lado direito da página, forneça um nome de fluxo de dados e selecione Crie.

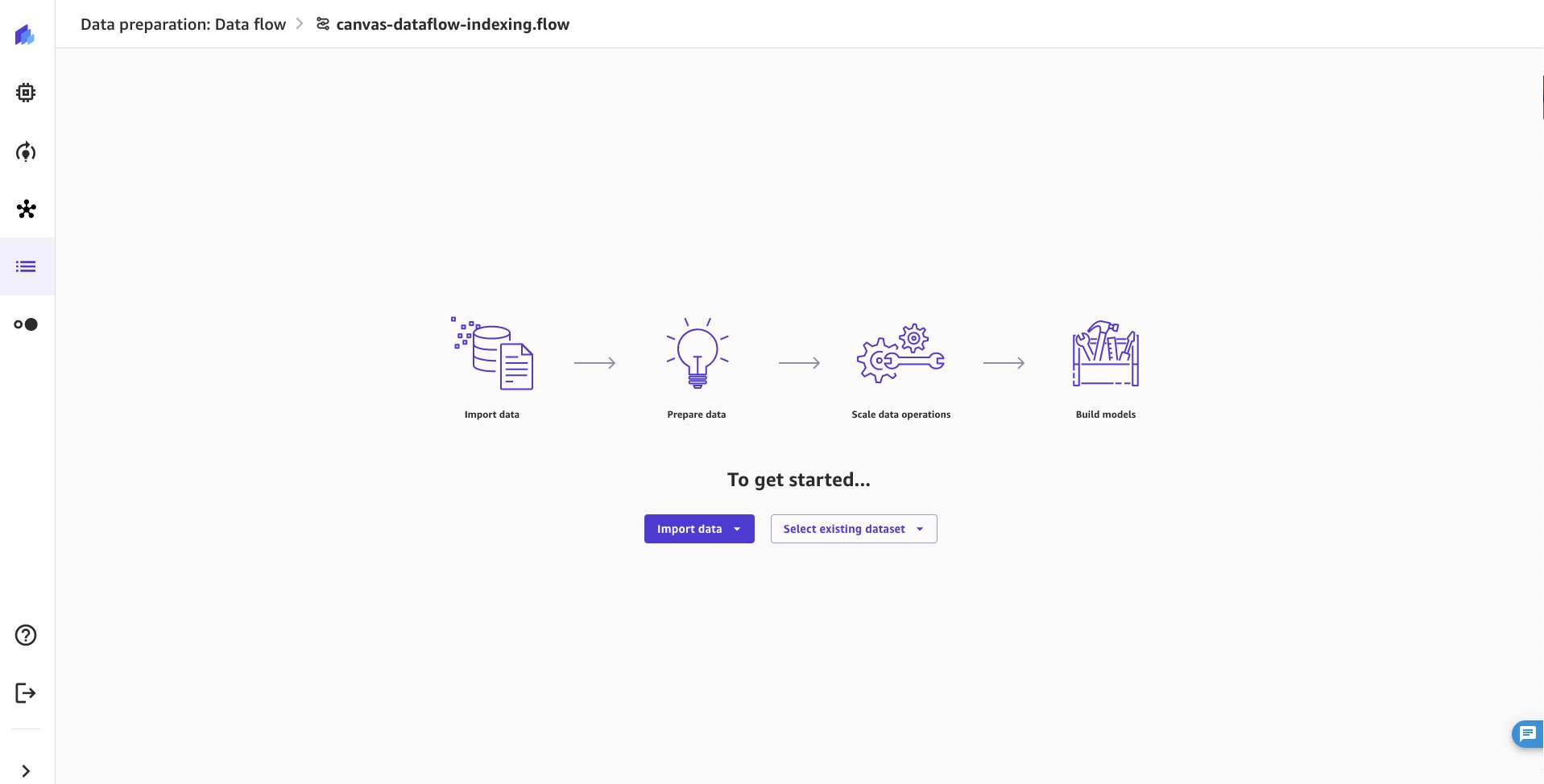

- Isso chegará a uma página de fluxo de dados.

- Escolha Datas de importação, selecione dados tabulares.

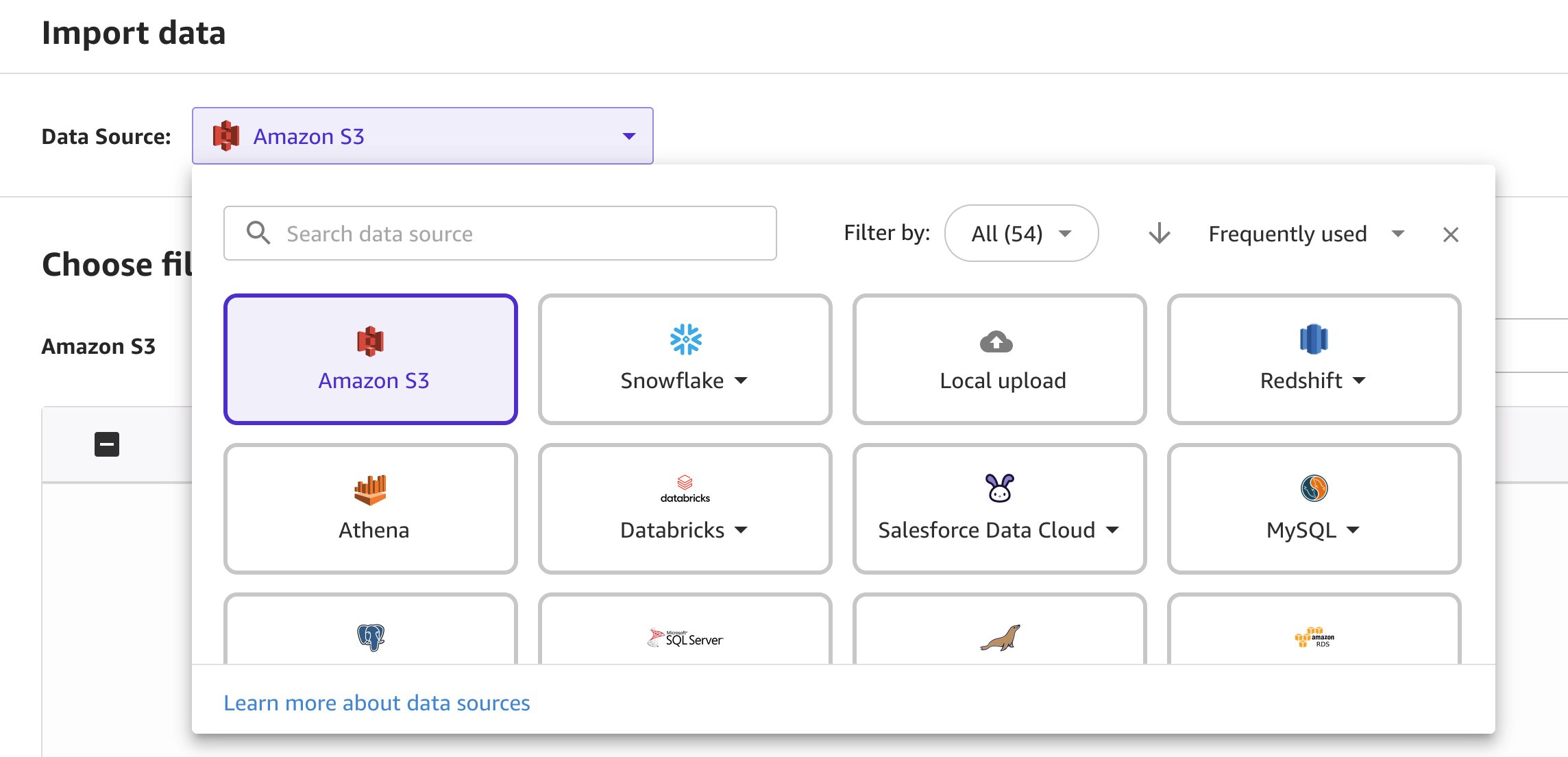

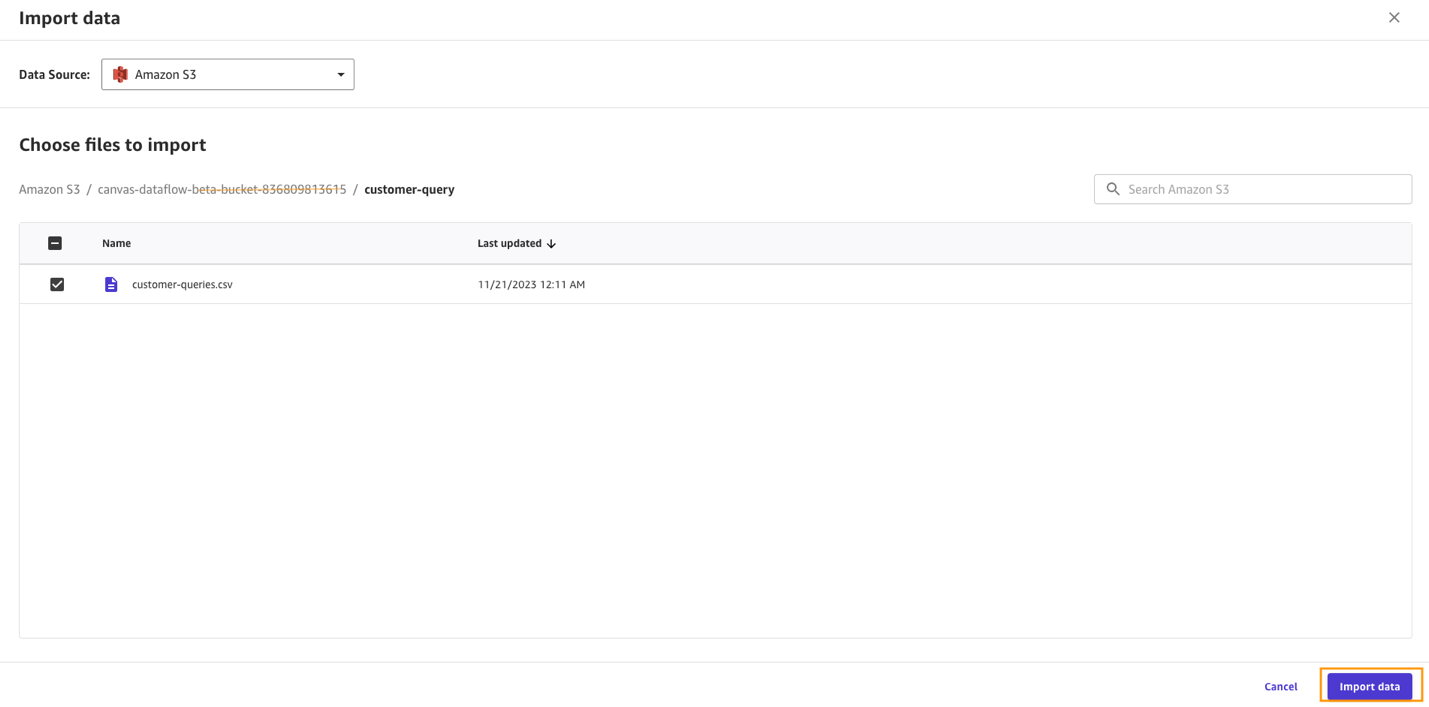

Agora vamos importar os dados do bucket Amazon S3:

- Escolha Datas de importação e selecione Tabular na lista suspensa.

- Fonte de dados e selecione Amazon S3 na lista suspensa.

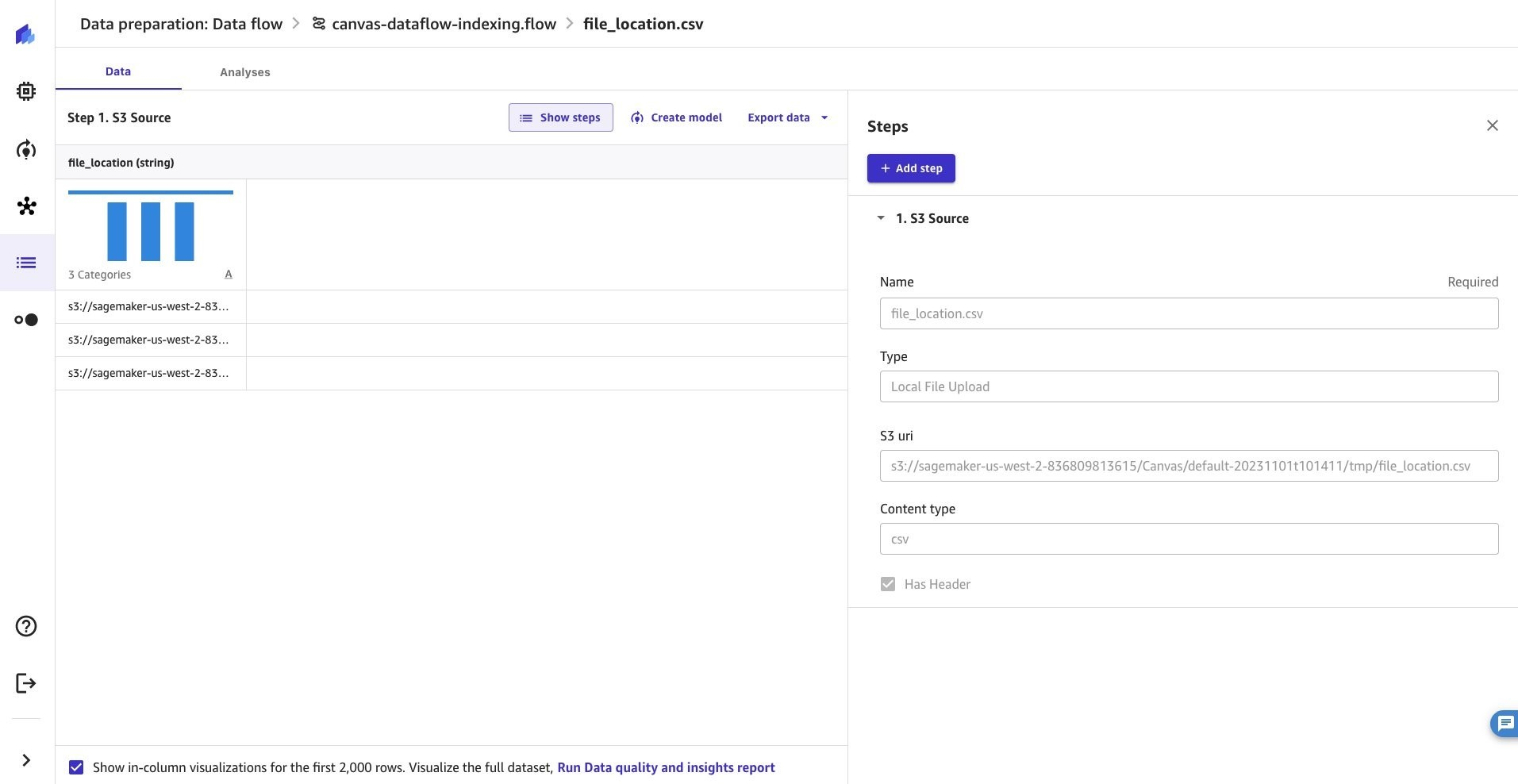

- Navegue até o arquivo de metadados com os locais dos arquivos PDF e escolha o arquivo.

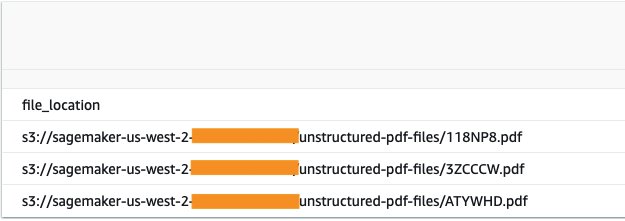

- Agora o arquivo de metadados é carregado no fluxo de dados de preparação de dados e podemos prosseguir para adicionar as próximas etapas para transformar os dados e o índice na Amazon Opensearch. Neste caso o arquivo possui os seguintes metadados, com a localização de cada arquivo no diretório Amazon S3.

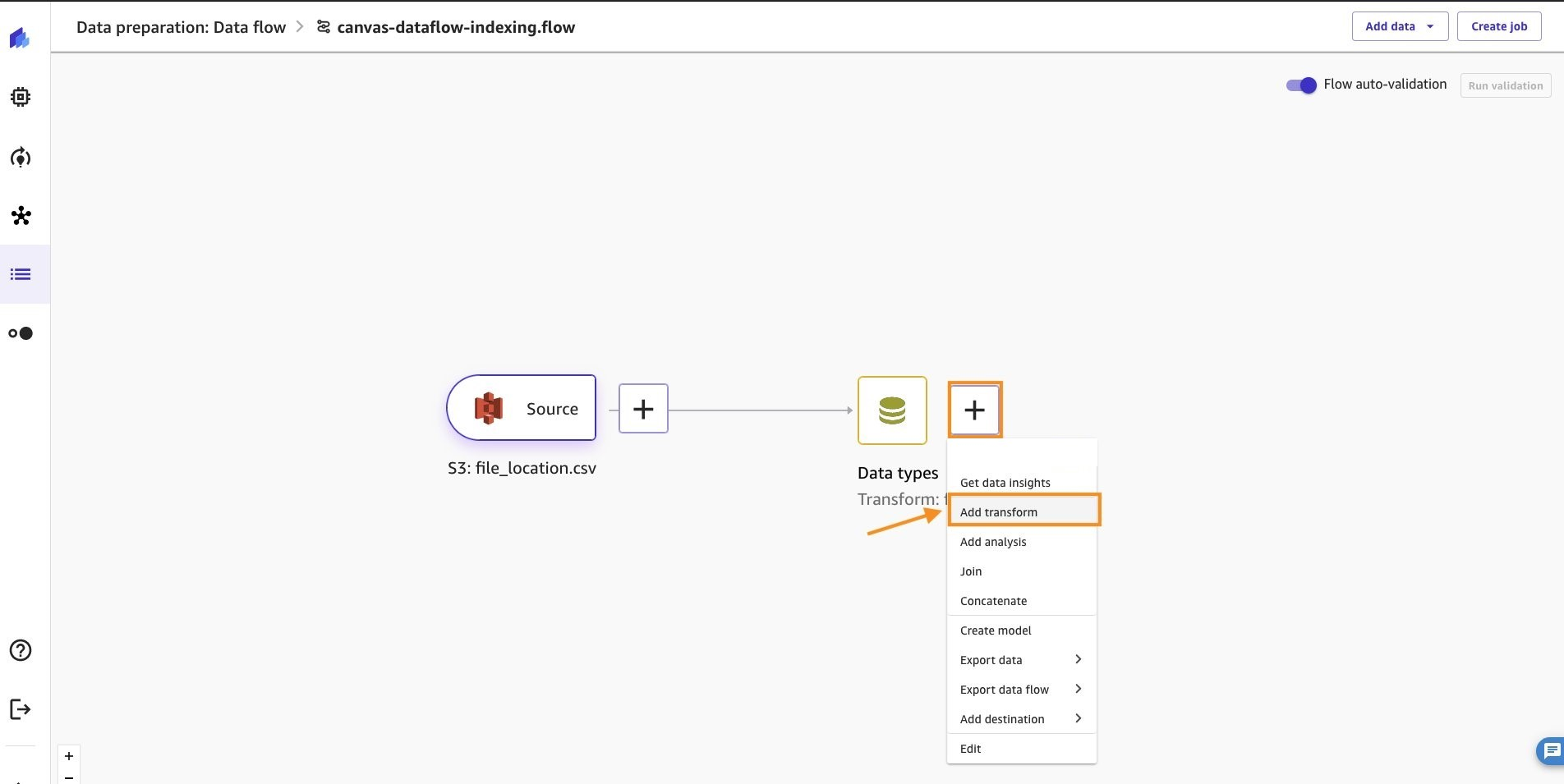

Para adicionar uma nova transformação, conclua as seguintes etapas:

- Escolha o sinal de mais e escolha Adicionar transformação.

- Escolha Adicionar Etapa e escolha Transformação personalizada.

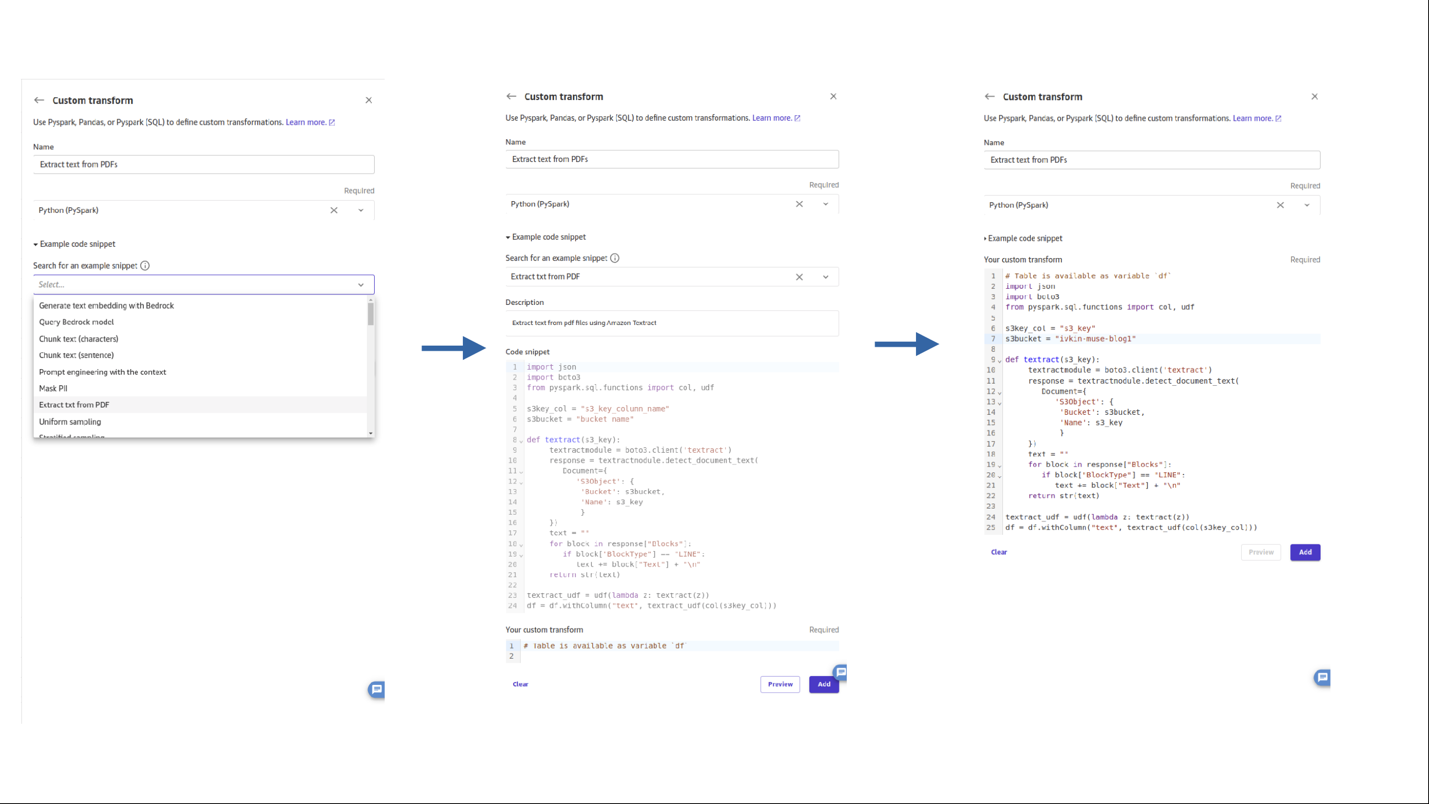

- Você pode criar uma transformação personalizada usando Pandas, PySpark, funções definidas pelo usuário Python e SQL PySpark. Escolher Python (PySpark) para este caso de uso.

- Insira um nome para a etapa. Nos trechos de código de exemplo, navegue e selecione extrair texto de pdf. Faça as alterações necessárias no snippet de código e selecione Adicionar.

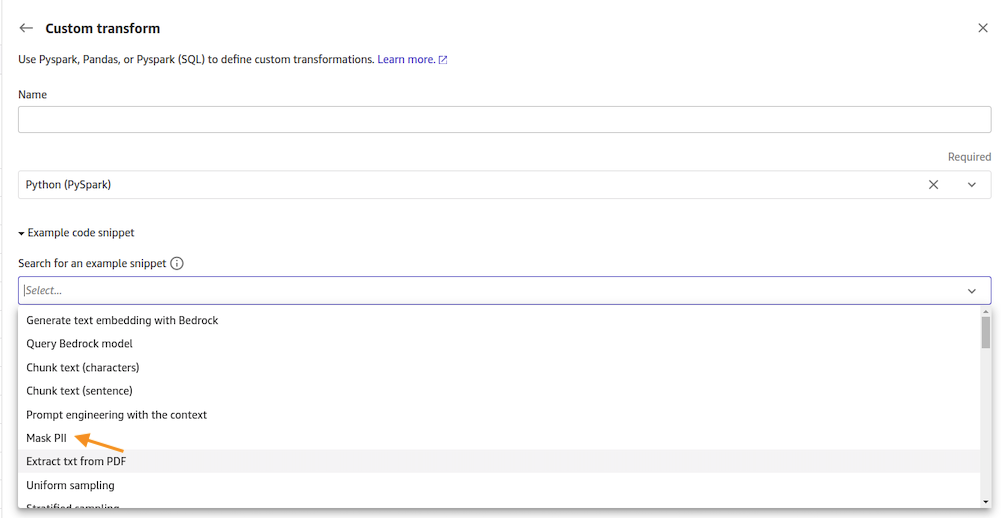

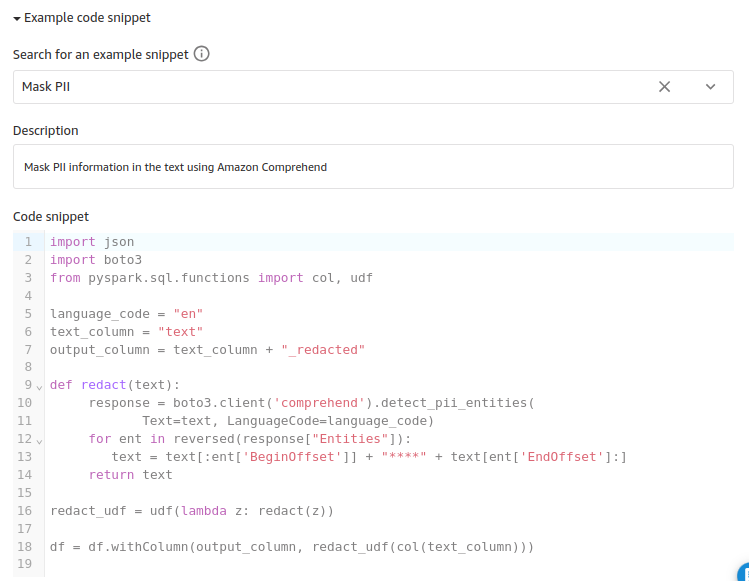

- Vamos adicionar uma etapa para redigir dados de informações de identificação pessoal (PII) dos dados extraídos, aproveitando Amazon Comprehend. Escolher Adicionar Etapa e escolha Transformação personalizada. E selecione Python (PySpark).

Nos trechos de código de exemplo, navegue e selecione máscara PII. Faça as alterações necessárias no snippet de código e selecione Adicionar.

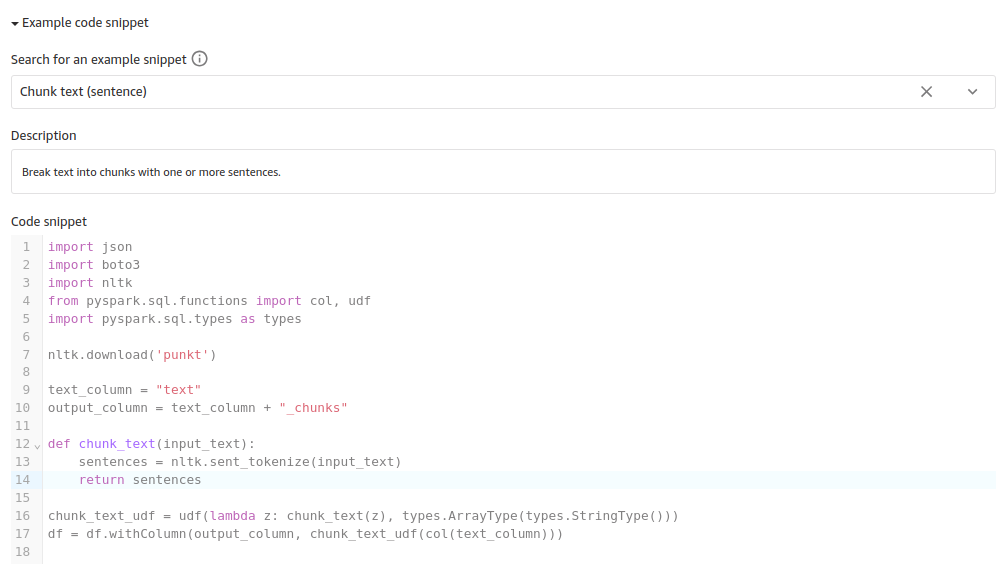

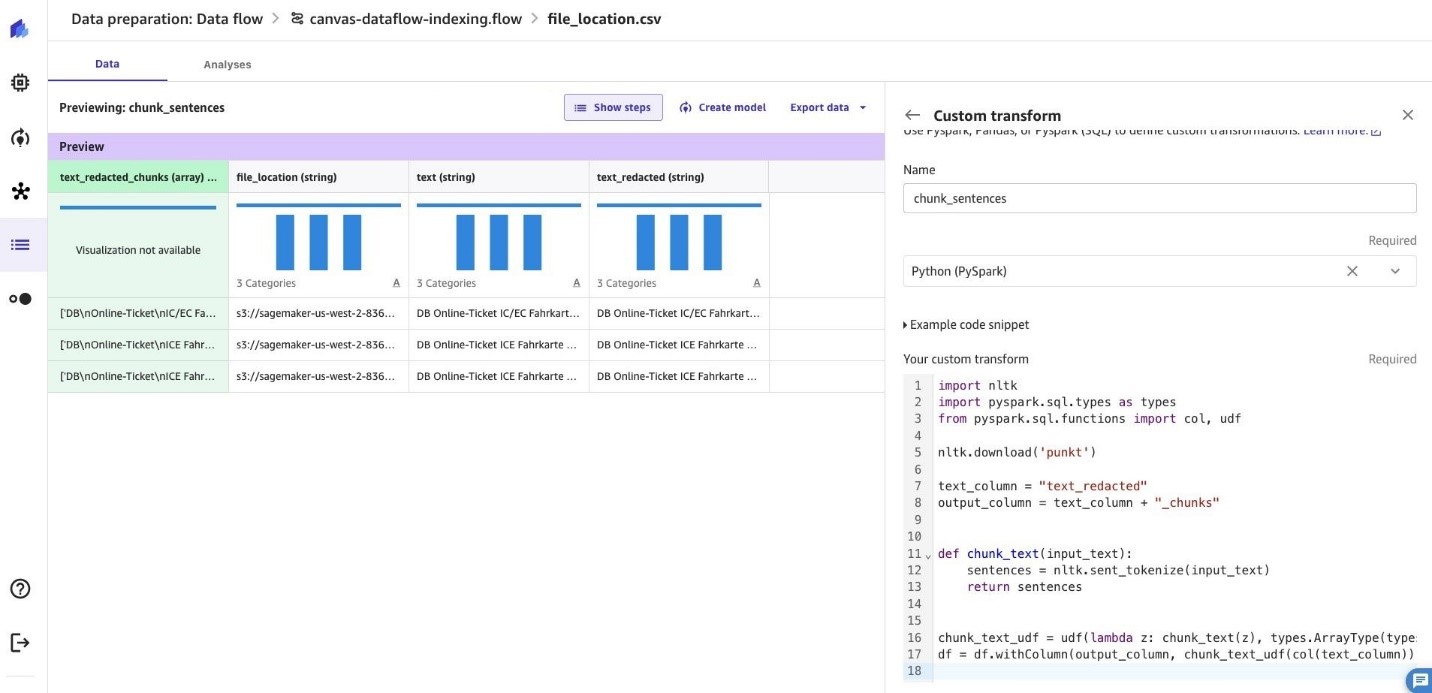

- A próxima etapa é fragmentar o conteúdo do texto. Escolher Adicionar Etapa e escolha Transformação personalizada. E selecione Python (PySpark).

Nos trechos de código de exemplo, navegue e selecione Texto em pedaços. Faça as alterações necessárias no snippet de código e selecione Adicionar.

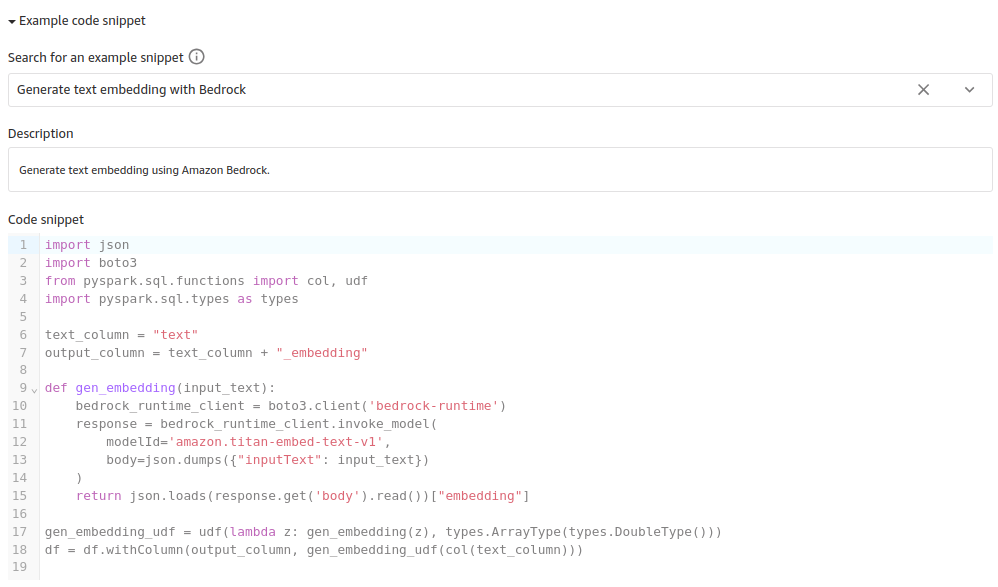

- Vamos converter o conteúdo do texto em incorporações vetoriais usando o Rocha Amazônica Modelo Titan Embeddings. Escolher Adicionar Etapa e escolha Transformação personalizada. E selecione Python (PySpark).

Nos trechos de código de exemplo, navegue e selecione Gere incorporação de texto com Bedrock. Faça as alterações necessárias no snippet de código e selecione Adicionar.

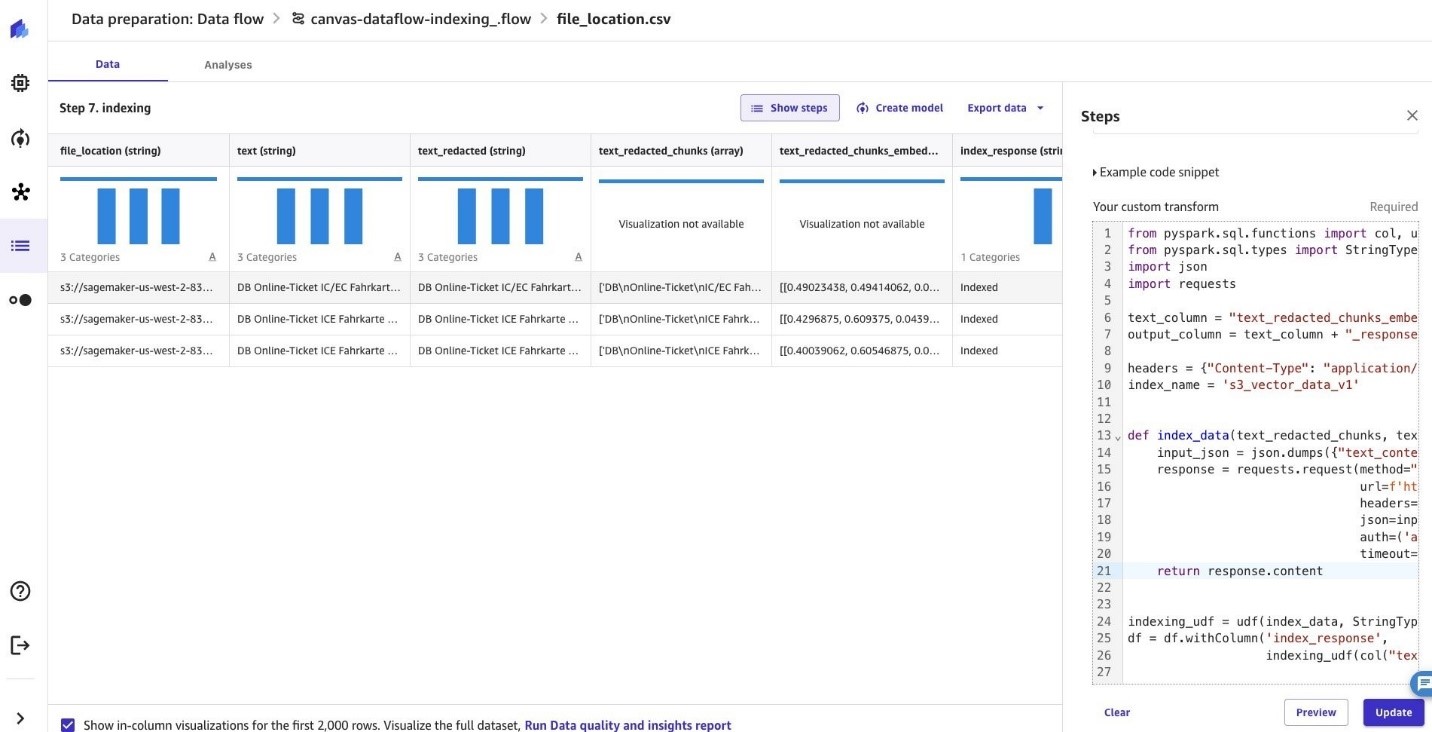

- Agora temos incorporações vetoriais disponíveis para o conteúdo do arquivo PDF. Vamos indexar os dados no Amazon OpenSearch. Escolher Adicionar Etapa e escolha Transformação personalizada. E selecione Python (PySpark). Você está livre para reescrever o código a seguir para usar seu banco de dados vetorial preferido. Para simplificar, estamos usando nome de usuário e senha mestres para acessar APIs OpenSearch, para cargas de trabalho de produção, selecione a opção de acordo com as políticas da sua organização.

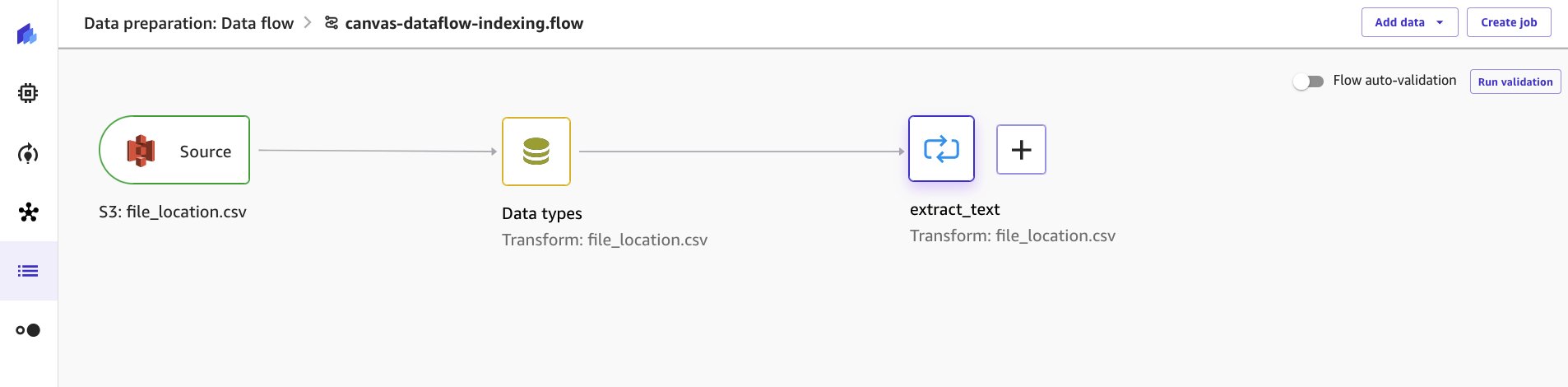

Por fim, o fluxo de dados criado seria o seguinte:

Com esse fluxo de dados, os dados do arquivo PDF foram lidos e indexados com incorporações de vetores no Amazon OpenSearch. Agora é hora de criarmos um arquivo com consultas para consultar os dados indexados e salvá-los no local do Amazon S3. Apontaremos nosso fluxo de dados de pesquisa para o arquivo e geraremos um arquivo com os resultados correspondentes em um novo arquivo em um local do Amazon S3.

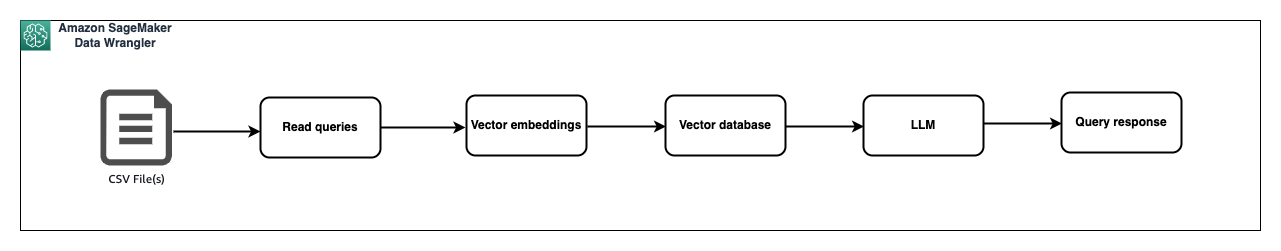

Preparando um prompt

Depois de criarmos uma base de conhecimento a partir de nosso PDF, podemos testá-la pesquisando na base de conhecimento alguns exemplos de consultas. Processaremos cada consulta da seguinte maneira:

- Gere incorporação para a consulta (desenvolvido pela Amazon Bedrock)

- Consultar banco de dados de vetores para o contexto do vizinho mais próximo (desenvolvido pelo Amazon OpenSearch)

- Combine a consulta e o contexto no prompt.

- Consulte o LLM com um prompt (desenvolvido pela Amazon Bedrock)

- Na página inicial do SageMaker Canvas, escolha Preparação de dados.

- Escolha Crie no lado direito da página, forneça um nome de fluxo de dados e selecione Crie.

Agora vamos carregar as perguntas do usuário e criar um prompt combinando a pergunta e os documentos semelhantes. Este prompt é fornecido ao LLM para gerar uma resposta à pergunta do usuário.

- Vamos carregar um arquivo csv com as perguntas do usuário. Escolher Importar dados e selecione Tabular na lista suspensa.

- Fonte de dados, e selecione Amazon S3 na lista suspensa. Como alternativa, você pode optar por fazer upload de um arquivo com as consultas do usuário.

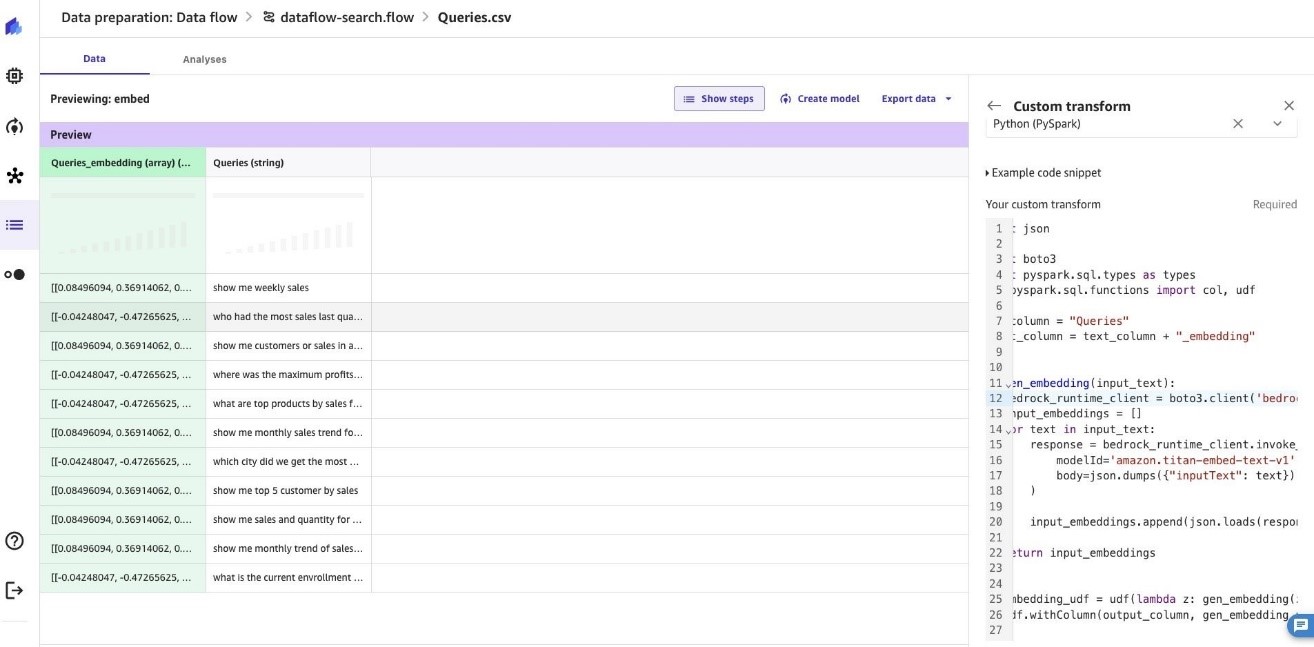

- Vamos adicionar uma transformação personalizada para converter os dados em embeddings vetoriais, seguida de pesquisar embeddings relacionados no Amazon OpenSearch, antes de enviar um prompt ao Amazon Bedrock com a consulta e o contexto da base de conhecimento. Para gerar embeddings para a consulta, você pode usar o mesmo trecho de código de exemplo Gere incorporação de texto com Bedrock mencionado na Etapa 7 acima.

Vamos invocar a API Amazon OpenSearch para pesquisar documentos relevantes para os embeddings de vetores gerados. Adicione uma transformação personalizada com Python (PySpark).

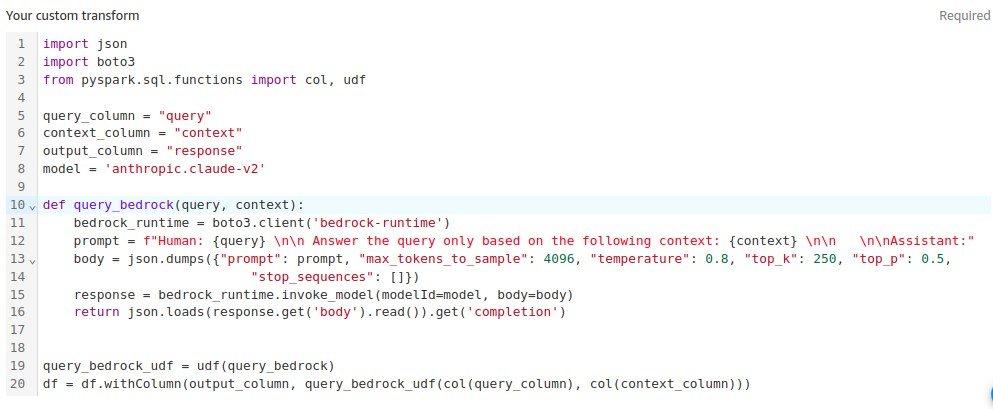

Vamos adicionar uma transformação personalizada para chamar a API Amazon Bedrock para resposta à consulta, passando os documentos da base de conhecimento do Amazon OpenSearch. Nos trechos de código de exemplo, navegue e selecione Consulte Bedrock com contexto. Faça as alterações necessárias no snippet de código e selecione Adicionar.

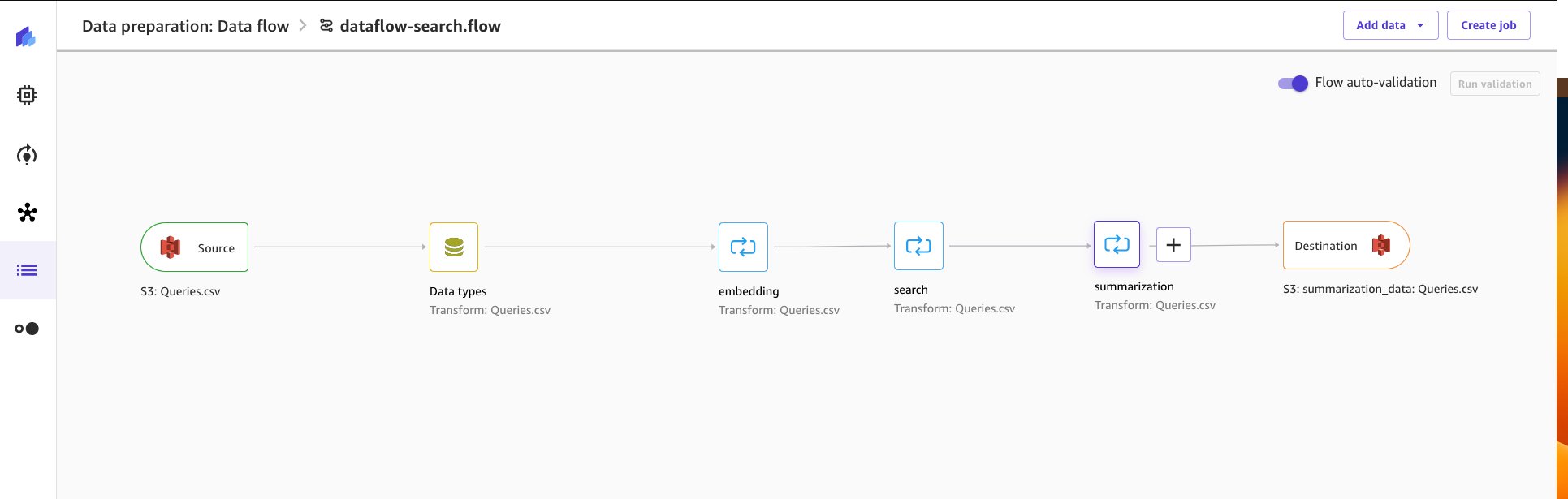

Em resumo, o fluxo de dados de resposta a perguntas baseado em RAG é o seguinte:

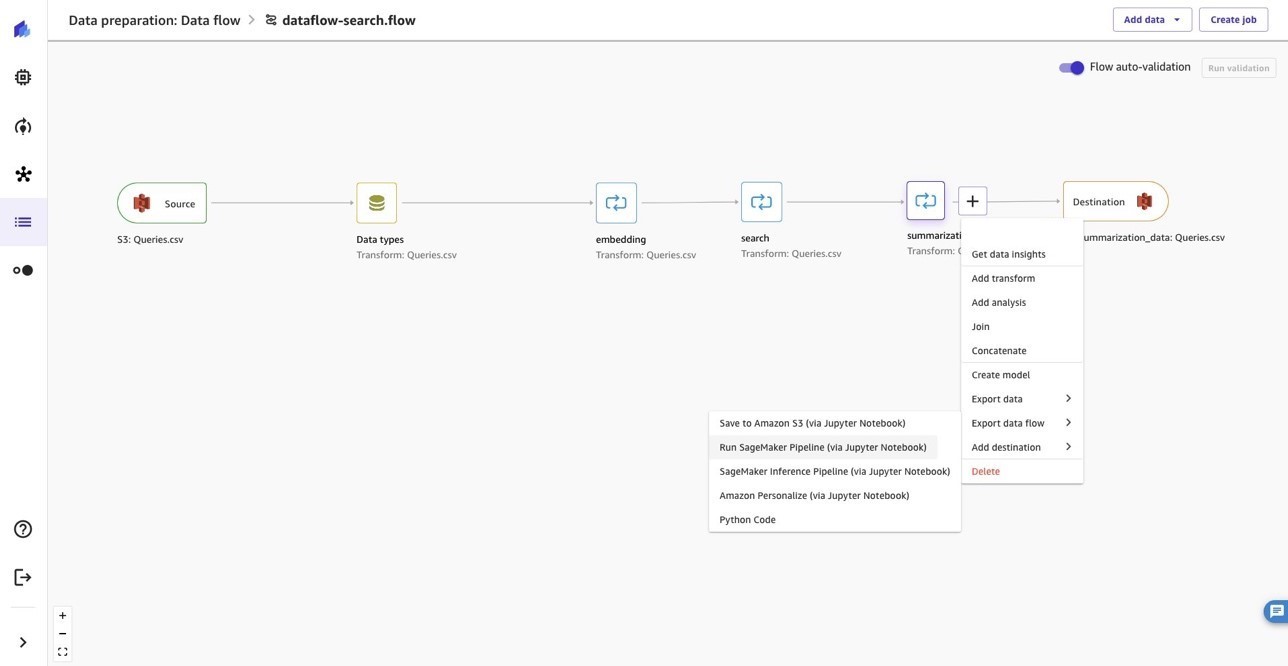

Os profissionais de ML gastam muito tempo elaborando código de engenharia de recursos, aplicando-o a seus conjuntos de dados iniciais, treinando modelos nos conjuntos de dados projetados e avaliando a precisão do modelo. Dada a natureza experimental deste trabalho, mesmo o menor projeto leva a múltiplas iterações. O mesmo código de engenharia de recursos costuma ser executado repetidamente, desperdiçando tempo e recursos de computação ao repetir as mesmas operações. Em grandes organizações, isso pode causar uma perda de produtividade ainda maior porque equipes diferentes geralmente executam trabalhos idênticos ou até mesmo escrevem códigos de engenharia de recursos duplicados porque não têm conhecimento de trabalhos anteriores. Para evitar o reprocessamento de recursos, exportaremos nosso fluxo de dados para uma Amazon Pipeline SageMaker. Vamos selecionar o + botão à direita da consulta. Selecione exportar fluxo de dados e escolha Execute o pipeline do SageMaker (via bloco de notas Jupyter).

Limpando

Para evitar cobranças futuras, exclua ou desligue os recursos que você criou ao seguir esta postagem. Referir-se Sair do Amazon SageMaker Canvas para mais detalhes.

Conclusão

Nesta postagem, mostramos como os recursos ponta a ponta do Amazon SageMaker Canvas assumem o papel de um profissional de dados que prepara dados para um LLM. A preparação interativa de dados permitiu limpar, transformar e analisar rapidamente os dados para projetar recursos informativos. Ao remover as complexidades de codificação, o SageMaker Canvas permitiu uma iteração rápida para criar um conjunto de dados de treinamento de alta qualidade. Esse fluxo de trabalho acelerado levou diretamente à construção, ao treinamento e à implantação de um modelo de aprendizado de máquina de alto desempenho para causar impacto nos negócios. Com sua preparação abrangente de dados e experiência unificada de dados a insights, o SageMaker Canvas capacita os usuários a melhorar seus resultados de ML.

Incentivamos você a aprender mais explorando Gerenciador de dados do Amazon SageMaker, Tela do Amazon SageMaker, Titã Amazona modelos, Rocha Amazônicae Amazon Serviço OpenSearch para construir uma solução usando o exemplo de implementação fornecido nesta postagem e um conjunto de dados relevante para o seu negócio. Se você tiver dúvidas ou sugestões, deixe um comentário.

Sobre os autores

Ajjay Govindaram é Arquiteto de Soluções Sênior na AWS. Ele trabalha com clientes estratégicos que usam AI/ML para resolver problemas complexos de negócios. Sua experiência está em fornecer orientação técnica e assistência de design para implantações de aplicativos de IA/ML de modesta a grande escala. Seu conhecimento varia de arquitetura de aplicativos a big data, análise e aprendizado de máquina. Ele gosta de ouvir música enquanto descansa, experimenta o ar livre e passa tempo com seus entes queridos.

Ajjay Govindaram é Arquiteto de Soluções Sênior na AWS. Ele trabalha com clientes estratégicos que usam AI/ML para resolver problemas complexos de negócios. Sua experiência está em fornecer orientação técnica e assistência de design para implantações de aplicativos de IA/ML de modesta a grande escala. Seu conhecimento varia de arquitetura de aplicativos a big data, análise e aprendizado de máquina. Ele gosta de ouvir música enquanto descansa, experimenta o ar livre e passa tempo com seus entes queridos.

Nikita Ivkin é um cientista aplicado sênior no Amazon SageMaker Data Wrangler com interesses em aprendizado de máquina e algoritmos de limpeza de dados.

Nikita Ivkin é um cientista aplicado sênior no Amazon SageMaker Data Wrangler com interesses em aprendizado de máquina e algoritmos de limpeza de dados.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/simplify-data-prep-for-gen-ai-with-amazon-sagemaker-data-wrangler/

- :tem

- :é

- :não

- 100

- 14

- 20

- 25

- 28

- 50

- 7

- 8

- 804

- a

- Capaz

- Sobre

- acima

- acelerar

- acelerado

- Acesso

- Segundo

- Contas

- precisão

- adicionar

- Adicional

- Adoção

- avanços

- Vantagem

- vantagens

- Depois de

- novamente

- agregar

- à frente

- AI

- AI / ML

- algoritmos

- Alinha

- Todos os Produtos

- permitidas

- tb

- Amazon

- Amazon Sage Maker

- Gerenciador de dados do Amazon SageMaker

- Amazon Web Services

- quantidades

- an

- Analisa

- analítica

- análise

- e

- responder

- qualquer

- api

- Aplicação

- aplicado

- Aplicando

- arquitetura

- SOMOS

- artificial

- inteligência artificial

- AS

- Assistência

- At

- anexar

- auditivo

- aumentado

- disponível

- evitar

- AWS

- base

- baseado

- BE

- Porque

- torna-se

- sido

- antes

- ser

- Melhor

- tendencioso

- Grande

- Big Data

- construir

- Prédio

- construídas em

- negócio

- negócios

- botão

- by

- chamada

- CAN

- lona

- capacidades

- casas

- Causar

- Alterações

- acusações

- Escolha

- limpar

- Limpeza

- código

- Codificação

- combinando

- comentar

- Empresas

- comparado

- competitivo

- completar

- integrações

- complexidades

- compreender

- compreensivo

- Computar

- Considerar

- cônsul

- não contenho

- contém

- conteúdo

- conteúdo

- contexto

- Contextos

- continua

- ao controle

- converter

- Correspondente

- poderia

- cobrir

- crio

- criado

- crítico

- personalizadas

- cliente

- Atendimento ao Cliente

- Clientes

- dados,

- Preparação de dados

- banco de dados

- conjuntos de dados

- Deloitte

- demonstraram

- Implantação

- Implantações

- Design

- detalhes

- em desenvolvimento

- diferente

- difícil

- Dimensão

- direção

- diretamente

- descobrir

- do

- documento

- documentação

- INSTITUCIONAIS

- domínio

- domínios

- down

- durante

- e

- cada

- facilmente

- efetivamente

- eficiente

- eficientemente

- e-mails

- embutindo

- empodera

- habilitado

- permitindo

- encorajar

- end-to-end

- engenheiro

- engenharia

- Engenharia

- avaliação

- Mesmo

- exemplo

- existe

- vasta experiência

- experimentando

- experimental

- explorar

- Explorando

- exportar

- extrato

- Característica

- Funcionalidades

- poucos

- Campos

- Envie o

- filtro

- final

- Encontre

- fluxo

- seguido

- seguinte

- segue

- Escolha

- Forbes

- Foundation

- Fundações

- Gratuito

- da

- cheio

- funções

- mais distante

- futuro

- Ganho

- gerar

- gerado

- gerando

- geração

- generativo

- IA generativa

- ter

- OFERTE

- dado

- Global

- Go

- meta

- Bom estado, com sinais de uso

- maior

- Ter

- he

- cabeçalhos

- alta qualidade

- sua

- detém

- Início

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- HTTPS

- i

- idêntico

- if

- imagens

- Impacto

- implementação

- importar

- importante

- impressionante

- melhorar

- in

- inclui

- índice

- indexado

- INFORMAÇÕES

- informativo

- do estado inicial,

- insights

- instruções

- integração

- Inteligência

- interativo

- interesses

- Interface

- Internet

- para dentro

- envolver

- IT

- iteração

- iterações

- ESTÁ

- Empregos

- jpg

- json

- Conhecimento

- Terreno

- língua

- grande

- em grande escala

- lançamento

- Leads

- APRENDER

- aprendizagem

- Deixar

- levou

- aproveitando

- encontra-se

- como

- Lista

- Escuta

- LLM

- carregar

- localização

- locais

- fora

- lote

- amado

- Baixo

- máquina

- aprendizado de máquina

- a Principal

- fazer

- FAZ

- máscara

- maciço

- dominar

- Posso..

- mecanismos

- Mídia

- Menu

- Meta

- metadados

- ML

- modelo

- modelos

- modesto

- mais

- a maioria

- múltiplo

- Música

- nome

- natural

- Processamento de linguagem natural

- Natureza

- Navegação

- necessário

- você merece...

- Novo

- Próximo

- não

- caderno

- agora

- of

- frequentemente

- on

- uma vez

- queridos

- só

- Operações

- Opção

- or

- organização

- organizações

- Outros

- A Nossa

- Fora

- resultados

- ao ar livre

- saída

- Acima de

- página

- pandas

- pão

- Passagem

- Senha

- atuação

- pessoal

- escolher

- peça

- peças

- oleoduto

- platão

- Inteligência de Dados Platão

- PlatãoData

- por favor

- mais

- ponto

- políticas

- Publique

- potencial

- alimentado

- preferido

- preparação

- Preparar

- preparação

- Prévio

- provavelmente

- Problema

- problemas

- prosseguir

- processo

- em processamento

- Produção

- produtividade

- profissional

- projeto

- Propriedades

- fornecido

- fornece

- fornecendo

- Python

- consultas

- questão

- Frequentes

- rapidamente

- gamas

- rápido

- avaliações

- alcançar

- Leia

- mundo real

- recebido

- referir

- relacionado

- relevante

- removendo

- Informou

- pedidos

- requerer

- exige

- Recursos

- resposta

- respostas

- em repouso

- Resultados

- retorno

- Opinões

- certo

- Tipo

- Execute

- sábio

- mesmo

- Salvar

- Cientista

- Pesquisar

- pesquisar

- Seção

- visto

- selecionar

- envio

- senior

- sensível

- serviço

- Serviços

- Configurações

- rede de apoio social

- mostrar

- mostrou

- fechar

- Encerre

- lado

- assinar

- periodo

- semelhante

- simplicidade

- simplificar

- Tamanho

- fragmento

- So

- Redes Sociais

- meios de comunicação social

- solução

- Soluções

- RESOLVER

- alguns

- fonte

- Fontes

- específico

- especificamente

- gastar

- Passar

- Etapa

- Estágio

- Passo

- Passos

- Ainda

- Estratégico

- estruturada

- RESUMO

- suportes

- Vistorias

- Tire

- equipes

- Dados Técnicos:

- técnicas

- teste

- texto

- que

- A

- O Futuro

- deles

- Eles

- então

- Lá.

- Este

- deles

- isto

- Assim

- tempo

- titã

- para

- hoje

- ferramentas

- Training

- Transformar

- Transformação

- transformações

- transformando

- verdadeiro

- truncamento

- tipo

- tipos

- unificado

- us

- usar

- usava

- Utilizador

- usuários

- utilização

- Valioso

- via

- Vídeo

- visual

- Passo a passo

- we

- web

- serviços web

- BEM

- qual

- enquanto

- QUEM

- precisarão

- de

- Atividades:

- de gestão de documentos

- trabalho

- seria

- escrever

- Vocês

- investimentos

- zefirnet