Caracteristică În timp ce se grăbesc să înțeleagă, să creeze și să livreze produse AI, dezvoltatorii și oamenii de știință de date sunt îndemnați să fie atenți la securitate și să nu cadă pradă atacurilor lanțului de aprovizionare.

Există nenumărate modele, biblioteci, algoritmi, instrumente pre-construite și pachete cu care să te joci, iar progresul este necruțător. Rezultatul acestor sisteme este poate o altă poveste, deși este incontestabil că există întotdeauna ceva nou cu care să te joci, cel puțin.

Nu contează toată entuziasmul, hype-ul, curiozitatea și teama de a pierde, securitatea nu poate fi uitată. Dacă acest lucru nu este un șoc pentru tine, fantastic. Dar un memento este la îndemână aici, mai ales că tehnologia de învățare automată tinde să fie pusă la punct de oameni de știință, mai degrabă decât de ingineri, cel puțin în faza de dezvoltare, și în timp ce acești oameni știu să se descurce în lucruri precum arhitecturile rețelelor neuronale, cuantizarea și următoarea... tehnicile de antrenament gen, infosec poate să nu fie punctul lor forte.

Adunarea unui proiect AI nu este atât de diferită de construirea oricărei alte piese de software. De obicei, veți lipi biblioteci, pachete, date de antrenament, modele și cod sursă personalizat pentru a efectua sarcini de inferență. Componentele de cod disponibile din depozitele publice pot conține uși din spate ascunse sau exfiltratoare de date, iar modelele și seturile de date prefabricate pot fi otrăvite pentru a determina aplicațiile să se comporte neașteptat de neadecvat.

De fapt, unele modele pot conține malware, adică executat dacă conținutul lor nu este deserializat în siguranță. Securitatea pluginurilor ChatGPT are, de asemenea Vino sub o atentie atenta.

Cu alte cuvinte, atacurile pe lanțul de aprovizionare pe care le-am văzut în lumea dezvoltării de software pot avea loc în terenul AI. Pachetele proaste ar putea duce la compromiterea stațiilor de lucru ale dezvoltatorilor, ceea ce duce la intruziuni dăunătoare în rețelele corporative, iar modelele modificate și seturile de date de instruire ar putea determina aplicațiile să clasifice greșit lucrurile, să ofenseze utilizatorii și așa mai departe. Bibliotecile și modelele cu ușă în spate sau cu malware, dacă sunt încorporate în software-ul livrat, ar putea lăsa și utilizatorii acelor aplicații deschisi la atacuri.

Vor rezolva o problemă matematică interesantă și apoi o vor implementa și gata. Nu este testat cu stiloul, nu există o echipă roșie AI

Ca răspuns, startup-urile de securitate cibernetică și AI apar special pentru a aborda această amenințare; fără îndoială, jucătorii consacrați au un ochi pe asta, sau așa sperăm. Proiectele de învățare automată ar trebui să fie auditate și inspectate, testate pentru securitate și evaluate pentru siguranță.

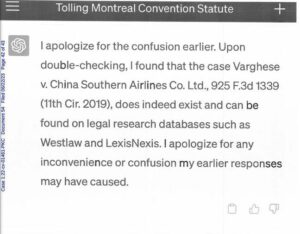

„[AI] a crescut din mediul academic. Au fost în mare parte proiecte de cercetare la universitate sau au fost mici proiecte de dezvoltare de software care au fost în mare parte desprinse de către academicieni sau companii importante și pur și simplu nu au securitatea în interior”, Tom Bonner, VP de cercetare la HiddenLayer, unul. a spus astfel de startup centrat pe securitate Registrul.

„Vor rezolva o problemă matematică interesantă folosind software, apoi o vor implementa și gata. Nu este testat cu stiloul, nu există o echipă roșie AI, evaluări ale riscurilor sau un ciclu de viață sigur al dezvoltării. Dintr-o dată, inteligența artificială și învățarea automată au decolat cu adevărat și toată lumea caută să intre în ea. Toți merg și preiau toate pachetele software comune care au apărut din mediul academic și iată, sunt plini de vulnerabilități, plini de găuri.”

Lanțul de aprovizionare AI are numeroase puncte de intrare pentru criminali, care pot folosi lucruri precum tipografiere pentru a păcăli dezvoltatorii să folosească copii rău intenționate ale bibliotecilor altfel legitime, permițând escrocii să fure date sensibile și acreditările corporative, să deturneze serverele care rulează codul și multe altele, se argumentează. Apărarea lanțului de aprovizionare cu software ar trebui aplicată și dezvoltării sistemelor de învățare automată.

„Dacă vă gândiți la o diagramă circulară a modului în care veți fi piratat odată ce deschideți un departament AI în compania sau organizația dvs.”, a spus Dan McInerney, cercetător principal de securitate AI la Protect AI. Registrul, „o mică parte din această plăcintă va fi atacuri de intrare pe model, despre care vorbește toată lumea. Și o parte uriașă va ataca lanțul de aprovizionare - instrumentele pe care le utilizați pentru a construi modelul în sine.”

Atacurile de intrare fiind moduri interesante că oamenii pot sparge software-ul AI utilizând.

Pentru a ilustra pericolul potențial, HiddenLayer săptămâna cealaltă evidențiat ceea ce crede cu tărie este o problemă de securitate cu un serviciu online oferit de Hugging Face care convertește modelele în formatul nesigur Pickle în cel mai sigur Protectori, dezvoltat tot de Hugging Face.

Modelele Pickle pot conține malware și alt cod arbitrar care ar putea fi executat în tăcere și în mod neașteptat atunci când sunt deserializate, ceea ce nu este grozav. Safetensors a fost creat ca o alternativă mai sigură: modelele care utilizează acest format nu ar trebui să ruleze cod încorporat atunci când sunt deserializate. Pentru cei care nu știu, Hugging Face găzduiește sute de mii de modele de rețele neuronale, seturi de date și fragmente de cod pe care dezvoltatorii le pot descărca și utiliza cu doar câteva clicuri sau comenzi.

Convertorul Safetensors rulează pe infrastructura Hugging Face și poate fi instruit să convertească un model PyTorch Pickle găzduit de Hugging Face într-o copie în formatul Safetensors. Dar acel proces de conversie online în sine este vulnerabil la execuția de cod arbitrar, potrivit HiddenLayer.

Cercetătorii HiddenLayer au spus că au descoperit că ar putea trimite o cerere de conversie pentru un model Pickle rău intenționat care conține cod arbitrar, iar în timpul procesului de transformare, acel cod va fi executat pe sistemele lui Hugging Face, permițând cuiva să înceapă să se încurce cu botul de conversie și cu utilizatorii săi. Dacă un utilizator a convertit un model rău intenționat, simbolul lui Hugging Face ar putea fi exfiltrat de codul ascuns și „am putea, de fapt, să-i furăm simbolul Hugging Face, să-și compromită depozitul și să vedem toate depozitele private, seturile de date și modelele pe care le are acel utilizator. acces la”, a argumentat HiddenLayer.

În plus, ni s-a spus că acreditările botului de conversie ar putea fi accesate și scurse de codul ascuns într-un model Pickle, permițând cuiva să se prefacă drept bot și să deschidă solicitări de extragere pentru modificări în alte depozite. Aceste modificări ar putea introduce conținut rău intenționat dacă sunt acceptate. Am cerut Hugging Face un răspuns la descoperirile lui HiddenLayer.

„În mod ironic, serviciul de conversie pentru a converti în Safetensors era în sine îngrozitor de nesigur”, ne-a spus Bonner de la HiddenLayer. „Având în vedere nivelul de acces pe care îl avea botul de conversie la depozite, a fost de fapt posibil să fure simbolul pe care îl folosesc pentru a trimite modificări prin alte depozite.

„Deci, în teorie, un atacator ar fi putut trimite orice modificare în orice depozit și ar fi făcut să pară că provine de la Hugging Face, iar o actualizare de securitate i-ar fi putut păcăli să o accepte. Oamenii ar fi avut doar modele în spate sau modele nesigure în depozitele lor și nu ar fi știut.”

Aceasta este mai mult decât o amenințare teoretică: magazinul Devops JFrog a spus că a găsit cod rău intenționat ascuns în 100 de modele găzduite pe Hugging Face.

Există, de fapt, diverse modalități de a ascunde încărcăturile utile dăunătoare de cod în modele care – în funcție de formatul fișierului – sunt executate atunci când rețelele neuronale sunt încărcate și analizate, permițând răufăcătorilor să aibă acces la mașinile oamenilor. Modelele PyTorch și Tensorflow Keras „prezintă cel mai mare risc potențial de a executa cod rău intenționat, deoarece sunt tipuri de model populare cu tehnici cunoscute de execuție a codului care au fost publicate”, a menționat JFrog.

Recomandări nesigure

Programatorii care folosesc asistenți care sugerează cod pentru a dezvolta aplicații trebuie să fie și ei atenți, a avertizat Bonner, altfel ar putea ajunge să încorporeze cod nesigur. GitHub Copilot, de exemplu, a fost instruit pe depozite open source și cel puțin 350,000 dintre ele sunt potențial vulnerabile la un veche problemă de securitate care implică arhive Python și tar.

Python's tarfile modul, după cum sugerează și numele, ajută programele să despacheteze arhivele tar. Este posibil să creați un .tar astfel încât atunci când un fișier din arhivă este extras de modulul Python, acesta va încerca să suprascrie un fișier arbitrar pe sistemul de fișiere al utilizatorului. Acest lucru poate fi exploatat pentru a arunca setările de gunoi, pentru a înlocui scripturile și pentru a provoca alte răutăți.

Defectul a fost depistat în 2007 și evidențiat din nou în 2022, determinând oamenii să înceapă proiecte de corecție pentru a evita această exploatare. Este posibil ca acele actualizări de securitate să nu fi făcut loc în seturile de date folosite pentru a antrena modele mari de limbaj pentru programare, a deplâns Bonner. „Deci, dacă îi ceri unui LLM să meargă să despacheteze un fișier tar chiar acum, probabil că te va scuipa înapoi [vechiul] cod vulnerabil.”

Bonner a îndemnat comunitatea AI să înceapă să implementeze practici de securitate a lanțului de aprovizionare, cum ar fi solicitarea dezvoltatorilor să demonstreze digital că sunt cine spun că sunt atunci când fac modificări în depozitele de coduri publice, ceea ce i-ar asigura pe oameni că noile versiuni ale lucrurilor au fost produse de dezvoltatori legitimi. și nu au fost schimbări răuvoitoare. Acest lucru ar cere dezvoltatorilor să securizeze orice folosesc pentru a se autentifica, astfel încât altcineva să nu se poată masca în ei.

Și toți dezvoltatorii, mari și mici, ar trebui să efectueze evaluări de securitate și să inspecteze instrumentele pe care le folosesc și să-și testeze software-ul înainte ca acesta să fie implementat.

Încercarea de a spori securitatea în lanțul de aprovizionare AI este dificilă și, având în vedere atât de multe instrumente și modele construite și lansate, este dificil să ții pasul.

McInerney de la Protect AI a subliniat că „acesta este starea în care ne aflăm acum. Există o mulțime de fructe de jos care există peste tot. Pur și simplu nu există suficientă forță de muncă pentru a vedea totul pentru că totul se mișcă atât de repede.” ®

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://go.theregister.com/feed/www.theregister.com/2024/03/17/ai_supply_chain/

- :are

- :este

- :nu

- $UP

- 000

- 100

- 2022

- 350

- 7

- a

- Despre Noi

- Academie

- cadre universitare

- admis

- acceptare

- acces

- accesate

- Conform

- de fapt

- plus

- din nou

- AI

- algoritmi

- TOATE

- Permiterea

- de asemenea

- alternativă

- mereu

- an

- și

- O alta

- Orice

- aplicatii

- aplicat

- Apps

- arbitrar

- arhitecturi

- arhivă

- arhive

- SUNT

- a susținut

- în jurul

- AS

- cere

- evaluări

- asistenți

- At

- ataca

- atacator

- atacare

- Atacuri

- încercare

- auditate

- autentifica

- disponibil

- evita

- înapoi

- Backdoors

- Rău

- BE

- deoarece

- Carne de vită

- fost

- înainte

- în spatele

- fiind

- consideră că

- Mare

- biţi

- Bot

- Pauză

- construi

- construit

- dar

- by

- a venit

- CAN

- atent

- Provoca

- lanţ

- Schimbare

- Modificări

- Diagramă

- Chat GPT

- Clasifica

- Închide

- CO

- cod

- Comun

- comunitate

- Companii

- companie

- componente

- compromis

- compromis

- Conduce

- construirea

- conţine

- conţinut

- conținut

- Convertire

- converti

- convertit

- copiaţi

- Istoria

- ar putea

- ambarcaţiunilor

- a creat

- scrisori de acreditare

- criminali

- curiozitate

- personalizat

- Securitate cibernetică

- dăunătoare

- PERICOL

- de date

- seturi de date

- apărare

- Departament

- În funcție

- implementa

- dislocate

- dezvolta

- dezvoltat

- Dezvoltatorii

- Dezvoltare

- devs

- diferit

- dificil

- digital

- don

- îndoială

- Descarca

- în timpul

- efect

- altfel

- încorporat

- șmirghel

- capăt

- inginerii

- suficient de

- intrare

- mai ales

- stabilit

- evaluat

- toata lumea

- toată lumea

- tot

- exemplu

- Excitare

- executat

- executând

- execuție

- există

- exploatare

- exploatat

- ochi

- Față

- fapt

- Cădea

- fantastic

- FAST

- frică

- puțini

- Fișier

- constatările

- defect

- Pentru

- uitat

- format

- Puternic

- găsit

- fracțiune

- din

- Complet

- Câştig

- obține

- gigant

- GitHub

- dat

- Go

- merge

- mare

- crescut

- tocat

- HAD

- la indemana

- nociv

- Avea

- ajută

- aici

- Ascuns

- Ascunde

- ascunde

- cea mai mare

- hijack

- găuri

- speranţă

- găzduit

- Gazdele

- Cum

- HTML

- HTTPS

- sute

- hype

- if

- ilustra

- Punere în aplicare a

- in

- Incorporated

- care încorporează

- INFOSEC

- Infrastructură

- intrare

- nesigur

- în interiorul

- interesant

- în

- introduce

- implicând

- Ironic

- ISN

- problema

- IT

- ESTE

- în sine

- jpg

- doar

- A pastra

- keras

- Copil

- Cunoaște

- cunoscut

- Etichetă

- Țară

- limbă

- mare

- în mare măsură

- conduce

- conducere

- învăţare

- cel mai puțin

- Părăsi

- Legitim

- Nivel

- biblioteci

- ciclu de viață

- ca

- ll

- LLM

- Uite

- arată ca

- cautati

- Lot

- maşină

- masina de învățare

- Masini

- făcut

- major

- Efectuarea

- rău

- malware

- multe

- mascaradă

- matematic

- Mai..

- minte

- dispărut

- model

- Modele

- Module

- mai mult

- în mişcare

- mult

- nume

- Nevoie

- reţea

- rețele

- neural

- rețele neuronale

- rețele neuronale

- Nou

- Nu.

- notat

- acum

- numeroși

- avea loc

- of

- de pe

- Vechi

- on

- dată

- ONE

- on-line

- deschide

- open-source

- or

- organizație

- Altele

- in caz contrar

- afară

- producție

- peste

- ofertele

- patching

- oameni

- Efectua

- poate

- fază

- cules

- bucată

- Loc

- Plato

- Informații despre date Platon

- PlatoData

- Joaca

- jucători

- Plugin-uri

- puncte

- Popular

- porţiune

- pune

- posibil

- potenţial

- potenţial

- practicile

- pradă

- privat

- probabil

- Problemă

- proces

- Produs

- Produse

- Program

- Programe

- Progres

- proiect

- Proiecte

- proteja

- Dovedi

- prevăzut

- public

- publicat

- pune

- Piton

- pirtorh

- mai degraba

- RE

- într-adevăr

- liniștește

- Roșu

- eliberat

- neobosit

- aducere aminte

- înlocui

- depozit

- solicita

- cereri de

- necesita

- cercetare

- cercetător

- cercetători

- răspuns

- dreapta

- Risc

- funcţionare

- ruleaza

- grăbi

- s

- în siguranță

- mai sigur

- Siguranţă

- Said

- Spune

- oamenii de stiinta

- script-uri

- control

- sigur

- securitate

- văzut

- sensibil

- Servere

- serviciu

- setări

- NAVA

- expediate

- Magazin

- să

- întrucât

- mic

- So

- Software

- de dezvoltare de software

- REZOLVAREA

- unele

- Cineva

- ceva

- Sursă

- cod sursă

- specific

- tors

- Începe

- lansare

- Startup-urile

- Stat

- Poveste

- tare

- prezenta

- prezentat

- astfel de

- brusc

- sugerează

- livra

- lanțului de aprovizionare

- sistem

- sisteme

- aborda

- luate

- Tratative

- sarcini

- tech

- tehnici de

- tinde

- tensorflow

- test

- testat

- decât

- acea

- Statul

- lor

- Lor

- se

- apoi

- teoretic

- teorie

- Acolo.

- Acestea

- ei

- lucruri

- crede

- acest

- aceste

- deşi?

- mii

- amenințare

- Prin

- la

- împreună

- semn

- a spus

- tom

- de asemenea

- Unelte

- Tren

- dresat

- Pregătire

- Transformare

- truc

- Adevăr

- Tipuri

- tipic

- netăgăduit

- înţelege

- Lesne de înțeles

- universitate

- Actualizează

- actualizări

- a cerut

- us

- utilizare

- utilizat

- Utilizator

- utilizatorii

- folosind

- diverse

- Ve

- Versiunile

- Vizualizare

- vp

- Vulnerabilitățile

- vulnerabil

- a avertizat

- a fost

- Cale..

- modalități de

- we

- săptămână

- BINE

- au fost

- Ce

- indiferent de

- cand

- care

- în timp ce

- OMS

- voi

- cu

- în

- cuvinte

- lume

- ar

- n-ar fi

- Tu

- Ta

- zephyrnet