Agenții de model de limbă mare (LLM) sunt programe care extind capacitățile LLM-urilor de sine stătătoare cu 1) acces la instrumente externe (API-uri, funcții, webhook-uri, pluginuri și așa mai departe) și 2) capacitatea de a planifica și executa sarcini în sine. -moda regizata. Adesea, LLM-urile trebuie să interacționeze cu alte programe software, baze de date sau API-uri pentru a îndeplini sarcini complexe. De exemplu, un chatbot administrativ care programează întâlniri ar necesita acces la calendarele și e-mailurile angajaților. Cu acces la instrumente, agenții LLM pot deveni mai puternici, cu prețul complexității suplimentare.

În această postare, vă prezentăm agenți LLM și demonstrăm cum să construiți și să implementăm un agent LLM de comerț electronic folosind Amazon SageMaker JumpStart și AWS Lambda. Agentul va folosi instrumente pentru a oferi noi capabilități, cum ar fi răspunsul la întrebări despre returnări („Este returnarea mea rtn001 procesate?”) și furnizarea de actualizări despre comenzi („Poți să-mi spui dacă comand 123456 a fost expediat?"). Aceste noi capabilități necesită ca LLM să preia date din mai multe surse de date (orders, returns) și efectuați generarea augmentată de recuperare (RAG).

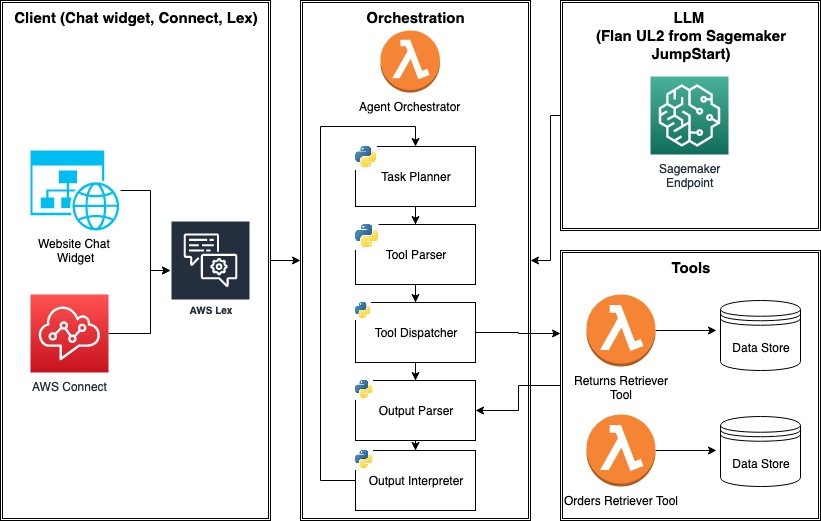

Pentru a alimenta agentul LLM, folosim a Flan-UL2 model implementat ca a Punct final SageMaker și utilizați instrumente de recuperare a datelor create cu AWS Lambda. Agentul poate fi ulterior integrat cu Amazon Lex și folosit ca chatbot în interiorul site-urilor web sau AWS Connect. Încheiem postarea cu elemente de luat în considerare înainte de a implementa agenți LLM în producție. Pentru o experiență gestionată complet pentru construirea de agenți LLM, AWS oferă și agenți pentru caracteristica Amazon Bedrock (în previzualizare).

O scurtă prezentare generală a arhitecturilor agenților LLM

Agenții LLM sunt programe care folosesc LLM-urile pentru a decide când și cum să folosească instrumentele după cum este necesar pentru a finaliza sarcini complexe. Cu instrumente și abilități de planificare a sarcinilor, agenții LLM pot interacționa cu sistemele externe și pot depăși limitările tradiționale ale LLM-urilor, cum ar fi limitele de cunoștințe, halucinațiile și calculele imprecise. Instrumentele pot lua o varietate de forme, cum ar fi apeluri API, funcții Python sau pluginuri bazate pe webhook. De exemplu, un LLM poate folosi un „plugin de recuperare” pentru a prelua contextul relevant și pentru a efectua RAG.

Deci, ce înseamnă pentru un LLM să aleagă instrumente și să planifice sarcini? Există numeroase abordări (cum ar fi Reacţiona, MRKL, formator de scule, ÎmbrățișareGPT, și Agent transformators) la utilizarea LLM-urilor cu instrumente, iar progresele au loc rapid. Dar o modalitate simplă este de a solicita unui LLM o listă de instrumente și de a-i cere să determine 1) dacă un instrument este necesar pentru a satisface interogarea utilizatorului și, dacă da, 2) selectați instrumentul corespunzător. Un astfel de prompt arată de obicei ca următorul exemplu și poate include câteva exemple pentru a îmbunătăți fiabilitatea LLM în alegerea instrumentului potrivit.

Abordări mai complexe implică utilizarea unui LLM specializat care poate decoda direct „apeluri API” sau „utilizarea instrumentelor”, cum ar fi GorillaLLM. Astfel de LLM-uri reglate fin sunt instruite pe seturi de date cu specificații API pentru a recunoaște și a prezice apelurile API pe baza instrucțiunilor. Adesea, aceste LLM necesită unele metadate despre instrumentele disponibile (descrieri, yaml sau schema JSON pentru parametrii lor de intrare) pentru a scoate invocări de instrumente. Această abordare este adoptată de agenți pentru Amazon Bedrock și Apeluri de funcții OpenAI. Rețineți că, în general, LLM-urile trebuie să fie suficient de mari și complexe pentru a demonstra capacitatea de selecție a instrumentelor.

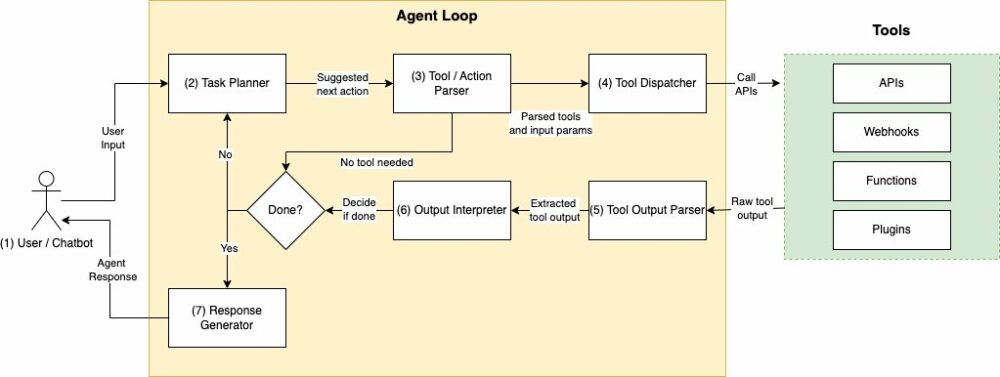

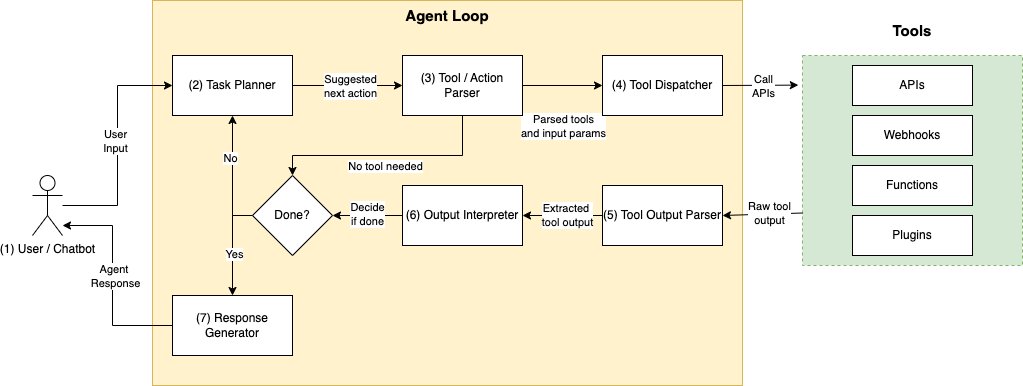

Presupunând că sunt alese mecanismele de planificare a sarcinilor și de selecție a instrumentelor, un program tipic de agent LLM funcționează în următoarea secvență:

- Cerere utilizator – Programul primește o intrare de utilizator, cum ar fi „Unde este comanda mea

123456?” dintr-o aplicație client. - Planificați acțiunile următoare și selectați instrumentele de utilizat – Apoi, programul folosește un prompt pentru ca LLM să genereze următoarea acțiune, de exemplu, „Căutați tabelul de comenzi folosind

OrdersAPI.” LLM este solicitat să sugereze un nume de instrument, cum ar fiOrdersAPIdintr-o listă predefinită de instrumente disponibile și descrierile acestora. Alternativ, LLM ar putea fi instruit să genereze direct un apel API cu parametri de intrare, cum ar fiOrdersAPI(12345).- Rețineți că următoarea acțiune poate implica sau nu utilizarea unui instrument sau API. Dacă nu, LLM ar răspunde la intrarea utilizatorului fără a încorpora context suplimentar din instrumente sau va returna pur și simplu un răspuns predefinit, cum ar fi „Nu pot răspunde la această întrebare”.

- Solicitarea instrumentului de analiză – În continuare, trebuie să analizăm și să validăm predicția instrumentului/acțiunii sugerate de LLM. Validarea este necesară pentru a se asigura că numele instrumentelor, API-urile și parametrii de solicitare nu sunt halucinate și că instrumentele sunt invocate corespunzător, conform specificațiilor. Această analiză poate necesita un apel separat LLM.

- Instrumentul de invocare – Odată ce sunt asigurate numele și parametrii valide a instrumentului, invocăm instrumentul. Aceasta ar putea fi o solicitare HTTP, un apel de funcție și așa mai departe.

- Analizați ieșirea – Răspunsul din partea instrumentului poate necesita o prelucrare suplimentară. De exemplu, un apel API poate avea ca rezultat un răspuns JSON lung, unde doar un subset de câmpuri sunt de interes pentru LLM. Extragerea informațiilor într-un format curat și standardizat poate ajuta LLM să interpreteze rezultatul în mod mai fiabil.

- Interpretați rezultatul – Având în vedere rezultatul din instrument, LLM este solicitat din nou să-și dea sens și să decidă dacă poate genera răspunsul final înapoi către utilizator sau dacă sunt necesare acțiuni suplimentare.

- Terminați sau continuați cu pasul 2 – Fie returnați un răspuns final, fie un răspuns implicit în cazul erorilor sau expirărilor.

Cadrele de agenți diferite execută fluxul de program anterior în mod diferit. De exemplu, Reacţiona combină selecția instrumentului și generarea răspunsului final într-un singur prompt, spre deosebire de utilizarea solicitărilor separate pentru selectarea instrumentului și generarea răspunsului. De asemenea, această logică poate fi rulată într-o singură trecere sau rulată într-o instrucțiune while („bucla agentului”), care se termină atunci când este generat răspunsul final, este aruncată o excepție sau are loc timeout. Ceea ce rămâne constant este că agenții folosesc LLM-ul ca piesă centrală pentru a orchestra planificarea și invocările de instrumente până când sarcina se încheie. În continuare, arătăm cum să implementăm o buclă simplă de agent folosind serviciile AWS.

Prezentare generală a soluțiilor

Pentru această postare pe blog, implementăm un agent LLM de suport pentru comerțul electronic care oferă două funcționalități bazate pe instrumente:

- Instrument de recuperare a stării returnării – Răspundeți la întrebări despre starea returnărilor, cum ar fi „Ce se întâmplă cu returnarea mea

rtn001? " - Instrument de recuperare a stării comenzii – Urmăriți starea comenzilor, cum ar fi „Care este starea comenzii mele

123456? "

Agentul folosește efectiv LLM ca router de interogare. Dată o interogare („Care este starea comenzii 123456?”), selectați instrumentul de preluare adecvat pentru a interoga în mai multe surse de date (adică retururi și comenzi). Realizam rutarea interogărilor prin alegerea LLM dintre mai multe instrumente de recuperare, care sunt responsabile pentru interacțiunea cu o sursă de date și contextul de preluare. Aceasta extinde modelul RAG simplu, care presupune o singură sursă de date.

Ambele instrumente de recuperare sunt funcții Lambda care au un id (orderId or returnId) ca intrare, preia un obiect JSON din sursa de date și convertește JSON într-un șir de reprezentare prietenos cu oamenii, care este potrivit pentru a fi utilizat de LLM. Sursa de date într-un scenariu real ar putea fi o bază de date NoSQL extrem de scalabilă, cum ar fi DynamoDB, dar această soluție folosește Python simplu Dict cu date eșantion în scopuri demonstrative.

Funcționalități suplimentare pot fi adăugate la agent adăugând Instrumente de recuperare și modificând prompturile în consecință. Acest agent poate fi testat un serviciu de sine stătător care se integrează cu orice interfață de utilizare prin HTTP, ceea ce poate fi realizat cu ușurință Amazon Lex.

Iată câteva detalii suplimentare despre componentele cheie:

- Punct final de inferență LLM – Nucleul unui program de agent este un LLM. Vom folosi hub-ul modelului de fundație SageMaker JumpStart pentru a implementa cu ușurință

Flan-UL2model. SageMaker JumpStart facilitează implementarea punctelor finale de inferență LLM către dedicate SageMaker instanțe. - Agent orchestrator – Agent orchestrator orchestrează interacțiunile dintre LLM, instrumente și aplicația client. Pentru soluția noastră, folosim o funcție AWS Lambda pentru a conduce acest flux și folosim următoarele ca funcții de ajutor.

- Planificator de sarcini (instrument) - Planificatorul de sarcini folosește LLM pentru a sugera una dintre 1) solicitări de returnare, 2) solicitari de comandă sau 3) niciun instrument. Folosim numai inginerie promptă și

Flan-UL2modelul așa cum este, fără reglaj fin. - Analizor instrument - Analizatorul de instrumente asigură că sugestia instrumentului din planificatorul de activități este validă. În special, ne asigurăm că un singur

orderIdorreturnIdpoate fi analizat. În caz contrar, răspundem cu un mesaj implicit. - Dispecer de scule - Dispecerul de instrumente invocă instrumente (funcții Lambda) folosind parametrii validi.

- Analizator de ieșire - Analizorul de ieșire curăță și extrage elementele relevante din JSON într-un șir care poate fi citit de om. Această sarcină este realizată atât de fiecare instrument de recuperare, cât și în cadrul orchestratorului.

- interpret de ieșire - Responsabilitatea interpretului de ieșire este să 1) să interpreteze rezultatul din invocarea instrumentului și 2) să determine dacă cererea utilizatorului poate fi satisfăcută sau sunt necesari pași suplimentari. Dacă acesta din urmă, un răspuns final este generat separat și returnat utilizatorului.

- Planificator de sarcini (instrument) - Planificatorul de sarcini folosește LLM pentru a sugera una dintre 1) solicitări de returnare, 2) solicitari de comandă sau 3) niciun instrument. Folosim numai inginerie promptă și

Acum, să ne aprofundăm puțin în componentele cheie: orchestrator agent, planificator de sarcini și dispecer de instrumente.

Agent orchestrator

Mai jos este o versiune prescurtată a buclei de agent în cadrul funcției Lambda a agentului orchestrator. Bucla folosește funcții de ajutor precum task_planner or tool_parser, pentru modularizarea sarcinilor. Bucla de aici este proiectată să ruleze de cel mult două ori pentru a preveni blocarea LLM într-o buclă inutil de lungă.

Planificator de sarcini (predicție instrument)

Agentul orchestrator folosește task planner pentru a prezice un instrument de recuperare bazat pe intrarea utilizatorului. Pentru agentul nostru LLM, vom folosi pur și simplu inginerie promptă și câteva sugestii pentru a preda LLM această sarcină în context. Agenții mai sofisticați ar putea folosi un LLM ajustat pentru predicția instrumentului, ceea ce depășește scopul acestei postări. Solicitarea este după cum urmează:

Dispecer de scule

Mecanismul de expediere a sculei funcționează prin if/else logica pentru a apela funcțiile Lambda corespunzătoare în funcție de numele instrumentului. Următorul este tool_dispatch implementarea funcției de ajutor. Este folosit în interiorul agent buclă și returnează răspunsul brut de la funcția Lambda a instrumentului, care este apoi curățat de un output_parser Funcția.

Implementați soluția

Cerințe preliminare importante - Pentru a începe implementarea, trebuie să îndepliniți următoarele cerințe preliminare:

- Acces la Consola de administrare AWS printr-un utilizator care poate lansa Stive AWS CloudFormation

- Familiaritate cu navigarea AWS Lambdas și Amazon Lex console

Flan-UL2necesită un singurml.g5.12xlargepentru implementare, care poate necesita creșterea limitelor de resurse prin a bilet de sprijin. În exemplul nostru, folosimus-east-1ca Regiune, deci asigurați-vă că creșteți cota de servicii (dacă este necesar) înus-east-1.

Implementați folosind CloudFormation – Puteți implementa soluția pentru us-east-1 dând clic pe butonul de mai jos:![]()

Implementarea soluției va dura aproximativ 20 de minute și va crea un LLMAgentStack stivă, care:

- implementează punctul final SageMaker folosind

Flan-UL2model de la SageMaker JumpStart; - implementează trei funcții Lambda:

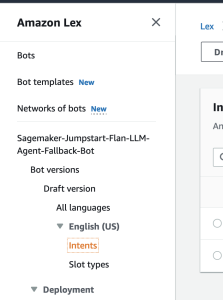

LLMAgentOrchestrator,LLMAgentReturnsTool,LLMAgentOrdersToolŞi - desfășoară o AWS Lex bot care poate fi folosit pentru a testa agentul:

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot.

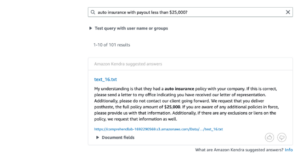

Testați soluția

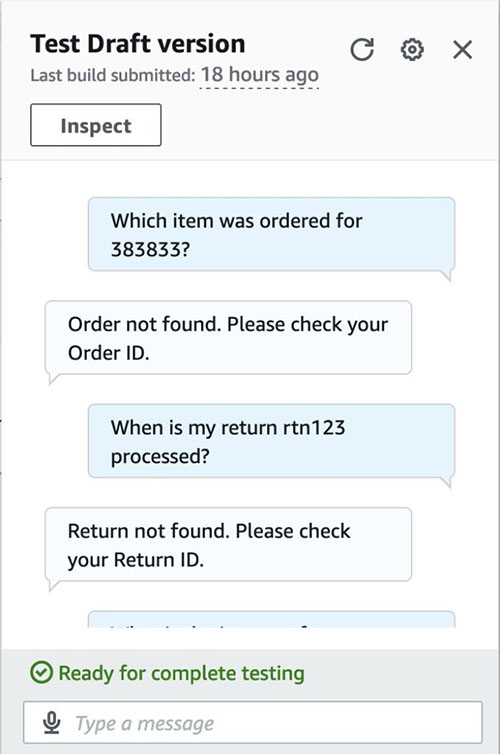

Stiva implementează un bot Amazon Lex cu numele Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Botul poate fi folosit pentru a testa agentul de la capăt la capăt. Iată un ghid suplimentar cuprinzător pentru testarea roboților AWS Amazon Lex cu o integrare Lambda și cum funcționează integrarea la un nivel înalt. Dar, pe scurt, Amazon Lex bot este o resursă care oferă o interfață de utilizare rapidă pentru a discuta cu agentul LLM care rulează într-o funcție Lambda pe care am creat-o (LLMAgentOrchestrator).

Exemplele de cazuri de testare care trebuie luate în considerare sunt următoarele:

- Cerere de comandă valabilă (de exemplu, „Pentru ce articol a fost comandat

123456? ”)- Comanda „123456” este o comandă validă, așa că ar trebui să ne așteptăm la un răspuns rezonabil (de exemplu, „Sapun de mâini cu plante”)

- Cerere de returnare valabilă pentru o întoarcere (de exemplu, „Când este întoarcerea mea

rtn003procesat?”)- Ar trebui să ne așteptăm la un răspuns rezonabil cu privire la starea returului.

- Irelevant atât pentru retururi, cât și pentru comenzi (de exemplu, „Cum este vremea în Scoția acum?”)

- O întrebare irelevantă pentru retururi sau comenzi, prin urmare ar trebui returnat un răspuns implicit („Ne pare rău, nu pot răspunde la această întrebare”).

- Cerere de comandă nevalidă (de exemplu, „Pentru ce articol a fost comandat

383833? ”)- Id-ul 383832 nu există în setul de date comenzi și, prin urmare, ar trebui să eșuăm cu grație (de exemplu, „Comanda nu a fost găsită. Vă rugăm să verificați ID-ul comenzii”).

- Cerere de returnare nevalidă (de exemplu, „Când se întoarce

rtn123procesat?”)- În mod similar, id

rtn123nu există în setul de date returnate și, prin urmare, ar trebui să eșueze cu grație.

- În mod similar, id

- Cerere de returnare irelevantă (de exemplu, „Care este impactul returnării

rtn001despre pacea mondială?”)- Această întrebare, deși pare să se refere la o comandă validă, este irelevantă. LLM este folosit pentru a filtra întrebările cu context irelevant.

Pentru a rula singur aceste teste, iată instrucțiunile.

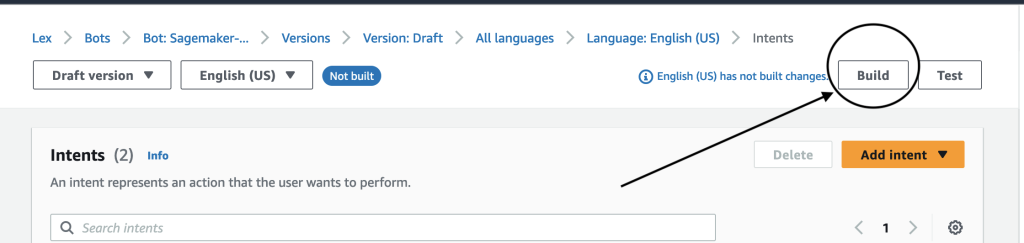

- Pe consola Amazon Lex (Consola AWS > Amazon Lex), navigați la botul intitulat

Sagemaker-Jumpstart-Flan-LLM-Agent-Fallback-Bot. Acest bot a fost deja configurat pentru a apelaLLMAgentOrchestratorFuncția lambda ori de câte oriFallbackIntenteste declanșat. - În panoul de navigare, alegeți intenţii.

- Alege Construi în colțul din dreapta sus

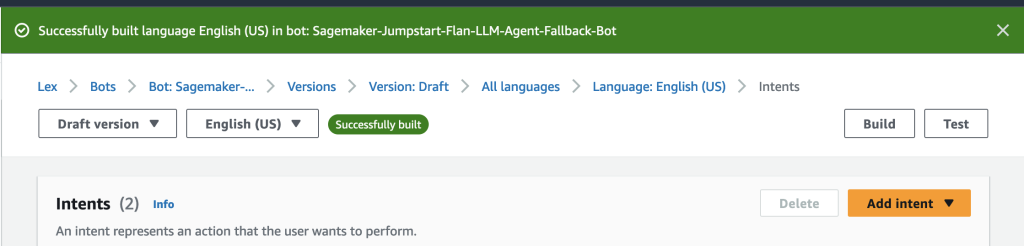

- 4. Așteptați finalizarea procesului de construire. Când este gata, primiți un mesaj de succes, așa cum se arată în următoarea captură de ecran.

- Testați botul introducând cazurile de testare.

A curăța

Pentru a evita costurile suplimentare, ștergeți resursele create de soluția noastră urmând acești pași:

- Pe Formarea AWS Cloud console, selectați stiva numită

LLMAgentStack(sau numele personalizat pe care l-ați ales). - Alege Șterge

- Verificați dacă stiva este șters din consola CloudFormation.

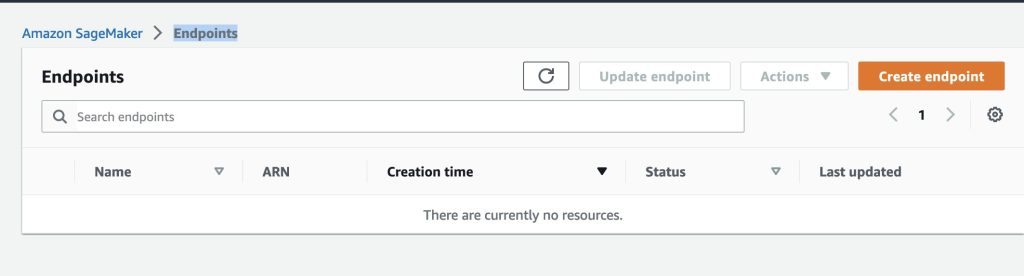

Important: verificați de două ori dacă stiva este șters cu succes, asigurându-vă că Flan-UL2 punctul final de inferență este eliminat.

- Pentru a verifica, accesați Consola AWS > Sagemaker > Puncte finale > Inferență .

- Pagina ar trebui să enumere toate punctele finale active.

- Asigurați-vă că

sm-jumpstart-flan-bot-endpointnu există ca în captura de ecran de mai jos.

Considerații pentru producție

Implementarea agenților LLM în producție necesită luarea de pași suplimentari pentru a asigura fiabilitatea, performanța și mentenabilitatea. Iată câteva considerații înainte de implementarea agenților în producție:

- Selectarea modelului LLM pentru a alimenta bucla agent: Pentru soluția discutată în această postare am folosit a

Flan-UL2model fără reglaj fin pentru a efectua planificarea sarcinilor sau selectarea instrumentului. În practică, utilizarea unui LLM care este ajustat pentru a furniza direct instrumente sau solicitări API poate crește fiabilitatea și performanța, precum și simplifica dezvoltarea. Am putea ajusta un LLM pentru sarcinile de selecție a instrumentelor sau am putea folosi un model care decodifică direct jetoane de instrumente, cum ar fi Toolformer.- Utilizarea modelelor ajustate poate simplifica, de asemenea, adăugarea, eliminarea și actualizarea instrumentelor disponibile unui agent. Cu abordările bazate doar pe prompturi, actualizarea instrumentelor necesită modificarea fiecărui prompt din interiorul orchestratorului agent, cum ar fi cele pentru planificarea sarcinilor, analizarea instrumentelor și expedierea instrumentului. Acest lucru poate fi greoi, iar performanța se poate degrada dacă sunt furnizate prea multe instrumente în context LLM.

- Fiabilitate și performanță: Agenții LLM pot fi nesiguri, în special pentru sarcini complexe care nu pot fi finalizate în câteva bucle. Adăugarea de validări de ieșire, reîncercări, structurarea ieșirilor din LLM-uri în JSON sau yaml și impunerea de timeout-uri pentru a oferi trape de evacuare pentru LLM blocate în bucle poate spori fiabilitatea.

Concluzie

În această postare, am explorat cum să construim un agent LLM care poate utiliza mai multe instrumente de la zero, folosind inginerie promptă de nivel scăzut, funcții AWS Lambda și SageMaker JumpStart ca elemente de bază. Am discutat în detaliu arhitectura agenților LLM și bucla de agenți. Conceptele și arhitectura soluției introduse în această postare de blog pot fi adecvate pentru agenții care folosesc un număr mic de un set predefinit de instrumente. Am discutat, de asemenea, câteva strategii de utilizare a agenților în producție. Agents for Bedrock, care este în previzualizare, oferă, de asemenea, o experiență gestionată pentru crearea de agenți cu suport nativ pentru invocarea instrumentelor agentice.

Despre autor

John Hwang este un arhitect generativ AI la AWS, cu accent special pe aplicații cu model de limbaj mare (LLM), baze de date vectoriale și strategia de produs AI generativă. Este pasionat de a ajuta companiile cu dezvoltarea de produse AI/ML și viitorul agenților și copiloților LLM. Înainte de a se alătura AWS, a fost manager de produs la Alexa, unde a contribuit la introducerea AI conversațională pe dispozitivele mobile, precum și comerciant de derivate la Morgan Stanley. Este licențiat în informatică de la Universitatea Stanford.

John Hwang este un arhitect generativ AI la AWS, cu accent special pe aplicații cu model de limbaj mare (LLM), baze de date vectoriale și strategia de produs AI generativă. Este pasionat de a ajuta companiile cu dezvoltarea de produse AI/ML și viitorul agenților și copiloților LLM. Înainte de a se alătura AWS, a fost manager de produs la Alexa, unde a contribuit la introducerea AI conversațională pe dispozitivele mobile, precum și comerciant de derivate la Morgan Stanley. Este licențiat în informatică de la Universitatea Stanford.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. Automobile/VE-uri, carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- ChartPrime. Crește-ți jocul de tranzacționare cu ChartPrime. Accesați Aici.

- BlockOffsets. Modernizarea proprietății de compensare a mediului. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/learn-how-to-build-and-deploy-tool-using-llm-agents-using-aws-sagemaker-jumpstart-foundation-models/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 100

- 15%

- 19

- 20

- 200

- 24

- 27

- 500

- 7

- 9

- a

- abilități

- capacitate

- Despre Noi

- acces

- realiza

- Conform

- în consecință

- peste

- Acțiune

- acțiuni

- activ

- adăugat

- adăugare

- Suplimentar

- administrativ

- progresele

- După

- din nou

- Agent

- agenţi

- AI

- AI / ML

- Alexa

- TOATE

- deja

- de asemenea

- Amazon

- Amazon Lex

- Amazon Web Services

- printre

- sumă

- an

- și

- răspunde

- Orice

- api

- API-uri

- aplicaţia

- aplicație

- aplicatii

- abordare

- abordari

- adecvat

- arhitectură

- SUNT

- AS

- cere

- presupune

- At

- augmented

- disponibil

- evita

- AWS

- AWS Lambdas

- înapoi

- bazat

- BE

- deveni

- fost

- înainte

- fiind

- de mai jos

- Berkeley

- Dincolo de

- Pic

- Blocuri

- Blog

- corp

- Bot

- atât

- roboţii

- aduce

- construi

- Clădire

- construit

- afaceri

- dar

- buton

- by

- calcule

- calendare

- apel

- apeluri

- CAN

- nu poti

- capacități

- caz

- cazuri

- taxe

- chatbot

- verifica

- Alege

- ales

- client

- combină

- Companii

- Completă

- Terminat

- complex

- complexitate

- componente

- cuprinzător

- calculator

- Informatică

- Concepte

- încheia

- configurat

- Lua în considerare

- Considerații

- Consoleze

- constant

- context

- continua

- de conversaţie

- AI de conversație

- Nucleu

- A costat

- ar putea

- crea

- a creat

- greoaie

- personalizat

- de date

- Baza de date

- baze de date

- seturi de date

- Zi

- decide

- dedicat

- Mai adânc

- Mod implicit

- Definitii

- Demo

- demonstra

- În funcție

- implementa

- dislocate

- Implementarea

- desfășurarea

- implementează

- Instrumentele financiare derivate

- proiectat

- detaliu

- detalii

- Determina

- Dezvoltare

- Dispozitive

- direct

- discutat

- scufunda

- do

- face

- făcut

- conduce

- e

- e-commerce

- fiecare

- cu ușurință

- uşor

- în mod eficient

- oricare

- altfel

- angajează

- un capăt la altul

- Punct final

- aplicarea

- Inginerie

- spori

- asigura

- asigurat

- asigură

- asigurare

- intrarea

- Intitulat

- eroare

- Erori

- scăpa

- mai ales

- etc

- eveniment

- Fiecare

- exemplu

- exemple

- Cu excepția

- excepție

- a executa

- exista

- aștepta

- experienţă

- explorat

- extinde

- extinde

- extern

- suplimentar

- extracte

- FAIL

- fals

- Modă

- Caracteristică

- puțini

- Domenii

- filtru

- final

- debit

- Concentra

- următor

- urmează

- Pentru

- format

- formulare

- găsit

- Fundație

- cadre

- prietenos

- din

- Îndeplini

- complet

- funcţie

- funcționalități

- funcții

- viitor

- în general

- genera

- generată

- generaţie

- generativ

- AI generativă

- obține

- dat

- Go

- Teren

- ghida

- lucru

- trape

- Avea

- având în

- he

- ajutor

- a ajutat

- ajutor

- prin urmare

- aici

- hi

- Înalt

- extrem de

- deține

- ORE

- Cum

- Cum Pentru a

- HTML

- http

- HTTPS

- Butuc

- uman

- uman poate fi citit

- i

- ID

- if

- Impactul

- punerea în aplicare a

- implementarea

- importurile

- îmbunătăţi

- in

- include

- care încorporează

- Crește

- crescând

- informații

- intrare

- anchetă

- în interiorul

- instrucțiuni

- integrate

- integreaza

- integrare

- scop

- interacţiona

- interacționând

- interacţiuni

- interes

- în

- introduce

- introdus

- invocat

- invocă

- implica

- IT

- articole

- iterații

- aderarea

- jpg

- JSON

- Cheie

- cunoştinţe

- limbă

- mare

- lansa

- AFLAȚI

- Nivel

- ca

- limitări

- Limitele

- Listă

- LLM

- logică

- Lung

- Se pare

- face

- FACE

- gestionate

- administrare

- manager

- multe

- Mai..

- me

- însemna

- mecanism

- mecanisme

- reuniuni

- mesaj

- Metadata

- minute

- Mobil

- dispozitive mobile

- model

- Modele

- mai mult

- Morgan

- Morgan Stanley

- cele mai multe

- multiplu

- my

- nume

- Numit

- nume

- nativ

- Navigaţi

- navigând

- Navigare

- necesar

- Nevoie

- necesar

- Nou

- următor

- Nu.

- Nici unul

- în special

- acum

- număr

- numeroși

- obiect

- of

- de multe ori

- on

- dată

- ONE

- afară

- opus

- or

- comandă

- comenzilor

- Altele

- in caz contrar

- al nostru

- afară

- producție

- exterior

- peste

- Învinge

- Prezentare generală

- pagină

- pâine

- parametrii

- trece

- pasionat

- Model

- pace

- în așteptarea

- Efectua

- performanță

- alege

- ales

- plan

- planificare

- Plato

- Informații despre date Platon

- PlatoData

- "vă rog"

- Plugin-uri

- Politica

- Post

- putere

- alimentat

- practică

- prezice

- prezicere

- premise

- împiedica

- Anunţ

- precedent

- anterior

- proces

- Procesat

- prelucrare

- Produs

- dezvoltare de produs

- manager de produs

- producere

- Program

- Programe

- cum se cuvine

- furniza

- prevăzut

- furnizează

- furnizarea

- scopuri

- Piton

- întrebare

- Întrebări

- Rapid

- ridica

- repede

- Crud

- lumea reală

- rezonabil

- recunoaște

- rambursa

- regiune

- încredere

- rămășițe

- îndepărtat

- eliminarea

- reprezentare

- solicita

- cereri de

- necesita

- necesar

- Necesită

- resursă

- Resurse

- Răspunde

- răspuns

- responsabilitate

- responsabil

- rezultat

- reveni

- revenind

- Returnează

- dreapta

- router

- rutare

- Alerga

- funcţionare

- s

- sagemaker

- satisfăcut

- scalabil

- scenariu

- Ştiinţă

- domeniu

- Caută

- pare

- selectate

- selecţie

- autodirectat

- sens

- distinct

- Secvenţă

- serviciu

- Servicii

- set

- câteva

- expediate

- Livrarea

- Pantaloni scurți

- shot

- să

- Arăta

- indicat

- simplu

- simplifica

- pur şi simplu

- singur

- mic

- So

- Software

- soluţie

- unele

- sofisticat

- Sursă

- Surse

- special

- de specialitate

- specific

- specificație

- stivui

- standalone

- stanford

- Universitatea Stanford

- Stanley

- Începe

- început

- Declarație

- Stare

- Pas

- paşi

- Stop

- stoca

- strategii

- Strategie

- Şir

- structurarea

- Ulterior

- succes

- Reușit

- astfel de

- sugera

- potrivit

- a sustine

- sigur

- sisteme

- tabel

- Lua

- luate

- ia

- luare

- Sarcină

- sarcini

- spune

- test

- testat

- Testarea

- teste

- acea

- Viitorul

- lor

- apoi

- Acolo.

- Acestea

- acest

- aceste

- trei

- Prin urmare

- ori

- la

- indicativele

- de asemenea

- instrument

- Unelte

- top

- Total

- urmări

- comerciant

- tradiţional

- dresat

- a declanșat

- încerca

- Două

- tipic

- tipic

- ui

- universitate

- inutil

- până la

- actualizări

- actualizarea

- utilizare

- utilizat

- Utilizator

- utilizări

- folosind

- folosi

- VALIDA

- validare

- varietate

- versiune

- de

- aștepta

- a fost

- Cale..

- we

- Vreme

- web

- servicii web

- site-uri web

- BINE

- Ce

- Ce este

- cand

- oricând

- dacă

- care

- în timp ce

- OMS

- voi

- cu

- în

- fără

- fabrică

- lume

- ar

- yaml

- Tu

- Ta

- te

- zephyrnet