Implementarea unor sisteme AI puternice ne-a îmbogățit înțelegerea siguranței și a utilizării greșite mult mai mult decât ar fi fost posibil doar prin cercetare. În special:

- Utilizarea greșită a modelului de limbaj bazat pe API vine adesea în forme diferite decât ne temeam cel mai mult.

- Am identificat limitări în evaluările modelelor de limbaj existente pe care le abordăm cu noi repere și clasificatoare.

- Cercetarea de bază a siguranței oferă beneficii semnificative pentru utilitatea comercială a sistemelor AI.

Aici, descriem cea mai recentă gândire a noastră în speranța de a ajuta alți dezvoltatori AI să abordeze siguranța și utilizarea greșită a modelelor implementate.

Oîn ultimii doi ani, am învățat multe despre modul în care modelele lingvistice pot fi utilizate și abuzate - informații pe care nu le-am fi putut obține fără experiența implementării în lumea reală. În iunie 2020, am început să oferim acces dezvoltatorilor și cercetătorilor la API OpenAI, o interfață pentru accesarea și construirea de aplicații pe deasupra noilor modele AI dezvoltate de OpenAI. Implementarea GPT-3, Codex și a altor modele într-un mod care reduce riscurile de vătămare a pus diverse provocări tehnice și politice.

Prezentare generală a abordării noastre de implementare a modelului

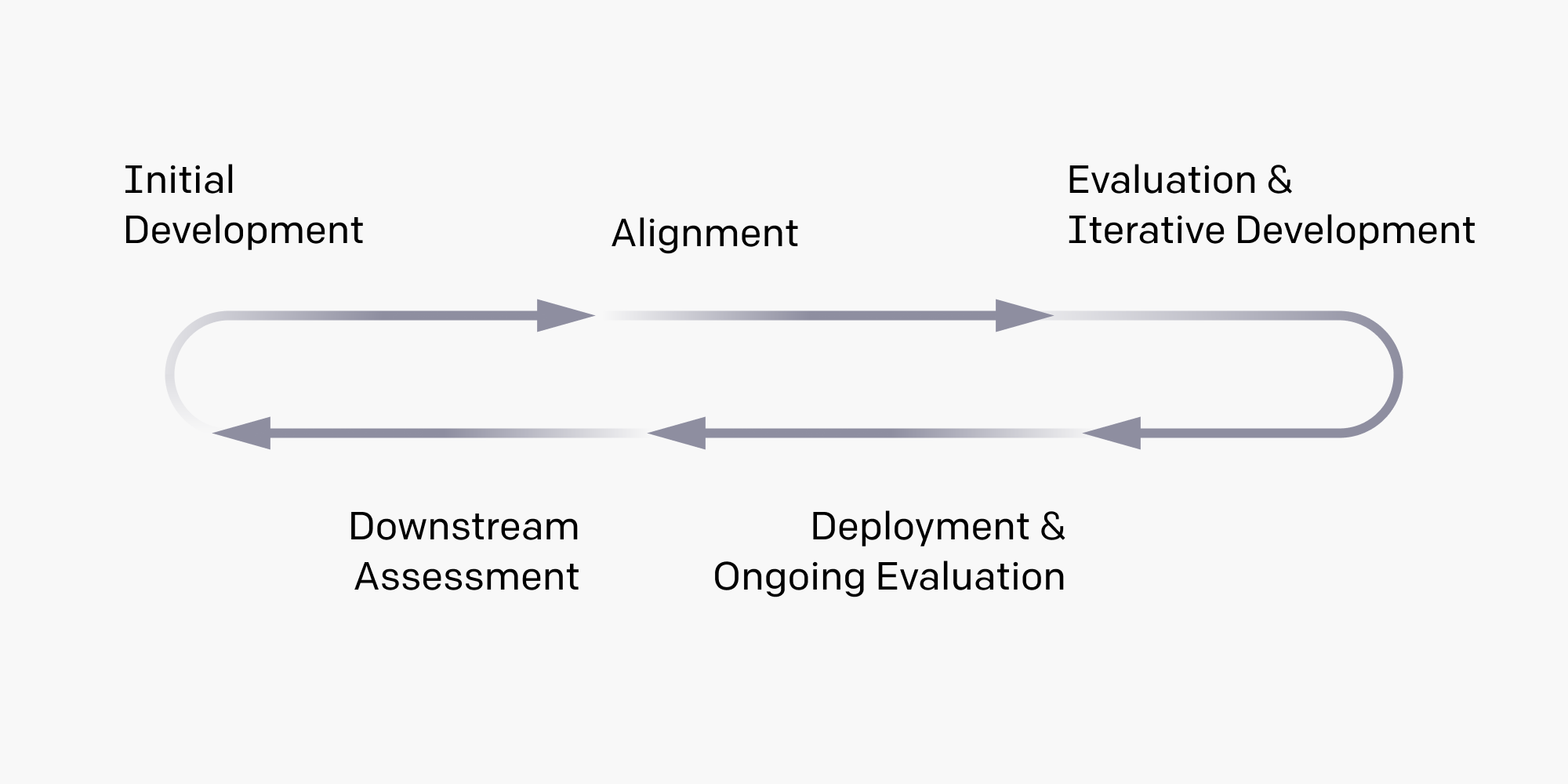

Modelele de limbaj mari sunt acum capabile să realizeze a gamă foarte largă de sarcini, adesea scoase din cutie. Profilurile lor de risc, aplicațiile potențiale și efectele mai ample asupra societății rămâne slab înțeles. Ca rezultat, abordarea noastră de implementare pune accent pe iterația continuă și utilizează următoarele strategii menite să maximizeze beneficiile implementării, reducând în același timp riscurile asociate:

- Analiza riscului înainte de implementare, utilizând un set tot mai mare de evaluări de siguranță și instrumente de echipă roșie (de exemplu, ne-am verificat InstructGPT pentru orice degradări ale siguranței folosind evaluările discutat mai jos)

- Începând cu o bază mică de utilizatori (de exemplu, atât GPT-3, cât și programul nostru InstructGPT seria a început ca beta private)

- Studierea rezultatelor pilotilor de cazuri noi de utilizare (de exemplu, explorarea condițiilor în care am putea activa în siguranță generarea de conținut lung, lucrând cu un număr mic de clienți)

- Implementarea proceselor care ajută la menținerea pulsului asupra utilizării (de exemplu, revizuirea cazurilor de utilizare, cotele de simboluri și limitele de rată)

- Efectuarea de revizuiri retrospective detaliate (de exemplu, a incidentelor de siguranță și a implementărilor majore)

Rețineți că această diagramă este destinată să transmită vizual nevoia de bucle de feedback în procesul continuu de dezvoltare și implementare a modelului și faptul că siguranța trebuie integrată în fiecare etapă. Nu este destinat să transmită o imagine completă sau ideală a procesului nostru sau al oricărei alte organizații.

Nu există nicio soluție pentru o implementare responsabilă, așa că încercăm să aflăm și să abordăm limitările modelelor noastre și posibilele căi de utilizare greșită, în fiecare etapă de dezvoltare și implementare. Această abordare ne permite să învățăm cât de mult putem despre problemele de siguranță și politici la scară mică și să încorporăm aceste informații înainte de a lansa implementări la scară mai mare.

Deși nu sunt exhaustive, unele domenii în care am investit până acum includ[1]:

- Pre-antrenament de date curatare si filtrare

- Reglaj fin modele la mai bune urmează instrucțiunile

- Analiza riscului implementărilor potențiale

- Furnizarea utilizatorului detaliat documentaţie

- Clădire Unelte pentru a monitoriza rezultatele dăunătoare ale modelului

- Examinarea cazurilor de utilizare împotriva noastră Politicile

- Monitorizare pentru semne de folosire greșită

- Studiind impactul modelelor noastre

Deoarece fiecare etapă de intervenție are limitări, este necesară o abordare holistică.

Sunt domenii în care am fi putut face mai mult și în care mai avem loc de îmbunătățire. De exemplu, când am lucrat pentru prima dată la GPT-3, l-am văzut mai degrabă ca pe un artefact intern de cercetare decât ca pe un sistem de producție și nu am fost la fel de agresivi în filtrarea datelor de antrenament toxice cum am fi fost altfel. Am investit mai mult în cercetarea și eliminarea unui astfel de material pentru modelele ulterioare. Ne-a luat mai mult timp să abordăm unele cazuri de utilizare abuzivă în cazurile în care nu aveam politici clare pe acest subiect și am reușit să repetăm acele politici. Și continuăm să iterăm către un pachet de cerințe de siguranță care este la maximum eficient în abordarea riscurilor, fiind, de asemenea, comunicați în mod clar dezvoltatorilor și minimizând frecarea excesivă.

Totuși, credem că abordarea noastră ne-a permis să măsurăm și să reducem diferite tipuri de daune cauzate de utilizarea modelului lingvistic, în comparație cu o abordare mai „hands-off”, permițând, în același timp, o gamă largă de aplicații academice, artistice și comerciale ale noastre. modele.[2]

Multe forme și dimensiuni ale utilizării greșite a modelului de limbaj

OpenAI a fost activ în cercetarea riscurilor de utilizare abuzivă a AI încă de la începutul lucrărilor noastre asupra utilizarea rău intenționată a AI în 2018 şi pe GPT-2 în 2019 și am acordat o atenție deosebită sistemelor AI care împuternicesc operațiunile de influență. Avem lucrat cu experți externi de dezvoltat dovezi de concept si promovat atent analiză a unor astfel de riscuri de către terți. Rămânem angajați să abordăm riscurile asociate cu operațiunile de influență bazate pe modelul lingvistic și recent am co-organizat un atelier pe acest subiect.[3]

Cu toate acestea, am detectat și am oprit sute de actori care încearcă să utilizeze greșit GPT-3 într-o gamă mult mai largă de scopuri decât producerea dezinformarii pentru operațiuni de influență, inclusiv în moduri pe care fie nu le-am anticipat, fie pe care le-am anticipat, dar nu ne așteptam să fie. atât de răspândită.[4] Our ghiduri pentru cazuri de utilizare, liniile directoare privind conținutul, iar infrastructura internă de detectare și răspuns au fost inițial orientate către riscuri pe care le-am anticipat pe baza cercetărilor interne și externe, cum ar fi generarea de conținut politic înșelător cu GPT-3 sau generarea de malware cu Codex. Eforturile noastre de detectare și răspuns au evoluat de-a lungul timpului ca răspuns la cazurile reale de utilizare greșită întâlnite „în sălbăticie” care nu au fost la fel de proeminente precum operațiunile de influență în evaluările noastre inițiale de risc. Exemplele includ promoții de spam pentru produse medicale dubioase și jocuri de rol ale fanteziei rasiste.

Pentru a sprijini studiul utilizării abuzive a modelului lingvistic și atenuării acestora, explorăm în mod activ oportunitățile de a împărtăși statistici privind incidentele de siguranță în acest an, pentru a concretiza discuțiile despre utilizarea abuzivă a modelului lingvistic.

Dificultatea de a măsura riscul și impactul

Multe aspecte ale riscurilor și impactului modelelor lingvistice rămân greu de măsurat și, prin urmare, greu de monitorizat, minimizat și dezvăluit într-un mod responsabil. Am folosit în mod activ reperele academice existente pentru evaluarea modelelor lingvistice și suntem dornici să continuăm să construim pe munca externă, dar am constatat, de asemenea, că seturile de date de referință existente nu reflectă adesea riscurile de siguranță și utilizare greșită pe care le vedem în practică.[5]

Astfel de limitări reflectă faptul că seturile de date academice sunt rareori create în scopul explicit de a informa utilizarea modelelor lingvistice în producție și nu beneficiază de experiența dobândită în urma implementării unor astfel de modele la scară. Drept urmare, am dezvoltat noi seturi de date de evaluare și cadre pentru măsurarea siguranței modelelor noastre, pe care intenționăm să le lansăm în curând. Mai exact, am dezvoltat noi valori de evaluare pentru măsurarea toxicității în rezultatele modelului și am dezvoltat, de asemenea, clasificatoare interne pentru detectarea conținutului care încalcă politica de conținut, cum ar fi conținutul erotic, discursul instigator la ură, violența, hărțuirea și autovătămarea. Ambele, la rândul lor, au fost, de asemenea, valorificate pentru îmbunătățirea datelor noastre înainte de antrenament[6]— în mod specific, prin utilizarea clasificatoarelor pentru a filtra conținutul și a parametrilor de evaluare pentru a măsura efectele intervențiilor setului de date.

Clasificarea fiabilă a rezultatelor modelului individual de-a lungul diferitelor dimensiuni este dificilă, iar măsurarea impactului lor social la scara API-ului OpenAI este și mai dificilă. Am efectuat mai multe studii interne pentru a construi un mușchi instituțional pentru o astfel de măsurare, dar acestea au ridicat adesea mai multe întrebări decât răspunsuri.

Ne interesează în special să înțelegem mai bine impactul economic al modelelor noastre și distribuția acestor impacturi. Avem motive întemeiate să credem că impactul pe piața muncii de la implementarea modelelor actuale poate fi deja semnificativ în termeni absoluti și că ele vor crește pe măsură ce capacitățile și acoperirea modelelor noastre cresc. Am aflat de o varietate de efecte locale până în prezent, inclusiv îmbunătățiri masive ale productivității asupra sarcinilor existente efectuate de persoane, cum ar fi redactarea și rezumatul (care contribuie uneori la înlocuirea și crearea locurilor de muncă), precum și cazuri în care API-ul a deblocat noi aplicații care anterior nu erau fezabile. , ca sinteza feedback-ului calitativ la scară largă. Dar ne lipsește o bună înțelegere a efectelor nete.

Credem că este important ca cei care dezvoltă și implementează tehnologii AI puternice să abordeze atât efectele pozitive, cât și cele negative ale muncii lor direct. Discutăm câțiva pași în această direcție în secțiunea finală a acestei postări.

Relația dintre siguranța și utilitatea sistemelor AI

În nostru Cartă, publicat în 2018, spunem că „suntem îngrijorați de faptul că dezvoltarea AGI în faza avansată devine o cursă competitivă fără timp pentru măsuri de siguranță adecvate”. Atunci noi publicat o analiză detaliată a dezvoltării AI competiționale și am urmărit-o îndeaproape ulterior cercetare. În același timp, implementarea sistemelor AI prin intermediul API-ului OpenAI ne-a aprofundat și înțelegerea sinergiilor dintre siguranță și utilitate.

De exemplu, dezvoltatorii preferă în mod covârșitor modelele noastre InstructGPT — care sunt reglate fin pentru a urma intențiile utilizatorilor[7]— peste modelele de bază GPT-3. În mod remarcabil, totuși, modelele InstructGPT nu au fost inițial motivate de considerente comerciale, ci mai degrabă vizau realizarea de progrese pe termen lung. probleme de aliniere. În termeni practici, acest lucru înseamnă că clienții, poate nu este surprinzător, preferă cu mult modelele care rămân la sarcină și înțeleg intenția utilizatorului și modelele care sunt mai puțin susceptibile de a produce rezultate dăunătoare sau incorecte.[8] Alte cercetări fundamentale, cum ar fi munca noastră asupra valorificarea informațiilor preluat de pe Internet pentru a răspunde la întrebări mai sincer, are și potențialul de a îmbunătăți utilitatea comercială a sistemelor AI.[9]

Aceste sinergii nu vor apărea întotdeauna. De exemplu, sistemele mai puternice vor necesita adesea mai mult timp pentru a evalua și a alinia eficient, excluzând oportunitățile imediate de profit. Și utilitatea unui utilizator și cea a societății pot să nu fie aliniate din cauza externalităților negative - luați în considerare redactarea complet automatizată, care poate fi benefică pentru creatorii de conținut, dar dăunătoare pentru ecosistemul informațional în ansamblu.

Este încurajator să vedem cazuri de sinergie puternică între siguranță și utilitate, dar ne-am hotărât să investim în cercetarea în materie de siguranță și politici, chiar și atunci când acestea fac schimb cu utilitatea comercială.

Modalități de a te implica

Fiecare dintre lecțiile de mai sus ridică noi întrebări proprii. Ce tipuri de incidente de siguranță este posibil să nu reușim să detectăm și să anticipăm? Cum putem măsura mai bine riscurile și impactul? Cum putem continua să îmbunătățim atât siguranța, cât și utilitatea modelelor noastre și cum putem naviga în compromisuri între acestea două atunci când apar?

Discutăm în mod activ multe dintre aceste probleme cu alte companii care implementează modele lingvistice. Dar știm, de asemenea, că nicio organizație sau set de organizații nu are toate răspunsurile și am dori să evidențiem câteva moduri prin care cititorii se pot implica mai mult în înțelegerea și modelarea implementării noastre de sisteme AI de ultimă generație.

În primul rând, dobândirea experienței directe în interacțiunea cu sistemele AI de ultimă generație este de neprețuit pentru înțelegerea capacităților și implicațiilor acestora. Recent, am încheiat lista de așteptare API după ce ne-am dobândit mai multă încredere în capacitatea noastră de a detecta și de a răspunde eficient la utilizarea necorespunzătoare. Persoanele din țările și teritoriile sprijinite pot obține rapid acces la API-ul OpenAI prin înscriere aici.

În al doilea rând, cercetătorii care lucrează pe subiecte de interes special pentru noi, cum ar fi părtinirea și utilizarea abuzivă și care ar beneficia de sprijin financiar, pot aplica pentru credite API subvenționate folosind acest formular. Cercetarea externă este vitală pentru a informa atât înțelegerea noastră a acestor sisteme cu mai multe fațete, cât și pentru înțelegerea publică mai largă.

În sfârșit, astăzi publicăm un agenda de cercetare explorarea impactului pieței muncii asociate cu familia noastră de modele Codex și un apel pentru colaboratori externi pentru realizarea acestei cercetări. Suntem încântați să lucrăm cu cercetători independenți pentru a studia efectele tehnologiilor noastre pentru a informa intervențiile politice adecvate și, în cele din urmă, pentru a ne extinde gândirea de la generarea de cod la alte modalități.

Dacă sunteți interesat să lucrați pentru a implementa în mod responsabil tehnologiile AI de ultimă oră, aplica să lucrez la OpenAI!

- 2019

- 2020

- 7

- 9

- Despre Noi

- Absolut

- acces

- activ

- adresa

- adresare

- Avantajele

- AI

- TOATE

- deja

- amplificând

- analiză

- api

- aplicabil

- aplicație

- aplicatii

- abordare

- Artă

- Automata

- fiind

- Benchmark

- Beneficiile

- Berkeley

- Cutie

- construi

- Clădire

- apel

- Cambridge

- Poate obține

- capacități

- purtător

- cazuri

- contesta

- provocări

- cod

- comercial

- Companii

- comparație

- component

- încredere

- Recipient

- conţinut

- continua

- Control

- Cheltuieli

- ar putea

- țări

- Creatorii

- credite

- Curent

- clienţii care

- ultima generație

- de date

- implementa

- Implementarea

- desfășurarea

- detectat

- Detectare

- dezvolta

- dezvoltat

- Dezvoltator

- Dezvoltatorii

- în curs de dezvoltare

- Dezvoltare

- FĂCUT

- diferi

- diferit

- Dimensiune

- discuta

- distribuire

- Devreme

- Economic

- Impact economic

- ecosistem

- efect

- Eficace

- efecte

- împuternicirea

- permițând

- Fii încurajator.

- angajament

- îmbogățit

- exemplu

- Extinde

- aștepta

- cheltuieli

- experienţă

- experți

- Eșec

- familie

- Caracteristică

- feedback-ul

- financiar

- First

- Concentra

- concentrat

- urma

- următor

- formă

- formulare

- găsit

- Complet

- Gen

- Oferirea

- bine

- Crește

- În creştere

- Sănătate

- ajutor

- util

- Evidențiați

- Cum

- Cum Pentru a

- HTTPS

- sute

- Impactul

- important

- îmbunătăţi

- include

- inclus

- Inclusiv

- individ

- influență

- informații

- Infrastructură

- perspective

- Instituţional

- integrate

- scop

- interes

- interfaţă

- Internet

- investind

- implicat

- probleme de

- IT

- Loc de munca

- etichetarea

- muncă

- limbă

- Ultimele

- lansare

- AFLAȚI

- învățat

- Lectii invatate

- mic

- local

- Lung

- major

- Efectuarea

- malware

- manual

- Piață

- masiv

- măsura

- medical

- De sănătate mintală

- Metrici

- model

- Modele

- cele mai multe

- net

- promoții

- deschide

- open-source

- Operațiuni

- Oportunităţi

- comandă

- organizație

- organizații

- Altele

- in caz contrar

- plătit

- oameni

- poate

- perspectivă

- imagine

- pilot

- Politicile

- Politica

- politic

- posibil

- puternic

- privat

- proces

- procese

- produce

- producere

- productivitate

- Produse

- Profiluri

- Profit

- public

- Editare

- scop

- scopuri

- repede

- Rasă

- ridică

- gamă

- RE

- cititori

- reduce

- reducerea

- reflecta

- relaţie

- eliberaţi

- Cerinţe

- cercetare

- răspuns

- responsabil

- restricții

- REZULTATE

- revizuiască

- Recenzii

- Risc

- Riscurile

- Siguranţă

- economisire

- Scară

- Ecran

- caută

- serie

- set

- forme

- Distribuie

- semnificativ

- Semne

- Silver

- mic

- So

- Social

- Societate

- Spaţiu

- spam-

- specific

- Etapă

- Stat

- statistică

- şedere

- strategii

- puternic

- studiu

- Studiu

- stil

- a sustine

- sistem

- sisteme

- sarcini

- Tehnic

- Tehnologii

- Gândire

- terțe părți

- Prin

- timp

- astăzi

- semn

- Unelte

- top

- subiecte

- comerţului

- Pregătire

- Transforma

- înţelege

- us

- utilizare

- utilizatorii

- utilitate

- Ce

- OMS

- fără

- Apartamente

- a lucrat

- de lucru

- scris

- an