Cercetătorii continuă să dezvolte noi arhitecturi model pentru sarcini comune de învățare automată (ML). O astfel de sarcină este clasificarea imaginilor, unde imaginile sunt acceptate ca intrare și modelul încearcă să clasifice imaginea ca un întreg cu ieșiri ale etichetei obiectului. Cu multe modele disponibile astăzi care efectuează această sarcină de clasificare a imaginilor, un practician ML poate pune întrebări precum: „Ce model ar trebui să ajustez fin și apoi să implementez pentru a obține cea mai bună performanță pe setul meu de date?” Și un cercetător ML poate pune întrebări de genul: „Cum îmi pot genera propria comparație corectă a mai multor arhitecturi model față de un set de date specificat în timp ce controlez hiperparametrii de antrenament și specificațiile computerului, cum ar fi GPU-uri, procesoare și RAM?” Prima întrebare se referă la selecția modelului în arhitecturile modelului, în timp ce cea de-a doua întrebare se referă la compararea modelelor antrenate în raport cu un set de date de testare.

În această postare, veți vedea cum Clasificarea imaginii TensorFlow algoritm de Amazon SageMaker JumpStart poate simplifica implementările necesare pentru a răspunde acestor întrebări. Împreună cu detaliile de implementare într-un corespondent exemplu de caiet Jupyter, veți avea la dispoziție instrumente pentru a efectua selecția modelului prin explorarea frontierelor pareto, unde îmbunătățirea unei valori de performanță, cum ar fi acuratețea, nu este posibilă fără înrăutățirea unei alte valori, cum ar fi debitul.

Prezentare generală a soluțiilor

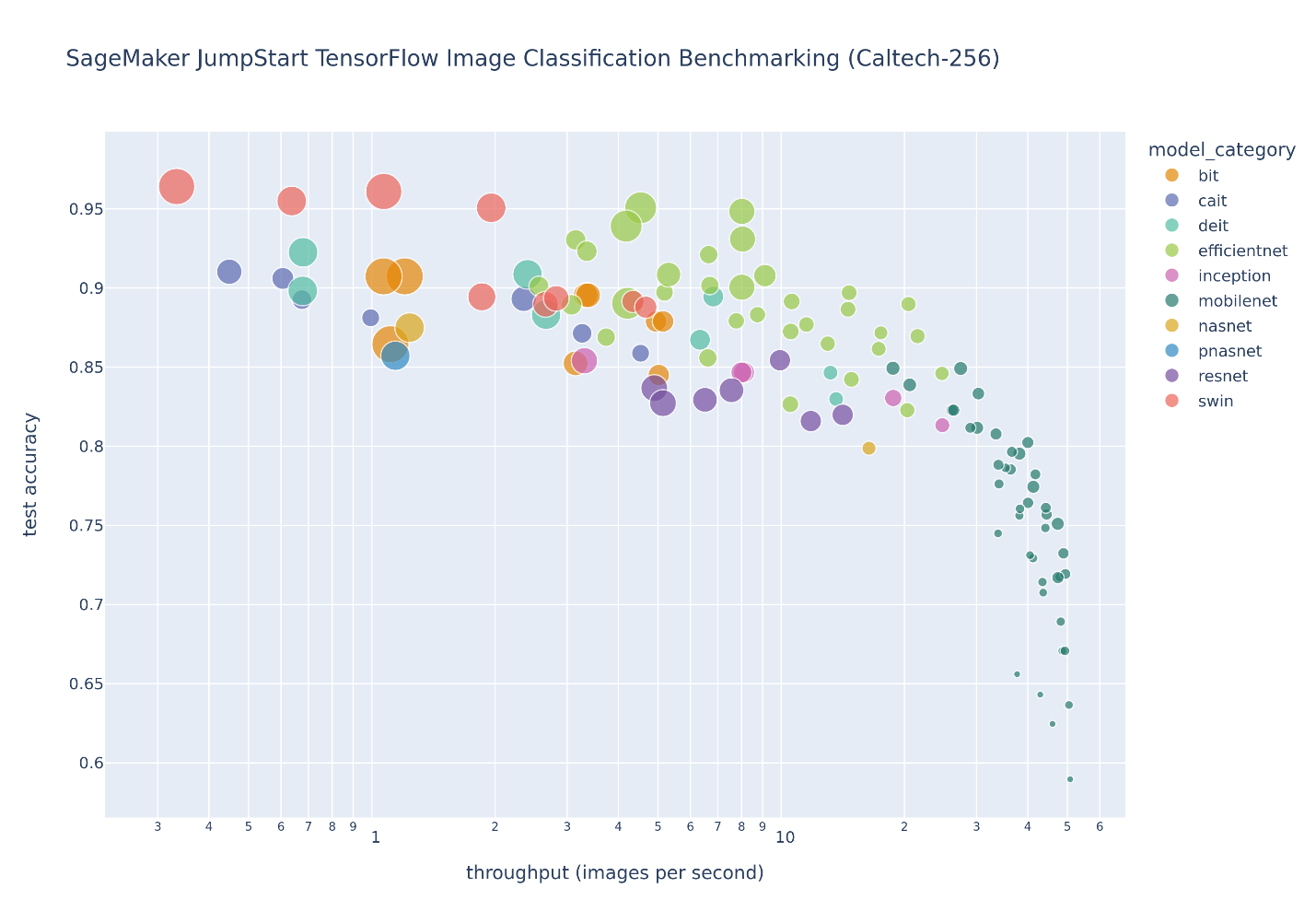

Următoarea figură ilustrează compromisul de selecție a modelului pentru un număr mare de modele de clasificare a imaginilor reglate fin pe Caltech-256 set de date, care este un set provocator de 30,607 de imagini din lumea reală care acoperă 256 de categorii de obiecte. Fiecare punct reprezintă un singur model, dimensiunile punctelor sunt scalate în funcție de numărul de parametri care cuprind modelul, iar punctele sunt codificate cu culori pe baza arhitecturii modelului lor. De exemplu, punctele de culoare verde deschis reprezintă arhitectura EfficientNet; fiecare punct verde deschis este o configurație diferită a acestei arhitecturi cu măsurători unice ale performanței modelului. Figura arată existența unei frontiere pareto pentru selecția modelului, unde o precizie mai mare este schimbată cu un randament mai mic. În cele din urmă, selecția unui model de-a lungul frontierei pareto sau a setului de soluții eficiente Pareto, depinde de cerințele de performanță de implementare a modelului dvs.

Dacă observați acuratețea testului și frontierele de debit de testare de interes, setul de soluții eficiente pareto din figura anterioară sunt extrase în tabelul următor. Rândurile sunt sortate astfel încât randamentul testului să crească și precizia testului să scadă.

| Nume model | Numărul de parametri | Precizia testului | Testează acuratețea Top 5 | Debit (imagini/e) | Durata pe epocă(e) |

| swin-large-patch4-window12-384 | 195.6M | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-large-patch4-window7-224 | 195.4M | 96.1% | 99.5% | 1.1 | 698.0 |

| efficientnet-v2-imagenet21k-ft1k-l | 118.1M | 95.1% | 99.2% | 4.5 | 1434.7 |

| efficientnet-v2-imagenet21k-ft1k-m | 53.5M | 94.8% | 99.1% | 8.0 | 769.1 |

| efficientnet-v2-imagenet21k-m | 53.5M | 93.1% | 98.5% | 8.0 | 765.1 |

| eficientnet-b5 | 29.0M | 90.8% | 98.1% | 9.1 | 668.6 |

| efficientnet-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% | 97.3% | 14.6 | 54.3 |

| efficientnet-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% | 97.0% | 20.5 | 38.3 |

| efficientnet-v2-imagenet21k-b0 | 6.2M | 87.0% | 95.6% | 21.5 | 38.2 |

| mobilenet-v3-large-100-224 | 4.6M | 84.9% | 95.4% | 27.4 | 28.8 |

| mobilenet-v3-large-075-224 | 3.1M | 83.3% | 95.2% | 30.3 | 26.6 |

| mobilenet-v2-100-192 | 2.6M | 80.8% | 93.5% | 33.5 | 23.9 |

| mobilenet-v2-100-160 | 2.6M | 80.2% | 93.2% | 40.0 | 19.6 |

| mobilenet-v2-075-160 | 1.7M | 78.2% | 92.8% | 41.8 | 19.3 |

| mobilenet-v2-075-128 | 1.7M | 76.1% | 91.1% | 44.3 | 18.3 |

| mobilenet-v1-075-160 | 2.0M | 75.7% | 91.0% | 44.5 | 18.2 |

| mobilenet-v1-100-128 | 3.5M | 75.1% | 90.7% | 47.4 | 17.4 |

| mobilenet-v1-075-128 | 2.0M | 73.2% | 90.0% | 48.9 | 16.8 |

| mobilenet-v2-075-96 | 1.7M | 71.9% | 88.5% | 49.4 | 16.6 |

| mobilenet-v2-035-96 | 0.7M | 63.7% | 83.1% | 50.4 | 16.3 |

| mobilenet-v1-025-128 | 0.3M | 59.0% | 80.7% | 50.8 | 16.2 |

Această postare oferă detalii despre cum să implementați la scară largă Amazon SageMaker sarcini de benchmarking și de selecție a modelelor. În primul rând, introducem JumpStart și algoritmii de clasificare a imaginilor TensorFlow încorporați. Apoi discutăm despre considerente de implementare la nivel înalt, cum ar fi configurațiile de hiperparametru JumpStart, extragerea de metrici din Jurnalele Amazon CloudWatchși lansarea lucrărilor de reglare a hiperparametrului asincron. În cele din urmă, acoperim mediul de implementare și parametrizarea care duce la soluțiile eficiente Pareto din tabelul și figura precedente.

Introducere în clasificarea imaginilor JumpStart TensorFlow

JumpStart oferă o reglare fină și implementare cu un singur clic a unei game largi de modele pregătite în prealabil pentru sarcinile ML populare, precum și o selecție de soluții end-to-end care rezolvă problemele comune de afaceri. Aceste caracteristici îndepărtează sarcinile grele din fiecare pas al procesului ML, facilitând dezvoltarea modelelor de înaltă calitate și reducând timpul până la implementare. The API-uri JumpStart vă permit să implementați și să reglați în mod programatic o selecție vastă de modele pre-antrenate pe propriile seturi de date.

Hub-ul model JumpStart oferă acces la un număr mare de Modele de clasificare a imaginilor TensorFlow care permit învățarea transferului și reglarea fină a seturilor de date personalizate. În momentul scrierii acestui articol, centrul de modele JumpStart conține 135 de modele de clasificare a imaginilor TensorFlow într-o varietate de arhitecturi de model populare de la TensorFlow Hub, pentru a include rețelele reziduale (ResNet), MobileNet, EfficientNet, Inception, Rețele de căutare în arhitectură neuronală (NASNet), Transfer mare (Pic), fereastra deplasată (Porcine) transformatoare, Class-Atention in Image Transformers (CaiT) și transformatoare de imagine eficiente pentru date (DeiT).

Structuri interne foarte diferite cuprind fiecare arhitectură model. De exemplu, modelele ResNet utilizează conexiuni de ignorare pentru a permite rețele mult mai profunde, în timp ce modelele bazate pe transformatoare utilizează mecanisme de auto-atenție care elimină localitatea intrinsecă a operațiilor de convoluție în favoarea câmpurilor receptive mai globale. Pe lângă seturile diverse de caracteristici oferite de aceste structuri diferite, fiecare arhitectură de model are mai multe configurații care ajustează dimensiunea, forma și complexitatea modelului în cadrul acelei arhitecturi. Rezultă sute de modele unice de clasificare a imaginilor disponibile pe hub-ul de modele JumpStart. Combinat cu scripturi de învățare și inferență de transfer încorporate care cuprind multe funcții SageMaker, JumpStart API este un punct de lansare excelent pentru practicanții ML pentru a începe instruirea și implementarea modelelor rapid.

A se referi la Transferați învățarea pentru modelele de clasificare a imaginilor TensorFlow în Amazon SageMaker si urmatoarele exemplu caiet pentru a afla mai în profunzime despre clasificarea imaginilor SageMaker TensorFlow, inclusiv cum să rulați inferența pe un model pre-antrenat, precum și cum să reglați modelul pre-antrenat pe un set de date personalizat.

Considerații de selecție a modelelor la scară largă

Selecția modelului este procesul de selectare a celui mai bun model dintr-un set de modele candidate. Acest proces poate fi aplicat asupra modelelor de același tip cu greutăți diferite ale parametrilor și asupra modelelor de tipuri diferite. Exemplele de selecție a modelelor între modele de același tip includ potrivirea aceluiași model cu hiperparametri diferiți (de exemplu, rata de învățare) și oprirea timpurie pentru a preveni supraadaptarea greutăților modelului la setul de date al trenului. Selectarea modelelor pentru modele de diferite tipuri include selectarea celei mai bune arhitecturi de model (de exemplu, Swin vs. MobileNet) și selectarea celor mai bune configurații de model într-o singură arhitectură de model (de exemplu, mobilenet-v1-025-128 Raport mobilenet-v3-large-100-224).

Considerațiile prezentate în această secțiune permit toate aceste procese de selecție a modelului pe un set de date de validare.

Selectați configurațiile hiperparametrilor

Clasificarea imaginilor TensorFlow în JumpStart are un număr mare de imagini disponibile hiperparametri care poate ajusta comportamentele scriptului de învățare de transfer în mod uniform pentru toate arhitecturile model. Acești hiperparametri se referă la creșterea și preprocesarea datelor, specificațiile optimizatorului, controalele de supraadaptare și indicatorii de strat antrenabili. Sunteți încurajat să ajustați valorile implicite ale acestor hiperparametri după cum este necesar pentru aplicația dvs.:

Pentru această analiză și pentru notebook-ul asociat, toți hiperparametrii sunt setați la valori implicite, cu excepția ratei de învățare, a numărului de epoci și a specificației de oprire timpurie. Rata de învățare este ajustată ca a parametru categoric langa Ajustarea automată a modelului SageMaker loc de munca. Deoarece fiecare model are valori unice implicite de hiperparametru, lista discretă a ratelor de învățare posibile include rata de învățare implicită, precum și o cincime din rata de învățare implicită. Aceasta lansează două joburi de instruire pentru un singur job de reglare a hiperparametrului și este selectat jobul de antrenament cu cea mai bună performanță raportată pe setul de date de validare. Deoarece numărul de epoci este setat la 10, ceea ce este mai mare decât setarea implicită a hiperparametrului, cea mai bună lucrare de antrenament selectată nu corespunde întotdeauna cu rata de învățare implicită. În cele din urmă, un criteriu de oprire timpurie este utilizat cu o răbdare, sau numărul de epoci pentru a continua antrenamentul fără îmbunătățiri, de trei epoci.

O setare implicită de hiperparametru de o importanță deosebită este train_only_on_top_layer, unde, dacă este setat la True, straturile de extracție a caracteristicilor modelului nu sunt reglate fin pe setul de date de antrenament furnizat. Optimizatorul va antrena numai parametrii din stratul de clasificare complet conectat de sus, cu o dimensionalitate de ieșire egală cu numărul de etichete de clasă din setul de date. În mod implicit, acest hiperparametru este setat la True, care este o setare destinată transferului de învățare pe seturi de date mici. Este posibil să aveți un set de date personalizat în care extragerea caracteristicilor din pre-instruire pe setul de date ImageNet nu este suficientă. În aceste cazuri, ar trebui să setați train_only_on_top_layer la False. Deși această setare va crește timpul de antrenament, veți extrage funcții mai semnificative pentru problema dvs. de interes, crescând astfel acuratețea.

Extrageți valorile din CloudWatch Logs

Algoritmul de clasificare a imaginilor JumpStart TensorFlow înregistrează în mod fiabil o varietate de valori în timpul antrenamentului, care sunt accesibile pentru SageMaker Estimator și obiecte HyperparameterTuner. Constructorul unui SageMaker Estimator are o metric_definitions argument cuvânt cheie, care poate fi folosit pentru a evalua jobul de instruire prin furnizarea unei liste de dicționare cu două chei: Nume pentru numele valorii și Regex pentru expresia regulată folosită pentru a extrage metrica din jurnalele. Cel care însoțește caiet arată detaliile implementării. Următorul tabel listează valorile disponibile și expresiile regulate asociate pentru toate modelele de clasificare a imaginilor JumpStart TensorFlow.

| Numele metricii | Expresie uzuala |

| numărul de parametri | „- Numărul de parametri: ([0-9\.]+)” |

| numărul de parametri antrenabili | „- Numărul de parametri antrenabili: ([0-9\.]+)” |

| numărul de parametri neantrenați | „- Numărul de parametri care nu se pot antrena: ([0-9\.]+)” |

| metrica setului de date tren | f”- {metric}: ([0-9\.]+)” |

| metrica setului de date de validare | f”- val_{metric}: ([0-9\.]+)” |

| metrica setului de date de testare | f”- Test {metric}: ([0-9\.]+)” |

| durata trenului | „- Durata totală a antrenamentului: ([0-9\.]+)” |

| durata trenului pe epocă | „- Durata medie de antrenament pe epocă: ([0-9\.]+)” |

| latența de evaluare a testului | „- Testarea latenței evaluării: ([0-9\.]+)” |

| testează latența pe probă | „- Latența medie de testare per probă: ([0-9\.]+)” |

| randamentul de testare | „- Debit mediu de testare: ([0-9\.]+)” |

Scriptul de învățare de transfer încorporat oferă o varietate de metrici ale setului de date de instruire, validare și testare în cadrul acestor definiții, așa cum sunt reprezentate de valorile de înlocuire a șirului f. Valorile exacte disponibile variază în funcție de tipul de clasificare efectuat. Toate modelele compilate au un loss metrică, care este reprezentată de o pierdere de entropie încrucișată pentru o problemă de clasificare binară sau categorială. Primul este folosit atunci când există o singură etichetă de clasă; acesta din urmă este utilizat dacă există două sau mai multe etichete de clasă. Dacă există doar o singură etichetă de clasă, atunci următoarele valori sunt calculate, înregistrate și extrase prin intermediul expresiilor regulate f-string din tabelul precedent: numărul de pozitive adevărate (true_pos), numărul de fals pozitive (false_pos), numărul de negative adevărate (true_neg), numărul de fals negative (false_neg), precision, recall, aria sub curba caracteristicii de operare a receptorului (ROC) (auc), și aria de sub curba de precizie-rechemare (PR) (prc). În mod similar, dacă există șase sau mai multe etichete de clasă, o valoare de precizie de top 5 (top_5_accuracy) poate fi, de asemenea, calculată, înregistrată și extrasă prin intermediul expresiilor regulate precedente.

În timpul antrenamentului, valorile specificate unui SageMaker Estimator sunt emise către CloudWatch Logs. Când antrenamentul este complet, puteți invoca SageMaker DescribeTrainingJob API și inspectați FinalMetricDataList introduceți răspunsul JSON:

Acest API necesită ca interogarea să fie furnizată numai numele jobului, astfel încât, odată finalizată, valorile pot fi obținute în analizele viitoare, atâta timp cât numele jobului de instruire este înregistrat în mod corespunzător și poate fi recuperat. Pentru această sarcină de selecție a modelului, numele lucrărilor de reglare hiperparametrică sunt stocate și analizele ulterioare reatașează a HyperparameterTuner obiectul dat numele jobului de reglare, extrageți cel mai bun nume de job de antrenament din tunerul de hiperparametru atașat și apoi invocați DescribeTrainingJob API așa cum este descris mai devreme pentru a obține valori asociate cu cea mai bună muncă de formare.

Lansați lucrări de ajustare a hiperparametrului asincron

Consultați cele corespunzătoare caiet pentru detalii de implementare despre lansarea asincronă a joburilor de reglare a hiperparametrului, care utilizează biblioteca standard Python viitoare concurente modul, o interfață de nivel înalt pentru rularea asincronă a apelabilelor. În această soluție sunt implementate mai multe considerații legate de SageMaker:

- Fiecare cont AWS este afiliat Cote de servicii SageMaker. Ar trebui să vedeți limitele actuale pentru a vă utiliza pe deplin resursele și, eventual, să solicitați creșteri ale limitelor de resurse, după cum este necesar.

- Apelurile API frecvente pentru a crea multe joburi simultane de reglare a hiperparametrilor pot depășește rata Python SDK și aruncă excepții de limitare. O soluție pentru aceasta este crearea unui client SageMaker Boto3 cu o configurație personalizată de reîncercare.

- Ce se întâmplă dacă scriptul dvs. întâmpină o eroare sau scriptul este oprit înainte de finalizare? Pentru o selecție atât de mare de modele sau un studiu de evaluare comparativă, puteți înregistra numele de joburi de reglare și puteți oferi funcții comode pentru reatașați lucrările de reglare a hiperparametrului care exista deja:

Detalii analize și discuții

Analiza din acest post realizează transfer de învățare pentru ID-uri de model în algoritmul de clasificare a imaginilor JumpStart TensorFlow pe setul de date Caltech-256. Toate lucrările de instruire au fost efectuate pe instanța de antrenament SageMaker ml.g4dn.xlarge, care conține un singur GPU NVIDIA T4.

Setul de date de testare este evaluat pe instanța de antrenament la sfârșitul antrenamentului. Selecția modelului este efectuată înainte de evaluarea setului de date de testare pentru a seta ponderile modelului la epoca cu cea mai bună performanță a setului de validare. Debitul de testare nu este optimizat: dimensiunea lotului setului de date este setată la dimensiunea implicită a lotului hiperparametrului de antrenament, care nu este ajustată pentru a maximiza utilizarea memoriei GPU; debitul de testare raportat include timpul de încărcare a datelor deoarece setul de date nu este pre-memorizat în cache; iar inferența distribuită pe mai multe GPU-uri nu este utilizată. Din aceste motive, acest debit este o măsură relativ bună, dar debitul real ar depinde în mare măsură de configurațiile de implementare a punctelor finale de inferență pentru modelul antrenat.

Deși centrul de modele JumpStart conține multe tipuri de arhitectură de clasificare a imaginilor, această frontieră pareto este dominată de anumite modele Swin, EfficientNet și MobileNet. Modelele Swin sunt mai mari și relativ mai precise, în timp ce modelele MobileNet sunt mai mici, relativ mai puțin precise și potrivite pentru constrângerile de resurse ale dispozitivelor mobile. Este important de reținut că această frontieră este condiționată de o varietate de factori, inclusiv de setul de date exact utilizat și de hiperparametrii de reglare fină selectați. Este posibil să descoperiți că setul dvs. de date personalizat produce un set diferit de soluții eficiente Pareto și este posibil să doriți timpi mai lungi de antrenament cu diferiți hiperparametri, cum ar fi mai multă creștere a datelor sau reglare fină mai mult decât stratul de clasificare superior al modelului.

Concluzie

În această postare, am arătat cum să rulăm selecția modelelor la scară largă sau sarcinile de evaluare comparativă folosind hub-ul de modele JumpStart. Această soluție vă poate ajuta să alegeți cel mai bun model pentru nevoile dumneavoastră. Vă încurajăm să încercați și să explorați acest lucru soluţie pe propriul set de date.

Referinte

Mai multe informații sunt disponibile la următoarele resurse:

Despre autori

Dr. Kyle Ulrich este un om de știință aplicat cu Algoritmi încorporați Amazon SageMaker echipă. Interesele sale de cercetare includ algoritmi scalabili de învățare automată, viziunea computerizată, serii temporale, non-parametrice bayesiene și procese gaussiene. Doctoratul său este de la Universitatea Duke și a publicat lucrări în NeurIPS, Cell, and Neuron.

Dr. Kyle Ulrich este un om de știință aplicat cu Algoritmi încorporați Amazon SageMaker echipă. Interesele sale de cercetare includ algoritmi scalabili de învățare automată, viziunea computerizată, serii temporale, non-parametrice bayesiene și procese gaussiene. Doctoratul său este de la Universitatea Duke și a publicat lucrări în NeurIPS, Cell, and Neuron.

Dr. Ashish Khetan este un Senior Applied Scientist cu Algoritmi încorporați Amazon SageMaker și ajută la dezvoltarea algoritmilor de învățare automată. Și-a luat doctoratul la Universitatea din Illinois Urbana Champaign. Este un cercetător activ în învățarea automată și inferența statistică și a publicat multe lucrări în conferințele NeurIPS, ICML, ICLR, JMLR, ACL și EMNLP.

Dr. Ashish Khetan este un Senior Applied Scientist cu Algoritmi încorporați Amazon SageMaker și ajută la dezvoltarea algoritmilor de învățare automată. Și-a luat doctoratul la Universitatea din Illinois Urbana Champaign. Este un cercetător activ în învățarea automată și inferența statistică și a publicat multe lucrări în conferințele NeurIPS, ICML, ICLR, JMLR, ACL și EMNLP.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- Platoblockchain. Web3 Metaverse Intelligence. Cunoștințe amplificate. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- Despre Noi

- acces

- accesibil

- Cont

- precizie

- precis

- Obține

- peste

- activ

- plus

- adresa

- adrese

- Ajustat

- Afiliat

- împotriva

- Algoritmul

- algoritmi

- TOATE

- deja

- Cu toate ca

- mereu

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- analize

- analiză

- și

- O alta

- api

- aplicație

- aplicat

- în mod corespunzător

- arhitectură

- ZONĂ

- argument

- asociate

- atașa

- Încercările

- Automat

- disponibil

- in medie

- AWS

- bazat

- Bayesian

- deoarece

- înainte

- fiind

- analiza comparativă

- CEL MAI BUN

- Mare

- construit-in

- afaceri

- apeluri

- candidat

- cazuri

- categorii

- provocare

- caracteristică

- Alege

- clasă

- clasificare

- Clasifica

- client

- combinate

- Comun

- comparație

- Completă

- Terminat

- completare

- complexitate

- calculator

- Computer Vision

- preocupările

- conferințe

- Configuraţie

- legat

- Conexiuni

- Considerații

- constrângeri

- conține

- continua

- controlul

- controale

- comoditate

- Corespunzător

- acoperi

- crea

- Curent

- curba

- personalizat

- de date

- seturi de date

- Mai adânc

- Mod implicit

- depinde de

- implementa

- Implementarea

- desfășurarea

- adâncime

- descris

- descriere

- detalii

- dezvolta

- Dispozitive

- diferit

- discuta

- distribuite

- diferit

- Nu

- Duce

- duke universitate

- în timpul

- fiecare

- Mai devreme

- Devreme

- mai ușor

- eficient

- oricare

- elimina

- permite

- încuraja

- incurajata

- un capăt la altul

- Punct final

- Mediu inconjurator

- epocă

- epoci

- eroare

- evalua

- evaluat

- evaluare

- exemplu

- exemple

- Cu excepția

- explora

- Explorarea

- expresii

- extrage

- factori

- echitabil

- favoriza

- Caracteristică

- DESCRIERE

- Domenii

- Figura

- În cele din urmă

- Găsi

- First

- montaj

- următor

- Fost

- din

- Frontieră

- Frontiere

- complet

- funcții

- viitor

- Futures

- genera

- obține

- dat

- Caritate

- bine

- GPU

- unități de procesare grafică

- mare

- mai mare

- Verde

- se întâmplă

- puternic

- ajutor

- ajută

- la nivel înalt

- de înaltă calitate

- superior

- Cum

- Cum Pentru a

- HTML

- HTTPS

- Butuc

- sute

- Reglarea hiperparametrului

- Illinois

- imagine

- Clasificarea imaginilor

- imagini

- punerea în aplicare a

- implementarea

- implementat

- importanță

- important

- îmbunătățire

- îmbunătățirea

- in

- include

- include

- Inclusiv

- Crește

- Creșteri

- crescând

- Indicatorii

- informații

- intrare

- instanță

- interes

- interese

- interfaţă

- intern

- intrinsec

- introduce

- IT

- Loc de munca

- Locuri de munca

- JSON

- Cheie

- chei

- Etichetă

- etichete

- mare

- pe scară largă

- mai mare

- Latență

- lansează

- lansare

- strat

- straturi

- conducere

- AFLAȚI

- învăţare

- ridicare

- ușoară

- LIMITĂ

- Limitele

- Listă

- liste

- încărcare

- Lung

- mai lung

- de pe

- maşină

- masina de învățare

- Efectuarea

- multe

- Maximaliza

- semnificativ

- măsurători

- Memorie

- metric

- Metrici

- ML

- Mobil

- dispozitive mobile

- model

- Modele

- Module

- mai mult

- multiplu

- nume

- nume

- necesar

- nevoilor

- rețele

- Nou

- caiet

- număr

- Nvidia

- obiect

- obiecte

- observa

- obține

- obținut

- ONE

- de operare

- Operațiuni

- optimizate

- a subliniat

- propriu

- lucrări

- parametru

- parametrii

- special

- Răbdare

- Efectua

- performanță

- efectuează

- Plato

- Informații despre date Platon

- PlatoData

- Punct

- puncte

- Popular

- posibil

- Post

- potenţial

- pr

- împiedica

- anterior

- Problemă

- probleme

- proces

- procese

- furniza

- prevăzut

- furnizează

- furnizarea

- publicat

- Piton

- întrebare

- Întrebări

- repede

- RAM

- rată

- tarife

- lumea reală

- motive

- reducerea

- regulat

- relativ

- scoate

- Raportat

- reprezenta

- reprezentate

- reprezintă

- solicita

- necesar

- Cerinţe

- Necesită

- cercetare

- cercetător

- Rezoluţie

- resursă

- Resurse

- răspuns

- REZULTATE

- Alerga

- funcţionare

- sagemaker

- acelaşi

- scalabil

- Om de stiinta

- script-uri

- sdk

- Caută

- Secțiune

- selectate

- selectarea

- selecţie

- senior

- serie

- serviciu

- sesiune

- set

- Seturi

- instalare

- câteva

- Modela

- să

- Emisiuni

- asemănător

- simplifica

- singur

- SIX

- Mărimea

- dimensiuni

- mic

- mai mici

- So

- soluţie

- soluţii

- REZOLVAREA

- specificație

- Specificaţii

- specificată

- standard

- început

- statistic

- Pas

- oprit

- oprire

- stocate

- Studiu

- ulterior

- astfel de

- suficient

- potrivit

- tabel

- vizate

- Sarcină

- sarcini

- echipă

- tensorflow

- test

- lor

- astfel

- trei

- debit

- timp

- Seria de timp

- ori

- la

- astăzi

- împreună

- Unelte

- top

- top 5

- Total

- Tren

- dresat

- Pregătire

- transfer

- transformatoare

- adevărat

- Tipuri

- în cele din urmă

- în

- unic

- universitate

- Folosire

- utilizare

- folosi

- utilizate

- validare

- Valori

- varietate

- Fixă

- de

- Vizualizare

- viziune

- care

- în timp ce

- întreg

- larg

- voi

- în

- fără

- ar

- scris

- Tu

- Ta

- zephyrnet