Inteligența artificială (AI) has created a furor recently with its possibility to revolutionize how people approach and solve different tasks and complex problems. From healthcare to finance, AI and its associated machine-learning models have demonstrated their potential to streamline intricate processes, enhance decision-making patterns and uncover valuable insights.

Cu toate acestea, în ciuda potențialului imens al tehnologiei, o problemă persistentă de „cutie neagră” a continuat să prezinte o provocare semnificativă pentru adoptarea acesteia, ridicând semne de întrebare cu privire la transparența și interpretabilitatea acestor sisteme sofisticate.

Pe scurt, problema cutiei negre provine din dificultatea de a înțelege modul în care sistemele AI și modelele de învățare automată procesează datele și generează predicții sau decizii. Aceste modele se bazează adesea pe algoritmi complicati care nu sunt ușor de înțeles pentru oameni, ceea ce duce la o lipsă de responsabilitate și încredere.

Prin urmare, pe măsură ce IA devine din ce în ce mai integrată în diferite aspecte ale vieții noastre, abordarea acestei probleme este crucială pentru a asigura utilizarea responsabilă și etică a acestei tehnologii puternice.

Cutia neagră: o privire de ansamblu

Metafora „cutie neagră” provine din ideea că sistemele AI și modelele de învățare automată funcționează într-un mod ascuns înțelegerii umane, la fel ca conținutul unei cutii sigilate, opace. Aceste sisteme sunt construite pe modele matematice complexe și seturi de date cu dimensiuni mari, care creează relații și modele complicate care le ghidează procesele de luare a deciziilor. Cu toate acestea, aceste funcții interioare nu sunt ușor accesibile sau de înțeles pentru oameni.

În termeni practici, problema cutiei negre AI este dificultatea de a descifra raționamentul din spatele predicțiilor sau deciziilor unui sistem AI. Această problemă este deosebit de răspândită în modelele de învățare profundă, cum ar fi rețelele neuronale, în care mai multe straturi de noduri interconectate procesează și transformă datele într-o manieră ierarhică. Complexitatea acestor modele și transformările neliniare pe care le efectuează fac să fie extrem de dificilă urmărirea rațiunii din spatele rezultatelor lor.

Nikita Brudnov, CEO al BR Group — un tablou de bord de analiză de marketing bazat pe inteligență artificială — a declarat pentru Cointelegraph că lipsa de transparență în modul în care modelele de inteligență artificială ajung la anumite decizii și predicții ar putea fi problematică în multe contexte, cum ar fi diagnosticul medical, luarea deciziilor financiare și proceduri judiciare, având un impact semnificativ asupra adoptării continue a IA.

Magazine: Joe Lubin: Adevărul despre despărțirea fondatorilor ETH și despre „Crypto Google”

„În ultimii ani, s-a acordat multă atenție dezvoltării tehnicilor de interpretare și explicare a deciziilor luate de modelele AI, cum ar fi generarea de scoruri de importanță a caracteristicilor, vizualizarea limitelor de decizie și identificarea explicațiilor ipotetice contrafactuale”, a spus el, adăugând:

„Cu toate acestea, aceste tehnici sunt încă la început și nu există nicio garanție că vor fi eficiente în toate cazurile.”

Brudnov consideră, de asemenea, că, odată cu descentralizarea ulterioară, autoritățile de reglementare pot solicita ca deciziile luate de sistemele AI să fie mai transparente și mai responsabile pentru a le asigura validitatea etică și corectitudinea generală. El a sugerat, de asemenea, că consumatorii ar putea ezita să folosească produse și servicii bazate pe inteligență artificială dacă nu înțeleg cum funcționează și procesul lor de luare a deciziilor.

James Wo, fondatorul DFG – o firmă de investiții care investește activ în tehnologiile legate de inteligența artificială – consideră că problema cutiei negre nu va afecta adoptarea în viitorul apropiat. Pe Wo, majoritatea utilizatorilor nu le pasă neapărat de modul în care funcționează modelele AI existente și sunt fericiți să obțină pur și simplu utilitate din ele, cel puțin pentru moment.

„Pe termen mediu, odată ce noutatea acestor platforme dispare, cu siguranță va exista mai mult scepticism cu privire la metodologia cutiei negre. Întrebările vor crește, de asemenea, pe măsură ce utilizarea AI intră în cripto și Web3, unde există mize financiare și consecințe de luat în considerare”, a recunoscut el.

Impact asupra încrederii și transparenței

Un domeniu în care absența transparenței poate afecta în mod substanțial încrederea este diagnosticul medical bazat pe inteligență artificială. De exemplu, modelele AI pot analiza date medicale complexe din domeniul sănătății pentru a genera diagnostice sau recomandări de tratament. Cu toate acestea, atunci când clinicienii și pacienții nu pot înțelege rațiunea din spatele acestor sugestii, ei ar putea pune la îndoială fiabilitatea și validitatea acestor perspective. Acest scepticism poate duce și mai mult la ezitare în adoptarea soluțiilor AI, împiedicând potențial progresele în îngrijirea pacienților și în medicina personalizată.

În domeniul financiar, sistemele AI pot fi folosite pentru evaluarea creditului, detectarea fraudelor și evaluarea riscurilor. Cu toate acestea, problema cutiei negre poate crea incertitudine în ceea ce privește corectitudinea și acuratețea acestor scoruri de credit sau raționamentul din spatele alertelor de fraudă, limitând capacitatea tehnologiei de a digitiza industria.

Industria cripto se confruntă, de asemenea, cu repercusiunile problemei cutiei negre. De exemplu, activele digitale și tehnologia blockchain sunt înrădăcinate în descentralizare, deschidere și verificabilitate. Sistemele de inteligență artificială cărora le lipsește transparența și interpretabilitatea formează o deconectare între așteptările utilizatorilor și realitatea soluțiilor bazate pe inteligență artificială în acest spațiu.

Preocupări de reglementare

Din punct de vedere normativ, problema cutiei negre AI prezintă provocări unice. Pentru început, opacitatea proceselor AI poate face din ce în ce mai dificilă pentru autoritățile de reglementare să evalueze conformitatea acestor sisteme cu regulile și liniile directoare existente. În plus, lipsa de transparență poate complica capacitatea autorităților de reglementare de a dezvolta noi cadre care pot aborda riscurile și provocările prezentate de aplicațiile AI.

Legislatorii s-ar putea lupta să evalueze corectitudinea, părtinirea și practicile de confidențialitate a datelor ale sistemelor AI și impactul potențial al acestora asupra drepturilor consumatorilor și stabilității pieței. În plus, fără o înțelegere clară a proceselor de luare a deciziilor ale sistemelor bazate pe inteligență artificială, autoritățile de reglementare pot întâmpina dificultăți în identificarea potențialelor vulnerabilități și pentru a se asigura că există măsuri de protecție adecvate pentru a atenua riscurile.

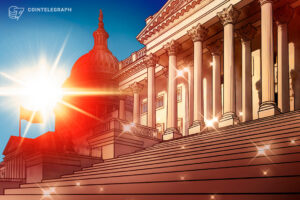

One notable regulatory development regarding this technology has been the European Union’s Artificial Intelligence Act, which is moving closer to becoming part of the bloc’s statute book after reaching a provisional political agreement on April 27.

În esență, Actul AI își propune să creeze un mediu de încredere și responsabil pentru dezvoltarea IA în UE. Legislatorii au adoptat un sistem de clasificare care clasifică diferite tipuri de IA în funcție de risc: inacceptabil, ridicat, limitat și minim. Acest cadru este conceput pentru a aborda diverse preocupări legate de problema cutiei negre AI, inclusiv probleme legate de transparență și responsabilitate.

Incapacitatea de a monitoriza și reglementa eficient sistemele de inteligență artificială a tensionat deja relațiile dintre diferite industrii și organisme de reglementare.

Early last month, the popular AI chatbot ChatGPT was banned in Italy for 29 days, primarily due to privacy concerns raised by the country’s data protection agency for suspected violations of the EU’s General Data Protection Regulations (GDPR). However, the platform was allowed to resume its services on April 29 after CEO Sam Altman announced that he and his team had taken specific steps to comply with the regulator’s demands, including the revelation of its data processing practices and implementation of its implementation of age-gating measures.

Reglementarea inadecvată a sistemelor AI ar putea eroda încrederea publicului în aplicațiile AI, deoarece utilizatorii devin din ce în ce mai preocupați de părtinirile inerente, inexactitățile și implicațiile etice.

Rezolvarea problemei cutiei negre

Pentru a aborda în mod eficient problema cutiei negre AI, este esențială utilizarea unei combinații de abordări care promovează transparența, interpretabilitatea și responsabilitatea. Două astfel de strategii complementare sunt modelele AI explicabile (XAI) și open-source.

XAI este o zonă de cercetare dedicată reducerii decalajului dintre complexitatea sistemelor AI și nevoia de interpretabilitate umană. XAI se concentrează pe dezvoltarea de tehnici și algoritmi care pot oferi explicații ușor de înțeles de către om pentru deciziile bazate pe inteligență artificială, oferind perspective asupra raționamentului din spatele acestor alegeri.

Metodele adesea folosite în XAI includ modele surogat, analiza importanței caracteristicilor, analiza sensibilității și explicații agnostice de model interpretabile local. Implementarea XAI în toate industriile poate ajuta părțile interesate să înțeleagă mai bine procesele bazate pe inteligență artificială, sporind încrederea în tehnologie și facilitând conformitatea cu cerințele de reglementare.

În tandem cu XAI, promovarea adoptării modelelor open-source AI poate fi o strategie eficientă pentru a aborda problema cutiei negre. Modelele open-source oferă acces deplin la algoritmii și datele care conduc sistemele AI, permițând utilizatorilor și dezvoltatorilor să examineze și să înțeleagă procesele care stau la baza.

Această transparență sporită poate ajuta la construirea încrederii și la stimularea colaborării între dezvoltatori, cercetători și utilizatori. În plus, abordarea open-source poate crea sisteme AI mai robuste, mai responsabile și mai eficiente.

Problema cutiei negre în spațiul cripto

Problema cutiei negre are ramificații semnificative pentru diferite aspecte ale spațiului cripto, inclusiv strategiile de tranzacționare, predicțiile pieței, măsurile de securitate, tokenizarea și contractele inteligente.

În domeniul strategiilor de tranzacționare și al predicțiilor de piață, modelele bazate pe inteligență artificială câștigă popularitate pe măsură ce investitorii caută să valorifice tranzacțiile algoritmice. Cu toate acestea, problema cutiei negre împiedică utilizatorii înțelegerea modului în care funcționează aceste modele, ceea ce face dificilă evaluarea eficienței și a riscurilor potențiale. În consecință, această opacitate poate duce, de asemenea, la o încredere nejustificată în deciziile de investiții bazate pe inteligență artificială sau poate face investitorii să se bazeze prea mult pe sistemele automate.

AI va juca un rol crucial în îmbunătățirea măsurilor de securitate în cadrul ecosistemului blockchain prin detectarea tranzacțiilor frauduloase și a activităților suspecte. Cu toate acestea, problema cutiei negre complică procesul de verificare pentru aceste soluții de securitate bazate pe inteligență artificială. Lipsa de transparență în procesul decizional poate eroda încrederea în sistemele de securitate, ridicând îngrijorări cu privire la capacitatea acestora de a proteja activele și informațiile utilizatorilor.

Recent: Consens 2023: Companiile arată interes pentru Web3, în ciuda provocărilor de reglementare din SUA

Tokenizarea și contractele inteligente – două componente vitale ale ecosistemului blockchain – sunt, de asemenea, martorii unei integrări sporite a AI. Cu toate acestea, problema cutiei negre poate ascunde logica din spatele jetoanelor generate de AI sau execuției unui contract inteligent.

Pe măsură ce AI revoluționează diverse industrii, abordarea problemei cutiei negre devine din ce în ce mai presantă. Prin stimularea colaborării între cercetători, dezvoltatori, factorii de decizie politică și părțile interesate din industrie, pot fi dezvoltate soluții pentru a promova transparența, responsabilitatea și încrederea în sistemele AI. Astfel, va fi interesant de văzut cum continuă să evolueze această nouă paradigmă tehnologică.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoAiStream. Web3 Data Intelligence. Cunoștințe amplificate. Accesați Aici.

- Mintând viitorul cu Adryenn Ashley. Accesați Aici.

- Cumpărați și vindeți acțiuni în companii PRE-IPO cu PREIPO®. Accesați Aici.

- Sursa: https://cointelegraph.com/news/ai-s-black-box-problem-challenges-and-solutions-for-a-transparent-future

- :are

- :este

- :nu

- :Unde

- 2023

- 27

- a

- capacitate

- Despre Noi

- acces

- accesibil

- responsabilitate

- responsabil

- precizie

- peste

- act

- activ

- activităţi de

- adăugare

- În plus,

- adresa

- adresare

- adoptată

- Adoptarea

- Adoptare

- progresele

- afecta

- După

- agenție

- Acord

- AI

- AI Act

- Chatbot AI

- AI-alimentat

- isi propune

- Alerte

- algoritmică

- tranzacționare algoritmică

- algoritmi

- TOATE

- deja

- de asemenea

- printre

- an

- analiză

- Google Analytics

- analiza

- și

- a anunțat

- aplicatii

- abordare

- abordari

- adecvat

- Aprilie

- SUNT

- ZONĂ

- în jurul

- artificial

- inteligență artificială

- AS

- aspecte

- evaluare

- Bunuri

- asociate

- At

- atenţie

- Automata

- BE

- deveni

- devine

- devenire

- fost

- în spatele

- consideră că

- Mai bine

- între

- părtinire

- distorsiunilor

- Negru

- blockchain

- ecosistem blockchain

- Tehnologia blocurilor

- organisme

- carte

- limitele

- Cutie

- punte

- construi

- a cladi increderea

- construit

- întreprinderi

- by

- CAN

- nu poti

- valorifica

- pasă

- cazuri

- CEO

- sigur

- contesta

- provocări

- provocare

- chatbot

- Chat GPT

- alegeri

- clasificare

- sistem de clasificare

- clar

- clinicienii

- Cointelegraph

- colaborare

- combinaţie

- complementar

- complex

- complexitate

- conformitate

- componente

- înţelege

- îngrijorat

- preocupările

- Consecințele

- prin urmare

- Lua în considerare

- consumator

- Drepturile Consumatorului

- Consumatorii

- conținut

- contexte

- a continuat

- continuă

- contract

- contracte

- Nucleu

- ar putea

- țară

- crea

- a creat

- credit

- crucial

- cripto

- Industria criptelor

- spațiul de criptare

- tablou de bord

- de date

- confidențialitatea datelor

- de prelucrare a datelor

- protejarea datelor

- seturi de date

- Descentralizare

- decizie

- Luarea deciziilor

- Deciziile

- dedicat

- adânc

- învățare profundă

- categoric

- cererile

- demonstrat

- proiectat

- În ciuda

- Detectare

- dezvolta

- dezvoltat

- Dezvoltatorii

- în curs de dezvoltare

- Dezvoltare

- diferit

- dificil

- dificultăți

- Dificultate

- digital

- Active digitale

- situație computerizată

- do

- domeniu

- Dont

- conduce

- două

- cu ușurință

- ecosistem

- Eficace

- în mod eficient

- eficacitate

- angajat

- permițând

- spori

- consolidarea

- asigura

- asigurare

- intră

- Mediu inconjurator

- esenţial

- ETH

- etic

- EU

- european

- evalua

- evolua

- exemplu

- execuție

- existent

- aşteptări

- explicând

- Față

- fete

- facilitând

- cinste

- Caracteristică

- finanţa

- financiar

- Firmă

- se concentrează

- Pentru

- previzibil

- formă

- Foster

- promovarea

- fondator

- fondatorii

- Cadru

- cadre

- fraudă

- detectarea fraudei

- necinstit

- din

- Complet

- funcţie

- mai mult

- În plus

- viitor

- câștigă

- decalaj

- GDPR

- General

- date generale

- genera

- generator

- acordarea

- grup

- garanta

- ghida

- orientări

- HAD

- fericit

- Avea

- he

- de asistență medicală

- ajutor

- Înalt

- împiedică

- lui

- Cum

- Totuși

- HTTPS

- uman

- Oamenii

- identificarea

- if

- imens

- Impactul

- impact

- implementarea

- Punere în aplicare a

- implicații

- importanță

- in

- incapacitate

- include

- Inclusiv

- Crește

- a crescut

- tot mai mult

- industrii

- industrie

- informații

- inerent

- perspective

- integrate

- integrare

- Inteligență

- interconectate

- interes

- interesant

- în

- investiţie

- Investitori

- investeste

- problema

- probleme de

- IT

- Italia

- ESTE

- lipsă

- Nume

- parlamentarii

- straturi

- conduce

- conducere

- învăţare

- cel mai puțin

- Legal

- proceduri legale

- ca

- Limitat

- Locuiește

- local

- logică

- maşină

- masina de învățare

- făcut

- face

- Efectuarea

- manieră

- multe

- Piață

- predicțiile pieței

- Marketing

- matematic

- Mai..

- măsuri

- medical

- date medicale

- medicină

- Metodologie

- ar putea

- minim

- diminua

- Modele

- monitor

- Lună

- mai mult

- În plus

- cele mai multe

- în mişcare

- mult

- multiplu

- în mod necesar

- Nevoie

- rețele

- rețele neuronale

- cu toate acestea

- Nou

- Nu.

- noduri

- notabil

- noțiune

- roman

- noutate

- acum

- of

- de pe

- oferind

- de multe ori

- on

- dată

- opac

- open-source

- Sinceritate

- funcionar

- or

- al nostru

- global

- plătit

- paradigmă

- parte

- în special

- pacient

- pacientes

- modele

- oameni

- Efectua

- Personalizat

- Loc

- platformă

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- Joaca

- factorii de decizie politică

- politic

- Popular

- popularitate

- posibilitate

- potenţial

- potenţial

- puternic

- Practic

- practicile

- Predictii

- prezenta

- cadouri

- prevalent

- în primul rând

- intimitate

- Problemă

- probleme

- Proceedings

- proces

- procese

- prelucrare

- Produse

- promova

- Promovarea

- protecţie

- furniza

- provizoriu

- public

- încrederea publică

- întrebare

- Întrebări

- ridicat

- ridicare

- Argumentare

- ajungând

- Realitate

- tărâm

- recent

- recent

- Recomandări

- cu privire la

- Reglementa

- Regulament

- regulament

- Autoritățile de reglementare

- autoritățile de reglementare

- legate de

- Relaţii

- încredere

- se bazează

- repercusiuni

- necesita

- Cerinţe

- cercetare

- cercetători

- responsabil

- rezultat

- relua

- revoluţiona

- revolutioneaza

- Drepturile

- Risc

- evaluare a riscurilor

- Riscurile

- robust

- Rol

- norme

- garanții

- Said

- Sam

- Sam Altman

- notare

- securitate

- Măsuri de securitate

- vedea

- Căuta

- Sensibilitate

- Servicii

- Seturi

- Arăta

- semnificativ

- semnificativ

- pur şi simplu

- Scepticism

- inteligent

- contract inteligent

- Contracte inteligente

- soluţii

- REZOLVAREA

- sofisticat

- Sursă

- Spaţiu

- specific

- împărţi

- Stabilitate

- părțile interesate

- stand

- Standuri

- tulpini

- paşi

- Încă

- strategii

- Strategie

- simplifica

- Lupta

- astfel de

- suspicios

- sistem

- sisteme

- Tandem

- sarcini

- echipă

- tech

- tehnici de

- Tehnologii

- Tehnologia

- termeni

- acea

- lor

- Lor

- Acolo.

- Acestea

- ei

- acest

- la

- tokenizarea

- indicativele

- Urmă

- Trading

- Strategii de tranzacționare

- Tranzacții

- Transforma

- transformări

- Transparență

- transparent

- tratament

- Încredere

- demn de încredere

- Adevăr

- Două

- Tipuri

- Incertitudine

- descoperi

- care stau la baza

- înţelege

- inteligibil

- înţelegere

- unic

- pe

- us

- utilizare

- Utilizator

- utilizatorii

- utilitate

- Valoros

- diverse

- Verificare

- încălcări

- vital

- Vulnerabilitățile

- a fost

- Web3

- cand

- care

- voi

- cu

- în

- fără

- martori

- wo

- Apartamente

- lucrări

- ani

- zephyrnet