Fotografia falsă nu este nimic nou. În anii 1910, autorul britanic Arthur Conan Doyle a fost înșelat de două surori în vârstă de școală, care făcuseră fotografii cu zâne elegante care zburau în grădina lor.

Astăzi este greu de crezut că aceste fotografii ar fi putut păcăli pe cineva, dar abia în anii 1980, un expert pe nume Geoffrey Crawley a avut curajul să aplice direct cunoștințele sale despre fotografia de film și să deducă ceea ce este evident.

Fotografiile erau false, după cum a recunoscut ulterior chiar una dintre surori.

Vânătoare de artefacte și bun simț

Fotografia digitală a deschis o multitudine de tehnici atât pentru falsificatori, cât și pentru detectivi.

Examinarea criminalistică a imaginilor suspecte în zilele noastre implică căutarea calităților inerente fotografiei digitale, cum ar fi examinarea metadate încorporate în fotografii, folosind software precum Adobe Photoshop pentru a corecta distorsiunile imaginilor și căutând semne revelatoare de manipulare, cum ar fi regiunile duplicate pentru a ascunde caracteristicile originale.

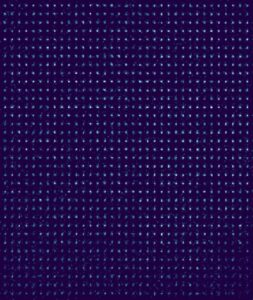

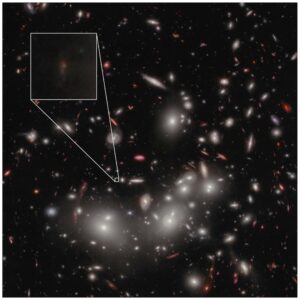

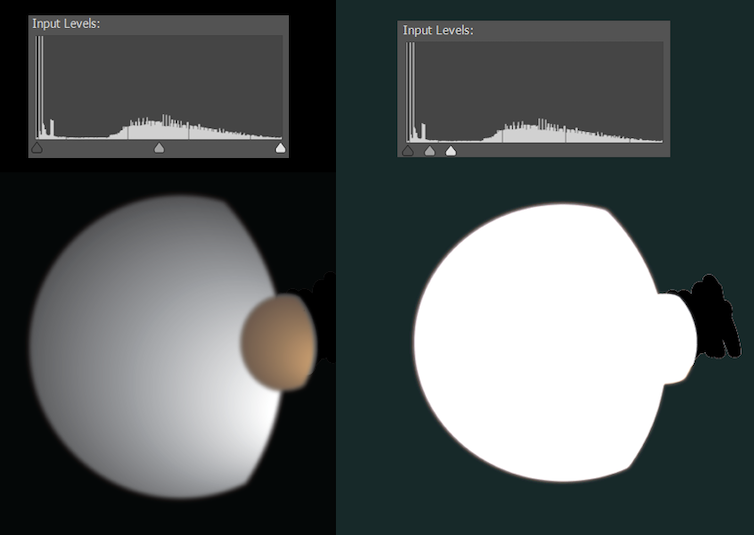

Uneori, editările digitale sunt prea subtile pentru a fi detectate, dar apar atunci când ajustăm modul în care sunt distribuiti pixelii lumini și întunecați. De exemplu, în 2010, NASA a lansat un fotografie a lunilor lui Saturn Dione și Titan. Nu era în niciun caz fals, dar fusese curățat pentru a îndepărta artefactele rătăcite – care au primit atenția teoreticienilor conspirației.

Curios, am pus imaginea în Photoshop. Ilustrația de mai jos recreează aproximativ cum arăta.

Majoritatea fotografiilor digitale sunt în formate comprimate, cum ar fi JPEG, reduse prin eliminarea multor informații capturate de cameră. Algoritmii standardizați asigură că informațiile eliminate au un impact vizibil minim, dar lasă urme.

Comprimarea oricărei regiuni a unei imagini va depinde de ceea ce se întâmplă în imagine și de setările curente ale camerei; atunci când o imagine falsă combină mai multe surse, este adesea posibil să se detecteze acest lucru prin analiza atentă a artefactelor de compresie.

O anumită metodologie criminalistică are puțin de-a face cu formatul unei imagini, dar este în esență munca de detectiv vizual. Toți cei din fotografie sunt luminați în același mod? Au sens umbrele și reflexiile? Urechile și mâinile arată lumină și umbră în locurile potrivite? Ce se reflectă în ochii oamenilor? S-ar suma toate liniile și unghiurile camerei dacă am modela scena în 3D?

Poate că Arthur Conan Doyle a fost păcălit de fotografiile cu zâne, dar cred că creația sa Sherlock Holmes s-ar putea simți ca acasă în lumea analizei fotografice criminalistice.

O nouă eră a inteligenței artificiale

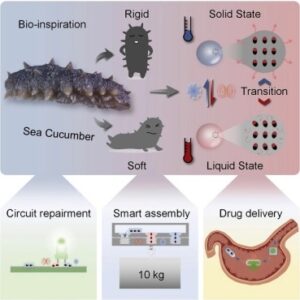

explozia actuală de imagini creat de text-to-image inteligență artificială instrumentele este în multe privințe mai radicală decât trecerea de la film la fotografia digitală.

Acum putem evoca orice imagine dorim, doar tastând. Aceste imagini nu sunt fotografii franken realizate prin împletirea unor aglomerări preexistente de pixeli. Sunt imagini complet noi, cu conținutul, calitatea și stilul specificate.

Până de curând, rețelele neuronale complexe folosite pentru a genera aceste imagini au avut o disponibilitate limitată pentru public. Acest lucru s-a schimbat pe 23 august 2022, odată cu lansarea către public a Difuziune stabilă open-source. Acum, oricine are o placă grafică Nvidia la nivel de joc în computerul său poate crea conținut de imagine AI fără niciun laborator de cercetare sau să-și controleze activitățile de afaceri.

Acest lucru i-a determinat pe mulți să întrebe „putem crede din nou ceea ce vedem online?”. Depinde.

AI text-to-image își obține inteligența din antrenament – analiza unui număr mare de perechi imagine/titlu. Punctele forte și punctele slabe ale fiecărui sistem sunt parțial derivate din imaginile pe care a fost antrenat. Iată un exemplu: așa îl vede Stable Diffusion pe George Clooney făcându-și călcatul.

Acest lucru este departe de a fi realist. Tot ce trebuie să continue Stable Diffusion sunt informațiile pe care le-a învățat și, deși este clar că l-a văzut pe George Clooney și poate lega acel șir de litere de trăsăturile actorului, nu este un expert Clooney.

Cu toate acestea, ar fi văzut și digerat multe mai multe fotografii cu bărbați de vârstă mijlocie în general, așa că să vedem ce se întâmplă când cerem un bărbat de vârstă mijlocie generic în același scenariu.

Aceasta este o îmbunătățire clară, dar încă nu chiar realistă. Așa cum a fost întotdeauna cazul, geometria complicată a mâinilor și urechilor sunt locuri bune pentru a căuta semne de falsitate - deși în acest mediu ne uităm mai degrabă la geometria spațială decât la indicii de iluminare imposibilă.

Pot exista și alte indicii. Dacă am reconstrui cu grijă camera, colțurile ar fi pătrate? Ar avea sens rafturile? Un expert criminalist obișnuit să examineze fotografiile digitale ar putea probabil să apeleze la asta.

Nu ne mai putem crede ochilor

Dacă extindem cunoștințele unui sistem text-to-image, acesta se poate descurca și mai bine. Puteți adăuga propriile fotografii descrise pentru a completa instruirea existentă. Acest proces este cunoscut ca inversare textuală.

Recent, Google a lansat Cabina de vis, o metodă alternativă, mai sofisticată, pentru a injecta anumite persoane, obiecte sau chiar stiluri de artă în sistemele AI text-to-image.

Acest proces necesită hardware rezistent, dar rezultatele sunt uluitoare. Unele lucrări grozave au început să fie distribuite pe Reddit. Uita-te la poze în postarea de mai jos care arată imagini introduse în DreamBooth și imagini false realiste din Stable Diffusion.

Nu ne mai putem crede ochilor, dar s-ar putea să mai avem încredere în cei ai experților criminalistici, cel puțin deocamdată. Este absolut posibil ca sistemele viitoare să fie antrenate în mod deliberat pentru a le păcăli și pe ele.

Trecem rapid într-o eră în care fotografia perfectă și chiar video vor fi comune. Timpul va spune cât de semnificativ va fi acest lucru, dar între timp merită să ne amintim lecția din fotografiile din Cottingley Fairy – uneori oamenii vor doar să creadă, chiar și în falsuri evidente.![]()

Acest articol este republicat de la Conversaţie sub licență Creative Commons. Citeste Articol original.

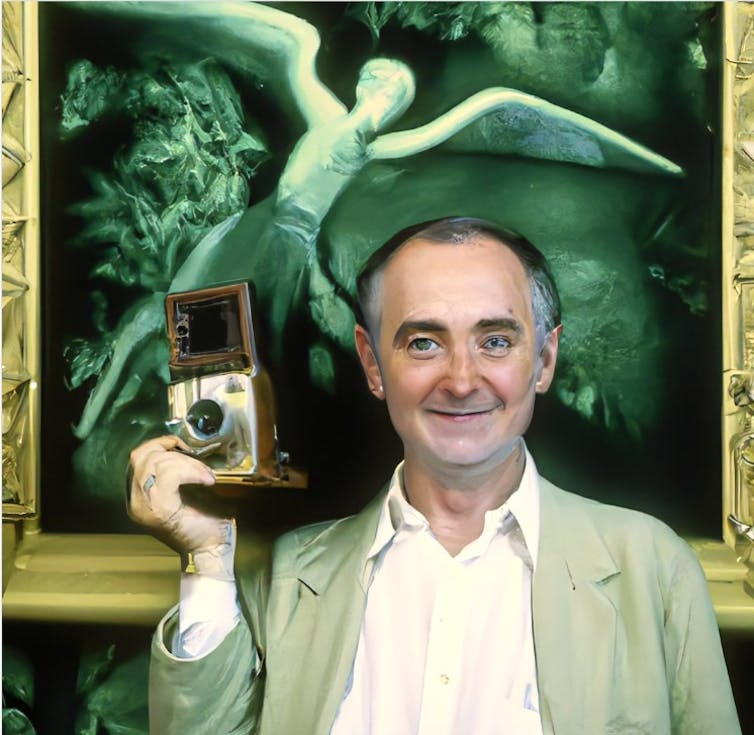

Credit imagine: Brendan Murphy / author furnizat