Modelele lingvistice mari (LLM) cu cunoștințele lor largi, pot genera text asemănător omului pe aproape orice subiect. Cu toate acestea, pregătirea lor pe seturi masive de date limitează, de asemenea, utilitatea lor pentru sarcini specializate. Fără învățare continuă, aceste modele rămân nevăzute de noile date și tendințe care apar după formarea lor inițială. În plus, costul pregătirii noilor LLM se poate dovedi prohibitiv pentru multe setări ale întreprinderii. Cu toate acestea, este posibil să faceți referințe încrucișate unui răspuns model cu conținutul original de specialitate, evitând astfel nevoia de a antrena un nou model LLM, folosind Retrieval-Augmented Generation (RAG).

RAG împuternicește LLM-urilor, oferindu-le capacitatea de a prelua și de a încorpora cunoștințe externe. În loc să se bazeze doar pe cunoștințele lor pre-instruite, RAG permite modelelor să extragă date din documente, baze de date și multe altele. Modelul integrează apoi cu pricepere aceste informații exterioare în textul său generat. Prin furnizarea de date relevante pentru context, modelul poate oferi răspunsuri informate și actualizate, adaptate cazului dvs. de utilizare. Creșterea cunoștințelor reduce, de asemenea, probabilitatea apariției halucinațiilor și a textului inexact sau fără sens. Cu RAG, modelele de fundație devin experți adaptabili care evoluează pe măsură ce baza ta de cunoștințe crește.

Astăzi, suntem încântați să dezvăluim trei demonstrații AI generative, sub licență Licență MIT-0:

- Amazon Kendra cu LLM de bază – Utilizează capacitățile de căutare profundă ale Amazon Kendra combinate cu cunoștințele extinse de LLM. Această integrare oferă răspunsuri precise și conștiente de context la interogări complexe prin extragerea dintr-o gamă variată de surse.

- Model de încorporare cu LLM de bază – Îmbină puterea înglobărilor – o tehnică de captare a semnificațiilor semantice ale cuvintelor și expresiilor – cu baza vastă de cunoștințe a LLM-urilor. Această sinergie permite modelarea subiectelor mai precise, recomandarea de conținut și capabilități de căutare semantică.

- Foundation Models Pharma Ad Generator – O aplicație specializată adaptată pentru industria farmaceutică. Valorificând capacitățile generative ale modelelor de bază, acest instrument creează reclame farmaceutice convingătoare și conforme, asigurând că conținutul respectă standardele și reglementările din industrie.

Aceste demonstrații pot fi implementate fără probleme în contul dvs. AWS, oferind informații fundamentale și îndrumări cu privire la utilizarea serviciilor AWS pentru a crea o întrebare de ultimă generație AI generativă LLM și generarea de răspunsuri și de conținut.

În această postare, explorăm modul în care RAG combinat cu Amazon Kendra sau încorporarea personalizată poate depăși aceste provocări și poate oferi răspunsuri rafinate la interogările în limbaj natural.

Prezentare generală a soluțiilor

Prin adoptarea acestei soluții, puteți obține următoarele beneficii:

- Acces îmbunătățit la informații – RAG permite modelelor să atragă informații din surse externe vaste, ceea ce poate fi deosebit de util atunci când cunoștințele modelului pre-instruit sunt depășite sau incomplete.

- scalabilitate – În loc să antreneze un model pe toate datele disponibile, RAG permite modelelor să preia informații relevante din mers. Aceasta înseamnă că, pe măsură ce noi date devin disponibile, acestea pot fi adăugate la baza de date de regăsire fără a fi nevoie să reinstruiți întregul model.

- Eficiența memoriei – LLM-urile necesită o memorie semnificativă pentru a stoca parametrii. Cu RAG, modelul poate fi mai mic deoarece nu este nevoie să memoreze toate detaliile; le poate recupera atunci când este nevoie.

- Actualizare dinamică a cunoștințelor – Spre deosebire de modelele convenționale cu un punct final de cunoștințe stabilit, baza de date externă a RAG poate suferi actualizări regulate, oferind modelului acces la informații actualizate. Funcția de recuperare poate fi reglată fin pentru sarcini distincte. De exemplu, o sarcină de diagnosticare medicală poate sursa date din reviste medicale, asigurându-se că modelul adună informații experte și pertinente.

- Atenuarea părtinirii – Abilitatea de a extrage dintr-o bază de date bine îngrijită oferă potențialul de a minimiza părtinirile prin asigurarea unor surse externe echilibrate și imparțiale.

Înainte de a aborda integrarea Amazon Kendra cu LLM de bază, este esențial să vă echipați cu instrumentele și cerințele de sistem necesare. A avea configurația corectă este primul pas către o implementare fără probleme a demo-urilor.

Cerințe preliminare

Trebuie să aveți următoarele condiții preliminare:

Deși este posibil să configurați și să implementați infrastructura detaliată în acest tutorial de pe computerul dvs. local, AWS Cloud9 oferă o alternativă convenabilă. Preechipat cu instrumente precum AWS CLI, AWS CDK și Docker, AWS Cloud9 poate funcționa ca stație de lucru pentru implementare. Pentru a utiliza acest serviciu, pur și simplu configura mediul prin intermediul Consola AWS Cloud9.

Cu cerințele prealabile în afara drumului, să ne aprofundăm în caracteristicile și capacitățile Amazon Kendra cu LLM-uri de bază.

Amazon Kendra cu LLM de bază

Amazon Kendra este un serviciu avansat de căutare pentru întreprinderi, îmbunătățit de învățarea automată (ML), care oferă capabilități de căutare semantică ieșite din cutie. Utilizând procesarea limbajului natural (NLP), Amazon Kendra înțelege atât conținutul documentelor, cât și intenția de bază a interogărilor utilizatorilor, poziționându-l ca instrument de regăsire a conținutului pentru soluțiile bazate pe RAG. Folosind conținutul de căutare de înaltă precizie de la Kendra ca sarcină utilă RAG, puteți obține răspunsuri LLM mai bune. Utilizarea Amazon Kendra în această soluție permite, de asemenea, căutarea personalizată prin filtrarea răspunsurilor în funcție de permisiunile de acces la conținutul utilizatorului final.

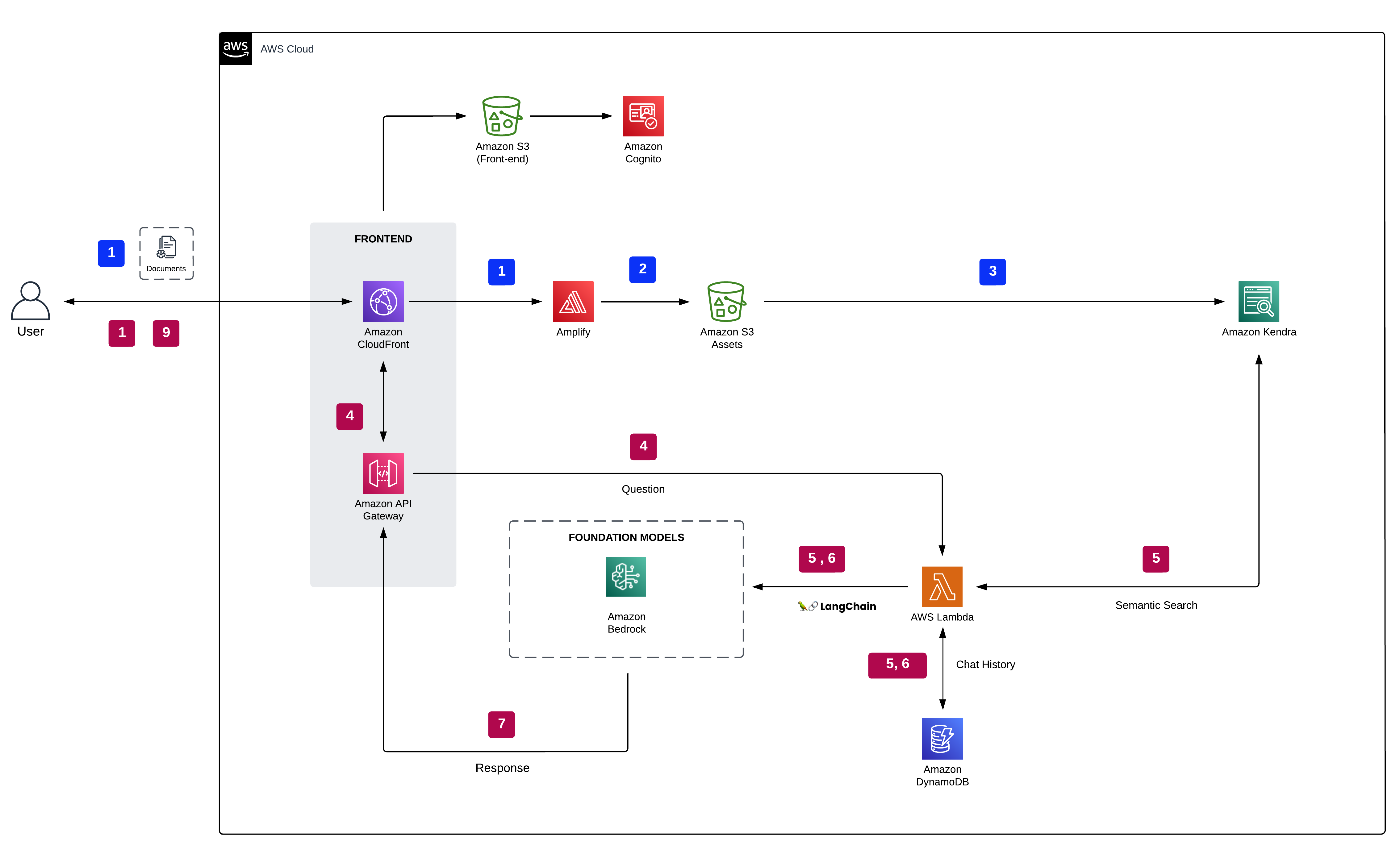

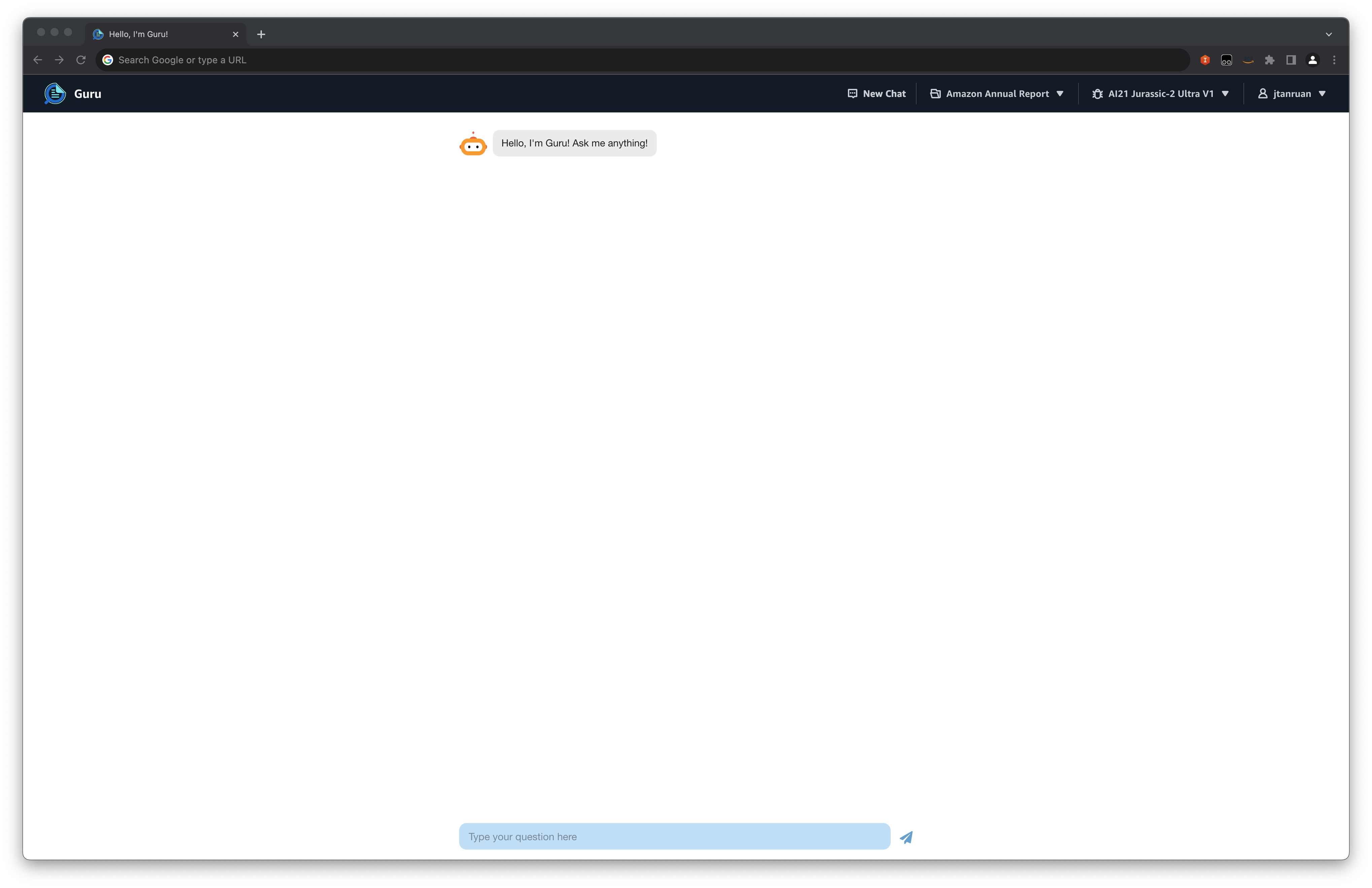

Următoarea diagramă arată arhitectura unei aplicații AI generative folosind abordarea RAG.

Documentele sunt procesate și indexate de Amazon Kendra prin intermediul Serviciul Amazon de stocare simplă (Amazon S3) conector. Solicitările clienților și datele contextuale de la Amazon Kendra sunt direcționate către un Amazon Bedrock model de fundație. Demo-ul vă permite să alegeți între modelele Titan lui Amazon, Jurassic de la AI21 și Claude de la Anthropic susținute de Amazon Bedrock. Istoricul conversațiilor este salvat în Amazon DynamoDB, oferind context suplimentar pentru ca LLM să genereze răspunsuri.

Am oferit acest demo în GitHub repo. Consultați instrucțiunile de implementare din fișierul readme pentru a-l implementa în contul dvs. AWS.

Următorii pași descriu procesul când un utilizator interacționează cu aplicația AI generativă:

- Utilizatorul se conectează la aplicația web autentificată de Amazon Cognito.

- Utilizatorul încarcă unul sau mai multe documente în Amazon S3.

- Utilizatorul rulează o lucrare de sincronizare Amazon Kendra pentru a ingera documente S3 în indexul Amazon Kendra.

- Întrebarea utilizatorului este direcționată printr-un API WebSocket securizat găzduit Gateway API Amazon susținut de un AWS Lambdas Funcția.

- Funcția Lambda, împuternicită de LangChain framework—un instrument versatil conceput pentru crearea de aplicații conduse de modele de limbaj AI—se conectează la punctul final Amazon Bedrock pentru a reformula întrebarea utilizatorului pe baza istoricului de chat. După reformulare, întrebarea este redirecționată către Amazon Kendra folosind API-ul Retrieve. Ca răspuns, indexul Amazon Kendra afișează rezultatele căutării, oferind extrase din documente pertinente provenite din datele ingerate de companie.

- Întrebarea utilizatorului împreună cu datele preluate din index sunt trimise ca context în promptul LLM. Răspunsul de la LLM este stocat ca istoric de chat în DynamoDB.

- În cele din urmă, răspunsul de la LLM este trimis înapoi utilizatorului.

Flux de lucru de indexare a documentelor

Următoarea este procedura de procesare și indexare a documentelor:

- Utilizatorii trimit documente prin interfața cu utilizatorul (UI).

- Documentele sunt transferate într-o găleată S3 utilizând Amplificare AWS API-ul.

- Amazon Kendra indexează documente noi în compartimentul S3 prin conectorul Amazon Kendra S3.

Beneficii

Următoarea listă evidențiază avantajele acestei soluții:

- Preluare la nivel de întreprindere – Amazon Kendra este conceput pentru căutarea întreprinderilor, făcându-l potrivit pentru organizațiile cu cantități mari de date structurate și nestructurate.

- Înțelegerea semantică – Capacitățile ML ale Amazon Kendra asigură că recuperarea se bazează pe o înțelegere semantică profundă și nu doar pe potrivirile cuvintelor cheie.

- scalabilitate – Amazon Kendra poate gestiona surse de date la scară largă și oferă rezultate de căutare rapide și relevante.

- Flexibilitate – Modelul de bază poate genera răspunsuri bazate pe o gamă largă de contexte, asigurându-se că sistemul rămâne versatil.

- Capabilitati de integrare – Amazon Kendra poate fi integrat cu diverse servicii AWS și surse de date, făcându-l adaptabil pentru diferite nevoi organizaționale.

Model de încorporare cu LLM de bază

An Încorporarea este un vector numeric care reprezintă esența de bază a diverselor tipuri de date, inclusiv text, imagini, audio și documente. Această reprezentare nu numai că surprinde semnificația intrinsecă a datelor, dar o adaptează și pentru o gamă largă de aplicații practice. Modelele de încorporare, o ramură a ML, transformă date complexe, cum ar fi cuvinte sau fraze, în spații vectoriale continue. Acești vectori înțeleg în mod inerent conexiunile semantice dintre date, permițând comparații mai profunde și mai perspicace.

RAG combină perfect punctele forte ale modelelor de bază, cum ar fi transformatoarele, cu precizia înglobărilor pentru a verifica bazele de date vaste pentru informații pertinente. La primirea unei interogări, sistemul utilizează înglobări pentru a identifica și extrage secțiuni relevante dintr-un corp extins de date. Modelul de bază formulează apoi un răspuns precis din punct de vedere contextual pe baza acestei informații extrase. Această sinergie perfectă între regăsirea datelor și generarea răspunsurilor permite sistemului să ofere răspunsuri amănunțite, bazându-se pe cunoștințele vaste stocate în baze de date extinse.

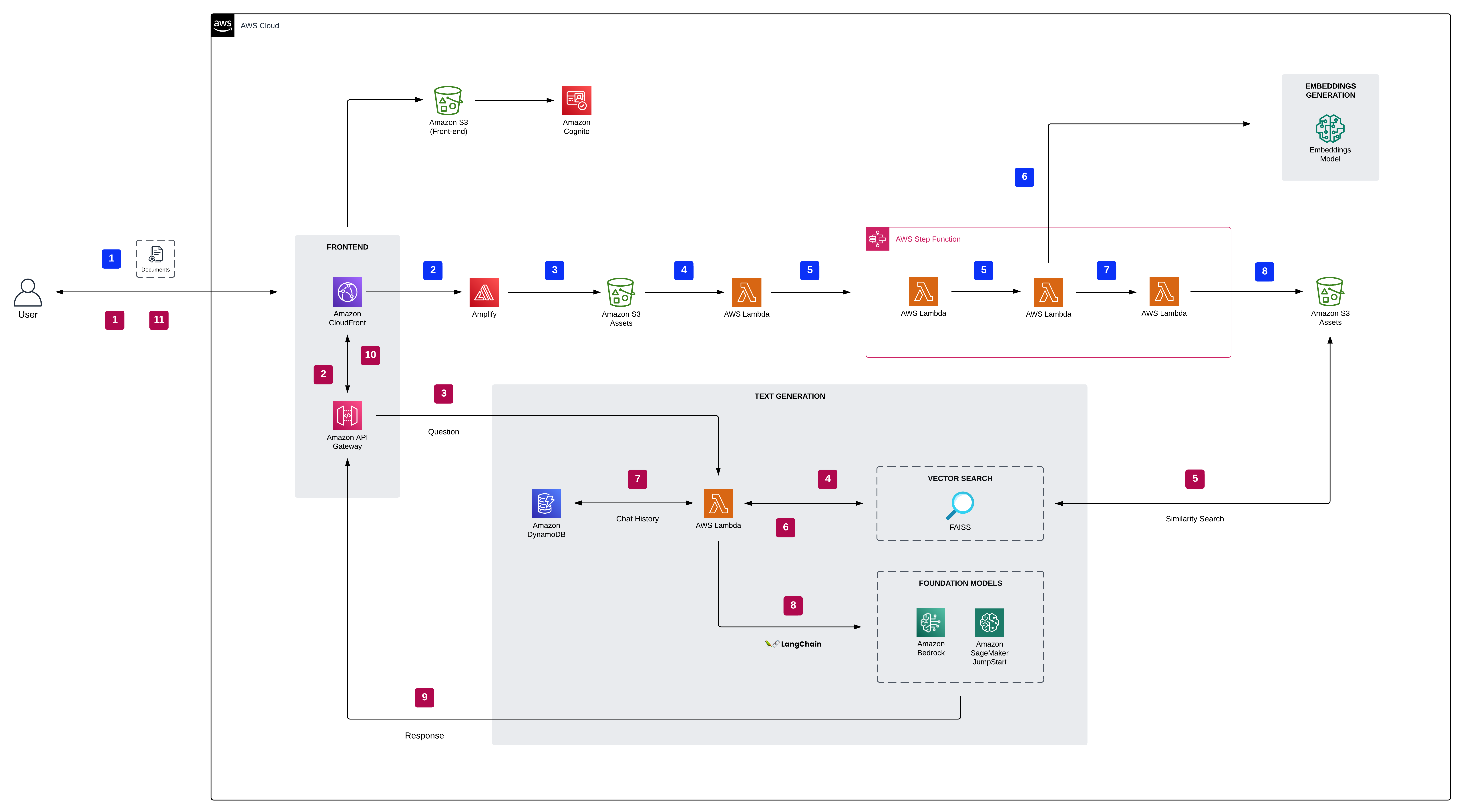

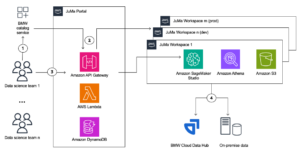

În aspectul arhitectural, pe baza selecției interfeței de utilizare, utilizatorii sunt ghidați fie către Amazon Bedrock, fie către Amazon SageMaker JumpStart modele de fundație. Documentele sunt supuse procesării, iar înglobările vectoriale sunt produse de modelul de încorporare. Aceste înglobări sunt apoi indexate folosind FAISS pentru a permite căutarea semantică eficientă. Istoricile conversațiilor sunt păstrate în DynamoDB, îmbogățind contextul pentru ca LLM să creeze răspunsuri.

Următoarea diagramă ilustrează arhitectura soluției și fluxul de lucru.

Am oferit acest demo în GitHub repo. Consultați instrucțiunile de implementare din fișierul readme pentru a-l implementa în contul dvs. AWS.

Model de înglobare

Responsabilitățile modelului de încorporare sunt următoarele:

- Acest model este responsabil pentru conversia textului (cum ar fi documentele sau pasajele) în reprezentări vectoriale dense, cunoscute în mod obișnuit ca înglobări.

- Aceste înglobări captează sensul semantic al textului, permițând comparații eficiente și semnificative din punct de vedere semantic între diferite bucăți de text.

- Modelul de înglobare poate fi antrenat pe același corpus vast ca și modelul de bază sau poate fi specializat pentru domenii specifice.

Flux de lucru de întrebări și răspunsuri

Următorii pași descriu fluxul de lucru al răspunsului la întrebare prin documente:

- Utilizatorul se conectează la aplicația web autentificată de Amazon Cognito.

- Utilizatorul încarcă unul sau mai multe documente pe Amazon S3.

- La transferul documentului, o notificare de eveniment S3 declanșează o funcție Lambda, care apelează apoi punctul final al modelului de încorporare SageMaker pentru a genera înglobări pentru noul document. Modelul de înglobare convertește întrebarea într-o reprezentare vectorială densă (înglobare). Fișierul vectorial rezultat este stocat în siguranță în compartimentul S3.

- Retrieverul FAISS compară această încorporare a întrebării cu încorporarea tuturor documentelor sau pasajelor din baza de date pentru a găsi cele mai relevante pasaje.

- Pasajele, împreună cu întrebarea utilizatorului, sunt furnizate ca context pentru modelul de bază. Funcția Lambda utilizează biblioteca LangChain și se conectează la punctul final Amazon Bedrock sau SageMaker JumpStart cu o interogare plină de context.

- Răspunsul de la LLM este stocat în DynamoDB împreună cu interogarea utilizatorului, marca temporală, un identificator unic și alți identificatori arbitrari pentru articol, cum ar fi categoria de întrebare. Stocarea întrebării și a răspunsului ca elemente discrete permite funcției Lambda să recreeze cu ușurință istoricul conversațiilor unui utilizator în funcție de momentul în care au fost puse întrebările.

- În cele din urmă, răspunsul este trimis înapoi utilizatorului printr-o solicitare HTTP prin răspunsul de integrare API API Gateway WebSocket.

Beneficii

Următoarea listă descrie beneficiile acestei soluții:

- Înțelegerea semantică – Modelul de încorporare asigură că retriever-ul selectează pasaje pe baza unei înțelegeri semantice profunde, nu doar pe potrivirile cuvintelor cheie.

- scalabilitate – Înglobarile permit comparații eficiente de similaritate, făcând posibilă căutarea rapidă în baze de date vaste de documente.

- Flexibilitate – Modelul de bază poate genera răspunsuri bazate pe o gamă largă de contexte, asigurându-se că sistemul rămâne versatil.

- Adaptabilitatea domeniului – Modelul de înglobare poate fi antrenat sau ajustat pentru domenii specifice, permițând adaptarea sistemului pentru diverse aplicații.

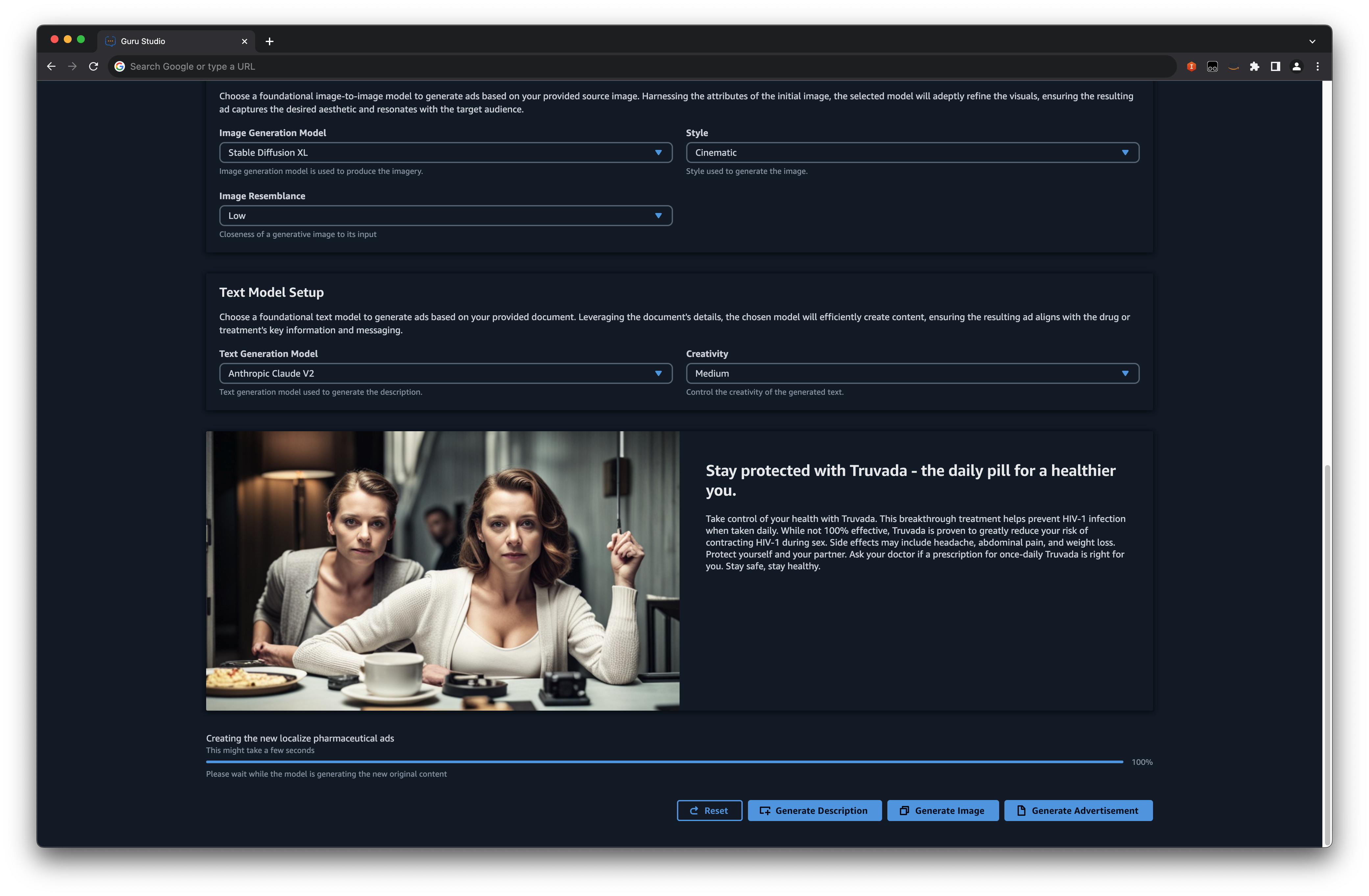

Modele de fundație Pharma Ad Generator

În industria farmaceutică cu ritm rapid de astăzi, publicitatea eficientă și localizată este mai importantă ca niciodată. Aici intră în joc o soluție inovatoare, folosind puterea AI generativă pentru a crea anunțuri farmaceutice localizate din imagini sursă și PDF-uri. Dincolo de simpla accelerare a procesului de generare a reclamelor, această abordare simplifică procesul de revizuire juridică medicală (MLR). MLR este un mecanism riguros de revizuire în care echipele medicale, juridice și de reglementare evaluează meticulos materialele promoționale pentru a garanta acuratețea, sprijinul științific și conformitatea cu reglementările. Metodele tradiționale de creare a conținutului pot fi greoaie, necesitând adesea ajustări manuale și revizuiri ample pentru a asigura alinierea la conformitatea și relevanța regională. Cu toate acestea, odată cu apariția IA generativă, acum putem automatiza crearea de reclame care rezonează cu adevărat cu publicul local, toate respectând standarde și linii directoare stricte.

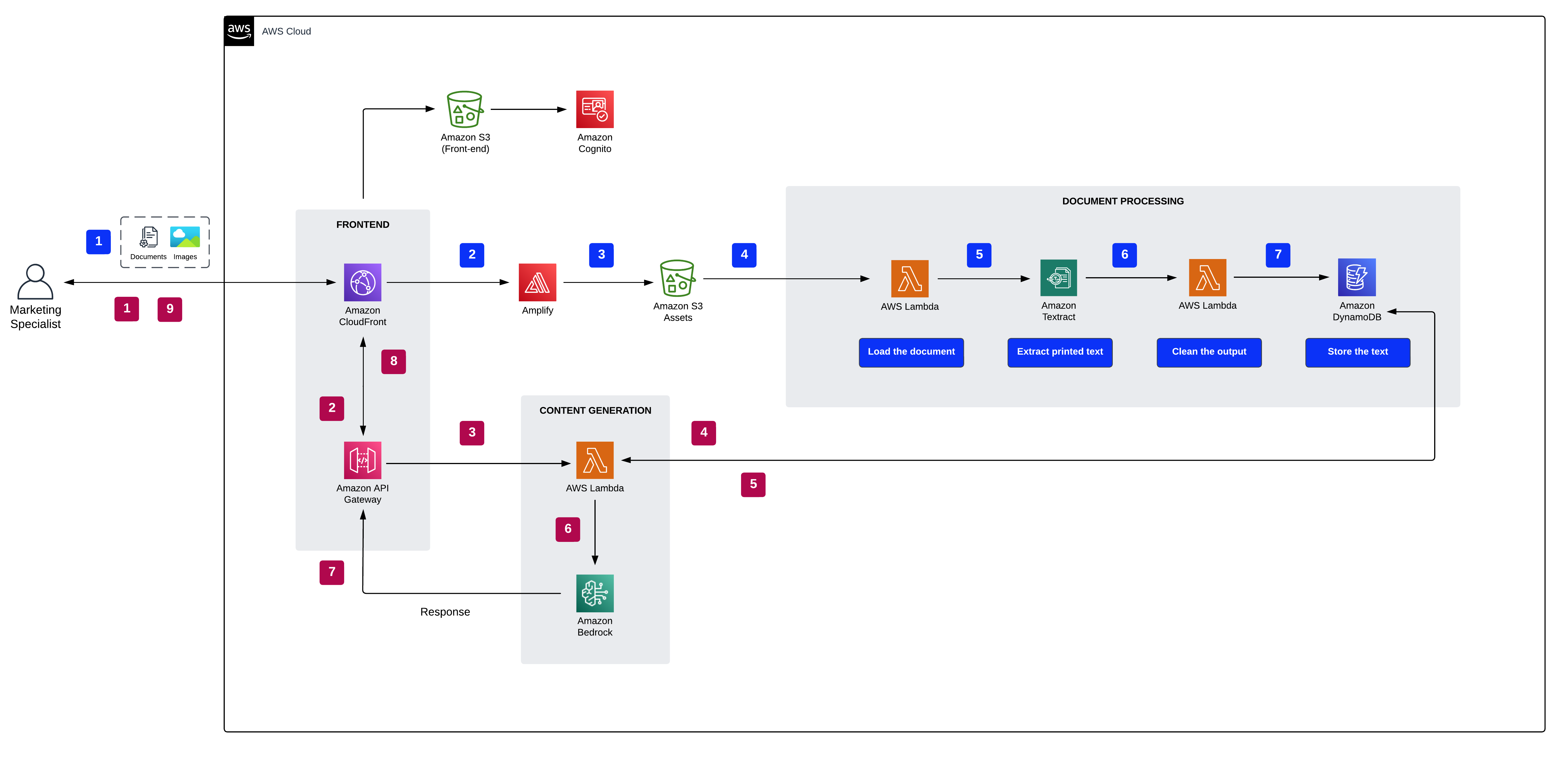

Următoarea diagramă ilustrează arhitectura soluției.

În aspectul arhitectural, pe baza modelului selectat și a preferințelor de anunțuri, utilizatorii sunt ghidați fără probleme către modelele de fundație Amazon Bedrock. Această abordare simplificată asigură că noi anunțuri sunt generate exact în funcție de configurația dorită. Ca parte a procesului, documentele sunt gestionate eficient de Text Amazon, cu textul rezultat stocat în siguranță în DynamoDB. O caracteristică remarcabilă este designul modular pentru generarea de imagini și text, oferindu-vă flexibilitatea de a regenera independent orice componentă, după cum este necesar.

Am oferit acest demo în GitHub repo. Consultați instrucțiunile de implementare din fișierul readme pentru a-l implementa în contul dvs. AWS.

Flux de lucru pentru generarea de conținut

Următorii pași descriu procesul de generare a conținutului:

- Utilizatorul își alege documentul, imaginea sursă, plasarea anunțului, limba și stilul imaginii.

- Accesul securizat la aplicația web este asigurat prin autentificarea Amazon Cognito.

- Frontend-ul aplicației web este găzduit prin Amplify.

- Un API WebSocket, gestionat de API Gateway, facilitează solicitările utilizatorilor. Aceste cereri sunt autentificate prin Gestionarea identității și accesului AWS (EU SUNT).

- Integrarea cu Amazon Bedrock include următorii pași:

- O funcție Lambda folosește biblioteca LangChain pentru a se conecta la punctul final Amazon Bedrock folosind o interogare bogată în context.

- Modelul de bază text-to-text creează un anunț adecvat contextual, bazat pe contextul și setările date.

- Modelul de bază text-to-image creează o imagine personalizată, influențată de imaginea sursă, stilul ales și locație.

- Utilizatorul primește răspunsul printr-o solicitare HTTPS prin intermediul API-ului integrat API Gateway WebSocket.

Flux de lucru de prelucrare a documentelor și imaginilor

Următoarea este procedura de procesare a documentelor și imaginilor:

- Utilizatorul încarcă materiale prin interfața de utilizare specificată.

- API-ul Amplify transferă documentele într-o găleată S3.

- După ce activul este transferat pe Amazon S3, are loc una dintre următoarele acțiuni:

- Dacă este un document, o funcție Lambda utilizează Amazon Texttract pentru a procesa și extrage text pentru generarea de anunțuri.

- Dacă este o imagine, funcția Lambda o convertește în format base64, potrivit pentru modelul Stable Diffusion pentru a crea o nouă imagine din sursă.

- Textul extras sau șirul de imagini base64 este salvat în siguranță în DynamoDB.

Beneficii

Următoarea listă descrie beneficiile acestei soluții:

- Eficiență – Utilizarea AI generativă accelerează semnificativ procesul de generare a reclamelor, eliminând necesitatea ajustărilor manuale.

- Respectarea conformității – Soluția asigură că reclamele generate respectă îndrumările și reglementările specifice, cum ar fi liniile directoare ale FDA pentru marketing.

- Cost-eficiente – Prin automatizarea creării de reclame personalizate, companiile pot reduce semnificativ costurile asociate cu producția și revizuirile reclamelor.

- Procesul MLR simplificat – Soluția simplifică procesul MLR, reducând punctele de frecare și asigurând recenzii mai fluide.

- Rezonanță localizată – Generative AI produce reclame care rezonează cu publicul local, asigurând relevanță și impact în diferite regiuni.

- Standardizare – Soluția menține standardele și liniile directoare necesare, asigurând coerența tuturor anunțurilor generate.

- scalabilitate – Abordarea bazată pe inteligență artificială poate gestiona baze de date vaste de imagini sursă și PDF-uri, făcând-o fezabilă pentru generarea de anunțuri pe scară largă.

- Intervenție manuală redusă – Automatizarea reduce nevoia de intervenție umană, minimizând erorile și asigurând consistența.

Puteți implementa infrastructura în acest tutorial de pe computerul dvs. local sau puteți utiliza AWS Cloud9 ca stație de lucru de implementare. AWS Cloud9 vine preîncărcat cu AWS CLI, AWS CDK și Docker. Dacă optați pentru AWS Cloud9, crea mediul de la Consola AWS Cloud9.

A curăța

Pentru a evita costurile inutile, curățați toată infrastructura creată prin consola AWS CloudFormation sau rulând următoarea comandă pe stația dvs. de lucru:

În plus, nu uitați să opriți toate punctele finale SageMaker pe care le-ați inițiat prin consola SageMaker. Rețineți că ștergerea unui index Amazon Kendra nu elimină documentele originale din spațiul de stocare.

Concluzie

Inteligența artificială generativă, simbolizată de LLM, anunță o schimbare de paradigmă în modul în care accesăm și generăm informații. Aceste modele, deși puternice, sunt adesea limitate de limitele datelor lor de antrenament. RAG abordează această provocare, asigurându-se că cunoștințele vaste din aceste modele sunt infuzate în mod constant cu perspective relevante și actuale.

Demo-urile noastre bazate pe RAG oferă o dovadă tangibilă a acestui lucru. Acestea prezintă sinergia perfectă dintre Amazon Kendra, încorporarea vectorului și LLM-urile, creând un sistem în care informațiile nu sunt doar vaste, ci și precise și actuale. Pe măsură ce vă scufundați în aceste demonstrații, veți explora direct potențialul de transformare al îmbinării cunoștințelor pregătite în prealabil cu capacitățile dinamice ale RAG, rezultând rezultate care sunt atât de încredere, cât și adaptate conținutului întreprinderii.

Deși AI generativă alimentată de LLM-uri deschide o nouă modalitate de a obține informații despre informații, aceste informații trebuie să fie de încredere și limitate la conținutul întreprinderii folosind abordarea RAG. Aceste demonstrații bazate pe RAG vă permit să fiți echipat cu informații care sunt precise și actualizate. Calitatea acestor informații depinde de relevanța semantică, care este activată prin utilizarea Amazon Kendra și încorporarea vectorială.

Dacă sunteți gata să explorați în continuare și să valorificați puterea AI generativă, iată următorii pași:

- Interacționează cu demonstrațiile noastre – Experiența practică este de neprețuit. Explorați funcționalitățile, înțelegeți integrările și familiarizați-vă cu interfața.

- Aprofundează-ți cunoștințele – Profitați de resursele disponibile. AWS oferă documentație aprofundată, tutoriale și asistență comunitară pentru a vă ajuta în călătoria dvs. AI.

- Inițiază un proiect pilot – Luați în considerare începerea cu o implementare la scară mică a IA generativă în întreprinderea dvs. Acest lucru va oferi informații despre caracterul practic și adaptabilitatea sistemului în contextul dvs. specific.

Pentru mai multe informații despre aplicațiile AI generative pe AWS, consultați următoarele:

Amintiți-vă, peisajul AI este în continuă evoluție. Rămâneți la curent, rămâneți curios și fiți întotdeauna gata să vă adaptați și să inovezi.

Despre autori

Jin Tan Ruan este un dezvoltator de prototipuri în cadrul echipei AWS Industries Prototyping and Customer Engineering (PACE), specializat în NLP și AI generativă. Cu o experiență în dezvoltarea de software și nouă certificări AWS, Jin aduce o mulțime de experiență pentru a ajuta clienții AWS să-și materializeze viziunile AI/ML și AI generative folosind platforma AWS. Deține o diplomă de master în Informatică și Inginerie Software de la Universitatea din Syracuse. În afara serviciului, lui Jin îi place să joace jocuri video și să se cufunde în lumea palpitantă a filmelor de groază.

Jin Tan Ruan este un dezvoltator de prototipuri în cadrul echipei AWS Industries Prototyping and Customer Engineering (PACE), specializat în NLP și AI generativă. Cu o experiență în dezvoltarea de software și nouă certificări AWS, Jin aduce o mulțime de experiență pentru a ajuta clienții AWS să-și materializeze viziunile AI/ML și AI generative folosind platforma AWS. Deține o diplomă de master în Informatică și Inginerie Software de la Universitatea din Syracuse. În afara serviciului, lui Jin îi place să joace jocuri video și să se cufunde în lumea palpitantă a filmelor de groază.

Aravind Kodandaramaiah este un producător senior de soluții de tip full stack de prototipare în cadrul echipei AWS Industries Prototyping and Customer Engineering (PACE). El se concentrează pe a ajuta clienții AWS să transforme idei inovatoare în soluții cu rezultate măsurabile și încântătoare. Este pasionat de o gamă largă de subiecte, inclusiv securitatea în cloud, DevOps și AI/ML și poate fi găsit, de obicei, căutând aceste tehnologii.

Aravind Kodandaramaiah este un producător senior de soluții de tip full stack de prototipare în cadrul echipei AWS Industries Prototyping and Customer Engineering (PACE). El se concentrează pe a ajuta clienții AWS să transforme idei inovatoare în soluții cu rezultate măsurabile și încântătoare. Este pasionat de o gamă largă de subiecte, inclusiv securitatea în cloud, DevOps și AI/ML și poate fi găsit, de obicei, căutând aceste tehnologii.

Arjun Shakdher este un dezvoltator din echipa AWS Industries Prototyping (PACE) care este pasionat de îmbinarea tehnologiei în structura vieții. Deținând o diplomă de master de la Universitatea Purdue, rolul actual al lui Arjun se învârte în jurul arhitecturii și al construirii de prototipuri de ultimă oră care se întind pe o serie de domenii, prezentând în mod proeminent domeniile AI/ML și IoT. Când nu ești cufundat în cod și peisaje digitale, îl vei găsi pe Arjun răsfățându-se în lumea cafelei, explorând mecanica complicată a orologiei sau delectându-se cu arta automobilelor.

Arjun Shakdher este un dezvoltator din echipa AWS Industries Prototyping (PACE) care este pasionat de îmbinarea tehnologiei în structura vieții. Deținând o diplomă de master de la Universitatea Purdue, rolul actual al lui Arjun se învârte în jurul arhitecturii și al construirii de prototipuri de ultimă oră care se întind pe o serie de domenii, prezentând în mod proeminent domeniile AI/ML și IoT. Când nu ești cufundat în cod și peisaje digitale, îl vei găsi pe Arjun răsfățându-se în lumea cafelei, explorând mecanica complicată a orologiei sau delectându-se cu arta automobilelor.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/harnessing-the-power-of-enterprise-data-with-generative-ai-insights-from-amazon-kendra-langchain-and-large-language-models/

- :este

- :nu

- :Unde

- $UP

- 100

- 150

- 7

- a

- capacitate

- Despre Noi

- Accelerează

- acces

- Conform

- Cont

- precizie

- precis

- peste

- acțiuni

- Ad

- adapta

- se adaptează

- adăugat

- adrese

- adera

- ajustări

- Adoptarea

- Anunţuri

- avansat

- Avantaj

- Avantajele

- venire

- Promovare

- După

- AI

- AI / ML

- Ajutorul

- aliniere

- TOATE

- permite

- Permiterea

- permite

- aproape

- de-a lungul

- de asemenea

- alternativă

- mereu

- Amazon

- Amazon Cognito

- Amazon Kendra

- Text Amazon

- Amazon Web Services

- Sume

- amplifica

- an

- și

- răspunde

- răspunsuri

- Orice

- api

- aplicaţia

- aplicație

- aplicatii

- abordare

- adecvat

- arhitectural

- arhitectură

- SUNT

- în jurul

- Mulțime

- măiestrie

- AS

- activ

- Bunuri

- ajuta

- asociate

- audieri

- audio

- autentificata

- Autentificare

- automatizarea

- automatizarea

- Automatizare

- disponibil

- evita

- evitarea

- AWS

- AWS Cloud9

- Formarea AWS Cloud

- înapoi

- sprijinit

- fundal

- sprijin

- de bază

- bazat

- BE

- deoarece

- deveni

- devine

- Beneficiile

- Mai bine

- între

- Dincolo de

- distorsiunilor

- amestecare

- corp

- Bot

- atât

- Branch firma

- Aduce

- larg

- constructor

- Clădire

- dar

- by

- apeluri

- CAN

- Poate obține

- capacități

- captura

- capturi

- caz

- Categorii

- certificări

- contesta

- provocări

- Alege

- ales

- curat

- Cloud

- Securitatea cloud

- Cloud9

- cod

- Cafea

- combinate

- combină

- vine

- în mod obișnuit

- comunitate

- Companii

- comparații

- complex

- conformitate

- conforme

- component

- cuprinde

- calculator

- Informatică

- Configuraţie

- Conectați

- Conexiuni

- Connects

- Lua în considerare

- consecvent

- Consoleze

- mereu

- conţinut

- Generare de conținut

- crearea de continut

- context

- contexte

- contextual

- a continuat

- continuu

- Convenabil

- convențional

- Conversație

- de conversie a

- Nucleu

- A costat

- Cheltuieli

- ambarcaţiunilor

- crea

- a creat

- creează

- Crearea

- creaţie

- crucial

- greoaie

- curios

- Curent

- personalizat

- client

- clienţii care

- ultima generație

- de date

- Baza de date

- baze de date

- seturi de date

- Data

- adânc

- Mai adânc

- Grad

- încântător

- Demo

- Demos

- Dependent/ă

- implementa

- dislocate

- Implementarea

- desfășurarea

- descrie

- Amenajări

- proiectat

- dorit

- distruge

- detaliat

- detalii

- Dezvoltator

- Dezvoltare

- diagnostic

- diferit

- difuziune

- digital

- dirijat

- afișează

- distinct

- scufunda

- diferit

- scufundare

- Docher

- document

- documentaţie

- documente

- Nu

- domenii

- a desena

- desen

- condus

- dinamic

- cu ușurință

- eficiență

- eficient

- eficient

- oricare

- eliminarea

- Încorporarea

- apărea

- angajează

- împuternicit

- imputerniceste

- permite

- activat

- permite

- permițând

- capăt

- Punct final

- Inginerie

- sporită

- îmbogățitor

- asigura

- asigurat

- asigură

- asigurare

- Afacere

- Întreg

- echipat

- Erori

- mai ales

- esenţă

- evalua

- eveniment

- EVER

- evolua

- evoluție

- exemplu

- excitat

- expansiv

- experienţă

- expert

- experți

- explora

- Explorarea

- extensiv

- extern

- extrage

- țesătură

- facilitează

- familiariza

- ritm rapid

- FB

- realizabil

- Caracteristică

- DESCRIERE

- Dispunând

- Fișier

- filtrare

- Găsi

- First

- Flexibilitate

- se concentrează

- următor

- urmează

- Pentru

- format

- găsit

- Fundație

- frecare

- din

- faţă

- În față

- Complet

- Stivă completă

- funcţie

- funcționalități

- mai mult

- În plus

- Câştig

- câștigă

- Jocuri

- poartă

- genera

- generată

- generaţie

- generativ

- AI generativă

- generator

- obține

- dat

- Oferirea

- acordarea

- înţelege

- creste

- garanta

- îndrumare

- ghidate

- orientări

- manipula

- hands-on

- valorifica

- Cablaje

- Avea

- având în

- he

- ajutor

- vestitori

- aici

- highlights-uri

- se

- istorii

- istorie

- deținere

- deține

- groază

- găzduit

- Cum

- Totuși

- HTML

- http

- HTTPS

- uman

- idei

- identificator

- identificatorii

- identifica

- Identitate

- if

- ilustrează

- imagine

- imagini

- cufundat

- Impactul

- implementarea

- in

- în profunzime

- inexact

- include

- Inclusiv

- incorpora

- independent

- index

- indexate

- indexurile

- industrii

- industrie

- standardele industriei

- influențat

- informații

- informat

- Infrastructură

- în mod inerent

- inițială

- iniţiat

- inova

- inovatoare

- profund

- perspective

- in schimb

- instrucțiuni

- integrate

- integreaza

- integrare

- integrările

- scop

- interactiv

- interfaţă

- intervenţie

- în

- intrinsec

- neprețuit

- IoT

- IT

- articole

- ESTE

- Loc de munca

- călătorie

- jpg

- doar

- cunoştinţe

- cunoscut

- peisaj

- limbă

- mare

- pe scară largă

- Aspect

- învăţare

- Legal

- Permite

- Bibliotecă

- Autorizat

- Viaţă

- ca

- probabilitate

- Limitat

- Limitele

- Listă

- LLM

- local

- locaţie

- maşină

- masina de învățare

- susține

- Efectuarea

- gestionate

- manual

- multe

- Marketing

- masiv

- studii de masterat

- meciuri

- Materiale

- sens

- semnificativ

- sensuri

- mijloace

- mecanică

- mecanism

- medical

- Memorie

- pur și simplu

- fuzionează

- care fuzionează

- Metode

- meticulos

- minimizând

- atenuare

- ML

- model

- modelare

- Modele

- modular

- mai mult

- cele mai multe

- Filme

- trebuie sa

- Natural

- Procesarea limbajului natural

- necesar

- Nevoie

- necesar

- au nevoie

- nevoilor

- Nou

- următor

- nouă

- nlp

- notificare

- acum

- of

- oferind

- promoții

- de multe ori

- on

- ONE

- afară

- deschide

- or

- de organizare

- organizații

- original

- Altele

- al nostru

- afară

- rezultate

- schiță

- iesiri

- exterior

- peste

- Învinge

- Pace

- paradigmă

- parametrii

- parte

- pasionat

- Perfect

- permisiuni

- Personalizat

- Pharma

- Farmaceutic

- Expresii

- piese

- pilot

- proiect pilot

- Loc

- plasare

- platformă

- Plato

- Informații despre date Platon

- PlatoData

- Joaca

- joc

- puncte

- poziţionare

- posibil

- Post

- potenţial

- putere

- alimentat

- puternic

- Practic

- precis

- tocmai

- Precizie

- preferinţele

- premise

- în prezent

- procedură

- proces

- Procesat

- prelucrare

- Produs

- produce

- producere

- proiect

- promoționale

- prototipuri

- prototipuri

- Dovedi

- furniza

- prevăzut

- furnizează

- furnizarea

- calitate

- interogări

- întrebare

- Întrebări

- Rapid

- repede

- gamă

- gata

- tărâmuri

- primește

- primire

- Recomandare

- reduce

- reduce

- reducerea

- trimite

- rafinat

- regional

- regiuni

- regulat

- regulament

- autoritățile de reglementare

- Respectarea reglementărilor

- relevanţa

- bazându-se

- rămâne

- rămășițe

- minte

- scoate

- reformularea

- reprezentare

- reprezintă

- solicita

- cereri de

- necesita

- necesar

- Cerinţe

- Rezoneze

- Resurse

- răspuns

- răspunsuri

- responsabilităţi

- responsabil

- rezultanta

- rezultând

- REZULTATE

- revizuiască

- Recenzii

- revizii

- se învârte

- dreapta

- riguros

- Rol

- funcţionare

- ruleaza

- sagemaker

- acelaşi

- salvate

- Ştiinţă

- ştiinţific

- fără sudură

- perfect

- Caută

- secțiuni

- sigur

- în siguranță,

- securitate

- selectate

- selecţie

- senior

- trimis

- serviciu

- Servicii

- set

- setări

- configurarea

- schimbare

- prezenta

- Emisiuni

- cerne

- semnificativ

- semnificativ

- simplu

- pur şi simplu

- mai mici

- mai lin

- Software

- de dezvoltare de software

- Inginerie software

- Numai

- soluţie

- soluţii

- Sursă

- provenind

- Surse

- Sourcing

- spații

- deschidere

- de specialitate

- specializata

- specific

- specificată

- stabil

- stivui

- standarde

- Pornire

- de ultimă oră

- şedere

- Pas

- paşi

- Stop

- depozitare

- stoca

- stocate

- stocarea

- raționalizate

- puncte forte

- Şir

- stringent

- structurat

- stil

- prezenta

- astfel de

- potrivit

- a sustine

- Suportat

- sinergie

- sistem

- adaptate

- Lua

- ia

- tangibil

- Sarcină

- sarcini

- echipă

- echipe

- tehnică

- Tehnologii

- Tehnologia

- testament

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- decât

- acea

- Peisajul

- Sursa

- lumea

- lor

- Lor

- apoi

- astfel

- Acestea

- ei

- acest

- trei

- emoționant

- Prin

- timp

- oportun

- timestamp-ul

- gigant

- la

- azi

- instrument

- Unelte

- subiect

- subiecte

- față de

- tradiţional

- Tren

- dresat

- Pregătire

- transfer

- transferat

- Transferuri

- Transforma

- transformare

- transformatoare

- Tendinţe

- cu adevărat

- demn de încredere

- ÎNTORCĂ

- tutorial

- tutoriale

- Tipuri

- ui

- suferi

- care stau la baza

- înţelege

- înţelegere

- unic

- universitate

- spre deosebire de

- inutil

- dezvălui

- up-to-data

- Actualizează

- actualizat

- actualizări

- susținător

- pe

- utilizare

- carcasa de utilizare

- Utilizator

- User Interface

- utilizatorii

- utilizări

- folosind

- obișnuit

- utilizează

- Utilizand

- diverse

- Fixă

- multilateral

- de

- Video

- jocuri video

- viziuni

- Cale..

- we

- Bogatie

- web

- aplicatie web

- servicii web

- WebSocket

- au fost

- cand

- care

- în timp ce

- OMS

- larg

- Gamă largă

- voi

- cu

- în

- fără

- cuvinte

- Apartamente

- flux de lucru

- Statie de lucru

- lume

- Tu

- Ta

- te

- zephyrnet