OpenAI Whisper este un model avansat de recunoaștere automată a vorbirii (ASR) cu licență MIT. Tehnologia ASR își găsește utilitate în serviciile de transcriere, asistenții vocali și îmbunătățirea accesibilității pentru persoanele cu deficiențe de auz. Acest model de ultimă generație este instruit pe un set de date vast și divers de date supravegheate multilingve și multitask colectate de pe web. Precizia și adaptabilitatea sa ridicată îl fac un bun valoros pentru o gamă largă de sarcini legate de voce.

În peisajul în continuă evoluție al învățării automate și al inteligenței artificiale, Amazon SageMaker oferă un ecosistem cuprinzător. SageMaker le permite oamenilor de știință ai datelor, dezvoltatorilor și organizațiilor să dezvolte, să antreneze, să implementeze și să gestioneze modele de învățare automată la scară. Oferind o gamă largă de instrumente și capabilități, simplifică întregul flux de lucru de învățare automată, de la preprocesarea datelor și dezvoltarea modelului până la implementarea și monitorizarea fără efort. Interfața prietenoasă a SageMaker îl face o platformă esențială pentru deblocarea întregului potențial al inteligenței artificiale, stabilindu-l ca o soluție care schimbă jocul în domeniul inteligenței artificiale.

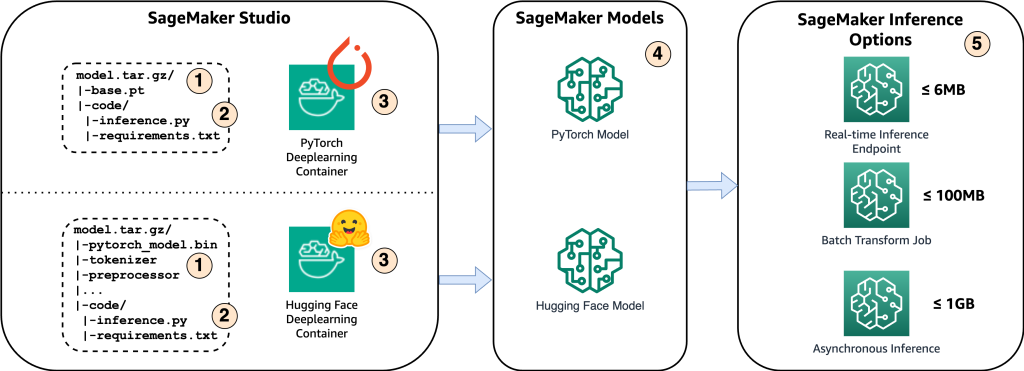

În această postare, ne lansăm într-o explorare a capacităților lui SageMaker, concentrându-ne în special pe găzduirea modelelor Whisper. Ne vom aprofunda în două metode pentru a face acest lucru: una utilizând modelul Whisper PyTorch și cealaltă folosind implementarea Hugging Face a modelului Whisper. În plus, vom efectua o examinare aprofundată a opțiunilor de inferență ale SageMaker, comparându-le în funcție de parametri precum viteza, costul, dimensiunea sarcinii utile și scalabilitatea. Această analiză permite utilizatorilor să ia decizii informate atunci când integrează modelele Whisper în cazurile și sistemele lor specifice de utilizare.

Prezentare generală a soluțiilor

Următoarea diagramă prezintă principalele componente ale acestei soluții.

- Pentru a găzdui modelul pe Amazon SageMaker, primul pas este salvarea artefactelor modelului. Aceste artefacte se referă la componentele esențiale ale unui model de învățare automată necesare pentru diverse aplicații, inclusiv implementare și reinstruire. Acestea pot include parametri de model, fișiere de configurare, componente de preprocesare, precum și metadate, cum ar fi detaliile versiunii, autorul și orice notă legată de performanța acestuia. Este important de reținut că modelele Whisper pentru implementările PyTorch și Hugging Face constau din diferite artefacte de model.

- Apoi, creăm scripturi de inferență personalizate. În cadrul acestor scripturi, definim modul în care modelul ar trebui să fie încărcat și specificăm procesul de inferență. De asemenea, aici putem încorpora parametri personalizați după cum este necesar. În plus, puteți enumera pachetele Python necesare într-un

requirements.txtfişier. În timpul implementării modelului, aceste pachete Python sunt instalate automat în faza de inițializare. - Apoi selectăm fie containerele de învățare profundă (DLC) PyTorch, fie Hugging Face furnizate și întreținute de AWS. Aceste containere sunt imagini Docker prefabricate cu cadre de învățare profundă și alte pachete Python necesare. Pentru mai multe informații, puteți verifica acest lucru legătură.

- Cu artefactele modelului, scripturile de inferență personalizate și DLC-urile selectate, vom crea modele Amazon SageMaker pentru PyTorch și, respectiv, Hugging Face.

- În cele din urmă, modelele pot fi implementate pe SageMaker și utilizate cu următoarele opțiuni: puncte finale de inferență în timp real, joburi de transformare în loturi și puncte finale de inferență asincrone. Vom aborda aceste opțiuni mai detaliat mai târziu în această postare.

Exemplul de blocnotes și codul pentru această soluție sunt disponibile pe aceasta GitHub depozit.

Figura 1. Prezentare generală a componentelor cheie ale soluției

walkthrough

Găzduirea modelului Whisper pe Amazon SageMaker

În această secțiune, vom explica pașii pentru a găzdui modelul Whisper pe Amazon SageMaker, folosind PyTorch și, respectiv, Hugging Face Frameworks. Pentru a experimenta această soluție, aveți nevoie de un cont AWS și de acces la serviciul Amazon SageMaker.

Cadrul PyTorch

- Salvați artefactele modelului

Prima opțiune de a găzdui modelul este utilizarea Pachetul oficial Python Whisper, care poate fi instalat folosind pip install openai-whisper. Acest pachet oferă un model PyTorch. La salvarea artefactelor modelului în depozitul local, primul pas este salvarea parametrilor învățabili ai modelului, cum ar fi ponderile modelului și prejudecățile fiecărui strat din rețeaua neuronală, ca fișier „pt”. Puteți alege dintre diferite dimensiuni de model, inclusiv „mic,” „de bază”, „mic”, „mediu” și „mari”. Dimensiunile mai mari ale modelului oferă performanțe de precizie mai ridicate, dar au prețul unei latențe de inferență mai lungi. În plus, trebuie să salvați dicționarul de stare a modelului și dicționarul de dimensiuni, care conțin un dicționar Python care mapează fiecare strat sau parametru al modelului PyTorch la parametrii săi de învățare corespunzători, împreună cu alte metadate și configurații personalizate. Codul de mai jos arată cum să salvați artefactele Whisper PyTorch.

- Selectați DLC

Următorul pas este să selectați DLC-ul pre-construit din acesta legătură. Fiți atenți când alegeți imaginea corectă, luând în considerare următoarele setări: cadru (PyTorch), versiune cadru, sarcină (inferență), versiune Python și hardware (adică, GPU). Este recomandat să utilizați cele mai recente versiuni pentru framework și Python ori de câte ori este posibil, deoarece acest lucru are ca rezultat o performanță mai bună și se rezolvă problemele și erorile cunoscute din versiunile anterioare.

- Creați modele Amazon SageMaker

În continuare, folosim SageMaker Python SDK pentru a crea modele PyTorch. Este important să vă amintiți să adăugați variabile de mediu atunci când creați un model PyTorch. În mod implicit, TorchServe poate procesa doar dimensiuni de fișiere de până la 6 MB, indiferent de tipul de inferență utilizat.

Următorul tabel arată setările pentru diferite versiuni PyTorch:

| Cadru | Variabile de mediu |

| PyTorch 1.8 (bazat pe TorchServe) | "TS_MAX_REQUEST_SIZE„: „100000000”" TS_MAX_RESPONSE_SIZE„: „100000000”" TS_DEFAULT_RESPONSE_TIMEOUT„: „1000” |

| PyTorch 1.4 (bazat pe MMS) | "MMS_MAX_REQUEST_SIZE„: „1000000000”" MMS_MAX_RESPONSE_SIZE„: „1000000000”" MMS_DEFAULT_RESPONSE_TIMEOUT„: „900” |

- Definiți metoda de încărcare a modelului în inference.py

În obicei inference.py script, verificăm mai întâi disponibilitatea unui GPU compatibil CUDA. Dacă un astfel de GPU este disponibil, atunci atribuim 'cuda' dispozitiv la DEVICE variabil; în caz contrar, atribuim 'cpu' dispozitiv. Acest pas asigură că modelul este plasat pe hardware-ul disponibil pentru un calcul eficient. Încărcăm modelul PyTorch folosind pachetul Whisper Python.

Cadru Hugging Face

- Salvați artefactele modelului

A doua opțiune este utilizarea Șoapta feței îmbrățișate implementare. Modelul poate fi încărcat folosind AutoModelForSpeechSeq2Seq clasa transformatoarelor. Parametrii care pot fi învățați sunt salvați într-un fișier binar (bin) folosind save_pretrained metodă. Tokenizatorul și preprocesorul trebuie, de asemenea, salvate separat pentru a se asigura că modelul Hugging Face funcționează corect. Alternativ, puteți implementa un model pe Amazon SageMaker direct din Hugging Face Hub setând două variabile de mediu: HF_MODEL_ID și HF_TASK. Pentru mai multe informații, vă rugăm să consultați aceasta pagina de web.

- Selectați DLC

Similar cu cadrul PyTorch, puteți alege un DLC Hugging Face prefabricat din același legătură. Asigurați-vă că selectați un DLC care acceptă cele mai recente transformatoare Hugging Face și care include suport pentru GPU.

- Creați modele Amazon SageMaker

În mod similar, folosim SageMaker Python SDK pentru a crea modele Hugging Face. Modelul Hugging Face Whisper are o limitare implicită în care poate procesa doar segmente audio de până la 30 de secunde. Pentru a rezolva această limitare, puteți include chunk_length_s parametrul în variabila de mediu la crearea modelului Hugging Face și, ulterior, treceți acest parametru în scriptul de inferență personalizat la încărcarea modelului. În cele din urmă, setați variabilele de mediu pentru a crește dimensiunea sarcinii utile și timpul de expirare a răspunsului pentru containerul Hugging Face.

| Cadru | Variabile de mediu |

|

Container de concluzie HuggingFace (bazat pe MMS) |

"MMS_MAX_REQUEST_SIZE„: „2000000000”" MMS_MAX_RESPONSE_SIZE„: „2000000000”" MMS_DEFAULT_RESPONSE_TIMEOUT„: „900” |

- Definiți metoda de încărcare a modelului în inference.py

Când creăm un script de inferență personalizat pentru modelul Hugging Face, utilizăm o conductă, permițându-ne să trecem chunk_length_s ca parametru. Acest parametru permite modelului să proceseze eficient fișiere audio lungi în timpul inferenței.

Explorarea diferitelor opțiuni de inferență pe Amazon SageMaker

Pașii pentru selectarea opțiunilor de inferență sunt aceiași atât pentru modelele PyTorch, cât și pentru Hugging Face, așa că nu vom face diferența între ele mai jos. Cu toate acestea, merită remarcat faptul că, la momentul scrierii acestei postări, inferență fără server opțiunea de la SageMaker nu acceptă GPU-uri și, prin urmare, excludem această opțiune pentru acest caz de utilizare.

Putem implementa modelul ca punct final în timp real, oferind răspunsuri în milisecunde. Cu toate acestea, este important de reținut că această opțiune este limitată la procesarea intrărilor sub 6 MB. Definim serializatorul ca un serializator audio, care este responsabil pentru conversia datelor de intrare într-un format potrivit pentru modelul implementat. Utilizăm o instanță GPU pentru inferență, permițând procesarea accelerată a fișierelor audio. Intrarea de inferență este un fișier audio care provine din depozitul local.

A doua opțiune de inferență este jobul de transformare în lot, care este capabil să proceseze încărcături utile de intrare de până la 100 MB. Cu toate acestea, această metodă poate dura câteva minute de latență. Fiecare instanță poate gestiona o singură solicitare de lot la un moment dat, iar inițierea și oprirea instanței necesită, de asemenea, câteva minute. Rezultatele inferenței sunt salvate într-un serviciu Amazon Simple Storage (Amazon S3) găleată la finalizarea lucrării de transformare a lotului.

Când configurați transformatorul de lot, asigurați-vă că includeți max_payload = 100 pentru a gestiona eficient sarcini utile mai mari. Intrarea inferenței ar trebui să fie calea Amazon S3 către un fișier audio sau un folder Amazon S3 Bucket care conține o listă de fișiere audio, fiecare cu o dimensiune mai mică de 100 MB.

Batch Transform partiţionează obiectele Amazon S3 din intrare după cheie şi mapează obiectele Amazon S3 la instanţe. De exemplu, atunci când aveți mai multe fișiere audio, o instanță poate procesa input1.wav, iar o altă instanță poate procesa fișierul numit input2.wav pentru a îmbunătăți scalabilitatea. Batch Transform vă permite să configurați max_concurrent_transforms pentru a crește numărul de solicitări HTTP făcute fiecărui container de transformator individual. Cu toate acestea, este important de reținut că valoarea (max_concurrent_transforms* max_payload) nu trebuie să depășească 100 MB.

În cele din urmă, Amazon SageMaker Asynchronous Inference este ideal pentru procesarea mai multor cereri simultan, oferind o latență moderată și suportând încărcături utile de intrare de până la 1 GB. Această opțiune oferă o scalabilitate excelentă, permițând configurarea unui grup de autoscaling pentru punctul final. Când are loc o creștere a cererilor, acesta crește automat pentru a gestiona traficul și, odată ce toate cererile sunt procesate, punctul final scade la 0 pentru a economisi costuri.

Folosind inferența asincronă, rezultatele sunt salvate automat într-o găleată Amazon S3. În AsyncInferenceConfig, puteți configura notificări pentru finalizarea cu succes sau eșuat. Calea de intrare indică o locație Amazon S3 a fișierului audio. Pentru detalii suplimentare, consultați codul de pe GitHub.

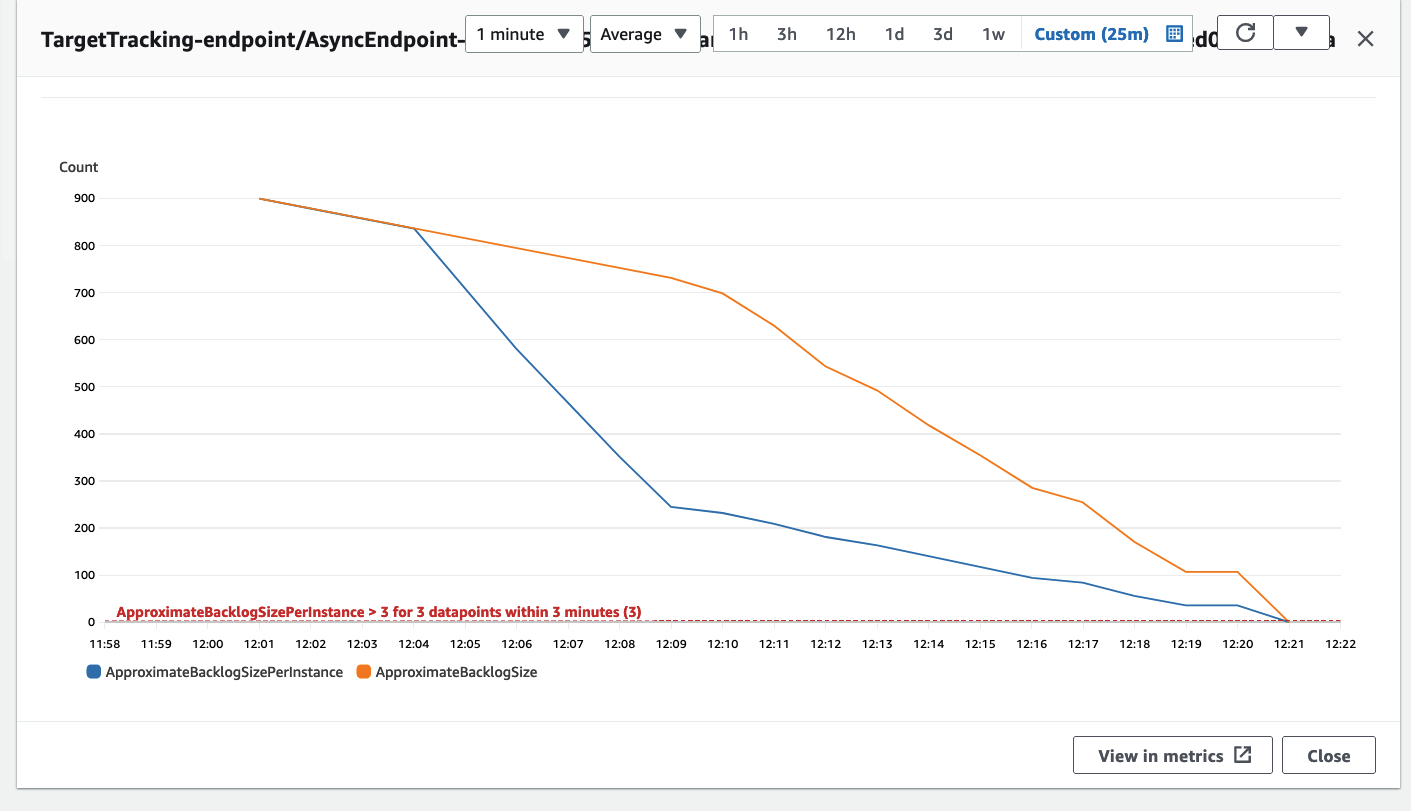

Opțional: După cum am menționat mai devreme, avem opțiunea de a configura un grup de autoscaling pentru punctul final de inferență asincron, ceea ce îi permite să gestioneze o creștere bruscă a cererilor de inferență. Un exemplu de cod este oferit în aceasta GitHub depozit. În diagrama următoare, puteți observa o diagramă cu linii care afișează două valori de la Amazon CloudWatch: ApproximateBacklogSize și ApproximateBacklogSizePerInstance. Inițial, când au fost declanșate 1000 de solicitări, era disponibilă o singură instanță pentru a gestiona inferența. Timp de trei minute, dimensiunea backlog a depășit în mod constant trei (vă rugăm să rețineți că aceste numere pot fi configurate), iar grupul de autoscaling a răspuns prin apariția unor instanțe suplimentare pentru a elimina eficient întârzierea. Acest lucru a dus la o scădere semnificativă a ApproximateBacklogSizePerInstance, permițând procesării cererilor în așteptare mult mai rapid decât în faza inițială.

Figura 2. Diagramă cu linii care ilustrează modificările temporale ale valorilor Amazon CloudWatch

Analiză comparativă pentru opțiunile de inferență

Comparațiile pentru diferite opțiuni de inferență se bazează pe cazuri comune de utilizare a procesării audio. Inferența în timp real oferă cea mai rapidă viteză de inferență, dar limitează dimensiunea sarcinii utile la 6 MB. Acest tip de inferență este potrivit pentru sistemele de comandă audio, în care utilizatorii controlează sau interacționează cu dispozitive sau software folosind comenzi vocale sau instrucțiuni vocale. Comenzile vocale sunt de obicei mici, iar latența scăzută a inferenței este crucială pentru a se asigura că comenzile transcrise pot declanșa prompt acțiuni ulterioare. Batch Transform este ideală pentru activitățile offline programate, când dimensiunea fiecărui fișier audio este mai mică de 100 MB și nu există o cerință specifică pentru timpi de răspuns rapid la inferență. Inferența asincronă permite încărcări de până la 1 GB și oferă o latență moderată de inferență. Acest tip de inferență este potrivit pentru transcrierea de filme, seriale TV și conferințe înregistrate în care fișierele audio mai mari trebuie procesate.

Atât opțiunile de inferență în timp real, cât și cele asincrone oferă capabilități de scalare automată, permițând instanțelor punctului final să crească sau să scadă automat în funcție de volumul de solicitări. În cazurile fără solicitări, scalarea automată elimină instanțele inutile, ajutându-vă să evitați costurile asociate cu instanțele furnizate care nu sunt utilizate în mod activ. Cu toate acestea, pentru inferența în timp real, trebuie reținută cel puțin o instanță persistentă, ceea ce ar putea duce la costuri mai mari dacă punctul final funcționează continuu. În schimb, inferența asincronă permite ca volumul instanței să fie redus la 0 atunci când nu este utilizat. Când configurați un job de transformare în lot, este posibil să folosiți mai multe instanțe pentru a procesa jobul și să ajustați max_concurrent_transforms pentru a permite unei instanțe să gestioneze mai multe solicitări. Prin urmare, toate cele trei opțiuni de inferență oferă o scalabilitate mare.

A curăța

După ce ați terminat de utilizat soluția, asigurați-vă că eliminați punctele finale SageMaker pentru a preveni costuri suplimentare. Puteți utiliza codul furnizat pentru a șterge punctele finale de inferență în timp real și, respectiv, asincrone.

Concluzie

În această postare, v-am arătat cum implementarea modelelor de învățare automată pentru procesarea audio a devenit din ce în ce mai esențială în diverse industrii. Luând ca exemplu modelul Whisper, am demonstrat cum să găzduim modele ASR open-source pe Amazon SageMaker folosind abordările PyTorch sau Hugging Face. Explorarea a cuprins diverse opțiuni de inferență pe Amazon SageMaker, oferind informații despre gestionarea eficientă a datelor audio, realizarea de predicții și gestionarea eficientă a costurilor. Această postare își propune să ofere cunoștințe cercetătorilor, dezvoltatorilor și oamenilor de știință de date interesați să folosească modelul Whisper pentru sarcini legate de audio și să ia decizii informate cu privire la strategiile de inferență.

Pentru informații mai detaliate despre implementarea modelelor pe SageMaker, consultați aceasta Ghid pentru dezvoltatori. În plus, modelul Whisper poate fi implementat folosind SageMaker JumpStart. Pentru detalii suplimentare, vă rugăm să verificați Modele Whisper pentru recunoașterea automată a vorbirii acum disponibile în Amazon SageMaker JumpStart post.

Nu ezitați să verificați blocnotesul și codul pentru acest proiect GitHub și împărtășește-ne comentariul tău.

Despre autor

Ying Hou, dr, este arhitect de prototipare pentru învățare automată la AWS. Domeniile ei principale de interes includ Deep Learning, cu accent pe GenAI, Computer Vision, NLP și predicția datelor în serie de timp. În timpul liber, îi place să petreacă momente de calitate cu familia ei, să se cufunde în romane și să facă drumeții în parcurile naționale din Marea Britanie.

Ying Hou, dr, este arhitect de prototipare pentru învățare automată la AWS. Domeniile ei principale de interes includ Deep Learning, cu accent pe GenAI, Computer Vision, NLP și predicția datelor în serie de timp. În timpul liber, îi place să petreacă momente de calitate cu familia ei, să se cufunde în romane și să facă drumeții în parcurile naționale din Marea Britanie.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/host-the-whisper-model-on-amazon-sagemaker-exploring-inference-options/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 10

- 100

- 12

- 14

- 140

- 16

- 19

- 30

- 32

- 7

- 8

- 900

- a

- accelerat

- acces

- accesibilitate

- Cont

- precizie

- peste

- acțiuni

- activ

- adăuga

- Suplimentar

- În plus,

- adresa

- avansat

- AI

- isi propune

- TOATE

- Permiterea

- permite

- de-a lungul

- de asemenea

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analiză

- și

- O alta

- Orice

- aplicatii

- abordari

- SUNT

- domenii

- Mulțime

- artificial

- inteligență artificială

- AS

- activ

- asistenți

- asociate

- At

- audio

- Paternitate

- Automat

- în mod automat

- disponibilitate

- disponibil

- evita

- AWS

- de bază

- bazat

- BE

- deveni

- de mai jos

- Mai bine

- între

- distorsiunilor

- BIN

- atât

- gandaci

- dar

- by

- CAN

- capacități

- capabil

- atent

- cazuri

- Modificări

- Diagramă

- verifica

- Alege

- alegere

- clasă

- clar

- cod

- cum

- comentariu

- Comun

- compararea

- comparații

- Terminat

- completare

- componente

- cuprinzător

- calcul

- calculator

- Computer Vision

- Conduce

- conferințe

- Configuraţie

- configurat

- configurarea

- luand in considerare

- consecvent

- conţine

- Recipient

- Containere

- continuu

- contrast

- Control

- de conversie a

- corecta

- Corespunzător

- A costat

- Cheltuieli

- ar putea

- crea

- Crearea

- crucial

- personalizat

- de date

- Deciziile

- scădea

- adânc

- învățare profundă

- Mod implicit

- defini

- demonstrat

- implementa

- dislocate

- Implementarea

- desfășurarea

- detaliu

- detaliat

- detalii

- dezvolta

- Dezvoltatorii

- Dezvoltare

- dispozitiv

- Dispozitive

- diferit

- distinge

- Dimensiune

- direct

- afișarea

- scufunda

- diferit

- Docher

- Nu

- face

- jos

- în timpul

- e

- fiecare

- Mai devreme

- ecosistem

- în mod eficient

- eficient

- eficient

- fără efort

- oricare

- altfel

- Îmbarce

- imputerniceste

- permite

- permite

- permițând

- înconjura

- a cuprins

- Punct final

- spori

- consolidarea

- asigura

- asigură

- Întreg

- Mediu inconjurator

- esenţial

- stabilirea

- exemplu

- depăși

- depășit

- excelent

- experiment

- Explica

- explorare

- Explorarea

- Față

- A eșuat

- fals

- familie

- FAST

- mai repede

- cel mai rapid

- puțini

- Fișier

- Fişiere

- descoperiri

- First

- Concentra

- concentrându-se

- următor

- Pentru

- format

- Cadru

- cadre

- Gratuit

- din

- Complet

- GPU

- unități de procesare grafică

- mare

- grup

- manipula

- Manipularea

- Piese metalice

- Avea

- auz

- ajutor

- ei

- Înalt

- superior

- gazdă

- găzduire

- Cum

- Cum Pentru a

- Totuși

- HTML

- http

- HTTPS

- Butuc

- Față îmbrățișată

- i

- ideal

- if

- ilustrând

- imagine

- imagini

- implementarea

- implementările

- import

- important

- in

- în profunzime

- include

- include

- Inclusiv

- incorpora

- Crește

- tot mai mult

- individ

- persoane fizice

- industrii

- informații

- informat

- inițială

- inițial

- inițiere

- intrare

- intrări

- perspective

- instala

- instalat

- instanță

- instrucțiuni

- integrarea

- Inteligență

- interacţiona

- interes

- interesat

- interfaţă

- în

- probleme de

- IT

- ESTE

- Loc de munca

- Locuri de munca

- jpg

- Cheie

- cunoştinţe

- cunoscut

- peisaj

- mai mare

- în cele din urmă

- Latență

- mai tarziu

- Ultimele

- strat

- conduce

- învăţare

- cel mai puțin

- efectului de pârghie

- Licență

- limitare

- Limitat

- Linie

- Listă

- încărca

- încărcare

- local

- locaţie

- Lung

- mai lung

- Jos

- maşină

- masina de învățare

- făcut

- Principal

- face

- FACE

- Efectuarea

- administra

- de conducere

- Harta

- Mai..

- menționat

- Metadata

- metodă

- Metode

- Metrici

- ar putea

- milisecunde

- minute

- MIT

- ML

- model

- Modele

- moderată

- Momente

- Monitorizarea

- mai mult

- Filme

- mult

- multiplu

- trebuie sa

- Numit

- național

- necesar

- Nevoie

- necesar

- reţea

- neural

- rețele neuronale

- următor

- nlp

- Nu.

- nota

- caiet

- notițe

- notificare

- notificări

- observând

- acum

- număr

- numere

- obiect

- obiecte

- observa

- of

- oferi

- oferind

- promoții

- oficial

- Offline

- on

- dată

- ONE

- afară

- open-source

- opereaza

- Opțiune

- Opţiuni

- or

- comandă

- organizații

- OS

- Altele

- in caz contrar

- afară

- Prezentare generală

- pachet

- ofertele

- parametru

- parametrii

- trece

- cale

- Efectua

- performanță

- fază

- conducte

- pivot

- platformă

- Plato

- Informații despre date Platon

- PlatoData

- "vă rog"

- puncte

- posibil

- Post

- potenţial

- prezicere

- Predictii

- împiedica

- precedent

- primar

- proces

- Procesat

- prelucrare

- procesor

- proiect

- cum se cuvine

- prototipuri

- furniza

- prevăzut

- furnizează

- furnizarea

- Piton

- pirtorh

- calitate

- gamă

- în timp real

- tărâm

- recunoaştere

- recomandat

- inregistrata

- Redus

- trimite

- Fără deosebire

- legate de

- Lansări

- minte

- scoate

- Îndepărtează

- depozit

- solicita

- cereri de

- necesita

- necesar

- cerință

- cercetători

- respectiv

- răspuns

- răspunsuri

- responsabil

- rezultat

- REZULTATE

- reveni

- sagemaker

- acelaşi

- Economisiți

- salvate

- economisire

- scalabilitate

- Scară

- cântare

- programată

- oamenii de stiinta

- scenariu

- script-uri

- Al doilea

- secunde

- Secțiune

- segmente

- selecta

- selectate

- selectarea

- serie

- serviciu

- Servicii

- set

- instalare

- setări

- Distribuie

- ea

- să

- a arătat

- Emisiuni

- închidere

- semnificativ

- simplu

- Simplifică

- Mărimea

- dimensiuni

- mic

- mai mici

- So

- Software

- soluţie

- specific

- specific

- specificată

- discurs

- Recunoaștere a vorbirii

- viteză

- Cheltuire

- vorbit

- Începe

- Stat

- de ultimă oră

- Pas

- paşi

- depozitare

- strategii

- ulterior

- de succes

- astfel de

- brusc

- potrivit

- a sustine

- De sprijin

- Sprijină

- sigur

- apare

- sisteme

- tabel

- Lua

- luare

- Sarcină

- sarcini

- Tehnologia

- decât

- acea

- Marea Britanie

- lor

- Lor

- apoi

- Acolo.

- prin urmare

- Acestea

- ei

- acest

- trei

- timp

- Seria de timp

- ori

- la

- Unelte

- lanternă

- trafic

- Tren

- dresat

- Transforma

- transformator

- transformatoare

- declanşa

- a declanșat

- tv

- Două

- tip

- tipic

- Uk

- în

- deblocare

- inutil

- pe

- us

- utilizare

- utilizat

- ușor de utilizat

- utilizatorii

- folosind

- utilitate

- folosi

- Utilizand

- Valoros

- valoare

- variabil

- diverse

- Fixă

- versiune

- Versiunile

- viziune

- Voce

- volum

- aștepta

- vrea

- a fost

- we

- web

- servicii web

- BINE

- au fost

- cand

- oricând

- care

- Şoaptă

- larg

- Gamă largă

- cu

- în

- flux de lucru

- fabrică

- valoare

- scris

- Tu

- Ta

- zephyrnet