AutoML vă permite să obțineți informații generale rapide din datele dvs. chiar la începutul ciclului de viață al unui proiect de învățare automată (ML). Înțelegerea din față a tehnicilor de preprocesare și a tipurilor de algoritm care oferă cele mai bune rezultate reduce timpul de dezvoltare, antrenament și implementare a modelului potrivit. Joacă un rol crucial în procesul de dezvoltare al fiecărui model și permite oamenilor de știință de date să se concentreze asupra celor mai promițătoare tehnici ML. În plus, AutoML oferă o performanță de bază a modelului care poate servi drept punct de referință pentru echipa de știință a datelor.

Un instrument AutoML aplică o combinație de diferiți algoritmi și diverse tehnici de preprocesare datelor dvs. De exemplu, poate scala datele, poate efectua selecția univariată a caracteristicilor, poate efectua PCA la diferite niveluri de prag de varianță și poate aplica gruparea. Astfel de tehnici de preprocesare ar putea fi aplicate individual sau combinate într-o conductă. Ulterior, un instrument AutoML ar antrena diferite tipuri de modele, cum ar fi Regresia liniară, Elastic-Net sau Random Forest, pe diferite versiuni ale setului de date preprocesat și ar efectua optimizarea hiperparametrului (HPO). Pilot automat cu Amazon SageMaker elimină ridicarea grea a modelelor ML de construcție. După furnizarea setului de date, SageMaker Autopilot explorează automat diferite soluții pentru a găsi cel mai bun model. Dar ce se întâmplă dacă doriți să implementați versiunea personalizată a unui flux de lucru AutoML?

Această postare arată cum să creați un flux de lucru AutoML personalizat Amazon SageMaker folosind Reglarea automată a modelelor Amazon SageMaker cu exemplu de cod disponibil în a Repo GitHub.

Prezentare generală a soluțiilor

Pentru acest caz de utilizare, să presupunem că faceți parte dintr-o echipă de știință a datelor care dezvoltă modele într-un domeniu specializat. Ați dezvoltat un set de tehnici personalizate de preprocesare și ați selectat o serie de algoritmi pe care de obicei vă așteptați să funcționeze bine cu problema dvs. de ML. Când lucrați la noi cazuri de utilizare ML, ați dori mai întâi să efectuați o rulare AutoML folosind tehnicile și algoritmii de preprocesare pentru a restrânge domeniul de aplicare a potențialelor soluții.

Pentru acest exemplu, nu utilizați un set de date specializat; în schimb, lucrați cu setul de date California Housing din care veți importa Serviciul Amazon de stocare simplă (Amazon S3). Accentul este de a demonstra implementarea tehnică a soluției folosind SageMaker HPO, care ulterior poate fi aplicată oricărui set de date și domeniu.

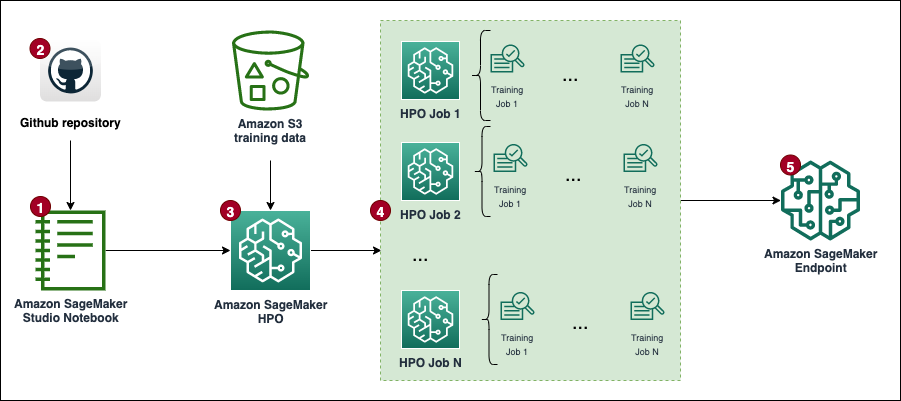

Următoarea diagramă prezintă fluxul de lucru global al soluției.

Cerințe preliminare

Următoarele sunt condiții prealabile pentru finalizarea tutorialului din această postare:

Implementează soluția

Codul complet este disponibil în GitHub repo.

Pașii de implementare a soluției (după cum este menționat în diagrama fluxului de lucru) sunt următorii:

- Creați o instanță de notebook și specificați următoarele:

- Pentru Tipul de instanță de notebook, alege ml.t3.mediu.

- Pentru Inferență elastică, alege nici unul.

- Pentru Identificatorul platformei, alege Amazon Linux 2, Jupyter Lab 3.

- Pentru Rolul IAM, alegeți valoarea implicită

AmazonSageMaker-ExecutionRole. Dacă nu există, creați unul nou Gestionarea identității și accesului AWS (IAM) și atașați Politica AmazonSageMakerFullAccess IAM.

Rețineți că ar trebui să creați un rol de execuție și o politică minimă în producție.

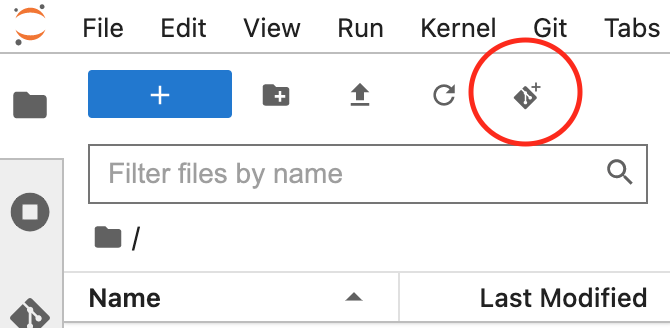

- Deschideți interfața JupyterLab pentru instanța de notebook și clonați depozitul GitHub.

Puteți face acest lucru pornind o nouă sesiune de terminal și rulând programul git clone <REPO> comanda sau utilizând funcționalitatea UI, așa cum se arată în următoarea captură de ecran.

- Deschideți

automl.ipynbfișier caiet, selectațiconda_python3nucleu și urmați instrucțiunile pentru a declanșa a set de joburi HPO.

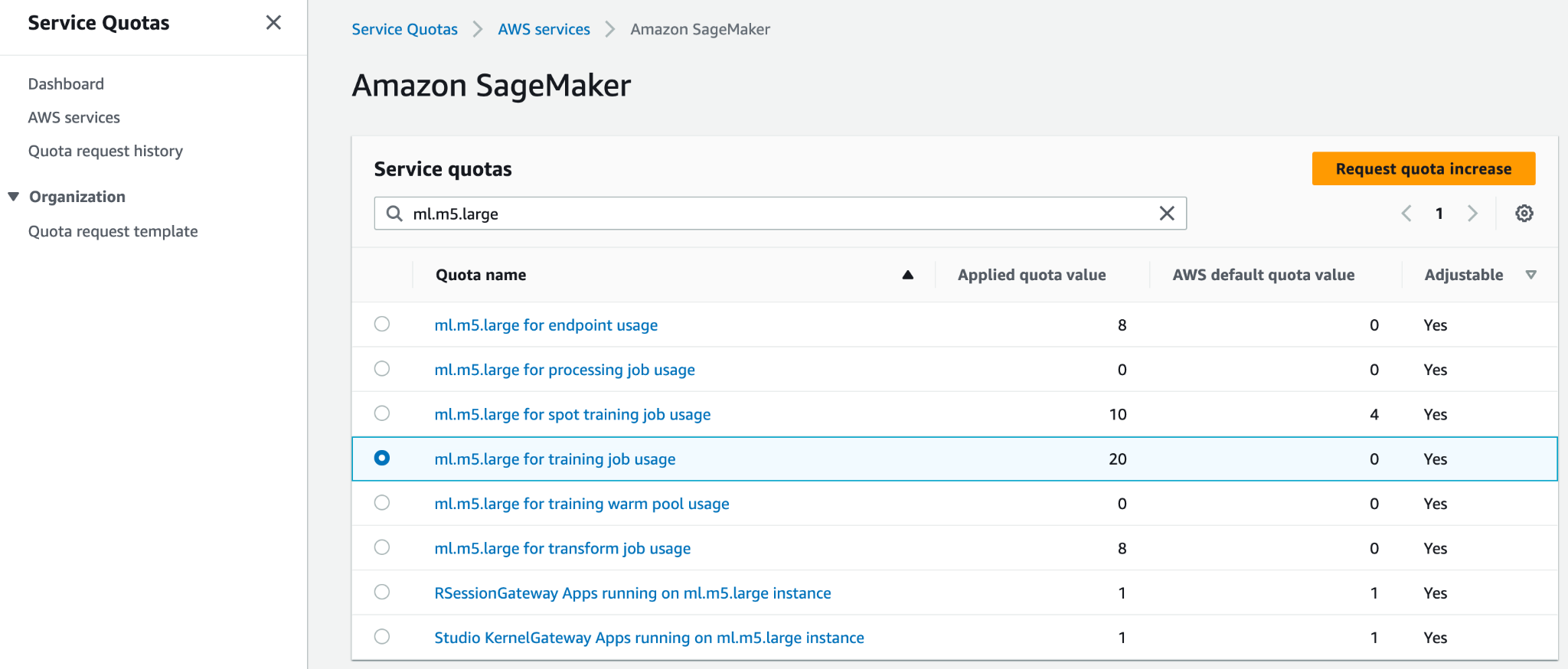

Pentru a rula codul fără modificări, trebuie să măriți cota de servicii pentru ml.m5.mare pentru utilizarea jobului de formare și Numărul de cazuri în toate joburile de formare. AWS permite implicit doar 20 de joburi paralele de instruire SageMaker pentru ambele cote. Trebuie să solicitați o creștere a cotei la 30 pentru ambele. Ambele modificări ale cotei ar trebui de obicei aprobate în câteva minute. A se referi la Solicitarea unei mariri de cota pentru mai multe informatii.

Dacă nu doriți să modificați cota, puteți modifica pur și simplu valoarea MAX_PARALLEL_JOBS variabilă în script (de exemplu, la 5).

- Fiecare lucrare HPO va completa un set de job de formare încercări și indicați modelul cu hiperparametri optimi.

- Analizați rezultatele și implementați modelul cel mai performant.

Această soluție va genera costuri în contul dvs. AWS. Costul acestei soluții va depinde de numărul și durata joburilor de formare HPO. Pe măsură ce acestea cresc, vor crește și costurile. Puteți reduce costurile prin limitarea timpului de antrenament și configurare TuningJobCompletionCriteriaConfig conform instrucțiunilor discutate mai târziu în această postare. Pentru informații despre preț, consultați Prețuri Amazon SageMaker.

În secțiunile următoare, discutăm mai detaliat caietul cu exemple de cod și pașii pentru a analiza rezultatele și a selecta cel mai bun model.

Configurare inițială

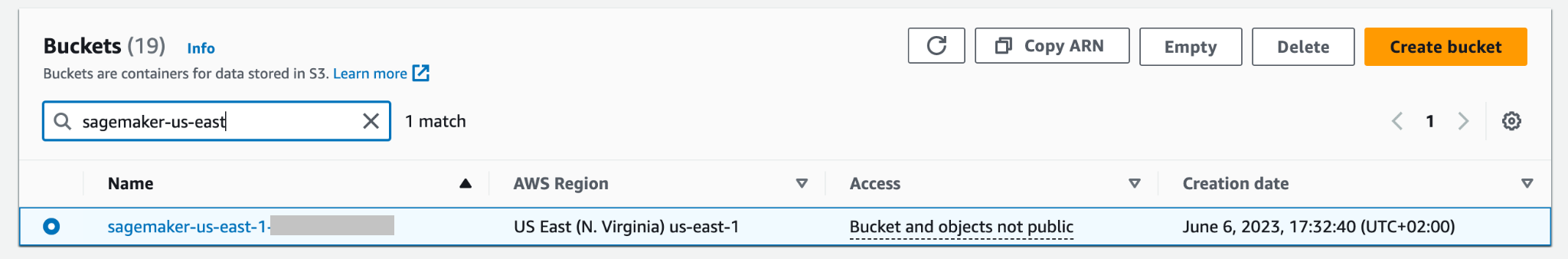

Să începem cu rularea Importuri și configurare secțiune în custom-automl.ipynb caiet. Instalează și importă toate dependențele necesare, instanțează o sesiune și un client SageMaker și setează Regiunea și compartimentul S3 implicit pentru stocarea datelor.

Pregătirea datelor

Descărcați setul de date California Housing și pregătiți-l executând aplicația Descărcați datele secțiunea caietului. Setul de date este împărțit în cadre de date de antrenament și testare și este încărcat în compartimentul S3 implicit al sesiunii SageMaker.

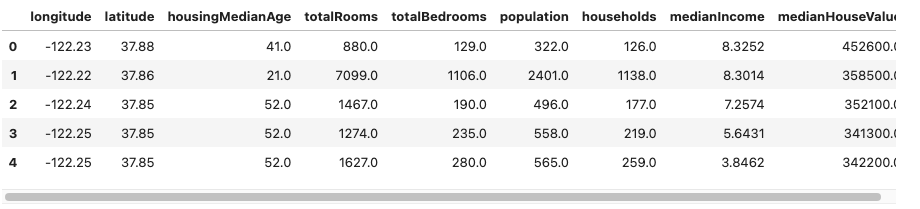

Întregul set de date are 20,640 de înregistrări și 9 coloane în total, inclusiv ținta. Scopul este de a prezice valoarea mediană a unei case (medianHouseValue coloană). Următoarea captură de ecran arată rândurile de sus ale setului de date.

Șablon de script de antrenament

Fluxul de lucru AutoML din această postare se bazează pe scikit-learn conducte și algoritmi de preprocesare. Scopul este de a genera o combinație mare de conducte și algoritmi de preprocesare diferite pentru a găsi configurația cu cea mai bună performanță. Să începem cu crearea unui script de antrenament generic, care este persistat local pe instanța notebook-ului. În acest script, există două blocuri de comentarii goale: unul pentru injectarea de hiperparametri și celălalt pentru obiectul pipeline al modelului de preprocesare. Acestea vor fi injectate dinamic pentru fiecare model candidat de preprocesare. Scopul de a avea un singur script generic este de a menține implementarea DRY (nu te repeta).

Creați combinații de preprocesare și model

preprocessors dicționarul conține o specificație a tehnicilor de preprocesare aplicate tuturor caracteristicilor de intrare ale modelului. Fiecare rețetă este definită folosind a Pipeline sau un FeatureUnion obiect din scikit-learn, care conectează transformările individuale de date și le stivuiește împreună. De exemplu, mean-imp-scale este o rețetă simplă care asigură că valorile lipsă sunt imputate utilizând valorile medii ale coloanelor respective și că toate caracteristicile sunt scalate folosind StandardScaler. În schimb, mean-imp-scale-pca Rețetele înlănțuiesc încă câteva operațiuni:

- Impută valorile lipsă în coloane cu media.

- Aplicați scalarea caracteristicilor folosind media și abaterea standard.

- Calculați PCA pe deasupra datelor de intrare la o valoare de prag de variație specificată și îmbinați-o împreună cu caracteristicile de intrare imputate și scalate.

În această postare, toate caracteristicile de intrare sunt numerice. Dacă aveți mai multe tipuri de date în setul de date de intrare, ar trebui să specificați o conductă mai complicată în care diferite ramuri de preprocesare sunt aplicate la diferite seturi de tipuri de caracteristici.

models dicționarul conține specificații ale diferiților algoritmi la care potriviți setul de date. Fiecare tip de model vine cu următoarele specificații în dicționar:

- script_output – Indică locația scriptului de antrenament utilizat de estimator. Acest câmp este completat dinamic atunci când

modelsdicționarul este combinat cupreprocessorsdicţionar. - inserții – Definește codul care va fi inserat în

script_draft.pyși ulterior salvat subscript_output. Cheia“preprocessor”este lăsat necompletat în mod intenționat deoarece această locație este completată cu unul dintre preprocesoare pentru a crea mai multe combinații model-preprocesor. - hiperparametri – Un set de hiperparametri care sunt optimizați de jobul HPO.

- include_cls_metadata – Mai multe detalii de configurare necesare de către SageMaker

Tunerclasă.

Un exemplu complet al models dicționarul este disponibil în depozitul GitHub.

În continuare, să repetăm preprocessors și models dicționare și creați toate combinațiile posibile. De exemplu, dacă dvs preprocessors dicționarul conține 10 rețete și aveți 5 definiții de model în models dicționar, noul dicționar de conducte creat conține 50 de conducte de model de preprocesor care sunt evaluate în timpul HPO. Rețineți că scripturile pipeline individuale nu sunt încă create în acest moment. Următorul bloc de cod (celula 9) al notebook-ului Jupyter iterează prin toate obiectele modelului de preprocesor din pipelines dicționar, inserează toate bucățile de cod relevante și persistă o versiune specifică conductei a scriptului local în blocnotes. Aceste scripturi sunt utilizate în următorii pași la crearea estimatorilor individuali pe care îi conectați la jobul HPO.

Definiți estimatorii

Acum puteți lucra la definirea estimatorilor SageMaker pe care jobul HPO îi folosește după ce scripturile sunt gata. Să începem cu crearea unei clase wrapper care definește unele proprietăți comune pentru toți estimatorii. Moștenește de la SKLearn clasa și specifică rolul, numărul de instanțe și tipul, precum și ce coloane sunt utilizate de script ca caracteristici și țintă.

Să construim estimators dicționar prin iterarea tuturor scripturilor generate înainte și situate în scripts director. Instanțiați un nou estimator folosind SKLearnBase clasa, cu un nume unic de estimator și unul dintre scripturi. Rețineți că estimators dicționarul are două niveluri: nivelul superior definește a pipeline_family. Aceasta este o grupare logică bazată pe tipul de modele de evaluat și este egală cu lungimea models dicţionar. Al doilea nivel conține tipuri individuale de preprocesoare combinate cu cele date pipeline_family. Această grupare logică este necesară la crearea jobului HPO.

Definiți argumentele tunerului HPO

Pentru a optimiza transmiterea argumentelor în HPO Tuner clasa, cel HyperparameterTunerArgs clasa de date este inițializată cu argumentele cerute de clasa HPO. Vine cu un set de funcții, care asigură ca argumentele HPO să fie returnate într-un format așteptat la implementarea mai multor definiții de model simultan.

Următorul bloc de cod folosește codul introdus anterior HyperparameterTunerArgs clasa de date. Creați un alt dicționar numit hp_args și generați un set de parametri de intrare specifici fiecăruia estimator_family de la estimators dicţionar. Aceste argumente sunt folosite în pasul următor la inițializarea joburilor HPO pentru fiecare familie de modele.

Creați obiecte tuner HPO

În acest pas, creați tunerele individuale pentru fiecare estimator_family. De ce creați trei joburi HPO separate în loc să lansați doar unul pentru toți estimatorii? The HyperparameterTuner clasa este limitată la 10 definiții de model atașate acesteia. Prin urmare, fiecare HPO este responsabil pentru găsirea celui mai bun preprocesor pentru o anumită familie de modele și pentru reglarea hiperparametrilor acelei familii de modele.

Următoarele sunt alte câteva puncte referitoare la configurare:

- Strategia de optimizare este Bayesiană, ceea ce înseamnă că HPO monitorizează în mod activ performanța tuturor încercărilor și navighează optimizarea către combinații de hiperparametri mai promițătoare. Oprirea timpurie ar trebui să fie setată la de pe or Auto atunci când lucrați cu o strategie bayesiană, care se ocupă de acea logică în sine.

- Fiecare job HPO rulează pentru maximum 100 de joburi și rulează 10 joburi în paralel. Dacă aveți de-a face cu seturi de date mai mari, este posibil să doriți să creșteți numărul total de locuri de muncă.

- În plus, poate doriți să utilizați setări care controlează cât timp rulează o lucrare și câte lucrări declanșează HPO. O modalitate de a face acest lucru este să setați durata maximă de rulare în secunde (pentru această postare, o setăm la 1 oră). Un altul este să folosești cel recent lansat

TuningJobCompletionCriteriaConfig. Oferă un set de setări care monitorizează progresul lucrărilor dvs. și decid dacă este probabil ca mai multe locuri de muncă să îmbunătățească rezultatul. În această postare, am setat numărul maxim de locuri de muncă de formare care nu se îmbunătățesc la 20. În acest fel, dacă scorul nu se îmbunătățește (de exemplu, din a XNUMX-a încercare), nu va trebui să plătiți pentru încercările rămase pânămax_jobseste atins.

Acum să repetăm tuners și hp_args dicționare și declanșează toate joburile HPO în SageMaker. Observați utilizarea argumentului wait setat la False, ceea ce înseamnă că nucleul nu va aștepta până când rezultatele sunt complete și puteți declanșa toate joburile simultan.

Este probabil ca nu toate joburile de formare să se finalizeze și unele dintre ele ar putea fi oprite de jobul HPO. Motivul pentru aceasta este TuningJobCompletionCriteriaConfig—optimizarea se termină dacă este îndeplinit oricare dintre criteriile specificate. În acest caz, când criteriile de optimizare nu se îmbunătățesc pentru 20 de locuri de muncă consecutive.

Analizați rezultatele

Celula 15 a notebook-ului verifică dacă toate lucrările HPO sunt finalizate și combină toate rezultatele sub forma unui cadru de date panda pentru analize ulterioare. Înainte de a analiza rezultatele în detaliu, să aruncăm o privire la nivel înalt asupra consolei SageMaker.

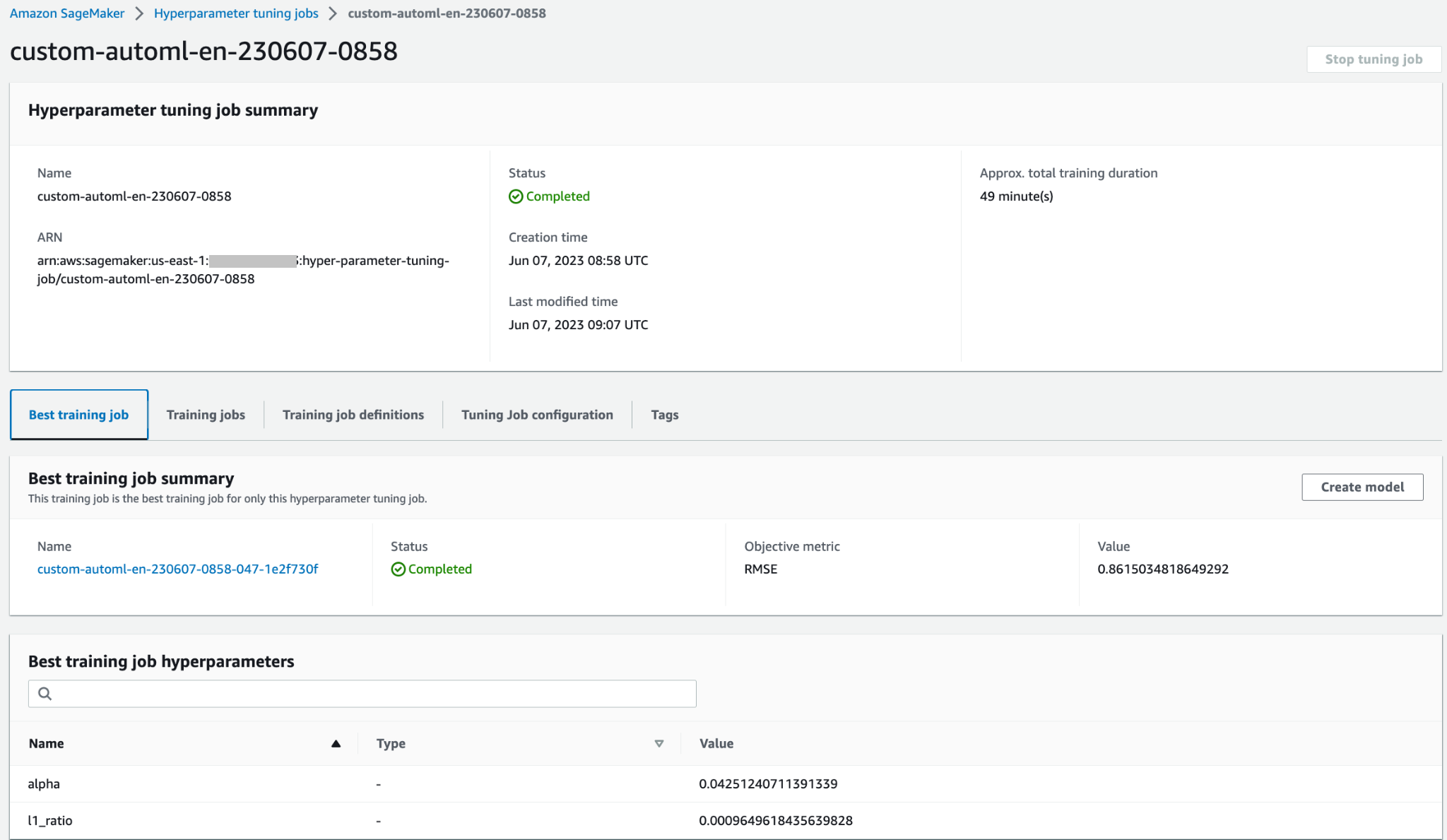

În partea de sus a Lucrări de reglare a hiperparametrilor pagina, puteți vedea cele trei joburi HPO lansate. Toți au terminat devreme și nu au efectuat toate cele 100 de locuri de muncă. În următoarea captură de ecran, puteți vedea că familia de modele Elastic-Net a finalizat cel mai mare număr de încercări, în timp ce alții nu au avut nevoie de atât de multe locuri de muncă pentru a găsi cel mai bun rezultat.

Puteți deschide jobul HPO pentru a accesa mai multe detalii, cum ar fi joburi de formare individuale, configurația jobului și informațiile și performanța celei mai bune joburi de antrenament.

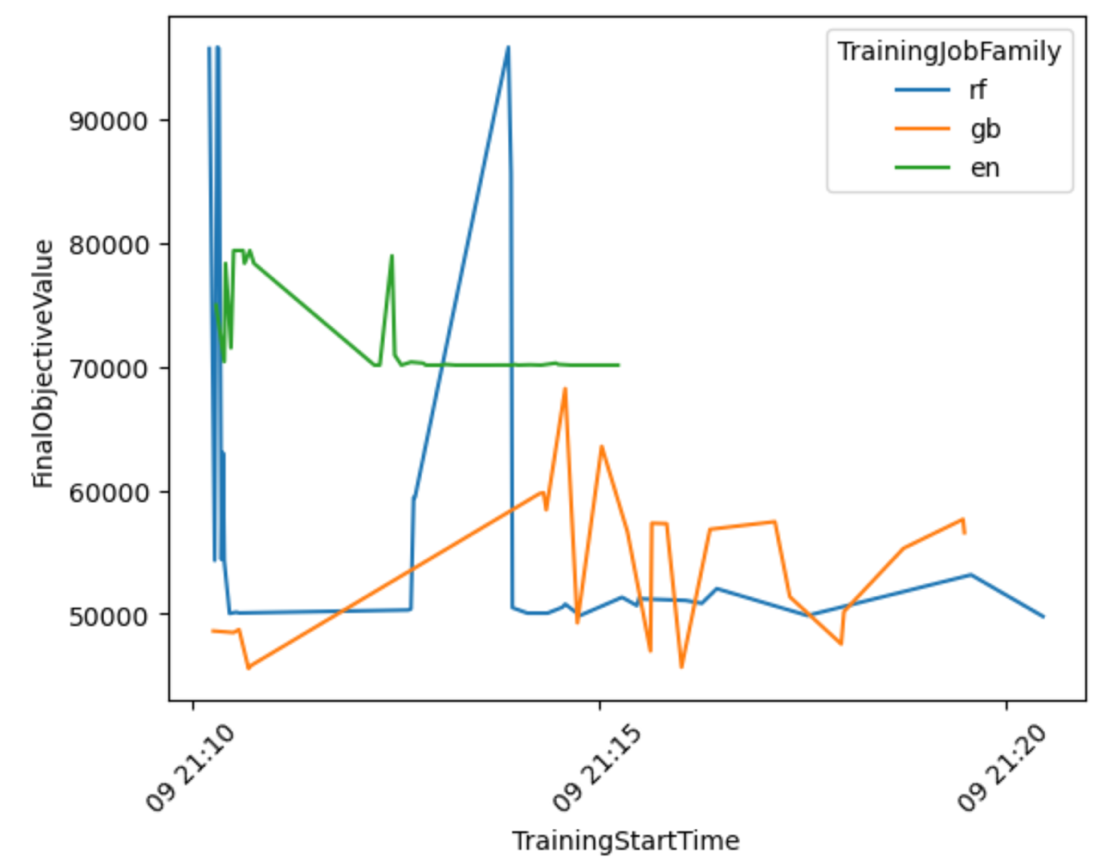

Să producem o vizualizare bazată pe rezultate pentru a obține mai multe informații despre performanța fluxului de lucru AutoML în toate familiile de modele.

Din graficul următor, puteți trage concluzia că Elastic-Net Performanța modelului a oscilat între 70,000 și 80,000 RMSE și, în cele din urmă, sa blocat, deoarece algoritmul nu a reușit să-și îmbunătățească performanța, în ciuda încercării diferitelor tehnici de preprocesare și a valorilor hiperparametrilor. De asemenea, se pare că RandomForest performanța a variat mult în funcție de setul de hiperparametri explorat de HPO, dar, în ciuda multor încercări, nu a putut să coboare sub eroarea de 50,000 RMSE. GradientBoosting a obținut cea mai bună performanță deja de la început, coborând sub 50,000 RMSE. HPO a încercat să îmbunătățească acest rezultat în continuare, dar nu a reușit să obțină performanțe mai bune în alte combinații de hiperparametri. O concluzie generală pentru toate joburile HPO este că nu au fost necesare atât de multe joburi pentru a găsi cel mai performant set de hiperparametri pentru fiecare algoritm. Pentru a îmbunătăți și mai mult rezultatul, ar trebui să experimentați cu crearea mai multor caracteristici și realizarea de inginerie de caracteristici suplimentare.

De asemenea, puteți examina o vedere mai detaliată a combinației model-preprocesor pentru a trage concluzii despre cele mai promițătoare combinații.

Selectați cel mai bun model și implementați-l

Următorul fragment de cod selectează cel mai bun model pe baza celei mai mici valori obiective atinse. Apoi puteți implementa modelul ca punct final SageMaker.

A curăța

Pentru a preveni taxele nedorite către contul dvs. AWS, vă recomandăm să ștergeți resursele AWS pe care le-ați folosit în această postare:

- Pe consola Amazon S3, goliți datele din compartimentul S3 în care au fost stocate datele de antrenament.

- Pe consola SageMaker, opriți instanța notebook-ului.

- Ștergeți punctul final al modelului dacă l-ați implementat. Punctele finale ar trebui șterse atunci când nu mai sunt utilizate, deoarece sunt facturate în funcție de timpul de implementare.

Concluzie

În această postare, am prezentat cum să creați o lucrare HPO personalizată în SageMaker folosind o selecție personalizată de algoritmi și tehnici de preprocesare. În special, acest exemplu demonstrează cum să automatizezi procesul de generare a multor scripturi de antrenament și cum să folosești structurile de programare Python pentru implementarea eficientă a mai multor joburi de optimizare paralelă. Sperăm că această soluție va forma schela oricăror lucrări personalizate de reglare a modelelor pe care le veți implementa folosind SageMaker pentru a obține performanțe mai mari și pentru a accelera fluxurile de lucru ML.

Consultați următoarele resurse pentru a vă aprofunda cunoștințele despre cum să utilizați SageMaker HPO:

Despre Autori

Konrad Semsch este arhitect senior de soluții ML la echipa Amazon Web Services Data Lab. El îi ajută pe clienți să folosească învățarea automată pentru a-și rezolva provocările de afaceri cu AWS. Îi place să inventeze și să simplifice pentru a oferi clienților soluții simple și pragmatice pentru proiectele lor AI/ML. El este cel mai pasionat de MlOps și știința tradițională a datelor. În afara serviciului, este un mare fan al windsurfingului și kitesurfing-ului.

Konrad Semsch este arhitect senior de soluții ML la echipa Amazon Web Services Data Lab. El îi ajută pe clienți să folosească învățarea automată pentru a-și rezolva provocările de afaceri cu AWS. Îi place să inventeze și să simplifice pentru a oferi clienților soluții simple și pragmatice pentru proiectele lor AI/ML. El este cel mai pasionat de MlOps și știința tradițională a datelor. În afara serviciului, este un mare fan al windsurfingului și kitesurfing-ului.

Ton Ersoy este arhitect senior de soluții la AWS. Obiectivul ei principal este de a ajuta clienții din sectorul public să adopte tehnologii cloud pentru sarcinile lor de lucru. Ea are experiență în dezvoltarea de aplicații, arhitectura întreprinderii și tehnologiile centrelor de contact. Interesele ei includ arhitecturi fără server și AI/ML.

Ton Ersoy este arhitect senior de soluții la AWS. Obiectivul ei principal este de a ajuta clienții din sectorul public să adopte tehnologii cloud pentru sarcinile lor de lucru. Ea are experiență în dezvoltarea de aplicații, arhitectura întreprinderii și tehnologiile centrelor de contact. Interesele ei includ arhitecturi fără server și AI/ML.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :are

- :este

- :nu

- :Unde

- $UP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Capabil

- Despre Noi

- acces

- Conform

- Cont

- Obține

- realizat

- peste

- activ

- Suplimentar

- În plus,

- adopta

- După

- AI / ML

- urmări

- Algoritmul

- algoritmi

- TOATE

- Permiterea

- permite

- deja

- de asemenea

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analiză

- analiza

- analiza

- și

- O alta

- Orice

- aplicație

- Dezvoltare de Aplicații

- aplicat

- se aplică

- Aplică

- aprobat

- arhitectură

- SUNT

- argument

- argumente

- AS

- asuma

- At

- atașa

- Auto

- automatizarea

- Automat

- în mod automat

- AutoML

- disponibil

- AWS

- fundal

- de bază

- bazat

- De bază

- Bayesian

- BE

- deoarece

- înainte

- Început

- de mai jos

- CEL MAI BUN

- Mai bine

- între

- Mare

- Bloca

- Blocuri

- atât

- ramuri

- construi

- Clădire

- afaceri

- dar

- buton

- by

- California

- apel

- denumit

- CAN

- candidat

- caz

- cazuri

- Centru

- lanţuri

- provocări

- Schimbare

- Modificări

- taxe

- Verificări

- Alege

- clasă

- CLF

- client

- Cloud

- Grup

- clustering

- cod

- Coloană

- Coloane

- combinaţie

- combinaţii

- combinate

- combină

- vine

- comentariu

- Comun

- Completă

- Terminat

- completarea

- complicat

- încheia

- concluzie

- Conduce

- Configuraţie

- consecutiv

- Consoleze

- contactați-ne

- centru de contact

- conține

- contrast

- Control

- A costat

- Cheltuieli

- ar putea

- crea

- a creat

- Crearea

- Criteriile de

- crucial

- În prezent

- personalizat

- clienţii care

- de date

- știința datelor

- seturi de date

- abuzive

- decide

- Aprofunda

- Mod implicit

- definit

- defineste

- definire

- Definitii

- demonstra

- demonstrează

- depinde

- dependențe

- În funcție

- implementa

- dislocate

- Implementarea

- desfășurarea

- deriva

- În ciuda

- detaliu

- detaliat

- detalii

- dezvolta

- dezvoltat

- Dezvoltare

- dezvoltă

- deviere

- DICT

- diferit

- directoare

- discuta

- discutat

- do

- Nu

- domeniu

- Dont

- jos

- a desena

- se usuce

- durată

- în timpul

- dinamic

- fiecare

- Devreme

- eficient

- elimină

- permite

- Punct final

- Inginerie

- asigura

- asigură

- Afacere

- Întreg

- în întregime

- egal

- eroare

- evalua

- evaluat

- în cele din urmă

- Fiecare

- examina

- exemplu

- exemple

- execuție

- exista

- aștepta

- de aşteptat

- experiment

- a explicat

- explorat

- Explorează

- fals

- familii

- familie

- ventilator

- Caracteristică

- DESCRIERE

- puțini

- camp

- Fișier

- umplut

- Găsi

- descoperire

- First

- potrivi

- cinci

- Concentra

- urma

- următor

- urmează

- Pentru

- pădure

- formă

- format

- FRAME

- din

- faţă

- Complet

- funcţie

- funcționalitate

- funcții

- mai mult

- General

- genera

- generată

- generator

- obține

- merge

- GitHub

- dat

- Go

- scop

- merge

- grafic

- mână

- Mânere

- Avea

- având în

- he

- greu

- ridicare de greutati

- ajutor

- ajută

- ei

- la nivel înalt

- superior

- cea mai mare

- speranţă

- oră

- casă

- gospodării

- carcasă

- Cum

- Cum Pentru a

- HTML

- http

- HTTPS

- Optimizarea hiperparametrului

- Reglarea hiperparametrului

- Identitate

- if

- punerea în aplicare a

- implementarea

- import

- importurile

- îmbunătăţi

- îmbunătățirea

- in

- include

- Inclusiv

- Crește

- indica

- individ

- Individual

- informații

- intrare

- intrări

- inserții

- perspective

- instanță

- in schimb

- instrucțiuni

- integrare

- intentionat

- interese

- interfaţă

- în

- introdus

- IT

- ESTE

- în sine

- Loc de munca

- Locuri de munca

- jpg

- doar

- doar unul

- A pastra

- Cheie

- cunoştinţe

- de laborator

- mare

- mai mare

- mai tarziu

- a lansat

- lansare

- învăţare

- stânga

- Lungime

- Nivel

- nivelurile de

- ciclu de viață

- ridicare

- ca

- Probabil

- limitativ

- linux

- încărca

- la nivel local

- situat

- locaţie

- logică

- logic

- Lung

- mai lung

- Uite

- Lot

- cel mai mic

- maşină

- masina de învățare

- multe

- maxim

- Mai..

- însemna

- mijloace

- Îmbina

- cu

- Metrici

- ar putea

- minute

- dispărut

- ML

- MLOps

- model

- Modele

- modifica

- monitor

- monitoare

- mai mult

- cele mai multe

- multiplu

- nume

- îngust

- navighează

- Nevoie

- Nou

- recent

- următor

- Nu.

- Nici unul

- caiet

- notat

- acum

- număr

- NumPy

- obiect

- obiectiv

- obiecte

- of

- de pe

- promoții

- on

- dată

- ONE

- afară

- deschide

- Operațiuni

- optimă

- optimizare

- Optimizați

- optimizate

- or

- comandă

- OS

- Altele

- Altele

- afară

- producție

- exterior

- peste

- global

- pagină

- panda

- Paralel

- parametrii

- parte

- special

- Care trece

- pasionat

- cale

- Plătește

- Efectua

- performanță

- efectuarea

- persistă

- piese

- conducte

- Plato

- Informații despre date Platon

- PlatoData

- joacă

- ștecher

- Punct

- puncte

- Politica

- populație

- posibil

- Post

- potenţial

- pragmatic

- prezice

- Predictor

- Pregăti

- premise

- cadouri

- împiedica

- în prealabil

- de stabilire a prețurilor

- primar

- Problemă

- proces

- produce

- producere

- Programare

- Progres

- proiect

- Proiecte

- promițător

- proprietăţi

- furniza

- furnizează

- furnizarea

- public

- scop

- Piton

- aleator

- rapid

- atins

- gata

- motiv

- recent

- reţetă

- recomanda

- înregistrări

- reduce

- reduce

- trimite

- referință

- cu privire la

- regex

- regiune

- eliberat

- rămas

- scoate

- repeta

- depozit

- solicita

- necesita

- necesar

- Resurse

- respectiv

- responsabil

- limitat

- rezultat

- REZULTATE

- reveni

- dreapta

- Rol

- Alerga

- funcţionare

- ruleaza

- Runtime

- sagemaker

- Reglarea automată a modelului SageMaker

- salvate

- Scară

- scalare

- Ştiinţă

- oamenii de stiinta

- scikit-learn

- domeniu

- scor

- scenariu

- script-uri

- Al doilea

- secunde

- Secțiune

- secțiuni

- sector

- vedea

- pare

- selectate

- selecţie

- SELF

- senior

- distinct

- servi

- serverless

- serviciu

- Servicii

- sesiune

- set

- Seturi

- setări

- configurarea

- ea

- să

- a prezentat

- indicat

- Emisiuni

- simplu

- simplificarea

- pur şi simplu

- fragment

- So

- soluţie

- soluţii

- REZOLVAREA

- unele

- de specialitate

- specific

- specificație

- Specificaţii

- specificată

- viteză

- împărţi

- stivui

- standard

- Începe

- Pornire

- Stare

- Pas

- paşi

- Stop

- oprit

- oprire

- depozitare

- stocate

- stocarea

- Strategie

- structura

- structurile

- Ulterior

- astfel de

- Suportat

- tabel

- adaptate

- Lua

- Ţintă

- echipă

- Tehnic

- tehnici de

- Tehnologii

- Terminal

- test

- Testarea

- acea

- lor

- Lor

- apoi

- Acolo.

- prin urmare

- Acestea

- ei

- acest

- aceste

- trei

- prag

- Prin

- timp

- la

- împreună

- instrument

- top

- Total

- față de

- tradiţional

- Tren

- Pregătire

- transformări

- proces

- studii

- încercat

- declanşa

- a declanșat

- declanșând

- încercat

- de reglaj

- Două

- tip

- Tipuri

- tipic

- ui

- în

- înţelegere

- unic

- până la

- nedorit

- încărcat

- Folosire

- utilizare

- carcasa de utilizare

- utilizat

- utilizări

- folosind

- VALIDA

- valoare

- Valori

- variabil

- variat

- diverse

- versiune

- Versiunile

- Vizualizare

- vizualizare

- W

- aștepta

- walkthrough

- vrea

- a fost

- Cale..

- we

- web

- servicii web

- BINE

- au fost

- Ce

- cand

- întrucât

- dacă

- care

- de ce

- voi

- cu

- în

- fără

- Apartamente

- flux de lucru

- fluxuri de lucru

- de lucru

- ar

- scrie

- încă

- Tu

- Ta

- te

- zephyrnet