Odată cu adoptarea rapidă a aplicațiilor AI generative, este nevoie ca aceste aplicații să răspundă la timp pentru a reduce latența percepută cu un debit mai mare. Modelele de fundație (FM) sunt adesea antrenate în prealabil pe corpuri vaste de date cu parametri variind la scară de la milioane la miliarde și nu numai. Modelele de limbaj mari (LLM) sunt un tip de FM care generează text ca răspuns la inferența utilizatorului. Deducerea acestor modele cu configurații diferite ale parametrilor de inferență poate duce la latențe inconsecvente. Incoerența s-ar putea datora numărului variabil de jetoane de răspuns la care vă așteptați de la model sau a tipului de accelerator pe care este implementat modelul.

În oricare dintre cazuri, în loc să așteptați răspunsul complet, puteți adopta abordarea fluxului de răspuns pentru concluziile dvs., care trimite înapoi bucăți de informații de îndată ce sunt generate. Acest lucru creează o experiență interactivă, permițându-vă să vedeți răspunsurile parțiale transmise în timp real în loc de un răspuns complet întârziat.

Odată cu anunțul oficial că Inferența în timp real Amazon SageMaker acceptă acum fluxul de răspuns, acum puteți transmite continuu răspunsuri de inferență înapoi către client atunci când utilizați Amazon SageMaker inferență în timp real cu streaming de răspuns. Această soluție vă va ajuta să construiți experiențe interactive pentru diverse aplicații AI generative, cum ar fi chatbot, asistenți virtuali și generatoare de muzică. Această postare vă arată cum să realizați timpi de răspuns mai rapizi sub formă de Time to First Byte (TTFB) și să reduceți latența generală percepută în timp ce deduceți modelele Llama 2.

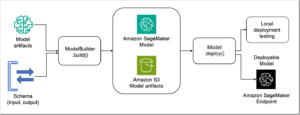

Pentru a implementa soluția, folosim SageMaker, un serviciu complet gestionat pentru a pregăti datele și a construi, antrena și implementa modele de învățare automată (ML) pentru orice caz de utilizare cu infrastructură, instrumente și fluxuri de lucru complet gestionate. Pentru mai multe informații despre diferitele opțiuni de implementare oferite de SageMaker, consultați Întrebări frecvente despre gazduirea modelului Amazon SageMaker. Să înțelegem cum putem aborda problemele de latență folosind inferența în timp real cu fluxul de răspuns.

Prezentare generală a soluțiilor

Deoarece dorim să abordăm latențele menționate mai sus asociate cu inferența în timp real cu LLM-urile, să înțelegem mai întâi cum putem folosi suportul de streaming de răspuns pentru inferența în timp real pentru Llama 2. Cu toate acestea, orice LLM poate profita de suportul de streaming de răspuns cu real. - deducerea timpului.

Llama 2 este o colecție de modele de text generative pre-antrenate și reglate fin, cu o scară cuprinsă între 7 miliarde și 70 de miliarde de parametri. Modelele Llama 2 sunt modele autoregresive cu arhitectură numai cu decodor. Atunci când sunt prevăzute cu un prompt și parametri de inferență, modelele Llama 2 sunt capabile să genereze răspunsuri text. Aceste modele pot fi folosite pentru traducere, rezumare, răspunsuri la întrebări și chat.

Pentru această postare, implementăm modelul Llama 2 Chat meta-llama/Llama-2-13b-chat-hf pe SageMaker pentru inferențe în timp real cu streaming de răspuns.

Când vine vorba de implementarea modelelor pe punctele finale SageMaker, puteți containeriza modelele folosind specialized Container AWS Deep Learning (DLC) imagini disponibile pentru bibliotecile open source populare. Modelele Llama 2 sunt modele de generare de text; puteți folosi fie Îmbrățișarea containerelor de inferență LLM Face pe SageMaker alimentat de Hugging Face Inferență de generare a textului (TGI) sau DLC-uri AWS pentru Inferența modelului mare (LMI).

În această postare, implementăm modelul Llama 2 13B Chat folosind DLC-uri pe SageMaker Hosting pentru inferențe în timp real, alimentate de instanțe G5. Instanțele G5 sunt instanțe de înaltă performanță bazate pe GPU pentru aplicații intensive în grafică și inferență ML. De asemenea, puteți utiliza tipurile de instanțe acceptate p4d, p3, g5 și g4dn cu modificările corespunzătoare conform configurației instanței.

Cerințe preliminare

Pentru a implementa această soluție, ar trebui să aveți următoarele:

- Un cont AWS cu un Gestionarea identității și accesului AWS (IAM) cu permisiuni de gestionare a resurselor create ca parte a soluției.

- Dacă este prima dată când lucrezi cu Amazon SageMaker Studio, mai întâi trebuie să creați un domeniul SageMaker.

- Un cont Hugging Face. Înregistrează-te

cu e-mailul dvs. dacă nu aveți deja cont.

- Pentru un acces fără probleme la modelele disponibile pe Hugging Face, în special modelele cu sistem de blocare, cum ar fi Llama, în scopuri de reglare fină și deducere, ar trebui să aveți un cont Hugging Face pentru a obține un token de acces la citire. După ce vă înregistrați pentru contul dvs. Hugging Face, autentifici a vizita https://huggingface.co/settings/tokens pentru a crea un jeton de acces la citire.

- Acces la Llama 2, folosind același ID de e-mail pe care l-ați folosit pentru a vă înscrie la Hugging Face.

- Modelele Llama 2 disponibile prin Hugging Face sunt modele cu blocare. Utilizarea modelului Llama este guvernată de licența Meta. Pentru a descărca greutățile modelului și tokenizerul, cere acces la Llama și să le accepte licența.

- După ce vi se acordă acces (de obicei în câteva zile), veți primi o confirmare prin e-mail. Pentru acest exemplu, folosim modelul

Llama-2-13b-chat-hf, dar ar trebui să puteți accesa și alte variante.

Abordarea 1: Hugging Face TGI

În această secțiune, vă arătăm cum să implementați meta-llama/Llama-2-13b-chat-hf model la un punct final în timp real SageMaker cu streaming de răspuns folosind Hugging Face TGI. Următorul tabel prezintă specificațiile pentru această implementare.

| Specificație | Valoare |

| Recipient | Hugging Face TGI |

| Nume model | meta-lama/Llama-2-13b-chat-hf |

| Instanță ML | ml.g5.12xmare |

| deducție | În timp real, cu streaming de răspuns |

Implementați modelul

Mai întâi, recuperați imaginea de bază pentru LLM-ul care urmează să fie implementat. Apoi construiți modelul pe imaginea de bază. În cele din urmă, implementați modelul în instanța ML pentru SageMaker Hosting pentru inferență în timp real.

Să observăm cum să realizăm implementarea în mod programatic. Pentru concizie, doar codul care ajută la pașii de implementare este discutat în această secțiune. Codul sursă complet pentru implementare este disponibil în notebook llama-2-hf-tgi/llama-2-13b-chat-hf/1-deploy-llama-2-13b-chat-hf-tgi-sagemaker.ipynb.

Preluați cel mai recent DLC Hugging Face LLM alimentat de TGI prin intermediul pre-construit DLC-uri SageMaker. Folosiți această imagine pentru a implementa meta-llama/Llama-2-13b-chat-hf model pe SageMaker. Vezi următorul cod:

Definiți mediul pentru model cu parametrii de configurare definiți după cum urmează:

Înlocui <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> pentru parametrul de configurare HUGGING_FACE_HUB_TOKEN cu valoarea jetonului obținut din profilul tău Hugging Face, așa cum este detaliat în secțiunea de cerințe preliminare a acestei postări. În configurație, definiți numărul de GPU-uri utilizate per replică a unui model ca fiind 4 pentru SM_NUM_GPUS. Apoi puteți implementa meta-llama/Llama-2-13b-chat-hf model pe o instanță ml.g5.12xlarge care vine cu 4 GPU-uri.

Acum puteți construi instanța de HuggingFaceModel cu configurația de mediu menționată mai sus:

În cele din urmă, implementați modelul furnizând argumente pentru metoda de implementare disponibilă pe model cu diferite valori ale parametrilor, cum ar fi endpoint_name, initial_instance_count, și instance_type:

Efectuați inferența

Hugging Face TGI DLC vine cu capacitatea de a transmite răspunsuri fără personalizări sau modificări de cod ale modelului. Poți să folosești invoke_endpoint_with_response_stream dacă utilizați Boto3 sau InvokeEndpointWithResponseStream când programați cu SageMaker Python SDK.

InvokeEndpointWithResponseStream API-ul SageMaker permite dezvoltatorilor să transmită în flux răspunsuri din modelele SageMaker, ceea ce poate ajuta la îmbunătățirea satisfacției clienților prin reducerea latenței percepute. Acest lucru este deosebit de important pentru aplicațiile construite cu modele AI generative, unde procesarea imediată este mai importantă decât așteptarea întregului răspuns.

Pentru acest exemplu, folosim Boto3 pentru a deduce modelul și folosim API-ul SageMaker invoke_endpoint_with_response_stream după cum urmează:

Argumentul CustomAttributes este setat la valoarea accept_eula=false. accept_eula parametrul trebuie setat la true pentru a obține cu succes răspunsul de la modelele Llama 2. După invocarea cu succes folosind invoke_endpoint_with_response_stream, metoda va returna un flux de răspuns de octeți.

Următoarea diagramă ilustrează acest flux de lucru.

Aveți nevoie de un iterator care să circule peste fluxul de octeți și să-i analizeze în text care poate fi citit. The LineIterator implementarea poate fi găsită la llama-2-hf-tgi/llama-2-13b-chat-hf/utils/LineIterator.py. Acum sunteți gata să pregătiți promptul și instrucțiunile pentru a le folosi ca sarcină utilă în timp ce deduceți modelul.

Pregătiți un prompt și instrucțiuni

În acest pas, pregătiți promptul și instrucțiunile pentru LLM. Pentru a solicita Llama 2, ar trebui să aveți următorul șablon de prompt:

Creați șablonul prompt definit în mod programatic în metodă build_llama2_prompt, care se aliniază cu șablonul de prompt menționat mai sus. Apoi definiți instrucțiunile conform cazului de utilizare. În acest caz, îi instruim modelului să genereze un e-mail pentru o campanie de marketing, așa cum este descris în get_instructions metodă. Codul pentru aceste metode este în llama-2-hf-tgi/llama-2-13b-chat-hf/2-sagemaker-realtime-inference-llama-2-13b-chat-hf-tgi-streaming-response.ipynb caiet. Construiți instrucțiunea combinată cu sarcina care trebuie efectuată, așa cum este detaliat în user_ask_1 după cum urmează:

Transmitem instrucțiunile pentru a construi promptul conform șablonului de prompt generat de build_llama2_prompt.

Clubăm parametrii de inferență împreună cu promptul cu cheia stream cu valoarea True pentru a forma o sarcină utilă finală. Trimite încărcătura utilă către get_realtime_response_stream, care va fi folosit pentru a invoca un punct final cu flux de răspuns:

Textul generat din LLM va fi transmis în flux la ieșire, așa cum se arată în animația următoare.

Abordarea 2: LMI cu servire DJL

În această secțiune, demonstrăm cum să implementăm meta-llama/Llama-2-13b-chat-hf model la un punct final în timp real SageMaker cu flux de răspuns folosind LMI cu DJL Serving. Următorul tabel prezintă specificațiile pentru această implementare.

| Specificație | Valoare |

| Recipient | Imagine container LMI cu DJL Serving |

| Nume model | meta-lama/Llama-2-13b-chat-hf |

| Instanță ML | ml.g5.12xmare |

| deducție | În timp real, cu streaming de răspuns |

Mai întâi descărcați modelul și îl stocați Serviciul Amazon de stocare simplă (Amazon S3). Apoi specificați URI-ul S3 indicând prefixul S3 al modelului în serving.properties fişier. Apoi, recuperați imaginea de bază pentru LLM care urmează să fie implementat. Apoi construiți modelul pe imaginea de bază. În cele din urmă, implementați modelul în instanța ML pentru SageMaker Hosting pentru inferență în timp real.

Să observăm cum să realizăm pașii de implementare menționați mai sus în mod programatic. Pentru concizie, doar codul care ajută la pașii de implementare este detaliat în această secțiune. Codul sursă complet pentru această implementare este disponibil în notebook llama-2-lmi/llama-2-13b-chat/1-deploy-llama-2-13b-chat-lmi-response-streaming.ipynb.

Descărcați instantaneul modelului de la Hugging Face și încărcați artefactele modelului pe Amazon S3

Cu cerințele preliminare menționate mai sus, descărcați modelul pe instanța de notebook SageMaker și apoi încărcați-l în compartimentul S3 pentru implementare ulterioară:

Rețineți că, deși nu furnizați un simbol de acces valid, modelul se va descărca. Dar când implementați un astfel de model, difuzarea modelului nu va reuși. Prin urmare, se recomandă înlocuirea <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> pentru argument token cu valoarea jetonului obținut din profilul tău Hugging Face, așa cum este detaliat în cerințele preliminare. Pentru această postare, specificăm numele modelului oficial pentru Llama 2, așa cum este identificat pe Hugging Face cu valoarea meta-llama/Llama-2-13b-chat-hf. Modelul necomprimat va fi descărcat în local_model_path ca urmare a rulării codului menționat mai sus.

Încărcați fișierele pe Amazon S3 și obțineți URI-ul, care va fi folosit ulterior în serving.properties.

Veți împacheta meta-llama/Llama-2-13b-chat-hf model pe imaginea containerului LMI cu DJL Serving folosind configurația specificată prin serving.properties. Apoi implementați modelul împreună cu artefactele modelului ambalate pe imaginea containerului din instanța SageMaker ML ml.g5.12xlarge. Apoi utilizați această instanță ML pentru SageMaker Hosting pentru inferențe în timp real.

Pregătiți artefacte model pentru DJL Serving

Pregătiți-vă artefactele model prin crearea unui serving.properties Fișier de configurare:

Utilizăm următoarele setări în acest fișier de configurare:

- motor – Acesta specifică motorul de rulare pe care DJL îl va utiliza. Valorile posibile includ

Python,DeepSpeed,FasterTransformer, șiMPI. În acest caz, l-am setat laMPI. Model Paralelization and Inference (MPI) facilitează partiționarea modelului pe toate GPU-urile disponibile și, prin urmare, accelerează inferența. - opțiune.entryPoint – Această opțiune specifică ce handler oferit de DJL Serving pe care doriți să îl utilizați. Valorile posibile sunt

djl_python.huggingface,djl_python.deepspeed, șidjl_python.stable-diffusion. Folosimdjl_python.huggingfacepentru Hugging Face Accelerate. - opțiune.tensor_paralel_degree – Această opțiune specifică numărul de partiții paralele tensoare efectuate pe model. Puteți seta numărul de dispozitive GPU pe care Accelerate trebuie să partiționeze modelul. Acest parametru controlează, de asemenea, numărul de lucrători per model care vor fi porniți când rulează servirea DJL. De exemplu, dacă avem o mașină cu 4 GPU și creăm patru partiții, atunci vom avea un lucrător pentru fiecare model pentru a servi cererile.

- option.low_cpu_mem_usage – Acest lucru reduce utilizarea memoriei procesorului la încărcarea modelelor. Vă recomandăm să setați acest lucru la

TRUE. - opțiune.lot_rulant – Acest lucru permite lotizarea la nivel de iterație folosind una dintre strategiile acceptate. Valorile includ

auto,scheduler, șilmi-dist. Folosimlmi-distpentru activarea lotului continuu pentru Llama 2. - option.max_rolling_batch_size – Acest lucru limitează numărul de solicitări concurente în lotul continuu. Valoarea este implicită la 32.

- opțiune.model_id — Ar trebui să înlocuiești

{{model_id}}cu ID-ul modelului unui model pre-antrenat găzduit în interiorul a depozit de modele pe Hugging Face sau calea S3 către artefactele modelului.

Mai multe opțiuni de configurare pot fi găsite în Configurații și setări.

Deoarece DJL Serving se așteaptă ca artefactele modelului să fie împachetate și formatate într-un fișier .tar, rulați următorul fragment de cod pentru a comprima și încărca fișierul .tar pe Amazon S3:

Preluați cea mai recentă imagine a containerului LMI cu DJL Serving

Apoi, utilizați DLC-urile disponibile cu SageMaker pentru LMI pentru a implementa modelul. Preluați URI-ul imaginii SageMaker pentru djl-deepspeed container în mod programatic folosind următorul cod:

Puteți utiliza imaginea menționată mai sus pentru a implementa meta-llama/Llama-2-13b-chat-hf model pe SageMaker. Acum puteți continua la crearea modelului.

Creați modelul

Puteți crea modelul al cărui container este construit folosind inference_image_uri și codul de servire a modelului situat la URI-ul S3 indicat de s3_code_artifact:

Acum puteți crea configurația modelului cu toate detaliile pentru configurarea punctului final.

Creați configurația modelului

Utilizați următorul cod pentru a crea o configurare a modelului pentru modelul identificat de model_name:

Configurația modelului este definită pentru ProductionVariants parametru InstanceType pentru instanța ML ml.g5.12xlarge. De asemenea, furnizați ModelName folosind același nume pe care l-ați folosit pentru a crea modelul în pasul anterior, stabilind astfel o relație între model și configurația punctului final.

Acum că ați definit modelul și configurația modelului, puteți crea punctul final SageMaker.

Creați punctul final SageMaker

Creați punctul final pentru a implementa modelul folosind următorul fragment de cod:

Puteți vedea progresul implementării utilizând următorul fragment de cod:

După ce implementarea are succes, starea punctului final va fi InService. Acum că punctul final este gata, să efectuăm inferențe cu fluxul de răspuns.

Inferență în timp real cu streaming de răspuns

După cum am abordat în abordarea anterioară pentru Hugging Face TGI, puteți folosi aceeași metodă get_realtime_response_stream pentru a invoca fluxul de răspuns de la punctul final SageMaker. Codul pentru inferență folosind abordarea LMI este în llama-2-lmi/llama-2-13b-chat/2-inference-llama-2-13b-chat-lmi-response-streaming.ipynb caiet. The LineIterator implementarea se află în llama-2-lmi/utils/LineIterator.py. Rețineți că LineIterator pentru modelul Llama 2 Chat implementat pe containerul LMI este diferit de LineIterator menționat în secțiunea Hugging Face TGI. The LineIterator bucle peste fluxul de octeți de la modelele Llama 2 Chat deduse cu containerul LMI cu djl-deepspeed versiunea 0.25.0. Următoarea funcție de ajutor va analiza fluxul de răspuns primit de la cererea de inferență făcută prin intermediul invoke_endpoint_with_response_stream API-uri:

Metoda anterioară imprimă fluxul de date citit de LineIterator într-un format care poate fi citit de om.

Să explorăm cum să pregătim promptul și instrucțiunile pentru a le folosi ca sarcină utilă în timp ce deducem modelul.

Deoarece deduceți același model atât în Hugging Face TGI, cât și în LMI, procesul de pregătire a promptului și a instrucțiunilor este același. Prin urmare, puteți utiliza metodele get_instructions și build_llama2_prompt pentru deducere.

get_instructions metoda returnează instrucțiunile. Construiți instrucțiunile combinate cu sarcina care trebuie efectuată, așa cum este detaliat în user_ask_2 după cum urmează:

Transmiteți instrucțiunile pentru a crea promptul conform șablonului de prompt generat de build_llama2_prompt:

Clubăm parametrii de inferență împreună cu solicitarea pentru a forma o sarcină utilă finală. Apoi trimiteți sarcina utilă către get_realtime_response_stream, care este utilizat pentru a invoca un punct final cu flux de răspuns:

Textul generat din LLM va fi transmis în flux la ieșire, așa cum se arată în animația următoare.

A curăța

Pentru a evita costurile inutile, utilizați Consola de administrare AWS pentru a șterge punctele finale și resursele asociate acestora care au fost create în timpul rulării abordărilor menționate în postare. Pentru ambele abordări de implementare, efectuați următoarea rutină de curățare:

Înlocui <SageMaker_Real-time_Endpoint_Name> pentru variabilă endpoint_name cu punctul final real.

Pentru a doua abordare, am stocat artefactele modelului și codului pe Amazon S3. Puteți curăța găleata S3 folosind următorul cod:

Concluzie

În această postare, am discutat despre modul în care un număr diferit de jetoane de răspuns sau un set diferit de parametri de inferență pot afecta latențele asociate cu LLM-urile. Am arătat cum să rezolvăm problema cu ajutorul fluxului de răspuns. Am identificat apoi două abordări pentru implementarea și deducerea modelelor Llama 2 Chat folosind DLC-uri AWS — LMI și Hugging Face TGI.

Acum ar trebui să înțelegeți importanța răspunsului în flux și cum poate reduce latența percepută. Răspunsul în flux poate îmbunătăți experiența utilizatorului, ceea ce altfel te-ar face să aștepți până când LLM construiește întregul răspuns. În plus, implementarea modelelor Llama 2 Chat cu streaming de răspuns îmbunătățește experiența utilizatorului și îi face pe clienții tăi fericiți.

Puteți consulta mostrele oficiale aws amazon-sagemaker-llama2-response-streaming-recipes care acoperă implementarea pentru alte variante de model Llama 2.

Referinte

Despre Autori

Pavan Kumar Rao Navule este arhitect de soluții la Amazon Web Services. El lucrează cu ISV-uri din India pentru a-i ajuta să inoveze pe AWS. Este un autor publicat pentru cartea „Începere cu programarea V”. El a urmat un M.Tech executiv în știința datelor de la Institutul Indian de Tehnologie (IIT), Hyderabad. De asemenea, a urmat un Executive MBA în specializare IT de la Școala Indiană de Management și Administrare a Afacerilor și deține un B.Tech în Inginerie Electronică și Comunicații de la Institutul de Tehnologie și Știință Vaagdevi. Pavan este un AWS Certified Solutions Architect Professional și deține alte certificări, cum ar fi AWS Certified Machine Learning Speciality, Microsoft Certified Professional (MCP) și Microsoft Certified Technology Specialist (MCTS). El este, de asemenea, un entuziast open-source. În timpul liber, îi place să asculte marile voci magice ale Siei și Rihannei.

Pavan Kumar Rao Navule este arhitect de soluții la Amazon Web Services. El lucrează cu ISV-uri din India pentru a-i ajuta să inoveze pe AWS. Este un autor publicat pentru cartea „Începere cu programarea V”. El a urmat un M.Tech executiv în știința datelor de la Institutul Indian de Tehnologie (IIT), Hyderabad. De asemenea, a urmat un Executive MBA în specializare IT de la Școala Indiană de Management și Administrare a Afacerilor și deține un B.Tech în Inginerie Electronică și Comunicații de la Institutul de Tehnologie și Știință Vaagdevi. Pavan este un AWS Certified Solutions Architect Professional și deține alte certificări, cum ar fi AWS Certified Machine Learning Speciality, Microsoft Certified Professional (MCP) și Microsoft Certified Technology Specialist (MCTS). El este, de asemenea, un entuziast open-source. În timpul liber, îi place să asculte marile voci magice ale Siei și Rihannei.

Sudhanshu Ură este principalul specialist AI/ML cu AWS și lucrează cu clienții pentru a-i sfătui cu privire la MLOps și călătoria AI generativă. În rolul său anterior înainte de Amazon, el a conceptualizat, creat și condus echipe pentru a construi platforme de IA și gamification bazate pe open source și le-a comercializat cu succes cu peste 100 de clienți. Sudhanshu la creditul său de câteva brevete, a scris două cărți și mai multe lucrări și bloguri și și-a prezentat punctele de vedere în diferite forumuri tehnice. El a fost un lider de gândire și un vorbitor și este în industrie de aproape 25 de ani. El a lucrat cu clienți Fortune 1000 de pe tot globul și, cel mai recent, cu clienți nativi digitali din India.

Sudhanshu Ură este principalul specialist AI/ML cu AWS și lucrează cu clienții pentru a-i sfătui cu privire la MLOps și călătoria AI generativă. În rolul său anterior înainte de Amazon, el a conceptualizat, creat și condus echipe pentru a construi platforme de IA și gamification bazate pe open source și le-a comercializat cu succes cu peste 100 de clienți. Sudhanshu la creditul său de câteva brevete, a scris două cărți și mai multe lucrări și bloguri și și-a prezentat punctele de vedere în diferite forumuri tehnice. El a fost un lider de gândire și un vorbitor și este în industrie de aproape 25 de ani. El a lucrat cu clienți Fortune 1000 de pe tot globul și, cel mai recent, cu clienți nativi digitali din India.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/inference-llama-2-models-with-real-time-response-streaming-using-amazon-sagemaker/

- :are

- :este

- :Unde

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 150

- 16

- 19

- 1

- 25

- 32

- 385

- 50

- 7

- 70

- 8

- 9

- a

- capacitate

- Capabil

- Despre Noi

- accelera

- Accelerează

- accelerator

- Accept

- acces

- Cont

- Obține

- peste

- Acțiune

- curent

- În plus,

- adresa

- administrare

- adopta

- Adoptare

- Avantaj

- sfătui

- afecta

- După

- AI

- Modele AI

- AI / ML

- alice

- Se aliniază

- TOATE

- Permiterea

- permite

- de-a lungul

- deja

- de asemenea

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- și

- animaţie

- a anunțat

- Anunț

- Orice

- api

- aplicatii

- abordare

- abordari

- adecvat

- arhitectural

- arhitectură

- SUNT

- argument

- argumente

- AS

- asistenți

- asociate

- At

- autor

- disponibil

- evita

- AWS

- înapoi

- de bază

- dozare

- BE

- deoarece

- fost

- înainte

- între

- Dincolo de

- Miliard

- miliarde

- BIN

- bloguri

- corp

- carte

- Manuale

- atât

- construi

- construiește

- construit

- afaceri

- dar

- by

- apel

- Campanie

- CAN

- capabil

- caz

- certificări

- Certificate

- Modificări

- taxe

- Chat

- chatbots

- curat

- client

- clientii

- club

- cod

- colectare

- COM

- combinate

- vine

- Comunicare

- concurent

- Configuraţie

- confirmare

- Recipient

- Containere

- continuu

- continuu

- controale

- ar putea

- Cuplu

- cupon

- acoperit

- Covers

- crea

- a creat

- creează

- Crearea

- credit

- client

- Satisfactia clientului

- clienţii care

- de date

- știința datelor

- Zi

- adânc

- învățare profundă

- implicite

- defini

- definit

- Întârziat

- demonstra

- implementa

- dislocate

- Implementarea

- desfășurarea

- detaliat

- detalii

- Dezvoltatorii

- Dispozitive

- diferit

- digital

- discutat

- Dont

- Descarca

- în timpul

- Mai devreme

- oricare

- Componente electronice

- permite

- Punct final

- Motor

- Inginerie

- entuziast

- Întreg

- Mediu inconjurator

- mai ales

- stabilirea

- Chiar

- exemplu

- executiv

- aşteaptă

- se așteaptă

- experienţă

- Experiențe

- explora

- Față

- facilitează

- fals

- mai repede

- Fișier

- Fişiere

- final

- În cele din urmă

- First

- prima dată

- următor

- urmează

- Pentru

- formă

- format

- Avere

- forumuri

- găsit

- Fundație

- patru

- Gratuit

- din

- Complet

- complet

- funcţie

- mai mult

- gamification

- gated

- genera

- generată

- generator

- generaţie

- generativ

- AI generativă

- Generatoare

- obține

- gif

- glob

- Go

- guvernată

- GPU

- unități de procesare grafică

- acordate

- mare

- fericit

- ură

- Avea

- he

- ajutor

- ajută

- performanta ridicata

- superior

- lui

- deține

- găzduit

- găzduire

- Cum

- Cum Pentru a

- Totuși

- HTML

- http

- HTTPS

- Față îmbrățișată

- uman poate fi citit

- ID

- identificat

- Identitate

- if

- ilustrează

- imagine

- imagini

- imediat

- punerea în aplicare a

- implementarea

- import

- importanță

- important

- îmbunătăţi

- îmbunătăţeşte

- in

- include

- Inclusiv

- India

- indian

- indicată

- industrie

- informații

- Infrastructură

- inova

- intrare

- intrări

- în interiorul

- instanță

- in schimb

- Institut

- instrucțiuni

- interactiv

- Internet

- probleme de

- IT

- ESTE

- călătorie

- JSON

- Cheie

- Kumar

- limbă

- mare

- Latență

- probleme de latență

- mai tarziu

- Ultimele

- lansa

- conduce

- lider

- învăţare

- Led

- Lungime

- biblioteci

- Licență

- ca

- Limitele

- Linie

- asculta

- Lamă

- LLM

- încărcare

- situat

- iubeste

- maşină

- masina de învățare

- făcut

- face

- FACE

- administra

- gestionate

- administrare

- Marketing

- max

- Mai..

- MCP

- Memorie

- menționat

- meta

- metodă

- Metode

- Microsoft

- milioane

- ML

- MLOps

- model

- Modele

- luni

- mai mult

- cele mai multe

- Muzică

- trebuie sa

- nume

- Numit

- nativ

- aproape

- Nevoie

- nevoilor

- Nou

- următor

- nota

- caiet

- acum

- număr

- obiecte

- observa

- obține

- obținut

- of

- oferit

- oficial

- de multe ori

- on

- ONE

- afară

- deschide

- open-source

- Opțiune

- Opţiuni

- or

- Altele

- in caz contrar

- contururi

- producție

- peste

- global

- ambalate

- ambalaje

- lucrări

- Paralel

- parametru

- parametrii

- parte

- trece

- Brevete de inventie

- cale

- pentru

- percepută

- Efectua

- efectuată

- permisiuni

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- puncte

- Popular

- posibil

- Post

- alimentat

- precedent

- Pregăti

- pregătirea

- premise

- prezentat

- precedent

- Principal

- printuri

- Problemă

- continua

- proces

- Procesat

- prelucrare

- Produs

- lansarea produsului

- profesional

- Profil

- Programare

- Progres

- proprietăţi

- furniza

- prevăzut

- furnizează

- furnizarea

- publicat

- scopuri

- Piton

- pirtorh

- întrebare

- variind

- rapid

- mai degraba

- Citeste

- gata

- real

- în timp real

- realiza

- a primi

- primit

- recent

- recomanda

- recomandat

- reduce

- reduce

- reducerea

- trimite

- relație

- înlocui

- răspunde

- depozit

- solicita

- cereri de

- Resurse

- Răspunde

- răspuns

- răspunsuri

- rezultat

- reveni

- Returnează

- Rol

- rutină

- Alerga

- funcţionare

- ruleaza

- Runtime

- sagemaker

- acelaşi

- satisfacție

- Scară

- Şcoală

- Ştiinţă

- sdk

- fără sudură

- Al doilea

- Secțiune

- vedea

- trimite

- trimite

- servi

- serviciu

- Servicii

- servire

- set

- setări

- câteva

- Pantaloni scurți

- să

- Arăta

- a arătat

- indicat

- Emisiuni

- semna

- simplu

- Instantaneu

- fragment

- soluţie

- soluţii

- curând

- Sursă

- cod sursă

- Vorbitor

- specialist

- de specialitate

- Specialitate

- Specificaţii

- specificată

- început

- Stare

- Pas

- paşi

- Stop

- depozitare

- stoca

- stocate

- strategii

- curent

- transmise în flux

- de streaming

- serviciul de streaming

- reuși

- de succes

- Reușit

- astfel de

- a sustine

- Suportat

- Sprijină

- tabel

- Lua

- Sarcină

- echipe

- tech

- Tehnic

- Tehnologia

- șablon

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- decât

- acea

- lor

- Lor

- apoi

- Acolo.

- astfel

- prin urmare

- Acestea

- ei

- acest

- deşi?

- gândit

- debit

- timp

- ori

- la

- semn

- indicativele

- Unelte

- Tren

- Traducere

- adevărat

- Cotitură

- Două

- tip

- Tipuri

- tipic

- înţelege

- inutil

- până la

- Folosire

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- Experiența de utilizare

- folosind

- valabil

- valoare

- Valori

- variabil

- diverse

- variabil

- Fixă

- versiune

- de

- Vizualizare

- Virtual

- Vizita

- VOCI

- aștepta

- Aşteptare

- vrea

- we

- web

- servicii web

- BINE

- au fost

- cand

- care

- în timp ce

- întreg

- a caror

- voi

- cu

- în

- fără

- a lucrat

- lucrător

- muncitorii

- flux de lucru

- fluxuri de lucru

- de lucru

- fabrică

- ar

- scrie

- scris

- ani

- Tu

- Ta

- zephyrnet