Semințele unei schimbări de paradigmă de învățare automată (ML) au existat de zeci de ani, dar odată cu disponibilitatea rapidă a capacității de calcul scalabile, o proliferare masivă a datelor și progresul rapid al tehnologiilor ML, clienții din diverse industrii își transformă afacerile. Recent, aplicațiile AI generative precum ChatGPT au captat atenția și imaginația pe scară largă. Ne aflăm într-adevăr într-un punct de inflexiune interesant în adoptarea pe scară largă a ML și credem că majoritatea experiențelor și aplicațiilor clienților vor fi reinventate cu IA generativă.

AI și ML au fost un accent pentru Amazon de peste 20 de ani, iar multe dintre capabilitățile pe care clienții le folosesc cu Amazon sunt conduse de ML. Motorul nostru de recomandări de comerț electronic este condus de ML; căile care optimizează rutele robotizate de alegere în centrele noastre de livrare sunt conduse de ML; iar lanțul nostru de aprovizionare, prognoza și planificarea capacității sunt informate de ML. Prime Air (dronele noastre) și tehnologia de viziune computerizată din Amazon Go (experiența noastră fizică de vânzare cu amănuntul care le permite consumatorilor să aleagă articolele de pe raft și să părăsească magazinul fără a fi nevoie să verifice în mod oficial) folosesc învățarea profundă. Alexa, alimentat de peste 30 de sisteme ML diferite, ajută clienții de miliarde de ori în fiecare săptămână să gestioneze casele inteligente, să facă cumpărături, să obțină informații și divertisment și multe altele. Avem mii de ingineri la Amazon dedicați ML și este o mare parte a moștenirii noastre, a etosului actual și a viitorului.

La AWS, am jucat un rol cheie în democratizarea ML și pentru a-l face accesibil oricui dorește să-l folosească, inclusiv a peste 100,000 de clienți de toate dimensiunile și industriile. AWS are cel mai larg și mai profund portofoliu de servicii AI și ML la toate cele trei straturi ale stivei. Am investit și am inovat pentru a oferi cea mai performantă și scalabilă infrastructură pentru instruire și inferență ML rentabile; a dezvoltat Amazon SageMaker, care este cel mai simplu mod pentru toți dezvoltatorii de a construi, antrena și implementa modele; și a lansat o gamă largă de servicii care le permit clienților să adauge capabilități AI precum recunoașterea imaginilor, prognoza și căutarea inteligentă la aplicații cu un simplu apel API. Acesta este motivul pentru care clienți precum Intuit, Thomson Reuters, AstraZeneca, Ferrari, Bundesliga, 3M și BMW, precum și mii de startup-uri și agenții guvernamentale din întreaga lume, își transformă ei înșiși, industriile și misiunile lor cu ML. Adoptăm aceeași abordare democratizantă a IA generativă: lucrăm pentru a scoate aceste tehnologii din domeniul cercetării și experimentelor și să extindem disponibilitatea lor mult dincolo de câteva startup-uri și companii tehnologice mari, bine finanțate. De aceea, astăzi sunt încântat să anunț câteva inovații noi care vor face mai ușor și practic pentru clienții noștri utilizarea AI generativă în afacerile lor.

Construire cu IA generativă pe AWS

AI generativă și modele de fundație

AI generativ este un tip de IA care poate crea conținut și idei noi, inclusiv conversații, povești, imagini, videoclipuri și muzică. La fel ca toată AI, IA generativă este alimentată de modele ML - modele foarte mari care sunt pre-antrenate pe cantități mari de date și denumite în mod obișnuit Modele de bază (FM). Progresele recente în ML (în special invenția arhitecturii rețelei neuronale bazate pe transformatoare) au condus la creșterea modelelor care conțin miliarde de parametri sau variabile. Pentru a da un sens schimbării de scară, cel mai mare model pre-antrenat din 2019 a fost de 330 de milioane de parametri. Acum, cele mai mari modele au mai mult de 500B parametri - o creștere de 1,600 de ori în dimensiune în doar câțiva ani. FM-urile de astăzi, cum ar fi modelele de limbă mari (LLM) GPT3.5 sau BLOOM și modelul text-to-image Stable Diffusion de la Stability AI, pot îndeplini o gamă largă de sarcini care acoperă mai multe domenii, cum ar fi scrierea postărilor pe blog, generarea imagini, rezolvarea problemelor de matematică, angajarea în dialog și răspunsul la întrebări pe baza unui document. Dimensiunea și natura generală a FM-urilor le fac diferite de modelele ML tradiționale, care îndeplinesc de obicei sarcini specifice, cum ar fi analiza textului pentru sentimente, clasificarea imaginilor și prognozarea tendințelor.

FM-urile pot îndeplini atât de multe sarcini, deoarece conțin un număr atât de mare de parametri care îi fac capabili să învețe concepte complexe. Și prin expunerea lor înainte de formare la datele la scară internet în toate formele sale diferite și nenumăratele de modele, FM învață să-și aplice cunoștințele într-o gamă largă de contexte. În timp ce capacitățile și posibilitățile rezultate ale unui FM pre-instruit sunt uimitoare, clienții sunt foarte entuziasmați, deoarece aceste modele capabile în general pot fi, de asemenea, personalizate pentru a îndeplini funcții specifice domeniului care se diferențiază de afacerile lor, folosind doar o mică parte din date și calculul necesar pentru a antrena un model de la zero. FM-urile personalizate pot crea o experiență unică pentru clienți, întruchipând vocea, stilul și serviciile companiei într-o mare varietate de industrii de consum, cum ar fi bancare, călătorii și asistență medicală. De exemplu, o firmă financiară care trebuie să genereze automat un raport zilnic de activitate pentru circulația internă folosind toate tranzacțiile relevante poate personaliza modelul cu date de proprietate, care vor include rapoarte anterioare, astfel încât FM să învețe cum ar trebui să citească aceste rapoarte și ce datele au fost folosite pentru a le genera.

Potențialul FM este incredibil de interesant. Dar, suntem încă în primele zile. În timp ce ChatGPT a fost prima experiență largă de IA generativă care a atras atenția clienților, majoritatea celor care studiază IA generativă au ajuns rapid să realizeze că mai multe companii lucrează la FM-uri de ani de zile și există mai multe FM-uri diferite disponibile - fiecare cu puncte forte unice și caracteristici. După cum am văzut de-a lungul anilor cu tehnologiile în mișcare rapidă și în evoluția ML, lucrurile se schimbă rapid. Ne așteptăm să apară noi arhitecturi în viitor, iar această diversitate de FM va declanșa un val de inovație. Vedem deja noi experiențe de aplicații nemaivăzute până acum. Clienții AWS ne-au întrebat cum pot profita rapid de ceea ce există astăzi (și ce urmează probabil mâine) și să înceapă rapid să utilizeze FM și AI generativă în cadrul afacerilor și organizațiilor lor pentru a conduce la noi niveluri de productivitate și a-și transforma ofertele.

Anunțarea modelelor Amazon Bedrock și Amazon Titan, cea mai simplă modalitate de a construi și scala aplicații AI generative cu FM

Clienții ne-au spus că astăzi le stau în cale câteva lucruri importante. În primul rând, au nevoie de o modalitate simplă de a găsi și de a accesa FM-uri de înaltă performanță, care oferă rezultate remarcabile și sunt cele mai potrivite pentru scopurile lor. În al doilea rând, clienții doresc ca integrarea în aplicații să fie perfectă, fără a fi nevoiți să gestioneze grupuri uriașe de infrastructură sau să suporte costuri mari. În cele din urmă, clienții doresc să fie ușor să preia FM de bază și să construiască aplicații diferențiate folosind propriile lor date (puține date sau multe). Deoarece datele pe care clienții doresc să le folosească pentru personalizare sunt IP incredibil de valoroase, au nevoie de el pentru a rămâne complet protejați, securizat și privat în timpul procesului și doresc control asupra modului în care datele lor sunt partajate și utilizate.

Am primit toate aceste feedback de la clienți și astăzi suntem încântați să vă anunțăm Amazon Bedrock, un nou serviciu care face ca FM de la AI21 Labs, Anthropic, Stability AI și Amazon să fie accesibile printr-un API. Bedrock este cea mai simplă modalitate prin care clienții pot construi și scala aplicații generative bazate pe inteligență artificială folosind FM-uri, democratizând accesul pentru toți constructorii. Bedrock va oferi posibilitatea de a accesa o serie de FM puternice pentru text și imagini, inclusiv Titan FM-uri de la Amazon, care constau din două noi LLM-uri pe care le anunțăm și astăzi— printr-un serviciu gestionat AWS scalabil, fiabil și sigur. Cu experiența Bedrock fără server, clienții pot găsi cu ușurință modelul potrivit pentru ceea ce încearcă să realizeze, să înceapă rapid, să personalizeze în mod privat FM-urile cu propriile date și să le integreze și să le implementeze cu ușurință în aplicațiile lor folosind instrumentele și capabilitățile AWS pe care le au. sunt familiarizați cu (inclusiv integrări cu caracteristicile Amazon SageMaker ML, cum ar fi Experimente pentru a testa diferite modele și Pipelines pentru a-și gestiona FM-urile la scară) fără a fi nevoie să gestionați nicio infrastructură.

Clienții Bedrock pot alege dintre unele dintre cele mai de ultimă oră FM disponibile astăzi. Aceasta include familia Jurassic-2 de LLM multilingve de la AI21 Labs, care urmează instrucțiuni în limbaj natural pentru a genera text în spaniolă, franceză, germană, portugheză, italiană și olandeză. Claude, LLM de la Anthropic, poate îndeplini o mare varietate de sarcini conversaționale și de procesare a textului și se bazează pe cercetările extinse ale Anthropic privind formarea sistemelor AI oneste și responsabile. De asemenea, Bedrock facilitează accesul la suita Stability AI de modele de fundație text-to-image, inclusiv Stable Diffusion (cea mai populară de acest gen), care este capabilă să genereze imagini unice, realiste, de înaltă calitate, artă, logo-uri și desene.

Una dintre cele mai importante capabilități ale Bedrock este cât de ușor este să personalizați un model. Clienții pur și simplu indică Bedrock către câteva exemple etichetate în Amazon S3, iar serviciul poate ajusta modelul pentru o anumită sarcină fără a fi nevoie să adnoteze volume mari de date (sunt suficiente doar 20 de exemple). Imaginați-vă un manager de marketing de conținut care lucrează la un important retailer de modă și trebuie să dezvolte reclame și campanii noi, direcționate, pentru o nouă linie de genți de mână. Pentru a face acest lucru, ei oferă Bedrock câteva exemple etichetate ale sloganelor lor cele mai performante din campaniile anterioare, împreună cu descrierile produselor asociate, iar Bedrock va începe automat să genereze rețele sociale eficiente, anunțuri grafice și copii web pentru noile genți de mână. Niciuna dintre datele clientului nu este folosită pentru a antrena modelele de bază și, deoarece toate datele sunt criptate și nu părăsesc Virtual Private Cloud (VPC) al clientului, clienții pot avea încredere că datele lor vor rămâne private și confidențiale.

Bedrock este acum în previzualizare limitată, iar clienților le place Coda sunt încântați de cât de repede au început să funcționeze echipele lor de dezvoltare. Shishir Mehrotra, co-fondator și CEO al Coda, spune: „În calitate de client fericit AWS de multă vreme, suntem încântați de modul în care Amazon Bedrock poate aduce calitate, scalabilitate și performanță Coda AI. Deoarece toate datele noastre sunt deja pe AWS, suntem capabili să încorporăm rapid AI generativă folosind Bedrock, cu toată securitatea și confidențialitatea de care avem nevoie pentru a ne proteja datele încorporate. Cu peste zeci de mii de echipe care rulează pe Coda, inclusiv echipe mari precum Uber, New York Times și Square, fiabilitatea și scalabilitatea sunt cu adevărat importante.”

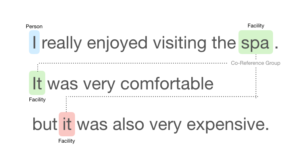

Am previzualizat noile Titan FM ale Amazon cu câțiva clienți înainte de a le face disponibile pe scară largă în lunile următoare. Inițial vom avea două modele Titan. Primul este un LLM generativ pentru sarcini precum rezumarea, generarea de text (de exemplu, crearea unei postări pe blog), clasificare, întrebări și răspunsuri deschise și extragerea de informații. Al doilea este un LLM de încorporare care traduce intrările de text (cuvinte, fraze sau eventual unități mari de text) în reprezentări numerice (cunoscute sub numele de înglobare) care conțin sensul semantic al textului. Deși acest LLM nu va genera text, este util pentru aplicații precum personalizarea și căutarea, deoarece prin compararea înglobărilor modelul va produce răspunsuri mai relevante și contextuale decât potrivirea cuvintelor. De fapt, capacitatea de căutare a produselor Amazon.com utilizează un model de încorporare similar, printre altele, pentru a ajuta clienții să găsească produsele pe care le caută. Pentru a susține în continuare cele mai bune practici în utilizarea responsabilă a inteligenței artificiale, Titan FM sunt concepute pentru a detecta și elimina conținutul dăunător din date, a respinge conținutul neadecvat din datele introduse de utilizator și a filtra rezultatele modelelor care conțin conținut neadecvat (cum ar fi discursul instigator la ură, blasfemie și violență).

Bedrock face ca puterea FM să fie accesibilă companiilor de toate dimensiunile, astfel încât acestea să poată accelera utilizarea ML în organizațiile lor și să își construiască propriile aplicații AI generative, deoarece va fi ușor pentru toți dezvoltatorii. Credem că Bedrock va fi un pas masiv înainte în democratizarea FM-urilor și a partenerilor noștri precum Accenture, Deloitte, Infosys și Slalom construiesc practici pentru a ajuta întreprinderile să meargă mai repede cu IA generativă. Furnizori independenți de software (ISV) cum ar fi C3 AI și Pega sunt încântați să folosească Bedrock pentru acces ușor la marea sa selecție de FM, cu toată securitatea, confidențialitatea și fiabilitatea pe care le așteaptă de la AWS.

Anunțând disponibilitatea generală a instanțelor Amazon EC2 Trn1n alimentate de AWS Trainium și a instanțelor Amazon EC2 Inf2 alimentate de AWS Inferentia2, cea mai rentabilă infrastructură cloud pentru AI generativă

Indiferent de ceea ce încearcă clienții să facă cu FM-urile – să le ruleze, să le construiască, să le personalizeze – au nevoie de cea mai performantă și mai rentabilă infrastructură, creată special pentru ML. În ultimii cinci ani, AWS a investit în propriul nostru siliciu pentru a împinge limitele în ceea ce privește performanța și performanța prețului pentru sarcini de lucru solicitante, cum ar fi antrenamentul ML și Inference, iar cipurile noastre AWS Trainium și AWS Inferentia oferă cel mai mic cost pentru modelele de antrenament și rularea inferenței. în nor. Această capacitate de a maximiza performanța și de a controla costurile prin alegerea infrastructurii ML optime este motivul pentru care startup-urile de IA de vârf, precum AI21 Labs, Anthropic, Cohere, Grammarly, Hugging Face, Runway și Stability AI rulează pe AWS.

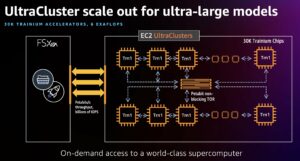

Instanțele Trn1, dezvoltate de Trainium, pot oferi economii de până la 50% la costurile de instruire față de orice altă instanță EC2 și sunt optimizate pentru a distribui instruirea pe mai multe servere conectate cu 800 Gbps de rețea Elastic Fabric Adapter (EFA) de a doua generație. Clienții pot implementa instanțe Trn1 în UltraClusters care pot scala până la 30,000 de cipuri Trainium (mai mult de 6 exaflopi de calcul) situate în aceeași zonă de disponibilitate AWS cu rețea la scară petabit. Mulți clienți AWS, inclusiv Helixon, Money Forward și echipa Amazon Search, folosesc instanțe Trn1 pentru a ajuta la reducerea timpului necesar antrenării celor mai mari modele de deep learning de la luni la săptămâni sau chiar zile, reducând în același timp costurile. 800 Gbps reprezintă o lățime de bandă mare, dar am continuat să inovăm pentru a oferi mai mult, iar astăzi anunțăm disponibilitatea generală a noilor, optimizate pentru rețea Trn1n cazuri, care oferă o lățime de bandă de rețea de 1600 Gbps și sunt concepute pentru a oferi performanțe cu 20% mai mari față de Trn1 pentru modelele mari, cu utilizare intensivă a rețelei.

Astăzi, cea mai mare parte a timpului și a banilor cheltuiți pe FM sunt destinate instruirii acestora. Acest lucru se datorează faptului că mulți clienți abia încep să implementeze FM-uri în producție. Cu toate acestea, în viitor, atunci când FM-urile sunt implementate la scară, cele mai multe costuri vor fi asociate cu rularea modelelor și realizarea de inferențe. În timp ce de obicei antrenați un model periodic, o aplicație de producție poate genera constant predicții, cunoscute sub numele de inferențe, potențial generatoare de milioane pe oră. Și aceste previziuni trebuie să se întâmple în timp real, ceea ce necesită o latență foarte scăzută și o rețea de mare debit. Alexa este un exemplu grozav, cu milioane de solicitări care vin în fiecare minut, ceea ce reprezintă 40% din toate costurile de calcul.

Deoarece știam că majoritatea costurilor viitoare de ML vor proveni din efectuarea de inferențe, am prioritizat siliciul optimizat pentru inferență atunci când am început să investim în noi cipuri în urmă cu câțiva ani. În 2018, am anunțat Inferentia, primul cip special creat pentru inferență. În fiecare an, Inferentia ajută Amazon să realizeze trilioane de inferențe și a economisit deja companii precum Amazon peste o sută de milioane de dolari în cheltuieli de capital. Rezultatele sunt impresionante și vedem multe oportunități de a continua inovarea, deoarece volumul de lucru va crește doar în dimensiune și complexitate, pe măsură ce mai mulți clienți integrează AI generativă în aplicațiile lor.

De aceea anunțăm astăzi disponibilitatea generala a Inf2 instanțe alimentate de AWS Inferentia2, care sunt optimizate special pentru aplicații AI generative la scară largă cu modele care conțin sute de miliarde de parametri. Instanțele Inf2 oferă un randament de până la 4 ori mai mare și o latență de până la 10 ori mai mică în comparație cu instanțele bazate pe Inferentia din generația anterioară. Ele au, de asemenea, conectivitate de ultra-înaltă viteză între acceleratoare pentru a sprijini inferența distribuită la scară largă. Aceste capabilități generează performanțe cu până la 40% mai bune la prețul de inferență decât alte instanțe Amazon EC2 comparabile și cel mai mic cost pentru inferență în cloud. Clienții precum Runway văd un randament de până la 2 ori mai mare cu Inf2 decât instanțe comparabile Amazon EC2 pentru unele dintre modelele lor. Această inferență de înaltă performanță și cu costuri reduse va permite Runway să introducă mai multe funcții, să implementeze modele mai complexe și, în cele din urmă, să ofere o experiență mai bună pentru milioanele de creatori care folosesc Runway.

Se anunță disponibilitatea generală a Amazon CodeWhisperer, gratuit pentru dezvoltatorii individuali

Știm că construirea cu FM-urile potrivite și rularea aplicațiilor AI generative la scară pe cea mai performantă infrastructură cloud va fi transformatoare pentru clienți. Noul val de experiențe va fi, de asemenea, transformator pentru utilizatori. Cu AI generativă încorporată, utilizatorii vor putea avea interacțiuni mai naturale și fără întreruperi cu aplicațiile și sistemele. Gândiți-vă la cum ne putem debloca telefoanele mobile doar privindu-le, fără a fi nevoie să știm nimic despre modelele puternice ML care fac posibilă această funcție.

Un domeniu în care prevedem că utilizarea IA generativă crește rapid este codificarea. Dezvoltatorii de software își petrec astăzi o mare parte din timp scriind cod destul de simplu și nediferențiat. De asemenea, ei petrec mult timp încercând să țină pasul cu un peisaj de instrumente și tehnologie complex și în continuă schimbare. Toate acestea le lasă dezvoltatorilor mai puțin timp pentru a dezvolta capabilități și servicii noi, inovatoare. Dezvoltatorii încearcă să depășească acest lucru prin copierea și modificarea fragmentelor de cod de pe web, ceea ce poate duce la copierea din greșeală a codului care nu funcționează, conține vulnerabilități de securitate sau nu urmărește utilizarea software-ului open source. Și, în cele din urmă, căutarea și copierea încă iau timp departe de lucrurile bune.

AI generativă poate elimina această problemă grea din ecuație „scriind” o mare parte din codul nediferențiat, permițând dezvoltatorilor să construiască mai rapid, eliberându-i în același timp să se concentreze pe aspectele mai creative ale codării. Acesta este motivul pentru care, anul trecut, am anunțat avanpremiera Amazon Code Whisperer, un însoțitor de codare AI care folosește un FM sub capotă pentru a îmbunătăți radical productivitatea dezvoltatorului prin generarea de sugestii de cod în timp real, pe baza comentariilor dezvoltatorilor în limbaj natural și a codului anterior în mediul lor de dezvoltare integrat (IDE). Dezvoltatorii pot spune pur și simplu lui CodeWhisperer să îndeplinească o sarcină, cum ar fi „analiza un șir CSV de melodii” și îi pot cere să returneze o listă structurată bazată pe valori precum artist, titlu și cel mai înalt rang în top. CodeWhisperer oferă o creștere a productivității prin generarea unei întregi funcții care parsează șirul și returnează lista așa cum este specificat. Răspunsul dezvoltatorilor la previzualizare a fost copleșitor de pozitiv și continuăm să credem că ajutarea codului dezvoltatorilor ar putea ajunge să fie una dintre cele mai puternice utilizări ale AI generative pe care le vom vedea în următorii ani. În timpul previzualizării, am desfășurat o provocare de productivitate, iar participanții care au folosit CodeWhisperer au finalizat sarcinile cu 57% mai rapid, în medie, și au avut 27% mai multe șanse să le finalizeze cu succes decât cei care nu au folosit CodeWhisperer. Acesta este un salt uriaș înainte în productivitatea dezvoltatorilor și credem că acesta este doar începutul.

Astăzi, suntem încântați să anunțăm disponibilitatea generală a Amazon CodeWhisperer pentru Python, Java, JavaScript, TypeScript și C# — plus zece limbi noi, inclusiv Go, Kotlin, Rust, PHP și SQL. CodeWhisperer poate fi accesat din IDE-uri precum VS Code, IntelliJ IDEA, AWS Cloud9 și multe altele prin extensiile IDE AWS Toolkit. CodeWhisperer este disponibil și în consola AWS Lambda. Pe lângă învățarea din miliardele de linii de cod disponibile public, CodeWhisperer a fost instruit pe codul Amazon. Credem că CodeWhisperer este acum cel mai precis, rapid și mai sigur mod de a genera cod pentru serviciile AWS, inclusiv Amazon EC2, AWS Lambda și Amazon S3.

Dezvoltatorii nu vor fi cu adevărat mai productivi dacă codul sugerat de instrumentul lor generativ AI conține vulnerabilități de securitate ascunse sau nu reușește să gestioneze responsabil sursa deschisă. CodeWhisperer este singurul partener de codare AI cu scanare de securitate încorporată (alimentată de raționament automat) pentru a găsi și sugera remedieri pentru vulnerabilități greu de detectat, cum ar fi cele din primele zece proiecte Open Worldwide Application Security (OWASP), cele care nu îndeplinesc cele mai bune practici ale bibliotecii cripto și altele. Pentru a ajuta dezvoltatorii să codifice în mod responsabil, CodeWhisperer filtrează sugestiile de cod care ar putea fi considerate părtinitoare sau neloiale, iar CodeWhisperer este singurul partener de codare care poate filtra și semnala sugestiile de cod care seamănă cu codul open source pe care clienții ar putea dori să îl facă referire sau să licențieze pentru utilizare.

Știm că IA generativă va schimba jocul pentru dezvoltatori și ne dorim să fie utilă pentru cât mai mulți. Acesta este motivul pentru care CodeWhisperer este gratuit pentru toți utilizatorii individuali, fără calificări sau limite de timp pentru generarea codului! Oricine se poate înscrie la CodeWhisperer doar cu un cont de e-mail și poate deveni mai productiv în câteva minute. Nici măcar nu trebuie să aveți un cont AWS. Pentru utilizatorii de afaceri, oferim un nivel profesional CodeWhisperer care include funcții de administrare, cum ar fi conectarea unică (SSO) cu integrarea AWS Identity and Access Management (IAM), precum și limite mai mari ale scanării de securitate.

Crearea de aplicații puternice precum CodeWhisperer este transformatoare pentru dezvoltatori și toți clienții noștri. Urmează multe altele și suntem încântați de ceea ce veți construi cu AI generativă pe AWS. Misiunea noastră este să facem posibil ca dezvoltatorii de toate nivelurile de calificare și organizațiile de toate dimensiunile să inoveze folosind IA generativă. Acesta este doar începutul a ceea ce credem că va fi următorul val de ML care va oferi noi posibilități pentru dvs.

Resurse

Consultați următoarele resurse pentru a afla mai multe despre AI generativă pe AWS și despre aceste anunțuri:

Despre autor

Swami Sivasubramanian este vicepreședinte pentru Data și Machine Learning la AWS. În acest rol, Swami supraveghează toate serviciile AWS Database, Analytics și AI & Machine Learning. Misiunea echipei sale este de a ajuta organizațiile să-și pună datele în funcțiune cu o soluție de date completă, de la capăt la capăt, pentru a stoca, accesa, analiza și vizualiza și prezice.

Swami Sivasubramanian este vicepreședinte pentru Data și Machine Learning la AWS. În acest rol, Swami supraveghează toate serviciile AWS Database, Analytics și AI & Machine Learning. Misiunea echipei sale este de a ajuta organizațiile să-și pună datele în funcțiune cu o soluție de date completă, de la capăt la capăt, pentru a stoca, accesa, analiza și vizualiza și prezice.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- Platoblockchain. Web3 Metaverse Intelligence. Cunoștințe amplificate. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-for-building-with-generative-ai-on-aws/

- :este

- $UP

- 000

- 000 de clienți

- 1

- 100

- ani 20

- 2018

- 2019

- 7

- a

- capacitate

- Capabil

- Despre Noi

- accelera

- acceleratoare

- Accenture

- acces

- accesate

- accesibil

- Cont

- Conturi

- precis

- peste

- activitate

- Ad

- plus

- administrare

- Adoptare

- avansare

- progresele

- Avantaj

- Agențiile

- AI

- AI și învățarea automată

- AIR

- Alexa

- TOATE

- Permiterea

- deja

- uimitor

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon SageMaker

- printre

- sumă

- Sume

- Google Analytics

- analiza

- analiza

- și

- anunța

- a anunțat

- anunturi

- anunțare

- oricine

- api

- aplicație

- securitatea aplicațiilor

- aplicatii

- Aplică

- abordare

- Apps

- arhitectură

- SUNT

- ZONĂ

- în jurul

- Artă

- artist

- AS

- aspecte

- asociate

- At

- atenţie

- Automata

- în mod automat

- disponibilitate

- disponibil

- in medie

- AWS

- AWS Cloud9

- Client AWS

- AWS Identity and Access Management (IAM)

- Inferentia AWS

- AWS Lambdas

- Lățime de bandă

- Bancar

- de bază

- bazat

- BE

- deoarece

- deveni

- înainte

- începe

- Început

- fiind

- Crede

- CEL MAI BUN

- Cele mai bune practici

- Mai bine

- între

- Dincolo de

- Mare

- miliarde

- Blog

- Blog

- Floare

- BMW

- a stimula

- aduce

- larg

- in linii mari

- construi

- constructori

- Clădire

- construit

- construit-in

- afaceri

- întreprinderi

- by

- apel

- Campanie

- Campanii

- CAN

- capacități

- capabil

- Capacitate

- capital

- Captură

- Centre

- CEO

- lanţ

- contesta

- Schimbare

- Caracteristici

- Diagramă

- Chat GPT

- verifica

- cip

- Chips

- Alege

- alegere

- Circulație

- clasificare

- Cloud

- infrastructura cloud

- Cloud9

- Co-fondator

- cod

- Codificare

- cum

- venire

- comentarii

- comise

- în mod obișnuit

- Companii

- Compania

- comparabil

- comparație

- compararea

- Completă

- Terminat

- complet

- complex

- complexitate

- Calcula

- calculator

- Computer Vision

- Concepte

- legat

- Suport conectare

- luate în considerare

- Consoleze

- mereu

- consumator

- Consumatorii

- conţine

- conține

- conţinut

- Conținut de marketing

- contexte

- contextual

- continua

- a continuat

- Control

- de conversaţie

- conversații

- copiere

- A costat

- cost-eficiente

- Cheltuieli

- ar putea

- crea

- Crearea

- Creator

- Creatorii

- cripto

- Curent

- client

- experienta clientului

- clienţii care

- personalizare

- personaliza

- personalizate

- ultima generație

- zilnic

- de date

- Baza de date

- Zi

- zeci de ani

- adânc

- învățare profundă

- cea mai adâncă

- livra

- Deloitte

- cerând

- democratizarea

- implementa

- dislocate

- proiectat

- modele

- dezvolta

- dezvoltat

- Dezvoltator

- Dezvoltatorii

- Dezvoltare

- Dialog

- diferit

- diferențiat

- difuziune

- Afişa

- distribui

- distribuite

- Diversitate

- document

- Nu

- face

- de dolari

- domenii

- Dont

- conduce

- condus

- Drone

- în timpul

- Olandeză

- e-commerce

- fiecare

- Devreme

- Cel mai simplu

- cu ușurință

- Eficace

- permite

- criptate

- un capăt la altul

- captivant

- Motor

- inginerii

- suficient de

- Companii

- Divertisment

- Întreg

- Mediu inconjurator

- Ethos

- Chiar

- mereu în schimbare

- Fiecare

- evoluţie

- exemplu

- exemple

- excitat

- captivant

- aștepta

- experienţă

- Experiențe

- Expunere

- extinde

- extensii

- extensiv

- țesătură

- Față

- eșuează

- familiar

- familie

- Modă

- FAST

- în mișcare rapidă

- mai repede

- cel mai rapid

- Caracteristică

- DESCRIERE

- feedback-ul

- Ferrari

- puțini

- filtru

- Filtre

- În cele din urmă

- financiar

- Găsi

- descoperire

- Firmă

- First

- Concentra

- urma

- următor

- Pentru

- Oficial

- formulare

- Înainte

- Fundație

- fracțiune

- Gratuit

- Franceză

- proaspăt

- din

- funcţie

- funcții

- viitor

- joc

- General

- scop general

- în general

- genera

- generator

- generaţie

- generativ

- AI generativă

- Germană

- obține

- gigant

- Da

- Go

- Merge

- merge

- bine

- Guvern

- mare

- În creştere

- mână

- manipula

- întâmpla

- fericit

- nociv

- Avea

- având în

- de asistență medicală

- greu

- ridicare de greutati

- ajutor

- ajutor

- ajută

- moștenire

- Ascuns

- performanta ridicata

- performanta inalta

- de înaltă calitate

- superior

- cea mai mare

- Case

- capotă

- Cum

- Totuși

- HTTPS

- mare

- sute

- idee

- idei

- Identitate

- imagine

- Recunoașterea imaginii

- imagini

- imaginaţie

- important

- impresionant

- îmbunătăţi

- in

- include

- include

- Inclusiv

- incorpora

- Crește

- incredibil

- independent

- individ

- industrii

- Punct de inflexiune

- informații

- extragerea informațiilor

- informat

- Infosys

- Infrastructură

- inițial

- inova

- inovatoare

- Inovaţie

- inovații

- inovatoare

- intrare

- instanță

- instrucțiuni

- integra

- integrate

- integrare

- integrările

- Inteligent

- interacţiuni

- intern

- introduce

- Intui

- Invenţie

- investit

- investind

- IP

- IT

- articole

- ESTE

- Java

- JavaScript

- A pastra

- Cheie

- Copil

- Cunoaște

- cunoştinţe

- cunoscut

- Labs

- peisaj

- limbă

- Limbă

- mare

- pe scară largă

- cea mai mare

- Nume

- Anul trecut

- Latență

- a lansat

- straturi

- conducere

- Salt

- AFLAȚI

- învăţare

- Părăsi

- Led

- Permite

- nivelurile de

- Pârghie

- Bibliotecă

- Licență

- ridicare

- ca

- Probabil

- Limitat

- Limitele

- Linie

- linii

- Listă

- mic

- LLM

- situat

- cautati

- Lot

- low-cost

- coborârea

- maşină

- masina de învățare

- face

- FACE

- Efectuarea

- administra

- gestionate

- administrare

- manager

- multe

- Marketing

- masiv

- potrivire

- matematica

- Maximaliza

- Mai..

- sens

- Mass-media

- Întâlni

- ar putea

- milion

- un milion de dolari

- milioane

- minut

- minute

- Misiune

- misiuni

- ML

- Mobil

- telefoane mobile

- model

- Modele

- bani

- luni

- mai mult

- cele mai multe

- Cel mai popular

- multiplu

- Muzică

- Natural

- Natură

- Nevoie

- au nevoie

- nevoilor

- reţea

- rețele

- rețele neuronale

- Nou

- New York

- New York Times

- următor

- număr

- of

- oferi

- oferind

- ofertele

- on

- ONE

- deschide

- open-source

- Oportunităţi

- optimă

- Optimizați

- optimizate

- organizații

- Altele

- Altele

- remarcabil

- Învinge

- propriu

- paradigmă

- parametrii

- parte

- participanţi

- special

- parteneri

- trecut

- modele

- Efectua

- performanță

- efectuarea

- personalizare

- Telefoane

- PHP

- Expresii

- fizic

- planificare

- Plato

- Informații despre date Platon

- PlatoData

- a jucat

- Punct

- Popular

- portofoliu

- Portugheză

- pozitiv

- posibilităţile de

- posibil

- Post

- postări

- potenţial

- potenţial

- putere

- alimentat

- puternic

- Alimentarea

- Practic

- practicile

- prezice

- Predictii

- preşedinte

- destul de

- Anunţ

- preţ

- Prim

- anterior

- prioritizate

- intimitate

- privat

- probleme

- proces

- prelucrare

- produce

- Produs

- producere

- productiv

- productivitate

- Produse

- PROFANITATE

- profesional

- proiect

- proprietate

- proteja

- protejat

- furniza

- furnizează

- public

- scopuri

- Împinge

- pune

- Piton

- Q & A

- calificări

- calitate

- Întrebări

- repede

- radical

- gamă

- rapid

- repede

- Citeste

- gata

- în timp real

- realist

- realiza

- tărâm

- recent

- recent

- recunoaştere

- Recomandări

- reduce

- menționat

- încredere

- de încredere

- rămâne

- scoate

- raportează

- Rapoarte

- cereri de

- necesar

- Necesită

- cercetare

- Resurse

- răspuns

- responsabil

- rezultat

- rezultând

- REZULTATE

- cu amănuntul

- vânzător cu amănuntul

- reveni

- Returnează

- Reuters

- Ridica

- Rol

- rute

- Alerga

- funcţionare

- pistei

- Rugină

- sagemaker

- acelaşi

- Economie

- spune

- scalabilitate

- scalabil

- Scară

- scanare

- fără sudură

- Caută

- căutare

- Al doilea

- sigur

- securitate

- seminţe

- vedere

- selecţie

- sens

- sentiment

- serverless

- Servere

- serviciu

- Servicii

- set

- câteva

- comun

- Raft

- schimbare

- Magazin

- să

- semna

- semnificativ

- Siliciu

- asemănător

- simplu

- pur şi simplu

- întrucât

- singur

- Mărimea

- dimensiuni

- calificare

- mic

- inteligent

- So

- Social

- social media

- Software

- Dezvoltatori de software

- soluţie

- Rezolvarea

- unele

- Sursă

- cod sursă

- deschidere

- Spaniolă

- specific

- specific

- specificată

- discurs

- petrece

- uzat

- pătrat

- Stabilitate

- stabil

- stivui

- Începe

- început

- Pornire

- Startup-urile

- şedere

- Pas

- Încă

- stoca

- Istorii

- simplu

- puncte forte

- Şir

- structurat

- Studiu

- stil

- Reușit

- astfel de

- suită

- livra

- lanțului de aprovizionare

- a sustine

- De sprijin

- sisteme

- Lua

- ia

- vizate

- Sarcină

- sarcini

- echipă

- echipe

- tech

- tech

- Tehnologii

- Tehnologia

- zece

- test

- acea

- Viitorul

- New York Times

- lumea

- lor

- Lor

- se

- Acestea

- lucruri

- Thomson Reuters

- mii

- trei

- Prin

- debit

- Nivelul

- timp

- ori

- gigant

- Titlu

- la

- astăzi

- azi

- mâine

- instrument

- Toolkit

- Unelte

- top

- Top zece

- urmări

- tradiţional

- Tren

- dresat

- Pregătire

- Tranzacții

- Transforma

- transformativă

- transformare

- călătorie

- Tendinţe

- trilioane

- Încredere

- manuscris dactilografiat

- tipic

- Uber

- în cele din urmă

- în

- care stau la baza

- unic

- de unităţi

- deschide

- viitoare

- us

- Folosire

- utilizare

- Utilizator

- utilizatorii

- Valoros

- Valori

- varietate

- diverse

- Fixă

- furnizori

- de

- Vicepreședinte

- Video

- Violenţă

- Virtual

- viziune

- Voce

- volume

- vs

- vs cod

- Vulnerabilitățile

- Val

- Cale..

- web

- săptămână

- săptămâni

- BINE

- Ce

- Ce este

- care

- în timp ce

- OMS

- larg

- Gamă largă

- pe scară largă

- voi

- cu

- în

- fără

- Cuvânt

- cuvinte

- Apartamente

- de lucru

- fabrică

- lume

- la nivel internațional.

- ar

- scris

- an

- ani

- Tu

- zephyrnet