Amazon SageMaker JumpStart este centrul de învățare automată (ML) al SageMaker, care oferă modele pre-instruite, disponibile public pentru o gamă largă de tipuri de probleme, pentru a vă ajuta să începeți cu învățarea automată.

Înțelegerea comportamentului clienților este cea mai importantă pentru fiecare afacere astăzi. Obținerea de informații despre de ce și cum cumpără clienții poate ajuta la creșterea veniturilor. Retragerea clienților este o problemă cu care se confruntă o gamă largă de companii, de la telecomunicații la servicii bancare, unde clienții sunt de obicei pierduți în fața concurenților. Este în interesul unei companii să păstreze clienții existenți în loc să achiziționeze clienți noi, deoarece de obicei costă mult mai mult pentru a atrage clienți noi. Atunci când încearcă să-și păstreze clienții, companiile își concentrează adesea eforturile asupra clienților care au șanse mai mari să plece. Comportamentul utilizatorilor și jurnalele de chat de asistență pentru clienți pot conține indicatori valoroși cu privire la probabilitatea ca un client să încheie serviciul. În această soluție, antrenăm și implementăm un model de predicție a abandonului care utilizează un model de procesare a limbajului natural (NLP) de ultimă generație pentru a găsi semnale utile în text. În plus față de intrările textuale, acest model utilizează intrări tradiționale de date structurate, cum ar fi câmpurile numerice și categoriale.

Multimodalitatea este un domeniu de cercetare multidisciplinar care abordează unele dintre obiectivele originale ale inteligenței artificiale prin integrarea și modelarea modalităților multiple. Această postare își propune să construiască un model care poate procesa și corela informațiile din mai multe modalități, cum ar fi caracteristicile tabelare și textuale.

Vă arătăm cum să antrenați, să implementați și să utilizați un model de predicție de abandon care a procesat caracteristici numerice, categoriale și textuale pentru a-și face predicția. Deși ne aprofundăm într-un caz de utilizare al predicției de abandon în această postare, puteți utiliza această soluție ca șablon pentru a generaliza reglarea fină a modelelor pre-antrenate cu propriul set de date și, ulterior, să rulați optimizarea hiperparametrului (HPO) pentru a îmbunătăți acuratețea. Puteți chiar înlocui setul de date exemplu cu al dvs. și îl puteți rula cap la cap pentru a vă rezolva propriile cazuri de utilizare. Soluția prezentată în postare este disponibilă pe GitHub.

Șabloane de soluție JumpStart

Amazon SageMaker JumpStart oferă soluții end-to-end cu un singur clic pentru multe cazuri comune de utilizare ML. Explorați următoarele cazuri de utilizare pentru mai multe informații despre șabloanele de soluții disponibile:

Șabloanele de soluție JumpStart acoperă o varietate de cazuri de utilizare, sub fiecare dintre acestea fiind oferite mai multe șabloane de soluție diferite (această soluție de înțelegere a documentelor se află în cazul de utilizare „Extrage și analizează date din documente”).

Alegeți șablonul de soluție care se potrivește cel mai bine cazului dvs. de utilizare din pagina de destinație JumpStart. Pentru mai multe informații despre soluții specifice pentru fiecare caz de utilizare și despre cum să lansați o soluție JumpStart, consultați Șabloane de soluții.

Prezentare generală a soluțiilor

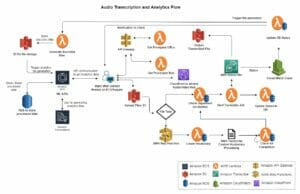

Următoarea figură demonstrează cum puteți utiliza această soluție cu Amazon SageMaker componente. Joburile de instruire SageMaker sunt folosite pentru a antrena diferitele modele NLP, iar punctele finale SageMaker sunt folosite pentru a implementa modelele în fiecare etapă. Folosim Serviciul Amazon de stocare simplă (Amazon S3) alături de SageMaker pentru a stoca datele de antrenament și artefactele modelului și Amazon CloudWatch pentru a înregistra rezultatele antrenamentului și ale punctelor finale.

Abordăm rezolvarea problemei de predicție a abandonului prin următorii pași:

- Explorarea datelor pentru a pregăti datele pentru a fi pregătite pentru ML.

- Antrenează un model multimodal cu a Transformator de propoziție Hugging Face și Scikit-learn clasificator de pădure aleatoriu.

- Îmbunătățiți în continuare performanța modelului folosind HPO Ajustarea automată a modelului SageMaker.

- Antrenează doi Modele multimodale AutoGluon: un model de ansamblu ponderat/stivuit multimodal AutoGluon și un model de fuziune multimodal AutoGluon.

- Evaluați și comparați performanța modelului pe datele testului de rezistență.

Cerințe preliminare

Pentru a încerca soluţie în cont propriu, asigurați-vă că aveți următoarele:

- Un cont AWS. Dacă nu ai cont, poți înscrie-te pentru unul.

- Soluția prezentată în postare face parte din SageMaker JumpStart. Pentru a rula această soluție JumpStart și a implementa infrastructura în contul dvs. AWS, trebuie să creați o soluție activă Amazon SageMaker Studio exemplu (vezi Integrat la Amazon SageMaker Studio). Când instanța dvs. Studio este gata, utilizați instrucțiunile din JumpStart pentru a lansa soluția.

- Când rulați acest lucru caiet pe Studio, ar trebui să vă asigurați că Python 3 (PyTorch 1.10 Python 3.8 CPU optimizat) se folosește imaginea/kernelul.

Puteți instala pachetele necesare așa cum este subliniat în soluția pentru a rula acest notebook:

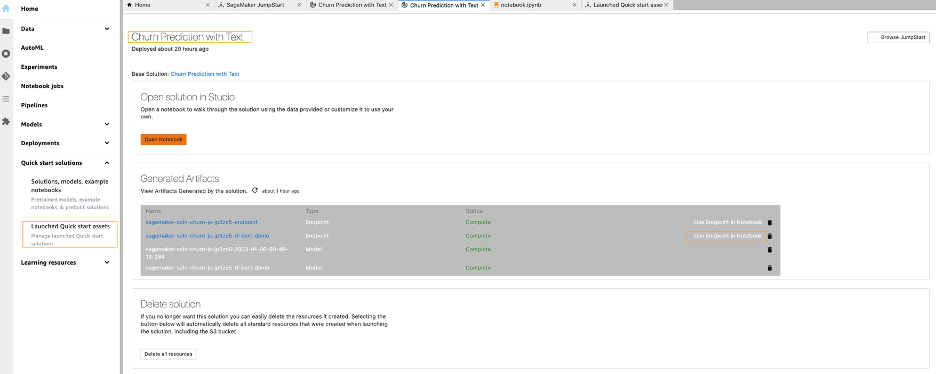

Deschideți cazul de utilizare al predicției abandonului

Pe consola Studio, alegeți Soluții, modele, exemple de caiete în Soluții de pornire rapidă în panoul de navigare. Navigați la Churn Prediction cu text soluție în JumpStart.

Acum putem arunca o privire mai atentă asupra unora dintre activele care sunt incluse în această soluție.

Explorarea datelor

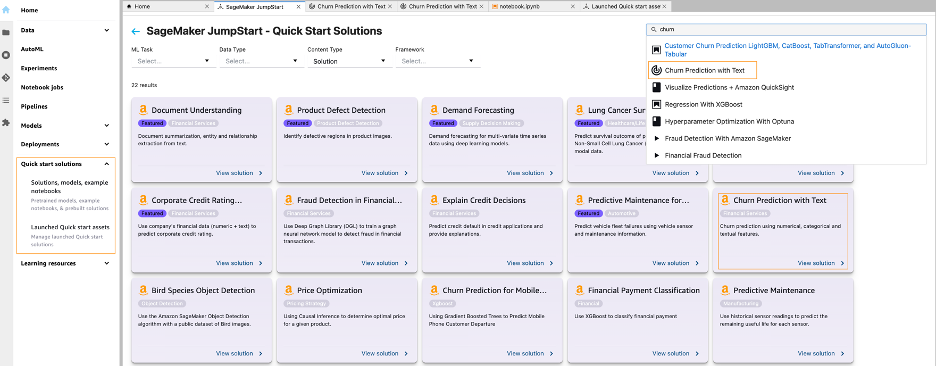

Mai întâi, să descarcăm setul de date de testare, validare și instruire din compartimentul S3 sursă și să îl încărcăm în compartimentul nostru S3. Următoarea captură de ecran ne arată 10 observații ale datelor de antrenament.

Să începem să explorăm trenul și setul de date de validare.

După cum puteți vedea, avem diferite caracteristici, cum ar fi CustServ Calls, Day Charge, și Day Calls pe care îl folosim pentru a prezice coloana țintă y (dacă clientul a părăsit serviciul).

y este cunoscut sub numele de atribut target: atributul pe care dorim să îl prezică modelul ML. Deoarece atributul țintă este binar, modelul nostru realizează predicție binară, cunoscută și ca clasificare binară.

Există 21 de caracteristici, inclusiv variabila țintă. Numărul de exemple pentru datele de instruire și validare este de 43,000, respectiv 5,000.

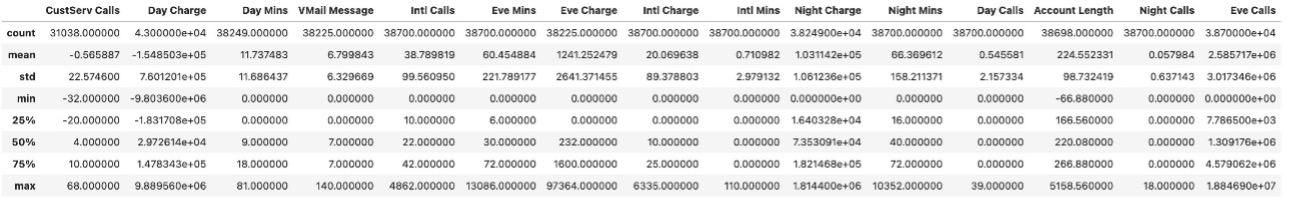

Următoarea captură de ecran arată statisticile rezumate ale setului de date de antrenament.

Am explorat setul de date și l-am împărțit în seturi de instruire, validare și testare. Setul de instruire și validare este utilizat pentru instruire și HPO. Setul de testare este folosit ca set de reținere pentru evaluarea performanței modelului. Acum efectuăm pașii de inginerie a caracteristicilor și apoi adaptăm modelul.

Potriviți un model multimodal cu un transformator de propoziție Hugging Face și un clasificator de pădure aleatoriu Scikit-learn

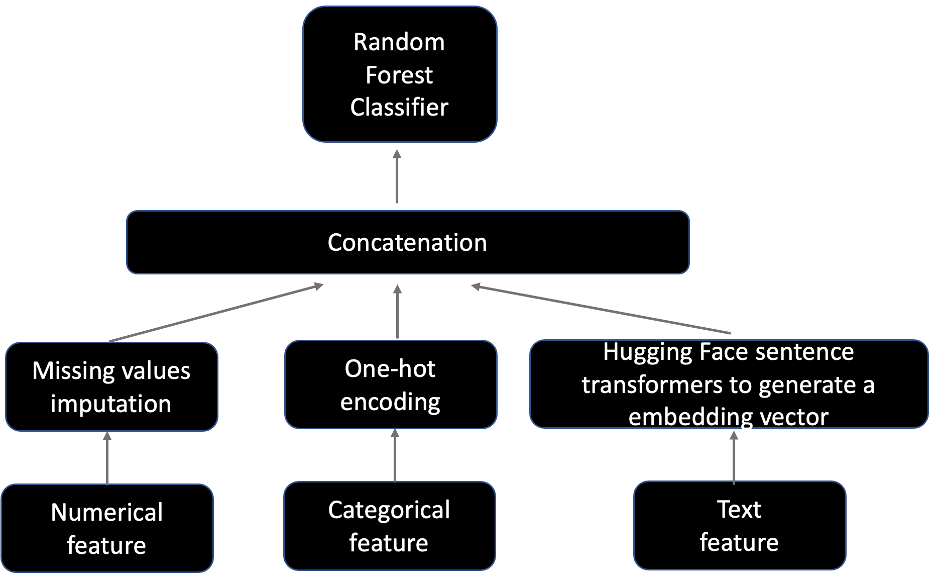

Antrenamentul modelului constă din două componente: un pas de inginerie a caracteristicilor care procesează caracteristici numerice, categoriale și de text și un pas de adaptare a modelului care încadrează caracteristicile transformate într-un Scikit-learn clasificator de pădure aleatoriu.

Pentru ingineria caracteristicilor, parcurgem următorii pași:

- Completați valorile lipsă pentru caracteristicile numerice.

- Codificați caracteristicile categoriale în valori one-hot, unde valorile lipsă sunt numărate ca una dintre categoriile pentru fiecare caracteristică.

- Folosi Transformator de propoziție Hugging Face pentru a codifica caracteristica textului pentru a genera un vector dens X-dimensional, unde valoarea lui X depinde de un anumit transformator de propoziție.

Alegem primele trei modele de transformatoare de propoziții cele mai descărcate și le folosim în următoarele modele de potrivire și HPO. Mai exact, folosim toate-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1, și parafraza-MiniLM-L6-v2. Pentru hiperparametrii clasificatorului de pădure aleatoriu, consultați GitHub repo.

Figura următoare prezintă diagrama arhitecturii modelului.

Există mulți hiperparametri pe care îi puteți regla, cum ar fi n-estimatori, max-depth și bootstrap. Pentru mai multe detalii, consultați GitHub repo.

În scopuri demonstrative, folosim doar caracteristici numerice CustServ Calls și Account Length, caracteristici categorice plan, și limit, și caracteristica text text pentru a se potrivi modelului. Caracteristicile multiple ar trebui separate prin ,.

Implementăm modelul după finalizarea instruirii:

Când apelăm noul nostru punct final din notebook, folosim un SDK SageMaker Predictor. O Predictor este folosit pentru a trimite date către un punct final (ca parte a unei cereri) și pentru a interpreta răspunsul. JSON este folosit ca format atât pentru datele de intrare, cât și pentru răspunsul de ieșire, deoarece este un format standard de punct final, iar răspunsul punctului final poate conține structuri de date imbricate.

Cu modelul nostru implementat cu succes și predictorul nostru configurat, putem încerca modelul de predicție a abandonului pe un exemplu de intrare:

Următorul cod arată răspunsul (probabilitatea de abandon) de la interogarea punctului final:

Rețineți că probabilitatea returnată de acest model nu a fost calibrată. Atunci când modelul oferă o probabilitate de abandon de 20%, de exemplu, acest lucru nu înseamnă neapărat că 20% dintre clienții cu o probabilitate de 20% au dus la abandon. Calibrarea este o proprietate utilă în anumite circumstanțe, dar nu este necesară în cazurile în care discriminarea între cazurile de abandon și non-chirn este suficientă. CalibratedClassifierCV din Scikit-învață poate fi folosit pentru a calibra un model.

Acum interogăm punctul final utilizând datele de testare hold-out, care constă din 1,939 de exemple. Următorul tabel rezumă rezultatele evaluării pentru modelul nostru multimodal cu un transformator de propoziție Hugging Face și un clasificator de pădure aleatoriu Scikit-learn.

| metric | BERT + Random Forest |

| Acuratete | 0.77463 |

| ROC AUC | 0.75905 |

Performanța modelului depinde de configurațiile hiperparametrilor. Antrenarea unui model cu un set de configurații de hiperparametri nu va garanta un model optim. Ca rezultat, rulăm procesul HPO în secțiunea următoare pentru a îmbunătăți și mai mult performanța modelului.

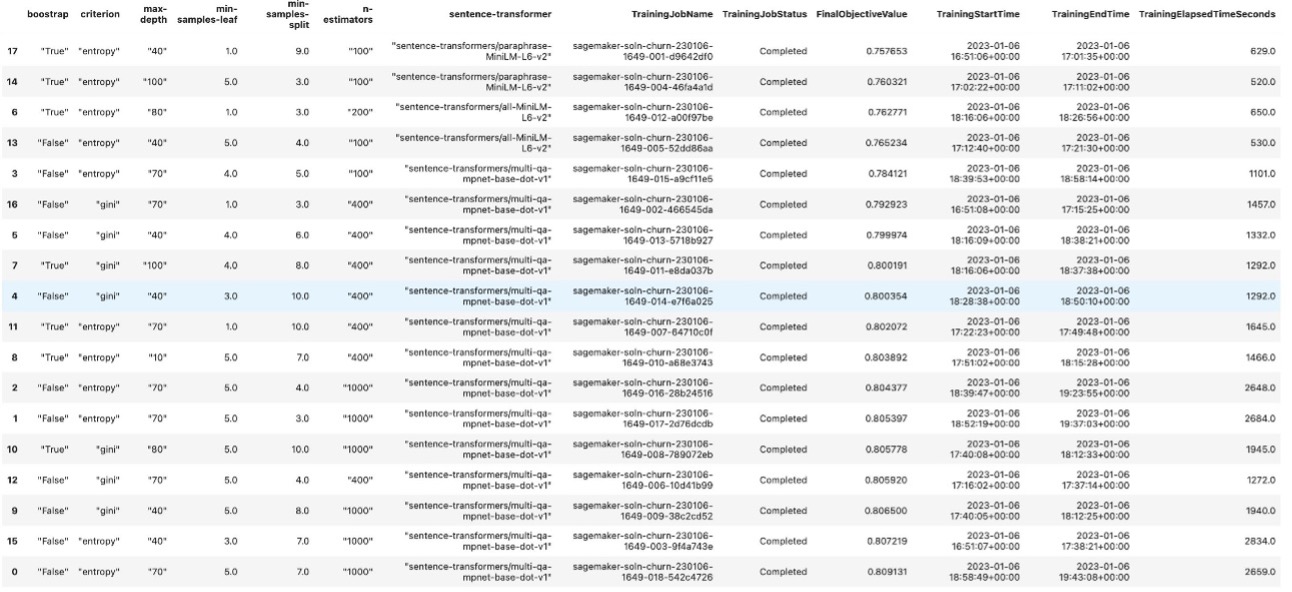

Potriviți un model multimodal cu HPO

În această secțiune, îmbunătățim și mai mult performanța modelului adăugând reglajul HPO cu Ajustarea automată a modelului SageMaker. Reglarea automată a modelului SageMaker, cunoscută și sub denumirea de reglare hiperparametrică, găsește cea mai bună versiune a unui model prin rularea multor joburi de antrenament pe setul de date folosind algoritmul și intervalele de hiperparametri pe care le specificați. Apoi alege valorile hiperparametrului care rezultă într-un model care are cele mai bune performanțe, măsurate de o metrică pe care o alegeți. Cel mai bun model și hiperparametrii săi corespunzători sunt selectați pe datele de validare. În continuare, cel mai bun model este evaluat pe datele de testare hold-out, care sunt aceleași date de testare pe care le-am creat în secțiunea anterioară. În cele din urmă, arătăm că performanța modelului antrenat cu HPO este semnificativ mai bună decât a celui antrenat fără HPO.

Următoarele sunt hiperparametrii statici pe care nu îi reglam și hiperparametrii dinamici pe care vrem să îi reglam și intervalele lor de căutare:

Definim numele metricii obiectivului, definiția metricii (cu model regex) și tipul obiectivului pentru sarcina de reglare.

În primul rând, am stabilit obiectivul ca scorul de acuratețe al datelor de validare (roc auc score on validation data) și valori definite pentru jobul de reglare prin specificarea numelui metricii obiectiv și a unei expresii regulate (regex). Expresia regulată este utilizată pentru a se potrivi cu rezultatul jurnalului algoritmului și pentru a capta valorile numerice ale valorilor.

Apoi, specificăm intervale de hiperparametri pentru a selecta cele mai bune valori ale hiperparametrului. Am stabilit numărul total de lucrări de reglare la 10 și le distribuim pe cinci lucrări diferite Cloud Elastic de calcul Amazon (Amazon EC2) instanțe pentru rularea joburilor de reglare paralelă.

În cele din urmă, trecem acele valori pentru a instanția un obiect SageMaker Estimator, similar cu ceea ce am făcut în pasul de antrenament anterior. În loc să apelăm funcția de potrivire a obiectului Estimator, trecem obiectul Estimator ca parametru la HyperparameterTuner constructor și apelați funcția fit a acesteia pentru a lansa joburi de reglare:

Când lucrarea de reglare este finalizată, putem genera tabelul rezumativ al tuturor joburilor de reglare.

După ce lucrările de reglare sunt finalizate, implementăm modelul care oferă cel mai bun punctaj de evaluare pentru setul de date de validare, efectuăm inferențe pe același set de date de test de rezistență pe care l-am făcut în secțiunea anterioară și calculăm valorile de evaluare.

| metric | BERT + Random Forest | BERT + Random Forest cu HPO |

| Acuratete | 0.77463 | 0.9278 |

| ROC AUC | 0.75905 | 0.79861 |

Putem vedea că rularea HPO cu reglarea automată a modelului SageMaker îmbunătățește semnificativ performanța modelului.

Pe lângă HPO, performanța modelului depinde și de algoritm. Este important să antrenați mai mulți algoritmi de ultimă generație, să le comparați performanța pe aceleași date de testare și să alegeți cel optim. Prin urmare, antrenăm încă două modele multimodale AutoGluon în secțiunile următoare.

Potriviți un model de ansamblu multimodal ponderat/stivuit AutoGluon

Există două tipuri de multimodalitate AutoGluon:

- Antrenați mai multe modele tabulare, precum și

TextPredictormodel (folosindTextPredictormodel din interiorulTabularPredictor), apoi combinați-le fie printr-un ansamblu ponderat, fie printr-un ansamblu stivuit, după cum este explicat în AutoGluon-Tabular: AutoML robust și precis pentru date structurate - Fuzionați mai multe modele de rețele neuronale direct și gestionați textul brut (care sunt, de asemenea, capabili să gestioneze coloane numerice și categoriale suplimentare)

Antrenăm un model de ansamblu multimodal ponderat sau stivuit mai întâi în această secțiune și antrenăm un model de rețea neuronală de fuziune în secțiunea următoare.

Mai întâi, recuperăm imaginea de antrenament AutoGluon:

În continuare, trecem în hiperparametri. Spre deosebire de cadrele AutoML existente care se concentrează în primul rând pe selecția modelului sau a hiperparametrului, AutoGluonTabular reușește prin asamblarea mai multor modele și stivuirea lor în mai multe straturi. Prin urmare, HPO nu este de obicei necesar pentru modelele de ansamblu AutoGluon.

În cele din urmă, creăm un SageMaker Estimator și sunați estimator.fit() pentru a începe un job de formare:

După finalizarea antrenamentului, recuperăm imaginea de inferență AutoGluon și implementăm modelul:

După ce implementăm punctele finale, interogăm punctul final utilizând același set de testare și calculăm valorile de evaluare. În tabelul următor, putem observa că ansamblul multimodal AutoGluon se îmbunătățește cu aproximativ 3% în ROC AUC în comparație cu transformatorul de propoziție BERT și pădurea aleatoare cu HPO.

| metric | BERT + Random Forest | BERT + Random Forest cu HPO | Ansamblul multimodal AutoGluon |

| Acuratete | 0.77463 | 0.9278 | 0.92625 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 |

Potriviți un model de fuziune multimodal AutoGluon

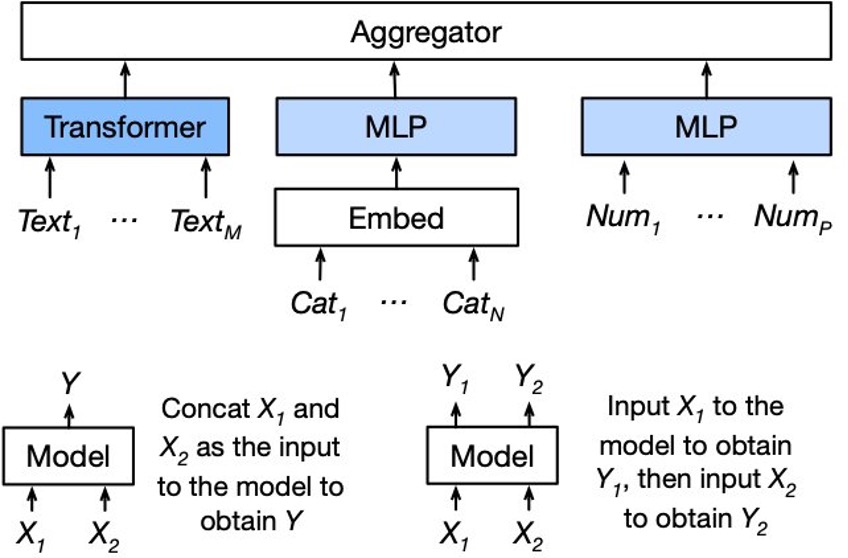

Următoarea diagramă ilustrează arhitectura modelului. Pentru detalii, vezi AutoMM pentru Text + Tabular – Pornire rapidă.

Pe plan intern, folosim diferite rețele pentru a codifica coloanele de text, coloanele categoriale și coloanele numerice. Caracteristicile generate de rețelele individuale sunt agregate de un agregator cu fuziune târzie. Agregatorul poate scoate atât logit-urile, cât și predicțiile de scor.

Aici, folosim coloana vertebrală NLP preantrenată pentru a extrage caracteristicile textului și apoi folosim alte două turnuri pentru a extrage caracteristica din coloana categorială și coloana numerică.

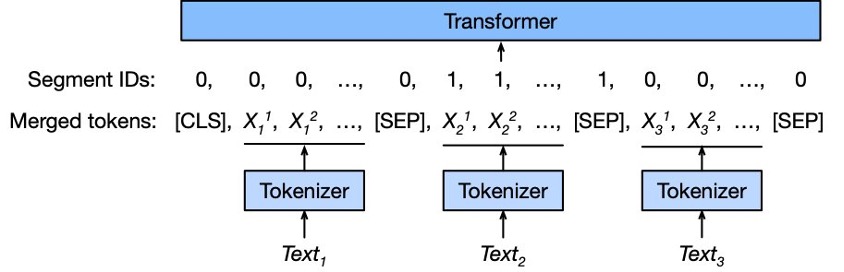

În plus, pentru a trata mai multe câmpuri de text, separăm aceste câmpuri cu simbolul [SEP] și alternăm 0 și 1 ca ID-uri de segment, așa cum se arată în diagrama următoare.

În mod similar, urmează instrucțiunile din secțiunea anterioară pentru a antrena și a implementa modelul de fuziune multimodal AutoGluon:

Următorul tabel rezumă rezultatele evaluării pentru modelul de fuziune multimodal AutoGluon, împreună cu cele a trei modele pe care le-am evaluat în secțiunile anterioare. Putem vedea că ansamblul multimodal AutoGluon și modelele de fuziune multimodală obțin cele mai bune performanțe.

| Metrici | BERT + Random Forest | BERT + Random Forest cu HPO | Ansamblul multimodal AutoGluon | AutoGluon Multimodal Fusion |

| Acuratete | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| ROC AUC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Rețineți că rezultatele și performanța relativă dintre aceste modele depind de setul de date pe care îl utilizați pentru antrenament. Aceste rezultate sunt reprezentative și, chiar dacă tendința anumitor algoritmi de a performa mai bine se bazează pe factori relevanți, echilibrul în performanță s-ar putea schimba având în vedere o distribuție diferită a datelor. Puteți înlocui setul de date exemplu cu propriile date pentru a determina ce model funcționează cel mai bine pentru dvs.

Notebook demonstrativ

Puteți folosi notebook-ul demonstrativ pentru a trimite date exemple către punctele finale model deja implementate. Notebook-ul demonstrativ vă permite rapid să obțineți experiență practică prin interogarea datelor exemplu. După ce lansați soluția Churn Prediction with Text, deschideți blocnotesul demonstrativ alegând Utilizați Endpoint în Notebook.

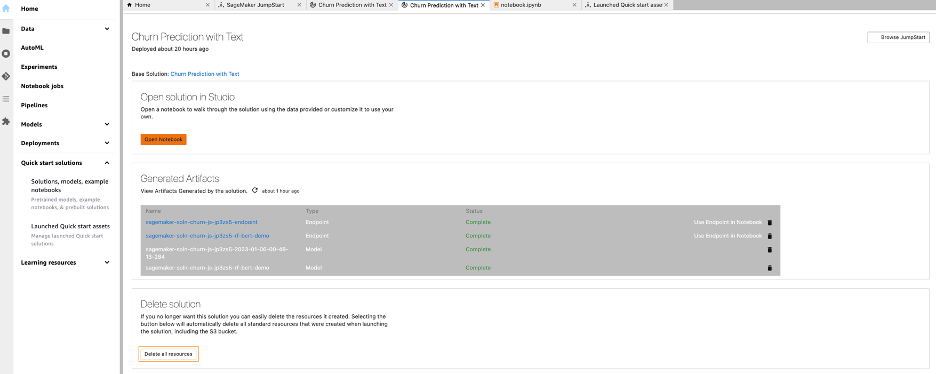

A curăța

Când ați terminat cu această soluție, asigurați-vă că ștergeți toate resursele AWS nedorite, alegând Ștergeți toate resursele.

Rețineți că trebuie să ștergeți manual orice resurse suplimentare pe care le-ați creat în acest blocnotes.

Concluzie

În această postare, am arătat cum puteți utiliza Sagemaker JumpStart pentru a prezice pierderea utilizând multimodalitatea textului și a caracteristicilor tabelare.

Dacă sunteți interesat să aflați mai multe despre modelele de retragere a clienților, consultați următoarele postări:

Despre Autori

Dr. Xin Huang este un om de știință aplicat pentru algoritmii încorporați Amazon SageMaker JumpStart și Amazon SageMaker. El se concentrează pe dezvoltarea de algoritmi scalabili de învățare automată. Interesele sale de cercetare sunt în domeniul procesării limbajului natural, al învățării profunde explicabile pe date tabulare și al analizei robuste a grupării neparametrice spațiu-timp. A publicat multe lucrări în ACL, ICDM, conferințe KDD și Royal Statistical Society: Series A journal.

Dr. Xin Huang este un om de știință aplicat pentru algoritmii încorporați Amazon SageMaker JumpStart și Amazon SageMaker. El se concentrează pe dezvoltarea de algoritmi scalabili de învățare automată. Interesele sale de cercetare sunt în domeniul procesării limbajului natural, al învățării profunde explicabile pe date tabulare și al analizei robuste a grupării neparametrice spațiu-timp. A publicat multe lucrări în ACL, ICDM, conferințe KDD și Royal Statistical Society: Series A journal.

Rajakumar Sampathkumar este manager principal de cont tehnic la AWS, oferind clienților îndrumări cu privire la alinierea tehnologiei de afaceri și sprijinind reinventarea modelelor și proceselor lor de operare în cloud. Este pasionat de cloud și machine learning. Raj este, de asemenea, un specialist în învățarea automată și lucrează cu clienții AWS pentru a proiecta, implementa și gestiona sarcinile de lucru și arhitecturile lor AWS.

Rajakumar Sampathkumar este manager principal de cont tehnic la AWS, oferind clienților îndrumări cu privire la alinierea tehnologiei de afaceri și sprijinind reinventarea modelelor și proceselor lor de operare în cloud. Este pasionat de cloud și machine learning. Raj este, de asemenea, un specialist în învățarea automată și lucrează cu clienții AWS pentru a proiecta, implementa și gestiona sarcinile de lucru și arhitecturile lor AWS.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- Platoblockchain. Web3 Metaverse Intelligence. Cunoștințe amplificate. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- Despre Noi

- Cont

- precizie

- precis

- Obține

- dobândirea

- activ

- plus

- Suplimentar

- adrese

- După

- Agent

- Agregator

- isi propune

- Algoritmul

- algoritmi

- TOATE

- permite

- pe langa

- Cu toate ca

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon SageMaker JumpStart

- analiză

- analiza

- și

- aplicat

- abordare

- arhitectură

- ZONĂ

- artificial

- inteligență artificială

- Bunuri

- Automat

- AutoML

- disponibil

- AWS

- Șira spinării

- Sold

- Bancar

- bazat

- deoarece

- CEL MAI BUN

- Mai bine

- între

- Bootstrap

- construi

- construit-in

- afaceri

- cumpăra

- apel

- apel

- apeluri

- capabil

- captura

- transporta

- caz

- cazuri

- categorii

- sigur

- șansă

- Schimbare

- verifica

- Alege

- alegere

- împrejurări

- clasificare

- mai aproape

- Cloud

- clustering

- cod

- Coloană

- Coloane

- combina

- Comun

- Companii

- Compania

- comparaţie

- comparație

- concurenți

- Completă

- componente

- Calcula

- conferințe

- Consoleze

- Recipient

- contract

- contracte

- Corespunzător

- Cheltuieli

- acoperi

- crea

- a creat

- client

- comportamentul clienților

- Serviciu clienți

- Relații Clienți

- clienţii care

- de date

- afacere

- abuzive

- hotărât

- adânc

- învățare profundă

- Dependent/ă

- depinde de

- implementa

- dislocate

- Amenajări

- detalii

- Determina

- în curs de dezvoltare

- FĂCUT

- diferit

- direct

- distribui

- distribuire

- Docher

- document

- Nu

- Dont

- Descarca

- dinamic

- fiecare

- Eforturile

- oricare

- un capăt la altul

- Punct final

- Inginerie

- evaluat

- evaluare

- Chiar

- exemplu

- exemple

- existent

- experienţă

- a explicat

- explorare

- explora

- explorat

- Explorarea

- extrage

- extrem

- Față

- cu care se confruntă

- factori

- Caracteristică

- DESCRIERE

- camp

- Domenii

- Figura

- În cele din urmă

- Găsi

- descoperiri

- First

- potrivi

- montaj

- Concentra

- se concentrează

- urma

- următor

- pădure

- format

- cadre

- din

- funcţie

- mai mult

- fuziune

- câștigă

- genera

- generată

- obține

- dat

- oferă

- Gluon

- Goluri

- bine

- Crește

- garanta

- manipula

- Manipularea

- hands-on

- ajutor

- util

- Cum

- Cum Pentru a

- HTML

- HTTPS

- Butuc

- Optimizarea hiperparametrului

- Reglarea hiperparametrului

- identifica

- imagine

- import

- important

- îmbunătăţi

- in

- inclus

- Inclusiv

- Crește

- Indicatorii

- individ

- informații

- Infrastructură

- intrare

- perspective

- instala

- instanță

- in schimb

- instrucțiuni

- integrarea

- Inteligență

- interes

- interesat

- interese

- implicat

- probleme de

- IT

- Loc de munca

- Locuri de munca

- jurnal

- JSON

- Cheie

- Copil

- cunoscut

- aterizare

- limbă

- lansa

- straturi

- învăţare

- Părăsi

- Lungime

- Probabil

- LIMITĂ

- Linie

- Lung

- Uite

- maşină

- masina de învățare

- face

- administra

- manager

- manual

- multe

- Meci

- Maximaliza

- maxim

- metric

- Metrici

- ar putea

- minte

- dispărut

- ML

- model

- Modele

- Lună

- luni

- mai mult

- cele mai multe

- multidisciplinar

- multiplu

- nume

- Natural

- Procesarea limbajului natural

- Navigaţi

- Navigare

- în mod necesar

- Nevoie

- reţea

- rețele

- rețele neuronale

- Nou

- următor

- nlp

- caiet

- număr

- obiect

- obiectiv

- oferit

- ONE

- deschide

- operaţie

- optimă

- optimizare

- optimizate

- original

- Altele

- a subliniat

- propriu

- ofertele

- pâine

- lucrări

- Paralel

- parametru

- parte

- special

- pasionat

- Model

- Efectua

- performanță

- spectacole

- efectuează

- telefon

- alege

- Loc

- plan

- Plato

- Informații despre date Platon

- PlatoData

- Post

- postări

- prezice

- prezicere

- Predictii

- Predictor

- Pregăti

- precedent

- în primul rând

- Principal

- Problemă

- proces

- Procesat

- procese

- prelucrare

- proprietate

- furnizează

- furnizarea

- public

- publicat

- scopuri

- Piton

- pirtorh

- Rapid

- repede

- aleator

- gamă

- Crud

- RE

- gata

- regex

- regulat

- înlocui

- reprezentant

- solicita

- necesar

- cercetare

- Resurse

- răspuns

- sensibil

- rezultat

- REZULTATE

- venituri

- robust

- regal

- Alerga

- funcţionare

- sagemaker

- Reglarea automată a modelului SageMaker

- acelaşi

- scalabil

- Om de stiinta

- scikit-learn

- sdk

- Caută

- căutare

- Secțiune

- secțiuni

- segment

- selectate

- selecţie

- propoziție

- serie

- Seria A

- serviciu

- set

- Seturi

- câteva

- să

- Arăta

- indicat

- Emisiuni

- semnalele

- semnificativ

- asemănător

- simplu

- So

- Societate

- soluţie

- soluţii

- REZOLVAREA

- Rezolvarea

- unele

- Sursă

- specialist

- specific

- specific

- împărţi

- Sprint

- stivuite

- stivuire

- Etapă

- standard

- Începe

- început

- de ultimă oră

- statistic

- statistică

- Pas

- paşi

- depozitare

- stoca

- structurat

- studio

- Ulterior

- Reușit

- astfel de

- suficient

- REZUMAT

- a sustine

- De sprijin

- tabel

- Lua

- Ţintă

- tech

- Tehnic

- de telecomunicaţii

- șablon

- şabloane

- termeni

- test

- Zona

- Sursa

- lor

- prin urmare

- trei

- la

- astăzi

- semn

- top

- Total

- tradiţional

- Tren

- dresat

- Pregătire

- transformat

- adevărat

- Tipuri

- tipic

- în

- înţelegere

- nelimitat

- nedorit

- upgrade-ul

- us

- utilizare

- carcasa de utilizare

- Utilizator

- obișnuit

- Utilizand

- VALIDA

- validare

- Valoros

- valoare

- Valori

- varietate

- diverse

- Ve

- Verizon

- versiune

- de

- Ce

- dacă

- care

- OMS

- larg

- Gamă largă

- voi

- fără

- Apartamente

- fabrică

- ar

- Greșit

- X

- Tu

- Ta

- zephyrnet