Lumea inteligenței artificiale (AI) și a învățării automate (ML) a fost martoră la o schimbare de paradigmă odată cu apariția modelelor AI generative care pot crea text, imagini, cod și audio asemănător omului. În comparație cu modelele ML clasice, modelele AI generative sunt semnificativ mai mari și mai complexe. Cu toate acestea, complexitatea lor tot mai mare vine și cu costuri ridicate pentru inferență și o nevoie tot mai mare de resurse de calcul puternice. Costul ridicat al inferenței pentru modelele generative de inteligență artificială poate fi o barieră în calea intrării pentru întreprinderi și cercetători cu resurse limitate, necesitând necesitatea unor soluții mai eficiente și mai rentabile. În plus, majoritatea cazurilor de utilizare a IA generativă implică interacțiune umană sau scenarii din lumea reală, necesitând hardware care poate oferi performanțe cu latență scăzută. AWS a inovat cu cipuri special create pentru a răspunde nevoii tot mai mari de hardware de calcul puternic, eficient și rentabil.

Astăzi, suntem încântați să anunțăm asta Amazon SageMaker sprijină AWS Inferentia2 (ml.inf2) și AWS Trainium Instanțele SageMaker bazate (ml.trn1) pentru a găzdui modele AI generative pentru inferențe în timp real și asincrone. Instanțele ml.inf2 sunt disponibile pentru implementarea modelului pe SageMaker în US East (Ohio) și ml.trn1 în US East (N. Virginia).

Puteți utiliza aceste instanțe pe SageMaker pentru a obține performanțe ridicate la un cost scăzut pentru modelele AI generative, inclusiv modele de limbaj mari (LLM), Stable Diffusion și transformatoare de viziune. În plus, puteți folosi Recomandator de inferențe Amazon SageMaker pentru a vă ajuta să efectuați teste de încărcare și să evaluați beneficiile preț-performanță ale implementării modelului dvs. în aceste cazuri.

Puteți utiliza instanțe ml.inf2 și ml.trn1 pentru a rula aplicațiile ML pe SageMaker pentru rezumarea textului, generarea de coduri, generarea de videoclipuri și imagini, recunoașterea vorbirii, personalizarea, detectarea fraudei și multe altele. Puteți începe cu ușurință prin specificarea instanțelor ml.trn1 sau ml.inf2 atunci când configurați punctul final SageMaker. Puteți utiliza containere AWS Deep Learning (DLC) compatibile cu ml.trn1 și ml.inf2 pentru PyTorch, TensorFlow, Hugging Face și inferența modelului mare (LMI) pentru a începe cu ușurință. Pentru lista completă cu versiuni, vezi Imagini disponibile ale containerelor Deep Learning.

În această postare, arătăm procesul de implementare a unui model de limbaj mare pe AWS Inferentia2 folosind SageMaker, fără a necesita codare suplimentară, profitând de containerul LMI. Noi folosim GPT4ALL-J, un model GPT-J 7B optimizat care oferă o interacțiune în stil chatbot.

Prezentare generală a instanțelor ml.trn1 și ml.inf2

Instanțele ml.trn1 sunt alimentate de acceleratorul Trainium, care este conceput special pentru formarea de înaltă performanță de învățare profundă a modelelor AI generative, inclusiv LLM-uri. Cu toate acestea, aceste instanțe acceptă și sarcini de lucru de inferență pentru modele care sunt chiar mai mari decât ceea ce se potrivește în Inf2. Cea mai mare dimensiune a instanțelor, trn1.32xlarge instances, are 16 Acceleratoare trainium cu 512 GB de memorie accelerator într-o singură instanță, oferind până la 3.4 petaflopi de putere de calcul FP16/BF16. 16 acceleratoare Trainium sunt conectate cu NeuronLinkv2 de ultra-înaltă viteză pentru comunicații colective simplificate.

Instanțele ml.Inf2 sunt alimentate de Acceleratorul AWS Inferentia2, un accelerator special creat pentru inferență. Oferă performanțe de calcul de trei ori mai mari, debit de până la patru ori mai mare și o latență de până la 10 ori mai mică în comparație cu AWS Inferentia de prima generație. Cea mai mare dimensiune a instanței, Inf2.48xlarge, are 12 acceleratoare AWS Inferentia2 cu 384 GB de memorie accelerator într-o singură instanță pentru o putere de calcul combinată de 2.3 petaflopi pentru BF16/FP16. Vă permite să implementați un model de până la 175 de miliarde de parametri într-o singură instanță. Inf2 este singura instanță optimizată pentru inferență care oferă această interconectare, o caracteristică care este disponibilă doar în instanțe de antrenament mai scumpe. Pentru modelele ultra-mari care nu se potrivesc într-un singur accelerator, datele circulă direct între acceleratoare cu NeuronLink, ocolind complet CPU-ul. Cu NeuronLink, Inf2 acceptă o inferență distribuită mai rapidă și îmbunătățește debitul și latența.

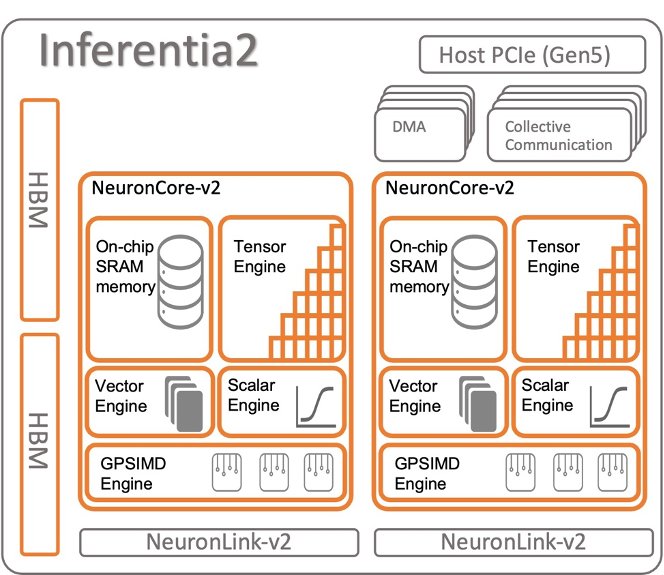

Atât AWS Inferentia2, cât și acceleratoarele Trainium au două NeuronCores-v2, stive de memorie HBM de 32 GB și motoare de calcul colective dedicate, care optimizează automat timpul de rulare prin suprapunerea calculelor și comunicării atunci când fac inferențe cu mai multe acceleratoare. Pentru mai multe detalii despre arhitectură, consultați Dispozitive Trainium și Inferentia.

Următoarea diagramă prezintă un exemplu de arhitectură folosind AWS Inferentia2.

AWS Neuron SDK

AWS Neuron este SDK-ul folosit pentru a rula sarcini de lucru de deep learning pe instanțe bazate pe AWS Inferentia și Trainium. AWS Neuron include un compilator de deep learning, runtime și instrumente care sunt integrate nativ în TensorFlow și PyTorch. Cu Neuron, puteți dezvolta, profila și implementa sarcini de lucru ML de înaltă performanță pe ml.trn1 și ml.inf2.

Compilatorul de neuroni acceptă modele ML în diverse formate (TensorFlow, PyTorch, XLA HLO) și le optimizează pentru a rula pe dispozitivele Neuron. Compilatorul Neuron este invocat în cadrul ML, unde modelele ML sunt trimise compilatorului de către pluginul cadru Neuron. Artefactul compilatorului rezultat se numește fișier NEFF (Format de fișier executabil Neuron) care, la rândul său, este încărcat de runtime Neuron pe dispozitivul Neuron.

Timpul de rulare al neuronului constă din driver de kernel și biblioteci C/C++, care oferă API-uri pentru a accesa dispozitivele AWS Inferentia și Trainium Neuron. Pluginurile de cadre Neuron ML pentru TensorFlow și PyTorch folosesc timpul de rulare Neuron pentru a încărca și a rula modele pe NeuronCores. Timpul de execuție Neuron încarcă modele de învățare profundă (NEFF) compilate pe dispozitivele Neuron și este optimizat pentru un randament ridicat și o latență scăzută.

Găzduiți modele NLP folosind instanțe SageMaker ml.inf2

Înainte de a ne aprofunda în deservirea LLM-urilor cu transformatoare-neuronx, care este o bibliotecă open-source pentru a împărți matricele mari de greutate ale modelului în mai multe NeuronCore, să trecem pe scurt prin fluxul tipic de implementare pentru un model care se poate potrivi pe un singur NeuronCore.

Verifică lista de modele acceptate pentru a vă asigura că modelul este acceptat pe AWS Inferentia2. În continuare, modelul trebuie să fie pre-compilat de Neuron Compiler. Puteți utiliza un caiet SageMaker sau un Cloud Elastic de calcul Amazon (Amazon EC2) pentru a compila modelul. Puteți utiliza SDK-ul SageMaker Python pentru a implementa modele folosind cadre populare de învățare profundă, cum ar fi PyTorch, așa cum se arată în codul următor. Vă puteți implementa modelul în serviciile de găzduire SageMaker și puteți obține un punct final care poate fi utilizat pentru inferență. Aceste puncte finale sunt complet gestionate și acceptă scalarea automată.

A se referi la Fluxuri de dezvoltator pentru mai multe detalii despre fluxurile de dezvoltare tipice ale Inf2 pe SageMaker cu exemple de scripturi.

Găzduiți LLM-uri folosind instanțe SageMaker ml.inf2

Modelele de limbaj mari cu miliarde de parametri sunt adesea prea mari pentru a se potrivi pe un singur accelerator. Acest lucru necesită utilizarea unor tehnici paralele de model pentru găzduirea LLM-urilor pe mai multe acceleratoare. O altă cerință crucială pentru găzduirea LLM-urilor este implementarea unei soluții de înaltă performanță de servire a modelelor. Această soluție ar trebui să încarce eficient modelul, să gestioneze partiționarea și să servească fără probleme cererile prin punctele finale HTTP.

SageMaker include containere specializate de învățare profundă (DLC-uri), biblioteci și instrumente pentru paralelismul modelului și inferența modelului mare. Pentru resurse pentru a începe cu LMI pe SageMaker, consultați Paralelismul modelului și inferența modelului mare. SageMaker menține DLC-uri cu biblioteci open-source populare pentru a găzdui modele mari, cum ar fi GPT, T5, OPT, BLOOM și Stable Diffusion pe infrastructura AWS. Aceste DLC-uri specializate sunt denumite containere SageMaker LMI.

Containere SageMaker LMI utilizați DJLServing, un server model care este integrat cu biblioteca transformers-neuronx pentru a sprijini paralelismul tensorului în NeuronCores. Pentru a afla mai multe despre cum funcționează DJLServing, consultați Implementați modele mari pe Amazon SageMaker folosind DJLServing și inferența paralelă a modelului DeepSpeed. Serverul model DJL și biblioteca transformers-neuronx servesc ca componente de bază ale containerului, care include și SDK-ul Neuron. Această configurare facilitează încărcarea modelelor pe acceleratoarele AWS Inferentia2, paralelizează modelul pe mai multe NeuronCores și permite servirea prin punctele finale HTTP.

Containerul LMI acceptă încărcarea modelelor de la un Serviciul Amazon de stocare simplă găleată (Amazon S3) sau Hugging Face Hub. Scriptul de gestionare implicit încarcă modelul, îl compilează și îl convertește într-un format optimizat pentru Neuron și îl încarcă. Pentru a folosi containerul LMI pentru a găzdui LLM-uri, avem două opțiuni:

- Un fără cod (de preferat) – Acesta este cel mai simplu mod de a implementa un LLM folosind un container LMI. În această metodă, puteți utiliza cele furnizate handler implicit și treceți doar numele modelului și parametrii necesari în

serving.propertiesfișier pentru a încărca și găzdui modelul. Pentru a utiliza handlerul implicit, oferimentryPointparametru cadjl_python.transformers-neuronx. - Adu-ți propriul scenariu – În această abordare, aveți opțiunea de a crea propriul fișier model.py, care conține codul necesar pentru încărcarea și servirea modelului. Acest fișier acționează ca intermediar între

DJLServingAPI-urile șitransformers-neuronxAPI-uri. Pentru a personaliza procesul de încărcare a modelului, puteți furnizaserving.propertiescu parametri configurabili. Pentru o listă cuprinzătoare a parametrilor configurabili disponibili, consultați Toate opțiunile de configurare DJL. Iată un exemplu de a model.py fișier.

Arhitectura runtime

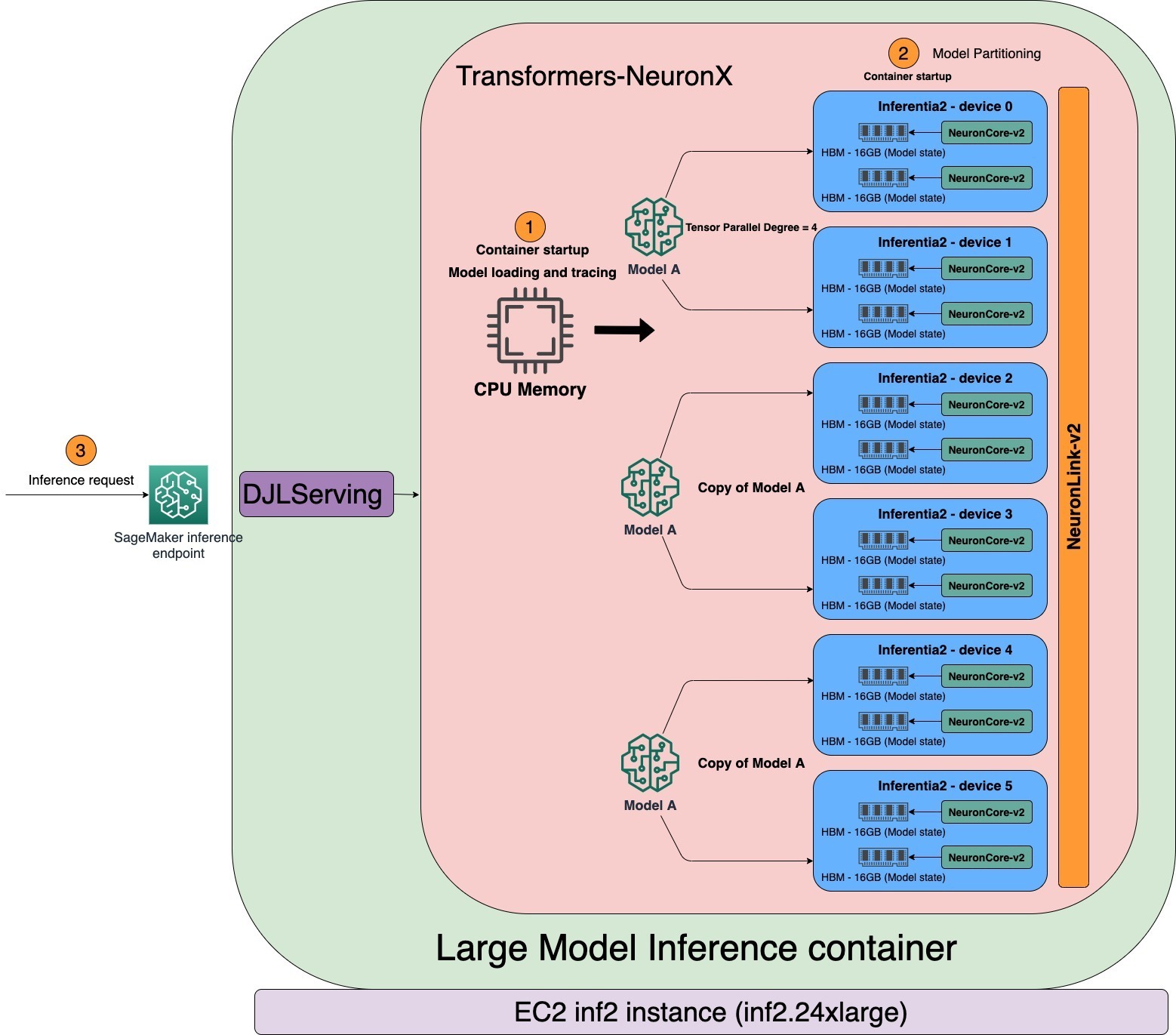

tensor_parallel_degree valoarea proprietății determină distribuția modulelor paralele tensorului în mai multe NeuronCores. De exemplu, inf2.24xlarge are șase acceleratoare AWS Inferentia2. Fiecare accelerator AWS Inferentia2 are două NeuronCoes. Fiecare NeuronCore are o memorie dedicată cu lățime de bandă mare (HBM) de 16 GB care stochează module paralele tensor. Cu un grad tensor paralel de 4, LMI va aloca trei copii model ale aceluiași model, fiecare utilizând patru NeuronCoes. După cum se arată în diagrama următoare, atunci când containerul LMI pornește, modelul va fi încărcat și urmărit mai întâi în memoria adresabilă CPU. Când trasarea este completă, modelul este împărțit în NeuronCores pe baza gradului paralel tensor.

LMI folosește DJLServing ca model de stivă de servire. După ce verificarea de sănătate a containerului trece în SageMaker, containerul este gata să servească cererea de inferență. DJLServing lansează mai multe procese Python echivalente cu TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Fiecare proces Python conține fire de execuție în C++ echivalent cu TENSOR_PARALLEL_DEGREE. Fiecare fir de execuție C++ deține un fragment al modelului pe un NeuronCore.

Mulți practicieni (procesul Python) tind să execute inferențe secvenţial atunci când serverul este invocat cu mai multe solicitări independente. Deși este mai ușor de configurat, de obicei nu este cea mai bună practică să folosești puterea de calcul a acceleratorului. Pentru a rezolva acest lucru, DJLServing oferă optimizările încorporate ale procesului de loturi dinamice pentru a combina aceste solicitări de inferență independente pe partea de server pentru a forma un lot mai mare în mod dinamic pentru a crește debitul. Toate cererile ajung mai întâi la dozatorul dinamic înainte de a intra în cozile de joburi reale pentru a aștepta inferența. Puteți seta dimensiunile de lot preferate pentru loturi dinamice folosind batch_size setări în serving.properties. De asemenea, puteți configura max_batch_delay pentru a specifica timpul maxim de întârziere în lot pentru a aștepta ca alte solicitări să se alăture lotului, pe baza cerințelor dvs. de latență. Debitul depinde și de numărul de copii ale modelului și de grupurile de procese Python lansate în container. După cum se arată în diagrama următoare, cu gradul paralel al tensorului setat la 4, containerul LMI lansează trei grupuri de procese Python, fiecare deținând copia completă a modelului. Acest lucru vă permite să creșteți dimensiunea lotului și să obțineți un randament mai mare.

Notebook SageMaker pentru implementarea LLM-urilor

În această secțiune, oferim o prezentare pas cu pas a implementării GPT4All-J, un model de 6 miliarde de parametri care are 24 GB în FP32. GPT4All-J este un chatbot popular care a fost instruit pe o mare varietate de conținut de interacțiune, cum ar fi probleme de cuvinte, dialoguri, cod, poezii, cântece și povești. GPT4all-J este un model GPT-J reglat fin care generează răspunsuri similare cu interacțiunile umane.

Caietul complet pentru acest exemplu este furnizat pe GitHub. Putem folosi SDK-ul SageMaker Python pentru a implementa modelul într-o instanță Inf2. Folosim cele furnizate handler implicit pentru a încărca modelul. Cu aceasta, trebuie doar să oferim un porţii.proprietăţi fişier. Acest fișier are configurațiile necesare pentru ca serverul de model DJL să descarce și să găzduiască modelul. Putem specifica numele modelului Hugging Face folosind model_id parametru pentru a descărca modelul direct din depozitul Hugging Face. Alternativ, puteți descărca modelul de pe Amazon S3 furnizând s3url parametru. The entryPoint parametrul este configurat pentru a indica biblioteca pentru a încărca modelul. Pentru mai multe detalii despre djl_python.fastertransformer, se referă la Cod GitHub.

tensor_parallel_degree valoarea proprietății determină distribuția modulelor paralele tensorului pe mai multe dispozitive. De exemplu, cu 12 NeuronCores și un grad tensor paralel de 4, LMI va aloca trei copii model, fiecare utilizând patru NeuronCores. De asemenea, puteți defini tipul de precizie folosind proprietatea dtype. n_position parametrul definește suma lungimii maxime a secvenței de intrare și de ieșire pentru model. Vezi următorul cod:

Construiește tarball conținând serving.properties și încărcați-l într-o găleată S3. Deși în acest exemplu este utilizat handlerul implicit, puteți dezvolta un model.py fișier pentru personalizarea procesului de încărcare și de servire. Dacă există pachete care necesită instalare, includeți-le în requirements.txt fişier. Vezi următorul cod:

Preluați imaginea containerului DJL și creați modelul SageMaker:

Apoi, creăm punctul final SageMaker cu configurația modelului definită mai devreme. Containerul descarcă modelul în /tmp spațiu deoarece SageMaker cartografiază /tmp la Magazin Amazon Elastic Block (Amazon EBS). Trebuie să adăugăm un volume_size parametru pentru a asigura /tmp directorul are suficient spațiu pentru a descărca și compila modelul. Noi am stabilit container_startup_health_check_timeout la 3,600 de secunde pentru a se asigura că începe verificarea sănătății după ce modelul este gata. Folosim instanța ml.inf2.8xlarge. Vezi următorul cod:

După ce punctul final SageMaker a fost creat, putem face predicții în timp real împotriva punctelor finale SageMaker folosind Predictor obiect:

A curăța

Ștergeți punctele finale pentru a economisi costuri după ce terminați testele:

Concluzie

În această postare, am prezentat capacitatea recent lansată a SageMaker, care acum acceptă instanțe ml.inf2 și ml.trn1 pentru găzduirea modelelor AI generative. Am demonstrat cum să implementăm GPT4ALL-J, un model AI generativ, pe AWS Inferentia2 folosind SageMaker și containerul LMI, fără a scrie niciun cod. De asemenea, am arătat cum puteți utiliza DJLServing și transformers-neuronx pentru a încărca un model, a-l partiți și a servi.

Instanțele Inf2 oferă cel mai rentabil mod de a rula modele AI generative pe AWS. Pentru detalii despre performanță, consultați Performanță Inf2.

Check out GitHub repo pentru un exemplu de notebook. Încercați-l și spuneți-ne dacă aveți întrebări!

Despre Autori

Vivek Gangasani este arhitect senior de soluții de învățare automată la Amazon Web Services. El lucrează cu Machine Learning Startup-uri pentru a construi și a implementa aplicații AI/ML pe AWS. În prezent, el se concentrează pe furnizarea de soluții pentru MLOps, ML Inference și ML low-code. A lucrat la proiecte în diferite domenii, inclusiv Procesarea limbajului natural și Viziunea pe computer.

Vivek Gangasani este arhitect senior de soluții de învățare automată la Amazon Web Services. El lucrează cu Machine Learning Startup-uri pentru a construi și a implementa aplicații AI/ML pe AWS. În prezent, el se concentrează pe furnizarea de soluții pentru MLOps, ML Inference și ML low-code. A lucrat la proiecte în diferite domenii, inclusiv Procesarea limbajului natural și Viziunea pe computer.

Hiroshi Tokoyo este arhitect de soluții la AWS Annapurna Labs. Cu sediul în Japonia, s-a alăturat Annapurna Labs chiar înainte de achiziționarea de către AWS și a ajutat constant clienții cu tehnologia Annapurna Labs. Accentul său recent este pe soluțiile de învățare automată bazate pe siliciu special creat, AWS Inferentia și Trainium.

Hiroshi Tokoyo este arhitect de soluții la AWS Annapurna Labs. Cu sediul în Japonia, s-a alăturat Annapurna Labs chiar înainte de achiziționarea de către AWS și a ajutat constant clienții cu tehnologia Annapurna Labs. Accentul său recent este pe soluțiile de învățare automată bazate pe siliciu special creat, AWS Inferentia și Trainium.

Dhawal Patel este arhitect principal de învățare automată la AWS. El a lucrat cu organizații, de la întreprinderi mari până la startup-uri mijlocii, pe probleme legate de calculul distribuit și inteligența artificială. El se concentrează pe învățarea profundă, inclusiv pe domeniile NLP și Computer Vision. El îi ajută pe clienți să obțină inferențe de model de înaltă performanță pe SageMaker.

Dhawal Patel este arhitect principal de învățare automată la AWS. El a lucrat cu organizații, de la întreprinderi mari până la startup-uri mijlocii, pe probleme legate de calculul distribuit și inteligența artificială. El se concentrează pe învățarea profundă, inclusiv pe domeniile NLP și Computer Vision. El îi ajută pe clienți să obțină inferențe de model de înaltă performanță pe SageMaker.

Qing Lan este inginer de dezvoltare software în AWS. El a lucrat la mai multe produse provocatoare în Amazon, inclusiv soluții de inferență ML de înaltă performanță și un sistem de înregistrare de înaltă performanță. Echipa Qing a lansat cu succes primul model cu miliard de parametri în Amazon Advertising, cu o latență foarte scăzută necesară. Qing are cunoștințe aprofundate despre optimizarea infrastructurii și accelerarea Deep Learning.

Qing Lan este inginer de dezvoltare software în AWS. El a lucrat la mai multe produse provocatoare în Amazon, inclusiv soluții de inferență ML de înaltă performanță și un sistem de înregistrare de înaltă performanță. Echipa Qing a lansat cu succes primul model cu miliard de parametri în Amazon Advertising, cu o latență foarte scăzută necesară. Qing are cunoștințe aprofundate despre optimizarea infrastructurii și accelerarea Deep Learning.

Qingwei Li este specialist în învățare automată la Amazon Web Services. Și-a primit doctoratul. în Cercetare operațională, după ce a spart contul de grant de cercetare al consilierului său și nu a reușit să dea Premiul Nobel pe care l-a promis. În prezent, ajută clienții din industria serviciilor financiare și a asigurărilor să construiască soluții de învățare automată pe AWS. În timpul liber, îi place să citească și să predea.

Qingwei Li este specialist în învățare automată la Amazon Web Services. Și-a primit doctoratul. în Cercetare operațională, după ce a spart contul de grant de cercetare al consilierului său și nu a reușit să dea Premiul Nobel pe care l-a promis. În prezent, ajută clienții din industria serviciilor financiare și a asigurărilor să construiască soluții de învățare automată pe AWS. În timpul liber, îi place să citească și să predea.

Alan Tan este manager de produs senior, iar SageMaker conduce eforturile pentru inferența modelelor mari. Este pasionat de aplicarea Machine Learning-ului în domeniul Analytics. În afara serviciului, se bucură de aer liber.

Alan Tan este manager de produs senior, iar SageMaker conduce eforturile pentru inferența modelelor mari. Este pasionat de aplicarea Machine Learning-ului în domeniul Analytics. În afara serviciului, se bucură de aer liber.

Varun Syal este inginer de dezvoltare software cu AWS Sagemaker, care lucrează la funcții critice pentru clienți pentru platforma ML Inference. Este pasionat să lucreze în sistemele distribuite și spațiul AI. În timpul liber, îi place să citească și să facă grădinărit.

Varun Syal este inginer de dezvoltare software cu AWS Sagemaker, care lucrează la funcții critice pentru clienți pentru platforma ML Inference. Este pasionat să lucreze în sistemele distribuite și spațiul AI. În timpul liber, îi place să citească și să facă grădinărit.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoAiStream. Web3 Data Intelligence. Cunoștințe amplificate. Accesați Aici.

- Mintând viitorul cu Adryenn Ashley. Accesați Aici.

- Cumpărați și vindeți acțiuni în companii PRE-IPO cu PREIPO®. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :are

- :este

- :nu

- :Unde

- $UP

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- Despre Noi

- accelerator

- acceleratoare

- acceptă

- acces

- Cont

- Obține

- achiziție

- peste

- Acte

- adăuga

- plus

- adresa

- adresabil

- Avantaj

- Promovare

- După

- împotriva

- AI

- ai cazuri de utilizare

- AI / ML

- TOATE

- permite

- de asemenea

- Cu toate ca

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- an

- Google Analytics

- și

- anunța

- O alta

- Orice

- API-uri

- aplicatii

- Aplicarea

- abordare

- arhitectură

- SUNT

- ZONĂ

- artificial

- inteligență artificială

- Inteligența artificială (AI)

- AS

- At

- audio

- Auto

- în mod automat

- disponibil

- AWS

- Inferentia AWS

- bilă

- Lățime de bandă

- barieră

- bazat

- BE

- deoarece

- fost

- înainte

- Beneficiile

- CEL MAI BUN

- între

- Mare

- mai mare

- miliarde

- Bloca

- Blog

- Floare

- scurt

- Rupt

- construi

- construit

- construit-in

- întreprinderi

- by

- C ++

- denumit

- CAN

- cazuri

- provocare

- chatbot

- verifica

- Chips

- cod

- Codificare

- Colectiv

- combina

- combinate

- vine

- Comunicare

- Comunicații

- comparație

- compatibil

- Completă

- complet

- complex

- complexitate

- componente

- cuprinzător

- calcul

- Calcula

- calculator

- Computer Vision

- tehnica de calcul

- Configuraţie

- legat

- Recipient

- Containere

- conține

- conţinut

- Nucleu

- A costat

- cost-eficiente

- Cheltuieli

- crea

- a creat

- critic

- crucial

- În prezent

- client

- clienţii care

- personaliza

- de date

- dedicat

- adânc

- învățare profundă

- Mod implicit

- definit

- defineste

- Grad

- întârziere

- livra

- livrarea

- Oferă

- demonstrat

- depinde de

- implementa

- Implementarea

- desfășurarea

- detalii

- Detectare

- determină

- dezvolta

- Dezvoltare

- dispozitiv

- Dispozitive

- diferit

- difuziune

- direct

- distribuite

- calcul distribuit

- sisteme distribuite

- distribuire

- face

- domenii

- Dont

- Descarca

- download-uri

- şofer

- dinamic

- dinamic

- fiecare

- Mai devreme

- mai ușor

- Cel mai simplu

- cu ușurință

- Est

- eficient

- eficient

- Eforturile

- permite

- capăt

- Punct final

- inginer

- Motoare

- suficient de

- asigura

- intrarea

- Companii

- intrare

- Echivalent

- evalua

- Chiar

- exemplu

- excitat

- scump

- suplimentar

- Față

- facilitează

- cu care se confruntă

- A eșuat

- mai repede

- Caracteristică

- DESCRIERE

- Fișier

- financiar

- asistență financiară

- termina

- First

- potrivi

- debit

- fluxurilor

- Concentra

- concentrat

- se concentrează

- următor

- Pentru

- formă

- format

- patru

- Cadru

- cadre

- fraudă

- detectarea fraudei

- din

- Complet

- complet

- În plus

- generează

- generaţie

- generativ

- AI generativă

- obține

- Go

- acordarea

- Grupului

- În creştere

- Piese metalice

- Avea

- he

- Sănătate

- ajutor

- a ajutat

- ajută

- aici

- Înalt

- performanta ridicata

- superior

- lui

- deținere

- deține

- gazdă

- găzduire

- servicii de gazduire

- casă

- Cum

- Cum Pentru a

- Totuși

- HTML

- http

- HTTPS

- Butuc

- uman

- if

- imagine

- imagini

- implementarea

- import

- in

- în profunzime

- include

- include

- Inclusiv

- Crește

- crescând

- independent

- industrie

- Infrastructură

- inovatoare

- intrare

- intrări

- instalare

- instanță

- asigurare

- integrate

- Inteligență

- interacţiune

- interacţiuni

- intermediar

- în

- invocat

- implica

- IT

- ESTE

- Japonia

- Loc de munca

- alătura

- alăturat

- jpg

- JSON

- doar

- Cunoaște

- cunoştinţe

- Labs

- limbă

- mare

- Întreprinderi mari

- mai mare

- cea mai mare

- Latență

- a lansat

- lansează

- conducere

- AFLAȚI

- învăţare

- Lungime

- lăsa

- biblioteci

- Bibliotecă

- ca

- îi place

- Limitat

- Listă

- LLM

- încărca

- încărcare

- loturile

- logare

- Jos

- LOWER

- cel mai mic

- maşină

- masina de învățare

- mai ales

- susține

- Majoritate

- face

- administra

- gestionate

- manager

- Harta

- max

- maxim

- Memorie

- metodă

- ML

- MLOps

- model

- Modele

- Module

- mai mult

- mai eficient

- cele mai multe

- multiplu

- nume

- Natural

- Procesarea limbajului natural

- necesar

- Nevoie

- nevoilor

- Nou

- New York

- următor

- nlp

- Premiul Nobel

- caiet

- acum

- număr

- obiect

- of

- oferi

- promoții

- de multe ori

- Ohio

- on

- ONE

- afară

- open-source

- Operațiuni

- optimizare

- Optimizați

- optimizate

- Optimizează

- Opțiune

- Opţiuni

- or

- organizații

- Altele

- al nostru

- afară

- în aer liber

- producție

- exterior

- propriu

- ofertele

- paradigmă

- Paralel

- parametru

- parametrii

- trece

- trece

- pasionat

- performanță

- personalizare

- platformă

- Plato

- Informații despre date Platon

- PlatoData

- conecteaza

- Plugin-uri

- Punct

- Popular

- Post

- putere

- alimentat

- puternic

- practică

- Precizie

- Predictii

- Predictor

- preferat

- Principal

- premiu

- probleme

- proces

- procese

- prelucrare

- Produs

- manager de produs

- Produse

- Profil

- Proiecte

- a promis

- proprietăţi

- proprietate

- furniza

- prevăzut

- furnizează

- furnizarea

- scop

- Piton

- pirtorh

- variind

- ajunge

- Citind

- gata

- lumea reală

- în timp real

- primit

- recent

- recunoaştere

- menționat

- legate de

- solicita

- cereri de

- necesar

- cerință

- Cerinţe

- cercetare

- cercetători

- Resurse

- răspunsuri

- rezultând

- Ridica

- Alerga

- sagemaker

- SageMaker Inference

- acelaşi

- Economisiți

- scalare

- scenarii

- script-uri

- sdk

- perfect

- secunde

- Secțiune

- vedea

- senior

- Secvenţă

- servi

- serviciu

- Servicii

- servire

- set

- setări

- configurarea

- câteva

- schimbare

- să

- Arăta

- a prezentat

- indicat

- Emisiuni

- parte

- semnificativ

- Siliciu

- asemănător

- simplu

- singur

- SIX

- Mărimea

- dimensiuni

- So

- Software

- de dezvoltare de software

- soluţie

- soluţii

- Spaţiu

- specialist

- de specialitate

- discurs

- Recunoaștere a vorbirii

- stabil

- stivui

- Stive

- Începe

- început

- începe

- Startup-urile

- depozitare

- Istorii

- stocarea

- raționalizate

- stil

- Reușit

- astfel de

- a sustine

- Suportat

- Sprijină

- sistem

- sisteme

- luare

- Predarea

- echipă

- tehnici de

- Tehnologia

- tensorflow

- teste

- decât

- acea

- Zona

- lor

- Lor

- Acolo.

- Acestea

- acest

- trei

- Prin

- debit

- timp

- ori

- la

- de asemenea

- Unelte

- calc

- dresat

- Pregătire

- transformatoare

- ÎNTORCĂ

- Două

- tip

- tipic

- încărcat

- us

- utilizare

- utilizat

- folosind

- obișnuit

- folosi

- Utilizand

- valoare

- varietate

- diverse

- Fixă

- foarte

- de

- Video

- Virginia

- viziune

- aștepta

- walkthrough

- Cale..

- we

- web

- servicii web

- greutate

- Ce

- cand

- care

- voi

- cu

- în

- fără

- martori

- Cuvânt

- Apartamente

- a lucrat

- de lucru

- fabrică

- lume

- scrie

- scris

- York

- Tu

- Ta

- zephyrnet