Amazon SageMaker puncte finale multimodel (MME) sunt o capacitate complet gestionată a inferenței SageMaker care vă permite să implementați mii de modele pe un singur punct final. Anterior, MME-urile alocau în mod predeterminat puterea de calcul a procesorului modelelor în mod static, indiferent de încărcarea de trafic a modelului, folosind Server cu mai multe modele (MMS) ca server model al acestuia. În această postare, discutăm despre o soluție în care un MME poate ajusta dinamic puterea de calcul atribuită fiecărui model pe baza modelului de trafic al modelului. Această soluție vă permite să utilizați calculul de bază al MME-urilor mai eficient și să economisiți costuri.

MME-urile încarcă și descarcă dinamic modelele pe baza traficului de intrare către punctul final. Când se utilizează MMS ca server model, MME-urile alocă un număr fix de lucrători model pentru fiecare model. Pentru mai multe informații, consultați Modele de găzduire în Amazon SageMaker, Partea 3: Rulați și optimizați inferența cu mai multe modele cu punctele finale cu mai multe modele Amazon SageMaker.

Cu toate acestea, acest lucru poate duce la câteva probleme atunci când modelul dvs. de trafic este variabil. Să presupunem că aveți un model singular sau puține care primesc un volum mare de trafic. Puteți configura MMS pentru a aloca un număr mare de lucrători pentru aceste modele, dar acest lucru este atribuit tuturor modelelor din spatele MME deoarece este o configurație statică. Acest lucru duce la un număr mare de lucrători care utilizează calcularea hardware - chiar și modelele inactive. Problema opusă se poate întâmpla dacă setați o valoare mică pentru numărul de lucrători. Modelele populare nu vor avea suficienți lucrători la nivel de server de model pentru a aloca în mod corespunzător suficient hardware în spatele punctului final pentru aceste modele. Problema principală este că este dificil să rămâi agnostic tiparului de trafic dacă nu-ți poți scala în mod dinamic lucrătorii la nivel de server model pentru a aloca cantitatea necesară de calcul.

Soluția pe care o discutăm în această postare o folosește DJLServing ca server de model, care poate ajuta la atenuarea unora dintre problemele discutate și poate permite scalarea pe model și permite MME-urilor să fie agnostice de tipare de trafic.

Arhitectura MME

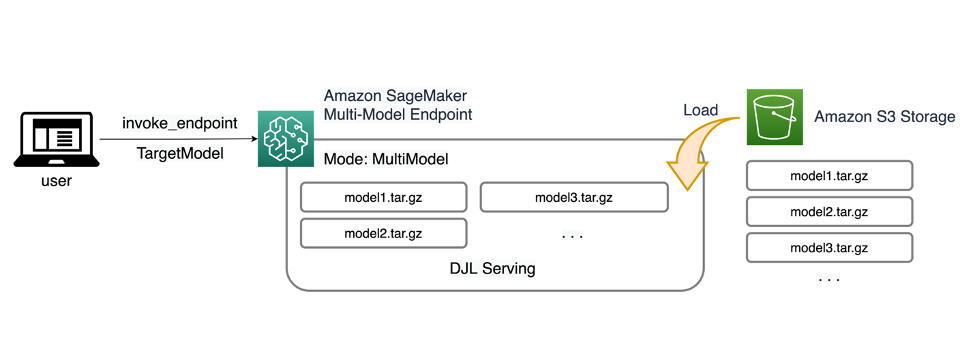

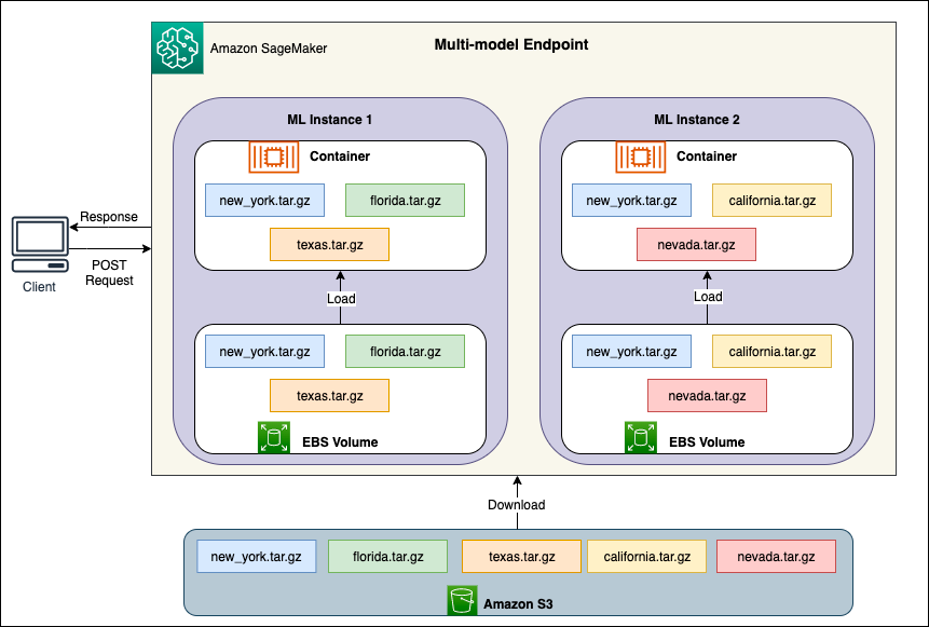

SageMaker MME vă permit să implementați mai multe modele în spatele unui singur punct final de inferență care poate conține una sau mai multe instanțe. Fiecare instanță este proiectată să încarce și să servească mai multe modele până la capacitatea memoriei și CPU/GPU. Cu această arhitectură, o afacere software ca serviciu (SaaS) poate reduce costul în creștere liniar al găzduirii mai multor modele și poate realiza reutilizarea infrastructurii în concordanță cu modelul multi-tenancy aplicat în altă parte a stivei de aplicații. Următoarea diagramă ilustrează această arhitectură.

Un SageMaker MME încarcă dinamic modele din Serviciul Amazon de stocare simplă (Amazon S3) atunci când este invocat, în loc să descărcați toate modelele atunci când punctul final este creat pentru prima dată. Ca rezultat, o invocare inițială la un model ar putea vedea o latență de inferență mai mare decât inferențe ulterioare, care sunt finalizate cu o latență scăzută. Dacă modelul este deja încărcat pe container atunci când este invocat, atunci pasul de descărcare este omis și modelul returnează inferențe cu latență scăzută. De exemplu, să presupunem că aveți un model care este folosit doar de câteva ori pe zi. Se încarcă automat la cerere, în timp ce modelele accesate frecvent sunt păstrate în memorie și invocate cu o latență constantă scăzută.

În spatele fiecărui MME se află modele de găzduire, așa cum este prezentat în diagrama următoare. Aceste instanțe încarcă și evacuează mai multe modele în și din memorie pe baza tiparelor de trafic către modele.

SageMaker continuă să direcționeze cererile de inferență pentru un model către instanța în care modelul este deja încărcat, astfel încât cererile să fie servite dintr-o copie a modelului stocată în cache (consultați următoarea diagramă, care arată calea cererii pentru prima cerere de predicție față de predicția stocată în cache). calea cererii). Cu toate acestea, dacă modelul primește multe solicitări de invocare și există instanțe suplimentare pentru MME, SageMaker direcționează unele solicitări către o altă instanță pentru a se adapta la creștere. Pentru a profita de scalarea automată a modelului în SageMaker, asigurați-vă că aveți Configurarea scalării automate a instanței pentru a furniza capacitate suplimentară de instanță. Configurați-vă politica de scalare la nivel de punct final fie cu parametri personalizați, fie cu invocări pe minut (recomandat) pentru a adăuga mai multe instanțe la flota de puncte finale.

Prezentare generală a serverului model

Un server de model este o componentă software care oferă un mediu de rulare pentru implementarea și servirea modelelor de învățare automată (ML). Acționează ca o interfață între modelele antrenate și aplicațiile client care doresc să facă predicții folosind acele modele.

Scopul principal al unui server de model este de a permite integrarea fără efort și implementarea eficientă a modelelor ML în sistemele de producție. În loc să încorporeze modelul direct într-o aplicație sau într-un cadru specific, serverul de model oferă o platformă centralizată unde mai multe modele pot fi implementate, gestionate și servite.

Serverele model oferă de obicei următoarele funcționalități:

- Încărcarea modelului – Serverul încarcă modelele ML antrenate în memorie, făcându-le pregătite pentru difuzarea predicțiilor.

- Inference API – Serverul expune un API care permite aplicațiilor client să trimită date de intrare și să primească predicții de la modelele implementate.

- Scalarea – Serverele model sunt proiectate pentru a gestiona cereri concurente de la mai mulți clienți. Ele oferă mecanisme pentru procesarea paralelă și gestionarea eficientă a resurselor pentru a asigura un randament ridicat și o latență scăzută.

- Integrare cu motoarele backend – Serverele model au integrări cu cadre backend precum DeepSpeed și FasterTransformer pentru a partiționa modelele mari și a rula inferențe foarte optimizate.

Arhitectura DJL

Servire DJL este un server de model universal, open source, de înaltă performanță. DJL Serving este construit pe deasupra DJL, o bibliotecă de deep learning scrisă în limbajul de programare Java. Poate fi nevoie de un model de învățare profundă, mai multe modele sau fluxuri de lucru și să le facă disponibile printr-un punct final HTTP. DJL Serving acceptă implementarea modelelor din mai multe cadre precum PyTorch, TensorFlow, Apache MXNet, ONNX, TensorRT, Hugging Face Transformers, DeepSpeed, FasterTransformer și multe altele.

DJL Serving oferă multe caracteristici care vă permit să vă implementați modelele cu performanță ridicată:

- Usor de folosit – DJL Serving poate servi majoritatea modelelor din cutie. Doar aduceți artefactele modelului, iar DJL Serving le poate găzdui.

- Suport pentru mai multe dispozitive și acceleratoare – DJL Serving acceptă implementarea modelelor pe CPU, GPU și Inferentia AWS.

- Performanţă – DJL Serving rulează inferențe cu mai multe fire într-un singur JVM pentru a crește debitul.

- Loturi dinamice – DJL Serving acceptă loturi dinamice pentru a crește debitul.

- Scalare automată – DJL Serving va scala automat lucrătorii în sus și în jos, în funcție de volumul de trafic.

- Suport multimotor – DJL Serving poate găzdui simultan modele folosind cadre diferite (cum ar fi PyTorch și TensorFlow).

- Modele de ansamblu și flux de lucru – DJL Serving acceptă implementarea fluxurilor de lucru complexe compuse din mai multe modele și rulează părți ale fluxului de lucru pe CPU și părți pe GPU. Modelele dintr-un flux de lucru pot folosi cadre diferite.

În special, caracteristica de scalare automată a DJL Serving face simplu să se asigure că modelele sunt scalate corespunzător pentru traficul de intrare. În mod implicit, DJL Serving determină numărul maxim de lucrători pentru un model care poate fi suportat pe baza hardware-ului disponibil (nuclee CPU, dispozitive GPU). Puteți seta limite inferioare și superioare pentru fiecare model pentru a vă asigura că un nivel minim de trafic poate fi întotdeauna servit și că un singur model nu consumă toate resursele disponibile.

DJL Serving utilizează a Netty frontend deasupra pool-urilor de fire de lucru ale lucrătorului backend. Frontend-ul folosește o singură configurare Netty cu mai multe HttpRequestHandlers. Diferiți operatori de solicitare vor oferi suport pentru Inference API, API de management, sau alte API-uri disponibile de la diferite plugin-uri.

Backend-ul se bazează pe WorkLoadManager (WLM). WLM are grijă de mai multe fire de lucru pentru fiecare model, împreună cu loturile și rutarea cererilor către acestea. Când sunt difuzate mai multe modele, WLM verifică mai întâi dimensiunea cozii de cereri de inferență a fiecărui model. Dacă dimensiunea cozii este mai mare de două ori dimensiunea lotului unui model, WLM crește numărul de lucrători alocați modelului respectiv.

Prezentare generală a soluțiilor

Implementarea DJL cu un MME diferă de configurația MMS implicită. Pentru DJL Serving cu un MME, comprimăm următoarele fișiere în formatul model.tar.gz pe care SageMaker Inference îl așteaptă:

- model.job – Pentru această implementare, împingem direct metadatele modelului în tarball. În acest caz, lucrăm cu un

.joblibfișier, așa că oferim acel fișier în tarball-ul nostru pentru ca scriptul nostru de inferență să fie citit. Dacă artefactul este prea mare, îl puteți împinge și către Amazon S3 și îl puteți indica în configurația de servire pe care o definiți pentru DJL. - deservire.proprietăţi – Aici puteți configura orice model legat de server variabile de mediu. Puterea DJL aici este că o puteți configura

minWorkersșimaxWorkerspentru fiecare tarball model. Acest lucru permite fiecărui model să crească și să scadă la nivel de server de model. De exemplu, dacă un model singular primește cea mai mare parte a traficului pentru un MME, serverul de model va scala lucrătorii în mod dinamic. În acest exemplu, nu configurăm aceste variabile și lăsăm DJL să determine numărul necesar de lucrători în funcție de modelul nostru de trafic. - model.py – Acesta este scriptul de inferență pentru orice preprocesare personalizată sau postprocesare pe care doriți să o implementați. Model.py se așteaptă ca logica dvs. să fie încapsulată într-o metodă de handle în mod implicit.

- requirements.txt (opțional) – În mod implicit, DJL vine instalat cu PyTorch, dar orice dependențe suplimentare de care aveți nevoie pot fi introduse aici.

Pentru acest exemplu, prezentăm puterea DJL cu un MME, luând un exemplu de model SKLearn. Efectuăm o lucrare de instruire cu acest model și apoi creăm 1,000 de copii ale acestui artefact model pentru a susține MME-ul nostru. Apoi vă prezentăm modul în care DJL se poate scala dinamic pentru a gestiona orice tip de tip de trafic pe care MME-ul dvs. îl poate primi. Aceasta poate include o distribuție uniformă a traficului pe toate modelele sau chiar pe câteva modele populare care primesc cea mai mare parte a traficului. Puteți găsi tot codul în cele ce urmează GitHub repo.

Cerințe preliminare

Pentru acest exemplu, folosim o instanță de notebook SageMaker cu un nucleu conda_python3 și ml.c5.xlarge. Pentru a efectua testele de sarcină, puteți utiliza un Cloud Elastic de calcul Amazon (Amazon EC2) sau o instanță de notebook SageMaker mai mare. În acest exemplu, scalam la peste o mie de tranzacții pe secundă (TPS), așa că vă sugerăm să testați pe o instanță EC2 mai grea, cum ar fi ml.c5.18xlarge, astfel încât să aveți mai multe calcule cu care să lucrați.

Creați un artefact model

Mai întâi trebuie să creăm artefactul model și datele pe care le folosim în acest exemplu. Pentru acest caz, generăm câteva date artificiale cu NumPy și antrenăm folosind un model de regresie liniară SKLearn cu următorul fragment de cod:

După ce rulați codul precedent, ar trebui să aveți un model.joblib fișier creat în mediul dvs. local.

Trageți imaginea DJL Docker

Imaginea Docker djl-inference:0.23.0-cpu-full-v1.0 este containerul nostru de servire DJL folosit în acest exemplu. Puteți ajusta următoarea adresă URL în funcție de regiunea dvs.:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

Opțional, puteți utiliza și această imagine ca imagine de bază și o puteți extinde pentru a vă construi propria imagine Docker Registrul Amazon de containere elastice (Amazon ECR) cu orice alte dependențe de care aveți nevoie.

Creați fișierul model

Mai întâi, creăm un fișier numit serving.properties. Acest lucru indică DJLServing să folosească motorul Python. De asemenea, definim max_idle_time a unui muncitor să fie de 600 de secunde. Acest lucru ne asigură că durăm mai mult pentru a reduce numărul de lucrători pe care îi avem pe model. Nu ne adaptăm minWorkers și maxWorkers pe care îl putem defini și lăsăm DJL să calculeze în mod dinamic numărul de lucrători necesar în funcție de traficul pe care îl primește fiecare model. Proprietățile de servire sunt prezentate după cum urmează. Pentru a vedea lista completă a opțiunilor de configurare, consultați Configurația motorului.

Apoi, creăm fișierul nostru model.py, care definește încărcarea modelului și logica de inferență. Pentru MME, fiecare fișier model.py este specific unui model. Modelele sunt stocate în propriile căi în magazinul de modele (de obicei /opt/ml/model/). La încărcarea modelelor, acestea vor fi încărcate sub calea magazinului de modele în propriul director. Exemplul complet model.py din această demonstrație poate fi văzut în GitHub repo.

Creăm un model.tar.gz fișier care include modelul nostru (model.joblib), model.py, și serving.properties:

În scopuri demonstrative, realizăm 1,000 de copii ale acestuia model.tar.gz fișier pentru a reprezenta numărul mare de modele care urmează să fie găzduite. În producție, trebuie să creați un model.tar.gz fișier pentru fiecare dintre modelele dvs.

În cele din urmă, încărcăm aceste modele pe Amazon S3.

Creați un model SageMaker

Acum creăm un Modelul SageMaker. Folosim imaginea ECR definită mai devreme și artefactul model de la pasul anterior pentru a crea modelul SageMaker. În configurarea modelului, configurăm Modul ca MultiModel. Acest lucru îi spune DJLServing că creăm un MME.

Creați un punct final SageMaker

În această demonstrație, folosim instanțe de 20 ml.c5d.18xlarge pentru a scala la un TPS în intervalul de mii. Asigurați-vă că obțineți o creștere a limitei pentru tipul de instanță, dacă este necesar, pentru a atinge TPS-ul pe care îl vizați.

Testare de sarcină

La momentul scrierii, instrumentul intern de testare a sarcinii SageMaker Recomandator de inferențe Amazon SageMaker nu acceptă în mod nativ testarea pentru MME. Prin urmare, folosim instrumentul open source Python roșcov. Locust este ușor de configurat și poate urmări valori precum TPS și latența end-to-end. Pentru o înțelegere completă a modului de configurare cu SageMaker, consultați Cele mai bune practici pentru testarea încărcării punctelor finale de inferență în timp real Amazon SageMaker.

În acest caz de utilizare, avem trei modele de trafic diferite pe care dorim să le simulăm cu MME-uri, așa că avem următoarele trei scripturi Python care se aliniază cu fiecare model. Scopul nostru aici este să dovedim că, indiferent de tiparul nostru de trafic, putem atinge același TPS țintă și putem scala în mod corespunzător.

Putem specifica o pondere în scriptul Locust pentru a atribui traficul în diferite părți ale modelelor noastre. De exemplu, cu modelul nostru unic fierbinte, implementăm două metode, după cum urmează:

Putem apoi atribui o anumită pondere fiecărei metode, adică atunci când o anumită metodă primește un anumit procent din trafic:

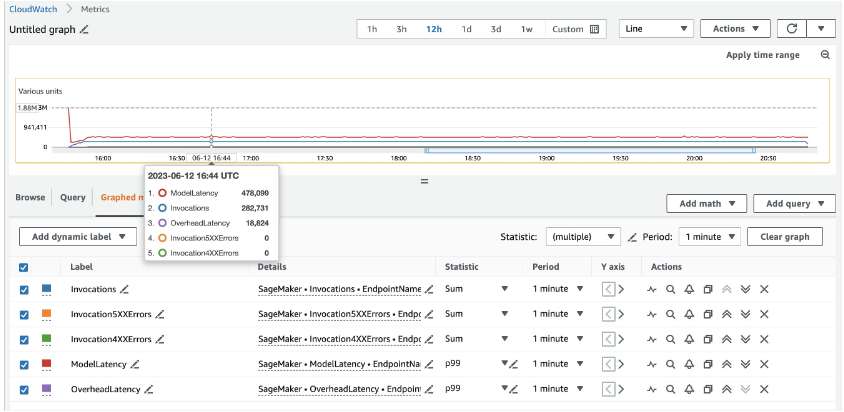

Pentru cazurile de 20 ml.c5d.18xlarge, vedem următoarele valori de invocare pe Amazon CloudWatch consolă. Aceste valori rămân destul de consistente în toate cele trei modele de trafic. Pentru a înțelege mai bine valorile CloudWatch pentru inferența în timp real SageMaker și MME, consultați SageMaker Endpoint Invocation Metrics.

Puteți găsi restul scripturilor Locust în directorul locust-utils în depozitul GitHub.

Rezumat

În această postare, am discutat despre modul în care un MME poate ajusta dinamic puterea de calcul atribuită fiecărui model pe baza modelului de trafic al modelului. Această funcție recent lansată este disponibilă în toate regiunile AWS în care este disponibil SageMaker. Rețineți că, la momentul anunțului, sunt acceptate doar instanțele CPU. Pentru a afla mai multe, consultați Algoritmi, cadre și instanțe acceptate.

Despre Autori

Ram Vegiraju este arhitect ML cu echipa SageMaker Service. El se concentrează pe a ajuta clienții să-și construiască și să-și optimizeze soluțiile AI/ML pe Amazon SageMaker. În timpul liber, îi place să călătorească și să scrie.

Ram Vegiraju este arhitect ML cu echipa SageMaker Service. El se concentrează pe a ajuta clienții să-și construiască și să-și optimizeze soluțiile AI/ML pe Amazon SageMaker. În timpul liber, îi place să călătorească și să scrie.

Qingwei Li este specialist în învățare automată la Amazon Web Services. Și-a primit doctoratul. în Cercetare operațională, după ce a spart contul de grant de cercetare al consilierului său și nu a reușit să dea Premiul Nobel pe care l-a promis. În prezent, ajută clienții din industria serviciilor financiare și a asigurărilor să construiască soluții de învățare automată pe AWS. În timpul liber, îi place să citească și să predea.

Qingwei Li este specialist în învățare automată la Amazon Web Services. Și-a primit doctoratul. în Cercetare operațională, după ce a spart contul de grant de cercetare al consilierului său și nu a reușit să dea Premiul Nobel pe care l-a promis. În prezent, ajută clienții din industria serviciilor financiare și a asigurărilor să construiască soluții de învățare automată pe AWS. În timpul liber, îi place să citească și să predea.

James Wu este arhitect senior de soluții de specialitate AI/ML la AWS. ajutând clienții să proiecteze și să construiască soluții AI/ML. Munca lui James acoperă o gamă largă de cazuri de utilizare ML, cu un interes principal în viziunea computerizată, învățarea profundă și scalarea ML în întreaga întreprindere. Înainte de a se alătura AWS, James a fost arhitect, dezvoltator și lider tehnologic timp de peste 10 ani, inclusiv 6 ani în inginerie și 4 ani în industriile de marketing și publicitate.

James Wu este arhitect senior de soluții de specialitate AI/ML la AWS. ajutând clienții să proiecteze și să construiască soluții AI/ML. Munca lui James acoperă o gamă largă de cazuri de utilizare ML, cu un interes principal în viziunea computerizată, învățarea profundă și scalarea ML în întreaga întreprindere. Înainte de a se alătura AWS, James a fost arhitect, dezvoltator și lider tehnologic timp de peste 10 ani, inclusiv 6 ani în inginerie și 4 ani în industriile de marketing și publicitate.

Saurabh Trikande este Senior Product Manager pentru Amazon SageMaker Inference. Este pasionat de lucrul cu clienții și este motivat de obiectivul democratizării învățării automate. El se concentrează pe provocările de bază legate de implementarea de aplicații ML complexe, modele ML multi-locatari, optimizări ale costurilor și de a face implementarea modelelor de învățare profundă mai accesibilă. În timpul liber, lui Saurabh îi place să facă drumeții, să învețe despre tehnologii inovatoare, să urmeze TechCrunch și să petreacă timpul cu familia sa.

Saurabh Trikande este Senior Product Manager pentru Amazon SageMaker Inference. Este pasionat de lucrul cu clienții și este motivat de obiectivul democratizării învățării automate. El se concentrează pe provocările de bază legate de implementarea de aplicații ML complexe, modele ML multi-locatari, optimizări ale costurilor și de a face implementarea modelelor de învățare profundă mai accesibilă. În timpul liber, lui Saurabh îi place să facă drumeții, să învețe despre tehnologii inovatoare, să urmeze TechCrunch și să petreacă timpul cu familia sa.

Xu Deng este manager de inginer software cu echipa SageMaker. El se concentrează pe a ajuta clienții să-și construiască și să-și optimizeze experiența de inferență AI/ML pe Amazon SageMaker. În timpul liber, îi place să călătorească și să facă snowboard.

Xu Deng este manager de inginer software cu echipa SageMaker. El se concentrează pe a ajuta clienții să-și construiască și să-și optimizeze experiența de inferență AI/ML pe Amazon SageMaker. În timpul liber, îi place să călătorească și să facă snowboard.

Siddharth Venkatesan este inginer software în AWS Deep Learning. În prezent, se concentrează pe construirea de soluții pentru inferența modelelor mari. Înainte de AWS, a lucrat în organizația Amazon Grocery, creând noi funcții de plată pentru clienții din întreaga lume. În afara serviciului, îi place să schieze, în aer liber și să urmărească sporturi.

Siddharth Venkatesan este inginer software în AWS Deep Learning. În prezent, se concentrează pe construirea de soluții pentru inferența modelelor mari. Înainte de AWS, a lucrat în organizația Amazon Grocery, creând noi funcții de plată pentru clienții din întreaga lume. În afara serviciului, îi place să schieze, în aer liber și să urmărească sporturi.

Rohith Nallamaddi este inginer de dezvoltare software la AWS. El lucrează la optimizarea sarcinilor de lucru de învățare profundă pe GPU-uri, construind inferențe ML de înaltă performanță și oferind soluții. Înainte de aceasta, a lucrat la construirea de microservicii bazate pe AWS pentru afacerile Amazon F3. În afara serviciului, îi place să joace și să urmărească sporturi.

Rohith Nallamaddi este inginer de dezvoltare software la AWS. El lucrează la optimizarea sarcinilor de lucru de învățare profundă pe GPU-uri, construind inferențe ML de înaltă performanță și oferind soluții. Înainte de aceasta, a lucrat la construirea de microservicii bazate pe AWS pentru afacerile Amazon F3. În afara serviciului, îi place să joace și să urmărească sporturi.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :este

- :Unde

- $UP

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- Despre Noi

- accelerator

- accesate

- accesibil

- găzdui

- Cont

- Obține

- peste

- Acte

- adăuga

- Suplimentar

- Avantaj

- Promovare

- După

- AI / ML

- algoritmi

- alinia

- TOATE

- aloca

- alocate

- permite

- permite

- de-a lungul

- deja

- de asemenea

- mereu

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- sumă

- an

- și

- Anunț

- O alta

- Orice

- Apache

- api

- API-uri

- aplicație

- aplicatii

- aplicat

- în mod corespunzător

- arhitectură

- SUNT

- în jurul

- artificial

- AS

- alocate

- asuma

- At

- Auto

- Automata

- în mod automat

- disponibil

- AWS

- înapoi

- Backend

- de bază

- bazat

- dozare

- BE

- deoarece

- în spatele

- Mai bine

- între

- corp

- a stimula

- limite

- Cutie

- Pauză

- aduce

- Rupt

- construi

- Clădire

- construit

- afaceri

- dar

- by

- denumit

- CAN

- capacitate

- Capacitate

- pasă

- caz

- cazuri

- celulă

- centralizat

- sigur

- provocări

- Verificări

- clasă

- client

- clientii

- cod

- vine

- Completă

- Terminat

- complex

- component

- Compus

- Calcula

- calculator

- Computer Vision

- tehnica de calcul

- puterea de calcul

- concurent

- Configuraţie

- consistent

- consecvent

- Consoleze

- consuma

- conţine

- Recipient

- context

- continuă

- Nucleu

- A costat

- Cheltuieli

- Covers

- crea

- a creat

- Crearea

- În prezent

- personalizat

- clienţii care

- de date

- zi

- adânc

- învățare profundă

- Mod implicit

- defini

- definit

- defineste

- livra

- Cerere

- Demo

- democratizarea

- dependențe

- În funcție

- descris

- implementa

- dislocate

- Implementarea

- desfășurarea

- Amenajări

- proiectat

- Determina

- determină

- Dezvoltator

- Dezvoltare

- dispozitiv

- Dispozitive

- diagramă

- diferit

- dificil

- direct

- director

- discuta

- discutat

- distribuire

- Docher

- Nu

- Dont

- jos

- Descarca

- descărcarea

- dinamic

- dinamic

- fiecare

- Mai devreme

- eficient

- eficient

- fără efort

- oricare

- în altă parte

- Încorporarea

- permite

- permite

- încapsulată

- un capăt la altul

- Punct final

- Motor

- inginer

- Inginerie

- suficient de

- asigura

- Afacere

- Mediu inconjurator

- eroare

- Chiar

- exemplu

- excepție

- aşteaptă

- se așteaptă

- experienţă

- extinde

- Față

- A eșuat

- destul de

- familie

- Caracteristică

- DESCRIERE

- puțini

- Fișier

- Fişiere

- financiar

- asistență financiară

- Găsi

- First

- fixată

- FLOTA

- se concentrează

- următor

- urmează

- Pentru

- format

- Cadru

- cadre

- frecvent

- din

- Frontend

- Complet

- complet

- funcționalități

- genera

- obține

- devine

- GitHub

- scop

- GPU

- unități de procesare grafică

- acordarea

- mai mare

- manipula

- întâmpla

- Piese metalice

- Avea

- he

- ajutor

- ajutor

- ajută

- aici

- Înalt

- superior

- extrem de

- lui

- gazdă

- găzduit

- găzduire

- FIERBINTE

- Cum

- Cum Pentru a

- Totuși

- HTML

- http

- HTTPS

- Idle

- if

- ilustrează

- imagine

- punerea în aplicare a

- implementarea

- import

- in

- include

- include

- Inclusiv

- Intrare

- Crește

- crescând

- industrii

- industrie

- informații

- Infrastructură

- inițială

- inovatoare

- tehnologii inovatoare

- intrare

- instalat

- instanță

- in schimb

- asigurare

- integrare

- integrările

- interes

- interfaţă

- în

- invocat

- problema

- probleme de

- IT

- ESTE

- james

- Java

- Loc de munca

- aderarea

- jpg

- doar

- limbă

- mare

- mai mare

- Latență

- Ultimele

- a lansat

- conduce

- lider

- Conduce

- AFLAȚI

- învăţare

- lăsa

- Nivel

- Bibliotecă

- ca

- îi place

- LIMITĂ

- liniar

- Listă

- încărca

- încărcare

- loturile

- local

- logică

- mai lung

- iubeste

- Jos

- LOWER

- maşină

- masina de învățare

- Principal

- Majoritate

- face

- FACE

- Efectuarea

- gestionate

- manager

- de conducere

- multe

- Marketing

- Marketing și publicitate

- maxim

- Mai..

- mecanisme

- Memorie

- Metadata

- metodă

- Metode

- Metrici

- microservices

- ar putea

- minim

- minut

- diminua

- ML

- mod

- model

- Modele

- Module

- mai mult

- cele mai multe

- motivat

- multiplu

- nume

- nativ

- necesar

- Nevoie

- necesar

- Nou

- recent

- Premiul Nobel

- Nici unul

- nota

- caiet

- acum

- număr

- NumPy

- of

- oferi

- promoții

- on

- ONE

- afară

- deschide

- open-source

- Operațiuni

- opus

- optimizări

- Optimizați

- optimizate

- optimizarea

- Opţiuni

- or

- Altele

- al nostru

- afară

- în aer liber

- producție

- exterior

- peste

- propriu

- Paralel

- parametrii

- parte

- special

- piese

- pasionat

- cale

- căi

- Model

- modele

- plată

- pentru

- procent

- Efectua

- performanță

- ţeavă

- platformă

- Plato

- Informații despre date Platon

- PlatoData

- joc

- Plugin-uri

- Punct

- Politica

- piscine

- Popular

- Post

- putere

- practicile

- precedent

- prezicere

- Predictii

- precedent

- în prealabil

- primar

- anterior

- premiu

- Problemă

- proces

- prelucrare

- Produs

- manager de produs

- producere

- Programare

- a promis

- cum se cuvine

- proprietăţi

- Dovedi

- furniza

- furnizează

- dispoziţie

- scop

- scopuri

- Împinge

- împins

- Piton

- pirtorh

- aleator

- gamă

- Citeste

- Citind

- gata

- în timp real

- a primi

- primit

- primește

- primire

- recomandat

- trimite

- Fără deosebire

- regiune

- regiuni

- legate de

- rămâne

- înlocui

- depozit

- reprezenta

- solicita

- cereri de

- Cerinţe

- cercetare

- Resurse

- răspuns

- REST

- rezultat

- Returnează

- reutilizarea

- Traseul

- rute

- rutare

- Alerga

- ruleaza

- Runtime

- SaaS

- sagemaker

- SageMaker Inference

- acelaşi

- probă

- Economisiți

- Spune

- Scară

- scalate

- cântare

- scalare

- scenariu

- script-uri

- Al doilea

- secunde

- vedea

- văzut

- SELF

- trimite

- senior

- servi

- servit

- serverul

- Servere

- serviciu

- Servicii

- servire

- set

- Seturi

- configurarea

- câteva

- să

- prezenta

- indicat

- Emisiuni

- simplu

- simula

- simultan

- singur

- singular

- Mărimea

- mic

- fragment

- So

- Software

- sistem de operare ca serviciu

- de dezvoltare de software

- Inginer Software

- soluţie

- soluţii

- unele

- Sursă

- specialist

- specific

- Cheltuire

- împărţi

- Sportul

- stivui

- static

- Pas

- depozitare

- stoca

- stocate

- simplu

- ulterior

- astfel de

- sugera

- a sustine

- Suportat

- Sprijină

- sigur

- sisteme

- Lua

- ia

- luare

- Ţintă

- direcționare

- Predarea

- echipă

- TechCrunch

- Tehnologii

- Tehnologia

- spune

- tensorflow

- Testarea

- teste

- decât

- acea

- lor

- Lor

- apoi

- Acolo.

- prin urmare

- Acestea

- ei

- acest

- aceste

- mie

- mii

- trei

- Prin

- debit

- timp

- ori

- la

- de asemenea

- instrument

- top

- față de

- tps

- urmări

- trafic

- Tren

- dresat

- Pregătire

- Tranzacții

- transformatoare

- Traveling

- încerca

- Două

- tip

- tipic

- în

- care stau la baza

- înţelege

- înţelegere

- Universal

- URL-ul

- utilizare

- carcasa de utilizare

- utilizat

- utilizări

- folosind

- obișnuit

- Utilizand

- valoare

- Valori

- variabil

- diverse

- viziune

- vs

- vrea

- a fost

- vizionarea

- we

- web

- servicii web

- greutate

- Ce

- cand

- întrucât

- care

- larg

- Gamă largă

- voi

- cu

- în

- Apartamente

- a lucrat

- lucrător

- muncitorii

- flux de lucru

- fluxuri de lucru

- de lucru

- fabrică

- ar

- scris

- scris

- X

- ani

- Tu

- Ta

- zephyrnet