Autor: Vitalik Buterin prin intermediul Blogul Vitalik Buterin

Mulțumiri speciale echipelor Worldcoin și Modulus Labs, Xinyuan Sun, Martin Koeppelmann și Illia Polosukhin pentru feedback și discuții.

Mulți oameni de-a lungul anilor mi-au pus o întrebare similară: care sunt intersecții între cripto și AI pe care o consider cea mai fructuoasă? Este o întrebare rezonabilă: cripto și AI sunt cele două tendințe principale de tehnologie profundă (software) din ultimul deceniu și se simte ca și cum există trebuie sa să fie un fel de legătură între cele două. Este ușor să veniți cu sinergii la nivel de vibrație superficială: descentralizarea cripto poate echilibrează centralizarea AI, AI este opac și cripto aduce transparență, AI are nevoie de date, iar blockchain-urile sunt bune pentru stocarea și urmărirea datelor. Dar de-a lungul anilor, când oamenii mi-au cerut să aprofundez un nivel și să vorbesc despre aplicații specifice, răspunsul meu a fost unul dezamăgitor: „da, sunt câteva lucruri, dar nu atât de multe”.

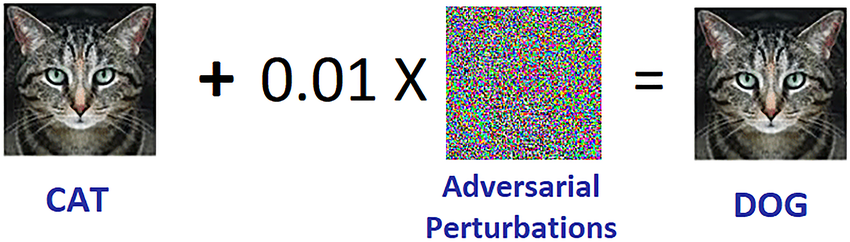

În ultimii trei ani, odată cu ascensiunea AI mult mai puternică sub formă de modern LLM-uri, și creșterea criptomonelor mult mai puternice sub formă nu doar de soluții de scalare blockchain, ci și ZKP-uri, FHE, (bipartit și N-partid) MPC, încep să văd această schimbare. Există într-adevăr câteva aplicații promițătoare ale AI în interiorul ecosistemelor blockchain sau AI împreună cu criptografie, deși este important să fiți atenți la modul în care este aplicată IA. O provocare deosebită este: în criptografie, open source este singura modalitate de a face ceva cu adevărat sigur, dar în AI, un model (sau chiar datele sale de antrenament) sunt deschise crește foarte mult vulnerabilitatea acestuia la învățare automată adversativă atacuri. Această postare va trece printr-o clasificare a diferitelor moduri în care cripto + AI s-ar putea intersecta și perspectivele și provocările fiecărei categorii.

Un rezumat la nivel înalt al intersecțiilor cripto+AI de la a Postare pe blogul uETH. Dar ce este nevoie pentru a realiza cu adevărat oricare dintre aceste sinergii într-o aplicație concretă?

Cele patru mari categorii

AI este un concept foarte larg: te poți gândi la „AI” ca fiind un set de algoritmi pe care îi creezi nu specificându-i în mod explicit, ci mai degrabă amestecând o supă mare de calcul și punând un fel de presiune de optimizare care împinge supa spre producând algoritmi cu proprietățile dorite. Această descriere cu siguranță nu trebuie luată cu dispreț: ea include il proces acea a creat noi oamenii, în primul rând! Dar înseamnă că algoritmii AI au unele proprietăți comune: capacitatea lor de a face lucruri extrem de puternice, împreună cu limitele capacității noastre de a ști sau înțelege ce se întâmplă sub capotă.

Există multe moduri de a clasifica AI; în scopul acestei postări, care vorbește despre interacțiunile dintre AI și blockchain (care au fost descrise ca o platformă pentru crearea de „jocuri”), îl voi clasifica după cum urmează:

- AI ca jucător într-un joc [cea mai înaltă viabilitate]: IA care participă la mecanisme în care sursa finală a stimulentelor provine dintr-un protocol cu contribuții umane.

- AI ca interfață cu jocul [potenţial ridicat, dar cu riscuri]: AI ajută utilizatorii să înțeleagă lumea cripto din jurul lor și să se asigure că comportamentul lor (adică mesajele și tranzacțiile semnate) se potrivește cu intențiile lor și nu sunt păcăliți sau înșelați.

- AI ca reguli ale jocului [calați foarte atent]: blockchain-uri, DAO-uri și mecanisme similare care apelează direct la AI. Gândiți-vă de ex. „judecători AI”

- AI ca obiectiv al jocului [pe termen mai lung, dar intrigant]: proiectarea blockchain-urilor, DAO-urilor și a mecanismelor similare cu scopul de a construi și menține o IA care ar putea fi utilizată în alte scopuri, folosind cripto-biții fie pentru a stimula mai bine antrenamentul, fie pentru a preveni scurgerea de date private sau utilizarea greșită a AI.

Să trecem prin acestea unul câte unul.

AI ca jucător într-un joc

Aceasta este de fapt o categorie care există de aproape un deceniu, cel puțin de atunci schimburi descentralizate în lanț (DEX) a început să vadă o utilizare semnificativă. De fiecare dată când există un schimb, există o oportunitate de a câștiga bani prin arbitraj, iar roboții pot face arbitraj mult mai bine decât oamenii. Acest caz de utilizare există de mult timp, chiar și cu AI mult mai simple decât cele pe care le avem astăzi, dar în cele din urmă este o intersecție foarte reală AI + cripto. Mai recent, am văzut roboți de arbitraj MEV exploatându-se adesea reciproc. De fiecare dată când aveți o aplicație blockchain care implică licitații sau tranzacționare, veți avea boți de arbitraj.

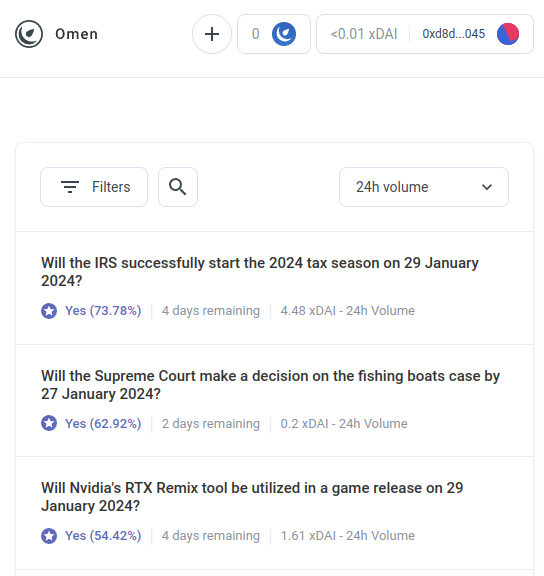

Dar boții de arbitraj AI sunt doar primul exemplu al unei categorii mult mai mari, despre care mă aștept să înceapă în curând să includă multe alte aplicații. Faceți cunoștință cu AIOmen, a demonstrația unei piețe de predicții în care AI sunt jucători:

Un răspuns la acest lucru este de a indica îmbunătățirile UX în curs de desfășurare Polimarket sau alte noi piețe de predicție și sperăm că vor reuși acolo unde iterațiile anterioare au eșuat. La urma urmei, povestea spune, oamenii sunt dispuși să parieze zeci de miliarde pe sport, deci de ce nu ar arunca oamenii suficienți bani pariând pe alegerile din SUA sau LK99 că începe să aibă sens ca jucătorii serioși să înceapă să vină? Dar acest argument trebuie să se lupte cu faptul că, ei bine, iterațiile anterioare avea nu a reușit să ajungă la acest nivel de scară (cel puțin în comparație cu visele susținătorilor lor), așa că se pare că aveți nevoie ceva nou pentru a face piețele de predicție să reușească. Astfel, un răspuns diferit este de a indica o caracteristică specifică a ecosistemelor pieței de predicții pe care ne putem aștepta să o vedem în anii 2020 și pe care nu am văzut-o în anii 2010: posibilitatea participării omniprezente a IA.

AI sunt dispuși să lucreze pentru mai puțin de 1 USD pe oră și au cunoștințele unei enciclopedii – și dacă asta nu este suficient, pot fi chiar integrate cu capacitatea de căutare web în timp real. Dacă faceți o piață și puneți o subvenție de lichiditate de 50 de dolari, oamenilor nu le va păsa suficient de licitat, dar mii de IA vor roi cu ușurință peste întrebarea și vor face cea mai bună presupunere. Stimulentul de a face o treabă bună la orice întrebare poate fi mic, dar stimulentul de a face o IA care face predicții bune în general poate fi de milioane. Rețineți că, potențial, nici măcar nu ai nevoie de oameni pentru a judeca majoritatea întrebărilor: puteți utiliza un sistem de dispute cu mai multe runde similar cu Augur sau Kleros, unde AI ar fi, de asemenea, cei care vor participa la rundele anterioare. Oamenii ar trebui să răspundă doar în acele puține cazuri în care au avut loc o serie de escalade și au fost comise sume mari de bani de ambele părți.

Aceasta este o primitivă puternică, deoarece odată ce o „piață de predicție” poate fi făcută să funcționeze la o astfel de scară microscopică, puteți reutiliza primitivul „piață de predicție” pentru multe alte tipuri de întrebări:

- Este această postare pe rețelele sociale acceptabilă în conformitate cu [termenii de utilizare]?

- Ce se va întâmpla cu prețul acțiunii X (de exemplu, vezi Numerai)

- Acest cont care îmi trimite în prezent mesaje este de fapt Elon Musk?

- Este acceptată această depunere a lucrărilor pe o piață de activități online?

- Este dapp de la https://examplefinance.network o înșelătorie?

- Is

0x1b54....98c3de fapt adresa jetonului ERC20 „Casinu Inu”?

S-ar putea să observați că multe dintre aceste idei merg în direcția a ceea ce am numit „apărarea informațiilor” în . În linii mari, întrebarea este: cum îi ajutăm pe utilizatori să deosebească informațiile adevărate și false și să detecteze escrocherii, fără a împuternici o autoritate centralizată să decidă corect și greșit cine ar putea apoi abuza de această poziție? La un nivel micro, răspunsul poate fi „AI”. Dar la nivel macro, întrebarea este: cine construiește IA? AI este o reflectare a procesului care a creat-o și, prin urmare, nu poate evita părtinirea. Prin urmare, este nevoie de un joc de nivel superior, care să judece cât de bine se descurcă diferitele AI, în care AI-urile pot participa ca jucători în joc..

Această utilizare a AI, în care AI participă la un mecanism în care sunt în cele din urmă recompensați sau penalizați (probabilistic) printr-un mecanism în lanț care adună intrări de la oameni (numiți-l descentralizat bazat pe piață). Rlhf?), este ceva despre care cred că merită cu adevărat analizat. Acum este momentul potrivit pentru a analiza mai mult cazuri de utilizare ca acesta, deoarece scalarea blockchain reușește în sfârșit, făcând „micro-” orice lucru în sfârșit viabil în lanț, când de multe ori nu era înainte.

O categorie conexă de aplicații merge în direcția agenților extrem de autonomi folosind blockchain-uri pentru a coopera mai bine, fie prin plăți, fie prin utilizarea unor contracte inteligente pentru a-și lua angajamente credibile.

AI ca interfață pentru joc

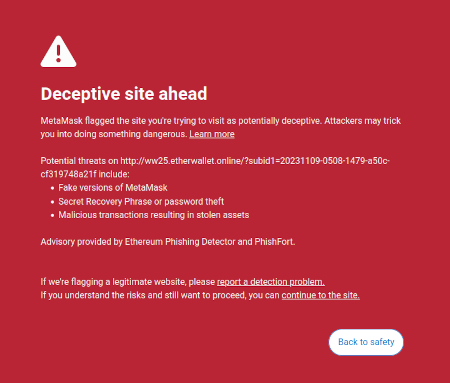

O idee pe care am adus-o în mine scrieri pe este ideea că există o oportunitate de piață de a scrie software orientat către utilizator care ar proteja interesele utilizatorilor prin interpretarea și identificarea pericolelor din lumea online în care navighează utilizatorul. Un exemplu deja existent în acest sens este funcția de detectare a înșelătoriei Metamask:

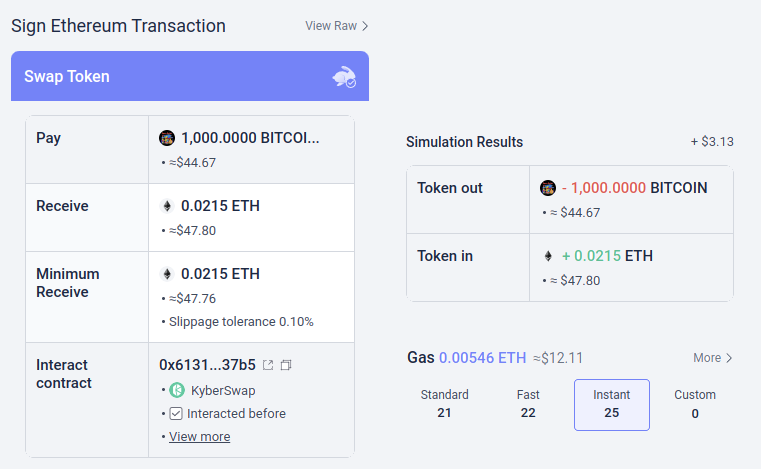

Potenţial, aceste tipuri de instrumente ar putea fi supraîncărcate cu AI. Inteligența artificială ar putea oferi o explicație mult mai bogată și prietenoasă cu oamenii la ce tip de Dapp participați, consecințele operațiunilor mai complicate pe care le semnați, dacă un anumit token este sau nu autentic (de ex. BITCOIN nu este doar un șir de caractere, este numele unei criptomonede reale, care nu este un token ERC20 și care are un preț cu mult mai mare de 0.045 USD, iar un LLM modern ar ști asta) și așa mai departe. Există proiecte care încep să meargă până la capăt în această direcție (de ex portofel LangChain, care folosește AI ca a primar interfață). Părerea mea este că interfețele AI pure sunt probabil prea riscante în acest moment, deoarece crește riscul de alte feluri de erori, dar AI care completează o interfață mai convențională devine foarte viabilă.

Există un risc special care merită menționat. Voi aborda mai mult acest lucru în secțiunea „AI ca reguli de joc” de mai jos, dar problema generală este învățarea automată adversa: dacă un utilizator are acces la un asistent AI într-un portofel open-source, băieții răi vor avea acces și la acel asistent AI și, astfel, vor avea oportunități nelimitate de a-și optimiza înșelătoriile pentru a nu declanșa. apărarea acelui portofel. Toate AI-urile moderne au erori undeva și nu este prea greu pentru un proces de antrenament, chiar și unul cu doar acces limitat la model, pentru a le găsi.

Aici funcționează mai bine „AI-urile care participă la micro-piețele în lanț”: fiecare IA individuală este vulnerabilă la aceleași riscuri, dar creați în mod intenționat un ecosistem deschis de zeci de oameni care le repetă și le îmbunătățesc în mod constant. În plus, fiecare IA individuală este închisă: securitatea sistemului vine din deschiderea regulilor joc, nu funcționarea internă a fiecăruia player.

Rezumat: Inteligența artificială poate ajuta utilizatorii să înțeleagă ce se întâmplă într-un limbaj simplu, poate servi ca tutore în timp real, poate proteja utilizatorii de greșeli, dar să fie avertizat atunci când încearcă să o folosească direct împotriva informatorilor și escrocilor rău intenționați.

AI ca reguli ale jocului

Acum, ajungem la aplicația de care mulți oameni sunt încântați, dar care cred că este cea mai riscantă și în care trebuie să pășim cu cea mai mare atenție: ceea ce eu numesc AI fac parte din regulile jocului. Acest lucru se leagă de entuziasmul în rândul elitelor politice principale cu privire la „judecătorii AI” (de ex. a se vedea acest articol pe site-ul „World Government Summit”) și există analogi ale acestor dorințe în aplicațiile blockchain. Dacă un contract inteligent bazat pe blockchain sau un DAO trebuie să ia o decizie subiectivă (de exemplu, un anumit produs de muncă este acceptabil într-un contract de muncă pentru închiriere? Care este interpretarea corectă a unei constituții în limbaj natural precum Optimism Legea Lanțurilor?), ai putea face ca un AI să fie pur și simplu parte a contractului sau DAO pentru a ajuta la aplicarea acestor reguli?

Aici e locul învățare automată adversativă va fi o provocare extrem de grea. Argumentul de bază din două propoziții este următorul:

Dacă un model AI care joacă un rol cheie într-un mecanism este închis, nu-i poți verifica funcționarea interioară și, prin urmare, nu este mai bine decât o aplicație centralizată. Dacă modelul AI este deschis, atunci un atacator îl poate descărca și simula local și poate proiecta atacuri puternic optimizate pentru a păcăli modelul, pe care apoi le poate reda în rețeaua live.

Acum, cititorii frecventi ai acestui blog (sau locuitorii criptoversului) s-ar putea să mă înainteze deja și să se gândească: dar așteptați! Avem dovezi fanteziste de zero cunoștințe și alte forme foarte interesante de criptografie. Cu siguranță putem face ceva cripto-magie și ascundem funcționalitatea interioară a modelului, astfel încât atacatorii să nu poată optimiza atacurile, dar în același timp dovedi că modelul este executat corect și a fost construit folosind un proces de instruire rezonabil pe un set rezonabil de date de bază!

În mod normal, asta este exact tipul de gândire pe care îl susțin atât pe acest blog, cât și în celelalte scrieri ale mele. Dar în cazul calculelor legate de IA, există două obiecții majore:

- Suprafața criptografică: este mult mai puțin eficient să faci ceva în interiorul unui SNARK (sau MPC sau…) decât să faci „în clar”. Având în vedere că IA este deja foarte intensivă din punct de vedere computațional, este chiar viabilă din punct de vedere informatic utilizarea AI în interiorul cutiilor negre criptografice?

- Atacurile adverse de învățare automată în cutie neagră: există modalități de optimizare a atacurilor împotriva modelelor AI chiar fără să știe multe despre funcționarea internă a modelului. Și dacă te ascunzi prea mult, riști să faci prea ușor pentru oricine alege datele de antrenament să corupă modelul cu care otrăvire Atacurile.

Ambele sunt gropi de iepure complicate, așa că haideți să intrăm în fiecare dintre ele pe rând.

Suprafața criptografică

Gadget-urile criptografice, în special cele de uz general, cum ar fi ZK-SNARK și MPC, au o suprasolicitare mare. Un bloc Ethereum durează câteva sute de milisecunde pentru ca un client să verifice direct, dar generarea unui ZK-SNARK pentru a demonstra corectitudinea unui astfel de bloc poate dura ore. Suprafața tipică a altor gadget-uri criptografice, cum ar fi MPC, poate fi și mai rău. Calculul AI este deja costisitor: cele mai puternice LLM-uri pot scoate cuvinte individuale doar puțin mai repede decât le pot citi ființele umane, ca să nu mai vorbim de costurile de calcul de multe milioane de dolari ale pregătire modelele. Diferența de calitate dintre modelele de top și modelele care încearcă să economisească mult mai mult costul instruirii or număr de parametri este larg. La prima vedere, acesta este un motiv foarte bun pentru a fi suspicios față de întregul proiect de încercare de a adăuga garanții AI prin includerea acestuia în criptografie.

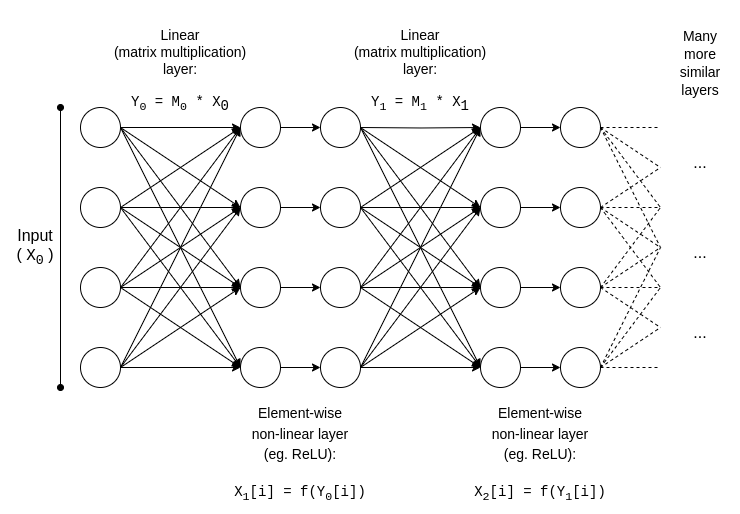

Din fericire, însă, AI este a tip foarte specific de calcul, ceea ce îl face accesibil la toate tipurile de optimizări de care nu pot beneficia de tipurile de calcul mai „nestructurate” precum ZK-EVM. Să examinăm structura de bază a unui model AI:

y = max(x, 0)). Asimptotic, înmulțirile matriceale ocupă cea mai mare parte a muncii: înmulțirea cu doi N*N matrici durează �(�2.8) timp, în timp ce numărul de operații neliniare este mult mai mic. Acest lucru este într-adevăr convenabil pentru criptografie, deoarece multe forme de criptografie pot face operații liniare (care sunt înmulțiri de matrice, cel puțin dacă criptați modelul, dar nu și intrările acestuia) aproape „gratuit”.

Dacă sunteți criptograf, probabil că ați auzit deja de un fenomen similar în contextul criptarea homomorfă: performant adăugări pe texte criptate este foarte ușor, dar înmulțiri sunt incredibil de greu și nu am găsit nicio modalitate de a face asta cu o adâncime nelimitată până în 2009.

Pentru ZK-SNARK, echivalentul este protocoale ca acesta din 2013, care arată a mai puțin de 4x overhead pentru demonstrarea înmulțirilor matriceale. Din păcate, supraîncărcarea pe straturile neliniare ajunge să fie în continuare semnificativă, iar cele mai bune implementări în practică arată o suprasarcină de aproximativ 200x. Dar există speranță că acest lucru poate fi redus foarte mult prin cercetări ulterioare; vedea această prezentare de la Ryan Cao pentru o abordare recentă bazată pe GKR și a mea explicație simplificată a modului în care funcționează componenta principală a GKR.

Dar pentru multe aplicații, nu vrem doar dovedi că o ieșire AI a fost calculată corect, vrem și noi ascunde modelul. Există abordări naive în acest sens: puteți împărți modelul astfel încât un set diferit de servere să stocheze redundant fiecare strat și să sperați că unele dintre serverele care scurg unele dintre straturi să nu scurgă prea multe date. Dar există și forme surprinzător de eficiente de calcul specializat în mai multe părți.

În ambele cazuri, morala poveștii este aceeași: cea mai mare parte a unui calcul AI este înmulțirile matriceale, pentru care este posibil să se facă foarte eficient ZK-SNARK-uri sau MPC-uri (sau chiar FHE), astfel încât suprasolicitarea totală a introducerii AI în cutii criptografice este surprinzător de mică. În general, straturile neliniare sunt cele mai mari blocaje, în ciuda dimensiunii lor mai mici; poate tehnici mai noi precum argumente de căutare poate ajuta.

Învățare automată adversară cutie neagră

Acum, să trecem la cealaltă mare problemă: tipurile de atacuri pe care le poți face chiar dacă conținutul modelului este păstrat privat și aveți doar „acces API” la model. Citând a hârtie de la 2016:

Multe modele de învățare automată sunt vulnerabile la exemple adverse: intrări care sunt special concepute pentru a determina ca un model de învățare automată să producă o ieșire incorectă. Exemplele adverse care afectează un model afectează adesea un alt model, chiar dacă cele două modele au arhitecturi diferite sau au fost antrenate pe seturi de antrenament diferite, atâta timp cât ambele modele au fost antrenate să îndeplinească aceeași sarcină. Prin urmare, un atacator poate să-și antreneze propriul model de înlocuire, să creeze exemple contradictorii împotriva substitutului și să le transfere la un model de victimă, cu foarte puține informații despre victimă.

Potențial, puteți chiar să creați atacuri știind doar datele de antrenament, chiar dacă aveți acces foarte limitat sau deloc la modelul pe care încercați să îl atacați. Începând cu 2023, aceste tipuri de atacuri continuă să fie o problemă mare.

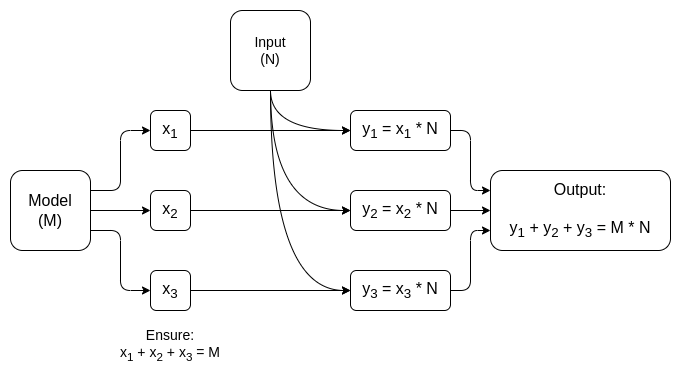

Pentru a reduce în mod eficient aceste tipuri de atacuri de tip cutie neagră, trebuie să facem două lucruri:

- Într-adevăr limita cine sau ce poate interoga modelul si cat de mult. Cutiile negre cu acces nerestricționat la API nu sunt securizate; casetele negre cu acces API foarte restricționat pot fi.

- Ascundeți datele de antrenament, păstrând în același timp încrederea că procesul utilizat pentru a crea datele de antrenament nu este corupt.

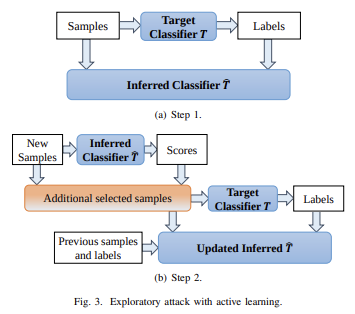

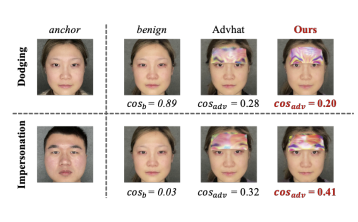

Proiectul care a făcut cel mai mult pe primul este poate Worldcoin, dintre care analizez pe larg o versiune anterioară (printre alte protocoale) aici. Worldcoin folosește în mod extensiv modele AI la nivel de protocol, pentru a (i) converti scanările irisului în „coduri de iris” scurte, care sunt ușor de comparat pentru similitudine și (ii) a verifica dacă obiectul pe care îl scanează este de fapt o ființă umană. Principala apărare pe care se bazează Worldcoin este faptul că nu permite nimănui să apeleze pur și simplu la modelul AI: mai degrabă, folosește hardware de încredere pentru a se asigura că modelul acceptă doar intrări semnate digital de camera globului..

Această abordare nu este garantată să funcționeze: se dovedește că puteți face atacuri adverse împotriva AI biometrice care vin sub formă de petice fizice sau bijuterii pe care le poți pune pe față:

Dar speranta este ca daca tu combina toate apărările împreună, ascunzând modelul AI în sine, limitând foarte mult numărul de interogări și necesitând ca fiecare interogare să fie într-un fel autentificată, puteți ataca atât de dificil încât sistemul să fie sigur.

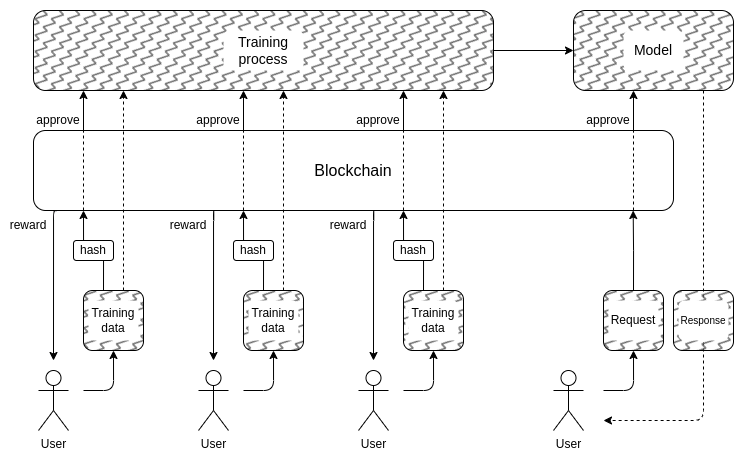

Și asta ne duce la a doua parte: cum putem ascunde datele de antrenament? Aici e locul „DAO să guverneze democratic AI” ar putea avea sens: putem crea un DAO în lanț care guvernează procesul cine are permisiunea de a trimite date de instruire (și ce atestări sunt necesare pentru datele în sine), cine are permisiunea de a face interogări și câte și să folosească tehnici criptografice precum MPC pentru a cripta întregul canal de creare și rulare a AI de la intrarea de formare a fiecărui utilizator individual până la rezultatul final al fiecărei interogări. Acest DAO ar putea satisface simultan obiectivul foarte popular de a compensa oamenii pentru transmiterea datelor.

- Suplimentarul criptografic ar putea fi încă prea mare pentru ca acest tip de arhitectură complet-neagră să fie competitivă cu abordările tradiționale închise „încredeți-mă”.

- S-ar putea dovedi că nu există o modalitate bună de a face procesul de transmitere a datelor de formare descentralizat și protejat împotriva atacurilor de otrăvire.

- Gadgeturile de calcul multipartite s-ar putea rupe garanțiile lor de siguranță sau confidențialitate datorită participanții se înțeleg: la urma urmei, acest lucru s-a întâmplat cu podurile de criptomonede încrucișate din nou și din nou.

Unul dintre motivele pentru care nu am început această secțiune cu mai multe etichete roșii mari de avertizare care spun „NU FACEȚI JUDECĂTORI AI, ESTE DISTOPIAN”, este că societatea noastră este deja foarte dependentă de judecători AI centralizați care nu sunt responsabili: algoritmii care determină ce tipuri de postările și opiniile politice sunt stimulate și deboostate, sau chiar cenzurate, pe rețelele sociale. Cred că extinderea acestei tendințe mai mult în acest stadiu este o idee destul de proastă, dar nu cred că există șanse mari ca comunitatea blockchain experimentează mai mult cu AI va fi lucrul care contribuie la agravarea situației.

De fapt, există câteva modalități de bază cu risc scăzut prin care tehnologia cripto poate face chiar și aceste sisteme centralizate existente mai bune în care sunt destul de încrezător. O tehnică simplă este IA verificată cu publicare întârziată: atunci când un site de socializare realizează un clasament al postărilor bazat pe inteligență artificială, ar putea publica un ZK-SNARK care să dovedească hash-ul modelului care a generat acel clasament. Site-ul s-ar putea angaja să-și dezvăluie modelele AI după ex. o întârziere de un an. Odată ce un model este dezvăluit, utilizatorii pot verifica hash-ul pentru a verifica dacă modelul corect a fost lansat, iar comunitatea poate efectua teste pe model pentru a verifica corectitudinea acestuia. Întârzierea publicării ar asigura că, în momentul în care modelul este dezvăluit, acesta este deja depășit.

Deci, în comparație cu centralizat lume, întrebarea nu este if putem face mai bine, dar cu cat mai mult. Pentru lume descentralizată, totuși, este important să fii atent: dacă cineva construiește de ex. o piață de predicții sau o monedă stabilă care folosește un oracol AI și se dovedește că oracolul este atacabil, aceasta este o sumă uriașă de bani care ar putea dispărea într-o clipă.

AI ca obiectiv al jocului

Dacă tehnicile de mai sus pentru crearea unui AI privat descentralizat scalabil, al cărui conținut este o cutie neagră necunoscută de nimeni, pot funcționa efectiv, atunci acest lucru ar putea fi folosit și pentru a crea AI cu utilitate care depășesc blockchain-urile. Echipa de protocol NEAR face acest lucru a obiectivul principal al activității lor în curs.

Există două motive pentru a face acest lucru:

- daca tu poate să face "AI-uri cutie neagră de încredere„prin rularea procesului de instruire și inferență folosind o combinație de blockchain și MPC, apoi o mulțime de aplicații în care utilizatorii sunt îngrijorați de faptul că sistemul este părtinitor sau că îi înșală ar putea beneficia de pe urma. Mulți oameni și-au exprimat dorința de guvernare democratică de IA cu importanță sistemică de care vom depinde; Tehnicile criptografice și bazate pe blockchain ar putea fi o cale către acest lucru.

- De la un Siguranța AI Perspectivă, aceasta ar fi o tehnică pentru a crea o IA descentralizată care are și un comutator de ucidere natural și care ar putea limita interogările care urmăresc să folosească IA pentru un comportament rău intenționat.

De asemenea, merită remarcat faptul că „folosirea stimulentelor cripto pentru a stimula realizarea unei IA mai bune” se poate face fără a trece și în cariera completă a utilizării criptografiei pentru a o cripta complet: abordări precum BitTensor intră în această categorie.

Concluzii

Acum că atât blockchain-urile, cât și AI-urile devin din ce în ce mai puternice, există un număr tot mai mare de cazuri de utilizare în intersecția celor două zone. Cu toate acestea, unele dintre aceste cazuri de utilizare au mult mai mult sens și sunt mult mai robuste decât altele. În general, cazuri de utilizare în care mecanismul de bază continuă să fie proiectat aproximativ ca înainte, dar individul jucători devin AI, permițând mecanismului să funcționeze eficient la o scară mult mai micro, sunt cele mai promițătoare imediat și cele mai ușor de corectat.

Cele mai dificile de făcut corect sunt aplicațiile care încearcă să folosească blockchain-uri și tehnici criptografice pentru a crea un „singleton”: un singur AI descentralizat de încredere pe care s-ar baza anumite aplicații pentru un anumit scop. Aceste aplicații sunt promițătoare, atât pentru funcționalitate, cât și pentru îmbunătățirea siguranței AI într-un mod care evită riscurile de centralizare asociate cu abordările mai populare ale acestei probleme. Dar există și multe moduri în care ipotezele de bază ar putea eșua; prin urmare, merită să fie luate cu atenție, mai ales atunci când implementați aceste aplicații în contexte cu valoare ridicată și cu risc ridicat.

Aștept cu nerăbdare să văd mai multe încercări de cazuri de utilizare constructivă a AI în toate aceste domenii, astfel încât să putem vedea care dintre ele sunt cu adevărat viabile la scară.

Autor: Vitalik Buterin

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- BlockOffsets. Modernizarea proprietății de compensare a mediului. Accesați Aici.

- Sursa: Inteligența datelor Platon.