Создатель мудреца Амазонки предоставляет широкий выбор инфраструктуры машинного обучения (ML) и вариантов развертывания модели, которые помогут удовлетворить ваши потребности в выводе ML. Это полностью управляемый сервис, который интегрируется с инструментами MLOps, поэтому вы можете работать над масштабированием развертывания модели, снижать затраты на логические выводы, более эффективно управлять моделями в производственной среде и снижать эксплуатационную нагрузку. SageMaker предоставляет несколько варианты вывода так что вы можете выбрать вариант, который лучше всего подходит для вашей рабочей нагрузки.

ЦП нового поколения предлагают значительное повышение производительности при выводе ML благодаря специализированным встроенным инструкциям. В этом посте мы сосредоточимся на том, как вы можете воспользоваться АМС Гравитон3на базе Amazon Elastic Compute Cloud (EC2) Экземпляры C7g чтобы помочь сократить затраты на вывод до 50% по сравнению с сопоставимыми инстансами EC2 для вывод в реальном времени на Amazon SageMaker. Мы покажем, как всего за несколько шагов оценить производительность логического вывода и переключить рабочие нагрузки машинного обучения на инстансы AWS Graviton.

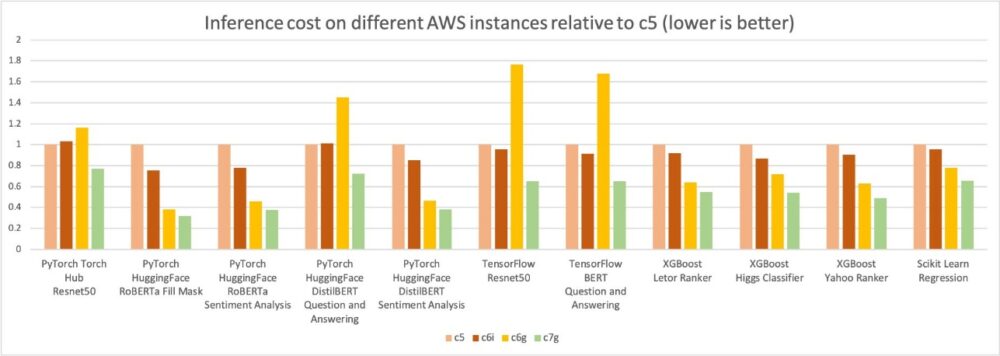

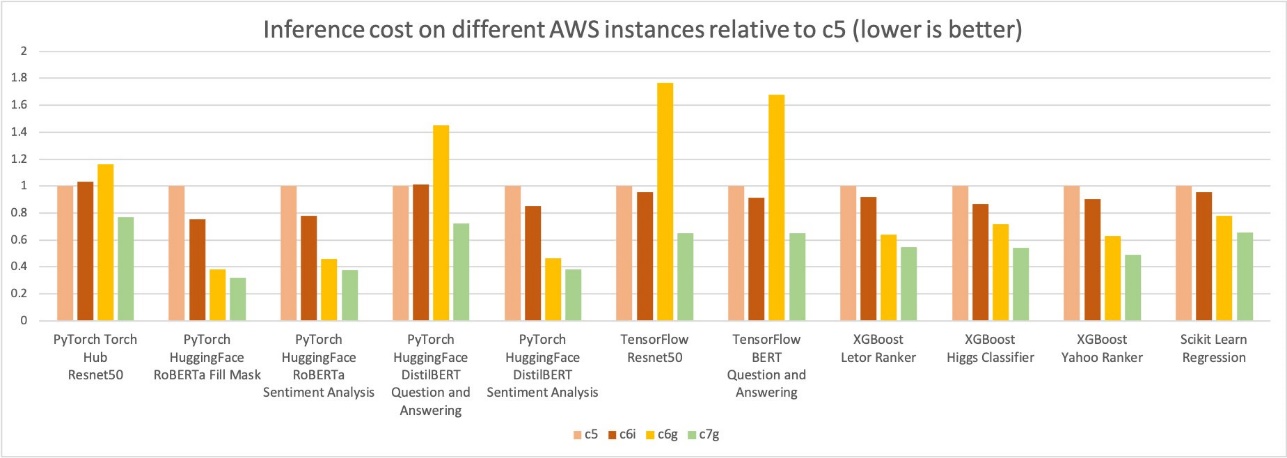

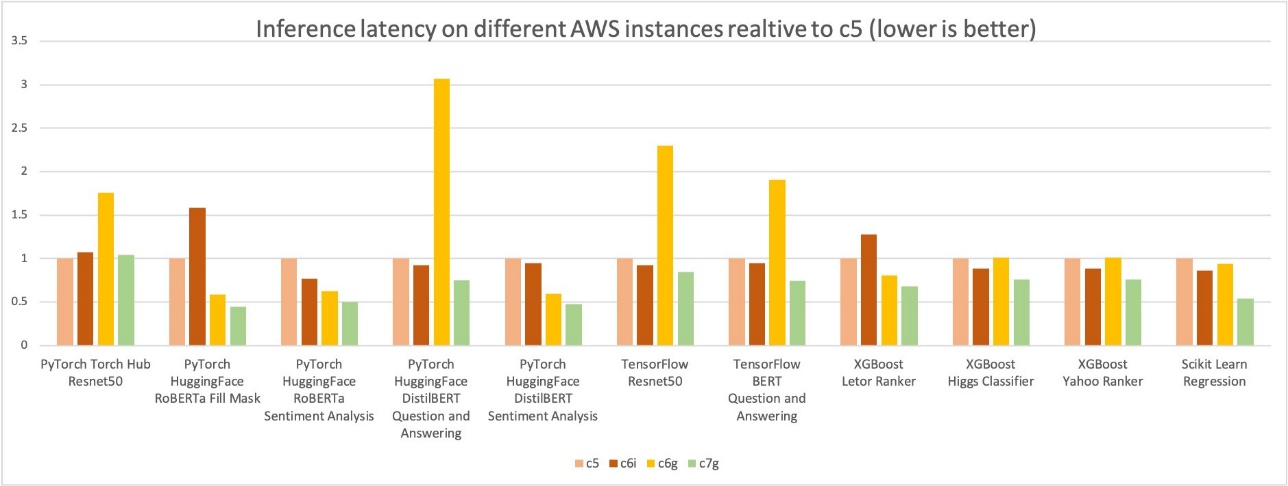

Чтобы охватить популярный и широкий спектр клиентских приложений, в этом посте мы обсудим производительность вывода фреймворков PyTorch, TensorFlow, XGBoost и scikit-learn. Мы охватываем сценарии компьютерного зрения (CV), обработки естественного языка (NLP), классификации и ранжирования для моделей и экземпляров ml.c6g, ml.c7g, ml.c5 и ml.c6i SageMaker для сравнительного анализа.

Результаты сравнительного анализа

AWS оценила экономию средств до 50 % для PyTorch, TensorFlow, XGBoost и вывода модели scikit-learn с инстансами EC3 C2g на базе AWS Graviton7 по сравнению с сопоставимыми инстансами EC2 в Amazon SageMaker. В то же время латентность вывода также уменьшается.

Для сравнения мы использовали четыре разных типа инстансов:

Все четыре экземпляра имеют 16 виртуальных ЦП и 32 ГБ памяти.

На следующем графике мы измерили стоимость вывода на миллион для четырех типов экземпляров. Далее мы нормализовали стоимость за миллион результатов логического вывода к экземпляру c5.4xlarge, который измеряется как 1 по оси Y диаграммы. Вы можете видеть, что для моделей XGBoost стоимость вывода на миллион для c7g.4xlarge (AWS Graviton3) составляет около 50 % от c5.4xlarge и 40 % от c6i.4xlarge; для моделей PyTorch NLP экономия средств составляет около 30–50 % по сравнению с экземплярами c5 и c6i.4xlarge. Для других моделей и платформ мы оценили экономию затрат не менее 30 % по сравнению с экземплярами c5 и c6i.4xlarge.

Как и на предыдущем графике сравнения стоимости вывода, на следующем графике показана задержка модели p90 для тех же четырех типов инстансов. Далее мы нормализовали результаты задержки для экземпляра c5.4xlarge, который измеряется как 1 по оси Y диаграммы. Задержка логического вывода модели c7g.4xlarge (AWS Graviton3) до 50 % лучше, чем задержки, измеренные на c5.4xlarge и c6i.4xlarge.

Перенос на инстансы AWS Graviton

Чтобы развернуть свои модели в экземплярах AWS Graviton, вы можете либо использовать Контейнеры глубокого обучения AWS (DLC) или привозите свои контейнеры которые совместимы с архитектурой ARMv8.2.

Миграция (или новое развертывание) ваших моделей в инстансы AWS Graviton выполняется просто, поскольку AWS не только предоставляет контейнеры для размещения моделей с помощью PyTorch, TensorFlow, scikit-learn и XGBoost, но и сами модели не зависят от архитектуры. Вы также можете принести свои собственные библиотеки, но убедитесь, что ваш контейнер создан в среде, поддерживающей архитектуру ARMv8.2. Для получения дополнительной информации см. Создание собственного контейнера алгоритмов.

Для развертывания модели вам потребуется выполнить три шага:

- Создайте модель SageMaker. Среди прочих параметров он будет содержать информацию о расположении файла модели, контейнере, который будет использоваться для развертывания, и расположении сценария вывода. (Если у вас есть существующая модель, уже развернутая в экземпляре вывода, оптимизированном для вычислений, вы можете пропустить этот шаг.)

- Создайте конфигурацию конечной точки. Он будет содержать информацию о типе экземпляра, который вы хотите использовать для конечной точки (например, ml.c7g.xlarge для AWS Graviton3), имени модели, созданной на предыдущем шаге, и количестве экземпляров на конечную точку.

- Запустите конечную точку с конфигурацией конечной точки, созданной на предыдущем шаге.

Подробные инструкции см. Запускайте рабочие нагрузки логического вывода машинного обучения на инстансах на базе AWS Graviton с помощью Amazon SageMaker.

Методология сравнительного анализа

Мы использовали Рекомендатор выводов Amazon SageMaker для автоматизации сравнительного анализа производительности в разных экземплярах. Эта служба сравнивает производительность вашей модели машинного обучения с точки зрения задержки и стоимости на разных экземплярах и рекомендует экземпляр и конфигурацию, которые обеспечивают наилучшую производительность при наименьших затратах. Мы собрали вышеупомянутые данные о производительности с помощью Inference Recommender. Для получения более подробной информации см. Репо GitHub.

Вы можете использовать образец тетради запустить тесты и воспроизвести результаты. Для бенчмаркинга мы использовали следующие модели:

Заключение

AWS оценила экономию средств до 50 % для PyTorch, TensorFlow, XGBoost и вывода модели scikit-learn с инстансами EC3 C2g на базе AWS Graviton7 по сравнению с сопоставимыми инстансами EC2 в Amazon SageMaker. Вы можете перенести существующие варианты использования логического вывода или развернуть новые модели машинного обучения на AWS Graviton, выполнив действия, описанные в этом посте. Вы также можете обратиться к Техническое руководство по AWS Graviton, в котором представлен список оптимизированных библиотек и рекомендаций, которые помогут вам добиться экономической выгоды с помощью инстансов AWS Graviton при различных рабочих нагрузках.

Если вы обнаружите случаи использования, в которых аналогичный прирост производительности не наблюдается на AWS Graviton, свяжитесь с нами. Мы продолжим добавлять дополнительные улучшения производительности, чтобы сделать AWS Graviton самым экономичным и эффективным процессором общего назначения для логического вывода машинного обучения.

Об авторах

Сунита Надампалли является менеджером по разработке программного обеспечения в AWS. Она руководит оптимизацией производительности программного обеспечения Graviton для машинного обучения, высокопроизводительных вычислений и мультимедийных рабочих нагрузок. Она увлечена разработкой с открытым исходным кодом и предоставлением экономически эффективных программных решений с помощью SoC Arm.

Сунита Надампалли является менеджером по разработке программного обеспечения в AWS. Она руководит оптимизацией производительности программного обеспечения Graviton для машинного обучения, высокопроизводительных вычислений и мультимедийных рабочих нагрузок. Она увлечена разработкой с открытым исходным кодом и предоставлением экономически эффективных программных решений с помощью SoC Arm.

Джеймин Десаи — инженер-разработчик программного обеспечения в команде Amazon SageMaker Inference. Он увлечен распространением ИИ в массы и повышением удобства использования современных активов ИИ путем превращения их в функции и услуги. В свободное время он любит заниматься музыкой и путешествовать.

Джеймин Десаи — инженер-разработчик программного обеспечения в команде Amazon SageMaker Inference. Он увлечен распространением ИИ в массы и повышением удобства использования современных активов ИИ путем превращения их в функции и услуги. В свободное время он любит заниматься музыкой и путешествовать.

Майк Шнайдер является системным разработчиком из Феникса, Аризона. Он является членом контейнеров Deep Learning, поддерживающих различные образы контейнеров Framework, включая Graviton Inference. Он занимается вопросами эффективности и стабильности инфраструктуры.

Майк Шнайдер является системным разработчиком из Феникса, Аризона. Он является членом контейнеров Deep Learning, поддерживающих различные образы контейнеров Framework, включая Graviton Inference. Он занимается вопросами эффективности и стабильности инфраструктуры.

Мохан Ганди является старшим инженером-программистом в AWS. Он работает с AWS последние 10 лет и работал над различными сервисами AWS, такими как EMR, EFA и RDS. В настоящее время он сосредоточен на улучшении SageMaker Inference Experience. В свободное время любит пешие прогулки и марафоны.

Мохан Ганди является старшим инженером-программистом в AWS. Он работает с AWS последние 10 лет и работал над различными сервисами AWS, такими как EMR, EFA и RDS. В настоящее время он сосредоточен на улучшении SageMaker Inference Experience. В свободное время любит пешие прогулки и марафоны.

Цинвэй Ли является специалистом по машинному обучению в Amazon Web Services. Он получил докторскую степень в Исследовании операций после того, как он сломал счет исследовательского гранта своего советника и был не в состоянии поставить Нобелевскую премию, которую он обещал. В настоящее время он помогает клиентам в сфере финансовых услуг и страхования создавать решения для машинного обучения на AWS. В свободное время он любит читать и преподавать.

Цинвэй Ли является специалистом по машинному обучению в Amazon Web Services. Он получил докторскую степень в Исследовании операций после того, как он сломал счет исследовательского гранта своего советника и был не в состоянии поставить Нобелевскую премию, которую он обещал. В настоящее время он помогает клиентам в сфере финансовых услуг и страхования создавать решения для машинного обучения на AWS. В свободное время он любит читать и преподавать.

Уэйн То является специалистом по архитектуре решений для Graviton в AWS. Он фокусируется на том, чтобы помочь клиентам внедрить архитектуру ARM для крупномасштабных контейнерных рабочих нагрузок. До прихода в AWS Уэйн работал с несколькими крупными поставщиками программного обеспечения, включая IBM и Red Hat.

Уэйн То является специалистом по архитектуре решений для Graviton в AWS. Он фокусируется на том, чтобы помочь клиентам внедрить архитектуру ARM для крупномасштабных контейнерных рабочих нагрузок. До прихода в AWS Уэйн работал с несколькими крупными поставщиками программного обеспечения, включая IBM и Red Hat.

Лорен Малленекс — архитектор решений из Денвера, штат Колорадо. Она работает с клиентами, помогая им разрабатывать решения на AWS. В свободное время она любит ходить в походы и готовить блюда гавайской кухни.

Лорен Малленекс — архитектор решений из Денвера, штат Колорадо. Она работает с клиентами, помогая им разрабатывать решения на AWS. В свободное время она любит ходить в походы и готовить блюда гавайской кухни.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- ПлатонАйСтрим. Анализ данных Web3. Расширение знаний. Доступ здесь.

- Чеканка будущего с Эдриенн Эшли. Доступ здесь.

- Покупайте и продавайте акции компаний PREIPO® с помощью PREIPO®. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :имеет

- :является

- :нет

- :куда

- $UP

- 1

- 10

- 100

- 7

- 98

- a

- О нас

- Учетная запись

- Достигать

- через

- Добавить

- принять

- плюс

- После

- AI

- алгоритм

- уже

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- среди

- an

- и

- Приложения

- архитектура

- МЫ

- ARM

- AS

- Активы

- At

- автоматизировать

- AWS

- основанный

- BE

- , так как:

- было

- бенчмаркинг

- тесты

- Преимущества

- ЛУЧШЕЕ

- лучшие практики

- Лучшая

- приносить

- широкий

- Сломался

- строить

- построенный

- встроенный

- бремя

- но

- by

- CAN

- случаев

- График

- классификация

- облако

- CO

- сравнимый

- сравненный

- сравнение

- совместим

- полный

- Вычисление

- компьютер

- Компьютерное зрение

- Конфигурация

- содержать

- Container

- Контейнеры

- продолжать

- Цена

- экономия на издержках

- рентабельным

- Расходы

- чехол для варгана

- создали

- В настоящее время

- клиент

- Клиенты

- данным

- преданный

- глубоко

- глубокое обучение

- доставить

- доставки

- Денвер

- развертывание

- развернуть

- развертывание

- подробный

- подробнее

- Застройщик

- Развитие

- различный

- обсуждать

- приносит

- два

- фактически

- затрат

- эффективный

- или

- Конечная точка

- инженер

- Окружающая среда

- оценивать

- пример

- существующий

- опыт

- Исследование

- Oшибка

- Особенности

- несколько

- Файл

- финансовый

- финансовая служба

- Найдите

- Фокус

- внимание

- фокусируется

- после

- Что касается

- 4

- Рамки

- каркасы

- Бесплатно

- далее

- Доходы

- общее назначение

- поколения

- дает

- предоставлять

- график

- имеет

- Есть

- he

- помощь

- помощь

- помогает

- ее

- его

- кашель

- Как

- HPC

- HTML

- HTTPS

- IBM

- if

- изображений

- улучшение

- улучшение

- улучшение

- in

- включают

- В том числе

- промышленность

- информация

- Инфраструктура

- пример

- инструкции

- страхование

- Интегрируется

- в

- присоединение

- JPG

- всего

- язык

- большой

- Фамилия

- Задержка

- Лиды

- изучение

- наименее

- библиотеки

- такое как

- нравится

- Список

- расположение

- низший

- машина

- обучение с помощью машины

- сделать

- управлять

- менеджер

- массы

- Встречайте

- член

- Память

- мигрировать

- миграция

- миллиона

- ML

- млн операций в секунду

- модель

- Модели

- БОЛЕЕ

- самых

- Мультимедиа

- с разными

- Музыка

- имя

- натуральный

- Обработка естественного языка

- Необходимость

- потребности

- Новые

- НЛП

- нобелевская торговая точка

- номер

- of

- предлагают

- on

- только

- с открытым исходным кодом

- оперативный

- Операционный отдел

- оптимизированный

- Опция

- Опции

- or

- заказ

- Другое

- внешний

- собственный

- параметры

- страстный

- производительность

- феникс

- выбирать

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- пожалуйста

- Популярное

- После

- практиками

- предыдущий

- Предварительный

- приз

- обработка

- процессор

- Производство

- обещанный

- обеспечивать

- при условии

- приводит

- pytorch

- ассортимент

- Ранжирование

- достигать

- Reading

- получила

- рекомендует

- Red

- Red Hat

- уменьшить

- Цена снижена

- исследованиям

- Итоги

- Run

- sagemaker

- Вывод SageMaker

- то же

- экономия

- Шкала

- Сценарии

- scikit учиться

- посмотреть

- выбор

- старший

- обслуживание

- Услуги

- несколько

- она

- показывать

- Шоу

- значительный

- аналогичный

- So

- Software

- разработка программного обеспечения

- Инженер-программист

- Решения

- специалист

- специализированный

- Стабильность

- современное состояние

- Шаг

- Шаги

- простой

- поддержки

- Поддержка

- Коммутатор

- системы

- взять

- с

- Обучение

- команда

- Технический

- tensorflow

- terms

- чем

- который

- Ассоциация

- информация

- Их

- этой

- три

- время

- в

- инструменты

- Путешествие

- напишите

- Типы

- us

- юзабилити

- использование

- используемый

- через

- различный

- поставщики

- видение

- хотеть

- we

- Web

- веб-сервисы

- ЧТО Ж

- который

- будете

- Работа

- работавший

- работает

- XGBoost

- лет

- Ты

- ВАШЕ

- зефирнет