Развитие контекстного и семантического поиска сделало предприятия электронной коммерции и розничной торговли более простыми в поиске своих потребителей. Поисковые системы и системы рекомендаций, основанные на генеративном искусственном интеллекте, могут значительно улучшить процесс поиска продуктов, понимая запросы на естественном языке и возвращая более точные результаты. Это улучшает общий пользовательский опыт, помогая клиентам найти именно то, что они ищут.

Сервис Amazon OpenSearch теперь поддерживает косинусное подобие метрика для индексов k-NN. Подобие косинуса измеряет косинус угла между двумя векторами, где меньший угол косинуса означает большее сходство между векторами. С помощью косинусного сходства вы можете измерить ориентацию между двумя векторами, что делает его хорошим выбором для некоторых конкретных приложений семантического поиска.

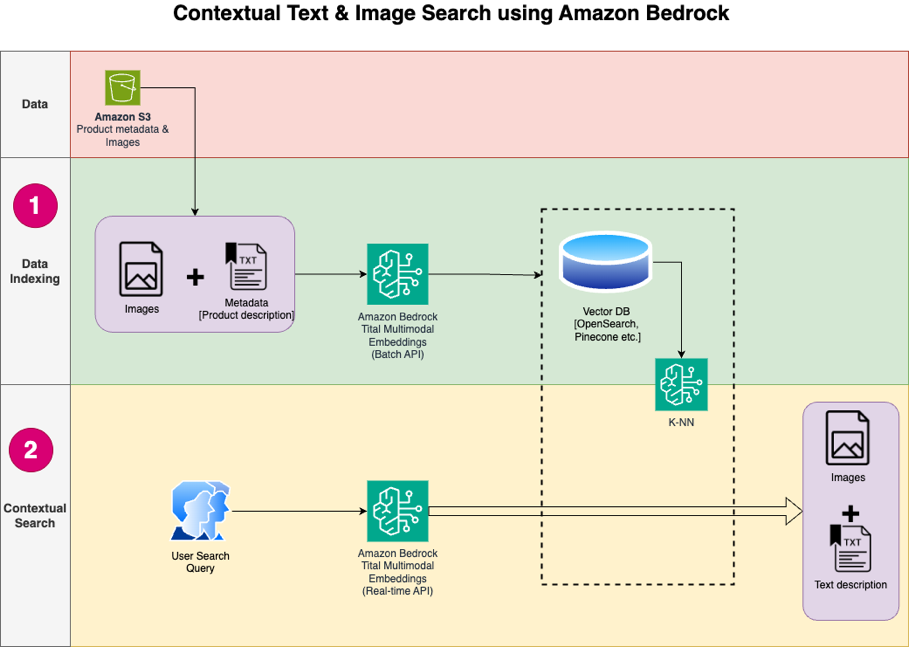

В этом посте мы покажем, как создать контекстную поисковую систему по тексту и изображениям для рекомендаций по продуктам, используя Модель мультимодальных вложений Amazon Titan, доступно в Коренная порода Амазонкипризывают Amazon OpenSearch без сервера.

Модель мультимодального внедрения предназначена для изучения совместных представлений различных модальностей, таких как текст, изображения и аудио. Обучаясь на крупномасштабных наборах данных, содержащих изображения и соответствующие им подписи, модель мультимодального внедрения учится встраивать изображения и тексты в общее скрытое пространство. Ниже приводится общий обзор того, как это работает концептуально:

- Отдельные кодеры – Эти модели имеют отдельные кодеры для каждой модальности — текстовый кодировщик для текста (например, BERT или RoBERTa), кодировщик изображений для изображений (например, CNN для изображений) и аудиокодеры для звука (например, такие модели, как Wav2Vec). . Каждый кодер генерирует вложения, фиксирующие семантические особенности соответствующих модальностей.

- Слияние модальностей – Вложения из унимодальных кодеров объединяются с использованием дополнительных слоев нейронной сети. Цель состоит в том, чтобы изучить взаимодействия и корреляции между модальностями. Общие подходы к слиянию включают конкатенацию, поэлементные операции, объединение и механизмы внимания.

- Общее пространство представления – Слои слияния помогают спроецировать отдельные модальности в общее пространство представления. Обучаясь на мультимодальных наборах данных, модель изучает общее пространство внедрения, в котором внедрения каждой модальности, представляющие одно и то же базовое семантическое содержание, расположены ближе друг к другу.

- Последующие задачи – Созданные совместные мультимодальные внедрения могут затем использоваться для различных последующих задач, таких как мультимодальный поиск, классификация или перевод. Модель использует корреляции между модальностями для повышения производительности этих задач по сравнению с отдельными модальными вложениями. Ключевым преимуществом является способность понимать взаимодействие и семантику между такими модальностями, как текст, изображения и аудио, посредством совместного моделирования.

Обзор решения

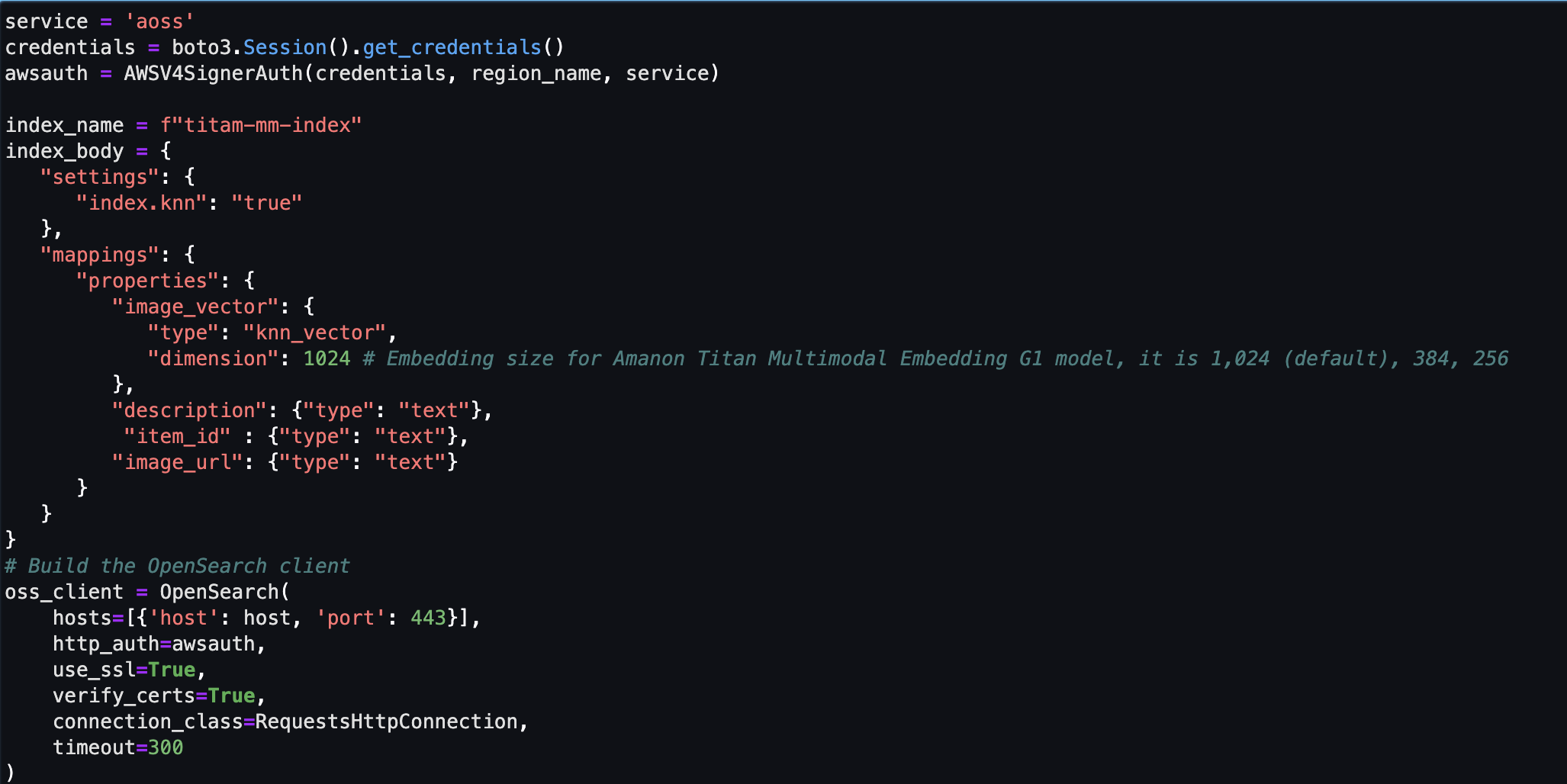

Решение обеспечивает реализацию создания прототипа поисковой системы на основе большой языковой модели (LLM) для поиска и рекомендации продуктов на основе текстовых или графических запросов. Мы подробно описываем шаги по использованию Мультимодальные встраивания Amazon Titan модель для кодирования изображений и текста во внедрения, приема внедрений в индекс службы OpenSearch и запроса индекса с помощью службы OpenSearch. Функциональность k-ближайших соседей (k-NN).

Это решение включает в себя следующие компоненты:

- Модель мультимодальных вложений Amazon Titan – Эта базовая модель (FM) генерирует встраивания изображений продуктов, использованных в этом посте. С помощью мультимодальных встраиваний Amazon Titan вы можете создавать встраивания для своего контента и хранить их в векторной базе данных. Когда конечный пользователь отправляет любую комбинацию текста и изображения в качестве поискового запроса, модель генерирует внедрения для поискового запроса и сопоставляет их с сохраненными внедрениями, чтобы предоставить конечным пользователям релевантные результаты поиска и рекомендации. Вы можете дополнительно настроить модель, чтобы она лучше понимала ваш уникальный контент и обеспечивала более значимые результаты, используя пары изображение-текст для точной настройки. По умолчанию модель генерирует векторы (вложения) 1,024 измерений, а доступ к ней осуществляется через Amazon Bedrock. Вы также можете создавать меньшие размеры для оптимизации скорости и производительности.

- Amazon OpenSearch без сервера – Это бессерверная конфигурация по требованию для службы OpenSearch. Мы используем Amazon OpenSearch Serverless в качестве векторной базы данных для хранения внедрений, созданных с помощью модели мультимодальных внедрений Amazon Titan. Индекс, созданный в бессерверной коллекции Amazon OpenSearch, служит векторным хранилищем для нашего решения Retrieval Augmented Generation (RAG).

- Студия Amazon SageMaker – Это интегрированная среда разработки (IDE) для машинного обучения (ML). Специалисты по машинному обучению могут выполнять все этапы разработки машинного обучения — от подготовки данных до построения, обучения и развертывания моделей машинного обучения.

Конструкция решения состоит из двух частей: индексации данных и контекстного поиска. Во время индексации данных вы обрабатываете изображения продуктов для создания вложений для этих изображений, а затем заполняете хранилище векторных данных. Эти шаги выполняются до шагов взаимодействия с пользователем.

На этапе контекстного поиска поисковый запрос (текст или изображение) от пользователя преобразуется во встраивания, и в базе данных векторов выполняется поиск по сходству, чтобы найти похожие изображения продуктов на основе поиска по сходству. Затем вы отображаете лучшие похожие результаты. Весь код для этого поста доступен в Репо GitHub.

Следующая диаграмма иллюстрирует архитектуру решения.

Ниже приведены этапы рабочего процесса решения:

- Скачать текст описания товара и изображения из паблика Простой сервис хранения Amazon (Amazon S3) ведро.

- Просмотрите и подготовьте набор данных.

- Создайте внедрения для изображений продуктов с помощью модели мультимодальных внедрений Amazon Titan (amazon.titan-embed-image-v1). Если у вас огромное количество изображений и описаний, при желании можно использовать Пакетный вывод для Amazon Bedrock.

- Хранить вложения в Amazon OpenSearch без сервера как поисковик.

- Наконец, извлеките пользовательский запрос на естественном языке, преобразуйте его во внедрения с помощью модели мультимодальных внедрений Amazon Titan и выполните поиск по k-NN, чтобы получить релевантные результаты поиска.

В качестве IDE для разработки решения мы используем SageMaker Studio (не показана на схеме).

Эти шаги подробно обсуждаются в следующих разделах. Мы также прилагаем скриншоты и подробную информацию о результатах.

Предпосылки

Чтобы реализовать решение, представленное в этом посте, у вас должно быть следующее:

- An Аккаунт AWS и знакомство с FM, Amazon Bedrock, Создатель мудреца Амазонкии Служба OpenSearch.

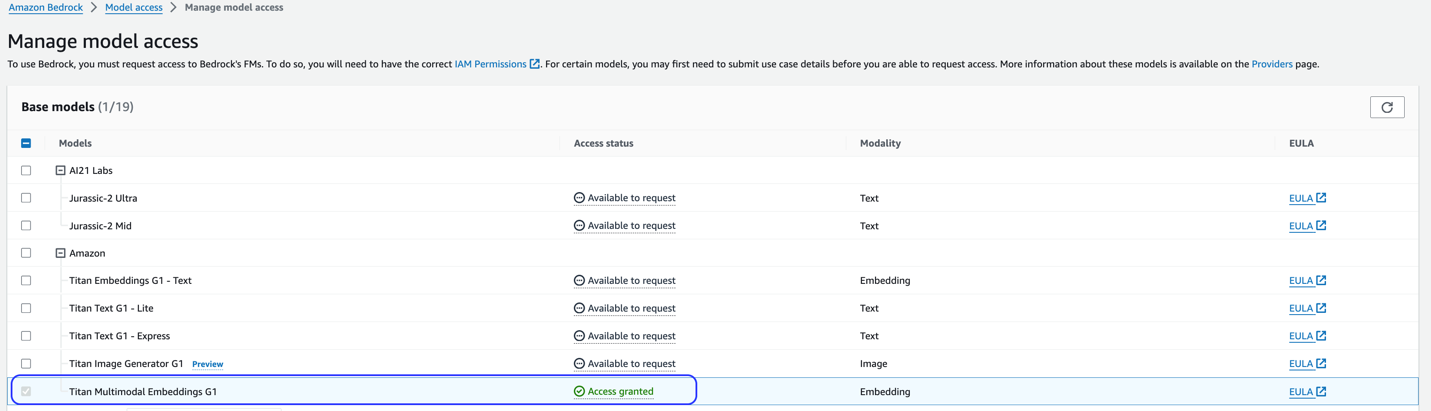

- Модель мультимодального внедрения Amazon Titan включена в Amazon Bedrock. Вы можете подтвердить, что он включен на Доступ к модели страница консоли Amazon Bedrock. Если мультимодальные внедрения Amazon Titan включены, статус доступа будет отображаться как Доступ предоставлен, как показано на следующем скриншоте.

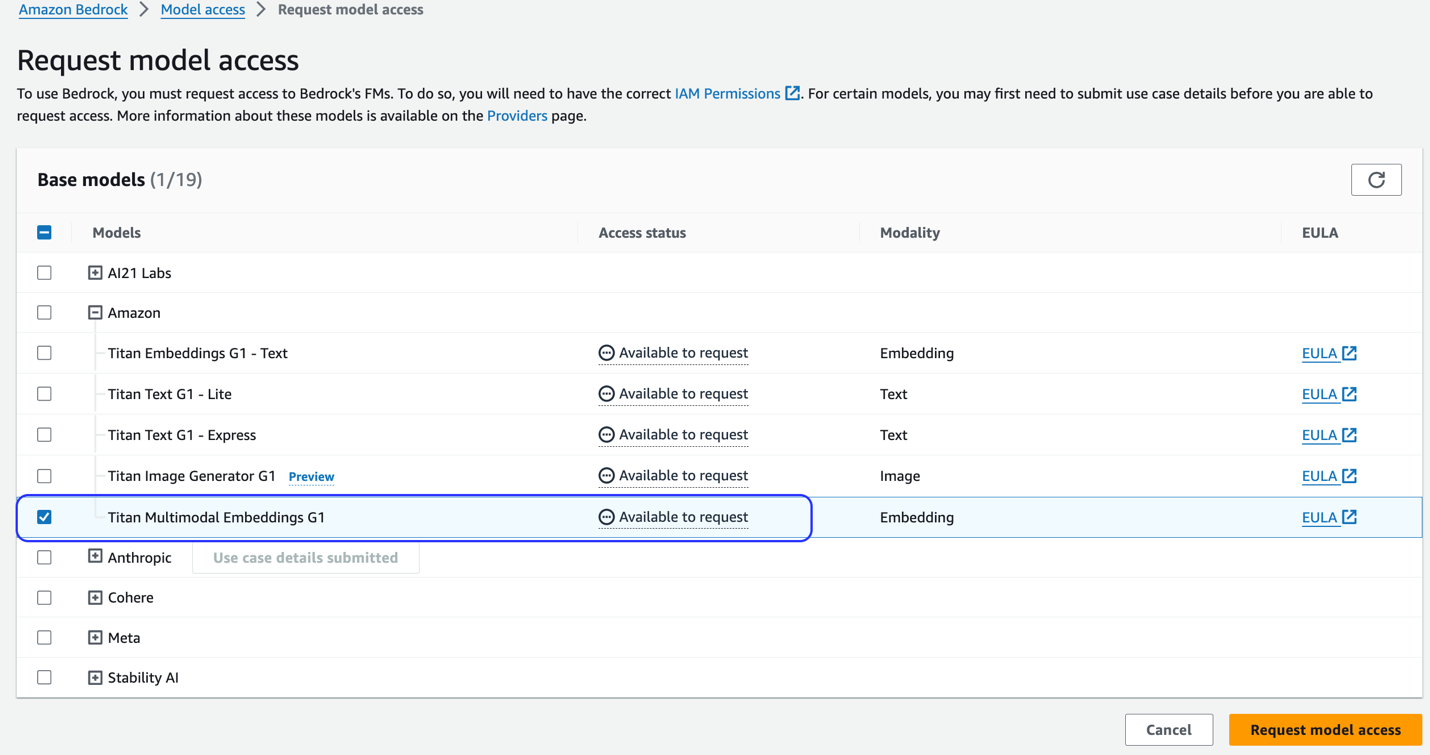

Если модель недоступна, включите доступ к модели, выбрав Управление доступом к модели, выбирая Мультимодальные встраивания Amazon Titan G1, и выбор Запросить доступ к модели. Модель сразу же становится доступной для использования.

Настройка решения

После выполнения необходимых шагов вы готовы к настройке решения:

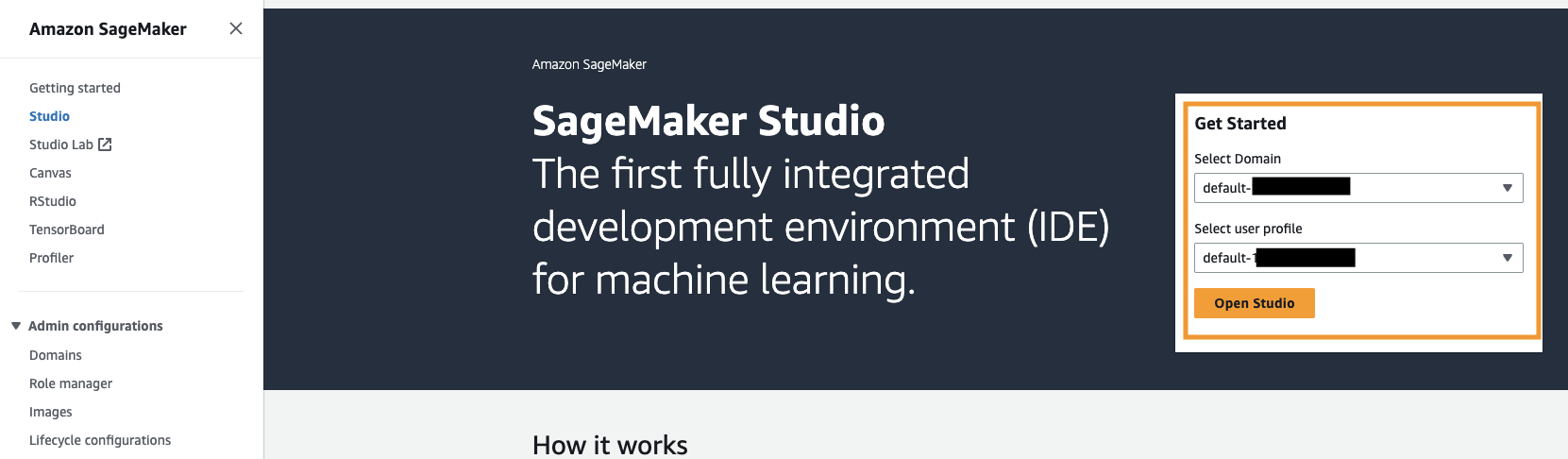

- В своей учетной записи AWS откройте консоль SageMaker и выберите Студия в навигационной панели.

- Выберите свой домен и профиль пользователя, затем выберите Открытая студия.

Имя вашего домена и профиля пользователя могут отличаться.

- Выберите Системный терминал под Утилиты и файлы.

- Запустите следующую команду, чтобы клонировать Репо GitHub в экземпляр SageMaker Studio:

- Перейдите в

multimodal/Titan/titan-multimodal-embeddings/amazon-bedrock-multimodal-oss-searchengine-e2eпапку. - Откройте приложение

titan_mm_embed_search_blog.ipynbБлокнот.

Запустите решение

Открыть файл titan_mm_embed_search_blog.ipynb и используйте ядро Data Science Python 3. На Run Меню, выберите Запустить все ячейки чтобы запустить код в этом блокноте.

Этот блокнот выполняет следующие действия:

- Установите пакеты и библиотеки, необходимые для этого решения.

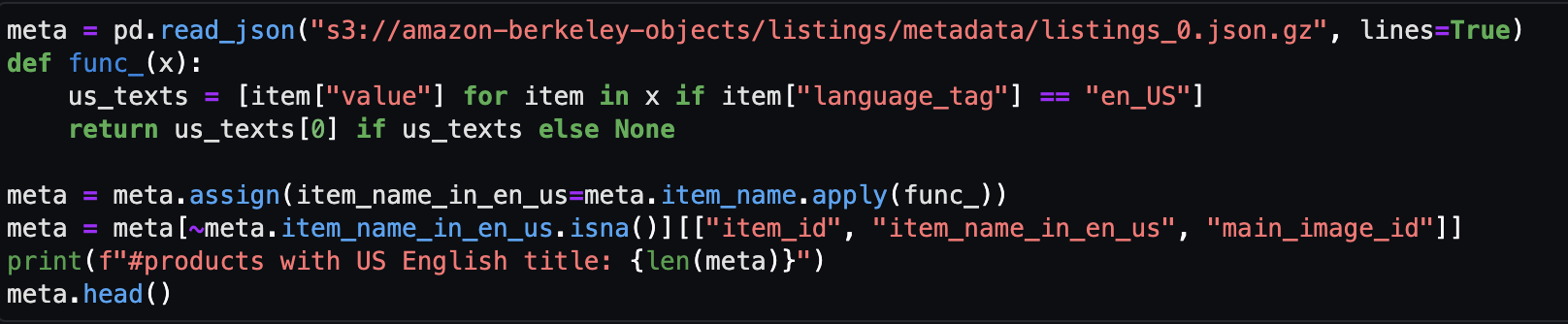

- Загрузите общедоступный Набор данных объектов Amazon Berkeley и метаданные во фрейме данных pandas.

Набор данных представляет собой коллекцию из 147,702 398,212 списков продуктов с многоязычными метаданными и 1,600 XNUMX уникальных изображений каталога. В этом посте вы используете изображения и названия предметов только на английском языке (США). Вы используете около XNUMX продуктов.

- Сгенерируйте внедрения для изображений элементов с помощью модели мультимодальных внедрений Amazon Titan с помощью

get_titan_multomodal_embedding()функция. Для абстракции мы определили все важные функции, используемые в этом блокноте, вutils.py.

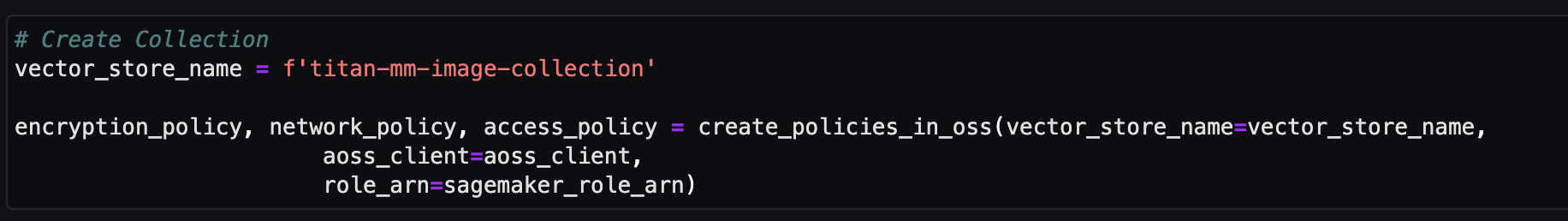

Затем вы создаете и настраиваете бессерверное векторное хранилище Amazon OpenSearch (коллекцию и индекс).

- Прежде чем создавать новую коллекцию векторного поиска и индекс, необходимо сначала создать три связанные политики OpenSearch Service: политику безопасности шифрования, политику сетевой безопасности и политику доступа к данным.

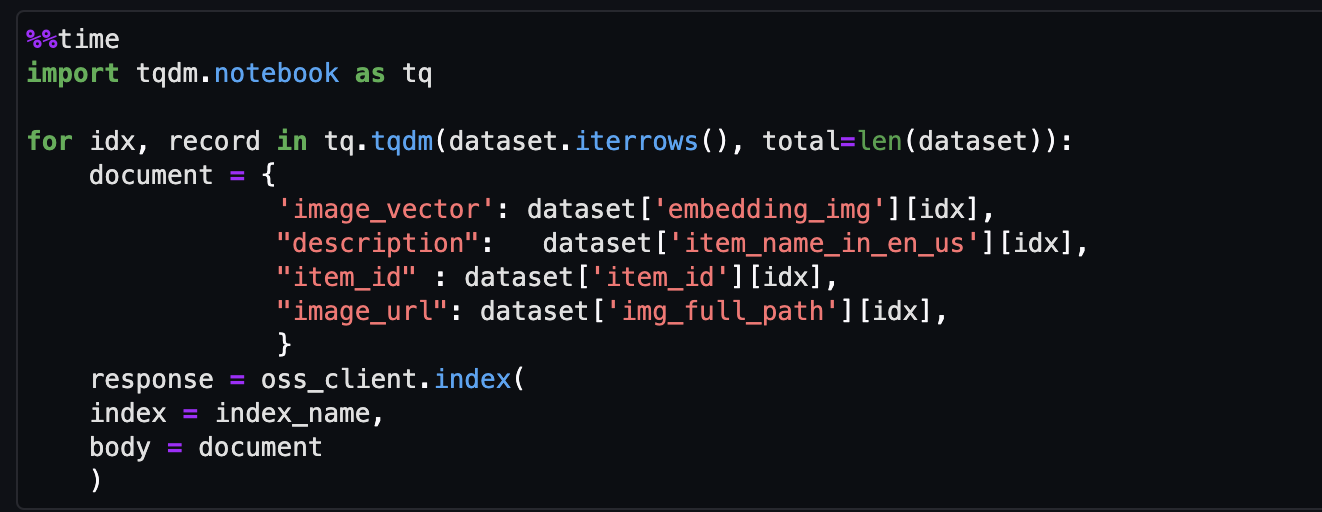

- Наконец, вставьте изображение в векторный индекс.

Теперь вы можете выполнять мультимодальный поиск в режиме реального времени.

Запустите контекстный поиск

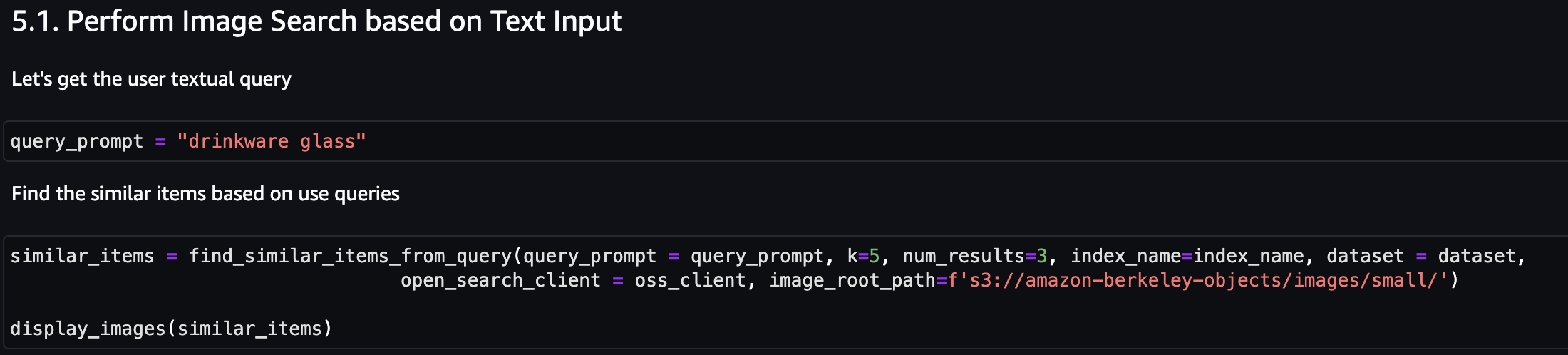

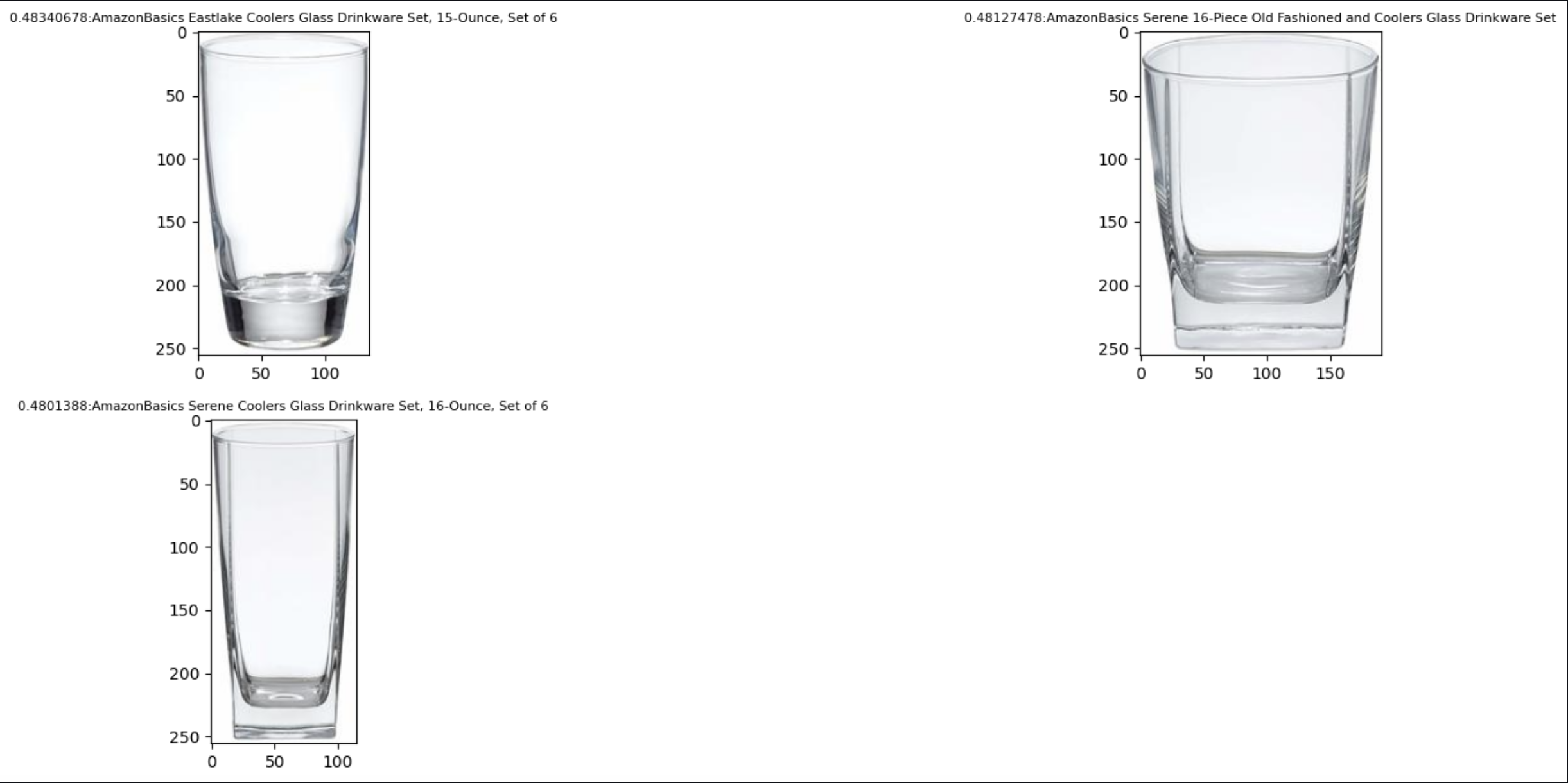

В этом разделе мы показываем результаты контекстного поиска по текстовому или графическому запросу.

Сначала давайте выполним поиск изображений на основе ввода текста. В следующем примере мы используем текстовый ввод «стакан для питья» и отправляем его в поисковую систему для поиска похожих предметов.

На следующем снимке экрана показаны результаты.

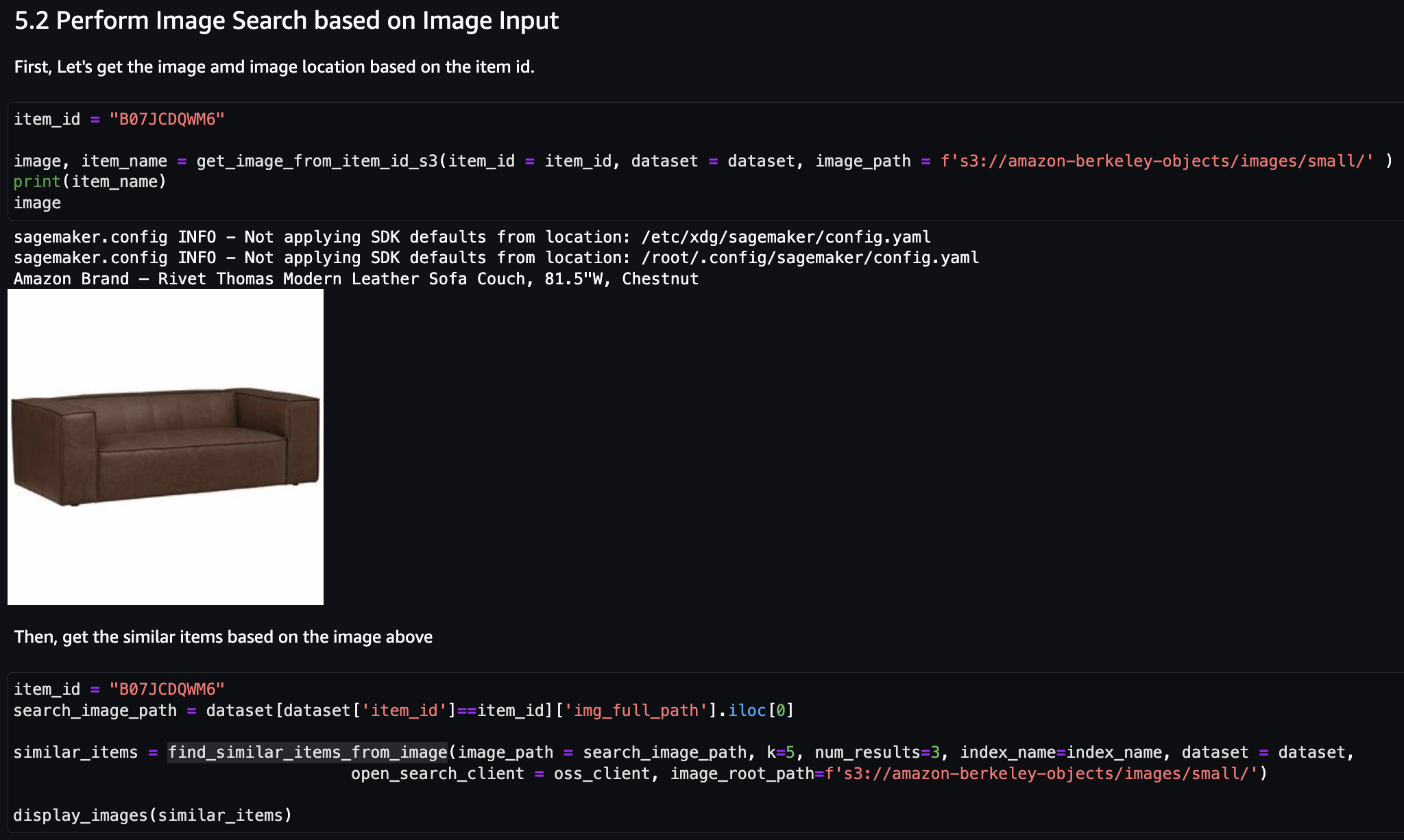

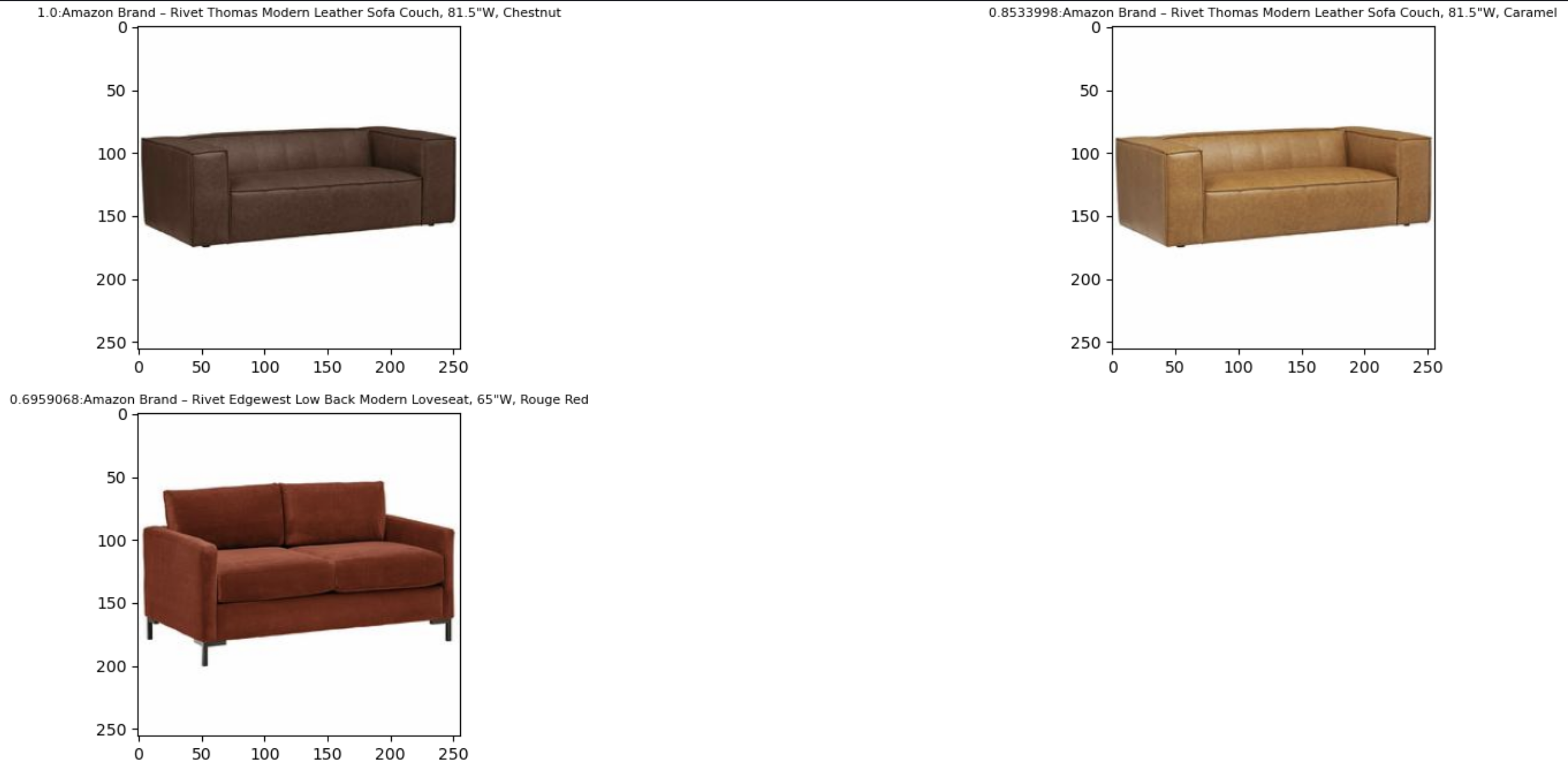

Теперь давайте посмотрим на результаты на основе простого изображения. Входное изображение преобразуется в векторные представления, и на основе поиска по сходству модель возвращает результат.

Вы можете использовать любое изображение, но в следующем примере мы используем случайное изображение из набора данных на основе идентификатора элемента (например, item_id = «B07JCDQWM6»), а затем отправьте это изображение в поисковую систему для поиска похожих предметов.

На следующем снимке экрана показаны результаты.

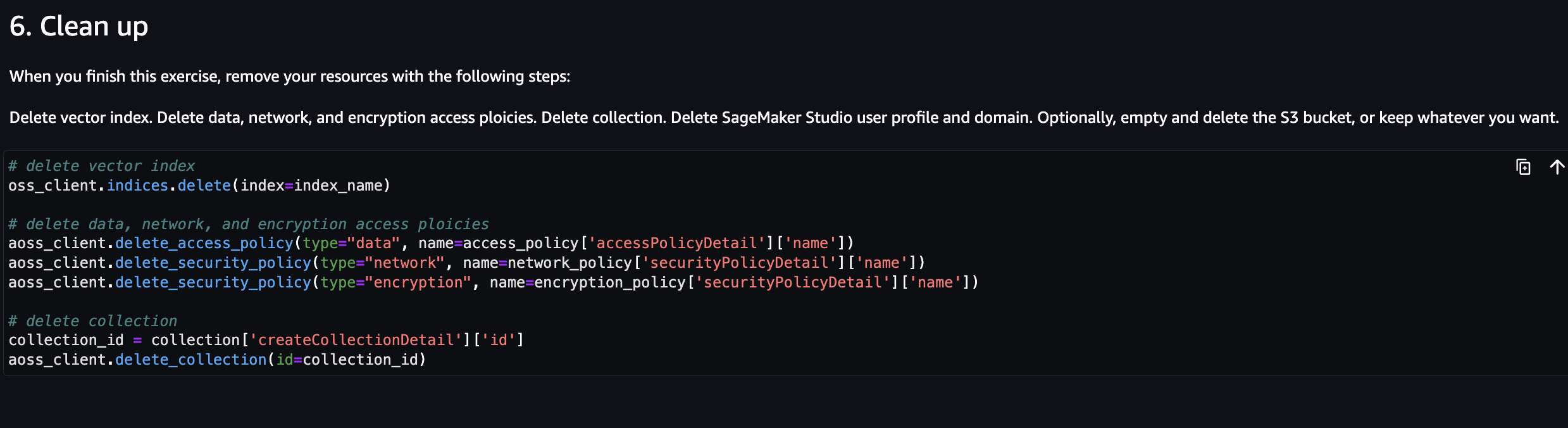

Убирать

Чтобы избежать будущих расходов, удалите ресурсы, используемые в этом решении. Вы можете сделать это, запустив раздел очистки блокнота.

Заключение

В этом посте представлено пошаговое руководство по использованию модели мультимодального внедрения Amazon Titan в Amazon Bedrock для создания мощных приложений контекстного поиска. В частности, мы продемонстрировали пример приложения для поиска по товарному списку. Мы увидели, как модель внедрения обеспечивает эффективное и точное обнаружение информации из изображений и текстовых данных, тем самым улучшая взаимодействие с пользователем при поиске соответствующих элементов.

Amazon Titan Multimodal Embeddings помогает обеспечить более точный и контекстно-релевантный мультимодальный поиск, рекомендации и персонализацию для конечных пользователей. Например, компания, занимающаяся стоковой фотографией и имеющая сотни миллионов изображений, может использовать эту модель для расширения своих функций поиска, чтобы пользователи могли искать изображения, используя фразу, изображение или комбинацию изображения и текста.

Модель мультимодального внедрения Amazon Titan в Amazon Bedrock теперь доступна в регионах AWS Восток США (Сев. Вирджиния) и Запад США (Орегон). Чтобы узнать больше, обратитесь к Генератор изображений Amazon Titan, мультимодальные встраивания и текстовые модели теперь доступны в Amazon Bedrock., Страница продукта Amazon Titan, и Руководство пользователя Amazon Bedrock. Чтобы начать работу с мультимодальными встраиваниями Amazon Titan в Amazon Bedrock, посетите Консоль Amazon Bedrock.

Начните создавать модели Amazon Titan Multimodal Embeddings в Коренная порода Амазонки прямо сейчас

Об авторах

Сандип Сингх — старший специалист по данным генеративного ИИ в Amazon Web Services, помогающий предприятиям внедрять инновации с помощью генеративного ИИ. Он специализируется на генеративном искусственном интеллекте, искусственном интеллекте, машинном обучении и системном проектировании. Он увлечен разработкой современных решений на базе искусственного интеллекта и машинного обучения для решения сложных бизнес-задач для различных отраслей, оптимизации эффективности и масштабируемости.

Сандип Сингх — старший специалист по данным генеративного ИИ в Amazon Web Services, помогающий предприятиям внедрять инновации с помощью генеративного ИИ. Он специализируется на генеративном искусственном интеллекте, искусственном интеллекте, машинном обучении и системном проектировании. Он увлечен разработкой современных решений на базе искусственного интеллекта и машинного обучения для решения сложных бизнес-задач для различных отраслей, оптимизации эффективности и масштабируемости.

Мани Хануджа — технический руководитель, специалисты по генеративному искусственному интеллекту, автор книги «Прикладное машинное обучение и высокопроизводительные вычисления на AWS», а также член совета директоров Фонда образования женщин в производстве. Она возглавляет проекты машинного обучения в различных областях, таких как компьютерное зрение, обработка естественного языка и генеративный искусственный интеллект. Она выступает на внутренних и внешних конференциях, таких как AWS re:Invent, Women in Manufacturing West, вебинарах YouTube и GHC 23. В свободное время она любит совершать длительные пробежки по пляжу.

Мани Хануджа — технический руководитель, специалисты по генеративному искусственному интеллекту, автор книги «Прикладное машинное обучение и высокопроизводительные вычисления на AWS», а также член совета директоров Фонда образования женщин в производстве. Она возглавляет проекты машинного обучения в различных областях, таких как компьютерное зрение, обработка естественного языка и генеративный искусственный интеллект. Она выступает на внутренних и внешних конференциях, таких как AWS re:Invent, Women in Manufacturing West, вебинарах YouTube и GHC 23. В свободное время она любит совершать длительные пробежки по пляжу.

Рупиндер Гревал — старший специалист по архитектуре решений AI/ML в AWS. В настоящее время он занимается обслуживанием моделей и MLOps в Amazon SageMaker. До этой должности он работал инженером по машинному обучению, создавая и размещая модели. Вне работы он любит играть в теннис и кататься на велосипеде по горным тропам.

Рупиндер Гревал — старший специалист по архитектуре решений AI/ML в AWS. В настоящее время он занимается обслуживанием моделей и MLOps в Amazon SageMaker. До этой должности он работал инженером по машинному обучению, создавая и размещая модели. Вне работы он любит играть в теннис и кататься на велосипеде по горным тропам.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-text-and-image-search-engine-for-product-recommendations-using-amazon-bedrock-and-amazon-opensearch-serverless/

- :имеет

- :является

- :нет

- :куда

- $UP

- 1

- 100

- 125

- 212

- 23

- 258

- 411

- 600

- 7

- 89

- a

- способность

- О нас

- абстракция

- доступ

- Доступ

- Учетная запись

- точный

- через

- дополнительный

- плюс

- AI

- Данные AI

- AI / ML

- Все

- вдоль

- причислены

- Amazon

- Создатель мудреца Амазонки

- Amazon Web Services

- an

- и

- угол

- любой

- Применение

- Приложения

- прикладной

- подходы

- примерно

- архитектура

- МЫ

- искусственный

- искусственный интеллект

- AS

- связанный

- At

- внимание

- аудио

- дополненная

- автор

- доступен

- избежать

- AWS

- AWS Re: Invent

- основанный

- BE

- Beach

- Беркли

- между

- доска

- совет директоров

- книга

- строить

- Строительство

- бизнес

- бизнес

- но

- by

- CAN

- Подписи

- Захват

- расходы

- выбор

- Выберите

- Выбирая

- классификация

- ближе

- CNN

- код

- лыжных шлемов

- сочетание

- сочетании

- Общий

- Компания

- сравненный

- полный

- Заполненная

- комплекс

- компоненты

- компьютер

- Компьютерное зрение

- вычисление

- Концептуально

- конференции

- Конфигурация

- подтвердить

- состоит

- Консоли

- Потребители

- содержание

- контекстной

- конвертировать

- переделанный

- корреляции

- соответствующий

- Создайте

- создали

- В настоящее время

- Клиенты

- настроить

- данным

- доступ к данным

- наука о данных

- ученый данных

- База данных

- Наборы данных

- По умолчанию

- определенный

- убивают

- обозначает

- развертывание

- описание

- Проект

- предназначенный

- подробность

- подробнее

- развивать

- развивающийся

- Развитие

- диаграмма

- различный

- размеры

- Директора

- открытие

- обсуждается

- Дисплей

- Разное

- do

- домен

- доменов

- в течение

- каждый

- восток

- электронной коммерции

- Обучение

- затрат

- эффективный

- вставлять

- вложения

- включить

- включен

- позволяет

- шифрование

- Двигатель

- инженер

- Двигатели

- Английский

- повышать

- Усиливает

- повышение

- Окружающая среда

- точно,

- пример

- опыт

- Впечатления

- экспоненциально

- и, что лучший способ

- фамильярность

- Особенности

- Файл

- Найдите

- First

- фокусируется

- после

- Что касается

- Год основания

- КАДР

- Бесплатно

- от

- функция

- функциональность

- Функции

- далее

- слияние

- будущее

- порождать

- генерируется

- генерирует

- поколение

- генеративный

- Генеративный ИИ

- генератор

- получить

- получает

- Go

- цель

- хорошо

- Есть

- he

- помощь

- помощь

- помогает

- ее

- High

- на высшем уровне

- высший

- хостинг

- Как

- How To

- HTML

- HTTP

- HTTPS

- огромный

- Сотни

- сотни миллионов

- ID

- if

- иллюстрирует

- изображение

- Поиск картинок

- изображений

- немедленно

- осуществлять

- реализация

- важную

- улучшать

- in

- включают

- включает в себя

- индекс

- Индексы

- individual

- промышленности

- информация

- обновлять

- вход

- пример

- интегрированный

- Интеллекта

- взаимодействие

- взаимодействие

- в нашей внутренней среде,

- в

- IT

- пункты

- ЕГО

- совместная

- JPEG

- Основные

- язык

- большой

- крупномасштабный

- слоев

- вести

- Лиды

- УЧИТЬСЯ

- изучение

- узнает

- библиотеки

- такое как

- нравится

- листинг

- Объявления

- LLM

- Длинное

- посмотреть

- искать

- машина

- обучение с помощью машины

- сделанный

- ДЕЛАЕТ

- производство

- спички

- Май..

- значимым

- проводить измерение

- меры

- механизмы

- член

- Меню

- Метаданные

- метрический

- миллионы

- ML

- млн операций в секунду

- модель

- моделирование

- Модели

- БОЛЕЕ

- гора

- должен

- имя

- имена

- натуральный

- Обработка естественного языка

- Навигация

- соседи

- сеть

- Сетевая безопасность

- нервный

- нейронной сети

- Новые

- ноутбук

- сейчас

- номер

- объекты

- of

- on

- On-Demand

- только

- открытый

- Операционный отдел

- Оптимизировать

- оптимизирующий

- or

- Орегон

- наши

- выходной

- внешнюю

- общий

- обзор

- пакеты

- пар

- панд

- хлеб

- особый

- части

- страстный

- Выполнять

- производительность

- выполняет

- воплощение

- фаза

- фотография

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- игры

- сборах

- политика

- объединение

- После

- мощностью

- Питание

- мощный

- Подготовить

- подготовка

- предпосылка

- представлены

- Предварительный

- проблемам

- процесс

- обработка

- Продукт

- Продукция

- Профиль

- Проект

- проектов

- прототип

- обеспечивать

- при условии

- приводит

- что такое варган?

- публично

- Питон

- Запросы

- запрос

- тряпка

- случайный

- RE

- готовый

- реального времени

- рекомендовать

- Рекомендация

- рекомендаций

- относиться

- районы

- соответствующие

- представлять

- представление

- обязательный

- Полезные ресурсы

- те

- результат

- Итоги

- розничный

- поиск

- возвращение

- Возвращает

- Рост

- Роли

- Run

- Бег

- работает

- sagemaker

- Сакэ

- то же

- видел

- Масштабируемость

- Наука

- Ученый

- скриншоты

- Поиск

- Поисковая система

- Поисковые системы

- поиск

- Раздел

- разделах

- безопасность

- выбор

- семантический

- семантика

- Отправить

- старший

- отдельный

- Serverless

- служит

- обслуживание

- Услуги

- выступающей

- набор

- общие

- она

- должен

- показывать

- показанный

- Шоу

- аналогичный

- просто

- меньше

- So

- Решение

- Решения

- РЕШАТЬ

- некоторые

- Space

- Говорит

- специалист

- специалисты

- специализируется

- конкретный

- скорость

- и политические лидеры

- современное состояние

- Статус:

- Шаги

- акции

- диск

- магазин

- хранить

- хранение

- простой

- студия

- такие

- Поддержка

- система

- системы

- задачи

- технологии

- теннис

- текст

- текстовый

- который

- Ассоциация

- сустав

- их

- Их

- тогда

- тем самым

- Эти

- этой

- три

- Через

- время

- исполин

- в

- сегодня

- вместе

- топ

- Обучение

- Переводы

- два

- под

- лежащий в основе

- понимать

- понимание

- созданного

- us

- использование

- используемый

- Информация о пользователе

- Пользовательский опыт

- пользователей

- использования

- через

- различный

- с помощью

- Виргиния

- видение

- Войти

- прохождение

- we

- Web

- веб-сервисы

- Вебинары

- запад

- Что

- когда

- который

- в то время как

- Википедия.

- будете

- Женщина

- Работа

- работавший

- рабочий

- работает

- Ты

- ВАШЕ

- YouTube

- зефирнет