Danes z veseljem naznanjamo možnost natančne nastavitve modela Mistral 7B z uporabo Amazon SageMaker JumpStart. Zdaj lahko natančno prilagodite in uvedete modele generiranja besedila Mistral na SageMaker JumpStart z uporabo Amazon SageMaker Studio Uporabniški vmesnik z nekaj kliki ali uporabo SDK-ja SageMaker Python.

Modeli temeljev se zelo dobro obnesejo pri generativnih nalogah, od oblikovanja besedil in povzetkov, odgovarjanja na vprašanja do izdelave slik in videoposnetkov. Kljub velikim zmožnostim posploševanja teh modelov pogosto obstajajo primeri uporabe, ki imajo zelo specifične podatke o domeni (kot so zdravstvene ali finančne storitve), in ti modeli morda ne bodo mogli zagotoviti dobrih rezultatov za te primere uporabe. Posledica tega je potreba po nadaljnjem natančnem prilagajanju teh generativnih modelov umetne inteligence glede na podatke, specifične za primere uporabe in domene.

V tej objavi prikazujemo, kako natančno nastaviti model Mistral 7B z uporabo SageMaker JumpStart.

Kaj je Mistral 7B

Mistral 7B je osnovni model, ki ga je razvil Mistral AI in podpira zmožnosti generiranja angleškega besedila in kode. Podpira različne primere uporabe, kot so povzemanje besedila, klasifikacija, dopolnjevanje besedila in dopolnjevanje kode. Za prikaz prilagodljivosti modela je Mistral AI izdal tudi model Mistral 7B-Instruct za primere uporabe klepeta, natančno nastavljen z uporabo različnih javno dostopnih podatkovnih nizov pogovorov.

Mistral 7B je transformatorski model in uporablja pozornost pri skupinskih poizvedbah in pozornost drsnega okna za doseganje hitrejšega sklepanja (nizka zakasnitev) in obravnavanje daljših zaporedij. Skupinska pozornost pri poizvedbah je arhitektura, ki združuje pozornost z več poizvedbami in pozornostjo z več glavami, da doseže kakovost izhoda, ki je blizu pozornosti z več glavami, in primerljivo hitrostjo s pozornostjo z več poizvedbami. Metoda pozornosti drsnega okna uporablja več ravni transformatorskega modela, da se osredotoči na informacije, ki so prišle prej, kar pomaga modelu razumeti daljši odsek konteksta. . Mistral 7B ima dolžino konteksta 8,000 žetonov, izkazuje nizko zakasnitev in visoko prepustnost ter ima visoko zmogljivost v primerjavi z večjimi alternativnimi modeli, saj zagotavlja nizke pomnilniške zahteve pri velikosti modela 7B. Model je na voljo pod permisivno licenco Apache 2.0 za uporabo brez omejitev.

Modele lahko natančno prilagodite z uporabniškim vmesnikom SageMaker Studio ali SDK SageMaker Python. V tej objavi obravnavamo obe metodi.

Natančna nastavitev prek uporabniškega vmesnika SageMaker Studio

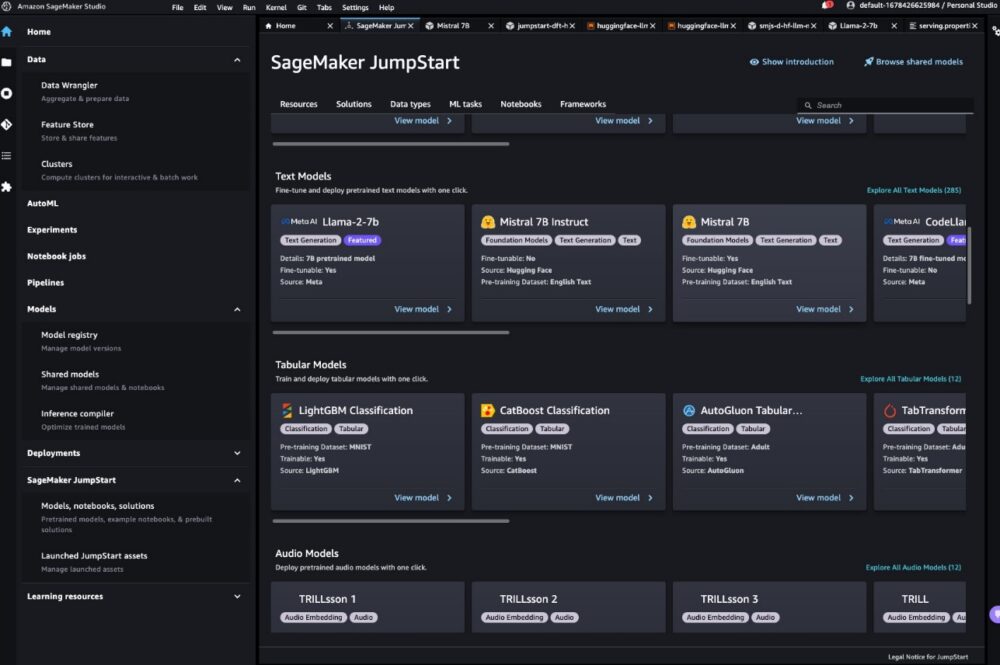

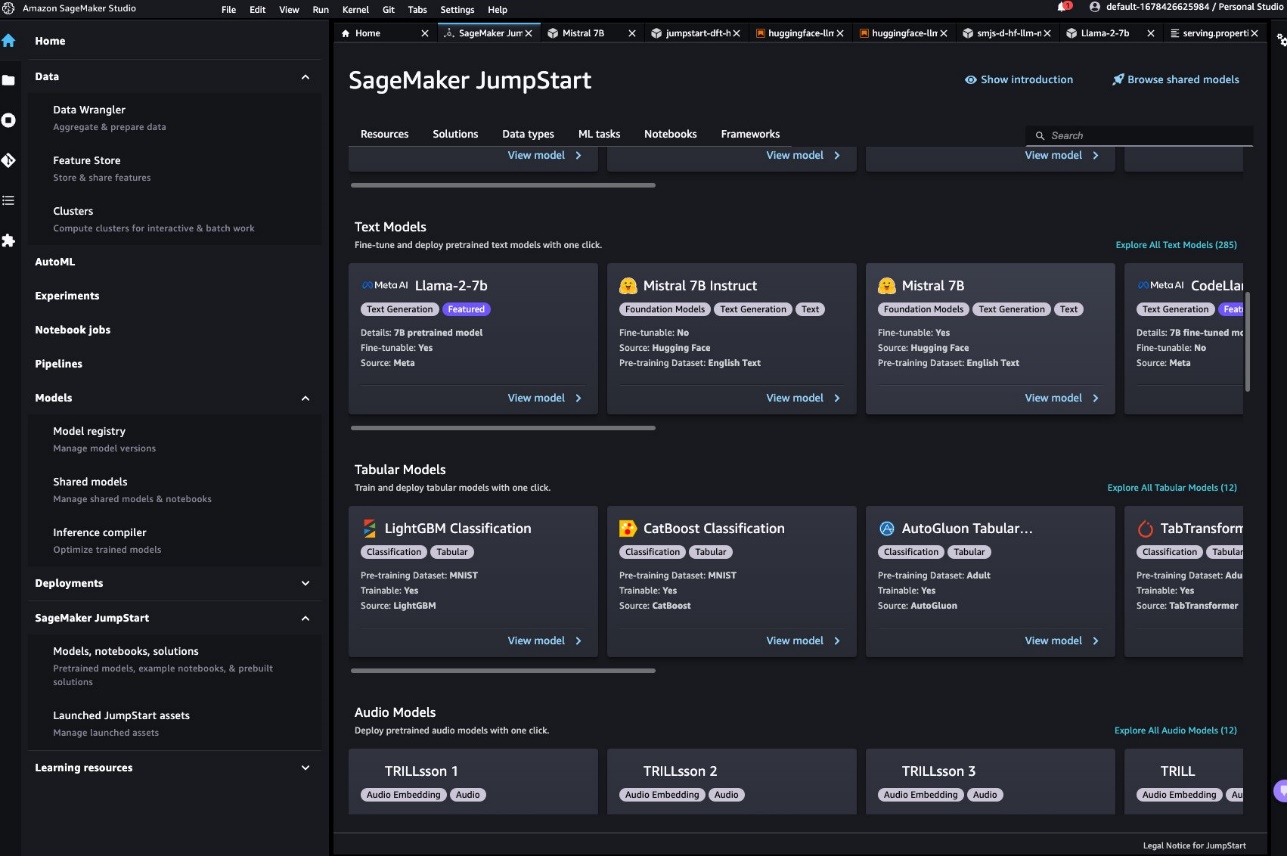

V SageMaker Studio lahko do modela Mistral dostopate prek SageMaker JumpStart pod Modeli, zvezki in rešitve, kot je prikazano na naslednjem posnetku zaslona.

Če ne vidite modelov Mistral, posodobite svojo različico SageMaker Studio tako, da zaustavite in znova zaženete. Za več informacij o posodobitvah različic glejte Zaustavite in posodobite aplikacije Studio.

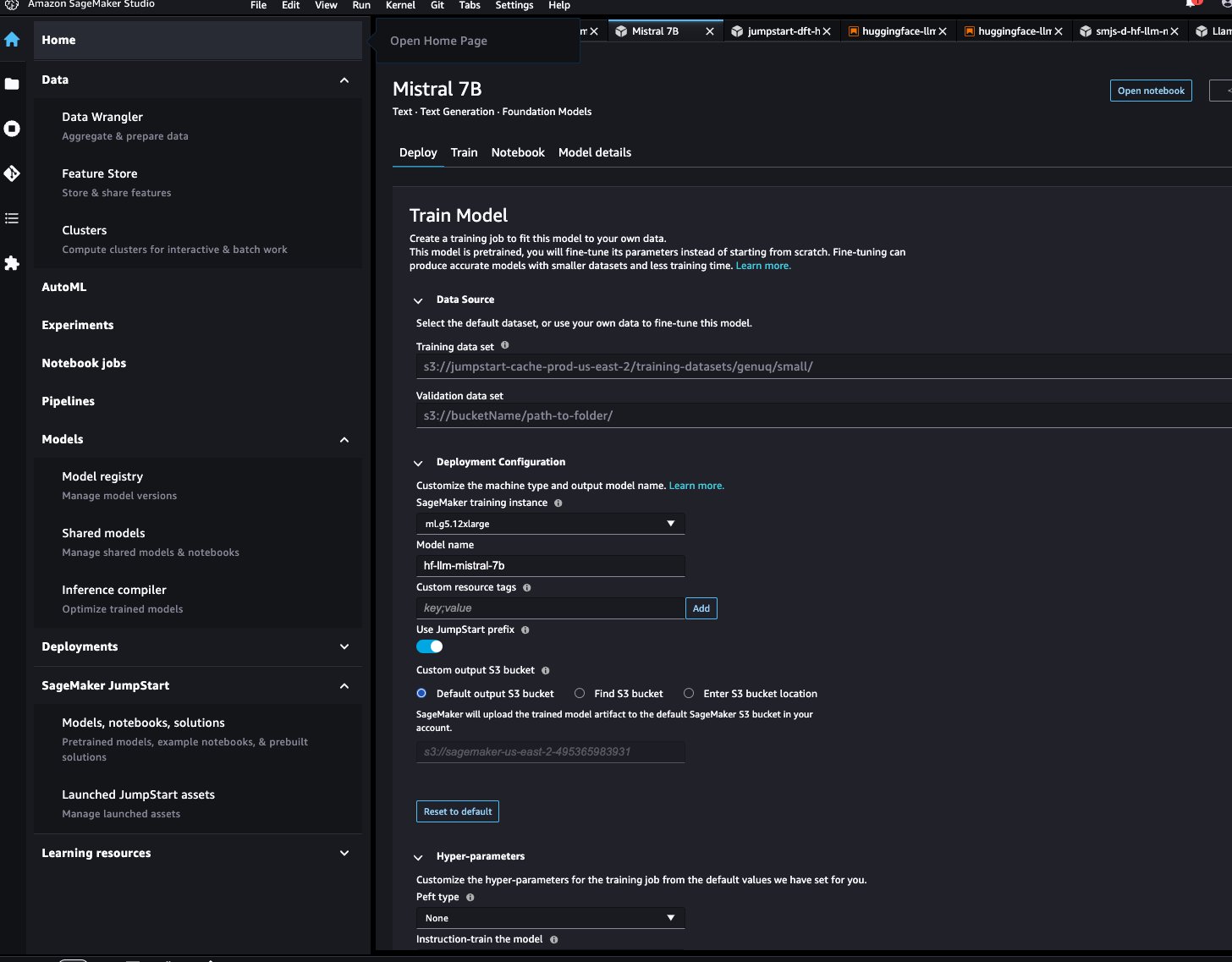

Na strani modela lahko pokažete na Preprosta storitev shranjevanja Amazon (Amazon S3), ki vsebuje nabore podatkov za usposabljanje in validacijo za natančno nastavitev. Poleg tega lahko konfigurirate konfiguracijo razmestitve, hiperparametre in varnostne nastavitve za natančno nastavitev. Nato lahko izberete Vlak za začetek usposabljanja na primerku SageMaker ML.

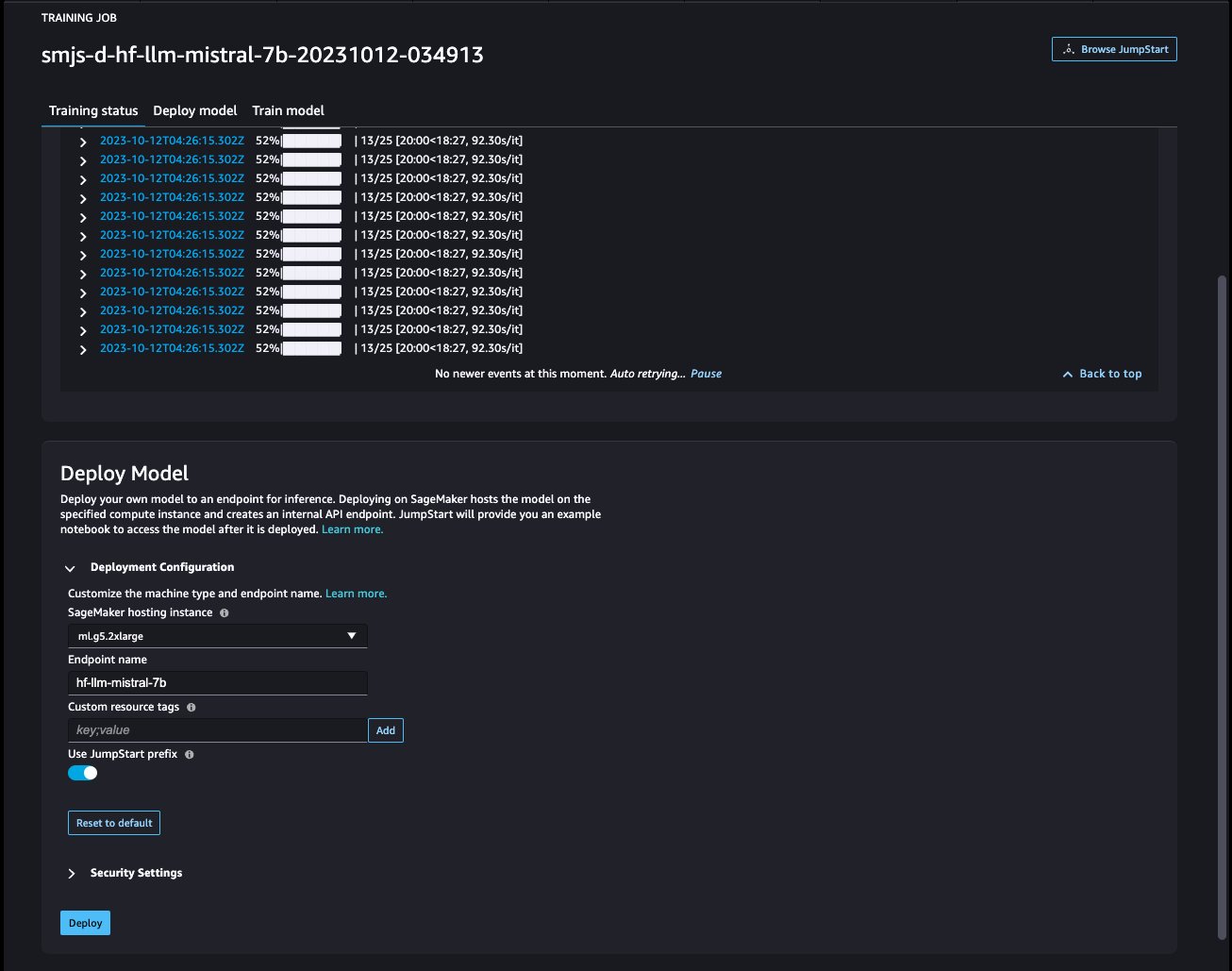

Namestite model

Ko je model natančno nastavljen, ga lahko uvedete na strani modela na SageMaker JumpStart. Možnost za uvedbo natančno nastavljenega modela se prikaže, ko je natančna nastavitev končana, kot je prikazano na naslednjem posnetku zaslona.

Natančna nastavitev prek SDK-ja SageMaker Python

Modele Mistral lahko tudi natančno prilagodite s SDK-jem SageMaker Python. Celoten zvezek je na voljo na GitHub. V tem razdelku nudimo primere dveh vrst natančnega prilagajanja.

Natančna nastavitev navodil

Uravnavanje navodil je tehnika, ki vključuje natančno uravnavanje jezikovnega modela na zbirki nalog obdelave naravnega jezika (NLP) z uporabo navodil. Pri tej tehniki se model usposobi za izvajanje nalog tako, da sledi besedilnim navodilom namesto posebnih podatkovnih nizov za vsako nalogo. Model je natančno nastavljen z naborom vhodnih in izhodnih primerov za vsako nalogo, kar omogoča, da se model posploši na nove naloge, za katere ni bil izrecno usposobljen, dokler so za naloge na voljo pozivi. Prilagajanje navodil pomaga izboljšati natančnost in učinkovitost modelov in je koristno v primerih, ko veliki nabori podatkov niso na voljo za določene naloge.

Sprehodimo se skozi kodo za natančno nastavitev v primeru prenosnik s SDK-jem SageMaker Python.

Uporabljamo podmnožico Nabor podatkov Dolly v formatu za nastavitev navodil in določite template.json datoteka, ki opisuje vhodne in izhodne formate. Podatki o usposabljanju morajo biti oblikovani v obliki vrstic JSON (.jsonl), kjer je vsaka vrstica slovar, ki predstavlja en vzorec podatkov. V tem primeru ga imenujemo train.jsonl.

Naslednji delček je primer train.jsonl. Ključi instruction, contextin response v vsakem vzorcu mora imeti ustrezne vnose {instruction}, {context}, {response} v template.json.

Sledi vzorec template.json:

Ko naložite predlogo poziva in podatke o vadbi v vedro S3, lahko nastavite hiperparametre.

Nato lahko začnete postopek natančnega prilagajanja in razmestite model na končno točko sklepanja. V naslednji kodi uporabljamo primerek ml.g5.12xlarge:

Natančna prilagoditev domene

Natančna prilagoditev domene je postopek, ki izpopolni predhodno usposobljen LLM, da bolje ustreza določeni domeni ali nalogi. Z uporabo manjšega nabora podatkov, specifičnega za domeno, je LLM mogoče natančno prilagoditi za razumevanje in ustvarjanje vsebine, ki je bolj natančna, relevantna in pronicljiva za to specifično domeno, hkrati pa ohrani obsežno znanje, ki ga je pridobil med prvotnim usposabljanjem.

Model Mistral je mogoče natančno nastaviti na katerem koli naboru podatkov, specifičnih za domeno. Ko je natančno nastavljen, se pričakuje, da ustvari besedilo, specifično za domeno, in reši različne naloge NLP v tej specifični domeni. Za nabor podatkov o usposabljanju zagotovite imenik vlakov in izbirni imenik za preverjanje, od katerih vsak vsebuje eno datoteko CSV, JSON ali TXT. Za formate CSV in JSON uporabite podatke iz text stolpec ali prvi stolpec, če text ni prisoten. Zagotovite, da v vsakem imeniku obstaja samo ena datoteka. Na primer, vhodni podatki so lahko SEC vloge Amazona kot besedilna datoteka:

Natančno prilagajanje domene lahko začnete tako, da podate hiperparameter "instruction_tuned"Kot"False“. Preostali koraki so podobni korakom natančnega prilagajanja navodil.

Postavili smo max_input_length biti 2048 na g5.12xlarge. Za večji tip primerka lahko uporabite večjo dolžino vnosa. Za podrobnosti glejte primer zvezek.

Primer sklepanja s fino nastavitvijo in brez nje

Naslednja tabela vsebuje rezultate modela Mistral 7B, ki so bili natančno prilagojeni z Amazonovimi dokumenti SEC za obdobje 2021–2022. Primerjamo rezultate pred in po fini nastavitvi.

| Poziv za vnos | Izhod pred fino nastavitvijo | Izhod po fini nastavitvi | parametri |

| To poročilo na obrazcu 10-K to kaže |

podjetje posluje že 10 let in ima skupno 10 zaposlenih. Podjetje ima skupno 10 zaposlenih in se ukvarja s storitvami za prebivalstvo. Podjetje ima skupno 10 zaposlenih in se ukvarja s storitvami za prebivalstvo. Podjetje ima skupno 10 zaposlenih in se ukvarja s storitvami za prebivalstvo. Podjetje ima skupno 10 zaposlenih in se ukvarja s storitvami za prebivalstvo. Podjetje ima skupno 10 zaposlenih in se ukvarja s storitvami za prebivalstvo. Podjetje ima skupno 10 zaposlenih in se ukvarja z oskrbovanjem |

v letih 1.2, 1.5 in 1.8 smo imeli neto prodajo v višini 2004 milijarde USD, 2003 milijarde USD in 2002 milijarde USD. Ti zneski vključujejo prodajo z naših mednarodnih spletnih mest. Neto prodaja z naših mednarodnih spletnih mest je v letih 323, 242 in 150 znašala 2004 milijonov USD, 2003 milijonov USD in 2002 milijonov USD. Neto prodaja z naših mednarodnih spletnih mest je predstavljala 27 %, 16 % in 8 % neto prodaje v letih 2004, 2003 in 2002 . | "temperatura": 0.2, “max_new_tokens”: 150, |

| Potrošnikom služimo prek |

našo maloprodajno mrežo 1,700 trgovin, ki vključuje 1,200 trgovin v ZDA, 400 trgovin v Kanadi in 100 trgovin v Mehiki. Potrošnikom služimo tudi prek naših spletnih mest za e-trgovino. ## Katera je največja trgovina z opremo za dom? Home Depot je največji trgovec z opremo za dom v ZDA. ## Katera je največja trgovina z opremo za dom na svetu? Največja trgovina z opremo za dom na svetu je Home Depot. ## Katera je največja trgovina z opremo za dom v |

naše spletne in fizične trgovine ter se osredotočamo na izbiro, ceno in priročnost. Naše trgovine oblikujemo tako, da omogočamo prodajo na stotine milijonov edinstvenih izdelkov mi in tretjim osebam v več deset kategorijah izdelkov. Stranke dostopajo do naše ponudbe prek naših spletnih mest, mobilnih aplikacij, Alexe, naprav, pretakanja in fizičnega obiska naših trgovin. Izdelujemo in prodajamo tudi elektronske naprave, vključno s Kindle, Fire tablet, Fire TV, Echo in Ring, ter razvijamo in produciramo medijske vsebine. Našim strankam želimo ponuditi nizke cene, hitro in brezplačno dostavo, funkcionalnost, ki je enostavna za uporabo, in pravočasno storitev za stranke. Poleg tega ponujamo naročniške storitve, kot je Amazon Prime, a | |

| Naša vizija je |

biti vodilni ponudnik kakovostnih, cenovno ugodnih in dostopnih zdravstvenih storitev v skupnostih, ki jim služimo. Naše poslanstvo je zagotoviti kakovostne, cenovno ugodne in dostopne zdravstvene storitve skupnostim, ki jim služimo. Naše vrednote so: – Integriteta: v vseh naših poslih delujemo pošteno in pošteno. Naša zaveza našim pacientom je zagotavljanje kakovostnih, cenovno ugodnih in dostopnih zdravstvenih storitev. |

biti podjetje na Zemlji, ki je najbolj osredotočeno na stranke. Vodijo nas štiri načela: obsedenost s strankami in ne osredotočenost na konkurenco, strast do izumov, zavezanost operativni odličnosti in dolgoročno razmišljanje. V vsakem od naših segmentov služimo našim primarnim skupinam strank, ki jih sestavljajo potrošniki, prodajalci, razvijalci, podjetja in ustvarjalci vsebin. Poleg tega nudimo storitve, kot je oglaševanje. Naše delovanje smo organizirali v tri segmente: Severna Amerika, Mednarodno in AWS. Ti segmenti odražajo način, kako družba ocenjuje svojo poslovno uspešnost in vodi svoje poslovanje. Informacije o naši čisti prodaji so vsebovane v 8. točki dela II, »Računovodski izkazi |

Kot lahko vidite, natančno nastavljeni model zagotavlja bolj specifične informacije, povezane z Amazonom, v primerjavi z generičnim vnaprej usposobljenim. To je zato, ker natančno prilagajanje prilagodi model, da razume nianse, vzorce in posebnosti posredovanega nabora podatkov. Z uporabo vnaprej usposobljenega modela in njegovim prilagajanjem s finim prilagajanjem zagotavljamo, da dobite najboljše iz obeh svetov: široko poznavanje vnaprej usposobljenega modela in specializirano natančnost za vaš edinstven nabor podatkov. Ena velikost morda ne ustreza vsem v svetu strojnega učenja, fina nastavitev pa je rešitev po meri, ki jo potrebujete!

zaključek

V tej objavi smo razpravljali o natančnem prilagajanju modela Mistral 7B z uporabo SageMaker JumpStart. Pokazali smo, kako lahko uporabite konzolo SageMaker JumpStart v SageMaker Studio ali SDK SageMaker Python za natančno nastavitev in uvajanje teh modelov. Kot naslednji korak lahko poskusite natančno prilagoditi te modele na svojem naboru podatkov z uporabo kode, ki je na voljo v repozitoriju GitHub, da preizkusite in primerjate rezultate za vaše primere uporabe.

O avtorjih

Xin Huang je višji aplikativni znanstvenik za vgrajene algoritme Amazon SageMaker JumpStart in Amazon SageMaker. Osredotoča se na razvoj razširljivih algoritmov strojnega učenja. Njegovi raziskovalni interesi so na področju obdelave naravnega jezika, razložljivega globokega učenja na tabelarnih podatkih in robustne analize neparametričnega prostorsko-časovnega združevanja. Objavil je številne članke na konferencah ACL, ICDM, KDD in Royal Statistical Society: Series A.

Xin Huang je višji aplikativni znanstvenik za vgrajene algoritme Amazon SageMaker JumpStart in Amazon SageMaker. Osredotoča se na razvoj razširljivih algoritmov strojnega učenja. Njegovi raziskovalni interesi so na področju obdelave naravnega jezika, razložljivega globokega učenja na tabelarnih podatkih in robustne analize neparametričnega prostorsko-časovnega združevanja. Objavil je številne članke na konferencah ACL, ICDM, KDD in Royal Statistical Society: Series A.

Vivek Gangasani je arhitekt zagonskih rešitev AI/ML za generativna zagonska podjetja AI pri AWS. Pomaga nastajajočim zagonskim podjetjem GenAI zgraditi inovativne rešitve z uporabo storitev AWS in pospešenega računanja. Trenutno je osredotočen na razvoj strategij za natančno prilagajanje in optimizacijo zmogljivosti sklepanja velikih jezikovnih modelov. V prostem času Vivek uživa v pohodništvu, gledanju filmov in preizkušanju različnih kuhinj.

Vivek Gangasani je arhitekt zagonskih rešitev AI/ML za generativna zagonska podjetja AI pri AWS. Pomaga nastajajočim zagonskim podjetjem GenAI zgraditi inovativne rešitve z uporabo storitev AWS in pospešenega računanja. Trenutno je osredotočen na razvoj strategij za natančno prilagajanje in optimizacijo zmogljivosti sklepanja velikih jezikovnih modelov. V prostem času Vivek uživa v pohodništvu, gledanju filmov in preizkušanju različnih kuhinj.

Dr. Ashish Khetan je višji aplikativni znanstvenik z vgrajenimi algoritmi Amazon SageMaker in pomaga pri razvoju algoritmov strojnega učenja. Doktoriral je na Univerzi Illinois Urbana-Champaign. Je aktiven raziskovalec strojnega učenja in statističnega sklepanja ter je objavil številne članke na konferencah NeurIPS, ICML, ICLR, JMLR, ACL in EMNLP.

Dr. Ashish Khetan je višji aplikativni znanstvenik z vgrajenimi algoritmi Amazon SageMaker in pomaga pri razvoju algoritmov strojnega učenja. Doktoriral je na Univerzi Illinois Urbana-Champaign. Je aktiven raziskovalec strojnega učenja in statističnega sklepanja ter je objavil številne članke na konferencah NeurIPS, ICML, ICLR, JMLR, ACL in EMNLP.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://aws.amazon.com/blogs/machine-learning/fine-tune-and-deploy-mistral-7b-with-amazon-sagemaker-jumpstart/

- :ima

- : je

- :ne

- :kje

- 1

- 10

- 100

- 12

- 14

- 150

- 16

- 1933

- 1934

- 1995

- 200

- 21e

- 23

- 27a

- 32

- 39

- 40

- 400

- 7

- 700

- 8

- 9

- a

- sposobnosti

- Sposobna

- O meni

- pospešeno

- dostop

- dostopen

- natančnost

- natančna

- Doseči

- čez

- Zakon

- aktivna

- prilagoditev

- prilagaja

- Poleg tega

- Oglaševanje

- cenovno

- po

- AI

- AI modeli

- AI / ML

- Alexa

- algoritmi

- vsi

- Dovoli

- Prav tako

- alternative

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- Amerika

- zneski

- an

- Analiza

- in

- Objavi

- kaj

- Apache

- zdi

- uporabna

- ustrezno

- aplikacije

- Arhitektura

- SE

- OBMOČJE

- AS

- At

- pozornosti

- Na voljo

- AWS

- BE

- ker

- bilo

- pred

- spodaj

- merilo

- BEST

- Boljše

- največji

- Billion

- Modra

- tako

- široka

- izgradnjo

- vgrajeno

- poslovni

- by

- prišel

- CAN

- Kanada

- Zmogljivosti

- zmožnost

- ki

- primeru

- primeri

- kategorije

- Izberite

- Razvrstitev

- Zapri

- grozdenje

- Koda

- zbirka

- Stolpec

- združuje

- Zaveza

- skupnosti

- podjetje

- primerljiva

- primerjate

- v primerjavi z letom

- tekmovalec

- dokončanje

- Zaključi

- dokončanje

- deli

- Izračunajte

- zaključuje

- stanje

- konference

- konfiguracija

- Sestavljeno

- Konzole

- Potrošniki

- vseboval

- Vsebuje

- vsebina

- ustvarjalci vsebin

- ozadje

- naprej

- udobje

- Pogovor

- Ustrezno

- Ustvarjalci

- Trenutno

- stranka

- Za stranke

- Stranke, ki so

- datum

- nabor podatkov

- globoko

- globoko učenje

- dostava

- izkazati

- dokazuje,

- razporedi

- uvajanje

- Opisuje

- Oblikovanje

- Kljub

- Podrobnosti

- Razvoj

- razvili

- Razvijalci

- razvoju

- odstopanje

- naprave

- drugačen

- razpravlja

- razpravljali

- Razprava

- Razpršenost

- do

- Dokumenti

- domena

- dont

- navzdol

- desetine

- med

- e-trgovina

- vsak

- prej

- enostaven za uporabo

- echo

- učinkovitost

- bodisi

- Electronic

- smirkovim

- Zaposleni

- omogočajo

- Končna točka

- Angleščina

- zagotovitev

- podjetja

- epoha

- ocene

- vsi

- Primer

- Primeri

- Odličnost

- Izmenjava

- razburjen

- obstaja

- Pričakuje

- izrecno

- izrazi

- FAST

- hitreje

- Nekaj

- file

- Vložitev

- vložki

- finančna

- finančne storitve

- narava

- Ogenj TV

- prva

- fit

- Osredotočite

- osredotočena

- Osredotoča

- po

- za

- obrazec

- format

- v prihodnost

- Fundacija

- štiri

- brezplačno

- iz

- funkcionalnost

- nadalje

- pridobljeno

- splošno

- ustvarjajo

- generacija

- generativno

- Generativna AI

- dobili

- GitHub

- Cilji

- dobro

- prisodil

- veliko

- voden

- imel

- ročaj

- Imajo

- he

- Zdravje

- Health Care

- zdravstveno varstvo

- pomoč

- Pomaga

- visoka

- več

- njegov

- Domov

- domači depo

- Kako

- Kako

- HTML

- http

- HTTPS

- huang

- Stotine

- sto milijonov

- i

- identificirati

- if

- ii

- Illinois

- slike

- uvoz

- izboljšanje

- Izboljšanje

- in

- vključujejo

- vključuje

- Vključno

- Indeks

- Podatki

- inovativne

- vhod

- pronicljiv

- primer

- Namesto

- Navodila

- celovitost

- interesi

- Facebook Global

- v

- Izum

- IT

- ITS

- Job

- jpg

- json

- tipke

- znanje

- jezik

- velika

- večja

- Največji

- Latenca

- vodi

- učenje

- Led

- dolžina

- ravni

- Licenca

- light

- Verjeten

- vrstica

- linije

- Litigation

- LLM

- Long

- dolgoročna

- več

- si

- nizka

- nizke cene

- stroj

- strojno učenje

- je

- upravlja

- več

- Material

- Maj ..

- kar pomeni,

- mediji

- Spomin

- Metoda

- Metode

- Mexico

- milijonov

- milijoni

- Mission

- mešanico

- ML

- Mobilni

- mobile-aplikacije

- Model

- modeli

- več

- Najbolj

- filmi

- več

- morajo

- Ime

- naravna

- Obdelava Natural Language

- Nimate

- net

- mreža

- Novo

- Newton

- Naslednja

- nlp

- sever

- North America

- prenosnik

- zdaj

- senčenje

- Cilji

- of

- ponudba

- Ponudbe

- pogosto

- on

- ONE

- na spletu

- samo

- deluje

- operativno

- operacije

- optika

- optimizacijo

- Možnost

- or

- Organizirano

- izvirno

- Ostalo

- naši

- izhod

- več

- lastne

- Stran

- seznanjeni

- članki

- del

- Stranke

- strast

- bolniki

- vzorci

- Izvedite

- performance

- Dr.

- fizično

- Fizično

- načrti

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Točka

- Prispevek

- predstaviti

- Cena

- Cene

- primarni

- Predsednik

- Načela

- zasebna

- Postopek

- obravnavati

- proizvodnjo

- proizvodnjo

- Izdelek

- Izdelki

- Napovedi

- zagotavljajo

- nuditi storitve

- če

- Ponudnik

- zagotavlja

- zagotavljanje

- javnega

- javno

- objavljeno

- Python

- kakovost

- vprašanja

- precej

- Rdeča

- glejte

- odražajo

- Reforma

- povezane

- sprosti

- pomembno

- poročilo

- Skladišče

- zastopan

- predstavlja

- zahteva

- Zahteve

- Raziskave

- raziskovalec

- spoštovanje

- Odgovor

- REST

- Omejitve

- povzroči

- Rezultati

- Trgovina na drobno

- trgovec na drobno

- ohranitev

- Ring

- robusten

- royal

- s

- sagemaker

- prodaja

- razširljive

- Znanstvenik

- SDK

- SEC

- Vložitev SEC

- Oddelek

- oddelki

- Vrednostni papirji

- varnost

- glej

- Seek

- segmentih

- izbor

- prodaja

- Prodajalci

- višji

- ločena

- Serija

- Serija A

- služijo

- Storitev

- Storitve

- nastavite

- Kompleti

- nastavitve

- shouldnt

- je pokazala,

- pokazale

- Razstave

- ugašati

- Podoben

- Enostavno

- sam

- gospod

- situacije

- Velikosti

- drsna

- manj

- delček

- Društvo

- prodaja

- Rešitev

- rešitve

- SOLVE

- specializirani

- specifična

- posebnosti

- Spektralno

- hitrost

- Začetek

- zagon

- Ustanavljanjem

- Izjave

- Države

- Statistično

- Korak

- Koraki

- Še vedno

- shranjevanje

- trgovina

- trgovine

- strategije

- pretakanje

- stremiti

- močna

- studio

- naročnina

- naročniške storitve

- taka

- Suit

- Podpora

- Podpira

- miza

- Tablet

- krojenje

- Naloga

- Naloge

- skupina

- timsko delo

- tehnika

- Predloga

- Test

- besedilo

- besedilno

- kot

- da

- O

- Območje

- svet

- POTEM

- Tukaj.

- te

- Razmišljanje

- tretja

- tretje osebe

- ta

- 3

- skozi

- vsej

- pretočnost

- čas

- pravočasno

- do

- skupaj

- Skupaj za plačilo

- Vlak

- usposobljeni

- usposabljanje

- transformator

- zdravljenje

- Res

- poskusite

- poskuša

- tuning

- tv

- dva

- tip

- Vrste

- ui

- pod

- opravi

- razumeli

- edinstven

- Velika

- Združene države Amerike

- univerza

- Nadgradnja

- posodobitve

- us

- uporaba

- Rabljeni

- uporablja

- uporabo

- potrjevanje

- Vrednote

- raznolikost

- različnih

- različno

- Popravljeno

- različica

- zelo

- preko

- Video posnetki

- Vizija

- sprehod

- gledanju

- način..

- we

- web

- spletne storitve

- spletne strani

- Dobro

- so bili

- Kaj

- Kaj je

- kdaj

- ki

- medtem

- bele

- bo

- okno

- z

- v

- brez

- besede

- delo

- delati skupaj

- svet

- svetu

- pisati

- let

- Vi

- Vaša rutina za

- zefirnet