Generativ AI applikationer som drivs av grundmodeller (FM) möjliggör organisationer med betydande affärsvärde i kundupplevelse, produktivitet, processoptimering och innovationer. Antagandet av dessa FM:s innebär dock att ta itu med några viktiga utmaningar, inklusive kvalitetsresultat, datasekretess, säkerhet, integration med organisationsdata, kostnader och färdigheter att leverera.

I det här inlägget utforskar vi olika tillvägagångssätt du kan ta när du bygger applikationer som använder generativ AI. Med den snabba utvecklingen av FM:er är det en spännande tid att utnyttja sin kraft, men också avgörande att förstå hur man använder dem på rätt sätt för att uppnå affärsresultat. Vi tillhandahåller en översikt över nyckelgenerativa AI-metoder, inklusive prompt engineering, Retrieval Augmented Generation (RAG) och modellanpassning. När vi tillämpar dessa tillvägagångssätt diskuterar vi viktiga överväganden kring potentiell hallucination, integration med företagsdata, utdatakvalitet och kostnad. I slutet kommer du att ha solida riktlinjer och ett användbart flödesschema för att bestämma den bästa metoden för att utveckla dina egna FM-drivna applikationer, grundade på verkliga exempel. Oavsett om du skapar en chatbot eller ett sammanfattningsverktyg kan du forma kraftfulla FM:er för att passa dina behov.

Generativ AI med AWS

Framväxten av FM skapar både möjligheter och utmaningar för organisationer som vill använda dessa tekniker. En viktig utmaning är att säkerställa högkvalitativa, sammanhängande resultat som är i linje med affärsbehov, snarare än hallucinationer eller falsk information. Organisationer måste också noggrant hantera datasekretess- och säkerhetsrisker som uppstår vid behandling av proprietär data med FM:er. De färdigheter som behövs för att korrekt integrera, anpassa och validera FM:er inom befintliga system och data är en bristvara. Att bygga stora språkmodeller (LLM) från grunden eller skräddarsy förutbildade modeller kräver betydande beräkningsresurser, expertdatavetare och månader av ingenjörsarbete. Enbart beräkningskostnaden kan lätt uppgå till miljontals dollar för att träna modeller med hundratals miljarder parametrar på massiva datamängder med hjälp av tusentals GPU:er eller TPU:er. Utöver hårdvara kräver datarensning och bearbetning, design av modellarkitektur, hyperparameterjustering och utveckling av pipeline för utbildning specialiserade färdigheter i maskininlärning (ML). Hela processen är komplex, tidskrävande och oöverkomligt dyr för de flesta organisationer utan den nödvändiga infrastrukturen och talanginvesteringen. Organisationer som misslyckas med att hantera dessa risker på ett adekvat sätt kan möta negativa effekter på deras varumärkesrykte, kundernas förtroende, verksamhet och intäkter.

Amazonas berggrund är en helt hanterad tjänst som erbjuder ett urval av högpresterande grundmodeller (FM) från ledande AI-företag som AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI och Amazon via ett enda API. Med Amazon Bedrock serverlösa upplevelse kan du komma igång snabbt, privatanpassa FMs med din egen data och integrera och distribuera dem i dina applikationer med hjälp av AWS-verktyg utan att behöva hantera någon infrastruktur. Amazon Bedrock är HIPAA-berättigat, och du kan använda Amazon Bedrock i enlighet med GDPR. Med Amazon Bedrock används inte ditt innehåll för att förbättra basmodellerna och delas inte med tredjepartsmodellleverantörer. Din data i Amazon Bedrock är alltid krypterad under överföring och vila, och du kan valfritt kryptera resurser med dina egna nycklar. Du kan använda AWS PrivateLink med Amazon Bedrock för att upprätta privat anslutning mellan dina FM:er och din VPC utan att exponera din trafik för internet. Med Kunskapsbaser för Amazon Bedrock, kan du ge FM:er och agenter kontextuell information från ditt företags privata datakällor för att RAG ska kunna leverera mer relevanta, korrekta och anpassade svar. Du kan personligen anpassa FM-apparater med din egen data genom ett visuellt gränssnitt utan att skriva någon kod. Som en helt hanterad tjänst erbjuder Amazon Bedrock en enkel utvecklarupplevelse för att arbeta med ett brett utbud av högpresterande FM:er.

Lanserades i 2017, Amazon SageMaker är en helt hanterad tjänst som gör det enkelt att bygga, träna och distribuera ML-modeller. Fler och fler kunder bygger sina egna FM med SageMaker, inklusive Stability AI, AI21 Labs, Hugging Face, Perplexity AI, Hippocratic AI, LG AI Research och Technology Innovation Institute. För att hjälpa dig komma igång snabbt, Amazon SageMaker JumpStart erbjuder ett ML-nav där du kan utforska, träna och distribuera ett brett urval av offentliga FM-apparater, såsom Mistral-modeller, LightOn-modeller, RedPajama, Mosiac MPT-7B, FLAN-T5/UL2, GPT-J-6B/Neox-20B , och Bloom/BloomZ, med hjälp av specialbyggda SageMaker-verktyg som experiment och pipelines.

Vanliga generativa AI-metoder

I det här avsnittet diskuterar vi vanliga metoder för att implementera effektiva generativa AI-lösningar. Vi utforskar populära prompt ingenjörstekniker som låter dig uppnå mer komplexa och intressanta uppgifter med FMs. Vi diskuterar också hur tekniker som RAG och modellanpassning ytterligare kan förbättra FMs kapacitet och övervinna utmaningar som begränsade data och beräkningsbegränsningar. Med rätt teknik kan du bygga kraftfulla och slagkraftiga generativa AI-lösningar.

Snabb ingenjörskonst

Snabb ingenjörskonst är praxis att noggrant designa uppmaningar för att effektivt utnyttja FMs kapacitet. Det involverar användning av uppmaningar, som är korta textstycken som vägleder modellen för att generera mer exakta och relevanta svar. Med snabb konstruktion kan du förbättra prestandan hos FM-apparater och göra dem mer effektiva för en mängd olika applikationer. I det här avsnittet utforskar vi tekniker som noll- och få-shot-prompting, som snabbt anpassar FM:er till nya uppgifter med bara några få exempel, och chain-of-thought-prompting, som bryter ner komplexa resonemang i mellansteg. Dessa metoder visar hur snabb ingenjörskonst kan göra FM:er mer effektiva på komplexa uppgifter utan att kräva omskolning av modellen.

Noll-shot-uppmaning

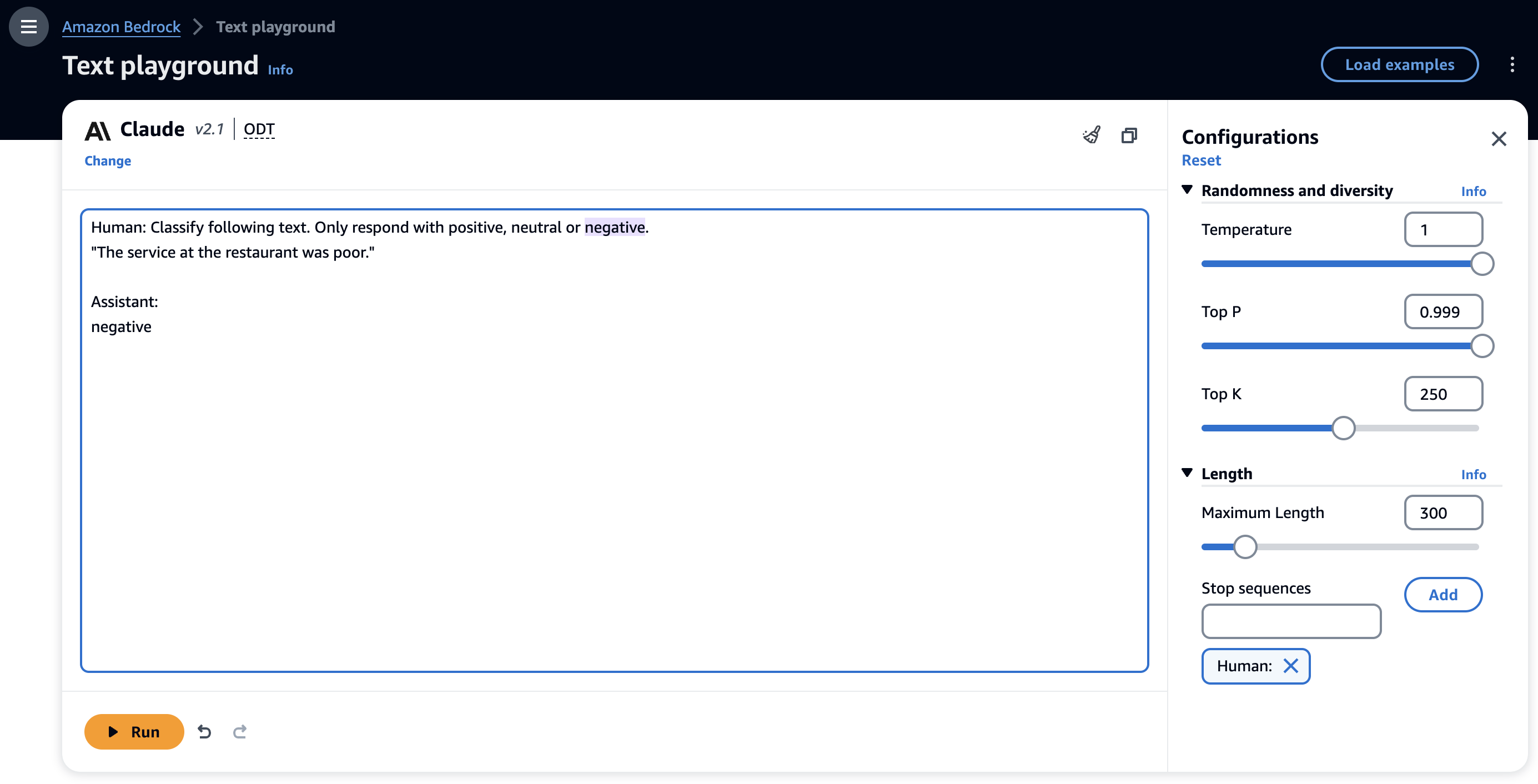

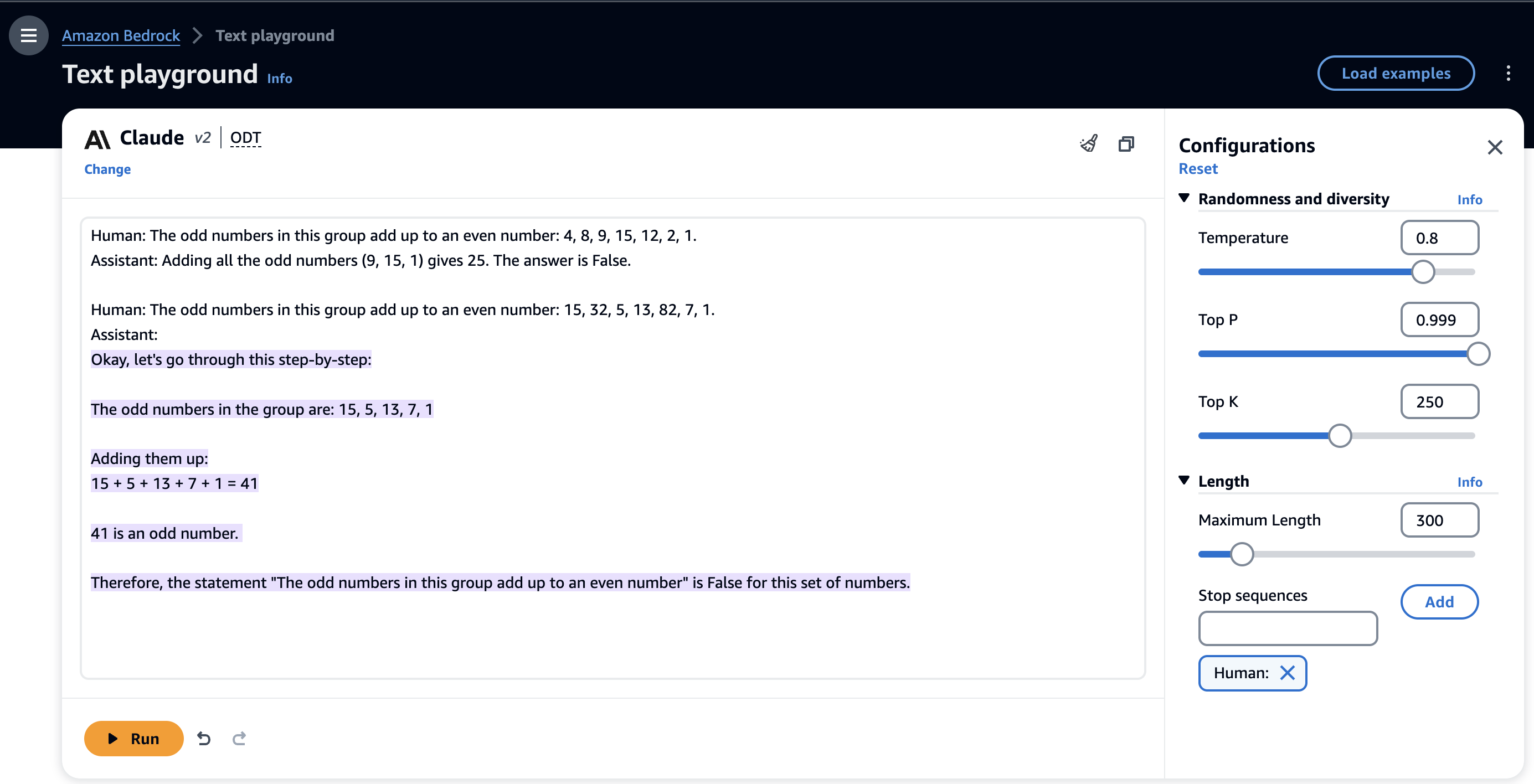

En noll-shot-promptteknik kräver att FM:er genererar ett svar utan att ge några explicita exempel på det önskade beteendet, och enbart förlitar sig på dess förträning. Följande skärmdump visar ett exempel på en noll-shot-prompt med Anthropic Claude 2.1-modellen på Amazon Bedrock-konsolen.

I dessa instruktioner gav vi inga exempel. Men modellen kan förstå uppgiften och generera lämplig utdata. Zero-shot prompter är den enklaste prompttekniken att börja med när du utvärderar en FM för ditt användningsfall. Men även om FM:er är anmärkningsvärda med noll-shot-uppmaningar, kanske det inte alltid ger korrekta eller önskade resultat för mer komplexa uppgifter. När noll-shot-prompter misslyckas, rekommenderas det att ge några exempel i prompten (få-shot-prompter).

Få skott uppmaning

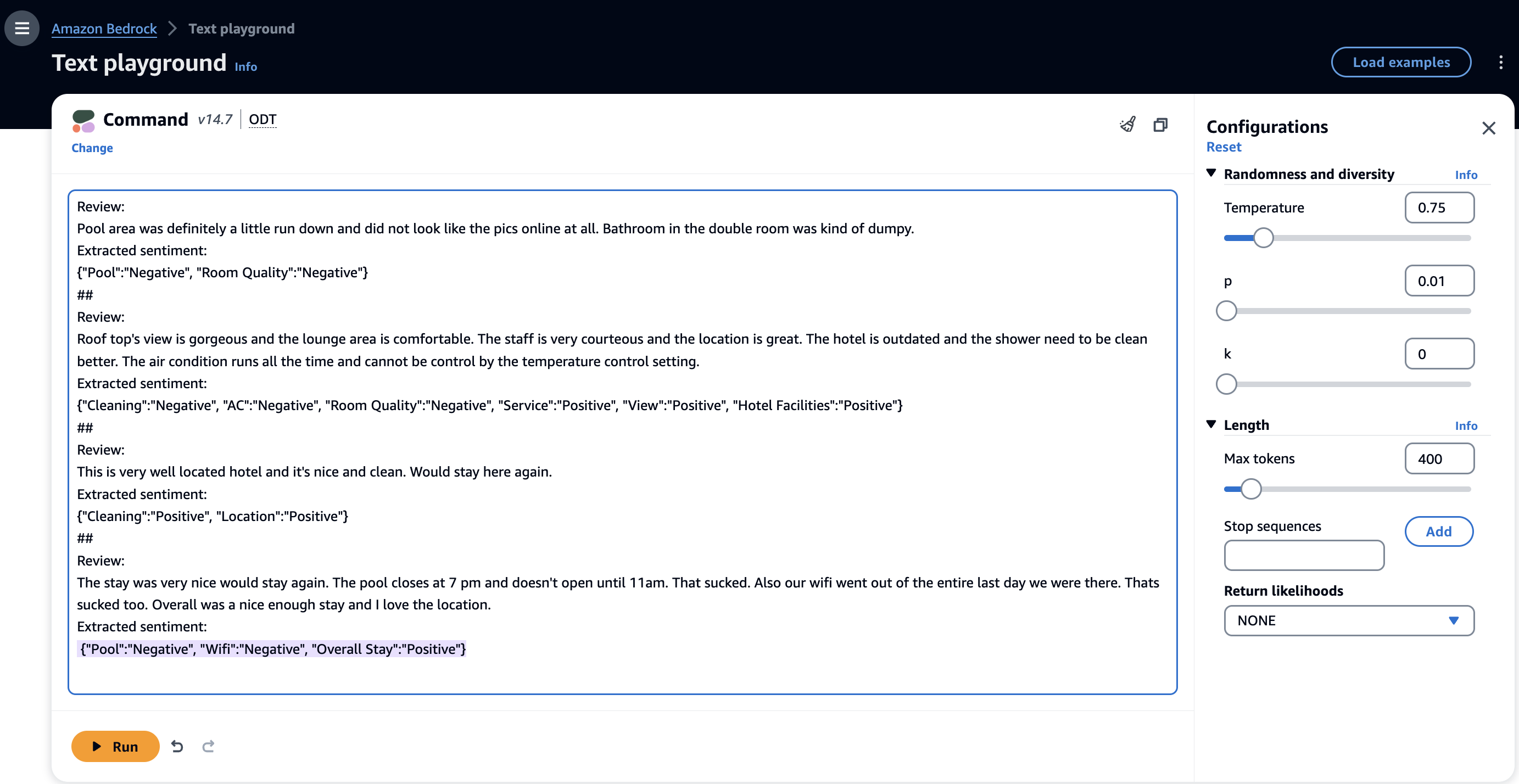

Tekniken med få skotts prompt gör att FM:er kan lära sig i sammanhanget från exemplen i uppmaningarna och utföra uppgiften mer exakt. Med bara några få exempel kan du snabbt anpassa FM:er till nya uppgifter utan stora träningsuppsättningar och guida dem mot önskat beteende. Följande är ett exempel på en snabbprompt med Cohere Command-modellen på Amazon Bedrock-konsolen.

I det föregående exemplet kunde FM identifiera enheter från inmatningstexten (recensioner) och extrahera de associerade känslorna. Få-shot-uppmaningar är ett effektivt sätt att ta itu med komplexa uppgifter genom att ge några exempel på input-output-par. För enkla uppgifter kan du ge ett exempel (1-shot), medan för svårare uppgifter bör du ge tre (3-shot) till fem (5-shot) exempel. Min et al. (2022) publicerade rön om inlärning i sammanhanget som kan förbättra prestandan för tekniken med få skott. Du kan använda få-shot prompt för en mängd olika uppgifter, såsom sentimentanalys, enhetsigenkänning, svar på frågor, översättning och kodgenerering.

Tankekedja

Trots sin potential har få-shot-uppmaning begränsningar, särskilt när man hanterar komplexa resonemangsuppgifter (som aritmetiska eller logiska uppgifter). Dessa uppgifter kräver att dela upp problemet i steg och sedan lösa det. Wei et al. (2022) introducerade chain-of-thought-tekniken (CoT) för att lösa komplexa resonemangsproblem genom mellanliggande resonemangssteg. Du kan kombinera CoT med få-shot-uppmaning för att förbättra resultaten på komplexa uppgifter. Följande är ett exempel på en resonemangsuppgift som använder få-shot CoT-uppmaning med Anthropic Claude 2-modellen på Amazon Bedrock-konsolen.

Kojima et al. (2022) introducerade en idé om zero-shot CoT genom att använda FMs outnyttjade zero-shot-kapacitet. Deras forskning indikerar att zero-shot CoT, med samma mall för enstaka prompt, avsevärt överträffar zero-shot FM-prestanda på olika benchmark-resonemangsuppgifter. Du kan använda Zero-shot CoT-uppmaning för enkla resonemangsuppgifter genom att lägga till "Låt oss tänka steg för steg" till den ursprungliga prompten.

Reagera

CoT-uppmaning kan förbättra FMs resonemangsförmåga, men det beror fortfarande på modellens interna kunskap och tar inte hänsyn till någon extern kunskapsbas eller miljö för att samla in mer information, vilket kan leda till problem som hallucinationer. ReAct-metoden (resonera och agera) tar itu med denna lucka genom att utöka CoT och tillåta dynamiska resonemang med hjälp av en extern miljö (som Wikipedia).

Integration

FM:er har förmågan att förstå frågor och ge svar med hjälp av sina förutbildade kunskaper. De saknar dock kapacitet att svara på frågor som kräver tillgång till en organisations privata data eller förmåga att självständigt utföra uppgifter. RAG och agenter är metoder för att koppla dessa generativa AI-drivna applikationer till företagsdatauppsättningar, vilket ger dem möjlighet att ge svar som tar hänsyn till organisationsinformation och möjliggör körning av åtgärder baserat på förfrågningar.

Retrieval Augmented Generation

Retrieval Augmented Generation (RAG) låter dig anpassa en modells svar när du vill att modellen ska överväga ny kunskap eller uppdaterad information. När din data ändras ofta, som lager eller prissättning, är det inte praktiskt att finjustera och uppdatera modellen medan den betjänar användarfrågor. För att utrusta FM med uppdaterad proprietär information, vänder sig organisationer till RAG, en teknik som innebär att man hämtar data från företagets datakällor och berikar uppmaningen med den informationen för att ge mer relevanta och korrekta svar.

Det finns flera användningsfall där RAG kan hjälpa till att förbättra FM-prestandan:

- Frågesvar – RAG-modeller hjälper frågesvarsapplikationer att lokalisera och integrera information från dokument eller kunskapskällor för att generera högkvalitativa svar. Till exempel kan en frågesvarsapplikation hämta stycken om ett ämne innan ett sammanfattande svar genereras.

- Chatbots och samtalsagenter – RAG tillåter chatbots att komma åt relevant information från stora externa kunskapskällor. Detta gör chatbotens svar mer kunniga och naturliga.

- Skrivhjälp – RAG kan föreslå relevant innehåll, fakta och diskussionspunkter för att hjälpa dig att skriva dokument som artiklar, rapporter och e-postmeddelanden mer effektivt. Den hämtade informationen ger användbara sammanhang och idéer.

- Sammanfattning – RAG kan hitta relevanta källdokument, passager eller fakta för att öka en sammanfattningsmodells förståelse av ett ämne, vilket gör att den kan generera bättre sammanfattningar.

- Kreativt skrivande och berättande – RAG kan hämta handlingsidéer, karaktärer, inställningar och kreativa element från befintliga berättelser för att inspirera AI-berättelsegenereringsmodeller. Detta gör utgången mer intressant och grundad.

- Översättning – RAG kan hitta exempel på hur vissa fraser översätts mellan språk. Detta ger översättningsmodellen sammanhang och förbättrar översättningen av tvetydiga fraser.

- personalisering – I chatbots och rekommendationsapplikationer kan RAG dra personliga sammanhang som tidigare konversationer, profilinformation och preferenser för att göra svaren mer personliga och relevanta.

Det finns flera fördelar med att använda ett RAG-ramverk:

- Minskade hallucinationer – Att hämta relevant information hjälper till att grunda den genererade texten i fakta och verklig kunskap, snarare än hallucinerande text. Detta främjar mer korrekta, sakliga och pålitliga svar.

- Rapportering – Hämtning gör att en FM kan täcka ett bredare spektrum av ämnen och scenarier utöver sin träningsdata genom att dra in extern information. Detta hjälper till att lösa problem med begränsad täckning.

- Effektivitet (CT-värde) – Hämtning låter modellen fokusera sin generation på den mest relevanta informationen, snarare än att generera allt från grunden. Detta förbättrar effektiviteten och gör att större sammanhang kan användas.

- Säkerhet – Att hämta informationen från obligatoriska och tillåtna datakällor kan förbättra styrningen och kontrollen över generering av skadligt och felaktigt innehåll. Detta stöder en säkrare adoption.

- skalbarhet – Indexering och hämtning från stora korpus gör det möjligt att skala bättre jämfört med att använda hela korpusen under generering. Detta gör att du kan använda FM i mer resursbegränsade miljöer.

RAG producerar kvalitetsresultat, tack vare utökad användningsfallsspecifik kontext direkt från vektoriserade datalager. Jämfört med snabb konstruktion ger den avsevärt förbättrade resultat med enormt låga chanser för hallucinationer. Du kan bygga RAG-drivna applikationer på din företagsdata med hjälp av Amazon Kendra. RAG har högre komplexitet än prompt ingenjörskonst eftersom du behöver ha kunskaper om kodning och arkitektur för att implementera denna lösning. Men kunskapsbaser för Amazon Bedrock ger en fullt hanterad RAG-upplevelse och det enklaste sättet att komma igång med RAG i Amazon Bedrock. Kunskapsbaser för Amazon Bedrock automatiserar RAG-arbetsflödet från början till slut, inklusive inmatning, hämtning och snabb ökning, vilket eliminerar behovet för dig att skriva anpassad kod för att integrera datakällor och hantera frågor. Sessionskontexthantering är inbyggd så att din app kan stödja konversationer i flera svängar. Kunskapsbassvar kommer med källhänvisningar för att förbättra transparensen och minimera hallucinationer. Det enklaste sättet att bygga en generativ AI-driven assistent är att använda Amazon Q, som har ett inbyggt RAG-system.

RAG har den högsta graden av flexibilitet när det kommer till förändringar i arkitekturen. Du kan ändra inbäddningsmodellen, vektorlagringen och FM oberoende med minimal till måttlig påverkan på andra komponenter. För att lära dig mer om RAG-metoden med Amazon OpenSearch Service och Amazon Bedrock, se Bygg skalbara och serverlösa RAG-arbetsflöden med en vektormotor för Amazon OpenSearch Serverless och Amazon Bedrock Claude-modeller. För att lära dig om hur man implementerar RAG med Amazon Kendra, se Utnyttja kraften i företagsdata med generativ AI: Insikter från Amazon Kendra, LangChain och stora språkmodeller.

Agenter

FM:er kan förstå och svara på frågor baserat på deras förutbildade kunskaper. De kan dock inte utföra några verkliga uppgifter, som att boka en flygresa eller behandla en inköpsorder, på egen hand. Detta beror på att sådana uppgifter kräver organisationsspecifika data och arbetsflöden som vanligtvis behöver anpassad programmering. Ramar som Langkedja och vissa FM:er som Claude-modeller tillhandahåller funktionsanrop för att interagera med API:er och verktyg. Dock, Agenter för Amazon Bedrock, en ny och fullt hanterad AI-kapacitet från AWS, syftar till att göra det enklare för utvecklare att bygga applikationer med hjälp av nästa generations FM-apparater. Med bara några klick kan den automatiskt bryta ned uppgifter och generera den nödvändiga orkestreringslogiken, utan att behöva manuell kodning. Agenter kan säkert ansluta till företagets databaser via API:er, mata in och strukturera data för maskinkonsumtion och utöka den med kontextuella detaljer för att producera mer exakta svar och uppfylla förfrågningar. Eftersom det hanterar integration och infrastruktur, låter Agents for Amazon Bedrock dig fullt ut utnyttja generativ AI för affärsanvändning. Utvecklare kan nu fokusera på sina kärnapplikationer snarare än rutinmässig VVS. Den automatiserade databehandlingen och API-anropet gör det också möjligt för FM att leverera uppdaterade, skräddarsydda svar och utföra faktiska uppgifter med hjälp av egen kunskap.

Modellanpassning

Grundmodeller är extremt kapabla och möjliggör en del fantastiska applikationer, men det som kommer att driva ditt företag är generativ AI som vet vad som är viktigt för dina kunder, dina produkter och ditt företag. Och det är bara möjligt när du överladdar modeller med din data. Data är nyckeln till att gå från generiska applikationer till skräddarsydda generativa AI-applikationer som skapar verkligt värde för dina kunder och ditt företag.

I det här avsnittet diskuterar vi olika tekniker och fördelar med att anpassa dina FM-apparater. Vi tar upp hur modellanpassning innebär vidareutbildning och förändring av modellens vikter för att förbättra dess prestanda.

Finjustering

Finjustering är processen att ta en förtränad FM, som Llama 2, och vidareutbilda den på en nedströmsuppgift med en datauppsättning som är specifik för den uppgiften. Den förtränade modellen ger allmänna språkkunskaper, och finjustering gör att den kan specialisera sig och förbättra prestanda på en viss uppgift som textklassificering, frågesvar eller textgenerering. Med finjustering tillhandahåller du märkta datauppsättningar – som är kommenterade med ytterligare sammanhang – för att träna modellen på specifika uppgifter. Du kan sedan anpassa modellparametrarna för den specifika uppgiften utifrån ditt affärssammanhang.

Du kan implementera finjustering på FM med Amazon SageMaker JumpStart och Amazonas berggrund. För mer information, se Distribuera och finjustera grundmodeller i Amazon SageMaker JumpStart med två rader kod och Anpassa modeller i Amazon Bedrock med din egen data med hjälp av finjustering och fortsatt förträning.

Fortsatt förträning

Fortsatt förträning i Amazon Bedrock gör att du kan lära ut en tidigare tränad modell på ytterligare data som liknar dess ursprungliga data. Det gör det möjligt för modellen att få mer allmänna språkkunskaper snarare än att fokusera på en enda tillämpning. Med fortsatt förträning kan du använda dina omärkta datamängder, eller rådata, för att förbättra noggrannheten i grundmodellen för din domän genom att justera modellparametrar. Till exempel kan ett hälsovårdsföretag fortsätta att förutbilda sin modell med hjälp av medicinska tidskrifter, artiklar och forskningsartiklar för att göra det mer kunnigt om industriterminologi. För mer information, se Amazon Bedrock Developer Experience.

Fördelar med modellanpassning

Modellanpassning har flera fördelar och kan hjälpa organisationer med följande:

- Domänspecifik anpassning – Du kan använda en allmän FM och sedan vidareutbilda den på data från en specifik domän (som biomedicinsk, juridisk eller finansiell). Detta anpassar modellen till den domänens ordförråd, stil och så vidare.

- Uppgiftsspecifik finjustering – Du kan ta en förtränad FM och finjustera den på data för en specifik uppgift (som sentimentanalys eller frågesvar). Detta specialiserar modellen för just den uppgiften.

- personalisering – Du kan anpassa en FM på en individs data (e-post, texter, dokument de har skrivit) för att anpassa modellen till deras unika stil. Detta kan möjliggöra mer personliga applikationer.

- Språkinställning med låga resurser – Du kan bara träna om de översta lagren av en flerspråkig FM på ett språk med låga resurser för att bättre anpassa det till det språket.

- Åtgärda brister – Om vissa oavsiktliga beteenden upptäcks i en modell, kan anpassning på lämplig data hjälpa till att uppdatera modellen för att minska dessa brister.

Modellanpassning hjälper till att övervinna följande FM-antagandeutmaningar:

- Anpassning till nya domäner och uppgifter – FM:er som är förutbildade på allmänna textkorpus behöver ofta finjusteras på uppgiftsspecifika data för att fungera bra för nedströmsapplikationer. Finjustering anpassar modellen till nya domäner eller uppgifter som den inte ursprungligen tränades på.

- Övervinna fördomar – FMs kan uppvisa fördomar från sina ursprungliga träningsdata. Att anpassa en modell på ny data kan minska oönskade fördomar i modellens utdata.

- Förbättra beräkningseffektiviteten – Förtränade FM:er är ofta mycket stora och beräkningsmässigt dyra. Modellanpassning kan göra det möjligt att minska modellen genom att beskära oviktiga parametrar, vilket gör implementeringen mer genomförbar.

- Hanterar begränsade måldata – I vissa fall finns det begränsad verklig data tillgänglig för måluppgiften. Modellanpassning använder de förtränade vikterna som lärts på större datamängder för att övervinna denna databrist.

- Förbättra uppgiftens prestanda – Finjustering förbättrar nästan alltid prestanda på måluppgifter jämfört med att använda de ursprungliga förtränade vikterna. Denna optimering av modellen för dess avsedda användning gör att du kan distribuera FMs framgångsrikt i verkliga applikationer.

Modellanpassning har högre komplexitet än prompt engineering och RAG eftersom modellens vikt och parametrar ändras via tuning scripts, vilket kräver datavetenskap och ML expertis. Amazon Bedrock gör det dock enkelt genom att ge dig en hanterad upplevelse att anpassa modeller med finjustering or fortsatt förträning. Modellanpassning ger mycket exakta resultat med jämförbar kvalitet än RAG. Eftersom du uppdaterar modellvikter på domänspecifika data, producerar modellen mer kontextuella svar. Jämfört med RAG kan kvaliteten vara marginellt bättre beroende på användningsfallet. Därför är det viktigt att göra en avvägningsanalys mellan de två teknikerna. Du kan potentiellt implementera RAG med en anpassad modell.

Omskolning eller träning från grunden

Att bygga din egen grundläggande AI-modell istället för att enbart använda förutbildade offentliga modeller möjliggör större kontroll, förbättrad prestanda och anpassning till din organisations specifika användningsfall och data. Att investera i att skapa en skräddarsydd FM kan ge bättre anpassningsförmåga, uppgraderingar och kontroll över kapacitet. Distribuerad utbildning möjliggör skalbarheten som behövs för att träna mycket stora FM:er på massiva datamängder över många maskiner. Denna parallellisering gör modeller med hundratals miljarder parametrar tränade på biljoner tokens möjliga. Större modeller har större kapacitet att lära och generalisera.

Träning från grunden kan ge resultat av hög kvalitet eftersom modellen tränar på användningsfallsspecifika data från grunden, chanserna för hallucinationer är sällsynta och noggrannheten i utdata kan vara bland de högsta. Men om din datauppsättning ständigt utvecklas kan du fortfarande stöta på hallucinationsproblem. Utbildning från grunden har den högsta implementeringskomplexiteten och kostnaden. Det kräver mest ansträngning eftersom det kräver att man samlar in en enorm mängd data, kurerar och bearbetar den och tränar en ganska stor FM, vilket kräver djup datavetenskap och ML-expertis. Detta tillvägagångssätt är tidskrävande (det kan vanligtvis ta veckor till månader).

Du bör överväga att träna en FM från grunden när ingen av de andra tillvägagångssätten fungerar för dig, och du har förmågan att bygga en FM med en stor mängd väl utvalda tokeniserade data, en sofistikerad budget och ett team av mycket skickliga ML-experter . AWS tillhandahåller den mest avancerade molninfrastrukturen för att träna och köra LLM:er och andra FM:er som drivs av GPU:er och det specialbyggda ML-träningschippet, AWS Trainium, och ML slutledningsaccelerator, AWS slutledning. För mer information om utbildning LLMs på SageMaker, se Utbildning av stora språkmodeller på Amazon SageMaker: Bästa metoder och SageMaker HyperPod.

Att välja rätt tillvägagångssätt för att utveckla generativa AI-applikationer

När man utvecklar generativa AI-applikationer måste organisationer noggrant överväga flera nyckelfaktorer innan de väljer den mest lämpliga modellen för att möta deras behov. En mängd olika aspekter bör övervägas, såsom kostnad (för att säkerställa att den valda modellen överensstämmer med budgetrestriktioner), kvalitet (för att leverera sammanhängande och faktiskt korrekt resultat), sömlös integration med nuvarande företagsplattformar och arbetsflöden, och att minska hallucinationer eller generera falsk information . Med många tillgängliga alternativ kommer att ta sig tid att noggrant utvärdera dessa aspekter hjälpa organisationer att välja den generativa AI-modell som bäst uppfyller deras specifika krav och prioriteringar. Du bör undersöka följande faktorer noggrant:

- Integration med företagssystem – För att FM:er verkligen ska vara användbara i företagssammanhang måste de integrera och samverka med befintliga affärssystem och arbetsflöden. Detta kan innebära åtkomst till data från databaser, företagsresursplanering (ERP) och kundrelationshantering (CRM), samt utlösa åtgärder och arbetsflöden. Utan ordentlig integration riskerar FM att vara ett isolerat verktyg. Företagssystem som ERP innehåller viktiga affärsdata (kunder, produkter, beställningar). FM måste vara ansluten till dessa system för att använda företagsdata snarare än att arbeta utifrån sin egen kunskapsgraf, som kan vara felaktig eller föråldrad. Detta säkerställer noggrannhet och en enda källa till sanning.

- Hallucinationer – Hallucinationer är när en AI-applikation genererar falsk information som verkar saklig. Dessa måste behandlas noggrant innan FM:er antas allmänt. Till exempel kan en medicinsk chatbot utformad för att ge diagnosförslag hallucinera detaljer om en patients symtom eller sjukdomshistoria, vilket leder till att den föreslår en felaktig diagnos. Att förebygga skadliga hallucinationer som dessa genom tekniska lösningar och datauppsättning kommer att vara avgörande för att se till att dessa FM:er kan litas på för känsliga applikationer som sjukvård, ekonomi och juridik. Grundliga tester och transparens om en FM:s träningsdata och kvarvarande brister kommer att behöva följa med i driftsättningen.

- Färdigheter och resurser – Ett framgångsrikt antagande av FM kommer att vara mycket beroende av att ha rätt kompetens och resurser för att använda tekniken effektivt. Organisationer behöver anställda med starka tekniska färdigheter för att korrekt implementera, anpassa och underhålla FMs för att passa deras specifika behov. De kräver också rikliga beräkningsresurser som avancerad hårdvara och molnberäkningskapacitet för att köra komplexa FM:er. Till exempel, ett marknadsföringsteam som vill använda en FM för att generera reklamtexter och inlägg på sociala medier behöver skickliga ingenjörer för att integrera systemet, annonsmaterial för att ge uppmaningar och bedöma utdatakvalitet och tillräckligt med molnkraft för att distribuera modellen kostnadseffektivt. Att investera i att utveckla expertis och teknisk infrastruktur kommer att göra det möjligt för organisationer att få verkligt affärsvärde genom att tillämpa FMs.

- Utgångskvalitet – Kvaliteten på den produktion som produceras av FM:er kommer att vara avgörande för att de ska användas och användas, särskilt i konsumentinriktade applikationer som chatbots. Om chatbotar som drivs av FM:er ger svar som är felaktiga, meningslösa eller olämpliga, kommer användare snabbt att bli frustrerade och sluta interagera med dem. Därför måste företag som vill distribuera chatbots noggrant testa de FM:er som driver dem för att säkerställa att de konsekvent genererar högkvalitativa svar som är användbara, relevanta och lämpliga för att ge en bra användarupplevelse. Utdatakvalitet omfattar faktorer som relevans, noggrannhet, koherens och lämplighet, som alla bidrar till den övergripande användarnöjdheten och kommer att göra eller bryta antagandet av FMs som de som används för chatbots.

- Pris – Den höga beräkningskraften som krävs för att träna och köra stora AI-modeller som FM kan medföra betydande kostnader. Många organisationer kanske saknar de ekonomiska resurser eller molninfrastruktur som krävs för att använda sådana massiva modeller. Integrering och anpassning av FM-apparater för specifika användningsfall ökar dessutom tekniska kostnader. De avsevärda utgifterna som krävs för att använda FMs kan avskräcka en bred användning, särskilt bland mindre företag och nystartade företag med begränsad budget. Att utvärdera potentiell avkastning på investeringen och väga kostnaderna kontra fördelarna med FMs är avgörande för organisationer som överväger deras tillämpning och användbarhet. Kostnadseffektivitet kommer sannolikt att vara en avgörande faktor för att avgöra om och hur dessa kraftfulla men resurskrävande modeller kan implementeras.

Designbeslut

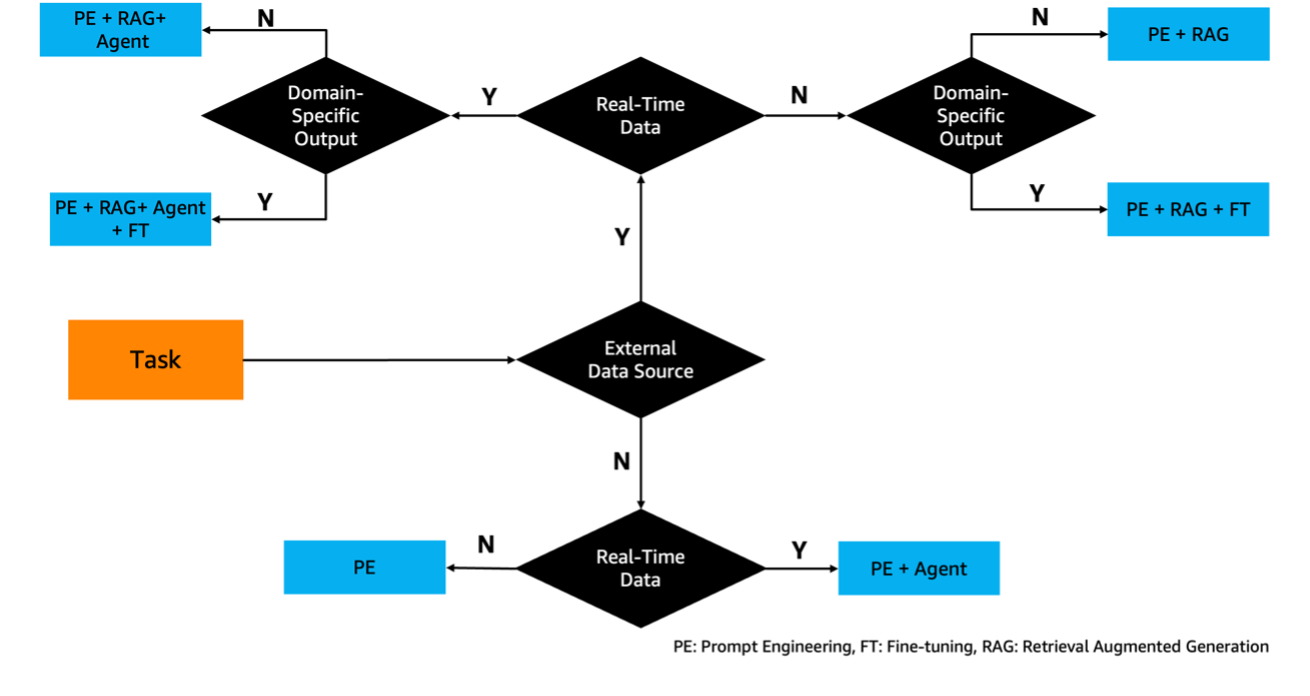

Som vi behandlade i det här inlägget finns för närvarande många olika AI-tekniker tillgängliga, såsom snabb konstruktion, RAG och modellanpassning. Detta breda utbud av val gör det utmanande för företag att bestämma det optimala tillvägagångssättet för just deras användningsfall. Att välja rätt uppsättning tekniker beror på olika faktorer, inklusive tillgång till externa datakällor, dataflöden i realtid och domänspecifikiteten för den avsedda applikationen. För att hjälpa till att identifiera den mest lämpliga tekniken baserat på användningsfallet och överväganden, går vi igenom följande flödesschema, som beskriver rekommendationer för att matcha specifika behov och begränsningar med lämpliga metoder.

För att få en tydlig förståelse, låt oss gå igenom flödesschemat för designbeslut med några illustrativa exempel:

- Företagssökning – En anställd vill begära ledighet från sin organisation. För att ge ett svar som är anpassat till organisationens HR-policyer behöver FM mer sammanhang utöver sin egen kunskap och förmåga. Specifikt kräver FM tillgång till externa datakällor som tillhandahåller relevanta HR-riktlinjer och policyer. Med tanke på detta scenario med en anställningsbegäran som kräver hänvisning till externa domänspecifika data, är det rekommenderade tillvägagångssättet enligt flödesschemat snabb utveckling med RAG. RAG kommer att hjälpa till att tillhandahålla relevant information från de externa datakällorna som sammanhang till FM.

- Företagssökning med organisationsspecifik utdata – Anta att du har tekniska ritningar och du vill extrahera materialförteckningen från dem och formatera utdata enligt industristandarder. För att göra detta kan du använda en teknik som kombinerar snabb ingenjörskonst med RAG och en finjusterad språkmodell. Den finjusterade modellen skulle tränas för att producera stycklistor när de ges tekniska ritningar som input. RAG hjälper till att hitta de mest relevanta tekniska ritningarna från organisationens datakällor att mata in i sammanhanget för FM. Sammantaget extraherar detta tillvägagångssätt materiallistor från tekniska ritningar och strukturerar resultatet på lämpligt sätt för ingenjörsområdet.

- Allmän sökning – Föreställ dig att du vill hitta identiteten på USA:s 30:e president. Du kan använda snabb teknik för att få svaret från en FM. Eftersom dessa modeller är tränade på många datakällor kan de ofta ge korrekta svar på faktafrågor som denna.

- Allmän sökning med senaste händelser – Om du vill bestämma den aktuella aktiekursen för Amazon kan du använda tillvägagångssättet för snabb teknik med en agent. Agenten kommer att förse FM med den senaste aktiekursen så att den kan generera det faktiska svaret.

Slutsats

Generativ AI erbjuder en enorm potential för organisationer att driva innovation och öka produktiviteten i en mängd olika applikationer. Att framgångsrikt anta dessa framväxande AI-tekniker kräver dock att man tar hänsyn till viktiga överväganden kring integration, utdatakvalitet, kompetens, kostnader och potentiella risker som skadliga hallucinationer eller säkerhetsbrister. Organisationer måste ta ett systematiskt tillvägagångssätt för att utvärdera sina användningsfallskrav och begränsningar för att bestämma de mest lämpliga teknikerna för att anpassa och tillämpa FMs. Som framhållits i det här inlägget, har snabb ingenjörskonst, RAG och effektiva modellanpassningsmetoder var och en sina egna styrkor och svagheter som passar olika scenarier. Genom att kartlägga affärsbehov till AI-kapacitet med hjälp av ett strukturerat ramverk kan organisationer övervinna hinder för implementering och börja realisera fördelar med FM:er samtidigt som de bygger skyddsräcken för att hantera risker. Med tankeväckande planering grundad i verkliga exempel kan företag i alla branscher frigöra enorma värden från denna nya våg av generativ AI. Lära om generativ AI på AWS.

Om författarna

Jay Rao är en Principal Solutions Architect på AWS. Han fokuserar på AI/ML-teknologier med ett stort intresse för Generativ AI och Computer Vision. På AWS tycker han om att ge teknisk och strategisk vägledning till kunder och hjälpa dem att designa och implementera lösningar som driver affärsresultat. Han är bokförfattare (Computer Vision on AWS), publicerar regelbundet bloggar och kodprover och har hållit föredrag på teknikkonferenser som AWS re:Invent.

Jay Rao är en Principal Solutions Architect på AWS. Han fokuserar på AI/ML-teknologier med ett stort intresse för Generativ AI och Computer Vision. På AWS tycker han om att ge teknisk och strategisk vägledning till kunder och hjälpa dem att designa och implementera lösningar som driver affärsresultat. Han är bokförfattare (Computer Vision on AWS), publicerar regelbundet bloggar och kodprover och har hållit föredrag på teknikkonferenser som AWS re:Invent.

Babu Kariyaden Parambath är senior AI/ML-specialist på AWS. På AWS tycker han om att arbeta med kunder för att hjälpa dem att identifiera rätt affärsanvändningsfall med affärsvärde och lösa det med hjälp av AWS AI/ML-lösningar och tjänster. Innan han började på AWS var Babu en AI-evangelist med 20 års mångsidig branscherfarenhet som levererade AI-drivet affärsvärde för kunder.

Babu Kariyaden Parambath är senior AI/ML-specialist på AWS. På AWS tycker han om att arbeta med kunder för att hjälpa dem att identifiera rätt affärsanvändningsfall med affärsvärde och lösa det med hjälp av AWS AI/ML-lösningar och tjänster. Innan han började på AWS var Babu en AI-evangelist med 20 års mångsidig branscherfarenhet som levererade AI-drivet affärsvärde för kunder.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/best-practices-to-build-generative-ai-applications-on-aws/

- : har

- :är

- :inte

- :var

- 1

- 100

- 116

- 20

- 20 år

- 2017

- 2022

- 30:e

- 7

- a

- förmåga

- Able

- Om oss

- accelerator

- tillgång

- åtkomst

- åtfölja

- Enligt

- Konto

- noggrannhet

- exakt

- exakt

- Uppnå

- tvärs

- verkande

- åtgärder

- faktiska

- anpassa

- anpassning

- anpassning

- anpassar sig

- tillsats

- Annat

- Dessutom

- adress

- adresserad

- adresser

- adresse

- Lägger

- adekvat

- anta

- antagen

- Anta

- Antagande

- avancerat

- befordran

- fördelar

- reklam

- Recensioner

- medel

- AI

- AI-modeller

- ai forskning

- AI-powered

- AI / ML

- Stöd

- Syftet

- AL

- rikta

- Justerat

- Justerar

- Alla

- tillåter

- tillåta

- tillåter

- nästan

- ensam

- också

- Även

- alltid

- amason

- Amazon Kendra

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- bland

- bland

- mängd

- an

- analys

- och

- och infrastruktur

- svara

- svar

- svar

- Antropisk

- vilken som helst

- api

- API: er

- app

- visas

- Ansökan

- tillämpningar

- Tillämpa

- tillvägagångssätt

- tillvägagångssätt

- lämpligt

- lämpligt

- arkitektur

- ÄR

- stiga upp

- runt

- artiklar

- AS

- aspekter

- bedöma

- Assistent

- associerad

- At

- förstärka

- augmented

- Författaren

- Automatiserad

- automatiserar

- automatiskt

- autonomt

- tillgänglig

- AWS

- AWS re: Invent

- bas

- baserat

- BE

- därför att

- blir

- innan

- börja

- beteende

- beteenden

- Där vi får lov att vara utan att konstant prestera,

- riktmärke

- Fördelarna

- BÄST

- bästa praxis

- Bättre

- mellan

- Bortom

- förspänner

- Bill

- miljarder

- Sedlar

- biomedicinsk

- bloggar

- boken

- bokning

- lyft

- båda

- varumärke

- Ha sönder

- Breaking

- raster

- bred

- bredare

- budget

- budgetar

- SLUTRESULTAT

- Byggnad

- byggt

- inbyggd

- företag

- företag

- men

- by

- anropande

- KAN

- Kan få

- kapacitet

- kapacitet

- kapabel

- Kapacitet

- försiktigt

- bära

- Vid

- fall

- vissa

- utmanar

- utmaningar

- utmanande

- chanser

- byta

- ändrats

- Förändringar

- byte

- tecken

- Diagram

- chatbot

- chatbots

- chip

- val

- val

- Välja

- klassificering

- Rengöring

- klar

- nära

- cloud

- cloud computing

- molninfrastruktur

- koda

- Kodning

- SAMMANHÄNGANDE

- Samla

- kombinera

- kombinerar

- komma

- kommer

- Gemensam

- Företag

- företag

- Företagets

- jämförbar

- jämfört

- fullborda

- komplex

- Komplexiteten

- Efterlevnad

- komponenter

- förstå

- beräkningar

- beräkningskraft

- beräkningsmässigt

- Compute

- dator

- Datorsyn

- databehandling

- beräkningskraft

- Genomför

- konferenser

- Kontakta

- anslutna

- Anslutningar

- Tänk

- betydande

- överväganden

- anses

- med tanke på

- konsekvent

- Konsol

- ständigt

- begränsningar

- konsumtion

- innehålla

- innehåll

- Innehållsgenerering

- sammanhang

- kontexter

- kontextuella

- fortsätta

- fortsatte

- bidra

- kontroll

- konversera

- konversationer

- kopiera

- Kärna

- Pris

- Kostar

- kunde

- täcka

- täckning

- omfattas

- skapa

- Skapa

- Kreativ

- annonstexter

- kritisk

- CRM

- avgörande

- organisera

- curation

- Aktuella

- För närvarande

- beställnings

- kund

- kundupplevelse

- Kunder

- anpassning

- skräddarsy

- kundanpassad

- datum

- dataintegritet

- Datas integritet och säkerhet

- databehandling

- datavetenskap

- databaser

- datauppsättningar

- som handlar om

- Avgörande

- Beslutet

- djup

- Examen

- leverera

- levereras

- leverera

- Efterfrågan

- demonstrera

- bero

- beroende

- beror

- distribuera

- utplacerade

- utplacering

- distributioner

- Designa

- utformade

- design

- önskas

- detaljer

- Bestämma

- bestämmande

- utveckla

- Utvecklare

- utvecklare

- utveckla

- Utveckling

- diagnos

- olika

- svårt

- direkt

- upptäckt

- diskutera

- distribueras

- distribuerad utbildning

- flera

- do

- dokument

- inte

- dollar

- domän

- domäner

- ner

- Ritningar

- driv

- driven

- grund

- under

- dynamisk

- E&T

- varje

- lätt

- Effektiv

- effektivt

- effektivitet

- effektiv

- effektivt

- ansträngning

- element

- berättigad

- eliminera

- e

- inbäddning

- uppkomst

- smärgel

- Anställd

- anställda

- ge

- möjliggöra

- möjliggör

- möjliggör

- omfattar

- kryptera

- krypterad

- änden

- början till slut

- engagerande

- Motor

- Teknik

- Ingenjörer

- förbättra

- berikande

- säkerställa

- säkerställer

- säkerställa

- Företag

- enheter

- enhet

- Miljö

- miljöer

- utrusta

- ERP

- speciellt

- etablera

- utvärdera

- utvärdering

- Evangelist

- Varje

- allt

- utvecklas

- undersöka

- exempel

- exempel

- spännande

- uppvisar

- befintliga

- kostnader

- dyra

- erfarenhet

- experiment

- expert

- expertis

- experter

- utforska

- sträcker

- extern

- extrahera

- extrakt

- extremt

- Ansikte

- faktor

- faktorer

- fakta

- MISSLYCKAS

- ganska

- Höst

- falsk

- möjlig

- få

- finansiering

- finansiella

- hitta

- resultat

- fem

- brister

- Flexibilitet

- flyg

- flöda

- Fokus

- fokuserar

- efter

- För

- fundament

- grundläggande

- Ramverk

- ramar

- ofta

- från

- frustrerad

- Uppfylla

- full

- fullständigt

- ytterligare

- Få

- spalt

- samla

- GDPR

- Allmänt

- generell mening

- generera

- genereras

- genererar

- generera

- generering

- generativ

- Generativ AI

- skaffa sig

- Ge

- ges

- Go

- god

- styrning

- GPUs

- diagram

- stor

- större

- Marken

- grundad

- vägleda

- styra

- riktlinjer

- Handtag

- hårdvara

- skadliga

- sele

- Har

- har

- he

- hälso-och sjukvård

- kraftigt

- hjälpa

- hjälp

- hjälpa

- hjälper

- Hög

- högpresterande

- hög kvalitet

- högre

- högsta

- högsta grad

- Markerad

- höggradigt

- historia

- Hur ser din drömresa ut

- How To

- Men

- hr

- html

- HTTPS

- Nav

- Hundratals

- häck

- Inställning av hyperparameter

- Tanken

- idéer

- identifiera

- identifiera

- Identitet

- if

- bild

- enorma

- Inverkan

- effektfull

- Konsekvenser

- genomföra

- genomförande

- med Esport

- förbättra

- förbättras

- förbättrar

- förbättra

- in

- felaktig

- Inklusive

- oberoende av

- pekar på

- industrin

- industristandarder

- informationen

- Infrastruktur

- Innovation

- innovationer

- ingång

- insikter

- inspirerar

- Institute

- instruktioner

- integrera

- Integrera

- integrering

- avsedd

- interagera

- intresse

- intressant

- Gränssnitt

- inre

- Internet

- samverka

- in

- introducerade

- lager

- investera

- investering

- engagera

- involverade

- innebär

- isolerat

- problem

- IT

- DESS

- sammanfogning

- bara

- Angelägen

- Nyckel

- nycklar

- kunskap

- Kunskap Diagram

- vet

- Labs

- Brist

- språk

- Språk

- Large

- större

- skikt

- leda

- ledande

- LÄRA SIG

- lärt

- inlärning

- Lämna

- Adress

- Lets

- LG

- tycka om

- sannolikt

- begränsningar

- Begränsad

- rader

- Lama

- Logiken

- logisk

- du letar

- Låg

- Maskinen

- maskininlärning

- Maskiner

- bibehålla

- göra

- GÖR

- Framställning

- hantera

- förvaltade

- ledning

- manuell

- många

- kartläggning

- Marknadsföring

- massiv

- massivt

- matchande

- material

- Maj..

- Media

- medicinsk

- Möt

- meta

- metod

- metoder

- kanske

- miljoner

- minimera

- ML

- modell

- modeller

- månader

- mer

- mest

- rörliga

- måste

- Natural

- nödvändigt för

- Behöver

- behövs

- behöver

- behov

- negativ

- Nya

- nästa generation

- Ingen

- nu

- of

- sänkt

- Erbjudanden

- Ofta

- on

- ONE

- endast

- Verksamhet

- möjligheter

- optimala

- optimering

- Tillbehör

- or

- orkestrering

- beställa

- ordrar

- organisation

- organisatoriska

- organisationer

- ursprungliga

- ursprungligen

- Övriga

- ut

- utfall

- föråldrad

- konturer

- utklassar

- produktion

- utgångar

- över

- övergripande

- Övervinna

- Översikt

- egen

- par

- papper

- parametrar

- särskilt

- särskilt

- passager

- Tidigare

- Utföra

- prestanda

- föreställningar

- personlig

- personlig

- fraser

- bitar

- rörledning

- planering

- Plattformar

- plato

- Platon Data Intelligence

- PlatonData

- komplott

- poäng

- Strategier

- Populära

- möjlig

- Inlägg

- inlägg

- potentiell

- potentiellt

- kraft

- drivs

- den mäktigaste

- Praktisk

- praktiken

- praxis

- föregående

- preferenser

- VD

- förebyggande

- tidigare

- pris

- prissättning

- Principal

- Innan

- privatpolicy

- Integritet och säkerhet

- privat

- Problem

- problem

- process

- bearbetning

- producera

- producerad

- producerar

- produktivitet

- Produkter

- Profil

- Programmering

- främjar

- prompter

- rätt

- ordentligt

- föreslå

- proprietary

- ge

- leverantörer

- ger

- tillhandahålla

- allmän

- publicerade

- publicerar

- dra

- inköp

- inköpsorder

- kvalitet

- sökfrågor

- fråga

- frågor

- snabbt

- trasa

- område

- snabb

- snabbt

- SÄLLSYNT

- snarare

- Raw

- RE

- Reagera

- verklig

- riktigt värde

- verkliga världen

- realtid

- data i realtid

- inse

- senaste

- erkännande

- Rekommendation

- rekommendationer

- rekommenderas

- minska

- reducerande

- hänvisa

- regelbundet

- relation

- relevans

- relevanta

- förlita

- Återstående

- anmärkningsvärd

- Rapport

- rykte

- begära

- förfrågningar

- kräver

- Obligatorisk

- Krav

- Kräver

- erforderlig

- forskning

- resurs

- Resursintensiv

- Resurser

- Svara

- respons

- svar

- REST

- Resultat

- hämtning

- avkastning

- intäkter

- Omdömen

- höger

- risker

- rutin

- Körning

- rinnande

- säkrare

- sagemaker

- Samma

- tillfredsställande

- skalbarhet

- skalbar

- Skala

- Brist

- scenario

- scenarier

- Vetenskap

- vetenskapsmän

- repa

- skript

- sömlös

- Sök

- §

- säkert

- säkerhet

- säkerhetsrisker

- vald

- väljer

- Val

- senior

- känslig

- känsla

- känslor

- Server

- serverar

- service

- Tjänster

- portion

- session

- in

- uppsättningar

- inställningar

- flera

- Forma

- delas

- Kort

- skall

- Visar

- signifikant

- signifikant

- liknande

- Enkelt

- enda

- skicklig

- färdigheter

- mindre

- So

- Social hållbarhet

- sociala medier

- Sociala medier inlägg

- enbart

- fast

- lösning

- Lösningar

- LÖSA

- Lösa

- några

- sofistikerade

- Källa

- Källor

- specialist

- specialisera

- specialiserad

- specialiserat

- specifik

- specifikt

- specificitet

- Stabilitet

- stå

- standarder

- starta

- igång

- Startups

- Stater

- Steg

- Steg

- Fortfarande

- lager

- Sluta

- lagra

- lagrar

- Upplevelser för livet

- Historia

- okomplicerad

- Strategisk

- styrkor

- stark

- struktur

- strukturerade

- strukturer

- stil

- väsentlig

- framgångsrik

- Framgångsrikt

- sådana

- tillräcklig

- föreslå

- följer

- lämplig

- Superladdning

- leverera

- stödja

- Stöder

- säker

- Symptom

- system

- System

- tackla

- skräddarsydd

- Ta

- tar

- Talang

- tala

- Talks

- Tryck

- Målet

- uppgift

- uppgifter

- grupp

- tech

- Teknisk

- tekniska förmågor

- Tekniken

- tekniker

- Tekniken

- Teknologi

- Teknisk innovation

- mall

- terminologi

- testa

- Testning

- text

- Textklassificering

- än

- den där

- Smakämnen

- den information

- deras

- Dem

- sedan

- Där.

- därför

- Dessa

- de

- tror

- tredje part

- detta

- grundlig

- grundligt

- de

- tusentals

- tre

- Genom

- tid

- tidskrävande

- till

- befogenhetsbeskrivas

- tokens

- verktyg

- verktyg

- topp

- ämne

- ämnen

- mot

- trafik

- Tåg

- tränad

- Utbildning

- transitering

- Översättning

- Öppenhet

- enorm

- trigg

- biljoner

- verkligen

- Litar

- betrodd

- trovärdig

- sanningen

- trimma

- SVÄNG

- tweaking

- två

- typiskt

- oförmögen

- förstå

- förståelse

- unika

- United

- USA

- låsa

- outnyttjad

- oönskade

- TIDSENLIG

- Uppdatering

- uppdaterad

- uppdatering

- uppgraderingar

- användning

- användningsfall

- Begagnade

- användbara

- Användare

- Användarupplevelse

- användare

- användningar

- med hjälp av

- verktyg

- BEKRÄFTA

- värde

- mängd

- olika

- Omfattande

- vastly

- mycket

- via

- syn

- visuell

- vs

- sårbarheter

- gå

- vill

- önskar

- var

- Våg

- Sätt..

- we

- svagheter

- webb

- webbservice

- veckor

- vägning

- vikt

- VÄL

- Vad

- när

- medan

- om

- som

- medan

- bred

- Brett utbud

- brett

- utbredd

- wikipedia

- kommer

- med

- inom

- utan

- Arbete

- arbetsflöde

- arbetsflöden

- arbetssätt

- skulle

- skriva

- skrivning

- skriven

- år

- Avkastning

- Om er

- Din

- zephyrnet